tfjs-wechat

tfjs-wechat 是专为微信小程序打造的 TensorFlow.js 插件,由谷歌官方支持。它成功将强大的机器学习能力引入微信生态,让开发者无需依赖云端服务器,即可在小程序端直接运行预训练的 AI 模型,实现如物体识别、图像分类等智能功能。

该工具主要解决了 JavaScript 环境下缺乏高效硬件加速推理能力,以及微信小程序原生不支持复杂机器学习库的痛点。通过封装 TensorFlow.js 核心功能并适配微信环境,它打通了从模型训练到移动端部署的最后一步。

tfjs-wechat 非常适合前端开发者、全栈工程师及 AI 应用研究者使用。只要熟悉 JavaScript 和小程序开发流程,即可快速上手构建具备本地智能交互能力的应用。

其技术亮点在于灵活的按需加载机制:针对小程序 2MB 的大小限制,开发者可仅引入必要的核心包(如 tfjs-core、converter 及 WebGL/CPU 后端),大幅减小体积。此外,它还提供了独特的本地缓存方案,支持将模型存储于 localStorage 或用户文件中,有效减少重复下载带来的带宽消耗与等待时间,同时通过 Polyfill 技术完美兼容微信的网络请求环境,确保模型加载流畅稳定。

使用场景

一家生鲜电商团队希望在微信小程序中实现“拍照识菜”功能,让用户拍摄蔬菜即可识别品种并推荐食谱。

没有 tfjs-wechat 时

- 无法本地运行模型:小程序环境不支持原生 TensorFlow.js,必须将图片上传至云端服务器进行识别,导致用户等待时间长。

- 隐私与合规风险:用户上传的食材照片需传输到第三方服务器,存在隐私泄露隐患,且增加了数据合规成本。

- 服务器成本高昂:高并发下的图像推理需要昂贵的 GPU 服务器集群支撑,运维压力大且响应速度受网络波动影响明显。

- 开发适配复杂:开发者需自行编写复杂的底层代码来桥接微信环境与 JS 机器学习库,甚至需要绕过小程序对 WebGL 的限制。

使用 tfjs-wechat 后

- 端侧实时推理:通过插件直接调用手机 GPU 加速,在用户手机端毫秒级完成物体识别,无需上传图片,体验流畅。

- 数据隐私安全:所有计算均在本地完成,图片不出设备,彻底消除了数据传输过程中的隐私泄露风险。

- 大幅降低成本:移除了后端推理服务器需求,仅依靠用户手机算力,显著节省了带宽和云计算资源开支。

- 开箱即用集成:只需在后台添加插件并配置少量代码(如注入 fetch polyfill 和 WebGL 后端),即可快速加载 MobileNet 等预训练模型。

tfjs-wechat 让高性能的浏览器端机器学习能力无缝落地微信小程序,实现了低成本、高隐私的智能化交互升级。

运行环境要求

- 未说明 (基于微信小程序平台,支持 iOS 和 Android)

- 非必需

- 默认使用 WebGL 后端(依赖手机 GPU),在中低端 Android 设备上可切换至 WASM 后端(运行于 CPU)

- 无需特定显卡型号或 CUDA 版本

未说明 (受限于微信小程序整体包大小限制及 localStorage/本地文件 10MB 缓存限制)

快速开始

TensorFlow.js 微信小程序插件

TensorFlow.js是谷歌开发的机器学习开源项目,致力于为javascript提供具有硬件加速的机器学习模型训练和部署。 TensorFlow.js 微信小程序插件封装了TensorFlow.js库,用于提供给第三方小程序调用。 例子可以看TFJS Mobilenet 物体识别小程序

添加插件

在使用插件前,首先要在小程序管理后台的“设置-第三方服务-插件管理”中添加插件。开发者可登录小程序管理后台,通过 appid [wx6afed118d9e81df9] 查找插件并添加。本插件无需申请,添加后可直接使用。

引入插件代码包

使用插件前,使用者要在 app.json 中声明需要使用的插件,例如:

代码示例:

{

...

"plugins": {

"tfjsPlugin": {

"version": "0.0.6",

"provider": "wx6afed118d9e81df9"

}

}

...

}

引入TensorFlow.js npm

TensorFlow.js 最新版本是以npm包的形式发布,小程序需要使用npm或者yarn来载入TensorFlow.js npm包。也可以手动修改 package.json 文件来加入。

TensorFlow.js v2.0 有一个联合包 - @tensorflow/tfjs,包含了六个分npm包:

- tfjs-core: 基础包

- tfjs-converter: GraphModel 导入和执行包

- tfjs-layers: LayersModel 创建,导入和执行包

- tfjs-backend-webgl: webgl 后端

- tfjs-backend-cpu: cpu 后端

- tfjs-data:数据流

对于小程序而言,由于有2M的app大小限制,不建议直接使用联合包,而是按照需求加载分包。

- 如果小程序只需要导入和运行GraphModel模型的的话,建议至少加入tfjs-core, tfjs-converter, tfjs-backend-webgl 和tfjs-backend-cpu包。这样可以尽量减少导入包的大小。

- 如果需要创建,导入或训练LayersModel模型,需要再加入 tfjs-layers包。

下面的例子是只用到tfjs-core, tfjs-converter,tfjs-backend-webgl 和tfjs-backend-cpu包。代码示例:

{

"name": "yourProject",

"version": "0.0.1",

"main": "dist/index.js",

"license": "Apache-2.0",

"dependencies": {

"@tensorflow/tfjs-core": "3.5.0",

"@tensorflow/tfjs-converter": "3.5.0",

"@tensorflow/tfjs-backend-webgl": "3.5.0"

}

}

参考小程序npm工具文档如何编译npm包到小程序中。

注意 请从微信小程序开发版Nightly Build更新日志下载最新的微信开发者工具,保证版本号>=v1.02.1907022.

Polyfill fetch 函数

如果需要使用tf.loadGraphModel或tf.loadLayersModel API来载入模型,小程序需要按以下流程填充fetch函数:

- 如果你使用npm, 你可以载入fetch-wechat npm 包

{

"name": "yourProject",

"version": "0.0.1",

"main": "dist/index.js",

"license": "Apache-2.0",

"dependencies": {

"@tensorflow/tfjs-core": "3.5.0",

"@tensorflow/tfjs-converter": "3.5.0",

"@tensorflow/tfjs-backend-webgl": "3.5.0"

"fetch-wechat": "0.0.3"

}

}

- 也可以直接拷贝以下文件到你的javascript源目录: https://cdn.jsdelivr.net/npm/fetch-wechat@0.0.3/dist/fetch_wechat.min.js

在app.js的onLaunch里调用插件configPlugin函数

var fetchWechat = require('fetch-wechat');

var tf = require('@tensorflow/tfjs-core');

var webgl = require('@tensorflow/tfjs-backend-webgl');

var plugin = requirePlugin('tfjsPlugin');

//app.js

App({

onLaunch: function () {

plugin.configPlugin({

// polyfill fetch function

fetchFunc: fetchWechat.fetchFunc(),

// inject tfjs runtime

tf,

// inject webgl backend

webgl,

// provide webgl canvas

canvas: wx.createOffscreenCanvas()

});

}

});

支持模型localStorage缓存

采用localStorage缓存可以减少模型下载耗费带宽和时间。由于微信小程序对于localStorage有10MB的限制,这个方法适用于小于10MB的模型。 步骤如下:

- 在app.js中提供localStorageHandler函数.

var fetchWechat = require('fetch-wechat');

var tf = require('@tensorflow/tfjs-core');

var plugin = requirePlugin('tfjsPlugin');

//app.js

App({

// expose localStorage handler

globalData: {localStorageIO: plugin.localStorageIO},

...

});

- 在模型加载时加入localStorageHandler逻辑。

const LOCAL_STORAGE_KEY = 'mobilenet_model';

export class MobileNet {

private model: tfc.GraphModel;

constructor() { }

async load() {

const localStorageHandler = getApp().globalData.localStorageIO(LOCAL_STORAGE_KEY);

try {

this.model = await tfc.loadGraphModel(localStorageHandler);

} catch (e) {

this.model =

await tfc.loadGraphModel(MODEL_URL);

this.model.save(localStorageHandler);

}

}

支持模型保存为用户文件

微信也支持保存模型为文件。同localStorage, 微信小程序对于本地文件也有10MB的限制,这个方法适用于小于10MB的模型。由于最终模型是按 binary 保存,较 localstorage 保存为 base64 string 更为节省空间。

步骤如下:

- 在app.js中提供 fileStorageHandler 函数.

var fetchWechat = require('fetch-wechat');

var tf = require('@tensorflow/tfjs-core');

var plugin = requirePlugin('tfjsPlugin');

//app.js

App({

// expose fileStorage handler

globalData: {fileStorageIO: plugin.fileStorageIO},

...

});

- 在模型加载时加入 fileStorageHandler 逻辑。

const FILE_STORAGE_PATH = 'mobilenet_model';

export class MobileNet {

private model: tfc.GraphModel;

constructor() { }

async load() {

const fileStorageHandler =.getApp().globalData.fileStorageIO(

FILE_STORAGE_PATH, wx.getFileSystemManager());

try {

this.model = await tfc.loadGraphModel(fileStorageHandler);

} catch (e) {

this.model =

await tfc.loadGraphModel(MODEL_URL);

this.model.save(fileStorageHandler);

}

}

}

使用 WebAssembly backend

微信小程序在 Android 手机上提供 WebAssembly的支持。TensorFlow.js的WASM backend非常适合在中低端Android手机上使用。 中低端手机的GPU往往相对CPU要弱一些,而WASM backend是跑在CPU上的,这就为中低端手机提供了另一个加速平台。而且WASM的能耗一般会更低。 使用WASM backend需要修改package.json文件:

{

"name": "yourProject",

"version": "0.0.1",

"main": "dist/index.js",

"license": "Apache-2.0",

"dependencies": {

"@tensorflow/tfjs-core": "2.0.0",

"@tensorflow/tfjs-converter": "2.0.0",

"@tensorflow/tfjs-backend-wasm": "2.0.0",

...

}

}

然后在app.js中设置 wasm backend, 你可以自行host wasm file以提高下载速度, 下面例子中的 wasmUrl可以替代成你host的URL。

const info = wx.getSystemInfoSync();

const wasmUrl = 'https://cdn.jsdelivr.net/npm/@tensorflow/tfjs-backend-wasm@2.0.0/wasm-out/tfjs-backend-wasm.wasm';

const usePlatformFetch = true;

console.log(info.platform);

if (info.platform == 'android') {

setWasmPath(wasmUrl, usePlatformFetch);

tf.setBackend('wasm').then(() => console.log('set wasm backend'));

}

注意 WASM backend is broken due to bundle imcompatible with WeChat npm loader, will update here when it is fixed.

注意 由于最新版本的WeChat的OffscreenCanvas会随页面跳转而失效,在app.js的 onLaunch 函数中设置 tfjs 会导致小程序退出或页面跳转之后操作出错。建议在使用tfjs的page的onLoad中调用 configPlugin 函数。 WeChat的12月版本会修复这个问题。

var fetchWechat = require('fetch-wechat');

var tf = require('@tensorflow/tfjs-core');

var plugin = requirePlugin('tfjsPlugin');

//index.js

Page({

onLoad: function () {

plugin.configPlugin({

// polyfill fetch function

fetchFunc: fetchWechat.fetchFunc(),

// inject tfjs runtime

tf,

// provide webgl canvas

canvas: wx.createOffscreenCanvas(),

backendName: 'wechat-webgl-' + Date.now()

});

...

}

});

组件设置完毕就可以开始使用 TensorFlow.js库的API了。

使用 tfjs-models 模型库注意事项

模型库提供了一系列训练好的模型,方便大家快速的给小程序注入ML功能。模型分类包括

- 图像识别

- 语音识别

- 人体姿态识别

- 物体识别

- 文字分类

由于这些API默认模型文件都存储在谷歌云上,直接使用会导致中国用户无法直接读取。在小程序内使用模型API时要提供 modelUrl 的参数,可以指向我们在谷歌中国的镜像服务器。 谷歌云的base url是 https://storage.googleapis.com, 中国镜像的base url是https://www.gstaticcnapps.cn 模型的url path是一致的,比如

- posenet模型的谷歌云地址是: https://storage.googleapis.com/tfjs-models/savedmodel/posenet/mobilenet/float/050/model-stride16.json

- 中国镜像的地址为 https://www.gstaticcnapps.cn/tfjs-models/savedmodel/posenet/mobilenet/float/050/model-stride16.json

他们的 URL Path 都是 /tfjs-models/savedmodel/posenet/mobilenet/float/050/model-stride16.json

下面是加载posenet模型的例子:

import * as posenet from '@tensorflow-models/posenet';

const POSENET_URL =

'https://www.gstaticcnapps.cn/tfjs-models/savedmodel/posenet/mobilenet/float/050/model-stride16.json';

const model = await posenet.load({

architecture: 'MobileNetV1',

outputStride: 16,

inputResolution: 193,

multiplier: 0.5,

modelUrl: POSENET_URL

});

tfjs-examples tfjs例子库

tfjs API 使用实例。

版本需求

- 微信基础库版本 >= 2.7.3

- 微信开发者工具 >= v1.02.1907022

- tfjs-core >= 1.5.2

- tfjs-converter >= 1.5.2 如果使用localStorage模型缓存

注意

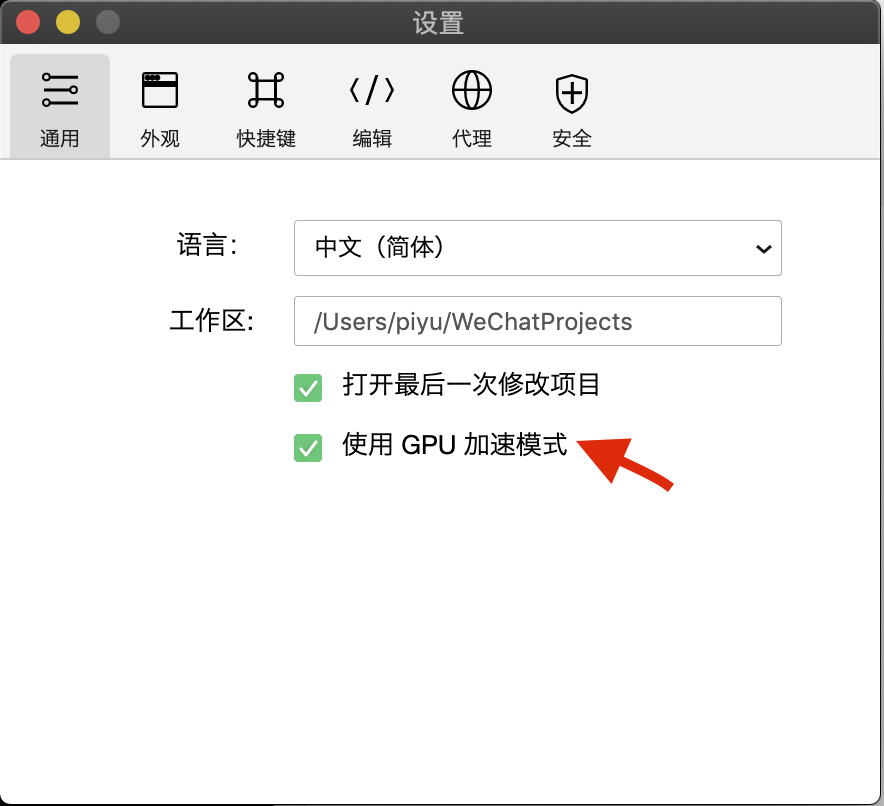

在微信开发者工具 v1.02.19070300 中,你需要在通用设置中打开硬件加速,从而在TensorFlow.js中启用WebGL加速。

更新说明

- 0.0.2 plugin不再映射TensorFlow.js API库,由小程序端提供。

- 0.0.3 使用offscreen canvas,小程序无需加入plugin component。

- 0.0.5 修改例子程序使用tfjs分包来降低小程序大小。

- 0.0.6 支持 tfjs-core版本1.2.7。

- 0.0.7 允许用户设置webgl backend name, 这可以解决小程序offscreen canvas会失效的问题。

- 0.0.8 加入localStorage支持,允许小于10M模型在localStorage内缓存。

- 0.0.9 加入fileSystem支持,允许小于10M模型在local file system内缓存。fixed missing kernel bug.

- 0.1.0 支持 tfjs版本2.0.x。

- 0.2.0 支持 tfjs版本3.x。

常见问题

相似工具推荐

openclaw

OpenClaw 是一款专为个人打造的本地化 AI 助手,旨在让你在自己的设备上拥有完全可控的智能伙伴。它打破了传统 AI 助手局限于特定网页或应用的束缚,能够直接接入你日常使用的各类通讯渠道,包括微信、WhatsApp、Telegram、Discord、iMessage 等数十种平台。无论你在哪个聊天软件中发送消息,OpenClaw 都能即时响应,甚至支持在 macOS、iOS 和 Android 设备上进行语音交互,并提供实时的画布渲染功能供你操控。 这款工具主要解决了用户对数据隐私、响应速度以及“始终在线”体验的需求。通过将 AI 部署在本地,用户无需依赖云端服务即可享受快速、私密的智能辅助,真正实现了“你的数据,你做主”。其独特的技术亮点在于强大的网关架构,将控制平面与核心助手分离,确保跨平台通信的流畅性与扩展性。 OpenClaw 非常适合希望构建个性化工作流的技术爱好者、开发者,以及注重隐私保护且不愿被单一生态绑定的普通用户。只要具备基础的终端操作能力(支持 macOS、Linux 及 Windows WSL2),即可通过简单的命令行引导完成部署。如果你渴望拥有一个懂你

n8n

n8n 是一款面向技术团队的公平代码(fair-code)工作流自动化平台,旨在让用户在享受低代码快速构建便利的同时,保留编写自定义代码的灵活性。它主要解决了传统自动化工具要么过于封闭难以扩展、要么完全依赖手写代码效率低下的痛点,帮助用户轻松连接 400 多种应用与服务,实现复杂业务流程的自动化。 n8n 特别适合开发者、工程师以及具备一定技术背景的业务人员使用。其核心亮点在于“按需编码”:既可以通过直观的可视化界面拖拽节点搭建流程,也能随时插入 JavaScript 或 Python 代码、调用 npm 包来处理复杂逻辑。此外,n8n 原生集成了基于 LangChain 的 AI 能力,支持用户利用自有数据和模型构建智能体工作流。在部署方面,n8n 提供极高的自由度,支持完全自托管以保障数据隐私和控制权,也提供云端服务选项。凭借活跃的社区生态和数百个现成模板,n8n 让构建强大且可控的自动化系统变得简单高效。

AutoGPT

AutoGPT 是一个旨在让每个人都能轻松使用和构建 AI 的强大平台,核心功能是帮助用户创建、部署和管理能够自动执行复杂任务的连续型 AI 智能体。它解决了传统 AI 应用中需要频繁人工干预、难以自动化长流程工作的痛点,让用户只需设定目标,AI 即可自主规划步骤、调用工具并持续运行直至完成任务。 无论是开发者、研究人员,还是希望提升工作效率的普通用户,都能从 AutoGPT 中受益。开发者可利用其低代码界面快速定制专属智能体;研究人员能基于开源架构探索多智能体协作机制;而非技术背景用户也可直接选用预置的智能体模板,立即投入实际工作场景。 AutoGPT 的技术亮点在于其模块化“积木式”工作流设计——用户通过连接功能块即可构建复杂逻辑,每个块负责单一动作,灵活且易于调试。同时,平台支持本地自托管与云端部署两种模式,兼顾数据隐私与使用便捷性。配合完善的文档和一键安装脚本,即使是初次接触的用户也能在几分钟内启动自己的第一个 AI 智能体。AutoGPT 正致力于降低 AI 应用门槛,让人人都能成为 AI 的创造者与受益者。

stable-diffusion-webui

stable-diffusion-webui 是一个基于 Gradio 构建的网页版操作界面,旨在让用户能够轻松地在本地运行和使用强大的 Stable Diffusion 图像生成模型。它解决了原始模型依赖命令行、操作门槛高且功能分散的痛点,将复杂的 AI 绘图流程整合进一个直观易用的图形化平台。 无论是希望快速上手的普通创作者、需要精细控制画面细节的设计师,还是想要深入探索模型潜力的开发者与研究人员,都能从中获益。其核心亮点在于极高的功能丰富度:不仅支持文生图、图生图、局部重绘(Inpainting)和外绘(Outpainting)等基础模式,还独创了注意力机制调整、提示词矩阵、负向提示词以及“高清修复”等高级功能。此外,它内置了 GFPGAN 和 CodeFormer 等人脸修复工具,支持多种神经网络放大算法,并允许用户通过插件系统无限扩展能力。即使是显存有限的设备,stable-diffusion-webui 也提供了相应的优化选项,让高质量的 AI 艺术创作变得触手可及。

everything-claude-code

everything-claude-code 是一套专为 AI 编程助手(如 Claude Code、Codex、Cursor 等)打造的高性能优化系统。它不仅仅是一组配置文件,而是一个经过长期实战打磨的完整框架,旨在解决 AI 代理在实际开发中面临的效率低下、记忆丢失、安全隐患及缺乏持续学习能力等核心痛点。 通过引入技能模块化、直觉增强、记忆持久化机制以及内置的安全扫描功能,everything-claude-code 能显著提升 AI 在复杂任务中的表现,帮助开发者构建更稳定、更智能的生产级 AI 代理。其独特的“研究优先”开发理念和针对 Token 消耗的优化策略,使得模型响应更快、成本更低,同时有效防御潜在的攻击向量。 这套工具特别适合软件开发者、AI 研究人员以及希望深度定制 AI 工作流的技术团队使用。无论您是在构建大型代码库,还是需要 AI 协助进行安全审计与自动化测试,everything-claude-code 都能提供强大的底层支持。作为一个曾荣获 Anthropic 黑客大奖的开源项目,它融合了多语言支持与丰富的实战钩子(hooks),让 AI 真正成长为懂上

opencode

OpenCode 是一款开源的 AI 编程助手(Coding Agent),旨在像一位智能搭档一样融入您的开发流程。它不仅仅是一个代码补全插件,而是一个能够理解项目上下文、自主规划任务并执行复杂编码操作的智能体。无论是生成全新功能、重构现有代码,还是排查难以定位的 Bug,OpenCode 都能通过自然语言交互高效完成,显著减少开发者在重复性劳动和上下文切换上的时间消耗。 这款工具专为软件开发者、工程师及技术研究人员设计,特别适合希望利用大模型能力来提升编码效率、加速原型开发或处理遗留代码维护的专业人群。其核心亮点在于完全开源的架构,这意味着用户可以审查代码逻辑、自定义行为策略,甚至私有化部署以保障数据安全,彻底打破了传统闭源 AI 助手的“黑盒”限制。 在技术体验上,OpenCode 提供了灵活的终端界面(Terminal UI)和正在测试中的桌面应用程序,支持 macOS、Windows 及 Linux 全平台。它兼容多种包管理工具,安装便捷,并能无缝集成到现有的开发环境中。无论您是追求极致控制权的资深极客,还是渴望提升产出的独立开发者,OpenCode 都提供了一个透明、可信