paperai

paperai 是一款专为医学和科学论文打造的 AI 应用,旨在利用人工智能技术大幅提升科研效率。面对海量的学术文献,研究人员往往需要耗费大量时间阅读和整理信息,而 paperai 通过自动化流程解决了这一痛点。它能够遍历本地或远程的论文仓库,针对用户提出的具体问题,批量生成有据可查的回答和深度研究报告。

这款工具特别适合医学研究者、科学家以及需要处理大量文献的数据分析师使用。其核心技术亮点在于结合了大型语言模型(LLM)与检索增强生成(RAG)管道。这意味着它不仅能理解复杂的学术问题,还能精准地从原始论文中检索相关片段作为依据,确保生成的答案准确可靠,有效避免了大模型常见的“幻觉”问题。此外,paperai 支持高度定制化的配置文件,允许用户一次性发起数百个查询任务,实现高性能的批量推理。最终成果可灵活输出为 Markdown、CSV 格式,甚至能直接在 PDF 原文上进行标注。无论是构建个人知识库还是进行大规模文献综述,paperai 都能成为得力的科研助手。

使用场景

某生物医药公司的研发分析师正面临紧急任务,需要在 48 小时内从上千篇最新的肿瘤免疫疗法论文中,梳理出特定靶点的临床实验数据并撰写综述报告。

没有 paperai 时

- 分析师需人工逐篇下载 PDF,肉眼筛选与目标靶点相关的段落,耗时极长且容易遗漏关键文献。

- 阅读过程中需手动摘录数据到 Excel,不仅效率低下,还常因疲劳导致数据转录错误或格式不统一。

- 面对海量专业术语和复杂句式,非本细分领域的专家难以快速抓住每篇文章的核心结论,理解成本极高。

- 最终报告生成缓慢,无法在紧迫的决策窗口期内提供足够的数据支撑,影响新药立项进度。

使用 paperai 后

- paperai 自动遍历本地或云端的海量论文库,利用 RAG 技术精准定位所有提及该靶点的章节,瞬间完成初筛。

- 通过预设的批量 LLM 提示词,paperai 直接提取结构化数据并生成 CSV 报表,同时支持在原始 PDF 上自动标注答案来源,确保数据可追溯。

- 借助大模型的专业理解能力,paperai 能准确概括复杂的医学结论,将晦涩的学术语言转化为清晰的要点摘要。

- 系统一键生成包含引用来源的 Markdown 综述草稿,将原本数周的工作压缩至几小时,让团队能迅速基于最新证据做出决策。

paperai 通过将检索、阅读、提取和写作全流程自动化,把研究人员从繁琐的文献搬运工作中解放出来,使其专注于高价值的科学洞察。

运行环境要求

- Linux

- macOS

- Windows

未说明 (取决于所选 LLM 模型,若运行本地量化模型如 GGUF 则非必需,若运行全精度模型则需高性能 GPU)

未说明 (建议根据处理的论文数据量和加载的 LLM 模型大小调整,通常推荐 16GB+)

快速开始

面向医学和科学论文的AI

paperai 是一款用于医学和科学论文的AI应用。

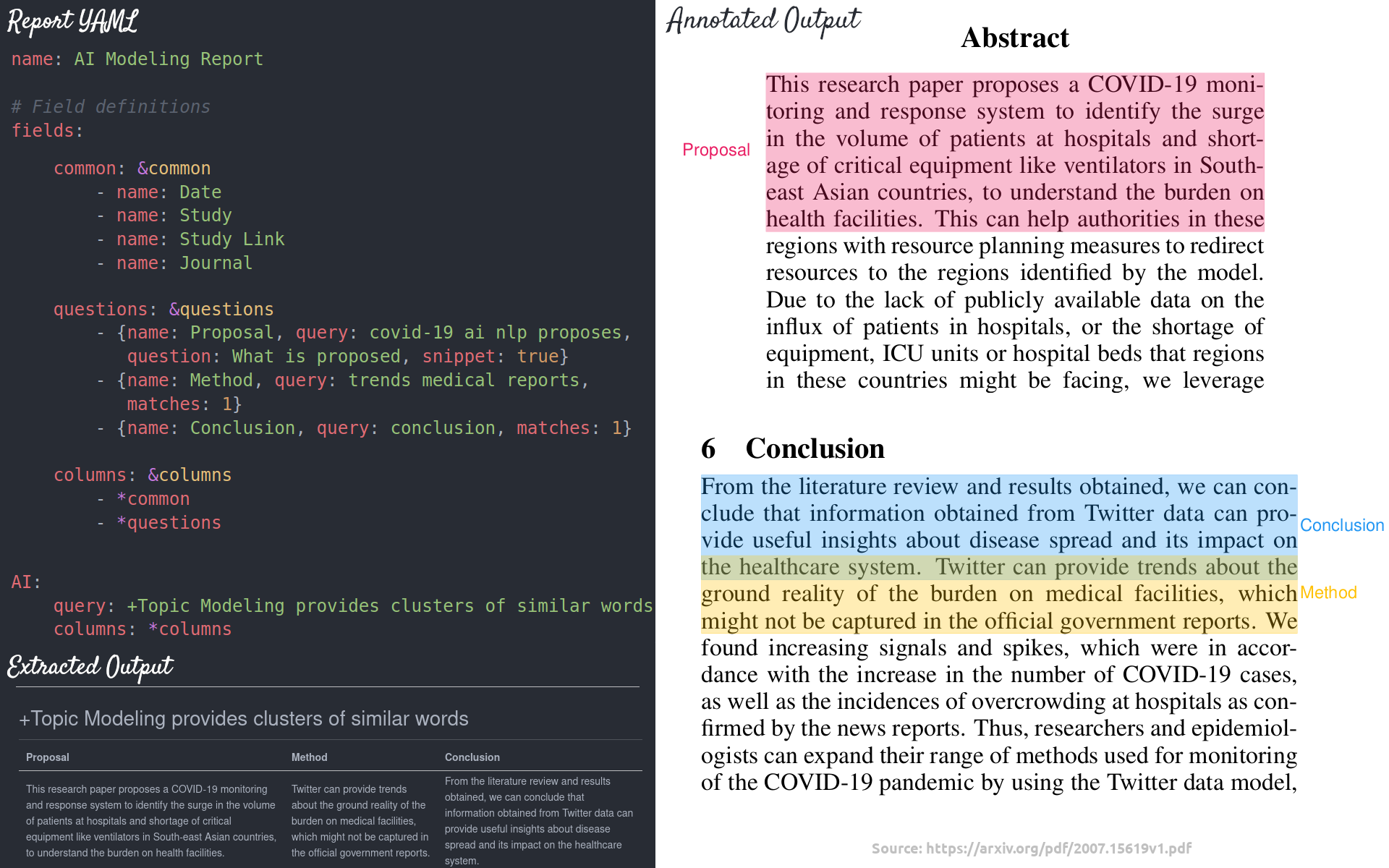

⚡ 通过AI驱动的报告生成,为研究任务注入强大动力。paperai 应用会遍历文章库,并基于大型语言模型(LLM)提示和检索增强生成(RAG)流程,批量生成对问题的回答。

借助 paperai 的配置文件,可以高效地执行大规模的 LLM 推理操作。这就好比在您的数据上同时启动数百个 ChatGPT 提示。

paperai 可以生成 Markdown、CSV 格式的报告,并在 PDF 文件上直接标注答案(如适用)。

安装

最简单的安装方式是通过 pip 和 PyPI:

pip install paperai

支持 Python 3.10 及以上版本。建议使用 Python 虚拟环境。

您也可以直接从 GitHub 安装 paperai 来获取最新的未发布功能:

pip install git+https://github.com/neuml/paperai

请参阅此链接,以帮助解决特定环境下的安装问题。

Docker

按照以下步骤构建包含 paperai 及所有依赖项的 Docker 镜像:

wget https://raw.githubusercontent.com/neuml/paperai/master/docker/Dockerfile

docker build -t paperai .

docker run --name paperai --rm -it paperai

还可以加入 paperetl,以便在一个镜像中完成内容的索引和查询。请遵循说明构建 paperetl Docker 镜像,然后运行以下命令:

docker build -t paperai --build-arg BASE_IMAGE=paperetl --build-arg START=/scripts/start.sh .

docker run --name paperai --rm -it paperai

示例

以下笔记本和应用程序展示了 paperai 提供的功能。

笔记本

| 笔记本 | 描述 | |

|---|---|---|

| 介绍 paperai | paperai 功能概览 | |

| 医学研究项目 | 研究年轻发病结肠癌 |

应用程序

| 应用程序 | 描述 |

|---|---|

| 搜索 | 搜索 paperai 索引。设置查询参数、执行搜索并显示结果。 |

构建模型

paperai 会索引先前使用 paperetl 构建的数据库。以下是创建新 paperai 索引的方法。

(可选)创建 index.yml 文件

如果未指定,

paperai将使用默认的 txtai 嵌入配置。或者,您可以指定一个 index.yml 文件,其中包含与 txtai 嵌入实例相同的选项。有关可能选项的更多信息,请参阅 txtai 文档。下面是一个简单示例:path: sentence-transformers/all-MiniLM-L6-v2 content: True构建嵌入索引

python -m paperai.index <输入数据路径 > < 可选索引配置 >paperai.index 过程需要输入数据路径,并可选择性地接受索引配置。该配置可以是向量模型路径,也可以是 index.yml 配置文件。

执行查询

执行查询的最快方式是启动一个 paperai shell:

paperai <模型目录路径>

随后会出现提示符。您可以直接在控制台中输入查询。

报表架构

以下步骤将逐步介绍一个 paperai 报表配置文件,并对每个部分进行说明。

name: ColonCancer

options:

llm: Intelligent-Internet/II-Medical-8B-1706-GGUF/II-Medical-8B-1706.Q4_K_M.gguf

system: 你是一名医学文献解析器。你负责从数据中提取字段。

template: |

请根据提供的规则和上下文,快速提取以下字段。

规则:

- 简单明了,不要过度思考

- 只提取数据

- 绝不解释为何提取该字段

- 绝不重复字段名称,只给出字段值

- 如果在上下文中找不到该字段,则回答“无数据”

字段:

{question}

上下文:

{context}

context: 5

params:

maxlength: 4096

stripthink: True

Research:

query: colon cancer young adults

columns:

- name: Date

- name: Study

- name: Study Link

- name: Journal

- {name: Sample Size, query: number of patients, question: Sample Size}

- {name: Objective, query: objective, question: Study Objective}

- {name: Causes, query: possible causes, question: List of possible causes}

- {name: Detection, query: diagnosis, question: List of ways to diagnose}

配置

以下是顶级配置选项的说明。

| 字段 | 描述 |

|---|---|

| name | 报表名称 |

| options | RAG 流水线选项 - 设置 LLM、提示模板、最大长度等 |

| report | 每个唯一的顶级参数都会设置报表名称。在上面的例子中,它被称为 Research |

| query | 用于识别前 n 篇文档的向量查询 |

| columns | 列表 |

标准列

标准列使用文章数据存储元数据,直接将字段复制到报表中。将列的 name 设置为以下值之一。

| 字段 | 描述 |

|---|---|

| Id | 文章唯一标识符 |

| Date | 文章发表日期 |

| Study | 文章标题 |

| Study Link | 文章的 HTTP 链接 |

| Journal | 出版物名称 |

| Source | 数据源名称 |

| Entry | 文章录入日期 |

| Matches | 导致该文章匹配报表查询的章节 |

生成列

paperai 最具创新性的功能是能够通过 RAG 流水线生成动态列。每个字段需要以下参数。

| 参数 | 描述 |

|---|---|

| name | 列名 |

| query | 搜索/相似度查询 |

| question | LLM 的问题参数 |

对于每篇匹配的文章,query 会根据与该查询的相关性对各章节进行排序。这可以是向量查询、关键词查询或混合查询。具体由嵌入索引配置控制。question 会与查询中排名靠前的 n 个上下文元素一起插入到 RAG 流水线模板中。生成的列将以 name 的形式存储在报表输出中。

构建报表文件

报表可以生成多种格式的输出。以下是一个报表调用示例:

python -m paperai.report crc.yml 10 csv <模型目录路径>

在上面的例子中,将创建一个名为 Research.csv 的文件,其中包含最相关的前 10 篇文章。

支持的报表格式如下:

- Markdown(默认) - 渲染 Markdown 报表。从文章中提取列和答案,并将结果存储在 Markdown 文件中。

- CSV - 渲染 CSV 报表。从文章中提取列和答案,并将结果存储在 CSV 文件中。

- 注释 - 从文章中提取列和答案,并将结果注释在原始 PDF 文件上。需要传入包含原始 PDF 文件的路径。

有关报表示例,请参阅 examples 目录。更多历史报表配置文件可在 这里 找到。

技术概述

paperai 是由 txtai 嵌入索引、包含文章的 SQLite 数据库以及 LLM 组成的组合。这些组件通过 txtai RAG 流水线 结合在一起。

每篇文章会被解析成多个章节,并连同文章元数据一起存储在数据存储中。整个语料库会构建嵌入。LLM 会分析受限于上下文的请求并生成输出。

有多个入口点可以与模型交互。

- paperai.report - 为一系列查询构建报表。对于每个查询,都会显示得分最高的文章及其匹配内容。还有一个亮点部分,展示最相关的结果。

- paperai.query - 从终端运行单个查询

- paperai.shell - 允许从终端运行多个查询

认可

paperai 和/或 NeuML 已在以下文章中被提及。

版本历史

v2.5.02025/07/01v2.4.02025/06/23v2.3.02024/12/28v2.2.12023/09/18v2.2.02023/09/18v2.1.02023/01/20v2.0.02022/03/12v1.10.02021/09/10v1.9.02021/08/18v1.8.02021/04/23v1.7.02021/02/24v1.6.02021/01/13v1.5.02020/12/11v1.4.02020/11/06v1.3.02020/08/18v1.2.12020/08/12v1.2.02020/08/11v1.1.02020/08/05v1.0.02020/07/21常见问题

相似工具推荐

openclaw

OpenClaw 是一款专为个人打造的本地化 AI 助手,旨在让你在自己的设备上拥有完全可控的智能伙伴。它打破了传统 AI 助手局限于特定网页或应用的束缚,能够直接接入你日常使用的各类通讯渠道,包括微信、WhatsApp、Telegram、Discord、iMessage 等数十种平台。无论你在哪个聊天软件中发送消息,OpenClaw 都能即时响应,甚至支持在 macOS、iOS 和 Android 设备上进行语音交互,并提供实时的画布渲染功能供你操控。 这款工具主要解决了用户对数据隐私、响应速度以及“始终在线”体验的需求。通过将 AI 部署在本地,用户无需依赖云端服务即可享受快速、私密的智能辅助,真正实现了“你的数据,你做主”。其独特的技术亮点在于强大的网关架构,将控制平面与核心助手分离,确保跨平台通信的流畅性与扩展性。 OpenClaw 非常适合希望构建个性化工作流的技术爱好者、开发者,以及注重隐私保护且不愿被单一生态绑定的普通用户。只要具备基础的终端操作能力(支持 macOS、Linux 及 Windows WSL2),即可通过简单的命令行引导完成部署。如果你渴望拥有一个懂你

n8n

n8n 是一款面向技术团队的公平代码(fair-code)工作流自动化平台,旨在让用户在享受低代码快速构建便利的同时,保留编写自定义代码的灵活性。它主要解决了传统自动化工具要么过于封闭难以扩展、要么完全依赖手写代码效率低下的痛点,帮助用户轻松连接 400 多种应用与服务,实现复杂业务流程的自动化。 n8n 特别适合开发者、工程师以及具备一定技术背景的业务人员使用。其核心亮点在于“按需编码”:既可以通过直观的可视化界面拖拽节点搭建流程,也能随时插入 JavaScript 或 Python 代码、调用 npm 包来处理复杂逻辑。此外,n8n 原生集成了基于 LangChain 的 AI 能力,支持用户利用自有数据和模型构建智能体工作流。在部署方面,n8n 提供极高的自由度,支持完全自托管以保障数据隐私和控制权,也提供云端服务选项。凭借活跃的社区生态和数百个现成模板,n8n 让构建强大且可控的自动化系统变得简单高效。

AutoGPT

AutoGPT 是一个旨在让每个人都能轻松使用和构建 AI 的强大平台,核心功能是帮助用户创建、部署和管理能够自动执行复杂任务的连续型 AI 智能体。它解决了传统 AI 应用中需要频繁人工干预、难以自动化长流程工作的痛点,让用户只需设定目标,AI 即可自主规划步骤、调用工具并持续运行直至完成任务。 无论是开发者、研究人员,还是希望提升工作效率的普通用户,都能从 AutoGPT 中受益。开发者可利用其低代码界面快速定制专属智能体;研究人员能基于开源架构探索多智能体协作机制;而非技术背景用户也可直接选用预置的智能体模板,立即投入实际工作场景。 AutoGPT 的技术亮点在于其模块化“积木式”工作流设计——用户通过连接功能块即可构建复杂逻辑,每个块负责单一动作,灵活且易于调试。同时,平台支持本地自托管与云端部署两种模式,兼顾数据隐私与使用便捷性。配合完善的文档和一键安装脚本,即使是初次接触的用户也能在几分钟内启动自己的第一个 AI 智能体。AutoGPT 正致力于降低 AI 应用门槛,让人人都能成为 AI 的创造者与受益者。

stable-diffusion-webui

stable-diffusion-webui 是一个基于 Gradio 构建的网页版操作界面,旨在让用户能够轻松地在本地运行和使用强大的 Stable Diffusion 图像生成模型。它解决了原始模型依赖命令行、操作门槛高且功能分散的痛点,将复杂的 AI 绘图流程整合进一个直观易用的图形化平台。 无论是希望快速上手的普通创作者、需要精细控制画面细节的设计师,还是想要深入探索模型潜力的开发者与研究人员,都能从中获益。其核心亮点在于极高的功能丰富度:不仅支持文生图、图生图、局部重绘(Inpainting)和外绘(Outpainting)等基础模式,还独创了注意力机制调整、提示词矩阵、负向提示词以及“高清修复”等高级功能。此外,它内置了 GFPGAN 和 CodeFormer 等人脸修复工具,支持多种神经网络放大算法,并允许用户通过插件系统无限扩展能力。即使是显存有限的设备,stable-diffusion-webui 也提供了相应的优化选项,让高质量的 AI 艺术创作变得触手可及。

everything-claude-code

everything-claude-code 是一套专为 AI 编程助手(如 Claude Code、Codex、Cursor 等)打造的高性能优化系统。它不仅仅是一组配置文件,而是一个经过长期实战打磨的完整框架,旨在解决 AI 代理在实际开发中面临的效率低下、记忆丢失、安全隐患及缺乏持续学习能力等核心痛点。 通过引入技能模块化、直觉增强、记忆持久化机制以及内置的安全扫描功能,everything-claude-code 能显著提升 AI 在复杂任务中的表现,帮助开发者构建更稳定、更智能的生产级 AI 代理。其独特的“研究优先”开发理念和针对 Token 消耗的优化策略,使得模型响应更快、成本更低,同时有效防御潜在的攻击向量。 这套工具特别适合软件开发者、AI 研究人员以及希望深度定制 AI 工作流的技术团队使用。无论您是在构建大型代码库,还是需要 AI 协助进行安全审计与自动化测试,everything-claude-code 都能提供强大的底层支持。作为一个曾荣获 Anthropic 黑客大奖的开源项目,它融合了多语言支持与丰富的实战钩子(hooks),让 AI 真正成长为懂上

opencode

OpenCode 是一款开源的 AI 编程助手(Coding Agent),旨在像一位智能搭档一样融入您的开发流程。它不仅仅是一个代码补全插件,而是一个能够理解项目上下文、自主规划任务并执行复杂编码操作的智能体。无论是生成全新功能、重构现有代码,还是排查难以定位的 Bug,OpenCode 都能通过自然语言交互高效完成,显著减少开发者在重复性劳动和上下文切换上的时间消耗。 这款工具专为软件开发者、工程师及技术研究人员设计,特别适合希望利用大模型能力来提升编码效率、加速原型开发或处理遗留代码维护的专业人群。其核心亮点在于完全开源的架构,这意味着用户可以审查代码逻辑、自定义行为策略,甚至私有化部署以保障数据安全,彻底打破了传统闭源 AI 助手的“黑盒”限制。 在技术体验上,OpenCode 提供了灵活的终端界面(Terminal UI)和正在测试中的桌面应用程序,支持 macOS、Windows 及 Linux 全平台。它兼容多种包管理工具,安装便捷,并能无缝集成到现有的开发环境中。无论您是追求极致控制权的资深极客,还是渴望提升产出的独立开发者,OpenCode 都提供了一个透明、可信