DenseNet

DenseNet(密集连接卷积网络)是一种创新的深度学习架构,曾荣获 CVPR 2017 最佳论文奖。它主要应用于计算机视觉领域,旨在解决传统深层神经网络中随着层数增加而出现的梯度消失、特征复用率低以及参数效率低下等难题。

与以往网络仅将上一层输出传递给下一层不同,DenseNet 的核心亮点在于其独特的“密集连接”机制:网络中的每一层都会直接连接到后续的所有层。这种设计如同建立了一个高效的信息高速公路,让特征图能够在层间自由流动和复用。这不仅极大地缓解了深层网络训练困难的问题,还显著减少了模型参数量,同时在图像分类、物体检测等任务上实现了更高的准确率。此外,社区已推出多种内存优化版本,使其在资源受限的环境下也能高效运行。

DenseNet 非常适合人工智能研究人员、算法工程师以及深度学习开发者使用。如果您正在探索更高效的网络结构,或需要在有限算力下构建高性能的图像识别模型,DenseNet 提供了一个经过验证的强大基础。目前,该架构已有 PyTorch、TensorFlow、Keras 等多种主流框架的实现版本,便于大家快速上手实验与应用。

使用场景

某医疗影像初创团队正在开发一套辅助诊断系统,需要从肺部 CT 扫描中精准识别早期微小结节,但受限于标注数据稀缺且对漏诊率零容忍。

没有 DenseNet 时

- 特征传递效率低:传统深层网络(如普通 CNN)在层数加深后,底层纹理细节难以有效传递至顶层,导致微小结节特征丢失。

- 训练收敛困难:为了提升精度强行增加网络深度,却引发梯度消失问题,模型极难训练收敛,调参耗时数周。

- 参数冗余严重:为补偿特征流失而盲目增加通道数,导致模型体积庞大,无法部署在医院边缘端的推理设备上。

- 小样本过拟合:在有限的病例数据下,模型容易记住噪声而非学习病理特征,泛化能力差,临床测试误报率高。

使用 DenseNet 后

- 特征复用最大化:DenseNet 通过密集连接机制,让每一层都能直接获取之前所有层的特征图,完美保留了结节边缘等细微纹理。

- 梯度流动顺畅:短路径连接确保了梯度能直接回传至浅层,即使构建超深网络也能快速稳定收敛,研发周期缩短一半。

- 模型轻量高效:得益于特征复用,DenseNet 用更少的参数量实现了更高的精度,顺利部署至低算力的便携式超声设备中。

- 强泛化抗过拟合:这种隐式的深度监督效果相当于正则化,使其在少量医疗数据上依然表现稳健,显著降低了假阳性率。

DenseNet 通过革命性的密集连接架构,在数据受限的严苛场景下,以更低算力成本实现了医疗级的高精度图像识别。

运行环境要求

- Linux

- macOS

- 必需 NVIDIA GPU

- 文中提到单张 NVIDIA TitanX (12GB 显存) 可训练大型模型

- 标准实现可能需要多卡,优化后可单卡运行

- 需安装 cuDNN

未说明

快速开始

密集连接卷积网络(DenseNets)

本仓库包含在以下论文中提出的DenseNet的代码:

Densely Connected Convolutional Networks(CVPR 2017,最佳论文奖)

Gao Huang、Zhuang Liu、Laurens van der Maaten 和 Kilian Weinberger(作者贡献相等)。

现已提供更加节省显存的实现! 请查阅 技术报告 和 代码 获取更多信息。

该代码基于 fb.resnet.torch 构建。

引用

如果您在研究中使用了DenseNet,请考虑引用以下内容:

@inproceedings{DenseNet2017,

title={Densely connected convolutional networks},

author={Huang, Gao and Liu, Zhuang and van der Maaten, Laurens and Weinberger, Kilian Q },

booktitle={Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition},

year={2017}

}

其他实现

我们的 [Caffe],我们更节省显存的 [Caffe],我们更节省显存的 [PyTorch],

[PyTorch] 由 Andreas Veit 实现,[PyTorch] 由 Brandon Amos 实现,[PyTorch] 由 Federico Baldassarre 实现,

[MXNet] 由 Nicatio 实现,

[MXNet] 由 Xiong Lin 实现,

[MXNet] 由 miraclewkf 实现,

[Tensorflow] 由 Yixuan Li 实现,

[Tensorflow] 由 Laurent Mazare 实现,

[Tensorflow] 由 Illarion Khlestov 实现,

[Lasagne] 由 Jan Schlüter 实现,

[Keras] 由 tdeboissiere 实现,

[Keras] 由 Roberto de Moura Estevão Filho 实现,

[Keras] 由 Somshubra Majumdar 实现,

[Chainer] 由 Toshinori Hanya 实现,

[Chainer] 由 Yasunori Kudo 实现,

[Torch 3D-DenseNet] 由 Barry Kui 实现,

[Keras] 由 Christopher Masch 实现,

[Tensorflow2] 由 Gaston Rios 和 Ulises Jeremias Cornejo Fandos 实现。

请注意,此处仅列出了一些早期的实现。如果您希望添加自己的实现,请提交拉取请求。

一些后续项目

- 用于高效预测的多尺度密集卷积网络

- DSOD:从零开始学习深度监督目标检测器

- CondenseNet:使用学习到的组卷积的高效DenseNet

- 用于语义分割的全卷积DenseNet

- Pelee:移动端上的实时目标检测系统

目录

简介

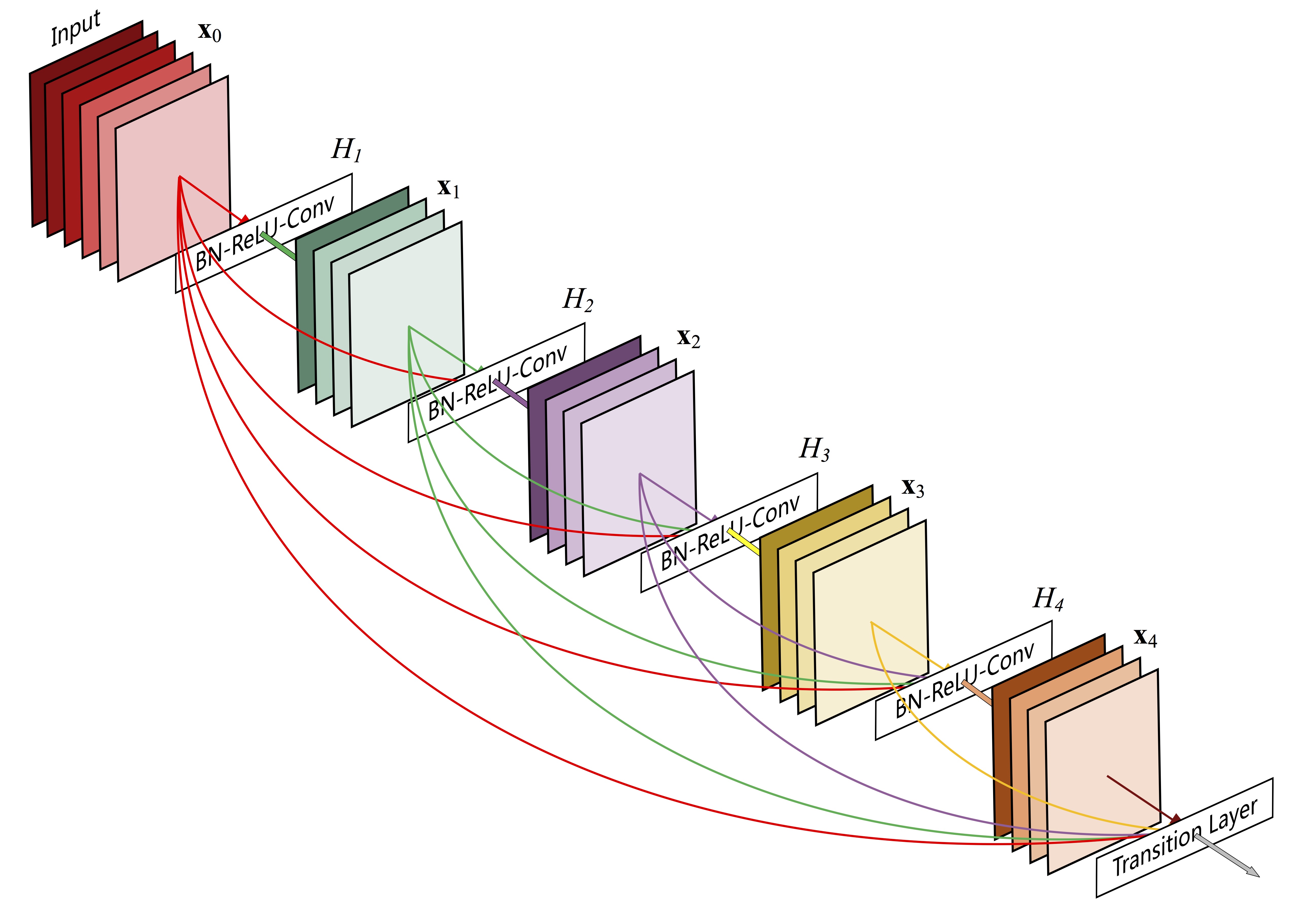

DenseNet是一种网络架构,其中每一层都以前馈方式直接连接到其他所有层(在每个密集块内)。对于每一层,所有前面层的特征图被视为独立的输入,而其自身的特征图则作为输入传递给所有后续层。这种连接模式在CIFAR10/100(无论是否进行数据增强)和SVHN上均取得了最先进的准确率。在大规模ILSVRC 2012(ImageNet)数据集上,DenseNet达到了与ResNet相似的准确率,但参数量不到ResNet的一半,浮点运算次数也大约是ResNet的一半。

图1:一个具有5层、增长率为4的密集块。

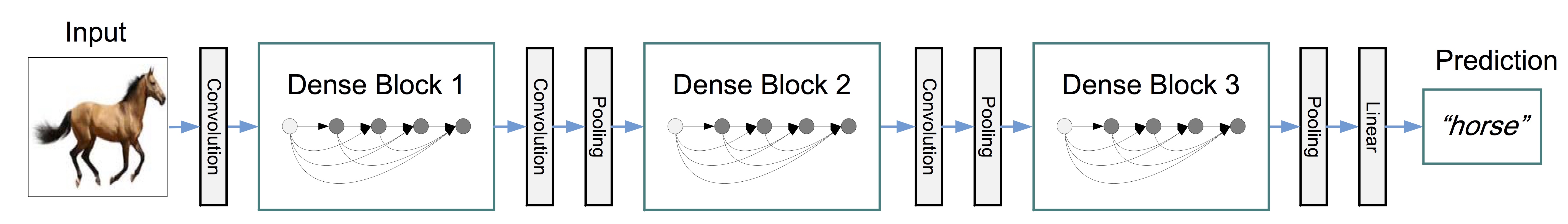

图2:一个包含三个密集块的深层DenseNet。

图2:一个包含三个密集块的深层DenseNet。

使用方法

- 安装Torch及所需的依赖库,如cuDNN。请参阅 这里 的逐步指南。

- 克隆本仓库:

git clone https://github.com/liuzhuang13/DenseNet.git

例如,以下命令将在CIFAR-10数据集上训练一个深度为L=100、增长率k=12的DenseNet-BC:

th main.lua -netType densenet -dataset cifar10 -batchSize 64 -nEpochs 300 -depth 100 -growthRate 12

再比如,以下命令将在ImageNet数据集上训练一个深度为L=121、增长率k=32的DenseNet-BC:

th main.lua -netType densenet -dataset imagenet -data [dataFolder] -batchSize 256 -nEpochs 90 -depth 121 -growthRate 32 -nGPU 4 -nThreads 16 -optMemory 3

有关数据准备,请参考 fb.resnet.torch。

DenseNet与DenseNet-BC

默认情况下,代码运行的是DenseNet-BC架构,该架构包含1×1卷积的瓶颈层,并且在每个过渡层将通道数压缩至原来的0.5倍。若要运行原始的DenseNet,只需使用选项*-bottleneck false和-reduction 1*即可。

节省显存的实现(2017年6月6日新增功能)

有一个选项*-optMemory*,在训练DenseNet时非常有助于减少GPU显存占用。默认值为2,会激活shareGradInput函数(并在此基础上进行了小幅修改,详见 这里)。此外,还有两种极端节省显存的模式(-optMemory 3或*-optMemory 4*),它们使用自定义的密集连接层。采用*-optMemory 4*时,即使是在CIFAR上最大的190层DenseNet-BC,也可以在单张NVIDIA TitanX GPU上进行训练(仅占用12G显存中的8.3G),而无需像标准的递归拼接实现那样完全占用四张GPU。

关于节省显存实现的更多细节,请参阅 这里。

CIFAR 数据集上的结果

下表展示了 DenseNet 在 CIFAR 数据集上的实验结果。“+”号表示使用了标准的数据增强(零填充后随机裁剪,以及水平翻转)。对于 DenseNet 模型,L 表示其深度,k 表示其增长率。在未进行数据增强的 CIFAR-10 和 CIFAR-100 上,除第一层卷积外,每层卷积之后都引入了一个丢弃率为 0.2 的 Dropout 层。

| 模型 | 参数量 | CIFAR-10 | CIFAR-10+ | CIFAR-100 | CIFAR-100+ |

|---|---|---|---|---|---|

| DenseNet (L=40, k=12) | 1.0M | 7.00 | 5.24 | 27.55 | 24.42 |

| DenseNet (L=100, k=12) | 7.0M | 5.77 | 4.10 | 23.79 | 20.20 |

| DenseNet (L=100, k=24) | 27.2M | 5.83 | 3.74 | 23.42 | 19.25 |

| DenseNet-BC (L=100, k=12) | 0.8M | 5.92 | 4.51 | 24.15 | 22.27 |

| DenseNet-BC (L=250, k=24) | 15.3M | 5.19 | 3.62 | 19.64 | 17.60 |

| DenseNet-BC (L=190, k=40) | 25.6M | - | 3.46 | - | 17.18 |

ImageNet 数据集及预训练模型上的结果

Torch

注意:Torch 中的预训练模型已废弃且不再维护。请改用 PyTorch 提供的 DenseNet 预训练模型。

原论文中的模型

Torch 模型是在与 fb.resnet.torch 相同的设置下训练的。所列误差率为 224×224 单裁剪测试误差。

| 网络 | Top-1 错误率 | Torch 模型 |

|---|---|---|

| DenseNet-121 (k=32) | 25.0 | [下载 (64.5MB)] |

| DenseNet-169 (k=32) | 23.6 | [下载 (114.4MB)] |

| DenseNet-201 (k=32) | 22.5 | [下载 (161.8MB)] |

| DenseNet-161 (k=48) | 22.2 | [下载 (230.8MB)] |

技术报告中的模型

采用 技术报告 中的内存高效实现训练出的更精确模型。

| 网络 | Top-1 错误率 | Torch 模型 |

|---|---|---|

| DenseNet-264 (k=32) | 22.1 | [下载 (256MB)] |

| DenseNet-232 (k=48) | 21.2 | [下载 (426MB)] |

| DenseNet-cosine-264 (k=32) | 21.6 | [下载 (256MB)] |

| DenseNet-cosine-264 (k=48) | 20.4 | [下载 (557MB)] |

Caffe

https://github.com/shicai/DenseNet-Caffe。

PyTorch

PyTorch 关于模型的文档。我们感谢 @gpleiss 在 PyTorch 方面所做的出色工作。

Keras、TensorFlow 和 Theano

https://github.com/flyyufelix/DenseNet-Keras。

MXNet

https://github.com/miraclewkf/DenseNet。

宽度-密集网络以改善时间/准确率和内存/准确率的权衡

如果您在学习任务中使用 DenseNet 作为模型,为了降低内存和时间消耗,我们建议采用宽度大、深度浅的 DenseNet,遵循 宽残差网络 的策略。为获得宽度较大的 DenseNet,我们将深度设得较小(例如 L=40),并将增长速率设得较高(例如 k=48)。

我们测试了一系列宽度-密集网络,并将其内存和时间消耗与上文所示的 DenseNet-BC (L=100, k=12) 进行了比较。统计结果是在单张 TITAN X 显卡上,批量大小为 64,且未进行任何内存优化的情况下得出的。

| 模型 | 参数量 | CIFAR-10+ | CIFAR-100+ | 每次迭代时间 | 内存 |

|---|---|---|---|---|---|

| DenseNet-BC (L=100, k=12) | 0.8M | 4.51 | 22.27 | 0.156s | 5452MB |

| Wide-DenseNet-BC (L=40, k=36) | 1.5M | 4.58 | 22.30 | 0.130s | 4008MB |

| Wide-DenseNet-BC (L=40, k=48) | 2.7M | 3.99 | 20.29 | 0.165s | 5245MB |

| Wide-DenseNet-BC (L=40, k=60) | 4.3M | 4.01 | 19.99 | 0.223s | 6508MB |

观察:

- Wide-DenseNet-BC (L=40, k=36) 在内存和时间消耗上更少,同时达到与 DenseNet-BC (L=100, k=12) 几乎相同的准确率。

- Wide-DenseNet-BC (L=40, k=48) 的内存和时间消耗与 DenseNet-BC (L=100, k=12) 相当,但准确率更高。

因此,在实际应用中,我们建议选择其中一款宽度-密集网络。

更新

2017年8月23日:

- 添加支持代码,方便用户直接 git clone 并运行。

2017年6月6日:

支持使用 自定义密集连接层 对 DenseNet 进行 超高效内存 训练。

通过修复 shareGradInput 函数,支持使用 标准密集连接层(递归拼接)对 DenseNet 进行 内存高效 训练。

2017年5月17日:

- 添加宽度-密集网络。

- 添加 Keras、TF 和 Theano 预训练模型的链接。

2017年4月20日:

- 添加 PyTorch 模型的使用说明。

2017年3月29日:

- 添加 ImageNet 训练代码。

2016年12月3日:

- 添加 ImageNet 结果及预训练模型。

- 添加 DenseNet-BC 结构。

联系方式

liuzhuangthu at gmail.com

欢迎讨论、建议和提问!

常见问题

相似工具推荐

openclaw

OpenClaw 是一款专为个人打造的本地化 AI 助手,旨在让你在自己的设备上拥有完全可控的智能伙伴。它打破了传统 AI 助手局限于特定网页或应用的束缚,能够直接接入你日常使用的各类通讯渠道,包括微信、WhatsApp、Telegram、Discord、iMessage 等数十种平台。无论你在哪个聊天软件中发送消息,OpenClaw 都能即时响应,甚至支持在 macOS、iOS 和 Android 设备上进行语音交互,并提供实时的画布渲染功能供你操控。 这款工具主要解决了用户对数据隐私、响应速度以及“始终在线”体验的需求。通过将 AI 部署在本地,用户无需依赖云端服务即可享受快速、私密的智能辅助,真正实现了“你的数据,你做主”。其独特的技术亮点在于强大的网关架构,将控制平面与核心助手分离,确保跨平台通信的流畅性与扩展性。 OpenClaw 非常适合希望构建个性化工作流的技术爱好者、开发者,以及注重隐私保护且不愿被单一生态绑定的普通用户。只要具备基础的终端操作能力(支持 macOS、Linux 及 Windows WSL2),即可通过简单的命令行引导完成部署。如果你渴望拥有一个懂你

n8n

n8n 是一款面向技术团队的公平代码(fair-code)工作流自动化平台,旨在让用户在享受低代码快速构建便利的同时,保留编写自定义代码的灵活性。它主要解决了传统自动化工具要么过于封闭难以扩展、要么完全依赖手写代码效率低下的痛点,帮助用户轻松连接 400 多种应用与服务,实现复杂业务流程的自动化。 n8n 特别适合开发者、工程师以及具备一定技术背景的业务人员使用。其核心亮点在于“按需编码”:既可以通过直观的可视化界面拖拽节点搭建流程,也能随时插入 JavaScript 或 Python 代码、调用 npm 包来处理复杂逻辑。此外,n8n 原生集成了基于 LangChain 的 AI 能力,支持用户利用自有数据和模型构建智能体工作流。在部署方面,n8n 提供极高的自由度,支持完全自托管以保障数据隐私和控制权,也提供云端服务选项。凭借活跃的社区生态和数百个现成模板,n8n 让构建强大且可控的自动化系统变得简单高效。

AutoGPT

AutoGPT 是一个旨在让每个人都能轻松使用和构建 AI 的强大平台,核心功能是帮助用户创建、部署和管理能够自动执行复杂任务的连续型 AI 智能体。它解决了传统 AI 应用中需要频繁人工干预、难以自动化长流程工作的痛点,让用户只需设定目标,AI 即可自主规划步骤、调用工具并持续运行直至完成任务。 无论是开发者、研究人员,还是希望提升工作效率的普通用户,都能从 AutoGPT 中受益。开发者可利用其低代码界面快速定制专属智能体;研究人员能基于开源架构探索多智能体协作机制;而非技术背景用户也可直接选用预置的智能体模板,立即投入实际工作场景。 AutoGPT 的技术亮点在于其模块化“积木式”工作流设计——用户通过连接功能块即可构建复杂逻辑,每个块负责单一动作,灵活且易于调试。同时,平台支持本地自托管与云端部署两种模式,兼顾数据隐私与使用便捷性。配合完善的文档和一键安装脚本,即使是初次接触的用户也能在几分钟内启动自己的第一个 AI 智能体。AutoGPT 正致力于降低 AI 应用门槛,让人人都能成为 AI 的创造者与受益者。

stable-diffusion-webui

stable-diffusion-webui 是一个基于 Gradio 构建的网页版操作界面,旨在让用户能够轻松地在本地运行和使用强大的 Stable Diffusion 图像生成模型。它解决了原始模型依赖命令行、操作门槛高且功能分散的痛点,将复杂的 AI 绘图流程整合进一个直观易用的图形化平台。 无论是希望快速上手的普通创作者、需要精细控制画面细节的设计师,还是想要深入探索模型潜力的开发者与研究人员,都能从中获益。其核心亮点在于极高的功能丰富度:不仅支持文生图、图生图、局部重绘(Inpainting)和外绘(Outpainting)等基础模式,还独创了注意力机制调整、提示词矩阵、负向提示词以及“高清修复”等高级功能。此外,它内置了 GFPGAN 和 CodeFormer 等人脸修复工具,支持多种神经网络放大算法,并允许用户通过插件系统无限扩展能力。即使是显存有限的设备,stable-diffusion-webui 也提供了相应的优化选项,让高质量的 AI 艺术创作变得触手可及。

everything-claude-code

everything-claude-code 是一套专为 AI 编程助手(如 Claude Code、Codex、Cursor 等)打造的高性能优化系统。它不仅仅是一组配置文件,而是一个经过长期实战打磨的完整框架,旨在解决 AI 代理在实际开发中面临的效率低下、记忆丢失、安全隐患及缺乏持续学习能力等核心痛点。 通过引入技能模块化、直觉增强、记忆持久化机制以及内置的安全扫描功能,everything-claude-code 能显著提升 AI 在复杂任务中的表现,帮助开发者构建更稳定、更智能的生产级 AI 代理。其独特的“研究优先”开发理念和针对 Token 消耗的优化策略,使得模型响应更快、成本更低,同时有效防御潜在的攻击向量。 这套工具特别适合软件开发者、AI 研究人员以及希望深度定制 AI 工作流的技术团队使用。无论您是在构建大型代码库,还是需要 AI 协助进行安全审计与自动化测试,everything-claude-code 都能提供强大的底层支持。作为一个曾荣获 Anthropic 黑客大奖的开源项目,它融合了多语言支持与丰富的实战钩子(hooks),让 AI 真正成长为懂上

ComfyUI

ComfyUI 是一款功能强大且高度模块化的视觉 AI 引擎,专为设计和执行复杂的 Stable Diffusion 图像生成流程而打造。它摒弃了传统的代码编写模式,采用直观的节点式流程图界面,让用户通过连接不同的功能模块即可构建个性化的生成管线。 这一设计巧妙解决了高级 AI 绘图工作流配置复杂、灵活性不足的痛点。用户无需具备编程背景,也能自由组合模型、调整参数并实时预览效果,轻松实现从基础文生图到多步骤高清修复等各类复杂任务。ComfyUI 拥有极佳的兼容性,不仅支持 Windows、macOS 和 Linux 全平台,还广泛适配 NVIDIA、AMD、Intel 及苹果 Silicon 等多种硬件架构,并率先支持 SDXL、Flux、SD3 等前沿模型。 无论是希望深入探索算法潜力的研究人员和开发者,还是追求极致创作自由度的设计师与资深 AI 绘画爱好者,ComfyUI 都能提供强大的支持。其独特的模块化架构允许社区不断扩展新功能,使其成为当前最灵活、生态最丰富的开源扩散模型工具之一,帮助用户将创意高效转化为现实。