harbor

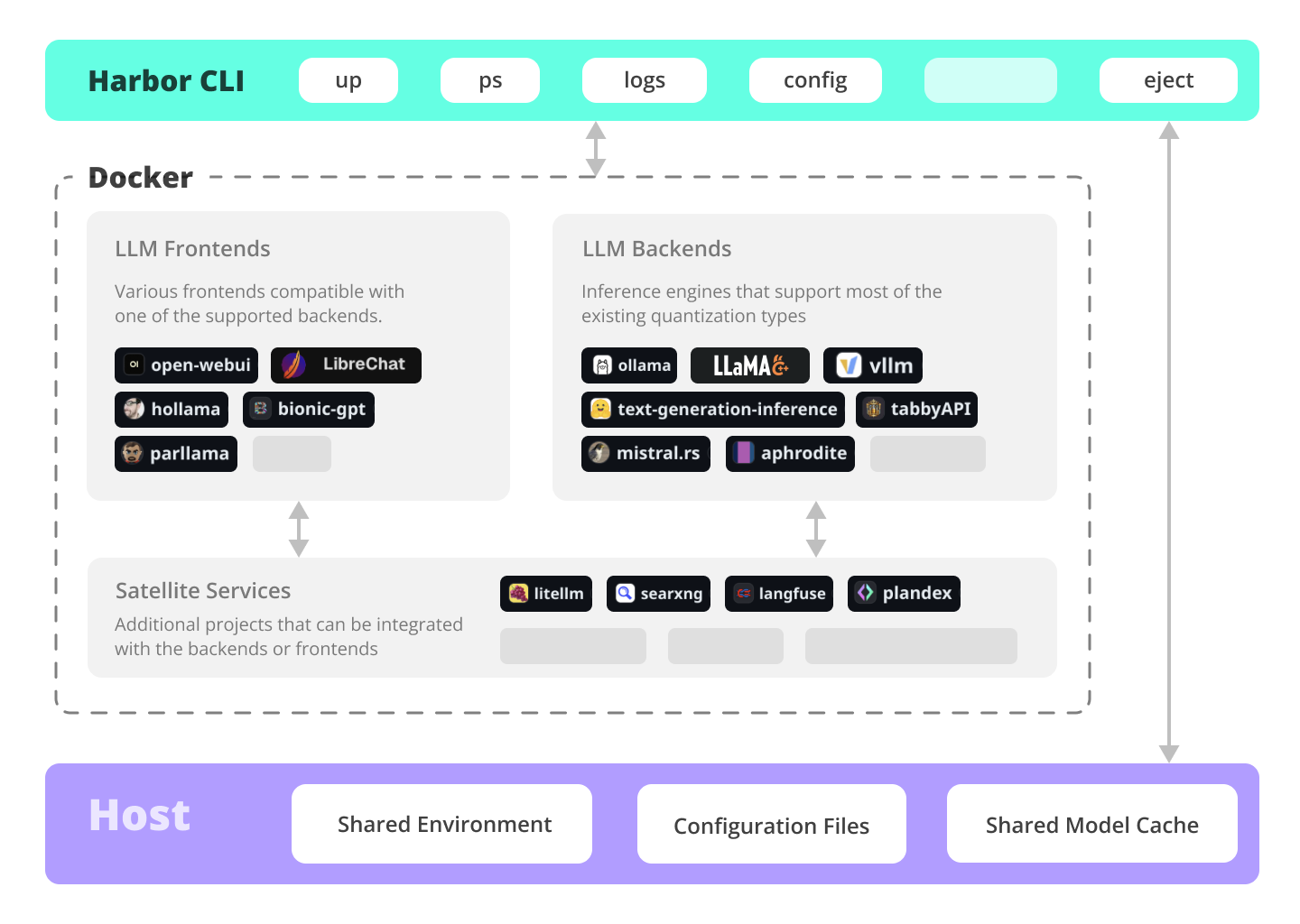

Harbor 是一款旨在简化大语言模型(LLM)部署的开源工具,它让用户只需执行一条命令,即可在本地搭建起一个功能完备且预配置好的 LLM 技术栈。面对当前 AI 生态中服务繁多、环境配置复杂、依赖关系难以处理的痛点,Harbor 通过集成数百种可探索的服务组件,将原本繁琐的安装调试过程极大简化,帮助用户快速从“配置环境”转向“实际探索”。

这款工具特别适合开发者、AI 研究人员以及希望深入体验本地大模型生态的技术爱好者使用。无论是想要测试不同模型的表现,还是构建复杂的 AI 应用原型,Harbor 都能提供开箱即用的支持。其核心亮点在于高度集成的架构设计,基于容器化技术自动编排各类服务,确保系统稳定运行的同时,保留了极高的灵活性与扩展性。用户无需具备深厚的运维背景,也能轻松管理包括模型推理、向量数据库、前端界面在内的全套设施。对于渴望在私有环境中安全、高效地探索人工智能潜力的用户而言,Harbor 提供了一个可靠且便捷的起点。

使用场景

某初创公司的 AI 研发团队急需在本地搭建一套包含大模型、向量数据库及监控面板的完整实验环境,以便快速验证新算法。

没有 harbor 时

- 环境配置繁琐:工程师需手动编写数十个 Docker Compose 文件,逐个拉取并配置 LLM 推理引擎、嵌入模型及依赖服务,耗时数天且极易出错。

- 版本兼容困难:不同组件(如 vLLM、Ollama、Postgres)的版本依赖复杂,经常因端口冲突或镜像不匹配导致启动失败,排查问题占据大量时间。

- 资源浪费严重:团队成员各自为战,重复下载相同的大型模型镜像,占用大量带宽和存储空间,且难以统一环境标准。

- 探索成本高昂:想要尝试新的开源模型或服务组合,需要重新研究文档和部署脚本,试错门槛极高,严重拖慢研发节奏。

使用 harbor 后

- 一键极速部署:只需执行一条命令,harbor 即可自动编排并启动包含数百种预配置服务的完整 LLM 技术栈,将环境搭建时间从几天缩短至几分钟。

- 预集成零冲突:harbor 内置了经过验证的服务依赖关系和版本组合,彻底消除了手动配置带来的兼容性报错,确保系统开箱即用。

- 统一高效管理:团队通过 harbor 共享标准化的本地环境,避免了重复下载和配置差异,显著节省了存储资源并提升了协作效率。

- 灵活自由探索:研究人员可轻松切换不同的模型后端或辅助工具组合,无需关心底层部署细节,能够专注于核心算法的创新与验证。

harbor 通过“一键式”全栈交付能力,将复杂的 AI 基础设施搭建转化为简单的开发体验,让团队真正实现了从“运维配置”到“模型创新”的重心转移。

运行环境要求

- Linux

- macOS

- Windows

非必需(取决于所选后端服务,如 Ollama, vLLM, llama.cpp 等支持 CPU 或 GPU 运行)

未说明(取决于运行的模型大小和服务数量)

快速开始

https://github.com/user-attachments/assets/8a7705e1-6f0e-4374-8784-62b95816aebc

轻松搭建本地LLM环境。

# 启动已完全配置的Open WebUI和Ollama

harbor up

# 现在,Open WebUI可以进行网络检索增强和TTS/STT

harbor up searxng speaches

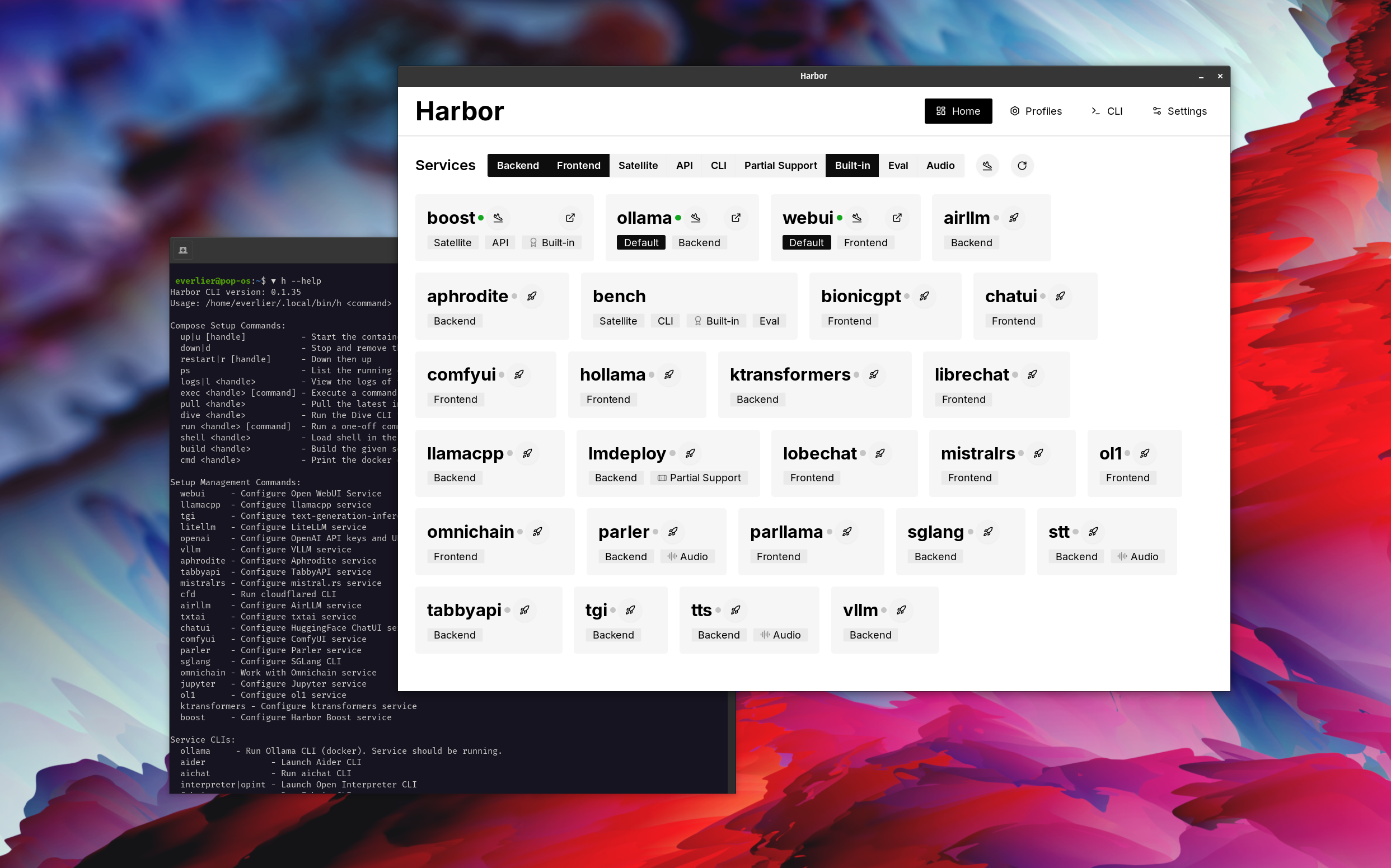

Harbor是一款CLI工具及配套应用,能够帮助您快速搭建完整的本地大模型运行环境——包括后端如Ollama、llama.cpp或vLLM,前端如Open WebUI,以及支持服务如用于网络搜索的SearXNG、用于语音对话的Speaches和用于图像生成的ComfyUI等。所有组件都预先配置好,只需一条harbor up命令即可实现无缝协作。无需手动设置:您只需选择所需的服务,Harbor便会自动完成Docker Compose编排、配置及各服务间的互联互通,让您专注于实际使用模型。

新闻

- v0.4.10 - 修复了 SearXNG 的 JSON 格式和工作区配置,解决了 CDI 种子脚本跳过构建变体的问题

- v0.4.9 - 新增两个 Boost 模块(

analogical、deaf),Open WebUI 原生函数调用默认启用,修复了 CLI 验证问题 - v0.4.8 - 单独的 CLI 和 ROS MCP 服务器服务,新增 MiniMax 云提供商,文档进行了大量更新

- v0.4.7 - Hermes Agent 服务,支持从源码构建 llama.cpp,更新了 llama.cpp 文档

- v0.4.6 - SillyTavern 服务,修复了 llama.cpp 缓存路径,改进了 Jupyter 工作区

- v0.4.5 - Harbor App:内置终端、服务日志、模型管理

- v0.4.4 - Harbor 集成测试套件,使用模拟的 OpenAI 接口,增强了服务管理 UI

文档

- 安装 Harbor

安装 Harbor CLI 和 App 的指南 - Harbor 用户指南

使用 Harbor 的高级概述 - Harbor App

Harbor 伴侣应用的概述和手册 - Harbor 服务

Harbor 中可用的服务目录 - Harbor CLI 参考

了解更多关于 Harbor CLI 命令和选项的信息。 阅读支持的服务以及如何配置它们的内容。 - 加入我们的 Discord

获取帮助、分享经验并为项目贡献力量。

维护者:重新生成文档

在 Harbor 仓库根目录下运行文档工作流:

harbor dev docs

新维护者的前提条件:

将 wiki 仓库克隆到父级目录

../harbor.wiki中,因为文档脚本会将生成的 wiki 页面复制到那里。git clone https://github.com/av/harbor.wiki.git ../harbor.wiki使用此仓库中的 Harbor CLI。如果

harbor尚未在您的PATH中,您可以直接运行本地入口点:./harbor.sh dev docs或者先链接该仓库,再使用上述维护者命令:

./harbor.sh link harbor dev docs在重新生成文档之前,必须确保 Docker Engine 和

docker compose正常工作。文档脚本会调用harbor run boost uv run ...来重建由 Boost 生成的页面,因此即使 Harbor 回退到容器化的 Deno 运行时,也需要 Docker。

此工作流会更新 docs/ 目录,同步兄弟 wiki 仓库,刷新应用文档副本,并重写生成的软件包 README 文件。

Harbor 能做什么?

✦ 本地 LLM

在本地运行 LLM 和相关服务,几乎无需或只需少量配置,通常只需一个命令或一次点击即可。

# 所有后端都已预先连接到 Open WebUI

harbor up ollama

harbor up llamacpp

harbor up vllm

# 设置并记住 llama.cpp 的参数

harbor llamacpp args -ngl 32

最前沿的推理

Harbor 支持大多数主流的推理引擎,同时也支持一些不太知名的引擎。

# 我们真诚地希望您不会尝试同时运行所有这些引擎

harbor up vllm llamacpp tgi litellm tabbyapi aphrodite sglang ktransformers mistralrs airllm

工具使用

享受 MCP 生态系统带来的好处,并将其扩展到您的应用场景中。

# 使用便捷的 Web UI 管理 MCP

harbor up metamcp

# 将 MCP 连接到 Open WebUI

harbor up metamcp mcpo

图像生成

Harbor 包含 ComfyUI + Flux + Open WebUI 的集成。

# 通过一个命令即可在 Open WebUI 中使用 FLUX

harbor up comfyui

本地 Web RAG / 深度研究

Harbor 内置 SearXNG,它开箱即用,预连接了许多服务:Perplexica、ChatUI、Morphic、本地深度研究等。

# SearXNG 已预先连接到 Open WebUI

harbor up searxng

# 并且连接到许多其他服务

harbor up searxng chatui

harbor up searxng morphic

harbor up searxng perplexica

harbor up searxng ldr

LLM 工作流

Harbor 包括多个用于构建基于 LLM 的数据和聊天工作流的服务:Dify、LitLytics、n8n、Open WebUI 流水线、FloWise、LangFlow。

# 在 Open WebUI 中使用 Dify

harbor up dify

与您的 LLM 对话

只需一个命令即可设置与您的 LLM 的语音聊天。Open WebUI + Speaches

# Speaches 包含兼容 OpenAI 的 SST 和 TTS

# 并且开箱即用连接到 Open WebUI

harbor up speaches

通过手机聊天

您可以通过二维码从手机访问 Harbor 服务。轻松获取本地、局域网或 Docker 访问的链接。

# 打印一个二维码,以便在手机上打开服务

harbor qr

# 打印一个链接,以便在手机上打开服务

harbor url webui

随时随地聊天

Harbor 内置一个 内建隧道服务,可将您的 Harbor 暴露到互联网上。

[!WARN] 请谨慎对待将您的计算机暴露到互联网上的行为,这并不安全。

# 将默认界面暴露到互联网

harbor tunnel

# 将特定服务暴露到互联网

# ⚠️ 请务必为该服务配置身份验证

harbor tunnel vllm

# Harbor 自带 Traefik,并已为所有包含的服务预配置好

harbor up traefik

LLM 脚本编写

Harbor Boost 允许您 轻松编写工作流脚本以及与下游 LLM 的交互。

# 使用 Harbor Boost 编写 LLM 工作流

harbor up boost

配置文件

保存和管理不同场景下的配置文件。例如,为不同的模型和上下文保存 llama.cpp 参数,并轻松切换。

# 保存和使用配置文件

harbor profile save llama4

harbor profile use default

# 从 URL 导入配置文件

harbor profile use https://example.com/path/to/harbor-profile.env

命令历史

Harbor 保留一份 仅限本地的最近命令历史。您可以轻松查找并重新执行命令,而无需依赖系统的 shell 历史记录。

# 查看最近使用的 Harbor 命令

harbor history

迁出

准备好迁移到您自己的设置了吗?Harbor 会为您提供一个 docker-compose 文件,以复制您的当前设置。

# 从 Harbor 中弹出并迁移到独立的 Docker Compose 配置

# 将相关服务和变量导出到一个独立的文件中。

harbor eject searxng llamacpp > docker-compose.harbor.yml

服务

前端界面

Open WebUI ⦁︎ ComfyUI ⦁︎ LibreChat ⦁︎ HuggingFace ChatUI ⦁︎ Lobe Chat ⦁︎ Hollama ⦁︎ parllama ⦁︎ BionicGPT ⦁︎ AnythingLLM ⦁︎ Chat Nio ⦁︎ mikupad ⦁︎ oterm ⦁︎ omnichain ⦁︎ ol1

后端服务

Ollama ⦁︎ llama.cpp ⦁︎ vLLM ⦁︎ TabbyAPI ⦁︎ Aphrodite Engine ⦁︎ mistral.rs ⦁︎ openedai-speech ⦁︎ Speaches ⦁︎ Parler ⦁︎ text-generation-inference ⦁︎ LMDeploy ⦁︎ AirLLM ⦁︎ SGLang ⦁︎ KTransformers ⦁︎ Nexa SDK ⦁︎ KoboldCpp ⦁︎ Modular MAX

卫星项目

Harbor Bench ⦁︎ Harbor Boost ⦁︎ SearXNG ⦁︎ Perplexica ⦁︎ Dify ⦁︎ Plandex ⦁︎ LiteLLM ⦁︎ LangFuse ⦁︎ Open Interpreter ⦁ ︎cloudflared ⦁︎ cmdh ⦁︎ fabric ⦁︎ txtai RAG ⦁︎ TextGrad ⦁︎ Aider ⦁︎ aichat ⦁︎ autogpt ⦁︎ lm-evaluation-harness ⦁︎ JupyterLab ⦁︎ ol1 ⦁︎ OpenHands ⦁︎ LitLytics ⦁︎ Repopack ⦁︎ n8n ⦁︎ Bolt.new ⦁︎ Open WebUI Pipelines ⦁︎ Qdrant ⦁︎ K6 ⦁︎ Promptfoo ⦁︎ Webtop ⦁︎ OmniParser ⦁︎ Flowise ⦁︎ Langflow ⦁︎ OptiLLM ⦁︎ Morphic ⦁︎ SQL Chat ⦁︎ gptme ⦁︎ traefik ⦁︎ Latent Scope ⦁︎ RAGLite ⦁︎ llama-swap ⦁︎ LibreTranslate ⦁︎ MetaMCP ⦁︎ mcpo ⦁︎ SuperGateway ⦁︎ Local Deep Research ⦁︎ LocalAI ⦁︎ AgentZero ⦁︎ Airweave ⦁︎ Docling ⦁︎ Browser Use ⦁︎ Unsloth ⦁︎ Windmill

有关每个项目的简要介绍,请参阅 服务文档。

CLI 使用指南

# 使用默认服务运行 Harbor:

# Open WebUI 和 Ollama

harbor up

# 使用附加服务运行 Harbor

# 运行 SearXNG 会自动在 Open WebUI 中启用 Web RAG 功能

harbor up searxng

# Speaches 包含与 OpenAI 兼容的 SST 和 TTS

# 并开箱即用地连接到 Open WebUI

harbor up speaches

# 运行额外的或替代的 LLM 推理后端

# Open Webui 会自动连接到这些后端。

harbor up llamacpp tgi litellm vllm tabbyapi aphrodite sglang ktransformers

# 运行不同的前端

harbor up librechat chatui bionicgpt hollama

# 通过内置优化代理获得免费的质量提升

harbor up boost

# 使用一条命令在 Open WebUI 中使用 FLUX

harbor up comfyui

# 为支持的后端使用自定义模型

harbor llamacpp model https://huggingface.co/user/repo/model.gguf

# 无需安装即可访问服务的 CLI

# 在可能的情况下,服务之间共享缓存

harbor hf scan-cache

harbor hf download google/gemma-2-2b-it

harbor ollama list

# 快速查找 HF Hub 上的模型

harbor hf find gguf gemma-2

# 使用 HFDownloader 和官方 HF CLI 下载模型

harbor hf dl -m google/gemma-2-2b-it -c 10 -s ./hf

harbor hf download google/gemma-2-2b-it

# 在可能的情况下,服务之间共享缓存

harbor tgi model google/gemma-2-2b-it

harbor vllm model google/gemma-2-2b-it

harbor aphrodite model google/gemma-2-2b-it

harbor tabbyapi model google/gemma-2-2b-it-exl2

harbor mistralrs model google/gemma-2-2b-it

harbor opint model google/gemma-2-2b-it

harbor sglang model google/gemma-2-2b-it

# 用于 Docker 设置的便捷工具

harbor logs llamacpp

harbor exec llamacpp ./scripts/llama-bench --help

harbor shell vllm

# 向你的 Shell 表达你的真实想法

harbor opint

harbor aider

harbor aichat

harbor cmdh

# 使用 Fabric 将你的 Linux 管道 LLM 化

cat ./file.md | harbor fabric --pattern extract_extraordinary_claims | grep "LK99"

# 从 CLI 打开服务

harbor open webui

harbor open llamacpp

# 打印一个二维码,以便快速在手机上打开服务

harbor qr

# 想要冒险吗?将你的 Harbor 暴露到互联网上

harbor tunnel

# 配置管理

harbor config list

harbor config set webui.host.port 8080

# 创建和管理配置文件

harbor profile save l370b

harbor profile use default

# 从 URL 导入配置文件

harbor profile use https://example.com/path/to/harbor-profile.env

# 查看最近使用的 Harbor 命令

harbor history

# 从 Harbor 中退出,进入独立的 Docker Compose 设置

# 会将相关服务和变量导出到一个独立的文件中。

harbor eject searxng llamacpp > docker-compose.harbor.yml

# 使用你自己的任务运行内置的 LLM 基准测试

harbor bench run

# 花样/趣味区

# 参数乱序,以下命令都与上面相同

# Harbor 不在乎是“vllm model”还是“model vllm”,它都会搞定。

harbor model vllm

harbor vllm model

harbor config get webui.name

harbor get config webui_name

harbor tabbyapi shell

harbor shell tabbyapi

# 50% 花样,50% 实用

# 向 Harbor 询问关于它自身的问题

harbor how to ping ollama container from the webui?

## Harbor 应用演示

https://github.com/user-attachments/assets/a5cd2ef1-3208-400a-8866-7abd85808503

在演示中,Harbor 应用被用来启动一个默认堆栈,包含 [Ollama](./2.2.1-Backend:-Ollama) 和 [Open WebUI](./2.1.1-Frontend:-Open-WebUI) 服务。随后,[SearXNG](./2.3.1-Satellite:-SearXNG) 也被启动,WebUI 可以直接连接到它,实现开箱即用的 Web RAG 功能。之后,[Harbor Boost](./5.2.-Harbor-Boost) 也被启动,并自动连接到 WebUI,以产生更具创造性的输出。最后一步,在应用中调整了 Harbor 的配置,针对 [Harbor Boost](./5.2.-Harbor-Boost) 中的 [`klmbr`](./5.2.-Harbor-Boost#klmbr---boost-llm-creativity) 模块,使输出对 LLM 来说变得无法解析(但仍然可以被人理解)。

## 为什么?

- 如果你已经熟悉 Docker 和 Linux 管理,那么你可能并不需要 Harbor 来管理你的本地 LLM 环境。然而,在搭建和扩展这个环境的过程中,你最终很可能会得到类似的解决方案。这一点我深有体会,因为 Harbor 正是这样诞生的。

- Harbor 并不是作为一个部署解决方案设计的,而是作为本地 LLM 开发环境的辅助工具。它是尝试 LLM 和相关服务的一个良好起点。

- 工作流/设置的集中化——你可以确切知道在哪里找到特定的配置或服务、日志、数据和配置文件。

- 便利性——单一的 CLI 提供大量服务和功能,可以从主机上的任何位置访问。

## 支持者

<a href="https://x.com/TheAhmadOsman"><img src="https://oss.gittoolsai.com/images/av_harbor_readme_78c67947c9ef.png" width="32" height="32" alt="@TheAhmadOsman" /></a>

版本历史

v0.4.102026/04/16v0.4.92026/04/16v0.4.12026/02/09v0.4.22026/03/02v0.4.82026/04/12v0.4.72026/04/03v0.4.62026/04/02v0.4.52026/03/16v0.4.42026/03/13v0.4.32026/03/08v0.4.02026/02/08v0.3.412026/01/30v0.3.402026/01/27v0.3.392026/01/26v0.3.382026/01/17v0.3.372026/01/10v0.3.352026/01/06v0.3.342026/01/04v0.3.332026/01/03v0.3.322026/01/03常见问题

相似工具推荐

openclaw

OpenClaw 是一款专为个人打造的本地化 AI 助手,旨在让你在自己的设备上拥有完全可控的智能伙伴。它打破了传统 AI 助手局限于特定网页或应用的束缚,能够直接接入你日常使用的各类通讯渠道,包括微信、WhatsApp、Telegram、Discord、iMessage 等数十种平台。无论你在哪个聊天软件中发送消息,OpenClaw 都能即时响应,甚至支持在 macOS、iOS 和 Android 设备上进行语音交互,并提供实时的画布渲染功能供你操控。 这款工具主要解决了用户对数据隐私、响应速度以及“始终在线”体验的需求。通过将 AI 部署在本地,用户无需依赖云端服务即可享受快速、私密的智能辅助,真正实现了“你的数据,你做主”。其独特的技术亮点在于强大的网关架构,将控制平面与核心助手分离,确保跨平台通信的流畅性与扩展性。 OpenClaw 非常适合希望构建个性化工作流的技术爱好者、开发者,以及注重隐私保护且不愿被单一生态绑定的普通用户。只要具备基础的终端操作能力(支持 macOS、Linux 及 Windows WSL2),即可通过简单的命令行引导完成部署。如果你渴望拥有一个懂你

n8n

n8n 是一款面向技术团队的公平代码(fair-code)工作流自动化平台,旨在让用户在享受低代码快速构建便利的同时,保留编写自定义代码的灵活性。它主要解决了传统自动化工具要么过于封闭难以扩展、要么完全依赖手写代码效率低下的痛点,帮助用户轻松连接 400 多种应用与服务,实现复杂业务流程的自动化。 n8n 特别适合开发者、工程师以及具备一定技术背景的业务人员使用。其核心亮点在于“按需编码”:既可以通过直观的可视化界面拖拽节点搭建流程,也能随时插入 JavaScript 或 Python 代码、调用 npm 包来处理复杂逻辑。此外,n8n 原生集成了基于 LangChain 的 AI 能力,支持用户利用自有数据和模型构建智能体工作流。在部署方面,n8n 提供极高的自由度,支持完全自托管以保障数据隐私和控制权,也提供云端服务选项。凭借活跃的社区生态和数百个现成模板,n8n 让构建强大且可控的自动化系统变得简单高效。

stable-diffusion-webui

stable-diffusion-webui 是一个基于 Gradio 构建的网页版操作界面,旨在让用户能够轻松地在本地运行和使用强大的 Stable Diffusion 图像生成模型。它解决了原始模型依赖命令行、操作门槛高且功能分散的痛点,将复杂的 AI 绘图流程整合进一个直观易用的图形化平台。 无论是希望快速上手的普通创作者、需要精细控制画面细节的设计师,还是想要深入探索模型潜力的开发者与研究人员,都能从中获益。其核心亮点在于极高的功能丰富度:不仅支持文生图、图生图、局部重绘(Inpainting)和外绘(Outpainting)等基础模式,还独创了注意力机制调整、提示词矩阵、负向提示词以及“高清修复”等高级功能。此外,它内置了 GFPGAN 和 CodeFormer 等人脸修复工具,支持多种神经网络放大算法,并允许用户通过插件系统无限扩展能力。即使是显存有限的设备,stable-diffusion-webui 也提供了相应的优化选项,让高质量的 AI 艺术创作变得触手可及。

everything-claude-code

everything-claude-code 是一套专为 AI 编程助手(如 Claude Code、Codex、Cursor 等)打造的高性能优化系统。它不仅仅是一组配置文件,而是一个经过长期实战打磨的完整框架,旨在解决 AI 代理在实际开发中面临的效率低下、记忆丢失、安全隐患及缺乏持续学习能力等核心痛点。 通过引入技能模块化、直觉增强、记忆持久化机制以及内置的安全扫描功能,everything-claude-code 能显著提升 AI 在复杂任务中的表现,帮助开发者构建更稳定、更智能的生产级 AI 代理。其独特的“研究优先”开发理念和针对 Token 消耗的优化策略,使得模型响应更快、成本更低,同时有效防御潜在的攻击向量。 这套工具特别适合软件开发者、AI 研究人员以及希望深度定制 AI 工作流的技术团队使用。无论您是在构建大型代码库,还是需要 AI 协助进行安全审计与自动化测试,everything-claude-code 都能提供强大的底层支持。作为一个曾荣获 Anthropic 黑客大奖的开源项目,它融合了多语言支持与丰富的实战钩子(hooks),让 AI 真正成长为懂上

opencode

OpenCode 是一款开源的 AI 编程助手(Coding Agent),旨在像一位智能搭档一样融入您的开发流程。它不仅仅是一个代码补全插件,而是一个能够理解项目上下文、自主规划任务并执行复杂编码操作的智能体。无论是生成全新功能、重构现有代码,还是排查难以定位的 Bug,OpenCode 都能通过自然语言交互高效完成,显著减少开发者在重复性劳动和上下文切换上的时间消耗。 这款工具专为软件开发者、工程师及技术研究人员设计,特别适合希望利用大模型能力来提升编码效率、加速原型开发或处理遗留代码维护的专业人群。其核心亮点在于完全开源的架构,这意味着用户可以审查代码逻辑、自定义行为策略,甚至私有化部署以保障数据安全,彻底打破了传统闭源 AI 助手的“黑盒”限制。 在技术体验上,OpenCode 提供了灵活的终端界面(Terminal UI)和正在测试中的桌面应用程序,支持 macOS、Windows 及 Linux 全平台。它兼容多种包管理工具,安装便捷,并能无缝集成到现有的开发环境中。无论您是追求极致控制权的资深极客,还是渴望提升产出的独立开发者,OpenCode 都提供了一个透明、可信

ComfyUI

ComfyUI 是一款功能强大且高度模块化的视觉 AI 引擎,专为设计和执行复杂的 Stable Diffusion 图像生成流程而打造。它摒弃了传统的代码编写模式,采用直观的节点式流程图界面,让用户通过连接不同的功能模块即可构建个性化的生成管线。 这一设计巧妙解决了高级 AI 绘图工作流配置复杂、灵活性不足的痛点。用户无需具备编程背景,也能自由组合模型、调整参数并实时预览效果,轻松实现从基础文生图到多步骤高清修复等各类复杂任务。ComfyUI 拥有极佳的兼容性,不仅支持 Windows、macOS 和 Linux 全平台,还广泛适配 NVIDIA、AMD、Intel 及苹果 Silicon 等多种硬件架构,并率先支持 SDXL、Flux、SD3 等前沿模型。 无论是希望深入探索算法潜力的研究人员和开发者,还是追求极致创作自由度的设计师与资深 AI 绘画爱好者,ComfyUI 都能提供强大的支持。其独特的模块化架构允许社区不断扩展新功能,使其成为当前最灵活、生态最丰富的开源扩散模型工具之一,帮助用户将创意高效转化为现实。