TigerBot

TigerBot 是一款支持多语言、多任务的大型语言模型,旨在为开发者和研究人员提供世界级的基础大模型能力。它不仅能处理通用的对话与文本生成,更在中文语境理解、长文档分析及垂直领域应用上表现出色,有效解决了传统模型在中文复杂场景下知识匮乏及长上下文处理能力不足的痛点。

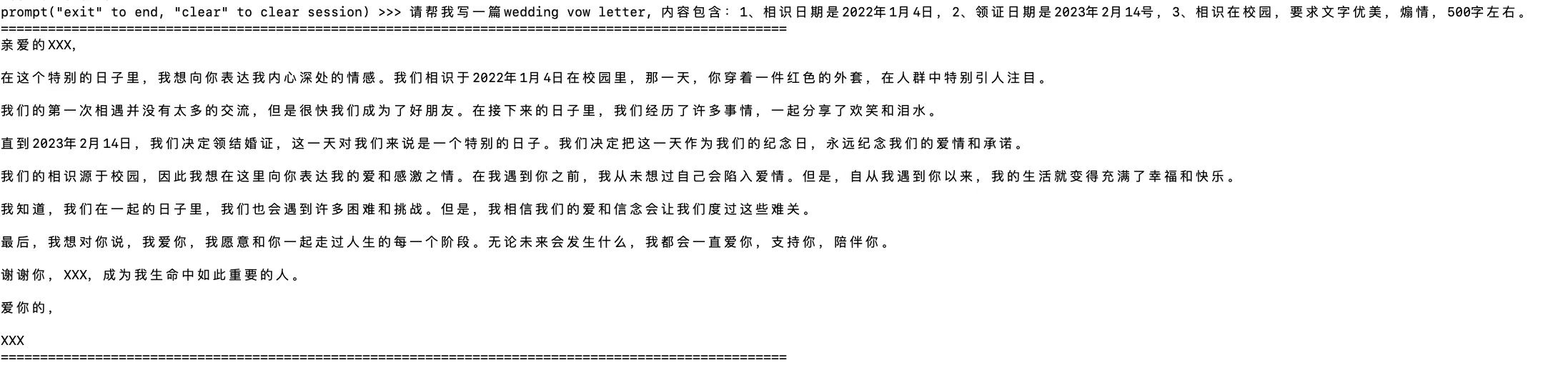

TigerBot 特别适合开发者构建智能应用、研究人员探索大模型技术,以及需要处理专业文档的企业用户。其独特亮点包括:支持高达 100K 的超长上下文窗口,能轻松解读整本手册或长篇论文;内置增强的搜索与文档检索(RAG)功能,让回答更具时效性和依据;此外,TigerBot 还发布了全球首个中文临床术语体系(MedCT)及专用医疗模型,在医疗命名实体识别等任务中达到了业界领先水平。无论是开发创意小游戏,还是部署专业的医疗辅助系统,TigerBot 都能提供坚实的技术底座。

使用场景

某三甲医院科研团队正在构建智能临床辅助系统,需要从海量非结构化的电子病历中快速提取关键诊疗信息并生成标准化报告。

没有 TigerBot 时

- 术语识别困难:通用大模型缺乏专业医学知识,无法准确识别“心梗”、“房颤”等中文临床缩略语及复杂术语,导致实体抽取错误率高。

- 长文档处理受限:面对长达数十页的完整病程记录或出院小结,传统模型受限于上下文长度,常常丢失首尾关键信息,无法进行全局分析。

- 人工校验成本高:由于模型输出不可靠且缺乏权威依据,医生必须逐字核对提取结果,耗时耗力,严重拖慢科研数据清洗进度。

- 多任务协作割裂:需要分别部署命名实体识别(NER)、文本分类和摘要生成等多个独立模型,系统架构臃肿,维护难度极大。

使用 TigerBot 后

- 专业术语精准捕获:依托全球首个中文临床术语体系 MedCT 及医疗基础模型,TigerBot 在中英文医疗 NER 任务中达到 SOTA 水平,能精准定位并标准化各类临床实体。

- 超长上下文无损理解:利用支持 100K 上下文的 70B 版本,TigerBot 可一次性读入整份复杂病历,完整捕捉患者从入院到出院的全周期诊疗逻辑。

- 可信溯源与高效产出:结合搜索增强模式,TigerBot 在生成结论时自动附带信息源链接,大幅降低人工复核成本,让医生专注于决策而非数据整理。

- 一站式多任务解决:凭借多语言多任务能力,单个 TigerBot 实例即可同时完成信息抽取、诊断辅助建议生成及结构化报告撰写,显著简化系统架构。

TigerBot 以世界级的中文医疗基座能力和超长上下文优势,将临床数据处理效率提升了数倍,真正实现了从“人工搬运”到“智能洞察”的跨越。

运行环境要求

- Linux

- Windows

- 需要 NVIDIA GPU

- 基础微调示例提及单张 RTX 3090 (24GB)

- 运行 70B 模型需多卡环境(示例使用 CUDA_VISIBLE_DEVICES=0 暗示单卡或多卡指定),具体显存取决于模型尺寸及量化方式(未明确最低显存,但 70B 全精度通常需多卡或高显存)

- 支持 CUDA(版本未明确,隐含支持主流版本)

未说明(建议根据模型尺寸配置,70B 模型通常需要大量系统内存或显存)

快速开始

TigerBot

您专属的前沿大模型基础。

以世界级的基础大模型,贡献于中国式的创新。

🌐 TigerBot • 🤗 Hugging Face • 💻ModelScope

中文 | English

最新发布

[12/28/2024] 虎博TigerBot发布全球首个中文临床术语体系——MedCT (Medical Clinical Terminology),以及相应的医疗NER模型和医疗基础模型,在中英文医疗NER任务中均取得新SOTA,同时发布真实临床标注数据。

[06/01/2024] 虎博TigerBot产品升级:搜索模式(search augmented)增加信息源链接。

[03/18/2024] 虎博TigerBot升级,支持100K上下文长度 (70b and 13b chat) :fire: [models];TigerBot医疗大模型被AAAI 2024 Spring Symposium on Clinical Foundation Models录取 [paper]。

# 可以根据实际硬件情况调整max_input/generate_length export PYTHONPATH='./' ; export CUDA_VISIBLE_DEVICES=0 ; streamlit run apps/web_demo.py -- --model_path tigerbot-70b-chat-v6 --rope_scaling yarn --rope_factor 8 --max_input_length 37888 --max_generate_length 62112[01/18/2024] 新一代的TigerBot基座模型训练了我们认为最大最高质量的中文数据。为了验证,我们做了个有趣的测试:我们让Tigerbot-70b-chat和GPT-4-Turbo对战40局成语接龙,各先出20局。每局中无法成功接龙成语者输(以权威成语词典为准),比分 Tigerbot:GPT-4 = 24:16。 基于此,Tigerbot发布第一款基于大模型的小游戏[TigerBot成语接龙],移动端扫如下二维码参与,有机会赢取顶配iPhone Pro Max. :fire:

- 大模型的生成能力、世界知识、和随机性可以增加文字类游戏的可玩性和知识性,

- 适合的prompt激发出大模型的底层知识,即完成的游戏引擎的开发,

- 前端设计好游戏的互动性和即时反馈便可完成一款可玩的小游戏。

[12/29/2023] Tigerbot发表技术报告(arXiv preprint),分享我们在大模型狂飙和应用落地方面的一些技术细节和浅见 :fire: [paper]

[12/08/2023] Tigerbot family新版模型发布,bigger and better :fire: [模型下载][测评]

- Tigerbot-70b base (v2) and chat (v4)更新,chat模型综合能力比上一版提升19%;

- Tigerbot-13b base (v3) and chat (v5)更新,chat模型综合能力比上一版提升16%;

- Tigerbot-180b base and chat (v2)更新,base模型优于Bloom 7%, chat模型优于Bloomz/Bloomz-mt 20%;

- 训练数据:500B tokens预训练数据,知识截止到2023年8月。更多优质数据,包括:万卷,arXiv, 中文教科书,法律和专利等领域数据;

- 序列长度:70b-chat和13b-chat均推出4k长度训练版本,推理可外推到32k;

- 训练方法:预训练优化了TP/PP算法,对齐采用了grouped sft, rejection-sampling,dpo (稍后会分享技术报告);

- 全线产品(web, app, 小程序)和api均升级到最新最强的Tigerbot-70b-chat-v4-4k,产品端增加了search (搜索增加) and document (文件增强) RAG功能。

[10/19/2023] Long(16k)-Tigerbot 发布

- Tigerbot-13/70B web/api接口支持16k-token长度(约为20k字符,或20页的pdf或word文档,paper类的可直接作为context输入)。

- 基于YaRN方法,推理时对RoPE表示进行“高频维度不变,低频维度插值”的方式外推,以达到处理长序列的目的。

- Tigerbot优化了TGI框架,为每个请求根据输入序列长度与最大生成序列长度单独计算cos/sin值,同时保证总长度不大于2048时的效果不变,因此API用户需要选择一个更合适的max_new_token参数,并且不同的max_new_token参数可能会导致不同的结果。

- Tigerbot后续将会在训练阶段继续优化对长序列的支持。

[9/27/2023] Tigerbot-70b-chat-api发布function calling功能: [tech report][tigerbot-api]

- {user prompt, functions def} --> TigerBot --> 3rd party API --> TigerBot --> natural answers with accurate results.

- Tigerbot训练并没有专门使用function calling类的结构化抽取数据,但已经呈现出不错的理解和抽取能力,所以我们相信经过领域数据微调,function calling的表现会接近生产可用。

[9/26/2023] Tigerbot-70b-chat(v3)和Tigerbot-13b-chat(v4)更新发布: [模型下载]

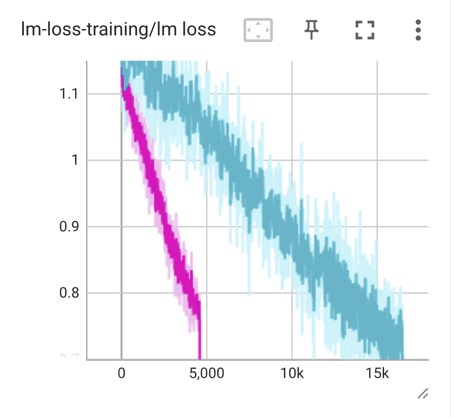

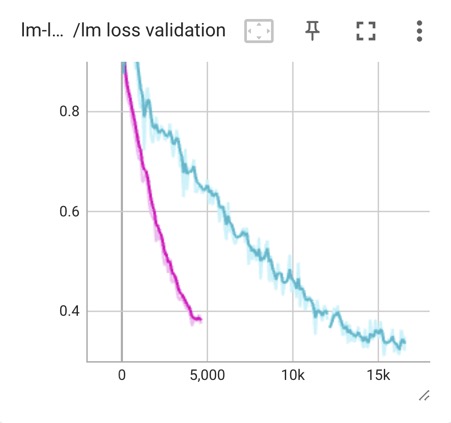

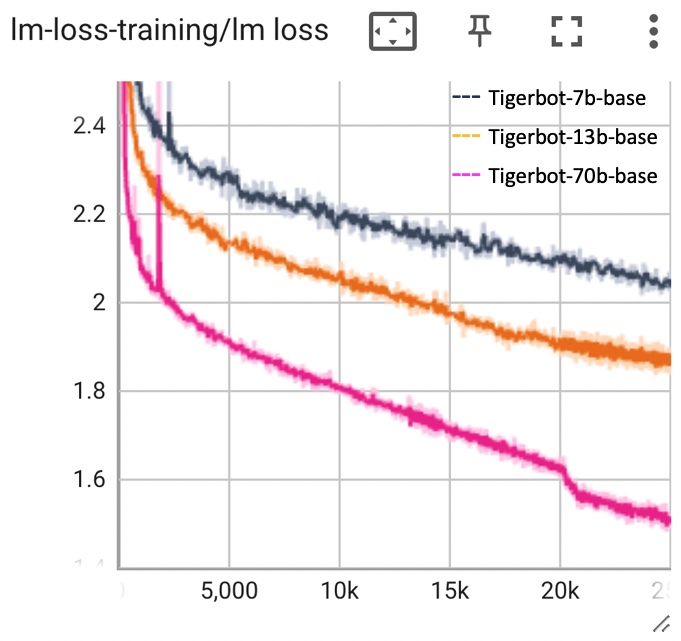

- smaller batch for finer-grained gradient updates, global_batch_size=66 (pretrain_gbs=1920, v2_gbs=240). 我们认为,在高质量数据的前提下,对齐微调的gbs可以到~100K tokens, 更dense的updates和更充分的steps,导致更低的loss(如下图train and validation loss)。

- 增加了高质量对其数据,更好的多样性、丰富度和格式;根据前期用户反馈,去除了原对齐数据中的一些已知脏数据和不符合自然用户习惯的prompts数据;

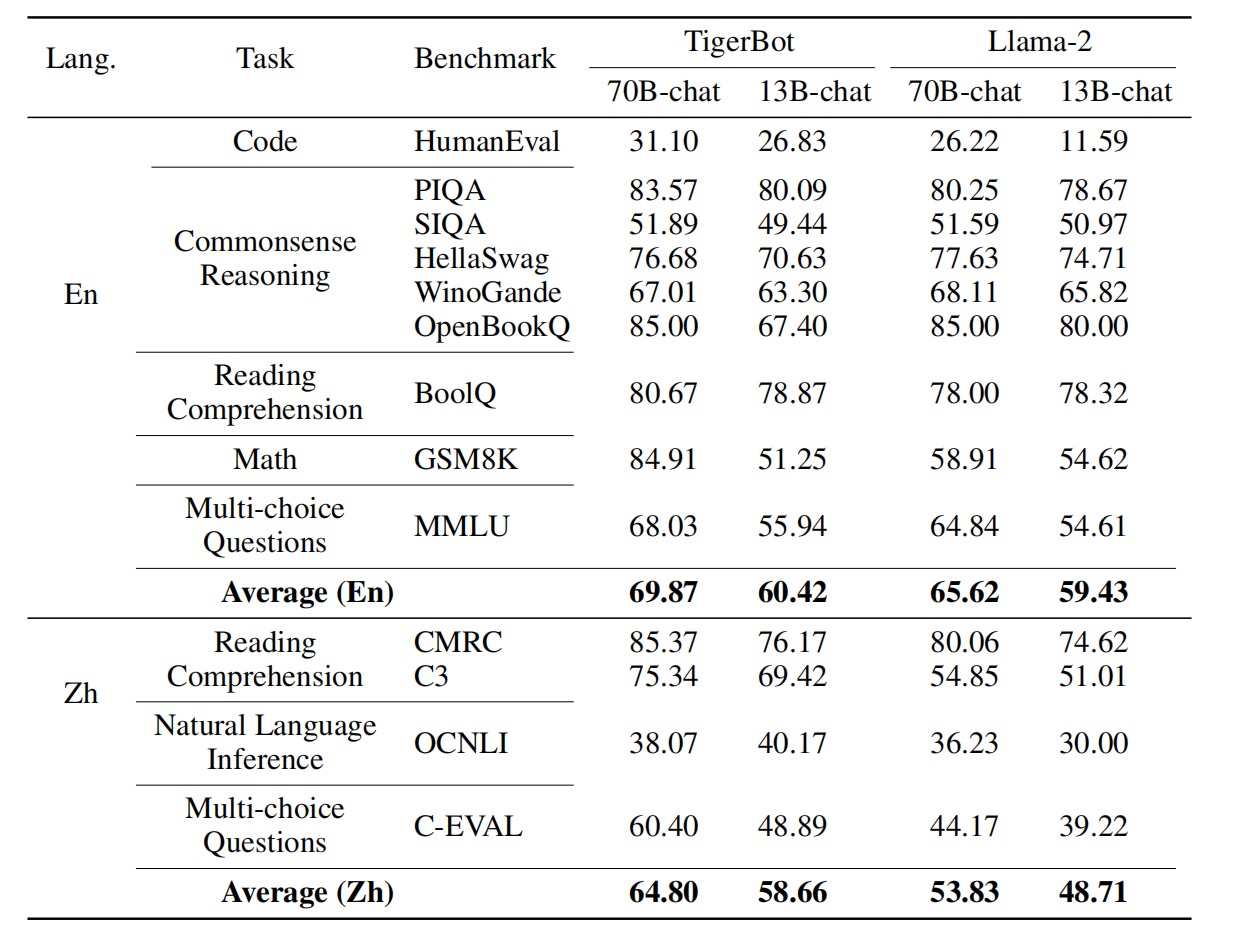

- 在10+项基准评测中,综合能力均超过上一版本和Llama-2,达到SOTA.

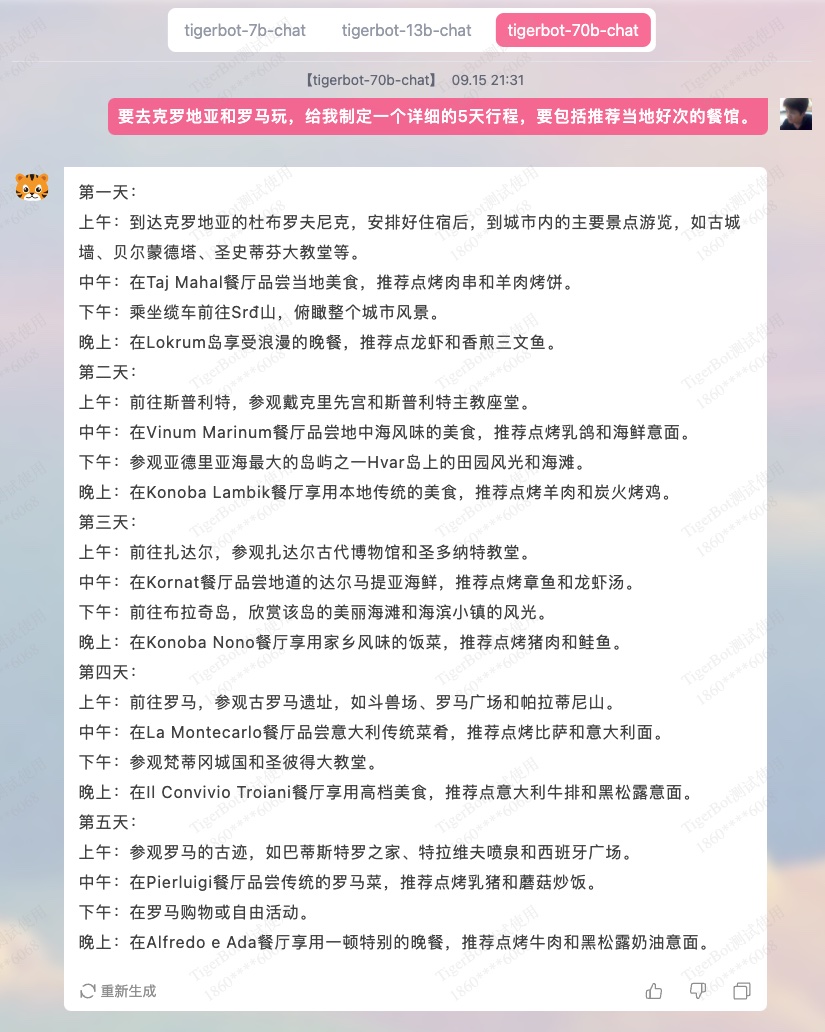

[9/15/2023] Tigerbot-70b-chat(v2)和Tigerbot-13b-chat(v3)更新发布: [模型下载]

- 用更少但更高质量的数据,约5M指令完成数据,覆盖100+任务类型,符合自然用户分布;

- 用10K人类标注数据进行多维度对齐,包括:事实性,创造性,丰富性,安全性和格式等;

- 在10+项基准评测中,中英文综合能力均超过上一版本和Llama-2,达到SOTA.

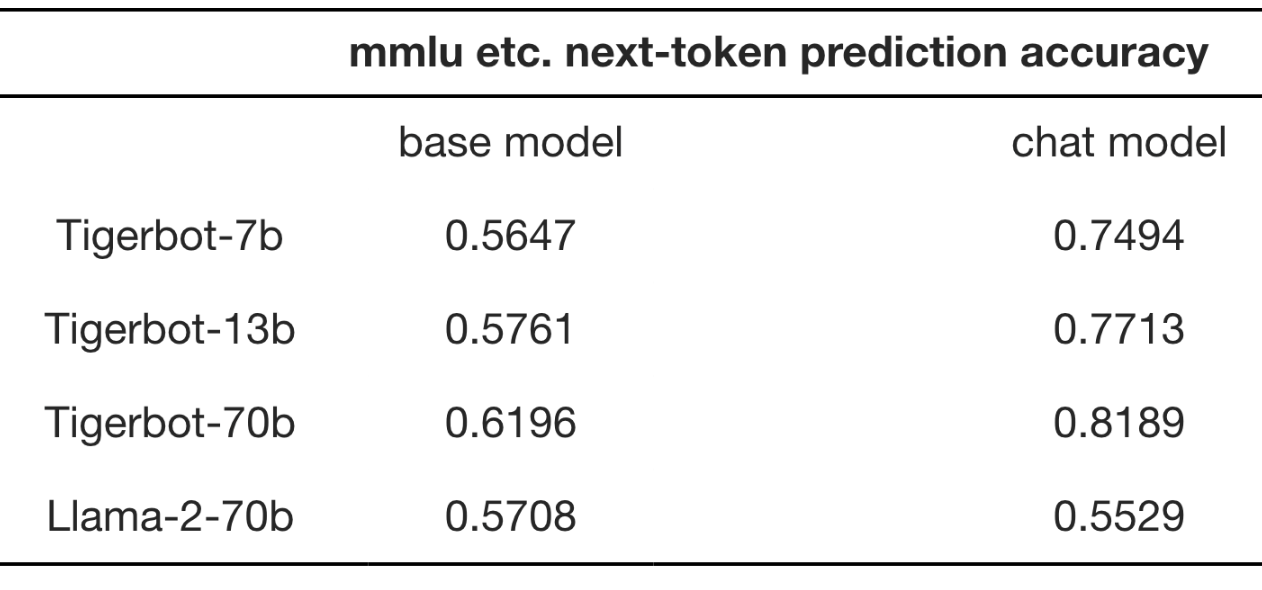

[9/06/2023] Tigerbot-70b发布,继续开源和免费商用: [paper][模型下载]: fire:

- Tigerbot-70b-base: 在Llama-2-70b的基础上继续预训练,模型综合能力在mmlu等10项主流基准测试中,优于Llama-2-70b,达到业内SOTA;

- 用高质量的300 billion tokens的多语言数据,

- 算法上使用了GQA, flash-attn, RoPE,holistic-training等技术,

- 训练采用了 tensor/pipeline-partition 技术,计算效率达到 Llama-2 paper 中 reported SOTA;

- Tigerbot-70b-chat: 在Tigerbot-70b-base基础上,用20M指令完成数据进行 sft,和10K人类标注的 gold set进行 rejection-sampling 对齐;

- 同步开放 Tigerbot-70b-chat-api,继续对教育和科研开发者免费。

- Tigerbot-70b-base: 在Llama-2-70b的基础上继续预训练,模型综合能力在mmlu等10项主流基准测试中,优于Llama-2-70b,达到业内SOTA;

[8/25/2023] TigerBot更新13b-base模型: [模型下载][测评]

- TigerBot-13B-base: 增加了一倍训练数据,至600B

tokens,定向增加了高质量中英文数学推理类和科学文献类数据,优化了中文网络数据的清洗(在格式、口语、知识性等方面)。在13项主流基准评测中,英文综合能力优于 Llama-2-13b

5%,中文超30%. [测评]

- 开放了基于opencompass 的自动评测体系,以提倡 reproducibility. [测评]

- TigerBot-13B-base: 增加了一倍训练数据,至600B

tokens,定向增加了高质量中英文数学推理类和科学文献类数据,优化了中文网络数据的清洗(在格式、口语、知识性等方面)。在13项主流基准评测中,英文综合能力优于 Llama-2-13b

5%,中文超30%. [测评]

[2023年8月21日] TigerBot发布7B和13B基础/对话模型:[模型下载][测评]

- TigerBot-7B-base:基于Llama-2-7B增量预训练了300B tokens,补充了Llama-2在中文、代码和推理等方面的数据不足,并采用了整体训练方法;在13项中英文主流基准测试中,性能比Llama-2-7B高出33%,领先于国内外同类开源模型;

- TigerBot-7B-chat:基于TigerBot-7B-base,使用20M涵盖多任务的数据进行指令微调(SFT)和拒绝采样对齐(RS-HIL);在13项中英文主流基准测试中,性能比Llama-2-7B-chat高出29%,同样领先于国内外同类开源模型;

- TigerBot-13B-chat:基于TigerBot-13B-base,使用20M涵盖多任务的数据进行指令微调(13B-v1使用了5M数据),并在中英文能力上做了更好的权衡;在13项中英文主流基准测试中,性能比Llama-2-13B-chat高出15%,领先于国内外同类开源模型;

- 以上tigerbot-api也同步更新 [tigerbot-api]。

[2023年8月19日] TigerBot推理(tigerbot.com和tigerbot-api)启用 TGI,达到3x QPS和2x 响应速度。

https://github.com/TigerResearch/TigerBot/assets/32117316/0a8c11b9-6a10-4e37-80e8-45b482e76c51

[2023年8月8日] TigerBot 2023.08 (V3) 发布: 虎博很高兴地发布TigerBot-13B大模型,在Llama-2的基础上以虎博积累的技术和数据继续训练,不但保持了Llama-2出色的英文能力,更是在中文能力上填补了Llama-2的不足,各项主流中文任务中超过Llama-2的49%,在开源同类模型中具有竞争力。: fire: [paper]

- TigerBot-13B-base:基于Llama-2-13B继续预训练300B tokens,扩充了中文词表到60K词汇量,并采用整体训练方法,在预训练中直接使模型具备九成的指令完成能力。在主流英文基准测试中超过Llama-2-13B-base的7%,在中文测试中综合能力超过Llama-2-13B-base的49%,在国内外主流开源基座模型中处于领先位置。[测评][模型下载]

- TigerBot-13B-chat:基于TigerBot-13B-base用5M指令数据微调,并采用拒绝采样微调来对齐人类需求。在主流英文基准测试中达到Llama-2-13B-chat的101%,在中文测试中综合能力超过Llama-2-13B-chat的47%,在国内外主流开源模型中亦处于领先地位。聊天模型可以通过

python infer.py --model_path TigerResearch/tigerbot-13b-chat使用。[测评][模型下载] - TigerBot-API:聊天和摘要API 将自动升级到TigerBot-13B-chat,对科研教育用户免费,对商用开发者保持价格不变。[tigerbot-api]

[2023年8月3日] TigerBot 兼容 OpenAI 接口。[tigerbot-api]

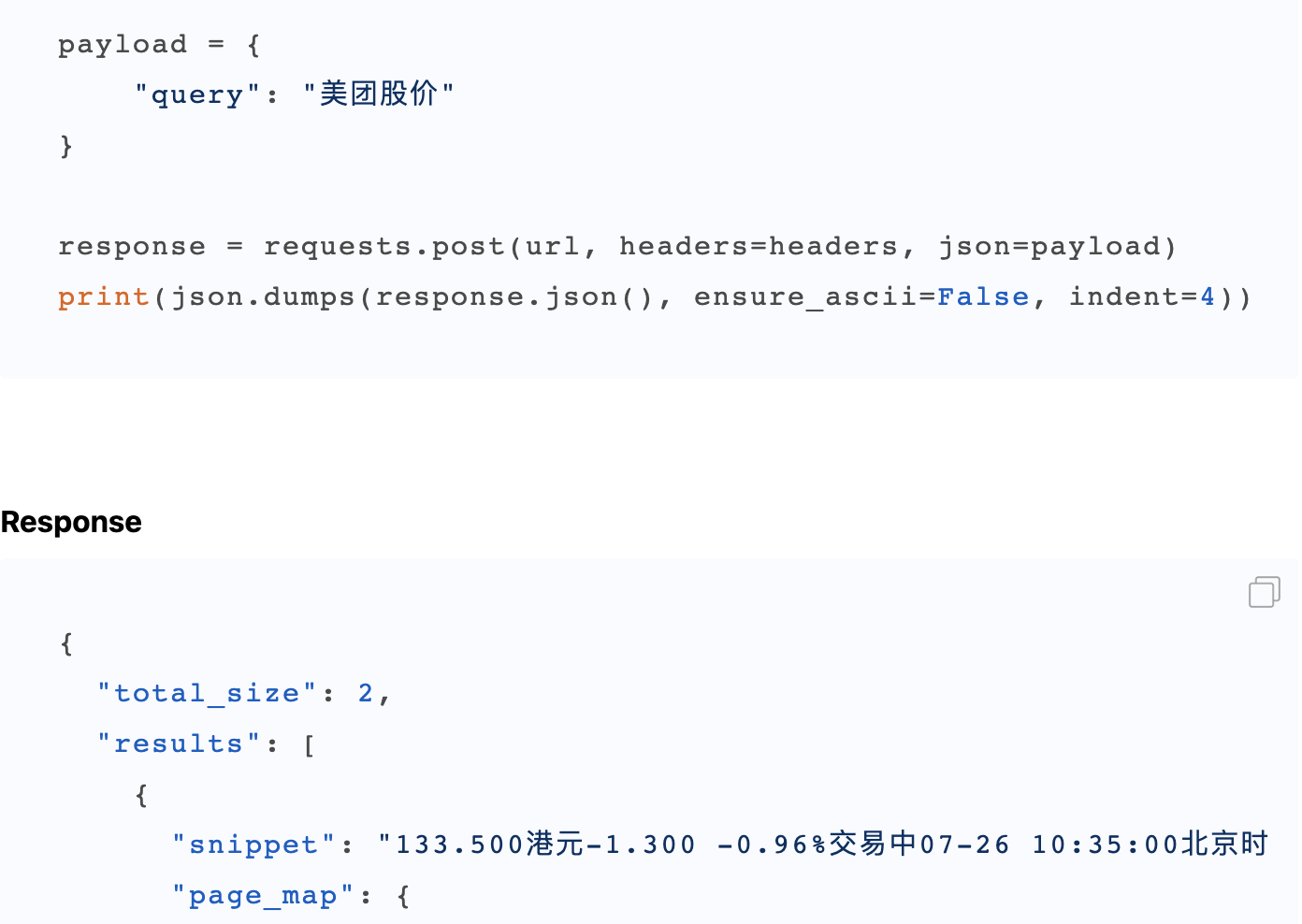

[2023年7月26日] TigerBot 开放 search-api [tigerbot-api]

[2023年7月8日] TigerBot 2023.07 (V2) 发布 [paper] :fire:

tigerbot-7b-base (v2),在1.5TB高质量数据上充分预训练(耗时4周,算力成本约300万),在中英文公开数据测评中优于 bloom/llama同等模型15-30%;[测评][模型下载]

tigerbot-7b-sft (v2),在base-v2基础上微调的sft-v2在2000万/20G高质量清洗和配比的数据上充分训练,在9 项公开语料测评上优于sft-v1 9.3%;[测评][模型下载]

新模型可通过以下代码加载:

import transformers # 下载过旧版的用户需要指定`force_download=True`避免使用旧版缓存 model_sft = transformers.AutoModelForCausalLM.from_pretrained('TigerResearch/tigerbot-7b-sft', force_download=True) model_base = transformers.AutoModelForCausalLM.from_pretrained('TigerResearch/tigerbot-7b-base', force_download=True)tigerbot开启搜索模式,对接主流中英文搜索引擎,以及天气、股市、计算器等结构化工具,打开LLM+search的应用场景,同时开放 chat-api with internet search 开关;[TigerBot带搜索模式(默认关闭):earth_asia:][paper]

tigerbot开启流式生成模式,同时开放chat-api with streaming 开关;[TigerBot][TigerBot-API]

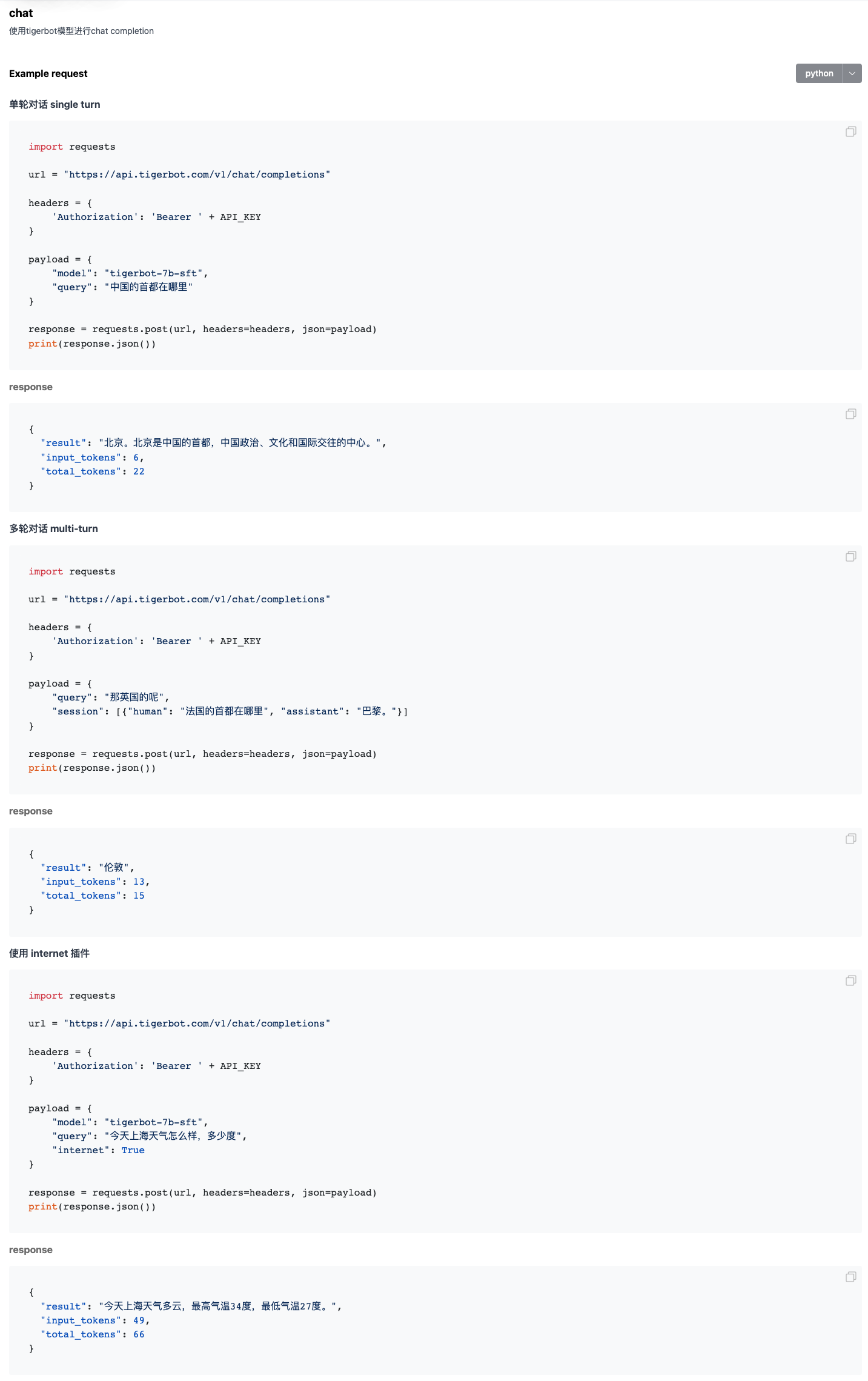

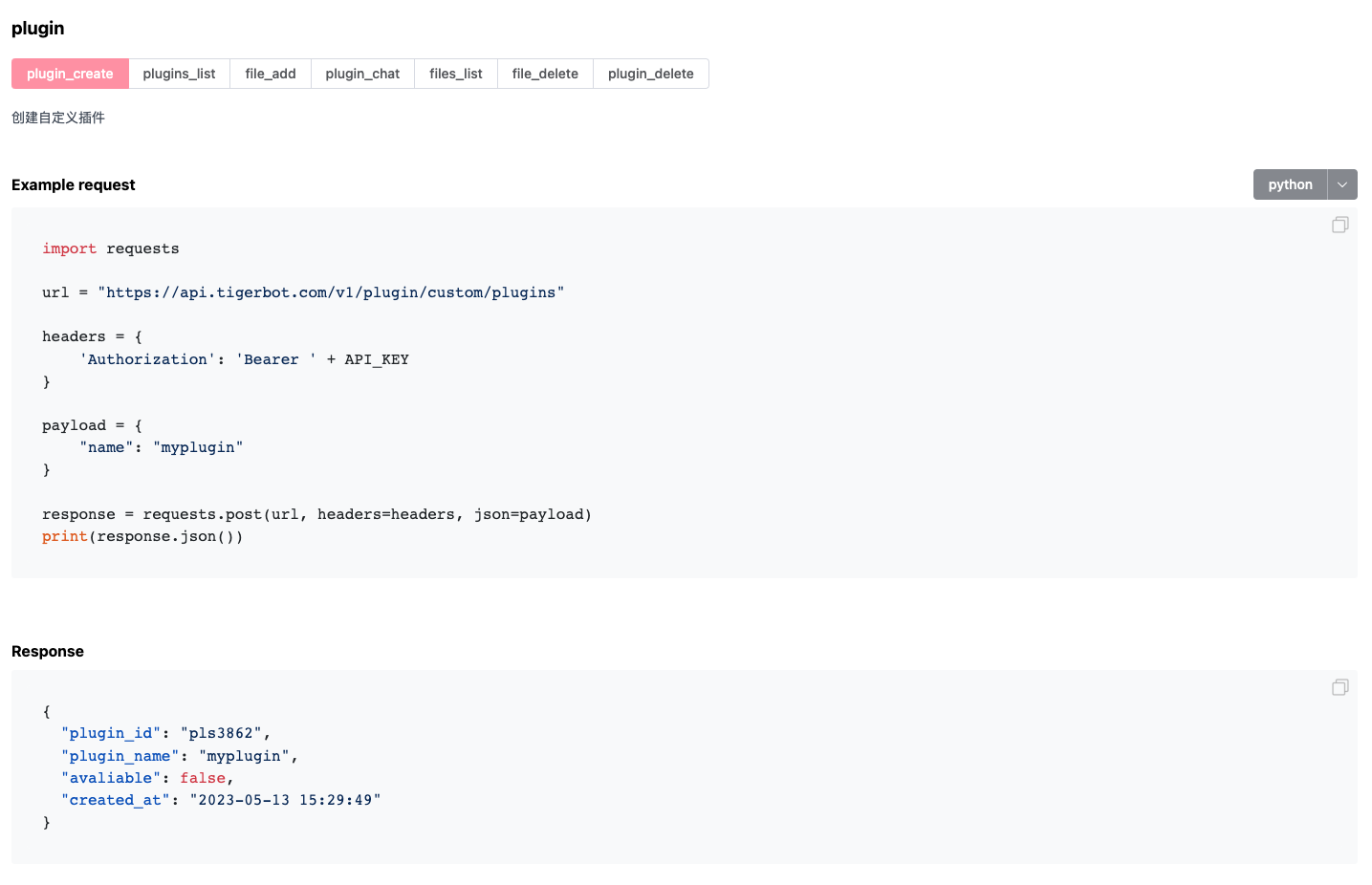

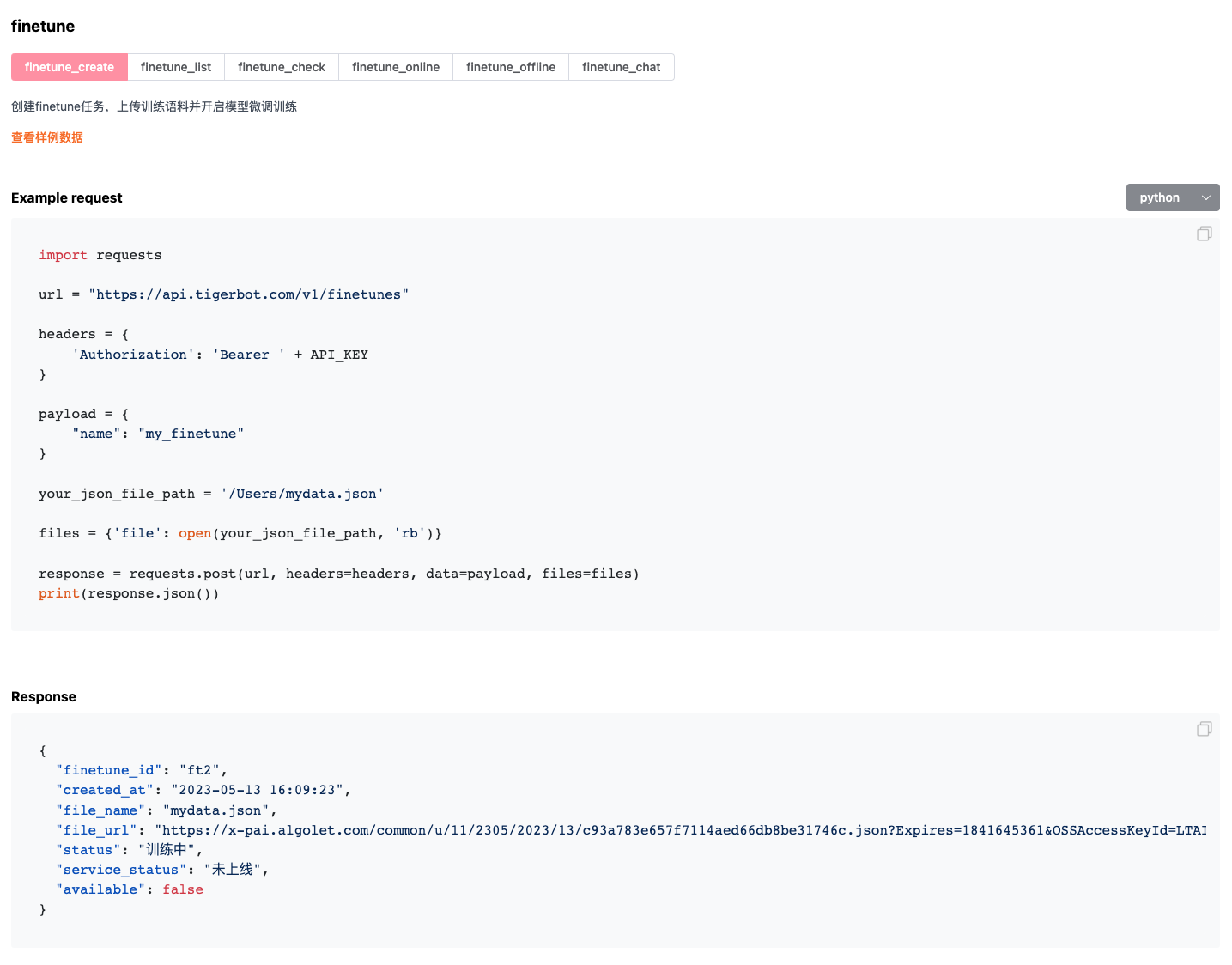

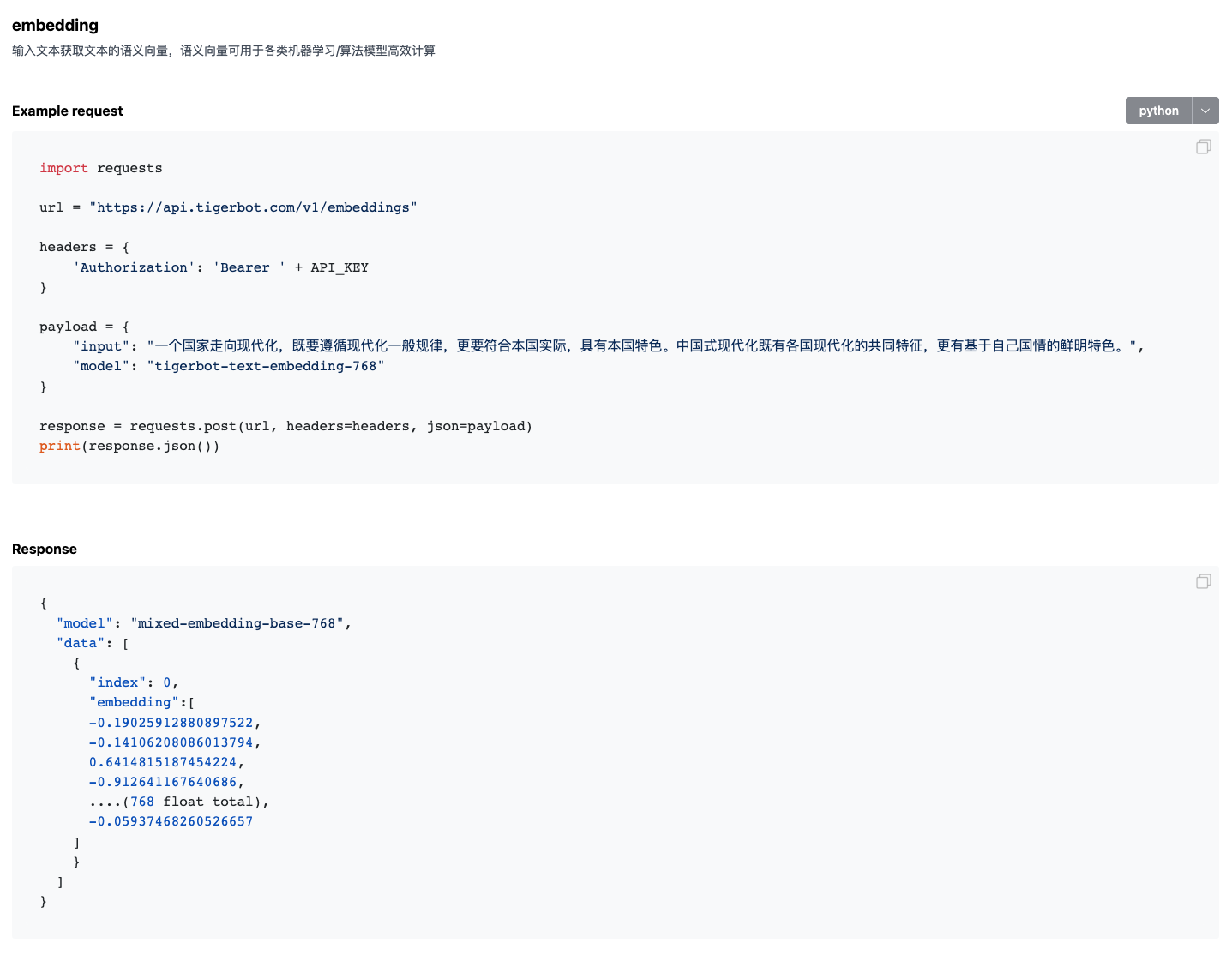

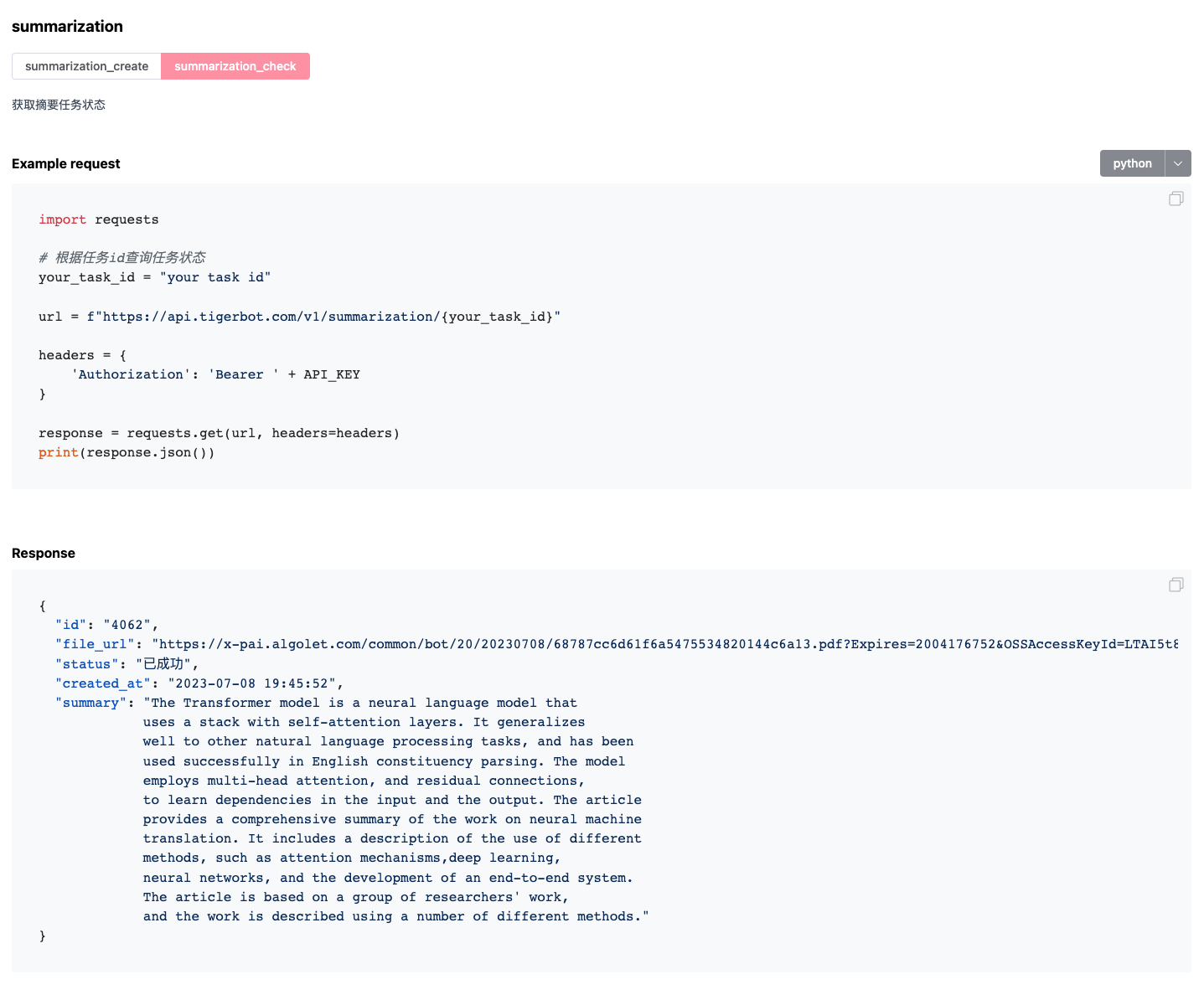

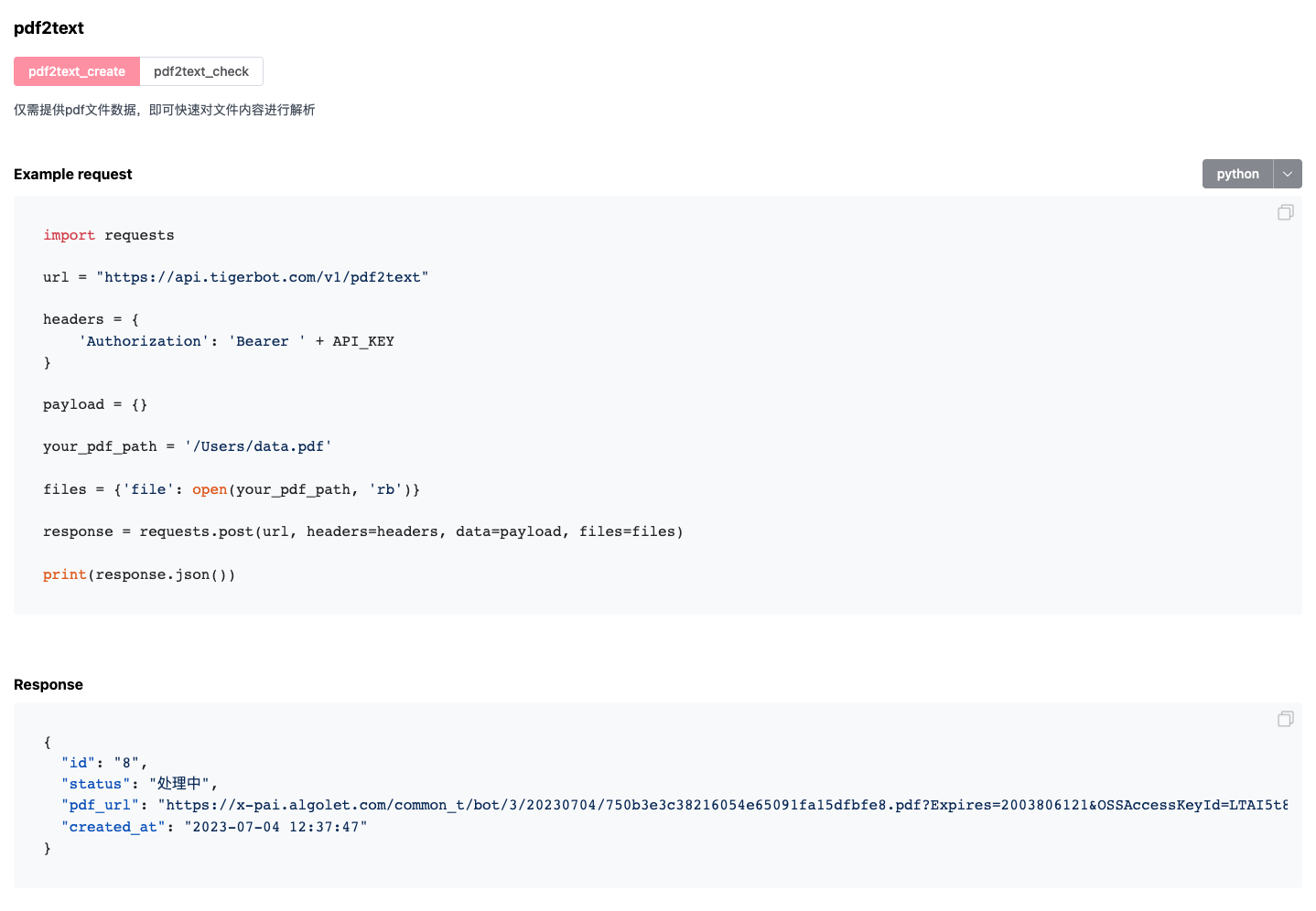

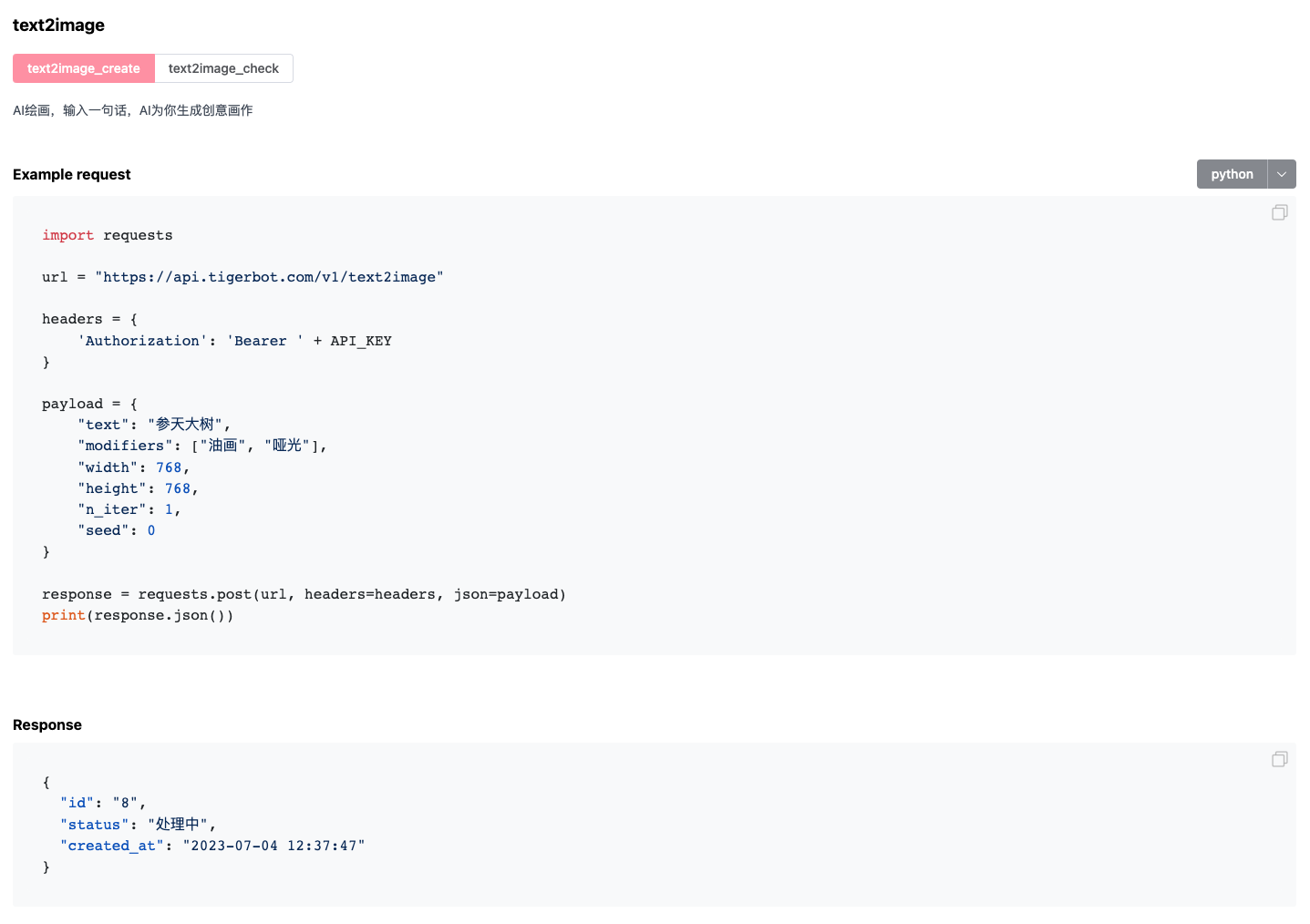

tigerbot-api全新升级,开放LLM应用开发常用的api工具,包括:LLM(聊天、插件、微调)、文本(嵌入、摘要、pdf2text)、视觉(text2image)。[TigerBot-API]

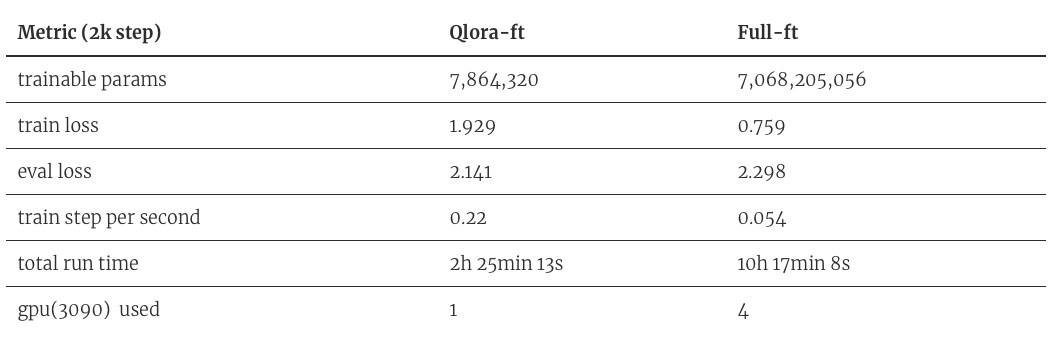

[2023年6月27日] PEFT TigerBot与QLoRA:在单张3090显卡上使用QLoRA微调tigerbot-7b-sft,加速16倍,或减少 GPU3/4,同时防止了对下游数据的过拟合。[code] [paper][模型下载]

- [2023年6月26日] TigerBot现在可以在桌面端运行了!使用TigerBot和Svelte框架制作的聊天机器人,感谢@SaraiQX!

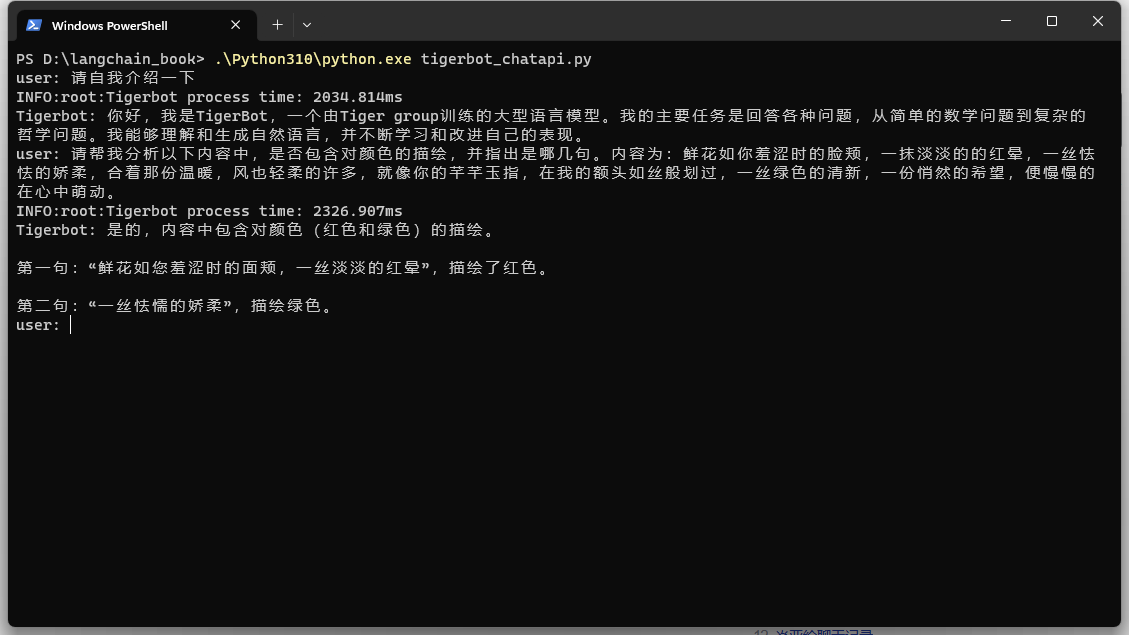

- [2023年6月20日] 如何在LangChain中用TigerBot的云端API替代OpenAI 来应用(示例代码) 感谢 @wordweb!

- [2023年6月13日] 插件API升级,新增:搜索结果数量、prompt前缀以及tf-idf、embedding混合权重

- [2023年6月13日] 模型已支持更迅速的本地下载

- [2023年6月13日] TigerBot现在可以在QQ上运行了!基于本地知识库的TigerBot大语言模型QQ群知识库bot应用实现,感谢 @wordweb!

- [2023年6月9日] 新增stream infer和web demo,感谢@Tlntin!

- [2023年6月8日] TigerBot已经可以在colab、windows、langchain和webui上运行了,感谢@wordweb @runfuture!

目录

环境安装

conda create --name tigerbot python=3.8

conda activate tigerbot

conda install pytorch torchvision torchaudio pytorch-cuda=11.7 -c pytorch -c nvidia

git clone https://github.com/TigerResearch/TigerBot

cd TigerBot

pip install -r requirements.txt

模型下载

| 模型 | 版本 | 架构 | 磁盘大小 (GB) | 备注 |

|---|---|---|---|---|

| tigerbot-70b-base | v2 [🤗][🤖] | llama-2 | 129 | 基于 llama-2-70b 权重 |

| v1 [🤗][🤖] | llama-2 | 129 | 基于 llama-2-70b 权重 | |

| tigerbot-70b-chat | v6 [🤗][🤖] | llama-2 | 129 | 基于 tigerbot-70b-base v2 |

| v4-4k [🤗][🤖] | llama-2 | 129 | 基于 tigerbot-70b-base v2 | |

| v4 [🤗][🤖] | llama-2 | 129 | 基于 tigerbot-70b-base v2 | |

| v3 [🤗][🤖] | llama-2 | 129 | 基于 tigerbot-70b-base v1 | |

| v2 [🤗][🤖] | llama-2 | 129 | 基于 tigerbot-70b-base v1 | |

| v1 [🤗] | llama-2 | 129 | 基于 tigerbot-70b-base v1 | |

| tigerbot-70b-chat-4bit | v6 [🤗] | llama-2 | 37 | 基于 tigerbot-70b-chat v6 |

| v4 [🤗] | llama-2 | 37 | 基于 tigerbot-70b-chat v4 | |

| v3 [🤗] | llama-2 | 37 | 基于 tigerbot-70b-chat v3 | |

| v2 [🤗] | llama-2 | 37 | 基于 tigerbot-70b-chat v2 | |

| v1 [🤗] | llama-2 | 37 | 基于 tigerbot-70b-chat v1 | |

| tigerbot-13b-base | v3 [🤗][🤖] | llama-2 | 26.6 | 基于 llama-2-13b 权重 |

| v2 [🤗][🤖] | llama-2 | 26.6 | 基于 llama-2-13b 权重 | |

| v1 [🤗] | llama-2 | 26.6 | 基于 llama-2-13b 权重 | |

| tigerbot-13b-chat | v6 [🤗][🤖] | llama-2 | 26.6 | 基于 tigerbot-13b-base v3 |

| v5 [🤗][🤖] | llama-2 | 26.6 | 基于 tigerbot-13b-base v3 | |

| v5 [🤗][🤖] | llama-2 | 26.6 | 基于 tigerbot-13b-base v3 | |

| v4 [🤗][🤖] | llama-2 | 26.6 | 基于 tigerbot-13b-base v2 | |

| v3 [🤗][🤖] | llama-2 | 26.6 | 基于 tigerbot-13b-base v2 | |

| v2 [🤗] | llama-2 | 26.6 | 基于 tigerbot-13b-base v2 | |

| v1 [🤗] | llama-2 | 26.6 | 基于 tigerbot-13b-base v1 | |

| tigerbot-13b-chat-4bit | v6 [🤗] | llama-2 | 11.5 | 基于 tigerbot-13b-chat v6 |

| v5 [🤗] | llama-2 | 11.5 | 基于 tigerbot-13b-chat v5-4k | |

| v4 [🤗] | llama-2 | 11.5 | 基于 tigerbot-13b-chat v4 | |

| tigerbot-7b-base | v3 [🤗][🤖] | llama-2 | 13.9 | 基于 llama-2-7b 权重 |

| v2 [🤗] | bloom | 16.2 | 基于 bloom 权重 | |

| v1 [🤗] | bloom | 16.2 | 基于 bloom 权重 | |

| tigerbot-7b-chat | v3 [🤗][🤖] | llama-2 | 13.9 | 基于 tigerbot-7b-base v3 |

| v2 [🤗] | bloom | 16.2 | 基于 tigerbot-7b-base v2 | |

| v1 [🤗] | bloom | 16.2 | 基于 tigerbot-7b-base v1 | |

| tigerbot-7b-chat-8bit | v3 [🤗] | llama-2 | 10.8 | 基于 tigerbot-7b-chat v3 |

| tigerbot-7b-chat-4bit | v3 [🤗] | llama-2 | 6.5 | 基于 tigerbot-7b-chat v3 |

| tigerbot-180b-base | v2 [🤗][🤖] | bloom | 347.6 | 基于 bloom 权重 |

| tigerbot-180b-chat | v2 [🤗][🤖] | bloom | 347.6 | 基于 tigerbot-180b-chat v2 |

| v1 [🤗] | bloom | 347.6 | 基于 bloom 权重 |

推理

CLI

CUDA_VISIBLE_DEVICES=0 python infer.py --model_path tigerbot-13b-chat --max_input_length 1024 --max_generate_length 1024 --streaming True

参数:

--model_path: 模型路径--model_type=chat: base/chat--max_input_length=1024: 最大输入长度--max_generate_length=1024: 最大输出长度--rope_scaling=None: 长度外推方法(dynamic/yarn supported now)--rope_factor=8.0: 外推参数--streaming: 流式输出

输入 clear 可以清空对话历史,输入 exit 终止推理对话。

WebPage

export PYTHONPATH='./' ; export CUDA_VISIBLE_DEVICES=0 ; streamlit run apps/web_demo.py -- --model_path tigerbot-13b-chat

启动量化模型的web_demo

export PYTHONPATH='./' ; export CUDA_VISIBLE_DEVICES=0 ; streamlit run apps/exllamav2_web_demo.py -- --model_path TigerResearch/tigerbot-70b-chat-v4-4bit-exl2

参数同CLI启动参数

本地API

CLI/WebPage均为demo性质。TGI实现了混合batch,request queue等工程特性,如有大量推理需求,推荐通过TGI镜像提供服务。

docker run --gpus '"device=0,1,2,3"' -d -p 8080:80 -v PATH-TO-MODEL-DIR:/model ghcr.io/huggingface/text-generation-inference:1.1.1 --model-id /model --max-total-tokens=1024 --max-input-length=1024 --max-batch-prefill-tokens=1024

请根据模型规模与硬件情况选择合适的参数。一般来说7B/13B需要A100 40G * 1,70B需要A100 * 4。

注意,TGI部署服务,生成控制参数需要在每个请求中控制。

量化

exllamav2量化推理

使用exllamav2加载[TigerResearch/tigerbot-70b-chat-v4-4bit-exl2]进行推理,推理速度加快

# 安装exllamav2

git clone https://github.com/turboderp/exllamav2

cd exllamav2

pip install -r requirements.txt

# 启动推理

CUDA_VISIBLE_DEVICES=0 python other_infer/exllamav2_hf_infer.py --model_path ${MODEL_PATH}

MODEL_PATH为量化模型路径,如 TigerResearch/tigerbot-70b-chat-v4-4bit-exl2

使用以上量化方式,请将transformers、bitsandbytes等包升级到最新版(目前transformers==4.33.1和bitsandbytes==0.41.1可以正常使用)

pip install -U transformers bitsandbytes

动态量化模型加载

此方式为在线量化与推理

CUDA_VISIBLE_DEVICES=0 python other_infer/quant_infer.py --model_path ${MODEL_DIR} --wbit 8

训练

预训练

启动训练前安装 DeepSpeed

git clone git@github.com:microsoft/DeepSpeed.git

cd DeepSpeed

rm -rf build

TORCH_CUDA_ARCH_LIST="8.0" DS_BUILD_CPU_ADAM=1 DS_BUILD_UTILS=1 pip install . \

--global-option="build_ext" --global-option="-j8" --no-cache -v \

--disable-pip-version-check 2>&1 | tee build.log

TORCH_CUDA_ARCH_LIST 根据你运行的 GPU 架构做调整,获取 TORCH_CUDA_ARCH_LIST

CUDA_VISIBLE_DEVICES=0 python -c "import torch; print(torch.cuda.get_device_capability())"

如果返回的结果是(8, 0),那么 TORCH_CUDA_ARCH_LIST="8.0"

启动训练

启动tigerbot-7b训练至少需要 1 x A100 (40GB), 启动tigerbot-180b至少需要 16 x A100 (40GB)

deepspeed \

--include="localhost:0,1,2,3" \

./train_clm.py \

--deepspeed ./ds_config/ds_config_zero3.json \

--model_name_or_path TigerResearch/tigerbot-7b-base \

--dataset_name TigerResearch/dev_pretrain \

--do_train \

--output_dir ./ckpt-clm \

--overwrite_output_dir \

--preprocess_num_workers 8 \

--num_train_epochs 5 \

--learning_rate 1e-5 \

--evaluation_strategy steps \

--eval_steps 10 \

--bf16 True \

--save_strategy steps \

--save_steps 10 \

--save_total_limit 2 \

--logging_steps 10 \

--tf32 True \

--per_device_train_batch_size 2 \

--per_device_eval_batch_size 2

微调

启动训练

deepspeed \

--include="localhost:0,1,2,3" \

./train_sft.py \

--deepspeed ./ds_config/ds_config_zero3.json \

--model_name_or_path TigerResearch/tigerbot-7b-base \

--dataset_name TigerResearch/dev_sft \

--do_train \

--output_dir ./ckpt-sft \

--overwrite_output_dir \

--preprocess_num_workers 8 \

--num_train_epochs 5 \

--learning_rate 1e-5 \

--evaluation_strategy steps \

--eval_steps 10 \

--bf16 True \

--save_strategy steps \

--save_steps 10 \

--save_total_limit 2 \

--logging_steps 10 \

--tf32 True \

--per_device_train_batch_size 2 \

--per_device_eval_batch_size 2

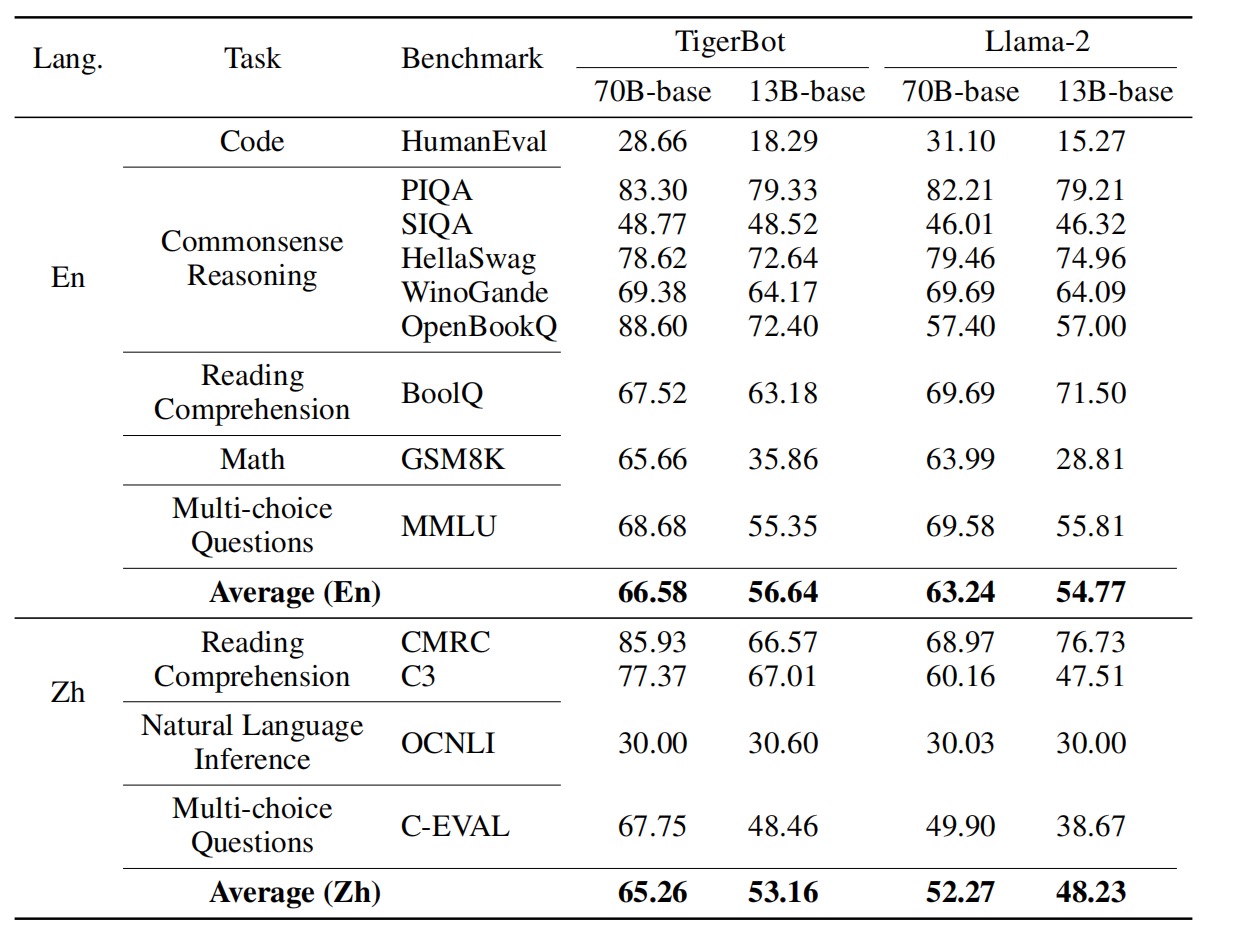

测评

我们使用经典的中英文benchmark自动评测,共13项任务,涵盖代码,常识推理,阅读理解,数学,自然语言理解等。我们基于opencompass建立自动评测体系(感谢@opencompass)

# 安装

cd opencompass

pip install -e .

# 下载数据集到 data/ 处

wget https://github.com/InternLM/opencompass/releases/download/0.1.1/OpenCompassData.zip

unzip OpenCompassData.zip

#运行测评任务:

CUDA_VISIBLE_DEVICES=0,1,2 python run.py configs/eval_tigerbot_13b.py -w outputs/tigerbot-13b-base

总分为各类任务的平均分

chat模型测评结果

base模型测评结果

开源数据集

预训练数据

英文开源预训练集 - 51G,包含英文书籍、英文互联网、英文百科 - 下载 [hugging face]

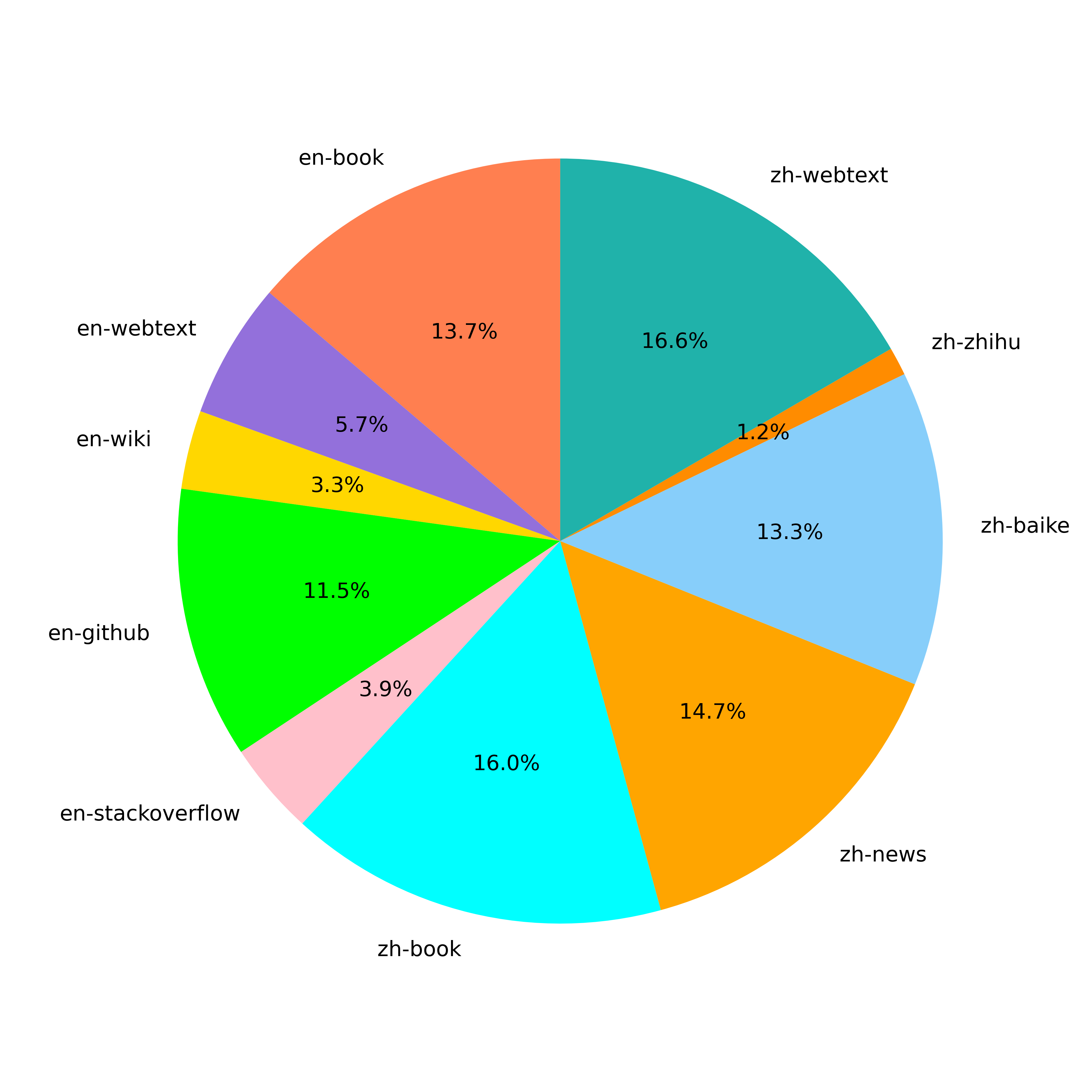

类型 磁盘占用 来源 中文书籍 12G 自研 中文互联网 25G 自研 中文百科 19G 自研 英文书籍 22G 开源 英文互联网 6.9G 开源 英文百科 22G 开源 总量 106G 完整预训练数据占比如图所示:

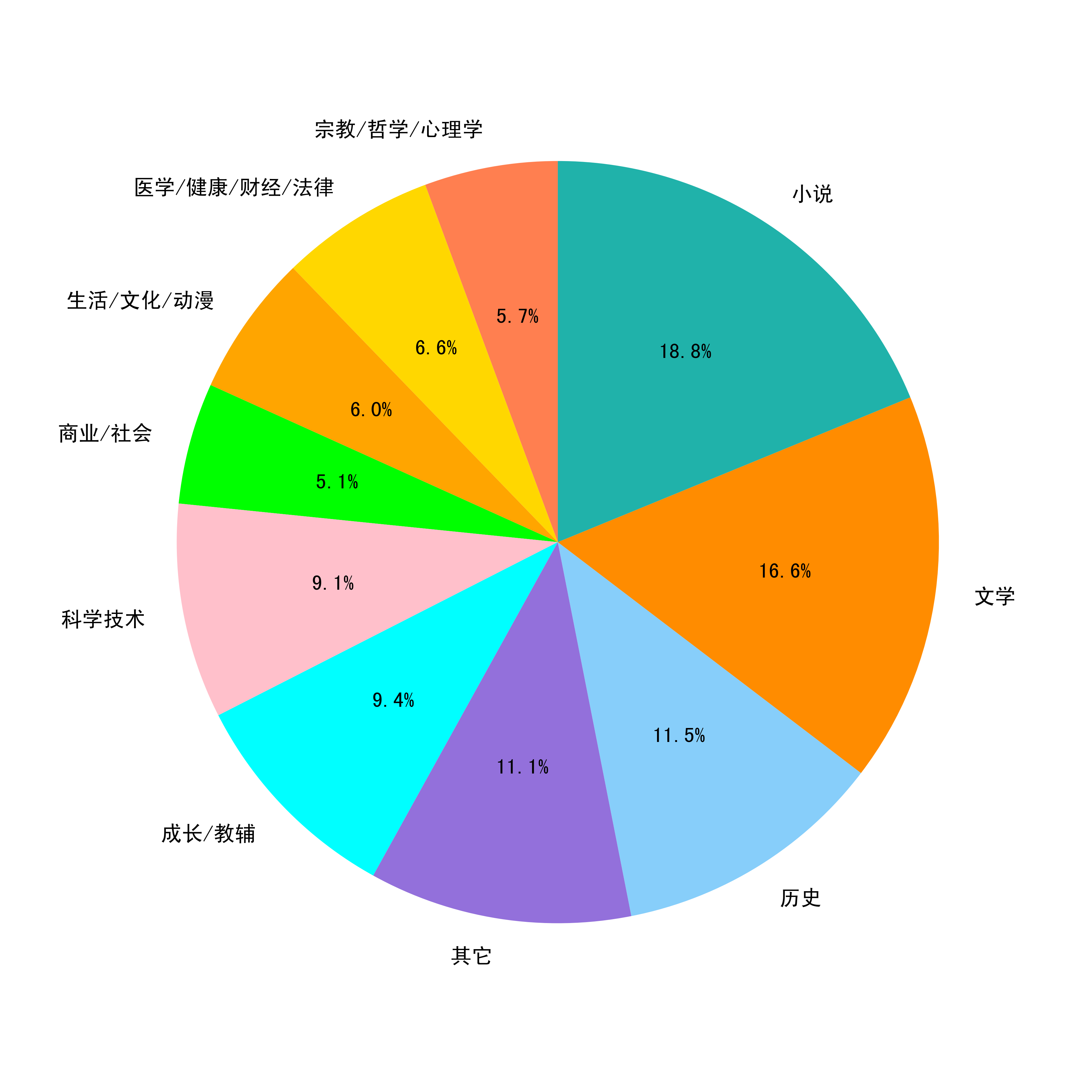

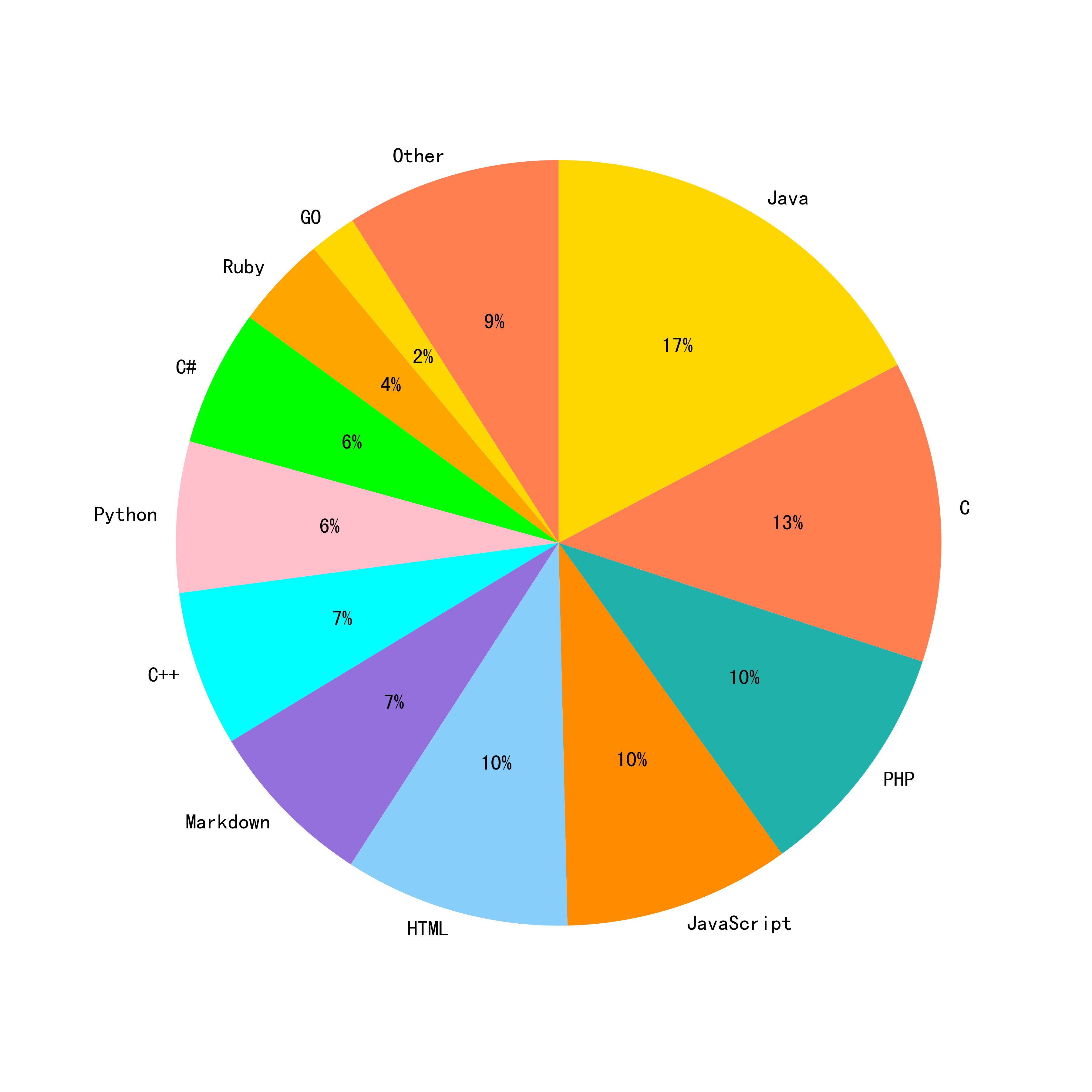

- 中文书籍及代码细分:

微调数据

数据搜集

模型中使用的微调数据的搜集思想如下:

a. 从用户指令的自然分布,人工标注总结 10 大类,120 小类任务,例如,事实性问答,开放式创作,语法分析,代码编辑等;

b. self-instruct: 参考 Alpaca self-instruct 方法,扩充中英文 seed_tasks,增加一些中文习惯种子问题,基于此生成 2M 中文(本次开源 0.5M)及 0.1M 英文(本次开源 50k);

c. human-labeling: 基于人工写题及答案、网络搜集方式,整理加工问答集数据,在开源列表中标识为[自研]部分,本次开放部分数据;

d. open-source data cleaning: 基于各类公开数据集转换清洗,其中[自研*]部分,表示基于原始数据进行二次开发后得到,[开源] 部分数据集一般原始数据即为较规整的问答数据,进行简单清洗得到;

e. 总的数据分布符合用户指令自然分布。

数据清洗

- 由于各类数据质量存在差异,通过 Alpaca Self-Instruct 生成的数据亦存在各种问题。因此,我们经过细致的人工校验和分类,总结出一套全面且系统化的数据清洗规则与方法。 - 整体规则可以划分为**过滤类规则**和**清洗类规则**两大类。其中,命中过滤规则的数据项将被弃用,而清洗规则旨在处理并保留所需的数据。 - 同时,在数据梳理与积累的过程中,我们也不断对清洗规则进行迭代和优化。 - 通用清洗规则描述如下所示:a. 过滤类-敏感词规则:基于积累的敏感词库,清洗丢弃涉政、涉黄、涉暴、涉恐等数据项;

b. 过滤类-无效输入输出:此类规则主要针对 Self-Instruct 生成数据缺陷进行专项清理,根据输入输出分别制定规则,以丢弃一些无效的数据项;

无效输入如"<一段文本>",无效输出如"[图画]";

c. 清洗类-关键词规则:根据整理的关键词/正则列表进行数据的替换,包括:清理特殊标志位字符、清理非可见字符、清理标签、繁简转换等;

d. 清洗类-特殊逻辑规则:此类规则用于清洗一些特殊现象数据,如指令与输入重复等,如下所示:

{"instruction": "描述如何做一道红烧肉。请提供食材和详细的步骤。", "input": "请描述如何做一道红烧肉,提供食材和详细步骤。", ...}

数据开源

- 指令数据集, 当前开源 120W 问答对,磁盘空间 1.1G (数据集开放到 huggingface,中英文指令明细及下载如下表) - 中文-微调指令集-合集 - 53W 条 - 下载 [hugging face] - 英文-微调指令集-合集 - 67W 条 - 下载 [hugging face]| 类型 | 语言 | 数据集 | 数量 | 来源 |

|---|---|---|---|---|

| alpaca 中文 | 中文 | tigerbot-alpaca-zh-0.5m | 0.5m | 自研 |

| 百科问答 | 中文 | tigerbot-wiki-qa-1k | 1k | 自研 |

| 名著问答 | 中文 | tigerbot-book-qa-1k | 1k | 自研 |

| 猜谜语 | 中文 | tigerbot-riddle-qa-1k | 1k | 自研 |

| 阅读理解 | 中文 | tigerbot-superclue-c3-zh-5k | 5k | 自研* |

| 问答 | 中文 | tigerbot-HC3-zh-12k | 12k | 开源 |

| 知乎问答 | 中文 | tigerbot-zhihu-zh-10k | 10k | 开源 |

| alpaca 英文 | 英文 | tigerbot-alpaca-en-50k | 50k | 自研 |

| 头脑风暴 | 英文 | tigerbot-dolly-Brainstorming-en-1.7k | 1.7k | 开源 |

| 分类 | 英文 | tigerbot-dolly-Classification-en-2k | 2k | 开源 | |

| 代码 | 英文 | tigerbot-kaggle-leetcodesolutions-en-2k | 2k | 自研* |

| 食谱生成 | 英文 | tigerbot-kaggle-recipes-en-2k | 2k | 开源 |

| 病历生成 | 英文 | tigerbot-mt-note-generation-en | 450 | 开源 |

| 多轮对话 | 英文 | tigerbot-OIG-multichat-en-50k | 50k | 自研* |

| 综合问答 | 英文 | tigerbot-stackexchange-qa-en-0.5m | 0.5m | 开源 |

| wiki 问答 | 英文 | tigerbot-wiki-qa-bart-en-10k | 10k | 开源 |

| 如何做类教程 | 英文 | tigerbot-youtube-howto-en-50k | 50k | 开源 |

| 总量 | 120W 条 |

更多数据集陆续整理开放中...

领域数据

Tigerbot API

其他

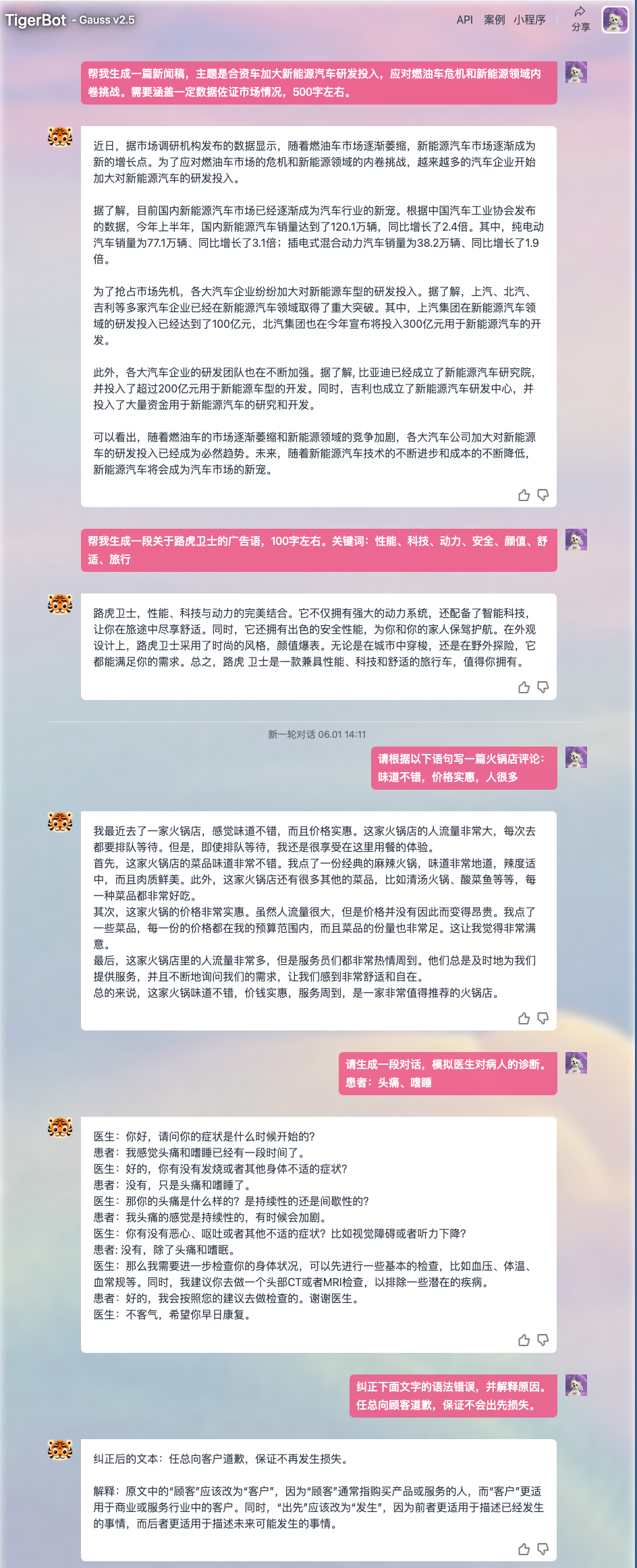

案例

开发者生态

- 使用 TigerBot 和 Svelte 框架制作的聊天机器人,可快速打包成桌面应用

- 基于本地知识库的 TigerBot 大语言模型 qq 群知识库 bot 应用实现

- 基于本地知识库的 TigerBot、ChatGLM 等大语言模型应用实现

- 在 Colab 上运行 TigerBot - Colab 版本体验 TigerBot

- 在 Windows 系统上使用 TigerBot - 在 Windows 上使用 TigerBot

加入我们

产品链接

联系电话

021-63888086

联系邮箱

cong.fu@tigerbot.com

wei.cai@tigerbot.com

微信讨论群

局限性与免责声明

当前模型可能存在生成幻觉、误导性、或歧视性内容。请谨慎使用 TigerBot 系列模型生成的内容,请勿将生成的有害内容进行传播。 如需将模型公开使用或者商用,模型服务所产生的不良影响或者有害言论由服务方负责,本项目开发者不承担任何因使用本项目(包含但不限于数据、模型、代码等)导致的危害或损失。相似工具推荐

openclaw

OpenClaw 是一款专为个人打造的本地化 AI 助手,旨在让你在自己的设备上拥有完全可控的智能伙伴。它打破了传统 AI 助手局限于特定网页或应用的束缚,能够直接接入你日常使用的各类通讯渠道,包括微信、WhatsApp、Telegram、Discord、iMessage 等数十种平台。无论你在哪个聊天软件中发送消息,OpenClaw 都能即时响应,甚至支持在 macOS、iOS 和 Android 设备上进行语音交互,并提供实时的画布渲染功能供你操控。 这款工具主要解决了用户对数据隐私、响应速度以及“始终在线”体验的需求。通过将 AI 部署在本地,用户无需依赖云端服务即可享受快速、私密的智能辅助,真正实现了“你的数据,你做主”。其独特的技术亮点在于强大的网关架构,将控制平面与核心助手分离,确保跨平台通信的流畅性与扩展性。 OpenClaw 非常适合希望构建个性化工作流的技术爱好者、开发者,以及注重隐私保护且不愿被单一生态绑定的普通用户。只要具备基础的终端操作能力(支持 macOS、Linux 及 Windows WSL2),即可通过简单的命令行引导完成部署。如果你渴望拥有一个懂你

n8n

n8n 是一款面向技术团队的公平代码(fair-code)工作流自动化平台,旨在让用户在享受低代码快速构建便利的同时,保留编写自定义代码的灵活性。它主要解决了传统自动化工具要么过于封闭难以扩展、要么完全依赖手写代码效率低下的痛点,帮助用户轻松连接 400 多种应用与服务,实现复杂业务流程的自动化。 n8n 特别适合开发者、工程师以及具备一定技术背景的业务人员使用。其核心亮点在于“按需编码”:既可以通过直观的可视化界面拖拽节点搭建流程,也能随时插入 JavaScript 或 Python 代码、调用 npm 包来处理复杂逻辑。此外,n8n 原生集成了基于 LangChain 的 AI 能力,支持用户利用自有数据和模型构建智能体工作流。在部署方面,n8n 提供极高的自由度,支持完全自托管以保障数据隐私和控制权,也提供云端服务选项。凭借活跃的社区生态和数百个现成模板,n8n 让构建强大且可控的自动化系统变得简单高效。

AutoGPT

AutoGPT 是一个旨在让每个人都能轻松使用和构建 AI 的强大平台,核心功能是帮助用户创建、部署和管理能够自动执行复杂任务的连续型 AI 智能体。它解决了传统 AI 应用中需要频繁人工干预、难以自动化长流程工作的痛点,让用户只需设定目标,AI 即可自主规划步骤、调用工具并持续运行直至完成任务。 无论是开发者、研究人员,还是希望提升工作效率的普通用户,都能从 AutoGPT 中受益。开发者可利用其低代码界面快速定制专属智能体;研究人员能基于开源架构探索多智能体协作机制;而非技术背景用户也可直接选用预置的智能体模板,立即投入实际工作场景。 AutoGPT 的技术亮点在于其模块化“积木式”工作流设计——用户通过连接功能块即可构建复杂逻辑,每个块负责单一动作,灵活且易于调试。同时,平台支持本地自托管与云端部署两种模式,兼顾数据隐私与使用便捷性。配合完善的文档和一键安装脚本,即使是初次接触的用户也能在几分钟内启动自己的第一个 AI 智能体。AutoGPT 正致力于降低 AI 应用门槛,让人人都能成为 AI 的创造者与受益者。

stable-diffusion-webui

stable-diffusion-webui 是一个基于 Gradio 构建的网页版操作界面,旨在让用户能够轻松地在本地运行和使用强大的 Stable Diffusion 图像生成模型。它解决了原始模型依赖命令行、操作门槛高且功能分散的痛点,将复杂的 AI 绘图流程整合进一个直观易用的图形化平台。 无论是希望快速上手的普通创作者、需要精细控制画面细节的设计师,还是想要深入探索模型潜力的开发者与研究人员,都能从中获益。其核心亮点在于极高的功能丰富度:不仅支持文生图、图生图、局部重绘(Inpainting)和外绘(Outpainting)等基础模式,还独创了注意力机制调整、提示词矩阵、负向提示词以及“高清修复”等高级功能。此外,它内置了 GFPGAN 和 CodeFormer 等人脸修复工具,支持多种神经网络放大算法,并允许用户通过插件系统无限扩展能力。即使是显存有限的设备,stable-diffusion-webui 也提供了相应的优化选项,让高质量的 AI 艺术创作变得触手可及。

everything-claude-code

everything-claude-code 是一套专为 AI 编程助手(如 Claude Code、Codex、Cursor 等)打造的高性能优化系统。它不仅仅是一组配置文件,而是一个经过长期实战打磨的完整框架,旨在解决 AI 代理在实际开发中面临的效率低下、记忆丢失、安全隐患及缺乏持续学习能力等核心痛点。 通过引入技能模块化、直觉增强、记忆持久化机制以及内置的安全扫描功能,everything-claude-code 能显著提升 AI 在复杂任务中的表现,帮助开发者构建更稳定、更智能的生产级 AI 代理。其独特的“研究优先”开发理念和针对 Token 消耗的优化策略,使得模型响应更快、成本更低,同时有效防御潜在的攻击向量。 这套工具特别适合软件开发者、AI 研究人员以及希望深度定制 AI 工作流的技术团队使用。无论您是在构建大型代码库,还是需要 AI 协助进行安全审计与自动化测试,everything-claude-code 都能提供强大的底层支持。作为一个曾荣获 Anthropic 黑客大奖的开源项目,它融合了多语言支持与丰富的实战钩子(hooks),让 AI 真正成长为懂上

ComfyUI

ComfyUI 是一款功能强大且高度模块化的视觉 AI 引擎,专为设计和执行复杂的 Stable Diffusion 图像生成流程而打造。它摒弃了传统的代码编写模式,采用直观的节点式流程图界面,让用户通过连接不同的功能模块即可构建个性化的生成管线。 这一设计巧妙解决了高级 AI 绘图工作流配置复杂、灵活性不足的痛点。用户无需具备编程背景,也能自由组合模型、调整参数并实时预览效果,轻松实现从基础文生图到多步骤高清修复等各类复杂任务。ComfyUI 拥有极佳的兼容性,不仅支持 Windows、macOS 和 Linux 全平台,还广泛适配 NVIDIA、AMD、Intel 及苹果 Silicon 等多种硬件架构,并率先支持 SDXL、Flux、SD3 等前沿模型。 无论是希望深入探索算法潜力的研究人员和开发者,还是追求极致创作自由度的设计师与资深 AI 绘画爱好者,ComfyUI 都能提供强大的支持。其独特的模块化架构允许社区不断扩展新功能,使其成为当前最灵活、生态最丰富的开源扩散模型工具之一,帮助用户将创意高效转化为现实。