Time-LLM

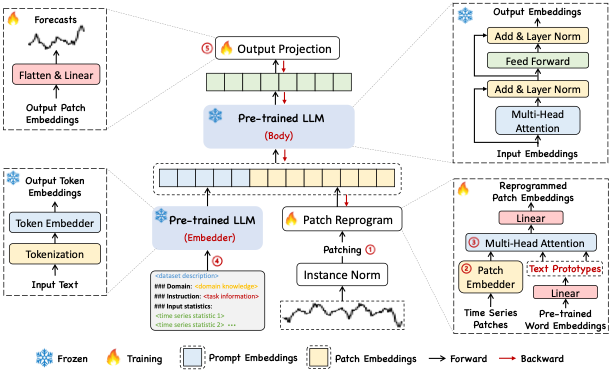

Time-LLM 是一个创新性的开源框架,旨在让大型语言模型(LLM)直接胜任时间序列预测任务。传统上,处理气象、能源或金融等时序数据需要专门的深度学习模型,而 Time-LLM 创造性地将时序分析转化为大模型擅长的“语言任务”,无需修改大模型内部结构即可实现高效预测。

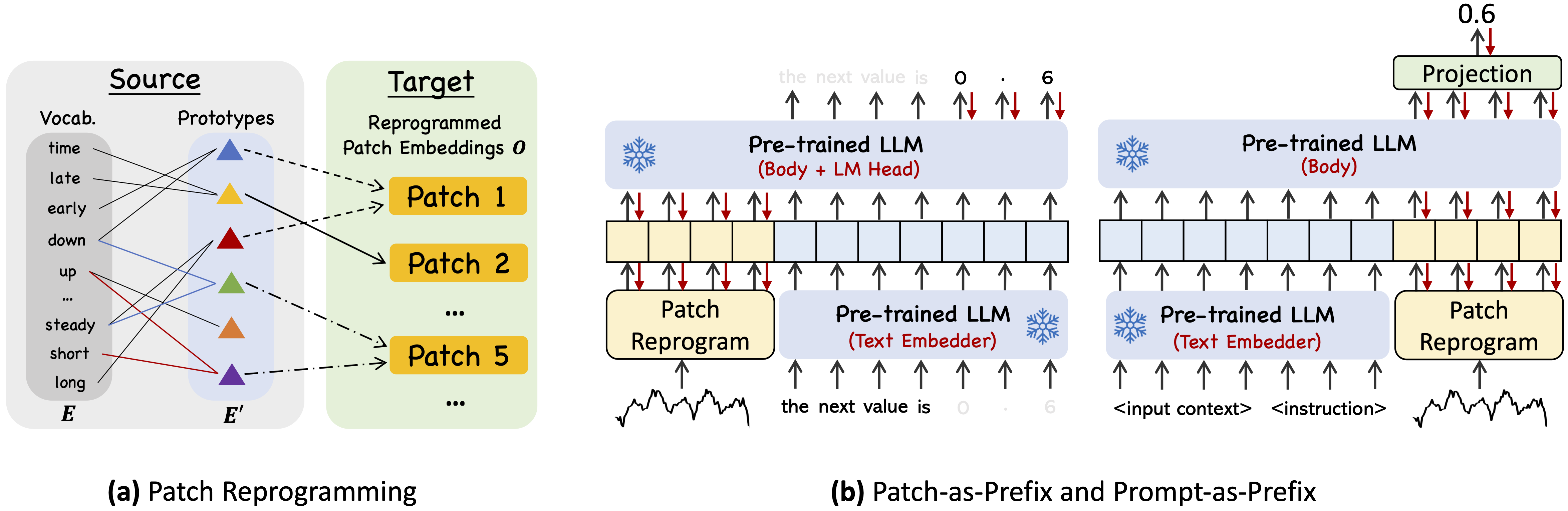

该工具主要解决了通用大模型难以直接理解数值型时序数据的难题。它通过两项核心技术实现突破:一是将输入的时间序列数据重编程为文本原型表示,使其更符合大模型的认知习惯;二是引入包含领域专家知识和任务指令的声明式提示词,引导大模型进行逻辑推理。这种方法不仅保留了预训练大模型的强大泛化能力,还显著提升了在少样本场景下的预测精度。

Time-LLM 非常适合人工智能研究人员、数据科学家以及希望探索大模型新应用的开发者使用。项目代码基于 PyTorch 构建,支持 Llama、GPT-2 和 BERT 等多种主流骨干网络,并已被集成到 NeuralForecast 和 PyPOTS 等知名库中。无论是学术研究还是工业界的太阳能发电预测、天气分析等实际场景,Time-LLM 都提供了一个灵活且强大的解决方案,帮助使用者轻松跨越时序分析与自然语言处理之间的技术鸿沟。

使用场景

某新能源运营团队正利用历史气象与发电数据,构建下一代风电场功率预测系统以优化电网调度。

没有 Time-LLM 时

- 模型冷启动困难:面对新投运的风电场,因缺乏足量历史训练数据,传统深度学习模型(如 Transformer 变体)难以收敛,预测误差极高。

- 专家知识融合成本高:气象学家关于“季节性季风突变”或“极端台风路径”的领域经验,无法直接注入黑盒模型,只能依赖人工事后修正。

- 多源异构数据处理繁琐:需要将数值天气预报(NWP)、传感器时序数据强行对齐并归一化,特征工程耗时且容易丢失关键上下文信息。

- 泛化能力受限:针对特定站点训练的模型无法迁移到其他地理环境相似的场站,每新增一个站点都需重新训练一套参数。

使用 Time-LLM 后

- 零样本/少样本快速适配:Time-LLM 将时序数据重编程为文本原型,直接复用预训练大语言模型(如 Llama-7B)的通用推理能力,即便在新场站数据极少时也能输出可靠预测。

- 自然语言注入领域智慧:团队可直接通过 Declarative Prompts(声明式提示词)输入“考虑夏季午后对流性大风”等专家指令,引导模型在推理阶段动态调整预测逻辑。

- 上下文感知增强:Time-LLM 自动将气象文本报告与时序数值联合编码,让模型像理解文章一样理解天气变化的前因后果,显著提升了极端天气下的鲁棒性。

- 统一框架降低维护成本:无需为不同场站维护独立的模型权重,仅需切换提示词和少量参数即可实现跨区域的通用预测,大幅缩减了算力投入。

Time-LLM 成功打破了时序分析与语言理解的壁垒,让大模型原本的常识推理能力转化为精准的工业级预测力。

运行环境要求

- 未说明

未明确说明具体型号,但依赖 deepspeed 和 accelerate 库且涉及 LLM(如 Llama-7B),通常隐含需要支持 CUDA 的 NVIDIA GPU

未说明

快速开始

(ICLR'24) Time-LLM:通过重编程大型语言模型进行时间序列预测

[论文页面] [YouTube演讲1] [YouTube演讲2] [Medium博客]

[机器之心中文解读] [量子位中文解读] [时序人中文解读] [AI算法厨房中文解读] [知乎中文解读]

🙋 如果您发现任何错误或有任何建议,请随时告知我们!

🌟 如果您觉得本资源有所帮助,请考虑给本仓库点个星,并引用我们的研究:

@inproceedings{jin2023time,

title={{Time-LLM}: Time series forecasting by reprogramming large language models},

author={Jin, Ming and Wang, Shiyu and Ma, Lintao and Chu, Zhixuan and Zhang, James Y and Shi, Xiaoming and Chen, Pin-Yu and Liang, Yuxuan and Li, Yuan-Fang and Pan, Shirui and Wen, Qingsong},

booktitle={International Conference on Learning Representations (ICLR)},

year={2024}

}

更新/新闻:

🚩 新闻(2025年10月):在过去两年里,Time-LLM已被引用1000次!🎉 我们衷心感谢社区在这段旅程中给予的大力支持。

🚩 新闻(2024年8月):Time-LLM已被XiMou优化技术有限公司(XMO)用于太阳能、风能和天气预报。

🚩 新闻(2024年10月):Time-LLM已被纳入PyPOTS。非常感谢PyPOTS团队!

🚩 新闻(2024年5月):Time-LLM已被纳入NeuralForecast。特别感谢贡献者@JQGoh和@marcopeix!

🚩 新闻(2024年3月):Time-LLM已升级为一个通用框架,可用于将多种语言模型重新用于时间序列预测。现在默认支持Llama-7B,并兼容另外两种较小的PLM(GPT-2和BERT)。只需调整--llm_model和--llm_dim即可切换主干模型。

简介

Time-LLM是一个重编程框架,旨在将LLM重新用于通用的时间序列预测,同时保持其原始的语言模型结构不变。值得注意的是,我们证明了时间序列分析(例如预测)可以被视为另一种“语言任务”,而现成的LLM能够有效地解决这一任务。

- Time-LLM包含两个关键组件:(1) 将输入的时间序列重新编程为更适合LLM处理的文本原型表示;(2) 通过声明式提示(例如领域专家知识和任务指令)增强输入上下文,以引导LLM的推理过程。

需求

使用MiniConda中的Python 3.11

- torch==2.2.2

- accelerate==0.28.0

- einops==0.7.0

- matplotlib==3.7.0

- numpy==1.23.5

- pandas==1.5.3

- scikit_learn==1.2.2

- scipy==1.12.0

- tqdm==4.65.0

- peft==0.4.0

- transformers==4.31.0

- deepspeed==0.14.0

- sentencepiece==0.2.0

安装所有依赖项:

pip install -r requirements.txt

数据集

您可以从[Google Drive]获取预处理好的数据集,然后将下载的内容放入./dataset目录下。

快速演示

- 下载数据集并将其放入

./dataset目录。 - 调整模型参数。我们在

./scripts文件夹中提供了五个用于演示的实验脚本。例如,您可以在ETT数据集上进行评估:

bash ./scripts/TimeLLM_ETTh1.sh

bash ./scripts/TimeLLM_ETTh2.sh

bash ./scripts/TimeLLM_ETTm1.sh

bash ./scripts/TimeLLM_ETTm2.sh

详细使用方法

请参考run_main.py、run_m4.py和run_pretrain.py,以了解每个超参数的详细说明。

延伸阅读

作为最早探索大型语言模型与时间序列交叉领域的工作之一,我们衷心感谢开源社区对我们研究的支持。尽管我们目前不计划对 Time-LLM 主代码库进行重大更新,但我们仍然欢迎 建设性的 Pull Request,以帮助维护和改进该库。

🌟 请查看我们团队的最新研究项目,如下所示。

- TimeOmni-1:在大型语言模型中利用时间序列激励复杂推理,arXiv 2025。

作者: 关彤、孟子杰、李典奇、王世宇、杨超翰、温庆松、刘作柱、萨巴托·马可·西尼斯卡基、金明、潘诗睿

@article{guan2025timeomni,

title={TimeOmni-1: Incentivizing Complex Reasoning with Time Series in Large Language Models},

author={Guan, Tong and Meng, Zijie and Li, Dianqi and Wang, Shiyu and Yang, Chao-Han Huck and Wen, Qingsong and Liu, Zuozhu and Siniscalchi, Sabato Marco and Jin, Ming and Pan, Shirui},

journal={arXiv preprint arXiv:2509.24803},

year={2025}

}

- Time-MQA:基于上下文增强的时间序列多任务问答,发表于 ACL 2025。 [HuggingFace]

作者: 孔亚轩、杨一元、黄润泰、杜文杰、斯特凡·佐伦、王张洋、金明、温庆松

@inproceedings{kong2025time,

title={Time-mqa: Time series multi-task question answering with context enhancement},

author={Kong, Yaxuan and Yang, Yiyuan and Hwang, Yoontae and Du, Wenjie and Zohren, Stefan and Wang, Zhangyang and Jin, Ming and Wen, Qingsong},

booktitle={The 63rd Annual Meeting of the Association for Computational Linguistics (ACL 2025)},

year={2025}

}

- 迈向时间序列基础模型的神经规模定律,发表于 ICLR 2025。 [GitHub 仓库]

作者: 姚清仁、杨超翰、蒋仁和、梁宇轩、金明、潘诗睿

@inproceedings{yaotowards,

title={Towards Neural Scaling Laws for Time Series Foundation Models},

author={Yao, Qingren and Yang, Chao-Han Huck and Jiang, Renhe and Liang, Yuxuan and Jin, Ming and Pan, Shirui},

booktitle={International Conference on Learning Representations (ICLR)},

year={2025}

}

- Time-MoE:基于专家混合的大规模时间序列基础模型,发表于 ICLR 2025。 [GitHub 仓库]

作者: 史晓明、王世宇、聂宇琪、李典奇、叶舟、温庆松、金明

@inproceedings{shi2024time,

title={Time-moe: Billion-scale time series foundation models with mixture of experts},

author={Shi, Xiaoming and Wang, Shiyu and Nie, Yuqi and Li, Dianqi and Ye, Zhou and Wen, Qingsong and Jin, Ming},

booktitle={International Conference on Learning Representations (ICLR)},

year={2025}

}

- TimeMixer++:用于通用预测分析的通用时间序列模式机器,发表于 ICLR 2025。 [GitHub 仓库]

作者: 王世宇、李嘉伟、史晓明、叶舟、莫百川、林文泽、鞠圣通、褚志轩、金明

@inproceedings{wang2024timemixer++,

title={TimeMixer++: A General Time Series Pattern Machine for Universal Predictive Analysis},

author={Wang, Shiyu and Li, Jiawei and Shi, Xiaoming and Ye, Zhou and Mo, Baichuan and Lin, Wenze and Ju, Shengtong and Chu, Zhixuan and Jin, Ming},

booktitle={International Conference on Learning Representations (ICLR)},

year={2025}

}

致谢

我们的实现以 Time-Series-Library 和 OFA (GPT4TS) 为基础代码库,并根据我们的需求进行了大量修改。我们感谢这些作者分享他们的实现及相关资源。

常见问题

相似工具推荐

openclaw

OpenClaw 是一款专为个人打造的本地化 AI 助手,旨在让你在自己的设备上拥有完全可控的智能伙伴。它打破了传统 AI 助手局限于特定网页或应用的束缚,能够直接接入你日常使用的各类通讯渠道,包括微信、WhatsApp、Telegram、Discord、iMessage 等数十种平台。无论你在哪个聊天软件中发送消息,OpenClaw 都能即时响应,甚至支持在 macOS、iOS 和 Android 设备上进行语音交互,并提供实时的画布渲染功能供你操控。 这款工具主要解决了用户对数据隐私、响应速度以及“始终在线”体验的需求。通过将 AI 部署在本地,用户无需依赖云端服务即可享受快速、私密的智能辅助,真正实现了“你的数据,你做主”。其独特的技术亮点在于强大的网关架构,将控制平面与核心助手分离,确保跨平台通信的流畅性与扩展性。 OpenClaw 非常适合希望构建个性化工作流的技术爱好者、开发者,以及注重隐私保护且不愿被单一生态绑定的普通用户。只要具备基础的终端操作能力(支持 macOS、Linux 及 Windows WSL2),即可通过简单的命令行引导完成部署。如果你渴望拥有一个懂你

n8n

n8n 是一款面向技术团队的公平代码(fair-code)工作流自动化平台,旨在让用户在享受低代码快速构建便利的同时,保留编写自定义代码的灵活性。它主要解决了传统自动化工具要么过于封闭难以扩展、要么完全依赖手写代码效率低下的痛点,帮助用户轻松连接 400 多种应用与服务,实现复杂业务流程的自动化。 n8n 特别适合开发者、工程师以及具备一定技术背景的业务人员使用。其核心亮点在于“按需编码”:既可以通过直观的可视化界面拖拽节点搭建流程,也能随时插入 JavaScript 或 Python 代码、调用 npm 包来处理复杂逻辑。此外,n8n 原生集成了基于 LangChain 的 AI 能力,支持用户利用自有数据和模型构建智能体工作流。在部署方面,n8n 提供极高的自由度,支持完全自托管以保障数据隐私和控制权,也提供云端服务选项。凭借活跃的社区生态和数百个现成模板,n8n 让构建强大且可控的自动化系统变得简单高效。

stable-diffusion-webui

stable-diffusion-webui 是一个基于 Gradio 构建的网页版操作界面,旨在让用户能够轻松地在本地运行和使用强大的 Stable Diffusion 图像生成模型。它解决了原始模型依赖命令行、操作门槛高且功能分散的痛点,将复杂的 AI 绘图流程整合进一个直观易用的图形化平台。 无论是希望快速上手的普通创作者、需要精细控制画面细节的设计师,还是想要深入探索模型潜力的开发者与研究人员,都能从中获益。其核心亮点在于极高的功能丰富度:不仅支持文生图、图生图、局部重绘(Inpainting)和外绘(Outpainting)等基础模式,还独创了注意力机制调整、提示词矩阵、负向提示词以及“高清修复”等高级功能。此外,它内置了 GFPGAN 和 CodeFormer 等人脸修复工具,支持多种神经网络放大算法,并允许用户通过插件系统无限扩展能力。即使是显存有限的设备,stable-diffusion-webui 也提供了相应的优化选项,让高质量的 AI 艺术创作变得触手可及。

everything-claude-code

everything-claude-code 是一套专为 AI 编程助手(如 Claude Code、Codex、Cursor 等)打造的高性能优化系统。它不仅仅是一组配置文件,而是一个经过长期实战打磨的完整框架,旨在解决 AI 代理在实际开发中面临的效率低下、记忆丢失、安全隐患及缺乏持续学习能力等核心痛点。 通过引入技能模块化、直觉增强、记忆持久化机制以及内置的安全扫描功能,everything-claude-code 能显著提升 AI 在复杂任务中的表现,帮助开发者构建更稳定、更智能的生产级 AI 代理。其独特的“研究优先”开发理念和针对 Token 消耗的优化策略,使得模型响应更快、成本更低,同时有效防御潜在的攻击向量。 这套工具特别适合软件开发者、AI 研究人员以及希望深度定制 AI 工作流的技术团队使用。无论您是在构建大型代码库,还是需要 AI 协助进行安全审计与自动化测试,everything-claude-code 都能提供强大的底层支持。作为一个曾荣获 Anthropic 黑客大奖的开源项目,它融合了多语言支持与丰富的实战钩子(hooks),让 AI 真正成长为懂上

ComfyUI

ComfyUI 是一款功能强大且高度模块化的视觉 AI 引擎,专为设计和执行复杂的 Stable Diffusion 图像生成流程而打造。它摒弃了传统的代码编写模式,采用直观的节点式流程图界面,让用户通过连接不同的功能模块即可构建个性化的生成管线。 这一设计巧妙解决了高级 AI 绘图工作流配置复杂、灵活性不足的痛点。用户无需具备编程背景,也能自由组合模型、调整参数并实时预览效果,轻松实现从基础文生图到多步骤高清修复等各类复杂任务。ComfyUI 拥有极佳的兼容性,不仅支持 Windows、macOS 和 Linux 全平台,还广泛适配 NVIDIA、AMD、Intel 及苹果 Silicon 等多种硬件架构,并率先支持 SDXL、Flux、SD3 等前沿模型。 无论是希望深入探索算法潜力的研究人员和开发者,还是追求极致创作自由度的设计师与资深 AI 绘画爱好者,ComfyUI 都能提供强大的支持。其独特的模块化架构允许社区不断扩展新功能,使其成为当前最灵活、生态最丰富的开源扩散模型工具之一,帮助用户将创意高效转化为现实。

gemini-cli

gemini-cli 是一款由谷歌推出的开源 AI 命令行工具,它将强大的 Gemini 大模型能力直接集成到用户的终端环境中。对于习惯在命令行工作的开发者而言,它提供了一条从输入提示词到获取模型响应的最短路径,无需切换窗口即可享受智能辅助。 这款工具主要解决了开发过程中频繁上下文切换的痛点,让用户能在熟悉的终端界面内直接完成代码理解、生成、调试以及自动化运维任务。无论是查询大型代码库、根据草图生成应用,还是执行复杂的 Git 操作,gemini-cli 都能通过自然语言指令高效处理。 它特别适合广大软件工程师、DevOps 人员及技术研究人员使用。其核心亮点包括支持高达 100 万 token 的超长上下文窗口,具备出色的逻辑推理能力;内置 Google 搜索、文件操作及 Shell 命令执行等实用工具;更独特的是,它支持 MCP(模型上下文协议),允许用户灵活扩展自定义集成,连接如图像生成等外部能力。此外,个人谷歌账号即可享受免费的额度支持,且项目基于 Apache 2.0 协议完全开源,是提升终端工作效率的理想助手。