jadx-ai-mcp

jadx-ai-mcp 是一款专为 Android 逆向分析打造的智能增强插件,它无缝集成于流行的反编译工具 JADX 中,并引入了 MCP(模型上下文协议)服务器架构。简单来说,它让 jadx 具备了与大型语言模型(如 Claude)直接对话的能力,将传统静态代码分析升级为 AI 辅助的智能洞察。

在面对复杂的 Android APK 文件时,人工逐行阅读反编译代码往往耗时费力且容易遗漏关键逻辑。jadx-ai-mcp 正是为了解决这一痛点而生,它能够自动提取代码上下文并发送给 AI 模型,帮助用户快速识别潜在的安全漏洞、梳理业务逻辑或解释晦涩的算法实现,从而大幅降低逆向工程的门槛和时间成本。

这款工具非常适合安全研究人员、移动应用开发者以及逆向工程爱好者使用。无论是进行恶意软件分析、应用安全审计,还是学习第三方应用的架构设计,用户都能从中获益。其独特的技术亮点在于实现了“完全自动化”的工作流:无需手动复制粘贴代码片段,插件即可在 JADX 界面内通过标准 MCP 协议与大模型实时交互,让 AI 成为你随叫随到的逆向分析专家,使复杂的技术分析过程变得更加轻松高效。

使用场景

某安全团队在紧急评估一款疑似窃取用户隐私的第三方安卓应用时,需要快速定位其数据泄露逻辑。

没有 jadx-ai-mcp 时

- 分析师需手动遍历 JADX 中成千上万个混淆后的类名和方法,像大海捞针般寻找敏感 API 调用点。

- 面对复杂的控制流和加密字符串,人工还原业务逻辑耗时极长,往往需要数小时才能理清数据流向。

- 不同分析师的经验差异导致分析结果不稳定,容易遗漏隐蔽的后门代码或深层漏洞。

- 编写分析报告时,需反复截图、复制代码片段并手动注释,文档整理工作占据了大量时间。

使用 jadx-ai-mcp 后

- 直接在 JADX 界面通过 MCP 协议调用大模型,一键询问“查找所有上传通讯录的代码”,瞬间定位关键函数。

- 利用 AI 自动解构混淆逻辑并解释加密算法,将原本数小时的逆向分析过程压缩至几分钟内完成。

- 借助大模型的通用知识库,自动识别出非标准的恶意行为模式,显著降低了因人为疏忽导致的漏报风险。

- 支持让 AI 直接生成包含代码片段和逻辑推导的专业分析报告草稿,实现了从分析到输出的无缝衔接。

jadx-ai-mcp 通过将大模型的推理能力注入逆向工程流程,把安卓安全分析从“体力劳动”升级为高效的“人机协作”。

运行环境要求

- Windows

- macOS

- Linux

未说明

未说明

快速开始

JADX-AI-MCP(Zin MCP 套件的一部分)

⚡ 全自动 MCP 服务器 + JADX 插件,专为通过 MCP 与 LLM 对接而构建,可利用 Claude 等大语言模型分析 Android APK 文件,轻松发现漏洞、分析 APK 并进行逆向工程。

⭐ 贡献者

感谢以下各位的贡献 ⭐

ljt270864457 |

p0px |

bx33661 |

Haicaji |

ChineseAStar |

cyal1 |

badmonkey7 |

tiann |

ZERO-A-ONE |

neoz |

SamadiPour |

wuseluosi |

CainYzb |

tbodt |

LilNick0101 |

lwsinclair |

文档阅读

🤖 什么是 JADX-AI-MCP?

JADX-AI-MCP 是一个针对 JADX 反编译器 的插件,它直接与 模型上下文协议(MCP) 集成,以提供 基于 Claude 等 LLM 的实时逆向工程支持。

可以理解为:“反编译 → 上下文感知代码审查 → AI 建议”——全程实时完成。

高级序列图

sequenceDiagram

LLM CLIENT->>JADX MCP SERVER: INVOKE MCP TOOL

JADX MCP SERVER->>JADX AI MCP PLUGIN: INVOKE HTTP REQUEST

JADX AI MCP PLUGIN->>REQUEST HANDLERS: INVOKE HTTP REQUEST HANDLER

REQUEST HANDLERS->>JADX GUI: PERFORM ACTION/GATHER DATA

JADX GUI->>REQUEST HANDLERS: ACTION PERFORMED/DATA GATHERED

REQUEST HANDLERS->>JADX AI MCP PLUGIN: CRAFT HTTP RESPONSE

JADX AI MCP PLUGIN->>JADX MCP SERVER:HTTP RESPONSE

JADX MCP SERVER->>LLM CLIENT: MCP TOOL RESULT

观看演示!

- 快速分析

https://github.com/user-attachments/assets/b65c3041-fde3-4803-8d99-45ca77dbe30a

- 快速查找漏洞

https://github.com/user-attachments/assets/c184afae-3713-4bc0-a1d0-546c1f4eb57f

- 多 AI 代理支持

https://github.com/user-attachments/assets/6342ea0f-fa8f-44e6-9b3a-4ceb8919a5b0

- 使用您喜爱的 LLM 客户端运行

https://github.com/user-attachments/assets/b4a6b280-5aa9-4e76-ac72-a0abec73b809

- 分析 APK 资源

https://github.com/user-attachments/assets/f42d8072-0e3e-4f03-93ea-121af4e66eb1

- 在使用 JADX 调试 APK 时的 AI 助手

https://github.com/user-attachments/assets/2b0bd9b1-95c1-4f32-9b0c-38b864dd6aec

它是两种工具的结合:

- JADX-AI-MCP

- JADX MCP 服务器

🤖 什么是 JADX-MCP-服务器?

JADX MCP 服务器 是一个独立的 Python 服务器,它通过 MCP(模型上下文协议)与 JADX-AI-MCP 插件(参见:jadx-ai-mcp)进行交互。它使大型语言模型能够实时与反编译后的 Android 应用程序上下文进行通信。

Zin MCP 套件中的其他项目

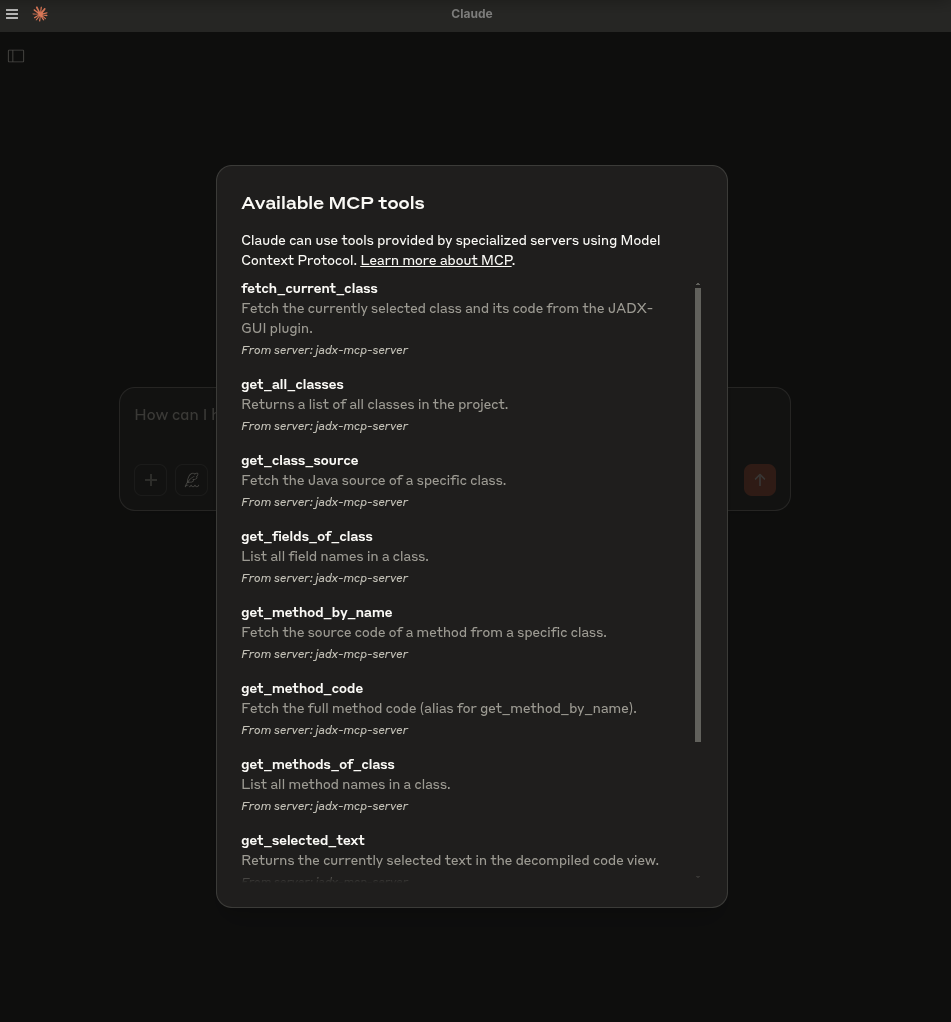

当前的 MCP 工具

以下 MCP 工具可供使用:

fetch_current_class()— 获取所选类的类名和完整源代码get_selected_text()— 获取当前选中的文本get_all_classes()— 列出项目中的所有类get_class_source()— 获取给定类的完整源代码get_method_by_name()— 获取某个方法的源代码search_method_by_name()— 在类中搜索方法search_classes_by_keyword()— 搜索源代码中包含特定关键字的类(支持分页)get_methods_of_class()— 列出类中的所有方法get_fields_of_class()— 列出类中的所有字段get_smali_of_class()— 获取类的 smali 代码get_main_activity_class()— 从 AndroidManifest.xml 文件中获取 jadx 提到的主活动类。get_main_application_classes_code()— 根据 AndroidManifest.xml 中定义的包名,获取所有主应用类的代码。get_main_application_classes_names()— 根据 AndroidManifest.xml 中定义的包名,获取所有主应用类的名称。get_android_manifest()— 检索并返回 AndroidManifest.xml 的内容。get_manifest_component— 检索特定的清单组件,而不是整个清单文件get_strings():获取 strings.xml 文件get_all_resource_file_names():检索应用程序中存在的所有资源文件名get_resource_file():检索资源文件的内容rename_class():重命名类名rename_method():重命名方法rename_field():重命名字段rename_package():重命名整个包rename_variable():重命名方法内的变量debug_get_stack_frames():从 jadx 调试器获取堆栈帧debug_get_threads():从 jadx 调试器获取线程信息debug_get_variables():从 jadx 调试器获取变量xrefs_to_class():查找对某个类的所有引用(返回方法级和类级引用,支持分页)xrefs_to_method():查找对某个方法的所有引用(包括覆盖相关的方法,支持分页)xrefs_to_field():查找对某个字段的所有引用(返回访问该字段的方法,支持分页)

🗒️ 示例提示

🔍 基本代码理解

“用一段话解释这个类的作用。”

“总结一下这个方法的职责。”

“这个类中是否有混淆代码?”

“列出这个类可能需要的所有 Android 权限。”

🛡️ 漏洞检测

“这个方法中是否存在不安全的 API 使用?”

“检查这个类中是否有硬编码的秘密或凭据。”

“这个方法在使用用户输入之前是否进行了清理?”

“这段代码可能会引入哪些安全漏洞?”

🛠️ 反向工程助手

“对类和方法进行去混淆并重命名为易读的名称。”

“你能推断出这个 smali 方法的原始用途吗?”

“这个类似乎属于哪些库或 SDK?”

“告诉我哪些类包含与‘加密’相关的代码?”

📦 静态分析

“列出这个类中所有的网络相关 API 调用。”

“识别文件 I/O 操作及其潜在风险。”

“这个方法是否会泄露设备信息或 PII?”

🤖 AI 代码修改

“重构这个方法以提高可读性。”

“为这段代码添加注释,解释每一步的操作。”

“将这个 Java 方法重写为 Python 代码以便分析。”

📄 文档与元数据

“为所有方法生成 Javadoc 样式的注释。”

“这个类可能属于哪个包或应用组件?”

“你能识别出 Android 组件类型吗(Activity、Service 等)?”

🐞 调试器助手

“从调试器获取堆栈帧、变量和线程,并提供摘要。”

“根据调试器提供的堆栈帧,解释应用程序的执行流程。”

“根据变量的状态,是否存在安全威胁?”

🛠️ 开始使用

1. 从发布页面下载:https://github.com/zinja-coder/jadx-ai-mcp/releases

[!注意]

请同时下载

jadx-ai-mcp-<version>.jar和jadx-mcp-server-<version>.zip文件。

# 0. 下载 jadx-ai-mcp-<version>.jar 和 jadx-mcp-server-<version>.zip

https://github.com/zinja-coder/jadx-ai-mcp/releases

# 1.

解压 jadx-ai-mcp-<version>.zip

├jadx-mcp-server/

├── jadx_mcp.py

├── requirements.txt

├── README.md

├── LICENSE

├jadx-ai-mcp-<version>.jar

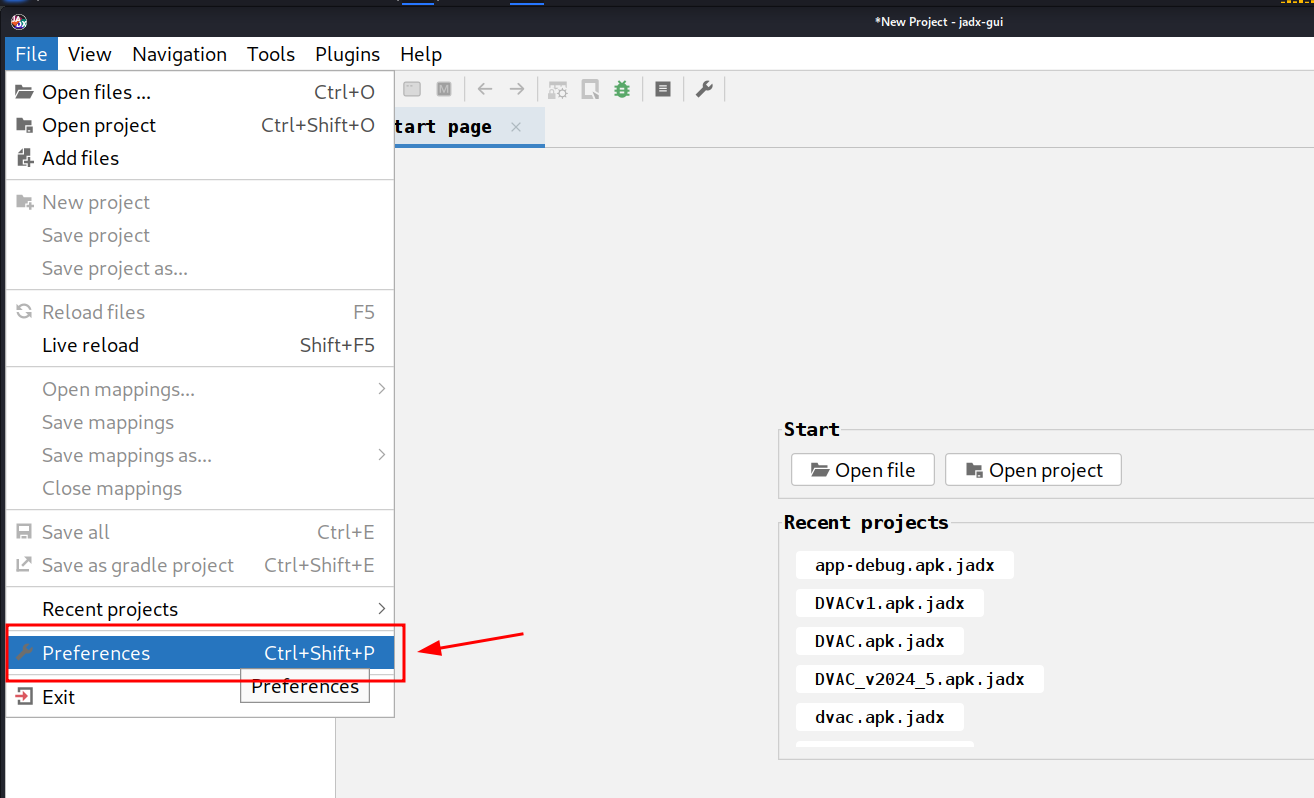

# 2. 安装插件

# 为此,您可以采取两种方法:

## 1. 一行命令 - 在您的终端中执行以下命令

jadx plugins --install "github:zinja-coder:jadx-ai-mcp"

## 上述一行命令会直接将最新版本的插件安装到 jadx 中,无需下载 jadx-ai-mcp 的 .jar 文件。

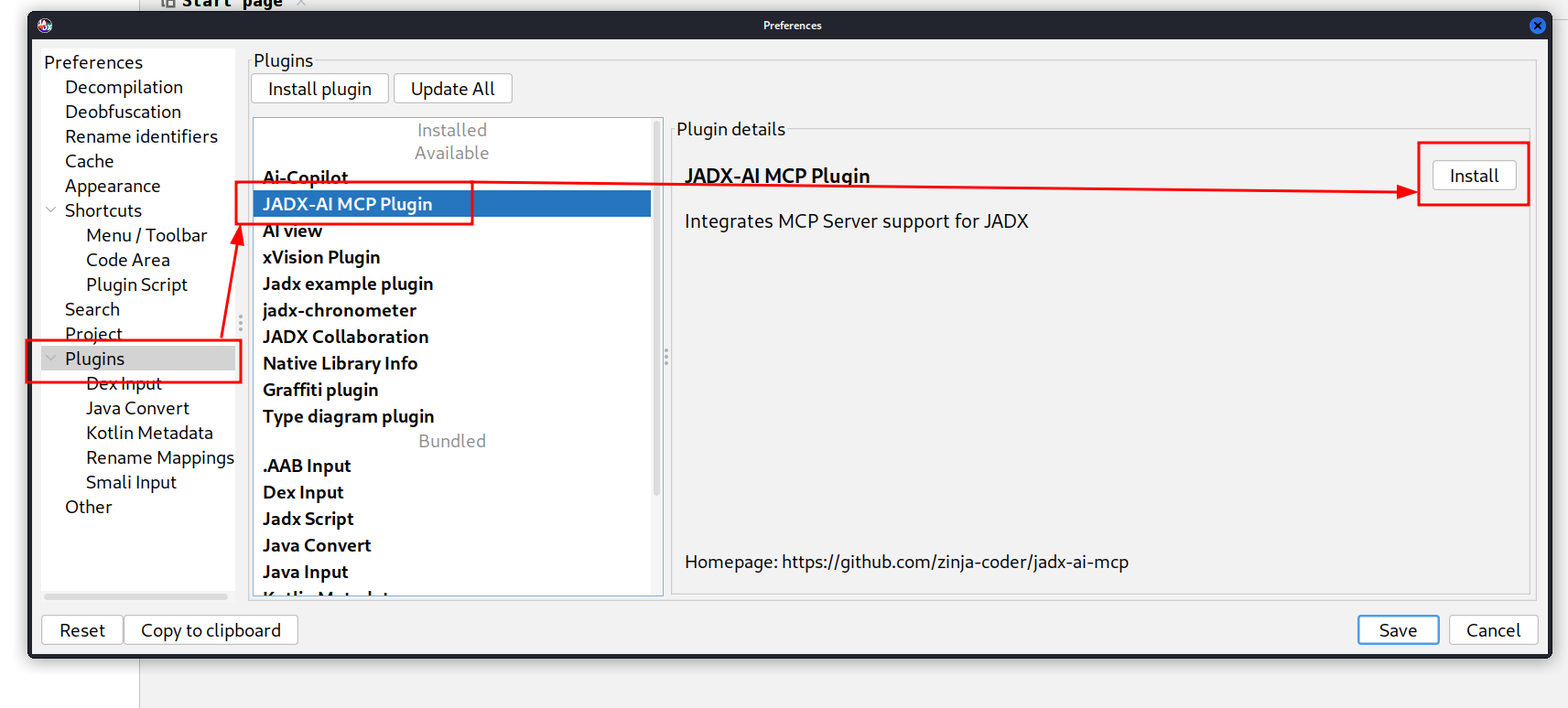

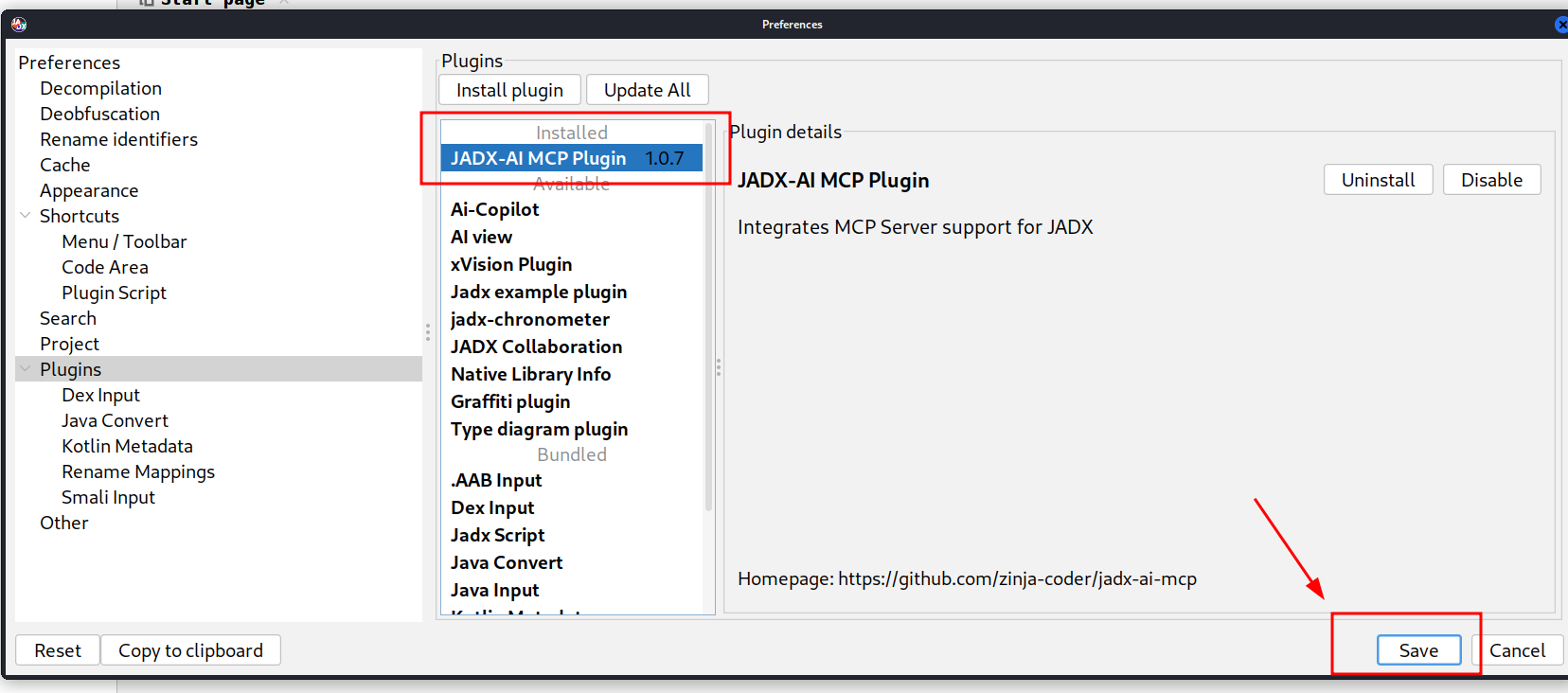

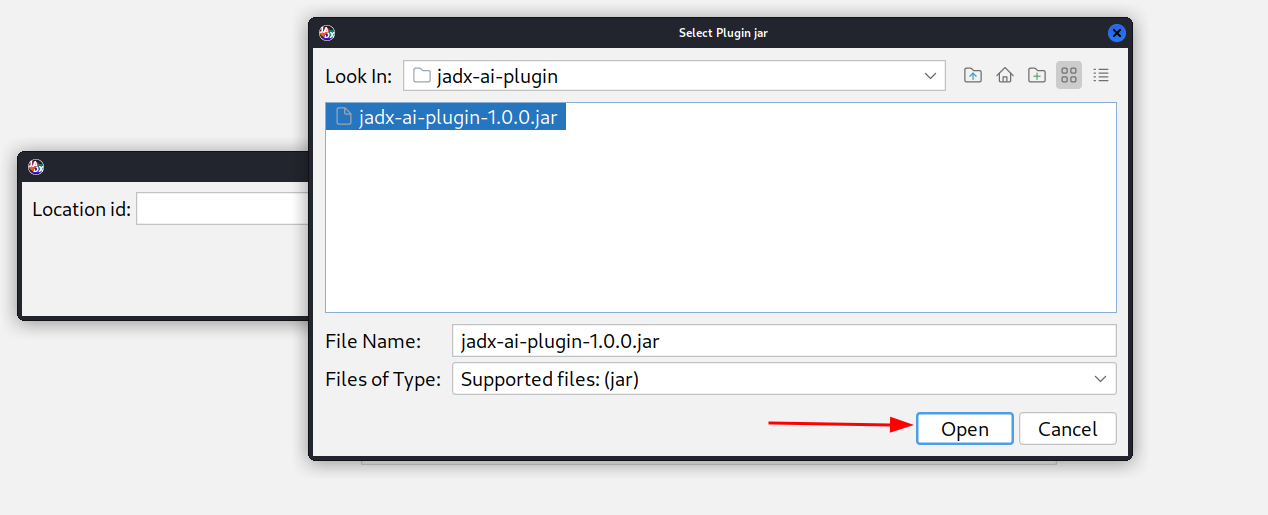

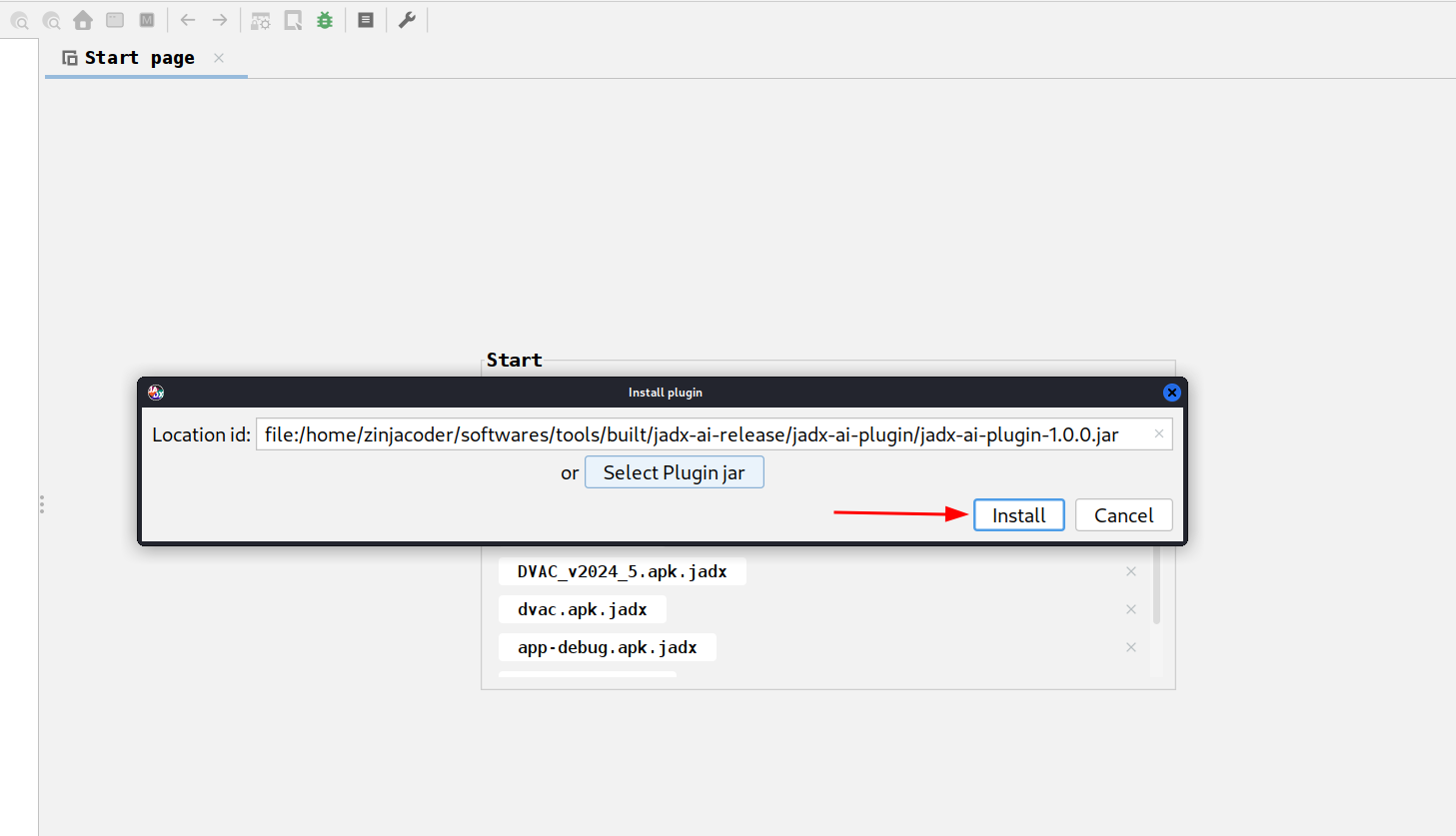

## 2. 或者,您也可以使用 JADX-GUI 按照下图所示的方式进行安装:

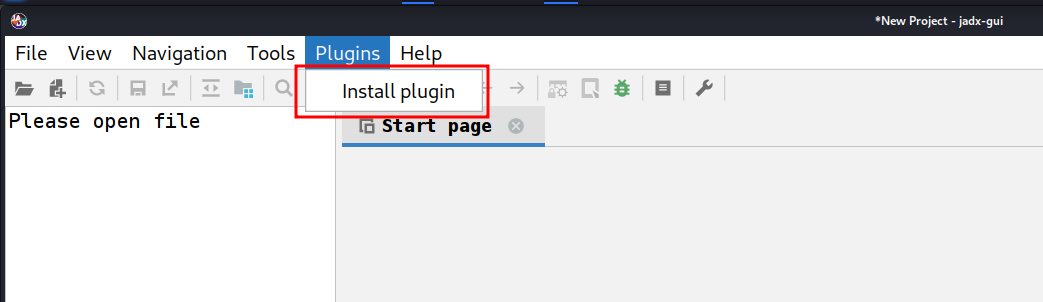

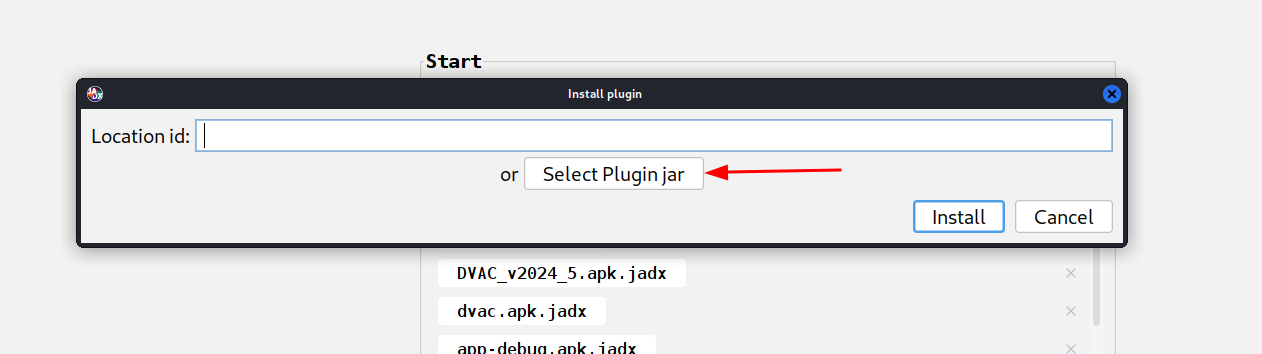

## 3. GUI 方法,下载 .jar 文件并按照图片中的步骤操作

# 3. 进入 jadx-mcp-server 目录

cd jadx-mcp-server

# 4. 该项目使用 uv - https://github.com/astral-sh/uv 代替 pip 进行依赖管理。

## a. 安装 uv(如果您还没有安装)

curl -LsSf https://astral.sh/uv/install.sh | sh

## b. 可选,如果由于某种原因,您在 jadx-mcp-server 中遇到依赖错误,请设置环境

uv venv

source .venv/bin/activate # 或 .venv\Scripts\activate 在 Windows 上

## c. 可选 安装依赖

uv pip install httpx fastmcp

# 至此,jadx-ai-mcp 和 jadx_mcp_server 的设置已完成。

🤖 2. 使用 Claude Desktop

确保 Claude Desktop 已启用 MCP 并正在运行。

例如,我在 Kali Linux 上使用了以下项目:https://github.com/aaddrick/claude-desktop-debian

配置并添加 MCP 服务器到 LLM 文件中:

nano ~/.config/Claude/claude_desktop_config.json

对于:

- Windows:

%APPDATA%\Claude\claude_desktop_config.json - macOS:

~/Library/Application Support/Claude/claude_desktop_config.json

并在文件中加入以下内容:

{

"mcpServers": {

"jadx-mcp-server": {

"command": "/<path>/<to>/uv",

"args": [

"--directory",

"</PATH/TO/>jadx-mcp-server/",

"run",

"jadx_mcp_server.py"

]

}

}

}

请替换:

path/to/uv为你的uv可执行文件的实际路径path/to/jadx-mcp-server为克隆此仓库的绝对路径

随后,你就可以通过内置集成,在代码导航和实时代码审查提示中进行交互了。

或者

你也可以直接使用以下命令将 jadx_mcp_server 安装为可执行文件:

uv tool install git+https://github.com/zinja-coder/jadx-mcp-server

然后在 mcp 配置的 command 部分直接指定 jadx_mcp_server 即可。

3. 使用 Cherry Studio

如果你想在 Cherry Studio 中配置 MCP 工具,可以参考以下配置:

- 类型:stdio

- 命令:uv

- 参数:

--directory

path/to/jadx-mcp-server

run

jadx_mcp_server.py

path/to/jadx-mcp-server为克隆此仓库的绝对路径

4. 使用 LMStudio

你也可以通过配置 LMStudio 的 mcp.json 文件来使用 JADX AI MCP 服务器。以下是视频教程:

https://github.com/user-attachments/assets/b4a6b280-5aa9-4e76-ac72-a0abec73b809

5. 以 HTTP 流模式运行

你还可以使用 --http 选项以 HTTP 流模式运行 jadx_mcp_server.py,如下所示:

uv run jadx_mcp_server.py --http

或

uv run jadx_mcp_server.py --http --port 9999

高级 CLI 选项 — 标志解析

这里有 两条独立的连接,每条都有自己的主机/端口:

┌─────────────┐ --host / --port ┌──────────────────┐ --jadx-host / --jadx-port ┌──────────────────┐

│ LLM Client │ ◄──────────────────► │ jadx-mcp-server │ ──────────────────────────► │ JADX-GUI Plugin │

│ (Claude, │ MCP 服务器在此监听客户端 │ │ MCP 服务器在此寻找 JADX 插件 │ (jadx-ai-mcp) │

│ Codex..) │ │ │ │ │

└─────────────┘ └──────────────────┘ └──────────────────┘

| 标志 | 默认值 | 功能 |

|---|---|---|

--http |

关闭 | 使用 HTTP 传输代替 stdio |

--host |

127.0.0.1 |

MCP 服务器监听的地址(LLM 客户端的绑定地址) |

--port |

8651 |

MCP 服务器监听的端口 |

--jadx-host |

127.0.0.1 |

找到 JADX 插件的位置(目标 JADX-GUI 机器) |

--jadx-port |

8650 |

JADX 插件所在的端口 |

使用示例

场景 1 — 所有组件在同一台机器上(最常见):

# 默认:MCP 服务器在 localhost:8651,连接到 localhost:8650 的 JADX 插件

uv run jadx_mcp_server.py --http

场景 2 — Docker 容器或 WSL(MCP 服务器可通过宿主机网络访问):

# MCP 服务器监听所有接口,以便宿主机可以访问

# JADX 插件仍在同一台机器上

uv run jadx_mcp_server.py --http --host 0.0.0.0

场景 3 — JADX-GUI 运行在另一台机器上(例如远程 VM):

# MCP 服务器本地运行,但连接到远程机器上的 JADX 插件

uv run jadx_mcp_server.py --http --jadx-host 192.168.1.100

场景 4 — 完全远程设置(所有组件位于不同机器上):

# MCP 服务器监听所有接口,端口为 9999

# JADX 插件位于另一台机器上,地址为 192.168.1.100:8652

uv run jadx_mcp_server.py --http --host 0.0.0.0 --port 9999 --jadx-host 192.168.1.100 --jadx-port 8652

[!CAUTION]

⚠️ 安全警告 — 远程绑定

当使用

--host 0.0.0.0(或任何非 localhost 地址)时,MCP 服务器会绑定到 所有网络接口,并通过 无认证的纯 HTTP 进行通信。这意味着:

- 网络中的任何人都可以连接并调用所有 MCP 工具

- 没有 TLS 加密 — 数据可能被截获

- 攻击者可以利用该服务器 读取反编译后的代码、重命名类/方法,以及 访问调试信息。

缓解措施:

- 仅在 受信任的隔离网络(如 Docker 网桥、本地 VM)上绑定到

0.0.0.0- 使用 防火墙 限制对 MCP 端口的访问

- 考虑使用 SSH 隧道:

ssh -L 8651:127.0.0.1:8651 remote-host

stdio 模式兼容性

[!NOTE] 在 stdio 模式下运行时(默认,不带

--http),所有人类可读的输出(横幅、健康检查)都会写入 stderr,以保留 stdout 用于 MCP JSON-RPC 流。这确保了与 Codex、Claude Desktop 等基于 stdio 的 MCP 客户端的兼容性。

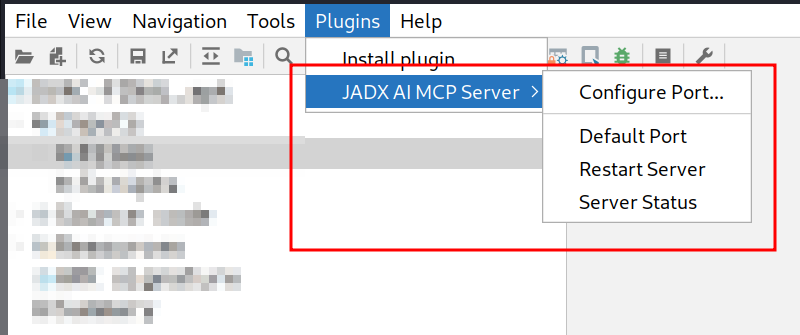

6. 自定义端口和主机配置用于 JADDO AI MCP 插件

- 配置端口:设置 JADDO AI MCP 插件监听的端口。

- 默认端口:恢复默认设置,使用默认端口。

- 重启服务器:强制重启 JADDO AI MCP 插件服务器。

- 服务器状态:查看 JADDO AI MCP 插件服务器的状态。

若要连接到运行在自定义端口上的 JADDO AI MCP 插件,需使用 --jadx-port 选项,如下所示:

uv run jadx_mcp_server.py --jadx-port 8652

如果 JADDO AI MCP 插件运行在 另一台机器 上(例如,JADDO 在远程 VM 上,MCP 服务器在你的本地主机上),则使用 --jadx-host 选项:

# 连接到远程主机上的 JADDO 插件

uv run jadx_mcp_server.py --jadx-host 192.168.1.100 --jadx-port 8650

CLI 参考 — 理解标志位

这里有两个独立的连接,每个连接都有自己的主机/端口:

┌─────────────┐ --host / --port ┌──────────────────┐ --jadx-host / --jadx-port ┌──────────────────┐

│ LLM 客户端 │ ◄──────────────────► │ jadx-mcp-server │ ──────────────────────────► │ JADX-GUI 插件 │

│ (Claude, │ MCP 服务器监听客户端 │ │ MCP 服务器寻找 JADX 插件 │ (jadx-ai-mcp) │

│ Codex..) │ │ │ │ │

└─────────────┘ └──────────────────┘ └──────────────────┘

| 标志 | 默认值 | 控制内容 |

|---|---|---|

--http |

关 | 使用 HTTP 传输代替 stdio |

--host |

127.0.0.1 |

MCP 服务器监听的地址(LLM 客户端的绑定地址) |

--port |

8651 |

MCP 服务器监听的端口 |

--jadx-host |

127.0.0.1 |

查找 JADX 插件的位置(目标 JADX-GUI 机器) |

--jadx-port |

8650 |

JADX 插件所在的端口 |

使用示例

场景 1 — 所有组件在同一台机器上(最常见):

# 默认:MCP 服务器在 localhost:8651,连接到 localhost:8650 的 JADX 插件

uv run jadx_mcp_server.py --http

场景 2 — Docker 容器或 WSL(MCP 服务器可通过宿主机网络访问):

# MCP 服务器监听所有接口,以便宿主机可以访问

# JADX 插件仍在同一台机器上

uv run jadx_mcp_server.py --http --host 0.0.0.0

场景 3 — JADX-GUI 运行在另一台机器上(例如远程 VM):

# MCP 服务器本地运行,但连接到远程机器上的 JADX 插件

uv run jadx_mcp_server.py --http --jadx-host 192.168.1.100

场景 4 — 完全远程设置(所有组件在不同机器上):

# MCP 服务器监听所有接口,端口为 9999

# JADX 插件在另一台机器上,地址为 192.168.1.100:8652

uv run jadx_mcp_server.py --http --host 0.0.0.0 --port 9999 --jadx-host 192.168.1.100 --jadx-port 8652

针对 Claude 的自定义 jadx 端口的 MCP 配置如下:

{

"mcpServers": {

"jadx-mcp-server": {

"command": "/path/to/uv",

"args": [

"--directory",

"/path/to/jadx-mcp-server/",

"run",

"jadx_mcp_server.py",

"--jadx-port",

"8652"

]

}

}

}

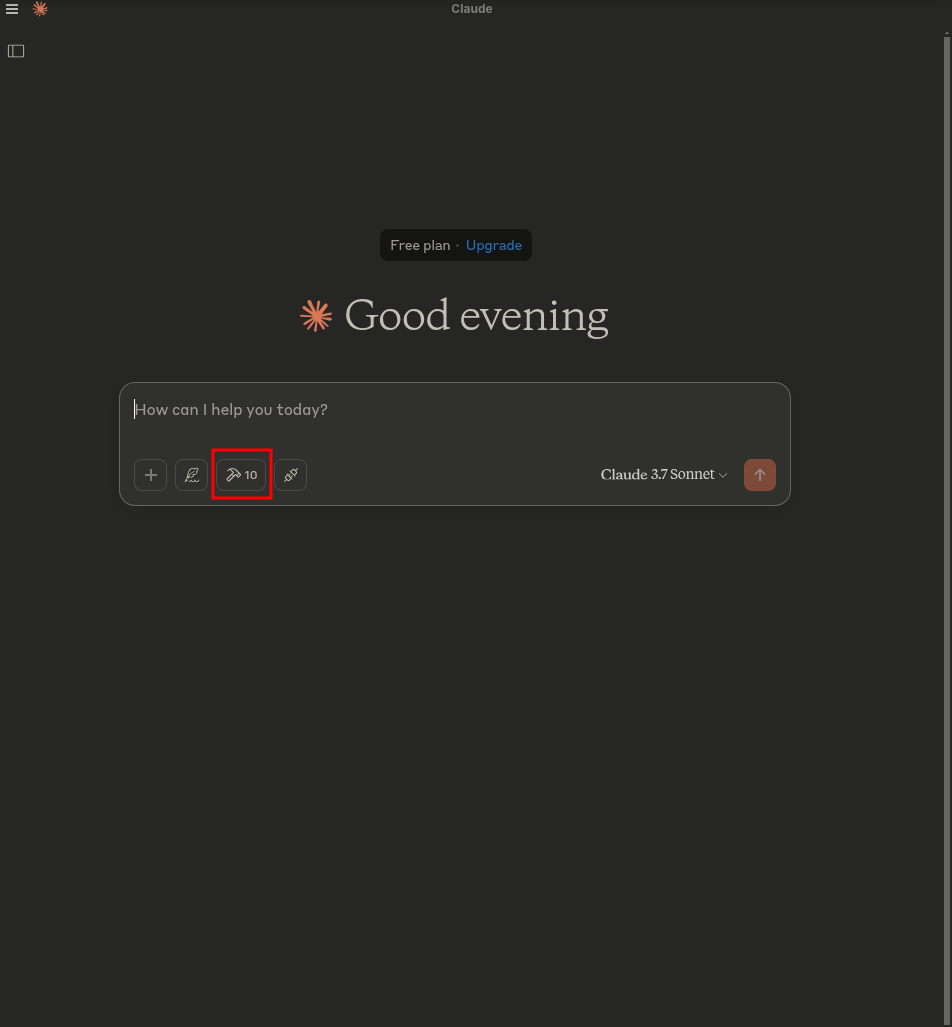

试试看

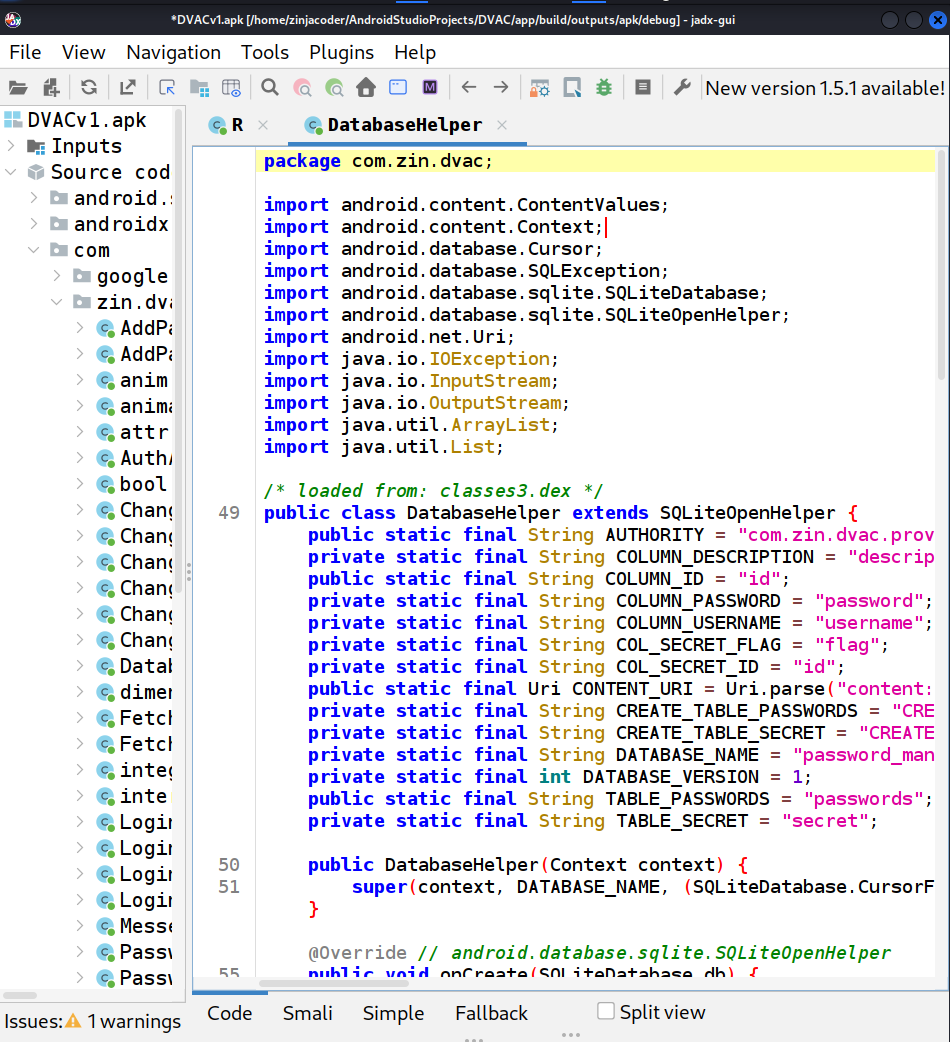

- 运行 jadx-gui 并加载任意 .apk 文件

- 启动 Claude - 您应该会看到锤子图标

- 点击“锤子”图标,您应该会看到类似以下的内容:

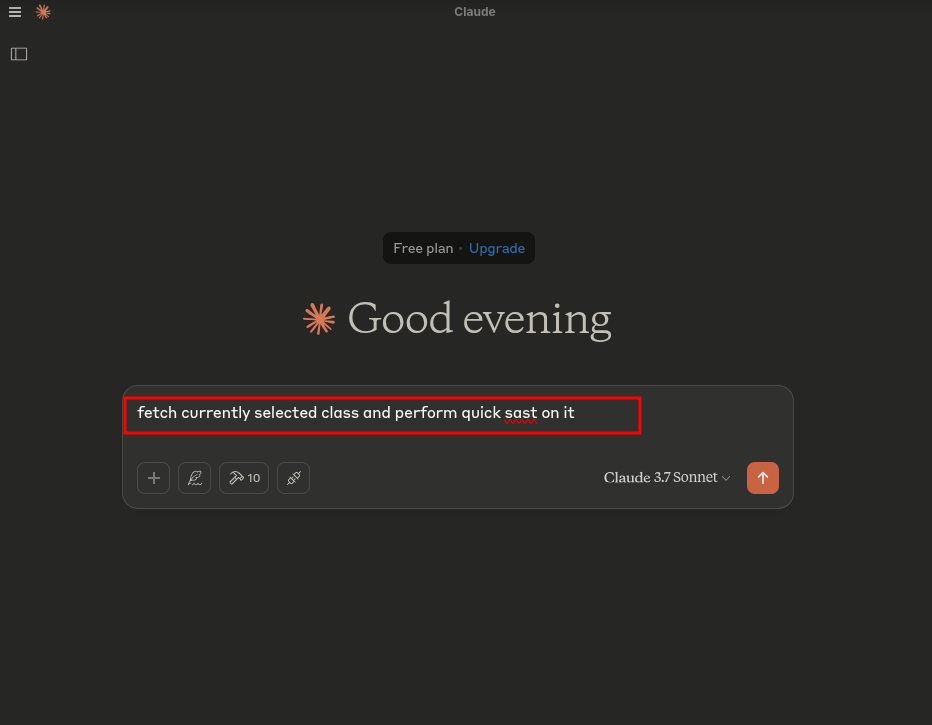

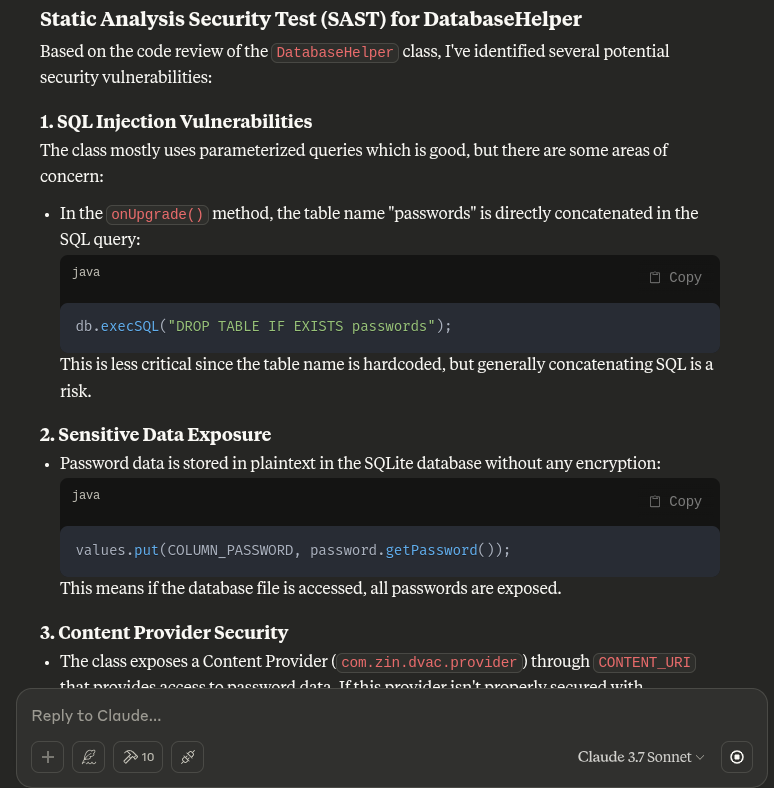

- 输入以下提示:

获取当前选中的类,并对其执行快速 SAST 分析

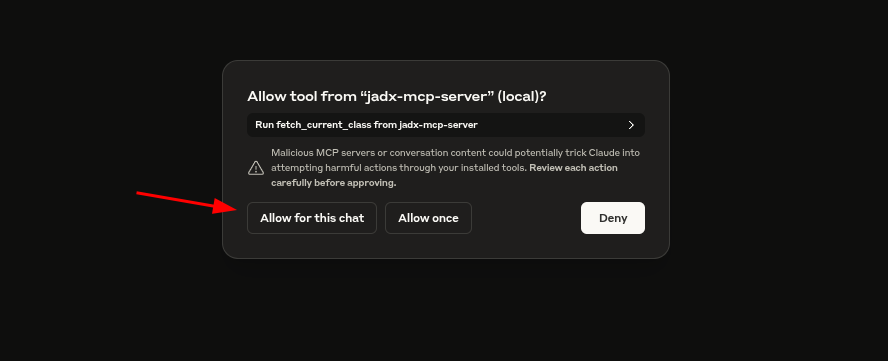

- 在出现提示时允许访问:

- 黑客攻击!

此插件允许完全控制 GUI 和内部项目模型,以支持更深入的 LLM 集成,包括:

- 将选定的类导出到 MCP

- 运行自动化的 Claude 分析

- 接收内联建议

故障排除

贡献者须知

- 与 JADX-AI-MCP 相关的文件可在本仓库中找到。

- 与 jadx-mcp-server 相关的文件可在 此处 找到。

如需报告 bug、问题、功能建议、性能问题、一般性疑问或文档问题,请使用相应的模板提交 issue。

- 已在 Claude Desktop Client 上测试,对其他 AI 的支持将很快推出!

🙏 致谢

该项目是为 JADX 开发的一个插件,JADX 是由 @skylot 创建并维护的优秀开源 Android 反编译工具。所有核心反编译逻辑均归其所有。我仅扩展了它,使其能够通过我的 MCP 服务器支持 AI 功能。

原始的 README.md 已包含在本仓库中,以供参考和致谢。

该 MCP 服务器的实现得益于 JADX-GUI 的可扩展性以及出色的 Android 逆向工程社区。

同时,非常感谢 @aaddrick 为基于 Debian 的 Linux 开发了 Claude 桌面版。

最后,感谢 @anthropics 开发了 Model Context Protocol,以及 @FastMCP 团队。

除此之外,还要感谢所有为本项目提供依赖并使其成为可能的开源项目。

依赖项

本项目使用了以下优秀的库:

插件 - Java

- Javalin - https://javalin.io/ - Apache 2.0 许可证

- SLF4J - https://slf4j.org/ - MIT 许可证

- org.w3c.dom - https://mvnrepository.com/artifact/org.w3c.dom - W3C 软件与文档许可证

MCP 服务器 - Python

- FastMCP - https://github.com/jlowin/fastmcp - Apache 2.0 许可证

- httpx - https://www.python-httpx.org - BSD-3-Clause(“BSD 许可”)

📄 许可证

JADX-AI-MCP 以及所有相关项目继承了来自原始 JADX 仓库的 Apache 2.0 许可证。

⚖️ 法律声明

免责声明

工具 jadx-ai-mcp 和 jadx_mcp_server 仅用于教育、研究和道德安全评估目的。它们按“原样”提供,不提供任何明示或暗示的保证。用户应自行负责确保其使用这些工具符合所有适用的法律、法规和道德准则。

通过使用 jadx-ai-mcp 或 jadx_mcp_server,您同意仅在您有权测试的环境中使用它们,例如您拥有的应用程序或经明确许可可分析的应用程序。严禁将这些工具用于未经授权的逆向工程、侵犯知识产权或恶意活动。

jadx-ai-mcp 和 jadx_mcp_server 的开发者对因使用或滥用这些工具而导致的任何损害、数据丢失、法律后果或其他后果概不负责。用户应对自己的行为及其使用所产生的任何影响承担全部责任。

请负责任地使用。尊重知识产权。遵循道德黑客实践。

🙌 贡献或支持

- 觉得有用吗?给个 ⭐️ 吧!

- 有想法吗?打开一个 issue 或提交 PR。

- 基于此构建了什么新东西吗?私信我或提及我——我会将其添加到 README 中!

- 喜欢我的工作并希望继续支持吗?请赞助本项目。

用 ❤️ 为逆向工程和 AI 社区打造。

版本历史

v6.3.02026/03/29v6.2.02026/02/28v6.1.02026/01/24v6.0.02025/12/29v5.0.02025/12/05v4.2.02025/11/27v4.1.02025/11/21v4.0.02025/11/04v3.3.52025/10/31v3.3.42025/10/27v3.3.32025/10/22v3.3.22025/10/16v3.3.12025/09/11v3.3.02025/09/09v3.2.02025/09/06v3.1.02025/08/31v3.0.02025/07/31v2.2.122025/07/31v2.2.112025/06/19v2.2.42025/05/09常见问题

相似工具推荐

openclaw

OpenClaw 是一款专为个人打造的本地化 AI 助手,旨在让你在自己的设备上拥有完全可控的智能伙伴。它打破了传统 AI 助手局限于特定网页或应用的束缚,能够直接接入你日常使用的各类通讯渠道,包括微信、WhatsApp、Telegram、Discord、iMessage 等数十种平台。无论你在哪个聊天软件中发送消息,OpenClaw 都能即时响应,甚至支持在 macOS、iOS 和 Android 设备上进行语音交互,并提供实时的画布渲染功能供你操控。 这款工具主要解决了用户对数据隐私、响应速度以及“始终在线”体验的需求。通过将 AI 部署在本地,用户无需依赖云端服务即可享受快速、私密的智能辅助,真正实现了“你的数据,你做主”。其独特的技术亮点在于强大的网关架构,将控制平面与核心助手分离,确保跨平台通信的流畅性与扩展性。 OpenClaw 非常适合希望构建个性化工作流的技术爱好者、开发者,以及注重隐私保护且不愿被单一生态绑定的普通用户。只要具备基础的终端操作能力(支持 macOS、Linux 及 Windows WSL2),即可通过简单的命令行引导完成部署。如果你渴望拥有一个懂你

stable-diffusion-webui

stable-diffusion-webui 是一个基于 Gradio 构建的网页版操作界面,旨在让用户能够轻松地在本地运行和使用强大的 Stable Diffusion 图像生成模型。它解决了原始模型依赖命令行、操作门槛高且功能分散的痛点,将复杂的 AI 绘图流程整合进一个直观易用的图形化平台。 无论是希望快速上手的普通创作者、需要精细控制画面细节的设计师,还是想要深入探索模型潜力的开发者与研究人员,都能从中获益。其核心亮点在于极高的功能丰富度:不仅支持文生图、图生图、局部重绘(Inpainting)和外绘(Outpainting)等基础模式,还独创了注意力机制调整、提示词矩阵、负向提示词以及“高清修复”等高级功能。此外,它内置了 GFPGAN 和 CodeFormer 等人脸修复工具,支持多种神经网络放大算法,并允许用户通过插件系统无限扩展能力。即使是显存有限的设备,stable-diffusion-webui 也提供了相应的优化选项,让高质量的 AI 艺术创作变得触手可及。

everything-claude-code

everything-claude-code 是一套专为 AI 编程助手(如 Claude Code、Codex、Cursor 等)打造的高性能优化系统。它不仅仅是一组配置文件,而是一个经过长期实战打磨的完整框架,旨在解决 AI 代理在实际开发中面临的效率低下、记忆丢失、安全隐患及缺乏持续学习能力等核心痛点。 通过引入技能模块化、直觉增强、记忆持久化机制以及内置的安全扫描功能,everything-claude-code 能显著提升 AI 在复杂任务中的表现,帮助开发者构建更稳定、更智能的生产级 AI 代理。其独特的“研究优先”开发理念和针对 Token 消耗的优化策略,使得模型响应更快、成本更低,同时有效防御潜在的攻击向量。 这套工具特别适合软件开发者、AI 研究人员以及希望深度定制 AI 工作流的技术团队使用。无论您是在构建大型代码库,还是需要 AI 协助进行安全审计与自动化测试,everything-claude-code 都能提供强大的底层支持。作为一个曾荣获 Anthropic 黑客大奖的开源项目,它融合了多语言支持与丰富的实战钩子(hooks),让 AI 真正成长为懂上

ComfyUI

ComfyUI 是一款功能强大且高度模块化的视觉 AI 引擎,专为设计和执行复杂的 Stable Diffusion 图像生成流程而打造。它摒弃了传统的代码编写模式,采用直观的节点式流程图界面,让用户通过连接不同的功能模块即可构建个性化的生成管线。 这一设计巧妙解决了高级 AI 绘图工作流配置复杂、灵活性不足的痛点。用户无需具备编程背景,也能自由组合模型、调整参数并实时预览效果,轻松实现从基础文生图到多步骤高清修复等各类复杂任务。ComfyUI 拥有极佳的兼容性,不仅支持 Windows、macOS 和 Linux 全平台,还广泛适配 NVIDIA、AMD、Intel 及苹果 Silicon 等多种硬件架构,并率先支持 SDXL、Flux、SD3 等前沿模型。 无论是希望深入探索算法潜力的研究人员和开发者,还是追求极致创作自由度的设计师与资深 AI 绘画爱好者,ComfyUI 都能提供强大的支持。其独特的模块化架构允许社区不断扩展新功能,使其成为当前最灵活、生态最丰富的开源扩散模型工具之一,帮助用户将创意高效转化为现实。

markitdown

MarkItDown 是一款由微软 AutoGen 团队打造的轻量级 Python 工具,专为将各类文件高效转换为 Markdown 格式而设计。它支持 PDF、Word、Excel、PPT、图片(含 OCR)、音频(含语音转录)、HTML 乃至 YouTube 链接等多种格式的解析,能够精准提取文档中的标题、列表、表格和链接等关键结构信息。 在人工智能应用日益普及的今天,大语言模型(LLM)虽擅长处理文本,却难以直接读取复杂的二进制办公文档。MarkItDown 恰好解决了这一痛点,它将非结构化或半结构化的文件转化为模型“原生理解”且 Token 效率极高的 Markdown 格式,成为连接本地文件与 AI 分析 pipeline 的理想桥梁。此外,它还提供了 MCP(模型上下文协议)服务器,可无缝集成到 Claude Desktop 等 LLM 应用中。 这款工具特别适合开发者、数据科学家及 AI 研究人员使用,尤其是那些需要构建文档检索增强生成(RAG)系统、进行批量文本分析或希望让 AI 助手直接“阅读”本地文件的用户。虽然生成的内容也具备一定可读性,但其核心优势在于为机器

LLMs-from-scratch

LLMs-from-scratch 是一个基于 PyTorch 的开源教育项目,旨在引导用户从零开始一步步构建一个类似 ChatGPT 的大型语言模型(LLM)。它不仅是同名技术著作的官方代码库,更提供了一套完整的实践方案,涵盖模型开发、预训练及微调的全过程。 该项目主要解决了大模型领域“黑盒化”的学习痛点。许多开发者虽能调用现成模型,却难以深入理解其内部架构与训练机制。通过亲手编写每一行核心代码,用户能够透彻掌握 Transformer 架构、注意力机制等关键原理,从而真正理解大模型是如何“思考”的。此外,项目还包含了加载大型预训练权重进行微调的代码,帮助用户将理论知识延伸至实际应用。 LLMs-from-scratch 特别适合希望深入底层原理的 AI 开发者、研究人员以及计算机专业的学生。对于不满足于仅使用 API,而是渴望探究模型构建细节的技术人员而言,这是极佳的学习资源。其独特的技术亮点在于“循序渐进”的教学设计:将复杂的系统工程拆解为清晰的步骤,配合详细的图表与示例,让构建一个虽小但功能完备的大模型变得触手可及。无论你是想夯实理论基础,还是为未来研发更大规模的模型做准备