Awesome-Embodied-Robotics-and-Agent

Awesome-Embodied-Robotics-and-Agent 是一个精心整理的开源资源库,专注于汇聚“具身智能”领域的前沿研究,特别是结合大语言模型(LLM)和视觉 - 语言模型(VLM)的机器人与智能体技术。它旨在解决该领域论文爆发式增长导致的信息分散问题,为研究者提供一站式的高质量文献导航,涵盖从基础理论综述、视觉 - 语言 - 动作模型(VLA)、智能体自我进化,到多智能体协作及各类仿真基准测试等全方位内容。

该资源库特别适合人工智能研究人员、机器人开发者以及高校师生使用。无论是希望快速把握行业趋势的初学者,还是需要追踪最新算法(如 π-0.5 轻量级框架、Mobile-Agent-v2 等)的资深专家,都能从中高效获取关键信息。其独特亮点在于不仅收录了经典的学术论文,还持续更新包括 ICLR、CVPR 等顶级会议的最新成果,甚至涵盖了智能体在电子游戏中的创新应用案例。通过清晰的分类目录和及时的动态维护,Awesome-Embodied-Robotics-and-Agent 成为了连接理论研究与实际落地的重要桥梁,助力社区共同推动具身智能技术的发展。

使用场景

某高校具身智能实验室的研究团队正致力于开发一款能理解自然语言指令并执行复杂家务操作的机器人,急需整合视觉 - 语言 - 动作(VLA)模型与多智能体协作技术。

没有 Awesome-Embodied-Robotics-and-Agent 时

- 文献检索效率低下:研究人员需在 arXiv、GitHub 和各大会议网站间手动穿梭,耗费数周才能拼凑出关于"Self-Evolving Agents"或"Efficient VLA"的零散论文,极易遗漏如 ICLR 2024 获奖论文等关键成果。

- 技术选型盲目试错:面对层出不穷的新框架(如 π-0.5 或 Mobile-Agent-v2),团队缺乏系统性的对比视角,往往花费大量时间复现过时或不适合物理系统的模型,导致项目进度严重滞后。

- 前沿动态感知滞后:由于缺乏统一的更新源,团队难以及时获取如"CRADLE 在游戏中的智能体应用”或最新的多智能体协同导航方案,导致研究思路局限于旧有范式,创新性不足。

- 基准测试标准混乱:在评估机器人性能时,找不到权威且最新的 Benchmark 列表,不同组员使用不同的评测数据集,导致实验结果无法横向对比,验证周期被无限拉长。

使用 Awesome-Embodied-Robotics-and-Agent 后

- 一站式资源聚合:团队直接利用该仓库分类清晰的目录(如 Vision-Language-Action Model、Simulator),几分钟内即可锁定 2025 年最新的高效 VLA 综述及相关代码库,文献调研时间缩短 80%。

- 精准技术落地:通过查看仓库中关于 π-0.5 轻量化框架和 Mobile-Agent-v2 的具体介绍,团队迅速确定了适合嵌入式设备的感知控制方案,避免了在非模块化架构上的无效投入。

- 实时追踪前沿突破:订阅仓库更新后,团队第一时间掌握了代理自进化(Self-Evolution)和多智能体协作的最新进展,迅速将"Learning Interactive Real-World Simulators"的思路引入仿真训练,显著提升了算法泛化能力。

- 统一评测体系:依据仓库推荐的 Benchmark 和 Simulator 列表,团队建立了标准化的评估流程,确保了实验数据的可比性,加速了从仿真到真机部署的迭代闭环。

Awesome-Embodied-Robotics-and-Agent 将原本分散杂乱的具身智能研究资源转化为结构化的知识图谱,成为研发团队加速技术落地与创新的核心引擎。

运行环境要求

未说明

未说明

快速开始

🤖 令人惊叹的具身机器人与智能体

这是一个由haonan维护的精选列表,专注于“结合视觉-语言模型(VLMs)和大型语言模型(LLMs)的具身机器人或智能体”相关研究。

请关注本仓库以获取最新动态,并如果您发现一些有趣的论文,欢迎随时提交Pull Request!

新闻🔥

[2025/10/30] 🎉 我们的综述论文“高效视觉-语言-行动模型综述”[arXiv]已发布!

[2025/04/23] 增加了π-0.5,这是一个轻量级且模块化的框架,旨在将感知、控制和学习直接集成到物理系统中。

[2025/03/18] 添加了一些流行的视觉-语言-行动(VLA)模型。🦾

[2024/06/28] 创建了一个关于智能体自我进化研究的新板块。🤖

[2024/06/07] 添加了Mobile-Agent-v2,这是一款通过多智能体协作实现高效导航的移动设备操作助手。🚀

[2024/05/13] 添加了“学习交互式真实世界模拟器”——该论文荣获ICLR 2024杰出论文奖🥇。

[2024/04/24] 添加了“大型语言模型的自我进化综述”,这是一篇系统性地探讨LLM自我进化的综述!💥

[2024/04/16] 添加了一些CVPR 2024的论文。

[2024/04/15] 添加了MetaGPT,该论文被ICLR 2024接受为口头报告(排名前1.2%),并在基于LLM的智能体类别中位居#1。🚀

[2024/03/13] 添加了CRADLE,一篇有趣的研究论文,探讨了在《荒野大镖客2》中使用LLM驱动的智能体!🎮

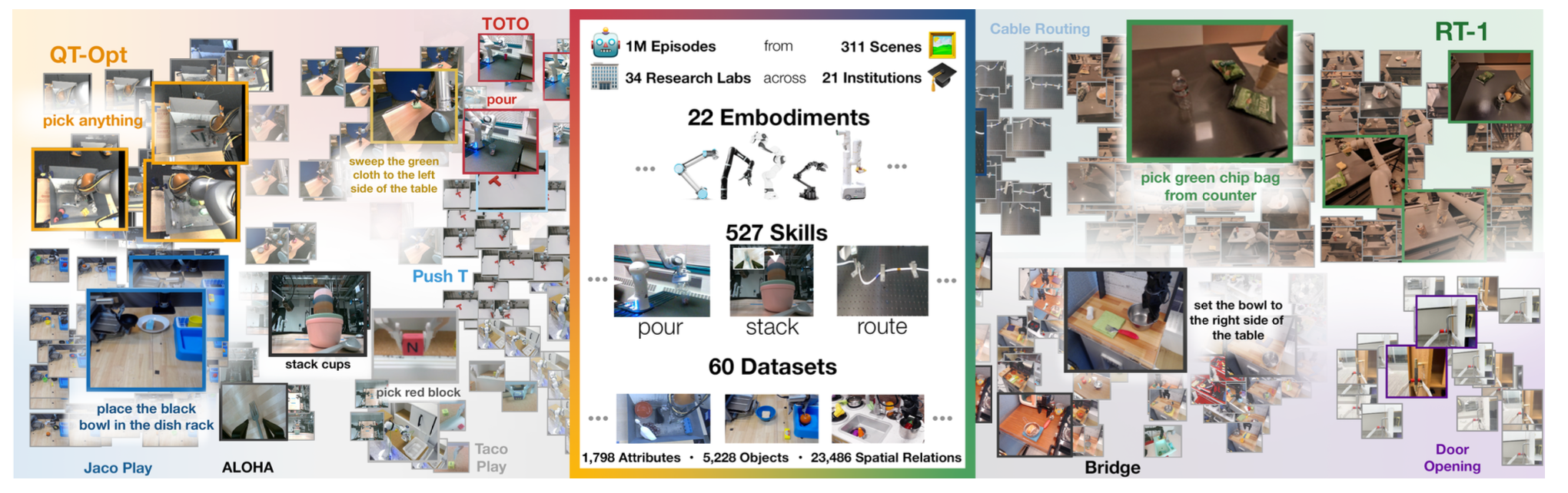

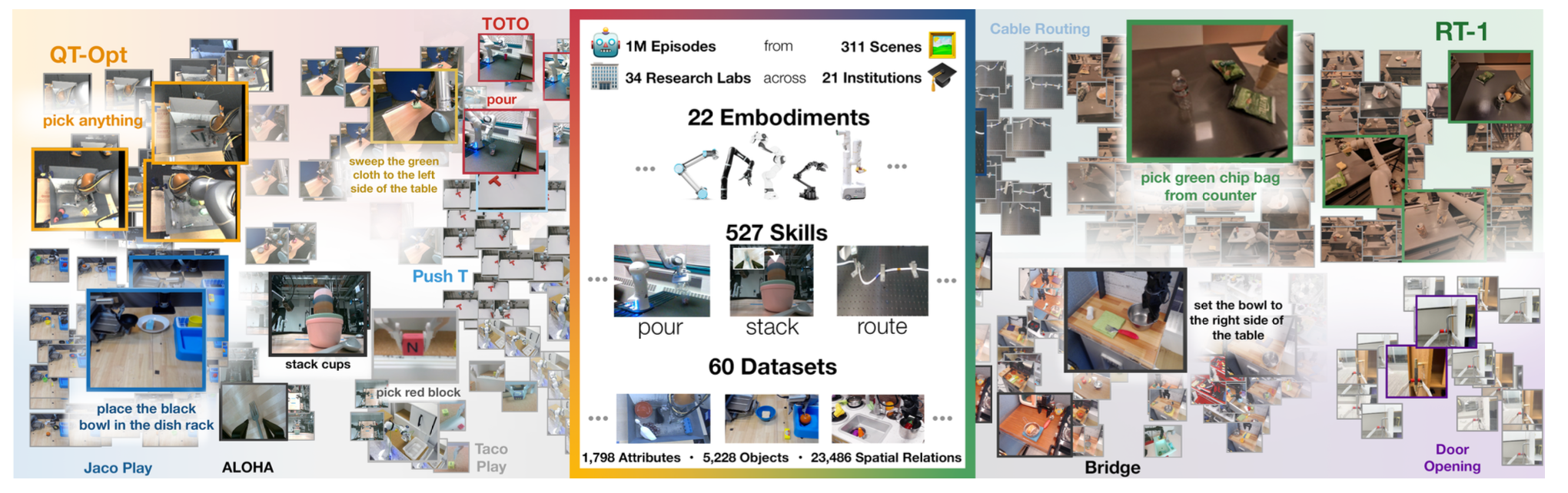

具身机器人发展与基准测试

- 视频演示及图片来自[1]和[2]。

目录 🍃

- 综述

- 视觉-语言-行动模型

- 自我进化智能体

- 高级智能体应用

- 结合强化学习或世界模型的LLMs

- 规划与操控或预训练

- 多智能体学习与协调

- 视觉与语言导航

- 检测

- 3D接地

- 交互式具身学习

- 重新布局

- 基准测试

- 模拟器

- 其他

方法

综述

- 高效视觉-语言-行动模型综述 [arXiv 2025.10] [Github] [项目页面]

余照书1, 王博1, 曾鹏鹏1, 张浩楠1, 张继1, 高莲莉3, 宋京宽1, 尼库·塞贝4, 沈恒涛1

1同济大学, 2西南交通大学, 3电子科技大学, 4特伦托大学

面向具身AI的视觉-语言-行动模型综述 [arXiv 2024.03]

香港中文大学、华为诺亚方舟实验室大型多模态智能体:综述 [arXiv 2024.02] [Github]

谢俊林♣♡ 陈志宏♣♡ 张瑞飞♣♡ 向万♣ 李冠斌♠

♡香港中文大学深圳分校,♣深圳大数据研究院,♠中山大学

大型语言模型的自我进化综述 [arXiv 2024.01]

HCST重点实验室(北大)、教育部;北京大学计算机学院、阿里巴巴集团、南洋理工大学智能体AI:探索多模态交互的边界 [arXiv 2024.01]

斯坦福大学、微软研究院(雷德蒙德)、加州大学洛杉矶分校、华盛顿大学、微软游戏部门点燃语言智能:从思维链推理到语言智能体的指南 [arXiv 2023.11]

上海交通大学、亚马逊云服务、耶鲁大学基于大型语言模型的智能体崛起与潜力:综述 [arXiv 2023.09]

复旦NLP小组、米哈游公司基于LLM的自主智能体综述 [arXiv 2023.08]

高瓴人工智能学院、中国人民大学

视觉-语言-行动模型

D2E:在桌面数据上扩展视觉-行动预训练,以迁移到具身AI [ICLR 2026] [Github][项目页面][HuggingFace🤗]

斯坦福大学、首尔国立大学、MAUM.AI基于具身思维链推理的机器人控制 [CoRL 2024] [Github][项目页面][HuggingFace🤗]

米哈尔·扎瓦尔斯基∗1,2, 威廉·陈∗1, 卡尔·佩尔奇1,3 奥耶尔·梅斯1, 切尔西·芬恩3, 谢尔盖·莱文1

1加州大学伯克利分校,2华沙大学,3斯坦福大学

π0.5:具有开放世界泛化能力的VLA [arXiv 2025.04] [项目页面]

物理智能π0:用于通用机器人控制的视觉-语言-动作流模型 [arXiv 2024.10] [项目页面]

物理智能Hi Robot:基于层次化视觉-语言-动作模型的开放式指令遵循 [arXiv 2025.02] [项目页面]

物理智能OpenVLA:开源视觉-语言-动作模型 [arXiv 2024.01] [Github][项目页面][HuggingFace🤗]

斯坦福大学、加州大学伯克利分校、丰田研究院、谷歌DeepMind、物理智能、麻省理工学院FAST:视觉-语言-动作模型的高效动作标记化 [arXiv 2025.01] [项目页面][HuggingFace🤗]

物理智能RT-2:将网络知识迁移到机器人控制中的视觉-语言-动作模型 [arXiv 2024.07] [项目页面]

谷歌DeepMindEmbodied-Reasoner:为具身交互任务协同视觉搜索、推理与行动 [arXiv 2025.03] [Github] [项目页面] [HuggingFace🤗]

浙江大学;中国科学院软件研究所;阿里巴巴集团

自我进化的智能体

- Meta-Control:面向异构机器人技能的自动模型基控制系统合成 [CoRL 2024] [项目页面]

Tianhao Wei1*, Liqian Ma12*, Rui Chen1, Weiye Zhao1, Changliu Liu1

1卡内基梅隆大学 2清华大学

AGENTGYM:在多样化环境中进化大型语言模型驱动的智能体 [arXiv 2024.06] [Github] [项目页面]

复旦NLP实验室及复旦视觉与学习实验室交互式进化:大型语言模型的神经符号自训练框架 [arXiv 2024.06] [Github]

Fangzhi Xu♢♡, Qiushi Sun2, ♡, Kanzhi Cheng1, Jun Liu♢, Yu Qiao♡, Zhiyong Wu♡

♢西安交通大学,♡上海人工智能实验室,1香港大学,2南京大学

- 符号学习赋能自我进化的智能体 [arXiv 2024.06] [Github]

Wangchunshu Zhou, Yixin Ou, Shengwei Ding, Long Li, Jialong Wu, Tiannan Wang, Jiamin Chen, Shuai Wang, Xiaohua Xu, Ningyu Zhang, Huajun Chen, Yuchen Eleanor Jiang

AIWaves公司 https://meta-control-paper.github.io/

高级智能体应用

- Meta-Control:面向异构机器人技能的自动模型基控制系统合成 [CoRL 2024] [项目页面]

Tianhao Wei1*, Liqian Ma12*, Rui Chen1, Weiye Zhao1, Changliu Liu1

*共同第一作者 1卡内基梅隆大学 2清华大学

[Embodied-agents] [Github]

无缝集成最先进的Transformer模型到机器人系统中。Mobile-Agent-v2:通过多智能体协作实现高效导航的移动设备操作助手 [arXiv 2024] [Github]

Junyang Wang1, Haiyang Xu2, Haitao Jia1, Xi Zhang2, Ming Yan2, Weizhou Shen2, Ji Zhang2, Fei Huang2, Jitao Sang1

1北京交通大学 2阿里巴巴集团

- Mobile-Agent:强大的移动设备操作助手家族 [ICLR 2024 LLM智能体研讨会] [Github]

Junyang Wang1, Haiyang Xu2, Jiabo Ye2, Ming Yan2, Weizhou Shen2, Ji Zhang2, Fei Huang2, Jitao Sang1

1北京交通大学 2阿里巴巴集团

[Machinascript-for-robots] [Github]

使用MachinaScript For Robots,在自家车库就能打造LLM驱动的机器人![ros2_medkit] [Github] [MCP服务器]

基于LLM的ROS 2机器人诊断——故障检测、根本原因分析,并通过MCP实现自我修复。DiffAgent:利用大型语言模型快速准确地选择文生图API [CVPR 2024] [Github]

Lirui Zhao1,2 Yue Yang2,4 Kaipeng Zhang2 Wenqi Shao2, Yuxin Zhang1, Yu Qiao2, Ping Luo2,3 Rongrong Ji1

1厦门大学,2OpenGVLab、上海人工智能实验室,3香港大学,4上海交通大学

MetaGPT:用于多智能体协作框架的元编程 [ICLR 2024(口头报告)]

DeepWisdom、AI Initiative、阿卜杜拉国王科技大学、厦门大学、香港中文大学、深圳、南京大学、宾夕法尼亚大学、加州大学伯克利分校、瑞士AI实验室IDSIA/USI/SUPSIAppAgent:作为智能手机用户的多模态智能体 [项目页面] [Github]

张驰∗ 赵阳∗ 刘家轩∗ 韩宇成 陈鑫 黄泽彪 付斌 于刚†

腾讯

结合强化学习或世界模型的大型语言模型

- KALM:基于大型语言模型回放的离线强化学习构建的知识型智能体 [NeurIPS 2024] [项目页面]

庞景程、杨思航、李凯源、张嘉吉、陈雄辉、唐楠、余洋

1南京大学,2Polixir.ai

- 学习交互式真实世界模拟器 [ICLR 2024(杰出论文)] [项目页面]

杨雪莉1,2、杜一伦3、加米亚尔·卡塞米普尔2、乔纳森·汤普森2、莱斯利·凯尔布林3、戴尔·舒尔曼斯2、皮特·阿贝尔1

1UC伯克利,2谷歌DeepMind,3MIT

鲁棒智能体学习因果世界模型 [ICLR 2024]

乔纳森·里琴斯*、汤姆·埃弗里特

谷歌DeepMind由大型语言模型从平行TextWorld训练的具身多模态智能体 [CVPR 2024] [Github]

杨义军154、周天翼2、李侃学3、陶大鹏3、李路松4、沈力4、何晓东4、蒋静5、史宇辉1

1南方科技大学,2马里兰大学帕克分校,3云南大学,4京东探索研究院,5悉尼科技大学

- 利用预训练大型语言模型构建并使用基于模型的任务规划世界模型 [NeurIPS 2023] [项目页面][Github]

关琳1、卡尔蒂克·瓦尔米坎1、萨拉特·斯里德哈兰2、苏巴拉奥·坎巴帕蒂1

1亚利桑那州立大学坦佩校区计算与人工智能学院,2科罗拉多州立大学计算机科学系

- Eureka:通过编码大型语言模型实现人类水平的奖励设计 [NeurIPS 2023 ALOE研讨会亮点] [项目页面] [Github]

贾森·马1,2、威廉·梁2、王冠志1,3、黄德安1, 奥斯伯特·巴斯塔尼2、迪内什·贾亚拉曼2、朱玉科1,4、范林希“吉姆”1、阿尼玛·阿南德库马尔1,3

1NVIDIA;2宾夕法尼亚大学;3加州理工学院;4德州大学奥斯汀分校

RLAdapter:在开放世界中将大型语言模型与强化学习连接起来 [arXiv 2023]

语言智能体能否替代PPO?关于OpenAI Gym的初步实证研究 [arXiv 2023]

RoboGPT:用于日常指令任务的具身长期决策智能体 [arXiv 2023]

像大型语言模型一样对齐智能体 [arXiv 2023]

AMAGO:面向自适应智能体的可扩展上下文强化学习 [ICLR 2024亮点]

STARLING:利用大型语言模型进行文本强化学习智能体的自监督训练 [arXiv 2023]

Text2Reward:利用语言模型为强化学习生成密集奖励 [ICLR 2024亮点]

在文本多智能体强化学习中利用大型语言模型优化协作 [arXiv 2023]

面向交互式指令跟随智能体的在线持续学习 [ICLR 2024]

ADAPTER-RL:利用强化学习适配任意智能体 [arXiv 2023]

用于强化学习预训练的语言奖励调制 [arXiv 2023]

通过将自然语言映射到马尔可夫决策过程来指导强化学习智能体 [arXiv 2023]

用语言学习建模世界 [arXiv 2023]

MAMBA:一种用于元强化学习的有效世界模型方法 [ICLR 2024]

用于强化学习预训练的语言奖励调制 [arXiv 2023] [Github]

阿德米·阿德尼吉、安珀·谢、卡梅洛·斯费拉扎、徐永教、斯蒂芬·詹姆斯、皮特·阿贝尔

1UC伯克利

- 用大型语言模型指导强化学习的预训练 [ICML 2023]

杜雨晴1*、奥利维娅·沃特金斯1*、王子涵2、塞德里克·科拉斯3,4、特雷弗·达雷尔1、皮特·阿贝尔1、阿比舍克·古普塔2、雅各布·安德烈亚斯3

1美国加州大学伯克利分校电气工程与计算机科学系,2华盛顿大学西雅图分校,3麻省理工学院计算机科学与人工智能实验室,4Inria花卉实验室。

规划与操作或预训练

- RoboRefer:迈向机器人视觉—语言模型中的推理空间指代 [Arxiv 2025] [项目页面] [代码]

周恩深1,2,、安京坤1,、迟诚2,*

1北京航空航天大学,2北京人工智能研究院

- RoboSpatial:为机器人2D和3D视觉-语言模型教授空间理解能力 [CVPR 2025(口头报告)] [项目页面] [代码]

宋灿熙1、瓦尔茨·布卢基斯2、乔纳森·特伦布雷2、斯蒂芬·泰里2、苏宇1、斯坦·伯奇菲尔德2

1俄亥俄州立大学,2NVIDIA

基于多模态接地的规划与高效重规划:通过少量示例学习具身智能体 [AAAI 2025] [项目页面]

金泰雄、金炳辉、崔钟贤†

首尔国立大学具身指令遵循智能体的环境反馈驱动式抢先行动修正 [CoRL 2024] [项目页面]

金珍妍1,2,、闵哲洪1,、金炳辉1、崔钟贤1

1首尔国立大学 2延世大学

- 元控制:面向异构机器人技能的自动模型基控制系统综合 [CoRL 2024] [项目页面]

魏天浩1*、马丽倩12*、陈睿1、赵伟业1、刘长流1

*共同第一作者 1卡内基梅隆大学 2清华大学

- Voyager:基于大型语言模型的开放式具身智能体 [NeurIPS 2023研讨会 ALOE Spotlight] [项目页面] [Github]

王冠志1,2、谢宇奇3、蒋云帆4、曼德尔卡尔1、肖超伟1,5、朱玉科1,3、范林溪1、安南德库马尔1,2

1NVIDIA,2加州理工学院,3得克萨斯大学奥斯汀分校,4斯坦福大学,5威斯康星大学麦迪逊分校

Agent-Pro:通过策略级反思与优化实现自我进化学习 [ACL 2024][Github]

张文琪、唐科、吴海、王梦娜、沈永亮、侯贵阳、谭泽奇、李鹏、庄雨婷、陆伟明自我对比:通过不一致的解题视角促进更佳的反思 [ACL 2024]

张文琪、沈永亮、吴琳娟、彭秋英、王军、庄雨婷、陆伟明MineDreamer:通过想象链式推理学习指令跟随,用于模拟世界控制 [arXiv 2024] [项目页面]

周恩深1,2、秦怡然1,3、尹振飞1,4、黄宇洲3、张瑞茂3、盛路2、乔宇1、邵静1

1上海人工智能实验室,2香港中文大学深圳校区,3北京航空航天大学,4悉尼大学

- MP5:基于主动感知的Minecraft多模态开放式具身系统 [CVPR 2024] [项目页面]

秦怡然1,2、周恩深1,3、刘启昌1,4、尹振飞1,5、盛路3、张瑞茂2、乔宇1、邵静1

1上海人工智能实验室,2香港中文大学深圳校区,3北京航空航天大学,4清华大学,5悉尼大学

- 代码即监控:面向反应式与主动式的机器人故障检测的约束感知型可视化编程 [CVPR 2025] [项目页面]

周恩深1*、苏琪2*、池成3*;、张志正4、王中源3、黄铁军2,3、盛路1;、汪鹤2,3,4;

1北京航空航天大学,2北京大学,3北京智源人工智能研究院,4GalBot

- RILA:零样本语义视听导航的反思性与想象力语言智能体 [CVPR 2024]

杨泽远1、刘嘉庚、陈培豪2、阿努普·切里安3、蒂姆·马克斯、乔纳森·勒鲁4、甘创5

1清华大学,2华南理工大学,3三菱电机研究实验室(MERL),4三菱电机研究实验室,5MIT-IBM 沃森人工智能实验室

- 迈向通用计算机控制:以《荒野大镖客2》为例的多模态智能体 [arXiv 2024] [项目页面] [代码]

谭伟浩2、丁子洛1、张文涛2、李博宇1、周博文3、岳俊鹏3、夏浩冲2、蒋杰川3、郑龙涛2、徐欣润1、毕一飞1、顾鹏杰2,

1中国北京智源人工智能研究院;2新加坡南洋理工大学;3中国北京大学计算机学院

- 看见并思考:虚拟环境中的具身智能体 [arXiv 2023]

赵仲涵1*、柴文浩2*、王轩1*、李博毅1、郝圣宇1、曹士东1、田叶3、黄景能2、王高昂1

1浙江大学 1华盛顿大学 1香港科技大学(广州)

- 智能体指导大型语言模型成为通用零样本推理者 [arXiv 2023]

尼古拉斯·克里斯皮诺1、凯尔·蒙哥马利1、曾凡坤1、邓恩·宋2、王晨光1

1圣路易斯华盛顿大学,2加州大学伯克利分校

JARVIS-1:具有记忆增强型多模态语言模型的开放世界多任务智能体 [NeurIPS 2023] [项目页面]

王子豪1,2 蔡绍飞1,2 刘安吉3 金永刚4 侯金兵4 张博伟5 林浩伟1,2 何兆峰4 郑子龙6 杨耀东1 马晓健6† 梁义涛1†

1北京大学人工智能研究院,2北京大学智能科学与技术学院,3加州大学洛杉矶分校计算机科学系,4北京邮电大学,5北京大学电子工程与计算机科学学院,6北京通用人工智能研究院(BIGAI)描述、解释、规划与选择:基于大型语言模型的交互式规划赋能开放世界多任务智能体 [NeurIPS 2023]

王子豪1,2 蔡绍飞1,2 陈冠州3 刘安吉4 马晓健4 梁义涛1,5†

1北京大学人工智能研究院,2北京大学智能科学与技术学院,3北京邮电大学计算机学院,4加州大学洛杉矶分校计算机科学系,5北京通用人工智能研究院(BIGAI)CAMEL:用于大规模语言模型社会“心智”探索的沟通型智能体 [NeurIPS 2023] [Github] [项目页面]

李国豪、哈桑·阿贝德·阿尔·卡德尔·哈穆德、哈尼·伊塔尼、德米特里·希兹布林、伯纳德·加内姆

1阿卜杜拉国王科技大学(KAUST)

- 语言模型作为零样本规划器:为具身智能体提取可操作知识 [arXiv 2022] [Github] [项目页面]

黄文龙1, 彼得·阿贝尔1, 迪帕克·帕塔克2, 伊戈尔·莫达奇3

1UC伯克利,2卡内基梅隆大学,3谷歌

- FILM:通过模块化方法遵循语言指令 [ICLR 2022] [Github] [项目页面]

闵素妍1, 查普洛特·德文德拉2, 拉维库马尔·普拉迪普1, 比斯克·约纳坦1, 萨拉胡丁诺夫·鲁斯兰1

1卡内基梅隆大学,2Facebook AI Research

- 基于大型语言模型的具身任务规划 [arXiv 2023] [Github] [项目页面] [演示] [Huggingface模型]

吴振宇1, 王子威2,3, 徐秀伟2,3, 卢继文2,3, 闫海斌1*

1北京邮电大学自动化学院, 2清华大学自动化系, 3北京国家信息科学技术研究中心

- SPRING:通过研读论文和推理,GPT-4的表现超越强化学习算法 [arXiv 2023]

吴悦1,4* , 普拉布莫耶·施里迈2 , 闵素妍1 , 比斯克·约纳坦1 , 萨拉胡丁诺夫·鲁斯兰1 , 阿扎里亚·阿莫斯3 , 米切尔·汤姆1 , 李元智1,4

1卡内基梅隆大学,2NVIDIA,3阿里埃尔大学,4微软研究

- PONI:用于ObjectGoal导航的势能函数,无需交互式学习 [CVPR 2022(口头报告)] [项目页面] [Github]

桑托什·库马尔·拉马克里希南1,2, 查普洛特·德文德拉1, 扎伊德·阿尔-哈拉赫2 贾廷德拉·马利克1,3, 克里斯汀·格劳曼1,2

1Facebook AI Research,2UT奥斯汀,3UC伯克利

- 向后而行以向前迈进:将动作影响嵌入到动作语义中 [ICLR 2023] [项目页面] [Github]

曾国豪1, 卢卡·魏斯2, 鲁兹贝·莫塔吉1, 阿里·法拉希1

1华盛顿大学保罗·G·艾伦计算机科学与工程学院, 2PRIOR @ Allen Institute for AI

- 用场景图记忆建模动态环境 [ICML 2023]

安德烈·库伦科夫1, 迈克尔·林格尔巴赫1, 坦迈·阿加瓦尔1, 艾米丽·金1, 李成书1, 张若涵1, 李飞飞1, 吴家俊1, 萨瓦雷斯·西尔维奥2, 马丁-马丁·罗伯托3

1斯坦福大学计算机科学系 2Salesforce AI Research 3德克萨斯大学奥斯汀分校计算机科学系。

- 利用语言模型进行推理即是在使用世界模型进行规划 [arXiv 2023]

郝世博∗♣, 顾毅∗♣, 马浩迪♢, 洪嘉华·乔舒亚♣, 王振♣ ♠, 王哲·黛西♢, 胡志婷♣

♣UC圣地亚哥,♢佛罗里达大学, ♠穆罕默德·本·扎耶德人工智能大学

做我能做到的,而不是我说的:将语言与机器人可用性相结合 [arXiv 2022]

谷歌机器人团队,Everyday Robots具身智能体是否会梦见像素化的羊?:基于语言引导的世界建模的具身决策 [ICML 2023]

科尔比·诺丁汉1 普里特维拉吉·阿曼纳布罗卢2 阿兰·苏尔2 耶金·乔伊3,2 哈娜内·哈吉希尔齐3,2 萨米尔·辛格1,2 罗伊·福克斯1

1加州大学欧文分校计算机科学系 2艾伦人工智能研究所 3保罗·G·艾伦计算机科学学院

面向指令遵循的具身智能体的上下文感知规划与环境感知记忆 [ICCV 2023] [项目页面]

金炳辉 金珍妍 金有英1,* 闵哲洪 崔钟贤†

延世大学 1光州科学技术院内心独白:通过语言模型规划实现具身推理 [CoRL 2022] [项目页面]

谷歌机器人实验室语言模型邂逅世界模型:具身经验增强语言模型 [arXiv 2023]

[Twitter]

向建南∗♠, 陶天华∗♠, 顾毅♠, 舒天敏♢, 王子睿♠, 杨子超♡, 胡志廷♠

♠加州大学圣地亚哥分校, ♣伊利诺伊大学厄巴纳-香槟分校, ♢麻省理工学院, ♡卡内基梅隆大学

- AlphaBlock:用于机器人操作中视觉-语言推理的具身微调 [arXiv 2023] [视频]

金初浩1* , 谭文辉1* , 杨建阁2* , 刘贝3† , 宋瑞华1 , 王利民2 , 傅建龙3†

1中国人民大学, 2南京大学, 3微软研究院

- 用于高层自然语言指令执行的持久化空间语义表示 [CoRL 2021]

[项目页面] [海报]

瓦尔茨·布鲁基斯1,2, 克里斯·帕克斯顿1, 迪特·福克斯1,3, 阿尼梅什·加格1,4, 约阿夫·阿策2

1NVIDIA 2康奈尔大学 3华盛顿大学 4多伦多大学,Vector Institute

- LLM-Planner:利用大型语言模型为具身智能体进行少样本接地规划 [ICCV 2023] [项目页面] [Github]

宋灿熙1, 吴佳曼1, 克莱顿·华盛顿1, 布赖恩·M·萨德勒2, 曹伟伦1, 苏宇1

1俄亥俄州立大学, 2DEVCOM ARL

代码即策略:用于具身控制的语言模型程序 [arXiv 2023] [项目页面] [Github] [博客] [Colab]

杰基·梁、黄文龙、夏飞、徐鹏、卡罗尔·豪斯曼、布莱恩·伊克特、皮特·弗洛伦斯、安迪·曾

谷歌机器人实验室3D-LLM:将三维世界注入大型语言模型 [arXiv 2023]

1洪怡宁, 2甄浩宇, 3陈培浩, 4郑书红, 5杜一伦, 6陈振芳, 6,7甘创

1加州大学洛杉矶分校 2上海交通大学 3华南理工大学 4伊利诺伊大学厄巴纳-香槟分校 5麻省理工学院 6MIT-IBM沃森人工智能实验室 7马萨诸塞大学阿默斯特分校

- VoxPoser:结合语言模型的可组合3D价值图用于机器人操作 [arXiv 2023] [项目页面] [在线演示]

黄文龙1, 王晨1, 张若涵1, 李云珠1,2, 吴家俊1, 李飞飞1

1斯坦福大学 2伊利诺伊大学厄巴纳-香槟分校

- Palm-e:一种具身多模态语言模型 [ICML 2023] [项目页面]

1谷歌机器人实验室 2柏林工业大学 3谷歌研究

大型语言模型作为大规模任务规划中的常识知识 [arXiv 2023]

赵子睿 李伟孙 大卫·许

新加坡国立大学计算机学院三维世界中的具身通用智能体 [ICML 2024]

黄江勇、雍思龙、马晓健、凌虎雄坤、李普浩、王燕、李青、朱松春、贾宝雄、黄思远 北京通用人工智能研究院 (BIGAI)

多智能体学习与协作

- 利用大型语言模型模块化构建合作型具身智能体 [ICLR 2024] [项目页面] [Github]

张宏鑫1*, 杜伟华2*, 山嘉明3, 周勤洪1, 杜一伦4, 乔舒亚·B·特南鲍姆4, 舒天敏4, 甘创1,5

1马萨诸塞大学阿默斯特分校, 2清华大学, 3上海交通大学, 4MIT, 5MIT-IBM沃森人工智能实验室

- 战争与和平(WarAgent):基于大型语言模型的世界大战多智能体仿真 [arXiv 2023]

华文悦1*,范立洲2*,李凌瑶2,梅凯1,季建超1,葛英强1,利比·亨菲尔2,张永峰1

1罗格斯大学,2密歇根大学

MindAgent:涌现式游戏交互 [arXiv 2023]

龚然*1† 黄秋源*2‡ 马晓健*1 霍伊·沃3 泽恩·杜兰特†4 野田悠介3 郑子龙5 朱松纯15678 德米特里·特尔佐波洛斯1 李飞飞4 高剑锋2

1加州大学洛杉矶分校;2微软雷德蒙德研究院;3微软Xbox团队;4斯坦福大学;5BIGAI;6北京大学;7清华大学;8加州大学洛杉矶分校通过隐式与双向课程实现无需演示的自主强化学习 [ICML 2023]

金志刚*1,2 曹大瑟*1,2 金洪镇1,3

1首尔国立大学,2首尔国立大学人工智能研究所(AIIS),3自动化与系统研究所有限公司(ASRI)。

注:本文主要关注具身人工智能中的强化学习。

- 社交具身重组中的适应性协调 [ICML 2023]

安德鲁·索特1,2 安纳特·贾因1 德鲁夫·巴特拉1,2 兹索特·基拉2 鲁塔·戴赛1 阿克沙拉·赖1

1Meta AI 2佐治亚理工学院。

视觉与语言导航

- CANVAS:面向直观人机交互的常识感知导航系统 [ICRA 2025]

崔秀焕1 曹勇俊1 金珉灿1 郑在允1 赵民哲1 朴有彬1 金敏书2 金成雄2 李成宰2 朴辉成1 钟智完2 柳英载2

1MAUM.AI 2延世大学

- IndoorSim-to-OutdoorReal:无需任何户外经验即可学会户外导航 [arXiv 2023]

乔安妮·庄1,2, 四月·齐特科维奇1, 索尼娅·切尔诺娃2, 德鲁夫·巴特拉2,3, 张婷楠1, 谭杰1, 于文浩1

1谷歌机器人部门 2佐治亚理工学院 3Meta AI

- DivScene:用于对象导航的多样化场景与物体基准测试 [arXiv 2024] [项目页面]

王兆伟1, 张宏明2, 方天青1,2, 田烨3, 杨悦4, 马凯欣2, 潘小曼2, 宋阳秋1, 于东2

1香港科技大学计算机科学与工程系 2腾讯AI实验室,美国贝尔维尤 3腾讯Robotics X 4宾夕法尼亚大学

- ESC:带有软性常识约束的零样本对象导航探索 [ICML 2023]

周凯文1, 郑凯志1, 康纳·普赖尔1, 沈怡琳2, 金红霞2, 利斯·吉托尔1, 王新埃里克1

1加州大学圣克鲁斯分校 2Samsung Research America.

- NavGPT:利用大型语言模型进行视觉-语言导航中的显式推理 [arXiv 2023]

周耿泽1 洪一聪2 吴奇1

1阿德莱德大学 2澳大利亚国立大学

- Instruct2Act:利用大型语言模型将多模态指令映射为机器人动作 [arXiv 2023] [Github]

黄思远1,2 姜正凯4 董浩3 乔宇2 高鹏2 李洪生5

1上海交通大学,2上海人工智能实验室,3北京大学计算机学院CFCS, 4中国科学院大学,5香港中文大学

检测

- DetGPT:通过推理检测所需内容 [arXiv 2023]

皮仁杰1∗ 高佳慧2* 迪奥世哲1∗ 潘锐1 董汉泽1 张继鹏1 姚乐威1 韩建华3 徐航2 孔令鹏2 张彤1

1香港科技大学 2香港大学 3上海交通大学

3D定位

- LLM-Grounder:以大型语言模型为代理的开放词汇3D视觉定位 [arXiv 2023]

杨嘉宁1,, 陈旭伟1,, 钱盛义1, 尼基尔·马丹,艾扬格尔1, 大卫·F·福黑1,2, 乔伊斯·柴1

1密歇根大学,2纽约大学

- 3D-VisTA:用于3D视觉与文本对齐的预训练Transformer [ICCV 2023]

朱子宇、马晓健、陈一鑫、邓志东、黄思远、李青

北京通用人工智能研究院(BIGAI)

交互式具身学习

CombatVLA:用于3D动作角色扮演游戏战斗任务的高效视觉-语言-行动模型 [ICCV 2025] [项目页面]

陈鹏*,卜丕*,王英耀,王心怡,王子铭,郭杰,赵英秀,朱琪,宋军†,王思然,王家猛,郑博

阿里巴巴集团元控制:针对异构机器人技能的自动基于模型控制系统合成 [CoRL 2024] [项目页面]

魏天昊1*, 马丽倩12*, 陈瑞1, 赵伟业1, 刘昌柳1

*贡献相等 1卡内基梅隆大学 2清华大学

- 基于在线强化学习的交互环境中大型语言模型接地 [ICML 2023]

托马斯·卡尔塔1*, 克莱芒·罗马克1,2, 托马斯·沃尔夫2, 西尔万·朗普里耶3, 奥利维埃·西戈4, 皮埃尔-伊夫·乌代耶1

1法国国家信息与自动化研究所(Flowers),波尔多大学,2Hugging Face,3昂热大学,LERIA,SFR MATHSTIC, F-49000,4索邦大学,ISIR

在3D环境中学习用于交互探索的可供性景观 [NeurIPS 2020]

[项目页面]

图沙尔·纳加拉詹,克里斯汀·格劳曼

德克萨斯大学奥斯汀分校和Facebook AI Research,德克萨斯大学奥斯汀分校和Facebook AI Research基于点云感知的真实感环境中具身问答 [CVPR 2019(口头报告)] [幻灯片]

埃里克·维杰曼斯1†, 萨米亚克·达塔1, 奥列克桑德尔·马克西梅茨2†, 阿比谢克·达斯1, 乔治娅·吉科扎里2, 斯蒂芬·李1, 伊尔凡·埃萨1, 德维·帕里克1,2, 德鲁夫·巴特拉1,2

1佐治亚理工学院,2Facebook AI Research

- 多目标具身问答 [CVPR 2019]

李成宇1, 辛雷·陈3, 乔治娅·吉科扎里3, 莫希特·班萨尔1, 塔玛拉·L·伯格1,3, 德鲁夫·巴特拉2,3

1北卡罗来纳大学教堂山分校 2佐治亚理工学院 3Facebook AI

- 用于具身问答的神经模块化控制 [CoRL 2018(亮点论文)] [项目页面] [Github]

阿比谢克·达斯1, 乔治娅·吉科扎里2, 斯蒂芬·李1, 德维·帕里克1,2, 德鲁夫·巴特拉1,2

1佐治亚理工学院 2Facebook AI Research

1佐治亚理工学院,2Facebook AI Research

重新布置

- 一种简单的视觉房间重新布置方法:3D建图与语义搜索 [ICLR 2023]

1布兰登·特拉布科,2冈纳尔·A·西古尔德森,2罗宾逊·皮拉穆图,2,3高拉夫·S·苏卡特梅,1鲁斯兰·萨拉胡丁诺夫

1卡内基梅隆大学,2亚马逊Alexa AI,3南加州大学

基准测试

- RoboRefer:面向机器人技术的视觉-语言模型推理空间指代 [Arxiv 2025] [项目页面]

恩申·周1,2,, 景坤·安1,, 成驰2,*

1北京航空航天大学,2北京人工智能研究院

- DivScene:针对多样化场景与物体的对象导航的LVLM基准测试 [arXiv 2024] [项目页面]

赵伟王1, 洪明张2, 天青方1,2, 叶田3, 岳阳4, 凯欣马2, 小满潘2, 杨秋宋1, 东宇2

1香港科技大学计算机科学与工程系 2Tencent AI Lab,贝尔维尤,美国 3腾讯Robotics X 4宾夕法尼亚大学

- ReALFRED:真实感环境中的具身指令遵循基准测试 [ECCV 2024] [项目页面]

泰雄金1*, 哲洪闵1*, 别亨辉金1, 珍妍金12, 愿济郑1, 宗贤崔1

*同等贡献 1首尔国立大学 2延世大学

- 交互式指令遵循智能体的在线持续学习 [ICLR 2024] [项目页面]

别亨辉金1*, 敏赫徐1*, 宗贤崔2

*同等贡献 1延世大学 2首尔国立大学

- SmartPlay:作为智能代理的LLM基准测试 [ICLR 2024] [Github]

岳吴1,2, 玄唐1, 汤姆·米切尔1, 元志李1,2

1卡内基梅隆大学,2微软研究

- RoboGen:通过生成式仿真释放无限数据以实现机器人自动化学习 [arXiv 2023] [项目页面] [Github]

玉飞王1, 周贤1, 冯晨2, 恒轩王3, 亦安王4, 卡特琳娜·弗拉吉亚达基1, 扎科里·埃里克森1, 大卫·赫尔德1, 创甘4,5

1卡内基梅隆大学,2清华大学IIIS,3MIT CSAIL,4马萨诸塞大学阿默斯特分校,5MIT-IBM AI实验室

- ALFWorld:对齐文本与具身环境以进行交互式学习 [ICLR 2021] [项目页面] [Github]

莫希特·施里达尔† 星迪袁♡ 马克-亚历山大·科特♡ 约纳坦·比斯克‡ 亚当·特里施勒♡ 马修·豪斯克内希特♣

‡华盛顿大学 ♡Microsoft Research,蒙特利尔 ‡卡内基梅隆大学 ♣Microsoft Research

- ALFRED:面向日常任务的具身指令理解基准 [CVPR 2020] [项目页面] [Github]

Mohit Shridhar1 Jesse Thomason1 Daniel Gordon1 Yonatan Bisk1,2,3 Winson Han3 Roozbeh Mottaghi1,3 Luke Zettlemoyer1 Dieter Fox1,4

1华盛顿大学保罗·G·艾伦计算机科学与工程学院,

2卡内基梅隆大学语言技术研究所,

3艾伦人工智能研究所,

4NVIDIA

VIMA:多模态提示下的机器人操作 [ICML 2023] [项目页面] [Github] [VIMA-Bench]

Yunfan Jiang1 Agrim Gupta1† Zichen Zhang2† Guanzhi Wang3,4† Yongqiang Dou5 Yanjun Chen1 Li Fei-Fei1 Anima Anandkumar3,4 Yuke Zhu3,6‡ Linxi Fan3‡SQA3D:三维场景中的情境问答 [ICLR 2023] [项目页面] [幻灯片] [Github]

Xiaojian Ma2 Silong Yong1,3* Zilong Zheng1 Qing Li1 Yitao Liang1,4 Song-Chun Zhu1,2,3,4 Siyuan Huang1

1北京通用人工智能研究院(BIGAI) 2加州大学洛杉矶分校 3清华大学 4北京大学

- IQA:交互式环境中的视觉问答 [CVPR 2018] [Github] [演示视频(YouTube)]

Danie1 Gordon1 Aniruddha Kembhavi2 Mohammad Rastegari2,4 Joseph Redmon1 Dieter Fox1,3 Ali Farhadi1,2

1华盛顿大学保罗·G·艾伦计算机科学学院 2艾伦人工智能研究所 3Nvidia 4Xnor.ai

- Env-QA:用于全面理解动态环境的视频问答基准 [ICCV 2021] [项目页面] [Github]

Difei Gao1,2, Ruiping Wang1,2,3, Ziyi Bai1,2, Xilin Chen1,

1中国科学院智能信息处理重点实验室,中国科学院计算技术研究所, 2中国科学院大学, 3北京人工智能研究院

模拟器

LEGENT:具身智能体开放平台 [ACL 2024] [项目页面] [Github]

清华大学AI2-THOR:用于视觉人工智能的交互式3D环境 [arXiv 2022] [项目页面] [Github]

艾伦人工智能研究所、华盛顿大学、斯坦福大学、卡内基梅隆大学iGibson:大型真实场景中交互任务的仿真环境 [IROS 2021] [项目页面] [Github]

Bokui Shen*, Fei Xia* 等人Habitat:具身人工智能研究平台 [ICCV 2019] [项目页面] [Habitat-Sim] [Habitat-Lab] [Habitat挑战赛]

Facebook AI Research、Facebook Reality Labs、佐治亚理工学院、西蒙弗雷泽大学、英特尔实验室、加州大学伯克利分校Habitat 2.0:训练家庭助手重新整理其居住环境 [NeurIPS 2021] [项目页面]

Facebook AI Research、佐治亚理工学院、英特尔研究、西蒙弗雷泽大学、加州大学伯克利分校

其他

从简到繁提示法赋能大型语言模型进行复杂推理 [ICLR 2023]

谷歌研究院,大脑团队React:在语言模型中协同推理与行动 [ICLR 2023]

Shunyu Yao1∗, Jeffrey Zhao2, Dian Yu2, Nan Du2, Izhak Shafran2, Karthik Narasimhan1, Yuan Cao2

1普林斯顿大学计算机科学系 2, 谷歌研究院,大脑团队

思维算法:增强大型语言模型中的思路探索 [arXiv 2023]

弗吉尼亚理工大学、微软思维图谱:利用大型语言模型解决复杂问题 [arXiv 2023]

苏黎世联邦理工学院、Cledar公司、华沙理工大学思维树:利用大型语言模型进行审慎的问题解决 [arXiv 2023]

Shunyu Yao1, Dian Yu2, Jeffrey Zhao2, Izhak Shafran2, Thomas L. Griffiths1, Yuan Cao2, Karthik Narasimhan1

1普林斯顿大学, 2谷歌DeepMind

思维链提示在大型语言模型中激发推理能力 [NeurIPS 2022]

Jason Wei, Xuezhi Wang, Dale Schuurmans, Maarten Bosma, Brian Ichter, Fei Xia, Ed H. Chi, Quoc V. Le, Denny Zhou

谷歌研究院,大脑团队MINEDOJO:利用互联网规模知识构建开放式具身智能体 [NeurIPS 2022] [Github]

[项目页面] [知识库]

Linxi Fan1 , Guanzhi Wang2∗ , Yunfan Jiang3* , Ajay Mandlekar1 , Yuncong Yang4 , Haoyi Zhu5 , Andrew Tang4 , De-An Huang1 , Yuke Zhu1,6† , Anima Anandkumar1,2†

1NVIDIA, 2加州理工学院, 3斯坦福大学, 4哥伦比亚大学, 5上海交通大学, 6德克萨斯大学奥斯汀分校

将互联网规模的视觉-语言模型蒸馏为具身智能体 [ICML 2023]

Theodore Sumers1∗ Kenneth Marino2 Arun Ahuja2 Rob Fergus2 Ishita Dasgupta2LISA:基于大型语言模型的推理分割 [arXiv 2023] [Github] [Huggingface模型] [数据集] [在线演示]

TXin Lai1 Zhuotao Tian2 Yukang Chen1 Yanwei Li1 Yuhui Yuan3 Shu Liu2 Jiaya Jia1,2

1香港中文大学 2SmartMore 3MSRA

- 元控制:用于异构机器人技能的自动模型基控制系统合成 [CoRL 2024] [项目页面]

Tianhao Wei1*, Liqian Ma12*, Rui Chen1, Weiye Zhao1, Changliu Liu1

*贡献相等 1卡内基梅隆大学 2清华大学

致谢

[1] 来自此项目的视频演示

[2] 来自此[项目][https://robotics-transformer-x.github.io/)的图片

相似工具推荐

openclaw

OpenClaw 是一款专为个人打造的本地化 AI 助手,旨在让你在自己的设备上拥有完全可控的智能伙伴。它打破了传统 AI 助手局限于特定网页或应用的束缚,能够直接接入你日常使用的各类通讯渠道,包括微信、WhatsApp、Telegram、Discord、iMessage 等数十种平台。无论你在哪个聊天软件中发送消息,OpenClaw 都能即时响应,甚至支持在 macOS、iOS 和 Android 设备上进行语音交互,并提供实时的画布渲染功能供你操控。 这款工具主要解决了用户对数据隐私、响应速度以及“始终在线”体验的需求。通过将 AI 部署在本地,用户无需依赖云端服务即可享受快速、私密的智能辅助,真正实现了“你的数据,你做主”。其独特的技术亮点在于强大的网关架构,将控制平面与核心助手分离,确保跨平台通信的流畅性与扩展性。 OpenClaw 非常适合希望构建个性化工作流的技术爱好者、开发者,以及注重隐私保护且不愿被单一生态绑定的普通用户。只要具备基础的终端操作能力(支持 macOS、Linux 及 Windows WSL2),即可通过简单的命令行引导完成部署。如果你渴望拥有一个懂你

stable-diffusion-webui

stable-diffusion-webui 是一个基于 Gradio 构建的网页版操作界面,旨在让用户能够轻松地在本地运行和使用强大的 Stable Diffusion 图像生成模型。它解决了原始模型依赖命令行、操作门槛高且功能分散的痛点,将复杂的 AI 绘图流程整合进一个直观易用的图形化平台。 无论是希望快速上手的普通创作者、需要精细控制画面细节的设计师,还是想要深入探索模型潜力的开发者与研究人员,都能从中获益。其核心亮点在于极高的功能丰富度:不仅支持文生图、图生图、局部重绘(Inpainting)和外绘(Outpainting)等基础模式,还独创了注意力机制调整、提示词矩阵、负向提示词以及“高清修复”等高级功能。此外,它内置了 GFPGAN 和 CodeFormer 等人脸修复工具,支持多种神经网络放大算法,并允许用户通过插件系统无限扩展能力。即使是显存有限的设备,stable-diffusion-webui 也提供了相应的优化选项,让高质量的 AI 艺术创作变得触手可及。

everything-claude-code

everything-claude-code 是一套专为 AI 编程助手(如 Claude Code、Codex、Cursor 等)打造的高性能优化系统。它不仅仅是一组配置文件,而是一个经过长期实战打磨的完整框架,旨在解决 AI 代理在实际开发中面临的效率低下、记忆丢失、安全隐患及缺乏持续学习能力等核心痛点。 通过引入技能模块化、直觉增强、记忆持久化机制以及内置的安全扫描功能,everything-claude-code 能显著提升 AI 在复杂任务中的表现,帮助开发者构建更稳定、更智能的生产级 AI 代理。其独特的“研究优先”开发理念和针对 Token 消耗的优化策略,使得模型响应更快、成本更低,同时有效防御潜在的攻击向量。 这套工具特别适合软件开发者、AI 研究人员以及希望深度定制 AI 工作流的技术团队使用。无论您是在构建大型代码库,还是需要 AI 协助进行安全审计与自动化测试,everything-claude-code 都能提供强大的底层支持。作为一个曾荣获 Anthropic 黑客大奖的开源项目,它融合了多语言支持与丰富的实战钩子(hooks),让 AI 真正成长为懂上

ComfyUI

ComfyUI 是一款功能强大且高度模块化的视觉 AI 引擎,专为设计和执行复杂的 Stable Diffusion 图像生成流程而打造。它摒弃了传统的代码编写模式,采用直观的节点式流程图界面,让用户通过连接不同的功能模块即可构建个性化的生成管线。 这一设计巧妙解决了高级 AI 绘图工作流配置复杂、灵活性不足的痛点。用户无需具备编程背景,也能自由组合模型、调整参数并实时预览效果,轻松实现从基础文生图到多步骤高清修复等各类复杂任务。ComfyUI 拥有极佳的兼容性,不仅支持 Windows、macOS 和 Linux 全平台,还广泛适配 NVIDIA、AMD、Intel 及苹果 Silicon 等多种硬件架构,并率先支持 SDXL、Flux、SD3 等前沿模型。 无论是希望深入探索算法潜力的研究人员和开发者,还是追求极致创作自由度的设计师与资深 AI 绘画爱好者,ComfyUI 都能提供强大的支持。其独特的模块化架构允许社区不断扩展新功能,使其成为当前最灵活、生态最丰富的开源扩散模型工具之一,帮助用户将创意高效转化为现实。

LLMs-from-scratch

LLMs-from-scratch 是一个基于 PyTorch 的开源教育项目,旨在引导用户从零开始一步步构建一个类似 ChatGPT 的大型语言模型(LLM)。它不仅是同名技术著作的官方代码库,更提供了一套完整的实践方案,涵盖模型开发、预训练及微调的全过程。 该项目主要解决了大模型领域“黑盒化”的学习痛点。许多开发者虽能调用现成模型,却难以深入理解其内部架构与训练机制。通过亲手编写每一行核心代码,用户能够透彻掌握 Transformer 架构、注意力机制等关键原理,从而真正理解大模型是如何“思考”的。此外,项目还包含了加载大型预训练权重进行微调的代码,帮助用户将理论知识延伸至实际应用。 LLMs-from-scratch 特别适合希望深入底层原理的 AI 开发者、研究人员以及计算机专业的学生。对于不满足于仅使用 API,而是渴望探究模型构建细节的技术人员而言,这是极佳的学习资源。其独特的技术亮点在于“循序渐进”的教学设计:将复杂的系统工程拆解为清晰的步骤,配合详细的图表与示例,让构建一个虽小但功能完备的大模型变得触手可及。无论你是想夯实理论基础,还是为未来研发更大规模的模型做准备

Deep-Live-Cam

Deep-Live-Cam 是一款专注于实时换脸与视频生成的开源工具,用户仅需一张静态照片,即可通过“一键操作”实现摄像头画面的即时变脸或制作深度伪造视频。它有效解决了传统换脸技术流程繁琐、对硬件配置要求极高以及难以实时预览的痛点,让高质量的数字内容创作变得触手可及。 这款工具不仅适合开发者和技术研究人员探索算法边界,更因其极简的操作逻辑(仅需三步:选脸、选摄像头、启动),广泛适用于普通用户、内容创作者、设计师及直播主播。无论是为了动画角色定制、服装展示模特替换,还是制作趣味短视频和直播互动,Deep-Live-Cam 都能提供流畅的支持。 其核心技术亮点在于强大的实时处理能力,支持口型遮罩(Mouth Mask)以保留使用者原始的嘴部动作,确保表情自然精准;同时具备“人脸映射”功能,可同时对画面中的多个主体应用不同面孔。此外,项目内置了严格的内容安全过滤机制,自动拦截涉及裸露、暴力等不当素材,并倡导用户在获得授权及明确标注的前提下合规使用,体现了技术发展与伦理责任的平衡。