LEANN

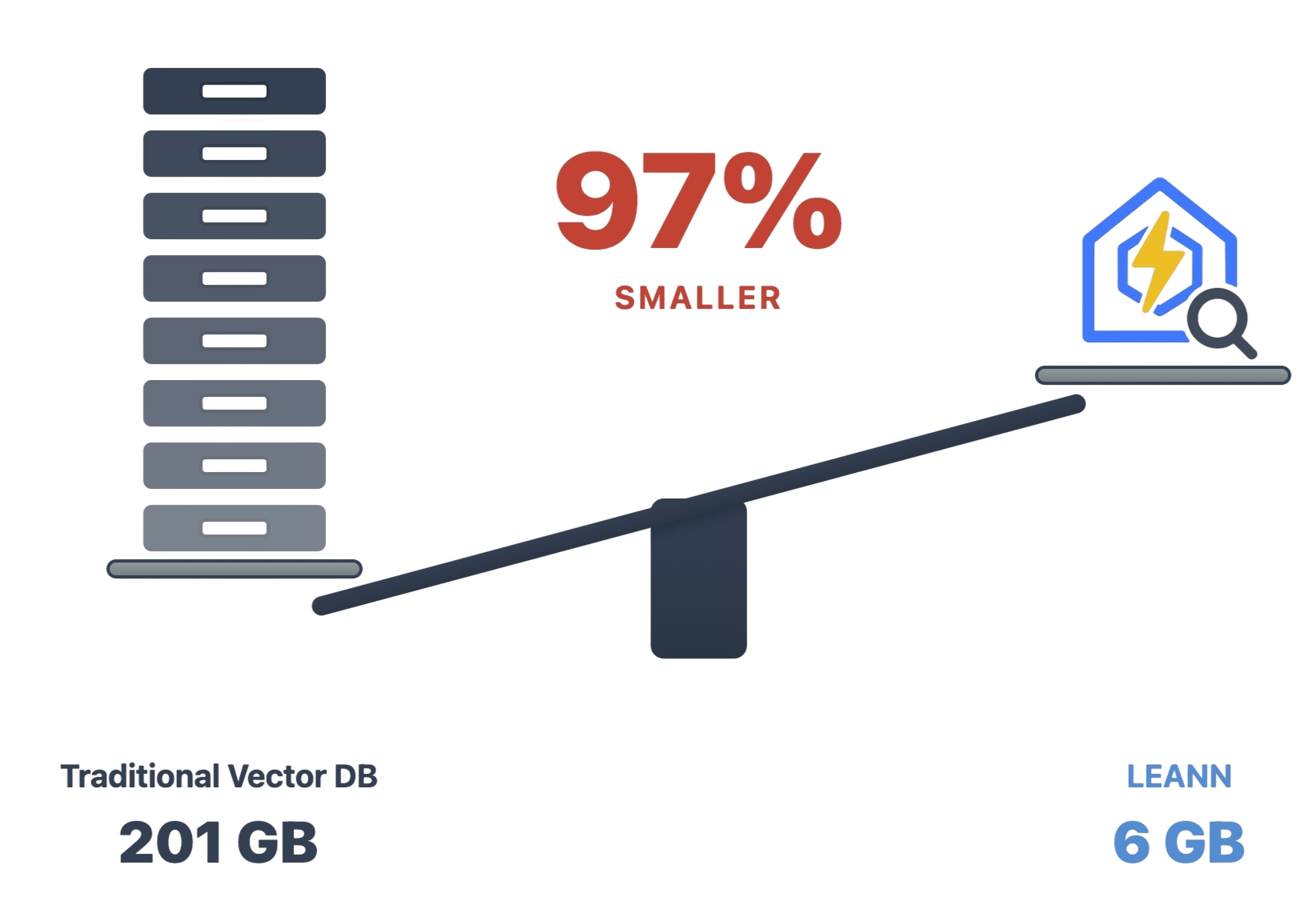

LEANN 是一款创新的向量数据库,旨在将你的个人电脑变身强大的私人 AI 助手。它核心解决了传统检索增强生成(RAG)系统存储成本高昂且依赖云服务的痛点,让你能在本地设备上对数百万份文档、邮件、聊天记录甚至代码库进行语义搜索,同时节省高达 97% 的存储空间且不损失准确性。

这款工具特别适合注重数据隐私的个人用户、希望在本地部署高效 RAG 应用的开发者,以及需要处理海量私有数据的研究人员。无论是整理微信聊天记忆、归档浏览器历史,还是构建个人知识库,LEANN 都能在不产生云端费用并确保数据完全私密的前提下轻松胜任。

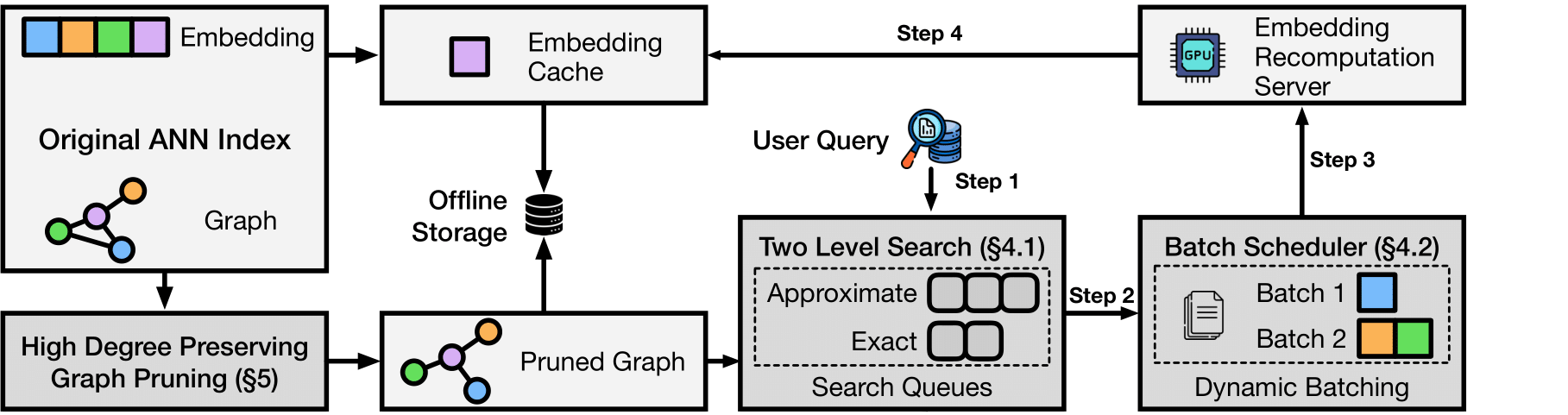

其独特的技术亮点在于采用了“基于图的选择性重计算”与“保持高度剪枝”算法。与传统方案预先存储所有向量不同,LEANN 按需计算嵌入向量,从而实现了极致的压缩效率。作为全球最小的向量索引之一,LEANN 让在笔记本电脑上运行快速、精准且 100% 私有的 AI 应用成为现实,真正推动了个人 AI 的普及。

使用场景

资深数据分析师李明需要在本地笔记本上构建一个涵盖数百万份历史研报、邮件往来及即时通讯记录的私有知识库,以支持高频次的语义检索与决策辅助。

没有 LEANN 时

- 存储成本高昂:传统向量数据库需全量存储嵌入向量,导致索引文件体积庞大,迅速占满笔记本有限的 SSD 空间。

- 隐私泄露风险:为节省资源被迫将数据上传至云端 RAG 服务,敏感的商业研报和内部沟通记录面临外泄隐患。

- 检索响应迟缓:受限于本地硬件性能,大规模数据下的相似度搜索延迟极高,严重打断分析思路。

- 数据孤岛严重:难以统一处理文件系统、邮件、微信及浏览器历史等多源异构数据,知识关联挖掘困难。

使用 LEANN 后

- 极致存储压缩:凭借基于图的选择性重计算技术,LEANN 在保持精度不变的前提下节省了 97% 的存储空间,轻松容纳百万级文档。

- 100% 本地隐私:所有索引构建与推理过程完全在个人设备运行,无需联网,彻底杜绝数据出域风险。

- 毫秒级极速响应:即使在普通笔记本上,也能对海量数据进行快速的语义搜索,实现流畅的交互式问答。

- 全域数据融合:原生支持集成文件、邮件、聊天记录及实时 MCP 数据源,将分散的个人数字足迹转化为统一的知识网络。

LEANN 让普通笔记本电脑瞬间变身为一台高效、安全且超大规模的私有 AI 知识引擎,真正实现了“万物皆可 RAG"。

运行环境要求

- Linux (Ubuntu

- Arch

- RHEL/CentOS)

- macOS (ARM64/Intel

- 需 13.3+)

- Windows

未说明 (默认支持 CPU,GPU 加速功能需通过社区投票决定)

未说明 (强调低内存占用,适合笔记本电脑运行)

快速开始

我们不收集任何遥测数据。本次调查是您告诉我们下一步希望我们开发GPU加速或更多集成功能的唯一方式。

👉 点击此处投票(只需2分钟)

💬 加入我们的Slack社区!

我们非常期待您的加入,成为LEANN社区的一员!

👉 加入LEANN Slack

如果邀请链接已过期或您遇到加入困难,请提交一个问题,我们会帮助您加入!

全球最小的向量索引。用LEANN实现RAG一切!

LEANN是一款创新的向量数据库,旨在让个人AI更加普及。它能将您的笔记本电脑转变为强大的RAG系统,能够在使用比传统方案少97%的存储空间且不损失准确性的情况下,对数百万份文档进行索引和检索。

LEANN通过基于图的选择性重计算与高阶保持剪枝技术来实现这一点,即按需计算嵌入向量,而不是预先存储所有向量。示意图 → | 论文 →

准备好RAG一切了吗? 将您的笔记本电脑变成一个个人AI助手,能够语义搜索您的文件系统(#-personal-data-manager-process-any-documents-pdf-txt-md)、电子邮件(#-your-personal-email-secretary-rag-on-apple-mail)、浏览器历史记录(#-time-machine-for-the-web-rag-your-entire-browser-history)、聊天记录(#-wechat-detective-unlock-your-golden-memories)(WeChat、iMessage)、代理记忆(#-chatgpt-chat-history-your-personal-ai-conversation-archive)(ChatGPT、Claude)、实时数据(#mcp-integration-rag-on-live-data-from-any-platform)(Slack、Twitter)、代码库(#-claude-code-integration-transform-your-development-workflow)*,或者外部知识库(例如6000万份文档)——所有这些都可以在您的笔记本电脑上完成,无需任何云成本,并且完全保护您的隐私。

* Claude Code仅支持基本的grep风格关键词搜索。而LEANN则是一个可直接使用的语义搜索MCP服务,与Claude Code完全兼容,让您无需改变工作流程即可实现智能检索。🔥 请查看简易设置 →

为什么选择LEANN?

数据说明一切: 只需6GB即可索引6000万个文本片段,而传统方法则需要201GB。从电子邮件到浏览器历史记录,一切都能装进您的笔记本电脑中。不同应用场景的详细基准测试见下方 ↓

🔒 隐私: 您的数据永远不会离开您的笔记本电脑。没有OpenAI,没有云端,也没有“服务条款”。

🪶 轻量级: 基于图的重计算机制消除了繁重的嵌入向量存储需求,同时通过智能图剪枝和CSR格式进一步降低了图存储的开销。始终占用更少的存储空间和内存!

📦 便携性: 您可以以极低的成本将整个知识库在不同设备之间转移(甚至与他人共享)——您的个人AI记忆将随身携带。

📈 可扩展性: 能够处理传统向量数据库容易崩溃的混乱个人数据,轻松管理您不断增长的个性化数据以及代理生成的记忆!

✨ 无精度损失: 在使用97%更少存储空间的同时,仍能保持与重型解决方案相同的搜索质量。

安装

📦 先决条件:安装uv

如果您尚未安装uv,请先按照以下步骤安装:

curl -LsSf https://astral.sh/uv/install.sh | sh

🚀 快速安装

克隆仓库以获取所有示例并尝试各种精彩应用,

git clone https://github.com/yichuan-w/LEANN.git leann

cd leann

然后从PyPI安装LEANN,即可立即运行:

uv venv

source .venv/bin/activate

uv pip install leann

# 仅限 CPU(Linux):使用 `cpu` 附加组件(例如 `leann[cpu]`)

🔧 从源代码构建(开发推荐)

git clone https://github.com/yichuan-w/LEANN.git leann

cd leann

git submodule update --init --recursive

macOS:

注意:DiskANN 需要 macOS 13.3 或更高版本。

brew install libomp boost protobuf zeromq pkgconf

uv sync --extra diskann

Linux(Ubuntu/Debian):

注意:在 Ubuntu 20.04 上,您可能需要编译更新的 Abseil 库,并锁定 Protobuf 版本(例如 v3.20.x),以便成功构建 DiskANN。有关逐步说明,请参阅 Issue #30。

您可以手动安装 Intel oneAPI MKL,而不是使用 libmkl-full-dev 来为 DiskANN 提供支持。此外,如果您只想构建 HNSW 索引,可以通过在以下命令中移除 --extra diskann 参数来使用 libopenblas-dev。

sudo apt-get update && sudo apt-get install -y \

libomp-dev libboost-all-dev protobuf-compiler libzmq3-dev \

pkg-config libabsl-dev libaio-dev libprotobuf-dev \

libmkl-full-dev

uv sync --extra diskann

Linux(Arch Linux):

sudo pacman -Syu && sudo pacman -S --needed base-devel cmake pkgconf git gcc \

boost boost-libs protobuf abseil-cpp libaio zeromq

# 用于 DiskANN 中的 MKL

sudo pacman -S --needed base-devel git

git clone https://aur.archlinux.org/paru-bin.git

cd paru-bin && makepkg -si

paru -S intel-oneapi-mkl intel-oneapi-compiler

source /opt/intel/oneapi/setvars.sh

uv sync --extra diskann

Linux(RHEL / CentOS Stream / Oracle / Rocky / AlmaLinux):

更多详细信息请参阅 Issue #50。

sudo dnf groupinstall -y "Development Tools"

sudo dnf install -y libomp-devel boost-devel protobuf-compiler protobuf-devel \

abseil-cpp-devel libaio-devel zeromq-devel pkgconf-pkg-config

# 用于 DiskANN 中的 MKL

sudo dnf install -y intel-oneapi-mkl intel-oneapi-mkl-devel \

intel-oneapi-openmp 或者 sudo dnf install -y intel-oneapi-compiler

source /opt/intel/oneapi/setvars.sh

uv sync --extra diskann

Windows:

需要安装带有 C++ 桌面开发 工作负载的 Visual Studio 2022 Build Tools,以及 vcpkg。

# 安装工具链(如果尚未安装)

choco install cmake swig pkgconfiglite nuget.commandline -y

# 通过 vcpkg 安装 C++ 依赖项

vcpkg install zeromq:x64-windows openblas:x64-windows lapack:x64-windows `

boost-program-options:x64-windows protobuf:x64-windows

# 设置环境变量(将 VCPKG_ROOT 调整为您的 vcpkg 路径)

$env:CMAKE_PREFIX_PATH = "$env:VCPKG_ROOT\installed\x64-windows"

$env:PKG_CONFIG_PATH = "$env:VCPKG_ROOT\installed\x64-windows\lib\pkgconfig"

$env:PKG_CONFIG_EXECUTABLE = "C:\ProgramData\chocolatey\bin\pkg-config.exe"

$env:OPENBLAS_LIB = "$env:VCPKG_ROOT\installed\x64-windows\lib\openblas.lib"

$env:PATH += ";$env:VCPKG_ROOT\installed\x64-windows\bin"

$env:PATH += ";$env:VCPKG_ROOT\installed\x64-windows\tools\protobuf"

uv sync --extra diskann

快速入门

我们的声明式 API 让 RAG 变得像编写配置文件一样简单。

请查看 demo.ipynb 或

from leann import LeannBuilder, LeannSearcher, LeannChat

from pathlib import Path

INDEX_PATH = str(Path("./").resolve() / "demo.leann")

# 构建索引

builder = LeannBuilder(backend_name="hnsw")

builder.add_text("LEANN 相比传统向量数据库节省了 97% 的存储空间。")

builder.add_text("咚咚咚,开斋饭叫他们——他们需要把香蕉鳄鱼杂交种还回来")

builder.build_index(INDEX_PATH)

# 搜索

searcher = LeannSearcher(INDEX_PATH)

results = searcher.search("奇幻的 AI 生成生物", top_k=1)

# 与您的数据对话

chat = LeannChat(INDEX_PATH, llm_config={"type": "hf", "model": "Qwen/Qwen3-0.6B"})

response = chat.ask("LEANN 能节省多少存储空间?", top_k=1)

对一切进行 RAG!

LEANN 支持对多种数据源进行 RAG,包括文档(.pdf、.txt、.md)、Apple Mail、Google 搜索历史、WeChat、ChatGPT 对话、Claude 对话、iMessage 对话,以及 通过 MCP(模型上下文协议)服务器从任何平台获取的实时数据——包括 Slack、Twitter 等。

生成模型设置

LLM 后端

LEANN 支持众多 LLM 提供商进行文本生成(HuggingFace、Ollama、Anthropic,以及任何兼容 OpenAI API 的服务)。

🔑 OpenAI API 设置(默认)

将您的 OpenAI API 密钥设置为环境变量:

export OPENAI_API_KEY="your-api-key-here"

使用 CLI 时,请务必使用 --llm openai 标志。您还可以使用 --llm-model <model-name> 标志指定模型名称。

🛠️ 支持的 LLM 和嵌入提供商(通过 OpenAI 兼容性)

得益于 OpenAI API 格式的广泛采用,LEANN 出厂即与大量 LLM 和嵌入提供商兼容。只需设置 OPENAI_BASE_URL 和 OPENAI_API_KEY 环境变量,即可连接到您首选的服务。

export OPENAI_API_KEY="xxx"

export OPENAI_BASE_URL="http://localhost:1234/v1" # 提供商的基本 URL

若要在 CLI 界面中使用兼容 OpenAI 的端点:

如果您用于文本生成,请确保使用 --llm openai 标志,并用 --llm-model <model-name> 标志指定模型名称。

如果您用于嵌入,则应设置 --embedding-mode openai 标志,并用 --embedding-model <MODEL> 标志指定模型名称。

以下是常见提供商的基本 URL 列表,供您参考。

🖥️ 本地推理引擎(建议用于完全隐私保护)

| 提供商 | 示例基本 URL |

|---|---|

| Ollama | http://localhost:11434/v1 |

| LM Studio | http://localhost:1234/v1 |

| vLLM | http://localhost:8000/v1 |

| llama.cpp | http://localhost:8080/v1 |

| SGLang | http://localhost:30000/v1 |

| LiteLLM | http://localhost:4000 |

☁️ 云服务提供商

🚨 隐私提示: 在选择云服务提供商之前,请仔细阅读其隐私和数据保留政策。根据他们的条款,您的数据可能会被用于其自身目的,包括但不限于人工审核和模型训练,若处理不当,可能导致严重后果。

| 服务提供商 | 基础 URL |

|---|---|

| OpenAI | https://api.openai.com/v1 |

| OpenRouter | https://openrouter.ai/api/v1 |

| Gemini | https://generativelanguage.googleapis.com/v1beta/openai/ |

| x.AI (Grok) | https://api.x.ai/v1 |

| Groq AI | https://api.groq.com/openai/v1 |

| DeepSeek | https://api.deepseek.com/v1 |

| SiliconFlow | https://api.siliconflow.cn/v1 |

| Zhipu (BigModel) | https://open.bigmodel.cn/api/paas/v4/ |

| Mistral AI | https://api.mistral.ai/v1 |

| Anthropic | https://api.anthropic.com/v1 |

| Jina AI(嵌入) | https://api.jina.ai/v1 |

💡 小贴士:使用不同的嵌入服务提供商

若要为嵌入使用不同的提供商(例如 Jina AI),同时为 LLM 使用另一家提供商,请使用

--embedding-api-base和--embedding-api-key:leann build my-index --docs ./docs \ --embedding-mode openai \ --embedding-model jina-embeddings-v3 \ --embedding-api-base https://api.jina.ai/v1 \ --embedding-api-key $JINA_API_KEY

如果您的提供商未在此列表中,也不用担心!请查阅其文档以找到与 OpenAI 兼容的端点——很可能它也是 OpenAI 兼容的!

🔧 Ollama 设置(推荐用于完全隐私保护)

macOS:

# 拉取一个轻量级模型(推荐用于消费级硬件)

ollama pull llama3.2:1b

Linux:

# 安装 Ollama

curl -fsSL https://ollama.ai/install.sh | sh

# 手动启动 Ollama 服务

ollama serve &

# 拉取一个轻量级模型(推荐用于消费级硬件)

ollama pull llama3.2:1b

⭐ 灵活配置

LEANN 提供了灵活的参数设置,涵盖嵌入模型、检索策略和数据处理等方面,以满足您的特定需求。

📚 需要配置最佳实践吗? 请查看我们的配置指南,其中包含详细的优化技巧、模型选择建议以及解决常见问题的方法,例如嵌入速度慢或检索质量不佳等。

📋 点击展开:常用参数(所有示例均适用)

所有 RAG 示例都共享这些常用参数。交互模式在所有示例中均可使用——只需不带 --query 参数运行,即可开始连续问答会话,您可以在其中提出多个问题。输入 'quit' 即可退出。

# 环境变量(GPU 设备选择)

LEANN_EMBEDDING_DEVICE # 用于嵌入模型的 GPU(例如 cuda:0, cuda:1, cpu)

LEANN_LLM_DEVICE # 用于 HFChat LLM 的 GPU(例如 cuda:1,或 "cuda" 表示多 GPU 自动分配)

# 核心参数(所有示例的通用预处理)

--index-dir DIR # 存储索引的目录(默认:当前目录)

--query "YOUR QUESTION" # 单次查询模式。省略则进入交互式聊天模式(输入 'quit' 可退出),此时您可以与索引进行交互式操作

--max-items N # 限制数据预处理的数量(默认:-1,即处理全部数据)

--force-rebuild # 强制重建索引,即使索引已存在

# 嵌入参数

--embedding-model MODEL # 例如 facebook/contriever, text-embedding-3-small, mlx-community/Qwen3-Embedding-0.6B-8bit 或 nomic-embed-text

--embedding-mode MODE # sentence-transformers, openai, mlx 或 ollama

# LLM 参数(文本生成模型)

--llm TYPE # LLM 后端:openai, ollama, hf 或 anthropic(默认:openai)

--llm-model MODEL # 模型名称(默认:gpt-4o),例如 gpt-4o-mini, llama3.2:1b, Qwen/Qwen2.5-1.5B-Instruct

--thinking-budget LEVEL # 思考预算,适用于推理模型:low/medium/high(支持 o3, o3-mini, GPT-Oss:20b 等推理模型)

# 检索参数

--top-k N # 返回的结果数量(默认:20)

--search-complexity N # 图遍历的搜索复杂度(默认:32)

# 分块参数

--chunk-size N # 文本分块的大小(默认因来源而异:大多数为 256,微信为 192)

--chunk-overlap N # 分块之间的重叠部分(默认因来源而异:25–128)

# 索引构建参数

--backend-name NAME # 使用的后端:hnsw 或 diskann(默认:hnsw)

--graph-degree N # 构建索引时的图度数(默认:32)

--build-complexity N # 索引构建的复杂度(默认:64)

--compact / --no-compact # 是否使用紧凑存储(默认:true)。若要进行“不重新计算”的构建,则必须设置为“no-compact”。

--recompute / --no-recompute # 是否启用嵌入重新计算(默认:启用)。不应在“重新计算”的构建中执行“不重新计算”的检索。

📄 个人数据管理器:处理任意文档(.pdf、.txt、.md)!

直接针对您的个人 PDF 文件、文档以及任何包含文件的目录提问吧!

以下示例询问关于我们论文摘要的问题(使用 data/ 中的默认数据,该目录包含多种数据源:两篇论文、《傲慢与偏见》以及一篇关于华为 LLM 的中文技术报告),这是此处最简单的示例:

source .venv/bin/activate # 别忘了激活虚拟环境

python -m apps.document_rag --query "LEANN 探索的主要技术有哪些?"

📋 点击展开:文档专用参数

参数

--data-dir DIR # 包含待处理文档的目录(默认:data)

--file-types .ext .ext # 按特定文件类型筛选(可选;若省略则处理所有 LlamaIndex 支持的类型)

示例命令

# 处理所有文档,并为学术论文使用更大的分块

python -m apps.document_rag --data-dir "~/Documents/Papers" --chunk-size 1024

# 仅筛选 Markdown 和 Python 文件,并使用较小的分块

python -m apps.document_rag --data-dir "./docs" --chunk-size 256 --file-types .md .py

# 为代码文件启用 AST 感知分块

python -m apps.document_rag --enable-code-chunking --data-dir "./my_project"

# 或者使用专门的代码 RAG 以更好地理解代码

python -m apps.code_rag --repo-dir "./my_codebase" --query "认证是如何工作的?"

🎨 ColQwen:基于视觉-语言模型的多模态 PDF 检索

使用 ColQwen2/ColPali 模型,结合文本和视觉理解能力,对 PDF 文件进行搜索。非常适合用于科研论文、技术文档以及包含复杂版面、图表或示意图的各类 PDF 文件。

🍎 Mac 用户:ColQwen 已针对 Apple Silicon 进行优化,并支持 MPS 加速,从而实现更快的推理速度!

# 从 PDF 文件构建索引

python -m apps.colqwen_rag build --pdfs ./my_papers/ --index research_papers

# 使用文本查询进行搜索

python -m apps.colqwen_rag search research_papers "注意力机制是如何工作的?"

# 交互式问答

python -m apps.colqwen_rag ask research_papers --interactive

📋 点击展开:ColQwen 的安装与使用

先决条件

# 安装依赖

uv pip install colpali_engine pdf2image pillow matplotlib qwen_vl_utils einops seaborn

brew install poppler # 仅限 macOS,用于 PDF 处理

构建索引

python -m apps.colqwen_rag build \

--pdfs ./pdf_directory/ \

--index my_index \

--model colqwen2 # 或 colpali

搜索

python -m apps.colqwen_rag search my_index "你的问题在这里" --top-k 5

模型

- ColQwen2 (

colqwen2):最新视觉-语言模型,性能更优 - ColPali (

colpali):经过验证的多模态检索器

有关详细用法,请参阅 ColQwen 指南。

📧 你的私人邮件秘书:基于 Apple Mail 的 RAG!

注意:以下示例目前仅支持 macOS。Windows 支持即将推出。

在运行下面的示例之前,你需要在系统偏好设置 → 隐私与安全性 → 全盘访问中,授予终端/VS Code 全盘访问权限。

python -m apps.email_rag --query "我最常通过 DoorDash 或 Uber Eats 订购的食物是什么?"

78 万个邮件片段 → 78MB 存储空间。 终于可以像在 Google 上搜索一样搜索你的电子邮件了。

📋 点击展开:邮件专用参数

参数

--mail-path PATH # 特定邮件目录的路径(省略时自动检测)

--include-html # 在处理中包含 HTML 内容(适用于新闻通讯)

示例命令

# 搜索来自特定账户的工作邮件

python -m apps.email_rag --mail-path "~/Library/Mail/V10/WORK_ACCOUNT"

# 查找所有收据和订单确认邮件(包含 HTML)

python -m apps.email_rag --query "收据 订单确认 发票" --include-html

📋 点击展开:你可以尝试的示例查询

索引构建完成后,你可以提出如下问题:

- “查找我老板关于截止日期的邮件”

- “John 对项目时间表说了什么?”

- “给我看看关于差旅费用的邮件”

🔍 网页时光机:将你的整个 Chrome 浏览器历史转化为 RAG!

python -m apps.browser_rag --query "告诉我我的浏览器历史中关于机器学习的内容吧?"

3.8 万条浏览器记录 → 6MB 存储空间。 你的浏览器历史将成为你个人的搜索引擎。

📋 点击展开:浏览器专用参数

参数

--chrome-profile PATH # Chrome 配置文件目录的路径(省略时自动检测)

示例命令

# 搜索浏览历史中的学术研究

python -m apps.browser_rag --query "arxiv 论文 机器学习 变压器架构"

# 跟踪工作配置文件中的竞争对手分析

python -m apps.browser_rag --chrome-profile "~/Library/Application Support/Google/Chrome/Work Profile" --max-items 5000

📋 点击展开:如何找到你的 Chrome 配置文件

默认的 Chrome 配置文件路径是为典型的 macOS 设置配置的。如果你需要找到自己的特定 Chrome 配置文件:

- 打开终端

- 输入:

ls ~/Library/Application\ Support/Google/Chrome/ - 查看类似“Default”、“Profile 1”、“Profile 2”等文件夹

- 将完整路径作为

--chrome-profile参数使用

常见的 Chrome 配置文件位置:

- macOS:

~/Library/Application Support/Google/Chrome/Default - Linux:

~/.config/google-chrome/Default

💬 点击展开:你可以尝试的示例查询

索引构建完成后,你可以提出如下问题:

- “我访问过哪些关于机器学习的网站?”

- “查找我关于编程的搜索历史”

- “我最近看了哪些 YouTube 视频?”

- “给我看看我访问过的旅行规划相关网站”

💬 微信侦探:解锁你的珍贵回忆!

python -m apps.wechat_rag --query "给我看看所有关于周末计划的群聊"

40 万条消息 → 64MB 存储空间 用任何语言搜索多年来的聊天记录。

🔧 点击展开:安装要求

首先,你需要安装 WeChat 导出工具,

brew install sunnyyoung/repo/wechattweak-cli

或者手动安装(如果 Homebrew 出现问题):

sudo packages/wechat-exporter/wechattweak-cli install

故障排除:

- 安装问题:请查看 WeChatTweak-CLI 的问题页面

- 导出错误:如果你遇到以下错误,请尝试重启微信:

导出微信数据失败。请确保微信正在运行,并且已安装 WeChatTweak。 未找到或无法导出微信数据。退出。

📋 点击展开:微信专用参数

参数

--export-dir DIR # 存储导出的微信数据的目录(默认:wechat_export_direct)

--force-export # 强制重新导出,即使已有数据

示例命令

# 搜索群聊中讨论的旅行计划

python -m apps.wechat_rag --query "旅行计划" --max-items 10000

# 重新导出并搜索最近的聊天记录(新消息后很有用)

python -m apps.wechat_rag --force-export --query "工作日程"

💬 点击展开:你可以尝试的示例查询

索引构建完成后,你可以提出如下问题:

- “我想买魔术师约翰逊的球衣,给我一些对应聊天记录?” (中文:给我看看关于购买魔术师约翰逊球衣的聊天记录)

🤖 ChatGPT 聊天记录:您的个人 AI 对话档案!

将您的 ChatGPT 对话转化为可搜索的知识库!在所有关于编码、研究、头脑风暴等方面的 ChatGPT 讨论中进行搜索。

python -m apps.chatgpt_rag --export-path chatgpt_export.html --query "如何在 Python 中创建列表?"

解锁您的 AI 对话历史。 再也不用担心丢失 ChatGPT 讨论中的宝贵见解了。

📋 点击展开:如何导出 ChatGPT 数据

分步导出流程:

- 登录 ChatGPT

- 点击右上角的个人资料图标

- 前往设置 → 数据控制

- 在“导出数据”下点击“导出”

- 确认导出请求

- 从邮件链接下载 ZIP 文件(有效期 24 小时)

- 解压或直接使用 LEANN 工具

支持的格式:

- ChatGPT 导出的

.html文件 - ChatGPT 的

.zip存档 - 包含多个导出文件的目录

📋 点击展开:ChatGPT 特定参数

参数

--export-path PATH # ChatGPT 导出文件(.html/.zip)或目录的路径(默认:./chatgpt_export)

--separate-messages # 分别处理每条消息,而非合并后的对话

--chunk-size N # 文本块大小(默认:512)

--chunk-overlap N # 块之间的重叠部分(默认:128)

示例命令

# 使用 HTML 导出的基本用法

python -m apps.chatgpt_rag --export-path conversations.html

# 处理来自 ChatGPT 的 ZIP 存档

python -m apps.chatgpt_rag --export-path chatgpt_export.zip

# 使用特定查询进行搜索

python -m apps.chatgpt_rag --export-path chatgpt_data.html --query "Python 编程帮助"

# 处理单个消息以实现精细化搜索

python -m apps.chatgpt_rag --separate-messages --export-path chatgpt_export.html

# 处理包含多个导出文件的目录

python -m apps.chatgpt_rag --export-path ./chatgpt_exports/ --max-items 1000

💡 点击展开:您可以尝试的示例查询

当您的 ChatGPT 对话被索引后,您可以使用以下查询进行搜索:

- “我曾向 ChatGPT 询问过哪些关于 Python 编程的问题?”

- “给我展示关于机器学习算法的对话”

- “查找关于 Web 开发框架的讨论”

- “ChatGPT 给了我哪些编程建议?”

- “搜索关于调试技巧的对话”

- “找到 ChatGPT 推荐的学习资源”

🤖 Claude 聊天记录:您的个人 AI 对话档案!

将您的 Claude 对话转化为可搜索的知识库!在所有关于编码、研究、头脑风暴等方面的 Claude 讨论中进行搜索。

python -m apps.claude_rag --export-path claude_export.json --query "我曾询问过关于 Python 字典的哪些问题?"

解锁您的 AI 对话历史。 再也不用担心丢失 Claude 讨论中的宝贵见解了。

📋 点击展开:如何导出 Claude 数据

分步导出流程:

- 在浏览器中打开 Claude

- 前往设置(寻找齿轮图标或设置菜单)

- 在账户设置中找到导出/下载选项

- 下载对话数据(通常为 JSON 格式)

- 将文件放置在项目目录中

注意:Claude 的导出方法可能因您使用的界面而异。请查阅 Claude 的帮助文档,以获取最新的导出说明。

支持的格式:

.json文件(推荐)- 包含 JSON 数据的

.zip存档 - 包含多个导出文件的目录

📋 点击展开:Claude 特定参数

参数

--export-path PATH # Claude 导出文件(.json/.zip)或目录的路径(默认:./claude_export)

--separate-messages # 分别处理每条消息,而非合并后的对话

--chunk-size N # 文本块大小(默认:512)

--chunk-overlap N # 块之间的重叠部分(默认:128)

示例命令

# 使用 JSON 导出的基本用法

python -m apps.claude_rag --export-path my_claude_conversations.json

# 处理来自 Claude 的 ZIP 存档

python -m apps.claude_rag --export-path claude_export.zip

# 使用特定查询进行搜索

python -m apps.claude_rag --export-path claude_data.json --query "机器学习建议"

# 处理单个消息以实现精细化搜索

python -m apps.claude_rag --separate-messages --export-path claude_export.json

# 处理包含多个导出文件的目录

python -m apps.claude_rag --export-path ./claude_exports/ --max-items 1000

💡 点击展开:您可以尝试的示例查询

当您的 Claude 对话被索引后,您可以使用以下查询进行搜索:

- “我曾向 Claude 询问过哪些关于 Python 编程的问题?”

- “给我展示关于机器学习算法的对话”

- “查找关于软件架构模式的讨论”

- “Claude 曾给我哪些调试建议?”

- “搜索关于数据结构的对话”

- “找到 Claude 推荐的学习资源”

💬 iMessage 历史:你的个人对话档案!

将你的 iMessage 对话转化为可搜索的知识库!在所有短信、群聊以及与朋友、家人和同事的对话中进行搜索。

python -m apps.imessage_rag --query "我们讨论了哪些周末计划?"

解锁你的消息历史。 再也不用担心错过重要的对话、分享的链接或 iMessage 历史中的难忘时刻。

📋 点击展开:如何访问 iMessage 数据

iMessage 数据位置:

iMessage 对话存储在你 Mac 上的 SQLite 数据库中,路径为:

~/Library/Messages/chat.db

重要设置要求:

授予终端或 IDE 完全磁盘访问权限:

- 打开 系统偏好设置 → 安全性与隐私 → 隐私

- 在左侧栏选择 完全磁盘访问权限

- 点击 + 按钮,添加你的终端应用(Terminal、iTerm2)或 IDE(VS Code 等)

- 授予访问权限后,请重启你的终端/IDE

替代方案:使用备份数据库

- 如果你有 Time Machine 备份或手动复制的数据库

- 使用

--db-path指定自定义路径

支持的格式:

- 直接访问

~/Library/Messages/chat.db(默认) - 使用

--db-path指定自定义数据库路径 - 也适用于数据库的备份副本

📋 点击展开:iMessage 特定参数

参数

--db-path PATH # chat.db 文件路径(默认:~/Library/Messages/chat.db)

--concatenate-conversations # 按对话分组消息(默认:True)

--no-concatenate-conversations # 将每条消息单独处理

--chunk-size N # 文本块大小(默认:1000)

--chunk-overlap N # 文本块之间的重叠量(默认:200)

示例命令

# 基本用法(需要完全磁盘访问权限)

python -m apps.imessage_rag

# 使用特定查询进行搜索

python -m apps.imessage_rag --query "家庭聚餐计划"

# 使用自定义数据库路径

python -m apps.imessage_rag --db-path /path/to/backup/chat.db

# 不按对话分组,而是单独处理每条消息

python -m apps.imessage_rag --no-concatenate-conversations

# 限制处理数量以进行测试

python -m apps.imessage_rag --max-items 100 --query "周末"

💡 点击展开:你可以尝试的示例查询

一旦你的 iMessage 对话被索引,你就可以使用以下查询进行搜索:

- “我们讨论过哪些度假计划?”

- “查找关于餐厅推荐的消息”

- “给我显示与 John 关于项目的对话”

- “搜索关于科技的分享链接”

- “查找关于周末活动的群聊讨论”

- “妈妈对家庭聚会说了什么?”

MCP 集成:跨平台实时数据的 RAG 检索

通过模型上下文协议(MCP)连接到实时数据源。LEANN 现在支持通过标准化的 MCP 服务器,在 Slack、Twitter 等平台上进行实时 RAG 检索。

主要优势:

- 实时数据访问:无需手动导出即可获取实时数据

- 标准化协议:可使用任何兼容 MCP 的服务器

- 易于扩展:只需少量代码即可添加新平台

- 安全访问:MCP 服务器负责身份验证

💬 Slack 消息:搜索团队对话

将你的 Slack 工作区转化为可搜索的知识库!在所有频道中查找讨论、决策和共享的知识。

# 测试 MCP 服务器连接

python -m apps.slack_rag --mcp-server "slack-mcp-server" --test-connection

# 索引并搜索 Slack 消息

python -m apps.slack_rag \

--mcp-server "slack-mcp-server" \

--workspace-name "my-team" \

--channels general dev-team random \

--query "我们关于产品发布做出了什么决定?"

📖 全面设置指南:有关详细的设置说明、常见问题排查(如“用户缓存尚未就绪”)以及高级配置选项,请参阅我们的 Slack 设置指南。

快速设置:

- 安装 Slack MCP 服务器(例如:

npm install -g slack-mcp-server) - 创建 Slack 应用并获取 API 凭证(详见上述指南)

- 设置环境变量:

export SLACK_BOT_TOKEN="xoxb-your-bot-token" export SLACK_APP_TOKEN="xapp-your-app-token" # 可选 - 使用

--test-connection标志测试连接

参数:

--mcp-server:启动 Slack MCP 服务器的命令--workspace-name:用于组织的 Slack 工作空间名称--channels:要索引的特定频道(可选)--concatenate-conversations:按频道分组消息(默认:是)--max-messages-per-channel:每个频道的最大消息数(默认:100)--max-retries:缓存同步问题的最大重试次数(默认:5)--retry-delay:每次重试之间的初始延迟时间,单位为秒(默认:2.0)

🐦 Twitter 书签:你的个人推文图书馆

搜索你的 Twitter 书签!找到你保存下来以备后用的那篇文章、话题串或精彩见解。

# 测试 MCP 服务器连接

python -m apps.twitter_rag --mcp-server "twitter-mcp-server" --test-connection

# 索引并搜索 Twitter 书签

python -m apps.twitter_rag \

--mcp-server "twitter-mcp-server" \

--max-bookmarks 1000 \

--query "我在机器学习方面收藏了哪些 AI 文章?"

设置要求:

- 安装一个 Twitter MCP 服务器(例如:

npm install -g twitter-mcp-server) - 获取 Twitter API 凭证:

- 在 developer.twitter.com 申请 Twitter 开发者账号

- 在 Twitter 开发者门户中创建一个新的应用

- 生成具有“读取”权限的 API 密钥和访问令牌

- 若要访问书签,可能需要使用具有相应作用域的 Twitter API v2

export TWITTER_API_KEY="your-api-key" export TWITTER_API_SECRET="your-api-secret" export TWITTER_ACCESS_TOKEN="your-access-token" export TWITTER_ACCESS_TOKEN_SECRET="your-access-token-secret" - 使用

--test-connection标志测试连接

参数:

--mcp-server: 用于启动 Twitter MCP 服务器的命令--username: 按用户名筛选书签(可选)--max-bookmarks: 最大获取书签数量(默认:1000)--no-tweet-content: 排除推文内容,仅保留元数据--no-metadata: 排除互动元数据

💡 点击展开:你可以尝试的示例查询

Slack 查询:

- “团队讨论了关于项目截止日期的哪些内容?”

- “查找有关新功能发布的消息”

- “向我展示关于预算规划的对话”

- “开发团队频道中做出了哪些决定?”

Twitter 查询:

- “上个月我收藏了哪些 AI 文章?”

- “查找有关机器学习技术的推文”

- “向我展示有关创业建议的已收藏话题串”

- “我保存了哪些 Python 教程?”

想将 MCP 数据与常规 LEANN CLI 结合使用吗? 你可以将 MCP 应用与 CLI 命令结合:

# 第一步:使用 MCP 应用获取并索引数据

python -m apps.slack_rag --mcp-server "slack-mcp-server" --workspace-name "my-team"

# 第二步:数据现已索引,可通过 CLI 使用

leann search slack_messages "project deadline"

leann ask slack_messages "What decisions were made about the product launch?"

# 对于 Twitter 书签也是一样

python -m apps.twitter_rag --mcp-server "twitter-mcp-server"

leann search twitter_bookmarks "machine learning articles"

MCP 与手动导出的区别:

- MCP:实时数据,自动更新,需要设置服务器

- 手动导出:一次性设置,可离线使用,需手动导出数据

🔧 添加新的 MCP 平台

希望添加对其他平台的支持吗?LEANN 的 MCP 集成设计为易于扩展:

- 找到或创建适用于你平台的 MCP 服务器

- 按照

apps/slack_data/slack_mcp_reader.py中的模式创建读取类 - 按照

apps/slack_rag.py中的模式创建 RAG 应用程序 - 测试后贡献回社区!

可探索的热门 MCP 服务器:

- GitHub 仓库和问题

- Discord 消息

- Notion 页面

- Google Drive 文档

- 以及 MCP 生态系统中的更多选项!

🚀 Claude Code 集成:变革你的开发工作流!

AST‑感知代码分块

LEANN 具有智能代码分块功能,能够保留语义边界(函数、类、方法),适用于 Python、Java、C# 和 TypeScript,相比基于文本的分块方式,能更好地理解代码。

📖 阅读 AST 分块指南 →

代码辅助的未来已经到来。 通过 LEANN 与 Claude Code 的原生 MCP 集成,索引你的整个代码库,并在 IDE 中直接获得智能代码辅助。

主要特性:

- 🔍 语义代码搜索 覆盖整个项目,完全本地化且轻量级

- 🧠 AST 感知分块 保留代码结构(函数、类)

- 📚 上下文感知辅助 用于调试和开发

- 🚀 零配置设置 自动检测语言

# 全局安装 LEANN 以实现 MCP 集成

uv tool install leann-core --with leann

claude mcp add --scope user leann-server -- leann_mcp

# 设置自动完成——只需开始使用 Claude Code!

体验我们的全代理式流程,包括自动查询重写、语义搜索规划等:

🔥 准备好提升你的编码能力了吗? 完整设置指南 →

命令行界面

LEANN 包含一个强大的命令行界面,用于文档处理和搜索。非常适合快速索引文档和进行交互式聊天。

安装

如果你遵循了快速入门指南,leann 已经安装在你的虚拟环境中:

source .venv/bin/activate

leann --help

若要使其全局可用:

# 使用 uv 工具全局安装 LEANN CLI

uv tool install leann-core --with leann

# 现在你可以在任何地方使用 leann,无需激活虚拟环境

leann --help

注意:全球安装是集成 Claude Code 所必需的。

leann_mcp服务器依赖于全局可用的leann命令。

使用示例

# 从特定目录构建索引,my_docs 是索引名称(这里也可以从多个目录或文件构建)

leann build my-docs --docs ./your_documents

# 搜索你的文档

leann search my-docs "machine learning concepts"

# 与你的文档进行交互式聊天

leann ask my-docs --interactive

# 提问单个问题(非交互式)

leann ask my-docs "提示在哪里配置?"

# 检测自上次构建/监视检查点以来的文件变化

leann watch my-docs

# 列出所有索引

leann list

# 删除一个索引

leann remove my-docs

关键 CLI 功能:

- 自动检测文档格式(PDF、TXT、MD、DOCX、PPTX 以及代码文件)

- 针对 Python、Java、C#、TypeScript 文件的 🧠 AST 感知分块

- 对其他内容进行带重叠的智能文本分块

- 通过 Merkle 树快照实现 📂 文件变更检测(

leann watch) - 支持多个 LLM 提供商(Ollama、OpenAI、HuggingFace)

- 索引以有序方式存储在

.leann/indexes/目录中(项目本地) - 支持高级搜索参数

📋 点击展开:完整 CLI 参考

您可以使用 leann --help,或 leann build --help、leann search --help、leann watch --help、leann ask --help、leann list --help、leann remove --help 来获取完整的 CLI 参考。

构建命令:

leann build INDEX_NAME --docs DIRECTORY|FILE [DIRECTORY|FILE ...] [OPTIONS]

选项:

--backend {hnsw,diskann} 使用的后端(默认:hnsw)

--embedding-model MODEL 嵌入模型(默认:facebook/contriever)

--graph-degree N 图的度数(默认:32)

--complexity N 构建复杂度(默认:64)

--force 强制重建现有索引

--compact / --no-compact 使用紧凑存储(默认:true)。若选择不重新计算,则必须设置为 --no-compact。

--recompute / --no-recompute 启用重新计算(默认:true)

搜索命令:

leann search INDEX_NAME QUERY [OPTIONS]

选项:

--top-k N 结果数量(默认:5)

--complexity N 搜索复杂度(默认:64)

--recompute / --no-recompute 是否启用嵌入重新计算(默认:启用)。在重新计算模式下构建的索引不应使用不重新计算的搜索。

--pruning-strategy {global,local,proportional}

监听命令:

leann watch INDEX_NAME

# 将当前文件系统状态与上次检查点(Merkle 树快照)进行比较,

# 并报告哪些文件被添加、删除或修改,以及它们对应的分块 ID。

#

# - 检测到更改后会自动保存新的检查点

# - 每次运行都会与最近的检查点进行对比

# - 文件变更检测采用 SHA-256 内容哈希算法,并通过 Merkle 树实现

#

# 示例输出:

# === 自上次检查点以来的变更 ===

# 已修改 (1):

# - /path/to/file.py

# 分块:42、43、44

提问命令:

leann ask INDEX_NAME [OPTIONS]

选项:

--llm {ollama,openai,hf,anthropic} LLM 提供商(默认:ollama)

--model MODEL 模型名称(默认:qwen3:8b)

--interactive 交互式聊天模式

--top-k N 检索数量(默认:20)

列出命令:

leann list

# 列出所有项目中的所有索引,并附带状态标识:

# ✅ - 索引已完成且可使用

# ❌ - 索引不完整或已损坏

# 📁 - 由 CLI 创建的索引(位于 .leann/indexes/ 目录中)

# 📄 - 由应用创建的索引(*.leann.meta.json 文件)

移除命令:

leann remove INDEX_NAME [OPTIONS]

选项:

--force, -f 强制移除,无需确认

# 智能移除:自动查找并安全移除索引

# - 显示跨项目的所有匹配索引

# - 跨项目移除需要确认

# - 当找到多个匹配项时支持交互式选择

# - 同时支持 CLI 和应用创建的索引

🚀 高级功能

🎯 元数据过滤

LEANN 支持简单的元数据过滤系统,可用于实现复杂的使用场景,例如按日期/类型筛选文档、按文件扩展名搜索代码,以及基于自定义条件的内容管理。

# 在索引过程中添加元数据

builder.add_text(

"def authenticate_user(token): ...",

metadata={"file_extension": ".py", "lines_of_code": 25}

)

# 带过滤条件的搜索

results = searcher.search(

query="authentication function",

metadata_filters={

"file_extension": {"==": ".py"},

"lines_of_code": {"<": 100}

}

)

支持的操作符:==、!=、<、<=、>、>=、in、not_in、contains、starts_with、ends_with、is_true、is_false

🔍 Grep 搜索

若需进行精确文本匹配而非语义搜索,可使用 use_grep 参数:

# 精确文本搜索

results = searcher.search("banana‑crocodile", use_grep=True, top_k=1)

适用场景:查找特定的代码模式、错误信息、函数名或确切短语,当不需要语义相似性时。

🏗️ 架构与工作原理

其奥秘在于:大多数向量数据库会存储每一个嵌入向量(成本高昂)。而 LEANN 则存储经过修剪的图结构(成本低廉),并在需要时才重新计算嵌入向量(速度快)。

核心技术:

- 基于图的按需重新计算:仅计算搜索路径上的节点嵌入

- 高阶保留式修剪:保留重要的“枢纽”节点,同时移除冗余连接

- 动态批处理:高效地将嵌入计算分批处理,以充分利用 GPU 资源

- 两级搜索:智能图遍历,优先探索最有希望的节点

后端:

- HNSW(默认):适用于大多数数据集,在完全重新计算的情况下可实现最大的存储节省

- DiskANN:高级选项,具有更出色的搜索性能,采用基于 PQ 的图遍历结合实时重排序,可在速度和准确率之间取得最佳平衡

基准测试

DiskANN 与 HNSW 性能对比 → - 比较两种后端的搜索性能

简单示例:LEANN 与 FAISS 对比 → - 观察存储节省的实际效果

📊 存储对比

| 系统 | DPR (2.1M) | Wiki (60M) | Chat (400K) | Email (780K) | Browser (38K) |

|---|---|---|---|---|---|

| 传统向量数据库(如 FAISS) | 3.8 GB | 201 GB | 1.8 GB | 2.4 GB | 130 MB |

| LEANN | 324 MB | 6 GB | 64 MB | 79 MB | 6.4 MB |

| 节省 | 91% | 97% | 97% | 97% | 95% |

复现我们的结果

uv run benchmarks/run_evaluation.py # 自动下载评估数据并运行基准测试

uv run benchmarks/run_evaluation.py benchmarks/data/indices/rpj_wiki/rpj_wiki --num-queries 2000 # 下载数据后,您可以用我们最大的索引运行基准测试

评估脚本会在首次运行时自动下载数据。最后三次的结果是使用部分个人数据测试的,您也可以用自己的数据来复现这些结果!

🔬 论文

如果您觉得 Leann 有用,请引用:

@misc{wang2025leannlowstoragevectorindex,

title={LEANN: A Low-Storage Vector Index},

author={Yichuan Wang and Shu Liu and Zhifei Li and Yongji Wu and Ziming Mao and Yilong Zhao and Xiao Yan and Zhiying Xu and Yang Zhou and Ion Stoica and Sewon Min and Matei Zaharia and Joseph E. Gonzalez},

year={2025},

eprint={2506.08276},

archivePrefix={arXiv},

primaryClass={cs.DB},

url={https://arxiv.org/abs/2506.08276},

}

✨ 详细功能 →

🤝 贡献指南 →

❓ 常见问题 →

📈 路线图 →

📄 许可证

MIT 许可证 - 详情请参阅 LICENSE。

🙏 致谢

核心贡献者:Yichuan Wang 和 Zhifei Li。

活跃贡献者:Gabriel Dehan、Aakash Suresh。

我们欢迎更多贡献者!欢迎随时提出问题或提交拉取请求。

本工作由 伯克利天空计算实验室 完成。

星标历史

⭐ 如果 Leann 对您的研究或应用有帮助,请在 GitHub 上给它点个 Star 吧!

由 Leann 团队用心制作 ❤️

🤖 使用 AI 探索 LEANN

LEANN 已被收录至 DeepWiki,您可以通过 Deep Research 向大型语言模型提问,以探索代码库并获得帮助来添加新功能。

版本历史

v0.3.72026/03/08v0.3.62026/01/11v0.3.52025/11/12v0.3.42025/09/18v0.3.32025/09/02v0.3.22025/08/19v0.3.12025/08/19v0.3.02025/08/16v0.2.92025/08/12v0.2.82025/08/12v0.2.72025/08/11v0.2.62025/08/10v0.2.52025/08/08v0.2.42025/08/08v0.2.22025/08/08v0.2.12025/08/05v0.2.02025/08/04v0.1.162025/07/29v0.1.152025/07/28v0.1.142025/07/27常见问题

相似工具推荐

openclaw

OpenClaw 是一款专为个人打造的本地化 AI 助手,旨在让你在自己的设备上拥有完全可控的智能伙伴。它打破了传统 AI 助手局限于特定网页或应用的束缚,能够直接接入你日常使用的各类通讯渠道,包括微信、WhatsApp、Telegram、Discord、iMessage 等数十种平台。无论你在哪个聊天软件中发送消息,OpenClaw 都能即时响应,甚至支持在 macOS、iOS 和 Android 设备上进行语音交互,并提供实时的画布渲染功能供你操控。 这款工具主要解决了用户对数据隐私、响应速度以及“始终在线”体验的需求。通过将 AI 部署在本地,用户无需依赖云端服务即可享受快速、私密的智能辅助,真正实现了“你的数据,你做主”。其独特的技术亮点在于强大的网关架构,将控制平面与核心助手分离,确保跨平台通信的流畅性与扩展性。 OpenClaw 非常适合希望构建个性化工作流的技术爱好者、开发者,以及注重隐私保护且不愿被单一生态绑定的普通用户。只要具备基础的终端操作能力(支持 macOS、Linux 及 Windows WSL2),即可通过简单的命令行引导完成部署。如果你渴望拥有一个懂你

stable-diffusion-webui

stable-diffusion-webui 是一个基于 Gradio 构建的网页版操作界面,旨在让用户能够轻松地在本地运行和使用强大的 Stable Diffusion 图像生成模型。它解决了原始模型依赖命令行、操作门槛高且功能分散的痛点,将复杂的 AI 绘图流程整合进一个直观易用的图形化平台。 无论是希望快速上手的普通创作者、需要精细控制画面细节的设计师,还是想要深入探索模型潜力的开发者与研究人员,都能从中获益。其核心亮点在于极高的功能丰富度:不仅支持文生图、图生图、局部重绘(Inpainting)和外绘(Outpainting)等基础模式,还独创了注意力机制调整、提示词矩阵、负向提示词以及“高清修复”等高级功能。此外,它内置了 GFPGAN 和 CodeFormer 等人脸修复工具,支持多种神经网络放大算法,并允许用户通过插件系统无限扩展能力。即使是显存有限的设备,stable-diffusion-webui 也提供了相应的优化选项,让高质量的 AI 艺术创作变得触手可及。

everything-claude-code

everything-claude-code 是一套专为 AI 编程助手(如 Claude Code、Codex、Cursor 等)打造的高性能优化系统。它不仅仅是一组配置文件,而是一个经过长期实战打磨的完整框架,旨在解决 AI 代理在实际开发中面临的效率低下、记忆丢失、安全隐患及缺乏持续学习能力等核心痛点。 通过引入技能模块化、直觉增强、记忆持久化机制以及内置的安全扫描功能,everything-claude-code 能显著提升 AI 在复杂任务中的表现,帮助开发者构建更稳定、更智能的生产级 AI 代理。其独特的“研究优先”开发理念和针对 Token 消耗的优化策略,使得模型响应更快、成本更低,同时有效防御潜在的攻击向量。 这套工具特别适合软件开发者、AI 研究人员以及希望深度定制 AI 工作流的技术团队使用。无论您是在构建大型代码库,还是需要 AI 协助进行安全审计与自动化测试,everything-claude-code 都能提供强大的底层支持。作为一个曾荣获 Anthropic 黑客大奖的开源项目,它融合了多语言支持与丰富的实战钩子(hooks),让 AI 真正成长为懂上

ComfyUI

ComfyUI 是一款功能强大且高度模块化的视觉 AI 引擎,专为设计和执行复杂的 Stable Diffusion 图像生成流程而打造。它摒弃了传统的代码编写模式,采用直观的节点式流程图界面,让用户通过连接不同的功能模块即可构建个性化的生成管线。 这一设计巧妙解决了高级 AI 绘图工作流配置复杂、灵活性不足的痛点。用户无需具备编程背景,也能自由组合模型、调整参数并实时预览效果,轻松实现从基础文生图到多步骤高清修复等各类复杂任务。ComfyUI 拥有极佳的兼容性,不仅支持 Windows、macOS 和 Linux 全平台,还广泛适配 NVIDIA、AMD、Intel 及苹果 Silicon 等多种硬件架构,并率先支持 SDXL、Flux、SD3 等前沿模型。 无论是希望深入探索算法潜力的研究人员和开发者,还是追求极致创作自由度的设计师与资深 AI 绘画爱好者,ComfyUI 都能提供强大的支持。其独特的模块化架构允许社区不断扩展新功能,使其成为当前最灵活、生态最丰富的开源扩散模型工具之一,帮助用户将创意高效转化为现实。

markitdown

MarkItDown 是一款由微软 AutoGen 团队打造的轻量级 Python 工具,专为将各类文件高效转换为 Markdown 格式而设计。它支持 PDF、Word、Excel、PPT、图片(含 OCR)、音频(含语音转录)、HTML 乃至 YouTube 链接等多种格式的解析,能够精准提取文档中的标题、列表、表格和链接等关键结构信息。 在人工智能应用日益普及的今天,大语言模型(LLM)虽擅长处理文本,却难以直接读取复杂的二进制办公文档。MarkItDown 恰好解决了这一痛点,它将非结构化或半结构化的文件转化为模型“原生理解”且 Token 效率极高的 Markdown 格式,成为连接本地文件与 AI 分析 pipeline 的理想桥梁。此外,它还提供了 MCP(模型上下文协议)服务器,可无缝集成到 Claude Desktop 等 LLM 应用中。 这款工具特别适合开发者、数据科学家及 AI 研究人员使用,尤其是那些需要构建文档检索增强生成(RAG)系统、进行批量文本分析或希望让 AI 助手直接“阅读”本地文件的用户。虽然生成的内容也具备一定可读性,但其核心优势在于为机器

LLMs-from-scratch

LLMs-from-scratch 是一个基于 PyTorch 的开源教育项目,旨在引导用户从零开始一步步构建一个类似 ChatGPT 的大型语言模型(LLM)。它不仅是同名技术著作的官方代码库,更提供了一套完整的实践方案,涵盖模型开发、预训练及微调的全过程。 该项目主要解决了大模型领域“黑盒化”的学习痛点。许多开发者虽能调用现成模型,却难以深入理解其内部架构与训练机制。通过亲手编写每一行核心代码,用户能够透彻掌握 Transformer 架构、注意力机制等关键原理,从而真正理解大模型是如何“思考”的。此外,项目还包含了加载大型预训练权重进行微调的代码,帮助用户将理论知识延伸至实际应用。 LLMs-from-scratch 特别适合希望深入底层原理的 AI 开发者、研究人员以及计算机专业的学生。对于不满足于仅使用 API,而是渴望探究模型构建细节的技术人员而言,这是极佳的学习资源。其独特的技术亮点在于“循序渐进”的教学设计:将复杂的系统工程拆解为清晰的步骤,配合详细的图表与示例,让构建一个虽小但功能完备的大模型变得触手可及。无论你是想夯实理论基础,还是为未来研发更大规模的模型做准备

%20%7C%20Windows-lightgrey)