allosaurus

Allosaurus 是一款预训练的通用音素识别工具,能够自动从音频文件中提取出超过 2000 种语言的音素序列。它主要解决了传统语音识别系统依赖特定语言数据、难以覆盖全球小众语言的痛点,让开发者无需重新训练模型即可处理多语种音频分析任务。

这款工具特别适合语音技术研究人员、自然语言处理开发者以及需要构建多语言语音应用的企业团队使用。无论是进行语言学研究、构建语音助手,还是开发跨语言翻译系统,Allosaurus 都能提供基础的音素标注支持。普通用户若对语音分析感兴趣,也可通过简单命令快速体验。

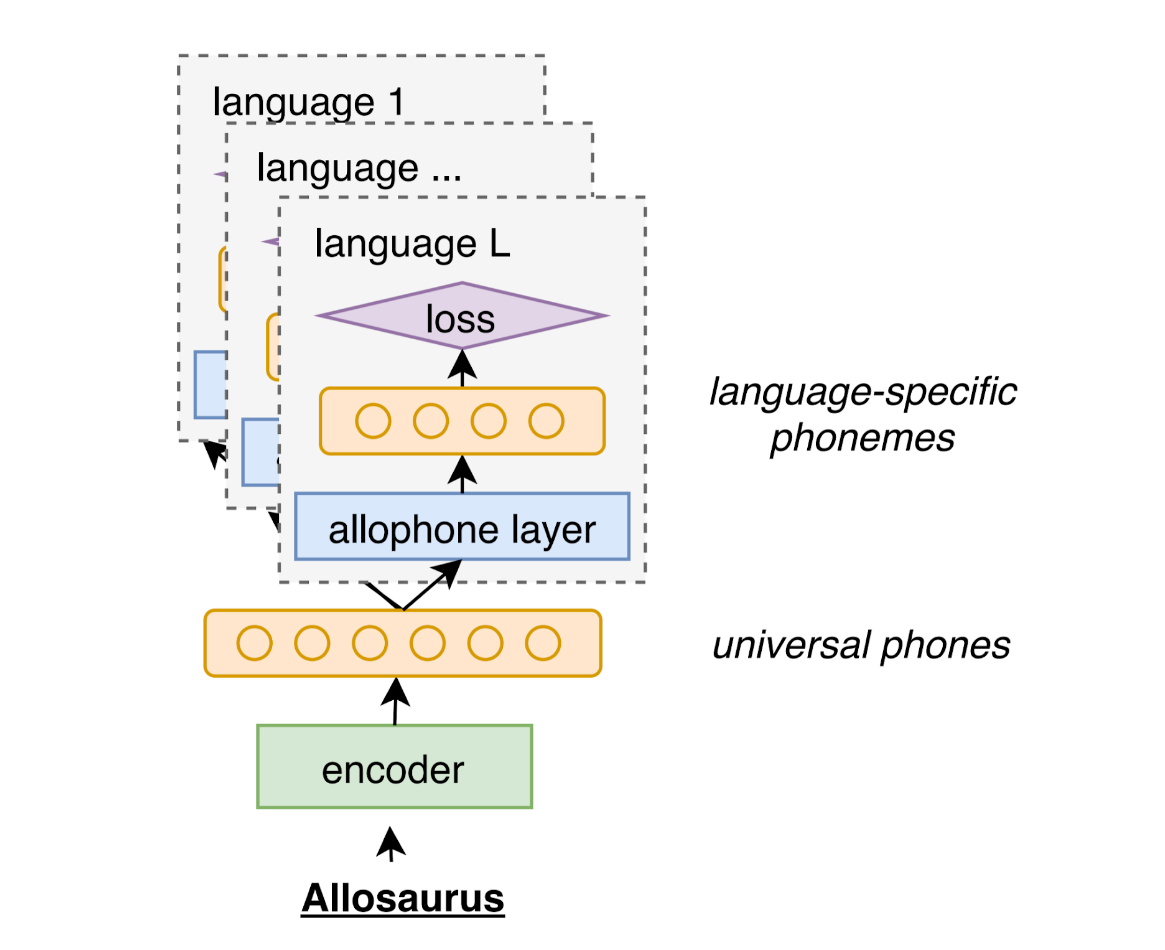

其核心技术亮点在于基于“多语言异音系统”架构,仅需一个统一模型即可适配全球约 230 种国际音标(IPA)音素。用户既可以通过命令行快速处理 WAV 格式音频,也能在 Python 代码中直接调用接口。工具支持自动重采样和单声道处理,并允许指定特定语言音素集以提升识别准确率。作为开源项目,Allosaurus 降低了多语言语音处理的门槛,为全球化语音技术应用提供了灵活高效的基础设施。

使用场景

一家跨国语言研究机构正在构建涵盖 2000 多种小语种的语音分析管道,急需从海量未标注的田野调查录音中提取基础发音单元。

没有 allosaurus 时

- 模型训练成本极高:面对稀缺的小语种数据,团队必须为每种语言单独收集标注数据并训练专用识别器,耗时数月且难以覆盖长尾语言。

- 音素标准不统一:不同语言团队使用各自的音素集合,导致跨语言对比分析时数据格式混乱,无法进行统一的类型学研究。

- 冷启动困难:对于完全未知的方言或濒危语言,由于缺乏先验知识,传统工具无法直接进行有效的语音特征提取。

使用 allosaurus 后

- 零样本即时识别:利用 allosaurus 预训练的通用音素识别能力,研究人员无需任何额外训练,直接输入 WAV 文件即可获取 2000 多种语言的音素序列。

- 标准化输出流:通过指定

lang参数(如eng或ipa),allosaurus 能将所有语言映射到统一的国际音标(IPA)体系,天然消除了数据对齐障碍。 - 灵活适配场景:无论是单文件快速测试还是批量处理整个录音目录,allosaurus 都能自动重采样并输出结构化结果,大幅缩短了从原始录音到语言学分析的周期。

allosaurus 通过“一次预训练,通用全语言”的能力,将多语言语音分析的门槛从“数月建模”降低到了“秒级推理”。

运行环境要求

- 未说明 (基于 Python pip 安装,通常支持 Linux

- macOS

- Windows)

- 非必需

- 默认使用 CPU (device_id=-1)

- 支持单张 NVIDIA GPU 加速,需指定 device_id

- 未提及具体型号、显存大小或 CUDA 版本要求

未说明

快速开始

异特龙

异特龙是一款预训练的通用音素识别器。它可以用于识别超过2000种语言中的音素。

该工具基于我们在 ICASSP 2020 上发表的工作 使用多语言同位异音系统进行通用音素识别。

快速入门

安装

异特龙可以通过 pip 安装:

pip install allosaurus

你也可以克隆本仓库并安装:

python setup.py install

快速开始

基本用法非常简单:输入是一个 WAV 音频文件,输出是一串音素序列。

python -m allosaurus.run -i <audio>

例如,你可以尝试使用本仓库中附带的示例文件。猜猜这段音频里是什么内容吧 :)

python -m allosaurus.run -i sample.wav

æ l u s ɔ ɹ s

你也可以直接在 Python 中使用异特龙:

from allosaurus.app import read_recognizer

# 加载你的模型

model = read_recognizer()

# 运行推理 -> æ l u s ɔ ɹ s

model.recognize('sample.wav')

有关完整功能和详细信息,请参阅以下章节。

推理

命令行界面如下:

python -m allosaurus.run [--lang <language name>] [--model <model name>] [--device_id <gpu_id>] [--output <output_file>] [--topk <int>] -i <audio file/directory>

它会识别音频文件中的窄音素。

只有输入参数是必需的,其他选项可以忽略。请参阅后续章节了解它们的详细信息。

此外,还有一个简单的 Python 接口如下:

from allosaurus.app import read_recognizer

# 根据 <model name> 加载模型,若留空则使用 'latest'

model = read_recognizer(model)

# 对 <audio_file> 进行推理,指定 <lang>,若留空则默认为 'ipa'

model.recognize(audio_file, lang)

两种接口中参数的详细说明如下:

输入

输入可以是一个单独的文件,也可以是一个包含多个音频文件的目录。

如果输入是一个文件,它只会输出音素序列;如果输入是一个目录,它会同时输出文件名和音素序列,并按文件名排序。

音频文件应符合以下格式:

- 必须是 WAV 文件。如果音频不是 WAV 格式,请提前使用 sox 或 ffmpeg 将其转换为 WAV 格式。

- 采样率可以任意,我们会根据模型的要求自动重新采样。

- 我们假设音频是单声道音频。

输出

默认情况下,输出是标准输出(即所有结果都会打印到终端)。

如果你指定了一个文件作为输出,则所有输出都会被重定向到该文件。

语言

lang 选项是语言标识符,用于指定你想要使用的音素库。

默认选项是 ipa,表示识别器将使用完整的音素库(约 230 个音素)。

通常,指定语言音素库可以提高识别准确率。

你可以通过以下命令查看完整的语言列表。可用的语言数量约为 2000 种。

python -m allosaurus.bin.list_lang

要查看特定语言的音素库,可以使用以下命令:

python -m allosaurus.bin.list_phone [--lang <language name>]

例如:

# 获取英语音素库

# ['a', 'aː', 'b', 'd', 'd̠', 'e', 'eː', 'e̞', 'f', 'h', 'i', 'iː', 'j', 'k', 'kʰ', 'l', 'm', 'n', 'o', 'oː', 'p', 'pʰ', 'r', 's', 't', 'tʰ', 't̠', 'u', 'uː', 'v', 'w', 'x', 'z', 'æ', 'ð', 'øː', 'ŋ', 'ɐ', 'ɐː', 'ɑ', 'ɑː', 'ɒ', 'ɒː', 'ɔ', 'ɔː', 'ɘ', 'ə', 'əː', 'ɛ', 'ɛː', 'ɜː', 'ɡ', 'ɪ', 'ɪ̯', 'ɯ', 'ɵː', 'ɹ', 'ɻ', 'ʃ', 'ʉ', 'ʉː', 'ʊ', 'ʌ', 'ʍ', 'ʒ', 'ʔ', 'θ']

python -m allosaurus.bin.list_phone --lang eng

# 你也可以不指定 lang 选项来获取全部音素库

#['I', 'a', 'aː', 'ã', 'ă', 'b', 'bʲ', 'bʲj', 'bʷ', 'bʼ', 'bː', 'b̞', 'b̤', 'b̥', 'c', 'd', 'dʒ', 'dʲ', 'dː', 'd̚', 'd̥', 'd̪', 'd̯', 'd͡z', 'd͡ʑ', 'd͡ʒ', 'd͡ʒː', 'd͡ʒ̤', 'e', 'eː', 'e̞', 'f', 'fʲ', 'fʷ', 'fː', 'g', 'gʲ', 'gʲj', 'gʷ', 'gː', 'h', 'hʷ', 'i', 'ij', 'iː', 'i̞', 'i̥', 'i̯', 'j', 'k', 'kx', 'kʰ', 'kʲ', 'kʲj', 'kʷ', 'kʷʼ', 'kʼ', 'kː', 'k̟ʲ', 'k̟̚', 'k͡p̚', 'l', 'lʲ', 'lː', 'l̪', 'm', 'mʲ', 'mʲj', 'mʷ', 'mː', 'n', 'nj', 'nʲ', 'nː', 'n̪', 'n̺', 'o', 'oː', 'o̞', 'o̥', 'p', 'pf', 'pʰ', 'pʲ', 'pʲj', 'pʷ', 'pʷʼ', 'pʼ', 'pː', 'p̚', 'q', 'r', 'rː', 's', 'sʲ', 'sʼ', 'sː', 's̪', 't', 'ts', 'tsʰ', 'tɕ', 'tɕʰ', 'tʂ', 'tʂʰ', 'tʃ', 'tʰ', 'tʲ', 'tʷʼ', 'tʼ', 'tː', 't̚', 't̪', 't̪ʰ', 't̪̚', 't͡s', 't͡sʼ', 't͡ɕ', 't͡ɬ', 't͡ʃ', 't͡ʃʲ', 't͡ʃʼ', 't͡ʃː', 'u', 'uə', 'uː', 'u͡w', 'v', 'vʲ', 'vʷ', 'vː', 'v̞', 'v̞ʲ', 'w', 'x', 'x̟ʲ', 'y', 'z', 'zj', 'zʲ', 'z̪', 'ä', 'æ', 'ç', 'çj', 'ð', 'ø', 'ŋ', 'ŋ̟', 'ŋ͡m', 'œ', 'œ̃', 'ɐ', 'ɐ̞', 'ɑ', 'ɑ̱', 'ɒ', 'ɓ', 'ɔ', 'ɔ̃', 'ɕ', 'ɕː', 'ɖ̤', 'ɗ', 'ə', 'ɛ', 'ɛ̃', 'ɟ', 'ɡ', 'ɡʲ', 'ɡ̤', 'ɡ̥', 'ɣ', 'ɣj', 'ɤ', 'ɤɐ̞', 'ɤ̆', 'ɥ', 'ɦ', 'ɨ', 'ɪ', 'ɫ', 'ɯ', 'ɯ̟', 'ɯ̥', 'ɰ', 'ɱ', 'ɲ', 'ɳ', 'ɴ', 'ɵ', 'ɸ', 'ɹ', 'ɹ̩', 'ɻ', 'ɻ̩', 'ɽ', 'ɾ', 'ɾj', 'ɾʲ', 'ɾ̠', 'ʀ', 'ʁ', 'ʁ̝', 'ʂ', 'ʃ', 'ʃʲː', 'ʃ͡ɣ', 'ʈ', 'ʉ̞', 'ʊ', 'ʋ', 'ʋʲ', 'ʌ', 'ʎ', 'ʏ', 'ʐ', 'ʑ', 'ʒ', 'ʒ͡ɣ', 'ʔ', 'ʝ', 'ː', 'β', 'β̞', 'θ', 'χ', 'ә', 'ḁ']

python -m allosaurus.bin.list_phone

模型

model 选项用于选择用于推理的模型。

默认选项是 latest,它指向您下载的最新模型。

如果您本地没有模型,在首次推理时会自动下载最新的模型。

我们计划训练新模型并持续发布。更新可能包括声学模型二进制文件和音素清单。 通常,模型名称会标明其训练日期,因此较高的模型 ID 通常意味着更好的性能。

要下载新模型,您可以运行以下命令:

python -m allosaurus.bin.download_model -m <model>

如果您不知道模型名称,

可以直接使用 latest 作为模型名称,系统会自动下载最新模型。

请注意,更新到新模型不会删除原有模型。所有模型都会存储在您安装 Allosaurus 的 pretrained 目录下。

在一次实验中,您可能希望固定使用某个特定模型以获得一致的结果。

要查看本地环境中有哪些可用模型,可以使用以下命令:

python -m allosaurus.bin.list_model

要删除某个模型,可以使用以下命令。这在后续进行模型微调时可能会很有用:

python -m allosaurus.bin.remove_model

当前可用的模型如下:

语言无关模型(通用模型)

通用模型能够预测与语言无关的音素,覆盖多种语言。这是 Allosaurus 默认尝试下载和使用的模型。 如果您在语言相关模型中找不到您的语言,请改用此通用模型。

| 模型 | 目标语言 | 描述 |

|---|---|---|

uni2005 |

通用 | 这是 latest 模型(之前名为 200529) |

语言相关模型

我们计划为一些广泛使用的语言提供语言相关模型。这些模型是专门针对目标语言训练的。

对于目标语言而言,它们的表现应该远优于通用模型。这些模型不会自动下载。请使用上述 download_model 命令进行下载,并在推理时使用 --model 标志。

| 模型 | 目标语言 | 描述 |

|---|---|---|

eng2102 |

英语 (eng) | 仅适用于英语的模型 |

设备

device_id 控制着在哪种设备上运行推理。

默认情况下,device_id 为 -1,表示模型将仅使用 CPU。

然而,如果您有 GPU,可以通过将 device_id 设置为某个 GPU 的编号来利用 GPU 进行推理。(注意:不支持多 GPU 推理)

时间戳

您可以通过使用 timestamp 参数获取每个识别出的音素的大致时间戳。

python -m allosaurus.run --timestamp=True -i sample.wav

0.210 0.045 æ

0.390 0.045 l

0.450 0.045 u

0.540 0.045 s

0.630 0.045 ɔ

0.720 0.045 ɹ

0.870 0.045 s

每一行的格式为 开始时间戳 持续时间 音素,其中 开始时间戳 和 持续时间 以秒为单位。

需要注意的是,当前的时间戳仅为近似值。它是通过 CTC 模型提供的,由于其特性,在某些情况下可能不够准确。

同样的接口也可以在 Python 中使用,如下所示:

model = read_recognizer()

model.recognize('./sample.wav', timestamp=True)

Top K

有时生成更多的音素可能会有所帮助。指定 top-k 参数会在每个发音帧生成 k 个音素。默认值为 1。

# 默认 topk 是 1

python -m allosaurus.run -i sample.wav

æ l u s ɔ ɹ s

# 输出每个发音帧中最有可能的 5 个音素,用 `|` 分隔各帧(当 topk=1 时无分隔符)

# 每个音素后面附有概率,最左边的音素是最有可能的音素

# `<blk>` 表示空白音素,可忽略。

python -m allosaurus.run -i sample.wav --topk=5

æ (0.577) ɛ (0.128) ɒ (0.103) a (0.045) ə (0.021) | l (0.754) l̪ (0.196) lː (0.018) ʁ (0.007) ʀ (0.006) | u (0.233) ɨ (0.218) uː (0.104) ɤ (0.070) ɪ (0.066) | s (0.301) <blk> (0.298) z (0.118) s̪ (0.084) sː (0.046) | ɔ (0.454) ɑ (0.251) <blk> (0.105) ɹ̩ (0.062) uə (0.035) | ɹ (0.867) ɾ (0.067) <blk> (0.024) l̪ (0.018) r (0.015) | s (0.740) z (0.191) s̪ (0.039) zʲ (0.009) sː (0.003)

音素发射率

您可以通过更改 --emit 或 -e 参数来控制模型发出更多或更少音素。

# 默认发射率为 1.0

python -m allosaurus.run -i sample.wav

æ l u s ɔ ɹ s

# 当 emit > 1 时,模型会发出更多音素

python -m allosaurus.run -e 1.2 -i sample.wav

æ l u s f h ɔ ɹ s

# 当 emit < 1 时,模型会发出较少音素

python -m allosaurus.run -e 0.8 -i sample.wav

æ l u ɹ s

音素清单自定义

默认的音素清单可能并不是您想要使用的清单,因此我们提供了若干命令供您自定义自己的音素清单。

我们已经提到,您可以通过以下命令查看当前的(默认)音素清单:

python -m allosaurus.bin.list_phone --lang <语言名称>

当前的音素清单文件可以导出到一个文件中:

# 导出音素文件

python -m allosaurus.bin.write_phone --lang <语言名称> --output <保存该文件的路径>

如果您查看该文件,会发现它是一个简单的格式,每行代表一个音素。例如,以下是英语的音素清单:

a

aː

b

d

...

您可以自定义此文件,添加或删除您需要的国际音标。每行应只包含一个国际音标,且不能有空格。虽然按顺序排列国际音标有助于后续调试,但这并非强制要求。

接下来,使用以下命令更新您的模型音素清单:

python -m allosaurus.bin.update_phone --lang <语言名称> --input <您自定义的文件>

更新完成后,再次运行 list_phone 命令,您会看到模型现在使用的是您更新后的音素清单:

python -m allosaurus.bin.list_phone --lang <语言名称>

现在,如果您再次进行推理,结果也会反映出您更新后的音素清单。

即使在更新之后,您也可以轻松切换回原始音素清单。在这种情况下,您自定义的文件会被删除:

python -m allosaurus.bin.restore_phone --lang <语言名称>

先验自定义

你还可以通过调整每个音素的先验概率来改变结果。

这可以帮助你减少不想要的音素,或者增加想要的音素。

例如,在示例文件中,我们得到如下输出:

æ l u s ɔ ɹ s

假设你觉得第一个音素不对,并希望降低该音素的概率,你可以创建一个新的文件 prior.txt,内容如下:

æ -10.0

该文件可以包含多行,每行对应一个音素的信息。第一列是你要调整的目标音素,第二列是基于对数的概率分数。正分数表示提高该音素的预测概率,负分数则会抑制其预测概率。在这种情况下,我们可以得到新的结果:

python -m allosaurus.run -i=sample.wav --lang=eng --prior=prior.txt

ɛ l u s ɔ ɹ s

可以看到,æ 被抑制了,另一个元音 ɛ 取代了它。

先验的另一个用途是改变总输出音素的数量。你可能希望输出更多或更少的音素。这时,你可以调整与静音音素对应的 <blk> 的分数。

正的 <blk> 分数会增加静音部分,从而减少输出音素的数量;相反,负的 <blk> 分数会增加输出音素的数量。下面的例子说明了这一点:

# <blk> 1.0

python -m allosaurus.run -i=sample.wav --lang=eng --prior=prior.txt

æ l u ɔ ɹ s

# <blk> -1.0

$ python -m allosaurus.run -i=sample.wav --lang=eng --prior=prior.txt

æ l u s f ɔ ɹ s

第一个例子减少了一个音素,第二个例子则增加了一个音素。

微调

我们注意到,预训练模型对于某些语言可能不够准确,因此我们提供了一个微调工具,允许用户根据自己的数据进一步改进模型。目前,该功能仅支持单语言的微调。

准备工作

要对你的数据进行微调,你需要准备音频文件及其转录文本。首先,创建一个数据目录(名称可任意),在该目录内再创建 train 和 validate 两个子目录。

显然,train 目录将存放训练集,而 validate 目录则用于验证集。

每个目录应包含以下两个文件:

wave:这个文件将每个话语与其对应的音频文件关联起来。text:这个文件将每个话语与其音素序列关联起来。

wave

wave 是一个文本文件,用于将每个话语映射到对应的 WAV 文件。每行的格式如下:

utt_id /path/to/your/audio.wav

其中,utt_id 表示话语 ID,可以是任意字符串,只要在你的数据集中保持唯一即可。audio.wav 是前面提到的音频文件,应为单声道 WAV 格式,采样率可以任意(如果需要,工具会自动重采样)。

此处使用的分隔符是空格。

为了获得最佳的微调效果,每个音频文件不宜过长。我们建议每个话语的时长不超过 10 秒。

text

text 是另一个文本文件,用于将每个话语映射到其转录文本。每行的格式如下:

utt_id phone1 phone2 ...

其中,utt_id 再次表示话语 ID,必须与对应的 WAV 文件匹配。

话语 ID 后面的音素序列是你对 WAV 文件的音标转录。

这些音素应限制在目标语言的音素库范围内。请确保所有音素都已经通过 list_phone 命令注册到你的目标语言中。

特征提取

接下来,我们将从 wave 和 text 文件中提取特征。我们假设你已经在 train 和 validate 目录中分别准备好了 wave 和 text 文件。

音频特征

要准备音频特征,请在 train 和 validate 目录中分别运行以下命令:

# 准备音频特征的命令

python -m allosaurus.bin.prep_feat --model=some_pretrained_model --path=/path/to/your/directory (train or validate)

其中,path 应指向训练或验证目录,model 应指向你所使用的预训练模型。若未指定,则会使用最新版本的模型。

该命令会生成三个文件:feat.scp、feat.ark 和 shape。

第一个文件是一个索引文件,将每个话语映射到第二个文件中的偏移量。

第二个文件是一个二进制文件,包含了所有的音频特征。

第三个文件包含了特征的维度信息。

如果你感兴趣,scp 和 ark 格式是 Kaldi 中常用的文件格式。

文本特征

要准备文本特征,请再次在 train 和 validate 目录中分别运行以下命令:

# 准备标记的命令

python -m allosaurus.bin.prep_token --model=<some_pretrained_model> --lang=<your_target_language_id> --path=/path/to/your/directory (train or validate)

这里的 path 和 model 与之前的命令相同。lang 是该数据集的 3 字符 ISO 语言代码。

请注意,你应该事先确认该语言代码的音素库包含你所有的音素转录。否则,特征提取可能会失败。

执行完该命令后,会生成一个名为 token 的文件,将每个话语映射到音素 ID 序列。

训练

接下来,我们可以开始用刚刚准备好的数据对模型进行微调。微调命令非常简单:

# 微调数据的命令

python -m allosaurus.bin.adapt_model --pretrained_model=<pretrained_model> --new_model=<your_new_model> --path=/path/to/your/data/directory --lang=<your_target_language_id> --device_id=<device_id> --epoch=<epoch>

这里还有一些可选参数,但我们只介绍必需的参数。

pretrained_model应与之前在prep_token和prep_feat中指定的模型一致。new_model可以是任意模型名称(实际上,如果给每个模型都采用与预训练模型相同的命名格式,比如 YYMMDD,会更容易管理)。path应指向train和validate目录的父目录。lang是你在prep_token中指定的语言代码。device_id是用于微调的 GPU ID,如果没有 GPU,则将device_id设置为 -1。目前不支持多 GPU。epoch是训练的轮数。

在训练过程中,系统会显示训练集和验证集的损失以及音素错误率等信息。每完成一个 epoch,模型都会在验证集上进行评估,如果验证集上的音素错误率比之前更好,则会保存该检查点。

当指定的 epoch 数完成后,微调过程即告结束,新的模型也将可用。

测试

训练完成后,新模型应会出现在您的模型列表中。使用 list_model 命令检查新模型是否已可用。

# 查看所有模型的命令

python -m allosaurus.bin.list_model

如果模型已可用,则可以像使用其他预训练模型一样使用它。只需运行推理即可使用您的新模型。

python -m allosaurus.run --lang <语言代码> --model <您的新模型> --device_id <GPU编号> -i <音频>

致谢

本工作使用了以下部分代码和资源。特别是,我们大量使用了 AlloVera 和 Phoible 来构建该模型的音素库。

- AlloVera:用于基于正确的同位异音映射对模型进行预训练

- Phoible:用于特定语言的音素库

- python_speech_features:用于提取 MFCC 和滤波器组特征

- fairseq:提供了一些实用工具

- kaldi_io:用于读写 Kaldi 的 SCP 和 ARK 文件

参考文献

如果您在工作中使用了本项目的代码,请引用以下论文。

如果您有任何建议或意见,欢迎随时通过电子邮件(xinjianl [at] cs.cmu.edu)与我联系,或在此仓库中提交问题。谢谢!

@inproceedings{li2020universal,

title={通用音素识别与多语言同位异音系统},

author={Li, Xinjian and Dalmia, Siddharth and Li, Juncheng and Lee, Matthew and Littell, Patrick and Yao, Jiali and Anastasopoulos, Antonios and Mortensen, David R and Neubig, Graham and Black, Alan W and Florian, Metze},

booktitle={ICASSP 2020-2020 IEEE 国际声学、语音与信号处理会议(ICASSP)},

pages={8249--8253},

year={2020},

organization={IEEE}

}

版本历史

v1.02021/05/27常见问题

相似工具推荐

openclaw

OpenClaw 是一款专为个人打造的本地化 AI 助手,旨在让你在自己的设备上拥有完全可控的智能伙伴。它打破了传统 AI 助手局限于特定网页或应用的束缚,能够直接接入你日常使用的各类通讯渠道,包括微信、WhatsApp、Telegram、Discord、iMessage 等数十种平台。无论你在哪个聊天软件中发送消息,OpenClaw 都能即时响应,甚至支持在 macOS、iOS 和 Android 设备上进行语音交互,并提供实时的画布渲染功能供你操控。 这款工具主要解决了用户对数据隐私、响应速度以及“始终在线”体验的需求。通过将 AI 部署在本地,用户无需依赖云端服务即可享受快速、私密的智能辅助,真正实现了“你的数据,你做主”。其独特的技术亮点在于强大的网关架构,将控制平面与核心助手分离,确保跨平台通信的流畅性与扩展性。 OpenClaw 非常适合希望构建个性化工作流的技术爱好者、开发者,以及注重隐私保护且不愿被单一生态绑定的普通用户。只要具备基础的终端操作能力(支持 macOS、Linux 及 Windows WSL2),即可通过简单的命令行引导完成部署。如果你渴望拥有一个懂你

stable-diffusion-webui

stable-diffusion-webui 是一个基于 Gradio 构建的网页版操作界面,旨在让用户能够轻松地在本地运行和使用强大的 Stable Diffusion 图像生成模型。它解决了原始模型依赖命令行、操作门槛高且功能分散的痛点,将复杂的 AI 绘图流程整合进一个直观易用的图形化平台。 无论是希望快速上手的普通创作者、需要精细控制画面细节的设计师,还是想要深入探索模型潜力的开发者与研究人员,都能从中获益。其核心亮点在于极高的功能丰富度:不仅支持文生图、图生图、局部重绘(Inpainting)和外绘(Outpainting)等基础模式,还独创了注意力机制调整、提示词矩阵、负向提示词以及“高清修复”等高级功能。此外,它内置了 GFPGAN 和 CodeFormer 等人脸修复工具,支持多种神经网络放大算法,并允许用户通过插件系统无限扩展能力。即使是显存有限的设备,stable-diffusion-webui 也提供了相应的优化选项,让高质量的 AI 艺术创作变得触手可及。

everything-claude-code

everything-claude-code 是一套专为 AI 编程助手(如 Claude Code、Codex、Cursor 等)打造的高性能优化系统。它不仅仅是一组配置文件,而是一个经过长期实战打磨的完整框架,旨在解决 AI 代理在实际开发中面临的效率低下、记忆丢失、安全隐患及缺乏持续学习能力等核心痛点。 通过引入技能模块化、直觉增强、记忆持久化机制以及内置的安全扫描功能,everything-claude-code 能显著提升 AI 在复杂任务中的表现,帮助开发者构建更稳定、更智能的生产级 AI 代理。其独特的“研究优先”开发理念和针对 Token 消耗的优化策略,使得模型响应更快、成本更低,同时有效防御潜在的攻击向量。 这套工具特别适合软件开发者、AI 研究人员以及希望深度定制 AI 工作流的技术团队使用。无论您是在构建大型代码库,还是需要 AI 协助进行安全审计与自动化测试,everything-claude-code 都能提供强大的底层支持。作为一个曾荣获 Anthropic 黑客大奖的开源项目,它融合了多语言支持与丰富的实战钩子(hooks),让 AI 真正成长为懂上

ComfyUI

ComfyUI 是一款功能强大且高度模块化的视觉 AI 引擎,专为设计和执行复杂的 Stable Diffusion 图像生成流程而打造。它摒弃了传统的代码编写模式,采用直观的节点式流程图界面,让用户通过连接不同的功能模块即可构建个性化的生成管线。 这一设计巧妙解决了高级 AI 绘图工作流配置复杂、灵活性不足的痛点。用户无需具备编程背景,也能自由组合模型、调整参数并实时预览效果,轻松实现从基础文生图到多步骤高清修复等各类复杂任务。ComfyUI 拥有极佳的兼容性,不仅支持 Windows、macOS 和 Linux 全平台,还广泛适配 NVIDIA、AMD、Intel 及苹果 Silicon 等多种硬件架构,并率先支持 SDXL、Flux、SD3 等前沿模型。 无论是希望深入探索算法潜力的研究人员和开发者,还是追求极致创作自由度的设计师与资深 AI 绘画爱好者,ComfyUI 都能提供强大的支持。其独特的模块化架构允许社区不断扩展新功能,使其成为当前最灵活、生态最丰富的开源扩散模型工具之一,帮助用户将创意高效转化为现实。

gemini-cli

gemini-cli 是一款由谷歌推出的开源 AI 命令行工具,它将强大的 Gemini 大模型能力直接集成到用户的终端环境中。对于习惯在命令行工作的开发者而言,它提供了一条从输入提示词到获取模型响应的最短路径,无需切换窗口即可享受智能辅助。 这款工具主要解决了开发过程中频繁上下文切换的痛点,让用户能在熟悉的终端界面内直接完成代码理解、生成、调试以及自动化运维任务。无论是查询大型代码库、根据草图生成应用,还是执行复杂的 Git 操作,gemini-cli 都能通过自然语言指令高效处理。 它特别适合广大软件工程师、DevOps 人员及技术研究人员使用。其核心亮点包括支持高达 100 万 token 的超长上下文窗口,具备出色的逻辑推理能力;内置 Google 搜索、文件操作及 Shell 命令执行等实用工具;更独特的是,它支持 MCP(模型上下文协议),允许用户灵活扩展自定义集成,连接如图像生成等外部能力。此外,个人谷歌账号即可享受免费的额度支持,且项目基于 Apache 2.0 协议完全开源,是提升终端工作效率的理想助手。

markitdown

MarkItDown 是一款由微软 AutoGen 团队打造的轻量级 Python 工具,专为将各类文件高效转换为 Markdown 格式而设计。它支持 PDF、Word、Excel、PPT、图片(含 OCR)、音频(含语音转录)、HTML 乃至 YouTube 链接等多种格式的解析,能够精准提取文档中的标题、列表、表格和链接等关键结构信息。 在人工智能应用日益普及的今天,大语言模型(LLM)虽擅长处理文本,却难以直接读取复杂的二进制办公文档。MarkItDown 恰好解决了这一痛点,它将非结构化或半结构化的文件转化为模型“原生理解”且 Token 效率极高的 Markdown 格式,成为连接本地文件与 AI 分析 pipeline 的理想桥梁。此外,它还提供了 MCP(模型上下文协议)服务器,可无缝集成到 Claude Desktop 等 LLM 应用中。 这款工具特别适合开发者、数据科学家及 AI 研究人员使用,尤其是那些需要构建文档检索增强生成(RAG)系统、进行批量文本分析或希望让 AI 助手直接“阅读”本地文件的用户。虽然生成的内容也具备一定可读性,但其核心优势在于为机器