LLMUnity

LLMUnity 是一款专为 Unity 引擎设计的开源插件,旨在让开发者轻松地将大型语言模型(LLM)集成到游戏或互动应用中。它主要解决了传统游戏角色对话生硬、缺乏智能交互的痛点,帮助创作者打造能够理解上下文、进行自然对话的智能 NPC,从而显著提升玩家的沉浸感。

这款工具非常适合 Unity 游戏开发者、互动叙事设计师以及希望探索 AI 在游戏领域应用的研究人员使用。无需深厚的机器学习背景,用户即可在熟悉的 Unity 工作流中快速部署本地运行的 AI 角色。

LLMUnity 的核心技术亮点在于其内置的检索增强生成(RAG)系统。该系统支持语义搜索,允许角色“阅读”并理解开发者提供的自定义数据(如游戏世界观文档或剧本),使回答更加精准且符合设定。此外,其底层后端基于高性能的 llama.cpp 库构建,并以独立的 C++/C# 库形式提供,确保了在本地设备上的高效运行与隐私安全。无论是制作冒险游戏中的智慧向导,还是开发教育类互动应用,LLMUnity 都为实现更生动的虚拟角色提供了强大而便捷的技术支持。

使用场景

一家独立游戏工作室正在开发一款开放世界 RPG,希望游戏中的 NPC 能根据玩家的历史行为和当前语境进行动态对话,而非重复固定台词。

没有 LLMUnity 时

- 开发者必须手动编写成千上万条分支对话树,不仅耗时耗力,还难以覆盖玩家所有可能的提问。

- NPC 无法记忆之前的互动细节,每次对话都像“失忆”一样重新开始,严重破坏沉浸感。

- 若想让玩家查询游戏内的百科知识(如怪物弱点、任务线索),只能硬编码简单的关键词匹配,灵活性极差。

- 调整角色性格或语气需要修改大量脚本逻辑,迭代成本极高,难以快速测试不同风格。

使用 LLMUnity 后

- 借助内置的大语言模型,NPC 能实时生成符合语境的自然回复,无需预设海量台词,大幅减少美术与策划的工作量。

- 利用 RAG(检索增强生成)系统,NPC 可自动检索游戏数据库中的背景设定,准确回答玩家关于世界观的复杂问题。

- 角色具备短期记忆能力,能结合上下文连续对话,甚至根据玩家之前的选择改变态度,显著提升代入感。

- 开发者只需在 Unity 编辑器中调整提示词(Prompt)参数,即可瞬间改变 NPC 的性格设定,实现快速原型验证。

LLMUnity 将静态的脚本对话转化为动态的智能交互,让游戏角色真正“活”了起来。

运行环境要求

- Windows

- macOS

- Linux

- Android

- iOS

- 非必需

- 支持 CPU 推理

- 若使用 GPU,支持 Nvidia (CUDA)、AMD 和 Apple Metal

- 未指定具体显存大小,移动端建议使用 10-20 亿参数的小模型

未说明(取决于所选 LLM 模型大小,移动端需适配小模型)

快速开始

使用 LLM 在 Unity 中创建角色!

使用 LLM 在 Unity 中创建角色!

使用 LLM 的 Unity 游戏/项目

- Verbal Verdict

- I, Chatbot: AISYLUM

- Nameless Souls of the Void

- Murder in Aisle 4

- Finicky Food Delivery AI

- AI Emotional Girlfriend

- Case Closed

- MaiMai AI Agent System

- Claria Chat

- Endless Casual Drive

- Dating App Simulator

- Virtual Reality Mock Interview

- Velesio AI server

- Dungeon Chat

- Tomonaka Desk

- Digital Humans

- CakeMix

- HeyWaifu

- Love and Lie

- Psycho Simulator

- False Flame

如需添加您的项目,请联系 hello@undream.ai!

设置方法

方法 1:通过 Asset Store 安装

- 打开 LLM for Unity 资产页面,点击

Add to My Assets。 - 在 Unity 中打开 Package Manager:

Window > Package Manager。 - 从下拉菜单中选择

Packages: My Assets选项。 - 选择

LLM for Unity包,点击Download后再点击Import。

方法 2:通过 GitHub 仓库安装:

- 在 Unity 中打开 Package Manager:

Window > Package Manager。 - 点击

+按钮,选择Add package from git URL。 - 使用仓库地址

https://github.com/undreamai/LLMUnity.git并点击Add。

快速入门

1. 设置 LLM

首先为您的游戏设置 LLM:

- 创建一个空的 GameObject。

在 GameObject 的 Inspector 中点击Add Component,然后选择LLM脚本。 - 使用

Download Model按钮下载默认模型之一(约 GB 级)。

或者使用Load model按钮加载您自己的 .gguf 模型(参见 LLM 模型管理)。

2. 创建 AI 角色

然后您可以按照以下步骤设置每个角色:

- 为该角色创建一个空的 GameObject。

在 GameObject 的 Inspector 中点击Add Component,然后选择LLMAgent脚本。 - 在

System Prompt中定义 AI 的角色。 - (可选)如果您有多个 LLM GameObject,则在

LLM字段中选择上面构建的 LLM。

3. 在脚本中使用

在您的脚本中,您可以按如下方式使用它:

using LLMUnity;

public class MyScript {

public LLMAgent llmAgent;

void HandleReply(string replySoFar){

// 对模型生成的回复进行处理

Debug.Log(replySoFar);

}

void Game(){

// 处理正在生成的回复

...

_ = llmAgent.Chat("Hello bot!", HandleReply);

...

}

async void GameAsync(){

// 或一次性处理完整回复

...

string reply = await llmAgent.Chat("Hello bot!");

Debug.Log(reply);

...

}

}

您还可以指定在模型回复完成后调用的函数:

void ReplyCompleted(){

// 当模型回复完成时执行的操作

Debug.Log("AI 回复已完成");

}

void Game(){

// 您的游戏函数

...

_ = llmAgent.Chat("Hello bot!", HandleReply, ReplyCompleted);

...

}

若需在回复完成前停止聊天,可以使用:

llmAgent.CancelRequests();

- 最后,在您脚本的 GameObject 的 Inspector 中,将上面创建的 LLMAgent GameObject 作为 llmAgent 属性选择。

这样就完成了!您的 AI 角色已经准备好聊天了!✨

高级用法

构建移动应用

对于移动应用,您可以使用参数量最多为 1-20 亿的模型(LLM 模型管理器中的“Tiny 模型”)。

由于移动设备硬件资源有限,更大的模型通常无法运行。

iOS iOS 可以使用默认的播放器设置进行构建。

Android

在 Android 上,您需要在播放器设置中指定 IL2CPP 脚本后端和 ARM64 目标架构。

这些设置可以在 Edit > Project Settings 菜单下的 Player > Other Settings 部分找到。

由于移动应用的体积通常较小,您可以在应用首次启动时下载 LLM 模型。

此功能可通过 Download on Build 选项启用。

在您的项目中,您可以等待模型下载完成:

await LLM.WaitUntilModelSetup();

您还可以在模型下载过程中接收下载进度通知:

await LLM.WaitUntilModelSetup(SetProgress);

void SetProgress(float progress){

string progressPercent = ((int)(progress * 100)).ToString() + "%";

Debug.Log($"下载进度:{progressPercent}");

}

这有助于显示进度条等界面元素。

MobileDemo 示例演示了一个适用于 Android / iOS 的应用。

限制 LLM 输出 / 函数调用 / 语法

要限制 LLM 的输出,您可以使用语法,更多信息请参见 这里。

语法可以直接在 LLMAgent 的 Grammar 字段中编辑,也可以保存为 gbnf / json schema 文件,并通过 Load Grammar 按钮加载(高级选项)。

例如,要获得 JSON 格式的回复,可以使用 json.gbnf 语法。

或者您也可以直接在脚本中设置语法:

llmAgent.grammar = "您的语法在此";

对于函数调用,您可以定义一种仅允许函数名称作为输出的语法,然后调用相应的函数。

您可以查看 FunctionCalling 示例以了解实现方法。

访问/保存/加载聊天记录

`LLMAgent` 的聊天记录保存在 `chat` 变量中,它是一个由 `ChatMessage` 对象组成的列表。`ChatMessage` 是一个类,用于定义消息的 `role`(角色)和 `content`(内容)。

该列表交替包含玩家的提示和 AI 的回复。

您可以修改聊天记录,然后将其设置到您的 LLMAgent GameObject 上: ``` c# List

要添加新消息,可以这样做:

_ = llmAgent.AddUserMessage("您的用户消息");

_ = llmAgent.AddAssistantMessage("您的助手回复");

要自动保存/加载聊天记录,您可以将 LLMAgent 的 Save 参数指定为您选择的文件名(或相对路径)。

聊天记录会以 JSON 对象的形式保存在 Unity 的 persistentDataPath 文件夹 中。

要手动保存聊天记录,可以使用:

_ = llmAgent.SaveHistory();

而要加载记录,则可以使用:

_ = llmAgent.Loadistory();

在应用启动时处理提示,以加快初始处理时间

void WarmupCompleted(){

// 温暖化完成时执行的操作

Debug.Log("AI 已准备就绪");

}

void Game(){

// 您的游戏函数

...

_ = llmAgent.Warmup(WarmupCompleted);

...

}

决定是否将消息添加到聊天/提示历史中

Chat 函数的最后一个参数是一个布尔值,用于指定是否将消息添加到历史中(默认为 true):

void Game(){

// 您的游戏函数

...

string message = "你好机器人!";

_ = llmAgent.Chat(message, HandleReply, ReplyCompleted, false);

...

}

使用纯文本补全

void Game(){

// 您的游戏函数

...

string message = "猫不在了";

_ = llmAgent.Completion(message, HandleReply, ReplyCompleted);

...

}

以编程方式添加 LLM / LLMAgent 组件

using UnityEngine;

using LLMUnity;

public class MyScript : MonoBehaviour

{

LLM llm;

LLMAgent llmAgent;

async void Start()

{

// 禁用 GameObject,以便 Awake 不会立即被调用

gameObject.SetActive(false);

// 添加 LLM 对象

llm = gameObject.AddComponent<LLM>();

// 使用模型文件名设置模型。

// 模型需要通过加载或下载的方式添加到 LLM 模型管理器中(参见 LLM 模型管理)。

// 否则,可以将模型文件直接复制到 StreamingAssets 文件夹内。

llm.model = "Qwen3-4B-Q4_K_M.gguf";

// 可选:您也可以以类似的方式设置 LoRA,并根据需要设置其权重。

llm.AddLora("my-lora.gguf");

llm.AddLora("my-lora-2.gguf", 0.5f);

// 可选:设置线程数

llm.numThreads = -1;

// 可选:启用 GPU,通过设置要卸载到 GPU 的模型层数来实现

llm.numGPULayers = 10;

// 添加 LLMAgent 对象

llmAgent = gameObject.AddComponent<LLMAgent>();

// 设置负责模型的 LLM 对象

llmAgent.llm = llm;

// 设置角色提示

llmAgent.systemPrompt = "一位好奇的人类与人工智能助手之间的对话。";

// 设置 AI 和玩家的角色名称

llmAgent.assistantRole = "AI";

llmAgent.userRole = "人类";

// 可选:设置保存路径

llmAgent.save = "AICharacter1.json";

// 可选:设置语法

llmAgent.grammar = "您的语法在此";

// 重新启用 GameObject

gameObject.SetActive(true);

}

}

使用远程服务器

您可以使用远程服务器来进行处理,并实现与之交互的角色。

创建服务器

要创建服务器:

- 按照上述说明,使用

LLM脚本创建一个带有 GameObject 的项目 - 启用

LLM的Remote选项,并可选配置服务器端口和 API 密钥 - 在项目设置中启用“允许通过 HTTP 下载”

- 构建并运行以启动服务器

或者,您也可以使用服务器二进制文件以简化部署:

- 从编辑器中运行上述场景,并从调试信息中复制命令(以“Deploy server command:”开头)

- 下载并解压 LlamaLib 二进制文件

- 在命令行中切换到选定的

servers文件夹,并运行之前复制的命令来启动服务器。

创建角色

使用上述说明中的 LLMAgent 脚本,创建第二个包含游戏角色的项目。

启用 Remote 选项,并使用服务器的 IP 地址(以“http://”开头)、端口和 API 密钥配置主机。

使用 LLM 计算嵌入向量

Embeddings 函数可用于获取短语的嵌入向量:

List<float> embeddings = await llmAgent.Embeddings("你好,最近怎么样?");

关于函数级别的详细文档可以在这里找到: <img src="https://img.shields.io/badge/Documentation-white.svg?logo=data:image/png;base64,iVBORw0KGgoAAAANSUhEUgAAADAAAAAwEAYAAAAHkiXEAAAABHNCSVQICAgIfAhkiAAAAAlwSFlzAAALEgAACxIB0t1+/AAAABl0RVh0U29mdHdhcmUAd3d3Lmlua3NjYXBlLm9yZ5vuPBoAAATqSURBVHic7ZtbiE1RGMc349K4M5EwklwjzUhJCMmTJPJAYjQXJJcH8+Blkry4lPJA8aAoJbekDLmUS6E8SHJL5AW5JPf7eHv93C2Wfttc/ee+0zc/4vv+bMXvusvfZa3/q+b33H80oqqaSSSmqrKnPdgXjUvbvYq5f4+7f486eb/rRajRsn7t4tPngg/vkj/vghXr0q7tghzpyZ//79+on79omXLomb//iFV68SN24UHz0qdugkzp0Td+0Sb90Sb90qtm0Tb90qtm0Tr14V27eLHTuKLVuKLVuKLVuKLVuKLVuKLVuKLVuKLVuKLVuKLVuKLVuKLVuKLVuKLVuKLVuKLVuKLVuKLVuKLVuKLVuKLVuKLVuKLVuKLVuKLVuKLVuKLVuKLVuKLVuKLVuKLVuKLVuKLVuKLVuKLVuKLVuKLVuKLVuKLVuKLVuKLVuKLVuKLVuKLVuKLVuKLVuKLVuKLVuKLVuKLVuKLVuKLVuKLVuKLVuKLVuKLVuKLVuKLVuKLVuKLVuKLVuKLVuKLVuKLVuKLVuKLVuKLVuKLVuKLVuKLVuKLVuKLVuKLVuKLVuKLVuKLVuKLVuKLVuKLVuKLVuKLVuKLVuKLVuKLVu......关于函数级别的详细文档可以在这里找到: <img src="https://img.shields.io/badge/Documentation-white.svg?logo=data:image/png;base64,iVBORw0KGgoAAAANSUhEUgAAADAAAAAwEAYAAAAHkiXEAAAABHNCSVQICAgIfAhkiAAAAAlwSFlzAAALEgAACxIB0t1+/AAAABl0RVh0U29mdHdhcmUAd3d3Lmlua3NjYXBlLm9yZ5vuPBoAAATqSURBVHic7ZtbiE1RGMc349K4M5EwklwjzUhJCMmTJPJAYjQXJJcH8+Blkry4lPJA8aAoJbekDLmUS6E8SHJL5AW5JPf7eHv93C22Wfttc/ee+0zc/4vv+bMXvusvfZa3/q+b33H80oqqaSSSmqrKnPdgXjUvbvYq5f4+7f486eb/rRajRsn7t4tPngg/vkj/vghXr0q7tghzpyZ//79+on79omXLomb92odV9GoSxdx8mSxqUm8eVNkgAvl0aPioEFip07i6dP52z15Ig4fbvVY2VVFhbhokXjrlogJiWvAg/jwoXjqVO53+leUny9eiFVV5mfMlLDRBw+KX76ISQ+0LZ8/F00P4uJFsWPHFh83O+rdWzx3TnQ9kLbECxo2TKyuFj9/zt9u+XIvG8LWv3wpuh5QW86f3/JznT+fv93s2S23C1Z72wbhtH692LdvMvdPSgzkhAkiJhT16ZO/PRPOmcr+Rda4aa5nclTeuZP7PDgRpr1g40bPrQYOFF0PYKHECxo2TKyuFj9/9v/eZDGjxcZh7dv4+mXtch+up7Rca+MsJvxiRNi6npBhw4iGxT16ZO/PRPOmcr+Rda4aa5nclTeuZP7PDgRpr1g40bPrQYOFF0PYKHECxo2TKyuFj9/9v/eZDGjxcZh7dv4+mXtch+up7Rca+MsJvxiRNi6npBhw44oqqaSSSmqrKnPdgXjUvbvYq5f4+7f486eb/rRajRsn7t4tPngg/vkj/vghXr0q7tghzpyZ//79+on79omXLomb92odV9GoSxdx8mSxqUm8eVNkgAvl0aPioEFip07i6dP52z15Ig4fbvVY2VVFhbhokXjrlogJiWvAg/jwoXjqVO53+leUny9eiFVV5mfMlLDRBw+TKuqZNo0kUTuypUrceBA7vcHB4uHDolE8IiZHPY+apTYs6dI3RIWwH//1NSZf/KkuHCh2GpMDyKbGNcLYE+YMkVks3/6NFx7XhTZ3szXiBaqtWvFuAOxM2dEZiyH8UErgc8JLNun7E0aFffSI7RP6owZm3/kSH5/L14UXrxejmj5M7NatIhWARS82xUJfAKahzFcdPnq0GLYgy7Rnbd8e6rGKRyzpuNzPBty4Idf71Kl211M2wwoOq1mzRAq5Pnywa5+4KDHE9mI7ly0TO3bMvZ6/eJE4dqx45IjnU0JxAGLpklPx+9VZFwPp/9v/eZDGjxcZh7dv4+mXtch+up7Rca+MsJvxiRNi6npBhw44oqqaSSSmqrKnPdgXjUvbvYq5f4+7f486eb/rRajRsn7t4tPngg/vkj/vghXr0q7tghzpyZ//79+on79omXLomb92odV9GoSxdx8mSxqUm8eVNkgAvl0aPioEFip07i6dP52z15Ig4fbvVY2VVFhbhokXjrlogJiWvAg/jwoXjqVO53+leUny9eiFVV5mfMlLDRBw+TKuqZNo0kUTiV1NTMvd5DQ0iuxRYuKJHJ4e/fEdevEajYnA4lNvXqJZDKuWiWa3DJe3N69oj8uSEq8CER88uaNOGBAOv2ILGY69TBBJoM8O0t72zaRoztXBzlLlrT8XARW/IQq82JTMv0mKmv0/9CC4mJMYPwrMSETxAyurRUxQVmXP1fEOd7Ny5GLYgy7Rnbd8e6rGKRyzpuNzPBty4Idf71Kl211M2wwoOq1mzRAq5Pnywa5+4KDHE9mI7ly0TO3bMvZ6/eJE4db8uHCh2GpMDyKbGNcLYE+YMkVks3/6NFx7XhTZ3szXiBaqtWvFuAOxM2dEZiyH8UErgc8JLNun7E0aFffSI7RP6owZm3/kSH5/L14UXrxejmj5M7NatIhWARS82xUJfAKahzFcdPnq0GLYgy7Rnbd8e6rGKRyzpuNzPBty4Idf71Kl211M2wwoOq1mzRAq5Pnywa5+4KDHE9mI7ly0TO3bMvZ6/eJE4db8uHCh2GpMDyKbGNcLYE+YMkVks3/6NFx7XhTZ3szXiBaqtWvFuAOxM2dEZiyH8UErgc8JLNun7E0aFffSI7RP6owZm3/kSH5/L14UXrxejmj5M7NatIhWARS82xUJfAKahzFcdPnq0GLYgy7Rnbd8e6rGKRyzpuNzPBty4Idf71Kl211M2wwoOq1mzRAq5Pnywa5+4KDHE9mI7ly0TO3bMvZ6/eJE4db8uHCh2GpMDyKbGNcLYE+YMkVks3/6NFx7XhTZ3szXiBaqtWvFuAOxM2dEZiyH8UErgc8JLNun7E0aFffSI7RP6owZm3/kSH5/L14UXrxejmj5M7NatIhWARS82xUJfAKahzFcdPnq0GLYgy7Rnbd8e6rGKRyzpuNzPBty4Idf71Kl211M2wwoOq1mzRAq5Pnywa5+4KDHE9mI7ly0TO3bMvZ6/eJE4db8uHCh2GpMDyKbGNcLYE+YMkVks3/6NFx7XhTZ3szXiBaqtWvFuAOxM2dEZiyH8UErgc8JLNun7E0aFffSI7RP6owZm3/kSH5/L14UXrxejmj5M7NatIhWARS82xUJfAKahzFcdPnq0GLYgy7Rnbd8e6rGKRyzpuNzPBty4Idf71Kl211M2wwoOq1mzRAq5Pnywa5+4KDHE9mI7ly0TO3bMvZ6/eJE4db8uHCh2GpMDyKbGNcLYE+YMkVks3/6NFx7XhTZ3szXiBaqtWvFuAOxM2dEZiyH8UErgc8JLNun7E0aFffSI7RP6owZm3/kSH5/L14UXrxejmj5M7NatIhWARS82xUJfAKahzFcdPnq0GLYgy7Rnbd8e6rGKRyzpuNzPBty4Idf71Kl211M2wwoOq1mzRAq5Pnywa5+4KDHE9mI7ly0TO3bMvZ6/eJE4db8uHCh2GpMDyKbGNcLYE+YMkVks3/6NFx7XhTZ3szXiBaqtWvFuAOxM2dEZiyH8UErgc8JLNun7E0aFffSI7RP6owZm3/kSH5/L14UXrxejmj5M7NatIhWARS82xUJfAKahzFcdPnq0GLYgy7Rnbd8e6rGKRyzpuNzPBty4Idf71Kl211M2wwoOq1mzRAq5Pnywa5+4KDHE9mI7ly0TO3bMvZ6/eJE4db8uHCh2GpMDyKbGNcLYE+YMkVks3/......

LLM 模型管理

LLM for Unity 内置了一个模型管理器,方便用户轻松管理模型。

模型管理器可用于加载或下载 LLM 模型,它位于 LLM GameObject 中:

您可以通过“Download model”按钮下载模型。

LLM for Unity 内置了多种不同规模的先进模型,并采用 Q4_K_M 方法进行量化。

您也可以从 HuggingFace 下载其他 .gguf 格式的模型。

您可以将模型下载到本地并通过“Load model”按钮加载,或者将 URL 复制到“Download model > Custom URL”字段中直接下载。

如果 HuggingFace 上的模型没有提供 gguf 文件,可以使用此 在线转换工具将其转换为 gguf 格式。

添加到模型管理器中的模型会在构建过程中复制到游戏中。

您可以通过取消选中“Build”复选框来排除某个模型。

要移除模型(但不从磁盘中删除),可以点击垃圾桶按钮。

通过模型管理器展开视图中的 `>>` 按钮,可以显示模型的路径和 URL:

您可以通过选择“Download on Build”选项来创建更轻量级的构建版本。

这样,模型将在游戏首次启动时下载,而不是打包在构建中。

如果您已本地加载模型,则需要通过展开视图设置其 URL,否则该模型仍会被复制到构建中。

❕ 在使用任何模型之前,请务必 检查其许可证 ❕

示例

Samples~ 文件夹包含多个 AI 交互示例 🤖:

- SimpleInteraction:与 AI 角色的简单交互

- MultipleCharacters:使用多个 AI 角色的简单交互

- FunctionCalling:带有 LLM 结构化输出的函数调用示例

- RAG:使用检索增强生成(RAG)系统的语义搜索。包含使用 RAG 向 LLM 提供信息的示例

- MobileDemo:适用于 Android / iOS 的移动应用示例,初始界面显示模型下载进度

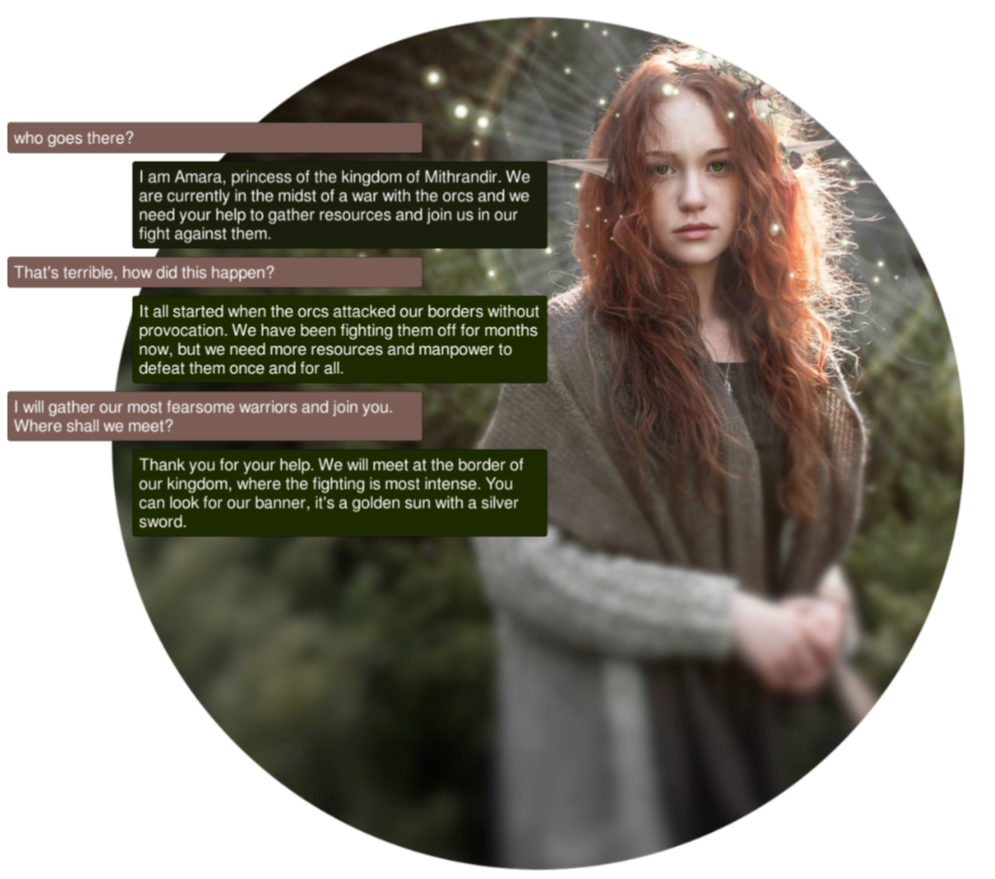

- ChatBot:玩家与 AI 之间的交互,界面类似于消息应用(见下图)

- KnowledgeBaseGame:基于 google/mysteryofthreebots 的简单侦探游戏,利用知识库向 LLM 提供信息

安装示例的方法:

- 打开包管理器:

Window > Package Manager - 选择“LLM for Unity”包,在“Samples”选项卡中,点击您想要安装的示例旁边的“Import”。

这些示例可以直接在其文件夹内包含的 Scene.unity 场景中运行。

在场景中,选择“LLM”GameObject,并指定您选择的 LLM(参见 LLM 模型管理)。

保存场景并运行,尽情体验吧!

许可证

LLM for Unity 的许可证为 Apache 2.0 (LICENSE.md),并使用了采用 MIT 和 Apache 许可证的第三方软件。 资源中包含的部分模型有各自的许可条款,请在使用前仔细阅读。 第三方许可证可在 (Third Party Notices.md) 中找到。

版本历史

v3.0.32026/03/08v3.0.22026/02/27v3.0.12026/01/28v3.0.02026/01/12v2.5.22025/05/29v2.5.12025/05/05v2.5.02025/03/28v2.4.22025/02/19v2.4.12024/12/18v2.4.02024/12/02v2.3.02024/11/04v2.2.42024/09/26v2.2.32024/09/12v2.2.22024/09/08v2.2.12024/08/29v2.2.02024/08/27v2.1.12024/08/13v2.1.02024/08/08v2.0.32024/07/11v2.0.22024/06/26相似工具推荐

openclaw

OpenClaw 是一款专为个人打造的本地化 AI 助手,旨在让你在自己的设备上拥有完全可控的智能伙伴。它打破了传统 AI 助手局限于特定网页或应用的束缚,能够直接接入你日常使用的各类通讯渠道,包括微信、WhatsApp、Telegram、Discord、iMessage 等数十种平台。无论你在哪个聊天软件中发送消息,OpenClaw 都能即时响应,甚至支持在 macOS、iOS 和 Android 设备上进行语音交互,并提供实时的画布渲染功能供你操控。 这款工具主要解决了用户对数据隐私、响应速度以及“始终在线”体验的需求。通过将 AI 部署在本地,用户无需依赖云端服务即可享受快速、私密的智能辅助,真正实现了“你的数据,你做主”。其独特的技术亮点在于强大的网关架构,将控制平面与核心助手分离,确保跨平台通信的流畅性与扩展性。 OpenClaw 非常适合希望构建个性化工作流的技术爱好者、开发者,以及注重隐私保护且不愿被单一生态绑定的普通用户。只要具备基础的终端操作能力(支持 macOS、Linux 及 Windows WSL2),即可通过简单的命令行引导完成部署。如果你渴望拥有一个懂你

stable-diffusion-webui

stable-diffusion-webui 是一个基于 Gradio 构建的网页版操作界面,旨在让用户能够轻松地在本地运行和使用强大的 Stable Diffusion 图像生成模型。它解决了原始模型依赖命令行、操作门槛高且功能分散的痛点,将复杂的 AI 绘图流程整合进一个直观易用的图形化平台。 无论是希望快速上手的普通创作者、需要精细控制画面细节的设计师,还是想要深入探索模型潜力的开发者与研究人员,都能从中获益。其核心亮点在于极高的功能丰富度:不仅支持文生图、图生图、局部重绘(Inpainting)和外绘(Outpainting)等基础模式,还独创了注意力机制调整、提示词矩阵、负向提示词以及“高清修复”等高级功能。此外,它内置了 GFPGAN 和 CodeFormer 等人脸修复工具,支持多种神经网络放大算法,并允许用户通过插件系统无限扩展能力。即使是显存有限的设备,stable-diffusion-webui 也提供了相应的优化选项,让高质量的 AI 艺术创作变得触手可及。

everything-claude-code

everything-claude-code 是一套专为 AI 编程助手(如 Claude Code、Codex、Cursor 等)打造的高性能优化系统。它不仅仅是一组配置文件,而是一个经过长期实战打磨的完整框架,旨在解决 AI 代理在实际开发中面临的效率低下、记忆丢失、安全隐患及缺乏持续学习能力等核心痛点。 通过引入技能模块化、直觉增强、记忆持久化机制以及内置的安全扫描功能,everything-claude-code 能显著提升 AI 在复杂任务中的表现,帮助开发者构建更稳定、更智能的生产级 AI 代理。其独特的“研究优先”开发理念和针对 Token 消耗的优化策略,使得模型响应更快、成本更低,同时有效防御潜在的攻击向量。 这套工具特别适合软件开发者、AI 研究人员以及希望深度定制 AI 工作流的技术团队使用。无论您是在构建大型代码库,还是需要 AI 协助进行安全审计与自动化测试,everything-claude-code 都能提供强大的底层支持。作为一个曾荣获 Anthropic 黑客大奖的开源项目,它融合了多语言支持与丰富的实战钩子(hooks),让 AI 真正成长为懂上

ComfyUI

ComfyUI 是一款功能强大且高度模块化的视觉 AI 引擎,专为设计和执行复杂的 Stable Diffusion 图像生成流程而打造。它摒弃了传统的代码编写模式,采用直观的节点式流程图界面,让用户通过连接不同的功能模块即可构建个性化的生成管线。 这一设计巧妙解决了高级 AI 绘图工作流配置复杂、灵活性不足的痛点。用户无需具备编程背景,也能自由组合模型、调整参数并实时预览效果,轻松实现从基础文生图到多步骤高清修复等各类复杂任务。ComfyUI 拥有极佳的兼容性,不仅支持 Windows、macOS 和 Linux 全平台,还广泛适配 NVIDIA、AMD、Intel 及苹果 Silicon 等多种硬件架构,并率先支持 SDXL、Flux、SD3 等前沿模型。 无论是希望深入探索算法潜力的研究人员和开发者,还是追求极致创作自由度的设计师与资深 AI 绘画爱好者,ComfyUI 都能提供强大的支持。其独特的模块化架构允许社区不断扩展新功能,使其成为当前最灵活、生态最丰富的开源扩散模型工具之一,帮助用户将创意高效转化为现实。

gemini-cli

gemini-cli 是一款由谷歌推出的开源 AI 命令行工具,它将强大的 Gemini 大模型能力直接集成到用户的终端环境中。对于习惯在命令行工作的开发者而言,它提供了一条从输入提示词到获取模型响应的最短路径,无需切换窗口即可享受智能辅助。 这款工具主要解决了开发过程中频繁上下文切换的痛点,让用户能在熟悉的终端界面内直接完成代码理解、生成、调试以及自动化运维任务。无论是查询大型代码库、根据草图生成应用,还是执行复杂的 Git 操作,gemini-cli 都能通过自然语言指令高效处理。 它特别适合广大软件工程师、DevOps 人员及技术研究人员使用。其核心亮点包括支持高达 100 万 token 的超长上下文窗口,具备出色的逻辑推理能力;内置 Google 搜索、文件操作及 Shell 命令执行等实用工具;更独特的是,它支持 MCP(模型上下文协议),允许用户灵活扩展自定义集成,连接如图像生成等外部能力。此外,个人谷歌账号即可享受免费的额度支持,且项目基于 Apache 2.0 协议完全开源,是提升终端工作效率的理想助手。

markitdown

MarkItDown 是一款由微软 AutoGen 团队打造的轻量级 Python 工具,专为将各类文件高效转换为 Markdown 格式而设计。它支持 PDF、Word、Excel、PPT、图片(含 OCR)、音频(含语音转录)、HTML 乃至 YouTube 链接等多种格式的解析,能够精准提取文档中的标题、列表、表格和链接等关键结构信息。 在人工智能应用日益普及的今天,大语言模型(LLM)虽擅长处理文本,却难以直接读取复杂的二进制办公文档。MarkItDown 恰好解决了这一痛点,它将非结构化或半结构化的文件转化为模型“原生理解”且 Token 效率极高的 Markdown 格式,成为连接本地文件与 AI 分析 pipeline 的理想桥梁。此外,它还提供了 MCP(模型上下文协议)服务器,可无缝集成到 Claude Desktop 等 LLM 应用中。 这款工具特别适合开发者、数据科学家及 AI 研究人员使用,尤其是那些需要构建文档检索增强生成(RAG)系统、进行批量文本分析或希望让 AI 助手直接“阅读”本地文件的用户。虽然生成的内容也具备一定可读性,但其核心优势在于为机器