autoresearch

autoresearch 是一款能将 Claude Code 转化为“自动进化引擎”的开源技能。它灵感源自 Andrej Karpathy 的 autoresearch 项目,旨在通过自主循环迭代,帮助用户在任何可量化的领域实现持续优化。

传统开发或优化过程往往依赖人工反复试错,效率低且容易中断。autoresearch 解决了这一痛点,它确立目标与核心指标后,能自动执行“修改→验证→保留或回滚”的闭环流程。系统会基于历史结果智能选择下一步操作,每次仅做一个聚焦的改动,若验证通过则提交,若效果变差则自动撤销,确保进步层层累积而不会倒退。

这款工具特别适合开发者、数据科学家、运维工程师以及任何希望通过数据驱动方式优化代码、营销策略或业务流程的专业人士。无论是机器学习模型调优、代码重构,还是内容生成优化,只要你有明确的衡量指标,它都能发挥作用。

其独特亮点在于将复杂的自动化探索简化为机械式的可靠循环:利用 Git 作为记忆库记录每一次尝试,支持自动回滚错误操作,并能全天候无人值守运行。你只需设定好目标和评分标准,剩下的交给 autoresearch 日夜不停地迭代,醒来即可收获优化成果。它证明了无需通用人工智能(AGI),仅需明确的目标、指标和不知疲倦的循环,就能产生复利般的增益效果。

使用场景

某电商初创团队的后端工程师需要在周五下班前,将订单推荐算法的响应延迟从 200ms 优化至 100ms 以内,同时确保单元测试通过率保持 100%。

没有 autoresearch 时

- 工程师只能凭经验手动修改代码,每次调整后需人工运行测试,耗时且容易遗漏边界情况。

- 遇到性能回退时,往往需要翻阅大量 Git 记录才能定位是哪次提交导致了问题,排查效率极低。

- 由于精力有限,一天仅能尝试 3-5 种优化方案,难以覆盖更多潜在的最优解空间。

- 深夜疲劳作战容易导致判断失误,可能误将带有隐蔽 Bug 的代码合并到主分支。

- 缺乏系统性的实验记录,无法量化对比不同优化策略的实际收益,决策依赖直觉。

使用 autoresearch 后

- 设定“延迟低于 100ms"为目标和自动化测试为指标后,autoresearch 自动执行“修改 - 验证 - 保留/回滚”循环,无需人工干预。

- 一旦某次修改导致测试失败或性能下降,工具立即自动 Git 回滚并记录原因,确保持续集成环境始终稳定。

- 整夜可自主完成上百次迭代实验,快速遍历各种参数组合与重构方案,挖掘出人类难以想到的优化路径。

- 所有实验结果自动生成 TSV 日志,清晰展示每次尝试的得失,让团队次日直接基于数据决策而非猜测。

- 工程师只需定义初始范围和约束,即可安心休息,醒来时直接获得经过充分验证的最优代码版本。

核心价值在于将繁琐的试错过程转化为无人值守的自动化增益引擎,让开发者从重复劳动中解放出来专注于架构设计。

运行环境要求

- Linux

- macOS

- Windows

未说明

未说明

快速开始

Claude 自动研究

将 Claude Code 转化为一个不懈改进的引擎。

基于 Karpathy 的 autoresearch — 约束 + 机械指标 + 自主迭代 = 复利式增长。

“设定目标 → Claude 执行循环 → 你醒来时已有成果”

你不需要 AGI。你需要的是一个目标、一个指标,以及永不停歇的循环。

计划 循环 调试 修复 安全 发布

┌──────────┐ ┌──────────┐ ┌──────────┐ ┌──────────┐ ┌──────────┐ ┌──────────┐

│ 目标 │ │ 修改 │ │ 查找 │ │ 修复 │ │ STRIDE │ │ 阶段 │

│ 指标 │────▶│ 验证 │────▶│ 缺陷 │────▶│ 错误 │────▶│ OWASP │────▶│ 部署 │

│ 范围 │ │ 保留/ │ └──────────┘ └──────────┘ │ 团队 │ └──────────┘

/autoresearch: └──────────┘ /autoresearch: /autoresearch: └──────────┘ /autoresearch:

计划 /autoresearch 调试 修复 /autoresearch: 发布

安全

┌──────────┐ ┌──────────┐ ┌──────────┐ ┌──────────┐

│ 场景 │ │ 预测 │ │ 学习 │ │ 推理 │

│ 边缘 │ │ 5位专家 │ │ 文档 │ │ 辩论 │

│ 案例 │ │ 群体 │ │ 生成 │ │ 收敛 │

└──────────┘ └──────────┘ └──────────┘ └──────────┘

/autoresearch: /autoresearch: /autoresearch: /autoresearch:

场景 预测 学习 推理

为何存在

Karpathy 的 autoresearch 证明,仅用一段 630 行的 Python 脚本,就能在遵循简单原则的情况下——单一指标、受限范围、快速验证、自动回滚、以 Git 作为记忆——实现机器学习模型的自主优化,每晚完成 100 次实验。

Claude Autoresearch 将这些原则推广到任何领域。 不仅限于机器学习——代码、内容、营销、销售、人力资源、DevOps,或任何可量化的事物。

工作原理

循环(无限次或 N 次):

1. 回顾当前状态 + Git 历史 + 结果日志

2. 根据成功、失败和未尝试过的方案,选择下一次改动

3. 进行一次专注的改动

4. 在验证前提交 Git 提交

5. 执行机械验证(测试、基准测试、评分)

6. 若有改进 → 保留;若变差 → Git 回滚;若崩溃 → 修复或跳过。

7. 记录结果

8. 重复。除非你中断,否则永不结束(或直到完成 N 次迭代)。

每一次改进都会叠加。每次失败都会自动回滚。进展会以 TSV 格式记录。

设置阶段

在进入循环之前,Claude 会进行一次性设置:

- 读取上下文 — 读取所有相关文件

- 定义目标 — 提取或询问一个可量化的指标

- 定义范围 — 哪些文件可以修改,哪些只读

- 建立基线 — 对当前状态进行验证(第 0 次迭代)

- 确认并开始 — 展示设置后,开始循环

8 条关键规则

| 序号 | 规则 |

|---|---|

| 1 | 循环直至完成 — 无限制:永远持续。有限制:N 次后总结 |

| 2 | 先读后写 — 在修改之前充分理解上下文 |

| 3 | 每次迭代一次改动 — 原子级变更。若出错,便知原因 |

| 4 | 仅进行机械验证 — 不依赖主观“看起来不错”。使用指标 |

| 5 | 自动回滚 — 失败的更改会立即回滚 |

| 6 | 越简单越好 — 在效果相同的情况下,代码越少越保留 |

| 7 | Git 是记忆 — 实验以 experiment: 为前缀提交,git revert 会将失败的实验保留在历史中,代理在每次迭代前必须阅读 git log 和 git diff |

| 8 | 卡住时,再深入思考 — 重新阅读、结合接近成功的尝试、尝试激进的改变 |

命令

| 命令 | 功能 |

|---|---|

/autoresearch |

运行自主迭代循环(无限次) |

Iterations: N |

添加到内联配置,运行恰好 N 次迭代后停止 |

/autoresearch:plan |

交互式向导:目标 → 范围、指标、验证配置 |

/autoresearch:security |

自主 STRIDE + OWASP + 红队安全审计 |

/autoresearch:ship |

通用发布流程(代码、内容、营销、销售、研究、设计) |

/autoresearch:debug |

自主漏洞挖掘循环 — 科学方法 + 迭代式调查 |

/autoresearch:fix |

自主修复循环 — 迭代修复错误,直至全部解决 |

/autoresearch:scenario |

场景驱动的用例生成器 — 探索各种情况、边缘案例及衍生场景 |

/autoresearch:predict |

多角色预测 |

/autoresearch:learn |

自主文档生成引擎 — 搜集代码库信息,生成/更新文档,验证并修复 |

/autoresearch:reason |

对抗性优化 — 通过隔离的多智能体辩论,让盲评小组对主观内容达成共识 |

Guard: <command> |

可选的安全网 — 必须通过才能保留更改 |

所有命令在未提供参数时,都会使用 AskUserQuestion 进行交互式设置。 只需输入命令,Claude 会根据你的代码库,逐步询问你需要的内容,并提供智能默认值。高级用户可以直接在命令中添加标志来跳过向导。

快速决策指南

| 我想... | 使用 |

|---|---|

| 提高测试覆盖率 / 减少打包体积 / 任何指标 | /autoresearch(对于有限次运行,添加 Iterations: N) |

| 不知道该使用什么指标 | /autoresearch:plan |

| 运行安全审计 | /autoresearch:security |

| 发布 PR / 部署 / 版本 | /autoresearch:ship |

| 在不破坏现有测试的情况下优化 | 添加 Guard: npm test |

| 搜索代码库中的所有 bug | /autoresearch:debug(对于有限次运行,添加 Iterations: 20) |

| 修复所有错误(测试、类型检查、lint) | /autoresearch:fix |

| 先调试再自动修复 | /autoresearch:debug --fix |

| 检查某项内容是否已准备好发布 | /autoresearch:ship --checklist-only |

| 探索某个功能的边界情况 | /autoresearch:scenario |

| 生成测试场景 | /autoresearch:scenario --domain software --format test-scenarios |

| 对用户流程进行压力测试 | /autoresearch:scenario --depth deep |

| 在开始前想要专家意见 | /autoresearch:predict |

| 从多个角度分析 | /autoresearch:predict --chain debug |

| 为新代码库生成文档 | /autoresearch:learn --mode init |

| 更新变更后的现有文档 | /autoresearch:learn --mode update |

| 检查文档是否过时 | /autoresearch:learn --mode check |

| 讨论架构决策 | /autoresearch:reason --domain software |

| 以对抗性方式完善提案或方案 | /autoresearch:reason --domain business |

| 先达成最佳设计共识再进行验证 | /autoresearch:reason --chain predict |

快速入门

1. 安装

选项 A — 插件安装(推荐):

在 Claude Code 中运行:

/plugin marketplace add uditgoenka/autoresearch

/plugin install autoresearch@autoresearch

完成!重启 Claude Code 后,所有 10 条命令即可使用。

注意: 安装后请启动一个新的 Claude Code 会话。在同一会话中无法解析引用文件——这是 Claude Code 平台的限制。

更新(无需重新安装):

/plugin update autoresearch

这将拉取最新版本。运行 /reload-plugins 即可激活,无需卸载或重新克隆。

选项 B — 手动复制:

git clone https://github.com/uditgoenka/autoresearch.git

# 将技能及子命令复制到您的项目中

cp -r autoresearch/claude-plugin/skills/autoresearch .claude/skills/autoresearch

cp -r autoresearch/claude-plugin/commands/autoresearch .claude/commands/autoresearch

cp autoresearch/claude-plugin/commands/autoresearch.md .claude/commands/autoresearch.md

或者全局安装:

cp -r autoresearch/claude-plugin/skills/autoresearch ~/.claude/skills/autoresearch

cp -r autoresearch/claude-plugin/commands/autoresearch ~/.claude/commands/autoresearch

cp autoresearch/claude-plugin/commands/autoresearch.md ~/.claude/commands/autoresearch.md

注意:

commands/目录是使子命令(如/autoresearch:ship、/autoresearch:plan、/autoresearch:security)正常运行所必需的。

2. 运行它

/autoresearch

目标:将测试覆盖率从 72% 提升至 90%

范围:src/**/*.test.ts, src/**/*.ts

指标:覆盖率 %(越高越好)

验证:npm test -- --coverage | grep "All files"

3. 离开

Claude 会读取所有文件,建立基线并开始迭代——每次只做一次更改。保留改进,自动回滚失败,并记录所有操作。除非您中断,否则不会停止(或直到达到设定的迭代次数)。

/autoresearch:plan — 目标 → 配置向导

最难的部分不是循环本身,而是正确地定义范围、指标和验证步骤。/autoresearch:plan 可以将您的自然语言目标转化为经过验证、可直接执行的配置。

/autoresearch:plan

目标:让 API 响应更快

向导会引导您完成 5 个步骤:捕捉目标 → 定义范围 → 定义指标 → 定义方向 → 验证验证命令(干运行)。每个环节都有严格的要求——范围必须能解析为文件,指标必须输出一个数字,验证必须通过干运行。

/autoresearch:security — 自主安全审计

基于 STRIDE 威胁建模、OWASP Top 10 检查以及红队对抗性分析(使用 4 种敌对角色)的只读安全审计。

/autoresearch:security

迭代次数:10

它的工作方式: 代码库侦察 → 资产清单 → 信任边界 → STRIDE 威胁模型 → 攻击面地图 → 自主测试循环 → 结构化报告。

每个发现都需提供 代码证据(文件:行 + 攻击场景)。不含任何理论上的空谈。

| 标志 | 用途 |

|---|---|

--diff |

仅审计自上次审计以来更改的文件 |

--fix |

自动修复确认的严重/高危问题 |

--fail-on <severity> |

如果出现指定级别的问题,则退出非零状态,用于 CI/CD 门控 |

输出: 创建 security/{日期}-{slug}/ 文件夹,包含 7 个结构化的报告文件。

/autoresearch:ship — 通用发布工作流

通过 8 个阶段发布任何内容:识别 → 清点 → 检查清单 → 准备 → 干运行 → 发布 → 验证 → 日志记录。

/autoresearch:ship --auto

它可以自动检测您要发布的对象(代码 PR、部署、博客文章、邮件营销活动、销售演示文稿、研究论文、设计资产),并生成特定领域的检查清单——每项内容均可机械验证。

| 标志 | 用途 |

|---|---|

--dry-run |

验证所有内容但不实际发布 |

--auto |

如果检查清单通过则自动批准 |

--force |

跳过非关键项(但仍强制执行关键项) |

--rollback |

撤销上一次发布操作 |

--monitor N |

发布后监控 N 分钟 |

--type <type> |

覆盖自动检测结果 |

--checklist-only |

仅检查准备情况 |

支持的类型: code-pr、code-release、deployment、content、marketing-email、marketing-campaign、sales、research、design。

/autoresearch:debug — 自主 Bug 搜寻器(v1.3.0)

科学方法与 autoresearch 循环相结合。它不会只找到一个 bug——而是通过可证伪的假设、基于证据的调查以及 7 种调查技术,迭代式地搜寻所有 bugs。

/autoresearch:debug

范围:src/api/**/*.ts

症状:API 在 POST /users 请求时返回 500 错误

迭代次数:20

工作原理: 收集症状 → 侦察(绘制错误表面) → 提出假设(具体且可测试) → 测试(每次迭代进行一项实验) → 分类(确认/证伪/不确定) → 记录 → 重复。

每个发现都需要 代码证据(文件:行 + 复现步骤)。所有被证伪的假设都会被记录下来——同样具有价值。它使用 7 种技术:二分查找、差异调试、最小化复现、跟踪执行、模式搜索、逆向推理、橡皮鸭法。

| 标志 | 用途 |

|---|---|

--fix |

搜寻完成后自动切换到 /autoresearch:fix |

--scope <glob> |

限制调查范围 |

--symptom "<text>" |

预先填写症状 |

--severity <level> |

最低报告级别 |

/autoresearch:fix — 自主错误修复器(v1.3.0)

接收一个存在错误的状态,并通过迭代逐步修复,直到所有问题都解决。每次迭代仅修复一处。操作具有原子性、提交后会验证,若失败则自动回滚。

/autoresearch:fix

工作原理: 自动检测哪些部分存在问题(测试、类型检查、代码风格检查、构建)→ 按优先级排序(阻塞问题优先)→ 修复其中一处 → 提交 → 验证错误数量是否减少 → 安全检查(确保无回归)→ 继续或回滚 → 重复此过程,直至错误数为零。

当错误数降为零时自动停止 — 即使在无界模式下也是如此。

| 标志 | 用途 |

|---|---|

--target <command> |

显式验证命令 |

--guard <command> |

必须始终通过的安全检查命令 |

--category <type> |

仅修复特定类型的错误(测试、类型检查、代码风格检查、构建) |

--from-debug |

从最近的调试会话中读取发现的问题 |

串联使用: 先运行 /autoresearch:debug 并设置 Iterations: 15,再运行 /autoresearch:fix --from-debug 并设置 Iterations: 30。

/autoresearch:learn — 自主文档生成引擎

扫描代码库 → 生成文档 → 验证 → 修复 → 重复。提供四种模式:init(从零开始创建)、update(更新现有文档)、check(只读健康报告)、summarize(快速概览)。

/autoresearch:learn --mode init --depth deep

动态发现文档(扫描 docs/*.md 文件),自动检测项目类型,进行验证-修复循环(最多重试三次),根据规模调整扫描范围,利用 git-diff 确定更新范围,支持通过 --file 选择性更新单个文档。自动生成 Mermaid 架构图、条件化文档(API 参考、测试指南、配置指南、变更日志)、文档间的交叉引用链接以及依赖关系文档。支持 --format 参数以输出其他格式。

/autoresearch:predict — 多角色预测(v1.7.0)

在调试、修复或发布之前——两分钟内获取五位专家的观点。

/autoresearch:predict 模拟一支由架构师、安全分析师、性能工程师、可靠性工程师和“魔鬼代言人”组成的专家团队,他们独立分析你的代码,讨论发现并达成共识。其输出可直接串联到其他任何命令:

/autoresearch:predict --chain debug— 在调试前对假设进行预排名/autoresearch:predict --chain security— 多角色红队分析/autoresearch:predict --chain scenario,debug,fix— 完整的质量流程

/autoresearch:reason — 对抗式优化(v1.9.0)

将 autoresearch 扩展至主观领域,即不存在客观度量标准的场景。盲评小组本身就是适应度函数——它用于评估架构决策、产品战略、内容质量和设计讨论等。

/autoresearch:reason

任务:我们的订单管理系统是否应采用事件溯源?

领域:软件

迭代次数:8

工作原理: 生成 A → 批评者提出攻击性观点(稻草人论证)→ 作者 B 回应 → 合成器整合 → 盲评小组(随机打标签)选出胜者 → 胜者成为新的 A → 重复此过程,直至收敛。

关键不变性: 每个参与者都是全新启动的独立调用——无共享会话,无历史信息泄露。评委永远不会看到 A/B/AB 的标签,只会看到 X/Y/Z。

| 标志 | 用途 |

|---|---|

--iterations N |

有界模式——精确执行 N 轮 |

--judges N |

评委人数(3–7 人,建议奇数) |

--convergence N |

连续获胜达到收敛的次数(默认:3) |

--mode <mode> |

收敛模式(默认)、创意模式、辩论模式 |

--domain <type> |

软件、产品、业务、安全、研究、内容等领域 |

--chain <targets> |

将收敛后的结果串联到任何 autoresearch 命令 |

串联模式: reason → predict(先收敛再压力测试)、reason → plan,fix(先收敛再实施)、reason → scenario(先收敛再探索边界情况)。

输出: 创建 reason/{date}-{slug}/ 目录,包含 lineage.md、candidates.md、judge-transcripts.md、reason-results.tsv 和 handoff.json。

/autoresearch:scenario — 场景探索器(v1.6.0)

自主场景探索引擎。以一个初始场景为起点,按 12 个维度迭代生成各种情境——正常路径、错误场景、边界情况、滥用、规模、并发、时间相关、数据变化、权限、集成、恢复以及状态转换。

/autoresearch:scenario

场景:用户尝试使用多种支付方式结账

迭代次数:25

工作原理: 分析初始场景 → 分解为 12 个维度 → 每次迭代生成一种情境 → 分类(新情境/变体/重复)→ 拓展边界情况 → 记录 → 重复此过程,直至所有维度都被探索完毕。

自适应设置:根据你提供的上下文信息,系统会提出 4–8 个问题。只需输入 /autoresearch:scenario,无需其他参数,系统便会引导你完成整个流程。

| 标志 | 用途 |

|---|---|

--domain <type> |

领域:软件、产品、业务、安全、营销 |

--depth <level> |

深度:浅层(10)、标准(25)、深层(50+) |

--format <type> |

输出格式:用例、用户故事、测试场景、威胁场景 |

--focus <area> |

优先处理:边界情况、失败场景、安全问题、规模相关问题 |

--scope <glob> |

限制于特定文件或功能 |

支持 5 种领域,并针对不同领域定制维度优先级和输出格式。可与 /autoresearch:debug 串联,以在发现的边界情况下查找 bug;或与 /autoresearch:security 串联,以审计发现的威胁场景。

Guard — 防止回归(v1.0.4)

在优化某个指标时,循环可能会破坏现有行为。Guard 是一个可选的安全保障机制。

/autoresearch

目标:将 API 响应时间降至 100ms 以下

验证:npm run bench:api | grep "p95"

Guard:npm test

- Verify = “指标是否改善了?”(目标)

- Guard = “是否有其他部分被破坏了?”(安全保障)

如果指标改善但安全检查未通过,Claude 会重新调整优化方案(最多尝试两次)。安全检查或测试文件绝不会被修改。

结果跟踪

每一轮迭代都会以 TSV 格式记录:

iteration commit metric delta status description

0 a1b2c3d 85.2 0.0 baseline 初始状态

1 b2c3d4e 87.1 +1.9 keep 添加认证边界情况的测试

2 - 86.5 -0.6 discard 重构测试辅助工具(导致 2 个测试失败)

3 c3d4e5f 88.3 +1.2 keep 添加错误处理测试

每 10 次迭代,Claude 会打印一次进度摘要。有界循环会在最后打印一份包含基线与当前最佳结果的总结。

故障恢复

| 故障 | 应对措施 |

|---|---|

| 语法错误 | 立即修复,不计入迭代次数 |

| 运行时错误 | 尝试修复(最多 3 次),然后继续 |

| 资源耗尽 | 回滚,尝试较小的变体 |

| 无限循环/卡死 | 超时后终止进程,回滚 |

| 外部依赖问题 | 跳过,记录日志,尝试其他方法 |

仓库结构

autoresearch/

├── README.md

├── COMPARISON.md ← Karpathy 的 Autoresearch 与 Claude Autoresearch 的对比

├── guide/ ← 综合指南 — 每个命令对应一篇,另加高级模式

│ ├── README.md ← 指南索引

│ ├── getting-started.md ← 安装、核心概念、常见问题解答

│ ├── autoresearch.md ← 自主循环

│ ├── autoresearch-plan.md ← 设置向导

│ ├── autoresearch-debug.md ← 捕捉错误

│ ├── autoresearch-fix.md ← 修复错误

│ ├── autoresearch-security.md ← 安全审计员

│ ├── autoresearch-ship.md ← 发布工作流

│ ├── autoresearch-scenario.md ← 场景探索者

│ ├── autoresearch-predict.md ← 多角色群体预测

│ ├── autoresearch-learn.md ← 文档生成引擎

│ ├── autoresearch-reason.md ← 对抗性优化

│ ├── chains-and-combinations.md ← 多命令流水线

│ ├── examples-by-domain.md ← 按领域划分的真实场景示例

│ ├── advanced-patterns.md ← 防护机制、MCP、CI/CD、常见问题解答

│ └── scenario/ ← 10 个真实场景操作指南

│ ├── README.md ← 场景指南索引

│ ├── real-time-chat-messaging.md

│ ├── multi-tenant-saas-onboarding.md

│ ├── cicd-pipeline-deployment.md

│ ├── healthcare-appointment-scheduling.md

│ ├── social-media-content-moderation.md

│ ├── iot-firmware-updates.md

│ ├── document-collaboration.md

│ ├── cross-border-wire-transfers.md

│ ├── search-autocomplete.md

│ ├── mobile-push-notifications.md

│ └── adversarial-architecture-decisions.md

├── LICENSE

├── .claude-plugin/

│ └── marketplace.json ← 插件市场清单(来源:./claude-plugin)

├── claude-plugin/ ← 分发包(用户安装的内容)

│ ├── .claude-plugin/

│ │ └── plugin.json ← 插件元数据 + 版本

│ ├── commands/

│ │ ├── autoresearch.md ← 主命令 /autoresearch

│ │ └── autoresearch/

│ │ ├── ship.md ← /autoresearch:ship 注册

│ │ ├── plan.md ← /autoresearch:plan 注册

│ │ ├── security.md ← /autoresearch:security 注册

│ │ ├── debug.md ← /autoresearch:debug 注册

│ │ ├── fix.md ← /autoresearch:fix 注册

│ │ ├── scenario.md ← /autoresearch:scenario 注册

│ │ ├── predict.md ← /autoresearch:predict 注册

│ │ ├── learn.md ← /autoresearch:learn 注册

│ │ └── reason.md ← /autoresearch:reason 注册

│ └── skills/

│ └── autoresearch/

│ ├── SKILL.md ← 主技能(由 Claude Code 加载)

│ └── references/

│ ├── autonomous-loop-protocol.md ← 8 阶段循环协议

│ ├── core-principles.md ← 7 条通用原则

│ ├── plan-workflow.md ← 计划向导协议

│ ├── security-workflow.md ← 安全审计协议

│ ├── ship-workflow.md ← 发布工作流协议

│ ├── debug-workflow.md ← 调试循环协议

│ ├── fix-workflow.md ← 修复循环协议

│ ├── scenario-workflow.md ← 场景探索协议

│ ├── predict-workflow.md ← 多角色群体预测协议

│ ├── learn-workflow.md ← 文档生成引擎协议

│ ├── reason-workflow.md ← 对抗性优化协议

│ └── results-logging.md ← TSV 格式跟踪记录

常见问题解答

问:我不知道该使用什么指标。

答:运行 /autoresearch:plan — 它会分析你的代码库,建议合适的指标,并在你正式开始之前先进行一次验证命令的试运行。

问:这个工具适用于任何项目吗?

答:是的。无论语言、框架或领域,都可以使用。你可以通过 /plugin marketplace add uditgoenka/autoresearch 进行安装,或者手动从 claude-plugin/ 目录中复制。

问:如何停止循环?

答:按 Ctrl+C 即可停止,或者在内联配置中添加 Iterations: N 来指定只运行 N 次迭代。Claude 会在验证之前提交更改,因此你的最后一次成功状态始终会保存在 Git 中。

问:我可以用它处理非代码任务吗? 答:当然可以。销售邮件、营销文案、人力资源政策、操作手册等,只要能设定可衡量的指标即可。更多信息请参阅 按领域划分的示例。

问:/autoresearch:security 会修改我的代码吗?

答:不会。它是只读模式——仅分析代码并生成结构化报告。如果需要自动修复已确认的严重或高危问题,可以使用 --fix 参数。

问:我可以使用 MCP 服务器吗? 答:可以。任何在 Claude Code 中配置的 MCP 服务器都可以在循环过程中用于数据库查询、API 调用、数据分析等。详情请参阅 高级模式。

问:/autoresearch:predict 和 /autoresearch:reason 有什么区别? 答:Predict 是一次性分析——5 位专家会针对你现有的代码展开讨论。而 Reason 则是一个迭代优化的循环过程——系统会生成多个候选方案,经过评审、整合和盲评等多个轮次,直到结果趋于一致。建议在需要行动前使用 Predict 进行分析;而在缺乏客观指标的情况下做决策时,则应使用 Reason。

参与贡献

欢迎贡献!详情请参阅 CONTRIBUTING.md。

感兴趣的领域:新的领域示例、验证脚本模板、CI/CD 集成、实际基准测试。所有指南都位于 guide/ 文件夹中。

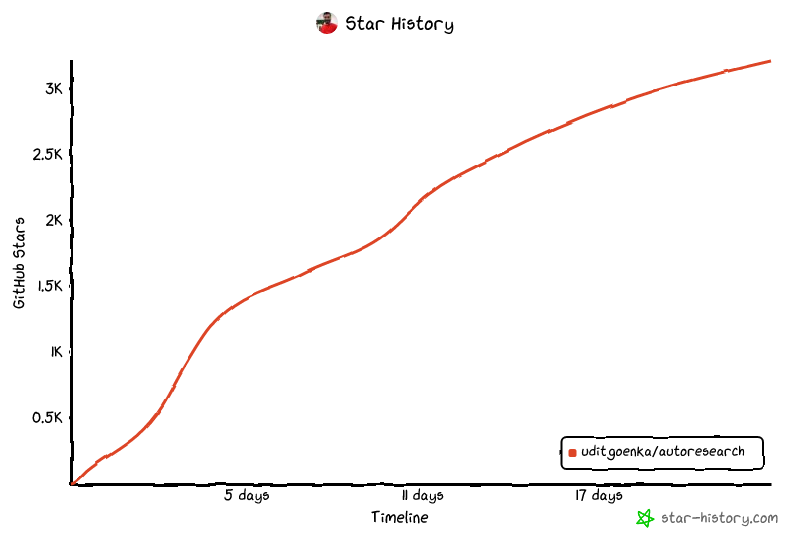

星标历史

许可证

MIT — 详见 LICENSE。

致谢

- Andrej Karpathy — 感谢 autoresearch

- Anthropic — 感谢 Claude Code 以及技能系统

关于作者

Udit Goenka — AI 产品专家、创始人兼天使投资人

一位自学成才的创业者,从印度那里的慢速网络起步,最终创立了多家公司,并帮助超过700家初创企业累计创造了逾2500万美元的收入。

创建的企业: TinyCheque(印度首家代理式 AI 创业工作室)· Firstsales.io(销售自动化平台)

投资方面: 已支持38家初创企业,其中6家成功退出。专注于早期阶段的AI和SaaS领域。

联系方式: udit.co · @iuditg · @uditgoenka · 博客

“当您限制任务范围、明确成功标准、实现验证流程的自动化,并让智能体负责优化执行策略、而人类专注于战略规划时,自主性才能真正规模化。”

版本历史

v1.9.02026/03/31v1.8.22026/03/21v1.8.12026/03/21v1.8.02026/03/20v1.7.62026/03/20v1.7.52026/03/19v1.7.42026/03/19v1.7.32026/03/18v1.7.22026/03/18v1.7.12026/03/18v1.7.02026/03/18v1.6.22026/03/17v1.6.12026/03/17v1.6.02026/03/17v1.5.02026/03/17v1.4.02026/03/17v1.3.32026/03/16v1.3.22026/03/16v1.3.12026/03/16v1.3.02026/03/16相似工具推荐

openclaw

OpenClaw 是一款专为个人打造的本地化 AI 助手,旨在让你在自己的设备上拥有完全可控的智能伙伴。它打破了传统 AI 助手局限于特定网页或应用的束缚,能够直接接入你日常使用的各类通讯渠道,包括微信、WhatsApp、Telegram、Discord、iMessage 等数十种平台。无论你在哪个聊天软件中发送消息,OpenClaw 都能即时响应,甚至支持在 macOS、iOS 和 Android 设备上进行语音交互,并提供实时的画布渲染功能供你操控。 这款工具主要解决了用户对数据隐私、响应速度以及“始终在线”体验的需求。通过将 AI 部署在本地,用户无需依赖云端服务即可享受快速、私密的智能辅助,真正实现了“你的数据,你做主”。其独特的技术亮点在于强大的网关架构,将控制平面与核心助手分离,确保跨平台通信的流畅性与扩展性。 OpenClaw 非常适合希望构建个性化工作流的技术爱好者、开发者,以及注重隐私保护且不愿被单一生态绑定的普通用户。只要具备基础的终端操作能力(支持 macOS、Linux 及 Windows WSL2),即可通过简单的命令行引导完成部署。如果你渴望拥有一个懂你

stable-diffusion-webui

stable-diffusion-webui 是一个基于 Gradio 构建的网页版操作界面,旨在让用户能够轻松地在本地运行和使用强大的 Stable Diffusion 图像生成模型。它解决了原始模型依赖命令行、操作门槛高且功能分散的痛点,将复杂的 AI 绘图流程整合进一个直观易用的图形化平台。 无论是希望快速上手的普通创作者、需要精细控制画面细节的设计师,还是想要深入探索模型潜力的开发者与研究人员,都能从中获益。其核心亮点在于极高的功能丰富度:不仅支持文生图、图生图、局部重绘(Inpainting)和外绘(Outpainting)等基础模式,还独创了注意力机制调整、提示词矩阵、负向提示词以及“高清修复”等高级功能。此外,它内置了 GFPGAN 和 CodeFormer 等人脸修复工具,支持多种神经网络放大算法,并允许用户通过插件系统无限扩展能力。即使是显存有限的设备,stable-diffusion-webui 也提供了相应的优化选项,让高质量的 AI 艺术创作变得触手可及。

everything-claude-code

everything-claude-code 是一套专为 AI 编程助手(如 Claude Code、Codex、Cursor 等)打造的高性能优化系统。它不仅仅是一组配置文件,而是一个经过长期实战打磨的完整框架,旨在解决 AI 代理在实际开发中面临的效率低下、记忆丢失、安全隐患及缺乏持续学习能力等核心痛点。 通过引入技能模块化、直觉增强、记忆持久化机制以及内置的安全扫描功能,everything-claude-code 能显著提升 AI 在复杂任务中的表现,帮助开发者构建更稳定、更智能的生产级 AI 代理。其独特的“研究优先”开发理念和针对 Token 消耗的优化策略,使得模型响应更快、成本更低,同时有效防御潜在的攻击向量。 这套工具特别适合软件开发者、AI 研究人员以及希望深度定制 AI 工作流的技术团队使用。无论您是在构建大型代码库,还是需要 AI 协助进行安全审计与自动化测试,everything-claude-code 都能提供强大的底层支持。作为一个曾荣获 Anthropic 黑客大奖的开源项目,它融合了多语言支持与丰富的实战钩子(hooks),让 AI 真正成长为懂上

ComfyUI

ComfyUI 是一款功能强大且高度模块化的视觉 AI 引擎,专为设计和执行复杂的 Stable Diffusion 图像生成流程而打造。它摒弃了传统的代码编写模式,采用直观的节点式流程图界面,让用户通过连接不同的功能模块即可构建个性化的生成管线。 这一设计巧妙解决了高级 AI 绘图工作流配置复杂、灵活性不足的痛点。用户无需具备编程背景,也能自由组合模型、调整参数并实时预览效果,轻松实现从基础文生图到多步骤高清修复等各类复杂任务。ComfyUI 拥有极佳的兼容性,不仅支持 Windows、macOS 和 Linux 全平台,还广泛适配 NVIDIA、AMD、Intel 及苹果 Silicon 等多种硬件架构,并率先支持 SDXL、Flux、SD3 等前沿模型。 无论是希望深入探索算法潜力的研究人员和开发者,还是追求极致创作自由度的设计师与资深 AI 绘画爱好者,ComfyUI 都能提供强大的支持。其独特的模块化架构允许社区不断扩展新功能,使其成为当前最灵活、生态最丰富的开源扩散模型工具之一,帮助用户将创意高效转化为现实。

LLMs-from-scratch

LLMs-from-scratch 是一个基于 PyTorch 的开源教育项目,旨在引导用户从零开始一步步构建一个类似 ChatGPT 的大型语言模型(LLM)。它不仅是同名技术著作的官方代码库,更提供了一套完整的实践方案,涵盖模型开发、预训练及微调的全过程。 该项目主要解决了大模型领域“黑盒化”的学习痛点。许多开发者虽能调用现成模型,却难以深入理解其内部架构与训练机制。通过亲手编写每一行核心代码,用户能够透彻掌握 Transformer 架构、注意力机制等关键原理,从而真正理解大模型是如何“思考”的。此外,项目还包含了加载大型预训练权重进行微调的代码,帮助用户将理论知识延伸至实际应用。 LLMs-from-scratch 特别适合希望深入底层原理的 AI 开发者、研究人员以及计算机专业的学生。对于不满足于仅使用 API,而是渴望探究模型构建细节的技术人员而言,这是极佳的学习资源。其独特的技术亮点在于“循序渐进”的教学设计:将复杂的系统工程拆解为清晰的步骤,配合详细的图表与示例,让构建一个虽小但功能完备的大模型变得触手可及。无论你是想夯实理论基础,还是为未来研发更大规模的模型做准备

Deep-Live-Cam

Deep-Live-Cam 是一款专注于实时换脸与视频生成的开源工具,用户仅需一张静态照片,即可通过“一键操作”实现摄像头画面的即时变脸或制作深度伪造视频。它有效解决了传统换脸技术流程繁琐、对硬件配置要求极高以及难以实时预览的痛点,让高质量的数字内容创作变得触手可及。 这款工具不仅适合开发者和技术研究人员探索算法边界,更因其极简的操作逻辑(仅需三步:选脸、选摄像头、启动),广泛适用于普通用户、内容创作者、设计师及直播主播。无论是为了动画角色定制、服装展示模特替换,还是制作趣味短视频和直播互动,Deep-Live-Cam 都能提供流畅的支持。 其核心技术亮点在于强大的实时处理能力,支持口型遮罩(Mouth Mask)以保留使用者原始的嘴部动作,确保表情自然精准;同时具备“人脸映射”功能,可同时对画面中的多个主体应用不同面孔。此外,项目内置了严格的内容安全过滤机制,自动拦截涉及裸露、暴力等不当素材,并倡导用户在获得授权及明确标注的前提下合规使用,体现了技术发展与伦理责任的平衡。