LMaaS-Papers

LMaaS-Papers 是一个专注于“语言模型即服务”(LMaaS)领域的精选学术论文清单。随着 GPT-3 等大型预训练语言模型因商业保护和高昂成本而不再公开权重,转而通过 API 提供服务,如何在无法获取模型内部参数和梯度的情况下,高效地将这些通用大模型适配到具体任务中,成为了当前研究的一大挑战。

该资源库旨在解决这一核心痛点,系统性地整理了 67 篇相关前沿论文,帮助研究者探索在不微调模型权重的前提下利用大模型能力的多种路径。其内容涵盖了五大关键技术方向:文本提示(Text Prompt)、上下文学习(In-Context Learning)、黑盒优化、基于特征的学习以及数据生成。特别值得一提的是,它清晰界定了“无样本提示”与“少样本上下文学习”的边界,为不同技术路线提供了明确的文献指引。

LMaaS-Papers 非常适合自然语言处理(NLP)领域的研究人员、算法工程师以及对大模型应用落地感兴趣的开发者使用。无论是希望快速了解 LMaaS 研究全貌,还是寻找特定技术方向的参考文献,这份由社区共同维护的动态清单都能提供极具价值的参考,助力大家在受限访问条件下充分释放大语言模型的潜力。

使用场景

某初创公司的 NLP 团队需要在不获取模型权重的前提下,利用闭源大模型 API 快速构建一个定制化的法律合同审查系统。

没有 LMaaS-Papers 时

- 技术路线迷茫:面对黑盒模型,团队在提示词工程、上下文学习等多种适配方案中盲目试错,难以确定最优技术路径。

- 文献检索低效:研究人员需耗费数周在海量论文中筛选仅针对“无参数访问”场景的研究,极易遗漏关键的黑盒优化或数据生成算法。

- 开发成本高昂:由于缺乏成熟的特征提取或小样本微调策略参考,团队被迫投入大量算力进行无效实验,导致项目延期。

- 概念边界模糊:难以厘清“文本提示”与“上下文学习”在具体落地时的界限,导致方案设计逻辑混乱,重复造轮子。

使用 LMaaS-Papers 后

- 方向精准锁定:直接参考库中分类清晰的五大研究方向(如黑盒优化、数据生成),迅速选定适合法律场景的少样本学习架构。

- 前沿成果直达:通过 curated list 一键获取 67 篇核心论文,立即复现最新的连续提示词调优方法,将适配周期从数周缩短至数天。

- 资源效率倍增:借鉴文中“数据生成”类论文思路,利用大模型合成标注数据训练本地小模型,大幅降低了对昂贵 API 调用的依赖。

- 理论体系清晰:依据仓库对技术边界的明确定义,团队规范了开发文档中的术语使用,确保了技术方案的一致性和可维护性。

LMaaS-Papers 将分散的黑盒大模型适配研究系统化,帮助开发者在无法触碰模型参数的限制下,以最低成本挖掘出大模型的最大业务价值。

运行环境要求

未说明

未说明

快速开始

语言模型即服务 (LMaaS)

这是一个精心整理的“语言模型即服务 (LMaaS)”论文列表,主要由 Tianxiang Sun 维护。我们强烈鼓励对该主题感兴趣的自然语言处理研究人员通过提交拉取请求来添加或更新论文(详见 贡献说明)。请关注本仓库以获取最新动态!

更新

- 2022年7月7日:撰写一篇中文博客 链接

- 2022年7月4日:创建此论文列表

目录

引言

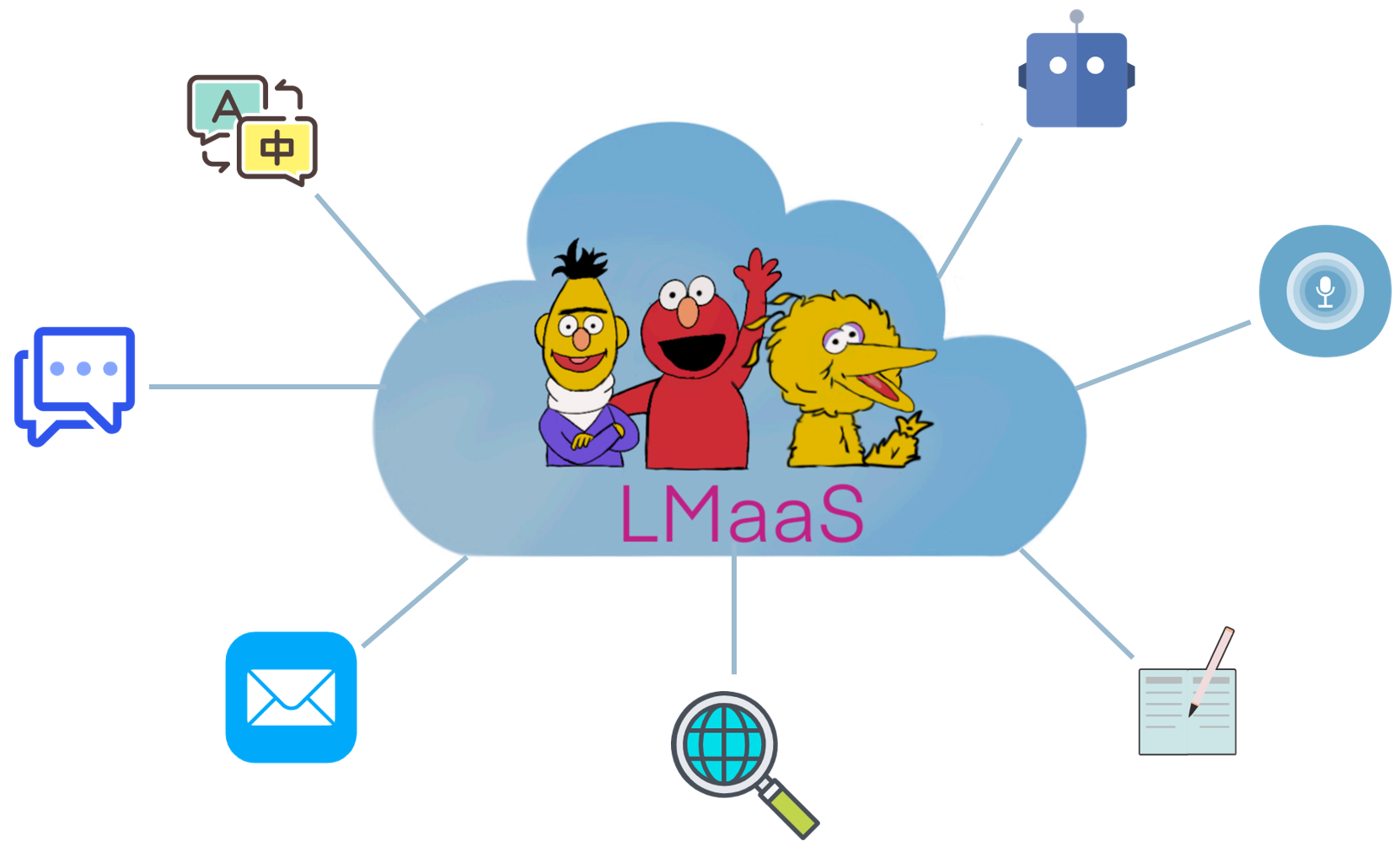

由于商业原因和高昂的调优成本,像 GPT-3 这样的预训练大型语言模型(LLMs)通常以服务形式提供,而非开源其模型权重。我们将这种情形称为“语言模型即服务 (LMaaS)”(该术语最初在我们的 ICML'2022 论文中提出 链接)。在这种场景下,用户可以通过推理 API 访问强大的 LLMs。LLMs 的服务已经支持了许多实际应用(参见 GPT-3 演示)。与微调相比,LMaaS 允许单个通用 LLM 服务于多种不同的任务,因此具有更高的部署效率。然而,在无法访问模型参数和梯度的情况下,如何将 LLMs 适配到目标任务仍是一个挑战。为了使 LLMs 能够惠及更广泛的受众,我们收集了符合这一场景的相关论文,以促进未来的研究。

范围

哪些论文属于 LMaaS 场景?我们主要考虑那些在不访问模型参数和梯度的情况下,将 LLMs 适配到下游任务的论文。尽管经过微调的 LLMs 在部署后也可以作为服务提供,但它们往往只能解决单一任务,且服务对象有限。而在我们的范围内,我们更倾向于使用通用模型为各类用户提供服务。

现有文献中,有几条研究方向符合 LMaaS 的范畴:

- 文本提示。通过手动或自动设计特定于任务的文本提示,用户可以利用冻结的 LLMs 来解决感兴趣的目标任务。

- 上下文学习。用户可以在推理时在输入中提供少量示例,帮助 LLMs 快速适应目标任务。

- 黑盒优化。仅通过访问 LLM 的输出概率,利用黑盒优化方法调整一小部分参数(例如连续提示),用户便可用少量训练数据解决目标任务。

- 基于特征的学习。LLMs 可以作为特征提取器,用户在其基础上构建可学习的任务特定模块,以执行分类或生成任务。

- 数据生成。生成式 LLMs 可以从零开始生成带标签的文本对数据集,然后用于本地训练一个规模小得多的模型。

“文本提示”和“上下文学习”之间的界限有时较为模糊。在本仓库中,“文本提示”类别包含不使用标注样本的论文;而“上下文学习”类别则包括在提示中包含标注样本的论文。

注:与此相关(并部分重叠)的主题是“基于提示的学习”,其目标是通过分别使用模板和表述器转换输入和输出,从而利用通用 LLMs 解决下游任务。然而,大多数基于提示的学习工作需要访问模型参数和梯度,因此并不属于我们的范围。对于不适合 LMaaS 的基于提示的学习论文,我们建议将其贡献到另一个优秀的论文列表:PromptPaper。

优势

与针对特定任务进行微调的 LLMs 相比,LMaaS 具有以下优势:

- 部署高效。LMaaS 只需部署一个通用 LLM 即可服务于多种任务。目标任务可以通过为 LLM 提供特定于任务的提示、调整一小部分参数或利用特征来实现,无需为每个任务维护一份完整的模型副本。

- 调优高效。当需要调优的任务特定参数较少时(例如通过黑盒优化),优化过程会非常高效,因为它不需要反向传播。反向传播的计算复杂度与模型大小成正比,对于 LLMs 而言可能代价高昂甚至不可行。相比之下,LMaaS 中的优化复杂度与模型大小无关。

- 样本高效。已有研究表明,LLMs 在大量任务上仅用少量甚至零标注数据即可取得竞争力强的表现。LMaaS 中的大多数研究也专注于少样本或零样本设置。

关键词

论文

文本提示

语言模型是知识库吗? EMNLP 2019

法比奥·佩特罗尼、蒂姆·罗克塔谢尔、帕特里克·刘易斯、安东·巴赫京、吴宇翔、亚历山大·H·米勒、塞巴斯蒂安·里德尔。[pdf] [代码]

我们如何知道语言模型掌握了什么? TACL 2020

语言模型是少样本学习者。 NeurIPS 2020

汤姆·B·布朗、本杰明·曼、尼克·赖德、梅拉妮·萨比亚、贾雷德·卡普兰、普拉富拉·达里瓦尔、阿温德·尼拉坎坦、普拉纳夫·夏亚姆、吉里什·萨斯特里、阿曼达·阿斯克尔、桑迪尼·阿加瓦尔、艾瑞尔·赫伯特-沃斯、格雷琴·克鲁格、汤姆·海尼根、雷文·柴尔德、阿迪提亚·拉梅什、丹尼尔·M·齐格勒、杰弗里·吴、克莱门斯·温特、克里斯托弗·赫塞、马克·陈、埃里克·西格勒、马特乌什·利特温和、斯科特·格雷、本杰明·切斯、杰克·克拉克、克里斯托弗·伯纳、萨姆·麦坎德利什、亚历克·拉德福德、伊利亚·苏茨克维尔、达里奥·阿莫迪。[pdf]

通过在数据集和提示集合上进行元调优,使语言模型适应零样本学习。EMNLP 2021 研究成果

微调后的语言模型是零样本学习者。ICLR 2022

杰森·魏、马尔滕·博斯马、文森特·Y·赵、凯尔文·古、亚当斯·魏·余、布莱恩·莱斯特、南·杜、安德鲁·M·戴、阮文乐。[pdf] [代码]

多任务提示训练实现零样本任务泛化。ICLR 2022

维克多·桑、阿尔伯特·韦布森、科林·拉菲尔、斯蒂芬·H·巴赫、林唐·苏塔维卡、扎伊德·阿拉菲、安托万·沙芬、阿诺·斯蒂格勒、泰文·勒·斯考、阿伦·拉贾、马南·戴、M·赛富尔·巴里、灿文·许、乌尔米什·塔克尔、莎尼亚·夏尔玛·夏尔玛、伊丽莎·斯切赫拉、泰文·金、冈詹·查布拉尼、尼哈尔·纳亚克、黛芭乔蒂·达塔、乔纳森·张、迈克·田建江、韩王、马特奥·马尼卡、盛申、郑欣·永、哈希特·潘迪、蕾切尔·鲍登、托马斯·王、特里沙拉·尼拉杰、乔斯·罗曾、阿比什特·夏尔玛、安德烈亚·桑蒂利、蒂博·费夫里、杰森·艾伦·弗里斯、瑞安·蒂汉、塔莉·贝尔斯、斯特拉·比德曼、里奥·高、托马斯·沃尔夫、亚历山大·M·拉什。[pdf] [代码]

通过人类反馈训练语言模型遵循指令。2022年3月预印本

龙欧阳、杰夫·吴、徐江、迪奥戈·阿尔梅达、卡罗尔·L·韦恩赖特、帕梅拉·米什金、张冲、桑迪尼·阿加瓦尔、卡塔琳娜·斯拉马、亚历克斯·雷、约翰·舒尔曼、雅各布·希尔顿、弗雷泽·凯尔顿、卢克·米勒、麦迪·西门斯、阿曼达·阿斯克尔、彼得·韦林德、保罗·克里斯蒂亚诺、扬·莱克、瑞安·洛。[pdf] [代码]

大型语言模型是零样本推理者。2022年6月预印本

通过冻结的双向语言模型实现零样本视频问答。2022年6月预印本

语言模型是通用接口。2022年6月预印本

面向代码大型语言模型的仓库级提示生成。2022年6月预印本

忽略先前提示:针对语言模型的攻击技术。2022年NeurIPS机器学习安全研讨会最佳论文奖。

上下文学习

- 语言模型是少样本学习者。 NeurIPS 2020

汤姆·B·布朗、本杰明·曼、尼克·赖德、梅拉妮·苏比亚、贾雷德·卡普兰、普拉富拉·达里瓦尔、阿温德·尼拉坎坦、普拉纳夫·夏亚姆、吉里什·萨斯特里、阿曼达·阿斯克尔、桑迪尼·阿加瓦尔、艾瑞尔·赫伯特-沃斯、格雷琴·克鲁格、汤姆·海尼根、雷文·柴尔德、阿迪蒂亚·拉梅什、丹尼尔·M·齐格勒、杰弗里·吴、克莱门斯·温特、克里斯托弗·赫塞、马克·陈、埃里克·西格勒、马特乌什·利特温、斯科特·格雷、本杰明·切斯、杰克·克拉克、克里斯托弗·伯纳、萨姆·麦坎德利什、亚历克·拉德福德、伊利亚·苏茨克维尔、达里奥·阿莫代伊。[pdf]

使用前校准:提升语言模型的小样本性能。ICML 2021

将上下文学习解释为隐式贝叶斯推理。ICLR 2022

思维链提示在大型语言模型中激发推理能力。预印本 2022.1

杰森·魏、薛志王、戴尔·舒尔曼、马尔滕·博斯马、布莱恩·伊希特、费伊·夏、埃德·奇、阮奎、周登尼。[pdf]

通过自然语言众包指令实现跨任务泛化。ACL 2022

奇妙有序的提示及其寻找方法:克服小样本提示顺序敏感性。ACL 2022

姚璐、马克斯·巴托洛、阿拉斯泰尔·摩尔、塞巴斯蒂安·里德、蓬图斯·斯滕托普。[pdf]

用于小样本文本分类的噪声信道语言模型提示。ACL 2022

通过语言模型上下文调优进行元学习。ACL 2022

对GPT-3而言,什么样的上下文示例才是好的? DeeLIO@ACL 2022

刘家昌、丁翰·申、张义哲、比尔·多兰、劳伦斯·卡林、陈伟柱。[pdf]

学习检索用于上下文学习的提示。NAACL 2022

MetaICL:学习如何在上下文中学习。NAACL 2022

通过自监督训练改进上下文小样本学习。NAACL 2022

陈明达、杜静菲、帕苏努鲁·拉马坎特、米哈伊洛夫·托多尔、伊耶尔·斯里尼、斯托亚诺夫·韦塞林、科扎列娃·佐尔尼察。[pdf]

自动生成的上下文学习:利用自回归语言模型作为演示生成器。LPLM@NAACL 2022

金炯俊、曹贤洙、金俊烨、金泰旭、柳康珉、李相九。[pdf]

重新思考演示的作用:是什么让上下文学习奏效? 预印本 2022.2

徐文敏、吕欣熙、阿里·霍尔茨曼、米凯尔·阿尔特切、迈克·刘易斯、汉娜内·哈吉希尔齐、卢克·泽特勒莫耶。[pdf] [code]

用于小样本对话状态跟踪的上下文学习。预印本 2022.3

自我一致性提升语言模型中的思维链推理。预印本 2022.3

薛志王、杰森·魏、戴尔·舒尔曼、阮奎、埃德·奇、周登尼。[pdf]

STaR:自教型推理者以推理驱动推理。预印本 2022.3

埃里克·泽利克曼、吴宇怀、诺亚·D·古德曼。[pdf]

基于1600多个语言任务的上下文指令进行泛化基准测试。预印本 2022.4

Yizhong Wang、Swaroop Mishra、Pegah Alipoormolabashi、Yeganeh Kordi、Amirreza Mirzaei、Anjana Arunkumar、Arjun Ashok、Arut Selvan Dhanasekaran、Atharva Naik、David Stap、Eshaan Pathak、Giannis Karamanolakis、Haizhi Gary Lai、Ishan Purohit、Ishani Mondal、Jacob Anderson、Kirby Kuznia、Krima Doshi、Maitreya Patel、Kuntal Kumar Pal、Mehrad Moradshahi、Mihir Parmar、Mirali Purohit、Neeraj Varshney、Phani Rohitha Kaza、Pulkit Verma、Ravsehaj Singh Puri、Rushang Karia、Shailaja Keyur Sampat、Savan Doshi、Siddhartha Mishra、Sujan Reddy、Sumanta Patro、Tanay Dixit、Xudong Shen、Chitta Baral、Yejin Choi、Noah A. Smith、Hannaneh Hajishirzi、Daniel Khashabi。[pdf] [code]

语言模型能否从上下文中的解释中学习?。预印本 2022.4

Andrew K. Lampinen、Ishita Dasgupta、Stephanie C. Y. Chan、Kory Matthewson、Michael Henry Tessler、Antonia Creswell、James L. McClelland、Jane X. Wang、Felix Hill。[pdf]

真实标签很重要:深入探讨输入-标签示范。预印本 2022.5

Junyeob Kim、Hyuhng Joon Kim、Hyunsoo Cho、Hwiyeol Jo、Sang-Woo Lee、Sang-goo Lee、Kang Min Yoo、Taeuk Kim。[pdf]

少样本上下文学习中解释的不可靠性。预印本 2022.5

Xi Ye、Greg Durrett。[pdf]

由浅入深提示法使大型语言模型具备复杂推理能力。预印本 2022.5

Denny Zhou、Nathanael Schärli、Le Hou、Jason Wei、Nathan Scales、Xuezhi Wang、Dale Schuurmans、Olivier Bousquet、Quoc Le、Ed Chi。[pdf]

助产术提示:通过递归解释实现逻辑一致的推理。预印本 2022.5

Jaehun Jung、Lianhui Qin、Sean Welleck、Faeze Brahman、Chandra Bhagavatula、Ronan Le Bras、Yejin Choi。[pdf]

关于提升语言模型推理能力的进展。预印本 2022.6

Yifei Li、Zeqi Lin、Shizhuo Zhang、Qiang Fu、Bei Chen、Jian-Guang Lou、Weizhu Chen。[pdf] [code]

大型语言模型的涌现能力。预印本 2022.6

Jason Wei、Yi Tay、Rishi Bommasani、Colin Raffel、Barret Zoph、Sebastian Borgeaud、Dani Yogatama、Maarten Bosma、Denny Zhou、Donald Metzler、Ed H. Chi、Tatsunori Hashimoto、Oriol Vinyals、Percy Liang、Jeff Dean、William Fedus。[pdf]

语言模型是通用接口。预印本 2022.6

Yaru Hao、Haoyu Song、Li Dong、Shaohan Huang、Zewen Chi、Wenhui Wang、Shuming Ma、Furu Wei。[pdf] [code]

Transformer 模型在上下文中能学到什么?以简单函数类为例。预印本 2022.8

Shivam Garg、Dimitris Tsipras、Percy Liang、Gregory Valiant。[pdf] [code]

通过蒸馏上下文进行学习。预印本 2022.9

Charlie Snell、Dan Klein、Ruiqi Zhong。[pdf]

将语言模型绑定到符号语言中。预印本 2022.10

Zhoujun Cheng*、Tianbao Xie*、Peng Shi、Chengzu Li、Rahul Nadkarni、Yushi Hu、Caiming Xiong、Dragomir Radev、Mari Ostendorf、Luke Zettlemoyer、Noah A. Smith、Tao Yu。[pdf] [code] [website]

在大型语言模型微调中保持上下文学习能力。预印本 2022.11

Yihan Wang、Si Si、Daliang Li、Michal Lukasik、Felix Yu、Cho-Jui Hsieh、Inderjit S Dhillon、Sanjiv Kumar。[pdf]

通过上下文学习教授算法推理。预印本 2022.11

Hattie Zhou、Azade Nova、Hugo Larochelle、Aaron Courville、Behnam Neyshabur、Hanie Sedghi。[pdf]

上下文学习到底是一种怎样的学习算法?基于线性模型的探究。预印本 2022.11

Ekin Akyürek、Dale Schuurmans、Jacob Andreas、Tengyu Ma、Denny Zhou。[pdf]

黑盒优化

面向语言模型即服务的黑盒调优。ICML 2022

Tianxiang Sun, Yunfan Shao, Hong Qian, Xuanjing Huang, Xipeng Qiu. [pdf] [code]

预训练语言模型的黑盒提示学习。TMLR 2023.2

Shizhe Diao, Xuechun Li, Yong Lin, Zhichao Huang, Tong Zhang. [pdf]

GrIPS:无需梯度、基于编辑的指令搜索,用于大型语言模型的提示工程。2022年3月预印本

Archiki Prasad, Peter Hase, Xiang Zhou, Mohit Bansal. [pdf] [code]

少样本提示技术在可控响应生成中的应用。2022年6月预印本

Hsuan Su, Pohan Chi, Shih-Cheng Huang, Chung Ho Lam, Saurav Sahay, Shang-Tse Chen, Hung-yi Lee. [pdf]

BBTv2:迈向无梯度的大型语言模型未来。EMNLP 2022

Tianxiang Sun, Zhengfu He, Hong Qian, Yunhua Zhou, Xuanjing Huang, Xipeng Qiu. [pdf] [code]

RLPrompt:利用强化学习优化离散文本提示。EMNLP 2022

Mingkai Deng, Jianyu Wang, Cheng-Ping Hsieh, Yihan Wang, Han Guo, Tianmin Shu, Meng Song, Eric P. Xing, Zhiting Hu. [pdf] [code]

Clip-Tuning:通过混合奖励实现无导数提示学习。EMNLP 2022研究发现

Yekun Chai, Shuohuan Wang, Yu Sun, Hao Tian, Hua Wu, Haifeng Wang. [pdf]

TEMPERA:基于强化学习的测试时提示编辑。2022年11月预印本

Tianjun Zhang, Xuezhi Wang, Denny Zhou, Dale Schuurmans, Joseph E. Gonzalez。[pdf] [code]

PromptBoosting:仅需十次前向传播的黑盒文本分类。2022年12月预印本

Bairu Hou, Joe O'Connor, Jacob Andreas, Shiyu Chang, Yang Zhang. [pdf]

面向中文少样本学习的模块化提示多任务预训练。ACL 2023

Tianxiang Sun, Zhengfu He, Qin Zhu, Xipeng Qiu, Xuanjing Huang. [pdf]

当梯度下降遇到无导数优化:黑盒场景下的完美结合。ACL 2023

Chengcheng Han, Liqing Cui, Renyu Zhu, Jianing Wang, Nuo Chen, Qiushi Sun, Xiang Li, Ming Gao. [pdf]

让基于提示的黑盒调优丰富多彩:从三个正交视角提升模型泛化能力。LREC-COLING 2024

Qiushi Sun, Chengcheng Han, Nuo Chen, Renyu Zhu, Jingyang Gong, Xiang Li, Ming Gao. [pdf]

基于特征的学习

调优还是不调优?将预训练表示适应于多样化任务。RepL4NLP@ACL 2019

Matthew E. Peters, Sebastian Ruder, Noah A. Smith. [pdf]

解释性方法能否用于校准黑盒模型? ACL 2022

协同训练提升大型语言模型的提示学习效果。ICML 2022

Hunter Lang, Monica Agrawal, Yoon Kim, David Sontag. [pdf]

Y-Tuning:通过标签表示学习实现大规模预训练模型的高效调优范式。2022年2月预印本

Yitao Liu, Chenxin An, Xipeng Qiu. [pdf]

LST:阶梯式侧向调优,用于参数与内存高效的迁移学习。NeurIPS 2022

解码器调优:以解码方式实现高效的语言理解。2022年12月预印本

Ganqu Cui, Wentao Li, Ning Ding, Longtao Huang, Zhiyuan Liu, Maosong Sun. [pdf]

数据生成

使用预训练语言模型生成数据集。EMNLP 2021

GPT3Mix:利用大规模语言模型进行文本增强。EMNLP 2021 论文集

Kang Min Yoo, Dongju Park, Jaewook Kang, Sang-Woo Lee, Woomyeong Park。[pdf] [代码]

用于常识推理的生成知识提示。ACL 2022

Jiacheng Liu, Alisa Liu, Ximing Lu, Sean Welleck, Peter West, Ronan Le Bras, Yejin Choi, Hannaneh Hajishirzi。[pdf] [代码]

ZeroGen:通过数据集生成实现高效的零样本学习。EMNLP 2022

Jiacheng Ye, Jiahui Gao, Qintong Li, Hang Xu, Jiangtao Feng, Zhiyong Wu, Tao Yu, Lingpeng Kong。[pdf] [代码]

ZeroGen+:在高效零样本学习中自我引导的高质量数据生成。2022年2月预印本

Jiahui Gao, Renjie Pi, Yong Lin, Hang Xu, Jiacheng Ye, Zhiyong Wu, Xiaodan Liang, Zhenguo Li, Lingpeng Kong。[pdf]

AugESC:利用大型语言模型进行情感支持对话的对话增强。ACL 2023 论文集

Chujie Zheng, Sahand Sabour, Jiaxin Wen, Zheng Zhang, Minlie Huang。[pdf]

使用语言模型生成训练数据:迈向零样本语言理解。NeurIPS 2022

贡献说明

:+1::tada: 首先,感谢您抽出时间参与贡献! :tada::+1:

贡献步骤如下:

- 添加新论文或更新现有论文。请确认您添加的论文是否符合本仓库的范围。

- 请使用与现有条目相同的格式。添加关键词标签时,请遵循关键词规范。添加论文的PDF链接时,若论文发表在arXiv上,请使用其摘要页面。

- 相应地修改页面顶部的

PaperNumber,然后提交您的拉取请求。我们建议简要说明您认为该论文应该被添加或更改的原因。

如果您不小心写错了也没关系,我们会帮您修正。 只管贡献,并在此推广您出色的工作吧!

贡献者

除了以下提交了拉取请求的贡献者之外,我们还要感谢Ohad Rubin和Kang Min Yoo推荐的论文。

相似工具推荐

openclaw

OpenClaw 是一款专为个人打造的本地化 AI 助手,旨在让你在自己的设备上拥有完全可控的智能伙伴。它打破了传统 AI 助手局限于特定网页或应用的束缚,能够直接接入你日常使用的各类通讯渠道,包括微信、WhatsApp、Telegram、Discord、iMessage 等数十种平台。无论你在哪个聊天软件中发送消息,OpenClaw 都能即时响应,甚至支持在 macOS、iOS 和 Android 设备上进行语音交互,并提供实时的画布渲染功能供你操控。 这款工具主要解决了用户对数据隐私、响应速度以及“始终在线”体验的需求。通过将 AI 部署在本地,用户无需依赖云端服务即可享受快速、私密的智能辅助,真正实现了“你的数据,你做主”。其独特的技术亮点在于强大的网关架构,将控制平面与核心助手分离,确保跨平台通信的流畅性与扩展性。 OpenClaw 非常适合希望构建个性化工作流的技术爱好者、开发者,以及注重隐私保护且不愿被单一生态绑定的普通用户。只要具备基础的终端操作能力(支持 macOS、Linux 及 Windows WSL2),即可通过简单的命令行引导完成部署。如果你渴望拥有一个懂你

stable-diffusion-webui

stable-diffusion-webui 是一个基于 Gradio 构建的网页版操作界面,旨在让用户能够轻松地在本地运行和使用强大的 Stable Diffusion 图像生成模型。它解决了原始模型依赖命令行、操作门槛高且功能分散的痛点,将复杂的 AI 绘图流程整合进一个直观易用的图形化平台。 无论是希望快速上手的普通创作者、需要精细控制画面细节的设计师,还是想要深入探索模型潜力的开发者与研究人员,都能从中获益。其核心亮点在于极高的功能丰富度:不仅支持文生图、图生图、局部重绘(Inpainting)和外绘(Outpainting)等基础模式,还独创了注意力机制调整、提示词矩阵、负向提示词以及“高清修复”等高级功能。此外,它内置了 GFPGAN 和 CodeFormer 等人脸修复工具,支持多种神经网络放大算法,并允许用户通过插件系统无限扩展能力。即使是显存有限的设备,stable-diffusion-webui 也提供了相应的优化选项,让高质量的 AI 艺术创作变得触手可及。

everything-claude-code

everything-claude-code 是一套专为 AI 编程助手(如 Claude Code、Codex、Cursor 等)打造的高性能优化系统。它不仅仅是一组配置文件,而是一个经过长期实战打磨的完整框架,旨在解决 AI 代理在实际开发中面临的效率低下、记忆丢失、安全隐患及缺乏持续学习能力等核心痛点。 通过引入技能模块化、直觉增强、记忆持久化机制以及内置的安全扫描功能,everything-claude-code 能显著提升 AI 在复杂任务中的表现,帮助开发者构建更稳定、更智能的生产级 AI 代理。其独特的“研究优先”开发理念和针对 Token 消耗的优化策略,使得模型响应更快、成本更低,同时有效防御潜在的攻击向量。 这套工具特别适合软件开发者、AI 研究人员以及希望深度定制 AI 工作流的技术团队使用。无论您是在构建大型代码库,还是需要 AI 协助进行安全审计与自动化测试,everything-claude-code 都能提供强大的底层支持。作为一个曾荣获 Anthropic 黑客大奖的开源项目,它融合了多语言支持与丰富的实战钩子(hooks),让 AI 真正成长为懂上

ComfyUI

ComfyUI 是一款功能强大且高度模块化的视觉 AI 引擎,专为设计和执行复杂的 Stable Diffusion 图像生成流程而打造。它摒弃了传统的代码编写模式,采用直观的节点式流程图界面,让用户通过连接不同的功能模块即可构建个性化的生成管线。 这一设计巧妙解决了高级 AI 绘图工作流配置复杂、灵活性不足的痛点。用户无需具备编程背景,也能自由组合模型、调整参数并实时预览效果,轻松实现从基础文生图到多步骤高清修复等各类复杂任务。ComfyUI 拥有极佳的兼容性,不仅支持 Windows、macOS 和 Linux 全平台,还广泛适配 NVIDIA、AMD、Intel 及苹果 Silicon 等多种硬件架构,并率先支持 SDXL、Flux、SD3 等前沿模型。 无论是希望深入探索算法潜力的研究人员和开发者,还是追求极致创作自由度的设计师与资深 AI 绘画爱好者,ComfyUI 都能提供强大的支持。其独特的模块化架构允许社区不断扩展新功能,使其成为当前最灵活、生态最丰富的开源扩散模型工具之一,帮助用户将创意高效转化为现实。

markitdown

MarkItDown 是一款由微软 AutoGen 团队打造的轻量级 Python 工具,专为将各类文件高效转换为 Markdown 格式而设计。它支持 PDF、Word、Excel、PPT、图片(含 OCR)、音频(含语音转录)、HTML 乃至 YouTube 链接等多种格式的解析,能够精准提取文档中的标题、列表、表格和链接等关键结构信息。 在人工智能应用日益普及的今天,大语言模型(LLM)虽擅长处理文本,却难以直接读取复杂的二进制办公文档。MarkItDown 恰好解决了这一痛点,它将非结构化或半结构化的文件转化为模型“原生理解”且 Token 效率极高的 Markdown 格式,成为连接本地文件与 AI 分析 pipeline 的理想桥梁。此外,它还提供了 MCP(模型上下文协议)服务器,可无缝集成到 Claude Desktop 等 LLM 应用中。 这款工具特别适合开发者、数据科学家及 AI 研究人员使用,尤其是那些需要构建文档检索增强生成(RAG)系统、进行批量文本分析或希望让 AI 助手直接“阅读”本地文件的用户。虽然生成的内容也具备一定可读性,但其核心优势在于为机器

LLMs-from-scratch

LLMs-from-scratch 是一个基于 PyTorch 的开源教育项目,旨在引导用户从零开始一步步构建一个类似 ChatGPT 的大型语言模型(LLM)。它不仅是同名技术著作的官方代码库,更提供了一套完整的实践方案,涵盖模型开发、预训练及微调的全过程。 该项目主要解决了大模型领域“黑盒化”的学习痛点。许多开发者虽能调用现成模型,却难以深入理解其内部架构与训练机制。通过亲手编写每一行核心代码,用户能够透彻掌握 Transformer 架构、注意力机制等关键原理,从而真正理解大模型是如何“思考”的。此外,项目还包含了加载大型预训练权重进行微调的代码,帮助用户将理论知识延伸至实际应用。 LLMs-from-scratch 特别适合希望深入底层原理的 AI 开发者、研究人员以及计算机专业的学生。对于不满足于仅使用 API,而是渴望探究模型构建细节的技术人员而言,这是极佳的学习资源。其独特的技术亮点在于“循序渐进”的教学设计:将复杂的系统工程拆解为清晰的步骤,配合详细的图表与示例,让构建一个虽小但功能完备的大模型变得触手可及。无论你是想夯实理论基础,还是为未来研发更大规模的模型做准备