Awesome-Parameter-Efficient-Transfer-Learning

Awesome-Parameter-Efficient-Transfer-Learning 是一个专注于“参数高效迁移学习”的优质资源合集。在大型人工智能模型日益庞大的今天,传统的全量微调方法往往需要巨大的计算资源和显存,这让许多尝试者望而却步。该项目正是为了解决这一痛点而生,它汇集了前沿的论文、代码实现和技术教程,旨在帮助用户仅通过更新极少量的模型参数,就能让强大的预训练模型适应特定的下游任务。

这里不仅系统梳理了以 Adapter Tuning(适配器微调)为代表的各类主流技术路线,还持续追踪该领域的最新研究进展。无论是希望降低实验成本、快速验证想法的 AI 研究人员,还是受限于硬件资源但渴望应用大模型的开发者,都能从中找到极具价值的参考指引。通过借鉴这些高效方案,用户可以显著减少训练时间和算力消耗,同时保持优异的性能表现。如果你正致力于探索如何让大模型更轻量、更经济地落地应用,Awesome-Parameter-Efficient-Transfer-Learning 将是你不可或缺的知识宝库。

使用场景

某初创医疗科技公司的算法团队,正试图将通用的大型语言模型微调为专业的“临床病历辅助生成助手”,但面临算力预算紧张和研发周期短的双重压力。

没有 Awesome-Parameter-Efficient-Transfer-Learning 时

- 算力成本高昂:团队不得不采用全量参数微调,需要租用多张昂贵的 A100 显卡,导致单次实验成本超出预算 50%。

- 技术选型迷茫:面对 Adapter、LoRA、Prefix Tuning 等数十种新兴技术,工程师花费两周时间漫无目的地搜索论文和代码库,难以确定最适合医疗文本的方案。

- 复现难度极大:找到的开源代码风格各异、依赖冲突严重,且缺乏针对特定任务的配置参考,导致环境搭建和调试耗时极长。

- 迭代速度缓慢:由于训练资源受限且试错成本高,模型一天只能进行一轮验证,严重拖慢了产品上线进度。

使用 Awesome-Parameter-Efficient-Transfer-Learning 后

- 资源消耗骤降:通过仓库推荐的 LoRA 和 Adapter 方案,团队仅用单张消费级显卡即可完成微调,显存占用减少 80%,直接节省了数万元云租赁费用。

- 决策路径清晰:利用仓库分类清晰的"Addition-based Tuning"目录和精选论文列表,团队在半天内就锁定了适合少样本医疗数据的最佳算法组合。

- 落地效率倍增:直接引用仓库中经过验证的高质量实现代码和基准配置,避免了重复造轮子,将原本需要两天的环境部署压缩至两小时。

- 快速迭代优化:低成本使得团队可以并行尝试多种参数策略,每天完成十轮以上实验,迅速提升了模型在专业术语理解上的准确率。

Awesome-Parameter-Efficient-Transfer-Learning 通过整合前沿资源与最佳实践,让中小团队也能以极低的成本高效驾驭大模型微调技术。

运行环境要求

未说明

未说明

快速开始

𝓐𝔀𝓮𝓼𝓸𝓶𝓮 𝓟𝓪𝓻𝓪𝓶𝓮𝓽𝓮𝓻-𝓔𝓯𝓯𝓲𝓬𝓲𝓮𝓷𝓽 𝓣𝓻𝓪𝓷𝓼𝓯𝓮𝓻 𝓛𝓮𝓪𝓻𝓷𝓲𝓷𝓰

📚 目录

📝 简介

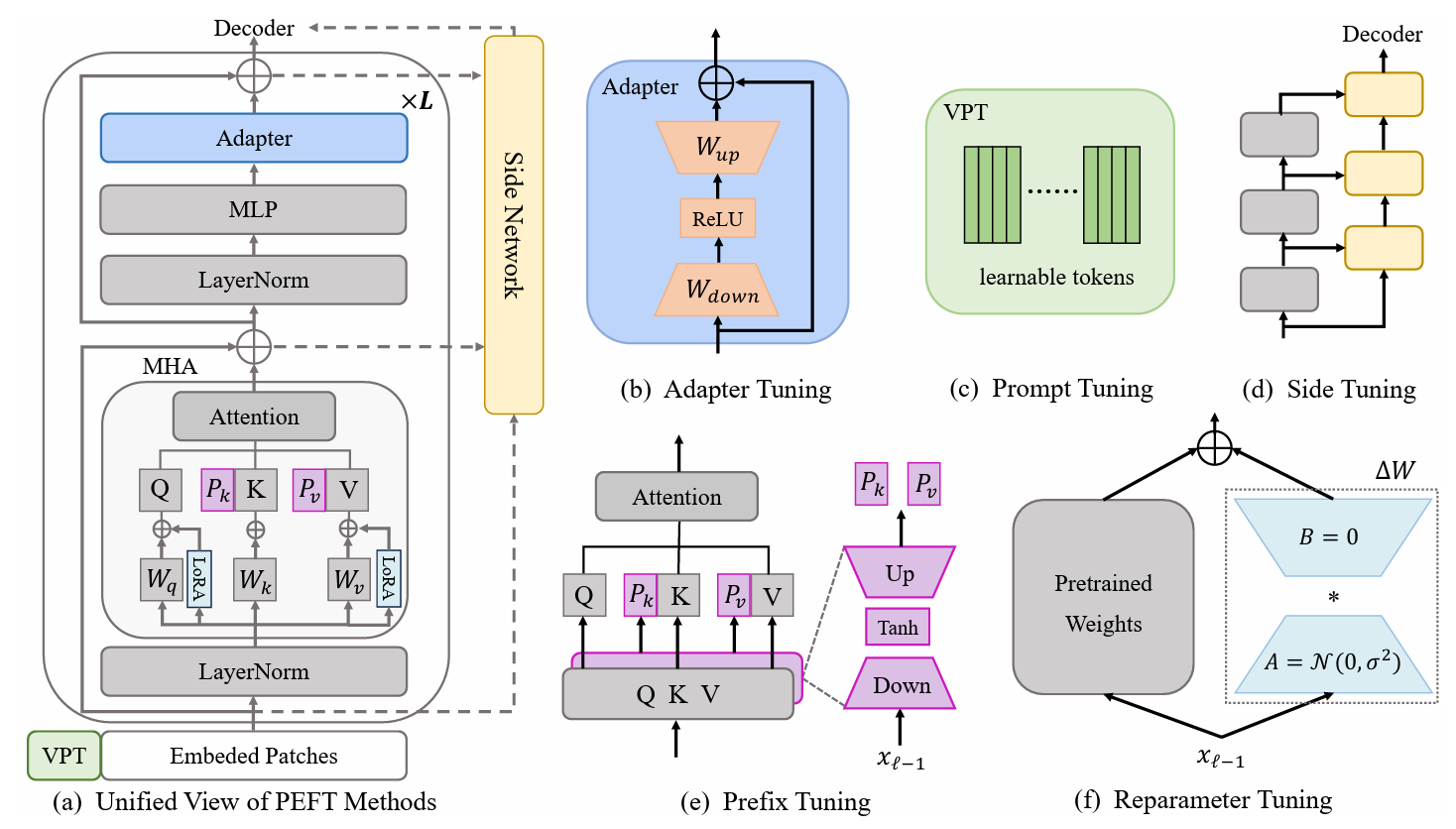

- 参数高效微调(PEFT) 旨在以最少的参数修改,超越全量微调的性能。

- 本仓库提供了一个全面的综述,并系统性地回顾了最新的进展。它提出了一种分类标准,将现有方法划分为三类:基于添加的微调、基于部分的微调和基于统一的微调。

- 此外,本仓库还介绍了常用的数据集和应用场景。

💬 关键词

🐌 论文

基于添加的微调

Adapter 微调

[1] AdaptFormer: 用于可扩展视觉识别的视觉 Transformer 自适应模型, NeurIPS 2022。

陈守法、葛崇健、佟展、王江柳、宋一兵、王珏、罗平。

[2] 卷积旁路是更好的视觉 Transformer Adapter, Arxiv 2022。

Jie, Shibo 和 Deng, Zhi-Hong。

[3] ST-Adapter: 参数高效的图像到视频迁移学习, NeurIPS 2022。

潘俊廷、林子怡、朱夏田、邵静、李洪生。

[4] AIM: 用于高效视频动作识别的图像模型自适应, ICLR 2023。

杨涛建南、朱毅、谢宇升、张阿斯顿、陈晨、李牧。

[5] 预训练视觉模型在机器人操作中的无损自适应, ICLR 2023。

夏尔马、范塔奇、周宇翔、科普拉以及其他研究人员。

[6] 1% VS 100%: 用于密集预测的参数高效低秩 Adapter, CVPR 2023。

尹东硕、杨艺然、王哲超、余洪峰、魏凯文、孙贤。

[论文][代码]

[7] Polyhistor: 用于密集视觉任务的参数高效多任务自适应, NeurIPS 2022。

刘延成、马志尧、田俊娇、何子健、齐索特·基拉。

[论文][代码]

[8] VMT-Adapter: 用于多任务密集场景理解的参数高效迁移学习, AAAI 2024。

易欣、杜俊龙、王强、林志文、严科。

[9] SCT: 通过显著通道实现参数高效微调的简单基线, IJCV 2023。

亨利·恒远·赵、皮超·王、宇洋·赵、浩·罗、凡·王、迈克·郑寿。

[10] 重要通道微调, Openreview 2023。

恒远·赵、皮超·王、宇洋·赵、凡·王、迈克·郑寿。

[论文][代码]

[11] 重访参数高效迁移学习:一种两阶段范式, Arxiv 2023。

赵恒远、罗浩、赵宇洋、王皮超、王凡、郑寿迈克。

[论文][代码]

[12] Compacter: 高效低秩超复数 Adapter 层, NeurIPS 2021。

卡里米·马哈巴迪、拉比赫、亨德森、詹姆斯、鲁德尔、塞巴斯蒂安。

[13] 参数高效且对学生友好的知识蒸馏, NeurIPS 2022。

饶俊、孟旭、丁亮、齐书涵、陶大成。

[论文][代码]

[14] VL-adapter: 用于视觉-语言任务的参数高效迁移学习, CVPR 2022。

Sung, Yi-Lin、Cho, Jaemin、Bansal, Mohit。

[15] UniAdapter: 用于跨模态建模的统一参数高效迁移学习, ICLR 2024。

陆浩宇、丁明宇、霍宇奇、杨国兴、卢志武、富冢正芳、詹伟。

[16] 基于跨块编排的参数高效微调方法应用于 Segment Anything Model, Arxiv 2023。

彭泽林、徐正钦、曾志林、谢凌熙、田琦、沈伟。

[论文][代码]

[17] Hydra: 用于参数高效微调的多头低秩适配器, Arxiv 2023。

金相贤、梁贤模、金英贤、洪英俊、朴恩炳。

[18] MixPHM: 面向低资源视觉问答任务的冗余感知型参数高效微调方法, CVPR 2023。

蒋静静、郑南宁。

[19] 视觉Transformer是高效的音视频学习模型, CVPR 2023。

林延博、宋怡琳、雷杰、班萨尔、贝尔塔修斯。

[20] SAM-Adapter: 在表现欠佳场景下对 Segment Anything 的适配, ICCVW 2023。

陈天润、朱兰云、邓超涛、曹润龙、王岩、张尚展、李泽健、孙凌云、臧颖、毛爸爸。

[21] T2I-Adapter: 学习适配器以挖掘文本到图像扩散模型的更多可控能力, AAAI 2024。

牟冲、王新涛、谢良斌、张健、齐中刚等。

[22] I2V-Adapter: 一种用于视频扩散模型的通用图像到视频适配器, Arxiv 2023。

郭勋、郑明武、侯亮、高远、邓宇凡等。

[23] AdaptIR: 针对预训练图像修复模型的参数高效多任务适配, Arxiv 2023。

郭航、戴涛、白元朝、陈彬、夏树涛、朱泽轩。

[24] 深入探讨扩散模型中的参数高效微调, Arxiv 2023。

项晨东、鲍帆、李崇轩、苏航、朱军。

[25] CAST: 用于视频动作识别的时空交叉注意力机制, NeurIPS 2023。

李东浩、李宗瑞、崔振宇。

[26] 动态适配器与提示微调结合:用于点云分析的参数高效迁移学习, CVPR 2024。

周鑫、梁定康、许伟、朱星奎、徐一涵、邹志康、白翔。

[27] MoMA: 多模态大语言模型适配器,用于快速个性化图像生成, ArXiv 2024。

宋鲲鹏、朱义哲、刘冰辰、严青、艾哈迈德·埃尔加马尔、杨晓。

[28] 沟通视觉与语言编码器:用于引用式图像分割的参数高效微调, ICCV 2023。

徐尊楠、陈志宏、张勇、宋一兵、万翔、李冠斌。

[29] 通过适配器增强细粒度多模态对齐:用于引用式图像分割的参数高效训练框架, WANT @ ICML 2024。

徐尊楠、黄佳琪、刘婷、刘勇、韩浩南、袁克洪、李秀。

[30] 稀疏微调:通过高效微调和推理适应视觉Transformer模型, ArXiv 2024。

刘婷、刘旭阳、石亮涛、徐尊南、黄思腾、辛毅、殷全军。

[30] PAVE:视频大型语言模型的补丁与适配, CVPR 2025。

刘卓明、李一泉、阮辉德、钟义武、李音。

提示词微调

[1] 视觉提示词微调, ECCV 2022。

贾梦琳、唐路明、陈博淳、克莱尔·卡迪、塞尔日·贝隆吉、巴拉特·哈里哈兰、林世南。

[2] 针对测试时领域适应的视觉提示词微调, Arxiv 2022。

高云鹤、史兴健、朱毅、王浩、唐志强、周雄等。

[论文][代码]

[3] LPT:用于图像分类的长尾提示词微调, ICLR 2023。

董博文、周攀、严水成、左望蒙。

[4] Pro-tuning:面向视觉任务的统一提示词微调, TCSVT 2023。

聂星、倪波林、常建龙、孟高锋、霍春雷等。

[论文][代码]

[5] 面向预训练点云模型的实例感知动态提示词微调, ICCV 2023。

查耀华、王金鹏、戴涛、陈斌、王志、夏树涛。

[6] 视觉提示词多模态跟踪, CVPR 2023。

朱嘉文、赖思淼、陈欣、王东、陆虎川。

[7] LION:隐式视觉提示词微调, AAAI 2024。

王海鑫、常建龙、罗晓、孙济南、林周晨、田琪。

[论文][代码]

[8] 用于鲁棒视觉感知的卷积视觉提示词, NeurIPS 2023。

蔡韵韵、毛成志、杨俊峰。

[论文][代码]

[9] ProSFDA:基于提示学习的无源域适应方法,用于医学图像分割, Arxiv 2023。

胡士帅、廖泽辉、夏勇。

[10] 针对低级结构分割的显式视觉提示词, CVPR 2023。

刘伟煌、沈曦、潘志民、存晓东。

[11] P2P:利用点到像素提示词微调预训练图像模型以进行点云分析, NeurIPS 2022。

王子怡、于旭敏、饶永明、周杰、陆继文。

[12] 探索用于大规模模型适配的视觉提示词, Arxiv 2022。

方孝珍、贾哈尼安、桑卡拉纳拉亚南、伊索拉。

[13] 在像素级别释放视觉提示词的力量, Arxiv 2023。

吴俊洋、李贤航、魏辰、王慧宇、尤伊尔、周雨寅、谢慈航。

[14] 从标签映射视角理解并改进视觉提示词, CVPR 2023。

陈奥川、姚玉光、陈品宇、张义华、刘思佳。

[15] 学习为视觉-语言模型生成提示词, IJCV 2022。

周凯阳、杨景康、洛伊陈昌、刘子威。

[16] Hyperprompt:基于提示的任务条件化变压器模型, ICML 2022。

何云、郑史蒂文、泰伊、古普塔·贾伊、杜宇、阿里班迪·万西等。

[论文][代码]

[17] MaPLe:多模态提示学习, CVPR 2023。

哈塔克·穆罕默德·乌宰尔、拉希德·哈努娜、马兹·穆罕默德等。

[18] 多任务学习中的层次化提示学习, CVPR 2023。

刘亚静、陆雨宁、刘浩、安耀祖、徐卓然、姚卓坤等。

[论文][代码]

[19] 自动驾驶中统一感知的视觉示例驱动任务提示, CVPR 2023。

梁锡文、牛敏哲、韩建华、徐航、徐春景、梁晓丹。

[论文][代码]

[20] 视觉-语言预训练模型的双模态提示调优, TMM 2023。

邢英辉、吴琪瑞、程德、张世洲、梁国强等。

[21] 通过提示实现任何内容的分词, Arxiv 2023。

潘婷、唐露露、王新龙、单世光。

[22] MmAP:跨领域多任务学习的多模态对齐提示, AAAI 2024。

易欣、杜俊龙、王强、严科、丁守红。

[论文][代码]

[23] 多样性感知的元视觉提示, CVPR 2023。

黄启东、董晓义、陈冬冬、张伟明、王菲菲、华刚、于能海。

[24] 跨模态提示:将大型预训练模型适配到音视频下游任务, NeurIPS 2023。

段浩毅、夏燕、周明泽、唐莉、朱继明、赵周。

[25] Point-PEFT:3D预训练模型的参数高效微调, AAAI 2024。

唐艺文、张雷、郭佐怡、马贤正、王东、王志刚、赵斌、李雪龙。

[论文][代码]

[26] E2VPT:一种有效且高效的视觉提示调优方法, ICCV 2023。

程汉、王奇凡、崔一鸣、曹志文、王文冠、戚思源、刘东方

[27] DGL:用于文本-视频检索的动态全局-局部提示调优, AAAI 2024。

杨向鹏、朱林超、王晓涵、杨毅

前缀调优

[1] 前缀调优:优化连续提示以用于生成任务, ACL 2021。

李翔 Lisa 和 梁 Percy。

[2] 向视觉参数高效迁移学习的统一视角迈进, Arxiv 2023。

Yu, Bruce XB、Chang, Jianlong、Liu, Lingbo、Tian, Qi 和 Chen, Chang Wen。

[3] 探索视觉Transformer的高效少样本适应方法, TMLR 2023。

Xu, Chengming、Yang, Siqian、Wang, Yabiao、Wang, Zhanxiong、Fu, Yanwei 和 Xue, Xiangyang。

[4] 视觉查询调优:迈向有效利用中间表示以实现参数与内存高效的迁移学习, CVPR 2023。

Tu, Cheng-Hao、Mai, Zheda 和 Chao, Wei-Lun。

[5] 具有通用参数高效调优的统一持续学习框架, ICCV 2023。

Tu, Cheng-Hao、Mai, Zheda 和 Chao, Wei-Lun。

基于部分的微调

规范调优

[1] 更好的 ImageNet 模型迁移效果更好吗? CVPR 2019。

Kornblith、Simon 和 Shlens、Jonathon 以及 Le、Quoc V.

[2] BitFit:基于 Transformer 的掩码语言模型的简单参数高效微调。 ACL 2022。

Zaken、Elad Ben 和 Ravfogel、Shauli 以及 Goldberg、Yoav.

[3] 基础模型的差分隐私偏置项仅微调, Arxiv 2022。

Bu、Zhiqi 和 Wang、Yu-Xiang 以及 Zha、Sheng 和 Karypis、George.

[论文][代码]

[4] AdapterBias:用于 NLP 任务中适配器的参数高效、与标记相关的表征迁移, NAACL 2022。

Fu、Chin-Lun 和 Chen、Zih-Ching 以及 Lee、Yun-Ru 以及 Lee、Hung-yi.

[5] 参数高效的少样本微调的强大基线, AAAI 2024。

Basu、Samyadeep 和 Massiceti、Daniela 以及 Hu、Shell Xu 以及 Feizi、Soheil.

[论文][代码]

[6] DiffFit:通过简单的参数高效微调解锁大型扩散模型的可迁移性, ICCV 2023。

Enze Xie、Lewei Yao、Han Shi、Zhili Liu、Daquan Zhou、Zhaoqiang Liu、Jiawei Li、Zhenguo Li.

[7] 基于梯度的参数选择以实现高效微调, Arxiv 2023。

Zhi Zhang、Qizhe Zhang、Zijun Gao、Renrui Zhang、Ekaterina Shutova、Shiji Zhou、Shanghang Zhang.

[8] 基于敏感性的视觉参数高效微调, ICCV 2023。

Haoyu He、Jianfei Cai、Jing Zhang、Dacheng Tao、Bohan Zhuang.

[9] 基于梯度的参数选择以实现高效微调, CVPR 2024。

Zhi Zhang、Qizhe Zhang、Zijun Gao、Renrui Zhang、Ekaterina Shutova、Shiji Zhou、Shanghang Zhang.

参数高效微调

[1] LoRA:大语言模型的低秩适应。 NeurIPS 2021。

Hu, Edward J 和 Shen, Yelong 和 Wallis, Phillip 和 Allen-Zhu, Zeyuan 和 Li, Yuanzhi 等。

[2] 缩放与偏移你的特征:一种高效的模型微调新基线, NeurIPS 2022。

Dongze Lian、Daquan Zhou、Jiashi Feng、Xinchao Wang。

[3] KronA:基于克罗内克适配器的参数高效微调, Arxiv 2023。

Ali Edalati、Marzieh Tahaei、Ivan Kobyzev、Vahid Partovi Nia、James J. Clark、Mehdi Rezagholizadeh。

[论文][代码]

[4] FacT:视觉Transformer上的轻量级自适应因子微调, AAAI 2023。

Jie, Shibo 和 Deng, Zhi-Hong。

[论文][代码]

[5] 聚合、分解与微调:一种简单而有效的视觉Transformer因子微调方法, Arxiv 2023。

Chen, Dongping。

[6] 参数高效少样本微调的强大基线, AAAI 2024。

Basu, Samyadeep 和 Massiceti, Daniela 和 Hu, Shell Xu 和 Feizi, Soheil。

[论文][代码]

[7] 视觉Transformer的参数高效模型适配, AAAI 2023。

He, Xuehai 和 Li, Chunyuan 和 Zhang, Pengchuan 和 Yang, Jianwei 和 Wang, Xin Eric。

[8] DnA:通过低秩分解与对齐提升少样本迁移学习, ECCV 2022。

Jiang, Ziyu 和 Chen, Tianlong 和 Chen, Xuxi 和 Cheng, Yu 和 Zhou, Luowei 和 Yuan, Lu 等。

[9] 通过结构化重参数化实现高效视觉适配, Arxiv 2023。

Luo, Gen 和 Huang, Minglang 和 Zhou, Yiyi 和 Sun, Xiaoshuai 和 Jiang, Guannan 和 Wang, Zhiyu 和 Ji, Rongrong。

[10]SAM-PARSER:通过参数空间重构高效微调SAM, AAAI 2024。

Zelin Peng、Zhengqin Xu、Zhilin Zeng、Xiaokang Yang、Wei Shen。

[10]DiffuseKronA:个性化扩散模型的参数高效微调方法, Arxiv 2023。

Shyam Marjit、Harshit Singh、Nityanand Mathur、Sayak Paul、Chia-Mu Yu、Pin-Yu Chen。

[11] 扩展稀疏微调以降低内存占用, NeurIPS 2024。

Shufan Shen、Junshu Sun、Xiangyang Ji、Qingming Huang、Shuhui Wang。

[12]PointLoRA:面向点云学习的基于标记选择的低秩适应, CVPR 2025。

Song Wang、Xiaolu Liu、Lingdong Kong、Jianyun Xu、Chunyong Hu、Gongfan Fang、Wentong Li、Jianke Zhu、Xinchao Wang。

统一调优

[1] 朝向参数高效迁移学习的统一视角, ICLR 2022。

Junxian He、Chunting Zhou、Xuezhe Ma、Taylor Berg-Kirkpatrick、Graham Neubig。

[2] 朝向视觉领域参数高效迁移学习的统一视角, Arxiv 2023。

Yu, Bruce XB、Chang, Jianlong、Liu, Lingbo、Tian, Qi、Chen, Chang Wen。

[3] 神经提示搜索, Arxiv 2022。

Zhang, Yuanhan、Zhou, Kaiyang、Liu, Ziwei。

[4] 从统一视角重新思考高效调优方法, Arxiv 2023。

Jiang, Zeyinzi、Mao, Chaojie、Huang, Ziyuan、Lv, Yiliang、Zhao, Deli、Zhou, Jingren。

[论文][代码]

[5] 具有通用参数高效调优的统一持续学习框架, ICCV 2023。

Gao, Qiankun、Zhao, Chen、Sun, Yifan、Xi, Teng、Zhang, Gang、Ghanem, Bernard、Zhang, Jian。

[6] GIST:通过知识交互改进参数高效微调, Arxiv 2023。

Jiacheng Ruan、Jingsheng Gao、Mingye Xie、Suncheng Xiang、Zefang Yu、Ting Liu、Yuzhuo Fu。

[论文][代码]

🎯 视觉 PETL 数据集

| 名称 | 论文 | 链接 | 备注 |

|---|---|---|---|

| FGVC | 视觉提示调优 | 链接 | FGVC 包含 5 个基准细粒度视觉分类任务。 |

| VTAB-1k | 基于视觉任务适应基准的大规模表征学习研究 | 链接 | VTAB-1k 包含 19 个多样化的视觉分类任务。 |

| Kinetics-400 | Kinetics 人类动作视频数据集。 | 链接 | 视频动作识别 |

| SSv2 | “something something” 视频数据库,用于学习和评估视觉常识 | 链接 | 视频动作识别 |

| HMDB51 | HMDB:大型人体运动数据库 | 链接 | 视频动作识别 |

| Diving-48 | RESOUND:迈向无表征偏见的动作识别 | 链接 | 视频动作识别 |

| UCF-101 | UCF101:来自野外视频的 101 类人类动作数据集 | 链接 | 视频动作识别 |

| MSCOCO | 微软 COCO:上下文中的常见物体 | 链接 | 实例分割 |

| ADE20K | 通过 ADE20K 数据集实现场景语义理解 | 链接 | 语义分割 |

| PASCALVOC | 帕斯卡视觉目标类别挑战赛:回顾 | 链接 | 语义分割 |

🧒 贡献

:clap: 感谢以上贡献者们的杰出工作!

⭐ 引用

如果您觉得我们的综述和仓库对您的研究有所帮助,请在下方引用:

@article{xin2024parameter,

title={预训练视觉模型的参数高效微调:综述},

author={Xin, Yi、Luo, Siqi、Zhou, Haodi、Du, Junlong、Liu, Xiaohong、Fan, Yue、Li, Qing、Du, Yuntao},

journal={arXiv 预印本 arXiv:2402.02242},

year={2024}

}

相似工具推荐

openclaw

OpenClaw 是一款专为个人打造的本地化 AI 助手,旨在让你在自己的设备上拥有完全可控的智能伙伴。它打破了传统 AI 助手局限于特定网页或应用的束缚,能够直接接入你日常使用的各类通讯渠道,包括微信、WhatsApp、Telegram、Discord、iMessage 等数十种平台。无论你在哪个聊天软件中发送消息,OpenClaw 都能即时响应,甚至支持在 macOS、iOS 和 Android 设备上进行语音交互,并提供实时的画布渲染功能供你操控。 这款工具主要解决了用户对数据隐私、响应速度以及“始终在线”体验的需求。通过将 AI 部署在本地,用户无需依赖云端服务即可享受快速、私密的智能辅助,真正实现了“你的数据,你做主”。其独特的技术亮点在于强大的网关架构,将控制平面与核心助手分离,确保跨平台通信的流畅性与扩展性。 OpenClaw 非常适合希望构建个性化工作流的技术爱好者、开发者,以及注重隐私保护且不愿被单一生态绑定的普通用户。只要具备基础的终端操作能力(支持 macOS、Linux 及 Windows WSL2),即可通过简单的命令行引导完成部署。如果你渴望拥有一个懂你

stable-diffusion-webui

stable-diffusion-webui 是一个基于 Gradio 构建的网页版操作界面,旨在让用户能够轻松地在本地运行和使用强大的 Stable Diffusion 图像生成模型。它解决了原始模型依赖命令行、操作门槛高且功能分散的痛点,将复杂的 AI 绘图流程整合进一个直观易用的图形化平台。 无论是希望快速上手的普通创作者、需要精细控制画面细节的设计师,还是想要深入探索模型潜力的开发者与研究人员,都能从中获益。其核心亮点在于极高的功能丰富度:不仅支持文生图、图生图、局部重绘(Inpainting)和外绘(Outpainting)等基础模式,还独创了注意力机制调整、提示词矩阵、负向提示词以及“高清修复”等高级功能。此外,它内置了 GFPGAN 和 CodeFormer 等人脸修复工具,支持多种神经网络放大算法,并允许用户通过插件系统无限扩展能力。即使是显存有限的设备,stable-diffusion-webui 也提供了相应的优化选项,让高质量的 AI 艺术创作变得触手可及。

everything-claude-code

everything-claude-code 是一套专为 AI 编程助手(如 Claude Code、Codex、Cursor 等)打造的高性能优化系统。它不仅仅是一组配置文件,而是一个经过长期实战打磨的完整框架,旨在解决 AI 代理在实际开发中面临的效率低下、记忆丢失、安全隐患及缺乏持续学习能力等核心痛点。 通过引入技能模块化、直觉增强、记忆持久化机制以及内置的安全扫描功能,everything-claude-code 能显著提升 AI 在复杂任务中的表现,帮助开发者构建更稳定、更智能的生产级 AI 代理。其独特的“研究优先”开发理念和针对 Token 消耗的优化策略,使得模型响应更快、成本更低,同时有效防御潜在的攻击向量。 这套工具特别适合软件开发者、AI 研究人员以及希望深度定制 AI 工作流的技术团队使用。无论您是在构建大型代码库,还是需要 AI 协助进行安全审计与自动化测试,everything-claude-code 都能提供强大的底层支持。作为一个曾荣获 Anthropic 黑客大奖的开源项目,它融合了多语言支持与丰富的实战钩子(hooks),让 AI 真正成长为懂上

ComfyUI

ComfyUI 是一款功能强大且高度模块化的视觉 AI 引擎,专为设计和执行复杂的 Stable Diffusion 图像生成流程而打造。它摒弃了传统的代码编写模式,采用直观的节点式流程图界面,让用户通过连接不同的功能模块即可构建个性化的生成管线。 这一设计巧妙解决了高级 AI 绘图工作流配置复杂、灵活性不足的痛点。用户无需具备编程背景,也能自由组合模型、调整参数并实时预览效果,轻松实现从基础文生图到多步骤高清修复等各类复杂任务。ComfyUI 拥有极佳的兼容性,不仅支持 Windows、macOS 和 Linux 全平台,还广泛适配 NVIDIA、AMD、Intel 及苹果 Silicon 等多种硬件架构,并率先支持 SDXL、Flux、SD3 等前沿模型。 无论是希望深入探索算法潜力的研究人员和开发者,还是追求极致创作自由度的设计师与资深 AI 绘画爱好者,ComfyUI 都能提供强大的支持。其独特的模块化架构允许社区不断扩展新功能,使其成为当前最灵活、生态最丰富的开源扩散模型工具之一,帮助用户将创意高效转化为现实。

markitdown

MarkItDown 是一款由微软 AutoGen 团队打造的轻量级 Python 工具,专为将各类文件高效转换为 Markdown 格式而设计。它支持 PDF、Word、Excel、PPT、图片(含 OCR)、音频(含语音转录)、HTML 乃至 YouTube 链接等多种格式的解析,能够精准提取文档中的标题、列表、表格和链接等关键结构信息。 在人工智能应用日益普及的今天,大语言模型(LLM)虽擅长处理文本,却难以直接读取复杂的二进制办公文档。MarkItDown 恰好解决了这一痛点,它将非结构化或半结构化的文件转化为模型“原生理解”且 Token 效率极高的 Markdown 格式,成为连接本地文件与 AI 分析 pipeline 的理想桥梁。此外,它还提供了 MCP(模型上下文协议)服务器,可无缝集成到 Claude Desktop 等 LLM 应用中。 这款工具特别适合开发者、数据科学家及 AI 研究人员使用,尤其是那些需要构建文档检索增强生成(RAG)系统、进行批量文本分析或希望让 AI 助手直接“阅读”本地文件的用户。虽然生成的内容也具备一定可读性,但其核心优势在于为机器

LLMs-from-scratch

LLMs-from-scratch 是一个基于 PyTorch 的开源教育项目,旨在引导用户从零开始一步步构建一个类似 ChatGPT 的大型语言模型(LLM)。它不仅是同名技术著作的官方代码库,更提供了一套完整的实践方案,涵盖模型开发、预训练及微调的全过程。 该项目主要解决了大模型领域“黑盒化”的学习痛点。许多开发者虽能调用现成模型,却难以深入理解其内部架构与训练机制。通过亲手编写每一行核心代码,用户能够透彻掌握 Transformer 架构、注意力机制等关键原理,从而真正理解大模型是如何“思考”的。此外,项目还包含了加载大型预训练权重进行微调的代码,帮助用户将理论知识延伸至实际应用。 LLMs-from-scratch 特别适合希望深入底层原理的 AI 开发者、研究人员以及计算机专业的学生。对于不满足于仅使用 API,而是渴望探究模型构建细节的技术人员而言,这是极佳的学习资源。其独特的技术亮点在于“循序渐进”的教学设计:将复杂的系统工程拆解为清晰的步骤,配合详细的图表与示例,让构建一个虽小但功能完备的大模型变得触手可及。无论你是想夯实理论基础,还是为未来研发更大规模的模型做准备