Tensor-Puzzles

Tensor-Puzzles 是一套专为提升 PyTorch 和 NumPy 编程能力设计的互动练习集,由知名学者 Sasha Rush 等人开发。它通过 21 个精心设计的“张量谜题”,帮助学习者摆脱对标准库函数或网络搜索的依赖,转而深入理解张量运算的核心机制。

许多开发者在处理数组操作时,习惯于直接调用现成函数,却忽略了底层广播(broadcasting)机制的强大表达力。Tensor-Puzzles 正是为了解决这一痛点而生:每个谜题要求用户在严格限制下(如仅限一行代码、禁止使用 sum/view 等高级函数),仅利用基础算术、索引和广播规则,重新实现常见的 NumPy 功能。这种类似“象棋残局”的训练方式,能在简化环境中高效锻炼逻辑思维与向量化编程技巧。

该工具特别适合正在学习深度学习框架的开发者、研究人员及学生使用。其独特亮点在于强制性的约束规则——例如必须用广播替代循环、用数学运算替代条件判断,从而迫使用户掌握“第一性原理”式的编程思维。项目支持在 Google Colab 中直接运行,并配有详细的可视化示例和视频讲解,让抽象的张量变换过程变得直观易懂。无论是想夯实基础的初学者,还是希望精进代码效率的资深工程师,都能从中获得实质性的提升。

使用场景

一位刚入门深度学习的研究员在尝试复现论文中的复杂张量操作时,发现自己过度依赖 for 循环和现成的库函数,导致代码运行缓慢且难以理解底层的广播机制。

没有 Tensor-Puzzles 时

- 思维固化:遇到多维数组操作习惯性编写低效的 Python

for循环,无法利用 GPU 并行加速。 - 盲目复制:过度依赖 StackOverflow 寻找“魔法函数”,一旦报错便不知如何从原理层面调试。

- 广播困惑:对 PyTorch 的广播规则(Broadcasting)一知半解,经常因维度不匹配引发难以追踪的形状错误。

- 代码冗余:实现简单的逻辑(如条件筛选或求和)需要多行冗长代码,缺乏向量化思维的简洁性。

使用 Tensor-Puzzles 后

- 掌握核心:通过 21 个限时谜题,强制在单行代码内利用广播机制解决问题,彻底摆脱了对循环的依赖。

- 原理内化:在禁止使用

sum、view等高级函数的限制下,学会了用基础算术和索引重构标准库功能,真正理解算子本质。 - 调试自信:能够预判张量形状的变化,快速定位维度对齐问题,不再被晦涩的形状报错劝退。

- 代码精简:养成了用一行向量化代码替代多行逻辑的习惯,显著提升了模型前向传播部分的执行效率。

Tensor-Puzzles 通过高强度的专项训练,帮助开发者从“调用 API"进阶为“精通张量语言”,从根本上提升了编写高效深度学习代码的能力。

运行环境要求

- 未说明

非必需

未说明

快速开始

张量谜题

- 作者:Sasha Rush - srush_nlp(与 Marcos Treviso 合作)

在学习像 PyTorch 或 NumPy 这样的张量编程语言时,人们很容易依赖标准库(或者更坦率地说,StackOverflow)来找到解决所有问题的“魔法函数”。但实际上,张量语言具有极强的表达能力,你可以通过基本原理和巧妙地利用广播机制来完成大多数任务。

这是一组包含 21 个张量谜题的集合。就像国际象棋谜题一样,这些谜题并不是为了模拟真实程序的复杂性,而是为了在一个简化的环境中进行练习。每个谜题都要求你不用任何“魔法”函数,重新实现 NumPy 标准库中的一个函数。

我建议在 Colab 中运行。点击这里并复制笔记本即可开始。

如果你感兴趣,还有一个关于这些谜题的 YouTube 演示视频:

!pip install -qqq torchtyping hypothesis pytest git+https://github.com/danoneata/chalk@srush-patch-1

!wget -q https://github.com/srush/Tensor-Puzzles/raw/main/lib.py

from lib import draw_examples, make_test, run_test

import torch

import numpy as np

from torchtyping import TensorType as TT

tensor = torch.tensor

规则

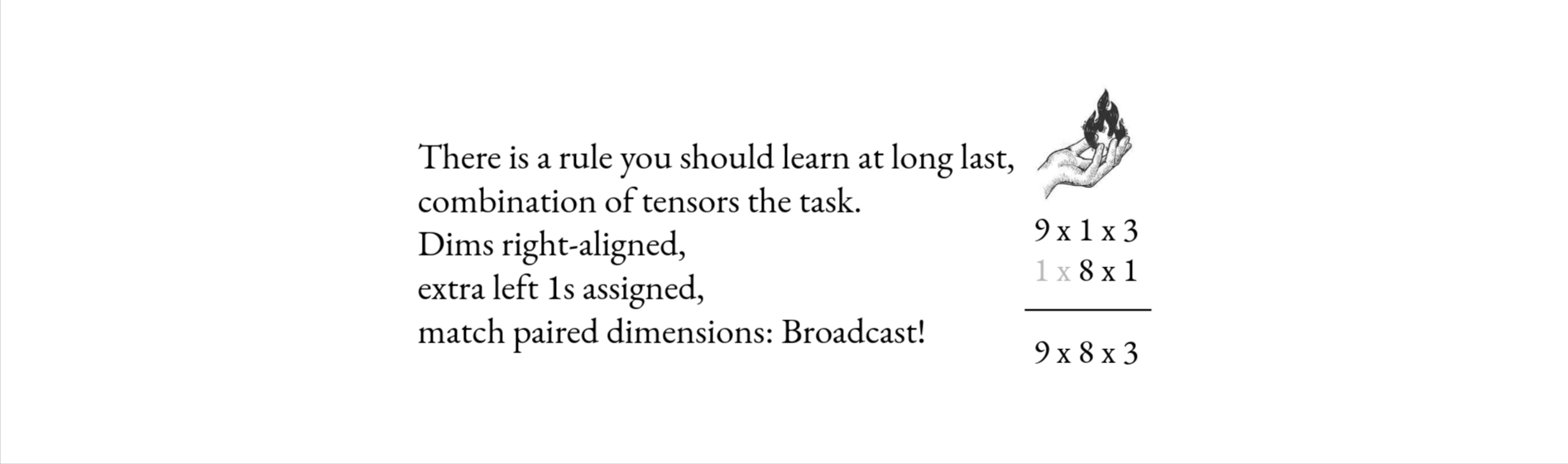

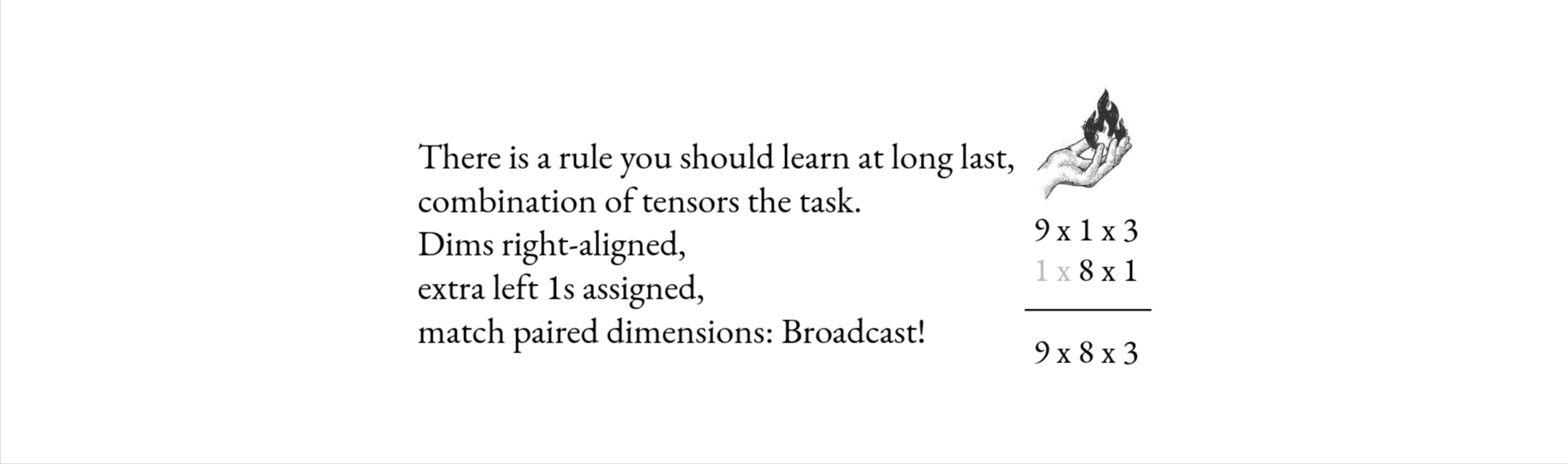

- 这些谜题围绕 广播 展开。请务必了解这一规则。

- 每个谜题都需要用一行代码(不超过 80 列)来解答。

- 你可以使用 @、算术运算、比较运算、

shape、任何索引操作(例如a[:j],a[:, None],a[arange(10)]),以及之前谜题中定义的函数。 - 你 不允许 使用其他任何东西。不能使用

view、sum、take、squeeze、tensor等函数。 - 你可以从以下两个函数开始:

def arange(i: int):

"使用此函数代替 for 循环。"

return torch.tensor(range(i))

draw_examples("arange", [{"" : arange(i)} for i in [5, 3, 9]])

# 广播的示例。

examples = [(arange(4), arange(5)[:, None]) ,

(arange(3)[:, None], arange(2))]

draw_examples("broadcast", [{"a": a, "b":b, "ret": a + b} for a, b in examples])

def where(q, a, b):

"使用此函数代替 if 语句。"

return (q * a) + (~q) * b

# 在图示中,橙色表示正数/True,零表示假/False,蓝色表示负数。

examples = [(tensor([False]), tensor([10]), tensor([0])),

(tensor([False, True]), tensor([1, 1]), tensor([-10, 0])),

(tensor([False, True]), tensor([1]), tensor([-10, 0])),

(tensor([[False, True], [True, False]]), tensor([1]), tensor([-10, 0])),

(tensor([[False, True], [True, False]]), tensor([[0], [10]]), tensor([-10, 0])),

]

draw_examples("where", [{"q": q, "a":a, "b":b, "ret": where(q, a, b)} for q, a, b in examples])

谜题 1 - ones

计算 ones——全为 1 的向量。

def ones_spec(out):

for i in range(len(out)):

out[i] = 1

def ones(i: int) -> TT["i"]:

raise NotImplementedError

test_ones = make_test("one", ones, ones_spec, add_sizes=["i"])

# run_test(test_ones)

谜题 2 - sum

计算 sum——向量的总和。

def sum_spec(a, out):

out[0] = 0

for i in range(len(a)):

out[0] += a[i]

def sum(a: TT["i"]) -> TT[1]:

raise NotImplementedError

test_sum = make_test("sum", sum, sum_spec)

# run_test(test_sum)

谜题 3 - outer

计算 outer——两个向量的外积。

def outer_spec(a, b, out):

for i in range(len(out)):

for j in range(len(out[0])):

out[i][j] = a[i] * b[j]

def outer(a: TT["i"], b: TT["j"]) -> TT["i", "j"]:

raise NotImplementedError

test_outer = make_test("outer", outer, outer_spec)

# run_test(test_outer)

谜题 4 - diag

计算 diag——方阵的对角线向量。

def diag_spec(a, out):

for i in range(len(a)):

out[i] = a[i][i]

def diag(a: TT["i", "i"]) -> TT["i"]:

raise NotImplementedError

test_diag = make_test("diag", diag, diag_spec)

# run_test(test_diag)

谜题 5 - eye

计算 eye——单位矩阵。

def eye_spec(out):

for i in range(len(out)):

out[i][i] = 1

def eye(j: int) -> TT["j", "j"]:

raise NotImplementedError

test_eye = make_test("eye", eye, eye_spec, add_sizes=["j"])

# run_test(test_eye)

谜题 6 - triu

计算 triu——上三角矩阵。

def triu_spec(out):

for i in range(len(out)):

for j in range(len(out)):

if i <= j:

out[i][j] = 1

else:

out[i][j] = 0

def triu(j: int) -> TT["j", "j"]:

raise NotImplementedError

test_triu = make_test("triu", triu, triu_spec, add_sizes=["j"])

# run_test(test_triu)

谜题 7 - cumsum

计算 cumsum——累积和。

def cumsum_spec(a, out):

total = 0

for i in range(len(out)):

out[i] = total + a[i]

total += a[i]

def cumsum(a: TT["i"]) -> TT["i"]:

raise NotImplementedError

test_cumsum = make_test("cumsum", cumsum, cumsum_spec)

# run_test(test_cumsum)

谜题 8 - diff

计算 diff——滚动差分。

def diff_spec(a, out):

out[0] = a[0]

for i in range(1, len(out)):

out[i] = a[i] - a[i - 1]

def diff(a: TT["i"], i: int) -> TT["i"]:

raise NotImplementedError

test_diff = make_test("diff", diff, diff_spec, add_sizes=["i"])

# run_test(test_diff)

谜题 9 - vstack

计算 vstack——两个向量组成的矩阵。

def vstack_spec(a, b, out):

for i in range(len(out[0])):

out[0][i] = a[i]

out[1][i] = b[i]

def vstack(a: TT["i"], b: TT["i"]) -> TT[2, "i"]:

raise NotImplementedError

test_vstack = make_test("vstack", vstack, vstack_spec)

# run_test(test_vstack)

谜题 10 - roll

计算 roll——向量循环右移一位。

def roll_spec(a, out):

for i in range(len(out)):

if i + 1 < len(out):

out[i] = a[i + 1]

else:

out[i] = a[i + 1 - len(out)]

def roll(a: TT["i"], i: int) -> TT["i"]:

raise NotImplementedError

test_roll = make_test("roll", roll, roll_spec, add_sizes=["i"])

# run_test(test_roll)

谜题 11 - flip

计算 flip——反转向量。

def flip_spec(a, out):

for i in range(len(out)):

out[i] = a[len(out) - i - 1]

def flip(a: TT["i"], i: int) -> TT["i"]:

raise NotImplementedError

test_flip = make_test("flip", flip, flip_spec, add_sizes=["i"])

# run_test(test_flip)

谜题 12 - compress

计算 compress——仅保留掩码标记的元素(左对齐)。

def compress_spec(g, v, out):

j = 0

for i in range(len(g)):

if g[i]:

out[j] = v[i]

j += 1

def compress(g: TT["i", bool], v: TT["i"], i:int) -> TT["i"]:

raise NotImplementedError

test_compress = make_test("compress", compress, compress_spec, add_sizes=["i"])

# run_test(test_compress)

谜题 13 - pad_to

计算 pad_to——通过删除或添加零来改变向量的大小。

def pad_to_spec(a, out):

for i in range(min(len(out), len(a))):

out[i] = a[i]

def pad_to(a: TT["i"], i: int, j: int) -> TT["j"]:

raise NotImplementedError

test_pad_to = make_test("pad_to", pad_to, pad_to_spec, add_sizes=["i", "j"])

# run_test(test_pad_to)

谜题 14 - sequence_mask

计算 sequence_mask——按批次填充到指定长度。

def sequence_mask_spec(values, length, out):

for i in range(len(out)):

for j in range(len(out[0])):

if j < length[i]:

out[i][j] = values[i][j]

else:

out[i][j] = 0

def sequence_mask(values: TT["i", "j"], length: TT["i", int]) -> TT["i", "j"]:

raise NotImplementedError

def constraint_set_length(d):

d["length"] = d["length"] % d["values"].shape[1]

return d

test_sequence = make_test("sequence_mask",

sequence_mask, sequence_mask_spec, constraint=constraint_set_length

)

# run_test(test_sequence)

谜题 15 - bincount

计算 bincount——统计每个元素出现的次数。

def bincount_spec(a, out):

for i in range(len(a)):

out[a[i]] += 1

def bincount(a: TT["i"], j: int) -> TT["j"]:

raise NotImplementedError

def constraint_set_max(d):

d["a"] = d["a"] % d["return"].shape[0]

return d

test_bincount = make_test("bincount",

bincount, bincount_spec, add_sizes=["j"], constraint=constraint_set_max

)

# run_test(test_bincount)

谜题 16 - scatter_add

计算 scatter_add——将指向同一位置的值相加。

def scatter_add_spec(values, link, out):

for j in range(len(values)):

out[link[j]] += values[j]

def scatter_add(values: TT["i"], link: TT["i"], j: int) -> TT["j"]:

raise NotImplementedError

def constraint_set_max(d):

d["link"] = d["link"] % d["return"].shape[0]

return d

test_scatter_add = make_test("scatter_add",

scatter_add, scatter_add_spec, add_sizes=["j"], constraint=constraint_set_max

)

# run_test(test_scatter_add)

谜题 17 - flatten

计算 flatten

def flatten_spec(a, out):

k = 0

for i in range(len(a)):

for j in range(len(a[0])):

out[k] = a[i][j]

k += 1

def flatten(a: TT["i", "j"], i:int, j:int) -> TT["i * j"]:

raise NotImplementedError

test_flatten = make_test("flatten", flatten, flatten_spec, add_sizes=["i", "j"])

# run_test(test_flatten)

谜题 18 - linspace

计算 linspace

def linspace_spec(i, j, out):

for k in range(len(out)):

out[k] = float(i + (j - i) * k / max(1, len(out) - 1))

def linspace(i: TT[1], j: TT[1], n: int) -> TT["n", float]:

raise NotImplementedError

test_linspace = make_test("linspace", linspace, linspace_spec, add_sizes=["n"])

# run_test(test_linspace)

谜题 19 - heaviside

计算 heaviside

def heaviside_spec(a, b, out):

for k in range(len(out)):

if a[k] == 0:

out[k] = b[k]

else:

out[k] = int(a[k] > 0)

def heaviside(a: TT["i"], b: TT["i"]) -> TT["i"]:

raise NotImplementedError

test_heaviside = make_test("heaviside", heaviside, heaviside_spec)

# run_test(test_heaviside)

谜题 20 - repeat (1d)

计算 repeat

def repeat_spec(a, d, out):

for i in range(d[0]):

for k in range(len(a)):

out[i][k] = a[k]

def constraint_set(d):

d["d"][0] = d["return"].shape[0]

return d

def repeat(a: TT["i"], d: TT[1]) -> TT["d", "i"]:

raise NotImplementedError

test_repeat = make_test("repeat", repeat, repeat_spec, constraint=constraint_set)

谜题 21 - bucketize

计算 bucketize

def bucketize_spec(v, boundaries, out):

for i, val in enumerate(v):

out[i] = 0

for j in range(len(boundaries)-1):

if val >= boundaries[j]:

out[i] = j + 1

if val >= boundaries[-1]:

out[i] = len(boundaries)

def constraint_set(d):

d["boundaries"] = np.abs(d["boundaries"]).cumsum()

return d

def bucketize(v: TT["i"], boundaries: TT["j"]) -> TT["i"]:

raise NotImplementedError

test_bucketize = make_test("bucketize", bucketize, bucketize_spec,

constraint=constraint_set)

快速通关模式!

你能把每一个函数都做得多小呢?

import inspect

fns = (ones, sum, outer, diag, eye, triu, cumsum, diff, vstack, roll, flip,

compress, pad_to, sequence_mask, bincount, scatter_add)

for fn in fns:

lines = [l for l in inspect.getsource(fn).split("\n") if not l.strip().startswith("#")]

if len(lines) > 3:

print(fn.__name__, len(lines[2]), "(超过1行)")

else:

print(fn.__name__, len(lines[1]))

ones 29

sum 29

outer 29

diag 29

eye 29

triu 29

cumsum 29

diff 29

vstack 29

roll 29

flip 29

compress 29

pad_to 29

sequence_mask 29

bincount 29

scatter_add 29

常见问题

相似工具推荐

openclaw

OpenClaw 是一款专为个人打造的本地化 AI 助手,旨在让你在自己的设备上拥有完全可控的智能伙伴。它打破了传统 AI 助手局限于特定网页或应用的束缚,能够直接接入你日常使用的各类通讯渠道,包括微信、WhatsApp、Telegram、Discord、iMessage 等数十种平台。无论你在哪个聊天软件中发送消息,OpenClaw 都能即时响应,甚至支持在 macOS、iOS 和 Android 设备上进行语音交互,并提供实时的画布渲染功能供你操控。 这款工具主要解决了用户对数据隐私、响应速度以及“始终在线”体验的需求。通过将 AI 部署在本地,用户无需依赖云端服务即可享受快速、私密的智能辅助,真正实现了“你的数据,你做主”。其独特的技术亮点在于强大的网关架构,将控制平面与核心助手分离,确保跨平台通信的流畅性与扩展性。 OpenClaw 非常适合希望构建个性化工作流的技术爱好者、开发者,以及注重隐私保护且不愿被单一生态绑定的普通用户。只要具备基础的终端操作能力(支持 macOS、Linux 及 Windows WSL2),即可通过简单的命令行引导完成部署。如果你渴望拥有一个懂你

stable-diffusion-webui

stable-diffusion-webui 是一个基于 Gradio 构建的网页版操作界面,旨在让用户能够轻松地在本地运行和使用强大的 Stable Diffusion 图像生成模型。它解决了原始模型依赖命令行、操作门槛高且功能分散的痛点,将复杂的 AI 绘图流程整合进一个直观易用的图形化平台。 无论是希望快速上手的普通创作者、需要精细控制画面细节的设计师,还是想要深入探索模型潜力的开发者与研究人员,都能从中获益。其核心亮点在于极高的功能丰富度:不仅支持文生图、图生图、局部重绘(Inpainting)和外绘(Outpainting)等基础模式,还独创了注意力机制调整、提示词矩阵、负向提示词以及“高清修复”等高级功能。此外,它内置了 GFPGAN 和 CodeFormer 等人脸修复工具,支持多种神经网络放大算法,并允许用户通过插件系统无限扩展能力。即使是显存有限的设备,stable-diffusion-webui 也提供了相应的优化选项,让高质量的 AI 艺术创作变得触手可及。

everything-claude-code

everything-claude-code 是一套专为 AI 编程助手(如 Claude Code、Codex、Cursor 等)打造的高性能优化系统。它不仅仅是一组配置文件,而是一个经过长期实战打磨的完整框架,旨在解决 AI 代理在实际开发中面临的效率低下、记忆丢失、安全隐患及缺乏持续学习能力等核心痛点。 通过引入技能模块化、直觉增强、记忆持久化机制以及内置的安全扫描功能,everything-claude-code 能显著提升 AI 在复杂任务中的表现,帮助开发者构建更稳定、更智能的生产级 AI 代理。其独特的“研究优先”开发理念和针对 Token 消耗的优化策略,使得模型响应更快、成本更低,同时有效防御潜在的攻击向量。 这套工具特别适合软件开发者、AI 研究人员以及希望深度定制 AI 工作流的技术团队使用。无论您是在构建大型代码库,还是需要 AI 协助进行安全审计与自动化测试,everything-claude-code 都能提供强大的底层支持。作为一个曾荣获 Anthropic 黑客大奖的开源项目,它融合了多语言支持与丰富的实战钩子(hooks),让 AI 真正成长为懂上

ComfyUI

ComfyUI 是一款功能强大且高度模块化的视觉 AI 引擎,专为设计和执行复杂的 Stable Diffusion 图像生成流程而打造。它摒弃了传统的代码编写模式,采用直观的节点式流程图界面,让用户通过连接不同的功能模块即可构建个性化的生成管线。 这一设计巧妙解决了高级 AI 绘图工作流配置复杂、灵活性不足的痛点。用户无需具备编程背景,也能自由组合模型、调整参数并实时预览效果,轻松实现从基础文生图到多步骤高清修复等各类复杂任务。ComfyUI 拥有极佳的兼容性,不仅支持 Windows、macOS 和 Linux 全平台,还广泛适配 NVIDIA、AMD、Intel 及苹果 Silicon 等多种硬件架构,并率先支持 SDXL、Flux、SD3 等前沿模型。 无论是希望深入探索算法潜力的研究人员和开发者,还是追求极致创作自由度的设计师与资深 AI 绘画爱好者,ComfyUI 都能提供强大的支持。其独特的模块化架构允许社区不断扩展新功能,使其成为当前最灵活、生态最丰富的开源扩散模型工具之一,帮助用户将创意高效转化为现实。

markitdown

MarkItDown 是一款由微软 AutoGen 团队打造的轻量级 Python 工具,专为将各类文件高效转换为 Markdown 格式而设计。它支持 PDF、Word、Excel、PPT、图片(含 OCR)、音频(含语音转录)、HTML 乃至 YouTube 链接等多种格式的解析,能够精准提取文档中的标题、列表、表格和链接等关键结构信息。 在人工智能应用日益普及的今天,大语言模型(LLM)虽擅长处理文本,却难以直接读取复杂的二进制办公文档。MarkItDown 恰好解决了这一痛点,它将非结构化或半结构化的文件转化为模型“原生理解”且 Token 效率极高的 Markdown 格式,成为连接本地文件与 AI 分析 pipeline 的理想桥梁。此外,它还提供了 MCP(模型上下文协议)服务器,可无缝集成到 Claude Desktop 等 LLM 应用中。 这款工具特别适合开发者、数据科学家及 AI 研究人员使用,尤其是那些需要构建文档检索增强生成(RAG)系统、进行批量文本分析或希望让 AI 助手直接“阅读”本地文件的用户。虽然生成的内容也具备一定可读性,但其核心优势在于为机器

LLMs-from-scratch

LLMs-from-scratch 是一个基于 PyTorch 的开源教育项目,旨在引导用户从零开始一步步构建一个类似 ChatGPT 的大型语言模型(LLM)。它不仅是同名技术著作的官方代码库,更提供了一套完整的实践方案,涵盖模型开发、预训练及微调的全过程。 该项目主要解决了大模型领域“黑盒化”的学习痛点。许多开发者虽能调用现成模型,却难以深入理解其内部架构与训练机制。通过亲手编写每一行核心代码,用户能够透彻掌握 Transformer 架构、注意力机制等关键原理,从而真正理解大模型是如何“思考”的。此外,项目还包含了加载大型预训练权重进行微调的代码,帮助用户将理论知识延伸至实际应用。 LLMs-from-scratch 特别适合希望深入底层原理的 AI 开发者、研究人员以及计算机专业的学生。对于不满足于仅使用 API,而是渴望探究模型构建细节的技术人员而言,这是极佳的学习资源。其独特的技术亮点在于“循序渐进”的教学设计:将复杂的系统工程拆解为清晰的步骤,配合详细的图表与示例,让构建一个虽小但功能完备的大模型变得触手可及。无论你是想夯实理论基础,还是为未来研发更大规模的模型做准备