deepwiki-rs

deepwiki-rs(又名 Litho)是一款基于 Rust 构建的高性能 AI 文档生成引擎,旨在将复杂的源代码自动转化为清晰、专业的架构文档。它能深入分析代码库,在几分钟内生成符合 C4 模型标准的完整技术文档,涵盖上下文图、容器图、组件图及代码级说明,让文档始终与代码变更保持同步。

长期以来,手动维护文档不仅耗时费力,还极易因更新滞后而导致信息失真或结构混乱。deepwiki-rs 彻底解决了这一痛点,它不再依赖人工编写易过时的 Markdown 文件,而是通过 AI 驱动自动生成结构严谨、格式统一且包含可视化图表的"Repo-Wiki",确保团队随时获取准确的架构全貌。

这款工具特别适合开发者、系统架构师及技术负责人使用。无论是需要快速理解遗留代码的新成员,还是希望降低文档维护成本的技术团队,都能从中受益。其独特的技术亮点在于采用 Rust 语言开发,保证了极高的运行性能,同时原生支持为人类团队和智能体(AI Agents)提供结构化的上下文信息,是连接代码现实与架构认知的理想桥梁。

使用场景

某金融科技公司后端团队在接手一个遗留的微服务支付系统时,急需理清复杂的模块依赖关系以进行重构,但原有文档已严重滞后于代码现状。

没有 deepwiki-rs 时

- 架构文档停留在两年前的版本,与新上线的支付网关和风控模块完全脱节,开发人员只能靠“猜”来理解代码逻辑。

- 手动绘制 C4 架构图耗时费力,每次代码迭代后图表迅速过时,导致技术评审会上因信息不准而频繁争论。

- 新入职工程师需要花费数周时间阅读源码才能梳理出数据流向,严重拖慢了故障排查和功能开发进度。

- 缺乏统一的文档结构,不同成员编写的说明文件格式混乱,难以形成系统性的知识库供 AI 助手学习。

使用 deepwiki-rs 后

- deepwiki-rs 自动扫描最新代码库,瞬间生成与当前生产环境完全同步的精准架构文档,消除了信息偏差。

- 基于 C4 模型自动生成上下文图、容器图和组件图,将原本需要数天的绘图工作缩短至几分钟,且随代码提交实时更新。

- 清晰的层级结构和自动提取的代码级文档,让新成员能在一天内掌握核心支付链路,大幅降低上手门槛。

- 输出标准化、结构化的技术内容,不仅便于人类团队查阅,更为内部 AI 编程助手提供了高质量的上下文语境。

deepwiki-rs 将原本滞后的文档负担转化为实时的架构资产,让团队能专注于业务创新而非维护过时的说明书。

运行环境要求

- 未说明

未说明

未说明

快速开始

Litho(deepwiki-rs)

💪🏻 基于Rust构建的高性能、AI驱动的智能文档生成器(类似DeepWiki)

📚 自动为任何代码库生成高质量的Repo-Wiki

👋 什么是Litho

Litho是一款基于AI的文档生成引擎,能够自动分析您的源代码,并以C4模型格式生成全面、专业的架构文档。再也不用担心手动维护的文档会落后于代码变更——Litho可以让您的文档始终与代码库保持完美同步。

Litho将原始代码转化为结构清晰、内容丰富的文档,包括上下文图、容器图、组件图以及代码级别的详细说明,所有这些都由您的源代码自动生成。

无论您是开发者、架构师还是技术负责人,Litho都能减轻您维护文档的负担,确保团队始终拥有准确、最新的架构信息。

在几分钟内将您的代码库转化为专业架构文档

| 使用Litho之前 | 使用Litho之后 |

|---|---|

|

手动维护的文档

|

AI生成的文档

|

🚀 Litho可以自动将凌乱的代码库转化为美观、专业的文档

😺 为什么选择Litho

- 自动保持文档与代码库同步,不再有陈旧过时的文档

- 节省数百小时的手动文档编写和维护时间

- 改善新成员入职体验,提供全面、最新的文档支持

- 提升代码评审效率,通过清晰的架构背景信息辅助决策

- 满足合规性要求,提供可审计的自动化文档

- 支持多种编程语言(Rust、Python、Java、Go、C#、JavaScript等)

- 生成专业的C4模型图,涵盖上下文、容器、组件及代码细节

- 集成CI/CD流水线,实现每次提交自动更新文档

🌟 适用人群:

- 各规模的开发团队

- 开源项目

- 企业级软件开发人员

- 所有讨厌维护过时文档的人!

❤️ 如果您喜欢Litho,请给它点个星🌟,或者赞助我!❤️

感谢各位的支持

🌠 功能与特性

核心能力

- 基于代码分析的AI驱动架构文档生成

- 自动创建C4模型图(上下文、容器、组件、代码)

- 智能提取代码注释、结构和关系

- 多语言支持,覆盖多种编程语言

- 可定制的文档输出模板系统

高级特性

- 外部知识整合:挂载外部文档(PDF、Markdown、SQL等)作为知识源,增强分析能力

- 数据库文档:为SQL项目自动生成包含ERD图的数据库模式文档

- Git历史分析,追踪架构演进过程

- 代码元素与文档之间的交叉引用

- 嵌入式图表和示例的交互式文档

- 与CI/CD流水线集成,实现自动化文档生成

💡 解决的问题

Litho解决了技术文档过时、不完整这一常见问题,通过自动从源代码中生成最新架构文档来实现。再也不用担心手动维护的文档会落后于代码变更——Litho让您的文档始终与代码库保持一致。

🌐 Litho生态体系

Litho是更广泛工具生态系统的一部分,旨在提升开发者的生产力和文档质量。Litho生态体系包含一系列与Litho无缝协作的互补工具,共同构成完整的文档工作流:

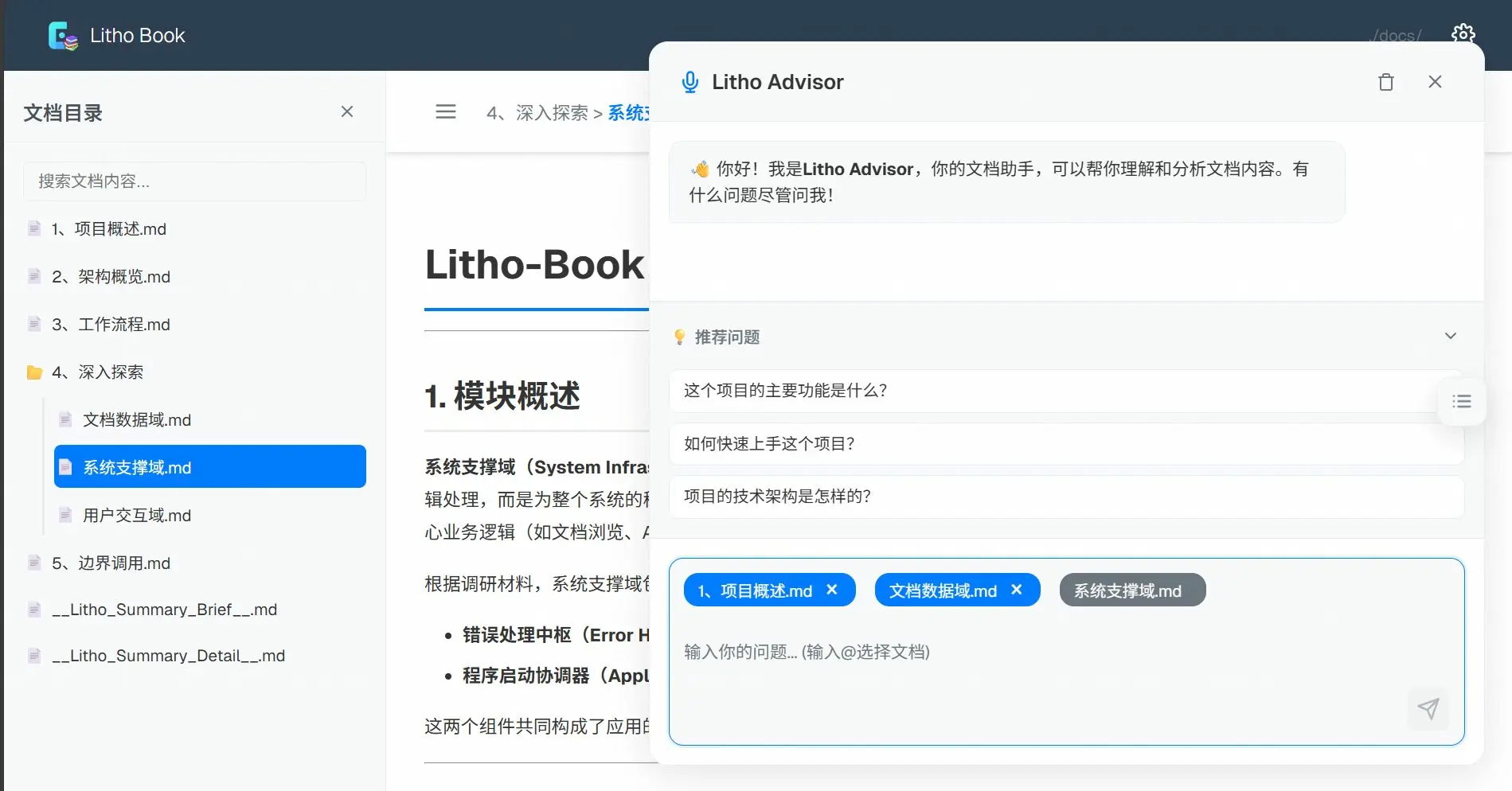

📘 Litho Book

Litho Book是一款基于Rust和Axum构建的高性能Markdown阅读器,专为优雅地浏览Litho生成的文档而设计。

核心功能

- 实时 Markdown 渲染,支持语法高亮

- 完整支持 Mermaid 图表,用于架构图绘制

- 智能搜索,支持文件和内容的模糊匹配

- 高性能架构,内存占用低

- AI 智能文档解析与问答

🌠 截图

|

|

与 Litho 的集成

Litho Book 是消费 Litho 生成文档的理想配套应用。典型的工作流程如下:

- 使用 Litho 从代码库中生成文档

- 使用 Litho Book 通过优雅的界面浏览和探索生成的文档

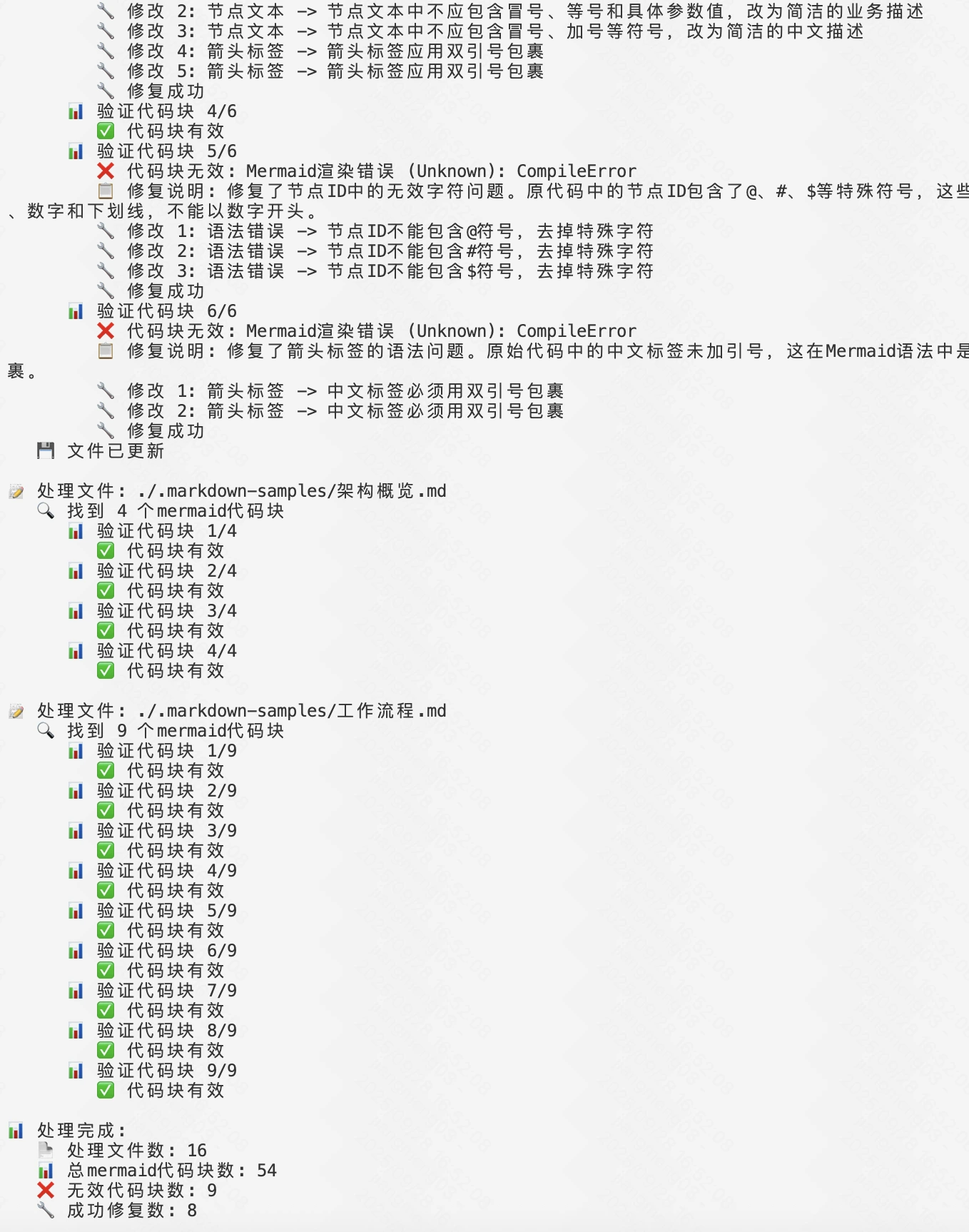

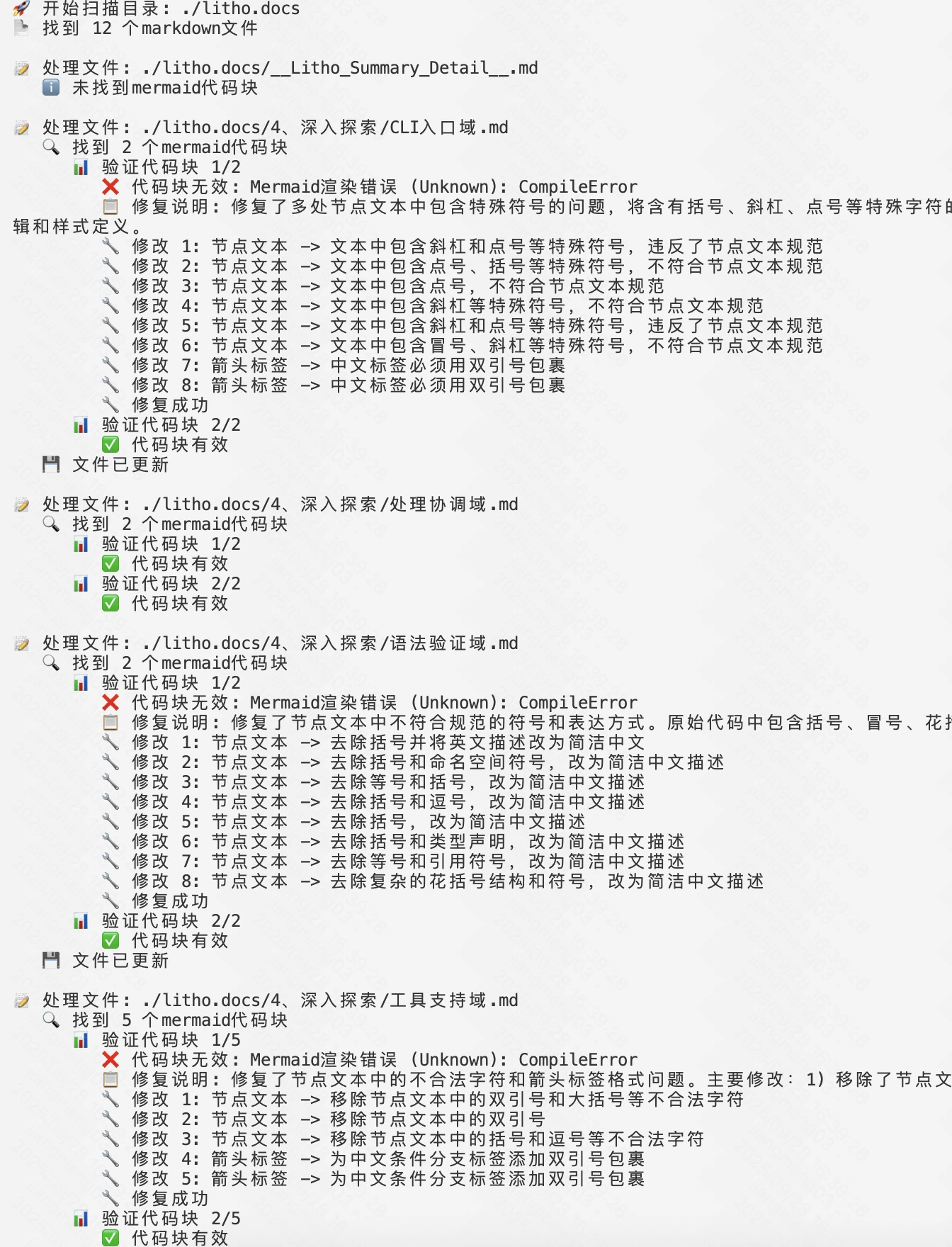

🔧 Mermaid Fixer

Mermaid Fixer 是一款高性能的 AI 驱动工具,能够自动检测并修复 Markdown 文件中 Mermaid 图表的语法错误。

核心功能

- 自动扫描目录中的 Markdown 文件

- 使用 JS 沙箱验证精准检测 Mermaid 语法错误

- 基于 LLM 的智能修复

- 提供修复前后的全面报告

- 灵活的配置,支持多种 LLM 提供商

与 Litho 的集成

Mermaid Fixer 通过自动修复 Mermaid 图表中的语法错误,提升了 Litho 生成文档的质量。这确保了文档中的所有架构图都是有效的,并能正确渲染。

👀 截图

|

|

🤖Agent 技能

🧠 工作原理

四阶段处理流程

Litho 的架构围绕一个四阶段处理流程设计,该流程将原始代码转换为全面的文档:

flowchart TD

A[输入:源代码仓库] --> B[阶段 1:预处理]

B --> C[阶段 2:智能研究与分析]

C --> D[阶段 3:文档生成]

D --> E[阶段 4:验证与增强]

E --> F[输出:高质量技术文档]

subgraph 预处理阶段

B1[代码扫描与发现]

B2[多语言语法分析]

B3[结构与依赖提取]

B4[代码洞察生成]

B5[Agent 内存块初始化]

B --> B1 --> B2 --> B3 --> B4 --> B5

end

subgraph 智能研究与分析阶段

C1[系统上下文研究员]

C2[领域模块检测器]

C3[工作流研究员]

C4[边界分析仪]

C5[关键模块洞察官]

C6[Agent 内存块读写]

C7[ReAct 推理循环]

C --> C1 --> C2 --> C3 --> C4 --> C5 --> C6 --> C7

end

subgraph 文档生成阶段

D1[概览文档编辑器]

D2[架构文档编辑器]

D3[工作流文档编辑器]

D4[边界文档编辑器]

D5[关键模块编辑器]

D6[Agent 内存块读取]

D7[高质量文档组装]

D --> D1 --> D2 --> D3 --> D4 --> D5 --> D6 --> D7

end

subgraph 验证与增强阶段

E1[Mermaid 语法验证]

E2[文档完整性检查]

E3[图表自动修复]

E4[质量报告生成]

E5[最终文档输出]

E --> E1 --> E2 --> E3 --> E4 --> E5

end

style B fill:#e3f2fd,stroke:#1976d2

style C fill:#f3e5f5,stroke:#7b1fa2

style D fill:#e8f5e8,stroke:#388e3c

style E fill:#fff3e0,stroke:#e65100

预处理阶段

Litho 首先会扫描整个代码库,以识别源文件、提取元数据并分析项目结构。此阶段:

- 发现多种语言的所有源代码文件

- 解析文件结构并识别关键组件

- 提取注释、文档字符串和代码标注

- 识别模块和组件之间的依赖关系

- 构建代码库的全面表示

flowchart TD

A[预处理代理] --> B[结构提取器]

A --> C[原始文档提取器]

A --> D[代码分析代理]

A --> E[关系分析代理]

B --> F[项目结构]

C --> G[原始文档材料]

D --> H[核心代码洞察]

E --> I[代码依赖关系]

F --> J[存储到内存]

G --> J

H --> J

I --> J

研究阶段

在这个由 AI 驱动的阶段,Litho 会分析代码结构以理解架构意图:

- 应用机器学习模型来识别模式和关系

- 根据代码结构和命名规范推断架构角色

- 确定组件边界和服务职责

- 绘制组件之间的依赖关系和数据流

- 识别潜在的架构异味和反模式

- 为每个组件生成上下文感知的文档

flowchart TD

A[研究编排器] --> B[系统上下文研究员]

A --> C[领域模块检测器]

A --> D[架构研究员]

A --> E[工作流研究员]

A --> F[关键模块洞察]

B --> G[系统上下文报告]

C --> H[领域模块报告]

D --> I[架构分析报告]

E --> J[工作流分析报告]

F --> K[模块深度洞察]

G --> 内存

H --> 内存

I --> 内存

J --> 内存

K --> 内存

组合与输出阶段

Litho 将分析后的信息组合成结构化的文档格式:

- 生成 C4 模型图(上下文、容器、组件、代码)

- 创建具有清晰导航的层次化文档结构

- 嵌入相关的代码示例和解释

- 对所有文档应用一致的样式和格式

- 添加相关组件和图表之间的交叉引用

flowchart TD

A[文档编排器] --> B[概览编辑器]

A --> C[架构编辑器]

A --> D[模块洞察编辑器]

B --> E[概述文档]

C --> F[架构文档]

D --> G[模块文档]

E --> H[文档树]

F --> H

G --> H

H --> I[磁盘输出]

I --> J[输出目录]

验证与增强阶段

最后阶段确保文档的质量和完整性:

- 验证图表语法和一致性

- 检查文档覆盖是否完整

- 识别文档中的空白并提出改进建议

- 与 Mermaid Fixer 集成,确保所有图表正确渲染

- 生成文档覆盖率的统计和报告

- 创建索引和目录以便于导航

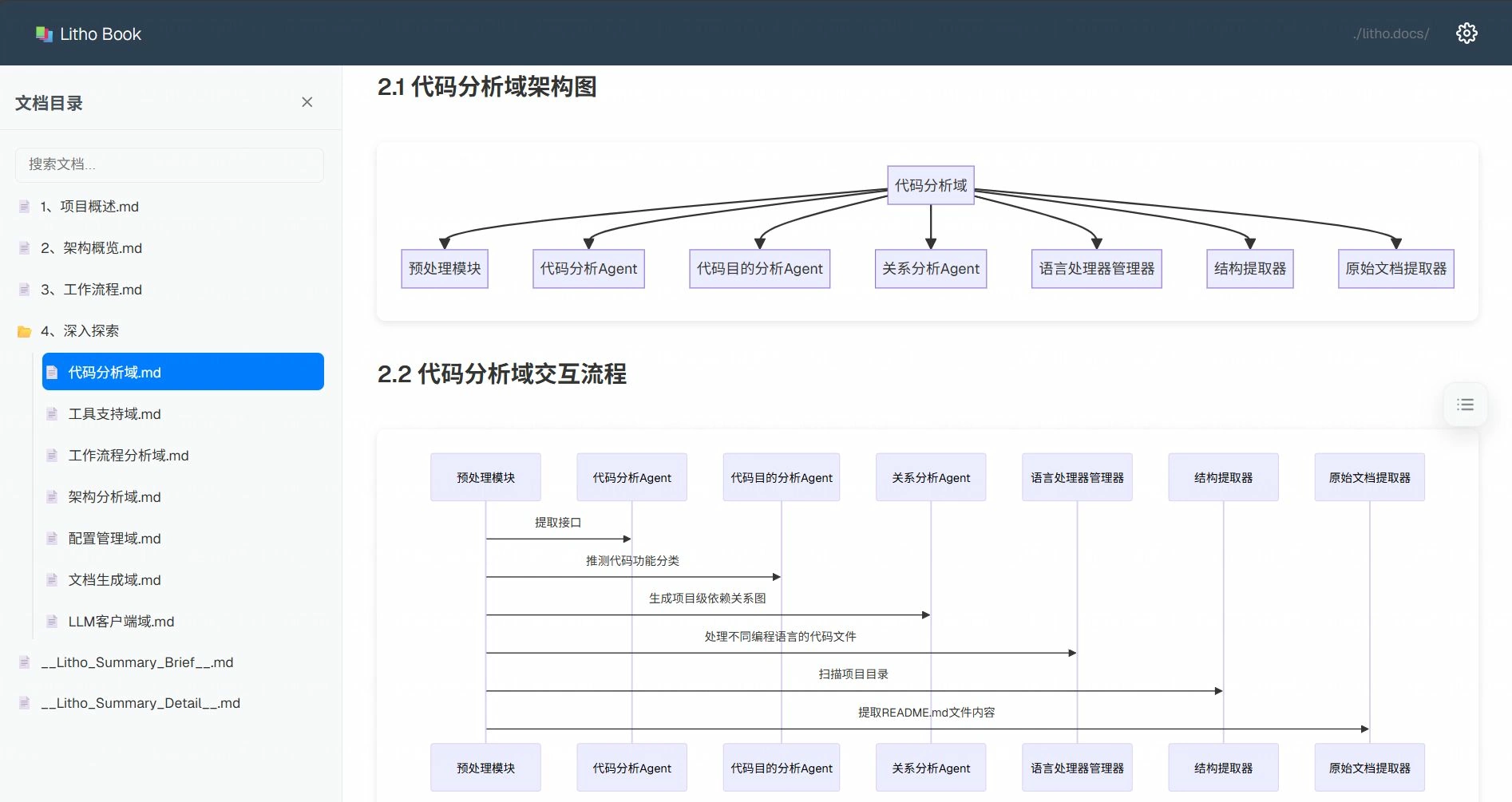

🏗️ 架构概述

Litho 具有复杂的模块化架构设计,旨在实现高性能、可扩展性和智能分析。该系统采用多阶段工作流程,配备专门的 AI 代理和全面的缓存机制。

graph LR

subgraph 输入阶段

A[CLI 启动] --> B[加载配置]

B --> C[扫描结构]

C --> D[提取 README]

end

subgraph 分析阶段

D --> E[语言解析]

E --> F[AI 增强分析]

F --> G[存储到内存]

end

subgraph 推理阶段

G --> H[编排器启动]

H --> I[系统上下文分析]

H --> J[领域模块检测]

H --> K[工作流分析]

H --> L[关键模块洞察]

I --> M[存储到内存]

J --> M

K --> M

L --> M

end

subgraph 编排阶段

M --> N[编排中心启动]

N --> O[生成项目概览]

N --> P[生成架构图]

N --> Q[生成工作流文档]

N --> R[生成模块洞察]

O --> S[写入 DocTree]

P --> S

Q --> S

R --> S

end

subgraph 输出阶段

S --> T[持久化文档]

T --> U[生成总结报告]

end

核心模块

Litho 的架构由多个相互连接的模块组成,协同工作以实现无缝的文档生成:

- 代码扫描器:发现并分析多种语言的源代码文件

- 语言解析器:使用特定于语言的解析器从代码中提取结构信息

- 架构分析器:基于 AI 的组件,用于推断架构模式和关系

- 图表生成器:使用 Mermaid 语法创建 C4 模型图

- 文档格式化器:将内容组织成结构化的可导航文档

核心流程

核心处理流程遵循确定性的管道:

- 扫描 - 发现并分析源代码文件

- 解析 - 提取结构和语义信息

- 分析 - 应用 AI 模型推断架构和关系

- 生成 - 创建图表和文档内容

- 格式化 - 将内容组织成结构化的文档

- 导出 - 以所需格式输出

sequenceDiagram

participant Main as main.rs

participant Workflow as workflow.rs

participant Context as GeneratorContext

participant Preprocess as PreProcessAgent

participant Research as ResearchOrchestrator

participant Doc as DocumentationOrchestrator

participant Outlet as DiskOutlet

Main->>Workflow : launch(config)

Workflow->>Context : Create context (LLM, Cache, Memory)

Workflow->>Preprocess : execute(context)

Preprocess->>Context : Store project structure and metadata

Context-->>Workflow : Preprocessing complete

Workflow->>Research : execute_research_pipeline(context)

Research->>Research : Execute multiple research agents in parallel

loop Each Research Agent

Research->>StepForwardAgent : execute(context)

StepForwardAgent->>Context : Validate data sources

StepForwardAgent->>AgentExecutor : Call prompt or extract

AgentExecutor->>LLMClient : Initiate LLM request

LLMClient->>CacheManager : Check cache

alt Cache hit

CacheManager-->>LLMClient : Return cached result

else Cache miss

LLMClient->>LLM : Call LLM API

LLM-->>LLMClient : Return raw response

LLMClient->>CacheManager : Store result to cache

end

LLMClient-->>AgentExecutor : Return processed result

AgentExecutor-->>StepForwardAgent : Return result

StepForwardAgent->>Context : Store result to Memory

end

Research-->>Workflow : Research complete

Workflow->>Doc : execute(context, doc_tree)

Doc->>Doc : Call multiple composition agents to generate docs

Doc-->>Workflow : Documentation generation complete

Workflow->>Outlet : save(context)

Outlet-->>Workflow : Storage complete

Workflow-->>Main : Process finished

🖥 开始使用

前置条件

安装

选项 1:从 crates.io 安装(推荐)

cargo install deepwiki-rs

选项 2:从源码构建

- 克隆仓库:

git clone https://github.com/sopaco/deepwiki-rs.git - 进入项目目录:

cd deepwiki-rs - 构建项目:

cargo build --release - 编译后的二进制文件将位于

target/release目录中。

🚀 使用方法

Litho 提供了一个简单的命令行界面,用于从您的代码库生成文档。更多配置参数,请参阅 CLI 选项详情。

基本命令

deepwiki-rs -p ./my-project -o ./docs

# 以目标语言生成文档。

deepwiki-rs --target-language en -p ./my-project

deepwiki-rs --target-language ja -p ./my-project

此命令将:

- 扫描

./my-project中的所有文件 - 分析代码结构和关系

- 生成全面的 C4 架构文档

- 将输出保存到

./litho.docs目录。

文档生成

Litho 支持多种文档生成选项:

# 使用默认设置生成文档

deepwiki-rs 跳过生成流程中的某些处理阶段

deepwiki-rs --skip-preprocessing --skip-research

高级选项

# 关闭 ReAct 模式,避免通过工具调用自动扫描项目文件

deepwiki-rs -p ./src --disable-preset-tools --llm-api-base-url <your llm provider base-api> --llm-api-key <your api key> --model-efficient GPT-5-mini

# 同时设置高效模型和强大模型

deepwiki-rs -p ./src --model-efficient GPT-5-mini --model-poweruful GPT-5-Pro --llm-api-base-url <your llm provider base-api> --llm_api_key <your api key> --model-efficient GPT-5-mini

📚 外部知识集成

Litho 支持挂载外部文档作为知识源,以增强生成文档的业务背景和架构决策信息。

支持的文档类型

- PDF - 架构图、设计文档

- Markdown - 技术文档、ADR

- SQL - 数据库模式文件

- YAML/JSON - API 规范(OpenAPI)、配置文件

- 文本 - 纯文本文档

知识类别

文档被组织成不同的类别,以便有针对性地传递给特定的代理:

architecture- 系统架构和 C4 模型文档database- 模式、ERD 和数据模型文档api- API 规范和端点文档deployment- 基础设施和 DevOps 文档adr- 架构决策记录workflow- 业务流程和工作流general- 未分类的一般文档

同步知识命令

# 同步外部知识源(处理并缓存本地文档)

deepwiki-rs sync-knowledge

# 即使缓存最新也强制同步

deepwiki-rs sync-knowledge --force

配置示例(litho.toml)

[knowledge.local_docs]

enabled = true

cache_dir = ".litho/cache/knowledge/local_docs"

watch_for_changes = true

# 大型文档的默认分块设置

[knowledge.local_docs.default_chunking]

enabled = true

max_chunk_size = 8000

chunk_overlap = 200

strategy = "semantic" # 选项:语义、段落、固定

min_size_for_chunking = 10000

# 架构文档类别

[[knowledge.local_docs.categories]]

name = "architecture"

description = "系统架构文档"

paths = [

"docs/architecture/**/*.md",

"docs/design/**/*.pdf"

]

target_agents = [

"SystemContextResearcher",

"ArchitectureResearcher",

"ArchitectureEditor"

]

# 数据库文档类别

[[knowledge.local_docs.categories]]

name = "database"

description = "数据库模式文档"

paths = [

"docs/database/**/*.md",

"docs/schema/**/*.sql"

]

target_agents = [

"ArchitectureResearcher",

"DomainModulesDetector",

"KeyModulesInsight"

]

🗄️ 数据库文档

Litho 会自动分析 SQL 数据库项目(.sqlproj)和 SQL 文件,生成全面的数据库文档,包括:

- 数据库项目 - SQL Server 项目结构

- 表 - 模式、列、数据类型、约束、主键

- 视图 - 视图定义及引用的表

- 存储过程 - 参数、操作、访问的表

- 函数 - 标量函数和表值函数

- 关系 - 外键和隐式引用(附带 ERD 图)

- 数据流 - ETL 操作和数据流动模式

数据库分析功能

📊 数据库代码分布:项目(2) SQL 文件(15) DAO(3)

✅ 数据库概览分析已完成:

- 数据库项目:2 项

- 表:12 项

- 视图:5 项

- 存储过程:8 项

- 函数:3 项

- 表关系:6 项

- 数据流:4 项

- 置信度:8.5/10

生成的数据库文档

数据库文档会自动包含在输出中,名为 6.Database-Overview.md,内容包括:

- 概要统计表

- 包含列定义的详细表模式

- 展示关系的 Mermaid ER 图

- 存储过程文档

- 数据流动描述

📁 输出结构

Litho 会生成一个组织良好的文档结构:

project-docs/

├── 1. Project Overview # 项目概述、核心功能、技术栈

├── 2. Architecture Overview # 整体架构、核心模块、模块分解

├── 3. Workflow Overview # 整体流程、核心流程

├── 4. Deep Dive/ # 详细的技术主题实现文档

│ ├── Topic1.md

│ ├── Topic2.md

├── 5. Boundary-Interfaces # API 端点、外部集成

├── 6. Database-Overview # 数据库模式、表、关系(仅限 SQL 项目)

🤝 贡献

我们欢迎任何形式的贡献!请通过 GitHub Issues 报告错误或提交功能请求。

贡献方式

- 语言支持:增加对其他编程语言的支持

- 模板创建:设计新的文档模板和样式

- 图表优化:改进 Mermaid 图表生成算法

- 性能优化:提升处理速度和内存使用效率

- 测试覆盖:为各种代码模式添加全面的测试用例

- 文档编写:完善项目文档和使用指南

- Bug 修复:帮助识别并修复代码库中的问题

开发贡献流程

- Fork 该项目

- 创建一个特性分支(

git checkout -b feature/amazing-feature) - 提交你的更改(

git commit -m '添加一项超赞功能') - 推送到该分支(

git push origin feature/amazing-feature) - 创建一个 Pull Request

🪪 许可证

MIT。许可证副本已在 LICENSE 文件中提供。

👨 关于我

🚀 通过在 GitHub 上赞助 来帮助我更好地开发这款软件

作为一名经验丰富的互联网老兵,我经历了个人电脑互联网、移动互联网和人工智能应用的浪潮。从一名独立的移动应用开发者到企业界的从业者,我在产品设计与研发方面积累了丰富的经验。目前就职于 快手,专注于通用前端系统的研发及人工智能领域的探索。

GitHub:sopaco

版本历史

1.5.02026/04/051.3.02026/03/101.2.82026/02/011.2.62025/11/241.2.52025/11/191.2.32025/11/171.2.12025/11/111.2.02025/10/301.1.72025/10/161.1.52025/10/141.1.02025/10/131.0.02025/10/060.9.112025/10/05常见问题

相似工具推荐

openclaw

OpenClaw 是一款专为个人打造的本地化 AI 助手,旨在让你在自己的设备上拥有完全可控的智能伙伴。它打破了传统 AI 助手局限于特定网页或应用的束缚,能够直接接入你日常使用的各类通讯渠道,包括微信、WhatsApp、Telegram、Discord、iMessage 等数十种平台。无论你在哪个聊天软件中发送消息,OpenClaw 都能即时响应,甚至支持在 macOS、iOS 和 Android 设备上进行语音交互,并提供实时的画布渲染功能供你操控。 这款工具主要解决了用户对数据隐私、响应速度以及“始终在线”体验的需求。通过将 AI 部署在本地,用户无需依赖云端服务即可享受快速、私密的智能辅助,真正实现了“你的数据,你做主”。其独特的技术亮点在于强大的网关架构,将控制平面与核心助手分离,确保跨平台通信的流畅性与扩展性。 OpenClaw 非常适合希望构建个性化工作流的技术爱好者、开发者,以及注重隐私保护且不愿被单一生态绑定的普通用户。只要具备基础的终端操作能力(支持 macOS、Linux 及 Windows WSL2),即可通过简单的命令行引导完成部署。如果你渴望拥有一个懂你

stable-diffusion-webui

stable-diffusion-webui 是一个基于 Gradio 构建的网页版操作界面,旨在让用户能够轻松地在本地运行和使用强大的 Stable Diffusion 图像生成模型。它解决了原始模型依赖命令行、操作门槛高且功能分散的痛点,将复杂的 AI 绘图流程整合进一个直观易用的图形化平台。 无论是希望快速上手的普通创作者、需要精细控制画面细节的设计师,还是想要深入探索模型潜力的开发者与研究人员,都能从中获益。其核心亮点在于极高的功能丰富度:不仅支持文生图、图生图、局部重绘(Inpainting)和外绘(Outpainting)等基础模式,还独创了注意力机制调整、提示词矩阵、负向提示词以及“高清修复”等高级功能。此外,它内置了 GFPGAN 和 CodeFormer 等人脸修复工具,支持多种神经网络放大算法,并允许用户通过插件系统无限扩展能力。即使是显存有限的设备,stable-diffusion-webui 也提供了相应的优化选项,让高质量的 AI 艺术创作变得触手可及。

everything-claude-code

everything-claude-code 是一套专为 AI 编程助手(如 Claude Code、Codex、Cursor 等)打造的高性能优化系统。它不仅仅是一组配置文件,而是一个经过长期实战打磨的完整框架,旨在解决 AI 代理在实际开发中面临的效率低下、记忆丢失、安全隐患及缺乏持续学习能力等核心痛点。 通过引入技能模块化、直觉增强、记忆持久化机制以及内置的安全扫描功能,everything-claude-code 能显著提升 AI 在复杂任务中的表现,帮助开发者构建更稳定、更智能的生产级 AI 代理。其独特的“研究优先”开发理念和针对 Token 消耗的优化策略,使得模型响应更快、成本更低,同时有效防御潜在的攻击向量。 这套工具特别适合软件开发者、AI 研究人员以及希望深度定制 AI 工作流的技术团队使用。无论您是在构建大型代码库,还是需要 AI 协助进行安全审计与自动化测试,everything-claude-code 都能提供强大的底层支持。作为一个曾荣获 Anthropic 黑客大奖的开源项目,它融合了多语言支持与丰富的实战钩子(hooks),让 AI 真正成长为懂上

ComfyUI

ComfyUI 是一款功能强大且高度模块化的视觉 AI 引擎,专为设计和执行复杂的 Stable Diffusion 图像生成流程而打造。它摒弃了传统的代码编写模式,采用直观的节点式流程图界面,让用户通过连接不同的功能模块即可构建个性化的生成管线。 这一设计巧妙解决了高级 AI 绘图工作流配置复杂、灵活性不足的痛点。用户无需具备编程背景,也能自由组合模型、调整参数并实时预览效果,轻松实现从基础文生图到多步骤高清修复等各类复杂任务。ComfyUI 拥有极佳的兼容性,不仅支持 Windows、macOS 和 Linux 全平台,还广泛适配 NVIDIA、AMD、Intel 及苹果 Silicon 等多种硬件架构,并率先支持 SDXL、Flux、SD3 等前沿模型。 无论是希望深入探索算法潜力的研究人员和开发者,还是追求极致创作自由度的设计师与资深 AI 绘画爱好者,ComfyUI 都能提供强大的支持。其独特的模块化架构允许社区不断扩展新功能,使其成为当前最灵活、生态最丰富的开源扩散模型工具之一,帮助用户将创意高效转化为现实。

markitdown

MarkItDown 是一款由微软 AutoGen 团队打造的轻量级 Python 工具,专为将各类文件高效转换为 Markdown 格式而设计。它支持 PDF、Word、Excel、PPT、图片(含 OCR)、音频(含语音转录)、HTML 乃至 YouTube 链接等多种格式的解析,能够精准提取文档中的标题、列表、表格和链接等关键结构信息。 在人工智能应用日益普及的今天,大语言模型(LLM)虽擅长处理文本,却难以直接读取复杂的二进制办公文档。MarkItDown 恰好解决了这一痛点,它将非结构化或半结构化的文件转化为模型“原生理解”且 Token 效率极高的 Markdown 格式,成为连接本地文件与 AI 分析 pipeline 的理想桥梁。此外,它还提供了 MCP(模型上下文协议)服务器,可无缝集成到 Claude Desktop 等 LLM 应用中。 这款工具特别适合开发者、数据科学家及 AI 研究人员使用,尤其是那些需要构建文档检索增强生成(RAG)系统、进行批量文本分析或希望让 AI 助手直接“阅读”本地文件的用户。虽然生成的内容也具备一定可读性,但其核心优势在于为机器

LLMs-from-scratch

LLMs-from-scratch 是一个基于 PyTorch 的开源教育项目,旨在引导用户从零开始一步步构建一个类似 ChatGPT 的大型语言模型(LLM)。它不仅是同名技术著作的官方代码库,更提供了一套完整的实践方案,涵盖模型开发、预训练及微调的全过程。 该项目主要解决了大模型领域“黑盒化”的学习痛点。许多开发者虽能调用现成模型,却难以深入理解其内部架构与训练机制。通过亲手编写每一行核心代码,用户能够透彻掌握 Transformer 架构、注意力机制等关键原理,从而真正理解大模型是如何“思考”的。此外,项目还包含了加载大型预训练权重进行微调的代码,帮助用户将理论知识延伸至实际应用。 LLMs-from-scratch 特别适合希望深入底层原理的 AI 开发者、研究人员以及计算机专业的学生。对于不满足于仅使用 API,而是渴望探究模型构建细节的技术人员而言,这是极佳的学习资源。其独特的技术亮点在于“循序渐进”的教学设计:将复杂的系统工程拆解为清晰的步骤,配合详细的图表与示例,让构建一个虽小但功能完备的大模型变得触手可及。无论你是想夯实理论基础,还是为未来研发更大规模的模型做准备