OmniXAI

OmniXAI 是一个专为可解释人工智能(XAI)打造的 Python 开源库,旨在帮助开发者轻松理解机器学习模型背后的决策逻辑。在实际应用中,许多复杂的 AI 模型如同“黑盒”,让人难以知晓其为何做出特定预测,OmniXAI 正是为了解决这一痛点而生。它提供了一套统一且易用的接口,支持表格、图像、文本和时间序列等多种数据类型,兼容 Scikit-learn 等传统机器学习框架以及 PyTorch、TensorFlow 等深度学习模型。

无论是数据科学家、机器学习研究人员还是工程实践者,都能通过 OmniXAI 快速生成特征归因、反事实解释、梯度分析等多样化的解释结果。除了代码调用,它还配备了直观的图形化仪表盘,让用户能可视化地探索模型行为,获得更深层的洞察。值得一提的是,最新版本还创新性地集成了基于 GPT 的实验性解释器,能够结合 SHAP 和 MACE 的计算结果,利用大语言模型生成自然流畅的文字解释,进一步降低了理解门槛。如果你希望在构建可信 AI 的过程中让模型决策更加透明,OmniXAI 将是一个得力的助手。

使用场景

某金融风控团队正在构建基于机器学习的信贷审批系统,急需向监管机构和业务方解释模型为何拒绝特定用户的贷款申请。

没有 OmniXAI 时

- 解释方法分散且割裂:团队需分别调用 SHAP、LIME 等不同库处理表格数据,代码冗余且接口不统一,维护成本极高。

- 多模态支持缺失:当引入用户上传的收入证明(图像)或征信描述(文本)时,缺乏统一框架生成连贯的解释,导致多源数据决策成“黑盒”。

- 沟通效率低下:生成的特征重要性图表过于技术化,业务人员难以理解,无法向被拒客户清晰说明具体原因,易引发合规投诉。

- 反事实分析困难:难以快速计算“若用户收入增加多少即可获批”等反事实场景,限制了模型对用户的指导价值。

使用 OmniXAI 后

- 统一接口高效集成:OmniXAI 提供标准化接口,一行代码即可切换多种解释算法,完美兼容 Scikit-learn 与 PyTorch 模型,开发效率提升 50%。

- 全数据类型覆盖:利用其内置能力,团队轻松实现了对表格、图像及文本数据的联合解释,确保复杂审批逻辑透明可见。

- 自然语言智能解读:借助最新的 GPT 解释器功能,OmniXAI 将复杂的 SHAP 值转化为通俗易懂的自然语言报告,直接用于客户通知,显著降低沟通门槛。

- 交互式反事实推演:通过内置的反事实解释模块,快速生成具体的改进建议(如“负债率降低 5% 即可通过),增强了模型的辅助决策能力。

OmniXAI 通过一站式可解释性方案,将晦涩的模型决策转化为透明、可信且具行动指导意义的业务洞察。

运行环境要求

未说明(支持 PyTorch/TensorFlow 模型,部分视觉解释方法如 Grad-CAM 可能需要 GPU,但无具体型号或显存要求)

未说明

快速开始

OmniXAI:可解释人工智能库

目录

最新动态

最新版本引入了一个实验性的 GPT 解释器。该解释器利用 SHAP 和 MACE 的输出结果,为 ChatGPT 构建输入提示。随后,ChatGPT 分析这些结果并生成相应的解释,帮助开发者更清晰地理解模型预测背后的逻辑。

简介

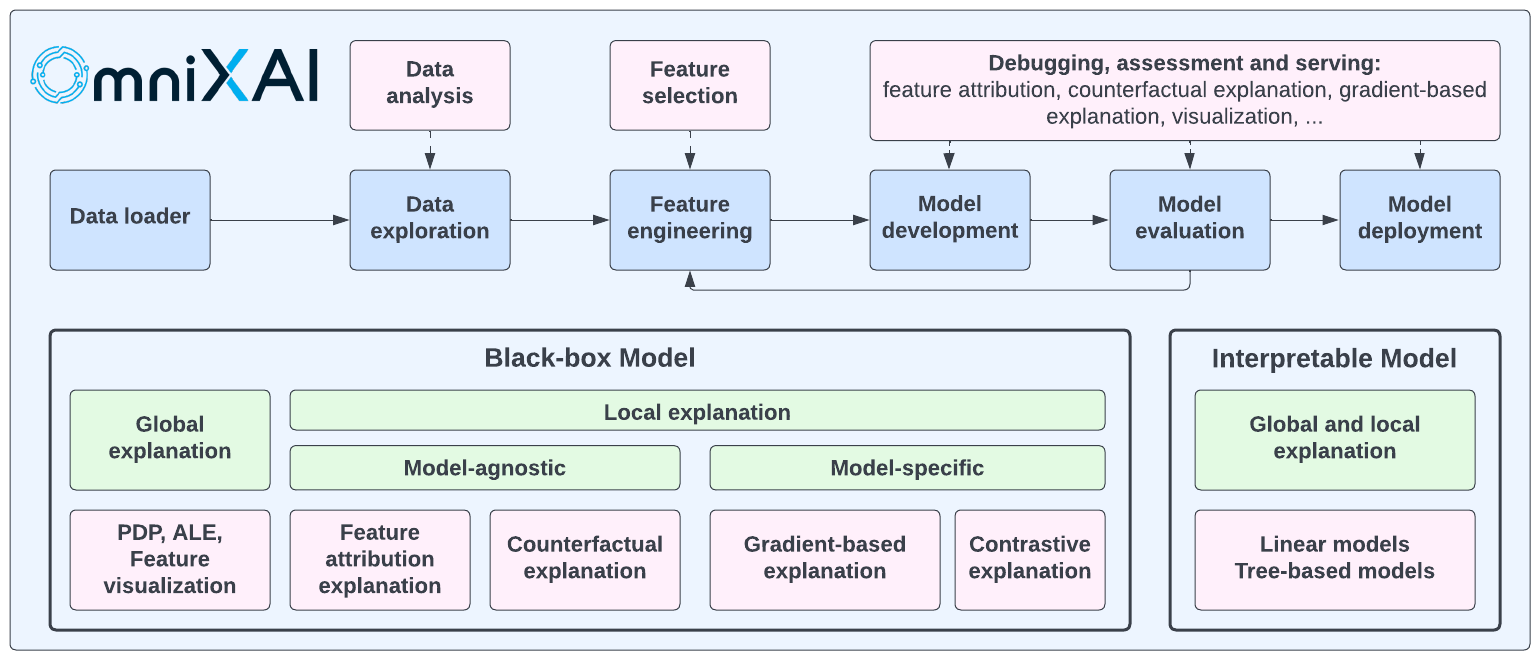

OmniXAI(全栈可解释人工智能的简称)是一个用于可解释人工智能(XAI)的 Python 机器学习库,提供全方位的可解释性和可解释性机器学习能力,以解决实际应用中机器学习模型决策解释方面的诸多痛点。OmniXAI 致力于成为一站式综合库,让数据科学家、机器学习研究人员和从业者能够轻松实现可解释人工智能,适用于不同类型的数据、模型以及不同机器学习阶段的各种解释方法:

OmniXAI 包含一个丰富的解释方法家族,并通过统一的接口进行集成,支持多种数据类型(表格数据、图像、文本、时间序列)、多种机器学习模型(Scikit-learn 中的传统机器学习模型以及 PyTorch/TensorFlow 中的深度学习模型),以及一系列多样化的解释方法,包括“模型特定”和“模型无关”的方法(如特征归因解释、反事实解释、基于梯度的解释、特征可视化等)。对于实践者而言,OmniXAI 提供了一个易于使用的统一接口,只需编写几行代码即可为其应用生成解释;同时,还配备了一个 GUI 仪表板,用于可视化展示,从而获得对决策的更多洞察。

下表展示了我们库中支持的解释方法和功能。未来我们将继续完善此库,使其更加全面。

| 方法 | 模型类型 | 解释类型 | EDA | 表格 | 图像 | 文本 | 时间序列 |

|---|---|---|---|---|---|---|---|

| 特征分析 | NA | 全局 | ✅ | ||||

| 特征选择 | NA | 全局 | ✅ | ||||

| 预测指标 | 黑盒 | 全局 | ✅ | ✅ | ✅ | ✅ | |

| 偏差指标 | 黑盒 | 全局 | ✅ | ||||

| 部分依赖图 | 黑盒 | 全局 | ✅ | ||||

| 累积局部效应 | 黑盒 | 全局 | ✅ | ||||

| 敏感性分析 | 黑盒 | 全局 | ✅ | ||||

| 排列重要性解释 | 黑盒 | 全局 | ✅ | ||||

| 特征可视化 | Torch 或 TF | 全局 | ✅ | ||||

| 特征图 | Torch 或 TF | 局部 | ✅ | ||||

| GPT 解释器 | 黑盒 | 局部 | ✅ | ||||

| LIME | 黑盒 | 局部 | ✅ | ✅ | ✅ | ||

| SHAP | 黑盒* | 局部 | ✅ | ✅ | ✅ | ✅ | |

| 如果-则 | 黑盒 | 局部 | ✅ | ||||

| 积分梯度 | Torch 或 TF | 局部 | ✅ | ✅ | ✅ | ||

| 反事实 | 黑盒* | 局部 | ✅ | ✅ | ✅ | ✅ | |

| 对比解释 | Torch 或 TF | 局部 | ✅ | ||||

| Grad-CAM、Grad-CAM++ | Torch 或 TF | 局部 | ✅ | ||||

| Score-CAM | Torch 或 TF | 局部 | ✅ | ||||

| Layer-CAM | Torch 或 TF | 局部 | ✅ | ||||

| 平滑梯度 | Torch 或 TF | 局部 | ✅ | ||||

| 引导式反向传播 | Torch 或 TF | 局部 | ✅ | ||||

| 学习解释 | 黑盒 | 局部 | ✅ | ✅ | ✅ | ||

| 线性模型 | 线性模型 | 全局和局部 | ✅ | ||||

| 决策树模型 | 决策树模型 | 全局和局部 | ✅ |

SHAP 支持黑盒模型处理表格数据,支持 PyTorch/TensorFlow 模型处理图像数据,支持 Transformer 模型处理文本数据。反事实支持黑盒模型处理表格、文本和时间序列数据,同时也支持 PyTorch/TensorFlow 模型处理图像数据。

此表格展示了我们的工具包/库与其他现有 XAI 工具包/库在文献中的比较。

OmniXAI 还集成了 ChatGPT,可根据表格数据集上的分类或回归模型生成纯文本解释。 生成的结果可能并非 100% 准确,但仍然值得一试(我们将持续优化输入提示)。

安装

您可以通过运行 pip install omnixai 从 PyPI 安装 omnixai。您也可以通过克隆 OmniXAI 仓库、进入根目录并运行 pip install . 来从源代码安装,或者使用 pip install -e . 以可编辑模式安装。此外,您可以安装额外的依赖项:

- 用于绘图与可视化:运行

pip install omnixai[plot],或从仓库根目录运行pip install .[plot]。 - 用于视觉任务:运行

pip install omnixai[vision],或从仓库根目录运行pip install .[vision]。 - 用于 NLP 任务:运行

pip install omnixai[nlp],或从仓库根目录运行pip install .[nlp]。 - 安装所有依赖项:运行

pip install omnixai[all],或从仓库根目录运行pip install .[all]。

快速入门

有关示例代码和库的介绍,请参阅 tutorials 中的 Jupyter 笔记本,以及此处的引导式教程 here。

一些示例:

要开始使用,我们建议您参考 tutorials 中的链接教程。通常,我们推荐在处理表格数据、视觉任务、NLP 和时间序列任务时分别使用 TabularExplainer、VisionExplainer、NLPExplainer 和 TimeseriesExplainer;而对于特征分析和预测结果分析,则可以使用 DataAnalyzer 和 PredictionAnalyzer。这些类充当 OmniXAI 中支持的各个解释器的工厂,提供更简单的接口来生成多种解释。要生成解释,您只需指定:

- 待解释的机器学习模型:例如,scikit-learn 模型、TensorFlow 模型、PyTorch 模型或黑盒预测函数。

- 预处理函数:即将原始输入特征转换为模型输入。

- 后处理函数(可选):例如,将模型输出转换为类别概率。

- 要应用的解释方法:例如,SHAP、MACE、Grad-CAM 等。

除了使用这些类之外,您还可以直接创建 omnixai.explainers 包中定义的单个解释器,例如 ShapTabular、 GradCAM、IntegratedGradient 或 FeatureVisualizer。

让我们以收入预测任务为例。

此示例中使用的 数据集 用于收入预测。我们建议使用 Tabular 数据类来表示表格数据集。要根据 Pandas DataFrame 创建一个 Tabular 实例,您需要指定 DataFrame、分类特征名称(如果存在)以及目标/标签列名称(如果存在)。

from omnixai.data.tabular import Tabular

# 加载数据集

feature_names = [

"年龄", "工作类型", "fnlwgt", "教育",

"受教育年限", "婚姻状况", "职业",

"关系", "种族", "性别", "资本收益",

"资本损失", "每周工时", "国籍", "label"

]

df = pd.DataFrame(

np.genfromtxt('adult.data', delimiter=', ', dtype=str),

columns=feature_names

)

tabular_data = Tabular(

df,

categorical_columns=[feature_names[i] for i in [1, 3, 5, 6, 7, 8, 9, 13]],

target_column='label'

)

omnixai.preprocessing 包提供了多个适用于 Tabular 实例的实用预处理函数。TabularTransform 是一种专为处理表格数据而设计的特殊转换工具。默认情况下,它会将分类特征转换为独热编码,并保留连续值特征。TabularTransform 的 transform 方法会将 Tabular 实例转换为 NumPy 数组。如果 Tabular 实例包含目标/标签列,则 NumPy 数组的最后一列即为目标/标签。您也可以不使用 TabularTransform,而是应用自定义的预处理函数。完成数据预处理后,让我们为该任务训练一个 XGBoost 分类器。

from omnixai.preprocessing.tabular import TabularTransform

# 数据预处理

transformer = TabularTransform().fit(tabular_data)

class_names = transformer.class_names

x = transformer.transform(tabular_data)

# 将数据分为训练集和测试集

train, test, train_labels, test_labels = \

sklearn.model_selection.train_test_split(x[:, :-1], x[:, -1], train_size=0.80)

# 训练 XGBoost 模型(转换后,`x` 的最后一列是标签列)

model = xgboost.XGBClassifier(n_estimators=300, max_depth=5)

model.fit(train, train_labels)

# 将转换后的数据重新转换为 Tabular 实例

train_data = transformer.invert(train)

test_data = transformer.invert(test)

要初始化 TabularExplainer,需要设置以下参数:

explainers:要应用的解释器名称列表,例如 ["lime", "shap", "mace", "pdp"]。data:用于初始化解释器的数据。data是用于训练机器学习模型的训练数据集。如果训练数据集过大,可以通过应用omnixai.sampler.tabular.Sampler.subsample将其缩减为子集。model:要解释的机器学习模型,例如 scikit-learn 模型、tensorflow 模型或 pytorch 模型。preprocess:预处理函数,将原始输入(一个Tabular实例)转换为model的输入。postprocess(可选):后处理函数,将model的输出转换为用户特定的形式,例如每个类别的预测概率。postprocess的输出应为 numpy 数组。mode:任务类型,例如 "classification" 或 "regression"。

预处理函数以 Tabular 实例作为输入,输出机器学习模型所使用的处理后的特征。在本示例中,我们直接调用 transformer.transform。如果您对 pandas 数据框使用自定义转换,则预处理函数的格式为:lambda z: some_transform(z.to_pd())。如果 model 的输出不是 numpy 数组,则需要设置 postprocess 以将其转换为 numpy 数组。

from omnixai.explainers.tabular import TabularExplainer

# 初始化一个 TabularExplainer

explainer = TabularExplainer(

explainers=["lime", "shap", "mace", "pdp", "ale"], # 要应用的解释器

mode="classification", # 任务类型

data=train_data, # 用于初始化解释器的数据

model=model, # 要解释的机器学习模型

preprocess=lambda z: transformer.transform(z), # 将原始特征转换为模型输入

params={

"mace": {"ignored_features": ["Sex", "Race", "Relationship", "Capital Loss"]}

} # 额外参数

)

在本示例中,LIME、SHAP 和 MACE 生成局部解释,而 PDP(部分依赖图)生成全局解释。explainer.explain 根据测试实例返回这三种方法生成的局部解释,而 explainer.explain_global 返回由 PDP 生成的全局解释。TabularExplainer 将所有解释器背后的细节封装起来,因此我们可以直接调用这两个方法来生成解释。

# 生成解释

test_instances = test_data[:5]

local_explanations = explainer.explain(X=test_instances)

global_explanations = explainer.explain_global(

params={"pdp": {"features": ["Age", "Education-Num", "Capital Gain",

"Capital Loss", "Hours per week", "Education",

"Marital Status", "Occupation"]}}

)

同样地,我们创建了一个 PredictionAnalyzer 来计算该分类任务的性能指标。要初始化 PredictionAnalyzer,需要设置以下参数:

mode:任务类型,例如 "classification" 或 "regression"。test_data:测试数据集,应为Tabular实例。test_targets:测试标签或目标值。对于分类任务,test_targets应为整数(经过 LabelEncoder 处理),并与机器学习模型返回的类别概率相匹配。preprocess:预处理函数,将原始数据(一个Tabular实例)转换为model的输入。postprocess(可选):后处理函数,将model的输出转换为用户特定的形式,例如每个类别的预测概率。postprocess的输出应为 numpy 数组。

from omnixai.explainers.prediction import PredictionAnalyzer

analyzer = PredictionAnalyzer(

mode="classification",

test_data=test_data, # 测试数据集(一个 `Tabular` 实例)

test_targets=test_labels, # 测试标签(一个 numpy 数组)

model=model, # 机器学习模型

preprocess=lambda z: transformer.transform(z) # 将原始特征转换为模型输入

)

prediction_explanations = analyzer.explain()

根据生成的解释,我们可以通过设置测试实例、局部解释、全局解释、预测指标、类别名称以及用于可视化的额外参数(可选),启动一个仪表板(Dash 应用程序)进行可视化。如果您想要进行“假设分析”,可以在初始化仪表板时设置 explainer 参数。对于“假设分析”,OmniXAI 还允许您设置第二个解释器,以便比较不同的模型。

from omnixai.visualization.dashboard import Dashboard

# 启动可视化仪表板

dashboard = Dashboard(

instances=test_instances, # 需要解释的实例

local_explanations=local_explanations, # 设置局部解释

global_explanations=global_explanations, # 设置全局解释

prediction_explanations=prediction_explanations, # 设置预测指标

class_names=class_names, # 设置类别名称

explainer=explainer # 用于假设分析的已创建 TabularExplainer

)

dashboard.show() # 启动仪表板

在浏览器中打开 Dash 应用后,我们将看到一个显示解释结果的仪表板:

你还可以使用 GPT 解释器为表格型模型生成文本形式的解释:

explainer = TabularExplainer(

explainers=["gpt"], # 要应用的 GPT 解释器

mode="classification", # 任务类型

data=train_data, # 用于初始化解释器的数据

model=model, # 需要解释的机器学习模型

preprocess=lambda z: transformer.transform(z), # 将原始特征转换为模型输入

params={

"gpt": {"apikey": "xxxx"}

} # 设置 OpenAI API 密钥

)

local_explanations = explainer.explain(X=test_instances)

对于视觉任务,同样使用该接口来创建解释器并生成解释。我们以图像分类模型为例。

from omnixai.explainers.vision import VisionExplainer

from omnixai.visualization.dashboard import Dashboard

explainer = VisionExplainer(

explainers=["gradcam", "lime", "ig", "ce", "feature_visualization"],

mode="classification",

model=model, # 图像分类模型,例如 ResNet50

preprocess=preprocess, # 预处理函数

postprocess=postprocess, # 后处理函数

params={

# 设置 GradCAM 的目标层

"gradcam": {"target_layer": model.layer4[-1]},

# 设置特征可视化的目标

"feature_visualization":

{"objectives": [{"layer": model.layer4[-3], "type": "channel", "index": list(range(6))}]}

},

)

# 生成 GradCAM、LIME、IG 和 CE 的解释

local_explanations = explainer.explain(test_img)

# 生成特征可视化的全局解释

global_explanations = explainer.explain_global()

# 启动仪表板

dashboard = Dashboard(

instances=test_img,

local_explanations=local_explanations,

global_explanations=global_explanations

)

dashboard.show()

下图展示了这些解释的仪表板:

对于 NLP 任务以及时间序列预测/异常检测,OmniXAI 同样提供了相同的接口来生成和可视化解释。下图展示了文本分类和时间序列异常检测的仪表板示例:

部署

OmniXAI 中的解释器可以通过 BentoML 轻松部署。BentoML 是一个流行的开源统一模型服务框架,支持包括 AWS、GCP、Heroku 等在内的多个平台。我们为 OmniXAI 实现了 BentoML 格式的接口,因此用户只需几行代码即可部署他们选择的解释器。

以收入预测任务为例。给定训练好的模型和已初始化的解释器,你只需将解释器保存到 BentoML 的本地模型仓库中:

from omnixai.explainers.tabular import TabularExplainer

from omnixai.deployment.bentoml.omnixai import save_model

explainer = TabularExplainer(

explainers=["lime", "shap", "mace", "pdp", "ale"],

mode="classification",

data=train_data,

model=model,

preprocess=lambda z: transformer.transform(z),

params={

"mace": {"ignored_features": ["Sex", "Race", "Relationship", "Capital Loss"]}

}

)

save_model("tabular_explainer", explainer)

然后创建一个文件(例如 service.py)用于 ML 服务代码:

from omnixai.deployment.bentoml.omnixai import init_service

svc = init_service(

model_tag="tabular_explainer:latest",

task_type="tabular",

service_name="tabular_explainer"

)

init_service 函数定义了两个 API 端点,即 /predict 用于模型预测,以及 /explain 用于生成解释。你可以在本地启动一个 API 服务器来测试上述服务代码:

bentoml serve service:svc --reload

这些端点可以在本地访问:

import requests

from requests_toolbelt.multipart.encoder import MultipartEncoder

data = '["39", "State-gov", "77516", "Bachelors", "13", "Never-married", ' \

'"Adm-clerical", "Not-in-family", "White", "Male", "2174", "0", "40", "United-States"]'

# 测试预测端点

prediction = requests.post(

"http://0.0.0.0:3000/predict",

headers={"content-type": "application/json"},

data=data

).text

# 测试解释端点

m = MultipartEncoder(

fields={

"data": data,

"params": '{"lime": {"y": [0]}}',

}

)

result = requests.post(

"http://0.0.0.0:3000/explain",

headers={"Content-Type": m.content_type},

data=m

).text

# 解析结果

from omnixai.explainers.base import AutoExplainerBase

exp = AutoExplainerBase.parse_explanations_from_json(result)

for name, explanation in exp.items():

explanation.ipython_plot()

你可以按照 BentoML 仓库 中所示的步骤构建 Bento 进行部署。更多示例请参阅 Tabular、Vision 和 NLP 目录。

如何贡献

我们欢迎开源社区为改进本库做出贡献!

如需向本库添加新的解释方法或功能,请遵循本 文档 中展示的模板和步骤。

技术报告与 OmniXAI 的引用

您可以在我们的技术报告中找到更多详细信息:https://arxiv.org/abs/2206.01612

如果您在研究或应用中使用 OmniXAI,请使用以下 BibTeX 格式进行引用:

@article{wenzhuo2022-omnixai,

author = {Wenzhuo Yang 和 Hung Le 和 Silvio Savarese 和 Steven Hoi},

title = {OmniXAI:可解释人工智能库},

year = {2022},

doi = {10.48550/ARXIV.2206.01612},

url = {https://arxiv.org/abs/2206.01612},

archivePrefix = {arXiv},

eprint = {206.01612},

}

联系我们

如果您有任何问题、意见或建议,请随时通过 omnixai@salesforce.com 与我们联系。

许可证

版本历史

v1.3.22024/04/25v1.3.12023/07/16v1.3.02023/05/27v1.2.52023/02/08v1.2.42023/01/03v1.2.32022/11/22v1.2.22022/10/25v1.2.12022/09/16v1.2.02022/09/08v1.1.42022/08/25v1.1.32022/08/05v1.1.22022/07/26v1.1.12022/07/22v1.1.02022/07/11v1.0.02022/06/10常见问题

相似工具推荐

openclaw

OpenClaw 是一款专为个人打造的本地化 AI 助手,旨在让你在自己的设备上拥有完全可控的智能伙伴。它打破了传统 AI 助手局限于特定网页或应用的束缚,能够直接接入你日常使用的各类通讯渠道,包括微信、WhatsApp、Telegram、Discord、iMessage 等数十种平台。无论你在哪个聊天软件中发送消息,OpenClaw 都能即时响应,甚至支持在 macOS、iOS 和 Android 设备上进行语音交互,并提供实时的画布渲染功能供你操控。 这款工具主要解决了用户对数据隐私、响应速度以及“始终在线”体验的需求。通过将 AI 部署在本地,用户无需依赖云端服务即可享受快速、私密的智能辅助,真正实现了“你的数据,你做主”。其独特的技术亮点在于强大的网关架构,将控制平面与核心助手分离,确保跨平台通信的流畅性与扩展性。 OpenClaw 非常适合希望构建个性化工作流的技术爱好者、开发者,以及注重隐私保护且不愿被单一生态绑定的普通用户。只要具备基础的终端操作能力(支持 macOS、Linux 及 Windows WSL2),即可通过简单的命令行引导完成部署。如果你渴望拥有一个懂你

stable-diffusion-webui

stable-diffusion-webui 是一个基于 Gradio 构建的网页版操作界面,旨在让用户能够轻松地在本地运行和使用强大的 Stable Diffusion 图像生成模型。它解决了原始模型依赖命令行、操作门槛高且功能分散的痛点,将复杂的 AI 绘图流程整合进一个直观易用的图形化平台。 无论是希望快速上手的普通创作者、需要精细控制画面细节的设计师,还是想要深入探索模型潜力的开发者与研究人员,都能从中获益。其核心亮点在于极高的功能丰富度:不仅支持文生图、图生图、局部重绘(Inpainting)和外绘(Outpainting)等基础模式,还独创了注意力机制调整、提示词矩阵、负向提示词以及“高清修复”等高级功能。此外,它内置了 GFPGAN 和 CodeFormer 等人脸修复工具,支持多种神经网络放大算法,并允许用户通过插件系统无限扩展能力。即使是显存有限的设备,stable-diffusion-webui 也提供了相应的优化选项,让高质量的 AI 艺术创作变得触手可及。

everything-claude-code

everything-claude-code 是一套专为 AI 编程助手(如 Claude Code、Codex、Cursor 等)打造的高性能优化系统。它不仅仅是一组配置文件,而是一个经过长期实战打磨的完整框架,旨在解决 AI 代理在实际开发中面临的效率低下、记忆丢失、安全隐患及缺乏持续学习能力等核心痛点。 通过引入技能模块化、直觉增强、记忆持久化机制以及内置的安全扫描功能,everything-claude-code 能显著提升 AI 在复杂任务中的表现,帮助开发者构建更稳定、更智能的生产级 AI 代理。其独特的“研究优先”开发理念和针对 Token 消耗的优化策略,使得模型响应更快、成本更低,同时有效防御潜在的攻击向量。 这套工具特别适合软件开发者、AI 研究人员以及希望深度定制 AI 工作流的技术团队使用。无论您是在构建大型代码库,还是需要 AI 协助进行安全审计与自动化测试,everything-claude-code 都能提供强大的底层支持。作为一个曾荣获 Anthropic 黑客大奖的开源项目,它融合了多语言支持与丰富的实战钩子(hooks),让 AI 真正成长为懂上

ComfyUI

ComfyUI 是一款功能强大且高度模块化的视觉 AI 引擎,专为设计和执行复杂的 Stable Diffusion 图像生成流程而打造。它摒弃了传统的代码编写模式,采用直观的节点式流程图界面,让用户通过连接不同的功能模块即可构建个性化的生成管线。 这一设计巧妙解决了高级 AI 绘图工作流配置复杂、灵活性不足的痛点。用户无需具备编程背景,也能自由组合模型、调整参数并实时预览效果,轻松实现从基础文生图到多步骤高清修复等各类复杂任务。ComfyUI 拥有极佳的兼容性,不仅支持 Windows、macOS 和 Linux 全平台,还广泛适配 NVIDIA、AMD、Intel 及苹果 Silicon 等多种硬件架构,并率先支持 SDXL、Flux、SD3 等前沿模型。 无论是希望深入探索算法潜力的研究人员和开发者,还是追求极致创作自由度的设计师与资深 AI 绘画爱好者,ComfyUI 都能提供强大的支持。其独特的模块化架构允许社区不断扩展新功能,使其成为当前最灵活、生态最丰富的开源扩散模型工具之一,帮助用户将创意高效转化为现实。

gemini-cli

gemini-cli 是一款由谷歌推出的开源 AI 命令行工具,它将强大的 Gemini 大模型能力直接集成到用户的终端环境中。对于习惯在命令行工作的开发者而言,它提供了一条从输入提示词到获取模型响应的最短路径,无需切换窗口即可享受智能辅助。 这款工具主要解决了开发过程中频繁上下文切换的痛点,让用户能在熟悉的终端界面内直接完成代码理解、生成、调试以及自动化运维任务。无论是查询大型代码库、根据草图生成应用,还是执行复杂的 Git 操作,gemini-cli 都能通过自然语言指令高效处理。 它特别适合广大软件工程师、DevOps 人员及技术研究人员使用。其核心亮点包括支持高达 100 万 token 的超长上下文窗口,具备出色的逻辑推理能力;内置 Google 搜索、文件操作及 Shell 命令执行等实用工具;更独特的是,它支持 MCP(模型上下文协议),允许用户灵活扩展自定义集成,连接如图像生成等外部能力。此外,个人谷歌账号即可享受免费的额度支持,且项目基于 Apache 2.0 协议完全开源,是提升终端工作效率的理想助手。

markitdown

MarkItDown 是一款由微软 AutoGen 团队打造的轻量级 Python 工具,专为将各类文件高效转换为 Markdown 格式而设计。它支持 PDF、Word、Excel、PPT、图片(含 OCR)、音频(含语音转录)、HTML 乃至 YouTube 链接等多种格式的解析,能够精准提取文档中的标题、列表、表格和链接等关键结构信息。 在人工智能应用日益普及的今天,大语言模型(LLM)虽擅长处理文本,却难以直接读取复杂的二进制办公文档。MarkItDown 恰好解决了这一痛点,它将非结构化或半结构化的文件转化为模型“原生理解”且 Token 效率极高的 Markdown 格式,成为连接本地文件与 AI 分析 pipeline 的理想桥梁。此外,它还提供了 MCP(模型上下文协议)服务器,可无缝集成到 Claude Desktop 等 LLM 应用中。 这款工具特别适合开发者、数据科学家及 AI 研究人员使用,尤其是那些需要构建文档检索增强生成(RAG)系统、进行批量文本分析或希望让 AI 助手直接“阅读”本地文件的用户。虽然生成的内容也具备一定可读性,但其核心优势在于为机器