text_renderer

text_renderer 是一款专为深度学习 OCR(光学字符识别)模型训练设计的开源工具,核心功能是批量生成带有真实标注的文本行图像数据集。在 AI 模型训练中,高质量且多样化的标注数据往往难以获取,手动制作成本极高,而 text_renderer 通过自动化渲染技术,利用字体文件、背景图和文本语料,快速合成包含各种干扰效果(如模糊、噪声、扭曲)的训练样本,有效解决了数据匮乏和场景单一的问题。

这款工具特别适合 AI 开发者、算法研究人员以及需要定制 OCR 数据集的技术团队使用。它采用模块化设计,允许用户灵活组合文本来源、视觉效果和版面布局,甚至支持集成 Albumentations 库以实现更丰富的图像增强。其独特亮点在于支持竖排文字生成、多语料混合渲染,并能直接输出兼容 PaddleOCR 等主流框架的 LMDB 格式数据集,大幅降低了数据预处理门槛。无论是复现 CRNN 等经典模型,还是构建特定业务场景下的识别系统,text_renderer 都能帮助用户高效完成数据准备环节,让模型训练更加顺畅。

使用场景

某物流科技公司正致力于升级其快递面单识别系统,需要训练一个能应对复杂背景、模糊打印及倾斜文字的深度学习 OCR 模型。

没有 text_renderer 时

- 数据收集成本高昂:团队需人工拍摄数万张真实面单或从网络爬取图片,不仅耗时费力,还面临隐私合规风险。

- 样本多样性严重不足:真实场景中罕见的极端字体、特殊噪点或严重扭曲角度难以覆盖,导致模型在边缘案例上频繁失效。

- 标注工作繁琐易错:每张图片都需要人工手动框选文字并录入对应内容,数千张图片的标注周期长达数周,且极易出现人为错误。

- 数据分布不均衡:常见字符样本过剩,而生僻字或特定格式文本稀缺,导致模型训练出现偏差,泛化能力差。

使用 text_renderer 后

- 无限生成合成数据:利用预设的字体库和背景图,text_renderer 可一键生成百万级带有精确标注的训练图像,彻底摆脱对真实数据的依赖。

- 模拟极端场景增强鲁棒性:通过集成 Albumentations 效果,轻松模拟污渍、模糊、光照变化及垂直排版等复杂情况,显著提升模型抗干扰能力。

- 自动化精准标注:工具在生成图像的同时自动输出对应的 JSON 或 LMDB 格式标签文件,将原本数周的标注工作缩短至几分钟,且零误差。

- 灵活控制数据分布:开发者可自定义语料采样策略,针对性地增加生僻字或特定版式的样本数量,确保训练数据集的平衡与全面。

text_renderer 将 OCR 模型训练的数据准备阶段从“劳动密集型”转变为“自动化配置型”,大幅降低了研发门槛并加速了模型迭代落地。

运行环境要求

- Linux

- macOS

- Windows

未说明

未说明

快速开始

文本渲染器

生成用于训练深度学习 OCR 模型的文本行图像(例如 CRNN)。

目录

特性

- 模块化设计。您可以轻松添加不同的组件:语料库、效果、布局。

- 与 Albumentations 集成,以实现图像增强效果。

- 支持在图像上使用不同效果渲染多个语料库。布局 负责多个语料库之间的排版。

- 支持在渲染过程的不同阶段应用效果:语料库效果、布局效果、渲染效果。

- 生成竖排文本。

- 支持生成与 PaddleOCR 兼容的

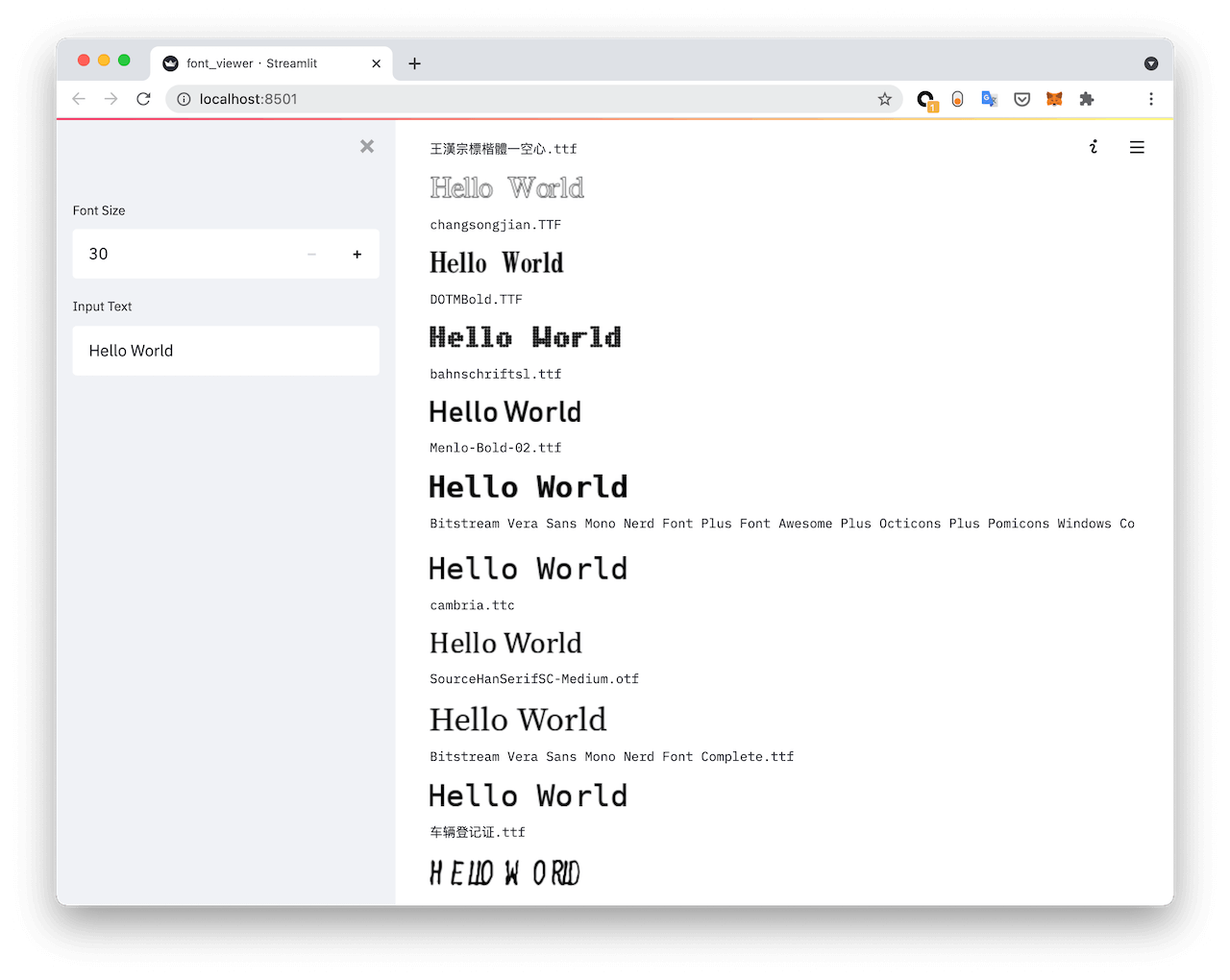

lmdb数据集,详情请参阅 数据集。 - 提供一个网页字体查看器。

- 语料库采样器:有助于实现字符平衡。

先决条件

- Python 3.10+

- 操作系统:Linux、macOS 或 Windows

安装

git clone https://github.com/oh-my-ocr/text_renderer

cd text_renderer

uv sync

或者使用 pip:

pip install '.[tools]' # 包含字体查看器和实用脚本

pip install '.[docs]' # 包括 Sphinx 用于构建文档

运行示例

运行以下命令以使用示例数据生成图像:

uv run python main.py \

--config example_data/example.py \

--dataset img \

--num_processes 2 \

--log_period 10

Windows 用户注意: 请使用

^代替\来换行,或将命令写成一行:uv run python main.py --config example_data/example.py --dataset img --num_processes 2 --log_period 10

数据将生成在 example_data/output 目录中。一个 labels.json 文件包含所有标注,格式如下:

{

"labels": {

"000000000": "test",

"000000001": "text2"

},

"sizes": {

"000000000": [

120,

32

],

"000000001": [

128,

32

]

},

"num-samples": 2

}

您也可以使用 --dataset lmdb 将图像存储在 lmdb 文件中,lmdb 文件包含以下键:

- num-samples

- image-000000000

- label-000000000

- size-000000000

您可以查看配置文件 example_data/example.py,了解如何使用 text_renderer, 或按照 快速入门 学习如何设置配置。

快速入门

准备文件资源

- 字体文件:

.ttf、.otf、.ttc - 任意尺寸的背景图像,可以来自您的业务场景,也可以来自公开可用的数据集(如 COCO、VOC)。

- 语料库:text_renderer 提供了多种 文本采样方法,要使用这些方法,您需要从两个方面考虑语料库的准备:

- 语料库必须是您希望进行 OCR 识别的目标语言。

- 语料库应符合您的实际业务需求,例如教育领域、医疗领域等。

- 字符集文件【可选但建议】:现实场景中的 OCR 模型(如 CRNN)通常只支持有限的字符集, 因此在数据生成过程中最好过滤掉字符集之外的字符。您可以通过设置 chars_file 参数来实现这一点。

您可以从这里下载为本次“快速入门”预先准备好的文件资源:

请将这些资源文件保存在同一目录下:

workspace

├── bg

│ └── background.png

├── corpus

│ └── eng_text.txt

└── font

└── simsun.ttf

创建配置文件

在 workspace 目录下创建一个名为 config.py 的文件。每个配置文件必须包含一个 configs 变量,该变量是一个由 GeneratorCfg 组成的列表。

完整的配置文件如下:

import os

from pathlib import Path

from text_renderer.effect import *

from text_renderer.corpus import *

from text_renderer.config import (

RenderCfg,

NormPerspectiveTransformCfg,

GeneratorCfg,

SimpleTextColorCfg,

)

CURRENT_DIR = Path(os.path.abspath(os.path.dirname(__file__)))

def story_data():

return GeneratorCfg(

num_image=10,

save_dir=CURRENT_DIR / "output",

render_cfg=RenderCfg(

bg_dir=CURRENT_DIR / "bg",

height=32,

perspective_transform=NormPerspectiveTransformCfg(20, 20, 1.5),

corpus=WordCorpus(

WordCorpusCfg(

text_paths=[CURRENT_DIR / "corpus" / "eng_text.txt"],

font_dir=CURRENT_DIR / "font",

font_size=(20, 30),

num_word=(2, 3),

),

),

corpus_effects=Effects(Line(0.9, thickness=(2, 5))),

gray=False,

text_color_cfg=SimpleTextColorCfg(),

),

)

configs = [story_data()]

在上述配置中,我们完成了以下工作:

- 指定了资源文件的位置。

- 指定了文本采样方法:从语料库中随机选择 2 或 3 个单词。

- 配置了一些用于生成的效果:

- 透视变换 NormPerspectiveTransformCfg

- 随机 Line 效果

- 将输出图像高度固定为 32 像素。

- 生成彩色图像。

gray=False,SimpleTextColorCfg()。

- 指定了字体相关参数:

font_size、font_dir。

运行

运行 main.py。它有 4 个参数:

- config: Python 配置文件路径。

- dataset: 数据集格式,可选

img或lmdb。 - num_processes: 使用的进程数。

- log_period: 日志打印周期。(0, 100)

使用 Albumentations 效果

Text Renderer 集成了 Albumentations 用于图像增强。以下是可用的 Albumentations 效果:

AlbumentationsEffect- 用于封装任何 Albumentations 增强器的通用包装器。AlbumentationsEmboss/Emboss- 浮雕效果。AlbumentationsMotionBlur/MotionBlur- 动感模糊效果。GaussianBlur- 高斯模糊。Noise、UniformNoise、SaltPepperNoise、PoissonNoise- 各种噪声效果。BrightnessContrast- 亮度和对比度调整。Rotate- 旋转。ShiftScaleRotate- 平移、缩放和旋转的组合。ElasticTransform- 弹性变换。GridDistortion- 网格扭曲。OpticalDistortion- 光学畸变。

使用示例

from text_renderer.effect import AlbumentationsEffect, AlbumentationsEmboss, Effects

import albumentations as A

# 使用内置的 Albumentations 效果

effects = Effects([

AlbumentationsEmboss(alpha=(0.9, 1.0), strength=(1.5, 1.6)),

])

# 使用自定义的 Albumentations 增强器

custom_aug = A.Compose([

A.GaussianBlur(blur_limit=(0, 1), p=1.0),

A.RandomBrightnessContrast(brightness_limit=0.2, contrast_limit=0.2, p=1.0)

])

effects = Effects([

AlbumentationsEffect(transform=custom_aug),

])

所有效果/布局示例

所有效果/布局配置示例可在链接中找到。

bg_and_text_mask: 将三张宽度相同的图像水平拼接在一起,可用于训练如EraseNet这样的GAN模型。

| 名称 | 示例 | |

|---|---|---|

| 0 | bg_and_text_mask |  |

| 1 | char_spacing_compact |  |

| 2 | char_spacing_large |  |

| 3 | color_image |  |

| 4 | curve |  |

| 5 | dropout_horizontal |  |

| 6 | dropout_rand |  |

| 7 | dropout_vertical |  |

| 8 | emboss |  |

| 9 | extra_text_line_layout |  |

| 10 | line_bottom |  |

| 11 | line_bottom_left |  |

| 12 | line_bottom_right |  |

| 13 | line_horizontal_middle |  |

| 14 | line_left |  |

| 15 | line_right |  |

| 16 | line_top |  |

| 17 | line_top_left |  |

| 18 | line_top_right |  |

| 19 | line_vertical_middle |  |

| 20 | padding |  |

| 21 | perspective_transform |  |

| 22 | same_line_layout_different_font_size |  |

| 23 | vertical_text |  |

贡献

设置Commitizen以规范提交信息。

- 语料库:欢迎为项目贡献更多语料库生成器。这些生成器不一定需要是通用的,也可以是特定业务场景下的生成器,例如生成身份证号码等。

字体查看器

安装工具扩展包后,启动字体查看器:

uv sync --extra tools

uv run streamlit run tools/font_viewer.py -- web /path/to/fonts_dir

构建文档

uv sync --extra docs

cd docs

uv run make html

open _build/html/index.html

引用 text_renderer

如果您在研究中使用了 text_renderer,请考虑使用以下 BibTeX 条目。

@misc{text_renderer,

author = {oh-my-ocr},

title = {text_renderer},

howpublished = {\url{https://github.com/oh-my-ocr/text_renderer}},

year = {2021}

}

版本历史

v0.2.02026/03/29常见问题

相似工具推荐

openclaw

OpenClaw 是一款专为个人打造的本地化 AI 助手,旨在让你在自己的设备上拥有完全可控的智能伙伴。它打破了传统 AI 助手局限于特定网页或应用的束缚,能够直接接入你日常使用的各类通讯渠道,包括微信、WhatsApp、Telegram、Discord、iMessage 等数十种平台。无论你在哪个聊天软件中发送消息,OpenClaw 都能即时响应,甚至支持在 macOS、iOS 和 Android 设备上进行语音交互,并提供实时的画布渲染功能供你操控。 这款工具主要解决了用户对数据隐私、响应速度以及“始终在线”体验的需求。通过将 AI 部署在本地,用户无需依赖云端服务即可享受快速、私密的智能辅助,真正实现了“你的数据,你做主”。其独特的技术亮点在于强大的网关架构,将控制平面与核心助手分离,确保跨平台通信的流畅性与扩展性。 OpenClaw 非常适合希望构建个性化工作流的技术爱好者、开发者,以及注重隐私保护且不愿被单一生态绑定的普通用户。只要具备基础的终端操作能力(支持 macOS、Linux 及 Windows WSL2),即可通过简单的命令行引导完成部署。如果你渴望拥有一个懂你

stable-diffusion-webui

stable-diffusion-webui 是一个基于 Gradio 构建的网页版操作界面,旨在让用户能够轻松地在本地运行和使用强大的 Stable Diffusion 图像生成模型。它解决了原始模型依赖命令行、操作门槛高且功能分散的痛点,将复杂的 AI 绘图流程整合进一个直观易用的图形化平台。 无论是希望快速上手的普通创作者、需要精细控制画面细节的设计师,还是想要深入探索模型潜力的开发者与研究人员,都能从中获益。其核心亮点在于极高的功能丰富度:不仅支持文生图、图生图、局部重绘(Inpainting)和外绘(Outpainting)等基础模式,还独创了注意力机制调整、提示词矩阵、负向提示词以及“高清修复”等高级功能。此外,它内置了 GFPGAN 和 CodeFormer 等人脸修复工具,支持多种神经网络放大算法,并允许用户通过插件系统无限扩展能力。即使是显存有限的设备,stable-diffusion-webui 也提供了相应的优化选项,让高质量的 AI 艺术创作变得触手可及。

ComfyUI

ComfyUI 是一款功能强大且高度模块化的视觉 AI 引擎,专为设计和执行复杂的 Stable Diffusion 图像生成流程而打造。它摒弃了传统的代码编写模式,采用直观的节点式流程图界面,让用户通过连接不同的功能模块即可构建个性化的生成管线。 这一设计巧妙解决了高级 AI 绘图工作流配置复杂、灵活性不足的痛点。用户无需具备编程背景,也能自由组合模型、调整参数并实时预览效果,轻松实现从基础文生图到多步骤高清修复等各类复杂任务。ComfyUI 拥有极佳的兼容性,不仅支持 Windows、macOS 和 Linux 全平台,还广泛适配 NVIDIA、AMD、Intel 及苹果 Silicon 等多种硬件架构,并率先支持 SDXL、Flux、SD3 等前沿模型。 无论是希望深入探索算法潜力的研究人员和开发者,还是追求极致创作自由度的设计师与资深 AI 绘画爱好者,ComfyUI 都能提供强大的支持。其独特的模块化架构允许社区不断扩展新功能,使其成为当前最灵活、生态最丰富的开源扩散模型工具之一,帮助用户将创意高效转化为现实。

gemini-cli

gemini-cli 是一款由谷歌推出的开源 AI 命令行工具,它将强大的 Gemini 大模型能力直接集成到用户的终端环境中。对于习惯在命令行工作的开发者而言,它提供了一条从输入提示词到获取模型响应的最短路径,无需切换窗口即可享受智能辅助。 这款工具主要解决了开发过程中频繁上下文切换的痛点,让用户能在熟悉的终端界面内直接完成代码理解、生成、调试以及自动化运维任务。无论是查询大型代码库、根据草图生成应用,还是执行复杂的 Git 操作,gemini-cli 都能通过自然语言指令高效处理。 它特别适合广大软件工程师、DevOps 人员及技术研究人员使用。其核心亮点包括支持高达 100 万 token 的超长上下文窗口,具备出色的逻辑推理能力;内置 Google 搜索、文件操作及 Shell 命令执行等实用工具;更独特的是,它支持 MCP(模型上下文协议),允许用户灵活扩展自定义集成,连接如图像生成等外部能力。此外,个人谷歌账号即可享受免费的额度支持,且项目基于 Apache 2.0 协议完全开源,是提升终端工作效率的理想助手。

LLMs-from-scratch

LLMs-from-scratch 是一个基于 PyTorch 的开源教育项目,旨在引导用户从零开始一步步构建一个类似 ChatGPT 的大型语言模型(LLM)。它不仅是同名技术著作的官方代码库,更提供了一套完整的实践方案,涵盖模型开发、预训练及微调的全过程。 该项目主要解决了大模型领域“黑盒化”的学习痛点。许多开发者虽能调用现成模型,却难以深入理解其内部架构与训练机制。通过亲手编写每一行核心代码,用户能够透彻掌握 Transformer 架构、注意力机制等关键原理,从而真正理解大模型是如何“思考”的。此外,项目还包含了加载大型预训练权重进行微调的代码,帮助用户将理论知识延伸至实际应用。 LLMs-from-scratch 特别适合希望深入底层原理的 AI 开发者、研究人员以及计算机专业的学生。对于不满足于仅使用 API,而是渴望探究模型构建细节的技术人员而言,这是极佳的学习资源。其独特的技术亮点在于“循序渐进”的教学设计:将复杂的系统工程拆解为清晰的步骤,配合详细的图表与示例,让构建一个虽小但功能完备的大模型变得触手可及。无论你是想夯实理论基础,还是为未来研发更大规模的模型做准备

Deep-Live-Cam

Deep-Live-Cam 是一款专注于实时换脸与视频生成的开源工具,用户仅需一张静态照片,即可通过“一键操作”实现摄像头画面的即时变脸或制作深度伪造视频。它有效解决了传统换脸技术流程繁琐、对硬件配置要求极高以及难以实时预览的痛点,让高质量的数字内容创作变得触手可及。 这款工具不仅适合开发者和技术研究人员探索算法边界,更因其极简的操作逻辑(仅需三步:选脸、选摄像头、启动),广泛适用于普通用户、内容创作者、设计师及直播主播。无论是为了动画角色定制、服装展示模特替换,还是制作趣味短视频和直播互动,Deep-Live-Cam 都能提供流畅的支持。 其核心技术亮点在于强大的实时处理能力,支持口型遮罩(Mouth Mask)以保留使用者原始的嘴部动作,确保表情自然精准;同时具备“人脸映射”功能,可同时对画面中的多个主体应用不同面孔。此外,项目内置了严格的内容安全过滤机制,自动拦截涉及裸露、暴力等不当素材,并倡导用户在获得授权及明确标注的前提下合规使用,体现了技术发展与伦理责任的平衡。