claude-code-router

claude-code-router 是一款专为增强 Claude Code 灵活性而设计的开源路由工具。它允许开发者以 Claude Code 为核心构建编码基础设施,同时自由决定如何与底层模型交互,既能享受 Anthropic 的官方更新,又能突破单一模型限制。

该工具主要解决了开发者在使用 AI 编程时面临的模型选择僵化问题。通过它,用户可以轻松将请求路由至 OpenRouter、DeepSeek、Ollama、Gemini 等多种模型提供商,针对不同任务场景(如后台处理、深度思考或长上下文分析)动态切换最合适的模型。此外,它还支持自定义请求与响应转换,并能在 GitHub Actions 等自动化流程中无缝集成。

claude-code-router 特别适合需要高度定制化 AI 工作流的软件开发者、技术研究人员及 DevOps 工程师。其独特亮点在于提供了终端命令行管理功能(ccr model)和实时模型切换命令(/model),让用户无需重启即可在对话中灵活调整模型策略。配合插件系统,用户还能扩展更多个性化功能。无论是希望降低 API 成本,还是想尝试不同模型特性的技术团队,都能借此获得更稳定、高效且可控的编码体验。

使用场景

某全栈开发团队在构建微服务架构时,需要频繁调用 AI 辅助生成代码、编写单元测试及分析长日志,但面临模型成本高昂且响应速度不稳定的挑战。

没有 claude-code-router 时

- 成本与性能难以平衡:所有任务(包括简单的语法检查)都强制使用昂贵的 Claude Opus 模型,导致 API 账单激增,而轻量级任务无需如此强大的算力。

- 多模型切换繁琐:当需要针对长上下文分析切换至 DeepSeek 或本地 Ollama 模型时,开发者必须手动修改环境变量或重启终端会话,打断心流。

- 供应商锁定风险:深度绑定单一提供商,一旦遇到网络波动或服务限流,整个团队的 AI 编码工作流即刻停摆,缺乏自动降级机制。

- 定制化能力缺失:无法根据不同任务类型(如“后台静默任务”或“即时交互”)动态调整请求参数,导致资源利用率低下。

使用 claude-code-router 后

- 智能路由降本增效:配置规则让简单任务自动路由至低价的 DeepSeek 或本地模型,仅复杂推理才调用 Claude Opus,整体 API 成本降低 60%。

- 终端内无缝热切换:开发者直接在 Claude Code 终端输入

/model命令即可实时切换后端模型,无需重启环境,保持开发节奏流畅。 - 多源容错保障连续性:同时接入 OpenRouter、SiliconFlow 等多个供应商,当主节点故障时自动故障转移,确保团队编码工作零中断。

- 精细化请求定制:利用 Transformer 插件针对不同场景自定义请求体,例如为长日志分析任务自动开启大上下文窗口,为代码补全任务优化延迟设置。

claude-code-router 通过灵活的路由策略和多模型管理能力,将原本僵化的单点 AI 依赖转化为低成本、高可用且可定制的智能编码基础设施。

运行环境要求

- Linux

- macOS

- Windows

未说明

未说明

快速开始

本项目由Z.ai赞助,他们通过GLM CODING PLAN计划支持我们。

GLM CODING PLAN是一项专为AI编码设计的订阅服务,每月仅需10美元起。它让开发者能够使用其旗舰模型GLM-4.7及(GLM-5仅供Pro用户使用)在10余款热门AI编码工具中进行开发,提供顶级、快速且稳定的编码体验。

GLM CODING PLAN享受10%折扣:https://z.ai/subscribe?ic=8JVLJQFSKB

一款强大的工具,可将Claude Code请求路由到不同模型,并自定义任何请求。

✨ 功能

- 模型路由:根据需求将请求路由到不同模型(如后台任务、思考、长上下文等)。

- 多提供商支持:支持OpenRouter、DeepSeek、Ollama、Gemini、Volcengine和SiliconFlow等多种模型提供商。

- 请求/响应转换:使用转换器为不同提供商自定义请求和响应。

- 动态模型切换:在Claude Code中使用

/model命令实时切换模型。 - CLI模型管理:通过

ccr model直接在终端管理模型和提供商。 - GitHub Actions集成:在GitHub工作流中触发Claude Code任务。

- 插件系统:通过自定义转换器扩展功能。

🚀 快速上手

1. 安装

首先,请确保已安装Claude Code:

npm install -g @anthropic-ai/claude-code

然后,安装Claude Code Router:

npm install -g @musistudio/claude-code-router

2. 配置

创建并配置你的 ~/.claude-code-router/config.json 文件。更多详细信息,请参考 config.example.json。

config.json 文件包含几个关键部分:

PROXY_URL(可选):你可以为 API 请求设置代理,例如:"PROXY_URL": "http://127.0.0.1:7890"。LOG(可选):通过将其设置为true可以启用日志记录。当设置为false时,将不会创建任何日志文件。默认值为true。LOG_LEVEL(可选):设置日志级别。可用选项包括:"fatal"、"error"、"warn"、"info"、"debug"、"trace"。默认值为"debug"。日志系统:Claude Code Router 使用两种独立的日志系统:

- 服务器级日志:HTTP 请求、API 调用和服务器事件会使用 pino 记录在

~/.claude-code-router/logs/目录下,文件名为ccr-*.log等。 - 应用级日志:路由决策和业务逻辑事件会记录在

~/.claude-code-router/claude-code-router.log中。

- 服务器级日志:HTTP 请求、API 调用和服务器事件会使用 pino 记录在

APIKEY(可选):你可以设置一个密钥来验证请求。当设置后,客户端必须在Authorization头部(例如Bearer your-secret-key)或x-api-key头部中提供该密钥。示例:"APIKEY": "your-secret-key"。HOST(可选):你可以设置服务器的主机地址。如果未设置APIKEY,出于安全考虑,主机将被强制设置为127.0.0.1,以防止未经授权的访问。示例:"HOST": "0.0.0.0"。NON_INTERACTIVE_MODE(可选):当设置为true时,可与非交互式环境兼容,如 GitHub Actions、Docker 容器或其他 CI/CD 系统。这会设置适当的环境变量(CI=true、FORCE_COLOR=0等),并配置标准输入处理,以防止进程在自动化环境中挂起。示例:"NON_INTERACTIVE_MODE": true。Providers:用于配置不同的模型提供商。Router:用于设置路由规则。default指定默认模型,如果没有其他路由配置,则所有请求都将使用该模型。API_TIMEOUT_MS:指定 API 调用的超时时间,单位为毫秒。

环境变量插值

Claude Code Router 支持环境变量插值,以便安全地管理 API 密钥。你可以在 config.json 中使用 $VAR_NAME 或 ${VAR_NAME} 语法引用环境变量:

{

"OPENAI_API_KEY": "$OPENAI_API_KEY",

"GEMINI_API_KEY": "${GEMINI_API_KEY}",

"Providers": [

{

"name": "openai",

"api_base_url": "https://api.openai.com/v1/chat/completions",

"api_key": "$OPENAI_API_KEY",

"models": ["gpt-5", "gpt-5-mini"]

}

]

}

这样可以将敏感的 API 密钥保存在环境变量中,而不是硬编码到配置文件中。插值功能会递归地应用于嵌套的对象和数组。

以下是一个完整的示例:

{

"APIKEY": "your-secret-key",

"PROXY_URL": "http://127.0.0.1:7890",

"LOG": true,

"API_TIMEOUT_MS": 600000,

"NON_INTERACTIVE_MODE": false,

"Providers": [

{

"name": "openrouter",

"api_base_url": "https://openrouter.ai/api/v1/chat/completions",

"api_key": "sk-xxx",

"models": [

"google/gemini-2.5-pro-preview",

"anthropic/claude-sonnet-4",

"anthropic/claude-3.5-sonnet",

"anthropic/claude-3.7-sonnet:thinking"

],

"transformer": {

"use": ["openrouter"]

}

},

{

"name": "deepseek",

"api_base_url": "https://api.deepseek.com/chat/completions",

"api_key": "sk-xxx",

"models": ["deepseek-chat", "deepseek-reasoner"],

"transformer": {

"use": ["deepseek"],

"deepseek-chat": {

"use": ["tooluse"]

}

}

},

{

"name": "ollama",

"api_base_url": "http://localhost:11434/v1/chat/completions",

"api_key": "ollama",

"models": ["qwen2.5-coder:latest"]

},

{

"name": "gemini",

"api_base_url": "https://generativelanguage.googleapis.com/v1beta/models/",

"api_key": "sk-xxx",

"models": ["gemini-2.5-flash", "gemini-2.5-pro"],

"transformer": {

"use": ["gemini"]

}

},

{

"name": "volcengine",

"api_base_url": "https://ark.cn-beijing.volces.com/api/v3/chat/completions",

"api_key": "sk-xxx",

"models": ["deepseek-v3-250324", "deepseek-r1-250528"],

"transformer": {

"use": ["deepseek"]

}

},

{

"name": "modelscope",

"api_base_url": "https://api-inference.modelscope.cn/v1/chat/completions",

"api_key": "",

"models": ["Qwen/Qwen3-Coder-480B-A35B-Instruct", "Qwen/Qwen3-235B-A22B-Thinking-2507"],

"transformer": {

"use": [

[

"maxtoken",

{

"max_tokens": 65536

}

],

"enhancetool"

],

"Qwen/Qwen3-235B-A22B-Thinking-2507": {

"use": ["reasoning"]

}

}

},

{

"name": "dashscope",

"api_base_url": "https://dashscope.aliyuncs.com/compatible-mode/v1/chat/completions",

"api_key": "",

"models": ["qwen3-coder-plus"],

"transformer": {

"use": [

[

"maxtoken",

{

"max_tokens": 65536

}

],

"enhancetool"

]

}

},

{

"name": "aihubmix",

"api_base_url": "https://aihubmix.com/v1/chat/completions",

"api_key": "sk-",

"models": [

"Z/glm-4.5",

"claude-opus-4-20250514",

"gemini-2.5-pro"

]

}

],

"Router": {

"default": "deepseek,deepseek-chat",

"background": "ollama,qwen2.5-coder:latest",

"think": "deepseek,deepseek-reasoner",

"longContext": "openrouter,google/gemini-2.5-pro-preview",

"longContextThreshold": 60000,

"webSearch": "gemini,gemini-2.5-flash"

}

}

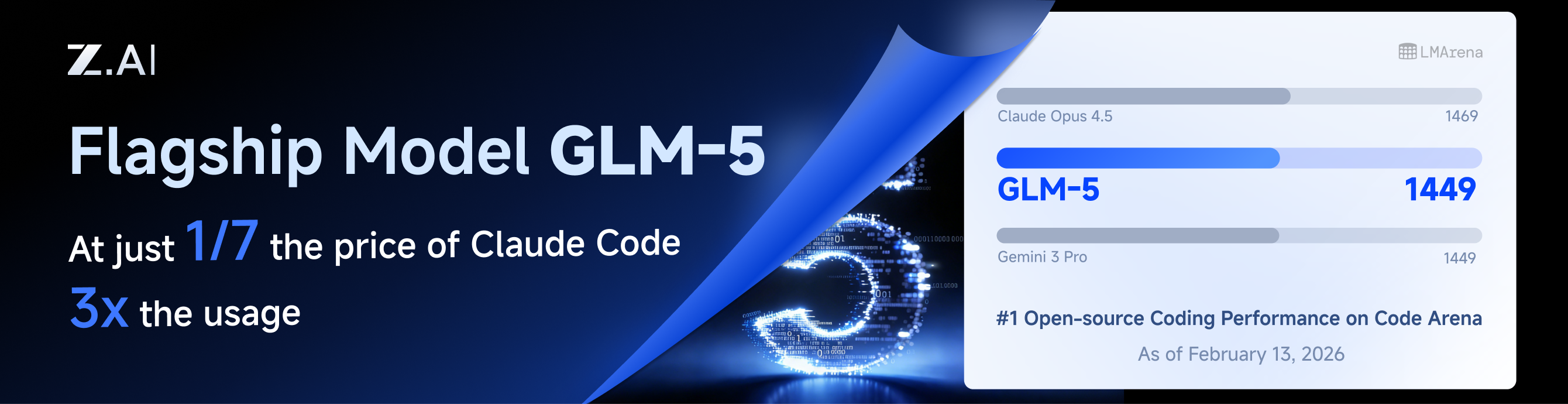

3. 使用路由器运行 Claude Code

使用路由器启动 Claude Code:

ccr code

注意:修改配置文件后,需要重启服务才能使更改生效:

ccr restart

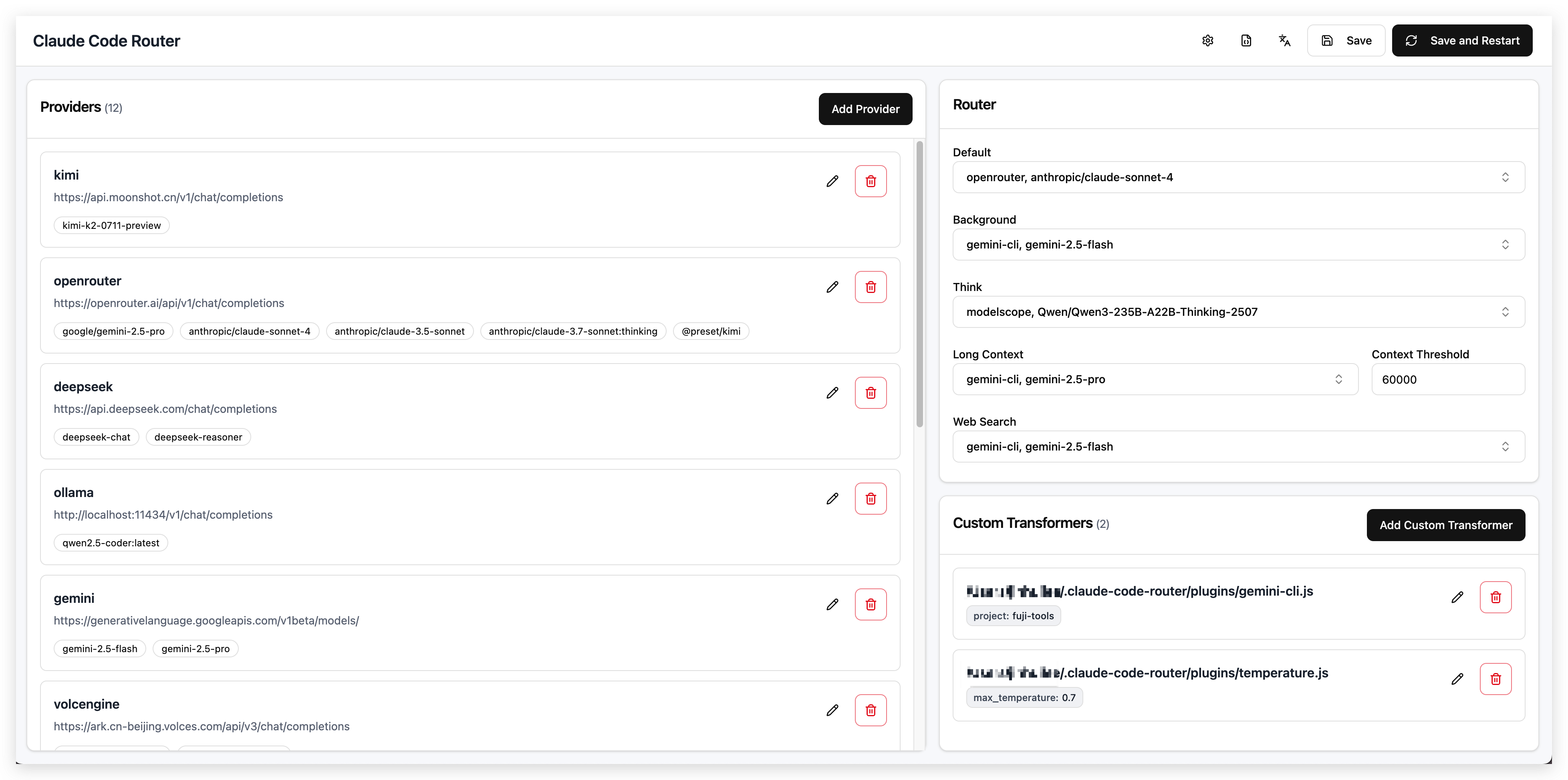

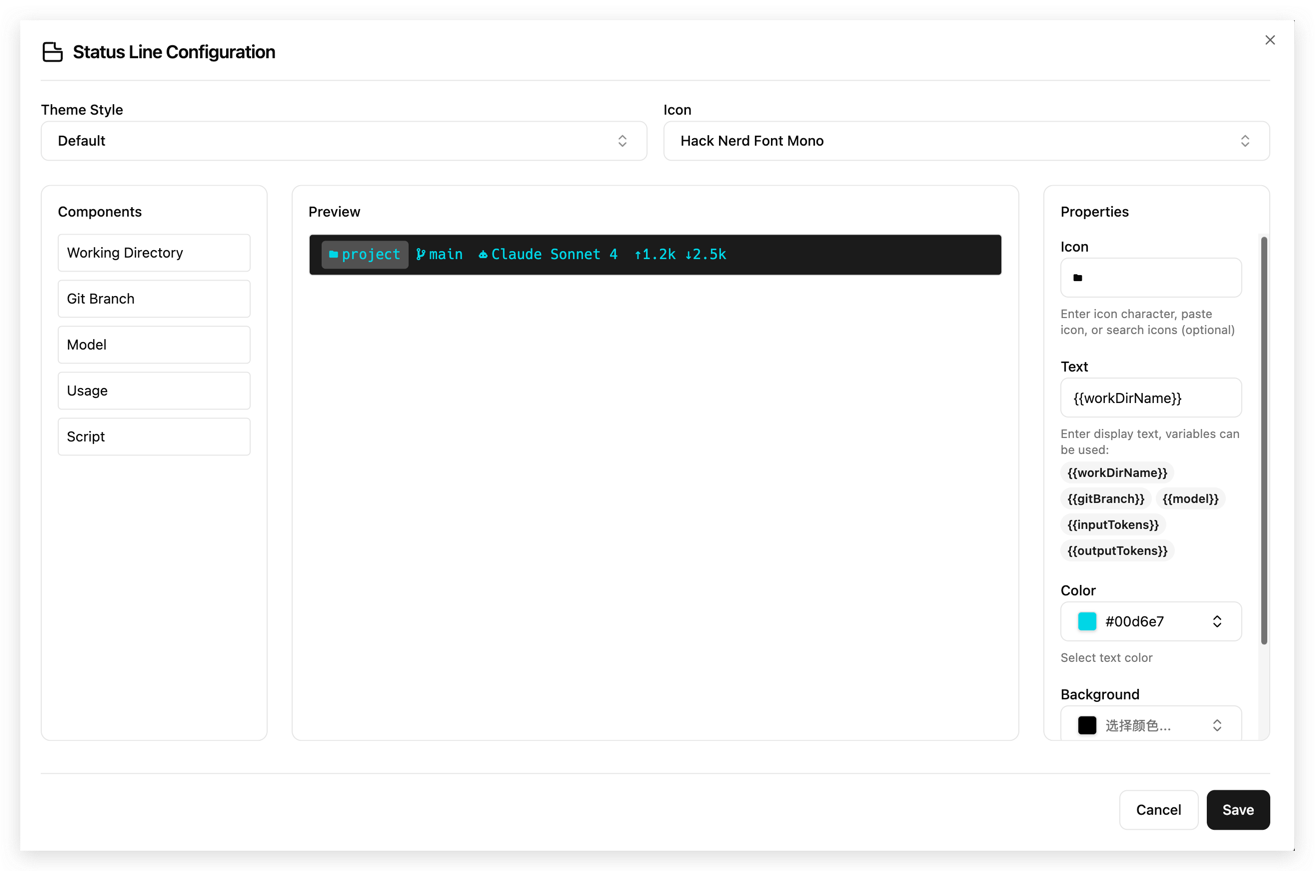

4. UI 模式

为了获得更直观的体验,你可以使用 UI 模式来管理你的配置:

ccr ui

这将打开一个基于 Web 的界面,你可以在其中轻松查看和编辑你的 config.json 文件。

5. CLI 模型管理

对于喜欢使用终端工作流的用户,可以使用交互式的 CLI 模型选择器:

ccr model

该命令提供了一个交互式界面,用于:

- 查看当前配置:

- 查看所有已配置的模型(默认、背景、思考、长上下文、网页搜索、图像)

- 切换模型:快速更改每种路由器类型所使用的模型

- 添加新模型:将模型添加到现有提供商

- 创建新提供商:设置完整的提供商配置,包括:

- 提供商名称和 API 端点

- API 密钥

- 可用模型

- 转换器配置,支持:

- 多个转换器(openrouter、deepseek、gemini 等)

- 转换器选项(例如,带有自定义限制的 maxtoken)

- 特定提供商的路由规则(例如,OpenRouter 提供商偏好)

CLI 工具会验证所有输入,并提供有用的提示来引导您完成配置过程,从而轻松管理复杂的设置,而无需手动编辑 JSON 文件。

6. 预设管理

预设允许您轻松保存、共享和重复使用配置。您可以将当前配置导出为预设,并从文件或 URL 安装预设。

# 将当前配置导出为预设

ccr preset export my-preset

# 带元数据导出

ccr preset export my-preset --description "我的 OpenAI 配置" --author "您的姓名" --tags "openai,production"

# 从本地目录安装预设

ccr preset install /path/to/preset

# 列出所有已安装的预设

ccr preset list

# 显示预设信息

ccr preset info my-preset

# 删除预设

ccr preset delete my-preset

预设功能:

- 导出:将当前配置保存为预设目录(包含 manifest.json)

- 安装:从本地目录安装预设

- 敏感数据处理:API 密钥和其他敏感数据在导出时会自动被屏蔽(标记为

{{field}}占位符) - 动态配置:预设可以包含输入模式,以便在安装时收集所需信息

- 版本控制:每个预设都包含版本元数据,用于跟踪更新

预设文件结构:

~/.claude-code-router/presets/

├── my-preset/

│ └── manifest.json # 包含配置和元数据

7. 激活命令(环境变量设置)

activate 命令允许您在 shell 中全局设置环境变量,从而使您可以直接使用 claude 命令,或将 Claude Code Router 与使用 Agent SDK 构建的应用程序集成。

要激活环境变量,请运行:

eval "$(ccr activate)"

该命令会以适合 shell 的格式输出必要的环境变量,然后在当前 shell 会话中进行设置。激活后,您可以:

- 直接使用

claude命令:无需使用ccr code即可运行claude命令。claude命令将自动通过 Claude Code Router 路由请求。 - 与 Agent SDK 应用程序集成:使用 Anthropic Agent SDK 构建的应用程序将自动使用已配置的路由器和模型。

activate 命令会设置以下环境变量:

ANTHROPIC_AUTH_TOKEN:来自您的配置的 API 密钥ANTHROPIC_BASE_URL:本地路由器端点(默认:http://127.0.0.1:3456)NO_PROXY:设置为127.0.0.1,以防止代理干扰DISABLE_TELEMETRY:禁用遥测DISABLE_COST_WARNINGS:禁用成本警告API_TIMEOUT_MS:来自您的配置的 API 超时时间

注意:在使用激活后的环境变量之前,请确保 Claude Code Router 服务正在运行(

ccr start)。这些环境变量仅对当前 shell 会话有效。如需使其持久化,可将eval "$(ccr activate)"添加到您的 shell 配置文件中(例如~/.zshrc或~/.bashrc)。

提供商

Providers 数组是您定义要使用的不同模型提供商的地方。每个提供商对象需要:

name:提供商的唯一名称。api_base_url:聊天完成的完整 API 端点。api_key:您对该提供商的 API 密钥。models:该提供商可用的模型列表。transformer(可选):指定用于处理请求和响应的转换器。

转换器

转换器允许您修改请求和响应负载,以确保与不同提供商 API 的兼容性。

- 全局转换器:将转换器应用于提供商的所有模型。在此示例中,

openrouter转换器被应用于openrouter提供商下的所有模型。{ "name": "openrouter", "api_base_url": "https://openrouter.ai/api/v1/chat/completions", "api_key": "sk-xxx", "models": [ "google/gemini-2.5-pro-preview", "anthropic/claude-sonnet-4", "anthropic/claude-3.5-sonnet" ], "transformer": { "use": ["openrouter"] } } - 特定模型转换器:将转换器应用于特定模型。在此示例中,

deepseek转换器被应用于所有模型,而额外的tooluse转换器仅应用于deepseek-chat模型。{ "name": "deepseek", "api_base_url": "https://api.deepseek.com/chat/completions", "api_key": "sk-xxx", "models": ["deepseek-chat", "deepseek-reasoner"], "transformer": { "use": ["deepseek"], "deepseek-chat": { "use": ["tooluse"] } } } - 向转换器传递选项:某些转换器,如

maxtoken,接受选项。要传递选项,可以使用嵌套数组,其中第一个元素是转换器名称,第二个元素是选项对象。{ "name": "siliconflow", "api_base_url": "https://api.siliconflow.cn/v1/chat/completions", "api_key": "sk-xxx", "models": ["moonshotai/Kimi-K2-Instruct"], "transformer": { "use": [ [ "maxtoken", { "max_tokens": 16384 } ] ] } }

可用的内置转换器:

Anthropic:如果仅使用Anthropic转换器,它将保留原始的请求和响应参数(你可以直接用它连接到 Anthropic 的 API 端点)。deepseek:为 DeepSeek API 适配请求/响应。gemini:为 Gemini API 适配请求/响应。openrouter:为 OpenRouter API 适配请求/响应。它还可以接受一个provider路由参数,以指定 OpenRouter 应该使用哪些底层提供商。更多详情请参阅 OpenRouter 文档。示例如下:"transformer": { "use": ["openrouter"], "moonshotai/kimi-k2": { "use": [ [ "openrouter", { "provider": { "only": ["moonshotai/fp8"] } } ] ] } }groq:为 groq API 适配请求/响应。maxtoken:设置特定的max_tokens值。tooluse:通过tool_choice优化某些模型的工具使用。gemini-cli(实验性):通过 Gemini CLI gemini-cli.js 对 Gemini 提供非官方支持。reasoning:用于处理reasoning_content字段。sampling:用于处理采样相关字段,如temperature、top_p、top_k和repetition_penalty。enhancetool:为 LLM 返回的工具调用参数增加一层容错机制(这会导致工具调用信息不再以流式传输)。cleancache:从请求中清除cache_control字段。vertex-gemini:使用 Vertex 认证来处理 Gemini API。chutes-glm:通过 Chutes chutes-glm-transformer.js 对 GLM 4.5 模型提供非官方支持。qwen-cli(实验性):通过 Qwen CLI qwen-cli.js 对 qwen3-coder-plus 模型提供非官方支持。rovo-cli(实验性):通过 Atlassian Rovo Dev CLI rovo-cli.js 对 gpt-5 提供非官方支持。

自定义转换器:

你也可以创建自己的转换器,并通过 config.json 中的 transformers 字段加载它们。

{

"transformers": [

{

"path": "/User/xxx/.claude-code-router/plugins/gemini-cli.js",

"options": {

"project": "xxx"

}

}

]

}

路由器

Router 对象定义了在不同场景下应使用的模型:

default:通用任务的默认模型。background:后台任务使用的模型。这可以是一个较小的本地模型,以节省成本。think:用于推理密集型任务的模型,比如计划模式。longContext:用于处理长上下文的模型(例如超过 60K 个 token)。longContextThreshold(可选):触发长上下文模型的 token 数阈值。若未指定,则默认为 60000。webSearch:用于处理网络搜索任务,这需要模型本身支持该功能。如果你使用 openrouter,则需要在模型名称后添加:online后缀。image(测试版):用于处理图像相关任务(由 CCR 内置代理支持)。如果模型不支持工具调用,则需要将config.forceUseImageAgent属性设置为true。

你还可以在 Claude Code 中使用 /model 命令动态切换模型:

/model provider_name,model_name

示例:/model openrouter,anthropic/claude-3.5-sonnet

自定义路由器

对于更高级的路由逻辑,你可以在 config.json 中通过 CUSTOM_ROUTER_PATH 指定自定义路由器脚本。这允许你实现超出默认场景的复杂路由规则。

在你的 config.json 中:

{

"CUSTOM_ROUTER_PATH": "/User/xxx/.claude-code-router/custom-router.js"

}

自定义路由器文件必须是一个导出 async 函数的 JavaScript 模块。该函数接收请求对象和配置对象作为参数,并应返回一个字符串形式的提供者和模型名称(例如 "provider_name,model_name"),或返回 null 以回退到默认路由器。

以下是一个基于 custom-router.example.js 的 custom-router.js 示例:

// /User/xxx/.claude-code-router/custom-router.js

/**

* 自定义路由器函数,根据请求决定使用哪个模型。

*

* @param {object} req - 来自 Claude Code 的请求对象,包含请求体。

* @param {object} config - 应用程序的配置对象。

* @returns {Promise<string|null>} - 一个 Promise,解析为“provider,model_name”字符串,或返回 null 以使用默认路由器。

*/

module.exports = async function router(req, config) {

const userMessage = req.body.messages.find((m) => m.role === "user")?.content;

if (userMessage && userMessage.includes("explain this code")) {

// 使用强大的模型进行代码解释

return "openrouter,anthropic/claude-3.5-sonnet";

}

// 回退到默认的路由器配置

return null;

};

子代理路由

对于子代理内的路由,你必须在子代理提示的开头包含 <CCR-SUBAGENT-MODEL>provider,model</CCR-SUBAGENT-MODEL>,以指定特定的提供者和模型。这样可以将特定的子代理任务定向到指定的模型。

示例:

<CCR-SUBAGENT-MODEL>openrouter,anthropic/claude-3.5-sonnet</CCR-SUBAGENT-MODEL>

请帮我分析这段代码,看看是否有优化的空间……

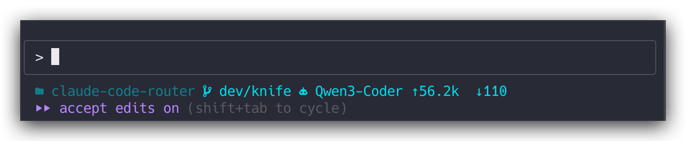

状态栏(测试版)

为了更好地监控 claude-code-router 运行时的状态,v1.0.40 版本内置了一个状态栏工具,你可以在 UI 中启用它。

效果如下:

🤖 GitHub Actions

将 Claude Code Router 集成到您的 CI/CD 流水线中。在设置好 Claude Code Actions 后,修改您的 .github/workflows/claude.yaml 文件以使用该路由器:

name: Claude Code

on:

issue_comment:

types: [created]

# ... 其他触发条件

jobs:

claude:

if: |

(github.event_name == 'issue_comment' && contains(github.event.comment.body, '@claude')) ||

# ... 其他条件

runs-on: ubuntu-latest

permissions:

contents: read

pull-requests: read

issues: read

id-token: write

steps:

- name: 检出仓库

uses: actions/checkout@v4

with:

fetch-depth: 1

- name: 准备环境

run: |

curl -fsSL https://bun.sh/install | bash

mkdir -p $HOME/.claude-code-router

cat << 'EOF' > $HOME/.claude-code-router/config.json

{

"log": true,

"NON_INTERACTIVE_MODE": true,

"OPENAI_API_KEY": "${{ secrets.OPENAI_API_KEY }}",

"OPENAI_BASE_URL": "https://api.deepseek.com",

"OPENAI_MODEL": "deepseek-chat"

}

EOF

shell: bash

- name: 启动 Claude Code Router

run: |

nohup ~/.bun/bin/bunx @musistudio/claude-code-router@1.0.8 start &

shell: bash

- name: 运行 Claude Code

id: claude

uses: anthropics/claude-code-action@beta

env:

ANTHROPIC_BASE_URL: http://localhost:3456

with:

anthropic_api_key: "any-string-is-ok"

注意:在 GitHub Actions 或其他自动化环境中运行时,请确保在配置中设置

"NON_INTERACTIVE_MODE": true,以防止因标准输入处理问题而导致进程挂起。

此设置允许实现一些有趣的自动化任务,例如在非高峰时段运行任务以降低 API 成本。

📝 更多阅读

❤️ 支持与赞助

如果您觉得这个项目很有帮助,请考虑赞助它的开发。您的支持将不胜感激!

|

|

我们的赞助者

衷心感谢所有赞助者的慷慨支持!

- AIHubmix

- BurnCloud

- 302.AI

- Z智谱

- @Simon Leischnig

- @duanshuaimin

- @vrgitadmin

- @*o

- @ceilwoo

- @*说

- @*更

- @K*g

- @R*R

- @bobleer

- @*苗

- @*划

- @Clarence-pan

- @carter003

- @S*r

- @*晖

- @*敏

- @Z*z

- @*然

- @cluic

- @*苗

- @PromptExpert

- @*应

- @yusnake

- @*飞

- @董*

- @*汀

- @*涯

- @*:-)

- @**磊

- @*琢

- @*成

- @Z*o

- @*琨

- @congzhangzh

- @*_

- @Z*m

- @*鑫

- @c*y

- @*昕

- @witsice

- @b*g

- @*亿

- @*辉

- @JACK

- @*光

- @W*l

- @kesku

- @biguncle

- @二吉吉

- @a*g

- @*林

- @*咸

- @*明

- @S*y

- @f*o

- @*智

- @F*t

- @r*c

- @qierkang

- @*军

- @snrise-z

- @*王

- @greatheart1000

- @*王

- @zcutlip

- @Peng-YM

- @*更

- @*.

- @F*t

- @*政

- @*铭

- @*叶

- @七*o

- @*青

- @**晨

- @*远

- @*霄

- @**吉

- @**飞

- @**驰

- @x*g

- @**东

- @*落

- @哆*k

- @*涛

- @苗大

- @*呢

- @\d*u

- @crizcraig

- s*s

- *火

- *勤

- **锟

- *涛

- **明

- *知

- *语

- *瓜

(如果您的名字被遮挡,请通过我的主页邮箱联系我,以便用您的 GitHub 用户名更新。)

相似工具推荐

openclaw

OpenClaw 是一款专为个人打造的本地化 AI 助手,旨在让你在自己的设备上拥有完全可控的智能伙伴。它打破了传统 AI 助手局限于特定网页或应用的束缚,能够直接接入你日常使用的各类通讯渠道,包括微信、WhatsApp、Telegram、Discord、iMessage 等数十种平台。无论你在哪个聊天软件中发送消息,OpenClaw 都能即时响应,甚至支持在 macOS、iOS 和 Android 设备上进行语音交互,并提供实时的画布渲染功能供你操控。 这款工具主要解决了用户对数据隐私、响应速度以及“始终在线”体验的需求。通过将 AI 部署在本地,用户无需依赖云端服务即可享受快速、私密的智能辅助,真正实现了“你的数据,你做主”。其独特的技术亮点在于强大的网关架构,将控制平面与核心助手分离,确保跨平台通信的流畅性与扩展性。 OpenClaw 非常适合希望构建个性化工作流的技术爱好者、开发者,以及注重隐私保护且不愿被单一生态绑定的普通用户。只要具备基础的终端操作能力(支持 macOS、Linux 及 Windows WSL2),即可通过简单的命令行引导完成部署。如果你渴望拥有一个懂你

stable-diffusion-webui

stable-diffusion-webui 是一个基于 Gradio 构建的网页版操作界面,旨在让用户能够轻松地在本地运行和使用强大的 Stable Diffusion 图像生成模型。它解决了原始模型依赖命令行、操作门槛高且功能分散的痛点,将复杂的 AI 绘图流程整合进一个直观易用的图形化平台。 无论是希望快速上手的普通创作者、需要精细控制画面细节的设计师,还是想要深入探索模型潜力的开发者与研究人员,都能从中获益。其核心亮点在于极高的功能丰富度:不仅支持文生图、图生图、局部重绘(Inpainting)和外绘(Outpainting)等基础模式,还独创了注意力机制调整、提示词矩阵、负向提示词以及“高清修复”等高级功能。此外,它内置了 GFPGAN 和 CodeFormer 等人脸修复工具,支持多种神经网络放大算法,并允许用户通过插件系统无限扩展能力。即使是显存有限的设备,stable-diffusion-webui 也提供了相应的优化选项,让高质量的 AI 艺术创作变得触手可及。

everything-claude-code

everything-claude-code 是一套专为 AI 编程助手(如 Claude Code、Codex、Cursor 等)打造的高性能优化系统。它不仅仅是一组配置文件,而是一个经过长期实战打磨的完整框架,旨在解决 AI 代理在实际开发中面临的效率低下、记忆丢失、安全隐患及缺乏持续学习能力等核心痛点。 通过引入技能模块化、直觉增强、记忆持久化机制以及内置的安全扫描功能,everything-claude-code 能显著提升 AI 在复杂任务中的表现,帮助开发者构建更稳定、更智能的生产级 AI 代理。其独特的“研究优先”开发理念和针对 Token 消耗的优化策略,使得模型响应更快、成本更低,同时有效防御潜在的攻击向量。 这套工具特别适合软件开发者、AI 研究人员以及希望深度定制 AI 工作流的技术团队使用。无论您是在构建大型代码库,还是需要 AI 协助进行安全审计与自动化测试,everything-claude-code 都能提供强大的底层支持。作为一个曾荣获 Anthropic 黑客大奖的开源项目,它融合了多语言支持与丰富的实战钩子(hooks),让 AI 真正成长为懂上

ComfyUI

ComfyUI 是一款功能强大且高度模块化的视觉 AI 引擎,专为设计和执行复杂的 Stable Diffusion 图像生成流程而打造。它摒弃了传统的代码编写模式,采用直观的节点式流程图界面,让用户通过连接不同的功能模块即可构建个性化的生成管线。 这一设计巧妙解决了高级 AI 绘图工作流配置复杂、灵活性不足的痛点。用户无需具备编程背景,也能自由组合模型、调整参数并实时预览效果,轻松实现从基础文生图到多步骤高清修复等各类复杂任务。ComfyUI 拥有极佳的兼容性,不仅支持 Windows、macOS 和 Linux 全平台,还广泛适配 NVIDIA、AMD、Intel 及苹果 Silicon 等多种硬件架构,并率先支持 SDXL、Flux、SD3 等前沿模型。 无论是希望深入探索算法潜力的研究人员和开发者,还是追求极致创作自由度的设计师与资深 AI 绘画爱好者,ComfyUI 都能提供强大的支持。其独特的模块化架构允许社区不断扩展新功能,使其成为当前最灵活、生态最丰富的开源扩散模型工具之一,帮助用户将创意高效转化为现实。

gemini-cli

gemini-cli 是一款由谷歌推出的开源 AI 命令行工具,它将强大的 Gemini 大模型能力直接集成到用户的终端环境中。对于习惯在命令行工作的开发者而言,它提供了一条从输入提示词到获取模型响应的最短路径,无需切换窗口即可享受智能辅助。 这款工具主要解决了开发过程中频繁上下文切换的痛点,让用户能在熟悉的终端界面内直接完成代码理解、生成、调试以及自动化运维任务。无论是查询大型代码库、根据草图生成应用,还是执行复杂的 Git 操作,gemini-cli 都能通过自然语言指令高效处理。 它特别适合广大软件工程师、DevOps 人员及技术研究人员使用。其核心亮点包括支持高达 100 万 token 的超长上下文窗口,具备出色的逻辑推理能力;内置 Google 搜索、文件操作及 Shell 命令执行等实用工具;更独特的是,它支持 MCP(模型上下文协议),允许用户灵活扩展自定义集成,连接如图像生成等外部能力。此外,个人谷歌账号即可享受免费的额度支持,且项目基于 Apache 2.0 协议完全开源,是提升终端工作效率的理想助手。

markitdown

MarkItDown 是一款由微软 AutoGen 团队打造的轻量级 Python 工具,专为将各类文件高效转换为 Markdown 格式而设计。它支持 PDF、Word、Excel、PPT、图片(含 OCR)、音频(含语音转录)、HTML 乃至 YouTube 链接等多种格式的解析,能够精准提取文档中的标题、列表、表格和链接等关键结构信息。 在人工智能应用日益普及的今天,大语言模型(LLM)虽擅长处理文本,却难以直接读取复杂的二进制办公文档。MarkItDown 恰好解决了这一痛点,它将非结构化或半结构化的文件转化为模型“原生理解”且 Token 效率极高的 Markdown 格式,成为连接本地文件与 AI 分析 pipeline 的理想桥梁。此外,它还提供了 MCP(模型上下文协议)服务器,可无缝集成到 Claude Desktop 等 LLM 应用中。 这款工具特别适合开发者、数据科学家及 AI 研究人员使用,尤其是那些需要构建文档检索增强生成(RAG)系统、进行批量文本分析或希望让 AI 助手直接“阅读”本地文件的用户。虽然生成的内容也具备一定可读性,但其核心优势在于为机器