MassGen

MassGen 是一款运行在终端的开源多智能体扩展系统,旨在通过协作式人工智能解决复杂任务。它不再依赖单个模型“单打独斗”,而是自主编排多个前沿 AI 模型与智能体,让它们并行工作、相互观察、批判并迭代优化彼此的结果。当智能体们认为已找到足够好的答案时,会通过投票机制达成共识,最终输出集体验证的高质量结果。

这一机制有效解决了传统单代理系统在应对高难度问题时容易出现的逻辑断层或质量不稳定痛点,利用冗余处理和集体智慧显著提升了输出的可靠性与速度(实测可达 4 倍加速)。其核心理念源自“思维线程”与“迭代优化”,并扩展了经典的多智能体对话框架。

MassGen 特别适合开发者、AI 研究人员以及需要处理复杂逻辑推理任务的技术团队使用。它不仅支持跨模型协同和实时可视化监控,还能作为技能插件无缝集成到 Claude Code、Cursor 等 40 多种主流开发工具中。对于希望探索多智能体规模化应用、追求更高代码质量或研究共识机制的用户来说,MassGen 提供了一个原则清晰且易于上手的高效平台。

使用场景

某金融科技团队需要在极短时间内,基于最新监管文件重构核心风控系统的代码逻辑,并确保零逻辑漏洞。

没有 MassGen 时

- 单模型局限明显:资深工程师依赖单个大模型生成代码,常因模型“幻觉”遗漏边缘情况,导致风控规则覆盖不全。

- 人工审查耗时:团队成员需轮流手动审查每一段生成代码,反复进行多轮对话修正错误,开发周期被拉长数倍。

- 缺乏一致性验证:不同成员对监管条款理解存在偏差,生成的代码逻辑前后矛盾,难以在部署前发现深层逻辑冲突。

- 迭代效率低下:遇到复杂逻辑死胡同时,只能人工重启会话或更换提示词,无法自动利用之前的失败经验进行优化。

使用 MassGen 后

- 多智能体协同纠错:MassGen 自动调度多个异构 Agent 并行处理同一任务,它们互相观察、批判并构建彼此的代码方案,自动填补单一模型的盲区。

- 共识机制保障质量:系统通过多轮迭代 refinement,只有当多个 Agent 对某段风控逻辑投票达成共识时才输出结果,显著降低逻辑漏洞率。

- 自动化深度推理:面对复杂监管条款,Agent 们自主进行“思维链”推演和重启尝试,无需人工干预即可突破逻辑死角,输出高鲁棒性代码。

- 终端可视化监控:工程师在终端即可实时看到多个 Agent 的协作辩论过程和收敛路径,将原本数天的审查工作压缩至小时级。

MassGen 通过将“单人独斗”升级为“群体智慧共识”,在确保金融级代码严谨性的同时,实现了研发效率的倍数级跃升。

运行环境要求

- Linux

- macOS

- Windows

未说明 (主要基于 API 调用云端模型,本地仅需运行协调逻辑)

未说明

快速开始

🚀 MassGen: 多智能体生成式AI扩展系统

MassGen是一个前沿的多智能体系统,利用协作式AI的力量来解决复杂任务。

通过协作、持续改进的智能体实现AI规模化(速度提升4倍)

MassGen是一个尖端的多智能体框架,它通过冗余和迭代优化来协调AI智能体解决复杂任务。每个智能体都会处理整个问题,在优化和重启的循环中相互观察、批评并在此基础上继续工作。当智能体认为答案足够可靠时,它们会进行投票,最终由集体验证的最佳答案胜出。这种并行优化与集体验证的方法为原则性的多智能体扩展奠定了基础,系统能够通过利用不同智能体的视角,并以共识来确保质量,从而不断改进其输出。

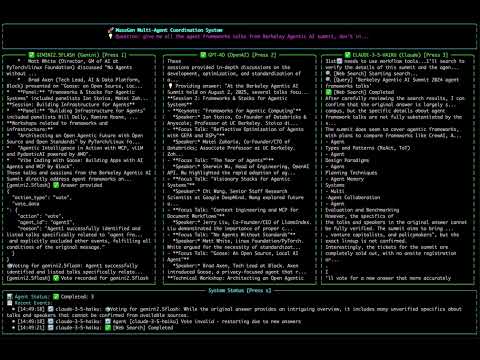

该项目始于《推理的神话》(The Myth of Reasoning)中提出的“思维线程”和“迭代优化”理念,并扩展了AG2(AG2)中的经典“多智能体对话”思想。这里有一段在2025年伯克利代理型AI峰会上介绍背景情况的视频记录。

🧩 将MassGen用作技能: npx skills add massgen/skills --all — 然后在Claude Code、Cursor、Copilot或其他40多个智能体中调用该技能。 了解更多 →

📚 致贡献者: 请参阅MassGen贡献者手册 - 面向开发和研究团队的集中化政策与资源

📋 目录

🆕 最新特性

🚀 快速入门

🤖 自动化与LLM集成

💡 案例研究与示例

🗺️ 路线图

- 近期成就(v0.1.73)

- 之前成就(v0.0.3 - v0.1.72)

- 关键未来增强功能

- 错误修复与后端改进

- 高级智能体协作

- 扩展模型、工具和智能体集成

- 性能与可扩展性提升

- 开发者体验优化

- v0.1.74路线图

✨ 核心功能

| 功能 | 描述 |

|---|---|

| 🤝 跨模型/代理协同 | 充分利用由不同前沿模型驱动的代理的优势 |

| ⚡ 并行处理 | 多个代理同时解决任务 |

| 👥 智能共享 | 代理之间共享并相互学习彼此的工作成果 |

| 🔄 达成共识 | 通过协作式优化自然收敛 |

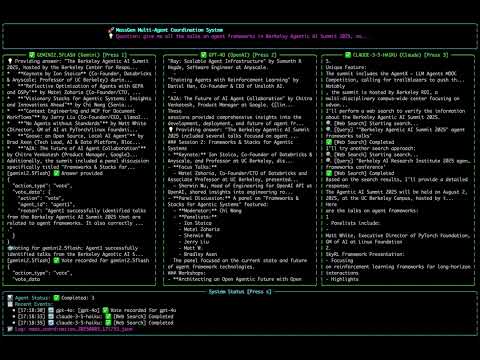

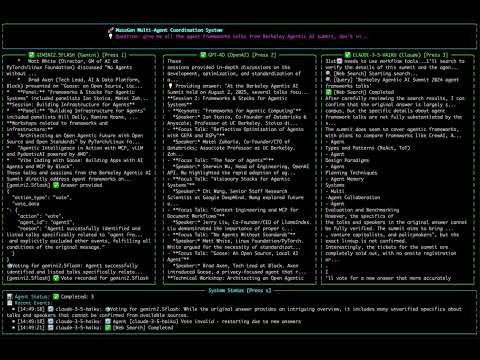

| 🖥️ 实时可视化 | 默认提供带有时间线、代理卡片和投票跟踪的交互式文本 TUI。此外还支持 Web UI 和丰富显示模式。 |

🆕 最新特性(v0.1.73)

🎉 发布日期:2026年4月6日

v0.1.73 新增内容:

- 🧬 评估标准进化子代理 - 一种可在多轮中不断进化评估标准的新类型子代理。

- 🛡️ 检查点目标模式 - 初步实现了检查点 MCP 的

objective模式,用于规划不可逆操作的安全性。 - 👁️ 评估标准可见性提升 - 更清晰地展示代理当前所依据的评估标准。

体验 v0.1.73 特性:

pip install massgen==0.1.73

uv run massgen --config @examples/features/trace_analyzer_background.yaml "创建一个 AI 代理编码的 SVG 图像。"

🏗️ 系统设计

MassGen 采用专为无缝多代理协作设计的架构运行:

graph TB

O[🚀 MassGen 协调器<br/>📋 任务分配与协调]

subgraph 协作代理

A1[代理 1<br/>🏗️ Anthropic/Claude + 工具]

A2[代理 2<br/>🌟 Google/Gemini + 工具]

A3[代理 3<br/>🤖 OpenAI/GPT + 工具]

A4[代理 4<br/>⚡ xAI/Grok + 工具]

end

H[🔄 共享协作中心<br/>📡 实时通知与共识]

O --> A1 & A2 & A3 & A4

A1 & A2 & A3 & A4 <--> H

classDef orchestrator fill:#e1f5fe,stroke:#0288d1,stroke-width:3px

classDef agent fill:#f3e5f5,stroke:#7b1fa2,stroke-width:2px

classDef hub fill:#e8f5e8,stroke:#388e3c,stroke-width:2px

class O orchestrator

class A1,A2,A3,A4 agent

class H hub

系统的运行流程基于以下核心原则:

并行处理 - 多个代理同时处理同一任务,各自发挥其独特能力(不同的模型、工具和专业方法)。

实时协作 - 代理通过通知系统持续共享工作摘要和见解,从而相互学习并在此基础上构建集体知识。

收敛检测 - 系统智能监测代理何时在解决方案上达到稳定状态,并通过自然协作而非强制一致达成共识。

适应性协调 - 当代理从其他成员处获得新见解时,可以重新开始并优化工作,从而形成动态且响应迅速的解决问题环境。

这种协作方式确保最终输出能够充分利用多个 AI 系统的集体智慧,产生比单个代理单独完成时更为稳健和全面的结果。

📖 完整文档: 如需全面指南、API 参考及详细示例,请访问 MassGen 官方文档

🚀 快速入门

1. 📥 安装

方法 1:PyPI 安装(推荐 - Python 3.11+):

# 使用 pip 安装 MassGen

pip install massgen

# 或使用 uv(更快)

pip install uv

uv venv && source .venv/bin/activate

uv pip install massgen

# 如果您使用 uv 安装 massgen,请确保先激活虚拟环境 source .venv/bin/activate,

# 或在所有命令前加上 "uv run"。

快速启动设置(最快运行方式):

# 步骤 1:设置 API 密钥、Docker 和技能

uv run massgen --setup

# 步骤 2:创建简单配置并启动

uv run massgen --quickstart

--setup 命令将:

- 配置您的 API 密钥(OpenAI、Anthropic、Google、xAI)

- 提供设置 Docker 镜像以执行代码的选项

- 提供安装技能的选项(openskills、Anthropic/OpenAI/Vercel 系列、Agent Browser 技能、Crawl4AI)

--quickstart 命令将:

- 询问您希望使用的代理数量(1–5 个,默认 3 个)

- 询问每个代理的后端或模型

- 对于 GPT-5x 模型,会询问

reasoning.effort参数(low|medium|high;Codex GPT-5 模型还包括xhigh) - 自动检测 Docker 是否可用,并配置执行模式

- 如果选择 Docker 模式,则会显示技能步骤,您可以从中选择软件包(基于 openskills 的 Anthropic/OpenAI/Vercel/Agent Browser 以及 Crawl4AI),并实时安装这些技能

- 创建一个即用型配置,并启动进入交互式 TUI 模式。

🤖 在您的 AI 编码代理中使用 MassGen:

安装 MassGen 技能,以便直接从 Claude Code、OpenAI Codex、GitHub Copilot、Cursor 以及其他支持 Agent Skills 标准的 40 多种代理 中调用 MassGen:

npx skills add massgen/skills

然后使用 /massgen(Claude Code)或 $massgen(Codex)来运行多代理评估、规划、编写规格说明或任何通用任务。有关各代理的具体安装选项,请参阅 技能文档。

🖥️ 文本 TUI(默认显示模式):

MassGen 默认启动交互式终端用户界面 (TUI),提供:

- 📊 所有代理活动的实时时间线

- 🎯 每位团队成员的独立代理状态卡

- 🗳️ 投票可视化及共识跟踪

- 💬 多轮对话管理

- ⌨️ 键盘控制导航(↑/↓ 滚动,'q' 取消)

旧版富文本显示:

massgen --display rich "您的问题"

替代方案:完整设置向导

如需更多控制,可使用完整的配置向导:

uv run massgen --init

该向导将引导您完成用例选择(研究、代码、问答等)以及高级配置选项。

设置完成后:

# 交互模式

uv run massgen

# 单一查询

uv run massgen "您的问题在这里"

# 使用示例配置

uv run massgen --config @examples/basic/multi/three_agents_default "您的问题"

→ 请参阅 安装指南 获取完整的设置说明。

方法 2:开发环境安装(适用于贡献者):

克隆仓库

git clone https://github.com/Leezekun/MassGen.git

cd MassGen

以可编辑模式使用 pip 安装

选项 1(推荐):使用 uv 安装(更快)

uv venv

source .venv/bin/activate # Windows: .venv\Scripts\activate

uv pip install -e .

# 如果您使用 uv 安装 massgen,请确保先激活虚拟环境 source .venv/bin/activate,

# 或在所有命令前加上 "uv run"。

# 自动化设置(适用于所有平台)——安装依赖项、技能、Docker 镜像,并配置 API 密钥

uv run massgen --setup

# 或者使用 Bash 脚本(仅限 Unix/Linux/macOS),需手动配置 API 密钥,详见下文

uv run ./scripts/init.sh

# 如果您希望稍后再安装其他依赖项

# 这里有一个轻量级的设置脚本,仅安装技能(适用于所有平台)

uv run massgen --setup-skills

# 或者使用 Bash 脚本(仅限 Unix/Linux/macOS)

uv run ./scripts/init_skills.sh

选项 2:使用传统 Python 环境

pip install -e .

# 可选:集成外部框架

pip install -e ".[external]"

# 自动化设置(适用于所有平台)——安装依赖项、技能、Docker 镜像,并配置 API 密钥

massgen --setup

# 或者使用 Bash 脚本(仅限 Unix/Linux/macOS),需手动配置 API 密钥,详见下文

./scripts/init.sh

# 如果您希望稍后再安装其他依赖项

# 这里有一个轻量级的设置脚本,仅安装技能(适用于所有平台)

massgen --setup-skills

# 或者使用 Bash 脚本(仅限 Unix/Linux/macOS)

./scripts/init_skills.sh

注意:

--setup和--setup-skills命令支持跨平台运行(Windows、macOS、Linux)。Bash 脚本(init.sh、init_skills.sh)仅适用于 Unix 系统,但提供了额外的开发环境设置,例如构建 Docker 镜像。

替代安装方法(点击展开)

使用 uv 和 venv:

git clone https://github.com/Leezekun/MassGen.git

cd MassGen

uv venv

source .venv/bin/activate # Windows: .venv\Scripts\activate

uv pip install -e .

使用传统 Python venv:

git clone https://github.com/Leezekun/MassGen.git

cd MassGen

python -m venv .venv

source .venv/bin/activate # Windows: .venv\Scripts\activate

pip install -e .

使用 uv 工具进行全局安装:

git clone https://github.com/Leezekun/MassGen.git

cd MassGen

uv tool install -e .

# 现在可以在任何目录下运行

uv tool run massgen --config @examples/basic/multi/three_agents_default "Question"

向后兼容(uv run):

cd /path/to/MassGen

uv run massgen --config @examples/basic/multi/three_agents_default "Question"

uv run python -m massgen.cli --config config.yaml "Question"

可选 CLI 工具:

# Claude Code CLI — 高级编码助手

npm install -g @anthropic-ai/claude-code

# LM Studio — 本地模型推理

# macOS/Linux:

sudo ~/.lmstudio/bin/lms bootstrap

# Windows:

cmd /c %USERPROFILE%\.lmstudio\bin\lms.exe bootstrap

设置完成后:

# 交互模式

uv run massgen

# 单次查询

uv run massgen "您的问题"

# 使用示例配置

uv run massgen --config @examples/basic/multi/three_agents_default "您的问题"

2. 🔐 API 配置

在工作目录中创建一个 .env 文件,并填写您的 API 密钥:

# 将此模板复制到 .env 文件中,并添加您的 API 密钥

OPENAI_API_KEY=sk-...

ANTHROPIC_API_KEY=sk-ant-...

GOOGLE_API_KEY=...

XAI_API_KEY=...

# 可选:其他提供商的密钥

CEREBRAS_API_KEY=...

TOGETHER_API_KEY=...

GROQ_API_KEY=...

OPENROUTER_API_KEY=...

MassGen 会自动从当前目录下的 .env 文件中加载 API 密钥。

→ 完整设置指南(包含所有提供商): 请参阅文档中的 API 密钥配置

获取 API 密钥:

- OpenAI | Claude | Gemini | Grok

- Azure OpenAI | Cerebras | OpenRouter | 更多提供商...

3. 🧩 支持的模型与工具

模型

当前系统支持多家具备先进能力的模型提供商:

基于 API 的模型:

- OpenAI:GPT-5.2(推荐默认)、GPT-5.1、GPT-5 系列(GPT-5、GPT-5-mini、GPT-5-nano)、GPT-5.1-Codex 系列、GPT-4.1 系列、GPT-4o、o4-mini,支持推理、网络搜索、代码解释器及计算机使用功能

- 注意:我们推荐使用 GPT-5.2/5.1/5 而非 Codex 模型。Codex 模型针对较短的系统消息进行了优化,可能无法很好地配合 MassGen 的协调提示。

- 推理设置:GPT-5.1 和 GPT-5.2 默认为

reasoning: none。MassGen 在未提供推理配置时会自动设置reasoning.effort: medium,这与 GPT-5 的默认行为一致。

- Azure OpenAI:任何 Azure 部署的模型(GPT-4、GPT-4o、GPT-35-turbo 等)

- Claude / Anthropic:Claude Opus 4.5、Claude Haiku 4.5、Claude Sonnet 4.5、Claude Opus 4.1、Claude Sonnet 4

- 高级工具支持:网络搜索、代码执行、Files API、程序化工具调用、延迟加载的工具搜索

- Claude Code:原生 Claude Code SDK,支持服务器端会话持久化和内置开发工具

- Gemini:Gemini 3 Pro、Gemini 2.5 Flash、Gemini 2.5 Pro,支持代码执行和上下文增强

- Grok / xAI:Grok-4.1、Grok-4、Grok-3、Grok-3-mini,配备 Grok 实时搜索功能

- Cerebras AI:为支持的模型提供超快速推理

- Together AI、Fireworks AI、Groq:为 LLaMA、Mistral、Qwen 等开源模型提供快速推理

- OpenRouter:多模型聚合平台,动态列出 400 多种模型

- Kimi / Moonshot:通过兼容 OpenAI 的 API 使用中文 AI 模型

- Nebius AI Studio:云端推理平台

- POE:Quora 的 AI 平台,可动态发现模型

- Qwen / Alibaba:通过 DashScope API 使用 Qwen 模型

- Z AI / Zhipu:GLM-4.5 及相关模型

本地模型支持:

vLLM & SGLang:统一的推理后端,同时支持 vLLM 和 SGLang 服务器

- vLLM(端口 8000)和 SGLang(端口 30000),提供兼容 OpenAI 的 API

- 支持

top_k、repetition_penalty、chat_template_kwargs参数 - SGLang 特有的

separate_reasoning参数,适用于需要独立思考的模型 - 混合服务器部署示例配置文件:

two_qwen_vllm_sglang.yaml

LM Studio:在本地运行开放权重模型,并实现自动服务器管理

- 自动安装 LM Studio CLI

- 自动下载并加载模型

- 支持 LLaMA、Mistral、Qwen 等开放权重模型

→ 完整模型列表及配置详情,请参阅 支持的模型

工具

MassGen 代理可以利用多种工具来提升其问题解决能力:

- 内置工具:网络搜索、代码执行、Bash/Shell(取决于提供商)

- 文件系统:原生文件操作或通过 MCP

- MCP 集成:连接任意 MCP 服务器以扩展功能

- 自定义工具:通过 YAML 配置定义您自己的工具

- 多模态:图像、音频、视频的理解与生成(原生或通过自定义工具)

→ 有关详细后端能力和工具支持矩阵,请参阅 用户指南 - 后端

4. 🏃 运行 MassGen

完整使用指南:关于所有使用模式、高级功能以及交互式多轮会话,请参阅 运行 MassGen

🚀 入门

CLI 配置参数

| 参数 | 描述 |

|---|---|

--config |

指向包含代理定义、模型参数、后端参数和 UI 设置的 YAML 配置文件路径 |

--backend |

快速设置时使用的后端类型,无需配置文件(claude、claude_code、gemini、grok、openai、azure_openai、zai)。对于具有默认后端的模型,此选项为可选。 |

--model |

快速设置时使用的模型名称(例如,gemini-2.5-flash、gpt-5-nano等)。--config 和 --model 互斥——只能选择其中之一。 |

--system-message |

快速设置模式下代理的系统提示语。如果提供了 --config,则忽略 --system-message。 |

--cwd-context |

将当前工作目录作为运行时上下文路径添加:ro/read 表示只读,rw/write 表示读写权限。在 TUI 中,这将初始化与 Ctrl+P 相同的状态。 |

--plan |

仅规划模式。代理会创建结构化的任务计划,但不会自动执行。 |

--plan-depth |

--plan 的规划粒度:dynamic、shallow、medium 或 deep。 |

--plan-and-execute |

同时运行规划和执行两个阶段:先创建计划,再自动执行。 |

--execute-plan |

根据路径、计划 ID 或 latest 执行现有计划。 |

--no-display |

禁用实时流媒体 UI 协调显示(回退到简单的文本输出)。 |

--no-logs |

禁用实时日志记录。 |

--debug |

启用调试模式并进行详细日志记录(v0.0.13 新增)。显示详细的编排活动、代理消息、后端操作和工具调用。调试日志保存至 agent_outputs/log_{time}/massgen_debug.log。 |

"<your question>" |

可选的单次提问输入;若省略,MassGen 将进入交互式聊天模式。 |

0. 兰开普兼容 HTTP 服务器(新增)

将 MassGen 作为OpenAI 兼容的 HTTP API 运行(FastAPI + Uvicorn)。这对于将 MassGen 集成到预期接收 POST /v1/chat/completions 请求的现有工具中非常有用。

# 启动服务器(默认:主机 0.0.0.0,端口 4000)

massgen serve

# 显式绑定 + 模型/配置默认值

massgen serve --host 0.0.0.0 --port 4000 --config path/to/config.yaml --default-model gpt-5

端点

GET /healthPOST /v1/chat/completions(支持stream: trueSSE 和 OpenAI 风格的工具调用)

cURL 示例

# 健康检查

curl http://localhost:4000/health

# 非流式对话完成

curl http://localhost:4000/v1/chat/completions \

-H "Content-Type: application/json" \

-d '{

"model": "massgen",

"messages": [{"role": "user", "content": "hi"}],

"stream": false

}'

# 流式(Server-Sent Events)

curl -N http://localhost:4000/v1/chat/completions \

-H "Content-Type: application/json" \

-d '{

"model": "massgen",

"messages": [{"role": "user", "content": "hi"}],

"stream": true

}'

注意事项

- 支持客户端提供的

tools,但与 MassGen 工作流工具名称冲突的工具将被拒绝。 - 环境变量(可选):

MASSGEN_SERVER_HOST、MASSGEN_SERVER_PORT、MASSGEN_SERVER_DEFAULT_CONFIG、MASSGEN_SERVER_DEFAULT_MODEL、MASSGEN_SERVER_DEBUG。

1. 单个代理(最简单启动方式)

快速启动命令:

使用任何支持的模型进行快速测试 - 无需配置

uv run python -m massgen.cli --model claude-sonnet-4-5-20250929 "什么是机器学习?" uv run python -m massgen.cli --model gemini-3-pro-preview "解释量子计算" uv run python -m massgen.cli --model gpt-5-nano "总结最新的AI发展"

**配置:**

使用 `agent` 字段定义一个具有后端和设置的单一智能体:

```yaml

agent:

id: "<agent_name>"

backend:

type: "azure_openai" | "chatcompletion" | "claude" | "claude_code" | "gemini" | "grok" | "openai" | "zai" | "lmstudio" #后端类型

model: "<model_name>" # 模型名称

api_key: "<optional_key>" # 后端的API密钥。默认使用环境变量。

system_message: "..." # 单一智能体的系统消息

2. 多智能体协作(推荐)

配置:

使用 agents 字段定义多个智能体,每个智能体都有自己的后端和配置:

快速入门命令:

# 三个强大的智能体协同工作——Gemini、GPT-5 和 Grok

massgen --config @examples/basic/multi/three_agents_default \

"分析可再生能源的优缺点"

这展示了 MassGen 的核心优势:

- Gemini 3 Pro - 带有网络搜索的快速研究

- GPT-5 Nano - 具有代码执行能力的高级推理

- Grok-4 Fast - 实时信息与不同视角

agents: # 多个智能体(替代 'agent')

- id: "<agent1 name>"

backend:

type: "azure_openai" | "chatcompletion" | "claude" | "claude_code" | "gemini" | "grok" | "openai" | "zai" | "lmstudio" #后端类型

model: "<model_name>" # 模型名称

api_key: "<optional_key>" # 后端的API密钥。默认使用环境变量。

system_message: "..." # 单一智能体的系统消息

- id: "..."

backend:

type: "..."

model: "..."

...

system_message: "..."

3. 模型上下文协议 (MCP)

模型上下文协议 (MCP) 标准化了应用程序向语言模型暴露工具和上下文的方式。根据官方文档:

MCP 是一种开放协议,用于标准化应用程序向 LLM 提供上下文的方式。可以将 MCP 看作是 AI 应用程序的 USB-C 接口。就像 USB-C 为您的设备提供了一种连接各种外设和配件的标准方式一样,MCP 也为 AI 模型提供了连接不同数据源和工具的标准方式。

MCP 配置参数:

| 参数 | 类型 | 必需 | 描述 |

|---|---|---|---|

mcp_servers |

字典 | 是(对于 MCP) | MCP 服务器定义的容器 |

└─ type |

字符串 | 是 | 传输方式:“stdio” 或 “streamable-http” |

└─ command |

字符串 | 仅 stdio | 运行 MCP 服务器的命令 |

└─ args |

列表 | 仅 stdio | 命令的参数 |

└─ url |

字符串 | 仅 http | 服务器端点 URL |

└─ env |

字典 | 否 | 要传递的环境变量 |

allowed_tools |

列表 | 否 | 白名单特定工具(若省略,则所有工具可用) |

exclude_tools |

列表 | 否 | 黑名单危险或不需要的工具 |

快速入门命令(在此处查看后端是否支持 MCP):

# GPT-5 天气服务

massgen --config @examples/tools/mcp/gpt5_nano_mcp_example \

"纽约本周的天气预报是什么?"

# Gemini 多工具 MCP —— 搜索 + 天气 + 文件系统(需要在 .env 中设置 BRAVE_API_KEY)

massgen --config @examples/tools/mcp/multimcp_gemini \

"查找巴黎最好的餐厅,并将推荐保存到文件中"

配置:

agents:

# 基本 MCP 配置:

backend:

type: "openai" # 您选择的后端

model: "gpt-5-mini" # 您选择的模型

# 在此处添加 MCP 服务器

mcp_servers:

weather: # 服务器名称(由您命名)

type: "stdio" # 通信类型

command: "npx" # 要运行的命令

args: ["-y", "@modelcontextprotocol/server-weather"] # MCP 服务器包

# 就这样!智能体现在可以查询天气了。

# 多工具 MCP 示例:

backend:

type: "gemini"

model: "gemini-3.0-pro-preview"

mcp_servers:

# 网络搜索

search:

type: "stdio"

command: "npx"

args: ["-y", "@modelcontextprotocol/server-brave-search"]

env:

BRAVE_API_KEY: "${BRAVE_API_KEY}" # 在 .env 文件中设置

# 基于 HTTP 的 MCP 服务器(streamable-http 传输)

custodm_api:

type: "streamable-http" # 适用于 HTTP/SSE 服务器

url: "http://localhost:8080/mcp/sse" # 服务器端点

# 工具配置(MCP 工具会自动发现)

allowed_tools: # 可选:白名单特定工具

- "mcp__weather__get_current_weather"

- "mcp__test_server__mcp_echo"

- "mcp__test_server__add_numbers"

exclude_tools: # 可选:黑名单特定工具

- "mcp__test_server__current_time"

→ 如需全面的 MCP 集成指南,请参阅 MCP 集成

4. 文件系统操作与工作区管理

MassGen 通过多种后端提供了全面的文件系统支持,使智能体能够在有序的工作区中读取、写入和操作文件。

文件系统配置参数:

| 参数 | 类型 | 必需 | 描述 |

|---|---|---|---|

cwd |

字符串 | 是(用于文件操作) | 文件操作的工作目录(智能体专属的工作区) |

snapshot_storage |

字符串 | 是 | 工作区快照的存储目录 |

agent_temporary_workspace |

字符串 | 是 | 临时工作区的父目录 |

快速入门命令:

# Claude Code 文件操作

massgen --config @examples/tools/filesystem/claude_code_single \

"创建一个 Python 网络爬虫,并将结果保存为 CSV 文件"

# 多智能体文件协作

massgen --config @examples/tools/filesystem/claude_code_context_sharing \

"生成包含图表和分析的综合项目报告"

配置:

# 基本工作区设置:

agents:

- id: "file-agent"

backend:

type: "claude_code" # 支持文件操作的后端

cwd: "workspace" # 文件操作的隔离工作区

# 多智能体工作空间隔离:

agents:

- id: "agent_a"

backend:

type: "claude_code"

cwd: "workspace1" # 智能体专用工作空间

- id: "agent_b"

backend:

type: "gemini"

cwd: "workspace2" # 独立工作空间

orchestrator:

snapshot_storage: "snapshots" # 共享快照目录

agent_temporary_workspace: "temp_workspaces" # 临时工作空间管理

可用文件操作:

- Claude Code: 内置工具(读取、写入、编辑、多编辑、Bash、Grep、Glob、LS、TodoWrite)

- 其他后端:通过 MCP 文件系统服务器

工作空间管理:

- 隔离的工作空间:每个智能体的

cwd完全隔离且可写 - 快照存储:在 Claude Code 智能体之间共享工作空间上下文

- 临时工作空间:智能体可以访问之前的协调结果

⚠️ 重要安全警告

MassGen 智能体可以在其被允许的目录内自主地读取、写入、修改和删除文件。

在运行具有文件系统访问权限的 MassGen 之前:

- 仅授予对您愿意让智能体修改的目录的访问权限

- 使用权限系统在必要时限制写入权限

- 建议先在一个隔离的目录或虚拟环境中进行测试

- 在授予写入权限前备份重要文件

- 仔细检查

context_paths配置一旦授予权限,智能体将无需额外确认即可执行文件操作。

→ 如需全面的文件操作指南,请参阅 文件操作

5. 项目集成与用户上下文路径(v0.0.21 新增)

直接与您现有的项目协作!用户上下文路径允许您在保持细粒度权限控制的同时,与所有智能体共享特定目录。这使得在您的实际代码库、文档和数据上进行安全的多智能体协作成为可能。

MassGen 会自动将其所有工作文件组织到项目根目录下的 .massgen/ 目录中,从而保持项目整洁,并便于将 MassGen 的临时文件从版本控制系统中排除。

项目集成参数:

| 参数 | 类型 | 必需 | 描述 |

|---|---|---|---|

context_paths |

列表 | 是(用于项目集成) | 所有智能体共享的目录 |

└─ path |

字符串 | 是 | 您项目目录的绝对或相对路径(必须是目录,不能是文件) |

└─ permission |

字符串 | 是 | 访问级别:“read” 或 “write”(写权限仅适用于最终智能体) |

└─ protected_paths |

列表 | 否 | 不受修改影响的文件/目录(相对于上下文路径) |

⚠️ 重要提示:

- 上下文路径必须指向目录,而非单个文件

- 路径可以是绝对路径或相对路径(相对于当前工作目录解析)

- 写权限仅在展示阶段适用于最终智能体

- 在协调过程中,所有上下文路径均为只读,以保护您的文件

- MassGen 会在启动时验证所有路径,对于缺失路径或文件路径,将显示明确的错误信息

快速入门命令:

# 多智能体协作,改进位于 `massgen/configs/resources/v0.0.21-example` 的网站

massgen --config @examples/tools/filesystem/gpt5mini_cc_fs_context_path "请对网站进行以下优化:1) 添加带有平滑过渡效果的暗色/浅色主题切换功能;2) 实现一项交互式功能,帮助用户更好地参与博客内容(您可以选择搜索、按主题筛选、阅读时间估算、社交分享、评论互动等);3) 通过 CSS 动画或过渡效果提升视觉效果,使网站更具现代感和响应性。请使用原生 JavaScript 实现,并在具体实现细节上发挥创意。"

配置:

# 基本项目集成:

agents:

- id: "code-reviewer"

backend:

type: "claude_code"

cwd: "workspace" # 智能体的隔离工作区

orchestrator:

context_paths:

- path: "." # 当前目录(相对路径)

permission: "write" # 最终智能体可以创建/修改文件

protected_paths: # 可选:不受修改影响的文件

- ".env"

- "config.json"

- path: "/home/user/my-project/src" # 绝对路径示例

permission: "read" # 智能体可以分析您的代码

# 高级:多智能体项目协作

agents:

- id: "analyzer"

backend:

type: "gemini"

cwd: "analysis_workspace"

- id: "implementer"

backend:

type: "claude_code"

cwd: "implementation_workspace"

orchestrator:

context_paths:

- path: "../legacy-app/src" # 相对路径,指向现有代码库

permission: "read" # 只读现有代码库

- path: "../legacy-app/tests"

permission: "write" # 最终智能体可以编写新测试

protected_paths: # 保护特定测试文件

- "integration_tests/production_data_test.py"

- path: "/home/user/modernized-app" # 绝对路径

permission: "write" # 最终智能体可以创建现代化版本

这展示了项目集成:

- 真实项目访问 - 使用您的实际代码库,而非副本

- 安全权限控制 - 对智能体可读/可修改的内容进行细粒度控制

- 多智能体协作 - 多个智能体可安全地协同处理同一项目

- 上下文智能体(协调期间):始终为只读访问,以保护您的文件

- 最终智能体(最终执行):获得配置的权限(只读或写入)

使用场景:

- 代码审查:智能体分析源代码并提出改进建议

- 文档生成:智能体阅读项目文档以理解上下文,并生成更新内容

- 数据处理:智能体访问共享数据集并生成分析报告

- 项目迁移:智能体检查现有项目并创建现代化版本

整洁的项目组织结构:

your-project/

├── .massgen/ # 所有 MassGen 状态文件

│ ├── sessions/ # 多轮对话历史(若交互式使用)

│ │ └── session_20240101_143022/

│ │ ├── turn_1/ # 第一轮结果

│ │ ├── turn_2/ # 第二轮结果

│ │ └── SESSION_SUMMARY.txt # 人类可读摘要

│ ├── workspaces/ # 智能体工作目录

│ │ ├── agent1/ # 单个智能体的工作空间

│ │ └── agent2/

│ ├── snapshots/ # 工作空间快照,用于协调

│ └── temp_workspaces/ # 上一轮结果,用作上下文

├── massgen/

└── ...

优势:

- ✅ 项目整洁 - 所有 MassGen 文件都集中在一个目录中

- ✅ 轻松 Gitignore - 只需将

.massgen/添加到.gitignore - ✅ 便携性 - 移动或删除

.massgen/不会影响您的项目 - ✅ 多轮会话 - 对话历史在不同会话间得以保留

配置自动整理:

orchestrator:

# 用户指定简单名称 - MassGen 自动在 .massgen/ 下组织

snapshot_storage: "snapshots" # → .massgen/snapshots/

agent_temporary_workspace: "temp" # → .massgen/temp/

agents:

- backend:

cwd: "workspace1" # → .massgen/workspaces/workspace1/

→ 如需全面的项目集成指南,请参阅 项目集成

安全注意事项:

- 智能体 ID 安全性:避免使用带有递增数字的智能体 ID(如

agent1、agent2)。这可能导致投票过程中 ID 泄露 - 文件访问控制:必要时使用 MCP 服务器配置限制文件访问

- 路径验证:所有上下文路径都会被验证,确保其存在且为目录(而非文件)

- 仅目录型上下文路径:上下文路径必须指向目录,而非单个文件

各提供商的额外示例

Claude(递归 MCP 执行 - v0.0.20+)

# Claude 配合高级工具链

massgen --config @examples/tools/mcp/claude_mcp_example \

"研究并比较北京和上海的天气情况"

OpenAI(GPT-5 系列配合 MCP - v0.0.17+)

# GPT-5 结合天气信息与外部工具

massgen --config @examples/tools/mcp/gpt5_nano_mcp_example \

"东京现在的天气如何"

Gemini(多服务器 MCP - v0.0.15+)

# Gemini 配合多个 MCP 服务

massgen --config @examples/tools/mcp/multimcp_gemini \

"在巴黎寻找住宿,并进行社区分析" # (需要在 .env 中设置 BRAVE_API_KEY)

Claude Code(开发工具)

# 专业开发环境,自动配置工作空间

uv run python -m massgen.cli \

--backend claude_code \

--model sonnet \

"创建一个带有身份验证功能的 Flask Web 应用"

# 默认工作空间目录会自动生成:

# - workspace1/ (工作目录)

# - snapshots/ (工作空间快照)

# - temp_workspaces/ (临时智能体工作空间)

本地模型(LM Studio - v0.0.7+)

# 在本地运行开源模型

massgen --config @examples/providers/local/lmstudio \

"解释机器学习的概念"

其他使用案例示例

问答与研究:

# 多视角复杂研究

massgen --config @examples/basic/multi/gemini_gpt5_claude \

"2025年10月在斯德哥尔摩有哪些值得体验的活动"

# 特定研究需求

massgen --config @examples/basic/multi/gemini_gpt5_claude \

"请列出2025年伯克利代理智能峰会中关于代理框架的所有演讲"

创意写作:

# 多个创意智能体共同创作故事

massgen --config @examples/basic/multi/gemini_gpt5_claude \

"写一篇关于机器人发现音乐的短篇小说"

开发与编码:

# 全栈开发,包含文件操作

massgen --config @examples/tools/filesystem/claude_code_single \

"创建一个带有身份验证功能的 Flask Web 应用"

网页自动化:(仍在测试中)

# 浏览器自动化,结合截图与报告

# 前提条件:安装 npm install @playwright/mcp@latest(用于 Playwright MCP 服务器)

massgen --config @examples/tools/code-execution/multi_agent_playwright_automation \

"浏览 https://github.com/Leezekun/MassGen 中的三个问题,并提出文档改进建议。将截图和建议整合到一个网站中。"

# 数据提取与分析

massgen --config @examples/tools/code-execution/multi_agent_playwright_automation \

"前往 https://news.ycombinator.com,提取前10条新闻,并制作一份总结报告"

→ 查看详细案例研究,包含真实的会话记录和成果

交互模式与进阶用法

多轮对话:

# 开始交互式聊天(无需初始问题)

massgen --config @examples/basic/multi/three_agents_default

# 快速添加只读 CWD 上下文

massgen --config @examples/basic/multi/three_agents_default --cwd-context ro

# 快速添加当前工作目录上下文(读+写)

massgen --config @examples/basic/multi/three_agents_default --cwd-context rw

# 调试模式用于故障排除

massgen --config @examples/basic/multi/three_agents_default \

--debug "你的问题"

配置文件

MassGen 的配置按功能和使用场景进行组织。详细的组织结构和示例请参阅 配置指南。

快速导航:

查看 MCP 服务器设置指南:Discord MCP | Twitter MCP

后端配置参考

有关所有支持的后端(OpenAI、Claude、Gemini、Grok 等)的详细配置,请参阅:

→ 后端配置指南

交互式多轮模式

MassGen 支持交互式模式,您可以在其中与系统进行持续对话:

# 使用单个智能体启动交互式模式(默认未启用工具)

uv run python -m massgen.cli --model gpt-5-mini

# 使用配置文件启动交互式模式

uv run python -m massgen.cli \

--config massgen/configs/basic/multi/three_agents_default.yaml

交互式模式功能:

- 多轮对话:多个智能体协作与您进行持续对话

- 实时协调跟踪:实时可视化智能体之间的交互、投票及决策过程

- 实时反馈:显示智能体和系统的实时状态,并增强协调可视化效果

- 多行输入:使用

"""或'''输入多行消息 - 斜杠命令:

/help或/h- 显示可用命令/status- 显示当前系统状态/config- 打开配置文件/clear或/reset- 清除对话历史并重新开始/quit、/exit或/q- 退出会话(或按Ctrl+C)

观看录制演示:

5. 📊 查看结果

系统提供了多种方式来查看和分析结果:

实时显示

- 实时协作视图:通过多区域终端显示,查看智能体并行工作的情况

- 状态更新:实时显示阶段转换、投票进展和共识形成过程

- 流式输出:观看智能体的推理和响应逐步展开

在此处观看示例:

全面日志记录

所有会话都会自动记录,包含详细的调试和分析信息。

实时交互:

- 在执行过程中按

r键,可在终端中查看协调表格 - 实时观察智能体协作、投票并达成共识的过程

日志存储结构

.massgen/

└── massgen_logs/

└── log_YYYYMMDD_HHMMSS/ # 带时间戳的日志目录

├── agent_<id>/ # 智能体特定的协调日志

│ └── YYYYMMDD_HHMMSS_NNNNNN/ # 带时间戳的协调步骤

│ ├── answer.txt # 智能体在该步骤的回答

│ ├── context.txt # 智能体可用的上下文

│ └── workspace/ # 智能体工作空间(如果使用了文件系统工具)

├── agent_outputs/ # 整合后的输出文件

│ ├── agent_<id>.txt # 每个智能体的完整输出

│ ├── final_presentation_agent_<id>.txt # 获胜智能体的最终答案

│ ├── final_presentation_agent_<id>_latest.txt # 最新版本的符号链接

│ └── system_status.txt # 系统状态及元数据

├── final/ # 最终展示阶段

│ └── agent_<id>/ # 获胜智能体的最终成果

│ ├── answer.txt # 最终答案

│ └── context.txt # 最终上下文

├── coordination_events.json # 结构化的协调事件日志

├── coordination_table.txt # 人类可读的协调表格

├── vote.json # 最终投票统计及共识信息

├── massgen.log # 完整的调试日志(或在调试模式下为 massgen_debug.log)

├── snapshot_mappings.json # 工作空间快照元数据

└── execution_metadata.yaml # 查询、配置及执行详情

重要日志文件

- 协调表格(

coordination_table.txt):完整展示多智能体协调情况,包括事件时间线、投票模式和共识形成过程。 - 协调事件(

coordination_events.json):所有事件的结构化 JSON 日志(started_streaming、new_answer、vote、restart、final_answer)。 - 投票汇总(

vote.json):最终投票统计、获胜智能体及共识信息。 - 执行元数据(

execution_metadata.yaml):原始查询、时间戳、配置及执行环境,便于复现。 - 智能体输出(

agent_outputs/):所有智能体的完整输出历史及最终展示。 - 调试日志(

massgen.log):系统运行的完整操作记录、API 调用、工具使用情况及错误追踪信息(使用--debug可获取详细日志)。

→ 如需全面的日志记录指南及调试技巧,请参阅 日志与调试

🤖 自动化与 LLM 集成

→ 对于 LLM 智能体:请参阅 AI_USAGE.md,获取完整的命令行使用指南

MassGen 提供了专为 LLM 智能体和程序化工作流设计的 自动化模式:

快速入门 - 自动化模式

# 以最小化输出和状态跟踪运行

uv run massgen --automation --config your_config.yaml "你的问题"

综合指南

→ 包含示例的完整自动化指南: 自动化指南

涵盖主题:

- 完整的自动化模式及错误处理

- 并行实验执行

- 性能优化建议及故障排除

Python API 和 LiteLLM

通过熟悉的 LiteLLM/OpenAI 接口以编程方式使用 MassGen:

from dotenv import load_dotenv

load_dotenv() # 从 .env 文件加载 API 密钥

import litellm

from massgen import register_with_litellm

register_with_litellm()

# 多智能体调用,采用斜杠格式:“后端/模型”

response = litellm.completion(

model="massgen/build",

messages=[{"role": "user", "content": "比较人工智能的不同方法"}],

optional_params={"models": ["openai/gpt-5", "groq/llama-3.3-70b"]}

)

print(response.choices[0].message.content) # 最终共识答案

或者直接使用 Python API:

from dotenv import load_dotenv

load_dotenv()

import asyncio

import massgen

result = asyncio.run(massgen.run(

query="什么是机器学习?",

models=["openai/gpt-5", "gemini/gemini-3-pro-preview"]

))

print(result["final_answer"]) # 获胜智能体的共识答案

完整 API 参考: 程序化 API 指南

💡 案例研究

要了解 MassGen 在实际中的运作方式,请查看这些基于真实会话日志的详细案例研究:

精选:

全部案例研究:

- MassGen 案例研究

- 案例研究文档 - 在线浏览案例研究

🗺️ 路线图

MassGen 目前处于基础阶段,重点是并行、异步的多智能体协作与编排。我们的路线图旨在将这一基础转化为一个高度稳健、智能且用户友好的系统,同时支持前沿研究与探索。

⚠️ 早期阶段提示: 由于 MassGen 处于积极开发中,随着我们不断优化和改进系统,预计未来会有重大架构变更。

最新进展(v0.1.73)

🎉 发布日期:2026年4月6日

评估标准进化器与检查点目标

- 评估标准进化子代理(#1047):一种新型子代理,可在各轮中不断进化评估标准——随着运行推进,评估标准将更加精准、更具倾向性。

- 检查点目标模式(初稿)(#1047):检查点 MCP 的初稿,包含

objective模式,用于规划不可逆操作的安全性。 - 评估标准可见性提升:更清晰地展示智能体当前依据的评估标准。

前期进展(v0.0.3 - v0.1.72)

✅ Grok 后端更新及熔断器第二阶段(v0.1.72):Grok 后端更新至最新版本。LLM API 熔断器现已扩展至 ChatCompletions、Response API 和 Gemini 后端(此前仅适用于 Claude)。

✅ 追踪记忆与评估优化(v0.1.71):每轮结束后,后台会启动追踪分析子代理,将执行轨迹中的洞察写入记忆。评估标准生成及系统提示词调优得到改进。

✅ 评估标准重新设计(v0.1.70):重新设计了三层评估标准,加入反模式定义和期望陈述。检查清单驱动的评估机制进一步完善。新增快速迭代模式、WebUI 审核模态窗口以及后台追踪分析功能。

✅ WebUI 自动化与技能优化(v0.1.69):WebUI 自动化功能无需浏览器交互即可自动启动。MassGen 技能重新设计,提升易用性并与 WebUI 更好集成。快速入门向导重构,工作区浏览器功能扩展。

✅ 检查点模式(v0.1.68):新增检查点协调模式,采用委托者模式——主智能体先单独规划,再通过 checkpoint() 工具委派给团队。LLM API 熔断器新增对 429 错误的处理功能。WebUI 支持检查点功能。LiteLLM 供应链问题修复。

✅ 现代化 WebUI(v0.1.67):全面改版 WebUI,新增内联最终答案、键盘快捷键和 Zustand 状态管理。引入 RoundBudgetGuardHook 实现每轮成本控制。统一并行预协作阶段。增加回归防护机制。

✅ 步骤模式(v0.1.66):新增 --step CLI 模式,供外部编排工具使用。支持 massgen-refinery 插件的步骤模式。修复 Codex Windows UTF-8 编码问题,并对控制台文本进行净化处理。

✅ MassGen Refinery 插件(v0.1.65):独立的 MCP 服务器(质量、工作流、媒体),通过 massgen-refinery 插件将 MassGen 的检查清单式评估引入 Claude Code。单智能体精炼已可运行;多智能体仍在实验阶段。

✅ Gemini CLI 后端(v0.1.64):Gemini CLI 成为一流后端,支持会话持久化、MCP 工具和 Docker 部署。OpenAI Response API 支持 WebSocket 流式传输。新增执行轨迹分析子代理。Copilot Docker 模式启用。

✅ 子代理集合与合约(v0.1.63):子代理集合模式,默认启用 disable_injection 和 defer_voting_until_all_answered。推动本轮评估者的转变,并引入成功合约。子代理精简优化,增强抗杀伤能力。

✅ MassGen 技能与观察器(v0.1.62):通用型多智能体技能,具备四种模式(通用、评估、计划、规格),适用于 Claude Code 及其他 AI 代理。提供会话观察器,实时监控运行情况。针对 Claude Code、Codex 和 Copilot 进行后端优化。新增无头模式和 Web 快速入门模式。

✅ 本轮评估者范式(v0.1.61):新增一轮评估者子代理类型,每次有新答案时自动启动评估子代理,提供详细反馈作为下一轮输入。大规模重构编排器,优化评估提示词、任务计划注入及子代理相关修复。

✅ 多模态工具、子代理增强及 GPT-5.4(v0.1.60):重写 read_media 函数,明确数据结构并引入 MediaCallLedgerHook。子代理增强功能包括 inherit_spawning_agent_backend、final_answer_strategy 和 per-agent subagent_agents。GPT-5.4 成为默认的 OpenAI 旗舰模型。分解模式与检查清单工作流协同。修复 Codex 提示词缓存问题。

✅ 质量回合改进(v0.1.59):自动添加任务计划改进内容,优化计划审查流程。评估生成配置更好,检查清单修复,Gemini 工具名称规范化以适应 MCP。调整子代理行为,修复 Docker 技能写入权限问题。调整视频生成技能,并恢复影响指标。

✅ 全面多模态升级(v0.1.58):引入 ElevenLabs TTS/STT、Nano Banana 2 图像生成、Grok 多媒体生成、媒体生成技能以及多轮图像编辑功能。Nvidia NIM 后端上线。重新思考质量子代理。检查清单更智能,包含改进/保留条目。CLI 模式标志位及日志架构重构。

✅ 委托子代理协议与构建者子代理(v0.1.57):基于文件的委托协议,用于在容器内启动主机端子代理。新增构建者子代理类型,支持以全新上下文生成大型工件。引入实质性跟踪机制,实现更智能的收敛。更新SDK中的Claude Code推理参数。

✅ 规范计划模式与定向消息传递(v0.1.56):通过plan_mode="spec"正式定义需求规格,并支持TUI规范模式。利用target_agents参数实现代理间的定向消息传递。新增批评者子代理用于质量评估。保持媒体对话连续性,便于后续图像分析。修复Codex OAuth登录问题。

✅ 专业化子代理类型与动态评估标准(v0.1.55):通过SUBAGENT.md前端元数据定义基于发现的子代理角色(评估员、探索者、研究员、新颖性)。借鉴GEPA理念,设置任务特定的评估标准,包含核心与扩展门控。原生后端图像路由功能。支持可配置的视频帧提取。

✅ 子代理消息传递与Copilot SDK后端(v0.1.54):运行时消息可用于引导正在执行的后台子代理。新增GitHub Copilot后端,基于copilot-sdk并原生支持MCP。支持Gemini 3.1 Pro。提供按代理注入的目标定位功能。

✅ 后台工具执行(v0.1.53):为长时间运行的任务提供非阻塞的生命周期工具(启动、监控、等待、取消、列出)。规划任务验证要求。TUI提供后台作业指示器和生命周期控制。奠定子代理基础设施基础,包括评估员和探索者类型。

✅ 最终答案模态与协调质量门控(v0.1.52):专用的最终答案模态,配备标签页式答案及工作区/评审界面。实质性门控可防止低价值迭代循环。新颖性注入机制对抗过早收敛。代理身份版本化,用于追踪答案来源。

✅ 评审协调与变更文档(v0.1.51):具备多文件差异可视化的评审模态。决策日志系统用于多代理协调的可追溯性。基于Changedoc锚定的评估清单,附带差距报告。漂移冲突策略确保更安全的变更应用。新增--cwd-context CLI标志。

✅ 分块计划执行与技能生命周期管理(v0.1.50):分块计划执行,通过进度检查点更安全地完成长篇任务。技能生命周期管理,支持整合、整理以及加载上一 session 的技能。迭代式计划评审模态。响应式TUI模式栏。工作树改进,支持分支累积及跨代理差异可见性。

✅ 协调质量:日志分析TUI、公平性门控与清单投票(v0.1.49):内置日志分析模式于TUI模式栏,便于应用内运行分析。公平性门控防止快速代理主导协调过程。清单投票工具用于结构化质量评估。自动化测试基础设施,配备CI/CD及SVG快照基准。

✅ 分解模式与工作树隔离(v0.1.48):新增分解协调模式,将任务分解为子任务分配给各代理,并指定一名汇报人;基于Git工作树的隔离机制,用于代理文件写入,并配备评审模态;快速入门向导提供Docker部署,带有动画拉取进度;停止工具用于代理完成信号传递。

✅ Codex后端与TUI主题重构(v0.1.47):新增Codex后端,支持OpenAI Codex CLI的本地及Docker运行;NativeToolMixin用于共享工具处理;TUI主题系统重构为基于调色板的架构,提供深色与浅色两种方案;支持按代理配置投票敏感度。

✅ 子代理TUI流式传输与事件架构重构(v0.1.46):交互式预览卡片可展开为完整时间线视图,支持实时事件流;统一事件管道,提供单一事实源用于展示创建;增强最终呈现效果,加入工作区可视化及优胜代理高亮;修复横幅显示及工具调用ID处理问题。

✅ TUI默认启用与配置迁移(v0.1.45):文本终端UI现默认启动,自动从rich_terminal迁移到textual_terminal;设置向导会生成TUI配置;可通过--display rich标志访问旧版Rich显示。

✅ 独立计划选择的执行模式(v0.1.44):通过Shift+Tab或模式栏在正常→规划→执行之间循环切换;计划选择器可浏览最多10个近期计划及其时间戳;查看完整计划模态,包含全面的任务分解;空提交即可执行计划;规划与执行阶段间保留上下文路径;增强案例研究,提供交互式设置指南;TUI性能优化,采用视口渲染。

✅ 工具调用批处理与交互式案例研究(v0.1.43):连续的MCP工具调用被归组为可折叠的树形视图,带有“+N更多”提示和点击展开功能。新增交互式案例研究页面,支持并排SVG对比。PlanOptionsPopover用于浏览计划并选择深度。支持带空格的路径引用。优化最终展示及TUI细节。

✅ TUI视觉重新设计与人工输入队列(v0.1.42):采用现代“对话型AI”美学,圆角设计;重新设计代理标签,增加点状指示器;自适应工具卡片;打磨后的模态窗口。新增HumanInputHook,可在流程中向代理注入消息,并提供线程安全的代理级追踪。修复AG2单代理协调问题。

✅ 异步子代理执行(v0.1.41):通过async_=True实现后台子代理执行,支持非阻塞的并行工作;轮询执行状态并获取结果;通过subagent_round_timeouts配置进行每轮超时控制;扩展子代理参数,用于超时和并发控制。

✅ Textual TUI交互模式(v0.1.40):交互式终端UI,通过--display textual实现实时代理流;提供全面的模态窗口,涵盖成本/投票/工作区/答案等信息;支持使用@path/to/file语法注入上下文路径;集成人工反馈,通过提示模态实现。

✅ 计划与执行工作流(v0.1.39):完整的先计划后执行工作流,通过--plan-and-execute实现自主规划与执行;--execute-plan则可直接运行现有计划而无需重新规划;任务验证工作流,配备verified状态及验证小组,用于批量校验;计划存储系统位于.massgen/plans/,保存冻结快照并记录执行情况;修复Response API函数调用消息净化问题。

✅ 任务规划与双层工作空间(v0.1.38):通过--plan标志进入任务规划模式,进行结构化的工作分解(仅规划,不自动执行);基于Git的双层工作空间,将临时探索与最终交付物分离;自动发现CLAUDE.md/AGENTS.md以确定项目上下文;支持多张图片对比的批量图像分析;设置断路器以防止超时死循环;新增Docker健康监测功能。

✅ 执行轨迹与思维模式 (v0.1.37):完整执行历史保存为 execution_trace.md,用于压缩恢复和跨智能体协调;集成 Claude Code 和 Gemini 推理内容流式缓冲;所有后端统一智能体标签规范。

✅ @path 上下文处理与钩子框架 (v0.1.36):支持 @path 语法及自动补全的内联文件选择器;提供 PreToolUse/PostToolUse 钩子用于权限校验和内容注入;支持全局及单个智能体的钩子注册;内置 MidStreamInjectionHook 和 HighPriorityTaskReminderHook;兼容 Claude Code 钩子;优化 Docker 资源管理。

✅ 日志分析 CLI 与 Logfire 可观测性 (v0.1.35):新增 massgen logs analyze 命令,支持提示模式及多智能体自我分析;Logfire 工作流属性用于记录回合上下文和投票推理过程;新增 direct_mcp_servers 配置,可将特定 MCP 作为协议工具保留;改进未知工具处理逻辑,并修复仅投票模式相关问题。

✅ OpenAI 兼容服务器与模型发现 (v0.1.34):本地 HTTP 服务器通过 massgen serve 命令启动,兼容任何 OpenAI SDK 客户端;通过认证 API 调用实现 Groq 和 Together 后端的动态模型发现;WebUI 支持文件差异对比及答案刷新轮询;优化子智能体状态跟踪与取消恢复功能。

✅ 响应式上下文压缩与流式缓冲 (v0.1.33):当上下文长度超出限制时自动进行对话压缩;引入流式缓冲系统,追踪部分响应以实现恢复;在 write_file 工具中增加文件覆盖保护机制;防止任务计划重复;修复 Grok MCP 工具可见性问题及 Gemini 仅投票模式问题;优化 GPT-5 模型行为。

✅ 多回合会话导出与每次尝试独立日志记录 (v0.1.32):支持按回合范围导出会话内容(--turns);新增工作区导出控制选项(--no-workspace、--workspace-limit);将 Logfire 移至可选的 [observability] 组件;每次尝试生成独立日志文件并重新配置处理器;自动将 DOCX/PPTX/XLSX 文件转换为 PDF 格式,便于会话分享。

✅ Logfire 可观测性与 Azure 工具流式传输 (v0.1.31):可选集成 Logfire,自动为 OpenAI、Claude 和 Gemini 后端进行 LLM 性能监控;Azure OpenAI 工具调用结果以结构化分块形式输出;新增 --logfire CLI 标志及 MASSGEN_LOGFIRE_ENABLED 环境变量。

✅ OpenRouter 网络搜索与角色多样性 (v0.1.30):通过 OpenRouter 插件原生支持网络搜索,启用 enable_web_search 参数;提供角色多样性模式(perspective/implementation),可根据阶段动态调整;支持 Azure 多端点自动检测;新增 ${VAR} 语法用于环境变量扩展。

✅ 子智能体系统与工具指标 (v0.1.29):可并行启动多个 MassGen 子进程,每个进程拥有独立的工作空间并自动汇总结果;增强工具指标功能,提供每次调用的平均值以及最小/最大/中位数分布统计;通过 massgen --quickstart 命令向各智能体发送系统消息。

✅ 统一多模态工具与产物预览 (v0.1.28):整合 read_media 工具,用于图像/音频/视频分析;统一 generate_media 工具,用于创建图像、视频和音频内容;Web UI 新增产物预览功能,支持 PDF/DOCX/PPTX/图片/HTML/SVG/Markdown/Mermaid 等格式;支持 OpenRouter 工具能力模型筛选;修复 Azure OpenAI 相关问题。

✅ 会话共享与日志分析 (v0.1.27):通过 GitHub Gist 实现会话共享,使用 massgen export 命令;新增日志分析 CLI 命令 massgen logs;提供每 LLM 调用的时间计量指标;支持 Gemini 3 Flash 模型;增强 CLI 配置构建器功能,支持针对不同智能体的网络搜索及系统消息设置。

✅ WebUI 设置与影子智能体深度 (v0.1.26):新增 Docker 诊断模块;推出 WebUI 设置向导,提供引导式首次使用体验;支持影子智能体响应深度调节,以实现测试时计算资源的弹性伸缩;支持 GPT-5.1-Codex 系列模型。

✅ UI-TARS 与技能进化 (v0.1.25):采用字节跳动的 UI-TARS-1.5-7B 模型进行 GUI 自动化操作;支持 GPT-5.2 模型;引入技能进化创建系统,结合会话持久化功能;增强 Textual 终端的自适应布局功能。

✅ 多后端成本追踪 (v0.1.24):实时统计 OpenRouter、xAI/Grok、Gemini 和 Claude Code 后端的 token 使用量;通过 /inspect c 命令查看成本明细,显示各智能体的 token 使用情况;同时汇总会话总成本,并优化显示格式。

✅ 回合历史检查与 WebUI 自动化 (v0.1.23):新增交互式 /inspect 命令,可通过菜单导航查看回合详情;引入 AutomationView 组件,实现程序化监控;新增 SessionMountManager,确保 Docker 容器在各回合间持续挂载;支持基于标志的取消操作,并恢复终端状态;提供 run_async_safely() 函数,用于处理嵌套事件循环。

✅ 影子智能体架构 (v0.1.22):轻量级影子智能体可并行响应广播消息,不会中断父智能体的工作;通过 asyncio.gather() 并行化机制继承完整的对话历史和当前回合上下文。

✅ 优雅取消与会话恢复 (v0.1.21):按下 Ctrl+C 可保存协作中的部分进度;被取消的会话可通过 --continue 参数恢复,保留智能体的回答和工作空间。

✅ WebUI 与自动 Docker 设置 (v0.1.20):基于浏览器的实时可视化界面,采用 React 前端、WebSocket 流式传输、时间线视图和工作区浏览功能。为计算机使用型智能体自动设置 Docker 容器,预配置 X11 虚拟显示器、xdotool、Firefox、Chromium 和 scrot 工具。

✅ LiteLLM 集成与 Claude 严格工具使用 (v0.1.19):MassGen 作为 LiteLLM 自定义提供商,支持 run() 和 build_config() 程序化 API;Claude 提供严格工具使用模式,输出结构化结果;Gemini 实现指数退避策略,提升对速率限制的韧性。

✅ 智能体沟通系统 (v0.1.18):通过 ask_others() 工具实现人类广播式问答,提供三种模式;支持内联回复交付以阻断执行流程;保持会话持久化的问答历史。

✅ Claude 高级工具功能 (v0.1.18):通过 enable_programmatic_flow 标志实现程序化工具调用;通过 enable_tool_search 标志在服务器端进行工具发现,支持正则表达式或 BM25 变体。

✅ Textual 终端界面 (v0.1.17):使用 Textual 库构建交互式终端 UI,支持深色/浅色主题;提供多面板布局,分别用于智能体和编排器;支持实时流式传输及语法高亮;具备关键模式的内容过滤功能。

✅ 终端评估与成本追踪 (v0.1.16):利用 AI 技术自动评估终端显示效果,生成 VHS 录像;集成 LiteLLM,实现对 500 多种模型的精准计价,支持推理及缓存 token 的计算;引入内存归档机制,确保多回合会话的持久化;为 MassGen 发展规划四项自我进化技能。

✅ 角色生成与 Docker 分发 (v0.1.15):根据多种策略(互补型、多样化、专业化、对抗型)自动为智能体生成角色,以提升多样性;集成 GitHub Container Registry,支持 ARM 架

✅ 并行工具执行与 Gemini 3 Pro (v0.1.14):基于 asyncio 的调度机制,可在所有后端上配置并发工具执行;Gemini 3 Pro 集成函数调用功能;交互式快速入门工作流;用于服务器元数据的 MCP 注册客户端。

✅ 代码化工具与 MCP 注册中心 (v0.1.13):实现 CodeAct 范式,通过可导入的 Python 代码集成工具,将令牌使用量减少 98%;MCP 服务器注册中心支持自动发现与按需加载;遵循 TOOL.md 文档标准。

✅ NLIP 集成与技能系统 (v0.1.13):在 Claude、Gemini 和 OpenAI 后端之间,利用自然语言接口协议实现高级工具路由;跨平台自动化技能安装程序,适用于 openskills CLI、Anthropic 技能和 Crawl4AI。

✅ 系统提示架构重构 (v0.1.12):采用基于 XML 的格式化方式为 Claude 构建分层系统提示结构,优化大模型注意力管理。

✅ Semtools 与 Serena 技能 (v0.1.12):通过嵌入式相似度实现语义搜索;借助 LSP 集成实现符号级代码理解;支持非 Docker 环境下的本地执行模式。

✅ 多智能体计算机使用 (v0.1.12):增强 Gemini 的计算机使用能力,集成 Docker、VNC 可视化,并实现多智能体协作,结合 Claude(Docker/Linux)与 Gemini(浏览器)。

✅ 技能系统 (v0.1.11):模块化提示框架,配备 SkillsManager 动态加载技能;自动发现功能,支持“始终”与“可选”类别;新增文件搜索技能;兼容 Docker 挂载。

✅ 内存 MCP 工具与文件系统集成 (v0.1.11):MCP 服务器用于内存管理,采用 Markdown 格式存储,划分短期与长期记忆层级;自动保存工作空间状态;集成编排器实现跨智能体内存共享;增强对 Windows 系统的支持,以应对长系统提示。

✅ 速率限制系统 (v0.1.11):针对 Gemini 模型实施多维度限制(RPM、TPM、RPD),支持自定义阈值;基于 YAML 的配置;CLI 集成 --enable-rate-limiting 标志;修复 asyncio 锁问题,确保事件循环可重用。

✅ 框架互操作性流式传输 (v0.1.10):为 LangGraph 和 SmoLAgent 提供实时中间步骤流式传输,区分日志与输出;增强对外部框架推理步骤的调试功能。

✅ Docker 配置增强 (v0.1.10):支持嵌套认证,提供独立的挂载数组与环境变量数组;通过 Dockerfile.custom-example 支持自定义镜像;自动安装软件包。

✅ 通用工作空间隔离 (v0.1.10):扩展实例 ID 生成至所有执行模式,确保安全并行执行;增强工作空间路径的唯一性,避免并发会话冲突。

✅ 会话管理系统 (v0.1.9):完整记录与恢复会话状态,采用 SessionState 数据类及 SessionRegistry 实现 CLI 调用间的多轮持久化;保持工作空间连续性,保留智能体状态与各轮之间的协作历史。

✅ 计算机使用工具 (v0.1.9):原生集成 Claude 和 Gemini 的计算机使用 API,实现浏览器与桌面自动化,包括截图分析与动作生成;轻量级浏览器自动化适用于特定任务,无需完整计算机使用开销。

✅ 模糊模型匹配 (v0.1.9):智能模型名称搜索,支持近似输入(如“sonnet”→“claude-sonnet-4-5-20250929”);构建模型目录系统,收录各提供商精选列表;增强配置生成器的自动模型搜索功能。

✅ 后端能力扩展 (v0.1.9):全面的后端注册表,包含所有提供商的详细规格;支持音频/视频处理、硬件加速;统一访问各类模型家族;优化内存更新逻辑,聚焦于可行动模式。

✅ LLM 智能体自动化模式 (v0.1.8):为在 LLM 智能体中运行 MassGen 构建完整基础设施,采用 SilentDisplay 类实现极简输出(约 10 行,而非 250–3,000+ 行);实时监控 status.json 文件,每 2 秒更新一次;定义有意义的退出码(0=成功,1=配置错误,2=执行错误,3=超时,4=中断);自动隔离工作空间以支持并行执行;具备元协调能力,允许 MassGen 运行 MassGen。

✅ DSPy 问句改写集成 (v0.1.8):为多智能体协作提供智能化问句多样性,搭载语义保留型改写模块,支持三种策略(多样/平衡/保守);自动进行语义验证以确保意义不丢失;采用线程安全的缓存系统,基于 SHA-256 哈希;作为改写引擎支持所有后端;集成编排器实现问句变体的自动分发。

✅ 智能体任务规划系统 (v0.1.7):基于 MCP 的规划服务器,管理任务生命周期;跟踪依赖关系并自动验证与阻塞;支持待处理/进行中/已完成/已阻塞等状态转换;集成编排器实现计划感知的多智能体协作。

✅ 后台 Shell 执行 (v0.1.7):为长时间运行的命令提供持久化 Shell 会话,BackgroundShell 类支持异步执行、实时输出流式传输与监控、自动超时处理;增强代码执行服务器的后台能力。

✅ 抢占式协调 (v0.1.7):智能体可在不完全重启的情况下中断正在进行的协调,提交更优答案;抢占过程中部分进度得以保留;增强协调跟踪器,记录抢占事件。

✅ 框架互操作性 (v0.1.6):AG2 嵌套聊天、LangGraph 工作流、AgentScope 智能体、OpenAI 助手以及 SmoLAgent 均被整合为自定义工具,支持跨框架协作与 AG2 的流式传输。

✅ 配置校验器 (v0.1.6):采用 ConfigValidator 类进行全面的 YAML 校验,集成 pre-commit 并提供包含可操作建议的详细错误信息。

✅ 统一工具执行 (v0.1.6):ToolExecutionConfig 数据类标准化 ResponseBackend、ChatCompletionsBackend 和 ClaudeBackend 中的工具处理流程,确保一致的错误报告。

✅ Gemini 后端简化 (v0.1.6):移除 gemini_mcp_manager 和 gemini_trackers 模块,整合代码后代码库减少 1,598 行。

✅ 内存系统 (v0.1.5):通过 mem0 集成实现长期语义记忆,支持跨会话的事实提取与检索;提供短期对话记忆以维持活跃上下文;接近令牌限制时自动压缩上下文;支持跨智能体内存共享,按轮次过滤;通过会话管理实现内存隔离与延续;集成 Qdrant 向量数据库以支持语义搜索。

✅ 多模态生成工具 (v0.1.4):通过 DALL-E API 根据文本创建图像;根据描述生成视频;支持文本转语音及音频转录;可生成 PDF/DOCX/XLSX/PPTX 格式的文档;具备对现有图像进行变换的能力。

✅ 二进制文件保护(v0.1.4):自动拦截功能可防止文本工具访问40多种二进制文件类型,包括图片、视频、音频、压缩包及Office文档;智能错误提示会引导用户使用适合处理二进制内容的专业工具。

✅ Crawl4AI集成(v0.1.4):基于大语言模型的内容提取与智能网页爬取功能,支持自定义提取模式,用于从网站中获取结构化数据。

✅ 后评估工作流(v0.1.3):获胜的智能体在提交答案前会自行评估,具备提交与重启功能;支持答案确认,并可在所有后端系统中根据反馈重新启动协调流程。

✅ 多模态理解工具(v0.1.3):可分析图像、转录音频、提取视频帧并处理文档(PDF/DOCX/XLSX/PPTX),输出结构化的JSON数据;通过OpenAI GPT-4.1集成,在所有后端系统中均可使用。

✅ Docker Sudo模式(v0.1.3):在Docker容器中以特权模式执行命令,适用于需要高权限的系统级操作。

✅ 智能规划模式(v0.1.2):自动分析问题,通过orchestrator中的_analyze_question_irreversibility()方法判断操作是否不可逆;可通过set_planning_mode_blocked_tools()和is_mcp_tool_blocked()方法选择性阻止工具使用;在协调过程中,MCP仅允许只读操作,禁止写入;零配置即可透明运行,支持多工作空间。

✅ 模型更新(v0.1.2):新增Claude 4.5 Haiku模型claude-haiku-4-5-20251001;重新调整Claude模型优先级,将claude-sonnet-4-5-20250929设为默认模型;修复Grok网络搜索问题,通过_add_grok_search_params()方法正确处理extra_body参数。

✅ 自定义工具系统(v0.1.1):用户可通过massgen/tool/_manager.py中的ToolManager类注册自定义Python函数;支持跨后端与MCP服务器协同工作,内置/MCP/自定义工具分类并实现自动发现;massgen/configs/tools/custom_tools/目录下提供40余种示例;通过三档质量体系(宽松/均衡/严格)控制投票敏感度,检测答案新颖性以避免重复。

✅ 后端增强(v0.1.1):重构Gemini架构,将MCP管理(gemini_mcp_manager.py)、追踪(gemini_trackers.py)及工具类提取出来;新增massgen/backend/capabilities.py能力注册表,记录各后端的功能支持情况。

✅ PyPI软件包发布(v0.1.0):通过pip install massgen正式发布,安装更简便;全局massgen命令可在任意目录下使用;提供详尽的Sphinx文档,网址为docs.massgen.ai;配备交互式设置向导,包含用例预设和API密钥管理;增强CLI功能,内置配置以@examples/为前缀。

✅ Docker执行模式(v0.0.32):基于容器的隔离机制,确保安全地在独立Docker容器中执行命令,防止访问宿主机文件系统;持久化状态管理,使包和依赖项在多次对话轮次间保持不变;支持多智能体协作,每个智能体拥有独立的隔离容器;可配置资源限制(CPU、内存)、网络隔离模式以及只读挂载卷,以提升安全性。

✅ MCP架构重构(v0.0.32):简化客户端,将MultiMCPClient更名为MCPClient,反映架构精简;移除已废弃模块并整合重复的MCP协议处理代码,提高可维护性;通过标准化类型注解、改进错误处理及更清晰的代码组织,优化代码结构。

✅ Claude Code Docker集成(v0.0.32):自动工具管理功能,Docker模式下Bash工具将被禁用,所有命令均通过execute_command路由执行;MCP工具自动获得权限批准,同时保留安全验证机制;通过系统消息强化指导,避免混淆宿主机与容器环境中的Git仓库。

✅ 通用命令执行(v0.0.31):基于MCP的execute_command工具适用于Claude、Gemini、OpenAI及Chat Completions等提供商;全面的安全措施包括权限管理和命令过滤;在规划模式下执行代码,以实现更安全的协调。

✅ 外部框架集成(v0.0.31):利用外部框架的群聊模式进行多智能体对话,由LLM驱动实现智能扬声器选择(自动、轮询、手动);增强适配器功能,支持原生群聊协调。

✅ 音视频生成(v0.0.31):提供文本转语音及转录的音频工具,同时利用OpenAI的Sora-2 API生成视频,进一步拓展多模态能力,超越文本与图像范畴。

✅ 多模态支持扩展(v0.0.30):为Chat Completions和Claude后端增加音视频处理功能(支持WAV、MP3、MP4、AVI、MOV、WEBM格式);灵活支持本地路径或URL作为媒体输入;扩展音频/视频文件的Base64编码;可配置文件大小限制。

✅ Claude Agent SDK迁移(v0.0.30):将软件包从claude-code-sdk迁移到claude-agent-sdk>=0.0.22;改进Bash工具的权限验证;增强系统消息处理能力。

✅ Qwen API集成(v0.0.30):将Qwen API提供商加入Chat Completions生态系统,支持QWEN_API_KEY;提供视频理解配置示例。

✅ MCP规划模式(v0.0.29):一种更安全的MCP工具使用协调策略;支持多后端(Response API、Chat Completions、Gemini);智能体在协调期间仅规划而不执行;提供5种规划模式配置。

✅ 文件操作安全(v0.0.29):通过FileOperationTracker类强制执行“先读后删”原则;集成PathPermissionManager,提供操作跟踪方法;进一步强化文件操作安全机制。

✅ 外部框架集成(v0.0.28):建立外部智能体框架适配器系统,支持异步执行;可在多种环境中(本地、Docker、Jupyter、YepCode)执行代码;提供开箱即用的框架集成配置。

✅ 多模态支持——图像处理(v0.0.27):新增stream_chunk模块,用于多模态内容处理;具备图像生成与理解能力;支持文件上传及文档问答检索;Claude Sonnet 4.5版本支持;增强工作空间内的多模态工具。

✅ 文件删除与工作空间管理(v0.0.26):新增MCP工具(delete_file、delete_files_batch、compare_directories、compare_files),用于清理工作空间和文件比较;整合_workspace_tools_server.py,增强路径权限管理器。

✅ 受保护路径与基于文件的上下文路径(v0.0.26):可在允许写入的目录中保护特定文件,仅授予对单个文件的访问权限,而非整个目录。

✅ 多轮文件系统支持(v0.0.25):支持多轮对话,跨轮次保持上下文;自动创建 .massgen 目录结构;支持工作区快照与恢复;增强路径权限系统,加入智能排除功能;以及全面的后端改进。

✅ SGLang 后端集成(v0.0.25):统一 vLLM/SGLang 后端架构,具备自动检测功能;支持 SGLang 特有的参数如 separate_reasoning;并提供双服务器支持,适用于 vLLM 和 SGLang 混合部署场景。

✅ vLLM 后端支持(v0.0.24):与 vLLM 完全集成,实现高性能本地模型服务;支持 POE 提供者;可识别 GPT-5-Codex 模型;重构后端工具模块;并修复包括流式分块处理在内的多项 bug。

✅ 后端架构重构(v0.0.23):大幅整合代码,新增 base_with_mcp.py 类,减少各后端总计约 1,932 行代码;提取格式化模块以提升代码组织性;通过统一的 MCP 集成提高可维护性。

✅ 通过 MCP 的工作区复制工具(v0.0.22):实现工作区间无缝文件复制;采用层级结构组织配置;并增强面向大规模协作的文件操作功能。

✅ Grok MCP 集成(v0.0.21):统一后端架构,全面支持 MCP 服务器;通过 MCP 服务器实现文件系统功能;并优化配置文件。

✅ Claude 后端的 MCP 支持(v0.0.20):将 MCP 集成扩展至 Claude 后端;全面支持 MCP 协议及文件系统;强化错误处理机制;并完善文档说明。

✅ 全面协调跟踪(v0.0.19):构建完整的协调跟踪与可视化系统,基于事件的跟踪机制、交互式协调表格展示,以及针对多智能体协作模式的高级调试能力。

✅ 全面 MCP 集成(v0.0.18):将 MCP 扩展至所有 Chat Completions 后端(Cerebras AI、Together AI、Fireworks AI、Groq、Nebius AI Studio、OpenRouter);实现跨提供商的函数调用兼容性;新增 9 个 MCP 配置示例。

✅ OpenAI 的 MCP 集成(v0.0.17):将 MCP(模型上下文协议)支持扩展至 OpenAI 后端,实现 GPT 模型的完整工具发现与执行能力;统一多后端的 MCP 架构;并加强调试功能。

✅ 结合 MCP 集成的统一文件系统支持(v0.0.16):完成 FilesystemManager 类,为 Gemini 和 Claude Code 后端提供统一的文件系统访问;基于 MCP 进行文件操作和跨智能体协作。

✅ MCP 集成框架(v0.0.15):为 Gemini 后端实现完整的 MCP 实现,支持多服务器部署、断路器模式,并构建全面的安全框架。

✅ 增强日志记录(v0.0.14):改进日志系统,便于调试智能体的回答;新增最终答案目录结构;并提供详细的架构文档。

✅ 统一日志系统(v0.0.13):建立集中式日志基础设施,配备调试模式和更完善的终端显示格式。

✅ Windows 平台支持(v0.0.13):实现 Windows 平台兼容性,优化路径处理与进程管理。

✅ 增强 Claude Code 智能体上下文共享(v0.0.12):Claude Code 智能体现在可通过在编排器端维护快照和临时工作区来共享工作区上下文。

✅ 文档改进(v0.0.12):更新 README 文件,包含当前功能并改进安装说明。

✅ 自定义系统消息(v0.0.11):增强系统消息的配置与保存功能,支持后端特定的系统提示词定制。

✅ Claude Code 后端增强(v0.0.11):改进集成,优化系统消息处理、JSON 响应解析及协调动作描述。

✅ Azure OpenAI 支持(v0.0.10):集成 Azure OpenAI 服务,包括 GPT-4.1 和 GPT-5-chat 模型,并支持异步流式传输。

✅ MCP(模型上下文协议)支持(v0.0.9):集成 MCP,为 Claude Code 智能体提供高级工具能力,包括 Discord 和 Twitter 集成。

✅ 超时管理系统(v0.0.8):引入编排器级别的超时机制,具备优雅降级和更丰富的错误信息提示。

✅ 本地模型支持(v0.0.7):完全集成 LM Studio,可在本地运行开放权重模型,并实现自动服务器管理。

✅ GPT-5 系列集成(v0.0.6):支持 OpenAI 的 GPT-5、GPT-5-mini 和 GPT-5-nano 模型,并提供高级推理参数。

✅ Claude Code 集成(v0.0.5):原生 Claude Code 后端,具备流式传输能力和工具支持。

✅ GLM-4.5 模型支持(v0.0.4):集成智谱 AI 的 GLM-4.5 系列模型。

✅ 基础架构(v0.0.3):构建完整的多智能体编排系统,支持异步流式传输、内置工具及多后端支持。

✅ 扩展的提供商生态:支持超过 15 家提供商,包括 Cerebras AI、Together AI、Fireworks AI、Groq、Nebius AI Studio 和 OpenRouter。

未来重点改进方向

- Bug 修复与后端优化:修复图像生成路径问题,并增加对 Claude 多模态的支持。

- 高级智能体协作:探索更高效的通信模式和共识构建协议,以提升智能体间的协同效应。

- 扩展模型集成:增加对更多前沿模型和本地推理引擎的支持。

- 性能与 scalability 优化:优化流式传输和日志记录机制,提升性能与资源管理效率。

- 开发者体验提升:完善工具注册系统和 Web 界面,以提供更好的可视化效果。

我们欢迎社区贡献,共同实现这些目标。

v0.1.74 路线图

版本 0.1.74 专注于云端执行:

计划功能

- Cloud Modal MVP(#982):将 MassGen 作为云任务在 Modal 上运行——进度流会显示在终端上,结果会保存在本地的

.massgen/cloud_jobs/目录下。

🤝 贡献方式

我们热烈欢迎各位的贡献!详情请参阅我们的 贡献指南。

🤝 致谢

我们感谢 AgentWeb

提供的慷慨赞助。

📄 许可证

本项目采用 Apache License 2.0 许可证——详细信息请参阅 LICENSE 文件。

⭐ 如果你觉得这个项目有用,请给它点个 Star 吧!⭐

由 MassGen 团队用心打造 ❤️

⭐ Star 历史

版本历史

v0.1.732026/04/06v0.1.722026/04/03v0.1.712026/04/01v0.1.702026/03/30v0.1.692026/03/27v0.1.682026/03/25v0.1.672026/03/23v0.1.662026/03/20v0.1.652026/03/18v0.1.642026/03/16v0.1.632026/03/13v0.1.622026/03/11v0.1.612026/03/09v0.1.602026/03/06v0.1.592026/03/04v0.1.582026/03/02v0.1.572026/02/27v0.1.562026/02/25v0.1.552026/02/23v0.1.542026/02/20相似工具推荐

openclaw

OpenClaw 是一款专为个人打造的本地化 AI 助手,旨在让你在自己的设备上拥有完全可控的智能伙伴。它打破了传统 AI 助手局限于特定网页或应用的束缚,能够直接接入你日常使用的各类通讯渠道,包括微信、WhatsApp、Telegram、Discord、iMessage 等数十种平台。无论你在哪个聊天软件中发送消息,OpenClaw 都能即时响应,甚至支持在 macOS、iOS 和 Android 设备上进行语音交互,并提供实时的画布渲染功能供你操控。 这款工具主要解决了用户对数据隐私、响应速度以及“始终在线”体验的需求。通过将 AI 部署在本地,用户无需依赖云端服务即可享受快速、私密的智能辅助,真正实现了“你的数据,你做主”。其独特的技术亮点在于强大的网关架构,将控制平面与核心助手分离,确保跨平台通信的流畅性与扩展性。 OpenClaw 非常适合希望构建个性化工作流的技术爱好者、开发者,以及注重隐私保护且不愿被单一生态绑定的普通用户。只要具备基础的终端操作能力(支持 macOS、Linux 及 Windows WSL2),即可通过简单的命令行引导完成部署。如果你渴望拥有一个懂你

stable-diffusion-webui

stable-diffusion-webui 是一个基于 Gradio 构建的网页版操作界面,旨在让用户能够轻松地在本地运行和使用强大的 Stable Diffusion 图像生成模型。它解决了原始模型依赖命令行、操作门槛高且功能分散的痛点,将复杂的 AI 绘图流程整合进一个直观易用的图形化平台。 无论是希望快速上手的普通创作者、需要精细控制画面细节的设计师,还是想要深入探索模型潜力的开发者与研究人员,都能从中获益。其核心亮点在于极高的功能丰富度:不仅支持文生图、图生图、局部重绘(Inpainting)和外绘(Outpainting)等基础模式,还独创了注意力机制调整、提示词矩阵、负向提示词以及“高清修复”等高级功能。此外,它内置了 GFPGAN 和 CodeFormer 等人脸修复工具,支持多种神经网络放大算法,并允许用户通过插件系统无限扩展能力。即使是显存有限的设备,stable-diffusion-webui 也提供了相应的优化选项,让高质量的 AI 艺术创作变得触手可及。

everything-claude-code

everything-claude-code 是一套专为 AI 编程助手(如 Claude Code、Codex、Cursor 等)打造的高性能优化系统。它不仅仅是一组配置文件,而是一个经过长期实战打磨的完整框架,旨在解决 AI 代理在实际开发中面临的效率低下、记忆丢失、安全隐患及缺乏持续学习能力等核心痛点。 通过引入技能模块化、直觉增强、记忆持久化机制以及内置的安全扫描功能,everything-claude-code 能显著提升 AI 在复杂任务中的表现,帮助开发者构建更稳定、更智能的生产级 AI 代理。其独特的“研究优先”开发理念和针对 Token 消耗的优化策略,使得模型响应更快、成本更低,同时有效防御潜在的攻击向量。 这套工具特别适合软件开发者、AI 研究人员以及希望深度定制 AI 工作流的技术团队使用。无论您是在构建大型代码库,还是需要 AI 协助进行安全审计与自动化测试,everything-claude-code 都能提供强大的底层支持。作为一个曾荣获 Anthropic 黑客大奖的开源项目,它融合了多语言支持与丰富的实战钩子(hooks),让 AI 真正成长为懂上

ComfyUI

ComfyUI 是一款功能强大且高度模块化的视觉 AI 引擎,专为设计和执行复杂的 Stable Diffusion 图像生成流程而打造。它摒弃了传统的代码编写模式,采用直观的节点式流程图界面,让用户通过连接不同的功能模块即可构建个性化的生成管线。 这一设计巧妙解决了高级 AI 绘图工作流配置复杂、灵活性不足的痛点。用户无需具备编程背景,也能自由组合模型、调整参数并实时预览效果,轻松实现从基础文生图到多步骤高清修复等各类复杂任务。ComfyUI 拥有极佳的兼容性,不仅支持 Windows、macOS 和 Linux 全平台,还广泛适配 NVIDIA、AMD、Intel 及苹果 Silicon 等多种硬件架构,并率先支持 SDXL、Flux、SD3 等前沿模型。 无论是希望深入探索算法潜力的研究人员和开发者,还是追求极致创作自由度的设计师与资深 AI 绘画爱好者,ComfyUI 都能提供强大的支持。其独特的模块化架构允许社区不断扩展新功能,使其成为当前最灵活、生态最丰富的开源扩散模型工具之一,帮助用户将创意高效转化为现实。

markitdown

MarkItDown 是一款由微软 AutoGen 团队打造的轻量级 Python 工具,专为将各类文件高效转换为 Markdown 格式而设计。它支持 PDF、Word、Excel、PPT、图片(含 OCR)、音频(含语音转录)、HTML 乃至 YouTube 链接等多种格式的解析,能够精准提取文档中的标题、列表、表格和链接等关键结构信息。 在人工智能应用日益普及的今天,大语言模型(LLM)虽擅长处理文本,却难以直接读取复杂的二进制办公文档。MarkItDown 恰好解决了这一痛点,它将非结构化或半结构化的文件转化为模型“原生理解”且 Token 效率极高的 Markdown 格式,成为连接本地文件与 AI 分析 pipeline 的理想桥梁。此外,它还提供了 MCP(模型上下文协议)服务器,可无缝集成到 Claude Desktop 等 LLM 应用中。 这款工具特别适合开发者、数据科学家及 AI 研究人员使用,尤其是那些需要构建文档检索增强生成(RAG)系统、进行批量文本分析或希望让 AI 助手直接“阅读”本地文件的用户。虽然生成的内容也具备一定可读性,但其核心优势在于为机器

LLMs-from-scratch

LLMs-from-scratch 是一个基于 PyTorch 的开源教育项目,旨在引导用户从零开始一步步构建一个类似 ChatGPT 的大型语言模型(LLM)。它不仅是同名技术著作的官方代码库,更提供了一套完整的实践方案,涵盖模型开发、预训练及微调的全过程。 该项目主要解决了大模型领域“黑盒化”的学习痛点。许多开发者虽能调用现成模型,却难以深入理解其内部架构与训练机制。通过亲手编写每一行核心代码,用户能够透彻掌握 Transformer 架构、注意力机制等关键原理,从而真正理解大模型是如何“思考”的。此外,项目还包含了加载大型预训练权重进行微调的代码,帮助用户将理论知识延伸至实际应用。 LLMs-from-scratch 特别适合希望深入底层原理的 AI 开发者、研究人员以及计算机专业的学生。对于不满足于仅使用 API,而是渴望探究模型构建细节的技术人员而言,这是极佳的学习资源。其独特的技术亮点在于“循序渐进”的教学设计:将复杂的系统工程拆解为清晰的步骤,配合详细的图表与示例,让构建一个虽小但功能完备的大模型变得触手可及。无论你是想夯实理论基础,还是为未来研发更大规模的模型做准备