nnom

NNoM(Neural Network on Microcontroller)是一款专为微控制器设计的高层神经网络推理库,旨在让资源受限的嵌入式设备也能轻松运行复杂的 AI 模型。随着神经网络结构日益复杂(如 ResNet、Inception 等),传统面向 MCU 的底层库往往难以高效部署这些模型,而 NNoM 正是为了解决这一痛点而生。

它允许开发者仅需一行代码即可将 Keras 训练好的模型转换为 NNoM 格式,并自动管理内存与网络结构,极大简化了部署流程。NNoM 支持多种先进网络架构,包括卷积神经网络及 RNN、LSTM、GRU 等循环网络,并提供按通道量化、预编译优化等特性,在运行时零解释器损耗,显著提升执行效率。此外,它还内置了性能分析、混淆矩阵等评估工具,方便调试与优化。

NNoM 特别适合嵌入式系统开发者、物联网工程师以及希望在单片机上快速验证 AI 算法的研究人员使用。无论是进行智能传感器开发、边缘计算应用,还是教学实验,NNoM 都能提供友好且高效的解决方案。其基于 Apache 2.0 协议开源,社区活跃,文档完善,是连接深度学习与嵌入式世界的实用桥梁。

使用场景

某嵌入式团队正在为一款低功耗智能摄像头开发本地人脸检测功能,需要在资源受限的 MCU 上运行深度学习模型。

没有 nnom 时

- 模型移植极其繁琐:开发者需手动将 Keras 训练好的复杂网络(如 ResNet)逐层转换为底层 C 代码,耗时数周且极易出错。

- 内存管理高风险:MCU 内存极小,人工计算每层张量大小并分配静态内存,稍有不慎就会导致栈溢出或运行时崩溃。

- 性能优化门槛高:缺乏针对 MCU 指令集的后端优化,推理速度慢,无法满足实时视频流的处理帧率要求。

- 调试黑盒化:缺少板载评估工具,无法在设备上直接查看混淆矩阵或各层耗时,排查精度下降问题如同盲人摸象。

使用 nnom 后

- 一键自动部署:利用 nnom 的 Python 脚本,仅需一行代码即可将 Keras 模型自动转换为包含完整结构的 C 头文件,支持 Inception、LSTM 等复杂架构。

- 自动化内存调度:nnom 内部管理所有层级结构与内存复用,开发者无需关心底层细节,彻底消除手动分配带来的内存错误。

- 预编译零损耗:通过板载预编译技术,模型在运行时无需解释器开销,结合高性能后端选择,显著提升了推理速度。

- 可视化板载分析:内置运行时分析工具,可直接在 MCU 上输出 Top-k 准确率、混淆矩阵及各层耗时,让性能调优有据可依。

nnom 通过将复杂的神经网络部署简化为“喂食数据、获取结果”的简单流程,让嵌入式开发者能轻松在微控制器上落地先进的 AI 算法。

运行环境要求

- 未说明 (适用于任何支持标准 C 编译器和 Python 的环境,包括嵌入式开发主机)

不需要 (专为微控制器设计,模型转换在 CPU 上进行)

未说明 (主机端取决于 TensorFlow 运行需求;目标端为微控制器,资源占用极低)

快速开始

微控制器上的神经网络(NNoM)

NNoM 是一个专为微控制器设计的高级推理神经网络库。

亮点

- 一行代码即可将 Keras 模型部署到 NNoM 模型。

- 支持复杂结构;Inception、ResNet、DenseNet、八度卷积等。

- 友好的用户接口。

- 高性能后端选择。

- 内置预编译——运行时无解释器性能损失。

- 内置评估工具;运行时分析、Top-k、混淆矩阵等。

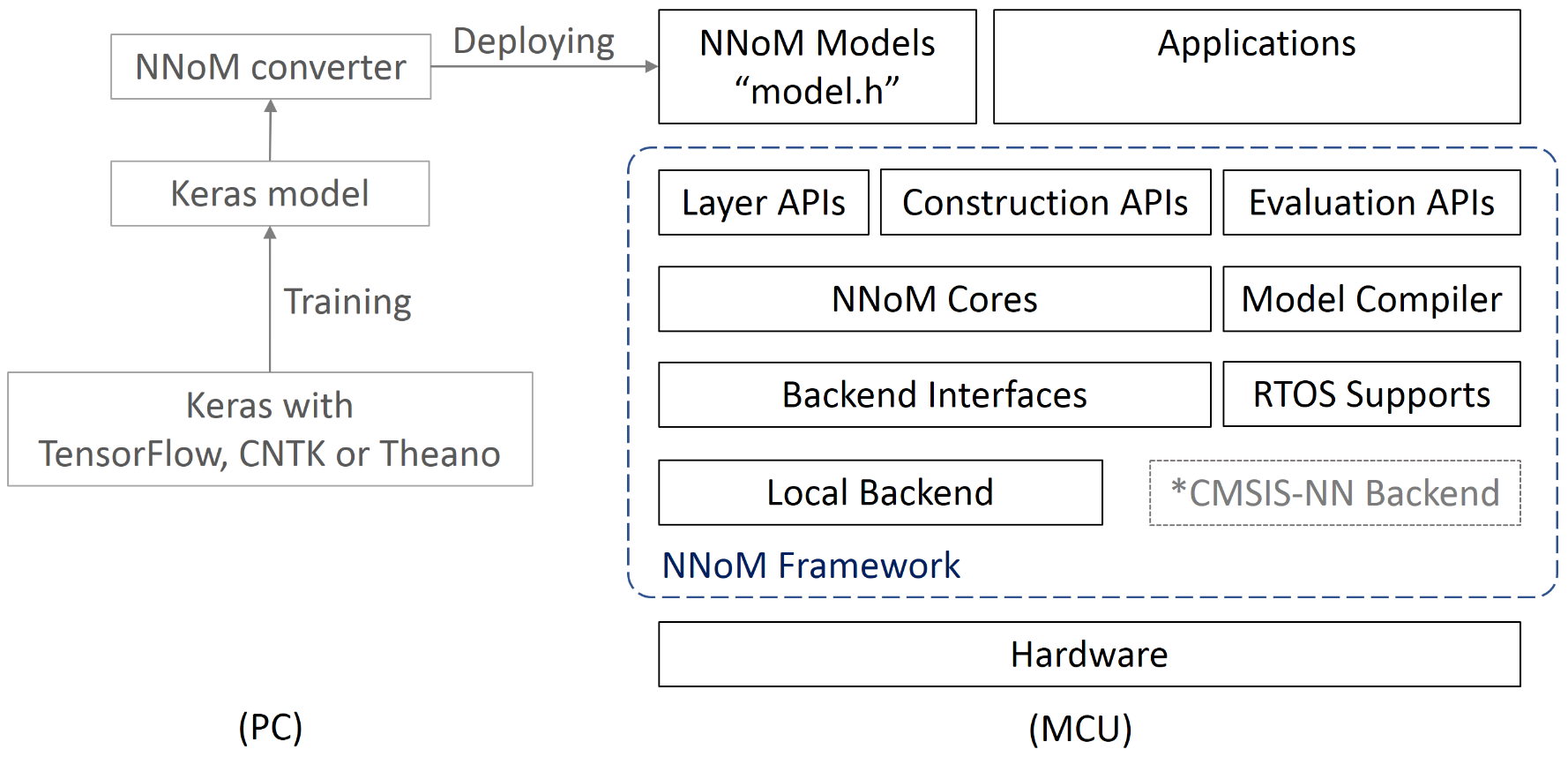

NNoM 的结构如下所示:

更多详细信息请参阅 开发指南。

欢迎通过 issues 进行讨论。也欢迎提交 Pull 请求。QQ/TIM 群:763089399。

最新更新 - v0.4.x

循环层(RNN)(0.4.1)

在 0.4.1 版本中实现了循环层 (简单 RNN、GRU、LSTM),支持 statful 和 return_sequence 选项。

新的结构化接口(0.4.0)

NNoM 提供了一种名为 “结构化接口” 的新层接口,所有接口均以 _s 后缀标记。该接口旨在使用一个 C 结构体来提供层的所有配置。与对人类友好的层 API 不同,这种结构化 API 更适合机器处理。

通道级量化(0.4.0)

新的结构化接口支持 卷积层 的通道级量化(按轴量化)和膨胀操作。

新脚本(0.4.0)

从 0.4.0 版本开始,NNoM 将默认切换到结构化接口来生成模型头文件 weights.h。对应于结构化接口的脚本是 nnom.py,而对应于层接口的脚本则是 nnom_utils.py。

许可证

自 nnom-V0.2.0 起,NNoM 采用 Apache License 2.0 发布。 许可证和版权信息可在代码中找到。

为什么选择 NNoM?

NNoM 的目标是为快速部署到 MCU 提供轻量级、用户友好且灵活的接口。

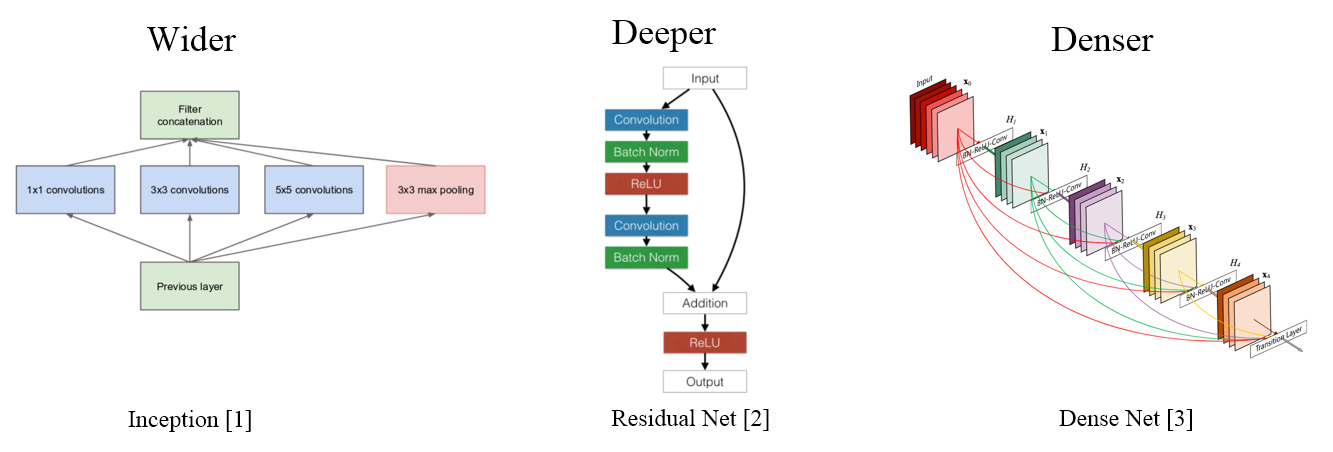

如今,神经网络变得越来越 宽、深 和 密。

[1] Szegedy, C., Liu, W., Jia, Y., Sermanet, P., Reed, S., Anguelov, D., ... & Rabinovich, A. (2015). 更深层次的卷积。载于 IEEE 计算机视觉与模式识别会议论文集(第 1–9 页)。

[2] He, K., Zhang, X., Ren, S., & Sun, J. (2016). 图像识别中的深度残差学习。载于 IEEE 计算机视觉与模式识别会议论文集(第 770–778 页)。

[3] Huang, G., Liu, Z., Van Der Maaten, L., & Weinberger, K. Q. (2017). 密集连接的卷积网络。载于 IEEE 计算机视觉与模式识别会议论文集(第 4700–4708 页)。

2014 年之后,神经网络的发展更加注重结构优化,以提高效率和性能,这对于 MCU 等小尺寸平台尤为重要。 然而,目前可用于 MCU 的神经网络库大多过于底层,导致在这些复杂结构上使用起来非常困难。

因此,我们开发了 NNoM,旨在帮助嵌入式开发者更快速、更简便地将神经网络模型直接部署到 MCU 上。

NNoM 将为开发者管理结构、内存及其他一切事宜。您只需输入新的测量数据并获取结果即可。

安装

NNoM 可以作为 Python 包安装:

pip install git+https://github.com/majianjia/nnom@master

NNoM 需要 TensorFlow 版本 <= 2.14。

安装方法有多种,请参阅 TensorFlow 文档。

例如:

pip install 'tensorflow-cpu<=2.14.1'

注意:TensorFlow 2.14 最高支持 Python 3.11。 但 不支持 Python 3.12。

访问 C 文件

NNoM 中的 C 头文件和源代码分布在 nnom_core Python 包中。

您可以通过运行以下命令找到其位置:

python -c "import nnom_core; print(nnom_core.__path__[0])"

在您的构建系统中,将 inc/ 和 port/ 目录添加为包含目录,

并编译 src/*.c 文件。

文档

指南

性能

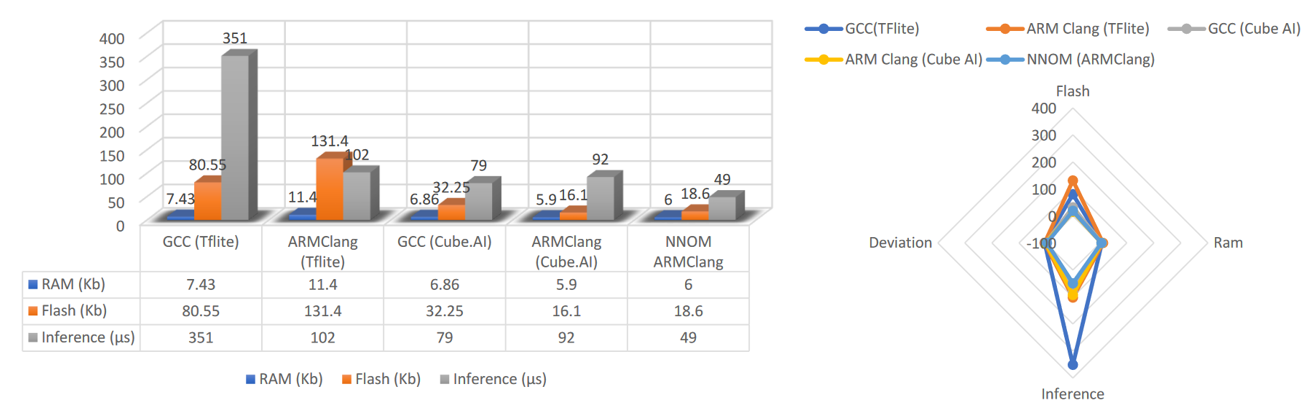

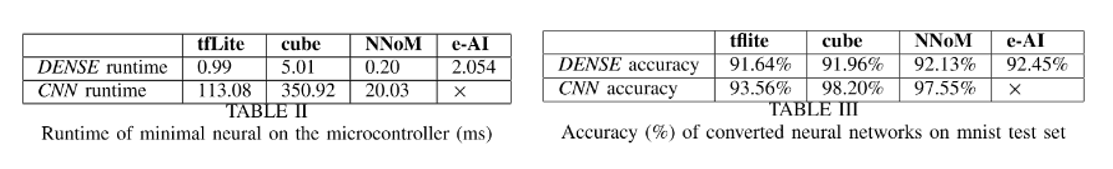

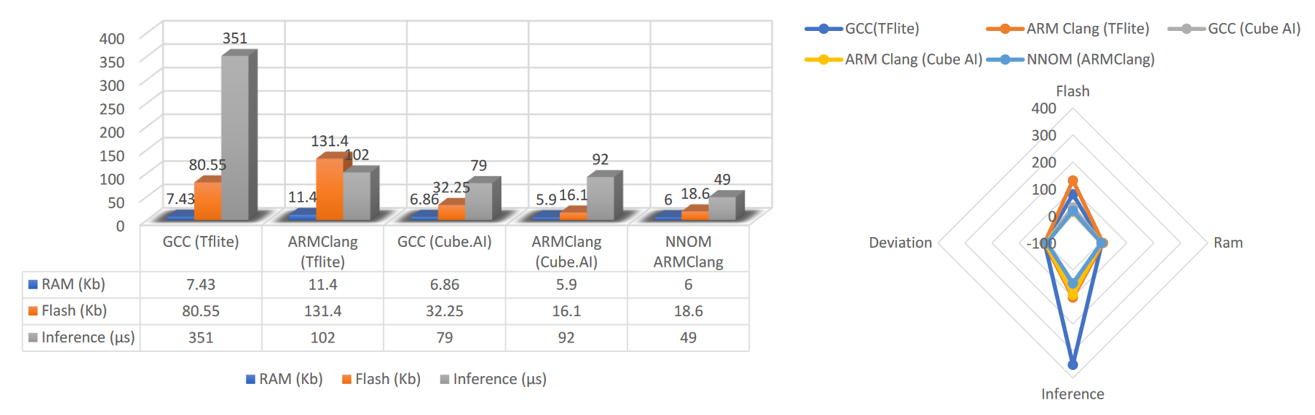

有许多文章将 NNoM 与其他著名的 MCU AI 工具进行了比较,如 TensorFlow Lite、STM32Cube.AI 等。

苏黎世应用科学大学的 Raphael Zingg 等人 在他们的论文《微控制器上的人工智能》中将 NNoM 与 TFLite、Cube 和 e-AI 进行了比较。博客:https://blog.zhaw.ch/high-performance/2020/05/14/artificial-intelligence-on-microcontrollers/

都灵理工大学的 Butt Usman Ali 在其论文《低成本嵌入式系统中人工神经网络(ANN)的部署》中进行了如下比较:

两篇文章都表明,NNoM 不仅可以与其他流行的神经网络框架相媲美,而且具有更快的推理速度和有时更低的内存占用。

注: 这些图表和表格的版权归其作者所有。有关详细信息及版权问题,请参阅原始论文。

示例

已记录的示例

请查看 示例,并选择一个开始尝试。

可用操作

注:NNoM 现在同时支持 HWC 和 CHW 格式。目前部分操作可能尚未完全支持这两种格式,请查看表格以了解当前状态。

核心层

| 层 | 结构化 API | 层 API | 备注 |

|---|---|---|---|

| 卷积 | conv2d_s() | Conv2D() | 支持 1D/2D,支持空洞卷积(新!) |

| 转置卷积(新!) | conv2d_trans_s() | Conv2DTrans() | 开发中 |

| 深度可分离卷积 | dwconv2d_s() | DW_Conv2D() | 支持 1D/2D |

| 全连接 | dense_s() | Dense() | |

| Lambda | lambda_s() | Lambda() | 单输入/单输出的匿名操作 |

| 批量归一化 | 无 | 无 | 此层已被脚本合并到前一个卷积层中 |

| 展平 | flatten_s() | Flatten() | |

| 重塑(新!) | reshape_s() | 无 | |

| SoftMax | softmax_s() | SoftMax() | Softmax 仅提供层 API |

| 激活函数 | 无 | Activation() | 用于激活的层实例 |

| 输入/输出 | input_s()/output_s() | Input()/Output() | |

| 上采样 | upsample_s() | UpSample() | |

| 零填充 | zeropadding_s() | ZeroPadding() | |

| 裁剪 | cropping_s() | Cropping() |

RNN 层

| 层 | 状态 | 结构化 API | 备注 |

|---|---|---|---|

| 循环神经网络层(新!) | Alpha | rnn_s() | RNN 的层封装 |

| 简单细胞(新!) | Alpha | simple_cell_s() | |

| GRU 单元(新!) | Alpha | gru_cell_s() | 门控循环网络 |

| LSTM 单元(新!) | Alpha | lstm_s() | 长短期记忆 |

激活函数

激活函数可以单独作为一层使用,也可以作为“actail”附加到前一层,以减少内存开销(详见 NNoM 临时指南)。

目前没有针对激活函数的结构化 API,因为激活通常不作为独立的层来使用。

| 激活函数 | 结构化 API | 层 API | 激活 API | 备注 |

|---|---|---|---|---|

| ReLU | 无 | ReLU() | act_relu() | |

| Leaky ReLU(新!) | 无 | LeakyReLU() | act_leaky_relu() | |

| Adv ReLU(新!) | 无 | 无 | act_adv_relu() | 高级 ReLU,包含斜率、最大值、阈值等参数 |

| TanH | 无 | TanH() | act_tanh() | |

| Hard TanH(新!) | 无 | TanH() | 仅后端实现 | |

| Sigmoid | 无 | Sigmoid() | act_sigmoid() | |

| Hard Sigmoid(新!) | 无 | 无 | 无 | 仅后端实现 |

池化层

| 池化 | 结构化 API | 层 API | 备注 |

|---|---|---|---|

| 最大池化 | maxpool_s() | MaxPool() | |

| 平均池化 | avgpool_s() | AvgPool() | |

| 求和池化 | sumpool_s() | SumPool() | |

| 全局最大池化 | global_maxpool_s() | GlobalMaxPool() | |

| 全局平均池化 | global_avgpool_s() | GlobalAvgPool() | |

| 全局求和池化 | global_sumpool_s() | GlobalSumPool() | 动态输出位移 |

矩阵运算层

| 矩阵 | 结构化 API | 层 API | 备注 |

|---|---|---|---|

| 拼接 | concat_s() | Concat() | 沿任意轴拼接 |

| 乘法 | mult_s() | Mult() | |

| 加法 | add_s() | Add() | |

| 减法 | sub_s() | Sub() |

依赖项

NNoM 目前默认使用本地纯 C 后端实现。因此,无需额外的特殊依赖。

不过,您需要启用 libc 以使用动态内存分配函数 malloc()、free() 和 memset()。或者,您可以移植到您系统中等效的内存管理方法。

优化

CMSIS-NN/DSP 是针对 ARM-Cortex-M4/7/33/35P 的优化后端。选择该后端时,性能可比默认 C 后端提升高达 5 倍。当条件满足时,NNoM 会自动使用 CMSIS-NN 中的等效方法。

详细信息请参阅 移植与优化指南。

已知问题

转换器不支持隐式定义的激活函数

当前脚本不支持隐式激活:

x = Dense(32, activation="relu")(x)

请改用显式激活:

x = Dense(32)(x)

x = Relu()(x)

小贴士 - 提高精度

- 在每个卷积层后添加批量归一化可以限制激活范围,从而有助于量化。在 NNoM 中,BN 不会增加额外的计算量。

- 不要训练过多的轮次。过大的轮次会导致激活值出现极端值,从而降低量化精度。

- 为瓶颈层保留足够的数据——不要在模型输出之前过度压缩数据,否则信息会在量化过程中丢失。

联系方式

Jianjia Ma majianjia@live.com

如有现场支持需求,也欢迎联系我。

发表论文时需引用

如遇任何问题,请通过上述联系方式与我联系。

示例:

@software{jianjia_ma_2020_4158710,

author = {Jianjia Ma},

title = {{微控制器上的高级神经网络库 (NNoM)}},

month = oct,

year = 2020,

publisher = {Zenodo},

version = {v0.4.2},

doi = {10.5281/zenodo.4158710},

url = {https://doi.org/10.5281/zenodo.4158710}

}

版本历史

v0.4.32021/11/29v0.4.22020/11/09v0.4.12020/08/31v0.4.02020/07/11v0.3.02020/04/25v0.2.12019/07/23v0.2.02019/06/19v0.2.0-beta2019/04/28v0.1.0-beta-12019/04/03v0.1.0-beta2019/03/31v0.1.0-alpha2019/03/23常见问题

相似工具推荐

openclaw

OpenClaw 是一款专为个人打造的本地化 AI 助手,旨在让你在自己的设备上拥有完全可控的智能伙伴。它打破了传统 AI 助手局限于特定网页或应用的束缚,能够直接接入你日常使用的各类通讯渠道,包括微信、WhatsApp、Telegram、Discord、iMessage 等数十种平台。无论你在哪个聊天软件中发送消息,OpenClaw 都能即时响应,甚至支持在 macOS、iOS 和 Android 设备上进行语音交互,并提供实时的画布渲染功能供你操控。 这款工具主要解决了用户对数据隐私、响应速度以及“始终在线”体验的需求。通过将 AI 部署在本地,用户无需依赖云端服务即可享受快速、私密的智能辅助,真正实现了“你的数据,你做主”。其独特的技术亮点在于强大的网关架构,将控制平面与核心助手分离,确保跨平台通信的流畅性与扩展性。 OpenClaw 非常适合希望构建个性化工作流的技术爱好者、开发者,以及注重隐私保护且不愿被单一生态绑定的普通用户。只要具备基础的终端操作能力(支持 macOS、Linux 及 Windows WSL2),即可通过简单的命令行引导完成部署。如果你渴望拥有一个懂你

stable-diffusion-webui

stable-diffusion-webui 是一个基于 Gradio 构建的网页版操作界面,旨在让用户能够轻松地在本地运行和使用强大的 Stable Diffusion 图像生成模型。它解决了原始模型依赖命令行、操作门槛高且功能分散的痛点,将复杂的 AI 绘图流程整合进一个直观易用的图形化平台。 无论是希望快速上手的普通创作者、需要精细控制画面细节的设计师,还是想要深入探索模型潜力的开发者与研究人员,都能从中获益。其核心亮点在于极高的功能丰富度:不仅支持文生图、图生图、局部重绘(Inpainting)和外绘(Outpainting)等基础模式,还独创了注意力机制调整、提示词矩阵、负向提示词以及“高清修复”等高级功能。此外,它内置了 GFPGAN 和 CodeFormer 等人脸修复工具,支持多种神经网络放大算法,并允许用户通过插件系统无限扩展能力。即使是显存有限的设备,stable-diffusion-webui 也提供了相应的优化选项,让高质量的 AI 艺术创作变得触手可及。

everything-claude-code

everything-claude-code 是一套专为 AI 编程助手(如 Claude Code、Codex、Cursor 等)打造的高性能优化系统。它不仅仅是一组配置文件,而是一个经过长期实战打磨的完整框架,旨在解决 AI 代理在实际开发中面临的效率低下、记忆丢失、安全隐患及缺乏持续学习能力等核心痛点。 通过引入技能模块化、直觉增强、记忆持久化机制以及内置的安全扫描功能,everything-claude-code 能显著提升 AI 在复杂任务中的表现,帮助开发者构建更稳定、更智能的生产级 AI 代理。其独特的“研究优先”开发理念和针对 Token 消耗的优化策略,使得模型响应更快、成本更低,同时有效防御潜在的攻击向量。 这套工具特别适合软件开发者、AI 研究人员以及希望深度定制 AI 工作流的技术团队使用。无论您是在构建大型代码库,还是需要 AI 协助进行安全审计与自动化测试,everything-claude-code 都能提供强大的底层支持。作为一个曾荣获 Anthropic 黑客大奖的开源项目,它融合了多语言支持与丰富的实战钩子(hooks),让 AI 真正成长为懂上

ComfyUI

ComfyUI 是一款功能强大且高度模块化的视觉 AI 引擎,专为设计和执行复杂的 Stable Diffusion 图像生成流程而打造。它摒弃了传统的代码编写模式,采用直观的节点式流程图界面,让用户通过连接不同的功能模块即可构建个性化的生成管线。 这一设计巧妙解决了高级 AI 绘图工作流配置复杂、灵活性不足的痛点。用户无需具备编程背景,也能自由组合模型、调整参数并实时预览效果,轻松实现从基础文生图到多步骤高清修复等各类复杂任务。ComfyUI 拥有极佳的兼容性,不仅支持 Windows、macOS 和 Linux 全平台,还广泛适配 NVIDIA、AMD、Intel 及苹果 Silicon 等多种硬件架构,并率先支持 SDXL、Flux、SD3 等前沿模型。 无论是希望深入探索算法潜力的研究人员和开发者,还是追求极致创作自由度的设计师与资深 AI 绘画爱好者,ComfyUI 都能提供强大的支持。其独特的模块化架构允许社区不断扩展新功能,使其成为当前最灵活、生态最丰富的开源扩散模型工具之一,帮助用户将创意高效转化为现实。

gemini-cli

gemini-cli 是一款由谷歌推出的开源 AI 命令行工具,它将强大的 Gemini 大模型能力直接集成到用户的终端环境中。对于习惯在命令行工作的开发者而言,它提供了一条从输入提示词到获取模型响应的最短路径,无需切换窗口即可享受智能辅助。 这款工具主要解决了开发过程中频繁上下文切换的痛点,让用户能在熟悉的终端界面内直接完成代码理解、生成、调试以及自动化运维任务。无论是查询大型代码库、根据草图生成应用,还是执行复杂的 Git 操作,gemini-cli 都能通过自然语言指令高效处理。 它特别适合广大软件工程师、DevOps 人员及技术研究人员使用。其核心亮点包括支持高达 100 万 token 的超长上下文窗口,具备出色的逻辑推理能力;内置 Google 搜索、文件操作及 Shell 命令执行等实用工具;更独特的是,它支持 MCP(模型上下文协议),允许用户灵活扩展自定义集成,连接如图像生成等外部能力。此外,个人谷歌账号即可享受免费的额度支持,且项目基于 Apache 2.0 协议完全开源,是提升终端工作效率的理想助手。

markitdown

MarkItDown 是一款由微软 AutoGen 团队打造的轻量级 Python 工具,专为将各类文件高效转换为 Markdown 格式而设计。它支持 PDF、Word、Excel、PPT、图片(含 OCR)、音频(含语音转录)、HTML 乃至 YouTube 链接等多种格式的解析,能够精准提取文档中的标题、列表、表格和链接等关键结构信息。 在人工智能应用日益普及的今天,大语言模型(LLM)虽擅长处理文本,却难以直接读取复杂的二进制办公文档。MarkItDown 恰好解决了这一痛点,它将非结构化或半结构化的文件转化为模型“原生理解”且 Token 效率极高的 Markdown 格式,成为连接本地文件与 AI 分析 pipeline 的理想桥梁。此外,它还提供了 MCP(模型上下文协议)服务器,可无缝集成到 Claude Desktop 等 LLM 应用中。 这款工具特别适合开发者、数据科学家及 AI 研究人员使用,尤其是那些需要构建文档检索增强生成(RAG)系统、进行批量文本分析或希望让 AI 助手直接“阅读”本地文件的用户。虽然生成的内容也具备一定可读性,但其核心优势在于为机器