Awesome-Agent-Papers

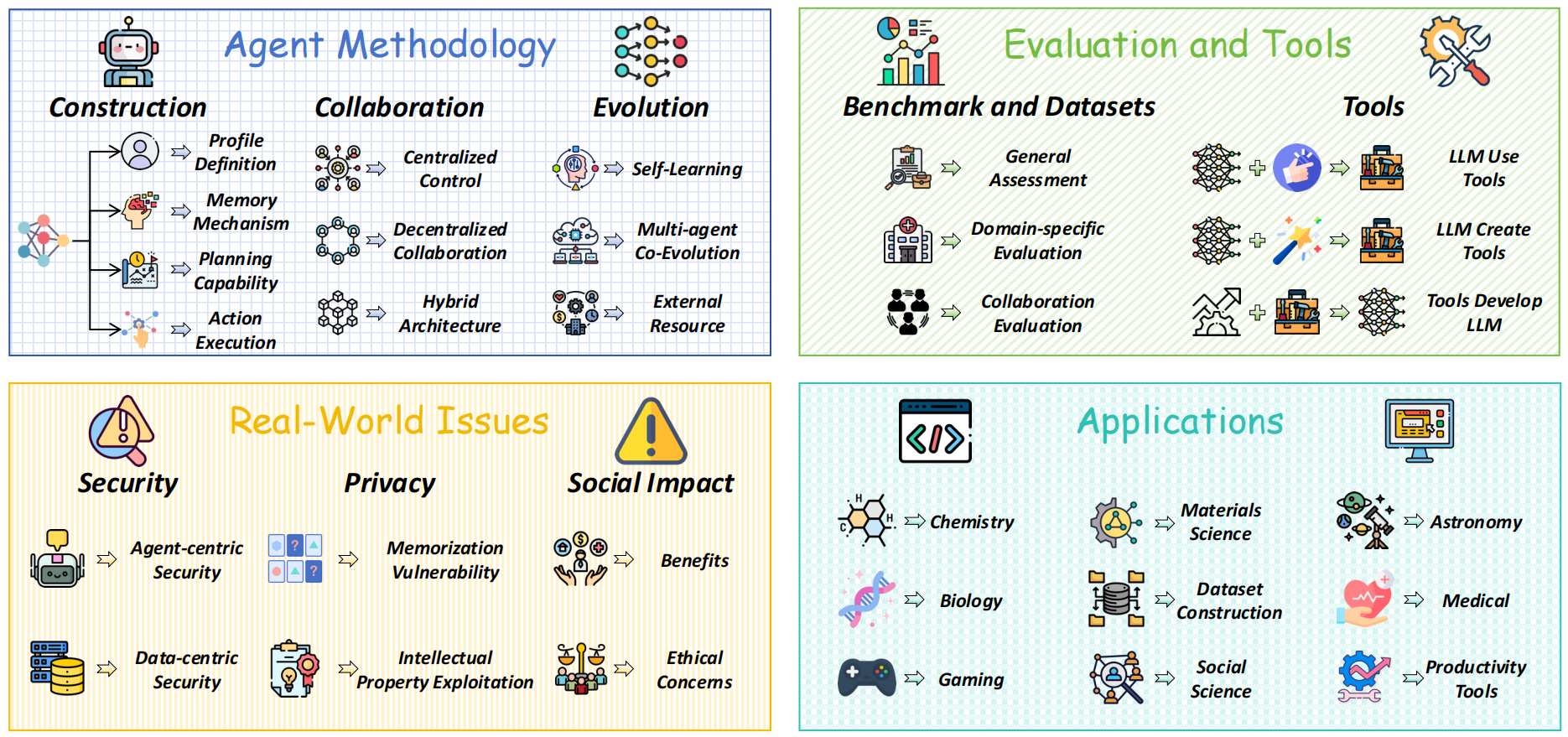

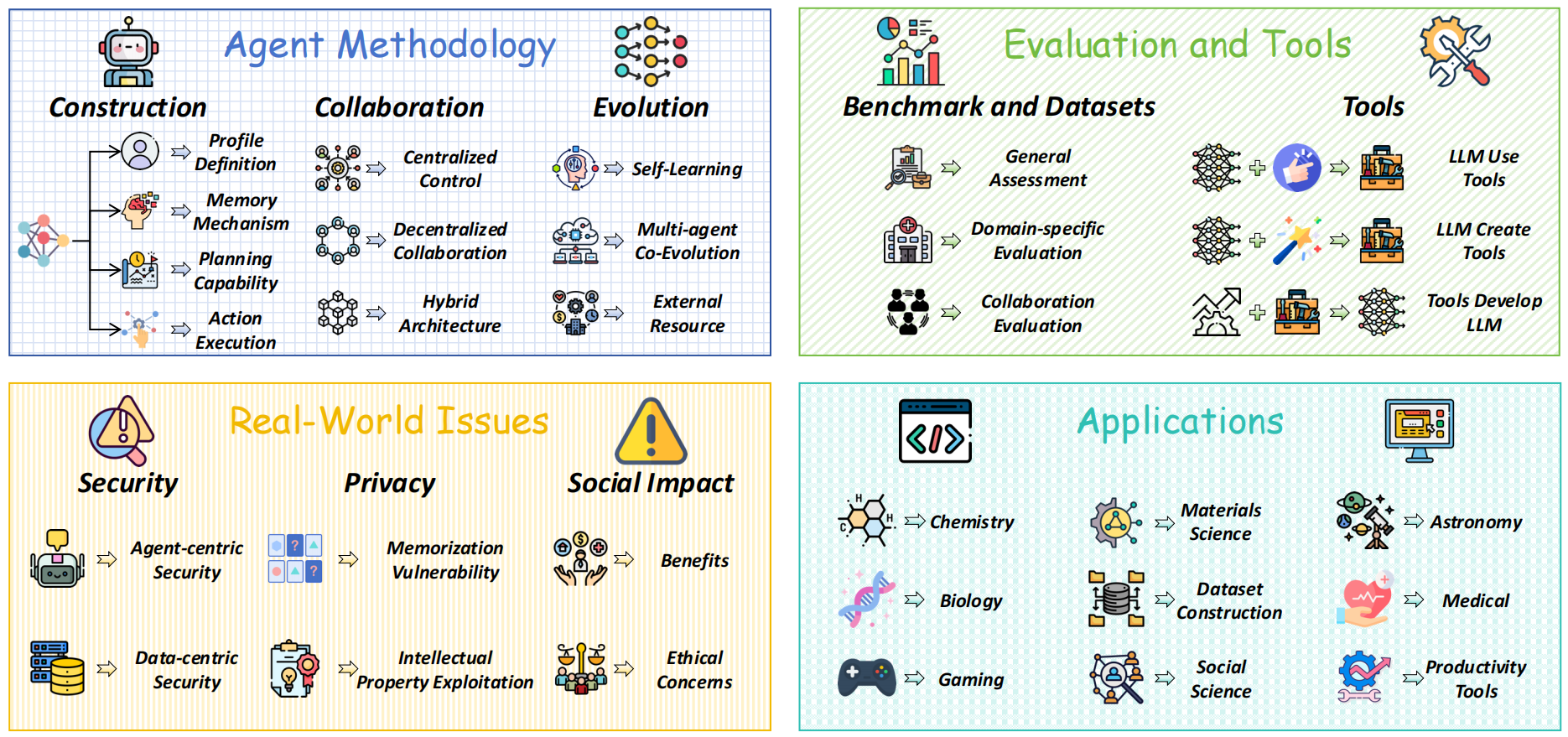

Awesome-Agent-Papers 是一个专注于大语言模型(LLM)智能体领域的开源学术资源库,旨在系统性地收集、整理并分类该方向的前沿研究论文。随着 2023 年以来智能体研究的爆发式增长,相关文献分散且更新迅速,开发者与研究者往往难以全面把握技术脉络。Awesome-Agent-Papers 通过构建清晰的分类体系,将零散的研究成果整合为涵盖智能体构建、多智能体协作、自我进化、工具调用、安全伦理及基准测试等关键维度的知识图谱,有效解决了信息碎片化问题,帮助用户快速定位核心文献并理解技术演进路径。

该项目不仅提供了一份动态更新的论文清单,还配套了深入的综述文章,详细阐述了从架构设计到实际落地的方法论与挑战。其独特的亮点在于对“多智能体协作失败原因”及“自动化工作流”等新兴议题的敏锐追踪,为社区提供了宝贵的洞察。无论是希望深入探索算法原理的科研人员,还是寻求落地解决方案的 AI 工程师,亦或是关注行业趋势的技术决策者,都能从中获得极具价值的参考指引,是进入 LLM 智能体领域不可或缺的知识导航站。

使用场景

某 AI 初创团队正致力于研发一套多智能体协作系统,用于自动化处理复杂的金融数据分析任务。

没有 Awesome-Agent-Papers 时

- 文献检索如大海捞针:研究人员需在 arXiv 等平台手动搜索关键词,难以区分高质量论文与过时内容,耗时数周仍无法覆盖最新进展。

- 技术选型缺乏体系:面对“智能体构建”与“协作机制”等碎片化概念,团队难以理清架构设计的逻辑脉络,导致原型开发反复试错。

- 忽视潜在安全风险:由于缺乏对“智能体安全”领域的系统性认知,初期方案未考虑对抗攻击防护,埋下严重隐患。

- 评估标准模糊不清:找不到权威的基准测试(Benchmarks)数据集,无法量化评估多智能体间的协作效率与竞争策略优劣。

使用 Awesome-Agent-Papers 后

- 前沿动态一键掌握:直接利用其分类清晰的资源列表,快速定位到 2025 年最新的《Foam-Agent》等关键论文,将调研周期从数周缩短至两天。

- 架构设计有据可依:参考仓库中关于“智能体演化”与“工具集成”的结构化综述,迅速确立了分层协作架构,避免了重复造轮子。

- 安全防线提前部署:通过"Security"专栏深入理解最新威胁模型,在系统设计阶段即融入了针对性的防御协议。

- 性能评估科学量化:直接采用推荐的

MultiAgentBench等基准测试集,精准量化了智能体在复杂任务中的协作表现,加速了迭代优化。

Awesome-Agent-Papers 将分散的研究孤岛连接成完整的知识地图,让团队从盲目探索转向高效创新。

运行环境要求

未说明

未说明

快速开始

🤖 LLM智能体研究综合合集

🌟 概述

本仓库收录了关于大型语言模型(LLM)智能体的全面研究论文合集。我们按关键类别对论文进行了整理,包括智能体构建、协作机制、进化、工具、安全、基准测试以及应用等。

我们的分类体系为理解快速发展的LLM智能体领域提供了一个结构化的框架,从架构基础到实际应用均有涵盖。该仓库通过揭示智能体设计原则与涌现行为之间的联系,将分散的研究线索有机地串联起来。

我们的综述覆盖了快速演进的LLM智能体领域,自2023年以来相关研究论文数量显著增加。

📑 目录

🔍 关键类别

- 🏗️ 智能体构建: 构建LLM智能体的方法论和架构

- 👥 智能体协作: 多智能体交互与合作的框架

- 🌱 智能体进化: 智能体的自我改进与学习能力

- 🔧 工具: 外部工具及API与LLM智能体的集成

- 🛡️ 安全: LLM智能体系统的安全问题与防护措施

- 📊 基准测试: 用于测试智能体能力的评估框架和数据集

- 💡 应用: 现实世界中的实现与使用场景

📚 资源列表

智能体协作

Foam-Agent: 向自动化智能CFD工作流迈进 (2025)

Arxiv本文提出了Foam-Agent,一个能够从自然语言自动执行CFD工作流的多智能体框架。它具备独特的检索、文件生成和错误纠正系统,从而降低了专业门槛。

为什么多智能体LLM系统会失败? (2025)

Arxiv提出了MAST这一用于分析MAS失败原因的分类体系,并开发了一条“LLM即法官”的流水线,同时开源了相关数据以指导MAS的开发。

多智能体系统的线性编队控制 (2025)

针对编队变化提出了一种新的分布式领导者—跟随者控制架构(线性编队控制),并引入了新概念和估计方法。

MultiAgentBench: 评估LLM智能体的协作与竞争能力 (2025)

Arxiv介绍了MultiAgentBench,用于评估基于LLM的多智能体系统。该基准测试可评估协作与竞争能力、协议与策略,并已开源代码和数据。

AI智能体协议综述 (2025)

Arxiv论文分析了现有的LLM智能体协议,提出了分类方案,并探讨了下一代协议的发展方向。

C^2: 面向LLM图表生成的可扩展自动反馈机制 (2025)

*ACL本文介绍了一种名为C2的框架,包含自动反馈提供者和无参考数据集,无需人工标注,相关资源已在chartsquared.github.io上开源。

AgentRxiv: 朝着协作式自主研究迈进 (2025)

Arxiv提出了AgentRxiv,这是一个允许LLM智能体实验室在预印本服务器上共享研究成果以促进协作的框架,有助于未来人机协同的AI设计。

多智能体微调:利用多样化推理链进行自我提升 (2025)

Arxiv提出了一种针对语言模型的多智能体微调方法,通过多智能体生成的数据来优化模型,同时保留多样化的推理链,从而实现更好的自我改进效果。

从辩论到均衡:基于贝叶斯纳什均衡的信念驱动型多智能体LLM推理 (2025)

ICML提出了ECON,一种将多LLM协调重新建模为BNE博弈的分层强化学习范式,具有更紧的后悔边界和更强的可扩展性。

智能体链:大型语言模型协作处理长上下文任务 (2025)

Blog提出了Chain-of-Agents,这是一种无需训练、任务无关的框架,利用LLM协作来处理长上下文任务,性能优于RAG和长上下文LLM。

CS-Agent: 基于双智能体协作的LLM社区搜索 (2025)

Arxiv提出了CS-Agent,采用双智能体协作模式(求解器、验证器)并结合决策器,用于LLM驱动的社区搜索,无需微调即可解决现有局限性。

MUA-RL: 面向代理式工具使用的多轮用户交互强化学习 (2025)

ArxivMUA-RL将LLM模拟的用户融入强化学习循环中,以实现动态的多轮用户交互学习,从而更好地支持代理式工具的使用。

CoMet: 基于隐喻的隐蔽通信,用于多智能体语言游戏 (2025)

*ACLCoMet提出了一套让LLM驱动的智能体处理隐喻的框架,结合假设推理器和自我反思生成器。这种新颖的方法通过细致入微的隐喻解读与运用,增强了多智能体语言游戏中战略性的隐蔽沟通能力。

多智能体协作中的思想交流 (2025)

Arxiv本文提出了一种全新的思想交流范式,使智能体能够直接分享潜在的思想,超越自然语言的限制。同时,提供了识别和结构化这些思想的理论框架,从而进一步提升多智能体协作的效果。

缓存到缓存:大型语言模型之间的直接语义通信 (2025)

Arxiv本文提出了一种名为“缓存到缓存”(C2C)的方法,利用大型语言模型的内部键值缓存实现模型间的直接语义通信,从而绕过低效的文本生成过程,以支持更丰富、更低延迟的跨模型协作。

用于医疗决策的大型语言模型自适应协作策略 (2024)

NeurIPS提出了一种名为医学决策代理(MDAgents)的框架,用于动态分配大型语言模型的协作结构,使其能够根据任务复杂度进行调整,并探索群体共识。

ReConcile:圆桌会议通过多样化大型语言模型间的共识提升推理能力 (2024)

*ACL提出了ReConcile框架,这是一种类似圆桌会议的多模型多智能体系统,通过讨论和投票机制来增强大型语言模型的协作推理能力。

MetaGPT:面向多智能体协作框架的元编程 (2024)

ICLR介绍了MetaGPT框架,该框架将人类工作流程融入基于大型语言模型的多智能体系统中,从而改进任务分解并减少错误。

与更具说服力的大型语言模型辩论有助于获得更真实的答案 (2024)

ICML本文探讨了较弱的模型是否可以通过辩论来评估更强的模型。研究表明,辩论可以帮助非专业人士,并且优化辩论者的表现有助于在缺乏真实答案的情况下寻找真相。

Roco:结合大型语言模型的辩证式多机器人协作 (2024)

Arxiv提议使用预训练的大型语言模型来进行多机器人的高层通信和低层路径规划,并引入上下文学习机制,同时推出了RoCoBench基准测试集。

AutoAct:基于自我规划的QA任务从零开始的自动智能体学习 (2024)

*ACLAutoAct是一个自动化的QA智能体学习框架,能够在无需外部帮助的情况下合成行动轨迹,并通过分工协作完成任务。

元提示:用任务无关的支架增强语言模型 (2024)

Arxiv提出了元提示方法,这是一种任务无关的支架技术,可以将单一的语言模型转变为多角色系统,并集成外部工具以提升任务性能。

通过多智能体辩论鼓励大型语言模型的发散性思维 (2024)

*ACL本文提出了一种多智能体辩论框架,旨在解决大型语言模型中的DoT问题,鼓励其在复杂任务中进行发散性思考。

AgentVerse:促进多智能体协作并探索涌现行为 (2024)

ICLR本文提出了AgentVerse框架,该框架受人类群体动力学启发,旨在促进智能体之间的协作,并揭示智能体的涌现行为。

ChatDev:面向软件开发的沟通型智能体 (2024)

*ACL本文介绍了ChatDev框架,这是一个基于聊天的协作平台。专门的大型语言模型智能体通过统一的语言交流进行协作,打通不同阶段以实现自主任务解决。

ChatEval:通过多智能体辩论打造更优秀的基于大型语言模型的评估工具 (2024)

ICLR本文提出了ChatEval框架,即一个多智能体裁判团队,利用多智能体辩论来进行文本评估,提供一种模拟人类评审的过程。

面向任务导向型智能体协作的动态大型语言模型驱动网络 (2024)

COLM本文提出了DyLAN框架,用于大型语言模型驱动的智能体协作。该框架能够动态选择智能体,并采用两阶段范式来解决问题。

AgentCoord:可视化探索基于大型语言模型的多智能体协作协调策略 (2024)

Arxiv提出了一种用于设计多智能体协作协调策略的可视化探索框架,可将目标转化为策略,并允许用户干预。

TradingAgents:基于大型语言模型的多智能体金融交易框架 (2024)

Arxiv本文提出了一种新颖的股票交易框架,其中大型语言模型驱动的智能体各司其职,模拟现实世界的协作方式,以提升交易绩效。

AutoGen:通过多智能体对话赋能下一代大型语言模型应用 (2023)

COLMAutoGen是一个开源框架,支持使用多智能体对话构建大型语言模型应用,提供可定制的智能体和灵活的交互定义。

通过多智能体辩论提升语言模型的事实性和推理能力 (2023)

ICML本文提出了一种多智能体辩论方法,用于改善大型语言模型的推理能力和事实准确性,该方法适用于黑盒模型,并具有统一的操作流程。

利用大型语言模型开展自主化学研究 (2023)

Nature本文介绍了Coscientist系统,该系统由GPT-4驱动,整合了多种工具,在科研领域展现出巨大潜力,证明了人工智能的多功能性和高效性。

智能体构建

通过协作式语言智能体实现多约束规划 (2025)

*ACL本文提出PMC方法,这是一种零样本的大型语言模型驱动多智能体系统构建技术。它通过任务分解简化复杂的、具有多重约束的任务规划。

具身智能体接口:评估大型语言模型在具身决策中的表现 (2025)

NeurIPS本文提出了一种具身智能体接口,用于统一任务、模块和指标,从而全面评估大型语言模型在具身决策中的表现。

SPeCtrum:面向大型语言模型驱动智能体的多维身份表示基础框架 (2025)

Arxiv介绍了SPeCtrum框架,该框架整合了S、P、C三个维度来构建大型语言模型智能体的角色形象。它增强了身份的真实感,使AI交互更加个性化。

通过模式策略优化实现社交语言智能体的自适应思维 (2025)

提出了自适应模式学习(AML)框架和AMPO算法,提供多粒度模式切换、上下文感知能力以及高效的令牌利用率。

关于大型语言模型智能体的架构 (2025)

Arxiv本文讨论了大型语言模型智能体的架构。智能体是人工智能领域的一个关键方向,它们既像混合体又像机器人,而合适的框架可以简化其创建过程。

统一心智模型:LLM时代下自主智能体的重新构想 (2025)

Arxiv本文提出了面向人类水平智能体的统一心智模型(UMM),并开发了MindOS,无需编程即可创建特定任务的智能体。

ATLaS:通过学习关键步骤进行智能体调优 (2025)

Arxiv提出ATLaS方法,用于识别专家轨迹中的关键步骤,以优化LLM智能体,从而降低成本并提升泛化能力。

认知AI记忆:一种使LLM具备更类人记忆的框架 (2025)

Arxiv本文受认知AI启发,为LLM提出CAIM框架,包含三个模块,通过整体性记忆建模增强人机长期交互能力。

自适应图剪枝:一种任务自适应的多智能体协作框架 (2025)

Arxiv提出自适应图剪枝(AGP)框架,该框架采用两阶段策略联合优化智能体数量与通信拓扑结构,实现任务自适应的多智能体协作。

变革者:用于战略规划的自我进化LLM智能体 (2025)

Arxiv将LLM智能体置于具有战略挑战性的环境中,以卡坦岛游戏作为基准测试,并提出一种可自我改进的多智能体架构。

通过多智能体反思强化大型语言模型推理 (2025)

ICML本文将多轮细化过程建模为马尔可夫决策过程,并引入DPSDP算法用于迭代式答案精炼,展示了其理论和实证优势。

Memory-R1:利用强化学习增强大型语言模型智能体的记忆管理与利用能力 (2025)

Arxiv提出Memory-R1框架,该框架包含两个智能体,用于LLM主动管理和利用外部记忆,为强化学习驱动的行为提供了新见解。

BudgetThinker:借助控制标记赋能预算感知型LLM推理 (2025)

Arxiv介绍BudgetThinker框架,用于实现预算感知的LLM推理。通过插入控制标记并采用两阶段训练流程,实现高效且可控的推理。

A-MEM:面向LLM智能体的代理式记忆系统 (2025)

Arxiv本文提出一种面向LLM的代理式记忆系统,以Zettelkasten方式组织记忆,支持动态更新和更灵活的记忆管理。

MemoCue:基于策略引导查询赋能LLM驱动智能体的人类记忆提取 (2025)

Arxiv提出MemoCue策略引导型智能体,配备回忆路由器框架,利用5W回忆地图和层次化回忆树,通过富含线索的查询提升记忆提取效果。

多智能体规划中的信息共享与协调分析 (2025)

Arxiv本文构建了一个基于LLM的多智能体系统,用于旅行规划,引入结构化信息共享笔记本和反思式协调器,以提升长周期规划能力。

AutoAgents:自动智能体生成框架 (2024)

IJCAI介绍AutoAgents框架,可根据任务自动生成并协调专用智能体,内置观察者功能,为复杂任务解决提供了全新视角。

MetaGPT:面向多智能体协作框架的元编程 (2024)

ICLRMetaGPT是一个元编程框架,能够将人类工作流整合到基于LLM的多智能体协作中,从而简化流程并减少错误。

面向语言智能体的认知架构 (2024)

TMLR提出CoALA框架,为语言智能体提供模块化的记忆、动作空间和决策机制,以组织工作并指导未来发展。

可执行代码行动促使LLM智能体表现更佳 (2024)

ICML本研究提出CodeAct方法,利用可执行Python代码定义LLM智能体的动作空间,并基于调优后的数据集构建了一个开源智能体。

ChatDev:用于软件开发的沟通型智能体 (2024)

ACL本文介绍了ChatDev框架,该框架允许智能体通过语言协作完成软件设计、编码和测试等环节,实现了各阶段的无缝衔接。

基于协作LLM智能体的可编辑场景仿真用于自动驾驶 (2024)

CVPR/ICCV/ECCV本文提出了ChatSim,可通过自然语言处理实现3D驾驶场景的可编辑仿真。该方法结合了LLM智能体、新型神经辐射场及光照估计技术。

面向任务导向型智能体协作的动态LLM驱动智能体网络 (2024)

COLM提出名为DyLAN的框架,用于LLM驱动的智能体协作。该框架采用两阶段范式,支持动态智能体选择和针对不同任务的通信。

更多智能体就是你需要的一切 (2024)

TMLR本文提出Agent Forest采样与投票方法,该方法与现有方法正交,能够根据任务难度提升LLM的表现。

智能医院:一个由可进化医疗智能体组成的医院模拟系统 (2024)

Arxiv展示了智能医院这一LLM驱动的医院模拟系统。医生智能体无需人工标注即可进化,相关方法也可应用于更广泛的领域。

利用AI智能体赋能生物医学发现 (2024)

Others本文提出“AI科学家”概念,即整合AI与生物工具的协作型智能体,结合人类与AI的能力,对多个生物领域产生深远影响。

SMART-LLM:基于大型语言模型的智能多机器人任务规划 (2024)

IROS提出SMART-LLM框架,用于多机器人任务规划。同时创建了一个基准数据集,并在https://sites.google.com/view/smart-llm/上提供了相关资源。

感知、反思与规划:设计无需指令的目标导向城市导航LLM智能体 (2024)

Arxiv本文提出一种新颖的LLM智能体工作流程,包含感知、反思和规划三个环节,用于目标导向的城市导航,有效避免了基线方法的缺陷。

通过微调与多分支推理提升小参数大模型的智能体能力 (2024)

Arxiv提出利用GPT-4构建智能体专用数据,并对小参数大模型进行微调。多路径推理和任务分解进一步提升了智能体性能。

PlanCritic:结合人类反馈的形式化规划 (2024)

Arxiv提出一种基于反馈的计划批评器,通过结合人类反馈的强化学习和遗传算法优化规划方案,填补了规划研究中的空白。

增强机器人任务规划:通过大型语言模型整合环境信息与反馈见解 (2024)

CCC提出EnviroFeedback Planner,将环境信息融入提示词构建及反馈机制中,从而提升智能体在任务规划中的执行效果。

魔鬼代言人:面向LLM智能体的预见性反思 (2024)

Arxiv该方法为LLM智能体赋予自我反思能力,通过任务分解、持续自评以及三重干预策略,显著提高其一致性和适应性。

规划、创造、使用:针对现实复杂场景中全面工具使用的LLM基准测试 (2024)

*ACL提出UltraTool,一个用于评估LLM在真实世界工具使用中的基准测试框架。它覆盖全流程,独立评估规划环节,并取消了预定义工具集的限制。

论LLM智能体的结构化记忆 (2024)

Arxiv本文探讨了记忆结构与检索方法对基于LLM的智能体的影响,发现特定任务下的优势以及迭代式检索的优越性。

CAMEL:用于探索大型语言模型社会“心智”的沟通型智能体 (2023)

NeurIPS提出了一种角色扮演式的沟通型智能体框架,提供了一种可扩展的多智能体系统研究方法,并开源了相关库。

AutoGen:通过多智能体对话赋能下一代LLM应用 (2023)

ArxivAutoGen是一个用于LLM应用的开源框架,支持自定义的多智能体对话、灵活的编程方式,以及多样化应用的构建。

AgentCoder:基于多智能体的代码生成,结合迭代测试与优化 (2023)

Arxiv该文介绍了AgentCoder,一个用于代码生成的多智能体框架,解决了平衡性问题,并优于现有方法。

战争与和平(WarAgent):基于大型语言模型的世界大战多智能体仿真 (2023)

Arxiv提出WarAgent,一个由LLM驱动的多智能体系统,用于模拟历史冲突,为冲突解决和维和行动提供了新的洞见。

描述、解释、规划与选择:基于LLM的交互式规划助力开放世界多任务智能体 (2023)

NeurIPS该文以Minecraft规划为例,研究多任务智能体面临的挑战,并提出一种解决低效规划的方法。

TPTU:基于大型语言模型的任务规划与工具使用智能体 (2023)

Arxiv提出了一套基于LLM的智能体框架,设计了两种智能体类型,通过评估TPTU的能力来指导LLM在AI应用中的使用。

智能体演进

模型融合配方的进化优化 (2025)

NMI提出一种双空间运作的模型融合进化方法,支持跨领域融合,并引入了一种全新的模型组合范式。

CREAM:一致性正则化的自奖励语言模型 (2025)

ICLR本文提出了一个自奖励LLM的框架,引入了正则化技术,并提出了CREAM,利用奖励一致性来获取更可靠的数据。

KnowAgent:知识增强型LLM智能体规划 (2025)

NAACL该文介绍了KNOWAGENT,通过动作知识库和自我学习来增强LLM的规划能力,并缓解幻觉现象。

STeCa:面向LLM智能体学习的步骤级轨迹校准 (2025)

*ACL文章提出STeCa框架,通过步骤级奖励比较和LLM反思来构建校准后的轨迹。

SWEET-RL:在协作推理任务上训练多轮LLM智能体 (2025)

Arxiv引入了ColBench基准测试,提出了SWEET-RL方法,利用训练时的信息构建批评者模型,提供步骤级奖励以优化LLM智能体的表现。

DualRAG:一种双过程方法,用于整合推理与检索以实现多跳问答 (2025)

Arxiv该文提出了DualRAG,一个将推理与检索相结合的双过程框架,用于处理MHQA任务。其耦合的过程形成循环,在不同规模下均表现出色。

Atom-Searcher:通过细粒度原子思维奖励提升智能体深度研究 (2025)

Arxiv提出了原子思维范式和Atom-Searcher RL框架,通过整合思维单元与奖励机制,实现了独特的监督与推理方式,从而更好地支持智能体的深度研究。

PVPO:面向智能体推理的预估价值策略优化 (2025)

Arxiv提出PVPO,一种具有优势参考锚点和预采样的强化学习方法,能够纠正偏差、减少对展开的依赖,并筛选出高收益的数据。

SE-Agent:基于LLM智能体的多步推理中自进化轨迹优化 (2025)

ArxivSE-Agent通过自我进化、重组和精炼来优化多步推理,扩大搜索空间并借助跨轨迹的启发,实现更高效的推理。

LLM与多智能体强化学习的合作 (2025)

Arxiv将LLM合作建模为协作式MARL,开发了MAGRPO算法,无需复杂的个体奖励即可实现有效合作。

[VLM 可以成为优秀的助手:利用自我改进的视觉语言模型增强具身视觉跟踪] (2025)

Arxiv本文提出了一种自我改进框架,通过集成 VLM 来提升具身视觉跟踪性能。该框架采用一种新颖的内存增强型自我反思机制,使 VLM 能够从失败中学习,并协助主动恢复。

[EvolveR:基于经验驱动生命周期的自进化大模型代理] (2025)

Arxiv本文介绍了一种大模型代理的自进化框架,通过闭环生命周期将过往经验提炼为抽象原则,指导未来的决策并实现策略的迭代优化。

[测试时的自改进大模型代理] (2025)

Arxiv本文提出了一种测试时的自改进方法,代理能够识别其不确定的预测,生成类似的训练样本,并在其上进行微调,从而实现高效且有效的自我进化。

[CoMAS:通过交互奖励实现多智能体系统的协同进化] (2025)

Arxiv该框架通过智能体间的讨论生成内在奖励,并利用强化学习进行优化,无需外部监督,从而实现自主智能体的协同进化。

[基准自进化:用于动态大模型评估的多智能体框架] (2024)

Arxiv一个基准自进化的多智能体框架扩展了基准测试,使用六种操作对大模型进行细粒度评估,有助于模型选择。

[Agent-Pro:通过策略级反思与优化学习进化] (2024)

ACL提出了 Agent-Pro,一种基于大模型的代理,利用策略级反思和优化机制,通过动态信念过程和深度优先搜索来进化更好的策略。

[与另一个“你”共同进化:基于序列式合作多智能体强化学习的大模型微调] (2024)

NeurIPS本文提出了 CORY 方法,将大模型微调扩展到多智能体框架中。智能体之间协同进化,可能在实际应用中的优化效果优于 PPO 方法。

[大型语言模型自进化综述] (2024)

Arxiv介绍了包含四个阶段的大模型自进化框架,分类了不同目标,总结了相关文献,并指出了当前面临的挑战及未来研究方向。

[LLM-Evolve:面向基准测试的大模型进化能力评估框架] (2024)

EMNLP本文提出了 LLM-Evolve 框架,将基准测试扩展到序列化场景中,使大模型能够从过往经验中学习。

[CRITIC:大型语言模型可通过工具交互式批评实现自我修正] (2024)

ICLR本文介绍了 CRITIC 框架,使大模型能够通过工具交互进行自我修正,强调了外部反馈在大模型自我改进中的作用。

[利用大型语言模型进行迭代式翻译优化] (2024)

EAMT本文提出通过迭代提示引导大模型进行自我纠正式翻译,强调源语文本的锚定作用,并展示了人类感知质量的显著提升。

[演化社会规范下的智能体对齐] (2024)

Arxiv提出了 EvolutionaryAgent,一种用于智能体对齐的演化框架,将对齐问题转化为演化与选择的过程,适用于多种大模型。

[缓解 RLHF 的对齐代价] (2024)

EMNLP本文揭示了 RLHF 中存在的对齐代价,提出通过模型平均实现 HMA 方法,以平衡对齐与遗忘之间的关系,从而在最小代价下最大化性能。

[自我奖励的语言模型] (2024)

Arxiv该论文研究了使用“大模型作为裁判”的方式,在训练过程中对语言模型进行自我奖励,为持续改进打开了新的大门。

[V-STaR:训练面向自教式推理者的验证器] (2024)

COLM提出了 V-STaR 方法,利用正确和错误的自动生成解决方案来训练验证器,从而提升解题选择能力和推理能力。

[RLCD:基于对比蒸馏的强化学习用于大模型对齐] (2024)

ICLR提出了 RLCD 方法,无需人工反馈即可实现大模型对齐。通过对比提示生成偏好对,进而训练偏好模型。

[基于强化学习沉思的大模型自我改进] (2024)

ICLR本文提出了 RLC 方法,利用评估与生成之间的差距来改进模型,无需监督即可实现模型优化,具有广泛的应用前景。

[ProAgent:利用大型语言模型构建主动协作型智能体] (2024)

AAAI提出了 ProAgent 框架,用于构建基于大模型的主动型智能体。该框架能够适应行为、分析状态、推断意图,并且模块化设计,可解决零样本问题。

[结合世界知识模型的智能体规划] (2024)

NeurIPS提出了参数化世界知识模型(WKM),用于智能体规划,整合知识并指导全局与局部规划,展现出独特潜力。

[利用 Textgrad 优化智能体规划的指南知识] (2024)

ICKG本文引入了 Textgrad 工具,用于优化智能体具身任务中的指南知识,通过文本梯度和失败轨迹分析实现自动优化。

[通过多智能体辩论促进大型语言模型的发散性思维] (2024)

Arxiv本文提出了一种多智能体辩论框架,旨在解决大模型中的“思维退化”问题,鼓励发散性思维。

[想象空间中的大模型:通过模拟试错进行工具学习] (2024)

ACL现有大模型的工具使用准确率较低。本文提出了一种受生物系统启发的新颖模拟试错方法,以提升工具学习能力。

里谢留:基于大语言模型的自进化AI外交智能体 (2024)

NeurIPS本文提出了一种用于Diplomacy游戏的自进化大语言模型智能体,该智能体集成了战略规划、目标导向的谈判,以及一种新颖的自我博弈机制,可在无需人类干预的情况下实现自主进化。

基于欲望驱动自主性的类人日常活动模拟 (2024)

Arxiv本文介绍了一种欲望驱动的自主智能体(D2A),它利用动态价值体系使大语言模型能够自主提出并选择任务,其动机源自内在的类人需求,而非明确的指令。

AlpacaFarm:一种用于学习人类反馈方法的仿真框架 (2023)

NeurIPSAlpacaFarm解决了大语言模型开发中的挑战。它能够低成本地模拟反馈,提供评估和方法实现,从而验证端到端流程。

SELF-REFINE:基于自我反馈的迭代优化 (2023)

NeurIPS本文提出了SELF-REFINE方法,这是一种无需额外训练即可对大语言模型输出进行迭代优化的技术,展示了在测试阶段提升大语言模型性能的能力。

判别式语言模型预训练中的自进化学习 (2023)

EMNLP本文提出了自进化学习(SE)方法,用于标记掩码和学习过程。该方法利用数据知识并采用新颖的平滑技术,从而提升语言学习效果。

用于高效指令微调的自进化多样化数据采样 (2023)

Arxiv本文介绍了一种名为DIVERSEEVOL的自进化机制,用于标签高效的指令微调,在无需人工或大语言模型干预的情况下增强数据多样性。

SELFEVOLVE:基于大型语言模型的代码进化框架 (2023)

Arxiv本文提出SELF-EVOLVE框架,该框架采用两步流程,利用大语言模型作为知识提供者和自我反思的程序员,且无需专门的测试用例。

SELF-INSTRUCT:通过自动生成指令对齐语言模型 (2023)

ACL本文介绍了SELF-INSTRUCT框架,该框架通过自动生成样本几乎无需标注即可提升语言模型的指令遵循能力。

大型语言模型具备自我验证能力后推理能力更强 (2023)

EMNLP本文提出大语言模型具有自我验证能力。通过反向验证,将思维链结论作为条件,以提升推理性能。

CODET:基于生成测试用例的代码生成 (2023)

ICLR本文提出了CODET方法,利用预训练的语言模型自动为代码样本生成测试用例,从而帮助选择更优的解决方案。

多轮多智能体游戏中多样化的红队语言模型演化 (2023)

Arxiv本文引入了动态红队游戏来分析多轮交互,并开发了GRTS以缓解模式崩溃问题,为大语言模型的安全性奠定了基础。

通过多智能体辩论提升语言模型的事实性和推理能力 (2023)

Arxiv本文提出了一种适用于大语言模型的多智能体辩论方法,能够增强推理能力和事实准确性,适用于黑盒模型,并有望推动大语言模型的发展。

CAMEL:用于探索大型语言模型社会“心智”的沟通型智能体 (2023)

NeurIPS本文提出了一种用于自主智能体协作的角色扮演框架,提供可扩展的研究方法,并开源了相关库。

STaR:利用推理引导自身推理的自教学推理器 (2022)

NeurIPS本文提出了STaR技术,该技术利用少量推理示例和无推理数据来引导复杂推理,使模型能够从自我生成的推理中学习。

应用

一种主动推理策略,用于在医疗实践中引导大型语言模型产生可靠响应 (2025)

npj Digital Medicine本文提出了一种领域特定的数据集和基于主动推理的提示协议,以解决大语言模型存在的问题,从而实现其在医疗领域的安全应用。

用于评估大型语言模型在患者交互任务中临床应用的框架 (2025)

Nature Medicine本文介绍了CRAFT-MD方法,该方法利用自然对话对大语言模型进行临床评估,并提出了未来大语言模型评估的建议,以提升医疗实践水平。

大型语言模型缺乏可靠的医疗推理所需的元认知能力 (2025)

Nature Communications研发了MetaMedQA工具,用于评估模型在医疗推理中的元认知能力,揭示了其不足之处,强调了需要基于元认知的框架。

在自主合成实验室中平衡自主性与专业知识 (2025)

Nature Computational Science本文评论了自主合成实验室面临的障碍,提出了人机协同的方法,以及优化实验室功能的策略。

SimUSER:利用大型语言模型模拟用户行为以评估推荐系统 (2025)

Arxiv本文介绍了SimUSER框架,该框架使用人物角色以低成本模拟用户行为,用于推荐系统的评估,并优化参数以提高实际应用中的参与度。

群体自治:从智能体功能化到机器智能 (2025)

Advanced Materials本综述总结了从智能体基础到应用的合成群体研究,探讨了涌现的机器智能在现实世界自主群体设计中的作用。

ShowUI:面向GUI视觉智能体的一体化视觉-语言-行动模型 (2025)

CVPR/ICCV/ECCV本文介绍了一种面向GUI视觉智能体的视觉-语言-行动模型,该模型通过UI引导的令牌选择、交错流传输和精选数据集,推动了GUI辅助技术的发展。

Agent Laboratory:利用大语言模型智能体作为科研助手 (2025)

Arxiv本文介绍了Agent Laboratory框架,这是一个基于大语言模型的全周期科研框架。它能够降低成本,同时通过用户反馈提升质量,加速科学发现进程。

迈向科学智能:基于大语言模型的科学智能体综述 (2025)

Arxiv该论文回顾了基于大语言模型的科学智能体,强调其与通用智能体的区别,并提出了科学发现的路线图。

CitySim:利用大规模大语言模型驱动的智能体仿真建模城市行为与城市动态 (2025)

Arxiv本文提出了CitySim,一种使用大语言模型的城市仿真器。它采用递归的价值驱动方法,赋予智能体关键特性,从而实现可扩展的城市研究。

材料科学中的人工智能综述:基础模型、LLM智能体、数据集和工具 (2025)

Arxiv本文综述了材料科学领域的基础模型,提出了分类体系,讨论了最新进展,回顾了相关资源,评估了优缺点,并提出了未来发展方向。

用于自动化分子优化的可审计智能体平台 (2025)

Arxiv该分层智能体框架实现了分子优化的自动化,生成可审计的推理轨迹,并将大语言模型转化为可审计的设计系统。

PosterForest:用于科学海报生成的分层多智能体协作框架 (2025)

Arxiv提出了一种无需训练的PosterForest框架。它利用海报树和多智能体协作进行海报生成,解决了结构和集成方面的挑战。

基于协作式多智能体LLM架构从SOAP病历中自动检测临床问题 (2025)

Arxiv一个模拟临床团队的协作式多智能体系统(MAS)分析SOAP病历中的主观和客观部分,为更好的临床决策支持工具提供了路径。

在游戏中思考:通过大语言模型强化学习在游戏中学习推理 (2025)

Arxiv提出了“在游戏中思考”(TiG)框架,使大语言模型能够通过与游戏环境的交互获得程序性知识,弥合知识鸿沟并提高透明度。

AlphaEvolve:用于科学和算法发现的编码智能体 (2025)

Arxiv本文介绍了AlphaEvolve,一种进化型编码智能体。它可以自主改进算法、发现新算法,并拓展自动化发现的范围。

Agent Laboratory:将LLM智能体用作科研助手 (2025)

Arxiv介绍了Agent Laboratory,一个基于大语言模型的全周期研究框架。它降低了成本,受益于人类反馈,使研究人员能够专注于创意构思。

CitySim:利用大规模大语言模型驱动的智能体仿真建模城市行为与城市动态 (2025)

Arxiv提出了CitySim,利用大语言模型模拟城市行为。智能体具有信念、目标和记忆。这是一个可扩展的城市现象测试平台。

aiXiv:由AI科学家生成的下一代开放获取科学发现生态系统 (2025)

Arxiv本文介绍了aiXiv,一个基于多智能体的开放获取平台,允许AI生成的研究通过无缝的人工智能与人类协作提交、评审和迭代完善,从而解决缺乏合适发表渠道的问题。

GenoMAS:基于代码驱动基因表达分析的科学发现多智能体框架 (2025)

Arxiv该框架引入了一个多智能体系统,将结构化工作流与自主规划相结合,用于基因表达分析。其核心创新在于引导式规划方法,智能体可以动态调整共享的分析计划,从而确保科学发现的可靠性和灵活性。

Motif:来自人工智能反馈的内在动机 (2024)

ICLR论文提出Motif方法,通过内在奖励将大语言模型的先验知识与智能体对接,从而产生直观的行为并在困难任务上取得进展。

Baba Is AI:打破规则以超越基准 (2024)

ICML该论文可能在“应用”部分展示了一种新颖的方法在动作游戏中,其中包含智能体可能使用的破例策略。

大语言模型赋能的智能体用于模拟宏观经济活动 (2024)

*ACL本文使用大语言模型赋能的智能体来模拟宏观经济活动,为经济应用提供了一种全新的方法。

CompeteAI:理解大语言模型驱动智能体中的竞争动态 (2024)

ICML该论文聚焦于经济应用中基于大语言模型的智能体的竞争动态,为该领域提供了新的见解。

理解基于大语言模型的对话式智能体在心理健康支持中的益处与挑战 (2024)

AMIA本文探讨了在心理学应用中,基于大语言模型的对话式智能体在心理健康支持方面的益处与挑战。

探索LLM智能体的协作机制 (2024)

*ACL本文探讨了心理学应用中LLM智能体的协作机制,为基于大型模型的智能体带来了新的思路。

利用大语言模型智能体模拟人类社会:城市、社交媒体和经济系统 (2024)

WWW该论文将大语言模型智能体应用于人类社会的模拟,涵盖城市、社交媒体和经济系统,是该领域的全新贡献。

大语言模型能否变革计算社会科学? (2024)

*ACL论文探讨了大语言模型是否能改变社会应用中的计算社会科学,提供了新的见解。

AgentCF:用于推荐系统的自主语言智能体协同学习 (2024)

SIGIR提出了AgentCF来模拟用户-物品交互。将用户和物品视为智能体,利用协同学习建模双边关系,启发行为模拟。

关于推荐系统中的生成式智能体 (2024)

SIGIR提出了Agent4Rec,一个由大语言模型赋能的用户模拟器,具备个人资料、记忆和行动模块,用于探索人类行为的模拟。

ChatDev:面向软件开发的沟通型智能体 (2024)

*ACL介绍了 ChatDev,一个基于聊天的开发框架。LLM 智能体在设计、编码和测试等阶段使用统一的语言进行通信,并通过语言桥接不同环节。https://github.com/OpenBMB/ChatDev

CRISPR-GPT:用于自动化基因编辑实验设计的 LLM 智能体 (2024)

Arxiv介绍了 CRISPR-GPT,这是一种具备领域知识和工具的 LLM 智能体,可自动设计基因编辑实验,同时关注伦理问题并弥合研究人员与技术之间的鸿沟。

SciAgents:通过生物启发的多智能体智能图推理实现科学发现自动化 (2024)

Advanced MaterialsSciAgents 利用本体知识图谱、LLM 和多智能体系统,在生物材料领域挖掘跨学科关系,自主生成并优化假设以推动科学发现。

医学大型语言模型易受定向虚假信息攻击 (2024)

npj Digital Medicine文章揭示了医疗领域的 LLM 存在脆弱性。仅需对权重进行 1.1% 的微调,即可注入错误信息,强调了加强安全防护措施的必要性。

CellAgent:基于 LLM 的多智能体框架,用于自动化单细胞数据分析 (2024)

Arxiv介绍了 CellAgent,一个由 LLM 驱动的多智能体框架,专门用于 scRNA-seq 数据分析。该框架具备专家角色、决策机制和自我迭代能力,能够显著减轻工作负担。

描述、解释、规划与选择:结合大型语言模型的交互式规划赋能开放世界多任务智能体 (2023)

NeurIPS文章提出了一种名为“DEPS”的交互式规划方法,利用 LLM 为多任务智能体提供支持,能够不断优化计划并在多个领域展现出有效性。

语言模型与世界模型的结合:具身经验增强语言模型 (2023)

NeurIPS将语言模型与世界模型相结合,借助具身化体验提升模型性能。该方法适用于模拟游戏场景,有助于增强模型的能力。

ChessGPT:连接策略学习与语言建模 (2023)

NeurIPS本文探讨了策略学习与语言建模之间的桥梁作用,其应用潜力涵盖竞技类游戏,并为基于大模型的智能体提供了全新思路。

Mindagent:涌现式游戏互动 (2023)

Arxiv该文研究合作游戏中涌现式的互动行为,为基于大模型的智能体开辟了新的应用场景。

探索大型语言模型在交流类游戏中的应用:狼人杀的实证研究 (2023)

Arxiv本文通过实证研究探讨了大型语言模型在狼人杀这一交流类游戏中的应用,为该领域贡献了新颖的实践案例。

语言即现实:基于生成式 AI 的《一千零一夜》共创叙事游戏体验 (2023)

AAAI本文介绍了一款基于生成式 AI 的《一千零一夜》共创叙事游戏,为游戏生成领域带来了全新的应用方向。

TradingGPT:具有分层记忆与独特角色的多智能体系统,用于提升金融交易绩效 (2023)

ArxivTradingGPT 提出了一种结合分层记忆和独特角色的多智能体系统,旨在提升金融交易表现,是该领域的创新性尝试。

利用大型语言模型模拟多人并复制人类受试者研究 (2023)

ICML本文将大型语言模型应用于模拟人类,以复制受试者研究,为心理学领域的应用提供了新方法。

生成式智能体:人类行为的交互式模拟 (2023)

UIST文章提出了能够模拟人类行为的生成式智能体,其在社会应用方面具有创新性,有望成为基于大模型的智能体研究的重要补充。

通过 ChatGPT 实现代码的自我协作生成 (2023)

TOSEM提出了一种利用 ChatGPT 等 LLM 进行代码自动生成的协作框架。该框架能够组建虚拟智能体团队,在无需人工干预的情况下提升复杂任务的处理效率。

语言模型可解决计算机任务 (2023)

NeurIPS文章介绍了 RCI 方法,这是一种简单的提示工程方案,使预训练的 LLM 能够通过自然语言执行计算机任务,从而提升推理能力并优于其他方法。

ChemCrow:用化学工具增强大型语言模型 (2023)

Arxiv介绍了 ChemCrow,一种集成了 18 种工具的 LLM 化学智能体。它能够增强 LLM 在化学领域的应用能力,实现任务自动化,并打通实验化学与计算化学之间的壁垒。

AlphaFlow:基于强化学习引导的自驱动流体实验室,用于多步化学反应的自主发现与优化 (2023)

Nature Communications本文介绍了 AlphaFlow,一种利用强化学习指导的自驱动流体实验室,可用于多步化学反应的发现,展示了其在 cALD 之外开辟新合成路径的潜力。

语言模型作为零样本规划器:为具身智能体提取可操作知识 (2022)

ICML本文提出将语言模型用作具身智能体的零样本规划器,可在模拟游戏中应用,其新颖之处在于能够提取可操作的知识。

基于智能体仿真的奥地利医疗体系韧性压力测试 (2022)

Nature Communications该数据驱动的智能体仿真框架量化了区域医疗体系应对冲击的韧性,有助于识别医疗服务获取瓶颈,并将系统性指标与个体指标关联起来。

数据集与基准测试

AgentHarm:评估 LLM 智能体在有害任务上的鲁棒性基准 (2025)

ICLR提出了 AgentHarm,一项用于评估 LLM 智能体鲁棒性的新基准。涵盖 11 类危害,可用来评估攻击与防御能力。

AI Hospital:多智能体医疗交互模拟器中的大型语言模型基准测试 (2025)

*ACL提出了用于模拟医疗交互的AI Hospital,开发了MVME基准,并提出了一种争议解决机制,以提升LLM的临床能力。

Benchmark Self-Evolving:用于动态LLM评估的多智能体框架 (2025)

*ACL一个能够自我演进的多智能体基准测试框架,可动态评估LLM。该框架会重新构建实例并扩展数据集,有助于模型选择和基准的持续发展。

DCA-Bench:数据集整理智能体的基准测试 (2025)

ICLR该论文为LLM智能体设立了一个基准,用于检测原始数据集中的问题、整理测试用例,并提出了一个评估框架,从而推动实际场景下的数据集整理工作。

MedAgentBench:用于评估医疗LLM智能体的逼真虚拟电子病历环境 (2025)

Arxiv论文介绍了MedAgentBench,这是一个基于临床任务和真实数据的医疗LLM智能体基准测试平台,能够在医疗领域进行评估与优化。

MLE-Bench:在机器学习工程中评估机器学习智能体 (2025)

ICLR提出了MLE-Bench,用于评估机器学习工程领域的AI智能体。该基准包括精心设计的任务、基线设置、模型评估,并开源了相关代码以供后续研究使用。

EgoLife:迈向第一人称视角的生活助手 (2025)

Arxiv介绍了EgoLife项目,旨在构建第一人称视角的生活助手。同时创建了EgoLife数据集和EgoLifeQA任务,用于日常生活辅助。

DSBench:数据科学智能体距离成为数据科学专家还有多远? (2025)

ICLR论文介绍了DSBench,一个包含真实任务的全面数据科学智能体基准测试,旨在缩小基准测试与实际应用之间的差距。

迈向互联网规模的智能体训练 (2025)

Arxiv该论文开发了一套无需大量人工标注即可实现互联网规模智能体训练的流程,由LLM负责任务生成、执行和评审。

macOSWorld:面向GUI智能体的交互式基准测试 (2025)

Arxiv论文提出了macOSWorld,这是首个包含多语言任务和安全子集的macOS GUI智能体基准测试,填补了操作系统评估方面的空白。

人类的最后一场考试 (2025)

Arxiv介绍了“人类的最后一场考试”(HLE),这是一个多模态、覆盖广泛的LLM基准测试,指出了当前存在的不足,并向公众开放以供研究使用。

MCPEval:基于MCP的AI智能体模型深度自动评估 (2025)

Arxiv, *ACL提出了MCPEval,一个基于MCP的开源框架,用于自动化LLM智能体的评估,标准化评估指标并减少人工工作量。

IDA-Bench:评估LLM在交互式引导数据分析中的表现 (2025)

Arxiv介绍了IDA-Bench,这是一个针对LLM在多轮数据分析中表现的新基准,强调指令遵循与推理能力之间的平衡。

SEC-bench:对LLM智能体在真实世界软件安全任务中的自动化基准测试 (2025)

Arxiv提出了SEC-bench,一个用于LLM智能体在真实世界安全任务中进行自动化基准测试的框架,并创新性地采用多智能体协作结构来生成数据集。

MMSearch-Plus:面向多模态浏览智能体的简单而具有挑战性的基准测试 (2025)

Arxiv介绍了MMSearch-Plus基准,专为多模态浏览智能体设计,包含新颖的数据整理方法和智能体框架,旨在应对真实的多模态挑战。

MultiAgentBench:评估LLM智能体的协作与竞争能力 (2025)

*ACL本文介绍了MultiAgentBench,用于在多种场景下评估多智能体系统,考察认知规划等协议与策略,并将发布代码和数据。

建立严谨的智能体基准测试的最佳实践 (2025)

Arxiv许多智能体基准测试存在设置或奖励机制方面的问题。本文提出了ABC指南,以使智能体评估更加严谨。

UserBench:面向以用户为中心的智能体的交互式训练环境 (2025)

Arxiv介绍了UserBench,一个包含模拟用户的交互式环境,用于评估智能体在主动协作方面的能力。它通过多轮对话和工具使用来衡量智能体澄清模糊且不断变化的目标的能力,揭示了任务完成度与用户满意度之间的重要差距。

PillagerBench:用于评估基于LLM的智能体在Minecraft中竞争力的多智能体基准测试 (2025)

Arxiv本文介绍了PillagerBench,一个用于在Minecraft中评估多智能体竞争力的基准测试,以及TactiCrafter,一种使用人类可读战术并学习因果依赖关系以适应对手的智能体。

UnrealZoo:为具身AI丰富照片级逼真的虚拟世界 (2025)

CVPR/ICCV/ECCVUnrealZoo是一个高保真3D虚拟世界平台,拥有丰富的实体和增强的工具,适用于具身AI。它能够高效地进行多智能体训练,并表明环境多样性对于开发能够应对开放世界复杂性的通用智能体至关重要。

以游戏为探针:评估LLM概念知识的游戏化基准测试 (2025)

ArxivCK-Arena引入了一个多智能体游戏基准,通过描述和区分概念等互动任务来评估LLM的概念推理能力,从而超越了单纯的静态事实回忆。

NewtonBench:评估LLM智能体在通用科学定律发现方面的基准测试 (2025)

ArxivNewtonBench引入了一个可扩展且不易受记忆影响的科学定律发现基准测试。它通过交互式的模型探索来评估智能体发现隐藏原理的能力,超越了静态的函数拟合,更贴近真实的科学探究过程。

[LiveMCP-101:在复杂查询上对启用MCP的智能体进行压力测试与诊断](2025)

Arxiv本文介绍了LiveMCP-101,这是一个包含101个需要多工具协同操作的真实世界查询基准。其核心创新在于采用基于真实执行计划的新评估方法,以更准确地反映动态环境,从而严格测试智能体的能力。

[分布式多智能体系统的阿喀琉斯之踵](2025)

Arxiv本文提出了一种分布式多智能体系统(DMAS)框架,并指出其易受搭便车行为和恶意攻击等关键可信度问题的影响,可作为未来研究的红队工具。

[AgentBench:评估LLM作为智能体](2024)

ICLR介绍了AgentBench,该基准包含8个环境用于评估LLM智能体,分析了失败原因,并提出了多轮对齐训练等改进策略。

[AgentQuest:衡量进展并改进LLM智能体的模块化基准框架](2024)

ACL提出了AgentQuest,一个包含模块化基准和指标的框架,并设计了两种新的评估指标来跟踪LLM智能体的进展。

[BENCHAGENTS:通过智能体交互实现基准自动化创建](2024)

Arxiv介绍了BENCHAGENTS,一个基于LLM的框架,用于自动创建复杂能力的基准,并通过智能体交互和人工反馈确保数据质量。

[数据科学智能体的基准测试](2024)

ACL提出了DSEval,一种针对数据科学智能体的新型评估范式及基准,采用自举方法以提高覆盖范围和全面性。

[将大型语言模型作为AI研究智能体进行基准测试](2024)

ICLR提出了MLAgent-Bench,用于基准测试AI研究智能体,设计了一个基于LLM的智能体,并指出了此类智能体面临的关键挑战。

[面向多智能体系统的大型语言模型基准测试:AutoGen、CrewAI和TaskWeaver的比较分析](2024)

其他该文对三个由LLM驱动的多智能体系统(AutoGen、CrewAI、TaskWeaver)在机器学习代码生成方面的性能进行了基准测试,推动了协作式问题解决的研究。

[BLADE:语言模型智能体的基准测试](2024)

ACL本文提出了BLADE,一个用于自动评估智能体在开放式研究中多方面方法的基准,支持面向数据驱动科学的智能体评估。

[CRAB:跨平台多模态具身语言模型智能体基准](2024)

NeurIPS推出了CRAB,一个基于图的评估方法和任务构建机制的跨环境智能体基准框架,并开发了CRAB Benchmark - v0。

[CToolEval:面向中文LLM智能体在真实API交互中的基准](2024)

ACL提议了CToolEval基准,适用于中文LLM智能体,包含398个API。提出了评估框架,并公开了数据和代码,以促进智能体层面的研究。

[DA-Code:面向大型语言模型的数据科学代码生成智能体基准](2024)

ACL介绍了DA-Code,这是一个针对基于智能体的数据科学领域的代码生成基准。它具有独特的任务、真实数据,并要求使用复杂语言,相关资源已在GitHub上发布。

[具身智能体接口:评估LLM在具身决策中的表现](2024)

NeurIPS提出了具身智能体接口,旨在统一任务、模块和指标,全面评估LLM在具身决策中的能力。

[GTA:通用工具智能体基准](2024)

NeurIPS提出了GTA,一个针对通用工具智能体的基准,包含真实查询、已部署工具和多模态输入,用于评估LLM在现实世界问题解决中的能力。

[LaMPilot:基于语言模型程序的自动驾驶开放基准数据集](2024)

CVPR/ICCV/ECCV展示了LaMPilot,将LLM集成到自动驾驶系统中以遵循用户指令。同时推出了LaMPilot - Bench,并发布了代码和数据供进一步研究。

[ML研究基准](2024)

Arxiv本文提出了ML研究基准,包含7项针对AI智能体的任务,提供了一个评估其在现实世界研究挑战中表现的框架。

[MMAU:跨不同领域智能体能力的综合性基准](2024)

Arxiv本文介绍了MMAU基准,包含横跨5个领域和5种能力的离线任务,提升了LLM智能体的可解释性。

[OmniACT:为桌面和Web端赋能多模态通才型自主智能体的数据集与基准](2024)

CVPR/ICCV/ECCV介绍了OmniACT,这是首个用于评估智能体在计算机任务自动化方面能力的数据集和基准,覆盖桌面应用程序。

[OSWorld:在真实计算机环境中对多模态智能体进行开放式任务的基准测试](2024)

NeurIPS推出了OSWorld,一个可扩展的真实计算机环境,专为多模态智能体设计,并创建了包含369个任务的基准,助力多模态通才智能体的发展。

[重新审视基准与评估:一种基于智能体的探索性动态评估框架,用于LLM](2024)

Arxiv本文引入了Benchmark+和Assessment+,提出了TestAgent框架,能够动态生成基准并对LLM进行领域自适应评估。

[Seal-Tools:用于智能体调优及详细基准测试的自我指令式工具学习数据集](2024)

其他这是一个全新的工具学习数据集Seal - Tools,采用自我指令式生成方法,包含高难度实例和严格指标,作为LLM工具调用能力的新基准。

Tapilot-Crossing:面向交互式数据分析代理的LLM基准测试与演进 (2024)

Arxiv该论文提出了用于评估交互式数据分析中LLM代理的Tapilot-Crossing基准,并提出AIR策略,以将LLM演化为高效的代理。

TheAgentCompany:针对具有实际影响的真实世界任务的LLM代理基准测试 (2024)

Arxiv本文介绍了TheAgentCompany,这是一个可扩展的基准测试平台,用于在模拟软件公司环境的真实世界任务上评估AI代理。

Tur[k]ingBench:面向网络代理的挑战性基准测试 (2024)

Arxiv介绍了TurkingBench,一个基于众包自然HTML页面的基准测试。开发了一套评估框架,以推动基于Web的代理技术进步。

Agent-FLAN:为大型语言模型设计有效的代理微调数据与方法 (2024)

*ACL论文指出了代理训练中的问题,提出了Agent-FLAN来微调LLM,对语料库进行分解,并使用负样本以减少幻觉现象。

AgentBank:通过在5万多个交互轨迹上微调,迈向通用LLM代理 (2024)

*ACL介绍了AgentBank,一个大规模的交互轨迹数据集。采用了新颖的标注方式,对LLM进行微调以得到Samoyed模型,并展示了数据规模对代理能力的影响。

AgentOhana:设计统一的数据与训练流水线,以实现高效的代理学习 (2024)

Arxiv介绍了AgentOhana,旨在整合来自不同来源的代理轨迹,构建平衡的训练流水线,并提出了xLAM-v0.1用于AI代理。

AgentTuning:为LLM赋予通用代理能力 (2024)

*ACL本文提出了AgentTuning方法,利用AgentInstruct和混合微调来提升LLM的代理能力,同时不牺牲其通用性,并开源了相关模型。

可执行代码动作能催生更优秀的LLM代理 (2024)

ICML本文提出了CodeAct,即使用Python代码作为LLM代理的动作。创建了一个数据集,并训练了一个具备自我调试能力的微调代理,以应对复杂任务。

AppWorld:用于基准测试交互式编码代理的可控应用与人物世界 (2024)

*ACL构建了AppWorld引擎和基准测试,以填补现有工具使用基准的空白,从而支持丰富且交互式的代码生成任务。

SheetAgent:借助大型语言模型迈向电子表格推理与操作的通用代理 (2024)

WWW该论文介绍了SheetRM基准,并提出了SheetAgent,一种由三个模块组成的基于LLM的代理,能够实现自主的电子表格推理与操作。

GenoTEX:用于自动化基因表达数据分析的LLM代理基准 (2024)

Arxiv本文介绍了GenoTEX,一个用于基因表达分析的LLM代理基准,以及GenoAgent,一个采用自我纠正代码生成技术的多智能体系统,用于自动化整个生物信息学流程。

FireAct:迈向语言代理的微调 (2023)

Arxiv该论文探讨了语言代理的LM微调问题。提出了使用多样化数据的FireAct方法,揭示了其优势并提供了实验见解。

伦理

医疗大型语言模型易受数据投毒攻击 (2025)

Nature Medicine论文评估了LLM的数据投毒攻击,发现低比例的错误信息也会损害模型,并提出了一种基于图的缓解策略。

基础模型与合理使用 (2024)

JMLR讨论了基础模型在受版权保护数据上的法律与伦理风险,提出了技术性缓解措施,并倡导法律与技术的协同发展以实现合理使用。

估算BLOOM语言模型的碳足迹(参数量1760亿) (2023)

JMLR该论文量化了BLOOM在其整个生命周期中的碳足迹,并研究了其推理阶段的排放情况,讨论了估算中的挑战及未来的研究方向。

LLaMA:开放且高效的语言基础模型 (2023)

介绍了LLaMA系列模型(70亿至650亿参数)。仅使用公开数据集进行训练,并将其发布给科研社区。

大型生成模型中的可预测性与意外性 (2022)

FAccT本文揭示了大型生成模型在可预测性与不可预测性之间的悖论,指出了其潜在危害,并列举了AI社区可以采取的干预措施。

关于随机鹦鹉的危险:语言模型是否可能太大?🦜 (2021)

FAccT该论文质疑语言模型的规模,探讨了相关的风险,并提出了超越单纯扩大规模之外的缓解建议。

价值观导向数据集驱动的语言模型社会适应过程(PALMS) (2021)

NeurIPS提出了PALMS,一种迭代过程,利用价值观导向的数据集,通过少量精选数据来改变语言模型的行为。

GPT-3:其本质、范围、局限及后果 (2020)

论文通过可逆与不可逆的问题分析了GPT-3,提出了它无法通过的三项测试,并阐述了人工制品工业化的后果。

现代深度学习研究中的能源与政策考量 (2020)

AAAI揭示了大型神经网络计算的高昂成本,量化了NLP模型的成本,并提出了降低成本与促进公平的建议。

防御神经网络虚假新闻 (2019)

NeurIPS介绍了Grover,一种可控制文本生成技术,用于研究神经网络虚假新闻的风险,展示了Grover的自我防御价值,并讨论了相关伦理问题。

安全

RTBAS:防御LLM代理免受提示注入与隐私泄露 (2025)

Arxiv论文介绍了RTBAS,它是TBAS的一种变体,结合了信息流控制技术,并使用新型筛选器自动处理工具调用,从而减轻用户负担。

通过通信攻击对 LLM 多智能体系统进行红队测试 (2025)

Arxiv提出了一种名为“中间人智能体”(AiTM)的新攻击方法,通过操纵消息对 LLM-MAS 进行攻击,揭示了多智能体系统安全性的迫切需求。

揭示 LLM 智能体内存中的隐私风险 (2025)

Arxiv该论文在黑盒环境下提出了 MEXTRA 方法,用于从 LLM 智能体内存中提取隐私信息,并探讨了泄露因素,呼吁采取相应的防护措施。

AEIA-MN:评估多模态 LLM 驱动的移动智能体对抗主动环境注入攻击的鲁棒性 (2025)

Arxiv论文定义了主动环境注入攻击(AEIA),并提出 AEIA-MN 方法来评估基于 MLLM 的智能体对此类威胁的鲁棒性。

用于保护动态 LLM 智能体网络的防火墙 (2025)

Arxiv论文识别了 LLM 智能体网络的通信特性,提出了一种平衡设计,并通过仿真构建了防火墙规则。

AUTOHIJACKER:针对黑盒 LLM 智能体的自动间接提示注入攻击 (2025)

Arxiv提出了 AutoHijacker,一种自动化的黑盒间接提示注入攻击。它利用 LLM 作为优化器,采用批处理优化和可训练的记忆机制。

受威胁的 AI 智能体:关键安全挑战与未来发展方向综述 (2025)

ACM 计算综述本文将新兴的 AI 智能体安全威胁归纳为四大知识空白,旨在激发研究以开发更安全的智能体应用。

SAGA:用于治理 AI 智能体系统的安全架构 (2025)

Arxiv提出了 SAGA 安全架构,用于治理智能体系统,提供用户监督和细粒度访问控制,从而实现安全的智能体部署。

WebInject:针对 Web 智能体的提示注入攻击 (2025)

Arxiv提出了 WebInject,一种针对 Web 智能体的提示注入攻击。该方法引入像素扰动,训练神经网络进行映射,并解决优化问题。

LLM 驱动的多智能体系统中的网络欺诈攻击 (2025)

Arxiv本文介绍了网络欺诈攻击,这是一种新颖的方法,通过篡改域名和伪装链接,诱导 LLM 驱动的多智能体系统访问恶意网站,从而绕过复杂的越狱技术。

攻击 LLM 和 AI 智能体:针对大型语言模型的广告嵌入攻击 (2025)

Arxiv介绍了广告嵌入攻击(AEA),这是一种新型威胁,能够劫持 LLM 将隐蔽的推广或恶意内容注入到输出中。文中详细描述了两种低成本的攻击向量,并提出了一种基于提示的防御方法,突出了 AI 安全领域的一个关键缺口。

超越数据隐私:大型语言模型的新隐私风险 (2025)

Arxiv本文认为,除了训练数据泄露之外,LLM 的部署还带来了新的隐私风险,这些风险源于其自主推理能力以及与应用程序的集成,从而可能引发复杂的大规模攻击,威胁个人和社会的安全。

隐私在行动:面向 LLM 驱动智能体的真实隐私缓解与评估 (2025)

Arxiv本文提出了 PrivacyChecker,一种与模型无关的缓解方法,以及 PrivacyLens-Live,一个动态基准测试工具。它们通过将情境完整性融入智能体协议,来应对 LLM 智能体中的新隐私风险。

PrivWeb:面向 Web 智能体的无感且内容感知型隐私保护 (2025)

Arxiv该工作提出了 PrivWeb,一种适用于 Web 智能体的隐私框架,利用本地 LLM 根据用户偏好自动匿名化屏幕上的数据,在自动化保护与用户控制之间取得平衡,并通过自适应、上下文感知的通知实现这一目标。

DemonAgent:针对基于 LLM 的智能体的动态加密多后门植入攻击 (2025)

*ACL提出了动态加密多后门植入攻击,采用动态加密和子片段技术以绕过安全审计。同时发布了 AgentBackdoorEval 数据集。

CORBA:基于大型语言模型的多智能体系统中的传染性递归阻塞攻击 (2025)

Arxiv提出了 LLM-MAS 中的传染性递归阻塞攻击(Corba)。该攻击在传播性和资源耗竭方面具有创新性,难以通过对齐手段缓解。

G-Safeguard:一种基于拓扑的 LLM 基础多智能体系统安全视角与治理方法 (2025)

*ACL论文介绍了 G-Safeguard,用于 LLM-MAS。它利用图神经网络进行异常检测和拓扑干预,具有较强的适应性,可与主流的 MAS 系统结合使用。

AgentHarm:评估 LLM 智能体在有害任务上的鲁棒性基准 (2025)

ICLR提出了 AgentHarm,一个包含 110 个恶意任务的新基准,用于评估 LLM 智能体的攻击与防御能力。

[商用 LLM 智能体已经容易受到简单但危险的攻击] (2025)

Arxiv本文分析了 LLM 智能体独特的安全和隐私漏洞,提供了攻击分类,并进行了无需机器学习知识的简单攻击实验。

LLM(-智能体)全栈安全综合综述:数据、训练与部署 (2025)

Arxiv本文提出了 LLM 的“全栈”安全概念,覆盖整个生命周期,并结合大量文献和独特见解,指明了未来的研究方向。

提示感染:多智能体系统中的 LLM 到 LLM 提示注入 (2025)

论文揭示了多智能体系统中 LLM 到 LLM 的提示注入现象,提出了“提示感染”方法,并建议通过 LLM 标记来缓解这一问题。

基于 LLM 的多智能体系统:技术与商业视角 (2024)

Arxiv本文探讨了基于 LLM 的多智能体系统(LaMAS),阐述了其优势,提供了协议,并将其视为实现人工群体智能的一种解决方案。

BlockAgents:通过区块链实现拜占庭容错的 LLM 基础多智能体协作 (2024)

TURC论文提出了 BlockAgents,将区块链技术整合到 LLM 基础多智能体系统中。该方案采用 PoT 机制和多指标评估,以缓解拜占庭行为。

[提示感染:多智能体系统中的 LLM 到 LLM 提示注入](2024)

Arxiv揭示了多智能体系统中 LLM 到 LLM 的提示注入攻击,提出了“提示感染”机制及“LLM 标记”防御方法,以提升安全性。

[AgentDojo:评估 LLM 智能体提示注入攻击与防御的动态环境](2024)

NeurIPS介绍了 AgentDojo,一个用于在不可信数据上评估 AI 智能体的可扩展框架,旨在促进可靠且鲁棒的智能体设计。

[AGENTPOISON:通过污染内存或知识库对 LLM 智能体进行红队攻防演练](2024)

NeurIPS提出 AGENTPOISON,一种通过污染内存/知识库对 LLM 智能体实施新型后门攻击的方法。无需额外训练,具有良好的迁移性和隐蔽性。

[AutoDefense:针对越狱攻击的多智能体 LLM 防御框架](2024)

Arxiv提出了 AutoDefense,一个过滤 LLM 有害响应的多智能体框架,能够抵御各类攻击,并使小型 LLM 能够保护大型模型。

[Imprompter:诱使 LLM 智能体不当使用工具](2024)

Arxiv该论文致力于智能体系统安全研究,提出了一种混淆的对抗性提示攻击,并证明其对多种智能体均有效。

[直击核心:通过直接操控 LLM 对基于 RAG 的智能体进行简单而有效的攻击](2024)

Arxiv本文揭示了一种由对抗性前缀引发的严重 LLM 漏洞,强调了在基于智能体的架构中实施多层安全防护的必要性。

[提示注入作为应对 LLM 驱动网络攻击的防御手段](2024)

Arxiv提出了 Mantis,一个利用提示注入来反击 LLM 驱动网络攻击的防御框架,能够自主“黑客式”回击攻击者,并且是开源的。

[邪恶天才:深入探讨基于 LLM 的智能体安全性](2024)

Arxiv该论文从三个方面探讨了基于 LLM 的智能体安全问题。提出了一种基于模板的攻击方法以及“邪恶天才”分析法,用于深入研究。

[智能体安全基准(ASB):为基于 LLM 的智能体攻击与防御提供形式化与基准测试](2024)

Arxiv介绍了智能体安全基准(ASB),用于形式化和基准测试基于 LLM 的智能体攻击与防御,揭示了潜在漏洞并指明未来研究方向。

[AGENTHARM:衡量 LLM 智能体危害性的基准测试](2024)

Arxiv提出了一项新的基准测试 AgentHarm,用于研究 LLM 智能体的滥用问题,包含多样化的恶意任务和独特的评分标准。

[CLAS 2024:LLM 和智能体安全竞赛](2024)

ArxivCLAS 2024 通过三个赛道推动对 LLM 和智能体安全的理解,促进社区协作,以构建更安全的 AI 系统。

[任务盾牌:通过强制任务对齐防御 LLM 智能体中的间接提示注入](2024)

Arxiv该论文提出将智能体安全重新定义为确保任务对齐,并开发了任务盾牌,用于验证指令是否真正有助于实现用户目标。

[WIPI:LLM 驱动的 Web 智能体面临的新型网络威胁](2024)

Arxiv本文介绍了一种新型威胁 WIPI,它通过网页指令间接控制 Web 智能体,从而提高攻击效率和隐蔽性。

[史密斯特工:一张图片即可呈指数级速度越狱百万个多模态 LLM 智能体](2024)

Arxiv论文揭示了多智能体多模态 LLM 中的“传染性越狱”现象,证明其可行性,并提出了一种限制防御传播的原则。

[CORBA:基于大型语言模型的多智能体系统中的传染性递归阻断攻击](2024)

Arxiv介绍了 CORBA,一种针对 LLM 多智能体系统的新型攻击。该攻击具有传染性和递归性,难以通过对齐技术缓解,在不同拓扑结构和模型上均有效。

[PsySafe:基于心理学的多智能体系统安全攻击、防御与评估综合框架](2024)

ACL本文从智能体心理学角度探讨多智能体系统安全问题,提出了 PsySafe 框架,并为未来研究提供了洞见。

[破解 ReAct 智能体:先入为主攻击让你得逞](2024)

Arxiv该论文介绍了针对 ReAct 智能体的“先入为主”攻击,并提出了一种反射机制来缓解这一安全漏洞。

[AGENT-SAFETYBENCH:评估 LLM 智能体的安全性](2024)

Arxiv该论文引入了 AGENT-SAFETYBENCH 来评估 LLM 智能体的安全性,指出了现有方法的不足,并强调需要更先进的策略,同时计划发布该基准测试。

[INJECAGENT:工具集成型大型语言模型智能体中间接提示注入的基准测试](2024)

Arxiv介绍了 INJECAGENT,这是一个用于评估工具集成型 LLM 智能体对 IPI 攻击脆弱性的基准测试,并对攻击意图进行了分类。

[PsySafe:基于心理学的多智能体系统安全攻击、防御与评估综合框架](2024)

Arxiv本文提出基于智能体心理学的 PsySafe 框架,以解决多智能体系统安全问题,提供了关于风险识别、评估和缓解的见解。

[TrustAgent:迈向安全可信的 LLM 基础智能体](2024)

ACL介绍了 TrustAgent,一个基于智能体宪章的框架。该框架采用三种策略来保障 LLM 智能体的安全,同时影响其助人能力,并揭示了 LLM 推理的重要性。

[警惕你的智能体!探究基于 LLM 的智能体中的后门威胁](2024)

NeurIPS该研究构建了一个智能体后门攻击框架,分析了多种形式,并指出需要针对性的防御措施来应对这些威胁。

[R-Judge:评估 LLM 智能体安全风险意识的基准测试](2024)

ACL介绍了 R-Judge,一个用于评估 LLM 智能体安全风险意识的基准测试,表明仍有改进空间,并揭示了一种有效的微调方法。

[NetSafe:探索多智能体网络的拓扑安全性](2024)

*ACL本文从拓扑视角探讨多智能体网络的安全性,提出了NetSafe框架,揭示了新的现象,为未来的安全研究提供了指导。

[摇摇欲坠的纸牌屋?面向语言智能体的对抗攻击映射](2024)

Arxiv首次系统性地梳理了针对语言智能体的对抗攻击,提出了一套框架和12种攻击场景,强调了理解相关风险的紧迫性。

综述

[LLM(-Agent)全栈安全的全面综述:数据、训练与部署](2025)

Arxiv本文首次提出了LLM“全栈”安全的概念,覆盖整个生命周期,并结合丰富的文献资料和独到见解,为未来研究指明方向。

[信任但需验证!测试时扩展的验证设计综述](2025)

Arxiv该综述涵盖了多种TTS验证方法,提出了验证器训练的统一视角,填补了现有文献中的空白。

[科学类大语言模型综述:从数据基础到智能体前沿](2025)

Arxiv本综述以数据为核心重新审视Sci-LLM的发展,分析了数据集、评估方法,并提出将科学发现转向闭环系统的思路。

[LLM智能体的评估与基准测试:综述](2025)

Arxiv提出了用于LLM智能体评估的二维分类法,指出了企业级应用中的挑战,并明确了系统化评估的未来研究方向。

[自进化AI智能体的全面综述:连接基础模型与终身智能体系统的新范式](2025)

Arxiv本文对自进化AI智能体进行了全面综述,提出了统一的框架,回顾了相关技术、领域特定策略、评估方法以及安全与伦理问题,旨在打通基础模型与终身智能体系统之间的桥梁。

[LLM智能体的评估与基准测试:综述](2025)

Arxiv该综述引入了一个二维分类体系来组织LLM智能体的评估方法,并强调了关键的企业级挑战,为研究人员和从业者提供了一个系统化的框架,用于评估智能体在实际部署中的表现。

[面向LLM的智能体强化学习全景:综述](2025)

Arxiv本综述正式确立了LLM从生成器向自主智能体的转变,提出了核心能力和应用场景的双重分类体系。它将强化学习定位为整合这些模块、实现适应性强且稳健的智能体行为的关键机制。

[大型视觉语言模型的基准评估、应用与挑战:综述](2025)

Arxiv本文系统性地概述了VLM的相关内容:模型信息、架构、基准测试、应用及面临的挑战,并在GitHub仓库中提供了详细资料。

[未来是智能体时代:多智能体推荐系统的定义、视角与开放挑战](2025)

Arxiv本文探讨了LLM智能体在推荐系统中的应用,提出了形式化框架、用例和挑战,为下一代服务奠定了基础。

[商用LLM智能体已易受简单却危险的攻击侵害](2025)

Arxiv分析了LLM智能体特有的安全与隐私漏洞,提供了攻击分类,并对热门智能体进行了简单的攻击实验。

[多智能体协作机制:基于LLM的综述](2025)

Arxiv本文综述了基于LLM的多智能体系统,提出了一个框架,探讨了其应用,并指出了人工智能集体智慧所面临的挑战与发展方向。

[面临威胁的AI智能体:关键安全挑战与未来路径的综述](2025)

ACM Computing Survey该综述指出了AI智能体在安全领域的四大知识缺口。它回顾了各类威胁,展示了当前进展与局限性,并为未来研究提供了启发。

[基于大型模型的智能体:现状、合作范式、安全与隐私及未来趋势](2024)

Arxiv本文探讨了LM智能体未来的自主协作,涵盖了当前状态、合作范式、安全风险,并提出了未来的研究方向。

[智能体AI:多模态交互的前沿探索](2024)

Arxiv定义了用于交互式多模态系统的“智能体AI”,探讨了动作预测、缓解模型幻觉等问题,并展望了虚拟交互的未来。

[基于大语言模型的多智能体:进展与挑战的综述](2024)

Arxiv该综述讨论了基于LLM的多智能体系统的核心要素与挑战,提供了相关数据集,并维护了一个GitHub仓库以更新最新研究成果。

[大型多模态智能体:综述](2024)

Arxiv回顾了由LLM驱动的多模态智能体,对相关研究进行了分类,整理了评估方法,并提出了未来的发展方向。

[理解LLM智能体的规划:综述](2024)

Arxiv该综述首次系统性地审视了基于LLM的智能体规划,对相关工作进行了分类,分析了发展方向并讨论了面临的挑战。

[计算实验与基于大语言模型的智能体:综述与展望](2024)

Arxiv本文探讨了计算实验与基于LLM的智能体相结合的可能性,梳理了二者的历史、相互优势,并讨论了挑战与发展趋势。

[个人LLM智能体:能力、效率与安全的洞察与综述](2024)

Arxiv本文聚焦于个人LLM智能体,讨论了其架构、挑战及解决方案,将其视为一种重要的软件范式。

[基于大型模型的智能体:现状、合作范式、安全与隐私及未来趋势](2024)

Arxiv本文探讨了LM智能体未来的自主协作,涵盖了当前状态、关键技术、安全与隐私问题,并提出了未来的研究方向。

用于推理、规划和工具调用的新兴 AI 代理架构全景:综述 (2024)

Arxiv本综述评估了 AI 代理的实现方式,分享了其能力、洞见及设计考量,并突出了构建稳健系统的关键主题。

基于大型语言模型的智能代理探索:定义、方法与前景 (2024)

Arxiv本文综述了单智能体与多智能体系统中基于 LLM 的智能代理,涵盖其定义、组成部分、部署机制,并展望了其发展前景。

立场论文:迈向整体性智能的代理 AI (2024)

Arxiv论文提出了用于具身智能的代理基础模型,探讨了代理 AI 的领域能力和跨学科潜力,以指导未来研究方向。

基于大型语言模型的多智能体:进展与挑战的综述 (2024)

IJCAI本综述深入探讨了基于 LLM 的多智能体系统,涵盖了其运行领域、智能体配置以及技能发展途径。此外,还列出了相关数据集并维护了一个 GitHub 仓库。

具备工具能力的 LLM:综述 (2024)

Arxiv提出了一种标准化的工具集成范式,探讨了其中的挑战、创新解决方案以及 LLM 自主创建工具的理念,并复现了相关实验结果。

基于大型语言模型的代理记忆机制综述 (2024)

Arxiv本文全面综述了基于 LLM 的代理记忆机制,回顾了其设计与评估方法,展示了具体应用,并提出了未来的研究方向。

理解 LLM 代理的规划:综述 (2024)

Arxiv本综述系统性地梳理了基于 LLM 的代理规划问题,对现有工作进行了分类,分析了研究方向,并讨论了当前面临的挑战。

基于大型语言模型的多智能体:进展与挑战的综述 (2024)

Arxiv本综述深入探讨了基于 LLM 的多智能体系统及其各个方面和挑战,并提供了相关数据集和开源代码库。

基于大型语言模型的游戏智能代理综述 (2024)

Arxiv本文全面概述了基于 LLM 的游戏智能代理,详细介绍了其架构,调研了不同游戏类型中的代理实例,并提出了未来研发的方向。

大型语言模型与游戏:综述与路线图 (2024)

Arxiv本文综述了 LLM 在游戏领域的应用,明确了 LLM 的角色,探讨了尚未开发的领域,并权衡了其潜力与局限性,为后续研究铺平了道路。

基于大型语言模型的智能代理探索:定义、方法与前景 (2024)

Arxiv本文综述了单智能体与多智能体系统中基于 LLM 的智能代理,内容涵盖定义、组件、部署方式、数据集,并展望了其发展前景。

风险导航:基于 LLM 的智能代理中的安全、隐私与伦理威胁综述 (2024)

Arxiv本综述分析了基于 LLM 的智能代理所面临的安全、隐私和伦理威胁,提出了分类体系,并建议了未来的研究方向。

AI 代理的安全性 (2024)

Arxiv本文从系统角度识别了 AI 代理的安全漏洞,介绍了相应的防御措施,并提出了提升其安全性和可靠性的方法。

个人 LLM 代理:关于能力、效率与安全的洞察与综述 (2024)

Arxiv本文聚焦于个人 LLM 代理,讨论了其架构、面临的挑战及解决方案,将其视为一种重要的软件范式。

LLM 代理的安全与隐私新议题:附案例研究的综述 (2024)

Arxiv本文全面概述了 LLM 代理在隐私与安全方面的问题,覆盖了威胁、影响、防御措施及发展趋势,并通过案例研究启发未来研究。

从行动与指令推断沟通智能体的目标 (2024)

ICML Workshop本文模拟了人类在合作中的推理能力。它使用 GPT-3 处理指令性话语,并结合多模态贝叶斯逆向规划来推断目标,从而凸显了言语交流的重要性。

个人 LLM 代理:关于能力、效率与安全的洞察与综述 (2024)

Arxiv本文聚焦于个人 LLM 代理,讨论了其架构、挑战与解决方案,将其视为一种重要的软件范式。

LLM 红队测试的最新进展:技术、防御与伦理考量 (2024)

Arxiv本文分析了 LLM 红队攻击(如基于梯度的方法、强化学习等)及其防御措施,旨在推动更安全、更可靠的语言模型发展。

从长期问题到新兴困境:大型语言模型伦理的解构——综述 (2024)

本文从旧有到新兴的层面综述了 LLM 面临的伦理挑战,分析了相关研究,并强调将伦理融入 LLM 开发的重要性。

基于大型语言模型的自主代理综述 (2023)

FCS本文综述了基于 LLM 的自主代理,提出了一套统一的构建框架,概述了其应用,并指出了当前的挑战及未来发展方向。

基于大型语言模型的代理的兴起与潜力:综述 (2023)

SCIS本文综述了基于 LLM 的代理,提出了一个通用框架,探讨了其应用场景,深入研究了代理社会,并讨论了关键议题与问题。

大型语言模型对齐:综述 (2023)

Arxiv本综述对 LLM 对齐方法进行了分类,探讨了相关问题,给出了基准测试,并展望了未来研究方向,以推动更具能力和更安全的 LLM 发展。

语言模型可能造成的伦理与社会危害风险 (2021)

Arxiv本文分析了大规模 LLM 带来的风险,列出了六个领域中的 21 种风险,提出了缓解措施,并指出了进一步研究的方向。

基础模型的机遇与风险 (2021)

Arxiv本文详细探讨了基础模型的机遇与风险,指出了涌现能力及同质化问题,并呼吁开展跨学科研究。

迈向可信的人工智能开发:支持可验证声明的机制 (2020)

Arxiv本文提出了不同利益相关者提升人工智能声明可验证性的步骤,分析了十种机制,并给出了相关建议。

可行动的审计:公开披露商业AI产品偏见性能结果的影响研究 (2019)

AIES本文通过Gender Shades审计案例分析了公开披露AI偏见结果的影响,表明此举能够促使企业减少算法偏差。

工具

ToolCoder:面向大型语言模型的系统性代码赋能工具学习框架 (2025)

Arxiv提出ToolCoder框架,将工具学习重新表述为代码生成任务。该框架能将用户查询转换为Python脚手架,实现代码复用与系统化调试。

VTool-R1:基于多模态工具使用的强化学习,让视觉语言模型学会借助图像思考 (2025)

Arxiv介绍了VTool-R1,这是首个训练视觉语言模型进行多模态思维链的框架。它将视觉工具整合到强化反馈机制中,使模型能够在无需过程监督的情况下进行策略性工具使用。

Re-Invoke:用于零样本工具检索的工具调用重写方法 (2024)

Arxiv提出了Re-Invoke方法,这是一种针对大规模工具集的无监督工具检索技术,结合查询合成、意图提取和多视角排序来实现高效检索。

工具链:大型语言模型作为自动化的多工具学习者 (2024)

Arxiv提出了LLM的自动工具链(ATC)概念,将其视为多工具使用者;同时提出了一种黑盒探针方法用于工具学习,并构建了ToolFlow基准测试集。

EASYTOOL:通过简洁的工具指令增强基于LLM的智能体 (2024)

Arxiv介绍了EASYTOOL框架,能够将多样化的工具文档转化为简洁明了的指令,从而提升LLM的工具使用能力。

ToolGen:通过生成式方法实现统一的工具检索与调用 (2024)

Arxiv提出了ToolGen框架,通过独特标记将工具知识融入LLM参数中,将工具检索转化为生成任务,从而显著提升LLM的多功能性和自主性。

ToolNet:通过工具图谱将大型语言模型与海量工具连接起来 (2024)

Arxiv本文提出了ToolNet插拔式框架,将工具以图谱形式组织起来,使LLM能够更高效地处理数千种工具。

ToolPlanner:一种具备路径规划与反馈功能的多粒度指令增强型工具LLM (2024)

Arxiv本文构建了MGToolBench以反映真实场景,并提出了ToolPlanner框架,包含路径规划与反馈机制,以更好地完成任务和遵循指令。

利用执行反馈提升语言模型的工具学习能力 (2024)

*ACL提出了TRICE两阶段框架,允许模型从工具执行反馈中学习,从而决定何时以及如何有效使用工具。

利用大型语言模型改进REST API测试 (2024)

ICSE-NIER本文提出了RESTGPT,利用LLM从API规范中提取规则并生成测试值,以解决现有方法的局限性。

想象中的LLM:通过模拟试错进行工具学习 (2024)

*ACL现有的LLM在工具使用方面的准确性较低。本文提出了STE方法,这是一种受生物启发的技术,结合尝试、想象和记忆,以提升工具学习效果。

情境技能:解锁大型语言模型的组合能力 (2024)

*ACL本文提出了情境技能(SKiC)提示方法,应用于上下文学习中,以释放LLM的组合能力,并实现零样本泛化。

TaskMatrix.AI:通过连接基础模型与数百万个API完成任务 (2024)

Others本文提出将基础模型与API连接以完成任务,利用模型的对话和代码生成等能力实现实际应用。

Gorilla:连接海量API的大规模语言模型 (2024)

NeurIPS开发了经过RAT训练优化的Gorilla模型,采用微调后的LLaMA架构,有效缓解幻觉问题,并通过检索机制更好地编写API调用代码,相关成果已在APIBench上得到验证。

大型语言模型作为工具制造者 (2024)

ICLR本文提出了LATM闭环框架,使LLM能够自主制造并使用工具,通过分工实现成本效益,并扩展缓存的应用范围。

多智能体协作:释放智能LLM代理的力量 (2023)

Arxiv该框架创新性地提升了LLM的能力,解决了其局限性,并通过多种案例展示了其在AGI领域的潜力。

推荐AI代理:整合大型语言模型实现交互式推荐 (2023)

Arxiv本文通过“InteRecAgent”将推荐模型与LLM桥梁连接,以LLM为大脑、推荐模型为工具,实现了交互式推荐功能。

ToolLLM:助力大型语言模型掌握超过16000个真实世界API (2023)

Arxiv介绍了ToolLLM框架,包含ToolBench数据集、新型决策树算法和ToolEval评估工具。通过对LLaMA进行微调,得到了具有良好泛化能力的ToolLLaMA模型。

TPTU-v2:提升大型语言模型驱动的智能体在现实系统中任务规划与工具使用能力 (2023)

Arxiv本文提出了一种框架,旨在提升基于LLM的智能体在现实系统中的TPTU能力,包括API检索器、LLM微调器和演示选择器。

TPTU:基于大型语言模型的AI智能体,用于任务规划与工具使用 (2023)

Arxiv提出了基于LLM的AI智能体框架,设计了两种类型的智能体,并评估了TPTU能力,为LLM在AI领域的应用提供了指导。

GPT4Tools:通过自我指令教导大型语言模型使用工具 (2023)

NeurIPS提出GPT4Tools方法,通过自我指令使开源LLM具备工具使用能力,提供基准测试,并展示其广泛的适用性。

API-Bank:面向工具增强型LLM的综合基准测试 (2023)

*ACL引入API-Bank用于工具增强型LLM。开发了评估体系,构建了训练数据集,并指出了未来的研究挑战。

ChatCoT:基于聊天式大型语言模型的工具增强型思维链推理 (2023)

*ACL提出ChatCoT框架,这是一种适用于聊天式LLM的工具增强型思维链推理方法,将思维链建模为多轮对话,统一了推理与工具使用。

ToolQA:用于LLM问答任务的外部工具使用数据集 (2023)

NeurIPS推出了ToolQA数据集,用于评估LLM在问答任务中对外部工具的使用能力。采用可扩展的策划方式,最小化数据重叠,并提供了新的评估方向。

关于开源大型语言模型的工具操控能力 (2023)

Arxiv该文重新审视了开源LLM在工具操控方面的经典方法,创建了ToolBench,并提供了一种实用的人工监督方案。

RestGPT:将大型语言模型与现实世界的RESTful API连接 (2023)

Arxiv本文提出RestGPT,通过规划机制和API执行器将LLM与RESTful API连接起来。同时提供了RestBench用于评估。

Toolformer:语言模型可以自我学习使用工具 (2023)

NeurIPS该文提出Toolformer,使LM能够通过少量示例,借助API自主学习使用外部工具,从而提升零样本任务的表现。

WebCPM:面向中文长文本问答的交互式网络搜索 (2023)

*ACL介绍了WebCPM,这是首个包含交互式网络搜索的中文LFQA数据集。记录了搜索行为,对模型进行了微调,并公开了相关资源。

ToolCoder:教导代码生成模型使用API搜索工具 (2023)

Arxiv提出ToolCoder,将API搜索工具整合到代码生成过程中。利用ChatGPT进行标注和微调,在这一过程中创新性地融入了工具。

ToolAlpaca:基于3000个模拟案例的语言模型通用工具学习 (2023)

Arxiv该文提出了ToolAlpaca框架,用于生成工具使用语料并让紧凑型模型学习通用技能,证明了此类模型的可行性。

ToolkenGPT:通过工具嵌入增强冻结语言模型的大规模工具使用能力 (2023)

NeurIPS该文提出ToolkenGPT,利用工具嵌入使LLM掌握类似预测token的工具使用技能,解决了现有集成方法的局限性。

MultiTool-CoT:GPT-3可通过思维链提示同时使用多个外部工具 (2023)

*ACL提出MultiTool-CoT框架,利用思维链提示将多个外部工具整合到推理过程中,以提升在NumGLUE上的表现。

CREATOR:用于解耦大型语言模型抽象与具体推理的工具创建 (2023)

*ACL提出CREATOR,使LLM能够创建工具,从而分离工具的创建与执行。引入了Creation Challenge,革新了问题解决范式。

GEAR:用通用且高效的工具解析增强语言模型 (2023)

Arxiv介绍了GEAR,一种通用且高效的查询-工具对接算法,可委托给SLM/LLM执行,在降低成本的同时提高了精度。

Dify (2023)

Dify是一个开源的LLM应用开发平台。其界面集成了多种功能,支持从原型快速部署到生产环境。

LangChain (2023)

LangChain简化了LLM应用的生命周期,提供了开发组件、生产工具以及基于大模型代理的部署平台。

WebGPT:结合浏览器辅助与人工反馈的问答系统 (2022)

Arxiv对GPT-3进行微调,使其能够结合网页浏览进行长篇问答,采用模仿学习、人工反馈和参考文献收集等方法,是一种新颖的尝试。

Task Bench:用于评估并行运行时性能的参数化基准测试 (2020)

SCTask Bench是针对分布式编程系统的参数化基准测试工具。它简化了基准测试流程,并引入了一种名为METG的新指标来评估系统性能。

🤝 贡献

我们欢迎各位贡献者扩充本合集。您可以:

- 提交拉取请求以添加论文或资源

- 开启议题建议新增论文或资源

- 通过我们的提交表单提交您的论文,或发送邮件至luo.junyu@outlook.com

我们将定期更新仓库,以纳入最新的研究成果。

📝 引用

如果您觉得本综述有所帮助,请考虑引用我们的工作:

@article{agentsurvey2025,

title={大型语言模型智能体:方法论、应用与挑战综述},

author={Luo, J. 和 Zhang, W. 和 Yuan, Y. 等},

journal={arXiv预印本 arXiv:2503.21460},

year={2025}

}

如有任何疑问或建议,请开启议题或联系仓库维护者。

相似工具推荐

openclaw

OpenClaw 是一款专为个人打造的本地化 AI 助手,旨在让你在自己的设备上拥有完全可控的智能伙伴。它打破了传统 AI 助手局限于特定网页或应用的束缚,能够直接接入你日常使用的各类通讯渠道,包括微信、WhatsApp、Telegram、Discord、iMessage 等数十种平台。无论你在哪个聊天软件中发送消息,OpenClaw 都能即时响应,甚至支持在 macOS、iOS 和 Android 设备上进行语音交互,并提供实时的画布渲染功能供你操控。 这款工具主要解决了用户对数据隐私、响应速度以及“始终在线”体验的需求。通过将 AI 部署在本地,用户无需依赖云端服务即可享受快速、私密的智能辅助,真正实现了“你的数据,你做主”。其独特的技术亮点在于强大的网关架构,将控制平面与核心助手分离,确保跨平台通信的流畅性与扩展性。 OpenClaw 非常适合希望构建个性化工作流的技术爱好者、开发者,以及注重隐私保护且不愿被单一生态绑定的普通用户。只要具备基础的终端操作能力(支持 macOS、Linux 及 Windows WSL2),即可通过简单的命令行引导完成部署。如果你渴望拥有一个懂你

stable-diffusion-webui

stable-diffusion-webui 是一个基于 Gradio 构建的网页版操作界面,旨在让用户能够轻松地在本地运行和使用强大的 Stable Diffusion 图像生成模型。它解决了原始模型依赖命令行、操作门槛高且功能分散的痛点,将复杂的 AI 绘图流程整合进一个直观易用的图形化平台。 无论是希望快速上手的普通创作者、需要精细控制画面细节的设计师,还是想要深入探索模型潜力的开发者与研究人员,都能从中获益。其核心亮点在于极高的功能丰富度:不仅支持文生图、图生图、局部重绘(Inpainting)和外绘(Outpainting)等基础模式,还独创了注意力机制调整、提示词矩阵、负向提示词以及“高清修复”等高级功能。此外,它内置了 GFPGAN 和 CodeFormer 等人脸修复工具,支持多种神经网络放大算法,并允许用户通过插件系统无限扩展能力。即使是显存有限的设备,stable-diffusion-webui 也提供了相应的优化选项,让高质量的 AI 艺术创作变得触手可及。

everything-claude-code

everything-claude-code 是一套专为 AI 编程助手(如 Claude Code、Codex、Cursor 等)打造的高性能优化系统。它不仅仅是一组配置文件,而是一个经过长期实战打磨的完整框架,旨在解决 AI 代理在实际开发中面临的效率低下、记忆丢失、安全隐患及缺乏持续学习能力等核心痛点。 通过引入技能模块化、直觉增强、记忆持久化机制以及内置的安全扫描功能,everything-claude-code 能显著提升 AI 在复杂任务中的表现,帮助开发者构建更稳定、更智能的生产级 AI 代理。其独特的“研究优先”开发理念和针对 Token 消耗的优化策略,使得模型响应更快、成本更低,同时有效防御潜在的攻击向量。 这套工具特别适合软件开发者、AI 研究人员以及希望深度定制 AI 工作流的技术团队使用。无论您是在构建大型代码库,还是需要 AI 协助进行安全审计与自动化测试,everything-claude-code 都能提供强大的底层支持。作为一个曾荣获 Anthropic 黑客大奖的开源项目,它融合了多语言支持与丰富的实战钩子(hooks),让 AI 真正成长为懂上

ComfyUI

ComfyUI 是一款功能强大且高度模块化的视觉 AI 引擎,专为设计和执行复杂的 Stable Diffusion 图像生成流程而打造。它摒弃了传统的代码编写模式,采用直观的节点式流程图界面,让用户通过连接不同的功能模块即可构建个性化的生成管线。 这一设计巧妙解决了高级 AI 绘图工作流配置复杂、灵活性不足的痛点。用户无需具备编程背景,也能自由组合模型、调整参数并实时预览效果,轻松实现从基础文生图到多步骤高清修复等各类复杂任务。ComfyUI 拥有极佳的兼容性,不仅支持 Windows、macOS 和 Linux 全平台,还广泛适配 NVIDIA、AMD、Intel 及苹果 Silicon 等多种硬件架构,并率先支持 SDXL、Flux、SD3 等前沿模型。 无论是希望深入探索算法潜力的研究人员和开发者,还是追求极致创作自由度的设计师与资深 AI 绘画爱好者,ComfyUI 都能提供强大的支持。其独特的模块化架构允许社区不断扩展新功能,使其成为当前最灵活、生态最丰富的开源扩散模型工具之一,帮助用户将创意高效转化为现实。

gemini-cli

gemini-cli 是一款由谷歌推出的开源 AI 命令行工具,它将强大的 Gemini 大模型能力直接集成到用户的终端环境中。对于习惯在命令行工作的开发者而言,它提供了一条从输入提示词到获取模型响应的最短路径,无需切换窗口即可享受智能辅助。 这款工具主要解决了开发过程中频繁上下文切换的痛点,让用户能在熟悉的终端界面内直接完成代码理解、生成、调试以及自动化运维任务。无论是查询大型代码库、根据草图生成应用,还是执行复杂的 Git 操作,gemini-cli 都能通过自然语言指令高效处理。 它特别适合广大软件工程师、DevOps 人员及技术研究人员使用。其核心亮点包括支持高达 100 万 token 的超长上下文窗口,具备出色的逻辑推理能力;内置 Google 搜索、文件操作及 Shell 命令执行等实用工具;更独特的是,它支持 MCP(模型上下文协议),允许用户灵活扩展自定义集成,连接如图像生成等外部能力。此外,个人谷歌账号即可享受免费的额度支持,且项目基于 Apache 2.0 协议完全开源,是提升终端工作效率的理想助手。

markitdown

MarkItDown 是一款由微软 AutoGen 团队打造的轻量级 Python 工具,专为将各类文件高效转换为 Markdown 格式而设计。它支持 PDF、Word、Excel、PPT、图片(含 OCR)、音频(含语音转录)、HTML 乃至 YouTube 链接等多种格式的解析,能够精准提取文档中的标题、列表、表格和链接等关键结构信息。 在人工智能应用日益普及的今天,大语言模型(LLM)虽擅长处理文本,却难以直接读取复杂的二进制办公文档。MarkItDown 恰好解决了这一痛点,它将非结构化或半结构化的文件转化为模型“原生理解”且 Token 效率极高的 Markdown 格式,成为连接本地文件与 AI 分析 pipeline 的理想桥梁。此外,它还提供了 MCP(模型上下文协议)服务器,可无缝集成到 Claude Desktop 等 LLM 应用中。 这款工具特别适合开发者、数据科学家及 AI 研究人员使用,尤其是那些需要构建文档检索增强生成(RAG)系统、进行批量文本分析或希望让 AI 助手直接“阅读”本地文件的用户。虽然生成的内容也具备一定可读性,但其核心优势在于为机器