Speech-AI-Forge

Speech-AI-Forge 是一个功能强大的开源语音合成(TTS)集成平台,旨在为用户提供一站式的文本转语音解决方案。它不仅仅是一个单一的模型,而是一个围绕多种主流 TTS 模型构建的生态框架,内置了 API 服务器和基于 Gradio 的友好网页界面,让用户无需编写复杂代码即可轻松体验前沿语音技术。

该项目有效解决了当前语音合成领域模型分散、部署门槛高以及缺乏统一操作界面的痛点。通过整合包、Colab 云端运行或本地容器化部署等多种方式,用户可以在几分钟内搭建起自己的语音生成服务。无论是需要批量处理长文本的内容创作者,还是希望快速验证不同模型效果的开发者,都能从中受益。

Speech-AI-Forge 特别适合 AI 研究者、应用开发者以及对语音技术感兴趣的普通用户。其核心亮点在于广泛的模型兼容性,支持包括 ChatTTS、CosyVoice、F5-TTS、FishSpeech、OpenVoice 等在内的十余种顶尖开源模型,并持续更新。此外,它还提供了丰富的进阶功能,如自定义音色克隆、多风格控制、超长文本自动分割、语速音调调节以及人声增强等,能够满足从基础配音到高质量语音创作的各种需求。

使用场景

某独立游戏开发者正在为一款多角色剧情冒险游戏制作本地化配音,需要快速生成数十种不同性格角色的语音台词。

没有 Speech-AI-Forge 时

- 模型切换繁琐:想尝试 ChatTTS、CosyVoice 或 FishSpeech 等不同效果时,需分别配置多个独立环境,代码冲突频发,调试耗时极长。

- 音色定制门槛高:想让反派角色拥有独特的沙哑嗓音,必须编写复杂的脚本上传参考音频并进行微调,无法实时预览效果。

- 长文本处理易崩溃:输入大段剧情对话时,原有方案常因超出长度限制而报错,需手动切割文本并分段合成,后期拼接工作量大且痕迹明显。

- 音质优化缺失:生成的原始音频音量忽大忽小,缺乏统一的响度均衡和人声增强处理,导致玩家体验割裂。

使用 Speech-AI-Forge 后

- 一站式模型管理:通过 Gradio WebUI 即可在界面下拉框中一键切换包括 Qwen3-TTS、F5TTS 在内的十多种主流模型,无需重复部署环境。

- 零代码音色克隆:直接上传一段反派角色的参考录音,利用“参考音色”功能即时推理出同款声线,并可通过调节器微调音调与语速直至满意。

- 智能长文本分割:开启“长文本推理”功能,系统自动将超长剧情按语义精准切分并批量处理,生成的音频连贯自然,彻底告别手动拼接。

- 内置专业后期处理:勾选“人声增强”与“响度均衡”选项,输出即达到广播级音质,省去了额外使用音频编辑软件进行降噪和标准化的步骤。

Speech-AI-Forge 将复杂的 TTS 工程链路整合为可视化的流畅工作流,让开发者能专注于内容创作而非技术折腾。

运行环境要求

- Windows

- Linux

- 需要 NVIDIA GPU (具体型号和显存取决于所选模型,如 ChatTTS/CosyVoice/FishSpeech 等通常建议 8GB+ 显存

- 支持 CPU 推理但速度较慢)

未说明 (建议 16GB+ 以运行大型 TTS 模型)

快速开始

🍦 Speech-AI-Forge

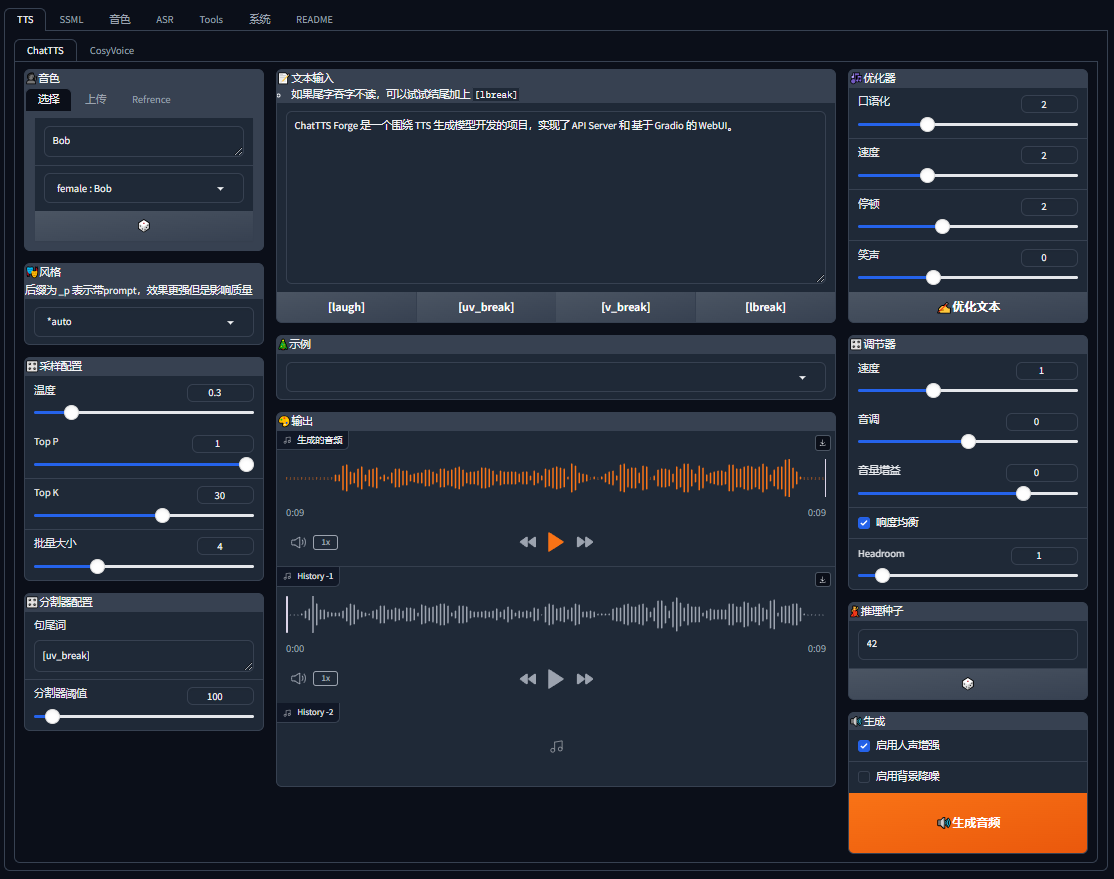

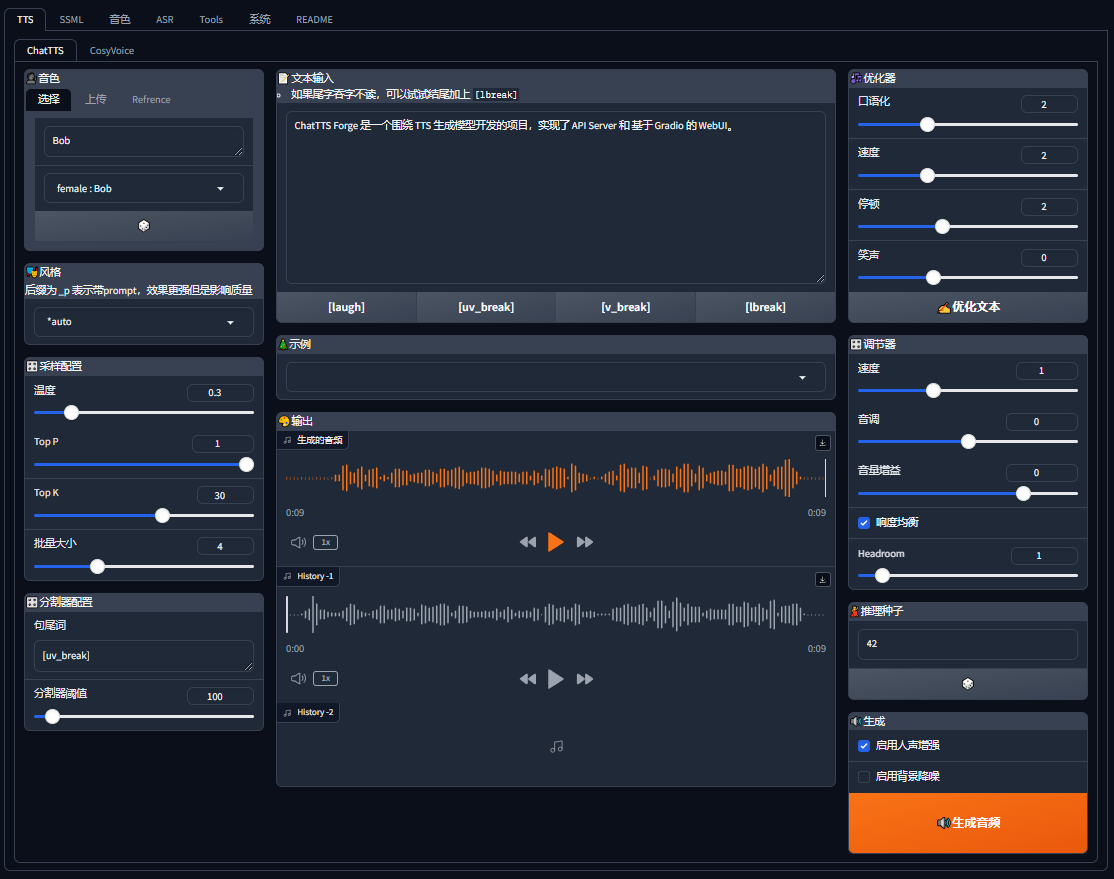

Speech-AI-Forge 是一个围绕 TTS 生成模型开发的项目,实现了 API Server 和 基于 Gradio 的 WebUI。

你可以通过以下几种方式体验和部署 Speech-AI-Forge:

| - | 描述 | 链接 |

|---|---|---|

| 整合包 | Windows整合包解压即用 | Releases |

| Colab体验 | 点击按钮,一键启动 Colab | |

| 本地部署 | 查看环境准备部分 | 本地部署 |

| 容器部署 | 查看 docker 部分 | Docker |

重大变更日志

- 260402: 支持云端TTS(minimax tts)#293

- 260202: 支持 CosyVoice3 #264

- 260129: 支持 Qwen3-TTS #282

- 250912: 支持 Index-TTS-2 #265

- 250702: 支持 Index-TTS-1.5 #250

- 250522: 支持 GptSoVits #198

- 250518: 支持 SenseVoice ASR #122

- 250508: 支持 Spark-TTS #223

- 250507: 支持 F5TTS-TTS-v1 模型 #231

- 250505: 支持 Index-TTS #229

- 241111: 添加

v2/ttsAPI #187 - 241109: 支持 fishspeech #191

- 241015: 支持 F5TTS v0.6.2 #176

- 241009: 支持 FireRedTTS #165

- 240813: 支持 OpenVoice #100

- 240801: 添加 ASR API #92

- 240723: 支持 CosyVoice #90

安装与运行

首先,确保 相关依赖 已经正确安装,并查看 模型下载 下载所需模型

启动:

python webui.py

WebUI 功能

TTS (文本转语音): 提供多种强大的 TTS 功能

- 音色切换 (Speaker Switch): 可选择不同音色

- 内置音色: 提供多个内置音色,包括

27 ChatTTS/7 CosyVoice音色 +1 参考音色 - 自定义音色上传: 支持上传自定义音色文件并进行实时推理

- 参考音色: 支持上传参考音频/文本,直接基于参考音频进行 TTS 推理

- 内置音色: 提供多个内置音色,包括

- 风格控制 (Style): 内置多种风格控制选项,调整语音风格

- 长文本推理 (Long Text): 支持超长文本的推理,自动分割文本

- Batch Size: 支持设置

Batch size,提升支持批量推理模型的长文本推理速度

- Batch Size: 支持设置

- Refiner: 支持

ChatTTS原生文本refiner,支持无限长文本处理 - 分割器设置 (Splitter): 调整分割器配置,控制分割结束符(

eos)和分割阈值 - 调节器 (Adjuster): 支持调整

速度/音调/音量,并增加响度均衡功能,优化音频输出 - 人声增强 (Voice Enhancer): 使用

Enhancer模型增强 TTS 输出,提高语音质量 - 生成历史 (Generation History): 保存最近三次生成结果,便于对比和选择

- 多模型支持 (Multi-model Support): 支持多种 TTS 模型推理,包括

ChatTTS/CosyVoice/FishSpeech/GPT-SoVITS/F5-TTS等

- 音色切换 (Speaker Switch): 可选择不同音色

SSML (语音合成标记语言): 提供高级 TTS 合成控制工具

- 分割器 (Splitter): 精细控制长文本的分割结果

- Podcast: 帮助创建

长文本、多角色的音频,适合博客或剧本式的语音合成 - From Subtitle: 从字幕文件生成 SSML 脚本,方便一键生成语音

- 脚本编辑器 (Script Editor): 新增 SSML 脚本编辑器,支持从分割器(Podcast、来自字幕)导出并编辑 SSML 脚本,进一步优化语音生成效果

音色管理 (Voice Management):

- 音色构建器 (Builder): 创建自定义音色,可从 ChatTTS seed 创建音色,或使用参考音频生成音色

- 试音功能 (Test Voice): 上传音色文件,进行简单的试音和效果评估

- ChatTTS 调试工具: 专门针对

ChatTTS音色的调试工具- 音色抽卡 (Random Seed): 使用随机种子抽取不同的音色,生成独特的语音效果

- 音色融合 (Blend): 融合不同种子创建的音色,获得新的语音效果

- 音色 Hub: 从音色库中选择并下载音色到本地,访问音色仓库 Speech-AI-Forge-spks 获取更多音色资源

ASR (自动语音识别):

- ASR: 使用 Whisper/SenseVoice 等模型进行高质量的语音转文本(ASR)

- Force Aligment: 使用 Whisper 模型可以进行【文稿匹配】提高识别准确性

工具 (Tools):

- 后处理工具 (Post Process): 提供音频剪辑、调整和增强等功能,优化生成的语音质量

launch.py: API Server

某些情况,你并不需要 webui 或者需要更高的 api 吞吐,那么可以使用这个脚本启动单纯的 api 服务。

启动:

python launch.py

启动之后开启 http://localhost:7870/docs 可以查看开启了哪些 api 端点

更多帮助信息:

- 通过

python launch.py -h查看脚本参数 - 查看 API 文档

Docker

手动 build

- webui:

docker-compose -f ./docker-compose.webui.yml up -d - api:

docker-compose -f ./docker-compose.api.yml up -d

环境变量配置

- webui: .env.webui

- api: .env.api

模型支持

| 模型类别 | 模型名称 | 支持多语言 | 实现情况 |

|---|---|---|---|

| TTS | |||

| Index-TTS | en, zh | ✅ (v1/v1.5) | |

| Qwen3-TTS | en, zh | ✅ | |

| FishSpeech | en, zh, jp, ko | ✅ (1.4) | |

| CosyVoice | en, zh, jp, yue, ko | ✅ (v2/v3) | |

| FireRedTTS | en, zh | ✅ | |

| F5-TTS | en, zh | ✅ (v0.6/v1) | |

| Spark-TTS | en, zh | ✅ | |

| GPT-SoVITS | en, zh, ja, ko, yue | ✅ | |

| ChatTTS | en, zh | ✅ | |

| Cloud TTS | |||

| MiniMax Cloud TTS | en, zh, jp, ko + more | ✅ (speech-2.8-hd/turbo) | |

| ASR | |||

| Whisper | ✅ | ✅ | |

| SenseVoice | ✅ | ✅ | |

| Voice Clone | OpenVoice | — | ✅ |

| Enhancer | ResembleEnhance | — | ✅ |

模型下载

python -m scripts.download_models --source=modelscope --models="model1,model2,..."

🔍 说明:

- 支持

--source=huggingface或--source=modelscope或--source=auto(自动根据网络环境选择hf或者ms)- 模型 ID 大小写不敏感,可忽略

-,_,/等符号- 例如:

Qwen3-TTS-12Hz-0.6B-Base可写作qwen3tts12hz06bbase或qwen3-tts-0.6b-base

📌 模型ID列表

| 模型类别 | 内部模型 ID(可直接用于 --models) |

|---|---|

| TTS | ChatTTS |

CosyVoice2-0.5B |

|

CosyVoice_300M_Instruct |

|

Fun-CosyVoice3-0.5B-2512 |

|

F5-TTS-V1 |

|

FireRedTTS |

|

fish-speech-1_4 |

|

fish-speech-1.2-sft |

|

Index-TTS-1.5 |

|

Index-TTS |

|

Index-TTS-2 |

|

Qwen3-TTS-12Hz-0.6B-Base |

|

Qwen3-TTS-12Hz-0.6B-CustomVoice |

|

Qwen3-TTS-12Hz-1.7B-Base |

|

Qwen3-TTS-12Hz-1.7B-CustomVoice |

|

Qwen3-TTS-12Hz-1.7B-VoiceDesign |

|

Spark-TTS-0.5B |

|

gpt_sovits_v4 |

|

| ASR | faster-whisper-large-v3 |

faster-whisper-large-v3-turbo-ct2 |

|

SenseVoiceSmall |

|

| CV / Voice Clone | OpenVoiceV2 |

| Enhancer | resemble-enhance |

| 依赖模型(Index-TTS-2 所需) | amphion/MaskGCT |

nvidia/bigvgan_v2_22khz_80band_256x |

|

funasr/campplus |

|

facebook/w2v-bert-2.0 |

|

vocos-mel-24khz |

|

| (sense_voice依赖) | fsmn-vad |

自动下载

配置环境变量 AUTO_DOWNLOAD 或者运行参数 --auto_download

auto_download=False: 关闭自动下载auto_download=*: 当使用到的时候自动下载匹配的模型"*"表示通配所有模型auto_download=qwen3*: 自动下载"qwen3"开头的模型

FAQ

Documents

Contributing

To contribute, clone the repository, make your changes, commit and push to your clone, and submit a pull request.

format code

isort --profile black

References

ChatTTS: https://github.com/2noise/ChatTTS

PaddleSpeech: https://github.com/PaddlePaddle/PaddleSpeech

resemble-enhance: https://github.com/resemble-ai/resemble-enhance

OpenVoice: https://github.com/myshell-ai/OpenVoice

FishSpeech: https://github.com/fishaudio/fish-speech

SenseVoice: https://github.com/FunAudioLLM/SenseVoice

CosyVoice: https://github.com/FunAudioLLM/CosyVoice

FireRedTTS: https://github.com/FireRedTeam/FireRedTTS

F5-TTS: https://github.com/SWivid/F5-TTS

Index-TTS: https://github.com/index-tts/index-tts

Spark-TTS: https://github.com/SparkAudio/Spark-TTS

GPT-SoVITS: https://github.com/RVC-Boss/GPT-SoVITS

Qwen3-TTS: https://github.com/QwenLM/Qwen3-TTS

Whisper: https://github.com/openai/whisper

ChatTTS 默认说话人: https://github.com/2noise/ChatTTS/issues/238

版本历史

portable_v0.72026/02/02常见问题

相似工具推荐

openclaw

OpenClaw 是一款专为个人打造的本地化 AI 助手,旨在让你在自己的设备上拥有完全可控的智能伙伴。它打破了传统 AI 助手局限于特定网页或应用的束缚,能够直接接入你日常使用的各类通讯渠道,包括微信、WhatsApp、Telegram、Discord、iMessage 等数十种平台。无论你在哪个聊天软件中发送消息,OpenClaw 都能即时响应,甚至支持在 macOS、iOS 和 Android 设备上进行语音交互,并提供实时的画布渲染功能供你操控。 这款工具主要解决了用户对数据隐私、响应速度以及“始终在线”体验的需求。通过将 AI 部署在本地,用户无需依赖云端服务即可享受快速、私密的智能辅助,真正实现了“你的数据,你做主”。其独特的技术亮点在于强大的网关架构,将控制平面与核心助手分离,确保跨平台通信的流畅性与扩展性。 OpenClaw 非常适合希望构建个性化工作流的技术爱好者、开发者,以及注重隐私保护且不愿被单一生态绑定的普通用户。只要具备基础的终端操作能力(支持 macOS、Linux 及 Windows WSL2),即可通过简单的命令行引导完成部署。如果你渴望拥有一个懂你

stable-diffusion-webui

stable-diffusion-webui 是一个基于 Gradio 构建的网页版操作界面,旨在让用户能够轻松地在本地运行和使用强大的 Stable Diffusion 图像生成模型。它解决了原始模型依赖命令行、操作门槛高且功能分散的痛点,将复杂的 AI 绘图流程整合进一个直观易用的图形化平台。 无论是希望快速上手的普通创作者、需要精细控制画面细节的设计师,还是想要深入探索模型潜力的开发者与研究人员,都能从中获益。其核心亮点在于极高的功能丰富度:不仅支持文生图、图生图、局部重绘(Inpainting)和外绘(Outpainting)等基础模式,还独创了注意力机制调整、提示词矩阵、负向提示词以及“高清修复”等高级功能。此外,它内置了 GFPGAN 和 CodeFormer 等人脸修复工具,支持多种神经网络放大算法,并允许用户通过插件系统无限扩展能力。即使是显存有限的设备,stable-diffusion-webui 也提供了相应的优化选项,让高质量的 AI 艺术创作变得触手可及。

everything-claude-code

everything-claude-code 是一套专为 AI 编程助手(如 Claude Code、Codex、Cursor 等)打造的高性能优化系统。它不仅仅是一组配置文件,而是一个经过长期实战打磨的完整框架,旨在解决 AI 代理在实际开发中面临的效率低下、记忆丢失、安全隐患及缺乏持续学习能力等核心痛点。 通过引入技能模块化、直觉增强、记忆持久化机制以及内置的安全扫描功能,everything-claude-code 能显著提升 AI 在复杂任务中的表现,帮助开发者构建更稳定、更智能的生产级 AI 代理。其独特的“研究优先”开发理念和针对 Token 消耗的优化策略,使得模型响应更快、成本更低,同时有效防御潜在的攻击向量。 这套工具特别适合软件开发者、AI 研究人员以及希望深度定制 AI 工作流的技术团队使用。无论您是在构建大型代码库,还是需要 AI 协助进行安全审计与自动化测试,everything-claude-code 都能提供强大的底层支持。作为一个曾荣获 Anthropic 黑客大奖的开源项目,它融合了多语言支持与丰富的实战钩子(hooks),让 AI 真正成长为懂上

ComfyUI

ComfyUI 是一款功能强大且高度模块化的视觉 AI 引擎,专为设计和执行复杂的 Stable Diffusion 图像生成流程而打造。它摒弃了传统的代码编写模式,采用直观的节点式流程图界面,让用户通过连接不同的功能模块即可构建个性化的生成管线。 这一设计巧妙解决了高级 AI 绘图工作流配置复杂、灵活性不足的痛点。用户无需具备编程背景,也能自由组合模型、调整参数并实时预览效果,轻松实现从基础文生图到多步骤高清修复等各类复杂任务。ComfyUI 拥有极佳的兼容性,不仅支持 Windows、macOS 和 Linux 全平台,还广泛适配 NVIDIA、AMD、Intel 及苹果 Silicon 等多种硬件架构,并率先支持 SDXL、Flux、SD3 等前沿模型。 无论是希望深入探索算法潜力的研究人员和开发者,还是追求极致创作自由度的设计师与资深 AI 绘画爱好者,ComfyUI 都能提供强大的支持。其独特的模块化架构允许社区不断扩展新功能,使其成为当前最灵活、生态最丰富的开源扩散模型工具之一,帮助用户将创意高效转化为现实。

gemini-cli

gemini-cli 是一款由谷歌推出的开源 AI 命令行工具,它将强大的 Gemini 大模型能力直接集成到用户的终端环境中。对于习惯在命令行工作的开发者而言,它提供了一条从输入提示词到获取模型响应的最短路径,无需切换窗口即可享受智能辅助。 这款工具主要解决了开发过程中频繁上下文切换的痛点,让用户能在熟悉的终端界面内直接完成代码理解、生成、调试以及自动化运维任务。无论是查询大型代码库、根据草图生成应用,还是执行复杂的 Git 操作,gemini-cli 都能通过自然语言指令高效处理。 它特别适合广大软件工程师、DevOps 人员及技术研究人员使用。其核心亮点包括支持高达 100 万 token 的超长上下文窗口,具备出色的逻辑推理能力;内置 Google 搜索、文件操作及 Shell 命令执行等实用工具;更独特的是,它支持 MCP(模型上下文协议),允许用户灵活扩展自定义集成,连接如图像生成等外部能力。此外,个人谷歌账号即可享受免费的额度支持,且项目基于 Apache 2.0 协议完全开源,是提升终端工作效率的理想助手。

markitdown

MarkItDown 是一款由微软 AutoGen 团队打造的轻量级 Python 工具,专为将各类文件高效转换为 Markdown 格式而设计。它支持 PDF、Word、Excel、PPT、图片(含 OCR)、音频(含语音转录)、HTML 乃至 YouTube 链接等多种格式的解析,能够精准提取文档中的标题、列表、表格和链接等关键结构信息。 在人工智能应用日益普及的今天,大语言模型(LLM)虽擅长处理文本,却难以直接读取复杂的二进制办公文档。MarkItDown 恰好解决了这一痛点,它将非结构化或半结构化的文件转化为模型“原生理解”且 Token 效率极高的 Markdown 格式,成为连接本地文件与 AI 分析 pipeline 的理想桥梁。此外,它还提供了 MCP(模型上下文协议)服务器,可无缝集成到 Claude Desktop 等 LLM 应用中。 这款工具特别适合开发者、数据科学家及 AI 研究人员使用,尤其是那些需要构建文档检索增强生成(RAG)系统、进行批量文本分析或希望让 AI 助手直接“阅读”本地文件的用户。虽然生成的内容也具备一定可读性,但其核心优势在于为机器