Awesome-LLM-RAG

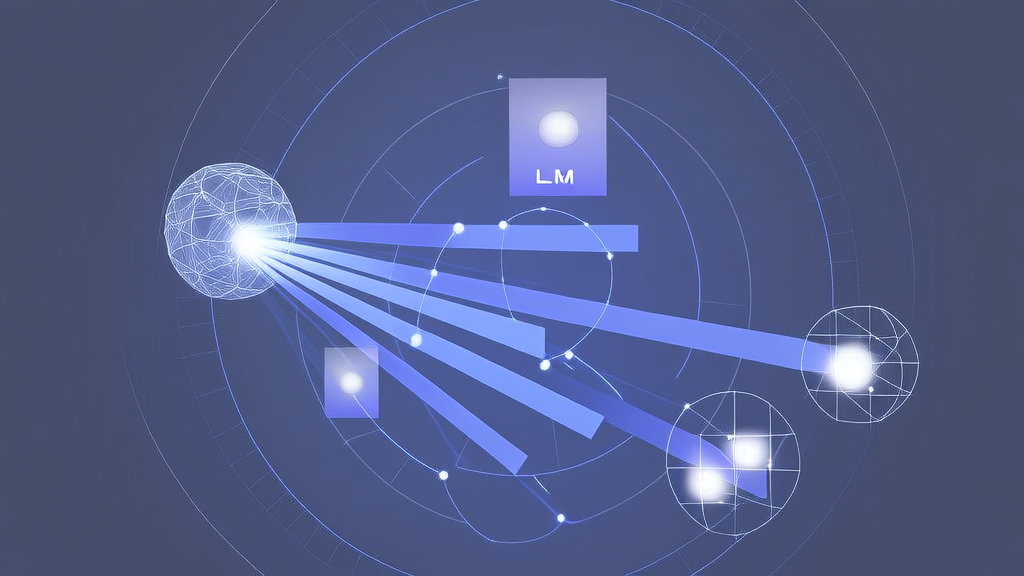

Awesome-LLM-RAG 是一个专注于大语言模型(LLM)检索增强生成(RAG)技术的精选资源库。它旨在解决大模型在面对私有数据、长文本或需要高精度事实回答时,容易产生的“幻觉”和知识滞后问题。通过整合外部检索机制,RAG 技术能让模型的回答更准确、可追溯且与时俱进。

这份清单系统地收录了该领域的前沿学术论文、权威教程、专业书籍以及实用的代码资源。内容覆盖广泛,从基础的综述与基准测试,到检索增强、指令微调、嵌入优化、长文本记忆处理,再到具体的应用案例和评估方法,形成了一个完整的技术生态图谱。其独特亮点在于不仅追踪最新的学术研究,还特别关注工业界的落地实践,并欢迎社区研究者共同更新维护,确保内容的时效性。

Awesome-LLM-RAG 非常适合 AI 研究人员、算法工程师及应用开发者使用。对于希望深入理解 RAG 原理、复现最新算法或构建企业级知识库应用的团队来说,它是一个高效的一站式导航工具,能帮助用户快速定位关键资料,降低技术探索门槛,加速从理论到实践的转化过程。

使用场景

某金融科技公司研发团队正致力于构建一套高精度的内部合规问答系统,需要利用大模型结合企业私有文档进行检索增强生成(RAG)。

没有 Awesome-LLM-RAG 时

- 技术选型迷茫:面对海量且分散的 RAG 论文,团队难以快速甄别哪些是真正经过验证的先进方案,导致在基础架构设计上反复试错。

- 关键模块缺失:在处理长文本记忆和复杂推理场景时,因缺乏针对性的嵌入(Embedding)优化策略和模拟器资源,系统频繁出现“幻觉”或遗漏关键条款。

- 评估标准模糊:缺少权威的基准测试(Benchmark)和评估框架,团队无法量化回答的准确率,只能凭主观感觉调整参数,上线风险极高。

- 学习成本高昂:开发人员需花费数周时间手动搜集教程、书籍和工作坊资料,严重拖慢了从原型验证到产品落地的进度。

使用 Awesome-LLM-RAG 后

- 精准锁定前沿:团队直接通过分类列表找到了"RAG Long-text and Memory"及"RAG Optimization"领域的顶会论文,迅速确立了基于最新算法的技术路线。

- 补齐能力短板:利用库中推荐的专用 RAG 模拟器和高级嵌入模型,成功解决了长文档上下文丢失问题,显著提升了合规条款引用的准确性。

- 建立科学评估:引入收录的标准化评估工具和基准数据集,实现了系统性能的量化监控,确保回答可信度达到金融级要求。

- 加速研发闭环:依托整理好的实战教程、书籍及工作坊资源,团队成员在一周内完成了从理论调研到核心代码实现的跨越。

Awesome-LLM-RAG 将原本分散杂乱的学术资源转化为结构化的工程指南,帮助团队在复杂的 RAG 技术浪潮中快速找到最优解,大幅降低了研发门槛与时间成本。

运行环境要求

未说明

未说明

快速开始

本仓库旨在收录关于大语言模型中检索增强生成(RAG)的前沿论文。

我们强烈鼓励希望推广其在LLM RAG领域杰出工作的研究人员提交拉取请求,以更新相关论文信息!

目录

资源

- guardian-agent-prompts - 49个经过生产环境验证的AI智能体系统提示词,适用于Claude Code多智能体编排及检索增强生成模式。采用MIT许可证。

研讨会与教程

个性化生成式AI

Zheng Chen, Ziyan Jiang, Fan Yang, Zhankui He, Yupeng Hou, Eunah Cho, Julian McAuley, Aram Galstyan, Xiaohua Hu, Jie Yang

CIKM 23 – 2023年10月 [链接]

首届基于生成模型的推荐系统研讨会

Wenjie Wang, Yong Liu, Yang Zhang, Weiwen Liu, Fuli Feng, Xiangnan He, Aixin Sun

CIKM 23 – 2023年10月 [链接]

首届生成式信息检索研讨会

Gabriel Bénédict, Ruqing Zhang, Donald Metzler

SIGIR 23 – 2023年7月 [链接]

基于检索的语言模型及其应用

Akari Asai, Sewon Min, Zexuan Zhong, Danqi Chen

ACL 23 – 2023年7月 [链接]

成为生成式AI开发者 Richie Cotton, Olivier Mertens, Korey Stegared-Pace, James Briggs, Vincent Vankrunkelsven, Alara Dirik, Jacob Marquez, Priyanka Asnani DataCamp [链接]

书籍

从零构建大型语言模型

Sebastian Raschka

Manning Publications - 2024年9月 [链接]

从零构建推理模型

Sebastian Raschka

Manning Publications - 2025年8月 [链接]

检索增强生成:奠基性论文集

Ben Auffarth

Manning Publications - 2026年3月 [链接]

检索增强生成简易指南

Abhinav Kimothi

Manning Publications - 2025年6月 [链接]

从零构建高级RAG应用

Hamza Farooq

Manning Publications - 2024年10月 [链接]

企业级RAG

Tyler Suard 和 Darshil Modi

Manning Publications - 2025年3月 [链接]

图RAG基础

"Tomaž Bratanič 和 Oskar Hane"

Manning Publications - 2025年7月 [链接]

论文

综述与基准测试

检索增强生成中的大型语言模型基准测试

Jiawei Chen, Hongyu Lin, Xianpei Han, Le Sun

arXiv 2023. [论文][GitHub]

2023年9月4日

检索增强型大语言模型

通过自我推理提升检索增强语言模型

夏源、周景博、史振辉、陈军、黄海峰 \

AAAI 25 – 2025年3月 [论文]

无需自我知识的自适应检索?让不确定性回归

维克托·莫斯科韦列茨基、玛丽亚·利修克、米哈伊尔·萨尔尼科夫、尼古拉·伊万诺夫、谢尔盖·普列特涅夫、达里娅·加林齐亚诺娃、尼基塔·克拉伊科、瓦西里·科诺瓦洛夫、伊琳娜·尼基希娜、亚历山大·潘琴科

arXiv – 2025年1月 [论文

DFA-RAG:基于确定有限自动机的大语言模型对话式语义路由

孙益友、胡俊杰、程伟、陈海峰

ICML 24 – 2024年2月 [论文]

笔记链:增强检索增强语言模型的鲁棒性

于文浩、张洪明、潘晓曼、马凯欣、王宏伟、于东

arXiv - 2023年11月 [论文]

REST:基于检索的推测解码

何振宇、钟泽轩、蔡天乐、Jason D Lee、何迪

arXiv - 2023年11月 [论文][GitHub]

Self-RAG:通过自我反思学习检索、生成和批判

匿名

ICLR 24 – 2023年10月 [论文]

自我知识引导的大型语言模型检索增强

王一乐、李鹏、孙茂松、刘洋

arXiv - 2023年10月 [论文]

检索遇见长上下文大语言模型

徐鹏、魏平、吴宪超、劳伦斯·麦卡菲、朱晨、刘子涵、桑迪普·苏布拉马尼安、埃韦丽娜·巴赫图里娜、穆罕默德·绍伊比、布莱恩·卡坦扎罗

arXiv - 2023年10月 [论文]

DSPy:将声明式语言模型调用编译为自我改进的流水线

奥马尔·哈塔卜、阿尔纳夫·辛格维、帕里迪·马赫什瓦里、张志远、凯沙夫·桑塔南、斯里·瓦尔达马南、赛富尔·哈克、阿舒托什·夏尔马、托马斯·T·乔希、汉娜·莫阿扎姆、希瑟·米勒、马泰伊·扎哈里亚、克里斯托弗·波茨

arXiv – 2023年10月 [论文] [代码]

适应性变色龙还是顽固的树懒:揭示大型语言模型在知识冲突中的行为

谢健、张凯、陈江杰、楼仁泽、苏宇

ICLR 24 – 2023年5月 [论文] [代码]

主动检索增强生成

江正宝、Frank F. Xu、高璐宇、孙志清、刘倩、简·德维迪-余、杨一鸣、杰米·卡兰、格雷厄姆·诺伊比格

arXiv – 2023年5月 [论文] [代码]

REPLUG:检索增强的黑盒语言模型

石伟嘉、闵世元、安永道广、徐敏俊、里奇·詹姆斯、迈克·刘易斯、卢克·泽特勒莫耶、叶问涛

arXiv – 2023年1月 [论文]

面向知识密集型NLP任务的检索增强生成 帕特里克·刘易斯、伊森·佩雷斯、亚历山德拉·皮克图斯、法比奥·佩特罗尼、弗拉基米尔·卡尔普金、纳曼·戈亚尔、海因里希·库特勒、迈克·刘易斯、叶问涛、蒂姆·罗克塔谢尔、塞巴斯蒂安·里德尔、杜威·基拉 NeurIPS 2020 - 2020年5月 [论文]

RAG指令微调

RA-DIT:检索增强双指令微调

匿名

ICLR 24 – 2023年10月 [论文]

InstructRetro:检索增强预训练后的指令微调

王博鑫、魏平、劳伦斯·麦卡菲、徐鹏、李博、穆罕默德·绍伊比、布莱恩·卡坦扎罗

arXiv - 2023年10月 [论文]

RAG上下文学习

上下文检索增强语言模型

奥里·拉姆、约阿夫·莱文、伊泰·达尔梅迪戈斯、多尔·穆赫盖、阿姆农·沙舒亚、凯文·莱顿-布朗、约阿夫·肖哈姆

AI21 Labs – 2023年1月 [论文][代码]

RAG嵌入

RegaVAE:用于语言建模的检索增强高斯混合变分自编码器

邓靖成、庞亮、沈华伟、程雪琪

EMNLP 2023 - 2023年10月 [论文][GitHub]

文本嵌入揭示的信息几乎与文本本身一样多

约翰·X·莫里斯、沃洛迪米尔·库列绍夫、维塔利·施马蒂科夫、亚历山大·M·拉什

EMNLP 2023 - 2023年10月 [论文][GitHub]

Jina Embeddings 2:适用于长文档的8192个标记通用文本嵌入

迈克尔·京特、张杰民、伊莎贝尔·莫尔、阿拉丁·阿卜德萨莱姆、唐吉·阿贝尔、穆罕默德·卡利姆·阿克拉姆、苏珊娜·古兹曼、乔治奥斯·马斯特拉斯、萨巴·斯图鲁阿、王博、马克西米利安·韦尔克、王楠、肖汉

arXiv - 2023年10月。[论文][模型]

RAG模拟器

KAUCUS:用于训练语言模型助手的知识增强用户模拟器

考斯图布·D·多勒

聊天对话智能模拟,EACL 2024 [论文]

RAG搜索

RAG 长文本与记忆

ComoRAG:一种受认知启发、基于记忆组织的 RAG,用于有状态的长篇叙事推理 \

王聚源、赵荣晨、魏伟、王宇峰、余墨、周杰、徐进、徐丽燕 \

AAAI 2026 - 2025年8月 [论文] [GitHub]

- Cortex - 面向代码助手的持久化 AI 记忆。自动捕获决策、模式和上下文。提供 VSCode 插件、命令行工具及 MCP 服务器。免费。

- Agent Brain - 适用于 AI 代理的七层认知记忆系统,具备感知门控、梦境循环和预测能力。基于 FastAPI 和 PostgreSQL/pgvector 构建,可自行部署。

HippoRAG:受神经生物学启发的大语言模型长期记忆

贝尔纳尔·希门尼斯·古铁雷斯、舒一恒、顾宇、米奇hiro·安永、苏宇

arXiv - 2024年5月 [论文] [GitHub]

理解面向长文档问答的检索增强技术

陈鸿廷、许芳远、谢恩·A·阿罗拉、崔恩瑟

arXiv - 2023年10月 [论文]

RAG 评估

ARES:检索增强生成系统的自动化评估框架

乔恩·萨德-法尔孔、奥马尔·哈塔卜、克里斯托弗·波茨、马泰伊·扎哈里亚

arXiv - 2023年11月。[论文] [GitHub]

评估与对齐:奠基性论文集

韩忠李

曼宁出版社 - 2026年3月。[书籍]

RAG 优化

学习如何过滤上下文以用于检索增强生成

王志若、荒木淳、蒋正宝、穆罕默德·里兹万·帕尔韦兹、格雷厄姆·诺伊比格

arXiv - 2023年11月 [论文][GitHub]

大语言模型极易被无关上下文干扰

史芙蕾达、陈欣云、米斯拉·卡尼什卡、内森·斯凯尔斯、大卫·多汉、埃德·奇、纳撒尼尔·舍尔利、周登尼

ICML 2023 - 2023年1月 [论文][GitHub]

证据导向生成在知识密集型 NLP 任务中的应用

浅井明里、马特·加德纳、汉娜内·哈吉希尔齐

NAACL 2022 - 2021年12月 [论文][GitHub]

何时不应信任语言模型:探究参数化与非参数化记忆的有效性

亚历克斯·马伦、浅井明里、维克多·钟、拉贾尔希·达斯、丹尼尔·卡沙比、汉娜内·哈吉希尔齐

ACL 2023 - 2022年12月 [论文][GitHub]

RAG 应用

大语言模型在金融领域的不足:幻觉现象的实证研究

康浩强、刘晓阳

arXiv - 2023年11月 [论文]

Clinfo.ai:一个开源的检索增强型大语言模型系统,用于基于科学文献回答医学问题

亚历杭德罗·洛萨诺、斯科特·L·弗莱明、江家纯、尼甘·沙赫

arXiv - 2023年10月。[论文]

PEARL:利用生成校准型检索器个性化大语言模型写作助手

谢舍拉·迈索尔、陆卓然、万梦婷、杨龙琪、史蒂夫·梅内塞斯、蒂娜·巴盖、埃马努埃尔·巴拉哈斯·冈萨雷斯、珍妮弗·内维尔、塔拉·萨法维

arXiv - 2023年11月。[论文]

相似工具推荐

openclaw

OpenClaw 是一款专为个人打造的本地化 AI 助手,旨在让你在自己的设备上拥有完全可控的智能伙伴。它打破了传统 AI 助手局限于特定网页或应用的束缚,能够直接接入你日常使用的各类通讯渠道,包括微信、WhatsApp、Telegram、Discord、iMessage 等数十种平台。无论你在哪个聊天软件中发送消息,OpenClaw 都能即时响应,甚至支持在 macOS、iOS 和 Android 设备上进行语音交互,并提供实时的画布渲染功能供你操控。 这款工具主要解决了用户对数据隐私、响应速度以及“始终在线”体验的需求。通过将 AI 部署在本地,用户无需依赖云端服务即可享受快速、私密的智能辅助,真正实现了“你的数据,你做主”。其独特的技术亮点在于强大的网关架构,将控制平面与核心助手分离,确保跨平台通信的流畅性与扩展性。 OpenClaw 非常适合希望构建个性化工作流的技术爱好者、开发者,以及注重隐私保护且不愿被单一生态绑定的普通用户。只要具备基础的终端操作能力(支持 macOS、Linux 及 Windows WSL2),即可通过简单的命令行引导完成部署。如果你渴望拥有一个懂你

stable-diffusion-webui

stable-diffusion-webui 是一个基于 Gradio 构建的网页版操作界面,旨在让用户能够轻松地在本地运行和使用强大的 Stable Diffusion 图像生成模型。它解决了原始模型依赖命令行、操作门槛高且功能分散的痛点,将复杂的 AI 绘图流程整合进一个直观易用的图形化平台。 无论是希望快速上手的普通创作者、需要精细控制画面细节的设计师,还是想要深入探索模型潜力的开发者与研究人员,都能从中获益。其核心亮点在于极高的功能丰富度:不仅支持文生图、图生图、局部重绘(Inpainting)和外绘(Outpainting)等基础模式,还独创了注意力机制调整、提示词矩阵、负向提示词以及“高清修复”等高级功能。此外,它内置了 GFPGAN 和 CodeFormer 等人脸修复工具,支持多种神经网络放大算法,并允许用户通过插件系统无限扩展能力。即使是显存有限的设备,stable-diffusion-webui 也提供了相应的优化选项,让高质量的 AI 艺术创作变得触手可及。

everything-claude-code

everything-claude-code 是一套专为 AI 编程助手(如 Claude Code、Codex、Cursor 等)打造的高性能优化系统。它不仅仅是一组配置文件,而是一个经过长期实战打磨的完整框架,旨在解决 AI 代理在实际开发中面临的效率低下、记忆丢失、安全隐患及缺乏持续学习能力等核心痛点。 通过引入技能模块化、直觉增强、记忆持久化机制以及内置的安全扫描功能,everything-claude-code 能显著提升 AI 在复杂任务中的表现,帮助开发者构建更稳定、更智能的生产级 AI 代理。其独特的“研究优先”开发理念和针对 Token 消耗的优化策略,使得模型响应更快、成本更低,同时有效防御潜在的攻击向量。 这套工具特别适合软件开发者、AI 研究人员以及希望深度定制 AI 工作流的技术团队使用。无论您是在构建大型代码库,还是需要 AI 协助进行安全审计与自动化测试,everything-claude-code 都能提供强大的底层支持。作为一个曾荣获 Anthropic 黑客大奖的开源项目,它融合了多语言支持与丰富的实战钩子(hooks),让 AI 真正成长为懂上

ComfyUI

ComfyUI 是一款功能强大且高度模块化的视觉 AI 引擎,专为设计和执行复杂的 Stable Diffusion 图像生成流程而打造。它摒弃了传统的代码编写模式,采用直观的节点式流程图界面,让用户通过连接不同的功能模块即可构建个性化的生成管线。 这一设计巧妙解决了高级 AI 绘图工作流配置复杂、灵活性不足的痛点。用户无需具备编程背景,也能自由组合模型、调整参数并实时预览效果,轻松实现从基础文生图到多步骤高清修复等各类复杂任务。ComfyUI 拥有极佳的兼容性,不仅支持 Windows、macOS 和 Linux 全平台,还广泛适配 NVIDIA、AMD、Intel 及苹果 Silicon 等多种硬件架构,并率先支持 SDXL、Flux、SD3 等前沿模型。 无论是希望深入探索算法潜力的研究人员和开发者,还是追求极致创作自由度的设计师与资深 AI 绘画爱好者,ComfyUI 都能提供强大的支持。其独特的模块化架构允许社区不断扩展新功能,使其成为当前最灵活、生态最丰富的开源扩散模型工具之一,帮助用户将创意高效转化为现实。

gemini-cli

gemini-cli 是一款由谷歌推出的开源 AI 命令行工具,它将强大的 Gemini 大模型能力直接集成到用户的终端环境中。对于习惯在命令行工作的开发者而言,它提供了一条从输入提示词到获取模型响应的最短路径,无需切换窗口即可享受智能辅助。 这款工具主要解决了开发过程中频繁上下文切换的痛点,让用户能在熟悉的终端界面内直接完成代码理解、生成、调试以及自动化运维任务。无论是查询大型代码库、根据草图生成应用,还是执行复杂的 Git 操作,gemini-cli 都能通过自然语言指令高效处理。 它特别适合广大软件工程师、DevOps 人员及技术研究人员使用。其核心亮点包括支持高达 100 万 token 的超长上下文窗口,具备出色的逻辑推理能力;内置 Google 搜索、文件操作及 Shell 命令执行等实用工具;更独特的是,它支持 MCP(模型上下文协议),允许用户灵活扩展自定义集成,连接如图像生成等外部能力。此外,个人谷歌账号即可享受免费的额度支持,且项目基于 Apache 2.0 协议完全开源,是提升终端工作效率的理想助手。

markitdown

MarkItDown 是一款由微软 AutoGen 团队打造的轻量级 Python 工具,专为将各类文件高效转换为 Markdown 格式而设计。它支持 PDF、Word、Excel、PPT、图片(含 OCR)、音频(含语音转录)、HTML 乃至 YouTube 链接等多种格式的解析,能够精准提取文档中的标题、列表、表格和链接等关键结构信息。 在人工智能应用日益普及的今天,大语言模型(LLM)虽擅长处理文本,却难以直接读取复杂的二进制办公文档。MarkItDown 恰好解决了这一痛点,它将非结构化或半结构化的文件转化为模型“原生理解”且 Token 效率极高的 Markdown 格式,成为连接本地文件与 AI 分析 pipeline 的理想桥梁。此外,它还提供了 MCP(模型上下文协议)服务器,可无缝集成到 Claude Desktop 等 LLM 应用中。 这款工具特别适合开发者、数据科学家及 AI 研究人员使用,尤其是那些需要构建文档检索增强生成(RAG)系统、进行批量文本分析或希望让 AI 助手直接“阅读”本地文件的用户。虽然生成的内容也具备一定可读性,但其核心优势在于为机器