vggt

VGGT(Visual Geometry Grounded Transformer)是一款荣获 CVPR 2025 最佳论文奖的开源人工智能模型,由牛津大学视觉几何组与 Meta AI 联合研发。它本质上是一个前馈神经网络,能够直接从单张、少量甚至数百张场景图像中,在数秒内直接推断出完整的 3D 几何属性。

传统方法重建 3D 场景往往依赖繁琐的迭代优化或复杂的流水线,而 VGGT 解决了这一效率瓶颈。它能一次性输出相机的内外参数、深度图、点云图以及 3D 点轨迹,将原本耗时的过程压缩至瞬间完成,且支持导出为 COLMAP 格式,便于与 3D 高斯溅射(Gaussian Splatting)等主流技术无缝衔接。

该工具特别适合计算机视觉研究人员、3D 开发者以及需要快速构建场景几何信息的工程师使用。其核心技术亮点在于“视觉几何接地”的 Transformer 架构,打破了以往模型难以统一处理多变视角数量的限制。值得一提的是,项目方已更新许可协议,推出了支持商业应用(非军事用途)的专用检查点,并开放了训练代码,允许用户在自定义数据集上进行微调,极大地降低了高质量 3D 重建的技术门槛。

使用场景

某文化遗产保护团队正利用无人机对一座古庙进行数字化重建,需要从数百张航拍照片中快速恢复高精度的 3D 模型。

没有 vggt 时

- 流程繁琐耗时:必须依赖 COLMAP 等传统多视图几何管线,特征匹配与束调整(Bundle Adjustment)往往需要数小时甚至数天才能完成。

- 稀疏数据失效:当无人机拍摄角度重叠度低或纹理缺失时,传统算法极易失败,无法计算出相机位姿,导致重建中断。

- 参数分离复杂:相机内参、外参、深度图和点云需分步估算,各环节误差累积严重,最终模型常出现分层或扭曲。

- 人工干预频繁:工程师需手动筛选图片、调整参数阈值并修复错误匹配,极大增加了技术门槛和时间成本。

使用 vggt 后

- 秒级端到端推理:vggt 作为前馈神经网络,能在几秒钟内直接从单张或多张图片中一次性输出所有关键 3D 属性,无需迭代优化。

- 强鲁棒性处理:即使面对视角差异大或纹理稀少的“困难”照片,vggt 仍能凭借视觉几何 grounding 能力精准预测相机位姿和深度。

- 统一属性输出:同时生成高精度的相机内外参、点图、深度图及 3D 点轨迹,数据一致性高,直接兼容 gsplat 等渲染引擎。

- 自动化工作流:支持一键导出 COLMAP 格式文件,彻底免去人工调参和中间步骤修复,让非专家也能轻松完成高质量重建。

vggt 将原本需要数天的复杂 3D 重建流程压缩至秒级,以端到端的智能推理彻底打破了传统几何管线的效率瓶颈。

运行环境要求

- 未说明

- 需要 NVIDIA GPU (代码中检查 torch.cuda.is_available)

- bfloat16 精度需要 Ampere 架构及以上 (算力 8.0+, 如 A100, H100),否则使用 float16

- 显存需求取决于输入图像数量,基准测试基于 NVIDIA H100 进行,未明确最低显存要求,但处理多视图 3D 重建通常建议大显存

未说明

快速开始

VGGT:视觉几何基础Transformer

Jianyuan Wang、Minghao Chen、Nikita Karaev、Andrea Vedaldi、Christian Rupprecht、David Novotny

@inproceedings{wang2025vggt,

title={VGGT: Visual Geometry Grounded Transformer},

author={Wang, Jianyuan and Chen, Minghao and Karaev, Nikita and Vedaldi, Andrea and Rupprecht, Christian and Novotny, David},

booktitle={Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition},

year={2025}

}

更新

[2025年7月29日] 我们已将VGGT的许可证更新为允许商业使用(军事应用除外)。本仓库中的所有代码现均采用对商业友好的许可证。然而,仅新发布的检查点VGGT-1B-Commercial获准用于商业用途——原始检查点仍为非商业用途。完整许可详情请见此处。访问该检查点需填写申请表,系统会以类似于LLaMA审批流程的方式自动处理。新检查点的性能与原模型相近。如您发现显著性能差异,请提交问题。

[2025年7月6日] 训练代码现已在

training文件夹中提供,包含一个在自定义数据集上微调VGGT的示例。[2025年6月13日] 荣幸荣获CVPR 2025最佳论文奖!近期回复咨询或GitHub问题可能较慢,敬请谅解。若您感兴趣,我们的口头报告可在此查看链接。另一份较长的演示文稿可在这里找到(注:以.pptx格式分享,包含动画效果——文件较大,但如有需要,可作为模板使用)。

[2025年6月2日] 新增了一个脚本,用于运行VGGT并将预测结果保存为COLMAP格式,可选支持束调整。保存的COLMAP文件可直接与gsplat或其他NeRF/高斯泼溅库配合使用。

[2025年5月3日] 用于在Co3D数据集上复现我们相机位姿估计结果的评估代码现已在evaluation分支中提供。

概述

视觉几何基础Transformer(VGGT,CVPR 2025)是一种前馈神经网络,能够直接从一张、几张或数百张图像中,在几秒钟内推断出场景的所有关键3D属性,包括相机外参和内参、点云图、深度图以及3D点轨迹。

快速入门

首先,将此仓库克隆到本地,并安装依赖项(torch、torchvision、numpy、Pillow和huggingface_hub)。

git clone git@github.com:facebookresearch/vggt.git

cd vggt

pip install -r requirements.txt

或者,您也可以将VGGT作为软件包进行安装(点击此处了解详情)。

现在,只需几行代码即可尝试该模型:

import torch

from vggt.models.vggt import VGGT

from vggt.utils.load_fn import load_and_preprocess_images

device = "cuda" if torch.cuda.is_available() else "cpu"

# bfloat16在Ampere架构GPU(计算能力8.0及以上)上受支持

dtype = torch.bfloat16 if torch.cuda.get_device_capability()[0] >= 8 else torch.float16

# 初始化模型并加载预训练权重。

# 首次运行时会自动下载模型权重,可能需要一些时间。

model = VGGT.from_pretrained("facebook/VGGT-1B").to(device)

# 加载并预处理示例图像(请替换为您自己的图像路径)

image_names = ["path/to/imageA.png", "path/to/imageB.png", "path/to/imageC.png"]

images = load_and_preprocess_images(image_names).to(device)

with torch.no_grad():

with torch.cuda.amp.autocast(dtype=dtype):

# 预测包括相机参数、深度图和点云图在内的各项属性。

predictions = model(images)

模型权重将自动从Hugging Face下载。若遇到加载缓慢等问题,您可以手动从这里下载并加载,或执行以下操作:

model = VGGT()

_URL = "https://huggingface.co/facebook/VGGT-1B/resolve/main/model.pt"

model.load_state_dict(torch.hub.load_state_dict_from_url(_URL))

详细用法

点击展开

你还可以选择性地指定要预测的属性(分支),如下所示。这与上面的示例效果相同。此示例使用批大小为 1(处理单个场景),但自然也适用于多个场景。

from vggt.utils.pose_enc import pose_encoding_to_extri_intri

from vggt.utils.geometry import unproject_depth_map_to_point_map

with torch.no_grad():

with torch.cuda.amp.autocast(dtype=dtype):

images = images[None] # 添加批次维度

aggregated_tokens_list, ps_idx = model.aggregator(images)

# 预测相机参数

pose_enc = model.camera_head(aggregated_tokens_list)[-1]

# 外参和内参矩阵,遵循 OpenCV 规范(从世界坐标系到相机坐标系)

extrinsic, intrinsic = pose_encoding_to_extri_intri(pose_enc, images.shape[-2:])

# 预测深度图

depth_map, depth_conf = model.depth_head(aggregated_tokens_list, images, ps_idx)

# 预测点云

point_map, point_conf = model.point_head(aggregated_tokens_list, images, ps_idx)

# 从深度图和相机参数构建 3D 点云

# 通常比点云分支生成的点云更精确

point_map_by_unprojection = unproject_depth_map_to_point_map(depth_map.squeeze(0),

extrinsic.squeeze(0),

intrinsic.squeeze(0))

# 预测轨迹

# 选择你要跟踪的点,形状为 (N, 2) 表示一个场景中的 N 个点

query_points = torch.FloatTensor([[100.0, 200.0],

[60.72, 259.94]]).to(device)

track_list, vis_score, conf_score = model.track_head(aggregated_tokens_list, images, ps_idx, query_points=query_points[None])

此外,如果输入帧中的某些像素不需要参与重建(例如反光表面、天空或水面),你可以简单地将这些像素的值设置为 0 或 1 来屏蔽它们。不需要精确的分割掩码——简单的边界框掩码同样有效(请参阅此 issue 中的示例)。

交互式演示

我们提供了多种方式来可视化你的 3D 重建结果。在使用这些可视化工具之前,请先安装所需的依赖项:

pip install -r requirements_demo.txt

交互式 3D 可视化

请注意: VGGT 通常可以在不到 1 秒钟内完成一个场景的重建。然而,由于第三方渲染的原因,3D 点云的可视化可能需要数十秒,这与 VGGT 的处理时间无关。当图像数量较多时,可视化过程会更加缓慢。

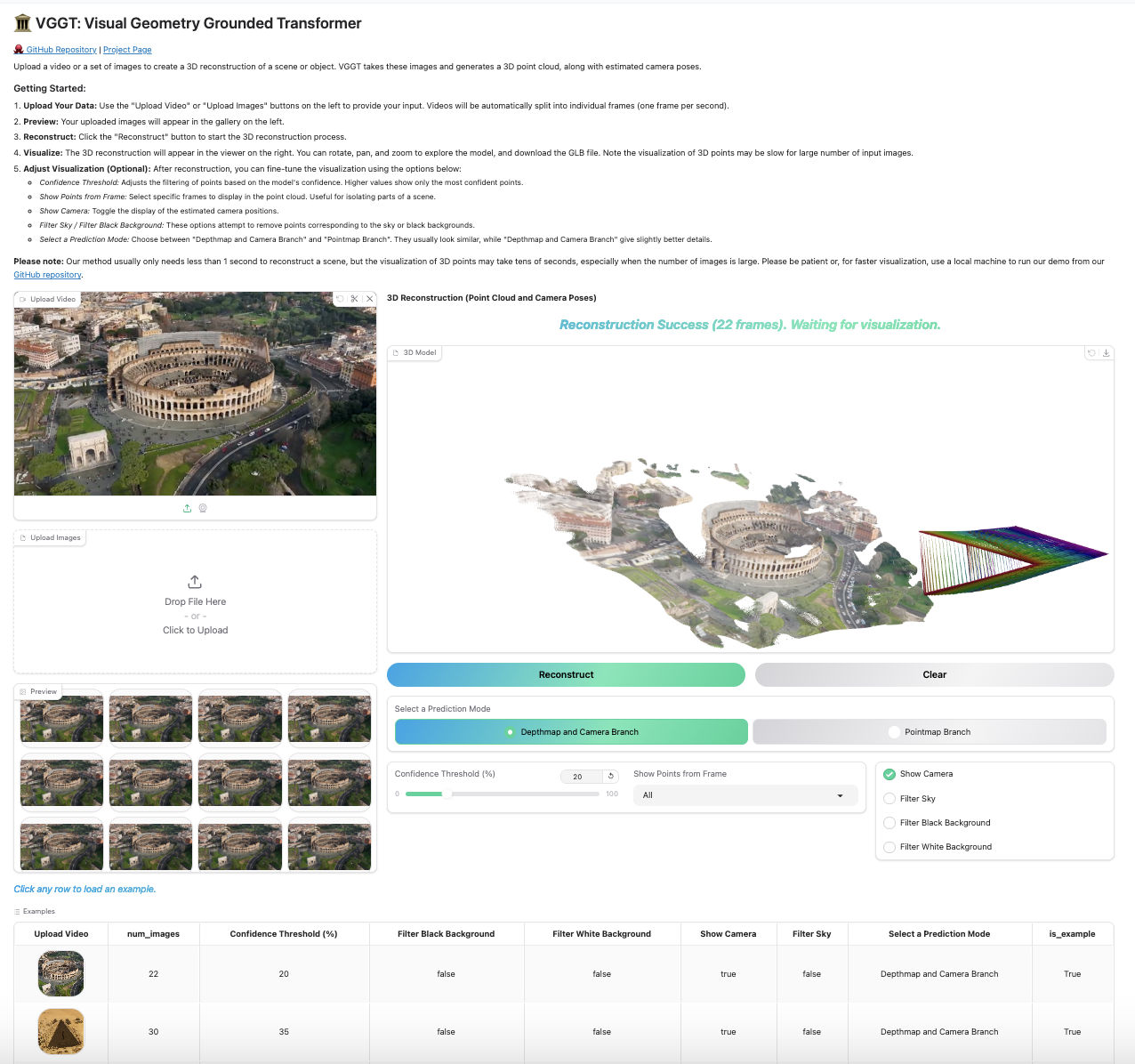

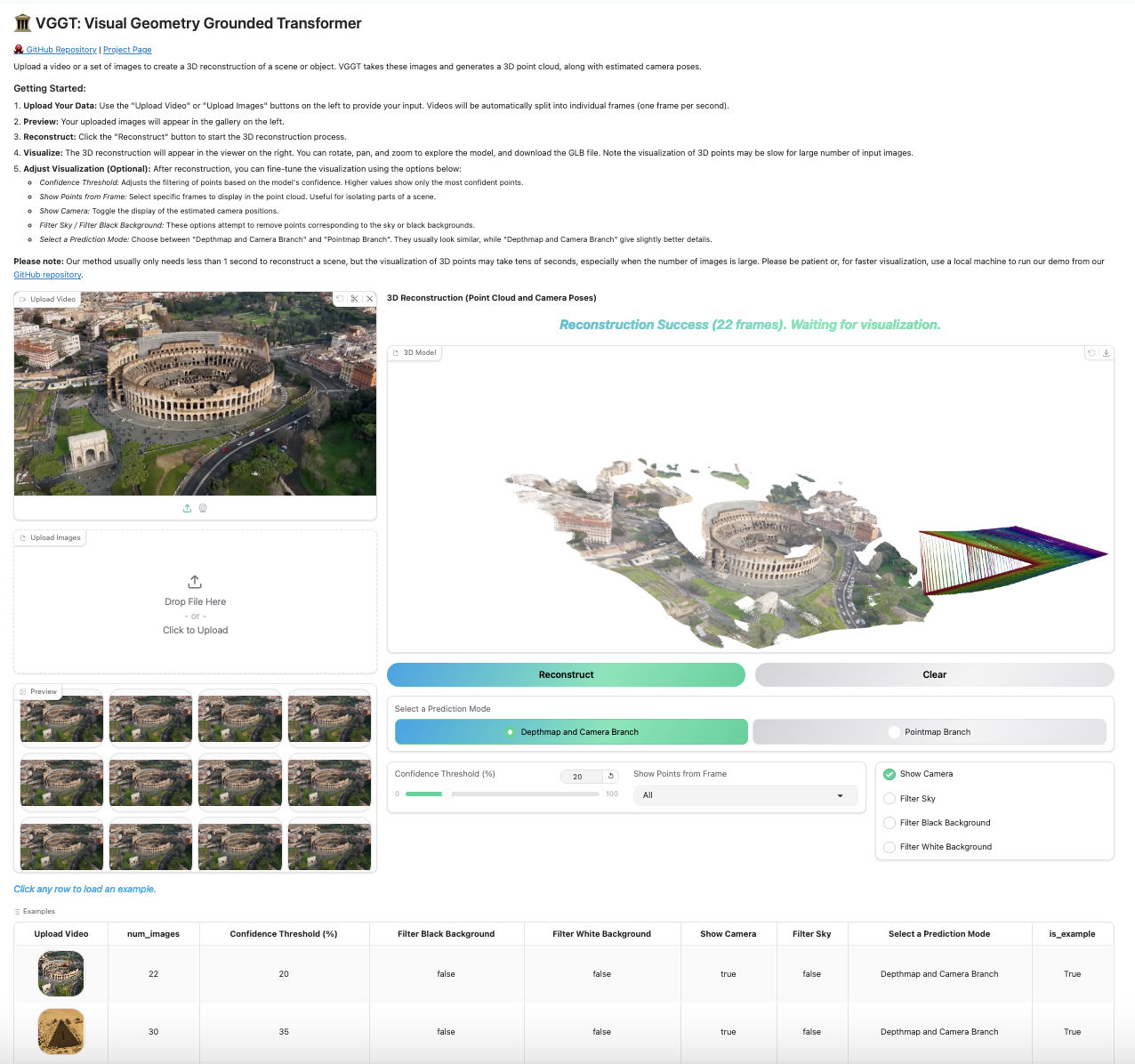

Gradio Web 界面

我们的基于 Gradio 的界面允许你上传图像或视频,运行重建,并在浏览器中交互式地探索 3D 场景。你可以在本地机器上启动该界面,也可以在 Hugging Face 上试用。

python demo_gradio.py

点击预览 Gradio 交互式界面

Viser 3D 查看器

运行以下命令可以执行重建并在 Viser 中可视化点云。请注意,此脚本需要一个包含图像的文件夹路径,并且假设该文件夹下仅包含图像文件。你可以通过设置 --use_point_map 参数来使用点云分支生成的点云,而不是基于深度图的点云。

python demo_viser.py --image_folder path/to/your/images/folder

导出为 COLMAP 格式

我们还支持将 VGGT 的预测结果直接导出为 COLMAP 格式,方法如下:

# 仅前向预测

python demo_colmap.py --scene_dir=/YOUR/SCENE_DIR/

# 带束调整

python demo_colmap.py --scene_dir=/YOUR/SCENE_DIR/ --use_ba

# 使用减少的参数运行带束调整以加快处理速度

# 将 max_query_pts 从默认的 4096 减少到 2048,将 query_frame_num 从默认的 8 减少到 5

# 代价是更快的执行速度,但在复杂场景中重建结果可能不够鲁棒(你可以考虑将 query_frame_num 设置为图像总数)

# 更多带束调整配置选项请参见 demo_colmap.py

python demo_colmap.py --scene_dir=/YOUR/SCENE_DIR/ --use_ba --max_query_pts=2048 --query_frame_num=5

请确保图像存储在 /YOUR/SCENE_DIR/images/ 目录下,该目录应仅包含图像文件。可参考 examples 文件夹中的数据结构示例。

重建结果(相机参数和 3D 点云)将自动保存到 /YOUR/SCENE_DIR/sparse/ 目录下,格式符合 COLMAP 标准,如下所示:

SCENE_DIR/

├── images/

└── sparse/

├── cameras.bin

├── images.bin

└── points3D.bin

与 Gaussian Splatting 集成

导出的 COLMAP 文件可以直接用于 gsplat 进行 Gaussian Splatting 训练。按照其官方说明安装 gsplat(推荐使用 gsplat==1.3.0):

训练模型的示例命令如下:

cd gsplat

python examples/simple_trainer.py default --data_factor 1 --data_dir /YOUR/SCENE_DIR/ --result_dir /YOUR/RESULT_DIR/

零样本单视角重建

尽管我们的模型从未针对单视角任务进行过训练,但它在单视角重建方面表现出令人惊讶的好性能。该模型无需将单张图像复制成一对,而是可以直接从单张图像的特征中推断出 3D 结构。你可以通过上述演示尝试这一功能,它同样适用于单视角重建。

我们并未对单目深度估计性能进行定量测试,但 @kabouzeid 慷慨地提供了 VGGT 与近期方法的对比结果 此处。结果显示,VGGT 在与 DepthAnything v2 或 MoGe 等最先进的单目方法相比时,表现具有竞争力甚至更优,尽管它从未专门针对单视角任务进行过训练。

运行时间和 GPU 内存

我们在单块 NVIDIA H100 GPU 上对 VGGT 的聚合器模块进行了不同输入规模下的运行时间和 GPU 内存占用基准测试。

| 输入帧数 | 1 | 2 | 4 | 8 | 10 | 20 | 50 | 100 | 200 |

|---|---|---|---|---|---|---|---|---|---|

| 时间 (s) | 0.04 | 0.05 | 0.07 | 0.11 | 0.14 | 0.31 | 1.04 | 3.12 | 8.75 |

| 内存 (GB) | 1.88 | 2.07 | 2.45 | 3.23 | 3.63 | 5.58 | 11.41 | 21.15 | 40.63 |

请注意,这些结果是在使用 Flash Attention 3 的情况下获得的,它比默认的 Flash Attention 2 实现更快,同时几乎保持相同的内存占用。你可以自行编译 Flash Attention 3 以获得更好的性能。

研究进展

我们的工作建立在一系列先前研究项目的基础上。如果您有兴趣了解我们的研究是如何演进的,请查看我们之前的工作:

| Deep SfM Revisited | ──┐ | |

| PoseDiffusion | ─────► | VGGSfM ──► VGGT |

| CoTracker | ──┘ |

致谢

感谢以下优秀的开源项目:PoseDiffusion、VGGSfM、CoTracker、DINOv2、Dust3r、Moge、PyTorch3D、Sky Segmentation、Depth Anything V2、Metric3D,以及社区中许多其他令人启发的工作。

待办事项

- 发布训练代码

- 发布 VGGT-500M 和 VGGT-200M

许可证

有关本代码所采用许可证的详细信息,请参阅 LICENSE 文件。

请注意,只有此 模型检查点 允许商业使用。该新检查点达到了与原始检查点相同的性能水平(甚至可能略优),例如,在 Co3D 数据集上的 AUC@30 分别为 90.37 和 89.98。

常见问题

相似工具推荐

openclaw

OpenClaw 是一款专为个人打造的本地化 AI 助手,旨在让你在自己的设备上拥有完全可控的智能伙伴。它打破了传统 AI 助手局限于特定网页或应用的束缚,能够直接接入你日常使用的各类通讯渠道,包括微信、WhatsApp、Telegram、Discord、iMessage 等数十种平台。无论你在哪个聊天软件中发送消息,OpenClaw 都能即时响应,甚至支持在 macOS、iOS 和 Android 设备上进行语音交互,并提供实时的画布渲染功能供你操控。 这款工具主要解决了用户对数据隐私、响应速度以及“始终在线”体验的需求。通过将 AI 部署在本地,用户无需依赖云端服务即可享受快速、私密的智能辅助,真正实现了“你的数据,你做主”。其独特的技术亮点在于强大的网关架构,将控制平面与核心助手分离,确保跨平台通信的流畅性与扩展性。 OpenClaw 非常适合希望构建个性化工作流的技术爱好者、开发者,以及注重隐私保护且不愿被单一生态绑定的普通用户。只要具备基础的终端操作能力(支持 macOS、Linux 及 Windows WSL2),即可通过简单的命令行引导完成部署。如果你渴望拥有一个懂你

stable-diffusion-webui

stable-diffusion-webui 是一个基于 Gradio 构建的网页版操作界面,旨在让用户能够轻松地在本地运行和使用强大的 Stable Diffusion 图像生成模型。它解决了原始模型依赖命令行、操作门槛高且功能分散的痛点,将复杂的 AI 绘图流程整合进一个直观易用的图形化平台。 无论是希望快速上手的普通创作者、需要精细控制画面细节的设计师,还是想要深入探索模型潜力的开发者与研究人员,都能从中获益。其核心亮点在于极高的功能丰富度:不仅支持文生图、图生图、局部重绘(Inpainting)和外绘(Outpainting)等基础模式,还独创了注意力机制调整、提示词矩阵、负向提示词以及“高清修复”等高级功能。此外,它内置了 GFPGAN 和 CodeFormer 等人脸修复工具,支持多种神经网络放大算法,并允许用户通过插件系统无限扩展能力。即使是显存有限的设备,stable-diffusion-webui 也提供了相应的优化选项,让高质量的 AI 艺术创作变得触手可及。

ComfyUI

ComfyUI 是一款功能强大且高度模块化的视觉 AI 引擎,专为设计和执行复杂的 Stable Diffusion 图像生成流程而打造。它摒弃了传统的代码编写模式,采用直观的节点式流程图界面,让用户通过连接不同的功能模块即可构建个性化的生成管线。 这一设计巧妙解决了高级 AI 绘图工作流配置复杂、灵活性不足的痛点。用户无需具备编程背景,也能自由组合模型、调整参数并实时预览效果,轻松实现从基础文生图到多步骤高清修复等各类复杂任务。ComfyUI 拥有极佳的兼容性,不仅支持 Windows、macOS 和 Linux 全平台,还广泛适配 NVIDIA、AMD、Intel 及苹果 Silicon 等多种硬件架构,并率先支持 SDXL、Flux、SD3 等前沿模型。 无论是希望深入探索算法潜力的研究人员和开发者,还是追求极致创作自由度的设计师与资深 AI 绘画爱好者,ComfyUI 都能提供强大的支持。其独特的模块化架构允许社区不断扩展新功能,使其成为当前最灵活、生态最丰富的开源扩散模型工具之一,帮助用户将创意高效转化为现实。

gemini-cli

gemini-cli 是一款由谷歌推出的开源 AI 命令行工具,它将强大的 Gemini 大模型能力直接集成到用户的终端环境中。对于习惯在命令行工作的开发者而言,它提供了一条从输入提示词到获取模型响应的最短路径,无需切换窗口即可享受智能辅助。 这款工具主要解决了开发过程中频繁上下文切换的痛点,让用户能在熟悉的终端界面内直接完成代码理解、生成、调试以及自动化运维任务。无论是查询大型代码库、根据草图生成应用,还是执行复杂的 Git 操作,gemini-cli 都能通过自然语言指令高效处理。 它特别适合广大软件工程师、DevOps 人员及技术研究人员使用。其核心亮点包括支持高达 100 万 token 的超长上下文窗口,具备出色的逻辑推理能力;内置 Google 搜索、文件操作及 Shell 命令执行等实用工具;更独特的是,它支持 MCP(模型上下文协议),允许用户灵活扩展自定义集成,连接如图像生成等外部能力。此外,个人谷歌账号即可享受免费的额度支持,且项目基于 Apache 2.0 协议完全开源,是提升终端工作效率的理想助手。

LLMs-from-scratch

LLMs-from-scratch 是一个基于 PyTorch 的开源教育项目,旨在引导用户从零开始一步步构建一个类似 ChatGPT 的大型语言模型(LLM)。它不仅是同名技术著作的官方代码库,更提供了一套完整的实践方案,涵盖模型开发、预训练及微调的全过程。 该项目主要解决了大模型领域“黑盒化”的学习痛点。许多开发者虽能调用现成模型,却难以深入理解其内部架构与训练机制。通过亲手编写每一行核心代码,用户能够透彻掌握 Transformer 架构、注意力机制等关键原理,从而真正理解大模型是如何“思考”的。此外,项目还包含了加载大型预训练权重进行微调的代码,帮助用户将理论知识延伸至实际应用。 LLMs-from-scratch 特别适合希望深入底层原理的 AI 开发者、研究人员以及计算机专业的学生。对于不满足于仅使用 API,而是渴望探究模型构建细节的技术人员而言,这是极佳的学习资源。其独特的技术亮点在于“循序渐进”的教学设计:将复杂的系统工程拆解为清晰的步骤,配合详细的图表与示例,让构建一个虽小但功能完备的大模型变得触手可及。无论你是想夯实理论基础,还是为未来研发更大规模的模型做准备

Deep-Live-Cam

Deep-Live-Cam 是一款专注于实时换脸与视频生成的开源工具,用户仅需一张静态照片,即可通过“一键操作”实现摄像头画面的即时变脸或制作深度伪造视频。它有效解决了传统换脸技术流程繁琐、对硬件配置要求极高以及难以实时预览的痛点,让高质量的数字内容创作变得触手可及。 这款工具不仅适合开发者和技术研究人员探索算法边界,更因其极简的操作逻辑(仅需三步:选脸、选摄像头、启动),广泛适用于普通用户、内容创作者、设计师及直播主播。无论是为了动画角色定制、服装展示模特替换,还是制作趣味短视频和直播互动,Deep-Live-Cam 都能提供流畅的支持。 其核心技术亮点在于强大的实时处理能力,支持口型遮罩(Mouth Mask)以保留使用者原始的嘴部动作,确保表情自然精准;同时具备“人脸映射”功能,可同时对画面中的多个主体应用不同面孔。此外,项目内置了严格的内容安全过滤机制,自动拦截涉及裸露、暴力等不当素材,并倡导用户在获得授权及明确标注的前提下合规使用,体现了技术发展与伦理责任的平衡。