dgl

DGL(Deep Graph Library)是一款专为图深度学习打造的高性能 Python 库,旨在降低在现有深度学习框架上进行图神经网络开发的门槛。它主要解决了传统框架在处理复杂图结构数据时效率低、扩展性差以及代码复用难的痛点,让开发者能够专注于模型逻辑而非底层实现。

无论是致力于前沿算法探索的研究人员,还是需要将图模型集成到端到端应用中的工程师,DGL 都是理想的选择。其核心优势在于“框架无关”的设计,完美支持 PyTorch、TensorFlow 和 MXNet 等主流后端,用户可灵活沿用熟悉的技术栈。技术亮点方面,DGL 提供了强大的图对象抽象,支持 CPU 与 GPU 无缝切换,并内置了高效且可定制的消息传递机制,极大简化了图神经网络的构建过程。此外,针对海量数据场景,DGL 经过深度优化,能够轻松利用多卡或多机集群进行分布式训练,从容应对十亿级节点的大规模图数据。配合丰富的预置模型库、基准测试支持以及详尽的新手教程,DGL 帮助用户快速从理论验证走向生产部署,是连接学术创新与工业应用的桥梁。

使用场景

某金融科技公司风控团队需要构建图神经网络模型,通过分析数亿用户间的转账关系来实时识别欺诈团伙。

没有 dgl 时

- 开发者需手动编写复杂的稀疏矩阵运算代码来实现消息传递机制,极易出错且难以调试。

- 面对十亿级边的超大图数据,单机内存直接爆满,团队不得不花费数周定制分布式切片逻辑。

- 想要尝试最新的 GNN 变体(如 GraphSAGE 或 GAT),必须从零复现论文算法,研发周期长达数月。

- 代码与底层深度学习框架强耦合,若想从 PyTorch 迁移到 TensorFlow,几乎需要重写整个图计算模块。

- 缺乏统一的数据结构管理,节点特征与拓扑结构分离存储,导致数据预处理流程繁琐且低效。

使用 dgl 后

- 直接调用 dgl 内置的高效消息传递原语,几行代码即可构建复杂的图卷积层,开发效率提升十倍。

- 利用 dgl 的原生分布式训练能力,轻松将十亿级大图拆分至多机多卡集群,无需关心底层通信细节。

- 通过 dgl 提供的丰富官方示例库和预置 SOTA 模型层,当天即可完成新算法的验证与基线测试。

- 凭借框架无关的特性,核心图逻辑保持不变,仅需修改少量接口即可在 PyTorch、MXNet 或 TensorFlow 间无缝切换。

- 使用 dgl 统一的图对象同时托管拓扑结构与特征数据,支持 GPU 直接加速,大幅简化了数据流水线。

dgl 让团队从繁琐的底层图算子实现中解放出来,专注于业务逻辑创新,将欺诈检测模型的迭代周期从月级缩短至天级。

运行环境要求

- Linux (x86 和 ARM 架构)

非必需(支持 CPU),若使用 GPU 需 NVIDIA GPU(通过 PyTorch/MXNet/TensorFlow 后端),具体显存和 CUDA 版本取决于所选深度学习框架

未说明(针对十亿级节点图推荐多机分布式训练)

快速开始

官网 | DGL 简明入门 | 文档 (最新 | 官方示例 | 讨论论坛 | Slack 频道)

DGL 是一个易于使用、高性能且可扩展的 Python 库,专用于图上的深度学习。DGL 不依赖于特定框架,这意味着如果深度图模型是端到端应用的一部分,其余逻辑可以使用任何主流框架实现,例如 PyTorch、Apache MXNet 或 TensorFlow。

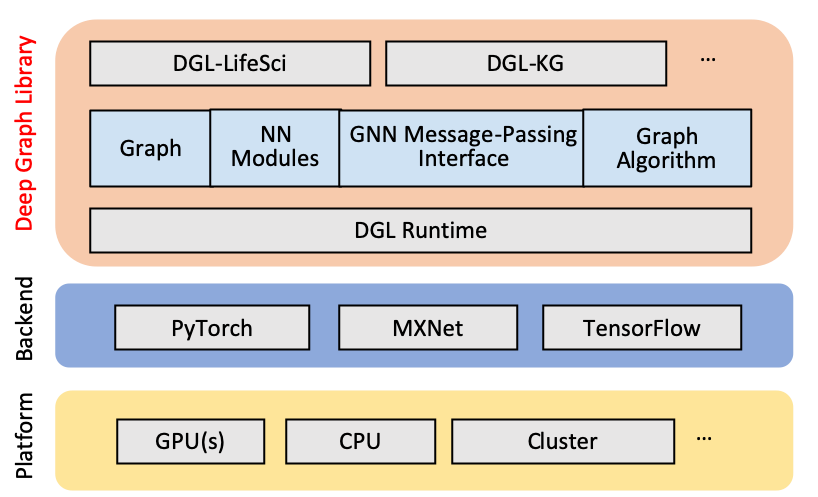

图:DGL 整体架构

亮点功能

适用于 GPU 的图库

DGL 提供了一个功能强大的图对象,既可以驻留在 CPU 上,也可以驻留在 GPU 上。它将结构数据和特征封装在一起,便于更好地控制。我们为图对象的计算提供了多种函数,包括高效且可定制的消息传递原语,适用于图神经网络。

GNN 研究者与从业者的多功能工具

图深度学习领域仍在快速发展,许多研究思路都是站在前人的肩膀上提出的。为了简化这一过程,DGl-Go 是一个命令行界面,帮助用户快速开始训练、使用和研究最先进的 GNN 模型。 DGL 收集了大量热门 GNN 模型的示例实现,涵盖广泛的主题。研究人员可以通过搜索找到相关模型,从中获得创新灵感,或将其用作实验基准。此外,DGL 还提供了许多最先进的GNN 层和模块,供用户构建新的模型架构。DGL 是许多标准图深度学习基准测试的首选平台之一,包括 OGB 和 GNNBenchmarks。

易学易用

DGL 为各类用户提供丰富的学习资料,从机器学习研究人员到领域专家。DGL 简明入门是一次为期 120 分钟的图机器学习基础之旅。用户指南则更详细地解释了图的概念以及训练方法。所有这些内容都包含可在 DGL 中运行的代码片段,可以直接集成到用户的流程中。

可扩展且高效

使用 DGL 在大规模图上进行训练时,可以在多块 GPU或多台机器之间轻松实现分布式训练。DGL 对整个栈进行了全面优化,以减少通信、内存消耗和同步方面的开销。因此,DGL 能够轻松扩展到数十亿节点的图。请参阅教程和用户指南了解分布式训练的相关内容。有关与其他工具的比较,请参阅系统性能说明。

开始使用

用户可以通过 pip 和 conda 安装 DGL。您还可以从 NVIDIA NGC 下载支持 GPU 的 DGL Docker 容器(基于 PyTorch),适用于 x86 和 ARM 架构的 Linux 系统。高级用户可以按照安装说明从源码安装。

对于完全的新手,可以从简明入门开始。它涵盖了常见图机器学习任务的基本概念,并逐步讲解如何构建图神经网络 (GNN) 来解决这些问题。

对于已经有一定基础的用户,若想进一步学习:

- 使用 DGL-Go,只需两行命令即可体验最先进的 GNN 模型。

- 通过 DGL 示例实现学习流行的 GNN 模型。

- 阅读用户指南(中文版链接),其中更详细地介绍了 DGL 的概念和用法。

- 学习高级功能的教程,例如GNN 的随机训练、在多 GPU或多机器上进行训练。

- 结合 DGL 阅读经典论文,深入了解图机器学习。

- 在API 参考手册中查找特定 API 的用法,该手册按命名空间组织了所有 DGL API。

所有学习资料均可在我们的文档网站上找到。如果您对深度学习尚不熟悉,不妨阅读开源书籍动手学深度学习。

社区

加入社区

我们提供了多种渠道,帮助您与 DGL 开发者、用户以及广大的 GNN 学术研究者建立联系:

- 我们的 Slack 频道,点击加入

- 我们的讨论论坛:https://discuss.dgl.ai/

- 我们的Zhihu 博客(中文)

- 每月一次的 GNN 用户组线上研讨会(活动链接 | 往期视频)

请在此处填写调查问卷这里,并留下您的反馈,帮助我们使 DGL 更好地满足您的需求。感谢!

DGL 驱动的项目

- DGL-LifeSci:基于 DGL 的软件包,用于生命科学领域中图神经网络的各种应用。https://github.com/awslabs/dgl-lifesci

- DGL-KE:一个高性能、易用且可扩展的软件包,用于学习大规模知识图谱嵌入。https://github.com/awslabs/dgl-ke

- 图神经网络基准测试:https://github.com/graphdeeplearning/benchmarking-gnns

- OGB:一组真实、大规模且多样化的图机器学习基准数据集。https://ogb.stanford.edu/

- Graph4NLP:一个易于使用的库,用于图深度学习与自然语言处理交叉领域的研发。https://github.com/graph4ai/graph4nlp

- GNN-RecSys:https://github.com/je-dbl/GNN-RecSys

- Amazon Neptune ML:Neptune 的一项新功能,利用图神经网络(GNN)——一种专为图结构设计的机器学习技术——通过图数据实现简单、快速且更准确的预测。https://aws.amazon.com/cn/neptune/machine-learning/

- GNNLens2:图神经网络的可视化工具。https://github.com/dmlc/GNNLens2

- RNAGlib:一个用于 RNA 2.5D 图构建、分析、可视化及机器学习的软件包。包含预构建的数据集:https://rnaglib.cs.mcgill.ca

- OpenHGNN:异构图神经网络的模型库和基准测试。https://github.com/BUPT-GAMMA/OpenHGNN

- TGL:面向大规模时序图的图学习框架。https://github.com/amazon-research/tgl

- gtrick:图神经网络技巧集。https://github.com/sangyx/gtrick

- ArangoDB-DGL 适配器:将 ArangoDB 图导入 DGL,反之亦然。https://github.com/arangoml/dgl-adapter

- DGLD:DGLD 是一个基于 PyTorch 和 DGL 的开源深度图异常检测库。

使用 DGL 的优秀论文

图神经网络基准测试,Vijay Prakash Dwivedi、Chaitanya K. Joshi、Thomas Laurent、Yoshua Bengio、Xavier Bresson

开放图基准:图机器学习数据集,NeurIPS'20,Weihua Hu、Matthias Fey、Marinka Zitnik、Yuxiao Dong、Hongyu Ren、Bowen Liu、Michele Catasta、Jure Leskovec

DropEdge:迈向节点分类任务中的深层图卷积网络,ICLR'20,Yu Rong、Wenbing Huang、Tingyang Xu、Junzhou Huan

话语感知的神经提取式文本摘要,ACL'20,Jiacheng Xu、Zhe Gan、Yu Cheng、Jingjing Liu

GCC:用于图神经网络预训练的图对比编码,KDD'20,Jiezhong Qiu、Qibin Chen、Yuxiao Dong、Jing Zhang、Hongxia Yang、Ming Ding、Kuansan Wang、Jie Tang

DGL-KE:大规模知识图谱嵌入的训练,SIGIR'20,Da Zheng、Xiang Song、Chao Ma、Zeyuan Tan、Zihao Ye、Jin Dong、Hao Xiong、Zheng Zhang、George Karypis

通过子图同构计数提升图神经网络表达能力,Giorgos Bouritsas、Fabrizio Frasca、Stefanos Zafeiriou、Michael M. Bronstein

INT:用于评估定理证明中泛化能力的不等式基准,Yuhuai Wu、Albert Q. Jiang、Jimmy Ba、Roger Grosse

寻找零号病人:利用图神经网络学习传染源,Chintan Shah、Nima Dehmamy、Nicola Perra、Matteo Chinazzi、Albert-László Barabási、Alessandro Vespignani、Rose Yu

FeatGraph:图神经网络系统的灵活高效后端,SC'20,Yuwei Hu、Zihao Ye、Minjie Wang、Jiali Yu、Da Zheng、Mu Li、Zheng Zhang、Zhiru Zhang、Yida Wang

更多

BP-Transformer:通过二元划分建模长距离上下文,Zihao Ye、Qipeng Guo、Quan Gan、Xipeng Qiu、Zheng Zhang

OptiMol:在化学空间中优化结合亲和力以用于药物发现,Jacques Boitreaud、Vincent Mallet、Carlos Oliver、Jérôme Waldispühl

JAKET:知识图谱与语言理解的联合预训练,Donghan Yu、Chenguang Zhu、Yiming Yang、Michael Zeng

图神经网络的架构启示,Zhihui Zhang、Jingwen Leng、Lingxiao Ma、Youshan Miao、Chao Li、Minyi Guo

结合强化学习与约束规划进行组合优化,Quentin Cappart、Thierry Moisan、Louis-Martin Rousseau1、Isabeau Prémont-Schwarz 和 Andre Cire

治疗学数据共同体:用于治疗学的机器学习数据集和任务(代码仓库),Kexin Huang、Tianfan Fu、Wenhao Gao、Yue Zhao、Yusuf Roohani、Jure Leskovec、Connor W. Coley、Cao Xiao、Jimeng Sun、Marinka Zitnik

稀疏图注意力网络,Yang Ye、Shihao Ji

关于自蒸馏图神经网络,Yuzhao Chen、Yatao Bian、Xi Xiao、Yu Rong、Tingyang Xu、Junzhou Huang

学习图上的鲁棒节点表示,Xu Chen、Ya Zhang、Ivor Tsang 和 Yuangang Pan

递归事件网络:时序知识图谱上的自回归结构推断,Woojeong Jin、Meng Qu、Xisen Jin、Xiang Ren

图神经网络常微分方程,Michael Poli、Stefano Massaroli、Junyoung Park、Atsushi Yamashita、Hajime Asama、Jinkyoo Park

FusedMM:用于图嵌入和图神经网络的统一 SDDMM-SpMM 核心,Md. Khaledur Rahman、Majedul Haque Sujon、Ariful Azad

一种高效的基于邻域的异构图推荐交互模型,KDD'20 Jiarui Jin、Jiarui Qin、Yuchen Fang、Kounianhua Du、Weinan Zhang、Yong Yu、Zheng Zhang、Alexander J. Smola

学习异构信息网络中结构化邻域的交互模型,Jiarui Jin、Kounianhua Du、Weinan Zhang、Jiarui Qin、Yuchen Fang、Yong Yu、Zheng Zhang、Alexander J. Smola

Graphein——用于蛋白质结构的几何深度学习与网络分析的Python库,Arian R. Jamasb、Pietro Lió、Tom L. Blundell

用于大规模机器人控制的图策略梯度,Arbaaz Khan、Ekaterina Tolstaya、Alejandro Ribeiro、Vijay Kumar

用于预测分子性质的异质分子图神经网络,Zeren Shui、George Karypis

图神经网络能否为药物发现学习到更好的分子表示?基于描述符与图模型的比较研究,Dejun Jiang、Zhenxing Wu、Chang-Yu Hsieh、Guangyong Chen、Ben Liao、Zhe Wang、Chao Shen、Dongsheng Cao、Jian Wu、Tingjun Hou

图网络中的主邻域聚合,Gabriele Corso、Luca Cavalleri、Dominique Beaini、Pietro Lió、Petar Veličković

知识图谱之间的集体多类型实体对齐,Qi Zhu、Hao Wei、Bunyamin Sisman、Da Zheng、Christos Faloutsos、Xin Luna Dong、Jiawei Han

患者医疗状况的图表示预测:迈向数字孪生,Pietro Barbiero、Ramon Viñas Torné、Pietro Lió

基于视觉与运动学嵌入的关系图学习,用于机器人手术中精确的手势识别,Yong-Hao Long、Jie-Ying Wu、Bo Lu、Yue-Ming Jin、Mathias Unberath、Yun-Hui Liu、Pheng-Ann Heng和Qi Dou

暗互惠排名:通过师生知识迁移提升图卷积自定位网络性能,Takeda Koji、Tanaka Kanji

Graph InfoClust:利用节点聚类级别信息进行无监督图表示学习,Costas Mavromatis、George Karypis

GraphSeam:用于语义UV映射的监督图学习框架,Fatemeh Teimury、Bruno Roy、Juan Sebastian Casallas、David macdonald、Mark Coates

使用图神经网络进行分子监督学习的综合研究,Doyeong Hwang、Soojung Yang、Yongchan Kwon、Kyung Hoon Lee、Grace Lee、Hanseok Jo、Seyeol Yoon和Seongok Ryu

用于预测miRNA-疾病关联的图自编码器模型,Zhengwei Li、Jiashu Li、Ru Nie、Zhu-Hong You、Wenzheng Bao

从稀疏心内膜地图进行心脏去极化的图卷积回归,STACOM 2020研讨会,Felix Meister、Tiziano Passerini、Chloé Audigier、Èric Lluch、Viorel Mihalef、Hiroshi Ashikaga、Andreas Maier、Henry Halperin、Tommaso Mansi

AttnIO:基于内外注意力流的知识图谱探索,用于知识驱动的对话系统,EMNLP'20,Jaehun Jung、Bokyung Son、Sungwon Lyu

通过张量分解从非二元句法树中学习,COLING'20,Daniele Castellana、Davide Bacciu

利用门控图注意力网络诱导对齐结构进行句子匹配,Peng Cui、Le Hu、Yuanchao Liu

利用主题感知图神经网络增强抽取式文本摘要,COLING'20,Peng Cui、Le Hu、Yuanchao Liu

基于双图推理的文档级关系抽取,EMNLP'20,Shuang Zeng、Runxin Xu、Baobao Chang、Lei Li

基于语言条件嵌入的gSCAN系统性泛化,AACL-IJCNLP'20,Tong Gao、Qi Huang、Raymond J. Mooney

利用监督图嵌入自动选择聚类算法,Noy Cohen-Shapira、Lior Rokach

通过强化学习改进分支学习,Haoran Sun、Wenbo Chen、Hui Li、Le Song

图神经网络实用指南,Isaac Ronald Ward、Jack Joyner、Casey Lickfold、Stash Rowe、Yulan Guo、Mohammed Bennamoun,代码链接

APAN:用于实时时序图嵌入的异步传播注意力网络,SIGMOD'21,Xuhong Wang、Ding Lyu、Mengjian Li、Yang Xia、Qi Yang、Xinwen Wang、Xinguang Wang、Ping Cui、Yupu Yang、Bowen Sun、Zhenyu Guo、Junkui Li

不确定性匹配图神经网络以防御中毒攻击,Uday Shankar Shanthamallu、Jayaraman J. Thiagarajan、Andreas Spanias

计算图神经网络:从算法到加速器的综述,Sergi Abadal、Akshay Jain、Robert Guirado、Jorge López-Alonso、Eduard Alarcón

NHK_STRL在WNUT-2020任务2中的表现:以句法依存关系为边的GATs及基于CTC的损失函数用于文本分类,Yuki Yasuda、Taichi Ishiwatari、Taro Miyazaki、Jun Goto

具有关系位置编码的关系感知图注意力网络,用于对话中的情感识别,Taichi Ishiwatari、Yuki Yasuda、Taro Miyazaki、Jun Goto

PGM-Explainer:图神经网络的概率图模型解释方法,Minh N. Vu、My T. Thai

Transformer网络向图的推广,Vijay Prakash Dwivedi、Xavier Bresson

话语感知的神经抽取式文本摘要,ACL'20,Jiacheng Xu、Zhe Gan、Yu Cheng、Jingjing Liu

在图上学习鲁棒的节点表示,Xu Chen、Ya Zhang、Ivor Tsang、Yuangang Pan

具有跳数级注意力的自适应图扩散网络,Chuxiong Sun、Guoshi Wu

光开关数据集:推动合成化学发展的分子机器学习基准,Aditya R. Thawani、Ryan-Rhys Griffiths、Arian Jamasb、Anthony Bourached、Penelope Jones、William McCorkindale、Alexander A. Aldrick、Alpha A. Lee

基于社区驱动的机器学习策略空间搜索,用于发现核磁共振性质预测模型,Lars A. Bratholm、Will Gerrard、Brandon Anderson、Shaojie Bai、Sunghwan Choi、Lam Dang、Pavel Hanchar、Addison Howard、Guillaume Huard、Sanghoon Kim、Zico Kolter、Risi Kondor、Mordechai Kornbluth、Youhan Lee、Youngsoo Lee、Jonathan P. Mailoa、Thanh Tu Nguyen、Milos Popovic、Goran Rakocevic、Walter Reade、Wonho Song、Luka Stojanovic、Erik H. Thiede、Nebojsa Tijanic、Andres Torrubia、Devin Willmott、Craig P. Butts、David R. Glowacki、Kaggle参赛者

基于图嵌入神经网络的自适应版图分解,Wei Li、Jialu Xia、Yuzhe Ma、Jialu Li、Yibo Lin、Bei Yu,DAC'20

利用图神经网络进行共轭低聚物光电性质的迁移学习,《物理化学杂志》第154卷,Chee-Kong Lee、Chengqiang Lu、Yue Yu、Qiming Sun、Chang-Yu Hsieh、Shengyu Zhang、Qi Liu以及Liang Shi

利用图网络在伦德平面上进行喷注标记,《高能物理杂志》2021年,Frédéric A. Dreyer和Huilin Qu

全局注意力机制提升图网络的泛化能力,Omri Puny、Heli Ben-Hamu和Yaron Lipman

集合族上的学习——面向高阶任务的超图表示学习,SDM 2021,Balasubramaniam Srinivasan、Da Zheng和George Karypis

SSFG:用于正则化图卷积网络的随机缩放特征与梯度方法,Haimin Zhang、Min Xu

知识图谱嵌入在生物医学数据中的应用与评估,PeerJ计算机科学第7卷,e341,Mona Alshahrani、Maha A. Thafar、Magbubah Essack

MoTSE:一种可解释的小分子性质预测任务相似性估计器,bioRxiv 2021.01.13.426608,Han Li、Xinyi Zhao、Shuya Li、Fangping Wan、Dan Zhao、Jianyang Zeng

针对图神经网络的数据投毒强化学习,Jacob Dineen、A S M Ahsan-Ul Haque、Matthew Bielskas

通过张量分解泛化递归神经网络模型,IJCNN'20,Daniele Castellana、Davide Bacciu

树结构数据中递归神经网络的张量分解,ESANN'20,Daniele Castellana、Davide Bacciu

结合自组织网络与图神经网络,用于机器人操作中可变形物体建模,《机器人与人工智能前沿》,Valencia, Angel J.和Pierre Payeur

在线手写文档中结合边缘池化注意力网络进行笔画分类与文本行分组,《模式识别》,Jun-Yu Ye、Yan-Ming Zhang、Qing Yang、Cheng-Lin Liu

通过量子力学描述符增强的图卷积神经网络实现原子性质的精准预测:该新方法在核磁共振化学位移预测中的应用,《物理化学快报》,Peng Gao、Jie Zhang、Yuzhu Sun和Jianguo Yu

用于建模用户在机器人导航中舒适度的图神经网络,Pilar Bachiller、Daniel Rodriguez-Criado、Ronit R. Jorvekar、Pablo Bustos、Diego R. Faria、Luis J. Manso

利用图神经网络进行医学实体消歧,Alina Vretinaris、Chuan Lei、Vasilis Efthymiou、Xiao Qin、Fatma Özcan

基于化学信息的大分子图表示,用于相似性计算与监督学习,Somesh Mohapatra、Joyce An、Rafael Gómez-Bombarelli

利用应用内行为图刻画并预测用户参与度:以Snapchat为例,Yozen Liu、Xiaolin Shi、Lucas Pierce、Xiang Ren

GIPA:用于图学习的通用信息传播算法,Qinkai Zheng、Houyi Li、Peng Zhang、Zhixiong Yang、Guowei Zhang、Xintan Zeng、Yongchao Liu

基于多棵依存句法树的图集成学习,用于方面级情感分类,NAACL'21,Xiaochen Hou、Peng Qi、Guangtao Wang、Rex Ying、Jing Huang、Xiaodong He、Bowen Zhou

利用引用图提升科技论文摘要生成效果,AAAI'21,Chenxin An、Ming Zhong、Yiran Chen、Danqing Wang、Xipeng Qiu、Xuanjing Huang

通过对比正则化改进图表示学习,Kaili Ma、Haochen Yang、Han Yang、Tatiana Jin、Pengfei Chen、Yongqiang Chen、Barakeel Fanseu Kamhoua、James Cheng

提取图神经网络的知识并超越它:一种有效的知识蒸馏框架,WWW'21,Cheng Yang、Jiawei Liu、Chuan Shi

VIKING:通过监督式网络投毒对网络嵌入进行对抗攻击,PAKDD'21,Viresh Gupta、Tanmoy Chakraborty

使用具有关系感知注意力的图卷积网络进行知识图谱嵌入,Nasrullah Sheikh、Xiao Qin、Berthold Reinwald、Christoph Miksovic、Thomas Gschwind、Paolo Scotton

SLAPS:自监督学习提升图神经网络的结构学习,Bahare Fatemi、Layla El Asri、Seyed Mehran Kazemi

在异质性干草堆中寻找针尖,AAAI'21,Bijaya Adhikari、Liangyue Li、Nikhil Rao、Karthik Subbian

RetCL:基于选择的逆合成方法,利用对比学习实现,IJCAI 2021,Hankook Lee、Sungsoo Ahn、Seung-Woo Seo、You Young Song、Eunho Yang、Sung-Ju Hwang、Jinwoo Shin

基于成对原子相互作用,利用图注意力网络和消息传递神经网络精确预测有机分子的自由溶剂化能,Ramin Ansari、Amirata Ghorbani

DIPS-Plus:用于界面预测的增强型相互作用蛋白质结构数据库,Alex Morehead、Chen Chen、Ada Sedova、Jianlin Cheng

指代消解感知的对话摘要,SIGDIAL'21,Zhengyuan Liu、Ke Shi、Nancy F. Chen

面向本体构建的文档结构感知关系图卷积网络,arXiv,Abhay M Shalghar、Ayush Kumar、Balaji Ganesan、Aswin Kannan、Shobha G

基于图卷积神经网络的胸部X光片与患者元数据新冠肺炎检测,Thosini Bamunu Mudiyanselage、Nipuna Senanayake、Chunyan Ji、Yi Pan、Yanqing Zhang

Rossmann工具箱:一种基于深度学习的协议,用于预测和设计Rossmann折叠蛋白中的辅因子特异性,《生物信息学简报》,Kamil Kaminski、Jan Ludwiczak、Maciej Jasinski、Adriana Bukala、Rafal Madaj、Krzysztof Szczepaniak、Stanislaw Dunin-Horkawicz

LGESQL:结合局部与非局部关系的线图增强型文本到SQL模型,ACL'21,Ruisheng Cao、Lu Chen、Zhi Chen、Yanbin Zhao、Su Zhu、Kai Yu

通过辅助训练提升半监督节点分类的图神经网络性能,《知识系统》'21,Yao Wu、Yu Song、Hong Huang、Fanghua Ye、Xing Xie、Hai Jin

利用邻居混合模型建模图节点相关性,Linfeng Liu、Michael C. Hughes、Li-Ping Liu

将物理学与机器学习相结合用于网络流量估计,ICLR'21,Arlei Silva、Furkan Kocayusufoglu、Saber Jafarpour、Francesco Bullo、Ananthram Swami、Ambuj Singh

基于图注意力网络的学术资源分类方法,《未来互联网》'21,Jie Yu、Yaliu Li、Chenle Pan 和 Junwei Wang

面向GPU的数据通信架构下的大规模图卷积网络训练,Seung Won Min、Kun Wu、Sitao Huang、Mert Hidayetoğlu、Jinjun Xiong、Eiman Ebrahimi、Deming Chen、Wen-mei Hwu

图注意力多层感知器,Wentao Zhang、Ziqi Yin、Zeang Sheng、Wen Ouyang、Xiaosen Li、Yangyu Tao、Zhi Yang、Bin Cui

GNNLens:一种用于图神经网络预测误差诊断的可视化分析方法,Zhihua Jin、Yong Wang、Qianwen Wang、Yao Ming、Tengfei Ma、Huamin Qu

图注意力网络有多“注意”?,Shaked Brody、Uri Alon、Eran Yahav,代码链接

SCENE:利用异质图神经网络进行交通场景推理,Thomas Monninger*、Julian Schmidt*、Jan Rupprecht、David Raba、Julian Jordan、Daniel Frank、Steffen Staab、Klaus Dietmayer,代码链接,*共同第一作者

贡献

如果您遇到任何错误或有任何建议,请通过提交问题告知我们。

我们欢迎各种形式的贡献,从修复漏洞到新增功能和扩展。

我们期望所有贡献都在议题跟踪器中讨论,并通过拉取请求(PR)提交。请参阅我们的贡献指南。

引用

如果您在科学出版物中使用了DGL,我们非常感谢您引用以下论文:

@article{wang2019dgl,

title={深度图库:一个以图为中心、高性能的图神经网络软件包},

author={王敏杰、郑达、叶子豪、权甘、李牧飞、宋翔、周金晶、马超、于凌凡、盖宇、肖天俊、何彤、加里皮斯、李金阳、张正},

year={2019},

journal={arXiv预印本 arXiv:1909.01315}

}

团队

DGL由纽约大学、纽约大学上海分校、AWS上海人工智能实验室以及AWS MXNet科研团队开发并维护。

许可证

DGL采用Apache许可证2.0版。

版本历史

v2.4.02024/09/03v2.3.02024/06/28v2.2.12024/05/11v2.1.02024/03/06v2.0.02024/01/12v1.1.32023/12/111.1.22023/08/151.1.12023/06/271.1.02023/05/051.0.22023/03/311.0.12023/02/211.0.02023/01/300.9.12022/09/200.9.02022/07/180.8.22022/05/300.8.12022/04/170.8.0post22022/04/030.8.0post12022/03/080.8.02022/03/010.7.22021/11/08相似工具推荐

openclaw

OpenClaw 是一款专为个人打造的本地化 AI 助手,旨在让你在自己的设备上拥有完全可控的智能伙伴。它打破了传统 AI 助手局限于特定网页或应用的束缚,能够直接接入你日常使用的各类通讯渠道,包括微信、WhatsApp、Telegram、Discord、iMessage 等数十种平台。无论你在哪个聊天软件中发送消息,OpenClaw 都能即时响应,甚至支持在 macOS、iOS 和 Android 设备上进行语音交互,并提供实时的画布渲染功能供你操控。 这款工具主要解决了用户对数据隐私、响应速度以及“始终在线”体验的需求。通过将 AI 部署在本地,用户无需依赖云端服务即可享受快速、私密的智能辅助,真正实现了“你的数据,你做主”。其独特的技术亮点在于强大的网关架构,将控制平面与核心助手分离,确保跨平台通信的流畅性与扩展性。 OpenClaw 非常适合希望构建个性化工作流的技术爱好者、开发者,以及注重隐私保护且不愿被单一生态绑定的普通用户。只要具备基础的终端操作能力(支持 macOS、Linux 及 Windows WSL2),即可通过简单的命令行引导完成部署。如果你渴望拥有一个懂你

stable-diffusion-webui

stable-diffusion-webui 是一个基于 Gradio 构建的网页版操作界面,旨在让用户能够轻松地在本地运行和使用强大的 Stable Diffusion 图像生成模型。它解决了原始模型依赖命令行、操作门槛高且功能分散的痛点,将复杂的 AI 绘图流程整合进一个直观易用的图形化平台。 无论是希望快速上手的普通创作者、需要精细控制画面细节的设计师,还是想要深入探索模型潜力的开发者与研究人员,都能从中获益。其核心亮点在于极高的功能丰富度:不仅支持文生图、图生图、局部重绘(Inpainting)和外绘(Outpainting)等基础模式,还独创了注意力机制调整、提示词矩阵、负向提示词以及“高清修复”等高级功能。此外,它内置了 GFPGAN 和 CodeFormer 等人脸修复工具,支持多种神经网络放大算法,并允许用户通过插件系统无限扩展能力。即使是显存有限的设备,stable-diffusion-webui 也提供了相应的优化选项,让高质量的 AI 艺术创作变得触手可及。

everything-claude-code

everything-claude-code 是一套专为 AI 编程助手(如 Claude Code、Codex、Cursor 等)打造的高性能优化系统。它不仅仅是一组配置文件,而是一个经过长期实战打磨的完整框架,旨在解决 AI 代理在实际开发中面临的效率低下、记忆丢失、安全隐患及缺乏持续学习能力等核心痛点。 通过引入技能模块化、直觉增强、记忆持久化机制以及内置的安全扫描功能,everything-claude-code 能显著提升 AI 在复杂任务中的表现,帮助开发者构建更稳定、更智能的生产级 AI 代理。其独特的“研究优先”开发理念和针对 Token 消耗的优化策略,使得模型响应更快、成本更低,同时有效防御潜在的攻击向量。 这套工具特别适合软件开发者、AI 研究人员以及希望深度定制 AI 工作流的技术团队使用。无论您是在构建大型代码库,还是需要 AI 协助进行安全审计与自动化测试,everything-claude-code 都能提供强大的底层支持。作为一个曾荣获 Anthropic 黑客大奖的开源项目,它融合了多语言支持与丰富的实战钩子(hooks),让 AI 真正成长为懂上

ComfyUI

ComfyUI 是一款功能强大且高度模块化的视觉 AI 引擎,专为设计和执行复杂的 Stable Diffusion 图像生成流程而打造。它摒弃了传统的代码编写模式,采用直观的节点式流程图界面,让用户通过连接不同的功能模块即可构建个性化的生成管线。 这一设计巧妙解决了高级 AI 绘图工作流配置复杂、灵活性不足的痛点。用户无需具备编程背景,也能自由组合模型、调整参数并实时预览效果,轻松实现从基础文生图到多步骤高清修复等各类复杂任务。ComfyUI 拥有极佳的兼容性,不仅支持 Windows、macOS 和 Linux 全平台,还广泛适配 NVIDIA、AMD、Intel 及苹果 Silicon 等多种硬件架构,并率先支持 SDXL、Flux、SD3 等前沿模型。 无论是希望深入探索算法潜力的研究人员和开发者,还是追求极致创作自由度的设计师与资深 AI 绘画爱好者,ComfyUI 都能提供强大的支持。其独特的模块化架构允许社区不断扩展新功能,使其成为当前最灵活、生态最丰富的开源扩散模型工具之一,帮助用户将创意高效转化为现实。

gemini-cli

gemini-cli 是一款由谷歌推出的开源 AI 命令行工具,它将强大的 Gemini 大模型能力直接集成到用户的终端环境中。对于习惯在命令行工作的开发者而言,它提供了一条从输入提示词到获取模型响应的最短路径,无需切换窗口即可享受智能辅助。 这款工具主要解决了开发过程中频繁上下文切换的痛点,让用户能在熟悉的终端界面内直接完成代码理解、生成、调试以及自动化运维任务。无论是查询大型代码库、根据草图生成应用,还是执行复杂的 Git 操作,gemini-cli 都能通过自然语言指令高效处理。 它特别适合广大软件工程师、DevOps 人员及技术研究人员使用。其核心亮点包括支持高达 100 万 token 的超长上下文窗口,具备出色的逻辑推理能力;内置 Google 搜索、文件操作及 Shell 命令执行等实用工具;更独特的是,它支持 MCP(模型上下文协议),允许用户灵活扩展自定义集成,连接如图像生成等外部能力。此外,个人谷歌账号即可享受免费的额度支持,且项目基于 Apache 2.0 协议完全开源,是提升终端工作效率的理想助手。

markitdown

MarkItDown 是一款由微软 AutoGen 团队打造的轻量级 Python 工具,专为将各类文件高效转换为 Markdown 格式而设计。它支持 PDF、Word、Excel、PPT、图片(含 OCR)、音频(含语音转录)、HTML 乃至 YouTube 链接等多种格式的解析,能够精准提取文档中的标题、列表、表格和链接等关键结构信息。 在人工智能应用日益普及的今天,大语言模型(LLM)虽擅长处理文本,却难以直接读取复杂的二进制办公文档。MarkItDown 恰好解决了这一痛点,它将非结构化或半结构化的文件转化为模型“原生理解”且 Token 效率极高的 Markdown 格式,成为连接本地文件与 AI 分析 pipeline 的理想桥梁。此外,它还提供了 MCP(模型上下文协议)服务器,可无缝集成到 Claude Desktop 等 LLM 应用中。 这款工具特别适合开发者、数据科学家及 AI 研究人员使用,尤其是那些需要构建文档检索增强生成(RAG)系统、进行批量文本分析或希望让 AI 助手直接“阅读”本地文件的用户。虽然生成的内容也具备一定可读性,但其核心优势在于为机器