openwork

OpenWork 是一款专为团队协作打造的开源智能工作流平台,旨在作为 Claude Cowork 等商业产品的免费替代方案。它基于强大的 OpenCode 引擎构建,核心目标是让用户能轻松地将复杂的 AI 代理(Agentic)工作流转化为可重复、产品化的标准流程。

针对现有开发者工具过于侧重代码细节、难以扩展且缺乏审计功能的问题,OpenWork 提供了更灵活的解决方案。它支持“本地优先,云端就绪”的架构:用户既可以在本地一键启动桌面应用处理敏感任务,也能无缝连接远程服务器或集成到 Slack、WhatsApp 等通讯工具中,彻底打破平台锁定。其独特的技术亮点包括可视化的执行计划时间轴、细粒度的权限审批机制(允许单次/始终/拒绝)、可复用的工作流模板以及完善的技能(Skills)管理器,让 AI 的操作过程透明、可控且可追溯。

这款工具非常适合希望将 AI 深度融入日常业务的开发团队、技术研究人员以及需要自动化复杂流程的企业用户。无论你是想在本机安全地调试 Agent,还是需要在团队间共享标准化的智能工作流,OpenWork 都能通过其模块化的设计和友好的交互界面,帮助你高效、安心地交付成果。

使用场景

某初创团队的后端工程师需要频繁将内部开发的 AI 代码生成工作流(基于 OpenCode)交付给非技术背景的产品经理和测试人员使用,以实现自动化文档生成和单元测试编写。

没有 openwork 时

- 部署门槛高:非开发人员必须手动配置 Node.js、Rust 环境及 OpenCode CLI,常因环境依赖问题导致无法启动。

- 协作流程断裂:开发者只能通过命令行运行脚本,无法将复杂的 Agent 工作流封装成可重复使用的图形化产品供团队直接调用。

- 权限管控缺失:AI 执行敏感操作(如写入生产数据库或修改核心配置)时缺乏直观的审批界面,存在误操作风险且难以审计。

- 知识复用困难:优秀的提示词工程和技能模块(Skills)散落在个人本地环境中,难以作为标准化模板在团队内共享和迭代。

使用 openwork 后

- 一键本地运行:团队成员只需下载 desktop 应用即可“一键启动”,无需关心底层 Rust 或 Node 环境,真正实现 Local-first 的零配置体验。

- 工作流产品化:开发者利用 Templates 功能将复杂的 OpenCode 任务封装为标准流程,产品经理可直接在图形界面中选择会话并执行,如同使用内部 SaaS 工具。

- 可视化权限审批:当 AI 请求执行高危操作时,openwork 会弹出明确的权限询问(允许一次/总是/拒绝),确保所有特权操作均有据可查且受控。

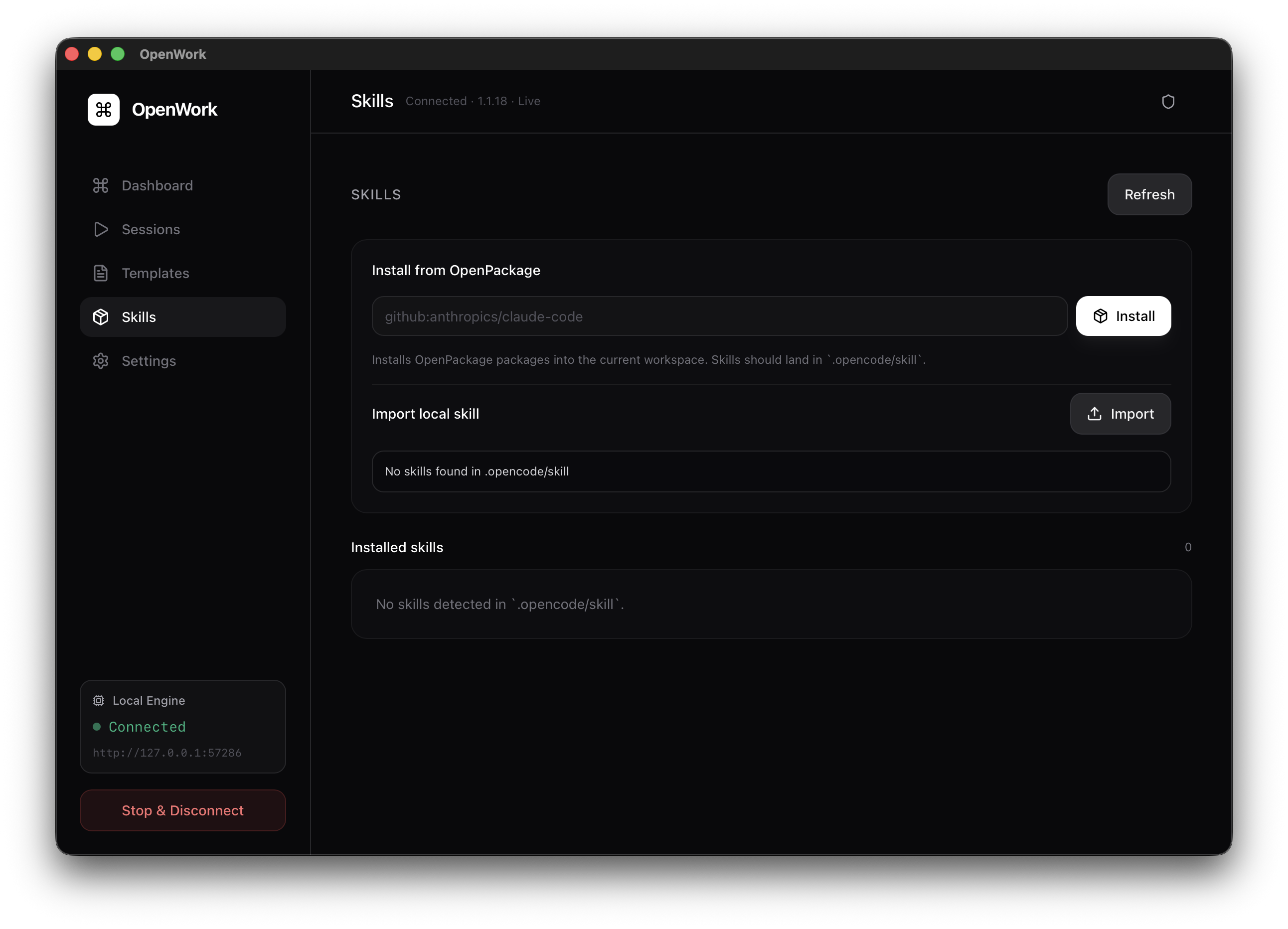

- 技能模块共享:通过 Skills Manager,团队可将验证过的

.opencode/skills文件夹轻松导入并分发给全员,让最佳实践迅速转化为团队标准能力。

openwork 成功将原本极客向的命令行 AI 能力转化为团队可协作、可审计且易于分发的标准化生产力工具。

运行环境要求

- Linux

- macOS

未说明

未说明

快速开始

OpenWork 是 Claude Cowork/Codex 的开源替代方案(桌面应用)。

核心理念

- 本地优先,云端就绪:OpenWork 可以在你的机器上一键运行,即时发送消息。

- 组合式设计:桌面应用、WhatsApp/Slack/Telegram 连接器,或服务器。选择适合你的部分,无厂商锁定。

- 可拔插性:OpenWork 基于 OpenCode 构建,因此 OpenCode 能做的功能在 OpenWork 中同样适用,即使目前还没有用户界面。

- 分享即关怀:先在本地单人使用,当你需要时再明确选择远程共享。

OpenWork 的设计理念是,你可以轻松地将智能体工作流打包成可重复、产品化的流程进行部署。

替代 UI

- OpenWork Orchestrator(CLI 主机):在没有桌面 UI 的情况下运行 OpenCode + OpenWork 服务器。

- 安装:

npm install -g openwork-orchestrator - 运行:

openwork start --workspace /path/to/workspace --approval auto - 文档:apps/orchestrator/README.md

- 安装:

快速开始

从 openworklabs.com/download 下载桌面应用,获取最新的 GitHub 发布,或从以下源码安装。

- macOS 和 Linux 的下载可以直接获取。

- Windows 的访问目前通过 openworklabs.com/pricing#windows-support 上的付费支持计划提供。

- 托管的 OpenWork Cloud 工作节点在完成结账后通过 Web 应用启动,然后可以通过桌面应用中的“添加工作节点” -> “连接远程”来连接。

为什么

当前用于 OpenCode 的 CLI 和 GUI 主要面向开发者,这意味着它们侧重于文件差异、工具名称,且扩展能力有限,通常需要暴露某种形式的命令行接口。

OpenWork 的设计目标是:

- 可扩展性:技能和 OpenCode 插件都是可安装的模块。

- 可审计性:展示发生了什么、何时发生以及原因。

- 权限控制:对特权流程的访问控制。

- 本地/远程:OpenWork 既可以在本地运行,也可以连接到远程服务器。

包含内容

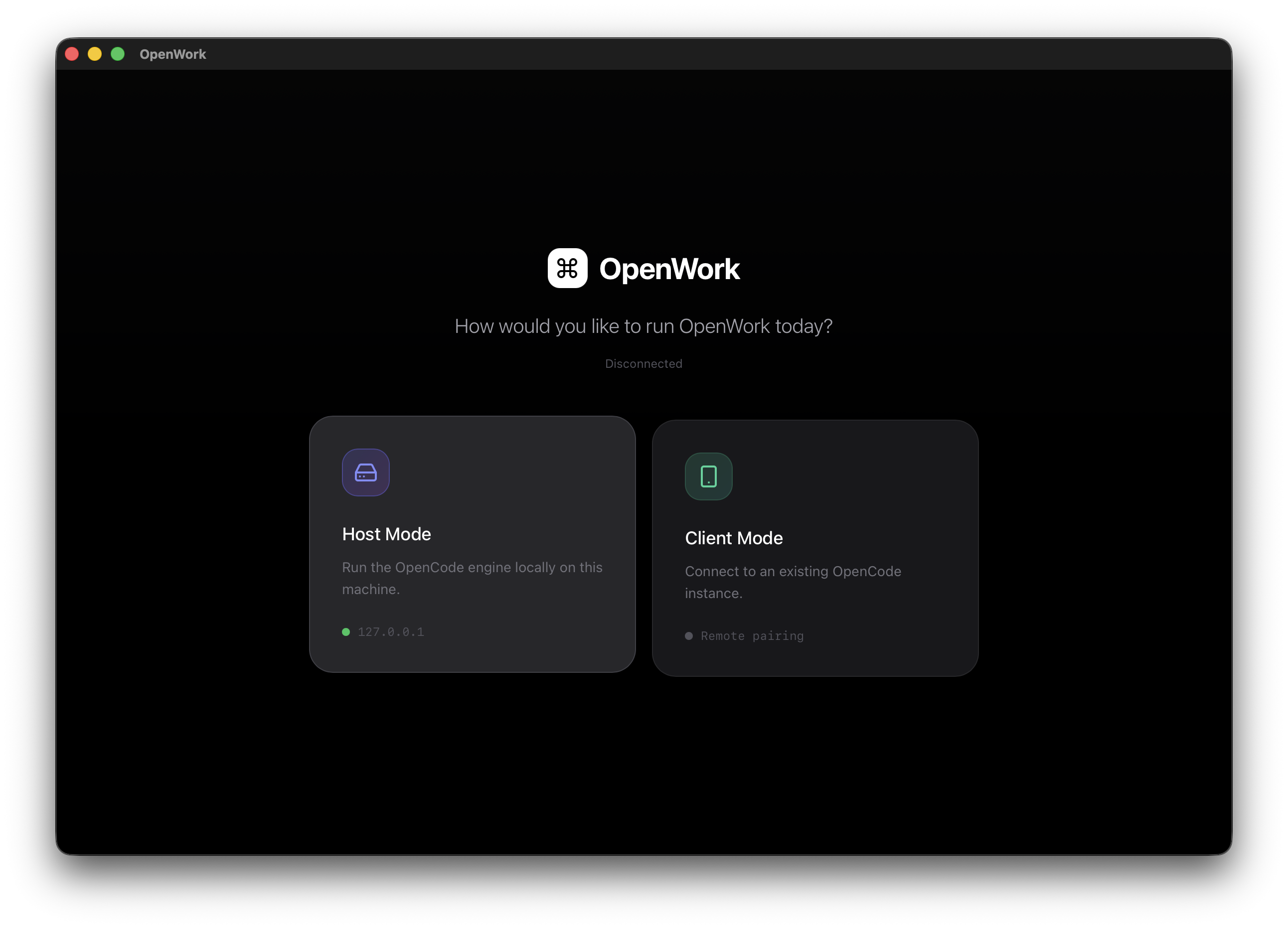

- 主机模式:在你本地计算机上运行 OpenCode

- 客户端模式:通过 URL 连接到现有的 OpenCode 服务器。

- 会话:创建或选择会话并发送提示。

- 实时流:SSE

/event订阅,用于实时更新。 - 执行计划:将 OpenCode 待办事项渲染为时间线。

- 权限管理:显示权限请求并回复(允许一次/始终允许/拒绝)。

- 模板:保存并重新运行常用的工作流(本地存储)。

- 调试导出:当需要提交 bug 时,可以从设置 -> 调试中复制或导出运行时调试报告和开发者日志流。

- 技能管理器:

- 列出已安装的

.opencode/skills文件夹 - 将本地技能文件夹导入到

.opencode/skills/<skill-name>

- 列出已安装的

技能管理器

可在本地计算机或服务器上运行

快速入门

需求

- Node.js +

pnpm - Rust 工具链(用于 Tauri):通过

curl --proto '=https' --tlsv1.2 -sSf https://sh.rustup.rs | sh安装 - Tauri CLI:

cargo install tauri-cli - OpenCode CLI 已安装并可在 PATH 中使用:

opencode

本地开发前提条件(桌面)

在运行 pnpm dev 之前,请确保以下内容已安装并在你的 shell 中生效:

- Node + pnpm(项目使用

pnpm@10.27.0) - Bun 1.3.9+ (

bun --version) - Rust 工具链(用于 Tauri),带有来自当前

rustup稳定版的 Cargo(支持Cargo.lockv4) - Xcode 命令行工具(macOS)

- 在 Linux 上,需要 WebKitGTK 4.1 开发包,以便

pkg-config能够解析webkit2gtk-4.1和javascriptcoregtk-4.1

一分钟自检

从仓库根目录运行:

git checkout dev

git pull --ff-only origin dev

pnpm install --frozen-lockfile

which bun

bun --version

pnpm --filter @openwork/desktop exec tauri --version

安装

pnpm install

OpenWork 目前位于 apps/app(UI)和 apps/desktop(桌面外壳)。

运行(桌面)

pnpm dev

pnpm dev 现在会自动启用 OPENWORK_DEV_MODE=1,因此桌面开发会使用隔离的 OpenCode 状态,而不是你个人的全局配置/认证/数据。

运行(仅 Web UI)

pnpm dev:ui

所有仓库的 dev 入口现在都会选择相同的开发模式隔离,这样本地测试就能一致地使用 OpenWork 管理的 OpenCode 状态。

Arch 用户:

sudo pacman -S --needed webkit2gtk-4.1

curl -fsSL https://opencode.ai/install | bash -s -- --version "$(node -e "const fs=require('fs'); const parsed=JSON.parse(fs.readFileSync('constants.json','utf8')); process.stdout.write(String(parsed.opencodeVersion||'').trim().replace(/^v/,''));")" --no-modify-path

架构(高层次)

- 在 主机模式 下,OpenWork 运行本地主机堆栈,并将 UI 连接到它。

- 默认运行时:

openwork(从openwork-orchestrator安装),负责协调opencode、openwork-server以及可选的opencode-router。 - 备用运行时:

direct,桌面应用直接启动opencode serve --hostname 127.0.0.1 --port <空闲端口>。

- 默认运行时:

当你选择一个项目文件夹时,OpenWork 会在本地使用该文件夹运行主机堆栈,并连接桌面 UI。这使你能够在没有远程服务器的情况下,在自己的机器上完全运行智能体工作流、发送提示并查看进度。

- UI 使用

@opencode-ai/sdk/v2/client来:- 连接到服务器

- 列出/创建会话

- 发送提示

- 订阅 SSE 事件(服务器发送事件用于将实时更新从服务器流式传输到 UI)

- 读取待办事项和权限请求

文件夹选择器

文件夹选择器使用 Tauri 对话框插件。功能权限定义在:

apps/desktop/src-tauri/capabilities/default.json

OpenCode 插件

插件是扩展 OpenCode 的 原生 方式。OpenWork 现在通过“技能”选项卡管理插件,通过读取和写入 opencode.json 来实现。

- 项目范围:

<workspace>/opencode.json - 全局范围:

~/.config/opencode/opencode.json(或$XDG_CONFIG_HOME/opencode/opencode.json)

你仍然可以手动编辑 opencode.json;OpenWork 使用与 OpenCode CLI 相同的格式:

{

"$schema": "https://opencode.ai/config.json",

"plugin": ["opencode-wakatime"]

}

有用命令

pnpm dev

pnpm dev:ui

pnpm typecheck

pnpm build

pnpm build:ui

pnpm test:e2e

故障排除

如果你需要报告桌面或会话相关的 bug,请打开设置 -> 调试,并在提交问题之前导出运行时调试报告和开发者日志。

Linux / Wayland (Hyprland)

如果 OpenWork 在启动时因 WebKitGTK 错误(例如 Failed to create GBM buffer)而崩溃,请在启动前禁用 dmabuf 或合成。尝试使用以下环境变量之一:

WEBKIT_DISABLE_DMABUF_RENDERER=1 openwork

WEBKIT_DISABLE_COMPOSITING_MODE=1 openwork

安全提示

- OpenWork 默认会隐藏模型推理过程和敏感的工具元数据。

- 主机模式默认绑定到

127.0.0.1。

贡献指南

- 在进行任何更改之前,请先阅读

AGENTS.md以及VISION.md、PRINCIPLES.md、PRODUCT.md和ARCHITECTURE.md,以充分理解项目目标。 - 在开始开发之前,请确保已安装 Node.js、

pnpm、Rust 工具链和opencode。 - 每次检出代码后运行一次

pnpm install,然后通过pnpm typecheck和pnpm test:e2e(或相关子集脚本)验证您的更改,再提交 PR。 - 提交 PR 时请使用

.github/pull_request_template.md模板,并附上确切的命令、执行结果、手动验证步骤及证据。 - 如果 CI 测试失败,请在 PR 描述中明确区分是代码相关的回归问题,还是外部/环境/认证等方面的阻塞问题。

- 新的 PRD 应按照

AGENTS.md中描述的.opencode/skills/prd-conventions/SKILL.md规范,添加到apps/app/pr/<name>.md文件中。

社区文档:

CODE_OF_CONDUCT.mdSECURITY.mdSUPPORT.mdTRIAGE.md

首次贡献检查清单:

- 运行

pnpm install及基准验证命令。 - 确认您的更改有明确的问题链接和范围。

- 为行为变更添加或更新测试。

- 在 PR 中包含执行的命令及其结果。

- 为面向用户的流程变更添加截图或视频。

面向团队与企业

贵公司是否有兴趣在组织内使用 OpenWork?我们非常期待与您交流!请发送邮件至 ben@openworklabs.com ,与我们探讨您的具体应用场景。

许可证

MIT — 详情请参阅 LICENSE 文件。

版本历史

openwork-orchestrator-v0.11.2052026/04/08v0.11.2052026/04/08openwork-orchestrator-v0.11.2042026/04/08openwork-orchestrator-v0.11.2032026/04/07v0.11.2032026/04/07openwork-orchestrator-v0.11.2022026/04/04v0.11.2022026/04/04openwork-orchestrator-v0.11.2012026/04/04v0.11.2012026/04/04openwork-orchestrator-v0.11.2002026/04/03v0.11.2002026/04/03openwork-orchestrator-v0.11.1992026/04/02v0.11.1992026/04/02openwork-orchestrator-v0.11.1982026/03/31v0.11.1982026/03/31v0.11.1972026/03/31openwork-orchestrator-v0.11.1972026/03/31v0.11.1962026/03/30openwork-orchestrator-v0.11.1952026/03/27v0.11.1952026/03/27常见问题

相似工具推荐

openclaw

OpenClaw 是一款专为个人打造的本地化 AI 助手,旨在让你在自己的设备上拥有完全可控的智能伙伴。它打破了传统 AI 助手局限于特定网页或应用的束缚,能够直接接入你日常使用的各类通讯渠道,包括微信、WhatsApp、Telegram、Discord、iMessage 等数十种平台。无论你在哪个聊天软件中发送消息,OpenClaw 都能即时响应,甚至支持在 macOS、iOS 和 Android 设备上进行语音交互,并提供实时的画布渲染功能供你操控。 这款工具主要解决了用户对数据隐私、响应速度以及“始终在线”体验的需求。通过将 AI 部署在本地,用户无需依赖云端服务即可享受快速、私密的智能辅助,真正实现了“你的数据,你做主”。其独特的技术亮点在于强大的网关架构,将控制平面与核心助手分离,确保跨平台通信的流畅性与扩展性。 OpenClaw 非常适合希望构建个性化工作流的技术爱好者、开发者,以及注重隐私保护且不愿被单一生态绑定的普通用户。只要具备基础的终端操作能力(支持 macOS、Linux 及 Windows WSL2),即可通过简单的命令行引导完成部署。如果你渴望拥有一个懂你

stable-diffusion-webui

stable-diffusion-webui 是一个基于 Gradio 构建的网页版操作界面,旨在让用户能够轻松地在本地运行和使用强大的 Stable Diffusion 图像生成模型。它解决了原始模型依赖命令行、操作门槛高且功能分散的痛点,将复杂的 AI 绘图流程整合进一个直观易用的图形化平台。 无论是希望快速上手的普通创作者、需要精细控制画面细节的设计师,还是想要深入探索模型潜力的开发者与研究人员,都能从中获益。其核心亮点在于极高的功能丰富度:不仅支持文生图、图生图、局部重绘(Inpainting)和外绘(Outpainting)等基础模式,还独创了注意力机制调整、提示词矩阵、负向提示词以及“高清修复”等高级功能。此外,它内置了 GFPGAN 和 CodeFormer 等人脸修复工具,支持多种神经网络放大算法,并允许用户通过插件系统无限扩展能力。即使是显存有限的设备,stable-diffusion-webui 也提供了相应的优化选项,让高质量的 AI 艺术创作变得触手可及。

everything-claude-code

everything-claude-code 是一套专为 AI 编程助手(如 Claude Code、Codex、Cursor 等)打造的高性能优化系统。它不仅仅是一组配置文件,而是一个经过长期实战打磨的完整框架,旨在解决 AI 代理在实际开发中面临的效率低下、记忆丢失、安全隐患及缺乏持续学习能力等核心痛点。 通过引入技能模块化、直觉增强、记忆持久化机制以及内置的安全扫描功能,everything-claude-code 能显著提升 AI 在复杂任务中的表现,帮助开发者构建更稳定、更智能的生产级 AI 代理。其独特的“研究优先”开发理念和针对 Token 消耗的优化策略,使得模型响应更快、成本更低,同时有效防御潜在的攻击向量。 这套工具特别适合软件开发者、AI 研究人员以及希望深度定制 AI 工作流的技术团队使用。无论您是在构建大型代码库,还是需要 AI 协助进行安全审计与自动化测试,everything-claude-code 都能提供强大的底层支持。作为一个曾荣获 Anthropic 黑客大奖的开源项目,它融合了多语言支持与丰富的实战钩子(hooks),让 AI 真正成长为懂上

ComfyUI

ComfyUI 是一款功能强大且高度模块化的视觉 AI 引擎,专为设计和执行复杂的 Stable Diffusion 图像生成流程而打造。它摒弃了传统的代码编写模式,采用直观的节点式流程图界面,让用户通过连接不同的功能模块即可构建个性化的生成管线。 这一设计巧妙解决了高级 AI 绘图工作流配置复杂、灵活性不足的痛点。用户无需具备编程背景,也能自由组合模型、调整参数并实时预览效果,轻松实现从基础文生图到多步骤高清修复等各类复杂任务。ComfyUI 拥有极佳的兼容性,不仅支持 Windows、macOS 和 Linux 全平台,还广泛适配 NVIDIA、AMD、Intel 及苹果 Silicon 等多种硬件架构,并率先支持 SDXL、Flux、SD3 等前沿模型。 无论是希望深入探索算法潜力的研究人员和开发者,还是追求极致创作自由度的设计师与资深 AI 绘画爱好者,ComfyUI 都能提供强大的支持。其独特的模块化架构允许社区不断扩展新功能,使其成为当前最灵活、生态最丰富的开源扩散模型工具之一,帮助用户将创意高效转化为现实。

markitdown

MarkItDown 是一款由微软 AutoGen 团队打造的轻量级 Python 工具,专为将各类文件高效转换为 Markdown 格式而设计。它支持 PDF、Word、Excel、PPT、图片(含 OCR)、音频(含语音转录)、HTML 乃至 YouTube 链接等多种格式的解析,能够精准提取文档中的标题、列表、表格和链接等关键结构信息。 在人工智能应用日益普及的今天,大语言模型(LLM)虽擅长处理文本,却难以直接读取复杂的二进制办公文档。MarkItDown 恰好解决了这一痛点,它将非结构化或半结构化的文件转化为模型“原生理解”且 Token 效率极高的 Markdown 格式,成为连接本地文件与 AI 分析 pipeline 的理想桥梁。此外,它还提供了 MCP(模型上下文协议)服务器,可无缝集成到 Claude Desktop 等 LLM 应用中。 这款工具特别适合开发者、数据科学家及 AI 研究人员使用,尤其是那些需要构建文档检索增强生成(RAG)系统、进行批量文本分析或希望让 AI 助手直接“阅读”本地文件的用户。虽然生成的内容也具备一定可读性,但其核心优势在于为机器

LLMs-from-scratch

LLMs-from-scratch 是一个基于 PyTorch 的开源教育项目,旨在引导用户从零开始一步步构建一个类似 ChatGPT 的大型语言模型(LLM)。它不仅是同名技术著作的官方代码库,更提供了一套完整的实践方案,涵盖模型开发、预训练及微调的全过程。 该项目主要解决了大模型领域“黑盒化”的学习痛点。许多开发者虽能调用现成模型,却难以深入理解其内部架构与训练机制。通过亲手编写每一行核心代码,用户能够透彻掌握 Transformer 架构、注意力机制等关键原理,从而真正理解大模型是如何“思考”的。此外,项目还包含了加载大型预训练权重进行微调的代码,帮助用户将理论知识延伸至实际应用。 LLMs-from-scratch 特别适合希望深入底层原理的 AI 开发者、研究人员以及计算机专业的学生。对于不满足于仅使用 API,而是渴望探究模型构建细节的技术人员而言,这是极佳的学习资源。其独特的技术亮点在于“循序渐进”的教学设计:将复杂的系统工程拆解为清晰的步骤,配合详细的图表与示例,让构建一个虽小但功能完备的大模型变得触手可及。无论你是想夯实理论基础,还是为未来研发更大规模的模型做准备