coai

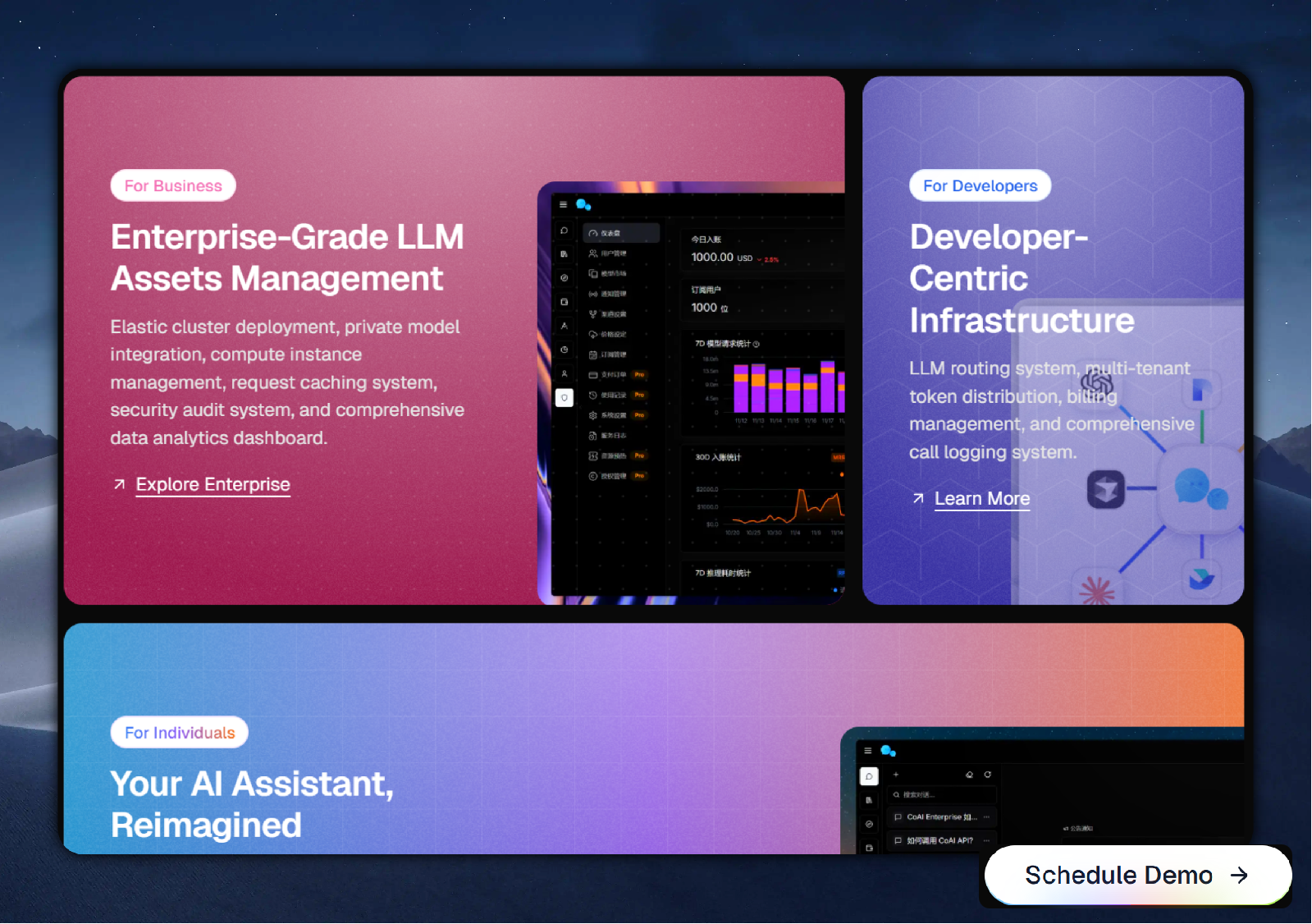

CoAI 是一款新一代多租户 AI 一站式解决方案,旨在为企业和个人提供开箱即用的大模型商业化部署服务。它巧妙融合了类似 Next Web 的精美前端交互与 One API 的强大网关能力,解决了传统方案中管理后台缺失、计费系统复杂以及多模型接入困难等痛点。

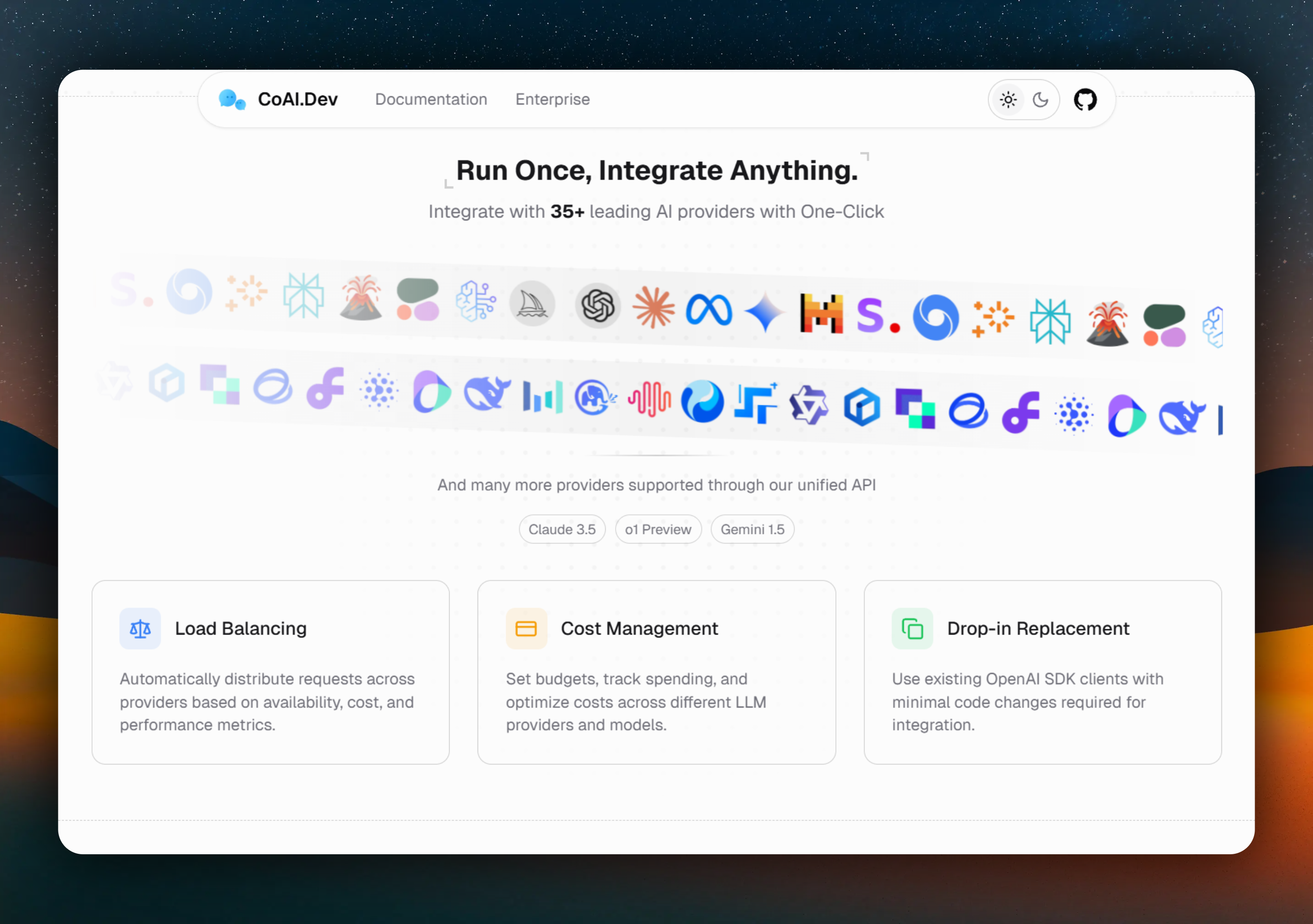

无论是希望快速搭建 AI 服务的开发者、需要统一管理算力的企业管理员,还是寻求私有化部署的创业者,CoAI 都能满足需求。其核心优势在于企业级的统一 LLM 网关,支持超过 200 种模型和 35+ 服务商,并具备基于优先级的负载均衡与智能缓存机制。

在功能亮点上,CoAI 内置了完整的行政与计费系统,支持订阅制和弹性计费等多种模式,让运营变现变得简单高效。它不仅拥有适配多端的现代化 UI 和深色模式,还集成了强大的文件解析(含 OCR)、联网搜索及文生图能力。此外,通过零成本的云同步技术,用户可轻松实现跨设备对话同步与分享,无需配置复杂的 WebDav 等依赖。配合丰富的后端仪表盘,CoAI 让构建专业级 AIGC 平台变得前所未有的轻松。

使用场景

某中型 SaaS 创业团队计划面向全球用户推出集成多种大模型的 AI 写作助手,需解决多模型接入、计费系统及跨设备同步等复杂需求。

没有 coai 时

- 开发周期漫长:团队需分别对接 OpenAI、Anthropic 等十几个供应商接口,并自行开发后台管理系统,耗时数月仍难以稳定上线。

- 计费逻辑缺失:缺乏内置的订阅与按量计费系统,无法灵活设置代币扣除规则或处理匿名调用,导致商业化变现受阻。

- 体验割裂严重:用户在不同设备间切换时对话记录无法同步,且不支持文件解析(如 PDF/Word)和联网搜索,功能单一且操作繁琐。

- 运维成本高昂:需额外部署 WebDav 或配置复杂的负载均衡策略来维持服务稳定性,技术门槛高且维护困难。

使用 coai 后

- 一站式快速部署:利用 coai 内置的 200+ 模型网关和管理后台,团队仅需一次部署即可统一管理所有模型供应商,上线时间缩短至数天。

- 灵活商业变现:直接启用 coai 的订阅制与弹性计费功能,轻松配置按请求或 Token 扣费规则,并支持礼品码管理,立即开启盈利模式。

- 全能用户体验:用户享受零成本的跨设备云同步,直接在对话框上传文档进行解析或利用 SearXNG 引擎进行全网搜索,交互流畅自然。

- 企业级稳定架构:依托 coai 自带的优先级路由负载均衡与模型缓存机制,系统自动优化流量分配,无需额外运维即可保障高并发下的稳定性。

coai 将原本需要数月构建的复杂 AI 中台能力浓缩为开箱即用的解决方案,让团队能专注于核心业务创新而非重复造轮子。

运行环境要求

- Linux

- macOS

- Windows

未说明

未说明

快速开始

🥳 CoAI.Dev

🚀 新一代 AIGC 一站式商业解决方案

"CoAI.Dev > Next Web + One API"

英语 · 简体中文 · 日语 · 文档 · Discord · 部署指南

📝 功能特性

- 🤖️ 丰富的模型支持:支持多模型服务商(OpenAI / Anthropic / Gemini / Midjourney 等十余种兼容格式及私有大模型)

- 🤯 精美的UI设计:PC / Pad / 手机全平台适配,遵循 Shadcn UI 和 Tremor Charts 设计规范,界面与后台仪表盘设计丰富美观

- 🎃 全面的Markdown支持:支持 LaTeX公式 / Mermaid思维导图 / 表格渲染 / 代码高亮 / 图表绘制 / 进度条等高级Markdown语法

- 👀 多主题支持:支持多种主题切换,包括浅色主题的 Light Mode 和深色主题的 Dark Mode。👉 自定义配色方案

- 📚 国际化支持:支持国际化多语言切换 🇨🇳 🇺🇸 🇯🇵 🇷🇺 👉 欢迎贡献翻译 Pull Request

- 🎨 文生图支持:支持多种文生图模型:OpenAI DALL-E✅、Midjourney(支持 U/V/R 操作)✅、Stable Diffusion✅ 等。

- 📡 强大的对话同步:为用户提供 零成本跨设备对话同步支持,支持 对话分享(链接分享、保存为图片、分享管理),无需依赖 WebDav / WebRTC 等复杂技术与学习成本。

- 🎈 模型市场与预设系统:支持后台自定义模型市场,提供模型介绍、标签等参数。站点所有者可根据实际情况自定义模型介绍。同时支持预设系统,包含 自定义预设 和 云端同步 功能。

- 📖 丰富的文件解析:开箱即用,支持针对 所有模型 的文件解析(PDF / Docx / Pptx / Excel / 图片格式解析),支持更多云存储方案(S3 / R2 / MinIO 等),支持OCR图像识别 👉 详情请参阅项目 CoAI.Dev Blob Service(支持 Vercel / Docker 一键部署)。

- 🌏 全模型互联网搜索:基于 SearXNG 开源引擎,支持 Google / Bing / DuckDuckGo / Yahoo / Wikipedia / Arxiv / Qwant 等丰富搜索引擎,支持安全搜索模式、内容截断、图片代理、搜索可用性测试等功能。

- 💕 渐进式Web应用(PWA):支持 PWA 应用及桌面端支持(基于 Tauri 的桌面应用)。

- 🤩 完善的后台管理:支持美观丰富的仪表盘、公告与通知管理、用户管理、订阅管理、礼品码与兑换码管理、定价设置、订阅配置、自定义模型市场、自定义站点名称与Logo、SMTP邮件设置等功能。

- 🤑 多种计费方式:支持 💴 订阅制 和 💴 弹性计费 两种计费模式。弹性计费支持按请求计费 / 按Token计费 / 不计费 / 匿名调用,以及 最低请求点数 检测等强大功能。

- 🎉 创新的模型缓存机制:支持启用模型缓存:即在相同请求参数哈希下,若此前已请求过,则直接返回缓存结果(命中缓存不计费),从而减少请求次数。可自定义是否缓存模型、缓存时间、缓存结果数量等高级缓存设置。

- 🥪 附加功能(已停止支持):🍎 AI项目生成器功能 / 📂 批量文章生成功能 / 🥪 AI卡片功能(已弃用)。

- 😎 卓越的通道管理:自研优秀通道算法,支持 ⚡ 多通道管理,支持 🥳优先级设置以确定通道调用顺序,支持 🥳权重设置以实现同优先级通道间的负载均衡概率分布,支持 🥳用户分组、🥳失败自动重试、🥳模型重定向、🥳内置上游隐藏、🥳通道状态管理等强大的 企业级功能。

- ⭐ OpenAI API 分发与代理系统:支持以 OpenAI API 标准格式调用各类大模型,集成强大的通道管理功能,只需部署一个站点即可同时开展B/C端业务💖。

- 👌 快速上游同步:通道设置、模型市场、价格设置等均可快速同步至上游站点,据此调整您的站点配置,快速搭建站点,省时省力,一键同步,快速上线。

- 👋 SEO优化:支持SEO优化,支持自定义站点名称、站点Logo等SEO优化设置,使搜索引擎更快抓取,让您的站点脱颖而出👋。

- 🎫 多重兑换码系统:支持多种兑换码系统,包括礼品码与兑换码,支持批量生成;礼品码适合推广发放,兑换码则适用于卡券销售。对于同一类型的礼品码,每位用户仅可兑换一次,一定程度上减少了促销活动中单个用户多次兑换的情况😀。

- 🥰 商业友好型许可证:采用 Apache-2.0 开源许可证,便于商业二次开发与分发(请同时遵守 Apache-2.0 许可证的相关规定,不得用于非法用途)。

✨ CoAI.Dev 商业版

- ✅ 美丽的商用级UI,优雅的前端界面与后台管理

- ✅ 支持TTS & STT、插件市场、RAG知识库等丰富功能与模块

- ✅ 更多支付提供商、更多计费模式及高级订单管理

- ✅ 支持更多认证方式,包括短信登录、OAuth登录等

- ✅ 支持模型监控、通道健康检测、故障报警与自动通道切换

- ✅ 支持多租户API Key分发系统、企业级Token权限管理与访客限制

- ✅ 支持安全审计、日志记录、模型限流、API网关等高级功能

- ✅ 支持促销奖励、专业数据统计、用户画像分析等商业分析能力

- ✅ 支持Discord/Telegram/Feishu等机器人集成能力(扩展模块)

- ...

🔨 支持的模型

- OpenAI & Azure OpenAI (✅ 视觉 ✅ 函数调用)

- Anthropic Claude (✅ 视觉 ✅ 函数调用)

- Google Gemini & PaLM2 (✅ 视觉)

- Midjourney (✅ 模式切换 ✅ U/V/R 操作)

- 科大讯飞 SparkDesk (✅ 视觉 ✅ 函数调用)

- 智谱 AI ChatGLM (✅ 视觉)

- 阿里云通义千问

- 腾讯混元

- 百川智能

- Moonshot AI (👉 OpenAI)

- DeepSeek AI (👉 OpenAI)

- 字节跳动 Skylark (✅ 函数调用)

- Groq Cloud AI

- OpenRouter (👉 OpenAI)

- 360 GPT

- LocalAI / Ollama (👉 OpenAI)

👻 OpenAI 兼容 API 代理

- 对话完成 (/v1/chat/completions)

- 图像生成 (/v1/images)

- 模型列表 (/v1/models)

- 控制台计费 (/v1/billing)

📦 部署

[!TIP] 部署成功后,管理员账号为

root,默认密码为chatnio123456

✨ Zeabur (一键)

Zeabur 提供一定的免费配额,您可以使用非付费区域进行一键部署,同时也支持套餐订阅和弹性计费,方便灵活扩展。

- 点击

Deploy进行部署,输入您希望绑定的域名,等待部署完成。- 部署完成后,请访问您的域名,并使用用户名

root和密码chatnio123456登录后台管理。请按照提示及时在 chatnio 后台更改密码。

🐳 BTPanel (一键)

- 访问 BTPanel 安装宝塔面板,使用稳定版脚本进行安装。

- 登录面板后,点击左侧的 Docker 进入 Docker 管理界面。

- 如果提示未安装 Docker / Docker Compose,可按照上方指南进行安装。

- 安装完成后,进入 应用商店,搜索

CoAI并点击 安装。 - 配置域名、端口等基础应用信息,然后点击 确认(也可使用默认配置)。

- 初次安装可能需要 1–2 分钟完成数据库初始化。如遇问题,请查看面板运行日志进行排查。

- 访问您配置的域名或服务器

http://[ip]:[port],使用用户名root和密码chatnio123456登录后台管理。

AlibabaCloud ComputeNest (一键)

- 在 ComputeNest 国际版 上访问 CoAI 服务。如果您在中国,请访问 ComputeNest,并按照提示填写部署参数。

- 选择支付方式,填写实例参数和网络参数,然后点击 下一步:确认订单。

- 确认部署参数并核对预估价格后,点击立即创建,等待服务实例部署完成。

- 在左侧点击 服务实例。服务实例部署完成后,点击实例 ID 进入详情界面。

- 在详情界面的 立即使用 中点击地址,即可进入 CoAI 界面。默认用户名为

root,密码为chatnio123456,用于登录后台管理。 - 更多操作细节和支付信息,请参阅:服务详情。

⚡ Docker Compose 安装(推荐)

[!NOTE] 成功运行后,宿主机映射地址为

http://localhost:8000

git clone --depth=1 --branch=main --single-branch https://github.com/coaidev/coai.git

cd chatnio

docker-compose up -d # 启动服务

# 如需使用稳定版,可使用 docker-compose -f docker-compose.stable.yaml up -d

# 如需使用 Watchtower 自动更新,可使用 docker-compose -f docker-compose.watch.yaml up -d

版本更新(若已启用 Watchtower 自动更新,则无需手动更新):

docker-compose down

docker-compose pull

docker-compose up -d

- MySQL 数据库挂载目录:~/db

- Redis 数据库挂载目录:~/redis

- 配置文件挂载目录:~/config

⚡ Docker 安装(轻量级运行时,常用于外部 MYSQL/RDS 服务)

[!NOTE] 成功运行后,宿主机地址为

http://localhost:8094。如需使用稳定版,可将

programzmh/chatnio:latest替换为programzmh/chatnio:stable

docker run -d --name chatnio \

--network host \

-v ~/config:/config \

-v ~/logs:/logs \

-v ~/storage:/storage \

-e MYSQL_HOST=localhost \

-e MYSQL_PORT=3306 \

-e MYSQL_DB=chatnio \

-e MYSQL_USER=root \

-e MYSQL_PASSWORD=chatnio123456 \

-e REDIS_HOST=localhost \

-e REDIS_PORT=6379 \

-e SECRET=secret \

-e SERVE_STATIC=true \

programzmh/chatnio:latest

- --network host 表示使用宿主机网络,使 Docker 容器能够共享宿主机网络。可根据需要调整。

- SECRET:JWT 密钥,需生成随机字符串并相应修改。

- SERVE_STATIC:是否启用静态文件服务(通常无需更改,详情请参阅下方 FAQ)。

- -v ~/config:/config 挂载配置文件,-v ~/logs:/logs 挂载宿主机日志目录,-v ~/storage:/storage 挂载用于存储额外功能生成文件的目录。

- MySQL 和 Redis 服务需提前配置。请参考上述信息,相应修改环境变量。

版本更新(启用 Watchtower 后无需手动更新。执行完毕后,按上述步骤重新运行):

docker stop chatnio

docker rm chatnio

docker pull programzmh/chatnio:latest

⚒ 编译与安装

[!NOTE] 部署成功后,默认端口为 8094,访问地址为

http://localhost:8094配置设置(~/config/config.yaml)可通过环境变量覆盖。例如,

MYSQL_HOST环境变量可以覆盖mysql.host配置项。

git clone https://github.com/coaidev/coai.git

cd chatnio

cd app

npm install -g pnpm

pnpm install

pnpm build

cd ..

go build -o chatnio

# 例如使用 nohup(你也可以使用 systemd 或其他服务管理器)

nohup ./chatnio > output.log & # 使用 nohup 在后台运行

📦 技术栈

- 🥗 前端:React + Redux + Radix UI + Tailwind CSS

- 🍎 后端:Golang + Gin + Redis + MySQL

- 🍒 应用技术:PWA + WebSocket

🤯 为什么创建这个项目及项目优势

我们发现市面上大多数 AIGC 商业站点都是以前端为主的轻量级部署项目,拥有精美的 UI 界面设计,比如 Next Chat 的商业版本。由于其面向个人私有化的定位,在二次商业化开发上存在一些局限性,主要体现在以下几个方面:

- 对话同步困难,例如需要依赖 WebDav 等服务,用户学习成本高,难以实现跨设备的实时同步。

- 计费方式不足,比如仅支持弹性计费或单一的订阅模式,无法满足不同用户的需求。

- 文件解析不便,例如只能先将文件上传至图床,再回到网站中将 URL 直链填入输入框,缺乏内置的文件解析功能。

- 不支持对话 URL 分享,例如仅能分享对话截图,无法直接生成对话链接进行分享(或者仅依赖 ShareGPT 等工具,难以有效推广站点)。

- 渠道管理不足,例如后端仅支持 OpenAI 格式的模型通道,难以兼容其他格式的模型;且只能配置单个通道,无法实现多渠道管理。

- 不支持 API 调用,例如仅提供用户界面调用,无法实现 API 代理与管理功能。

另一类则是以 API 分发为核心的站点,具备强大的分发系统,比如基于 One API 的项目。尽管这些项目能够支持强大的 API 代理与管理功能,但在界面设计和部分 C 端特性上却有所欠缺,具体表现为:

- 用户界面不足,例如仅提供 API 调用接口,没有内置的用户聊天界面。用户若需进行对话,必须手动复制密钥并跳转到其他平台使用,对于普通用户而言学习成本较高。

- 缺乏订阅体系,例如仅支持弹性计费,缺少针对 C 端用户的计费设计,无法满足多样化需求,且在无基础付费习惯的用户群体中,成本感知不够友好。

- C 端功能不足,例如仅支持 API 调用,而不具备对话同步、对话分享、文件解析等功能。

- 负载均衡能力有限,开源版本不支持 weight 参数,无法实现同优先级通道之间的概率性负载均衡(New API 则解决了这一痛点,并提供了更为美观的 UI)。

因此,我们希望结合这两类项目的优点,打造一个既拥有强大 API 分发系统,又具备丰富用户界面设计的项目,从而在满足 C 端用户需求的同时拓展 B 端业务,提升用户体验、降低用户学习成本,并增强用户粘性。

于是,CoAI.Dev 应运而生。我们致力于构建一个兼具强大 API 分发能力和丰富用户界面设计的项目,使其成为下一代开源 AIGC 项目的全栈商业解决方案。

❤ 捐赠

如果你觉得这个项目对你有帮助,请为它点亮一颗 Star,以表达你的支持吧!

版本历史

v4.0.02025/10/23v3.11.12025/01/20v3.102024/03/10v3.92024/01/25v3.82024/01/18v3.72024/01/04v3.62023/11/28v3.52023/10/29v3.42023/10/22v3.32023/10/05v3.22023/10/01v3.12023/09/30v3.02023/09/29v2.12023/09/08v2.02023/09/06相似工具推荐

openclaw

OpenClaw 是一款专为个人打造的本地化 AI 助手,旨在让你在自己的设备上拥有完全可控的智能伙伴。它打破了传统 AI 助手局限于特定网页或应用的束缚,能够直接接入你日常使用的各类通讯渠道,包括微信、WhatsApp、Telegram、Discord、iMessage 等数十种平台。无论你在哪个聊天软件中发送消息,OpenClaw 都能即时响应,甚至支持在 macOS、iOS 和 Android 设备上进行语音交互,并提供实时的画布渲染功能供你操控。 这款工具主要解决了用户对数据隐私、响应速度以及“始终在线”体验的需求。通过将 AI 部署在本地,用户无需依赖云端服务即可享受快速、私密的智能辅助,真正实现了“你的数据,你做主”。其独特的技术亮点在于强大的网关架构,将控制平面与核心助手分离,确保跨平台通信的流畅性与扩展性。 OpenClaw 非常适合希望构建个性化工作流的技术爱好者、开发者,以及注重隐私保护且不愿被单一生态绑定的普通用户。只要具备基础的终端操作能力(支持 macOS、Linux 及 Windows WSL2),即可通过简单的命令行引导完成部署。如果你渴望拥有一个懂你

everything-claude-code

everything-claude-code 是一套专为 AI 编程助手(如 Claude Code、Codex、Cursor 等)打造的高性能优化系统。它不仅仅是一组配置文件,而是一个经过长期实战打磨的完整框架,旨在解决 AI 代理在实际开发中面临的效率低下、记忆丢失、安全隐患及缺乏持续学习能力等核心痛点。 通过引入技能模块化、直觉增强、记忆持久化机制以及内置的安全扫描功能,everything-claude-code 能显著提升 AI 在复杂任务中的表现,帮助开发者构建更稳定、更智能的生产级 AI 代理。其独特的“研究优先”开发理念和针对 Token 消耗的优化策略,使得模型响应更快、成本更低,同时有效防御潜在的攻击向量。 这套工具特别适合软件开发者、AI 研究人员以及希望深度定制 AI 工作流的技术团队使用。无论您是在构建大型代码库,还是需要 AI 协助进行安全审计与自动化测试,everything-claude-code 都能提供强大的底层支持。作为一个曾荣获 Anthropic 黑客大奖的开源项目,它融合了多语言支持与丰富的实战钩子(hooks),让 AI 真正成长为懂上

opencode

OpenCode 是一款开源的 AI 编程助手(Coding Agent),旨在像一位智能搭档一样融入您的开发流程。它不仅仅是一个代码补全插件,而是一个能够理解项目上下文、自主规划任务并执行复杂编码操作的智能体。无论是生成全新功能、重构现有代码,还是排查难以定位的 Bug,OpenCode 都能通过自然语言交互高效完成,显著减少开发者在重复性劳动和上下文切换上的时间消耗。 这款工具专为软件开发者、工程师及技术研究人员设计,特别适合希望利用大模型能力来提升编码效率、加速原型开发或处理遗留代码维护的专业人群。其核心亮点在于完全开源的架构,这意味着用户可以审查代码逻辑、自定义行为策略,甚至私有化部署以保障数据安全,彻底打破了传统闭源 AI 助手的“黑盒”限制。 在技术体验上,OpenCode 提供了灵活的终端界面(Terminal UI)和正在测试中的桌面应用程序,支持 macOS、Windows 及 Linux 全平台。它兼容多种包管理工具,安装便捷,并能无缝集成到现有的开发环境中。无论您是追求极致控制权的资深极客,还是渴望提升产出的独立开发者,OpenCode 都提供了一个透明、可信

gemini-cli

gemini-cli 是一款由谷歌推出的开源 AI 命令行工具,它将强大的 Gemini 大模型能力直接集成到用户的终端环境中。对于习惯在命令行工作的开发者而言,它提供了一条从输入提示词到获取模型响应的最短路径,无需切换窗口即可享受智能辅助。 这款工具主要解决了开发过程中频繁上下文切换的痛点,让用户能在熟悉的终端界面内直接完成代码理解、生成、调试以及自动化运维任务。无论是查询大型代码库、根据草图生成应用,还是执行复杂的 Git 操作,gemini-cli 都能通过自然语言指令高效处理。 它特别适合广大软件工程师、DevOps 人员及技术研究人员使用。其核心亮点包括支持高达 100 万 token 的超长上下文窗口,具备出色的逻辑推理能力;内置 Google 搜索、文件操作及 Shell 命令执行等实用工具;更独特的是,它支持 MCP(模型上下文协议),允许用户灵活扩展自定义集成,连接如图像生成等外部能力。此外,个人谷歌账号即可享受免费的额度支持,且项目基于 Apache 2.0 协议完全开源,是提升终端工作效率的理想助手。

markitdown

MarkItDown 是一款由微软 AutoGen 团队打造的轻量级 Python 工具,专为将各类文件高效转换为 Markdown 格式而设计。它支持 PDF、Word、Excel、PPT、图片(含 OCR)、音频(含语音转录)、HTML 乃至 YouTube 链接等多种格式的解析,能够精准提取文档中的标题、列表、表格和链接等关键结构信息。 在人工智能应用日益普及的今天,大语言模型(LLM)虽擅长处理文本,却难以直接读取复杂的二进制办公文档。MarkItDown 恰好解决了这一痛点,它将非结构化或半结构化的文件转化为模型“原生理解”且 Token 效率极高的 Markdown 格式,成为连接本地文件与 AI 分析 pipeline 的理想桥梁。此外,它还提供了 MCP(模型上下文协议)服务器,可无缝集成到 Claude Desktop 等 LLM 应用中。 这款工具特别适合开发者、数据科学家及 AI 研究人员使用,尤其是那些需要构建文档检索增强生成(RAG)系统、进行批量文本分析或希望让 AI 助手直接“阅读”本地文件的用户。虽然生成的内容也具备一定可读性,但其核心优势在于为机器

LLMs-from-scratch

LLMs-from-scratch 是一个基于 PyTorch 的开源教育项目,旨在引导用户从零开始一步步构建一个类似 ChatGPT 的大型语言模型(LLM)。它不仅是同名技术著作的官方代码库,更提供了一套完整的实践方案,涵盖模型开发、预训练及微调的全过程。 该项目主要解决了大模型领域“黑盒化”的学习痛点。许多开发者虽能调用现成模型,却难以深入理解其内部架构与训练机制。通过亲手编写每一行核心代码,用户能够透彻掌握 Transformer 架构、注意力机制等关键原理,从而真正理解大模型是如何“思考”的。此外,项目还包含了加载大型预训练权重进行微调的代码,帮助用户将理论知识延伸至实际应用。 LLMs-from-scratch 特别适合希望深入底层原理的 AI 开发者、研究人员以及计算机专业的学生。对于不满足于仅使用 API,而是渴望探究模型构建细节的技术人员而言,这是极佳的学习资源。其独特的技术亮点在于“循序渐进”的教学设计:将复杂的系统工程拆解为清晰的步骤,配合详细的图表与示例,让构建一个虽小但功能完备的大模型变得触手可及。无论你是想夯实理论基础,还是为未来研发更大规模的模型做准备