SAX-NeRF

SAX-NeRF 是一款专为稀疏视角 X 射线三维重建打造的开源工具箱,核心功能涵盖计算机断层扫描(CT)重建与新视图合成。它主要解决了传统医学成像中因拍摄角度有限(稀疏视角)而导致重建图像模糊、细节丢失的难题,能够从极少量的 X 射线投影数据中恢复出高保真的三维结构。

这款工具非常适合医学影像研究人员、算法开发者以及相关领域的学生使用。SAX-NeRF 的独特亮点在于其“结构感知”机制,能够智能地利用物体内部的几何先验信息来填补数据缺失,显著提升了重建质量。作为一个综合性基准平台,它不仅实现了包括 SAX-NeRF 在内的 11 种前沿算法(涵盖 NeRF、3D 高斯溅射及传统优化方法),还提供了精美的可视化代码和数据生成脚本,方便用户进行公平的性能对比与二次开发。无论是希望探索低剂量 CT 成像新技术的研究者,还是需要高效复现 SOTA 模型的工程师,SAX-NeRF 都能提供强有力的支持,助力推动三维医学影像分析的发展。

使用场景

某医疗影像实验室的研究团队正试图利用极少量的 X 射线投影角度,重建高精度的肺部 CT 三维模型以辅助早期病灶诊断。

没有 SAX-NeRF 时

- 图像伪影严重:在稀疏视角(如仅用 20 个角度)下,传统解析算法重建的图像充满条纹状伪影,导致微小结节难以辨认。

- 结构细节丢失:现有的神经辐射场(NeRF)方法缺乏对解剖结构的先验感知,重建出的支气管和血管边缘模糊,甚至出现断裂。

- 研发效率低下:团队需手动集成多种基线代码进行对比实验,缺乏统一的评估框架,复现前沿算法耗时数周。

- 可视化验证困难:缺少高效的工具生成旋转视频或新视角合成图,难以直观向临床医生展示重建效果。

使用 SAX-NeRF 后

- 伪影显著抑制:借助其结构感知机制,SAX-NeRF 在同等稀疏数据下有效去除了条纹干扰,背景更纯净,病灶对比度大幅提升。

- 解剖结构还原:模型能精准捕捉肺部细微的拓扑结构,重建出的血管树连续且清晰,几何保真度达到临床可用标准。

- 一站式实验流程:依托其集成的 11 种 SOTA 方法工具箱,研究人员可快速切换不同算法进行基准测试,将对比实验周期缩短至几天。

- 直观成果展示:利用内置的高级可视化模块,一键生成高质量的新视角合成视频和转盘动画,极大提升了成果汇报的说服力。

SAX-NeRF 通过引入结构感知能力,成功解决了稀疏视角下 X 射线三维重建中伪影多、细节差的难题,为低剂量 CT 成像提供了可靠的算法基石。

运行环境要求

- Linux

必需 NVIDIA GPU,需安装 CUDA 11.3 (代码明确指定 torch==1.11.0+cu113),显存大小未说明

未说明

快速开始

简介

本仓库是一个用于X射线三维重建的综合工具箱和库,涵盖新视图合成(NVS)和计算机断层扫描(CT)重建两大任务。该仓库支持11种最先进的方法,包括6种基于NeRF的方法、2种基于3DGS的方法、2种基于优化的方法以及1种解析方法。我们还提供了转盘视频等炫酷可视化代码以及数据生成工具,以助力您的研究。如果您觉得本仓库有用,请为它点亮一颗星⭐,并考虑引用我们的论文。感谢您的支持。

最新动态

- 2025.09.18 : 我们关于基于扩散模型的解剖感知稀疏视角CT重建增强方法CARE的新工作已被NeurIPS 2025接收。祝贺Tianyu!代码和模型已在此仓库中发布。 🍒

- 2025.06.25 : 我们关于动态人体胸部呼吸CT重建的最新工作X2-Gaussian已被ICCV 2025接收。祝贺Weihao!代码和模型将在此仓库中发布。 🚀

- 2024.09.25 : 我们关于R2-Gaussian的新工作已被NeurIPS 2024接收。祝贺Ruyi!代码和模型将在此仓库中发布。 💫

- 2024.09.01 : 我们在ECCV 2024发表的工作X-Gaussian的代码已发布。欢迎试用! 🚀

- 2024.07.09 : 我们的SAX-NeRF已被加入Awesome-Transformer-Attention合集 💫

- 2024.06.16 : 我将亲自展示这项工作。我们的海报展示时间为6月20日上午10:30至下午00:30,地点为Arch 4A-E Poster #147。欢迎莅临西雅图会议中心与我交流。 :satisfied:

- 2024.06.16 : 更多原始数据和生成样本现已提供,欢迎大家使用。

- 2024.06.03 : 传统方法的代码已发布。 🚀

- 2024.06.03 : 炫酷可视化和数据生成的代码已发布。 🚀

- 2024.06.02 : 数据、代码、模型及训练日志均已公开,欢迎大家使用 :)

- 2024.03.07 : 我们的新工作X-Gaussian,首个基于3DGS的X射线成像方法,现已发表于arxiv。代码、模型和训练日志将在此仓库中发布。敬请期待。 💫

- 2024.02.26 : 我们的论文已被CVPR 2024接收。代码和预训练模型将于CVPR 2024开幕前(2024年6月19日)公开发布。敬请关注! :tada: :confetti_ball:

- 2023.11.21 : X3D基准测试已在paper-with-code网站上搭建完毕,欢迎大家进行对比。 🚀

- 2023.11.21 : 我们的论文现已发表于arxiv。我们将把本仓库打造成为X射线新视图合成和CT重建的基准平台,所有代码、模型、数据和训练日志都将公开发布。 💫

性能

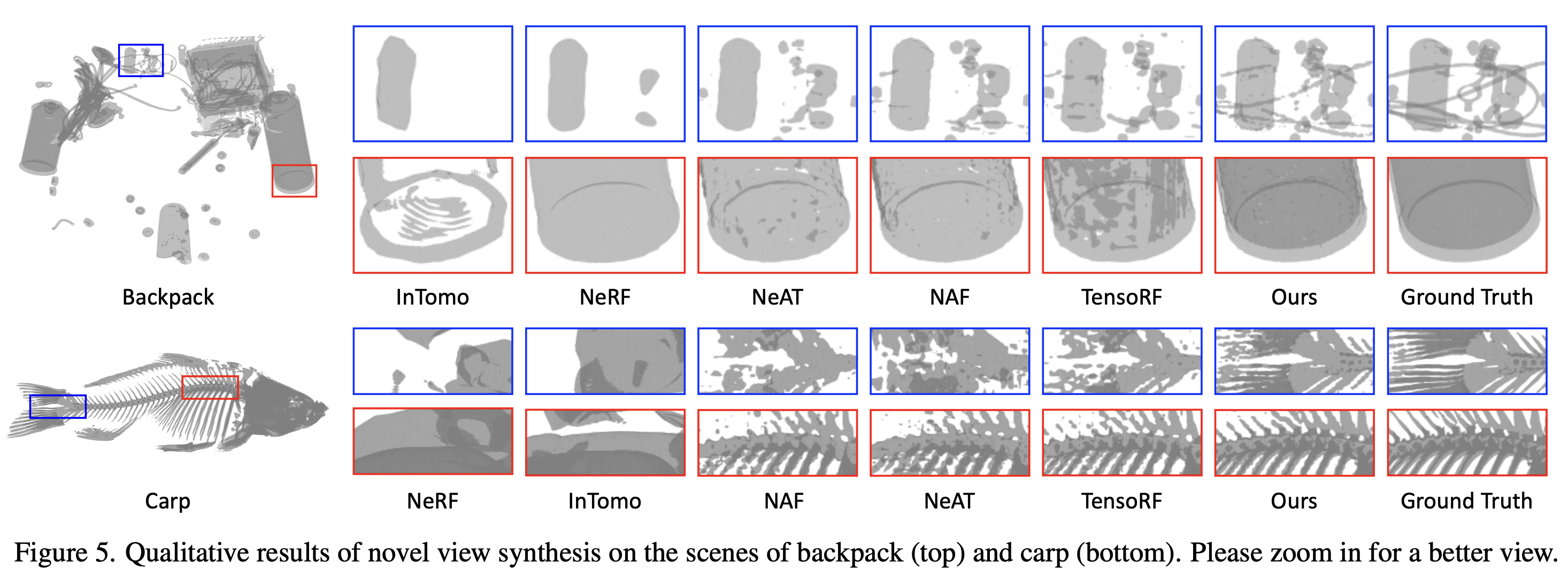

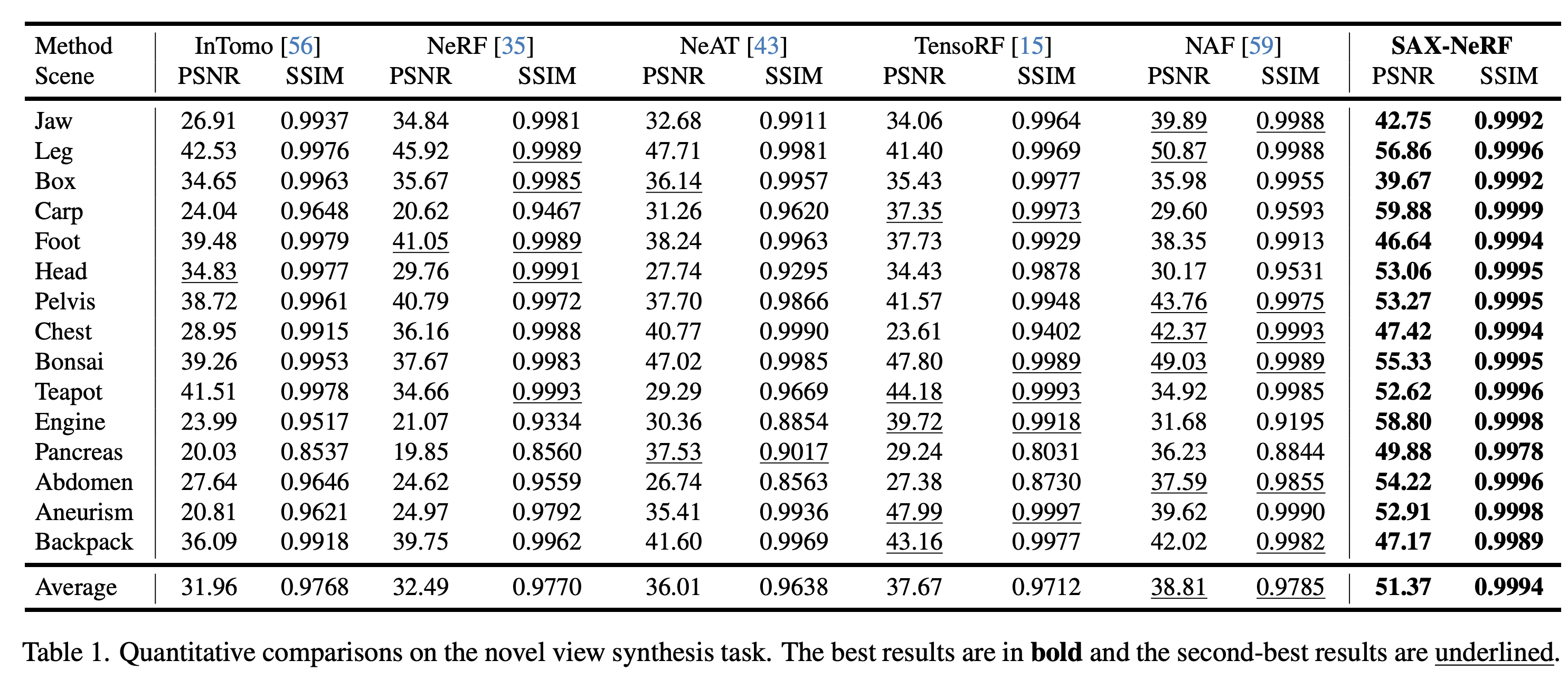

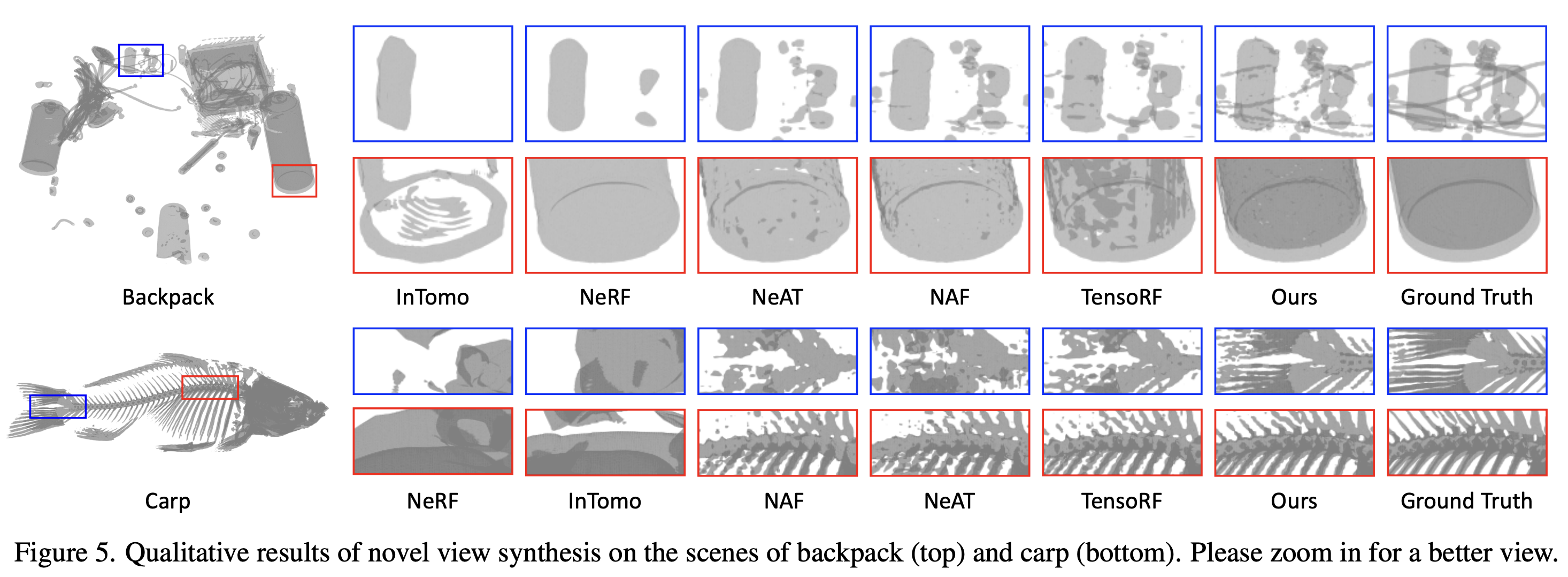

新视图合成

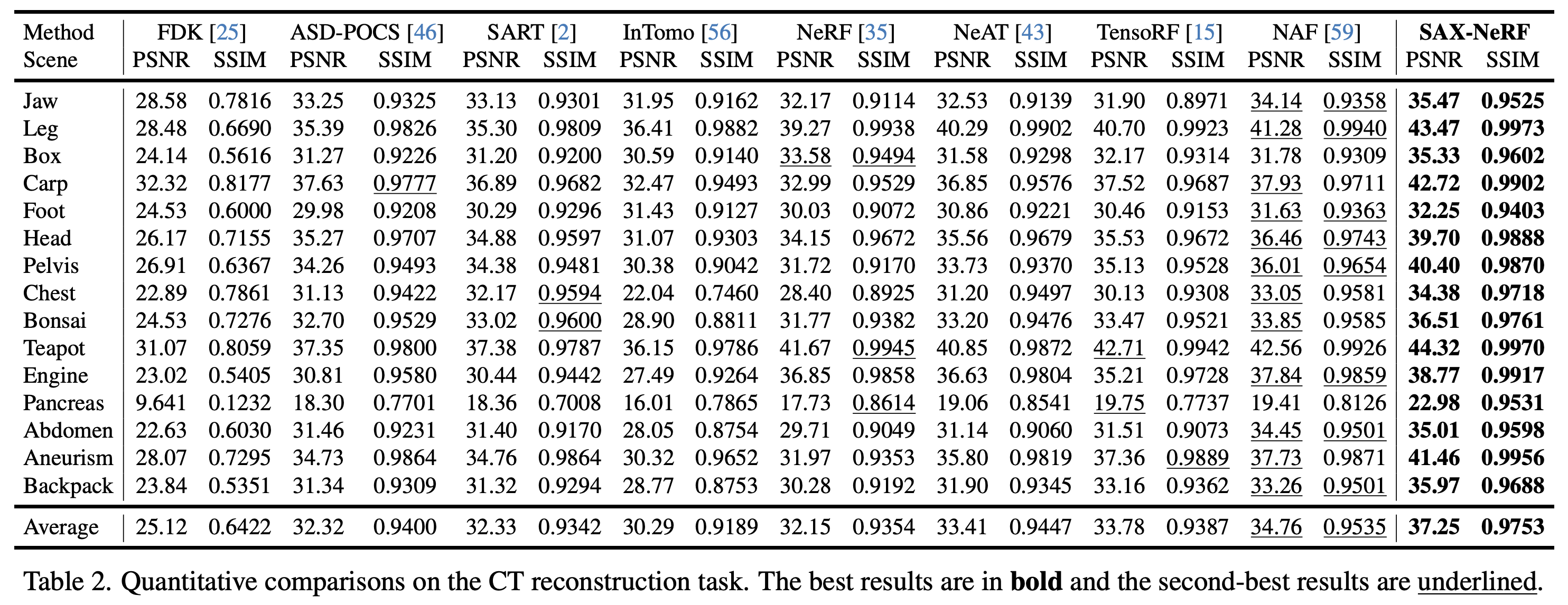

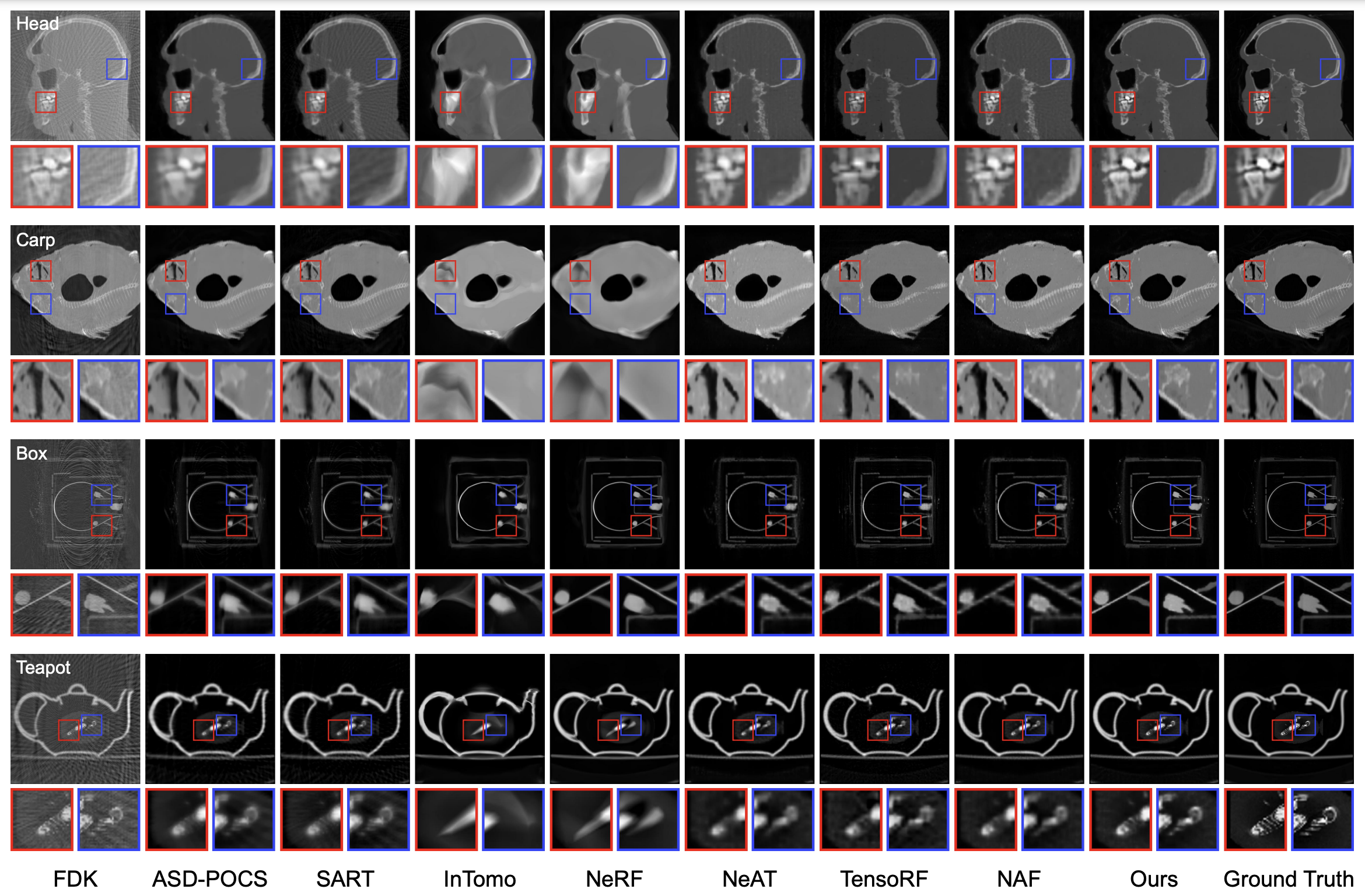

CT重建

支持的算法:

- SAX-NeRF (CVPR 2024)

- X-Gaussian (ECCV 2024)

- R2-Gaussian (NeurIPS 2024)

- X2-Gaussian (ICCV 2025)

- CARE (NeurIPS 2025)

- TensoRF (ECCV 2022)

- NAF (MICCAI 2022)

- NeAT (ACM TOG 2022)

- NeRF (ECCV 2020)

- InTomo (ICCV 2021)

- SART (超声成像,1984年)

- ASD-POCS (Physics in Medicine & Biology,2008年)

- FDK (Josa a,1984年)

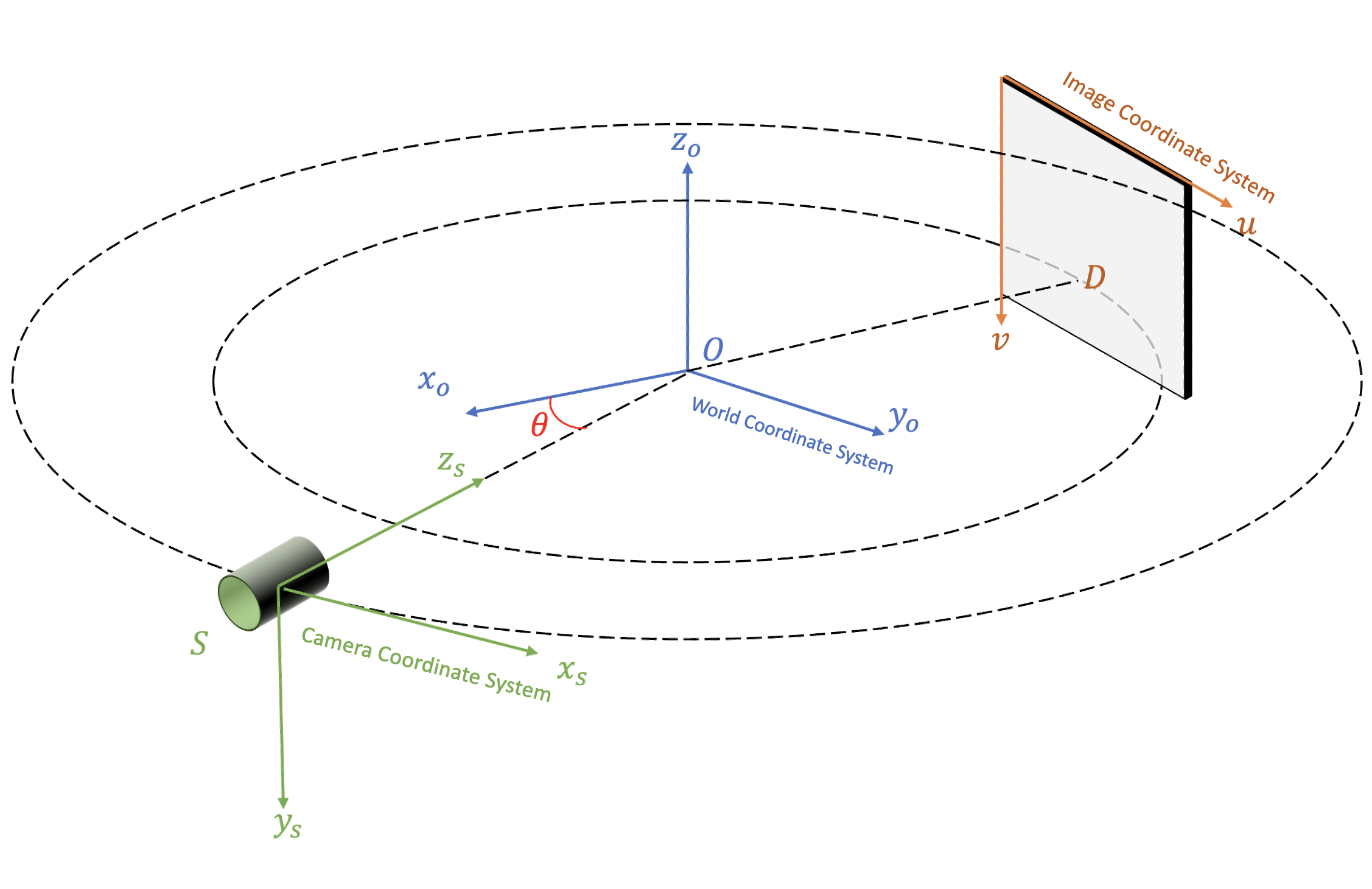

坐标系

圆锥束X射线扫描中的坐标系遵循OpenCV标准。相机、世界和图像坐标系之间的变换如下所示。

1. 创建环境:

我们建议使用Conda来设置环境。

# 创建环境

conda create -n sax_nerf python=3.9

conda activate sax_nerf

# 对于服务器上没有CUDA-11.3且无sudo权限安装的用户,请在conda环境中安装CUDA-11.3

# 否则可以跳过这些步骤

conda install -c nvidia/label/cuda-11.3.1 cuda cudnn cuda-nvcc # 为conda环境安装CUDA-11.3(及所有必要软件包)

ln -s $CONDA_PREFIX/lib $CONDA_PREFIX/lib64 # 软链接以解决TIGRE版本/路径检查问题

conda install -c conda-forge gcc=10 gxx=10 # 仅支持gcc <= 10

# 安装 PyTorch(哈希编码器需要 CUDA 11.3)

pip install torch==1.11.0+cu113 torchvision==0.12.0+cu113 torchaudio==0.11.0 --extra-index-url https://download.pytorch.org/whl/cu113

# 安装其他包

pip install -r requirements.txt

我们建议您安装 TIGRE 工具箱(2.3 版本),以执行传统的 CT 重建方法,并在计划时合成您自己的 CT 数据。请注意,当 CT 数据较大时,TIGRE v2.5 可能会卡住。

# 下载 TIGRE

wget https://github.com/CERN/TIGRE/archive/refs/tags/v2.3.zip

unzip v2.3.zip

rm v2.3.zip

# 安装 TIGRE

pip install cython==0.29.25

pip install numpy==1.21.6

cd TIGRE-2.3/Python/

python setup.py develop

2. 准备数据集:

从 Google Drive 或 百度网盘 下载我们处理好的数据集。然后将下载的数据集放入 data/ 文件夹中,结构如下:

|--data

|--chest_50.pickle

|--abdomen_50.pickle

|--aneurism_50.pickle

|--backpack_50.pickle

|--bonsai_50.pickle

|--box_50.pickle

|--carp_50.pickle

|--engine_50.pickle

|--foot_50.pickle

|--head_50.pickle

|--leg_50.pickle

|--pancreas_50.pickle

|--pelvis_50.pickle

|--teapot_50.pickle

|--jaw_50.pickle

3. 测试:

您可以直接从 Google Drive 或 百度网盘 下载我们预训练的模型。然后将下载的模型放入 pretrained/ 文件夹中,并运行以下命令:

# SAX-NeRF

python test.py --method Lineformer --category chest --config config/Lineformer/chest_50.yaml --weights pretrained/chest.tar --output_path output

# FDK

python3 eval_traditional.py --algorithm fdk --category chest --config config/FDK/chest_50.yaml

# SART

python3 eval_traditional.py --algorithm sart --category chest --config config/SART/chest_50.yaml

# ASD_POCS

python3 eval_traditional.py --algorithm asd_pocs --category chest --config config/ASD_POCS/chest_50.yaml

为了您的方便,我们提供了重建结果,存储在 Google Drive 和 百度网盘 中。

4. 训练:

我们提供了所有场景的训练日志,方便您进行调试。请从 Google Drive 或 百度网盘 下载训练日志。

# SAX-NeRF

python train_mlg.py --config config/Lineformer/chest_50.yaml

# NeRF

python train.py --config config/nerf/chest_50.yaml

# Intratomo

python train.py --config config/intratomo/chest_50.yaml

# NAF

python train.py --config config/naf/chest_50.yaml

# TensoRF

python train.py --config config/tensorf/chest_50.yaml

您可以使用 这个仓库 来运行 NeAT。请记得先重新处理数据。

5. 可视化

为了渲染一个酷炫的演示,我们在 3D_vis 文件夹中提供了可视化代码:

cd 3D_vis

python 3D_vis_backpack.py

python 3D_vis_backpack_gif.py

6. 生成您自己的数据

我们还在 dataGenerator 文件夹中提供了数据生成代码。为了让您快速上手,我们还提供了原始数据供您调试。请从 Google Drive 或 百度网盘 下载原始数据,并将其放入 dataGenerator/raw_data 文件夹中。然后运行以下命令:

cd dataGenerator

python data_vis_backpack.py

cd ..

python dataGenerator/generateData_backpack.py

7. 引用

如果本仓库对您有所帮助,请考虑引用我们的工作:

# SAX-NeRF

@inproceedings{sax_nerf,

title={结构感知的稀疏视角 X 射线三维重建},

author={袁浩才、王嘉豪、艾伦·尤伊尔、周宗伟、王昂天},

booktitle={CVPR},

year={2024}

}

# X-Gaussian

@inproceedings{x_gaussian,

title={用于高效 X 射线新视图合成的辐射高斯泼溅},

author={袁浩才、梁义勋、王嘉豪、王昂天、张宇伦、杨晓康、周宗伟、艾伦·尤伊尔},

booktitle={ECCV},

year={2024}

}

# R2-Gaussian

@inproceedings{r2_gaussian,

title={R2-Gaussian:校正辐射高斯泼溅用于断层扫描重建},

author={赵瑞怡、林涛俊、袁浩才、曹继文、张彦浩、李洪东},

booktitle={NeurIPS},

year={2024}

}

# X2-Gaussian

@inproceedings{x2_gaussian,

title={X2-Gaussian:用于连续时间断层扫描重建的四维辐射高斯泼溅},

author={于伟豪、袁浩才、赵瑞怡、范志文、李晨鑫、袁一轩},

booktitle={ICCV},

year={2025}

}

# CARE

@inproceedings{lin2025pixel,

title={像素级指标对于稀疏视角计算机断层扫描重建是否可靠?},

author={林天宇、李欣然、庄春彤、陈琪、袁浩才、丁凯、艾伦·尤伊尔、周宗伟},

booktitle={NeurIPS},

year={2025}

}

常见问题

相似工具推荐

openclaw

OpenClaw 是一款专为个人打造的本地化 AI 助手,旨在让你在自己的设备上拥有完全可控的智能伙伴。它打破了传统 AI 助手局限于特定网页或应用的束缚,能够直接接入你日常使用的各类通讯渠道,包括微信、WhatsApp、Telegram、Discord、iMessage 等数十种平台。无论你在哪个聊天软件中发送消息,OpenClaw 都能即时响应,甚至支持在 macOS、iOS 和 Android 设备上进行语音交互,并提供实时的画布渲染功能供你操控。 这款工具主要解决了用户对数据隐私、响应速度以及“始终在线”体验的需求。通过将 AI 部署在本地,用户无需依赖云端服务即可享受快速、私密的智能辅助,真正实现了“你的数据,你做主”。其独特的技术亮点在于强大的网关架构,将控制平面与核心助手分离,确保跨平台通信的流畅性与扩展性。 OpenClaw 非常适合希望构建个性化工作流的技术爱好者、开发者,以及注重隐私保护且不愿被单一生态绑定的普通用户。只要具备基础的终端操作能力(支持 macOS、Linux 及 Windows WSL2),即可通过简单的命令行引导完成部署。如果你渴望拥有一个懂你

stable-diffusion-webui

stable-diffusion-webui 是一个基于 Gradio 构建的网页版操作界面,旨在让用户能够轻松地在本地运行和使用强大的 Stable Diffusion 图像生成模型。它解决了原始模型依赖命令行、操作门槛高且功能分散的痛点,将复杂的 AI 绘图流程整合进一个直观易用的图形化平台。 无论是希望快速上手的普通创作者、需要精细控制画面细节的设计师,还是想要深入探索模型潜力的开发者与研究人员,都能从中获益。其核心亮点在于极高的功能丰富度:不仅支持文生图、图生图、局部重绘(Inpainting)和外绘(Outpainting)等基础模式,还独创了注意力机制调整、提示词矩阵、负向提示词以及“高清修复”等高级功能。此外,它内置了 GFPGAN 和 CodeFormer 等人脸修复工具,支持多种神经网络放大算法,并允许用户通过插件系统无限扩展能力。即使是显存有限的设备,stable-diffusion-webui 也提供了相应的优化选项,让高质量的 AI 艺术创作变得触手可及。

everything-claude-code

everything-claude-code 是一套专为 AI 编程助手(如 Claude Code、Codex、Cursor 等)打造的高性能优化系统。它不仅仅是一组配置文件,而是一个经过长期实战打磨的完整框架,旨在解决 AI 代理在实际开发中面临的效率低下、记忆丢失、安全隐患及缺乏持续学习能力等核心痛点。 通过引入技能模块化、直觉增强、记忆持久化机制以及内置的安全扫描功能,everything-claude-code 能显著提升 AI 在复杂任务中的表现,帮助开发者构建更稳定、更智能的生产级 AI 代理。其独特的“研究优先”开发理念和针对 Token 消耗的优化策略,使得模型响应更快、成本更低,同时有效防御潜在的攻击向量。 这套工具特别适合软件开发者、AI 研究人员以及希望深度定制 AI 工作流的技术团队使用。无论您是在构建大型代码库,还是需要 AI 协助进行安全审计与自动化测试,everything-claude-code 都能提供强大的底层支持。作为一个曾荣获 Anthropic 黑客大奖的开源项目,它融合了多语言支持与丰富的实战钩子(hooks),让 AI 真正成长为懂上

ComfyUI

ComfyUI 是一款功能强大且高度模块化的视觉 AI 引擎,专为设计和执行复杂的 Stable Diffusion 图像生成流程而打造。它摒弃了传统的代码编写模式,采用直观的节点式流程图界面,让用户通过连接不同的功能模块即可构建个性化的生成管线。 这一设计巧妙解决了高级 AI 绘图工作流配置复杂、灵活性不足的痛点。用户无需具备编程背景,也能自由组合模型、调整参数并实时预览效果,轻松实现从基础文生图到多步骤高清修复等各类复杂任务。ComfyUI 拥有极佳的兼容性,不仅支持 Windows、macOS 和 Linux 全平台,还广泛适配 NVIDIA、AMD、Intel 及苹果 Silicon 等多种硬件架构,并率先支持 SDXL、Flux、SD3 等前沿模型。 无论是希望深入探索算法潜力的研究人员和开发者,还是追求极致创作自由度的设计师与资深 AI 绘画爱好者,ComfyUI 都能提供强大的支持。其独特的模块化架构允许社区不断扩展新功能,使其成为当前最灵活、生态最丰富的开源扩散模型工具之一,帮助用户将创意高效转化为现实。

LLMs-from-scratch

LLMs-from-scratch 是一个基于 PyTorch 的开源教育项目,旨在引导用户从零开始一步步构建一个类似 ChatGPT 的大型语言模型(LLM)。它不仅是同名技术著作的官方代码库,更提供了一套完整的实践方案,涵盖模型开发、预训练及微调的全过程。 该项目主要解决了大模型领域“黑盒化”的学习痛点。许多开发者虽能调用现成模型,却难以深入理解其内部架构与训练机制。通过亲手编写每一行核心代码,用户能够透彻掌握 Transformer 架构、注意力机制等关键原理,从而真正理解大模型是如何“思考”的。此外,项目还包含了加载大型预训练权重进行微调的代码,帮助用户将理论知识延伸至实际应用。 LLMs-from-scratch 特别适合希望深入底层原理的 AI 开发者、研究人员以及计算机专业的学生。对于不满足于仅使用 API,而是渴望探究模型构建细节的技术人员而言,这是极佳的学习资源。其独特的技术亮点在于“循序渐进”的教学设计:将复杂的系统工程拆解为清晰的步骤,配合详细的图表与示例,让构建一个虽小但功能完备的大模型变得触手可及。无论你是想夯实理论基础,还是为未来研发更大规模的模型做准备

Deep-Live-Cam

Deep-Live-Cam 是一款专注于实时换脸与视频生成的开源工具,用户仅需一张静态照片,即可通过“一键操作”实现摄像头画面的即时变脸或制作深度伪造视频。它有效解决了传统换脸技术流程繁琐、对硬件配置要求极高以及难以实时预览的痛点,让高质量的数字内容创作变得触手可及。 这款工具不仅适合开发者和技术研究人员探索算法边界,更因其极简的操作逻辑(仅需三步:选脸、选摄像头、启动),广泛适用于普通用户、内容创作者、设计师及直播主播。无论是为了动画角色定制、服装展示模特替换,还是制作趣味短视频和直播互动,Deep-Live-Cam 都能提供流畅的支持。 其核心技术亮点在于强大的实时处理能力,支持口型遮罩(Mouth Mask)以保留使用者原始的嘴部动作,确保表情自然精准;同时具备“人脸映射”功能,可同时对画面中的多个主体应用不同面孔。此外,项目内置了严格的内容安全过滤机制,自动拦截涉及裸露、暴力等不当素材,并倡导用户在获得授权及明确标注的前提下合规使用,体现了技术发展与伦理责任的平衡。