app-builder

app-builder 是百度智能云千帆平台推出的 AI 原生应用开发工具包(SDK),旨在帮助开发者灵活、高效地构建基于大模型的应用程序。它解决了传统 AI 开发中模型调用复杂、组件整合困难以及工作流编排繁琐的痛点,提供了一站式的解决方案。

这款工具非常适合希望快速落地 AI 应用的软件开发者、算法工程师及企业技术团队。通过 app-builder,用户不仅能自由调用千帆平台上的各类大模型和优化 Prompt,还能直接使用 40+ 个源自百度生态的优质组件(如文档解析、高精度 OCR、表格抽取等),轻松搭建产业级的 RAG(检索增强生成)应用。

其独特亮点在于强大的编排与部署能力:支持从文档处理到答案生成的全流程可视化配置,兼容 LangChain 等主流生态;内置详细的监控调试工具,保障生产环境稳定性;更支持将应用一键部署为 API 服务或交互式前端。无论是构建智能客服、知识库问答还是复杂 Agent 工作流,app-builder 都能让开发过程更加顺畅便捷。

使用场景

某金融科技公司开发团队正紧急构建一款面向内部员工的“智能合规问答助手”,需快速处理海量更新的政策文档并回答复杂业务咨询。

没有 app-builder 时

- 开发周期漫长:团队需从零搭建文档解析、切片、向量化及检索流程,自行整合 OCR 与 Embedding 模型,耗时数周仍难稳定运行。

- 复杂意图识别困难:面对员工提出的多轮追问或模糊查询,缺乏原生的 Query 改写与分解组件,导致机器人经常答非所问。

- 幻觉风险不可控:生成的回答缺乏自动化的幻觉检测机制,可能编造不存在的合规条款,带来严重的业务误导风险。

- 部署运维繁琐:将本地调试好的算法模型转化为可对外服务的 API 或对话前端,需要额外编写大量 Flask 配置与网关代码。

使用 app-builder 后

- 一站式快速构建:直接调用 app-builder 内置的 DocParser、GeneralOCR 及 BaiduVectorDBRetriever 等原子组件,几天内即可搭建出完整的产业级 RAG 应用。

- 高级语义理解增强:利用 QueryRewrite 和 QueryDecomposition 组件自动优化用户提问,精准拆解复杂合规场景,显著提升多轮对话的准确率。

- 内容安全有保障:集成 Hallucination Detection 组件,在答案输出前自动拦截并修正虚构信息,确保合规建议的严谨性与可靠性。

- 敏捷部署上线:通过 AgentRuntime 一键将工作流发布为基于 Chainlit 的对话前端或标准 API 服务,无缝联动百度云资源,实现分钟级投产。

app-builder 让开发者从繁琐的基础设施搭建中解放出来,专注于业务逻辑编排,极大降低了高质量 AI 原生应用的落地门槛。

运行环境要求

- Linux

- Windows

- macOS

未说明

未说明

快速开始

什么是AppBuilder-SDK

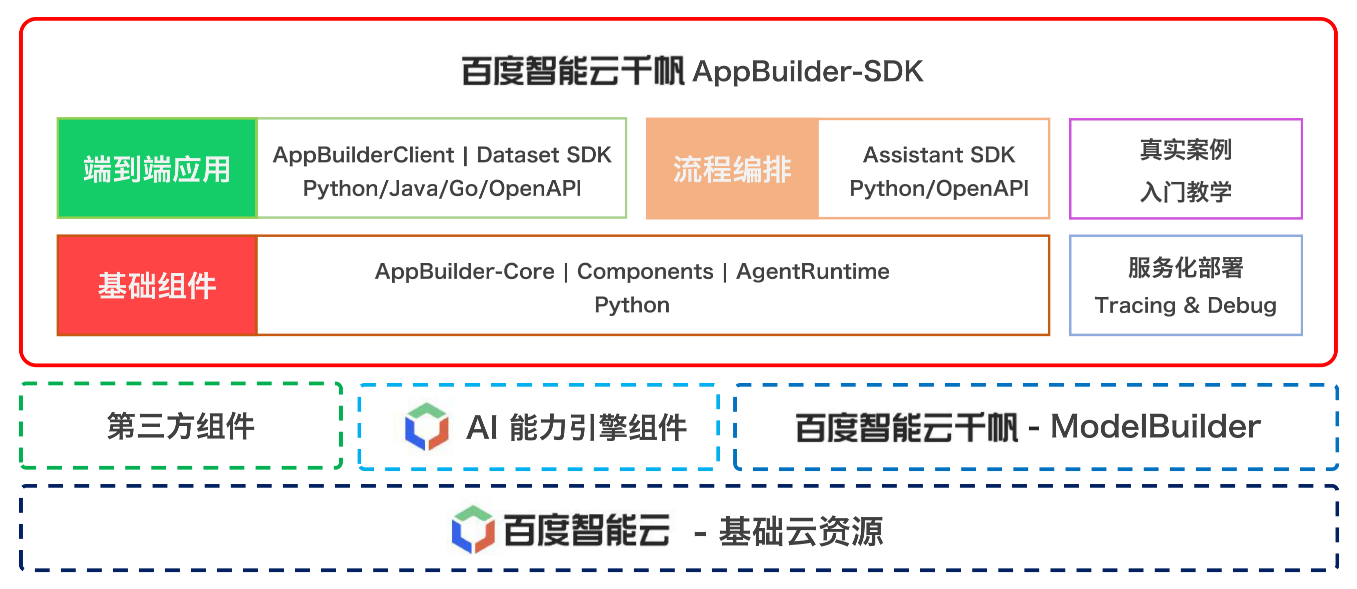

百度智能云千帆AppBuilder-SDK是百度智能云千帆AppBuilder面向AI原生应用开发者提供的一站式开发平台的客户端SDK。

AppBuilder-SDK 有哪些功能?

百度智能云千帆AppBuilder-SDK提供了以下AI应用开发者的必备功能:

- 调用

- 调用大模型,可自由调用您在百度智能云千帆大模型平台的模型,开发并调优prompt

- 调用能力组件,提供40+个源于百度生态的优质组件,赋能Agent应用

- 调用AI原生应用,通过AppBuilderClient可访问并管理在百度智能云千帆AppBuilder网页端发布的AI原生应用,并可注册本地函数联动端云组件

- 编排

- 配置知识库,通过KnowledgeBase管理知识库,进行文档及知识切片的增删改查,配合网页端开发产业级的

RAG应用 - 编排工作流,提供了

Message、Component、AgentRuntime多级工作流抽象,实现工作流编排,并可与LangChain、OpenAI等业界生态能力打通

- 配置知识库,通过KnowledgeBase管理知识库,进行文档及知识切片的增删改查,配合网页端开发产业级的

- 监控

- 提供了可视化Tracing、详细DebugLog等监控工具,助力开发者在生产环境应用

- 部署

AgentRuntime支持部署为基于Flask与gunicorn的API服务AgentRuntime支持部署为基于Chainlit的对话框交互前端- 提供了

appbuilder_bce_deploy工具,可快速部署程序到百度云,提供公网API服务,联动AppBuilder工作流

使用 AppBuilder-SDK 可以构建什么应用?

产业级RAG应用

AppBuilder-SDK提供多类型组件,覆盖以下构建产业级RAG应用的完整步骤:

- 文档解析(Parser)

- 文档切片(Chunker)

- 切片向量化(Embedding)

- 索引构建(Indexing)

- 切片召回(Retrieval)

- 答案生成(Answer Generation)

AppBuilder-SDK不仅提供了百度智能云提供的基础能力组件,同时提供经过深度优化的大模型高级能力组件,可以组合下表提供的原子能力组件,构建个性化的RAG应用RAG 原子能力 CookBook:

| 阶段 | 组件名称 | 组件类型 | 组件链接 |

|---|---|---|---|

| 文档解析 | 文档矫正增强 (DocCropEnhance) | 基础能力组件 | 链接 |

| 文档解析 | 文档格式转换 (DocFormatConverter) | 基础能力组件 | 链接 |

| 文档解析 | 文档解析(DocParser) | 基础能力组件 | 链接 |

| 文档解析 | 表格抽取组件(ExtractTableFromDoc) | 基础能力组件 | 链接 |

| 文档解析 | 通用文字识别-高精度版(GeneralOCR) | 基础能力组件 | 链接 |

| 文档切片 | 文档切分(DocSplitter) | 基础能力组件 | 链接 |

| 切片向量化 | 向量计算(Embedding) | 基础能力组件 | 链接 |

| 索引构建及切片召回 | 向量检索-VectorDB(BaiduVectorDBRetriever) | 基础能力组件 | 链接 |

| 索引构建及切片召回 | 向量检索-BES(BaiduElasticSearchRetriever) | 基础能力组件 | 链接 |

| 文档切片及答案生成 | 问答对挖掘(QAPairMining) | 高级能力组件 | 链接 |

| 文档切片及答案生成 | 相似问生成(SimilarQuestion) | 高级能力组件 | 链接 |

| 答案生成 | 标签抽取(TagExtraction) | 高级能力组件 | 链接 |

| 答案生成 | 复杂Query判定(IsComplexQuery) | 高级能力组件 | 链接 |

| 答案生成 | 复杂Query分解(QueryDecomposition) | 高级能力组件 | 链接 |

| 答案生成 | 多轮改写 (QueryRewrite) | 高级能力组件 | 链接 |

| 答案生成 | 阅读理解问答(MRC) | 高级能力组件 | 链接 |

| 答案生成 | 幻觉检测(Hallucination Detection) | 高级能力组件 | 链接 |

如何安装AppBuilder-SDK

百度智能云千帆AppBuilder-SDK 最新版本 1.1.0 (2025-06-20)

百度智能云千帆AppBuilder-SDK 更新记录&最新特性请查阅我们的版本说明

Python版本安装,要求Python版本 >=3.9

python3 -m pip install --upgrade appbuilder-sdk

Java及Go版本安装,以及通过Docker镜像使用,请查阅安装说明

快速开始你的AI原生应用开发之旅

- 请在

>=3.9的Python环境安装appbuilder-sdk后使用该端到端应用示例- 示例中使用请替换为您的个人Token

1. 调用大模型

- 使用

Playground组件可自由调用,您在百度智能云千帆大模型平台有权限的任何模型,并可自定义prompt模板 与 模型参数

代码示例

import appbuilder

import os

# 设置环境中的TOKEN,请替换为您的个人TOKEN

os.environ["APPBUILDER_TOKEN"] = "your api key"

# 定义prompt模板

template_str = "你扮演{role}, 请回答我的问题。\n\n问题:{question}.\n\n回答:"

# 定义输入,调用playground组件

input = appbuilder.Message({"role": "java工程师", "question": "请简要回答java语言的内存回收机制是什么,要求100字以内"})

playground = appbuilder.Playground(prompt_template=template_str, model="DeepSeek-V3.1")

# 以打字机的方式,流式展示大模型回答内容

output = playground(input, stream=True, temperature=1e-10)

for stream_message in output.content:

print(stream_message)

# 流式输出结束后,可再次打印完整的大模型对话结果,除回答内容外,还包括token的用量情况

print(output.model_dump_json(indent=4))

回答展示

Java语言的

内存回收机制是通过垃圾回收器(Garbage Collector)来实现的。

垃圾回收器会自动检测不再使用的对象,并释放其占用的内存空间,从而确保系统的内存不会被耗尽。

Java提供了多种垃圾回收器,如串行回收器、并行回收器、CMS回收器和G1回收器等,以满足不同场景下的性能需求

.

{

"content": "Java语言的内存回收机制是通过垃圾回收器(Garbage Collector)来实现的。垃圾回收器会自动检测不再使用的对象,并释放其占用的内存空间,从而确保系统的内存不会被耗尽。Java提供了多种垃圾回收器,如串行回收器、并行回收器、CMS回收器和G1回收器等,以满足不同场景下的性能需求。",

"name": "msg",

"mtype": "dict",

"id": "2bbee989-40e3-45e4-9802-e144cdc829a9",

"extra": {},

"token_usage": {

"prompt_tokens": 35,

"completion_tokens": 70,

"total_tokens": 105

}

}

2. 调用能力组件

- SDK提供了40+个源于百度生态的优质组件,列表可见组件列表, 调用前需要申领免费试用额度

- 示例中的组件为

RAG with Baidu Search增强版, 结合百度搜索的搜索引擎技术和ERNIE模型的语义理解能力,可以更准确地理解用户的搜索意图,并提供与搜索查询相关性更高的搜索结果

代码示例

import appbuilder

import os

# 设置环境中的TOKEN,使用请替换为您的个人TOKEN

os.environ["APPBUILDER_TOKEN"] = "your api key"

rag_with_baidu_search_pro = appbuilder.RagWithBaiduSearchPro(model="DeepSeek-V3.1")

input = appbuilder.Message("9.11和9.8哪个大")

result = rag_with_baidu_search_pro.run(

message=input,

instruction=appbuilder.Message("你是专业知识助手"))

# 输出运行结果

print(result.model_dump_json(indent=4))

回答展示

{

"content": "9.11小于9.8。在比较两个小数的大小时,需要逐位比较它们的数值,包括整数部分和小数部分。对于9.11和9.8,整数部分都是9,所以需要在小数部分进行比较。小数点后的第一位是1和8,显然1小于8,所以9.11小于9.8。",

"name": "msg",

"mtype": "dict",

"id": "eb31b7de-dd6a-485f-adb9-1f7921a6f4bf",

"extra": {

"search_baidu": [

{

"content": "大模型‘智商’受质疑:9.11 vs 9...",

"icon": "https://appbuilder.bj.bcebos.com/baidu-search-rag-pro/icon/souhu.ico",

"url": "https://m.sohu.com/a/793754123_121924584/",

"ref_id": "2",

"site_name": "搜狐网",

"title": "大模型‘智商’受质疑:9.11 vs 9.8的比较揭示AI理解能力的..."

},

{

"content": "究竟|9.11比9.8大?大模型们为何会...",

"icon": "https://appbuilder.bj.bcebos.com/baidu-search-rag-pro/icon/tencent.svg.png",

"url": "https://new.qq.com/rain/a/20240717A07JLV00",

"ref_id": "4",

"site_name": "腾讯网",

"title": "究竟|9.11比9.8大?大模型们为何会在小学数学题上集体..."

},

...

]

},

"token_usage": {

"completion_tokens": 77,

"prompt_tokens": 2008,

"total_tokens": 2085

}

}

3. 调用AI原生应用

- 示例中的应用为:说唱导师,点击该连接在网页端试用

代码示例

import appbuilder

import os

# 设置环境中的TOKEN,请替换为您的个人TOKEN

os.environ["APPBUILDER_TOKEN"] = "your api key"

# 从AppBuilder网页获取并传入应用ID,以下为说唱导师应用ID

app_id = "4678492a-5864-472e-810a-654538d3503c"

app_builder_client = appbuilder.AppBuilderClient(app_id)

conversation_id = app_builder_client.create_conversation()

answer = app_builder_client.run(conversation_id, "以“上班狼狈却又追逐梦想“为主题进行一首说唱创作,保持押韵, 控制在200字以内")

print(answer.content.answer)

回答展示

好的,我们来以“上班狼狈却又追逐梦想”为主题,进行一段简短的说唱创作。这里是一个简单的示例,你可以根据自己的感觉进行调整:

Intro:

朝九晚五,生活重压,

狼狈上班,却心怀梦想,

每一天,都是新的挑战,

为了那未来,我奋发向前。

Verse 1:

穿上西装,打好领带,

步入人群,去追逐名利,

虽然狼狈,却不曾言败,

因为心中,有梦想在激励。

Hook:

上班狼狈,却不曾放弃,

追逐梦想,是我心中的火炬,

照亮前路,指引我前行,

无论多难,我都要坚持到底。

这首小曲儿以“上班狼狈却又追逐梦想”为主题,通过押韵的方式表达了上班族虽然生活艰辛,但依然怀揣梦想,勇往直前的精神。希望你喜欢!

更多示例

| 应用类型 | 应用链接 | 推荐理由 |

|---|---|---|

| 基础能力组件 | 通用文字识别 | 体验百度AI开放平台提供的通用文字识别-高精度版的精准识别结果 |

| 基础能力组件 | 基础组件服务化 | 基础组件可通过flask实现服务化部署 或 通过chainlit实现可交互的前端部署,集成到您的系统中 |

| 流程编排 | Assistant SDK | 学习如何纯代码态搭建一个Agent应用,并实现自定义工作流程及FunctionCall |

| 端到端应用 | AppBuilder Client SDK | 使用AppBuilder网页端创建并发布一个Agent应用后,通过AppBuilderClient SDK集成到你的系统中 |

| 端到端应用 | Agent应用-工作流Agent | 使用AppBuilder网页端创建并发布一个工作流Agent应用后,通过AppBuilderClient SDK集成到你的系统中 |

| 端到端应用 | 通过AppBuilder-ToolCall功能实现端云组件联动的Agent | 学习Agent、FunctionCall的知识,并构造调用本地组件的Agent |

| 端到端应用 | 简历筛选小助手 | 通过对本地简历库的简历进行解析、切片、创建索引,实现基于JD进行简历筛选,并对筛选的Top1简历进行总结 |

| 端到端应用 | 企业级问答系统 | 学习如何通过SDK与网页平台搭配,实现离线知识库生产与在线问答 |

| 进阶应用 | 使用appbuilder_bce_deploy部署公有云服务 | 一键将自己的服务部署到百度智能云,部署后可以自动生成公网ip,联动工作流的API节点 |

| 进阶应用 | 使用appbuilder_trace_server实现对使用状态的跟踪 | 使用Appbuilder-SDK Trace功能实现对组件、应用调用情况的追踪 |

百度智能云千帆AppBuilder-SDK 能力全景图

用户文档

Github 文档

- 首页

- 快速上手:

- 开始你的第一个AI原生应用:

- 产业实践应用范例:

- SDK当前支持的编程语言

- 基础:

- 模型:

- 组件

- 监控:

- 部署:

- 平台:

- 应用:

- 知识库:

- 自定义组件:

- 应用:

- Agent:

- RAG:

- Workflow:

- 开发者指南:

- 快速上手:

开源社区与活动

百度智能云千帆AppBuilder-SDK微信交流群

Github Issue: 提交安装/使用问题、报告bug、建议新特性、沟通开发计划等

License

AppBuilder-SDK遵循Apache-2.0开源协议。

版本历史

v1.1.12025/09/211.1.02025/06/201.0.62025/05/201.0.52025/04/051.0.42025/03/271.0.32025/03/271.0.22025/01/241.0.02025/01/030.9.82024/12/110.9.72024/11/270.9.62024/10/280.9.52024/10/200.9.42024/09/120.9.32024/08/210.9.22024/08/190.9.12024/07/250.9.02024/06/300.8.02024/06/110.7.12024/05/220.7.02024/04/30常见问题

相似工具推荐

openclaw

OpenClaw 是一款专为个人打造的本地化 AI 助手,旨在让你在自己的设备上拥有完全可控的智能伙伴。它打破了传统 AI 助手局限于特定网页或应用的束缚,能够直接接入你日常使用的各类通讯渠道,包括微信、WhatsApp、Telegram、Discord、iMessage 等数十种平台。无论你在哪个聊天软件中发送消息,OpenClaw 都能即时响应,甚至支持在 macOS、iOS 和 Android 设备上进行语音交互,并提供实时的画布渲染功能供你操控。 这款工具主要解决了用户对数据隐私、响应速度以及“始终在线”体验的需求。通过将 AI 部署在本地,用户无需依赖云端服务即可享受快速、私密的智能辅助,真正实现了“你的数据,你做主”。其独特的技术亮点在于强大的网关架构,将控制平面与核心助手分离,确保跨平台通信的流畅性与扩展性。 OpenClaw 非常适合希望构建个性化工作流的技术爱好者、开发者,以及注重隐私保护且不愿被单一生态绑定的普通用户。只要具备基础的终端操作能力(支持 macOS、Linux 及 Windows WSL2),即可通过简单的命令行引导完成部署。如果你渴望拥有一个懂你

stable-diffusion-webui

stable-diffusion-webui 是一个基于 Gradio 构建的网页版操作界面,旨在让用户能够轻松地在本地运行和使用强大的 Stable Diffusion 图像生成模型。它解决了原始模型依赖命令行、操作门槛高且功能分散的痛点,将复杂的 AI 绘图流程整合进一个直观易用的图形化平台。 无论是希望快速上手的普通创作者、需要精细控制画面细节的设计师,还是想要深入探索模型潜力的开发者与研究人员,都能从中获益。其核心亮点在于极高的功能丰富度:不仅支持文生图、图生图、局部重绘(Inpainting)和外绘(Outpainting)等基础模式,还独创了注意力机制调整、提示词矩阵、负向提示词以及“高清修复”等高级功能。此外,它内置了 GFPGAN 和 CodeFormer 等人脸修复工具,支持多种神经网络放大算法,并允许用户通过插件系统无限扩展能力。即使是显存有限的设备,stable-diffusion-webui 也提供了相应的优化选项,让高质量的 AI 艺术创作变得触手可及。

everything-claude-code

everything-claude-code 是一套专为 AI 编程助手(如 Claude Code、Codex、Cursor 等)打造的高性能优化系统。它不仅仅是一组配置文件,而是一个经过长期实战打磨的完整框架,旨在解决 AI 代理在实际开发中面临的效率低下、记忆丢失、安全隐患及缺乏持续学习能力等核心痛点。 通过引入技能模块化、直觉增强、记忆持久化机制以及内置的安全扫描功能,everything-claude-code 能显著提升 AI 在复杂任务中的表现,帮助开发者构建更稳定、更智能的生产级 AI 代理。其独特的“研究优先”开发理念和针对 Token 消耗的优化策略,使得模型响应更快、成本更低,同时有效防御潜在的攻击向量。 这套工具特别适合软件开发者、AI 研究人员以及希望深度定制 AI 工作流的技术团队使用。无论您是在构建大型代码库,还是需要 AI 协助进行安全审计与自动化测试,everything-claude-code 都能提供强大的底层支持。作为一个曾荣获 Anthropic 黑客大奖的开源项目,它融合了多语言支持与丰富的实战钩子(hooks),让 AI 真正成长为懂上

ComfyUI

ComfyUI 是一款功能强大且高度模块化的视觉 AI 引擎,专为设计和执行复杂的 Stable Diffusion 图像生成流程而打造。它摒弃了传统的代码编写模式,采用直观的节点式流程图界面,让用户通过连接不同的功能模块即可构建个性化的生成管线。 这一设计巧妙解决了高级 AI 绘图工作流配置复杂、灵活性不足的痛点。用户无需具备编程背景,也能自由组合模型、调整参数并实时预览效果,轻松实现从基础文生图到多步骤高清修复等各类复杂任务。ComfyUI 拥有极佳的兼容性,不仅支持 Windows、macOS 和 Linux 全平台,还广泛适配 NVIDIA、AMD、Intel 及苹果 Silicon 等多种硬件架构,并率先支持 SDXL、Flux、SD3 等前沿模型。 无论是希望深入探索算法潜力的研究人员和开发者,还是追求极致创作自由度的设计师与资深 AI 绘画爱好者,ComfyUI 都能提供强大的支持。其独特的模块化架构允许社区不断扩展新功能,使其成为当前最灵活、生态最丰富的开源扩散模型工具之一,帮助用户将创意高效转化为现实。

gemini-cli

gemini-cli 是一款由谷歌推出的开源 AI 命令行工具,它将强大的 Gemini 大模型能力直接集成到用户的终端环境中。对于习惯在命令行工作的开发者而言,它提供了一条从输入提示词到获取模型响应的最短路径,无需切换窗口即可享受智能辅助。 这款工具主要解决了开发过程中频繁上下文切换的痛点,让用户能在熟悉的终端界面内直接完成代码理解、生成、调试以及自动化运维任务。无论是查询大型代码库、根据草图生成应用,还是执行复杂的 Git 操作,gemini-cli 都能通过自然语言指令高效处理。 它特别适合广大软件工程师、DevOps 人员及技术研究人员使用。其核心亮点包括支持高达 100 万 token 的超长上下文窗口,具备出色的逻辑推理能力;内置 Google 搜索、文件操作及 Shell 命令执行等实用工具;更独特的是,它支持 MCP(模型上下文协议),允许用户灵活扩展自定义集成,连接如图像生成等外部能力。此外,个人谷歌账号即可享受免费的额度支持,且项目基于 Apache 2.0 协议完全开源,是提升终端工作效率的理想助手。

markitdown

MarkItDown 是一款由微软 AutoGen 团队打造的轻量级 Python 工具,专为将各类文件高效转换为 Markdown 格式而设计。它支持 PDF、Word、Excel、PPT、图片(含 OCR)、音频(含语音转录)、HTML 乃至 YouTube 链接等多种格式的解析,能够精准提取文档中的标题、列表、表格和链接等关键结构信息。 在人工智能应用日益普及的今天,大语言模型(LLM)虽擅长处理文本,却难以直接读取复杂的二进制办公文档。MarkItDown 恰好解决了这一痛点,它将非结构化或半结构化的文件转化为模型“原生理解”且 Token 效率极高的 Markdown 格式,成为连接本地文件与 AI 分析 pipeline 的理想桥梁。此外,它还提供了 MCP(模型上下文协议)服务器,可无缝集成到 Claude Desktop 等 LLM 应用中。 这款工具特别适合开发者、数据科学家及 AI 研究人员使用,尤其是那些需要构建文档检索增强生成(RAG)系统、进行批量文本分析或希望让 AI 助手直接“阅读”本地文件的用户。虽然生成的内容也具备一定可读性,但其核心优势在于为机器