ailia-models

ailia-models 是一个专为 ailia SDK 打造的预训练 AI 模型库,汇集了超过 400 个涵盖视觉、语音、大语言模型及动作识别等领域的最先进模型。它主要解决了开发者在跨平台部署 AI 时面临的模型适配难、推理速度慢以及缺乏现成示例代码等痛点。

无论是需要在 Windows、macOS、Linux 上运行,还是希望将 AI 功能嵌入 iOS、Android、Jetson 甚至树莓派等边缘设备,ailia-models 都能提供开箱即用的支持。其核心亮点在于利用 Vulkan 和 Metal 技术实现高效的 GPU 加速推理,并针对特定模型进行了深度优化,从而在资源受限的设备上也能获得流畅体验。此外,该库还提供了丰富的示例代码,支持 C++、Python、Unity、Rust 等多种主流开发语言,大幅降低了从算法验证到产品落地的门槛。

这套工具非常适合希望快速构建高性能 AI 应用的软件工程师、嵌入式开发人员以及算法研究者。如果你正在寻找一个既能保证推理速度,又具备广泛硬件兼容性的模型解决方案,ailia-models 将是一个值得信赖的选择,帮助你轻松将前沿 AI 技术转化为实际生产力。

使用场景

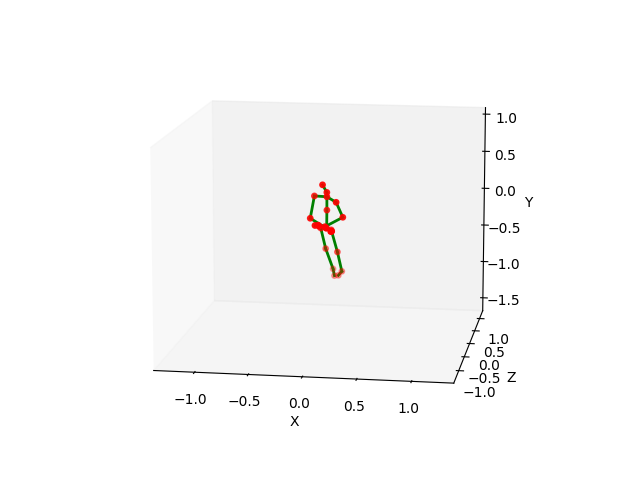

一家智能健身镜初创团队需要在低功耗的 Android 设备上实时分析用户的深蹲、拳击等动作,以提供即时纠正反馈。

没有 ailia-models 时

- 模型适配困难:团队需手动将 PyTorch 训练的 ST-GCN 或 MARS 模型转换为推理格式,常因算子不支持导致导出失败,耗费数周调试。

- 端侧性能瓶颈:普通推理引擎无法利用 Android 设备的 Vulkan GPU 加速,导致视频流分析帧率低于 15 FPS,动作识别严重滞后。

- 缺乏现成示例:开发者需从零编写数据预处理和后处理代码,难以快速验证算法在真实摄像头画面中的效果。

- 跨平台部署复杂:若未来需扩展至 iOS 或 Raspberry Pi 版本,需重新适配整套推理后端,维护成本极高。

使用 ailia-models 后

- 开箱即用模型库:直接调用已验证优化的

st-gcn和mars模型,无需关心底层转换细节,半天即可完成集成。 - 高性能边缘推理:借助 ailia SDK 的 Vulkan 加速,在同等 Android 设备上实现 60+ FPS 的流畅识别,确保用户动作零延迟反馈。

- 完整示例指引:参考官方提供的 Python 和 Kotlin 示例代码,快速打通从摄像头采集到骨骼点分析的完整链路。

- 一次开发多端运行:同一套模型代码可无缝部署至 iOS(Metal 加速)或嵌入式开发板,大幅降低多产品线扩展成本。

ailia-models 通过提供预优化的高性能模型库,让开发者跳过繁琐的工程化陷阱,专注于核心业务逻辑的快速落地。

运行环境要求

- Windows

- macOS

- Linux

- iOS

- Android

- 非必需

- 支持通过 Vulkan (NVIDIA/AMD/Intel) 和 Metal (Apple) 进行 GPU 加速

- 未指定具体显存大小或 CUDA 版本要求(因主要使用 Vulkan/Metal 而非纯 CUDA)

未说明

快速开始

预先训练的、最先进的AI模型集合。

关于ailia SDK

ailia SDK 是一款跨平台、高速的AI推理SDK。它支持Windows、Mac、Linux、iOS、Android、Jetson和Raspberry Pi,并通过Vulkan和Metal实现GPU加速。提供C++、Python、Unity (C#)、Kotlin、Rust和Flutter等语言的绑定。

为什么选择ailia SDK

| ailia SDK | ONNX Runtime | |

|---|---|---|

| 通过Vulkan和Metal进行GPU推理 | ✓ | − |

| ailia语音/声音/LLM/分词器/跟踪器 | ✓ | − |

| 400+个经过验证的模型库及示例代码 | ✓ | − |

| 非操作系统/实时操作系统推理支持 | ✓ | − |

| Unity绑定和模型集合 | ✓ | △ |

| 模型特定优化 | ✓ | △ |

△ = 支持,但因通用实现而有所限制。

如何使用

立即在Google Colaboratory上试用。

如果您想在自己的电脑上尝试:

文档

支持的模型

截至2026年3月12日,共有403个模型。

最新更新

- 2026.03.12 添加depth_anything_v3、depth_pro

- 2026.03.06 添加depth_anything_v2

- 2026.03.04 添加gpt-sovits-v2-pro、bevformer、uniad

- 2026.03.02 添加g2pw、gpt-sovits-v1、v2、v3(中文)

- 2026.01.16 添加embeddinggemma

- 2025.12.30 添加demucs、latentsync

- 2025.12.26 添加sadtalker

- 2025.12.25 添加samurai、cotracker3(ailia SDK 1.6.1)

- 2025.12.21 添加silerovad v5、v6、v6_2

- 2025.12.17 添加sensevoice、cosyvoice2

- 2025.12.01 添加glass、mobilevlm、donut

更多信息请参阅我们的维基。

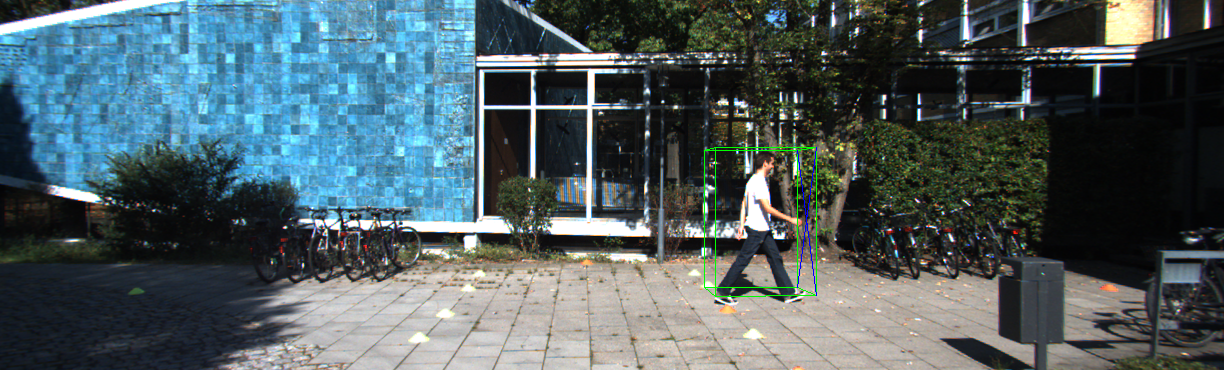

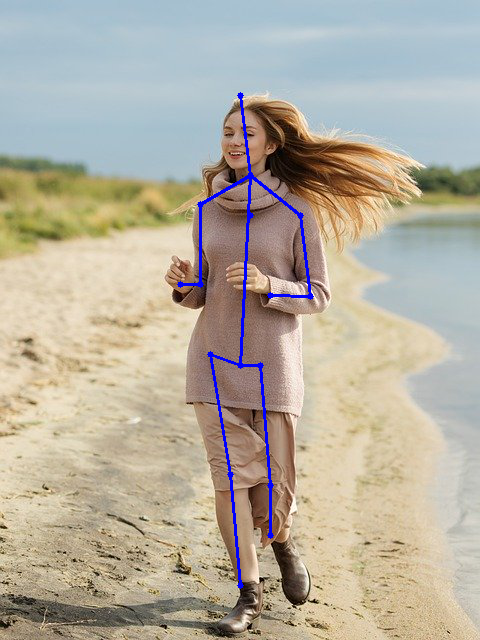

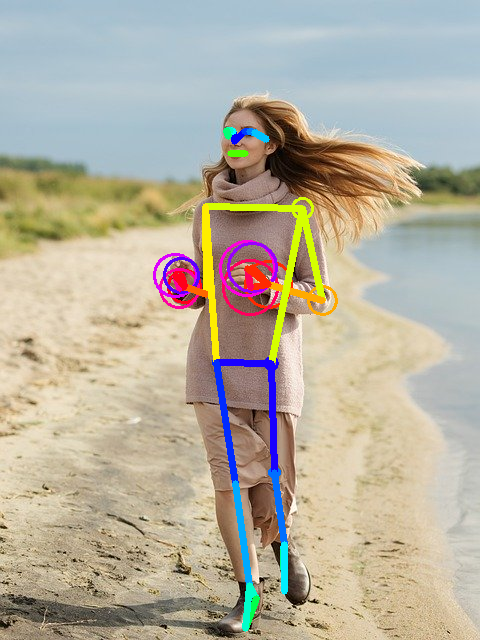

动作识别

| 模型 | 参考 | 导出自 | 支持的ailia版本 | 日期 | 博客 | |

|---|---|---|---|---|---|---|

|

va-cnn | 查看基于骨架的人类动作识别的自适应神经网络(VA) | Pytorch | 1.2.7及以上 | 2017年3月 | |

|

st-gcn | ST-GCN | Pytorch | 1.2.5及以上 | 2018年1月 | EN JP |

|

mars | MARS:用于动作识别的运动增强RGB流 | Pytorch | 1.2.4及以上 | 2018年11月 | EN JP |

|

ax_action_recognition | 实时动作识别 | Pytorch | 1.2.7及以上 | 2019年3月 | |

|

driver-action-recognition-adas | driver-action-recognition-adas-0002 | OpenVINO | 1.2.5及以上 | 2019年3月 | |

|

action_clip | ActionCLIP | Pytorch | 1.2.7及以上 | 2021年9月 |

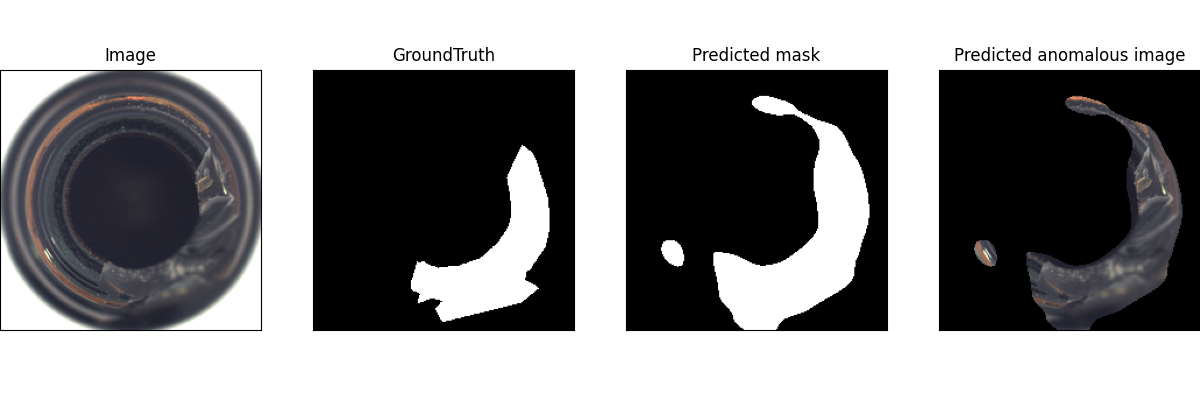

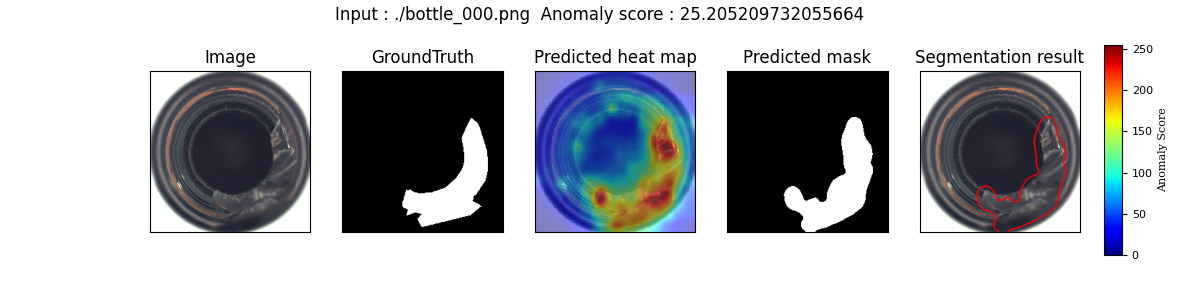

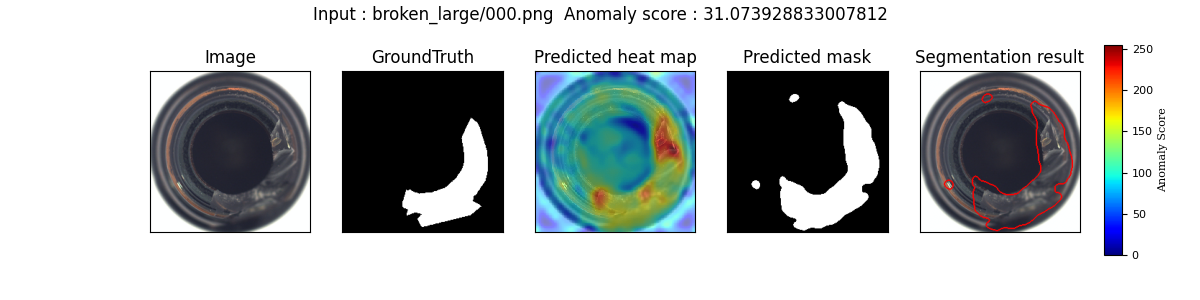

异常检测

| 模型 | 参考 | 导出自 | 支持的ailia版本 | 日期 | 博客 | |

|---|---|---|---|---|---|---|

|

mahalanobisad | MahalanobisAD-pytorch | Pytorch | 1.2.9及以上 | 2020年5月 | |

|

spade-pytorch | 基于深度金字塔对应关系的子图像异常检测 | Pytorch | 1.2.6及以上 | 2020年5月 | |

|

padim | PaDiM-异常检测与定位-master | Pytorch | 1.2.6及以上 | 2020年11月 | EN JP |

|

patchcore | PatchCore_anomaly_detection | Pytorch | 1.2.6及以上 | 2021年6月 | |

|

glass | 工业异常检测与定位的统一异常合成策略——梯度上升法 | Pytorch | 1.2.14及以上 | 2024年7月 |

音频语言模型

| 模型 | 参考文献 | 导出自 | 支持的 Ailia 版本 | 日期 | 博客 |

|---|---|---|---|---|---|

| qwen_audio | Qwen-Audio | Pytorch | 1.5.0 及更高版本 | 2023年11月 | 日文 |

音频处理

音频分类

| 模型 | 参考文献 | 导出自 | 支持的 Ailia 版本 | 日期 | 博客 |

|---|---|---|---|---|---|

| crnn_audio_classification | crnn-audio-classification | Pytorch | 1.2.5 及更高版本 | 2019年3月 | 英文 日文 |

| audioset_tagging_cnn | PANNs: 大规模预训练音频神经网络用于音频模式识别 | Pytorch | 1.2.9 及更高版本 | 2019年12月 | |

| transformer-cnn-emotion-recognition | 通过并行化 CNN 和 Transformer 编码器结合语音情感的空间与时间特征表示 | Pytorch | 1.2.5 及更高版本 | 2020年10月 | |

| microsoft clap | CLAP | Pytorch | 1.2.11 及更高版本 | 2022年6月 | |

| clap | CLAP | Pytorch | 1.2.6 及更高版本 | 2022年11月 | 日文 |

音乐增强

| 模型 | 参考文献 | 导出自 | 支持的 Ailia 版本 | 日期 | 博客 |

|---|---|---|---|---|---|

| hifigan | HiFi-GAN | Pytorch | 1.2.9 及更高版本 | 2020年10月 | |

| deep music enhancer | 关于使用深度神经网络进行音乐带宽扩展的滤波器泛化研究 | Pytorch | 1.2.6 及更高版本 | 2020年11月 |

音乐生成

| 模型 | 参考文献 | 导出自 | 支持的 Ailia 版本 | 日期 | 博客 |

|---|---|---|---|---|---|

| pytorch_wavenet | pytorch_wavenet | Pytorch | 1.2.14 及更高版本 | 2016年9月 |

噪声 reduction

| 模型 | 参考文献 | 导出自 | 支持的 Ailia 版本 | 日期 | 博客 |

|---|---|---|---|---|---|

| rnnoise | rnnoise | Keras | 1.2.15 及更高版本 | 2017年9月 | |

| voicefilter | VoiceFilter | Pytorch | 1.2.7 及更高版本 | 2018年10月 | 英文 日文 |

| unet_source_separation | source_separation | Pytorch | 1.2.6 及更高版本 | 2019年7月 | 英文 日文 |

| demucs | Demucs | Pytorch | 1.4.0 及更高版本 | 2019年9月 | |

| dtln | 双信号变换 LSTM 网络 | Tensorflow | 1.3.0 及更高版本 | 2020年5月 | |

| audiosep | AudioSep | Pytorch | 1.3.0 及更高版本 | 2023年8月 |

音素对齐

| 模型 | 参考文献 | 导出自 | 支持的 Ailia 版本 | 日期 | 博客 |

|---|---|---|---|---|---|

| narabas | narabas: 日语音素强制对齐工具 | Pytorch | 1.2.11 及更高版本 | 2023年3月 |

音高检测

| 模型 | 参考文献 | 导出自 | 支持的 Ailia 版本 | 日期 | 博客 |

|---|---|---|---|---|---|

| crepe | torchcrepe | Pytorch | 1.2.10 及更高版本 | 2018年2月 | 日文 |

说话人分离

| 模型 | 参考文献 | 导出自 | 支持的 Ailia 版本 | 日期 | 博客 |

|---|---|---|---|---|---|

| pyannote-audio | Pyannote-audio | Pytorch | 1.2.15 及更高版本 | 2019年11月 | JP |

| auto_speech | AutoSpeech: 基于神经架构搜索的说话人识别 | Pytorch | 1.2.5 及更高版本 | 2020年5月 | EN JP |

| wespeaker | WeSpeaker | Onnxruntime | 1.2.9 及更高版本 | 2022年10月 |

语音转文本

| 模型 | 参考文献 | 导出自 | 支持的 Ailia 版本 | 日期 | 博客 |

|---|---|---|---|---|---|

| deepspeech2 | deepspeech.pytorch | Pytorch | 1.2.2 及更高版本 | 2017年10月 | EN JP |

| whisper | Whisper | Pytorch | 1.2.10 及更高版本 | 2022年12月 | JP |

| reazon_speech | ReazonSpeech | Pytorch | 1.4.0 及更高版本 | 2023年1月 | |

| distil-whisper | Hugging Face - Distil-Whisper | Pytorch | 1.2.16 及更高版本 | 2023年11月 | |

| sensevoice | SenseVoice | Pytorch | 1.2.13 及更高版本 | 2024年7月 | JP |

| reazon_speech2 | ReazonSpeech2 | Pytorch | 1.4.0 及更高版本 | 2024年2月 | |

| kotoba-whisper | kotoba-whisper | Pytorch | 1.2.16 及更高版本 | 2024年4月 |

文本转语音

| 模型 | 参考文献 | 导出自 | 支持的 Ailia 版本 | 日期 | 博客 |

|---|---|---|---|---|---|

| pytorch-dc-tts | 基于深度卷积网络和引导注意力机制的高效可训练文本转语音系统 | Pytorch | 1.2.6 及更高版本 | 2017年10月 | EN JP |

| tacotron2 | Tacotron2 | Pytorch | 1.2.15 及更高版本 | 2018年2月 | JP |

| vall-e-x | VALL-E-X | Pytorch | 1.2.15 及更高版本 | 2023年3月 | JP |

| Bert-VITS2 | Bert-VITS2 | Pytorch | 1.2.16 及更高版本 | 2023年8月 | |

| gpt-sovits | GPT-SoVITS | Pytorch | 1.4.0 及更高版本 | 2024年2月 | JP |

| gpt-sovits-v2 | GPT-SoVITS | Pytorch | 1.4.0 及更高版本 | 2024年8月 | |

| cosyvoice2 | CosyVoice2 | Pytorch | 1.4.0 及更高版本 | 2024年12月 | |

| gpt-sovits-v3 | GPT-SoVITS | Pytorch | 1.4.0 及更高版本 | 2025年2月 | |

| gpt-sovits-v2-pro | GPT-SoVITS | Pytorch | 1.4.0 及更高版本 | 2025年6月 | JP |

语音活动检测

| 模型 | 参考文献 | 导出自 | 支持的 Ailia 版本 | 日期 | 博客 |

|---|---|---|---|---|---|

| silero-vad | Silero VAD | Pytorch | 1.2.15 及更高版本 | 2020年12月 | JP |

语音转换

| 模型 | 参考文献 | 导出自 | 支持的 Ailia 版本 | 日期 | 博客 |

|---|---|---|---|---|---|

| rvc | 基于检索的语音转换WebUI | Pytorch | 1.2.12及以上 | 2023年3月 | JP |

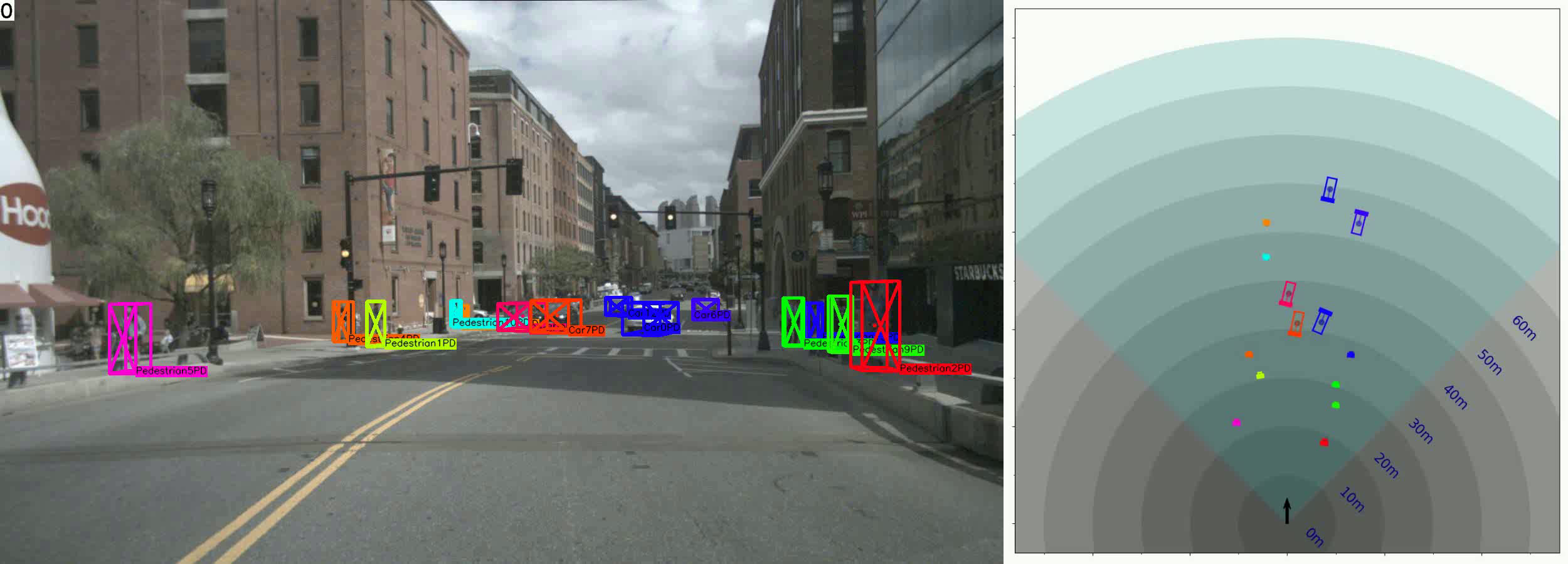

自动驾驶

| 模型 | 参考文献 | 导出自 | 支持的 Ailia 版本 | 日期 | 博客 |

|---|---|---|---|---|---|

| bevformer | BEVFormer | Pytorch | 1.6.1及以上 | 2022年3月 | JP |

| uniad | UniAD: 统一驾驶 | Pytorch | 1.6.1及以上 | 2022年12月 | JP |

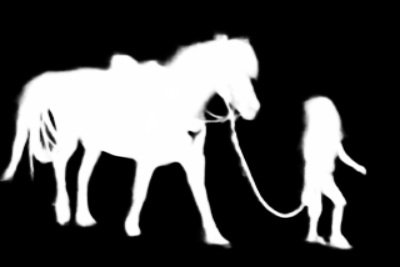

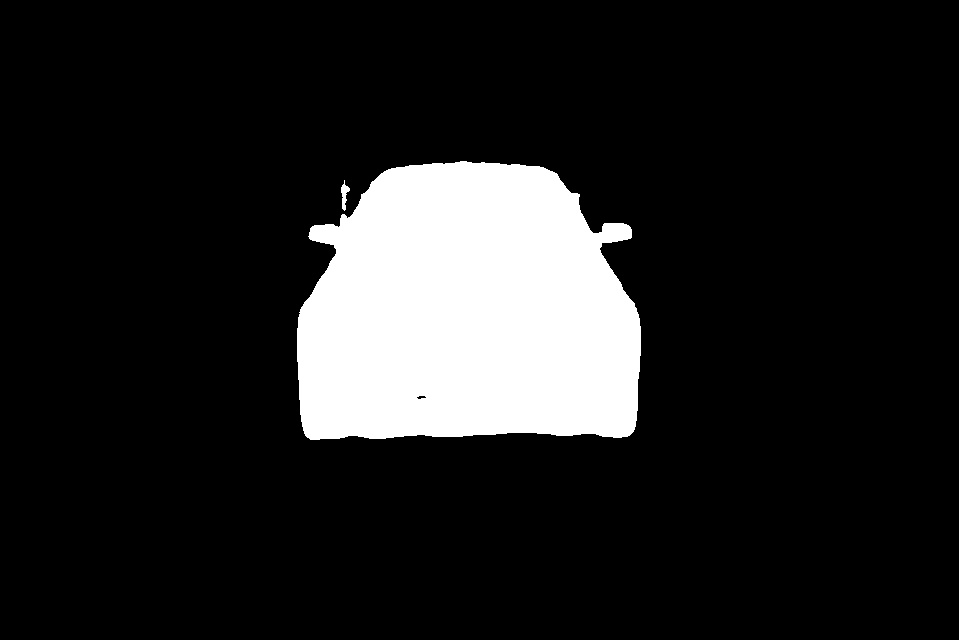

背景去除

| 模型 | 参考文献 | 导出自 | 支持的 Ailia 版本 | 日期 | 博客 | |

|---|---|---|---|---|---|---|

|

deep-image-matting | 深度图像抠图 | Keras | 1.2.3及以上 | 2017年3月 | EN JP |

|

indexnet | 索引很重要:为深度图像抠图学习索引 | Pytorch | 1.2.7及以上 | 2019年8月 | |

|

U-2-Net | U^2-Net:通过嵌套U结构深入显著目标检测 | Pytorch | 1.2.2及以上 | 2020年5月 | EN JP |

|

u2net-portrait-matting | U^2-Net - 人像抠图 | Pytorch | 1.2.7及以上 | 2020年5月 | |

|

u2net-human-seg | U^2-Net - 人体分割 | Pytorch | 1.2.4及以上 | 2020年5月 | |

|

cascade_psp | CascadePSP | Pytorch | 1.2.9及以上 | 2020年5月 | |

|

rembg | Rembg | Pytorch | 1.2.4及以上 | 2020年8月 | |

|

gfm | 弥合合成与真实:迈向端到端深度图像抠图 | Pytorch | 1.2.10及以上 | 2020年10月 | |

|

modnet | MODNet:实时无三通道图人像抠图 | Pytorch | 1.2.7及以上 | 2020年11月 | |

|

background_matting_v2 | 实时高分辨率背景抠图 | Pytorch | 1.2.9及以上 | 2020年12月 | |

|

dis_seg | 高度精确的二分图像分割 | Pytorch | 1.2.10及以上 | 2022年3月 |

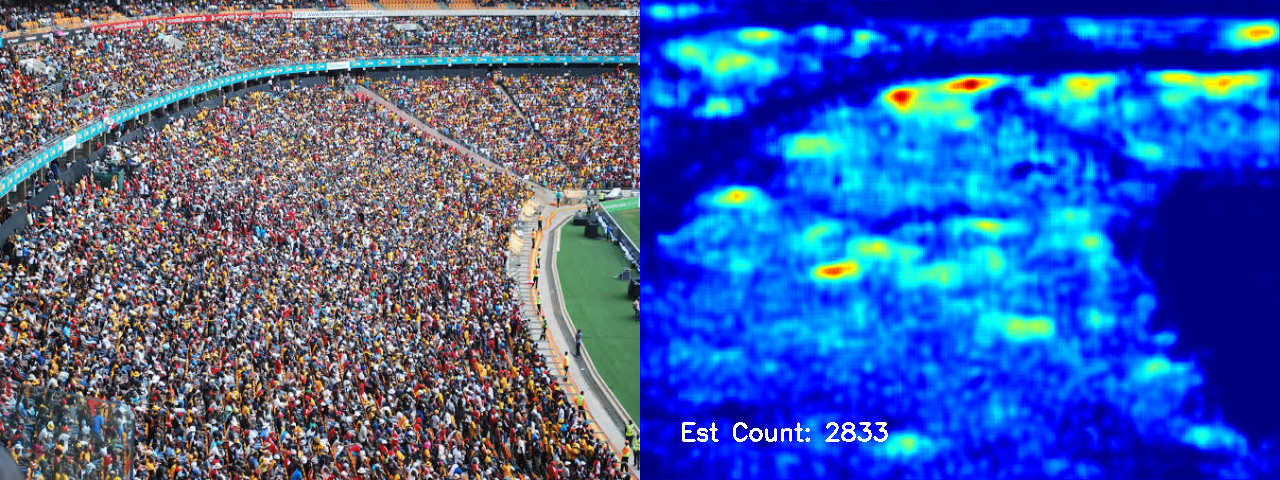

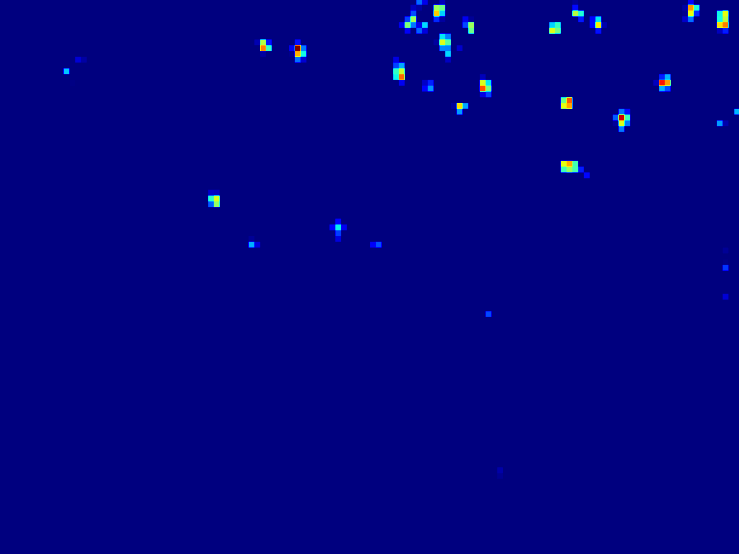

人群计数

| 模型 | 参考文献 | 导出自 | 支持的 Ailia 版本 | 日期 | 博客 | |

|---|---|---|---|---|---|---|

|

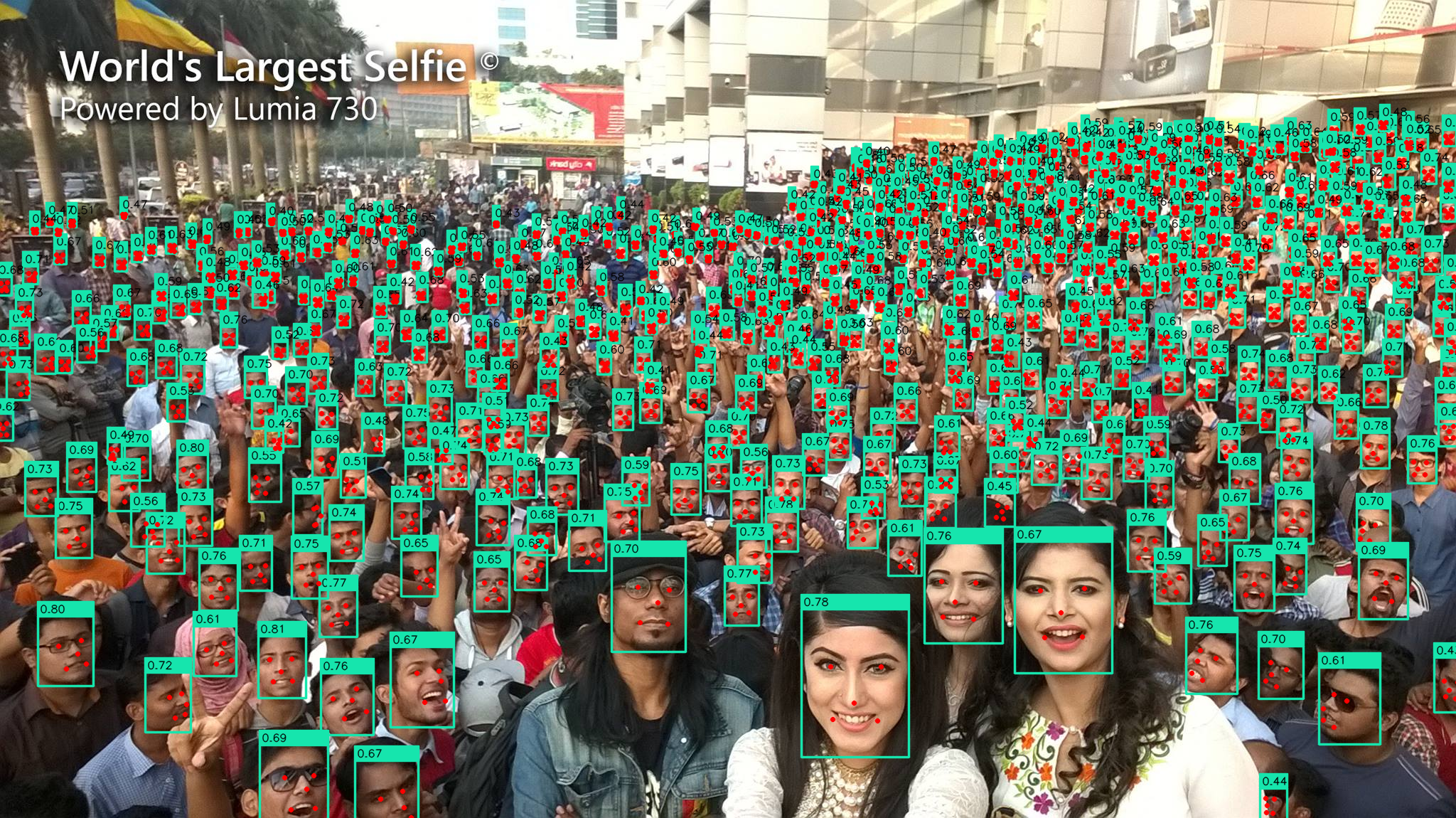

crowdcount-cascaded-mtl | 基于CNN的级联多任务学习: 高层先验与密度估计用于人群计数 (单张图像人群计数) |

Pytorch | 1.2.1及以上 | 2017年7月 | EN JP |

|

c-3-framework | 人群计数代码框架(C^3-框架) | Pytorch | 1.2.5及以上 | 2019年7月 |

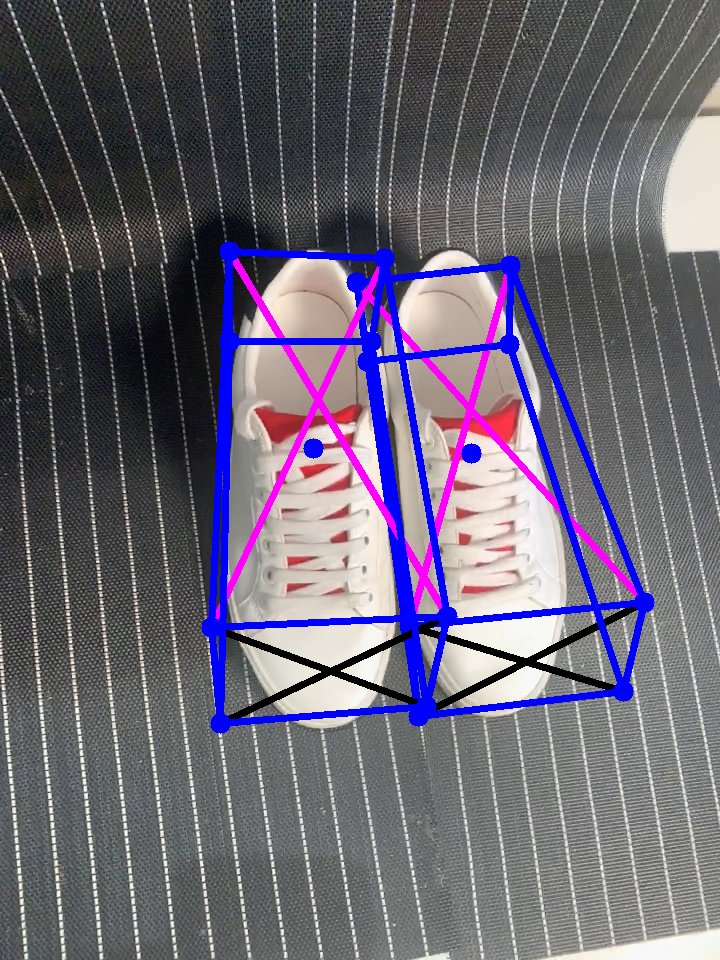

深度时尚

| 模型 | 参考 | 导出自 | 支持的 Ailia 版本 | 日期 | 博客 | |

|---|---|---|---|---|---|---|

|

fashionai-key-points-detection | A Pytorch Implementation of Cascaded Pyramid Network for FashionAI Key Points Detection | Pytorch | 1.2.5 及更高版本 | 2018年6月 | |

|

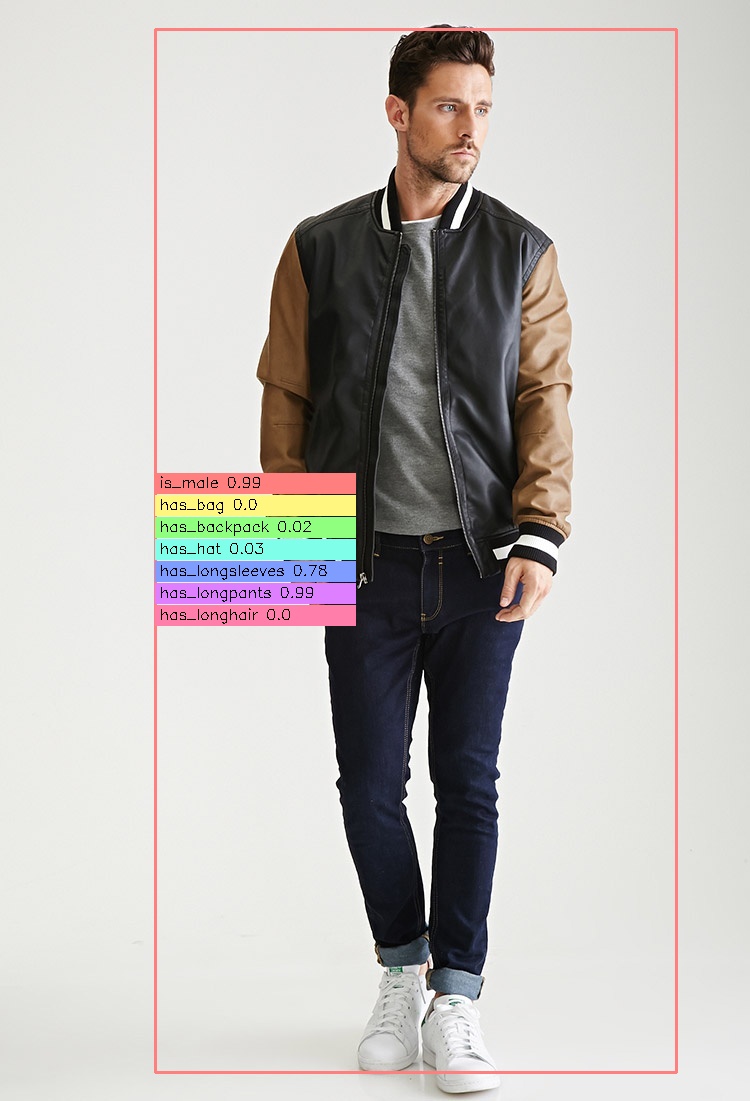

person-attributes-recognition-crossroad | person-attributes-recognition-crossroad-0230 | Pytorch | 1.2.10 及更高版本 | 2018年10月 | |

|

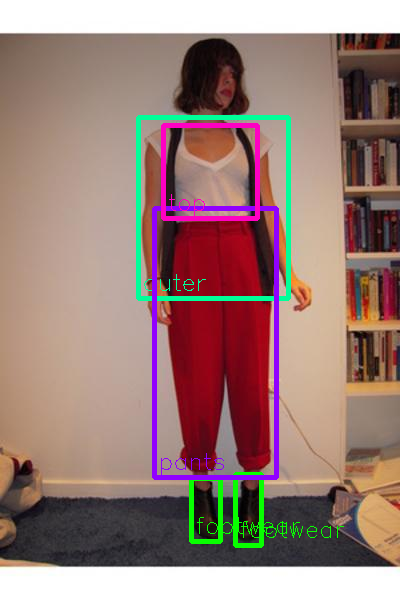

clothing-detection | Clothing-Detection | Pytorch | 1.2.1 及更高版本 | 2019年6月 | EN JP |

|

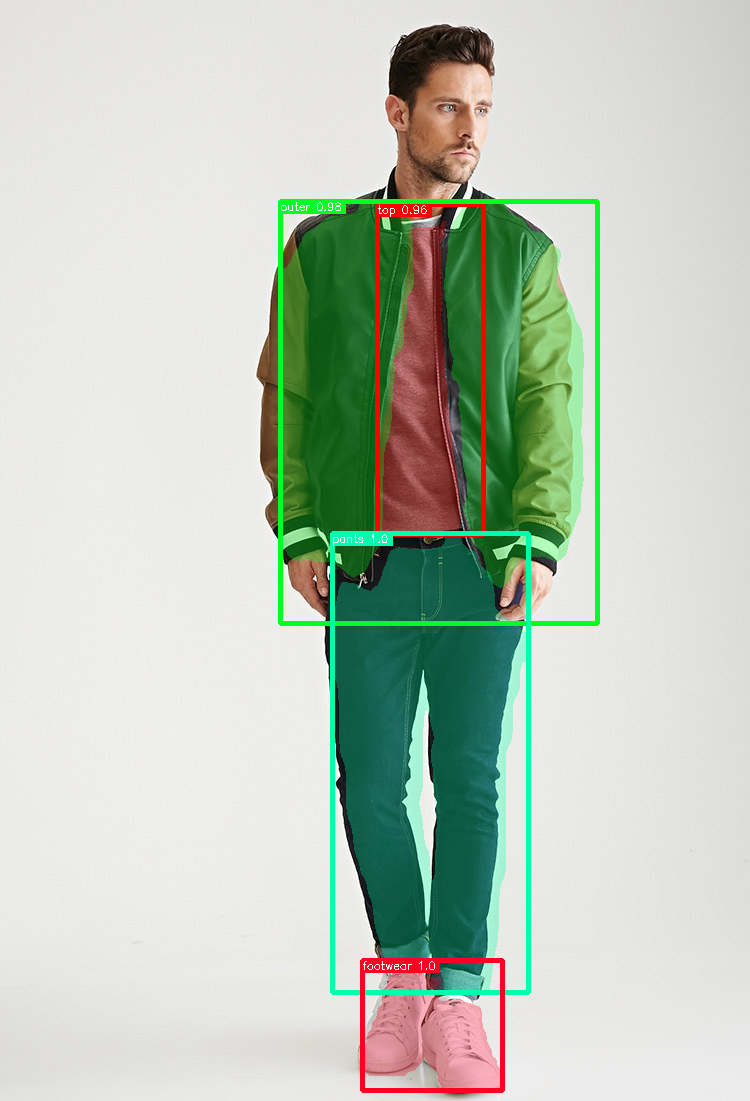

mmfashion | MMFashion | Pytorch | 1.2.5 及更高版本 | 2019年11月 | EN JP |

|

mmfashion_tryon | MMFashion virtual try-on | Pytorch | 1.2.8 及更高版本 | 2019年11月 | |

|

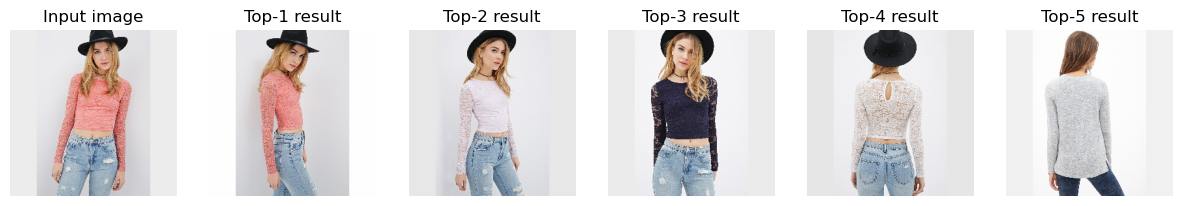

mmfashion_retrieval | MMFashion In-Shop Clothes Retrieval | Pytorch | 1.2.5 及更高版本 | 2019年11月 |

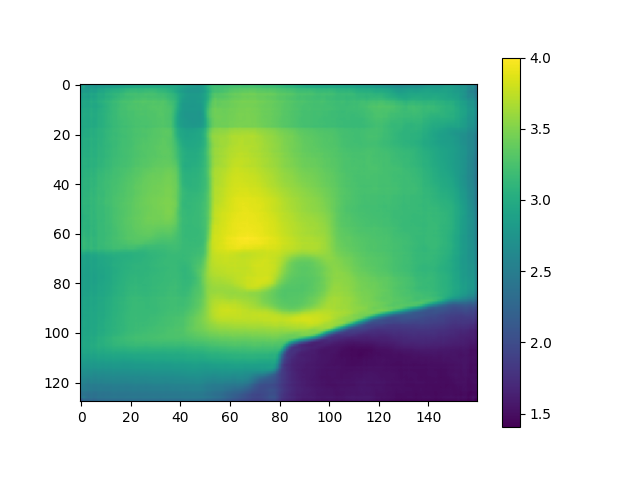

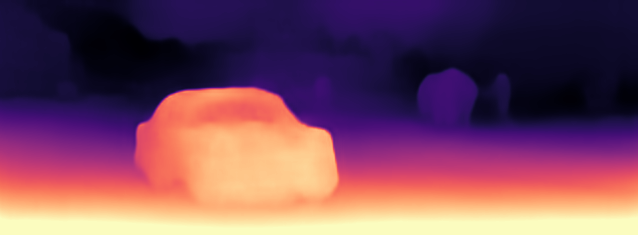

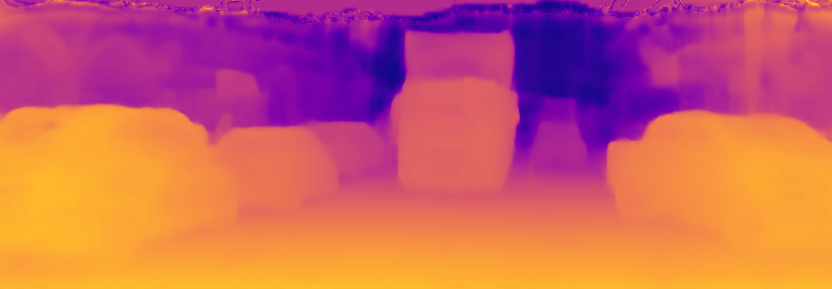

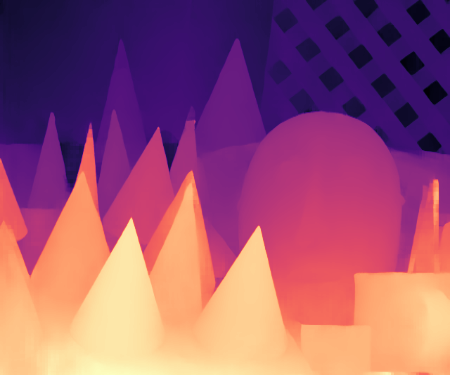

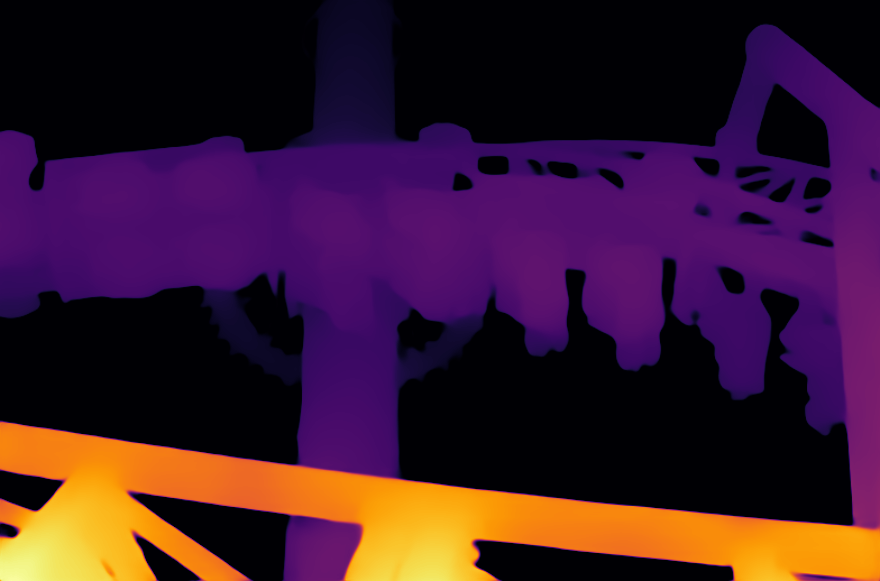

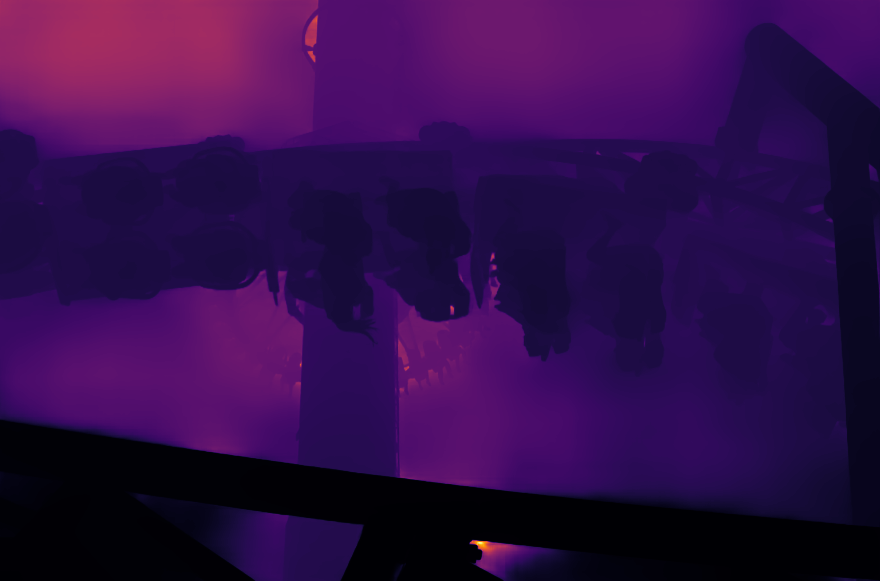

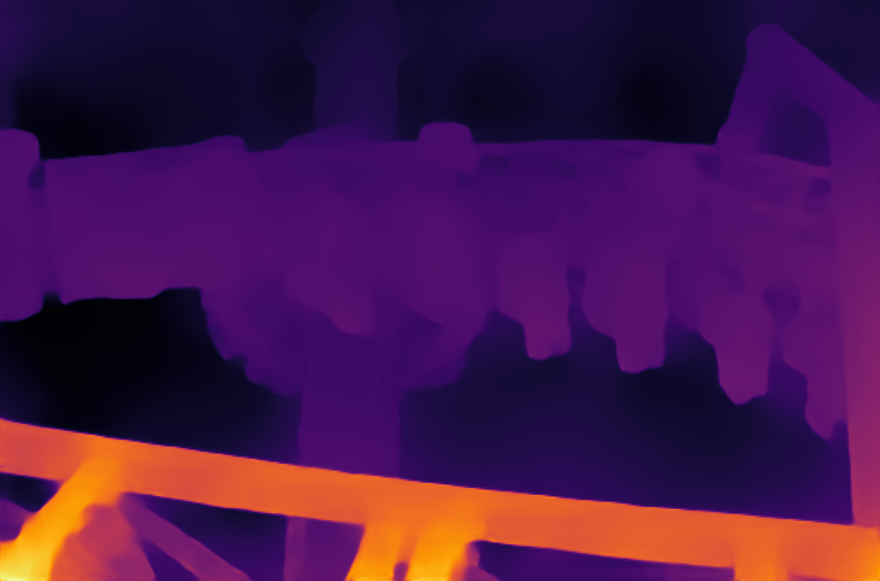

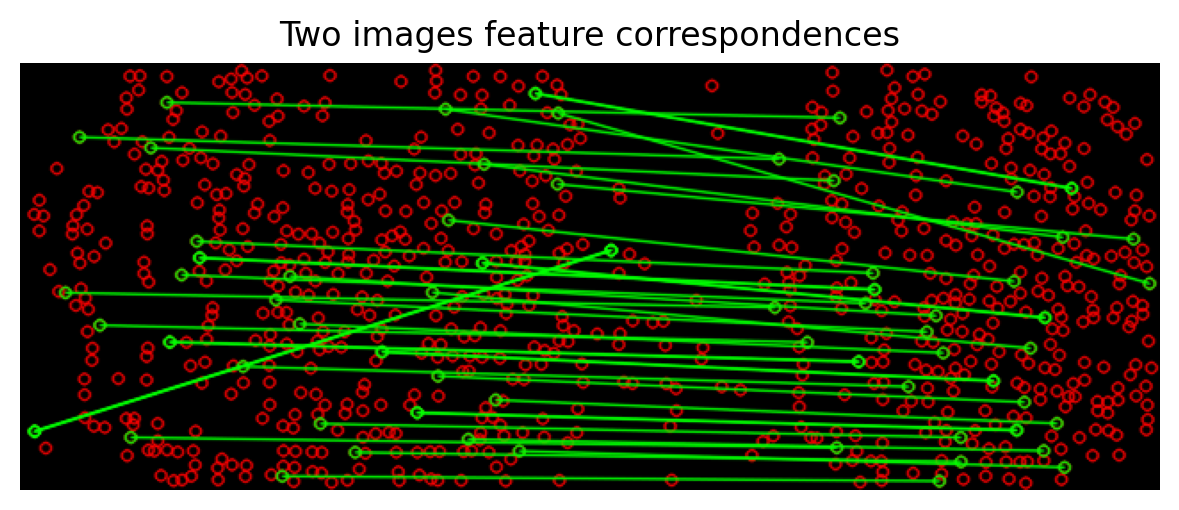

深度估计

扩散

文本转图像

| 模型 | 参考 | 导出自 | 支持的 Ailia 版本 | 日期 | 博客 | |

|---|---|---|---|---|---|---|

|

latent-diffusion-txt2img | Latent Diffusion - txt2img | Pytorch | 1.2.10 及更高版本 | 2021年12月 | |

|

stable-diffusion-txt2img | Stable Diffusion | Pytorch | 1.2.14 及更高版本 | 2022年8月 | JP |

|

anything_v3 | Linaqruf/anything-v3.0 | Pytorch | 1.5.0 及更高版本 | 2022年11月 | |

|

control_net | ControlNet | Pytorch | 1.2.15 及更高版本 | 2023年2月 | |

|

latent-consistency-models | latent-consistency-models | Pytorch | 1.2.16 及更高版本 | 2023年10月 | |

|

sd-turbo | Hugging Face - SD-Turbo | Pytorch | 1.2.16 及更高版本 | 2023年11月 | |

|

sdxl-turbo | Hugging Face - SDXL-Turbo | Pytorch | 1.2.16 及更高版本 | 2023年11月 | |

|

depth_anything_controlnet | DepthAnything | Pytorch | 1.2.16 及更高版本 | 2024年1月 | |

|

latentsync | LatentSync | Pytorch | 1.4.0 及更高版本 | 2024年12月 |

文本转音频

| 模型 | 参考 | 导出自 | 支持的 Ailia 版本 | 日期 | 博客 | |

|---|---|---|---|---|---|---|

|

riffusion | Riffusion | Pytorch | 1.2.16 及更高版本 | 2022年12月 |

其他

| 模型 | 参考 | 导出自 | 支持的 Ailia 版本 | 日期 | 博客 | |

|---|---|---|---|---|---|---|

|

latent-diffusion-inpainting | Latent Diffusion - inpainting | Pytorch | 1.2.10 及更高版本 | 2021年12月 | |

|

latent-diffusion-superresolution | Latent Diffusion - Super-resolution | Pytorch | 1.2.10 及更高版本 | 2021年12月 | |

|

DA-CLIP | DA-CLIP | Pytorch | 1.2.16 及更高版本 | 2023年10月 | |

|

marigold | Marigold: Repurposing Diffusion-Based Image Generators for Monocular Depth Estimation | Pytorch | 1.2.16 及更高版本 | 2023年12月 |

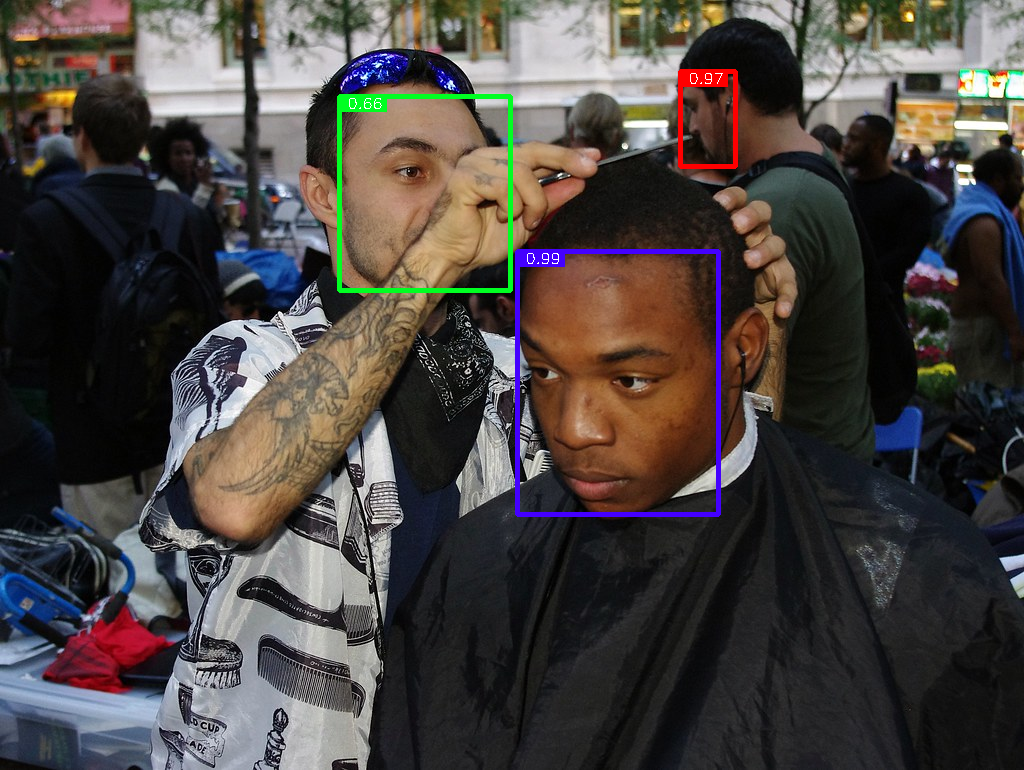

人脸检测

| 模型 | 参考资料 | 导出自 | 支持的 Ailia 版本 | 发布日期 | 博客 | |

|---|---|---|---|---|---|---|

|

mtcnn | mtcnn | Keras | 1.2.10 及更高版本 | 2016年4月 | |

|

yolov1-face | YOLO-Face-detection | Darknet | 1.1.0 及更高版本 | 2017年3月 | |

|

face-detection-adas | face-detection-adas-0001 | OpenVINO | 1.2.5 及更高版本 | 2018年10月 | |

|

retinaface | RetinaFace: Single-stage Dense Face Localisation in the Wild. | Pytorch | 1.2.5 及更高版本 | 2019年5月 | JP |

|

blazeface | BlazeFace-PyTorch | Pytorch | 1.2.1 及更高版本 | 2019年7月 | EN JP |

|

yolov3-face | Face detection using keras-yolov3 | Keras | 1.2.1 及更高版本 | 2019年12月 | |

|

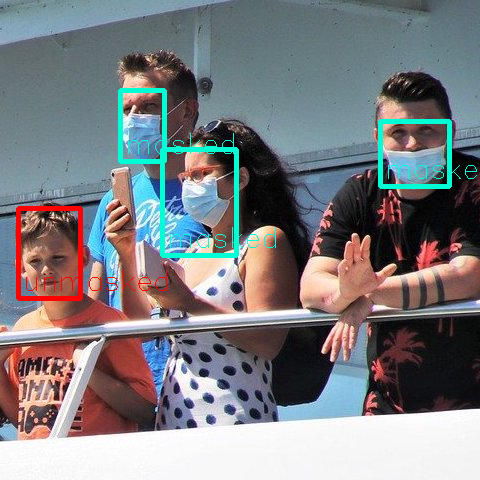

face-mask-detection | Face detection using keras-yolov3 | Keras | 1.2.1 及更高版本 | 2019年12月 | EN JP |

|

dbface | DBFace : real-time, single-stage detector for face detection, with faster speed and higher accuracy |

Pytorch | 1.2.2 及更高版本 | 2020年3月 | |

|

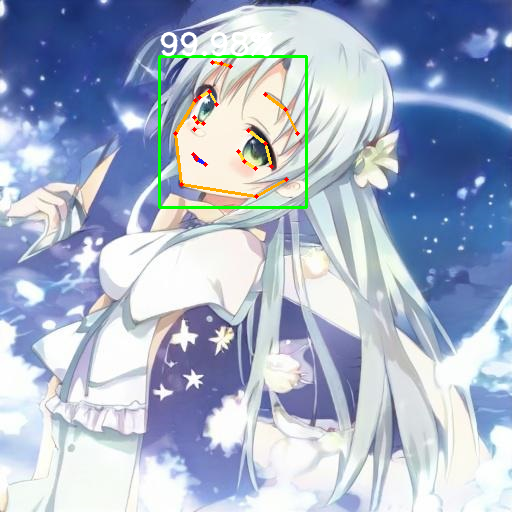

anime-face-detector | Anime Face Detector | Pytorch | 1.2.6 及更高版本 | 2021年10月 |

人脸识别

| 模型 | 参考资料 | 导出自 | 支持的 Ailia 版本 | 发布日期 | 博客 | |

|---|---|---|---|---|---|---|

|

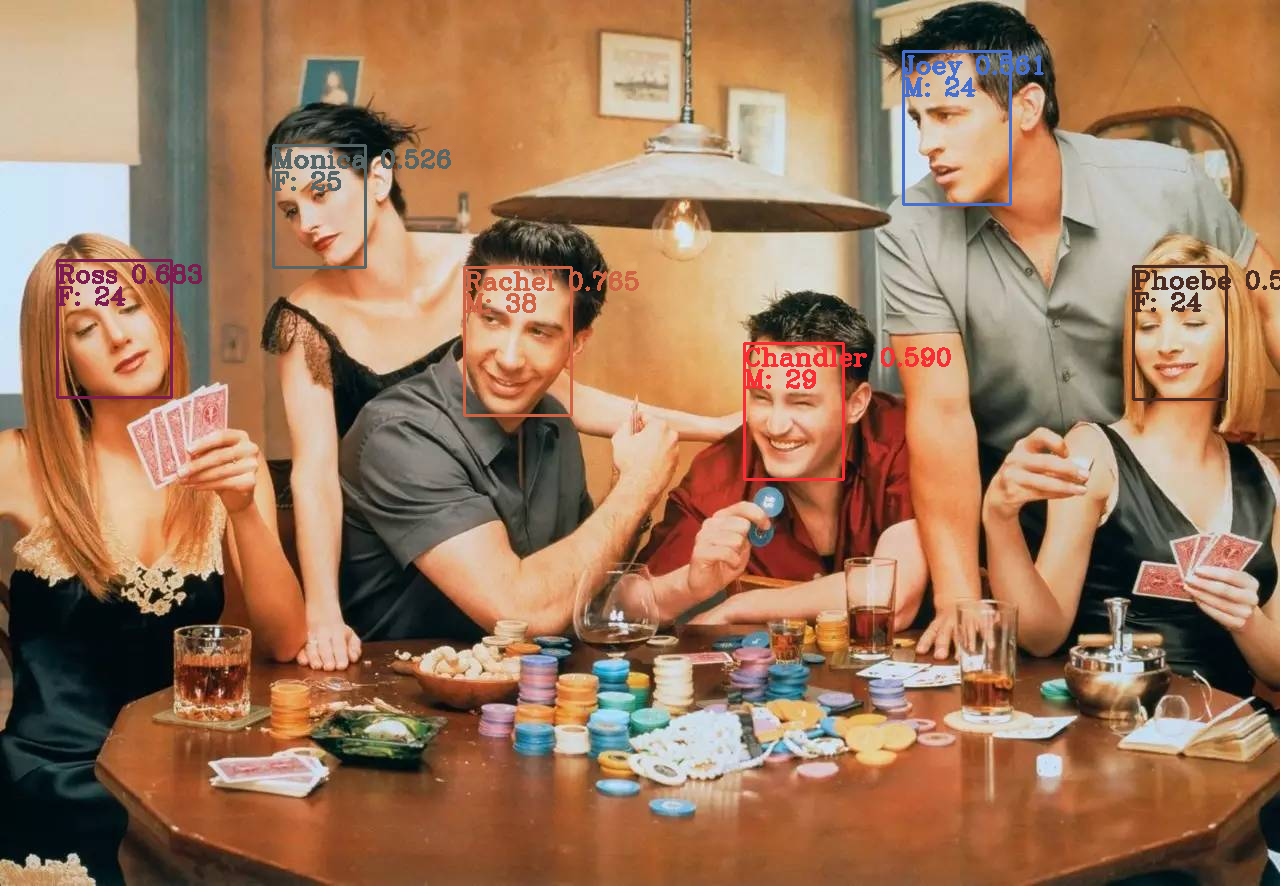

facenet_pytorch | Face Recognition Using Pytorch | Pytorch | 1.2.6 及更高版本 | 2015年3月 | |

|

insightface | InsightFace: 2D and 3D Face Analysis Project | Pytorch | 1.2.5 及更高版本 | 2017年9月 | |

|

vggface2 | VGGFace2 Dataset for Face Recognition | Caffe | 1.1.0 及更高版本 | 2017年10月 | |

|

arcface | pytorch implement of arcface | Pytorch | 1.2.1 及更高版本 | 2018年1月 | EN JP |

|

cosface | Pytorch implementation of CosFace | Pytorch | 1.2.10 及更高版本 | 2018年1月 |

人脸比对

年龄性别估计

| 模型 | 参考资料 | 导出自 | 支持的 Ailia 版本 | 日期 | 博客 | |

|---|---|---|---|---|---|---|

|

face_classification | 实时人脸检测与情绪/性别分类 | Keras | 1.1.0 及以上 | 2017年10月 | |

|

age-gender-recognition-retail | age-gender-recognition-retail-0013 | OpenVINO | 1.2.5 及以上 | 2018年5月 | EN JP |

|

mivolo | MiVOLO:用于年龄和性别估计的多输入Transformer | Pytorch | 1.2.13 及以上 | 2023年7月 | JP |

情绪识别

| 模型 | 参考资料 | 导出自 | 支持的 Ailia 版本 | 日期 | 博客 | |

|---|---|---|---|---|---|---|

|

ferplus | FER+ | CNTK | 1.2.2 及以上 | 2016年8月 | |

|

hsemotion | HSEmotion(高速人脸情绪识别)库 | Pytorch | 1.2.5 及以上 | 2021年3月 |

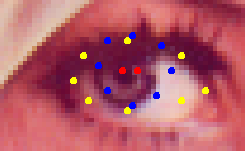

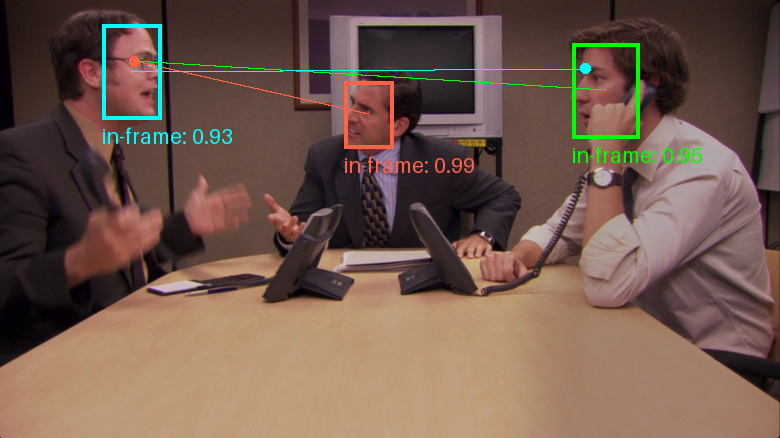

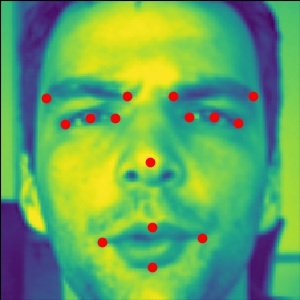

凝视估计

| 模型 | 参考资料 | 导出自 | 支持的 Ailia 版本 | 日期 | 博客 | |

|---|---|---|---|---|---|---|

|

gazeml | 基于TensorFlow的深度学习框架,用于训练高性能凝视估计模型 | TensorFlow | 1.2.0 及以上 | 2018年5月 | |

|

mediapipe_iris | irislandmarks.pytorch | Pytorch | 1.2.2 及以上 | 2020年6月 | EN JP |

|

gazelle | gazelle | Pytorch | 1.2.16 及以上 | 2024年12月 | JP |

|

ax_gaze_estimation | ax 凝视估计 | Pytorch | 1.2.2 及以上 | EN JP |

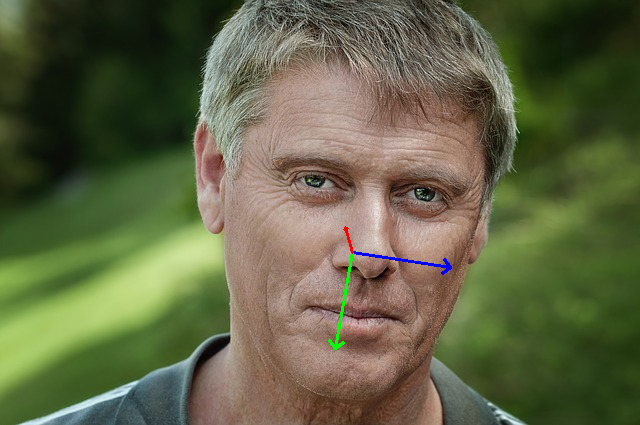

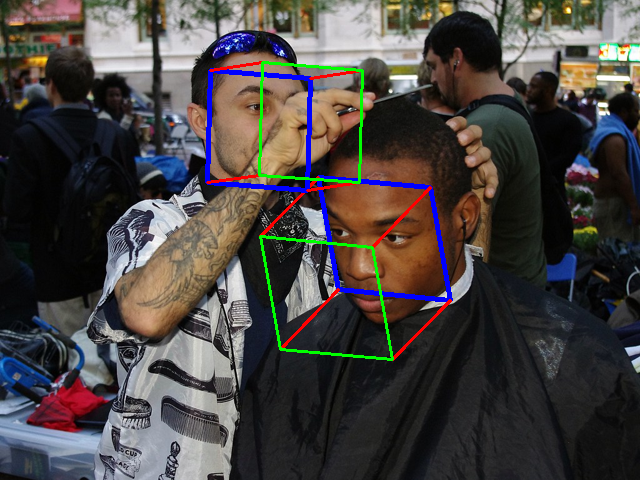

头部姿态估计

| 模型 | 参考资料 | 导出自 | 支持的 Ailia 版本 | 日期 | 博客 | |

|---|---|---|---|---|---|---|

|

hopenet | deep-head-pose | Pytorch | 1.2.2 及以上 | 2017年10月 | EN JP |

|

6d_repnet | 用于无约束头部姿态估计的6D旋转表示(Pytorch) | Pytorch | 1.2.6 及以上 | 2022年2月 | |

|

L2CS_Net | L2CS_Net | Pytorch | 1.2.9 及以上 | 2022年3月 | |

|

6d_repnet_360 | 迈向鲁棒且无约束的全范围旋转头部姿态估计 | Pytorch | 1.2.9 及以上 | 2023年9月 |

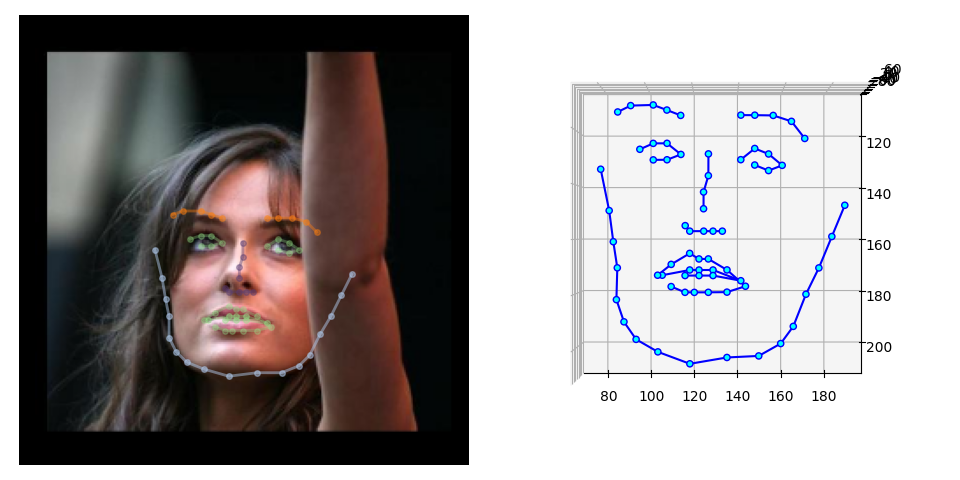

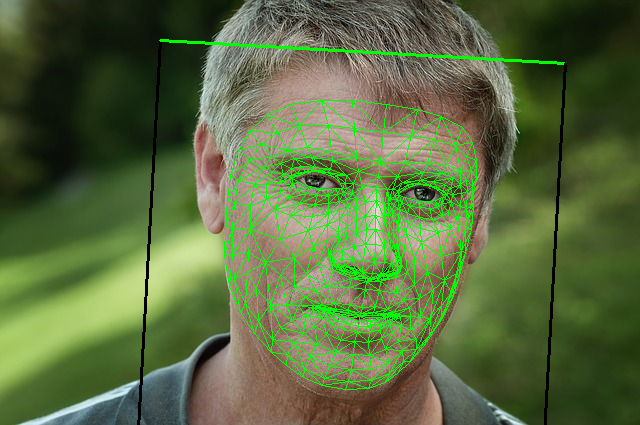

关键点检测

| 模型 | 参考资料 | 导出自 | 支持的 Ailia 版本 | 日期 | 博客 | |

|---|---|---|---|---|---|---|

|

face_alignment | 使用 PyTorch 构建的 2D 和 3D 面部对齐库 | PyTorch | 1.2.1 及以上 | 2017年3月 | EN JP |

|

prnet | 结合位置图回归网络的联合 3D 面部重建与密集对齐 |

TensorFlow | 1.2.2 及以上 | 2018年3月 | |

|

facemesh | facemesh.pytorch | PyTorch | 1.2.2 及以上 | 2019年7月 | EN JP |

|

facial_feature | kaggle-facial-keypoints | PyTorch | 1.2.0 及以上 | 2019年10月 | |

|

3ddfa | 迈向快速、准确且稳定的 3D 密集面部对齐 | PyTorch | 1.2.10 及以上 | 2020年9月 | |

|

facemesh_v2 | MediaPipe 面部地标检测 | PyTorch | 1.2.9 及以上 | 2023年5月 | JP |

其他

| 模型 | 参考资料 | 导出自 | 支持的 Ailia 版本 | 日期 | 博客 | |

|---|---|---|---|---|---|---|

|

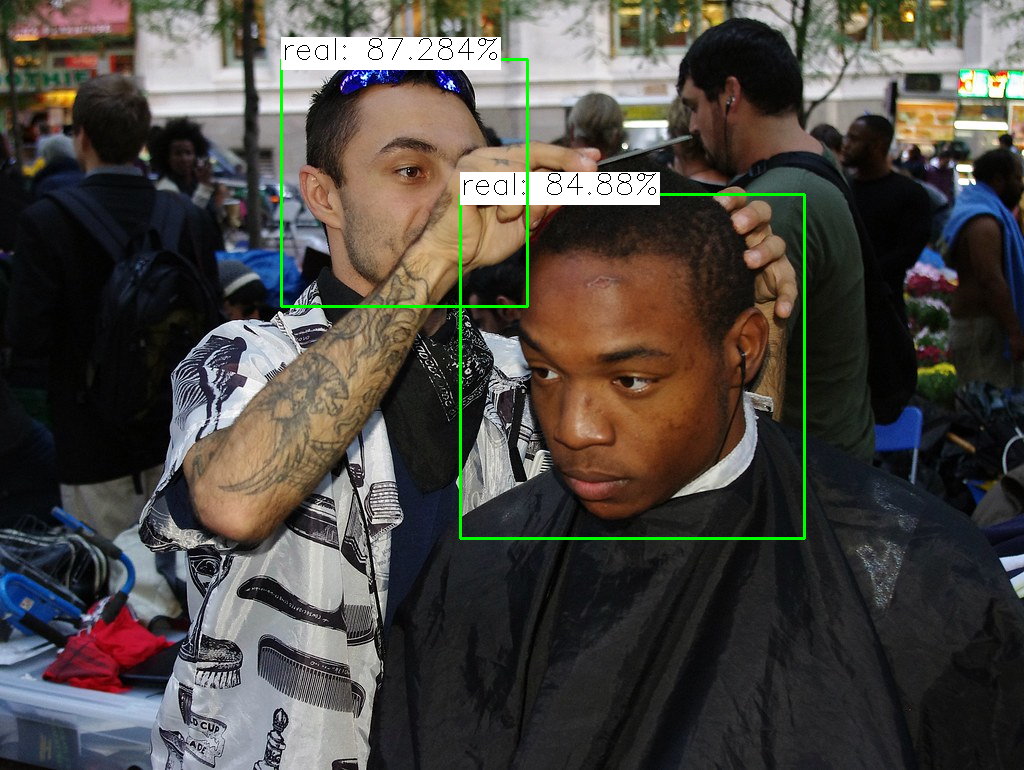

face-anti-spoofing | 轻量级面部防欺骗 | PyTorch | 1.2.5 及以上 | 2020年7月 | EN JP |

|

ax_facial_features | ax 面部特征 | PyTorch | 1.2.5 及以上 | EN |

面部修复

| 模型 | 参考资料 | 导出自 | 支持的 Ailia 版本 | 日期 | 博客 | |

|---|---|---|---|---|---|---|

|

gfpgan | GFP-GAN:基于生成式面部先验的真实世界盲人面部修复 | PyTorch | 1.2.10 及以上 | 2021年1月 | JP |

|

codeformer | CodeFormer:基于码本查找变换器的鲁棒盲人面部修复 | PyTorch | 1.2.9 及以上 | 2022年6月 |

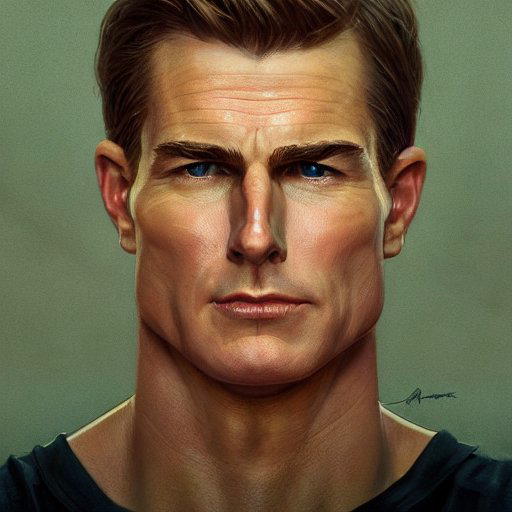

面部换脸

| 模型 | 参考资料 | 导出自 | 支持的 Ailia 版本 | 日期 | 博客 | |

|---|---|---|---|---|---|---|

|

deepfacelive | DeepFaceLive | ONNX Runtime | 1.2.10 及以上 | 2020年12月 | |

|

sber-swap | SberSwap | PyTorch | 1.2.12 及以上 | 2022年2月 | JP |

|

facefusion | FaceFusion | ONNX Runtime | 1.2.10 及以上 | 2023年8月 |

帧插值

| 模型 | 参考文献 | 导出自 | 支持的 Ailia 版本 | 日期 | 博客 | |

|---|---|---|---|---|---|---|

|

cain | 视频帧插值中只需通道注意力机制 | Pytorch | 1.2.5 及以上 | 2019年11月 | |

|

rife | 用于视频帧插值的实时中间光流估计 | Pytorch | 1.2.13 及以上 | 2020年11月 | |

|

flavr | FLAVR:适用于快速帧插值的光流无关视频表示 | Pytorch | 1.2.7 及以上 | 2020年12月 | EN JP |

|

film | FILM:大运动场景下的帧插值 | Tensorflow | 1.2.10 及以上 | 2022年2月 |

生成对抗网络

| 模型 | 参考文献 | 导出自 | 支持的 Ailia 版本 | 日期 | 博客 | |

|---|---|---|---|---|---|---|

|

pytorch-gan | PyTorch GAN Zoo 项目的代码仓库(用于训练此模型) | Pytorch | 1.2.4 及以上 | 2017年10月 | |

|

lipgan | LipGAN | Keras | 1.2.15 及以上 | 2019年10月 | JP |

|

council-gan | Council-GAN | Pytorch | 1.2.4 及以上 | 2019年11月 | |

|

sam | 基于风格的回归模型进行年龄转换 | Pytorch | 1.2.9 及以上 | 2021年2月 | |

|

encoder4editing | 为 StyleGAN 图像操作设计编码器 | Pytorch | 1.2.10 及以上 | 2021年2月 | |

|

restyle-encoder | ReStyle | Pytorch | 1.2.9 及以上 | 2021年4月 | |

|

SadTalker | SadTalker | Pytorch | 1.5.0 及以上 | 2022年11月 | |

|

live_portrait | LivePortrait | Pytorch | 1.5.0 及以上 | 2024年7月 | JP |

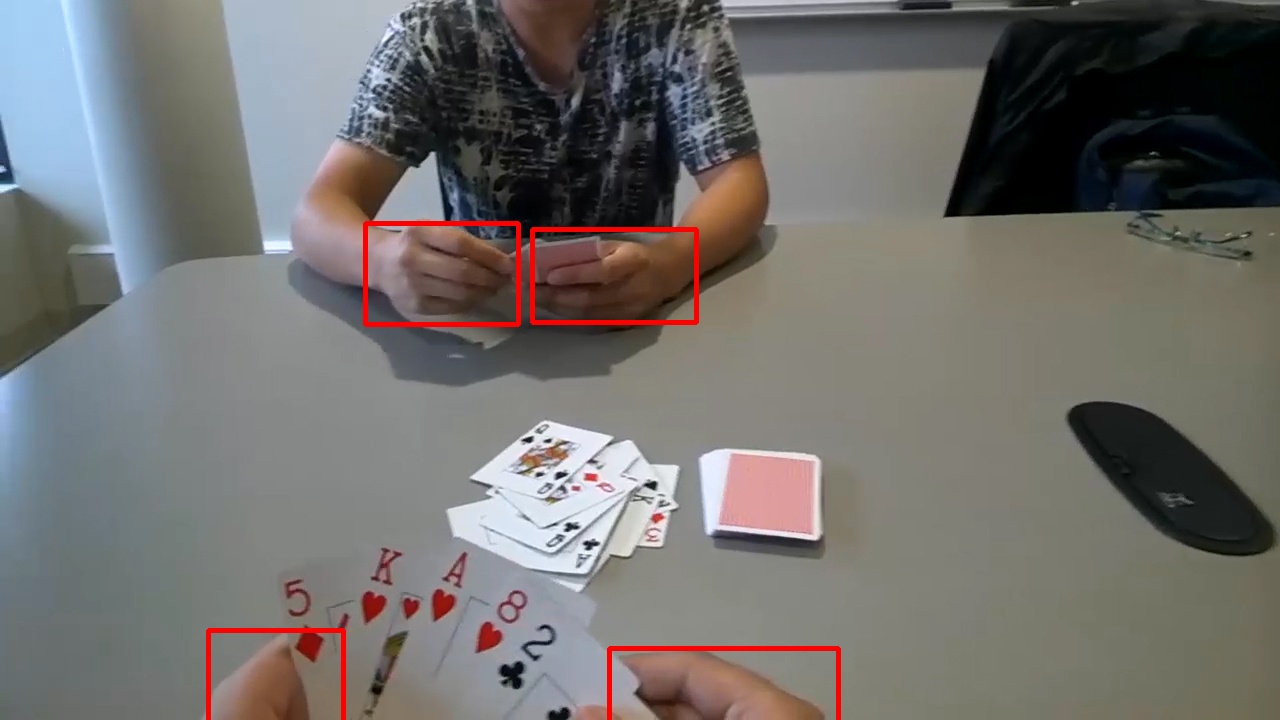

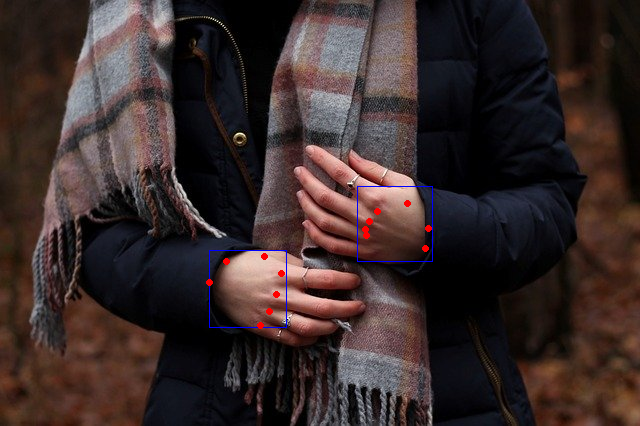

手部检测

| 模型 | 参考文献 | 导出自 | 支持的 Ailia 版本 | 日期 | 博客 | |

|---|---|---|---|---|---|---|

|

hand_detection_pytorch | hand-detection.PyTorch | Pytorch | 1.2.2 及以上 | 2019年3月 | |

|

yolov3-hand | 使用 keras-yolov3 的人脸检测分支中的手部检测模块 | Keras | 1.2.1 及以上 | 2019年12月 | |

|

blazepalm | MediaPipePyTorch | Pytorch | 1.2.5 及以上 | 2020年6月 |

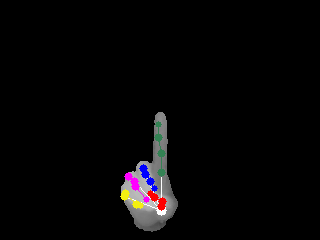

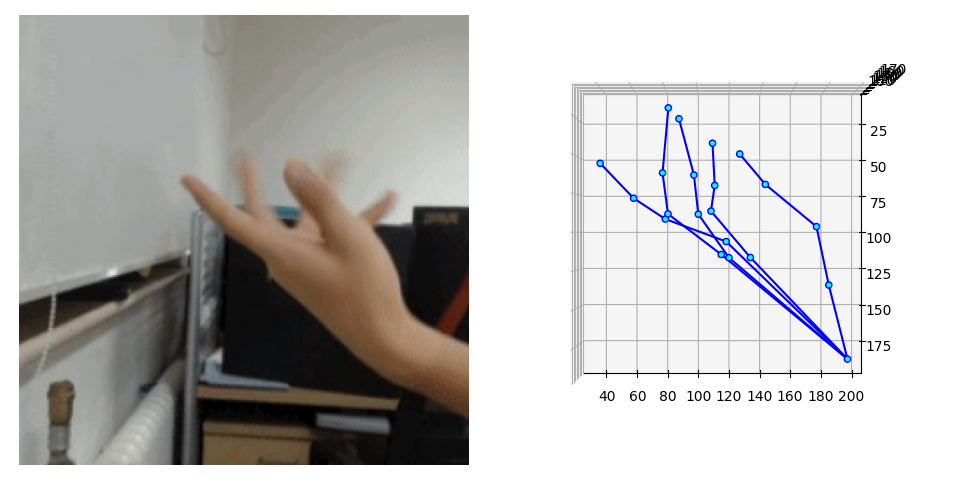

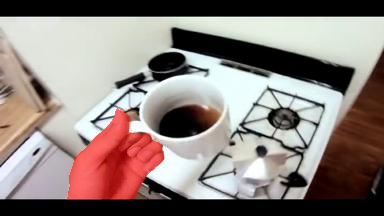

手部识别

| 模型 | 参考文献 | 导出自 | 支持的 Ailia 版本 | 日期 | 博客 | |

|---|---|---|---|---|---|---|

|

hand3d | ColorHandPose3D 网络 | TensorFlow | 1.2.5 及以上 | 2017年5月 | |

|

v2v-posenet | V2V-PoseNet | Pytorch | 1.2.6 及以上 | 2017年11月 | |

|

minimal-hand | Minimal Hand | TensorFlow | 1.2.8 及以上 | 2020年3月 | |

|

blazehand | MediaPipePyTorch | Pytorch | 1.2.5 及以上 | 2020年6月 | EN JP |

|

hands_segmentation_pytorch | hands-segmentation-pytorch | Pytorch | 1.2.10 及以上 | 2021年4月 |

图像描述生成

| 模型 | 参考文献 | 导出自 | 支持的 Ailia 版本 | 日期 | 博客 | |

|---|---|---|---|---|---|---|

|

illustration2vec | Illustration2Vec | Caffe | 1.2.2 及以上 | 2015年11月 | |

|

image_captioning_pytorch | Image Captioning pytorch | Pytorch | 1.2.5 及以上 | 2016年12月 | EN JP |

|

blip2 | Hugging Face - BLIP-2 | Pytorch | 1.2.16 及以上 | 2023年1月 |

图像分类

CNN

| 模型 | 参考文献 | 导出自 | 支持的 Ailia 版本 | 日期 | 博客 | |

|---|---|---|---|---|---|---|

|

alexnet | AlexNet PyTorch | Pytorch | 1.2.5 及更高版本 | 2012年9月 | |

|

vgg16 | 非常深层的卷积网络用于大规模图像识别 | Keras | 1.1.0 及更高版本 | 2014年9月 | |

|

googlenet | 通过卷积更深入地学习 | Pytorch | 1.2.0 及更高版本 | 2014年9月 | |

|

resnet18 | ResNet18 | Pytorch | 1.2.8 及更高版本 | 2015年12月 | |

|

resnet50 | 用于图像识别的深度残差学习 | Chainer | 1.2.0 及更高版本 | 2015年12月 | |

|

inceptionv3 | 重新思考计算机视觉中的 Inception 架构 | Pytorch | 1.2.0 及更高版本 | 2015年12月 | JP |

|

inceptionv4 | Keras Inception-V4 | Keras | 1.2.5 及更高版本 | 2016年2月 | |

|

wide_resnet50 | Wide Resnet | Pytorch | 1.2.5 及更高版本 | 2016年5月 | |

|

mobilenetv2 | MobileNet V2 的 PyTorch 实现 | Pytorch | 1.2.0 及更高版本 | 2018年1月 | |

|

mobilenetv3 | MobileNet V3 的 PyTorch 实现 | Pytorch | 1.2.1 及更高版本 | 2019年5月 | |

|

efficientnet | EfficientNet 的 PyTorch 实现 | Pytorch | 1.2.3 及更高版本 | 2019年5月 | |

|

efficientnetv2 | EfficientNetV2 | Pytorch | 1.2.4 及更高版本 | 2021年4月 | |

|

imagenet21k | ImageNet21K | Pytorch | 1.2.11 及更高版本 | 2021年4月 | |

|

mlp_mixer | MLP-Mixer | Pytorch | 1.2.9 及更高版本 | 2021年5月 | |

|

volo | VOLO:用于视觉识别的视觉观察者 | Pytorch | 1.2.9 及更高版本 | 2021年6月 | |

|

convnext | ConvNeXt 的 PyTorch 实现 | Pytorch | 1.2.5 及更高版本 | 2022年1月 | |

|

mobileone | MobileOne 的 PyTorch 实现 | Pytorch | 1.2.1 及更高版本 | 2022年6月 |

变压器

| 模型 | 参考资料 | 导出自 | 支持的 Ailia 版本 | 日期 | 博客 | |

|---|---|---|---|---|---|---|

|

vit | Vision Transformer 的 PyTorch 重实现(一张图胜过 16x16 个词:大规模图像识别中的 Transformer) | Pytorch | 1.2.7 及更高版本 | 2020年10月 | EN JP |

|

clip | CLIP | Pytorch | 1.2.9 及更高版本 | 2021年2月 | EN JP |

|

swin-transformer | Swin Transformer | Pytorch | 1.2.6 及更高版本 | 2021年3月 | |

|

japanese-clip | Japanese-CLIP | Pytorch | 1.2.15 及更高版本 | 2022年5月 | |

|

japanese-stable-clip-vit-l-16 | japanese-stable-clip-vit-l-16 | Pytorch | 1.2.11 及更高版本 | 2023年11月 | |

|

clip-japanese-base | line-corporation/clip-japanese-base | Pytorch | 1.2.16 及更高版本 | 2024年4月 | |

|

siglip2 | 具有改进语义理解、定位和密集特征的多语言视觉-语言编码器 | Pytorch | 1.2.16 及更高版本 | 2025年2月 | JP |

具体任务

| 模型 | 参考资料 | 导出自 | 支持的 Ailia 版本 | 日期 | 博客 | |

|---|---|---|---|---|---|---|

|

weather-prediction-from-image | 基于图像的天气预测 - (图像的温暖感) | Keras | 1.2.5 及更高版本 | 2017年10月 | |

|

partialconv | 用于填充和图像修复的局部卷积层 | Pytorch | 1.2.0 及更高版本 | 2018年11月 |

图像修复

| 模型 | 参考资料 | 导出自 | 支持的 Ailia 版本 | 日期 | 博客 | |

|---|---|---|---|---|---|---|

|

inpainting-with-partial-conv | pytorch-inpainting-with-partial-conv | PyTorch | 1.2.6 及更高版本 | 2018年4月 | EN JP |

|

deepfillv2 | 带有门控卷积的自由形式图像修复 | Pytorch | 1.2.9 及更高版本 | 2018年6月 | |

|

inpainting_gmcnn | 通过生成式多列卷积神经网络进行图像修复 | TensorFlow | 1.2.6 及更高版本 | 2018年10月 | |

|

3d-photo-inpainting | 使用上下文感知分层深度修复技术的 3D 摄影 | Pytorch | 1.2.7 及更高版本 | 2020年4月 | |

|

lama | LaMa:基于傅里叶卷积的分辨率鲁棒性大掩码修复 | Pytorch | 1.2.13 及更高版本 | 2021年9月 |

图像处理

图像修复

| 模型 | 参考文献 | 导出自 | 支持的 Ailia 版本 | 日期 | 博客 | |

|---|---|---|---|---|---|---|

|

nafnet | NAFNet: Nonlinear Activation Free Network for Image Restoration | Pytorch | 1.2.10 及以上 | 2022年3月 | JP |

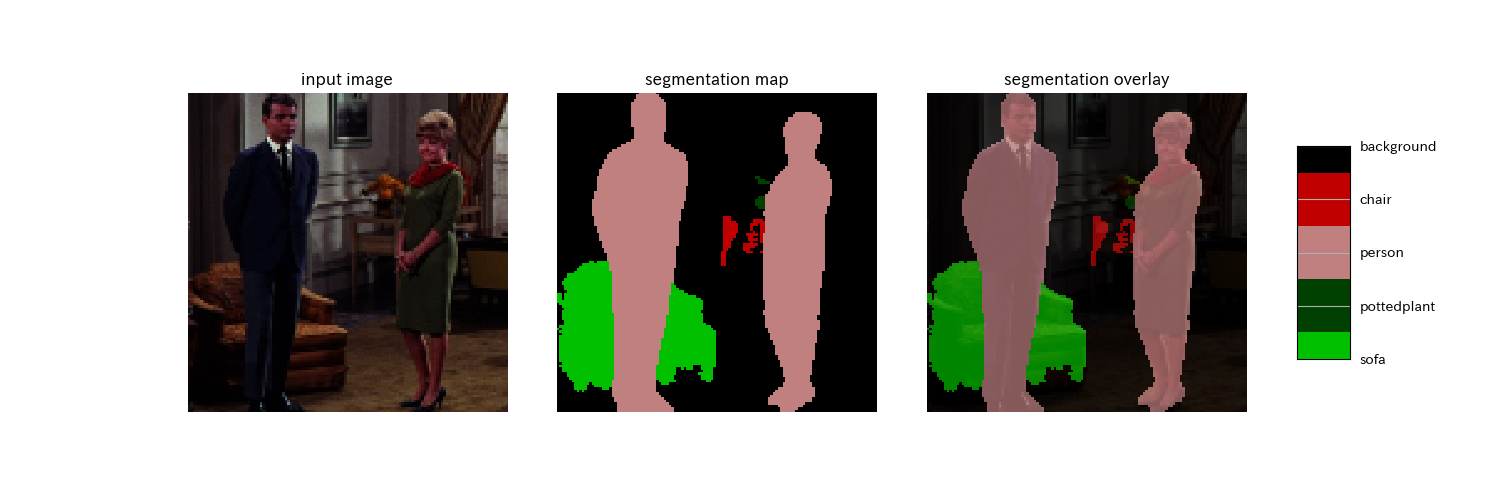

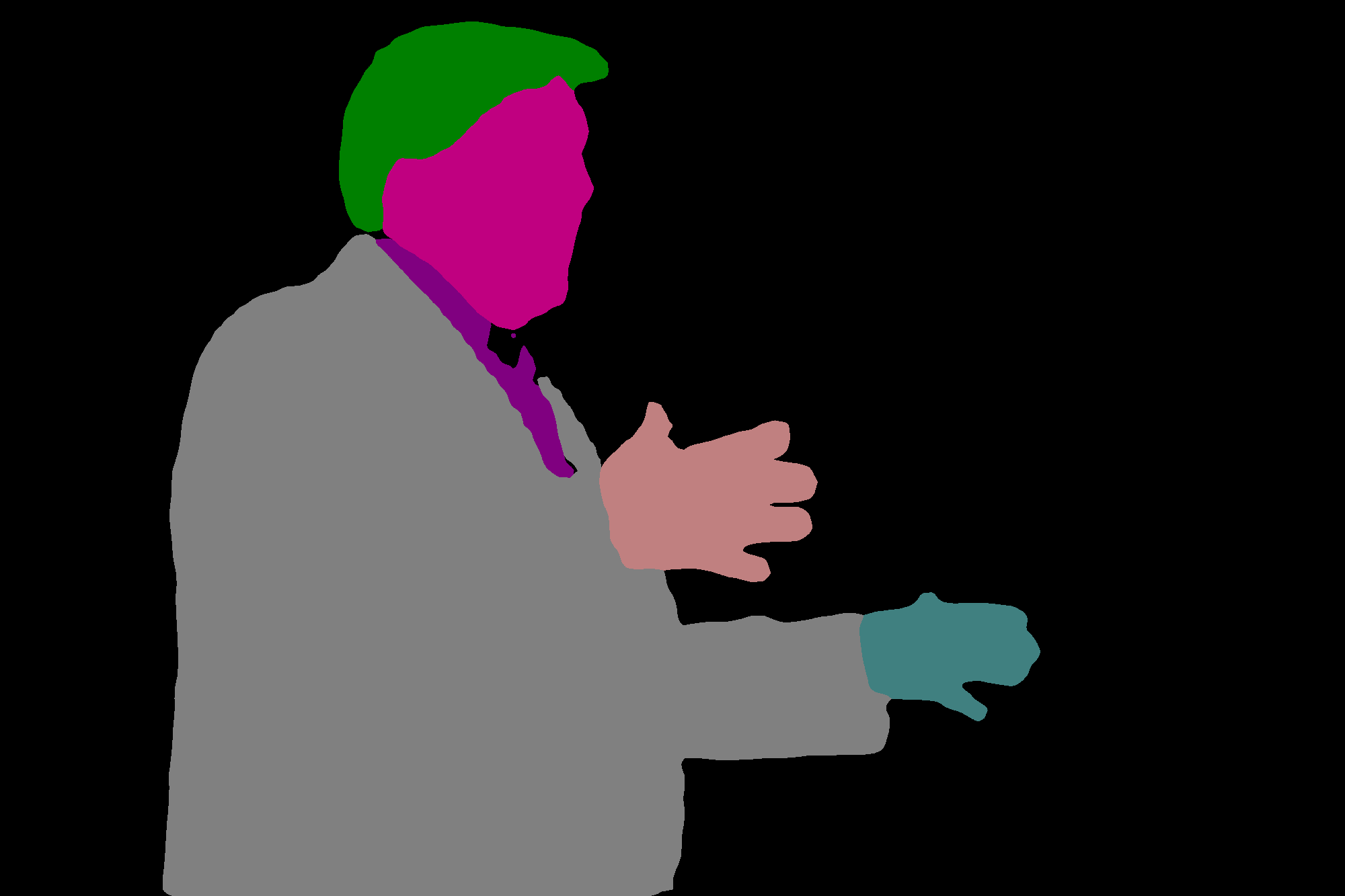

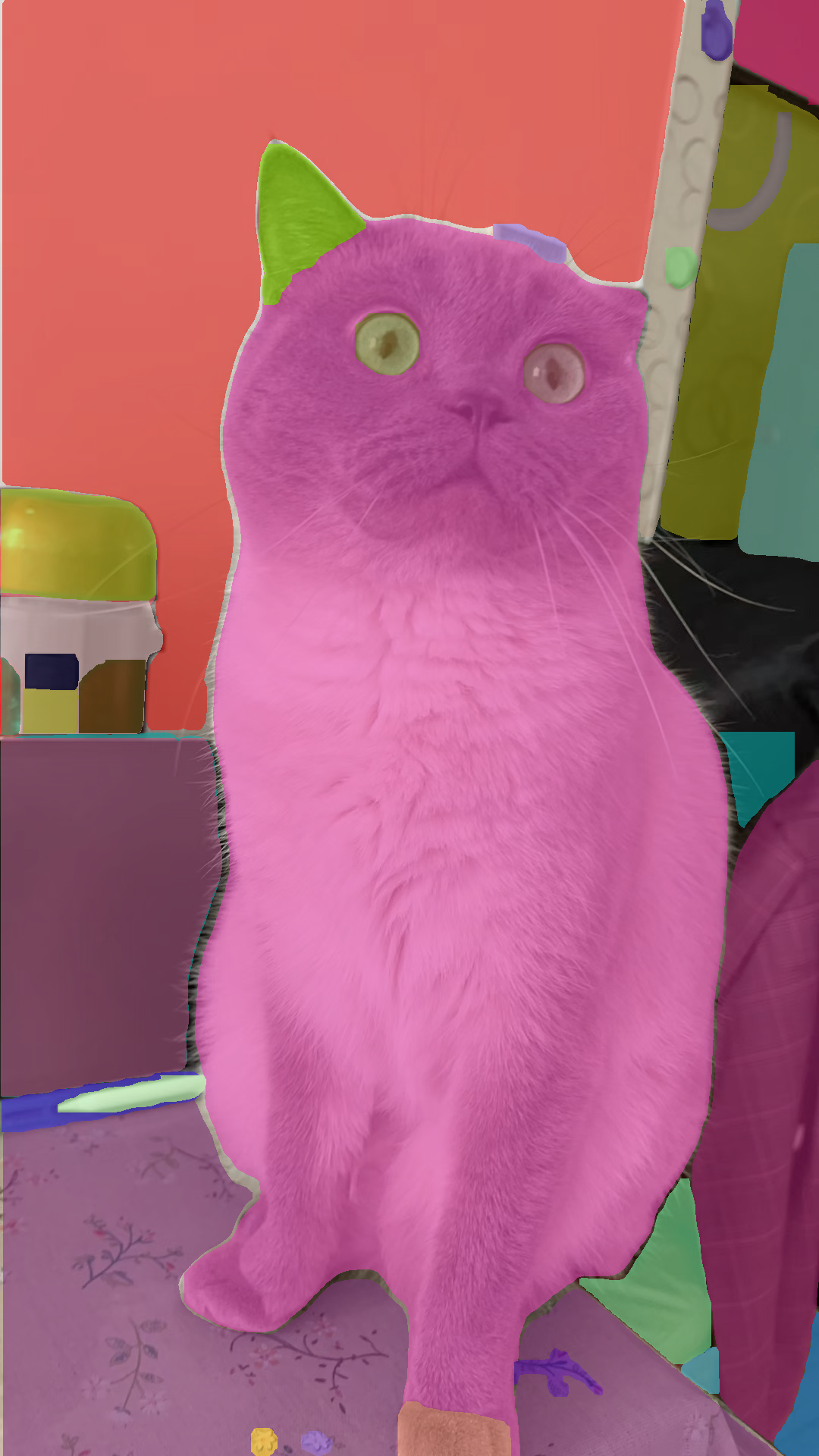

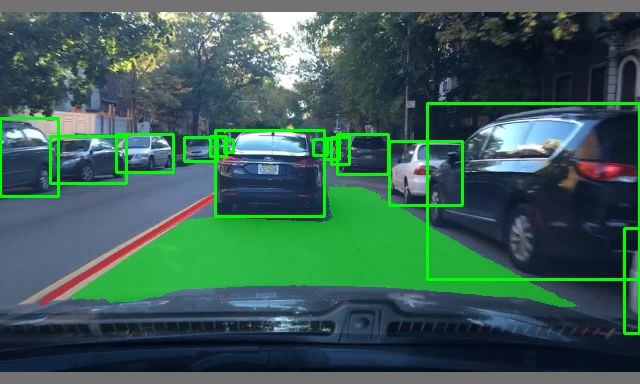

图像分割

| 模型 | 参考 | 导出自 | 支持的 Ailia 版本 | 日期 | 博客 | |

|---|---|---|---|---|---|---|

|

pytorch-fcn | pytorch-fcn | Pytorch | 1.3.0 及更高版本 | 2014年11月 | |

|

pytorch-enet | PyTorch-ENet | Pytorch | 1.2.8 及更高版本 | 2016年6月 | |

|

tusimple-DUC | TuSimple-DUC | Pytorch | 1.2.10 及更高版本 | 2017年2月 | |

|

pytorch-unet | Pytorch-Unet | Pytorch | 1.2.5 及更高版本 | 2017年8月 | |

|

deeplabv3 | Xception65 作为 DeepLab v3+ 的骨干网络 | Chainer | 1.2.0 及更高版本 | 2018年2月 | |

|

pspnet-hair-segmentation | pytorch-hair-segmentation | Pytorch | 1.2.2 及更高版本 | 2018年11月 | |

|

swiftnet | SwiftNet | Pytorch | 1.2.6 及更高版本 | 2019年3月 | |

|

hrnet_segmentation | 高分辨率网络(HRNets)用于语义分割 | Pytorch | 1.2.1 及更高版本 | 2019年4月 | |

|

hair_segmentation | 移动端头发分割 | Keras | 1.2.1 及更高版本 | 2019年7月 | |

|

paddleseg | PaddleSeg | Pytorch | 1.2.7 及更高版本 | 2019年8月 | EN JP |

|

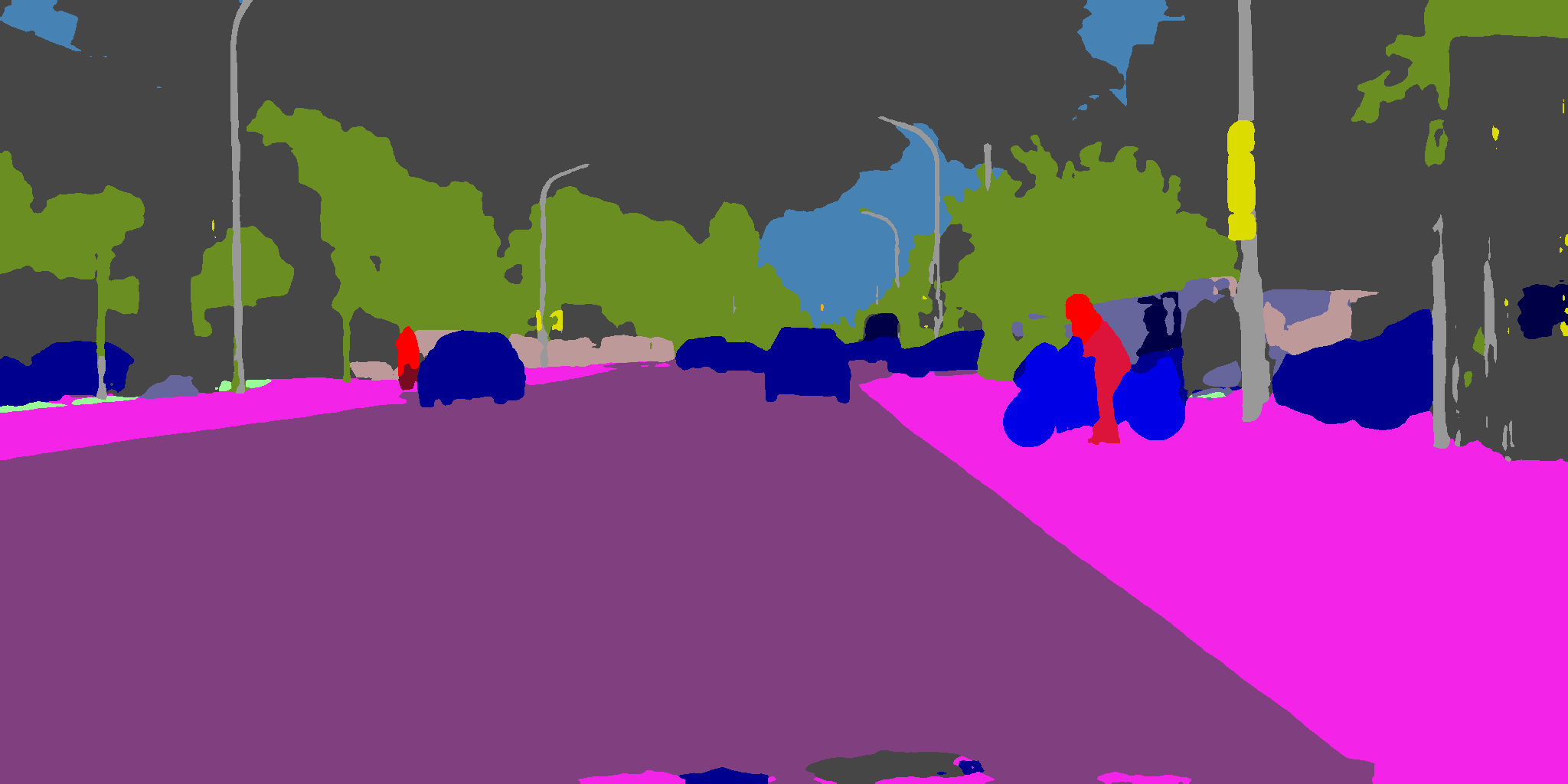

human_part_segmentation | 人体解析的自我修正 | Pytorch | 1.2.4 及更高版本 | 2019年10月 | EN JP |

|

semantic-segmentation-mobilenet-v3 | 使用 MobileNetV3 进行语义分割 | TensorFlow | 1.2.5 及更高版本 | 2019年11月 | |

|

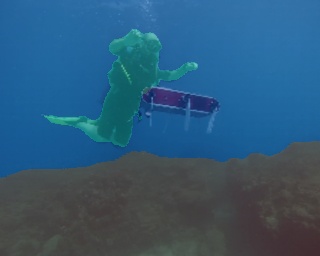

suim | SUIM | Keras | 1.2.6 及更高版本 | 2020年4月 | |

|

yet-another-anime-segmenter | 另一个动漫分割器 | Pytorch | 1.2.6 及更高版本 | 2020年10月 | |

|

dense_prediction_transformers | 用于密集预测的视觉Transformer | Pytorch | 1.2.7 及更高版本 | 2021年3月 | EN JP |

|

group_vit | GroupViT | Pytorch | 1.2.10 及更高版本 | 2022年2月 | |

|

pp_liteseg | PP-LiteSeg | Pytorch | 1.2.10 及更高版本 | 2022年4月 | |

|

anime-segmentation | 动漫分割 | Pytorch | 1.2.9 及更高版本 | 2022年8月 | |

|

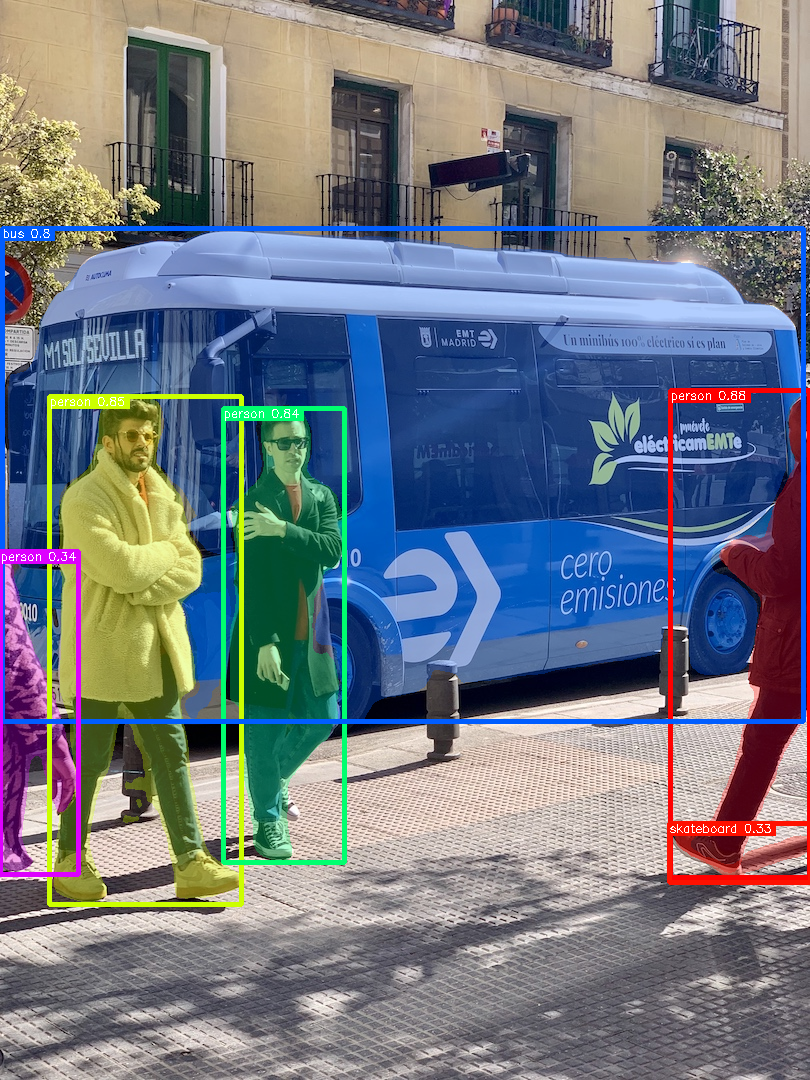

yolov8-seg | YOLOv8 | Pytorch | 1.2.14.1 及更高版本 | 2023年1月 | |

|

segment-anything | Segment Anything | Pytorch | 1.2.16 及更高版本 | 2023年4月 | |

|

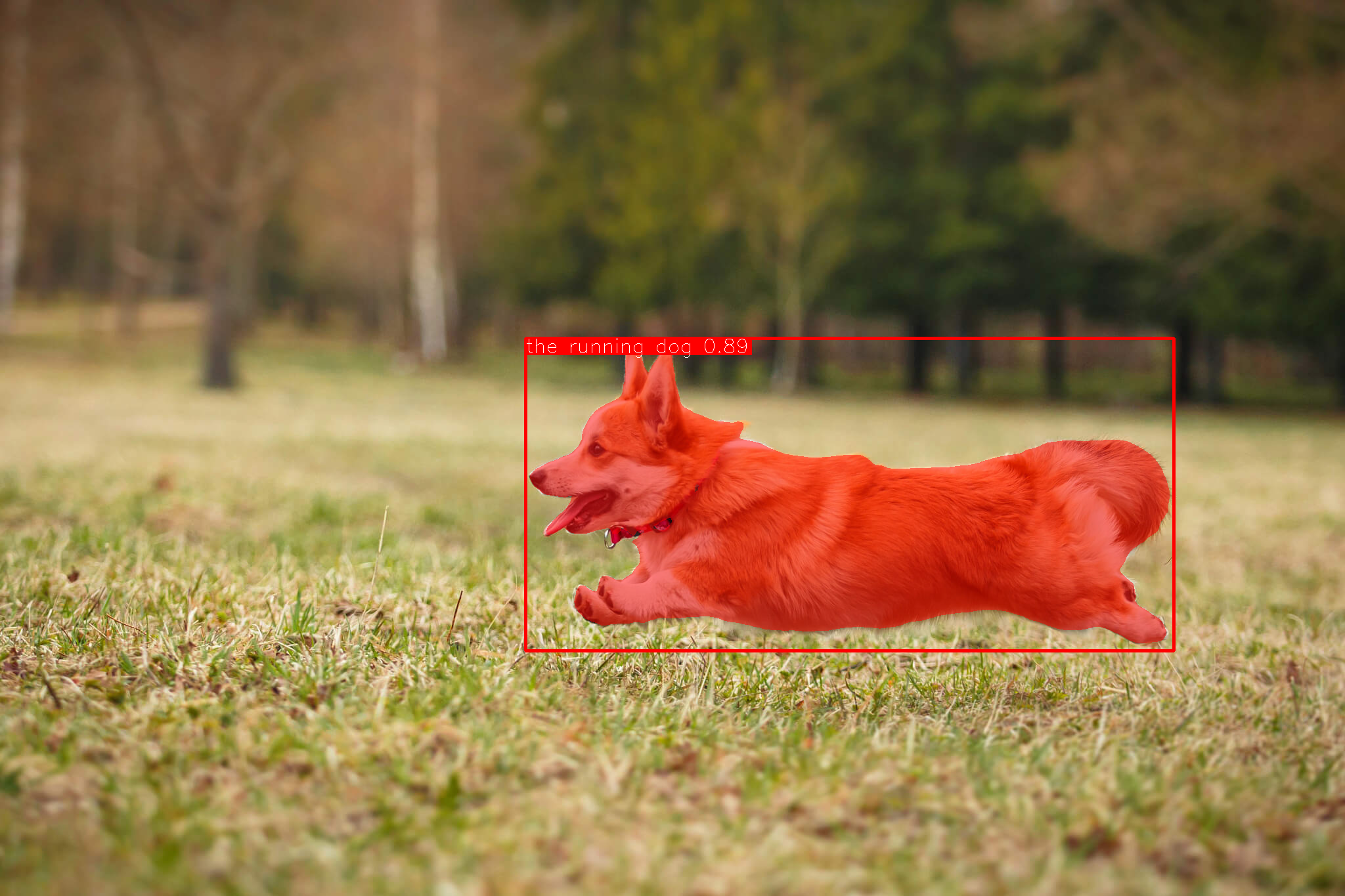

grounded_sam | Grounded-SAM | Pytorch | 1.2.16 及更高版本 | 2023年4月 | |

|

fast_sam | FastSAM | Pytorch | 1.2.14 及更高版本 | 2023年6月 | |

|

mobile_sam | MobileSAM | Pytorch | 1.6.0 及更高版本 | 2023年6月 | |

|

edge_sam | EdgeSAM | Pytorch | 1.2.10 及更高版本 | 2023年12月 | |

|

segment-anything-2 | Segment Anything 2 | Pytorch | 1.2.16 及更高版本 | 2024年7月 | |

|

yolov11-seg | Ultralytics YOLO11 | Pytorch | 1.2.14.1 及更高版本 | 2024年9月 |

地标分类

| 模型 | 参考资料 | 导出自 | 支持的 Ailia 版本 | 日期 | 博客 | |

|---|---|---|---|---|---|---|

|

places365 | Places365-CNNs 发布 | Pytorch | 1.2.5 及以上 | 2016年10月 | |

|

landmarks_classifier_asia | Landmarks classifier_asia_V1.1 | TensorFlow Hub | 1.2.4 及以上 | 2020年4月 | EN JP |

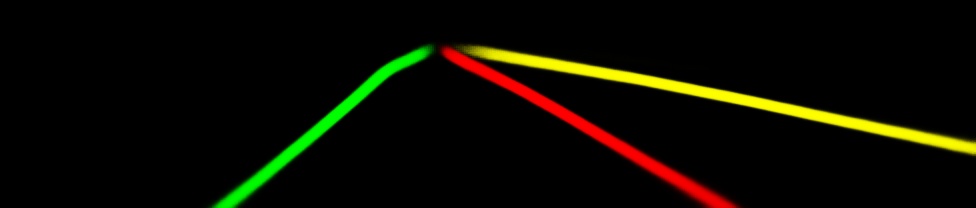

线段检测

| 模型 | 参考资料 | 导出自 | 支持的 Ailia 版本 | 日期 | 博客 | |

|---|---|---|---|---|---|---|

|

dexined | DexiNed:用于边缘检测的密集极端 Inception 网络 | Pytorch | 1.2.5 及以上 | 2019年9月 | |

|

mlsd | M-LSD:面向轻量级和实时线段检测 | TensorFlow | 1.2.8 及以上 | 2021年6月 | EN JP |

低光图像增强

| 模型 | 参考资料 | 导出自 | 支持的 Ailia 版本 | 日期 | 博客 | |

|---|---|---|---|---|---|---|

|

agllnet | AGLLNet:注意力引导的低光图像增强(IJCV 2021) | Pytorch | 1.2.9 及以上 | 2019年8月 | EN JP |

|

drbn_skf | DRBN SKF | Pytorch | 1.2.14 及以上 | 2023年4月 |

自然语言处理

Bert

| 模型 | 参考资料 | 导出自 | 支持的 Ailia 版本 | 日期 | 博客 |

|---|---|---|---|---|---|

| bert | pytorch-pretrained-bert | Pytorch | 1.2.2 及以上 | 2018年10月 | EN JP |

| bert_maskedlm | huggingface/transformers | Pytorch | 1.2.5 及以上 | 2018年10月 | |

| bert_question_answering | huggingface/transformers | Pytorch | 1.2.5 及以上 | 2018年10月 |

嵌入

| 模型 | 参考资料 | 导出自 | 支持的 Ailia 版本 | 日期 | 博客 |

|---|---|---|---|---|---|

| sentence_transformers_japanese | sentence transformers | Pytorch | 1.2.7 及以上 | 2019年8月 | JP |

| multilingual-e5 | multilingual-e5-base | Pytorch | 1.2.15 及以上 | 2022年12月 | JP |

| glucose | GLuCoSE(基于通用 Luke 的对比句子嵌入)-基础日语版 | Pytorch | 1.2.15 及以上 | 2023年7月 | |

| ruri-v3 | ruri-v3-310m | Pytorch | 1.2.13 及以上 | 2025年4月 | |

| embeddinggemma | EmbeddingGemma | Pytorch | 1.2.14 及以上 | 2025年9月 | JP |

错误纠正器

| 模型 | 参考 | 导出自 | 支持的 Ailia 版本 | 日期 | 博客 |

|---|---|---|---|---|---|

| bert_insert_punctuation | bert-japanese | Pytorch | 1.2.15 及更高版本 | 2019年11月 | |

| bertjsc | bertjsc | Pytorch | 1.2.15 及更高版本 | 2023年3月 | |

| t5_whisper_medical | 使用 t5 进行医学术语纠错 | Pytorch | 1.2.13 及更高版本 |

字素到音素转换

| 模型 | 参考 | 导出自 | 支持的 Ailia 版本 | 日期 | 博客 |

|---|---|---|---|---|---|

| g2p_en | g2p_en | Pytorch | 1.2.14 及更高版本 | 2019年1月 | JP |

| g2pw | g2pW | Pytorch | 1.2.9 及更高版本 | 2022年3月 | |

| soundchoice-g2p | Hugging Face - speechbrain/soundchoice-g2p | Pytorch | 1.2.16 及更高版本 | 2022年7月 |

命名实体识别

| 模型 | 参考 | 导出自 | 支持的 Ailia 版本 | 日期 | 博客 |

|---|---|---|---|---|---|

| bert_ner | huggingface/transformers | Pytorch | 1.2.5 及更高版本 | 2018年10月 | |

| t5_base_japanese_ner | t5-japanese | Pytorch | 1.2.13 及更高版本 | 2021年3月 | |

| bert_ner_japanese | jurabi/bert-ner-japanese | Pytorch | 1.2.10 及更高版本 | 2023年3月 |

重排序器

| 模型 | 参考 | 导出自 | 支持的 Ailia 版本 | 日期 | 博客 |

|---|---|---|---|---|---|

| cross_encoder_mmarco | jeffwan/mmarco-mMiniLMv2-L12-H384-v | Pytorch | 1.2.10 及更高版本 | 2022年9月 | JP |

| japanese-reranker-cross-encoder | hotchpotch/japanese-reranker-cross-encoder-large-v1 | Pytorch | 1.2.16 及更高版本 | 2024年4月 |

句子生成

| 模型 | 参考 | 导出自 | 支持的 Ailia 版本 | 日期 | 博客 |

|---|---|---|---|---|---|

| gpt2 | GPT-2 | Pytorch | 1.2.7 及更高版本 | 2019年2月 | |

| rinna_gpt2 | japanese-pretrained-models | Pytorch | 1.2.7 及更高版本 | 2021年4月 |

情感分析

| 模型 | 参考 | 导出自 | 支持的 Ailia 版本 | 日期 | 博客 |

|---|---|---|---|---|---|

| bert_sentiment_analysis | huggingface/transformers | Pytorch | 1.2.5 及更高版本 | 2018年10月 | |

| bert_tweets_sentiment | huggingface/transformers | Pytorch | 1.2.5 及更高版本 | 2018年10月 |

摘要生成

| 模型 | 参考 | 导出自 | 支持的 Ailia 版本 | 日期 | 博客 |

|---|---|---|---|---|---|

| bert_sum_ext | BERTSUMEXT | Pytorch | 1.2.7 及更高版本 | 2019年5月 | |

| presumm | PreSumm | Pytorch | 1.2.8 及更高版本 | 2019年8月 | |

| t5_base_japanese_title_generation | t5-japanese | Pytorch | 1.2.13 及更高版本 | 2021年3月 | JP |

| t5_base_summarization | t5-japanese | Pytorch | 1.2.13 及更高版本 | 2021年3月 |

翻译

| 模型 | 参考 | 导出自 | 支持的 Ailia 版本 | 日期 | 博客 |

|---|---|---|---|---|---|

| fugumt-en-ja | Fugu-Machine Translator | Pytorch | 1.2.9 及更高版本 | 2020年11月 | JP |

| fugumt-ja-en | Fugu-Machine Translator | Pytorch | 1.2.10 及更高版本 | 2020年11月 |

零样本分类

| 模型 | 参考 | 导出自 | 支持的 Ailia 版本 | 日期 | 博客 |

|---|---|---|---|---|---|

| bert_zero_shot_classification | huggingface/transformers | Pytorch | 1.2.5 及更高版本 | 2018年10月 | |

| multilingual-minilmv2 | MoritzLaurer/multilingual-MiniLMv2-L12-mnli-xnli | Pytorch | 1.2.10 及更高版本 | 2022年6月 |

网络入侵检测

| 模型 | 参考 | 导出自 | 支持的 Ailia 版本 | 日期 | 博客 |

|---|---|---|---|---|---|

| bert-network-packet-flow-header-payload | bert-network-packet-flow-header-payload | Pytorch | 1.2.10 及更高版本 | 2023年9月 | |

| falcon-adapter-network-packet | falcon-adapter-network-packet | Pytorch | 1.2.10 及更高版本 | 2023年9月 |

神经渲染

| 模型 | 参考 | 导出自 | 支持的 Ailia 版本 | 日期 | 博客 | |

|---|---|---|---|---|---|---|

|

nerf | NeRF: 神经辐射场 | Tensorflow | 1.2.10 及更高版本 | 2020年3月 | EN JP |

|

TripoSR | TripoSR | Pytorch | 1.2.6 及更高版本 | 2024年3月 |

不适宜内容检测器

| 模型 | 参考 | 导出自 | 支持的 Ailia 版本 | 日期 | 博客 |

|---|---|---|---|---|---|

| clip-based-nsfw-detector | CLIP-based-NSFW-Detector | Keras | 1.2.10 及更高版本 | 2022年3月 | JP |

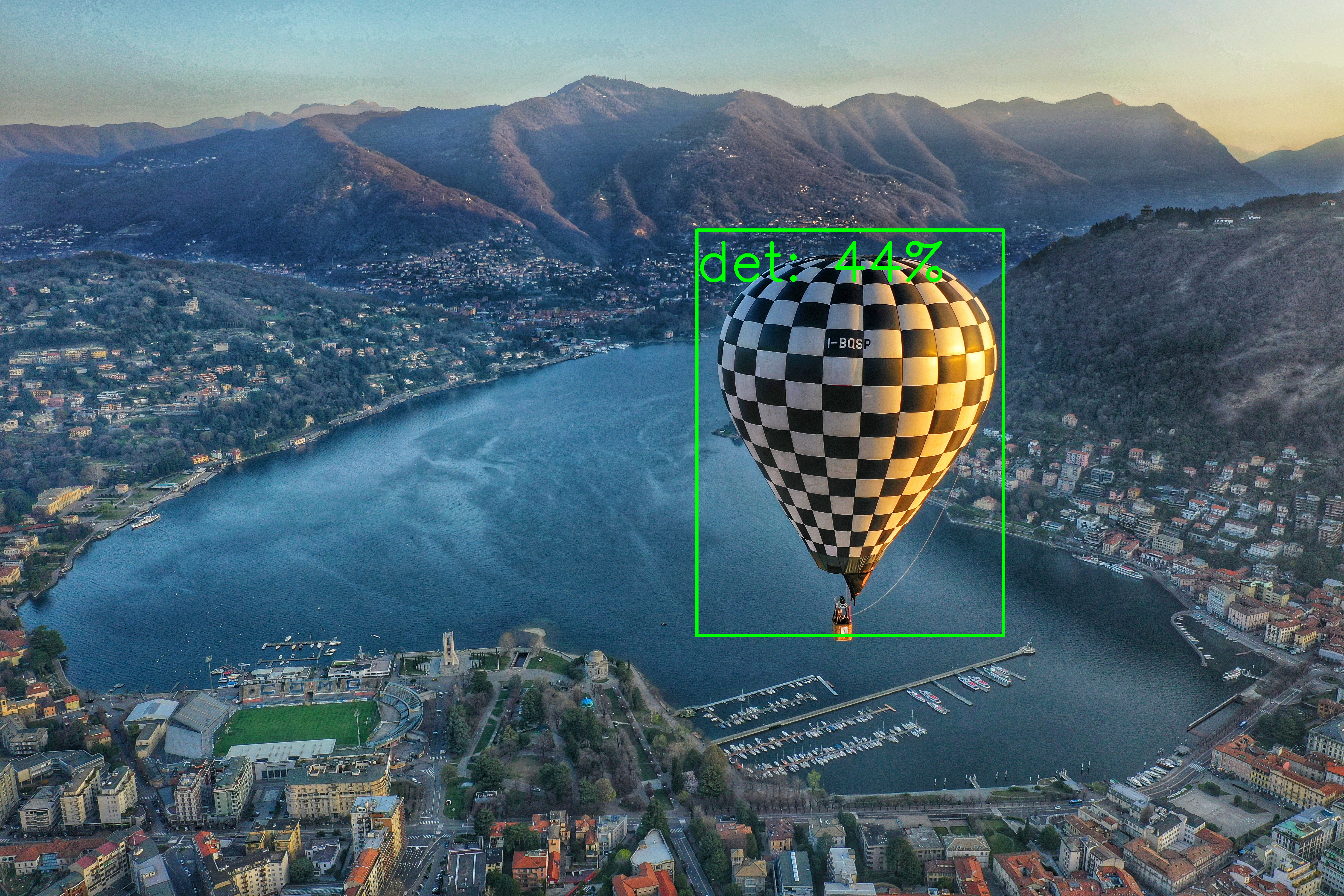

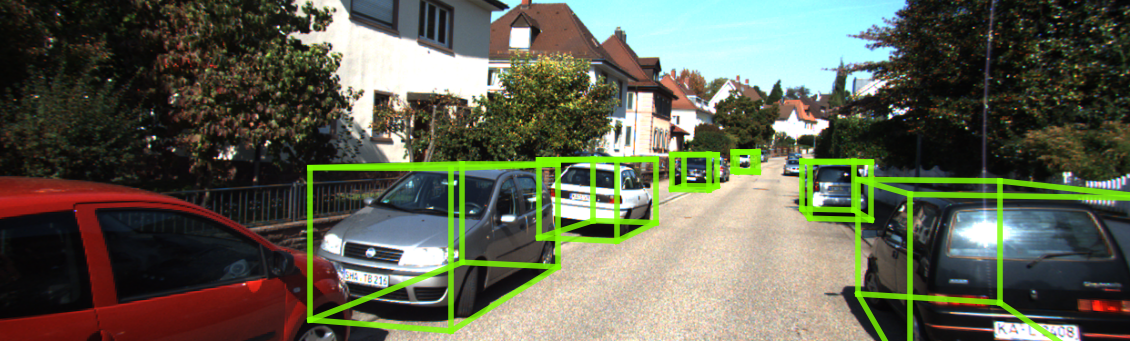

目标检测

CNN

| 模型 | 参考资料 | 导出自 | 支持的 Ailia 版本 | 日期 | 博客 | |

|---|---|---|---|---|---|---|

|

yolov1-tiny | YOLO:实时目标检测 | Darknet | 1.1.0 及以上 | 2015年6月 | 日文 |

|

yolov2 | YOLO:实时目标检测 | Pytorch | 1.2.0 及以上 | 2016年12月 | |

|

yolov2-tiny | YOLO:实时目标检测 | Pytorch | 1.2.6 及以上 | 2016年12月 | |

|

maskrcnn | Mask R-CNN:用于实例分割的实时神经网络 | Pytorch | 1.2.3 及以上 | 2017年3月 | |

|

yolov3 | YOLO:实时目标检测 | ONNX Runtime | 1.2.1 及以上 | 2018年4月 | 英文 日文 |

|

yolov3-tiny | YOLO:实时目标检测 | ONNX Runtime | 1.2.1 及以上 | 2018年4月 | |

|

mobilenet_ssd | 基于 MobileNetV1、MobileNetV2 和 VGG 的 SSD/SSD-lite PyTorch 实现 | Pytorch | 1.2.1 及以上 | 2018年8月 | 英文 日文 |

|

m2det | M2Det:基于多级特征金字塔网络的单次目标检测器 | Pytorch | 1.2.3 及以上 | 2018年11月 | 英文 日文 |

|

centernet | CenterNet:以点表示物体 | Pytorch | 1.2.1 及以上 | 2019年4月 | 英文 日文 |

|

yolact | You Only Look At CoefficienTs | Pytorch | 1.2.6 及以上 | 2019年4月 | |

|

efficientdet | EfficientDet:可扩展且高效的对象检测,基于 PyTorch | Pytorch | 1.2.6 及以上 | 2019年11月 | |

|

pedestrian_detection | 基于 YOLOv3 的行人检测:研究与应用 | Keras | 1.2.1 及以上 | 2020年3月 | |

|

crowd_det | 拥挤场景中的目标检测 | Pytorch | 1.2.13 及以上 | 2020年3月 | |

|

yolov4 | PyTorch-YOLOv4 | Pytorch | 1.2.4 及以上 | 2020年4月 | 英文 日文 |

|

yolov4-tiny | PyTorch-YOLOv4 | Pytorch | 1.2.5 及以上 | 2020年4月 | |

|

yolov5 | yolov5 | Pytorch | 1.2.5 及以上 | 2020年5月 | 英文 日文 |

|

poly_yolo | Poly YOLO | Keras | 1.2.6 及以上 | 2020年5月 | |

|

nanodet | NanoDet | Pytorch | 1.2.6 及以上 | 2020年11月 | |

|

yolor | yolor | Pytorch | 1.2.5 及以上 | 2021年5月 | |

|

yolox | YOLOX | Pytorch | 1.2.6 及以上 | 2021年7月 | 英文 日文 |

|

picodet | PP-PicoDet | Pytorch | 1.2.10 及以上 | 2021年11月 | |

|

yolox-ti-lite | edgeai-yolox | Pytorch | 1.2.9 及以上 | 2021年12月 | |

|

yolov7 | YOLOv7 | Pytorch | 1.2.7 及以上 | 2022年7月 | |

|

fastest-det | FastestDet | Pytorch | 1.2.5 及以上 | 2022年7月 | |

|

yolov | YOLOV | Pytorch | 1.2.10 及以上 | 2022年8月 | |

|

yolov6 | YOLOV6 | Pytorch | 1.2.10 及以上 | 2022年9月 | |

|

damo_yolo | DAMO-YOLO | Pytorch | 1.2.9 及以上 | 2022年11月 | |

|

yolov8 | YOLOv8 | Pytorch | 1.2.14.1 及以上 | 2023年1月 | |

|

yolox_body_head_hand_face | YOLOX-Body-Head-Hand-Face | Pytorch | 1.2.15 及以上 | 2024年1月 | |

|

yolov9 | YOLOv9 | Pytorch | 1.2.10 及以上 | 2024年2月 | |

|

yolov10 | YOLOv10 | Pytorch | 1.2.11 及以上 | 2024年5月 | |

|

yolov11 | YOLOv11 | Pytorch | 1.2.14 及以上 | 2024年9月 | |

|

yolov12 | YOLOv12 | Pytorch | 1.2.14 及以上 | 2025年2月 |

变压器

| 模型 | 参考 | 导出自 | 支持的 Ailia 版本 | 日期 | 博客 | |

|---|---|---|---|---|---|---|

|

glip | GLIP | Pytorch | 1.2.13 及更高版本 | 2021年12月 | |

|

dab-detr | DAB-DETR | Pytorch | 1.2.12 及更高版本 | 2022年1月 | |

|

detic | 使用图像级监督检测两万个类别 | Pytorch | 1.2.10 及更高版本 | 2022年1月 | EN JP |

|

groundingdino | Grounding DINO | Pytorch | 1.2.16 及更高版本 | 2023年3月 | JP |

|

rt-detr-v2 | RT-DETR | Pytorch | 1.2.13 及更高版本 | 2024年7月 | JP |

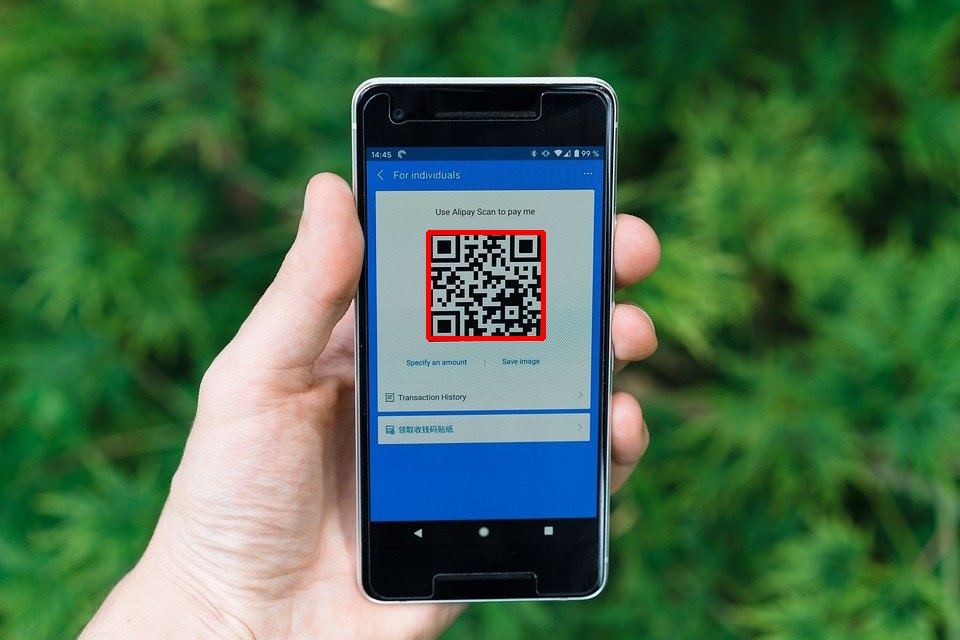

特定目标

| 模型 | 参考 | 导出自 | 支持的 Ailia 版本 | 日期 | 博客 | |

|---|---|---|---|---|---|---|

|

traffic-sign-detection | 交通标志检测 | Tensorflow | 1.2.10 及更高版本 | 2018年8月 | EN JP |

|

sku110k-densedet | SKU110K-DenseDet | Pytorch | 1.2.9 及更高版本 | 2019年4月 | EN JP |

|

footandball | FootAndBall:集成球员和球检测器 | Pytorch | 1.2.0 及更高版本 | 2019年12月 | |

|

qrcode_wechatqrcode | qrcode_wechatqrcode | Caffe | 1.2.15 及更高版本 | 2021年3月 | |

|

mobile_object_localizer | mobile_object_localizer_v1 | TensorFlow Hub | 1.2.6 及更高版本 | 2021年6月 | EN JP |

|

layout_parsing | unstructured-inference | Pytorch | 1.2.9 及更高版本 | 2022年12月 |

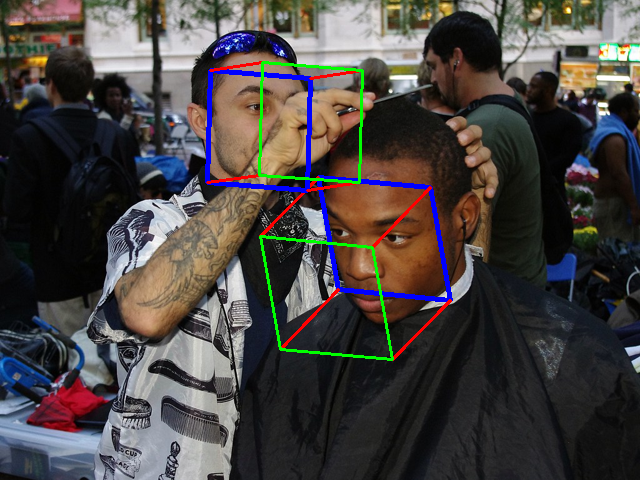

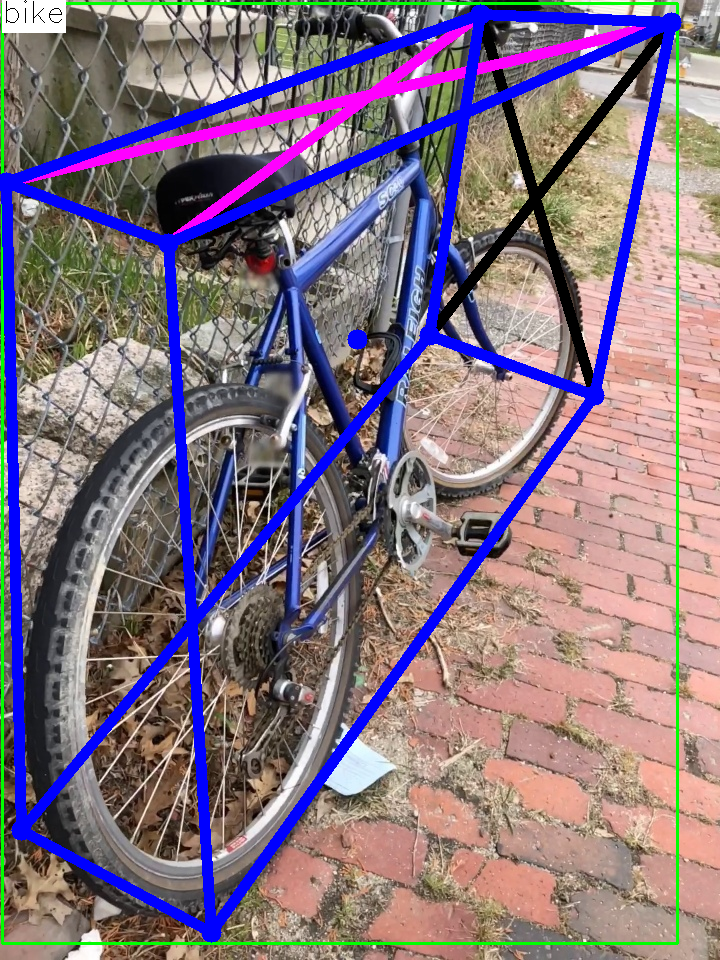

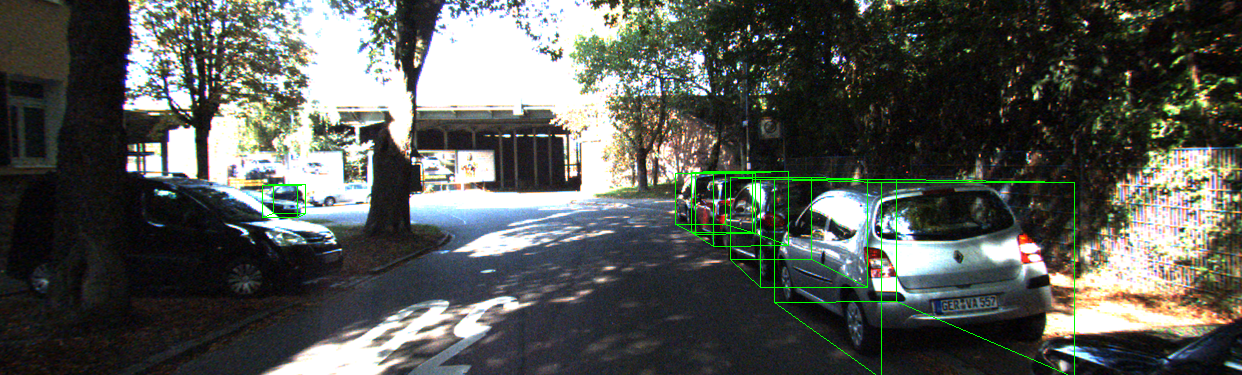

三维目标检测

| 模型 | 参考文献 | 导出自 | 支持的 Ailia 版本 | 日期 | 博客 | |

|---|---|---|---|---|---|---|

|

3d_bbox | 利用深度学习和几何学进行 3D 边界框估计 | Pytorch | 1.2.6 及更高版本 | 2016 年 12 月 | |

|

d4lcn | D4LCN | Pytorch | 1.2.9 及更高版本 | 2019 年 12 月 | |

|

egonet | EgoNet | Pytorch | 1.2.9 及更高版本 | 2020 年 11 月 | |

|

mediapipe_objectron | MediaPipe Objectron | TensorFlow Lite | 1.2.5 及更高版本 | 2020 年 12 月 | |

|

3d-object-detection.pytorch | 3d-object-detection.pytorch | Pytorch | 1.2.8 及更高版本 | 2021 年 2 月 | EN JP |

|

did_m3d | DID M3D | Pytorch | 1.2.11 及更高版本 | 2022 年 7 月 |

目标跟踪

| 模型 | 参考文献 | 导出自 | 支持的 Ailia 版本 | 日期 | 博客 | |

|---|---|---|---|---|---|---|

|

deepsort | 使用 PyTorch 的 Deep Sort | Pytorch | 1.2.3 及更高版本 | 2017 年 3 月 | EN JP |

|

person_reid_baseline_pytorch | UTS-Person-reID-Practical | Pytorch | 1.2.6 及更高版本 | 2019 年 3 月 | |

|

abd_net | 专注但多样的行人再识别 | Pytorch | 1.2.7 及更高版本 | 2019 年 8 月 | |

|

deepsort_vehicle | 多摄像头实时目标跟踪 | Pytorch | 1.2.9 及更高版本 | 2020 年 5 月 | |

|

qd-3dt | 单目准密集 3D 对象跟踪 | Pytorch | 1.2.11 及更高版本 | 2021 年 3 月 | |

|

centroids-reid | 论质心在图像检索中的不合理有效性 | Pytorch | 1.2.9 及更高版本 | 2021 年 4 月 | |

|

siam-mot | SiamMOT | Pytorch | 1.2.9 及更高版本 | 2021 年 5 月 | |

|

bytetrack | ByteTrack | Pytorch | 1.2.5 及更高版本 | 2021 年 10 月 | EN JP |

|

strong_sort | StrongSORT | Pytorch | 1.2.15 及更高版本 | 2022 年 2 月 | |

|

samurai | SAMURAI:通过运动感知内存将 Segment Anything Model 适配到零样本视觉跟踪 | Pytorch | 1.6.1 及更高版本 | 2024 年 11 月 |

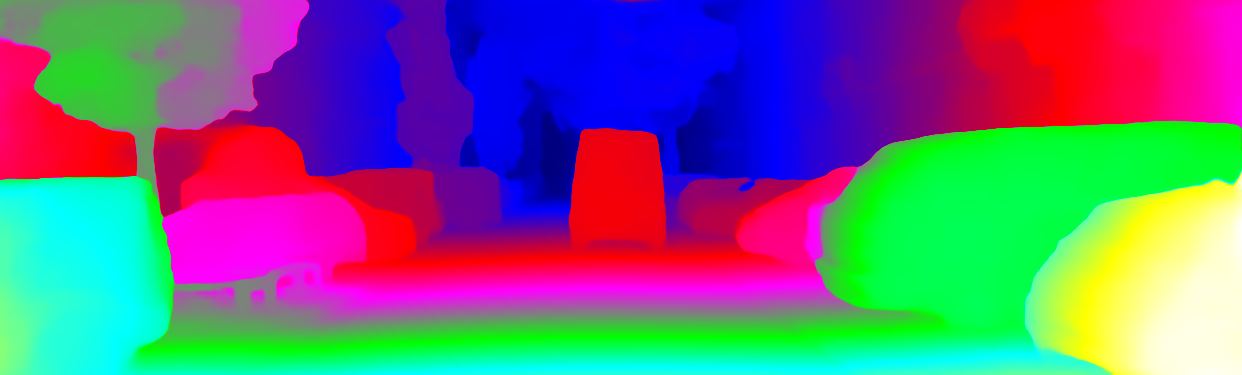

光流估计

| 模型 | 参考文献 | 导出自 | 支持的 Ailia 版本 | 日期 | 博客 | |

|---|---|---|---|---|---|---|

|

raft | RAFT:用于光流估计的递归全对场变换 | Pytorch | 1.2.6 及更高版本 | 2020 年 3 月 | EN JP |

|

cotracker3 | CoTracker3:通过伪标签真实视频实现更简单、更好的点跟踪 | Pytorch | 1.6.1 及更高版本 | 2024 年 10 月 |

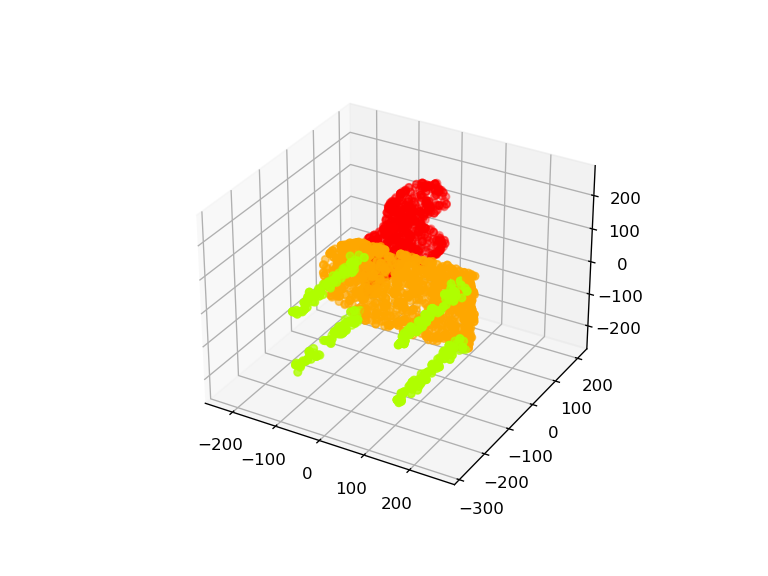

点云分割

| 模型 | 参考资料 | 导出自 | 支持的 Ailia 版本 | 日期 | 博客 | |

|---|---|---|---|---|---|---|

|

pointnet_pytorch | PointNet.pytorch | Pytorch | 1.2.6 及更高版本 | 2016年12月 |

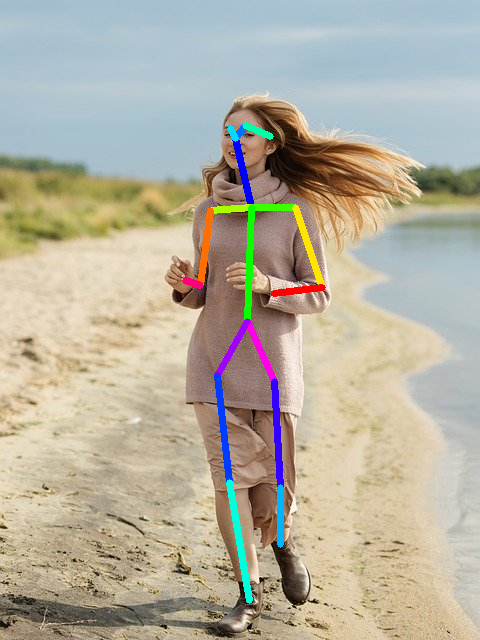

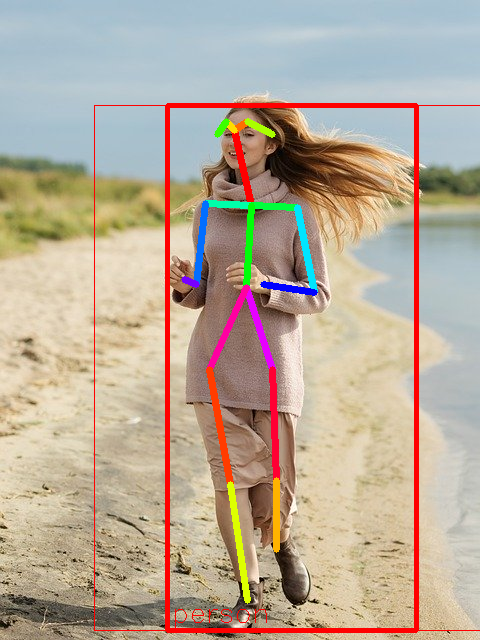

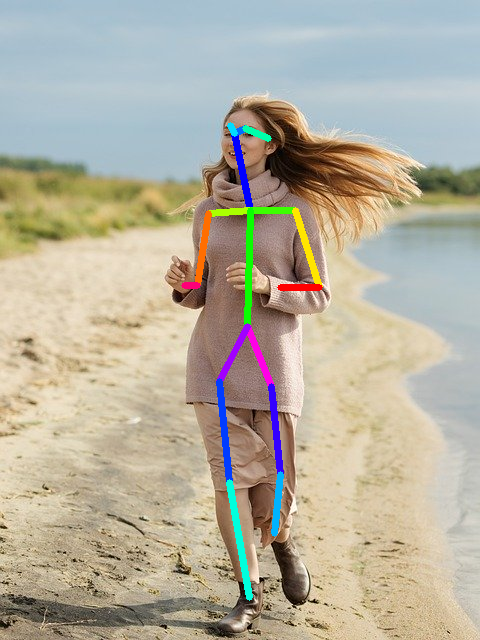

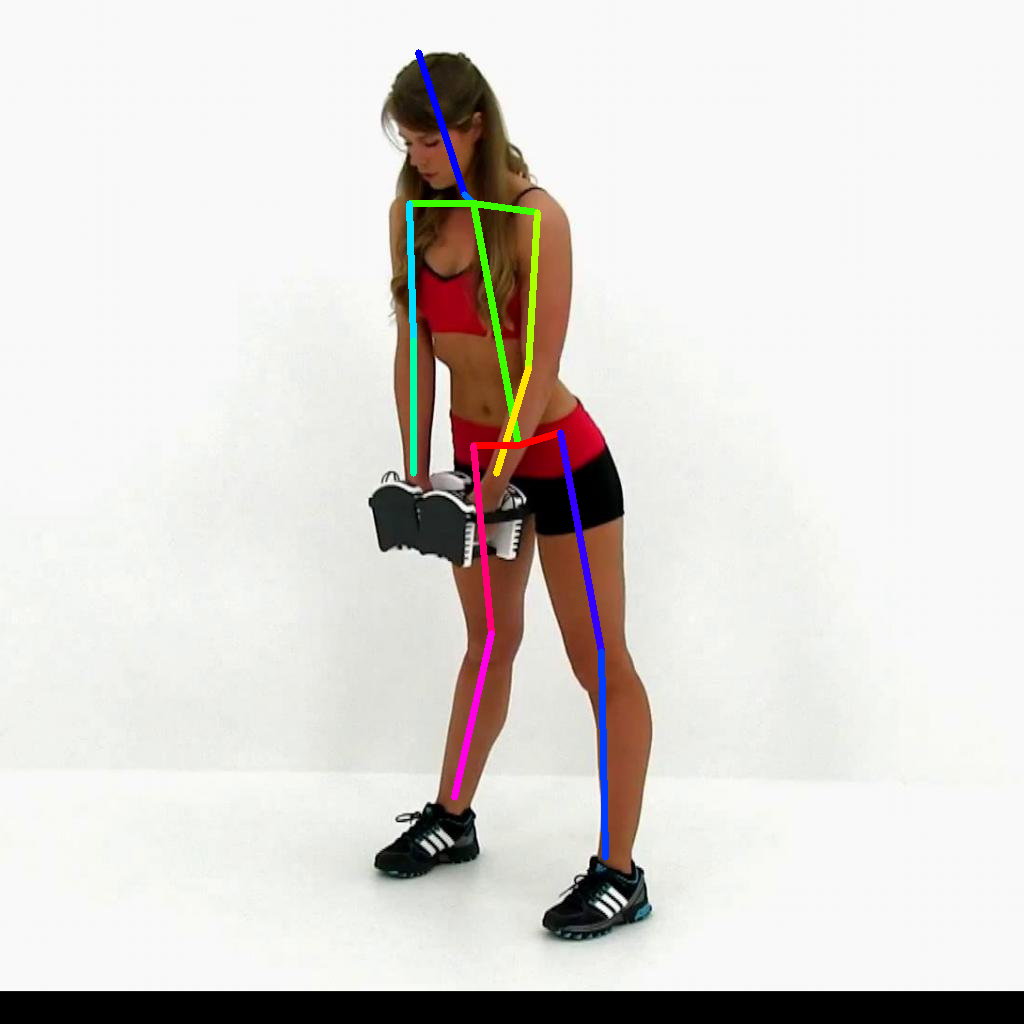

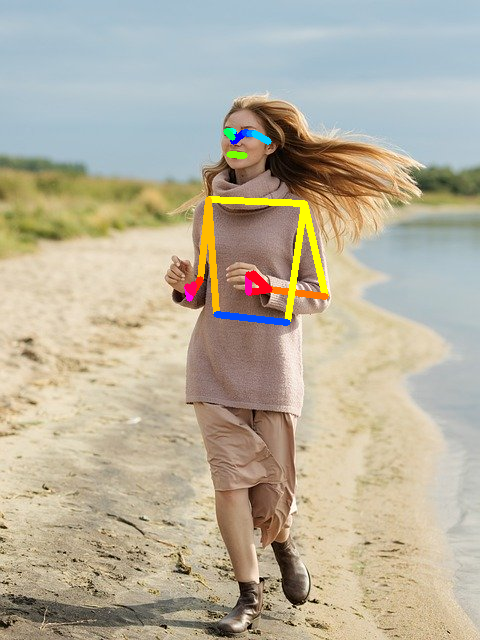

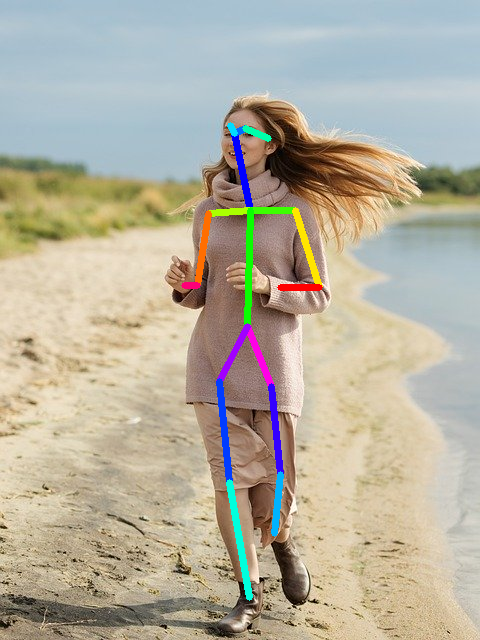

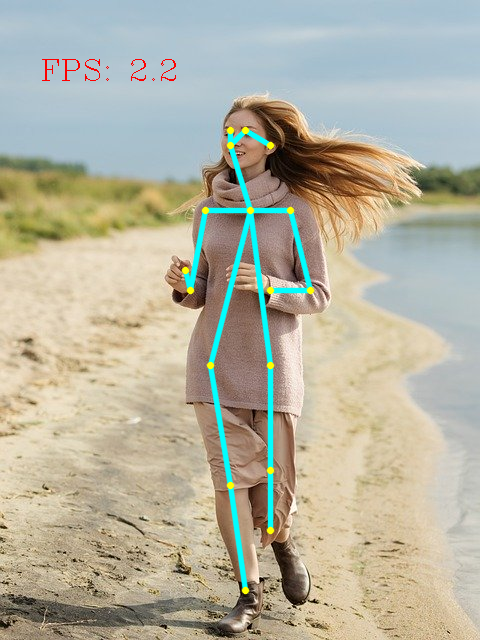

姿势估计

| 模型 | 参考资料 | 导出自 | 支持的 Ailia 版本 | 日期 | 博客 | |

|---|---|---|---|---|---|---|

|

openpose | CVPR'17 实时多人姿态估计代码库(口头报告) | Caffe | 1.2.1 及更高版本 | 2016年11月 | |

|

posenet | PoseNet Pytorch | Pytorch | 1.2.10 及更高版本 | 2017年1月 | |

|

pose_resnet | 人体姿态估计与跟踪的简单基线 | Pytorch | 1.2.1 及更高版本 | 2018年4月 | EN JP |

|

lightweight-human-pose-estimation | 在 PyTorch 中快速准确的人体姿态估计。 包含 “CPU 上的实时 2D 多人姿态估计:轻量级 OpenPose”论文的实现。 |

Pytorch | 1.2.1 及更高版本 | 2018年11月 | EN JP |

|

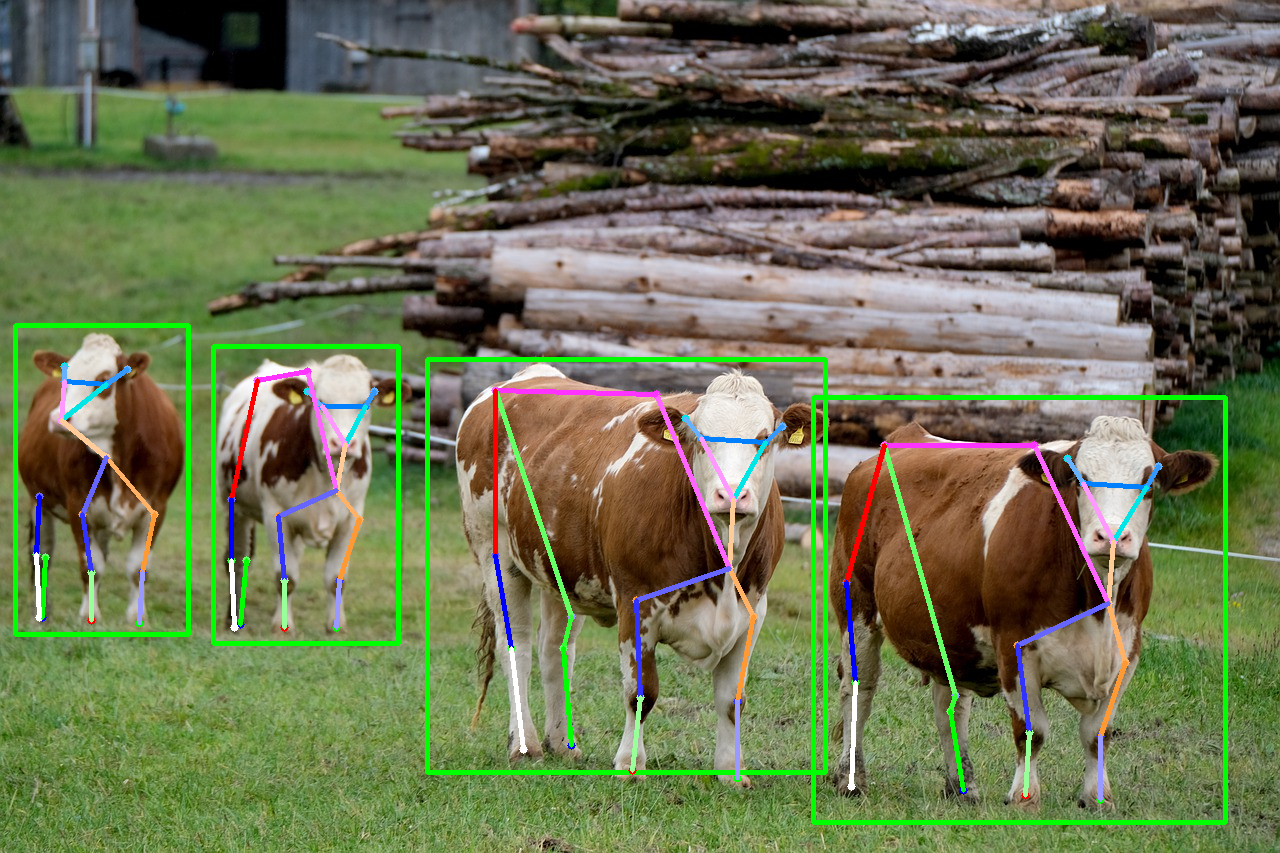

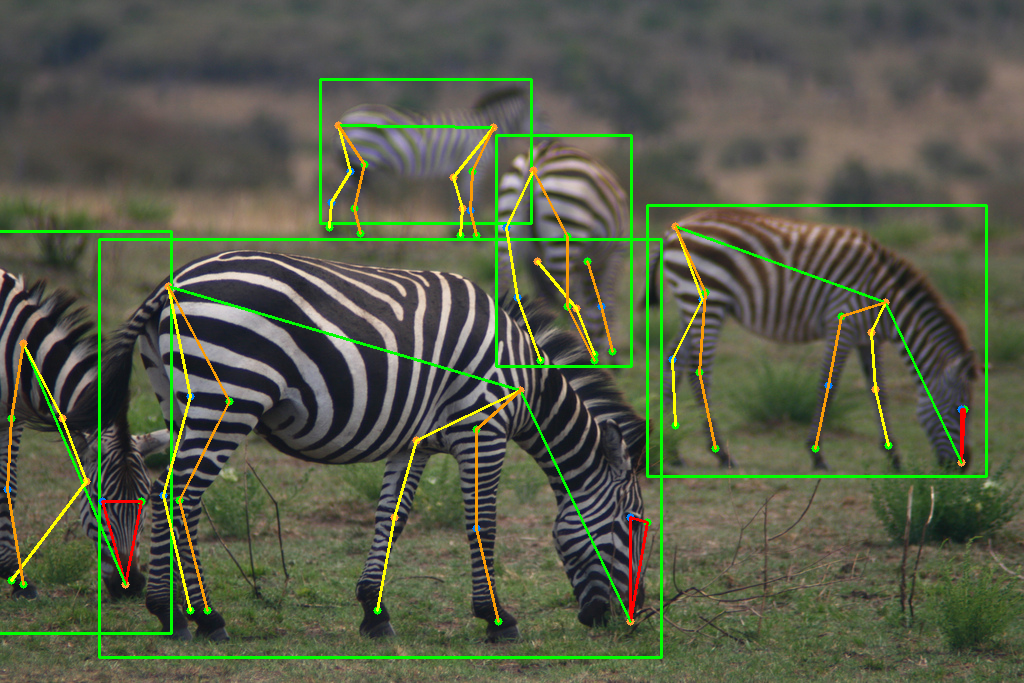

animalpose | MMPose - 2D 动物姿态估计 | Pytorch | 1.2.7 及更高版本 | 2019年8月 | EN JP |

|

efficientpose | EfficientPose 的代码库 | TensorFlow | 1.2.6 及更高版本 | 2020年4月 | |

|

blazepose | MediaPipePyTorch | Pytorch | 1.2.5 及更高版本 | 2020年6月 | |

|

mediapipe_holistic | MediaPipe Holistic | TensorFlow | 1.2.9 及更高版本 | 2020年12月 | |

|

movenet | movenet 的代码库 | TensorFlow | 1.2.8 及更高版本 | 2021年5月 | EN JP |

|

ap-10k | AP-10K | Pytorch | 1.2.4 及更高版本 | 2021年8月 | |

|

e2pose | E2Pose | Tensorflow | 1.2.5 及更高版本 | 2022年10月 |

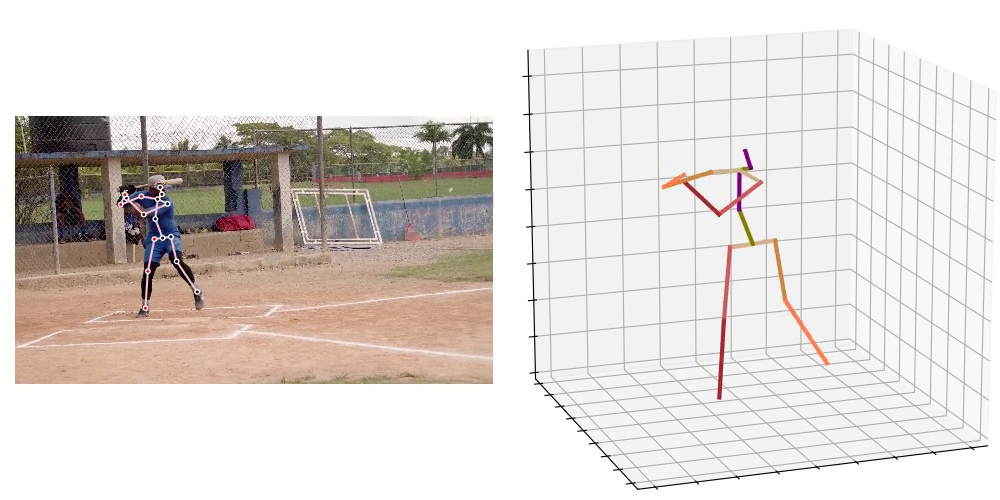

三维姿态估计

| 模型 | 参考文献 | 导出自 | 支持的 Ailia 版本 | 日期 | 博客 | |

|---|---|---|---|---|---|---|

|

pose-hg-3d | 迈向野外环境下的三维人体姿态估计:一种弱监督方法 | Pytorch | 1.2.6 及以上 | 2017年4月 | |

|

3d-pose-baseline | TensorFlow 中用于三维人体姿态估计的简单基线。 在 ICCV 17 上展示。 |

TensorFlow | 1.2.3 及以上 | 2017年5月 | |

|

lightweight-human-pose-estimation-3d | PyTorch 中的实时多人三维姿态估计演示。 可使用 OpenVINO 后端在 CPU 上进行快速推理。 |

Pytorch | 1.2.1 及以上 | 2017年12月 | |

|

3dmppe_posenet | “基于相机距离感知的自上而下方法,用于从单张 RGB 图像中进行多人三维姿态估计”的 PoseNet | Pytorch | 1.2.6 及以上 | 2019年7月 | |

|

gast | 用于视频中三维人体姿态估计的图注意力时空卷积网络 (GAST-Net) | Pytorch | 1.2.7 及以上 | 2020年3月 | EN JP |

|

blazepose-fullbody | MediaPipe | TensorFlow Lite | 1.2.5 及以上 | 2020年6月 | EN JP |

|

mediapipe_pose_world_landmarks | MediaPipe 姿态的真实世界 3D 坐标 | TensorFlow Lite | 1.2.10 及以上 | 2022年6月 |

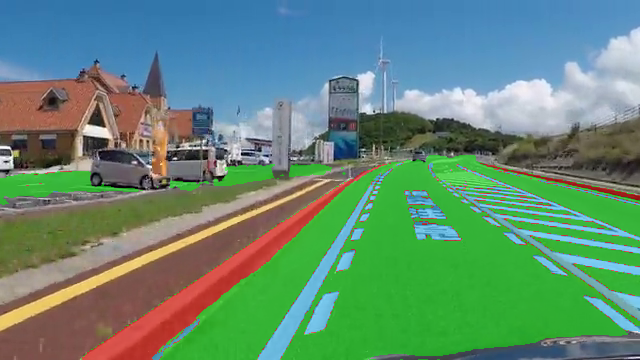

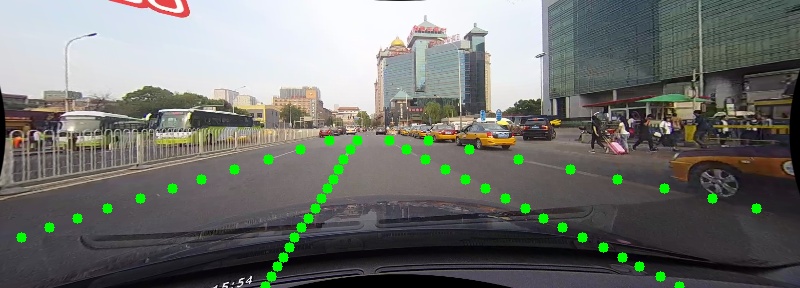

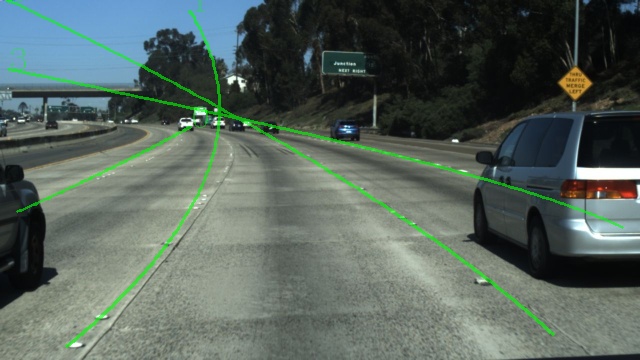

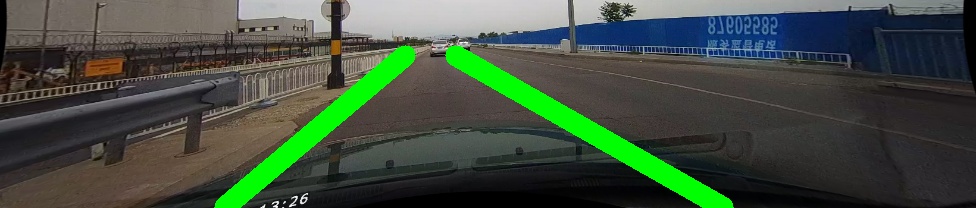

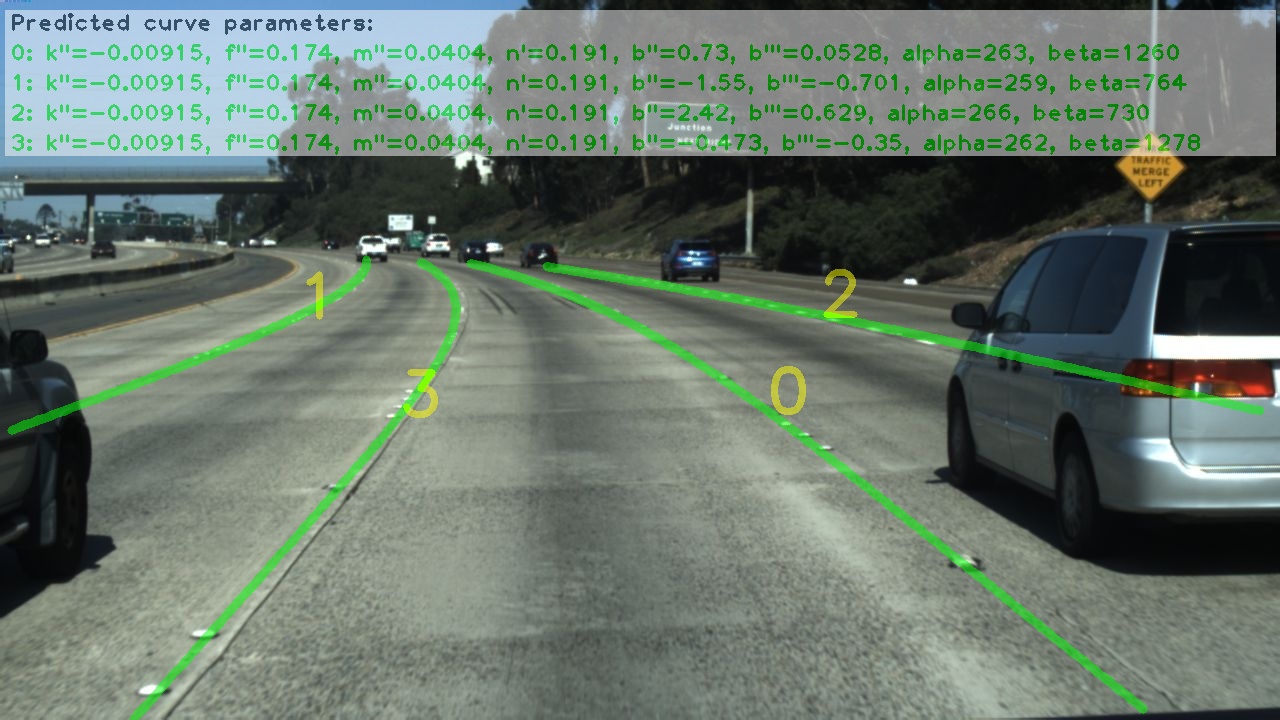

道路检测

| 模型 | 参考文献 | 导出自 | 支持的 Ailia 版本 | 日期 | 博客 | |

|---|---|---|---|---|---|---|

|

road-segmentation-adas | road-segmentation-adas-0001 | OpenVINO | 1.2.5 及以上 | 2018年9月 | |

|

codes-for-lane-detection | Codes-for-Lane-Detection | Pytorch | 1.2.6 及以上 | 2019年8月 | EN JP |

|

ultra-fast-lane-detection | Ultra-Fast-Lane-Detection | Pytorch | 1.2.6 及以上 | 2020年4月 | |

|

polylanenet | PolyLaneNet | Pytorch | 1.2.9 及以上 | 2020年4月 | |

|

roneld | RONELD-Lane-Detection | Pytorch | 1.2.6 及以上 | 2020年10月 | |

|

lstr | LSTR | Pytorch | 1.2.8 及以上 | 2020年11月 | |

|

yolop | YOLOP | Pytorch | 1.2.6 及以上 | 2021年8月 | |

|

cdnet | CDNet | Pytorch | 1.2.5 及以上 | 2022年2月 | |

|

hybridnets | HybridNets | Pytorch | 1.2.6 及以上 | 2022年3月 |

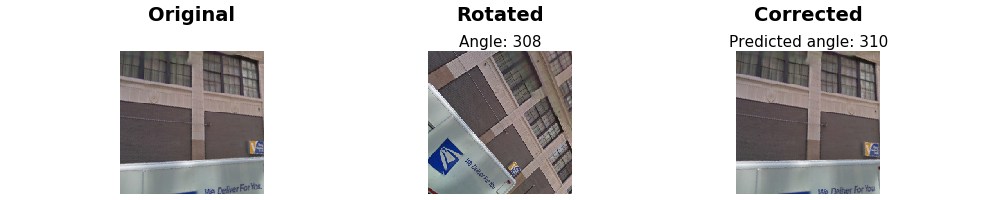

旋转预测

| 模型 | 参考文献 | 导出自 | 支持的 Ailia 版本 | 日期 | 博客 | |

|---|---|---|---|---|---|---|

|

rotnet | 用于预测图像旋转角度以校正其方向的 CNN | Keras | 1.2.1 及以上 | 2018年3月 |

风格迁移

| 模型 | 参考文献 | 导出自 | 支持的 Ailia 版本 | 日期 | 博客 | |

|---|---|---|---|---|---|---|

|

adain | 使用自适应实例归一化实现实时任意风格迁移 | Pytorch | 1.2.1 及更高版本 | 2017年3月 | EN JP |

|

pix2pixHD | pix2pixHD:基于条件 GAN 的高分辨率图像合成与语义操控 | Pytorch | 1.2.6 及更高版本 | 2017年11月 | |

|

beauty_gan | BeautyGAN | Pytorch | 1.2.7 及更高版本 | 2018年7月 | |

|

psgan | PSGAN:鲁棒姿态和表情的空间感知 GAN,用于可定制的化妆迁移 | Pytorch | 1.2.7 及更高版本 | 2019年9月 | |

|

animeganv2 | AnimeGANv2 的 PyTorch 实现 | Pytorch | 1.2.5 及更高版本 | 2020年11月 | |

|

EleGANt | EleGANt:精致且可局部编辑的 GAN,用于化妆迁移 | Pytorch | 1.2.15 及更高版本 | 2022年7月 |

超分辨率

| 模型 | 参考文献 | 导出自 | 支持的 Ailia 版本 | 日期 | 博客 | |

|---|---|---|---|---|---|---|

|

srresnet | 使用生成对抗网络实现照片级真实感单幅图像超分辨率 | Pytorch | 1.2.0 及更高版本 | 2016年9月 | EN JP |

|

edsr | 用于单幅图像超分辨率的增强深度残差网络 | Pytorch | 1.2.6 及更高版本 | 2017年7月 | EN JP |

|

han | 通过整体注意力网络实现单幅图像超分辨率 | Pytorch | 1.2.6 及更高版本 | 2020年8月 | |

|

real-esrgan | Real-ESRGAN | Pytorch | 1.2.9 及更高版本 | 2021年7月 | JP |

|

swinir | SwinIR:使用 Swin Transformer 进行图像修复 | Pytorch | 1.2.12 及更高版本 | 2021年8月 | |

|

rcan-it | 重新审视 RCAN:改进的图像超分辨率训练方法 | Pytorch | 1.2.10 及更高版本 | 2022年1月 | |

|

Hat | Hat | Pytorch | 1.2.6 及更高版本 | 2022年5月 | |

|

SPAN | SPAN | Pytorch | 1.2.14 及更高版本 | 2023年11月 | JP |

文本检测

| 模型 | 参考文献 | 导出自 | 支持的 Ailia 版本 | 日期 | 博客 | |

|---|---|---|---|---|---|---|

|

east | EAST:高效准确的场景文本检测器 | TensorFlow | 1.2.6 及更高版本 | 2017年4月 | |

|

pixel_link | Pixel-Link | TensorFlow | 1.2.6 及更高版本 | 2018年1月 | |

|

craft_pytorch | CRAFT:面向文本检测的字符区域感知模型 | Pytorch | 1.2.2 及更高版本 | 2019年4月 |

文本识别

| 模型 | 参考资料 | 导出自 | 支持的 Ailia 版本 | 日期 | 博客 | |

|---|---|---|---|---|---|---|

|

etl | 日本字符分类 | Keras | 1.1.0 及以上 | 1973年 | JP |

|

crnn.pytorch | 卷积循环神经网络 | Pytorch | 1.2.6 及以上 | 2015年7月 | |

|

deep-text-recognition-benchmark | 深度文本识别基准 | Pytorch | 1.2.6 及以上 | 2019年4月 | |

|

easyocr | 支持80多种语言的即用型OCR | Pytorch | 1.2.6 及以上 | 2020年4月 | |

|

paddleocr | PaddleOCR:基于飞桨的强大多语言OCR工具包 | Pytorch | 1.2.6 及以上 | 2020年9月 | EN JP |

|

donut | Donut | Pytorch | 1.2.16 及以上 | 2021年11月 | |

|

ndlocr_text_recognition | NDL OCR | Pytorch | 1.2.5 及以上 | 2022年4月 | |

|

paddleocr_v3 | PaddleOCR:基于飞桨的强大多语言OCR工具包 | Pytorch | 1.2.17 及以上 | 2022年6月 | JP |

时间序列预测

| 模型 | 参考资料 | 导出自 | 支持的 Ailia 版本 | 日期 | 博客 |

|---|---|---|---|---|---|

| informer2020 | Informer:超越高效Transformer的长序列时间序列预测(AAAI'21最佳论文) | Pytorch | 1.2.10 及以上 | 2020年12月 | |

| timesfm | TimesFM | Pytorch | 1.2.16 及以上 | 2023年10月 | JP |

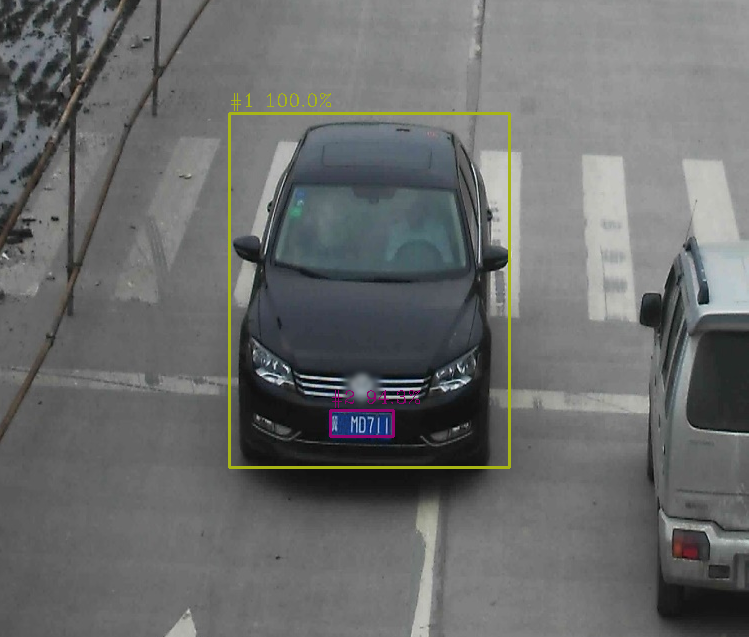

车辆识别

| 模型 | 参考资料 | 导出自 | 支持的 Ailia 版本 | 日期 | 博客 | |

|---|---|---|---|---|---|---|

|

vehicle-attributes-recognition-barrier | vehicle-attributes-recognition-barrier-0042 | OpenVINO | 1.2.5 及以上 | 2018年5月 | EN JP |

|

vehicle-license-plate-detection-barrier | vehicle-license-plate-detection-barrier-0106 | OpenVINO | 1.2.5 及以上 | 2018年5月 |

视觉语言模型

| 模型 | 参考 | 导出自 | 支持的 Ailia 版本 | 日期 | 博客 | |

|---|---|---|---|---|---|---|

|

llava | LLaVA | Pytorch | 1.2.16 及更高版本 | 2023年4月 | JP |

|

florence2 | Hugging Face - microsoft/Florence-2-base | Pytorch | 1.2.16 及更高版本 | 2023年11月 | JP |

|

mobilevlm | MobileVLM | Pytorch | 1.5.0 及更高版本 | 2023年12月 | |

|

llava-jp | LLaVA-JP | Pytorch | 1.5.0 及更高版本 | 2024年1月 | |

|

qwen2_vl | Qwen2-VL | Pytorch | 1.5.0 及更高版本 | 2024年9月 | JP |

商业模型

| 模型 | 参考 | 导出自 | 支持的 Ailia 版本 | 日期 | 博客 |

|---|---|---|---|---|---|

| acculus-pose | Acculus, Inc. | Caffe | 1.2.3 及更高版本 | 2018年5月 |

其他平台

使用 ailia MODELS(Python)进行原型开发,然后部署到生产环境。

联系方式

常见问题

相似工具推荐

openclaw

OpenClaw 是一款专为个人打造的本地化 AI 助手,旨在让你在自己的设备上拥有完全可控的智能伙伴。它打破了传统 AI 助手局限于特定网页或应用的束缚,能够直接接入你日常使用的各类通讯渠道,包括微信、WhatsApp、Telegram、Discord、iMessage 等数十种平台。无论你在哪个聊天软件中发送消息,OpenClaw 都能即时响应,甚至支持在 macOS、iOS 和 Android 设备上进行语音交互,并提供实时的画布渲染功能供你操控。 这款工具主要解决了用户对数据隐私、响应速度以及“始终在线”体验的需求。通过将 AI 部署在本地,用户无需依赖云端服务即可享受快速、私密的智能辅助,真正实现了“你的数据,你做主”。其独特的技术亮点在于强大的网关架构,将控制平面与核心助手分离,确保跨平台通信的流畅性与扩展性。 OpenClaw 非常适合希望构建个性化工作流的技术爱好者、开发者,以及注重隐私保护且不愿被单一生态绑定的普通用户。只要具备基础的终端操作能力(支持 macOS、Linux 及 Windows WSL2),即可通过简单的命令行引导完成部署。如果你渴望拥有一个懂你

stable-diffusion-webui

stable-diffusion-webui 是一个基于 Gradio 构建的网页版操作界面,旨在让用户能够轻松地在本地运行和使用强大的 Stable Diffusion 图像生成模型。它解决了原始模型依赖命令行、操作门槛高且功能分散的痛点,将复杂的 AI 绘图流程整合进一个直观易用的图形化平台。 无论是希望快速上手的普通创作者、需要精细控制画面细节的设计师,还是想要深入探索模型潜力的开发者与研究人员,都能从中获益。其核心亮点在于极高的功能丰富度:不仅支持文生图、图生图、局部重绘(Inpainting)和外绘(Outpainting)等基础模式,还独创了注意力机制调整、提示词矩阵、负向提示词以及“高清修复”等高级功能。此外,它内置了 GFPGAN 和 CodeFormer 等人脸修复工具,支持多种神经网络放大算法,并允许用户通过插件系统无限扩展能力。即使是显存有限的设备,stable-diffusion-webui 也提供了相应的优化选项,让高质量的 AI 艺术创作变得触手可及。

everything-claude-code

everything-claude-code 是一套专为 AI 编程助手(如 Claude Code、Codex、Cursor 等)打造的高性能优化系统。它不仅仅是一组配置文件,而是一个经过长期实战打磨的完整框架,旨在解决 AI 代理在实际开发中面临的效率低下、记忆丢失、安全隐患及缺乏持续学习能力等核心痛点。 通过引入技能模块化、直觉增强、记忆持久化机制以及内置的安全扫描功能,everything-claude-code 能显著提升 AI 在复杂任务中的表现,帮助开发者构建更稳定、更智能的生产级 AI 代理。其独特的“研究优先”开发理念和针对 Token 消耗的优化策略,使得模型响应更快、成本更低,同时有效防御潜在的攻击向量。 这套工具特别适合软件开发者、AI 研究人员以及希望深度定制 AI 工作流的技术团队使用。无论您是在构建大型代码库,还是需要 AI 协助进行安全审计与自动化测试,everything-claude-code 都能提供强大的底层支持。作为一个曾荣获 Anthropic 黑客大奖的开源项目,它融合了多语言支持与丰富的实战钩子(hooks),让 AI 真正成长为懂上

ComfyUI

ComfyUI 是一款功能强大且高度模块化的视觉 AI 引擎,专为设计和执行复杂的 Stable Diffusion 图像生成流程而打造。它摒弃了传统的代码编写模式,采用直观的节点式流程图界面,让用户通过连接不同的功能模块即可构建个性化的生成管线。 这一设计巧妙解决了高级 AI 绘图工作流配置复杂、灵活性不足的痛点。用户无需具备编程背景,也能自由组合模型、调整参数并实时预览效果,轻松实现从基础文生图到多步骤高清修复等各类复杂任务。ComfyUI 拥有极佳的兼容性,不仅支持 Windows、macOS 和 Linux 全平台,还广泛适配 NVIDIA、AMD、Intel 及苹果 Silicon 等多种硬件架构,并率先支持 SDXL、Flux、SD3 等前沿模型。 无论是希望深入探索算法潜力的研究人员和开发者,还是追求极致创作自由度的设计师与资深 AI 绘画爱好者,ComfyUI 都能提供强大的支持。其独特的模块化架构允许社区不断扩展新功能,使其成为当前最灵活、生态最丰富的开源扩散模型工具之一,帮助用户将创意高效转化为现实。

markitdown

MarkItDown 是一款由微软 AutoGen 团队打造的轻量级 Python 工具,专为将各类文件高效转换为 Markdown 格式而设计。它支持 PDF、Word、Excel、PPT、图片(含 OCR)、音频(含语音转录)、HTML 乃至 YouTube 链接等多种格式的解析,能够精准提取文档中的标题、列表、表格和链接等关键结构信息。 在人工智能应用日益普及的今天,大语言模型(LLM)虽擅长处理文本,却难以直接读取复杂的二进制办公文档。MarkItDown 恰好解决了这一痛点,它将非结构化或半结构化的文件转化为模型“原生理解”且 Token 效率极高的 Markdown 格式,成为连接本地文件与 AI 分析 pipeline 的理想桥梁。此外,它还提供了 MCP(模型上下文协议)服务器,可无缝集成到 Claude Desktop 等 LLM 应用中。 这款工具特别适合开发者、数据科学家及 AI 研究人员使用,尤其是那些需要构建文档检索增强生成(RAG)系统、进行批量文本分析或希望让 AI 助手直接“阅读”本地文件的用户。虽然生成的内容也具备一定可读性,但其核心优势在于为机器

LLMs-from-scratch

LLMs-from-scratch 是一个基于 PyTorch 的开源教育项目,旨在引导用户从零开始一步步构建一个类似 ChatGPT 的大型语言模型(LLM)。它不仅是同名技术著作的官方代码库,更提供了一套完整的实践方案,涵盖模型开发、预训练及微调的全过程。 该项目主要解决了大模型领域“黑盒化”的学习痛点。许多开发者虽能调用现成模型,却难以深入理解其内部架构与训练机制。通过亲手编写每一行核心代码,用户能够透彻掌握 Transformer 架构、注意力机制等关键原理,从而真正理解大模型是如何“思考”的。此外,项目还包含了加载大型预训练权重进行微调的代码,帮助用户将理论知识延伸至实际应用。 LLMs-from-scratch 特别适合希望深入底层原理的 AI 开发者、研究人员以及计算机专业的学生。对于不满足于仅使用 API,而是渴望探究模型构建细节的技术人员而言,这是极佳的学习资源。其独特的技术亮点在于“循序渐进”的教学设计:将复杂的系统工程拆解为清晰的步骤,配合详细的图表与示例,让构建一个虽小但功能完备的大模型变得触手可及。无论你是想夯实理论基础,还是为未来研发更大规模的模型做准备