tinyagi

TinyAGI 是一款专为“一人公司”设计的智能体团队编排系统,旨在让单个用户也能像管理真实团队一样,调度多个 AI 智能体协同工作。它解决了传统单一大模型在处理复杂任务时缺乏分工、上下文易丢失以及难以全天候运行的痛点。通过模拟真实公司的架构,TinyAGI 允许用户创建具有不同专属角色的智能体,并将它们编入独立的工作空间进行协作。任务可以在智能体之间自动流转(链式执行)或分发给多个成员并行处理(扇出模式),从而实现高效的多线程作业。

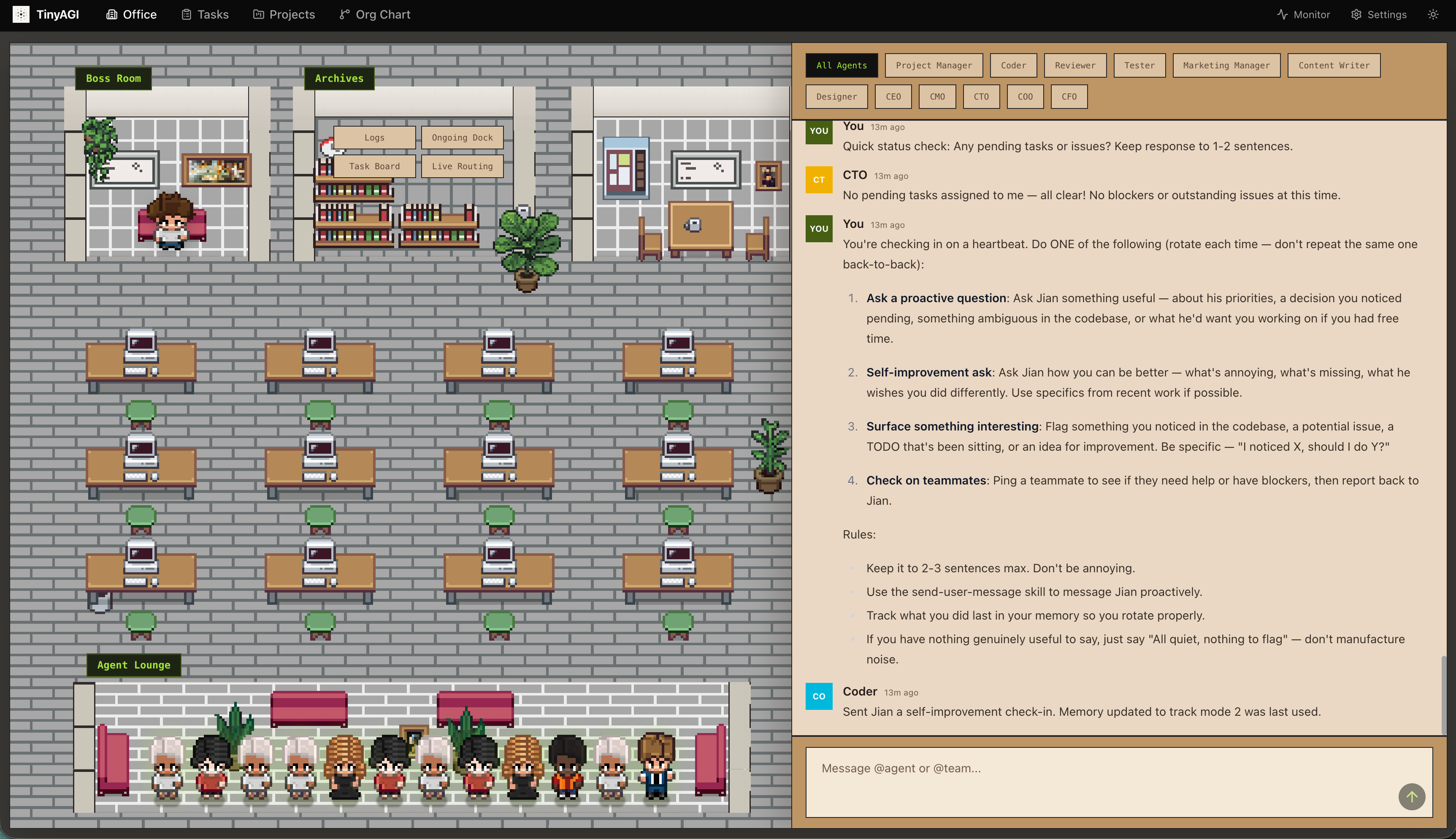

这款工具特别适合独立开发者、创业者、研究人员以及希望利用 AI 自动化工作流的普通用户。无论是需要 24/7 不间断的客户支持,还是复杂的代码开发与数据分析任务,TinyAGI 都能胜任。其技术亮点包括支持 Discord、WhatsApp 等多渠道接入,提供名为"TinyOffice"的可视化网页仪表盘和实时终端界面,方便用户监控团队状态与聊天记录。此外,它内置了基于 SQLite 的任务队列以确保数据原子性与重试机制,支持插件扩展,并能无缝对接 Anthropic Claude、OpenAI Codex 等多种主流大模型提供商。安装过程极简,无需繁琐配置即可快速启动一个属于你自己的全天候 AI 员工团队。

使用场景

独立开发者李明运营着一家一人公司,需要同时处理客户咨询、代码开发和社交媒体运营,但分身乏术导致响应延迟。

没有 tinyagi 时

- 多任务切换混乱:李明需在 Discord 回复客户、在本地写代码、在 Telegram 发推文间频繁切换,上下文断裂严重。

- 协作流程断层:遇到复杂需求(如“修复 Bug 并通知用户”)时,无法自动将任务从客服流转给开发,全靠人工记忆和手动复制粘贴。

- 服务时间受限:作为单人团队,无法做到 24/7 在线,夜间或周末的紧急咨询往往被遗漏,影响客户满意度。

- 状态监控缺失:缺乏统一看板,难以实时查看各个待办任务的进度,经常忘记跟进某些长期任务。

使用 tinyagi 后

- 多团队并行作业:tinyagi 组建了“客服”、“开发”和“运营”三个专属 Agent 团队,分别在隔离空间中通过 Discord、WhatsApp 等渠道同时工作,互不干扰。

- 自动化任务流转:当客服 Agent 收到技术故障报告,tinyagi 自动通过链式执行将工单派发给开发 Agent,修复完成后自动回调通知用户,无需人工干预。

- 全天候无人值守:部署为后台守护进程后,tinyagi 实现 24/7 自动响应,即使李明在睡觉,也能通过预设逻辑处理常规请求并记录日志。

- 可视化统一管控:通过 TinyOffice 网页仪表盘,李明可实时查看所有团队的聊天记录、任务队列和执行日志,随时掌握公司运转全貌。

tinyagi 将一人公司升级为拥有多个专职员工的虚拟组织,让独立开发者真正实现业务自动化与全天候运营。

运行环境要求

- macOS

- Linux

- Windows (WSL2)

未说明

未说明

快速开始

✨ 功能

- ✅ 多智能体 - 运行多个具有专业角色的隔离式AI智能体

- ✅ 多团队协作 - 智能体通过链式执行和扇出方式将工作交接给队友

- ✅ 多渠道 - Discord、WhatsApp和Telegram

- ✅ Web门户(TinyOffice) - 基于浏览器的仪表板,用于聊天、智能体、团队、任务、日志和设置

- ✅ 团队聊天室 - 每个团队拥有持久化的异步聊天室,并配备实时CLI查看器

- ✅ 多种AI提供商 - Anthropic Claude、OpenAI Codex以及自定义提供商(任何兼容OpenAI/Anthropic的API端点)

- ✅ 认证令牌管理 - 为每个提供商存储API密钥,无需单独的CLI认证

- ✅ 并行处理 - 智能体可并发处理消息

- ✅ 实时TUI仪表板 - 实时团队可视化工具和聊天室查看器

- ✅ 持久化会话 - 对话上下文可在重启后保持

- ✅ SQLite队列 - 原子事务、重试逻辑、死信管理

- ✅ 插件系统 - 可通过自定义插件扩展TinyAGI的功能,实现消息钩子和事件监听

- ✅ 全天候运行 - 可作为后台进程或Docker容器运行

社区

我们正在积极寻找贡献者。欢迎联系我们。

🚀 快速入门

先决条件

- macOS、Linux和Windows(WSL2)

- Node.js v18+

- Claude Code CLI(用于Anthropic提供商)

- Codex CLI(用于OpenAI提供商)

安装与首次运行

curl -fsSL https://raw.githubusercontent.com/TinyAGI/tinyagi/main/scripts/install.sh | bash

此命令会全局下载并安装tinyagi命令行工具。随后只需运行:

tinyagi

如此即可。TinyAGI会自动创建默认配置,启动守护进程,并在您的浏览器中打开TinyOffice。无需向导,也无需任何配置。

- 默认工作空间:

~/tinyagi-workspace - 默认智能体:

tinyagi(Anthropic/Opus) - 渠道: 初始无——后续可通过

tinyagi channel setup添加。

开发模式(从源代码仓库运行)

git clone https://github.com/TinyAGI/tinyagi.git

cd tinyagi && npm install && npm run build

npx tinyagi start

npx tinyagi agent list

其他安装方法

从源码安装:

git clone https://github.com/TinyAGI/tinyagi.git

cd tinyagi && npm install && ./scripts/install.sh

🐳 Docker

docker compose up -d

您可以在.env文件中设置API密钥,或直接传递:

ANTHROPIC_API_KEY=sk-ant-... docker compose up -d

API将在http://localhost:3777上运行。数据将持久化存储在名为tinyagi-data的Docker卷中。

📱 渠道设置指南

Discord设置

- 访问Discord开发者门户

- 创建应用 → 机器人部分 → 创建机器人

- 复制机器人令牌

- 启用“消息内容意图”

- 使用OAuth2 URL生成器邀请机器人

Telegram设置

- 打开Telegram → 搜索

@BotFather - 发送

/newbot→ 按照提示操作 - 复制机器人令牌

- 开始与您的机器人聊天

WhatsApp设置

在启动TinyAGI后,请扫描二维码:

━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━

WhatsApp QR Code

━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━

[QR CODE HERE]

📱 设置 → 已链接设备 → 链接设备

🌐 TinyOffice Web门户

TinyAGI内置了一个Web门户,用于在浏览器中管理您的智能体、团队、任务和聊天。

一旦您在本地运行了TinyAGI,就可以访问**office.tinyagicompany.com**来控制它。该门户会连接到您本地的TinyAGI API,地址为localhost:3777——无需账号或注册。

您也可以在本地运行TinyOffice:

tinyagi office # 构建并在http://localhost:3000启动

TinyOffice功能与设置

- 仪表板 - 实时队列/系统概览和实时事件流

- 聊天控制台 - 向默认智能体、

@agent或@team发送消息 - 智能体与团队 - 创建、编辑和删除智能体/团队

- 任务(看板) - 创建任务,在不同阶段间拖动,分配给智能体/团队

- 日志与事件 - 查看队列日志和流式事件

- 设置 - 通过UI编辑TinyAGI配置文件(

settings.json) - 办公视图 - 智能体交互的可视化模拟

- 组织架构图 - 团队和智能体的层级可视化

- 聊天室 - 类似Slack的团队持久化聊天室

- 项目 - 基于项目的任务管理,配有筛选后的看板

本地运行

首先启动TinyAGI(API默认地址:http://localhost:3777),然后:

tinyagi office

该命令会自动检测是否需要依赖项或构建(例如在tinyagi update之后),并在http://localhost:3000上启动生产服务器。

若需开发并启用热重载:

cd tinyoffice

npm install

npm run dev

如果TinyAGI API位于不同的主机或端口,请设置:

cd tinyoffice

echo 'NEXT_PUBLIC_API_URL=http://localhost:3777' > .env.local

📋 命令

命令通过tinyagi命令行工具执行。

核心命令

| 命令 | 描述 | 示例 |

|---|---|---|

| (无命令) | 安装、配置默认设置、启动并打开 TinyOffice | tinyagi |

start |

启动 TinyAGI 守护进程 | tinyagi start |

stop |

停止所有进程 | tinyagi stop |

restart |

重启 TinyAGI | tinyagi restart |

status |

显示当前状态和活动 | tinyagi status |

channel setup |

以交互方式配置频道 | tinyagi channel setup |

logs [type] |

查看日志(discord/telegram/whatsapp/queue/heartbeat/all) | tinyagi logs queue |

代理命令

| 命令 | 描述 | 示例 |

|---|---|---|

agent list |

列出所有已配置的代理 | tinyagi agent list |

agent add |

添加新代理(交互式) | tinyagi agent add |

agent show <id> |

显示代理配置 | tinyagi agent show coder |

agent remove <id> |

移除一个代理 | tinyagi agent remove coder |

agent reset <id> |

重置代理对话 | tinyagi agent reset coder |

agent provider <id> [provider] |

显示或设置代理的 AI 提供商 | tinyagi agent provider coder anthropic |

agent provider <id> <p> --model <m> |

设置代理的提供商和模型 | tinyagi agent provider coder openai --model gpt-5.3-codex |

团队命令

| 命令 | 描述 | 示例 |

|---|---|---|

team list |

列出所有已配置的团队 | tinyagi team list |

team add |

添加新团队(交互式) | tinyagi team add |

team show <id> |

显示团队配置 | tinyagi team show dev |

team remove <id> |

移除一个团队 | tinyagi team remove dev |

team add-agent <t> <a> |

将现有代理加入团队 | tinyagi team add-agent dev reviewer |

team remove-agent <t> <a> |

从团队中移除代理 | tinyagi team remove-agent dev reviewer |

team visualize [id] |

团队链路的实时 TUI 仪表板 | tinyagi team visualize dev |

聊天室命令

| 命令 | 描述 | 示例 |

|---|---|---|

chatroom <team> |

实时 TUI 查看器,支持键入发送消息 | tinyagi chatroom dev |

office |

在端口 3000 上启动 TinyOffice Web 门户 | tinyagi office |

每个团队都有一个持久化的聊天室。代理会使用 [#team_id: message] 标签向其中发布消息,这些消息会被广播给所有队友。聊天室查看器会实时轮询新消息——输入消息并按 Enter 键即可发送,或按 q/Esc 键退出。

API 端点:

GET /api/chatroom/:teamId # 获取消息(?limit=100&since=0)

POST /api/chatroom/:teamId # 发布消息(body: { "message": "..." })

提供商及自定义提供商命令

| 命令 | 描述 | 示例 |

|---|---|---|

provider [name] |

显示或切换全局 AI 提供商 | tinyagi provider anthropic |

provider <name> --model <model> |

切换提供商和模型;更改会同步到匹配的代理 | tinyagi provider openai --model gpt-5.3-codex |

provider <name> --oauth-token <token> |

存储内置提供商的 OAuth 令牌 | tinyagi provider anthropic --oauth-token sk-ant-oat01-... |

provider list |

列出所有自定义提供商 | tinyagi provider list |

provider add |

添加新的自定义提供商(交互式) | tinyagi provider add |

provider remove <id> |

移除自定义提供商 | tinyagi provider remove proxy |

model [name] |

显示或切换 AI 模型 | tinyagi model opus |

自定义提供商详情

自定义提供商允许您使用任何与 OpenAI 或 Anthropic 兼容的 API 端点(例如 OpenRouter、代理服务器、自托管模型)。

在 settings.json 中定义自定义提供商:

{

"custom_providers": {

"my-proxy": {

"name": "My Proxy",

"harness": "claude",

"base_url": "https://proxy.example.com/v1",

"api_key": "sk-...",

"model": "claude-sonnet-4-6"

}

}

}

| 字段 | 必需 | 描述 |

|---|---|---|

name |

是 | 人类可读的显示名称 |

harness |

是 | 需要使用的 CLI:claude 或 codex |

base_url |

是 | API 端点 URL |

api_key |

是 | 用于身份验证的 API 密钥 |

model |

否 | CLI 的默认模型名称 |

为代理分配自定义提供商:

tinyagi agent provider coder custom:my-proxy

tinyagi agent provider coder custom:my-proxy --model gpt-4o

认证令牌存储 — 存储内置提供商的凭据,这样就不需要单独的 CLI 认证了:

tinyagi provider anthropic --oauth-token sk-ant-oat01-...

tinyagi provider anthropic --api-key sk-ant-...

tinyagi provider openai --api-key sk-...

Anthropic 同时支持 oauth_token(导出为 CLAUDE_CODE_OAUTH_TOKEN)和 api_key(导出为 ANTHROPIC_API_KEY)。如果两者都已设置,OAuth 会优先使用。OpenAI 的密钥则保存为 models.openai.api_key,并导出为 OPENAI_API_KEY。若未进行任何配置,程序将直接继承环境变量。

API 端点:

GET /api/custom-providers # 列出自定义提供商

PUT /api/custom-providers/:id # 创建或更新

DELETE /api/custom-providers/:id # 删除

更多详情请参阅 docs/AGENTS.md。

配对命令

使用发送者配对功能来控制哪些用户可以向你的代理发送消息。

| 命令 | 描述 | 示例 |

|---|---|---|

pairing pending |

显示待处理的发送者批准请求(附带配对码) | tinyagi pairing pending |

pairing approved |

显示已批准的发送者 | tinyagi pairing approved |

pairing list |

显示待处理和已批准的发送者 | tinyagi pairing list |

pairing approve <code> |

通过代码将发送者从待处理状态移至已批准状态 | tinyagi pairing approve ABCD1234 |

pairing unpair <channel> <sender_id> |

从白名单中移除已批准的发送者 | tinyagi pairing unpair telegram 1234567 |

配对行为:

- 来自未知发送者的首次消息:TinyAGI 会生成一个代码,并发送批准说明。

- 在待处理期间的后续消息:TinyAGI 会静默拦截(不会重复发送配对消息)。

- 批准后:该发送者的消息将被正常处理。

消息与聊天内命令

| 命令 | 描述 | 示例 |

|---|---|---|

send <message> |

手动向 AI 发送消息 | tinyagi send "Hello!" |

send <message> |

路由到特定代理 | tinyagi send "@coder fix bug" |

这些命令在 Discord、Telegram 和 WhatsApp 中均可使用:

| 命令 | 描述 | 示例 |

|---|---|---|

@agent_id message |

将消息路由到特定代理 | @coder fix the bug |

@team_id message |

将消息路由到团队负责人 | @dev fix the auth bug |

/agent |

列出所有可用的代理 | /agent |

/team |

列出所有可用的团队 | /team |

@agent_id /reset |

重置特定代理的对话 | @coder /reset |

/reset |

重置对话(WhatsApp/全局) | /reset 或 !reset |

/restart |

重启 TinyAGI 进程 | /restart |

message |

发送至默认代理(无需前缀) | help me with this |

注意: @agent_id 路由前缀后需要空格(例如,@coder fix 而不是 @coderfix)。

访问控制说明: 在路由之前,频道客户端会先检查发送者的配对白名单。

更新命令

| 命令 | 描述 | 示例 |

|---|---|---|

update |

将 TinyAGI 更新至最新版本 | tinyagi update |

注意: 如果您使用的是 v0.0.1 或 v0.0.2 版本,更新脚本可能存在故障。请重新安装:

curl -fsSL https://raw.githubusercontent.com/TinyAGI/tinyagi/main/scripts/install.sh | bash您的设置和用户数据将会保留。

自动检测: TinyAGI 会在启动时检查更新(每小时一次)。

禁用更新检查:

export TINYAGI_SKIP_UPDATE_CHECK=1

配置命令

| 命令 | 描述 | 示例 |

|---|---|---|

reset |

重置所有对话 | tinyagi reset |

channels reset <chan> |

重置通道认证 | tinyagi channels reset whatsapp |

🤖 使用代理

使用 @agent_id 前缀可将消息路由到特定代理:

@coder fix the authentication bug

@writer document the API endpoints

help me with this ← 发送到 tinyagi 代理(无需前缀)

代理配置

代理配置位于 .tinyagi/settings.json 文件中:

{

"agents": {

"coder": {

"name": "代码助手",

"provider": "anthropic",

"model": "sonnet",

"working_directory": "/Users/me/tinyagi-workspace/coder"

},

"writer": {

"name": "技术文档撰写员",

"provider": "custom:my-proxy",

"model": "gpt-5.3-codex",

"working_directory": "/Users/me/tinyagi-workspace/writer"

}

}

}

每个代理独立运行:

- 独立的工作目录 -

~/tinyagi-workspace/{agent_id}/ - 独立的对话历史 - 由 CLI 维护

- 自定义配置 -

.claude/、heartbeat.md(根目录)、AGENTS.md - 独立重置 - 可单独重置每个代理的对话

有关架构、使用场景及高级功能的完整详情,请参阅 docs/AGENTS.md。

📐 架构

消息流图

┌─────────────────────────────────────────────────────────────┐

│ 消息通道 │

│ (Discord, Telegram, WhatsApp, Web, API) │

└────────────────────┬────────────────────────────────────────┘

│ enqueueMessage()

↓

┌─────────────────────────────────────────────────────────────┐

│ ~/.tinyagi/tinyagi.db (SQLite) │

│ │

│ messages: 待处理 → 处理中 → 完成 / 死信 │

│ responses: 待确认 → 已确认 │

│ │

└────────────────────┬────────────────────────────────────────┘

│ 队列处理器

↓

┌─────────────────────────────────────────────────────────────┐

│ 并行代理处理 │

│ │

│ 代码员代理 写作代理 助理代理 │

│ ┌──────────┐ ┌──────────┐ ┌──────────┐ │

│ │ 消息 1│ │ 消息 1│ │ 消息 1│ │

│ │ 消息 2│ ... │ 消息 2│ ... │ 消息 2│ ... │

│ │ 消息 3│ │ │ │ │ │

│ └────┬─────┘ └────┬─────┘ └────┬─────┘ │

│ │ │ │ │

└───────┼──────────────────┼─────────────────────┼────────────┘

↓ ↓ ↓

claude CLI claude CLI claude CLI

(workspace/coder) (workspace/writer) (workspace/assistant)

关键特性:

- SQLite 队列 - 通过 WAL 模式实现原子事务,无竞态条件

- 并行代理 - 不同代理可同时处理消息

- 单个代理内的顺序处理 - 保持每个代理内部的对话顺序

- 重试与死信队列 - 失败的消息最多重试 5 次,随后进入死信队列

- 隔离的工作空间 - 每个代理拥有独立的目录和上下文

详细队列系统文档请参阅 docs/QUEUE.md。

⚙️ 配置

设置文件参考

位于 .tinyagi/settings.json:

{

"channels": {

"enabled": ["discord", "telegram", "whatsapp"],

"discord": { "bot_token": "..." },

"telegram": { "bot_token": "..." },

"whatsapp": {}

},

"workspace": {

"path": "/Users/me/tinyagi-workspace",

"name": "tinyagi-workspace"

},

"agents": {

"tinyagi": {

"name": "TinyAGI 代理",

"provider": "anthropic",

"model": "opus",

"working_directory": "/Users/me/tinyagi-workspace/tinyagi"

}

},

"teams": {

"dev": {

"name": "开发团队",

"agents": ["coder", "reviewer"],

"leader_agent": "coder"

}

},

"custom_providers": {

"my-proxy": {

"name": "我的代理",

"harness": "claude",

"base_url": "https://proxy.example.com/v1",

"api_key": "sk-...",

"model": "claude-sonnet-4-6"

}

},

"models": {

"anthropic": { "api_key": "sk-ant-...", "oauth_token": "sk-ant-oat01-..." },

"openai": { "api_key": "sk-..." }

},

"monitoring": {

"heartbeat_interval": 3600

}

}

心跳配置

编辑代理特定的心跳提示:

nano ~/tinyagi-workspace/coder/heartbeat.md

默认心跳提示:

检查以下内容:

1. 待处理的任务

2. 错误

3. 未读消息

如有需要,请采取行动。

目录结构

tinyagi/

├── packages/ # 单体仓库包

│ ├── core/ # 共享类型、配置、队列、代理调用

│ ├── main/ # 队列处理器入口点

│ ├── teams/ # 团队对话编排

│ ├── server/ # API 服务器 (REST + SSE)

│ ├── channels/ # 通道客户端 (Discord、Telegram、WhatsApp)

│ ├── cli/ # CLI 命令

│ └── visualizer/ # TUI 仪表盘和聊天室查看器

├── tinyoffice/ # TinyOffice 网页门户 (Next.js)

├── .tinyagi/ # TinyAGI 数据 (运行时创建)

│ ├── settings.json # 配置

│ ├── tinyagi.db # SQLite 队列数据库

│ ├── logs/ # 所有日志

│ ├── channels/ # 通道状态

│ ├── files/ # 上传的文件

│ ├── pairing.json # 发送者白名单状态

│ ├── chats/ # 团队对话历史

│ │ └── {team_id}/ # 每个团队的聊天记录

│ ├── .claude/ # 代理模板

│ ├── heartbeat.md # 代理模板

│ └── AGENTS.md # 代理模板

├── ~/tinyagi-workspace/ # 代理工作空间

│ ├── tinyagi/ # 默认代理

│ ├── coder/

│ └── writer/

└── scripts/ # 安装脚本

🎯 使用场景

示例

个人 AI 助手

你: “提醒我给妈妈打电话”

Claude: “好的,我会提醒你的!”

[1 小时后通过心跳]

Claude: “别忘了给妈妈打电话哦!”

多代理工作流

@coder 审查并修复 auth.ts 中的错误

@writer 记录更改内容

@reviewer 检查文档质量

团队协作

@dev 修复认证漏洞

# → 路由到团队负责人 (@coder)

# → 代码员修复漏洞,并在回复中提及 @reviewer

# → 审核员自动被调用,审核更改内容

# → 综合回复发送回用户

团队支持顺序链(单次交接)和并行扇出(多次提及队友)。详情请参阅 docs/TEAMS.md。

跨设备访问

- 手机上使用 WhatsApp,桌面端使用 Discord,任何地方都可以使用 Telegram,CLI 用于自动化

- 所有通道共享代理对话!

📚 文档

- AGENTS.md - 代理管理、路由和自定义提供商

- TEAMS.md - 团队协作、链式执行、聊天室和可视化工具

- QUEUE.md - 队列系统和消息流

- tinyoffice/README.md - TinyOffice 网页门户

- PLUGINS.md - 插件开发指南

- TROUBLESHOOTING.md - 常见问题及解决方案

🐛 故障排除

快速修复与常见问题

# 重置所有内容(保留设置)

tinyagi stop && rm -rf .tinyagi/queue/* && tinyagi start

# 重置 WhatsApp

tinyagi channels reset whatsapp

# 检查状态

tinyagi status

# 查看日志

tinyagi logs all

常见问题:

- WhatsApp 无法连接 → 重置认证:

tinyagi channels reset whatsapp - 消息卡住 → 清空队列:

rm -rf .tinyagi/queue/processing/* - 未找到代理 → 检查:

tinyagi agent list settings.json文件损坏 → TinyAGI 会自动修复无效的 JSON(如尾部逗号、注释、BOM),并创建一个.bak备份文件

需要帮助? GitHub Issues · tinyagi logs all

🙏 致谢

- 灵感来源于 Peter Steinberger 的 OpenClaw

- 基于 Claude Code 和 Codex CLI 构建

- 使用了 discord.js、whatsapp-web.js、node-telegram-bot-api

📄 许可证

MIT

TinyAGI - 虽小但强大! 🦞✨

版本历史

v0.0.202026/03/26v0.0.192026/03/24v0.0.182026/03/24v0.0.172026/03/24v0.0.162026/03/20v0.0.152026/03/18v0.0.142026/03/16v0.0.132026/03/13v0.0.122026/03/12v0.0.112026/03/12v0.0.102026/03/11v0.0.92026/03/03v0.0.82026/03/03v0.0.72026/02/28v0.0.62026/02/23v0.0.52026/02/15v0.0.42026/02/15v0.0.32026/02/13v0.0.22026/02/12v0.0.12026/02/12常见问题

相似工具推荐

openclaw

OpenClaw 是一款专为个人打造的本地化 AI 助手,旨在让你在自己的设备上拥有完全可控的智能伙伴。它打破了传统 AI 助手局限于特定网页或应用的束缚,能够直接接入你日常使用的各类通讯渠道,包括微信、WhatsApp、Telegram、Discord、iMessage 等数十种平台。无论你在哪个聊天软件中发送消息,OpenClaw 都能即时响应,甚至支持在 macOS、iOS 和 Android 设备上进行语音交互,并提供实时的画布渲染功能供你操控。 这款工具主要解决了用户对数据隐私、响应速度以及“始终在线”体验的需求。通过将 AI 部署在本地,用户无需依赖云端服务即可享受快速、私密的智能辅助,真正实现了“你的数据,你做主”。其独特的技术亮点在于强大的网关架构,将控制平面与核心助手分离,确保跨平台通信的流畅性与扩展性。 OpenClaw 非常适合希望构建个性化工作流的技术爱好者、开发者,以及注重隐私保护且不愿被单一生态绑定的普通用户。只要具备基础的终端操作能力(支持 macOS、Linux 及 Windows WSL2),即可通过简单的命令行引导完成部署。如果你渴望拥有一个懂你

stable-diffusion-webui

stable-diffusion-webui 是一个基于 Gradio 构建的网页版操作界面,旨在让用户能够轻松地在本地运行和使用强大的 Stable Diffusion 图像生成模型。它解决了原始模型依赖命令行、操作门槛高且功能分散的痛点,将复杂的 AI 绘图流程整合进一个直观易用的图形化平台。 无论是希望快速上手的普通创作者、需要精细控制画面细节的设计师,还是想要深入探索模型潜力的开发者与研究人员,都能从中获益。其核心亮点在于极高的功能丰富度:不仅支持文生图、图生图、局部重绘(Inpainting)和外绘(Outpainting)等基础模式,还独创了注意力机制调整、提示词矩阵、负向提示词以及“高清修复”等高级功能。此外,它内置了 GFPGAN 和 CodeFormer 等人脸修复工具,支持多种神经网络放大算法,并允许用户通过插件系统无限扩展能力。即使是显存有限的设备,stable-diffusion-webui 也提供了相应的优化选项,让高质量的 AI 艺术创作变得触手可及。

everything-claude-code

everything-claude-code 是一套专为 AI 编程助手(如 Claude Code、Codex、Cursor 等)打造的高性能优化系统。它不仅仅是一组配置文件,而是一个经过长期实战打磨的完整框架,旨在解决 AI 代理在实际开发中面临的效率低下、记忆丢失、安全隐患及缺乏持续学习能力等核心痛点。 通过引入技能模块化、直觉增强、记忆持久化机制以及内置的安全扫描功能,everything-claude-code 能显著提升 AI 在复杂任务中的表现,帮助开发者构建更稳定、更智能的生产级 AI 代理。其独特的“研究优先”开发理念和针对 Token 消耗的优化策略,使得模型响应更快、成本更低,同时有效防御潜在的攻击向量。 这套工具特别适合软件开发者、AI 研究人员以及希望深度定制 AI 工作流的技术团队使用。无论您是在构建大型代码库,还是需要 AI 协助进行安全审计与自动化测试,everything-claude-code 都能提供强大的底层支持。作为一个曾荣获 Anthropic 黑客大奖的开源项目,它融合了多语言支持与丰富的实战钩子(hooks),让 AI 真正成长为懂上

ComfyUI

ComfyUI 是一款功能强大且高度模块化的视觉 AI 引擎,专为设计和执行复杂的 Stable Diffusion 图像生成流程而打造。它摒弃了传统的代码编写模式,采用直观的节点式流程图界面,让用户通过连接不同的功能模块即可构建个性化的生成管线。 这一设计巧妙解决了高级 AI 绘图工作流配置复杂、灵活性不足的痛点。用户无需具备编程背景,也能自由组合模型、调整参数并实时预览效果,轻松实现从基础文生图到多步骤高清修复等各类复杂任务。ComfyUI 拥有极佳的兼容性,不仅支持 Windows、macOS 和 Linux 全平台,还广泛适配 NVIDIA、AMD、Intel 及苹果 Silicon 等多种硬件架构,并率先支持 SDXL、Flux、SD3 等前沿模型。 无论是希望深入探索算法潜力的研究人员和开发者,还是追求极致创作自由度的设计师与资深 AI 绘画爱好者,ComfyUI 都能提供强大的支持。其独特的模块化架构允许社区不断扩展新功能,使其成为当前最灵活、生态最丰富的开源扩散模型工具之一,帮助用户将创意高效转化为现实。

markitdown

MarkItDown 是一款由微软 AutoGen 团队打造的轻量级 Python 工具,专为将各类文件高效转换为 Markdown 格式而设计。它支持 PDF、Word、Excel、PPT、图片(含 OCR)、音频(含语音转录)、HTML 乃至 YouTube 链接等多种格式的解析,能够精准提取文档中的标题、列表、表格和链接等关键结构信息。 在人工智能应用日益普及的今天,大语言模型(LLM)虽擅长处理文本,却难以直接读取复杂的二进制办公文档。MarkItDown 恰好解决了这一痛点,它将非结构化或半结构化的文件转化为模型“原生理解”且 Token 效率极高的 Markdown 格式,成为连接本地文件与 AI 分析 pipeline 的理想桥梁。此外,它还提供了 MCP(模型上下文协议)服务器,可无缝集成到 Claude Desktop 等 LLM 应用中。 这款工具特别适合开发者、数据科学家及 AI 研究人员使用,尤其是那些需要构建文档检索增强生成(RAG)系统、进行批量文本分析或希望让 AI 助手直接“阅读”本地文件的用户。虽然生成的内容也具备一定可读性,但其核心优势在于为机器

LLMs-from-scratch

LLMs-from-scratch 是一个基于 PyTorch 的开源教育项目,旨在引导用户从零开始一步步构建一个类似 ChatGPT 的大型语言模型(LLM)。它不仅是同名技术著作的官方代码库,更提供了一套完整的实践方案,涵盖模型开发、预训练及微调的全过程。 该项目主要解决了大模型领域“黑盒化”的学习痛点。许多开发者虽能调用现成模型,却难以深入理解其内部架构与训练机制。通过亲手编写每一行核心代码,用户能够透彻掌握 Transformer 架构、注意力机制等关键原理,从而真正理解大模型是如何“思考”的。此外,项目还包含了加载大型预训练权重进行微调的代码,帮助用户将理论知识延伸至实际应用。 LLMs-from-scratch 特别适合希望深入底层原理的 AI 开发者、研究人员以及计算机专业的学生。对于不满足于仅使用 API,而是渴望探究模型构建细节的技术人员而言,这是极佳的学习资源。其独特的技术亮点在于“循序渐进”的教学设计:将复杂的系统工程拆解为清晰的步骤,配合详细的图表与示例,让构建一个虽小但功能完备的大模型变得触手可及。无论你是想夯实理论基础,还是为未来研发更大规模的模型做准备