fast-stable-diffusion

fast-stable-diffusion 是一套专为 Google Colab 环境优化的高效工具集,旨在让用户无需本地高端显卡,即可在云端快速运行 Stable Diffusion 进行图像生成与模型训练。它主要解决了普通用户因硬件限制难以部署复杂 AI 绘图环境,以及传统训练流程耗时过长、配置繁琐的痛点。

该项目提供了开箱即用的 Notebook 脚本,完美支持三大主流生态:ComfyUI(节点式工作流)、AUTOMATIC1111(经典 WebUI)以及 DreamBooth(个性化模型微调)。用户只需点击链接,即可在几分钟内启动功能完整的云端绘图工作室,轻松实现从文生图到定制专属角色或风格模型的全流程操作。

fast-stable-diffusion 特别适合设计师、数字艺术家、AI 爱好者及研究人员使用。无论是希望快速尝试最新绘图技术的初学者,还是需要灵活算力进行模型迭代的专业创作者,都能从中受益。其核心技术亮点在于对云端资源的深度优化与预配置,大幅降低了环境搭建门槛,并显著提升了 DreamBooth 训练的速度与稳定性,让个性化 AI 创作变得触手可及且高效经济。

使用场景

一位独立游戏开发者需要在本地资源有限的情况下,快速训练一个包含特定角色和道具风格的定制化模型,以生成统一美术资产。

没有 fast-stable-diffusion 时

- 环境配置繁琐:手动在本地或云端安装 ComfyUI、AUTOMATIC1111 及 DreamBooth 依赖库耗时数小时,常因版本冲突导致报错。

- 训练门槛极高:缺乏优化好的 Colab 笔记本,开发者需自行编写复杂的训练脚本,难以调整超参数以适应特定数据集。

- 硬件资源受限:本地显卡显存不足无法运行大模型训练,而租用专用云服务器成本高昂且部署流程复杂。

- 工作流割裂:训练环境与生成环境分离,模型训练完成后需手动迁移文件才能进行推理测试,严重拖慢迭代速度。

使用 fast-stable-diffusion 后

- 一键启动环境:直接通过提供的 Colab 链接,几分钟内即可在云端拉起预配置好的 ComfyUI 或 AUTOMATIC1111 完整环境。

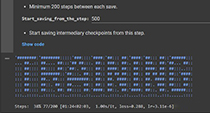

- 内置优化训练:利用集成的快速 DreamBooth 笔记本,无需编写代码即可上传素材并启动针对 SDXL 等模型的高效微调。

- 免费算力支持:充分利用 Google Colab 的免费 GPU 资源,绕过本地硬件限制,零成本完成高显存需求的模型训练任务。

- 无缝工作流整合:训练完成的模型可直接在当前会话中加载进行即时推理,实现了从“数据输入”到“资产输出”的闭环。

fast-stable-diffusion 通过将复杂的环境搭建与训练流程封装为即开即用的云端笔记本,让个人开发者也能以零成本、低门槛实现专业级的定制化 AI 绘画模型训练。

运行环境要求

- 未说明 (基于 Google Colab 云端环境)

必需 (运行于 Google Colab,依赖云端分配的 NVIDIA GPU,具体型号和显存取决于 Colab 实例类型,通常建议 T4 或更高)

未说明 (取决于所选 Google Colab 实例的 RAM 配置)

快速开始

如需高度先进且经过优化的Flux(dev、krea、kontext)训练器或SDXL Colab训练器,请联系X(收费)

fast-stable-diffusion 笔记本、ComfyUI + A1111 + DreamBooth

Colab-ComfyUI Colab-AUTOMATIC1111 Colab-Dreambooth

DreamBooth论文:https://dreambooth.github.io/

由@XavierXiao实现的SD版本:https://github.com/XavierXiao/Dreambooth-Stable-Diffusion

常见问题

相似工具推荐

openclaw

OpenClaw 是一款专为个人打造的本地化 AI 助手,旨在让你在自己的设备上拥有完全可控的智能伙伴。它打破了传统 AI 助手局限于特定网页或应用的束缚,能够直接接入你日常使用的各类通讯渠道,包括微信、WhatsApp、Telegram、Discord、iMessage 等数十种平台。无论你在哪个聊天软件中发送消息,OpenClaw 都能即时响应,甚至支持在 macOS、iOS 和 Android 设备上进行语音交互,并提供实时的画布渲染功能供你操控。 这款工具主要解决了用户对数据隐私、响应速度以及“始终在线”体验的需求。通过将 AI 部署在本地,用户无需依赖云端服务即可享受快速、私密的智能辅助,真正实现了“你的数据,你做主”。其独特的技术亮点在于强大的网关架构,将控制平面与核心助手分离,确保跨平台通信的流畅性与扩展性。 OpenClaw 非常适合希望构建个性化工作流的技术爱好者、开发者,以及注重隐私保护且不愿被单一生态绑定的普通用户。只要具备基础的终端操作能力(支持 macOS、Linux 及 Windows WSL2),即可通过简单的命令行引导完成部署。如果你渴望拥有一个懂你

stable-diffusion-webui

stable-diffusion-webui 是一个基于 Gradio 构建的网页版操作界面,旨在让用户能够轻松地在本地运行和使用强大的 Stable Diffusion 图像生成模型。它解决了原始模型依赖命令行、操作门槛高且功能分散的痛点,将复杂的 AI 绘图流程整合进一个直观易用的图形化平台。 无论是希望快速上手的普通创作者、需要精细控制画面细节的设计师,还是想要深入探索模型潜力的开发者与研究人员,都能从中获益。其核心亮点在于极高的功能丰富度:不仅支持文生图、图生图、局部重绘(Inpainting)和外绘(Outpainting)等基础模式,还独创了注意力机制调整、提示词矩阵、负向提示词以及“高清修复”等高级功能。此外,它内置了 GFPGAN 和 CodeFormer 等人脸修复工具,支持多种神经网络放大算法,并允许用户通过插件系统无限扩展能力。即使是显存有限的设备,stable-diffusion-webui 也提供了相应的优化选项,让高质量的 AI 艺术创作变得触手可及。

everything-claude-code

everything-claude-code 是一套专为 AI 编程助手(如 Claude Code、Codex、Cursor 等)打造的高性能优化系统。它不仅仅是一组配置文件,而是一个经过长期实战打磨的完整框架,旨在解决 AI 代理在实际开发中面临的效率低下、记忆丢失、安全隐患及缺乏持续学习能力等核心痛点。 通过引入技能模块化、直觉增强、记忆持久化机制以及内置的安全扫描功能,everything-claude-code 能显著提升 AI 在复杂任务中的表现,帮助开发者构建更稳定、更智能的生产级 AI 代理。其独特的“研究优先”开发理念和针对 Token 消耗的优化策略,使得模型响应更快、成本更低,同时有效防御潜在的攻击向量。 这套工具特别适合软件开发者、AI 研究人员以及希望深度定制 AI 工作流的技术团队使用。无论您是在构建大型代码库,还是需要 AI 协助进行安全审计与自动化测试,everything-claude-code 都能提供强大的底层支持。作为一个曾荣获 Anthropic 黑客大奖的开源项目,它融合了多语言支持与丰富的实战钩子(hooks),让 AI 真正成长为懂上

ComfyUI

ComfyUI 是一款功能强大且高度模块化的视觉 AI 引擎,专为设计和执行复杂的 Stable Diffusion 图像生成流程而打造。它摒弃了传统的代码编写模式,采用直观的节点式流程图界面,让用户通过连接不同的功能模块即可构建个性化的生成管线。 这一设计巧妙解决了高级 AI 绘图工作流配置复杂、灵活性不足的痛点。用户无需具备编程背景,也能自由组合模型、调整参数并实时预览效果,轻松实现从基础文生图到多步骤高清修复等各类复杂任务。ComfyUI 拥有极佳的兼容性,不仅支持 Windows、macOS 和 Linux 全平台,还广泛适配 NVIDIA、AMD、Intel 及苹果 Silicon 等多种硬件架构,并率先支持 SDXL、Flux、SD3 等前沿模型。 无论是希望深入探索算法潜力的研究人员和开发者,还是追求极致创作自由度的设计师与资深 AI 绘画爱好者,ComfyUI 都能提供强大的支持。其独特的模块化架构允许社区不断扩展新功能,使其成为当前最灵活、生态最丰富的开源扩散模型工具之一,帮助用户将创意高效转化为现实。

markitdown

MarkItDown 是一款由微软 AutoGen 团队打造的轻量级 Python 工具,专为将各类文件高效转换为 Markdown 格式而设计。它支持 PDF、Word、Excel、PPT、图片(含 OCR)、音频(含语音转录)、HTML 乃至 YouTube 链接等多种格式的解析,能够精准提取文档中的标题、列表、表格和链接等关键结构信息。 在人工智能应用日益普及的今天,大语言模型(LLM)虽擅长处理文本,却难以直接读取复杂的二进制办公文档。MarkItDown 恰好解决了这一痛点,它将非结构化或半结构化的文件转化为模型“原生理解”且 Token 效率极高的 Markdown 格式,成为连接本地文件与 AI 分析 pipeline 的理想桥梁。此外,它还提供了 MCP(模型上下文协议)服务器,可无缝集成到 Claude Desktop 等 LLM 应用中。 这款工具特别适合开发者、数据科学家及 AI 研究人员使用,尤其是那些需要构建文档检索增强生成(RAG)系统、进行批量文本分析或希望让 AI 助手直接“阅读”本地文件的用户。虽然生成的内容也具备一定可读性,但其核心优势在于为机器

LLMs-from-scratch

LLMs-from-scratch 是一个基于 PyTorch 的开源教育项目,旨在引导用户从零开始一步步构建一个类似 ChatGPT 的大型语言模型(LLM)。它不仅是同名技术著作的官方代码库,更提供了一套完整的实践方案,涵盖模型开发、预训练及微调的全过程。 该项目主要解决了大模型领域“黑盒化”的学习痛点。许多开发者虽能调用现成模型,却难以深入理解其内部架构与训练机制。通过亲手编写每一行核心代码,用户能够透彻掌握 Transformer 架构、注意力机制等关键原理,从而真正理解大模型是如何“思考”的。此外,项目还包含了加载大型预训练权重进行微调的代码,帮助用户将理论知识延伸至实际应用。 LLMs-from-scratch 特别适合希望深入底层原理的 AI 开发者、研究人员以及计算机专业的学生。对于不满足于仅使用 API,而是渴望探究模型构建细节的技术人员而言,这是极佳的学习资源。其独特的技术亮点在于“循序渐进”的教学设计:将复杂的系统工程拆解为清晰的步骤,配合详细的图表与示例,让构建一个虽小但功能完备的大模型变得触手可及。无论你是想夯实理论基础,还是为未来研发更大规模的模型做准备