EmoLLM

EmoLLM 是一款专注于心理健康领域的开源大模型项目,旨在构建能够“理解、支持并帮助用户”的智能心理辅导助手。它通过指令微调技术,让通用大语言模型掌握专业的心理咨询能力,从而解决传统 AI 在情感共鸣、心理危机干预及专业辅导话术上不足的问题,为用户提供温暖且科学的心理支持。

该项目非常适合人工智能开发者、心理学研究人员以及希望探索"AI+ 心理健康”应用的企业团队使用。开发者可以利用 EmoLLM 提供的完整链路工具——涵盖数据清洗、预训练、微调(支持全量、LoRA、QLoRA 等多种策略)、评估到部署——快速定制专属的心理垂直模型。

EmoLLM 的技术亮点在于其极强的兼容性与开放性。它不仅支持 InternLM、Qwen、Baichuan、DeepSeek、GLM 等主流国产及国际大模型基座,还开源了丰富的微调配置文件和评测体系,甚至结合了 RAG(检索增强生成)技术以提升回答的准确性与安全性。无论是想深入研究心理大模型机理的学者,还是希望低成本搭建心理陪伴应用的工程师,都能在这里找到成熟的解决方案与资源支持。

使用场景

某高校心理咨询中心试图为夜间求助的学生提供即时初步疏导,但面临专业人力严重不足的困境。

没有 EmoLLM 时

- 响应滞后:深夜时段无真人咨询师值班,学生的高危情绪信号无法得到秒级回应,错失最佳干预窗口。

- 回复机械:通用大模型缺乏心理学专业知识,常给出“请放松”等空洞建议,甚至因误解语境而说出刺激性话语。

- 风险漏判:系统无法精准识别隐晦的自杀或自残倾向,难以触发紧急预警机制,存在严重安全隐患。

- 数据孤岛:历史咨询案例与最新心理治疗指南未打通,助手无法结合具体情境提供个性化的认知行为疗法(CBT)策略。

使用 EmoLLM 后

- 全天候守护:基于 InternLM 或 Qwen 等基座微调的 EmoLLM 实现 7×24 小时在线,对求助信息做到即时共情响应。

- 专业疏导:依托“理解 - 支持 - 帮助”的全链路训练,能像资深咨询师一样运用倾听、共情技巧,提供有温度的专业话术。

- 精准风控:内置的心理危机评估能力可敏锐捕捉高危关键词,自动分级预警并推送紧急联系人,筑牢安全底线。

- 知识增强:结合 RAG 技术实时调用最新心理数据集与治疗手册,针对学生具体问题生成定制化的缓解方案。

EmoLLM 将通用人工智能转化为具备专业温度的“数字心理医师”,有效填补了非工作时段的心理服务空白。

运行环境要求

- 未说明

- 训练需求:全量微调 InternLM2-7B 需 2x A100 (80GB)

- QLoRA/LoRA 微调及推理需 NVIDIA GPU,显存需求视模型大小而定(如 7B 模型 QLoRA 约需 8-16GB,全量微调需更高),具体 CUDA 版本未说明

未说明(建议根据模型大小配置,全量微调 7B 模型建议 64GB+)

快速开始

EmoLLM-心理健康大模型

EmoLLM

EmoLLM 是一系列能够支持 理解用户-支持用户-帮助用户 心理健康辅导链路的心理健康大模型,由 LLM指令微调而来,欢迎大家star~⭐⭐。目前已经开源的 LLM 微调配置如下:

🎉欢迎大家为本项目做出贡献!

🔍对LLM原理/底层实现感兴趣的小伙伴可以关注ThinkLLM,专注于从零实现大模型的各种组件

心理健康大模型(Mental Health Grand Model)是一个综合性的概念,它旨在全面理解和促进个体、群体乃至整个社会的心理健康状态。这个模型通常包含以下几个关键组成部分:

- 认知因素:涉及个体的思维模式、信念系统、认知偏差以及解决问题的能力。认知因素对心理健康有重要影响,因为它们影响个体如何解释和应对生活中的事件。

- 情感因素:包括情绪调节、情感表达和情感体验。情感健康是心理健康的重要组成部分,涉及个体如何管理和表达自己的情感,以及如何从负面情绪中恢复。

- 行为因素:涉及个体的行为模式、习惯和应对策略。这包括应对压力的技巧、社交技能以及自我效能感,即个体对自己能力的信心。

- 社会环境:包括家庭、工作、社区和文化背景等外部因素,这些因素对个体的心理健康有着直接和间接的影响。

- 生理健康:身体健康与心理健康紧密相关。良好的身体健康可以促进心理健康,反之亦然。

- 心理韧性:指个体在面对逆境时的恢复力和适应能力。心理韧性强的人更能够从挑战中恢复,并从中学习和成长。

- 预防和干预措施:心理健康大模型还包括预防心理问题和促进心理健康的策略,如心理教育、心理咨询、心理治疗和社会支持系统。

- 评估和诊断工具:为了有效促进心理健康,需要有科学的工具来评估个体的心理状态,以及诊断可能存在的心理问题。

|

|

|

|

|

|

|

||

🎇最近更新

- 【2025.5】AI心理助手-深度思考版(Caryou):EmoLLM-心理数字人分项(目前完成了深度思考、Rag、web search和tts功能),已合并到EmoLLM,欢迎大家参与项目的优化和完善!

- 【2025.5】deepwiki-EmoLLM:可以基于该项目进行更加智能化的项目&文档理解

- 【2025.4】ThinkLLM是一个轻量、高效的大语言模型算法实现仓库,提供了BPE训练指南(支持EmoLLM)。

- 【2025.3】基于InternLM2.5-7B-chat全量微调的EmoLLM(GGUF格式,fp16精度) ,如何操作后续会更新~ @Rycen7822 @Slipstream-Max

- 【2025.2】更新首个心理健康R1蒸馏数据集 @Kedreamix

- 【2024.09.14】基于Qwen2-7B-Instruct模型的Lora微调模型开源,微调配置文件地址:Qwen2-7B-Instruct_lora.py ,模型权重链接:ModelScope

- 【2024.08】基于GLM4-9B-chat微调Lora模型开源(基于LLaMA-Factory),详情见微调教程 ,模型权重链接:ModelScope

- 【2024.07.16】欢迎大家体验 EmoLLM V3.0 ,该模型是基于InternLM2.5-7B-Chat模型的全量微调,微调配置文件地址:internlm2_5_chat_7b_full.py ,模型权重链接:OpenXLab, ModelScope ,WebDemo地址: OpenXLab apps, 配套全量微调知乎教程。

- 【2024.07】欢迎大家使用稳定版 EmoLLM V2.0 进行日常使用和学术研究,模型权重链接:OpenXLab。

- 【2024.07】新增基于InternLM2_5_7B_chat微调配置、模型文件发布在 ModelScope。

- 【2024.06】新增基于LLaMA-FactoryGLM4-9B-chat微调指南、新增基于swift的微调指南、论文ESC-Eval: Evaluating Emotion Support Conversations in Large Language Models引用了EmoLLM且EmoLLM取得了较好的效果。

- 【2024.05.28】EmoLLM使用的多轮对话数据集CPsyCounD和专业评测方法已公开,详见2024 ACL findings《CPsyCoun: A Report-based Multi-turn Dialogue Reconstruction and Evaluation Framework for Chinese Psychological Counseling》!

- 【2024.05.08】EmoLLM爹系男友阅览体验版上线 1. 百度AppBuilder 2. OpenXLab, 欢迎点赞收藏

- 【2024.05.07】增量预训练指南

- 【2024.05.04】基于LLaMA3_8b_instruct的EmoLLM3.0 OpenXLab Demo上线(重启链接), LLAMA3微调指南更新,在OpenXLab和ModelScope平台发布LLaMA3_8b_instruct-8B QLoRA微调模型 EmoLLM3.0权重

- 【2024.04.20】LLAMA3微调指南及基于LLaMA3_8b_instruct的艾薇开源

- 【2023.04.14】新增快速开始和保姆级教程BabyEmoLLM

- 【2024.04.02】在 Huggingface 上传老母亲心理咨询师

- 【2024.03.25】在百度飞桨平台发布爹系男友心理咨询师

查看更多

- 【2024.03.24】在OpenXLab和ModelScope平台发布InternLM2-Base-7B QLoRA微调模型, 具体请查看InternLM2-Base-7B QLoRA

- 【2024.03.12】在百度飞桨平台发布艾薇

- 【2024.03.11】 EmoLLM V2.0 相比 EmoLLM V1.0 全面提升,已超越 Role-playing ChatGPT 在心理咨询任务上的能力!点击体验EmoLLM V2.0,更新数据集统计及详细信息、路线图

- 【2024.03.09】 新增并发功能加速 QA 对生成、RAG pipeline

- 【2024.03.03】 基于InternLM2-7B-chat全量微调版本EmoLLM V2.0开源,需要两块A100*80G,更新专业评估,详见evaluate,更新基于PaddleOCR的PDF转txt工具脚本,详见scripts

- 【2024.02.29】更新客观评估计算,详见evaluate,更新一系列数据集,详见datasets

- 【2024.02.27】更新英文readme和一系列数据集(舔狗和单轮对话)

- 【2024.02.23】推出基于InternLM2_7B_chat_qlora的

温柔御姐心理医生艾薇,点击获取模型权重,配置文件,在线体验链接 - 【2024.02.23】更新若干微调配置,新增 data_pro.json(数量更多、场景更全、更丰富)和 aiwei.json(温柔御姐角色扮演专用,带有Emoji表情),即将推出

温柔御姐心理医生艾薇 - 【2024.02.18】 基于Qwen1_5-0_5B-Chat全量微调版本开源,算力有限的道友可以玩起来~

- 【2024.02.06】 EmoLLM在Openxlab 平台下载量高达18.7k,欢迎大家体验!

- 【2024.02.05】 项目荣获公众号NLP工程化推文宣传推文链接,为博主推广一波,欢迎大家关注!!🥳🥳

- 【2024.02.03】 项目宣传视频完成 😊

- 【2024.01.27】 完善数据构建文档、微调指南、部署指南、Readme等相关文档 👏

- 【2024.01.25】 EmoLLM V1.0 已部署上线 https://openxlab.org.cn/apps/detail/jujimeizuo/EmoLLM 😀

🏆荣誉栏

- 项目荣获上海人工智能实验室举办的2024浦源大模型系列挑战赛春季赛创新创意奖

荣获AI 赋能大学计划“全国高校行”一等奖

🎉感谢以下媒体及公众号朋友对本项目的报道和支持(以下排名不分先后! 若有遗漏、十分抱歉, 一并感激! 欢迎补充!): NLP工程化, 机智流, 爱可可爱生活, 阿郎小哥, 大模型日知路, AI Code 等!

项目宣传视频 EmoLLM 已发布,欢迎大家围观 😀

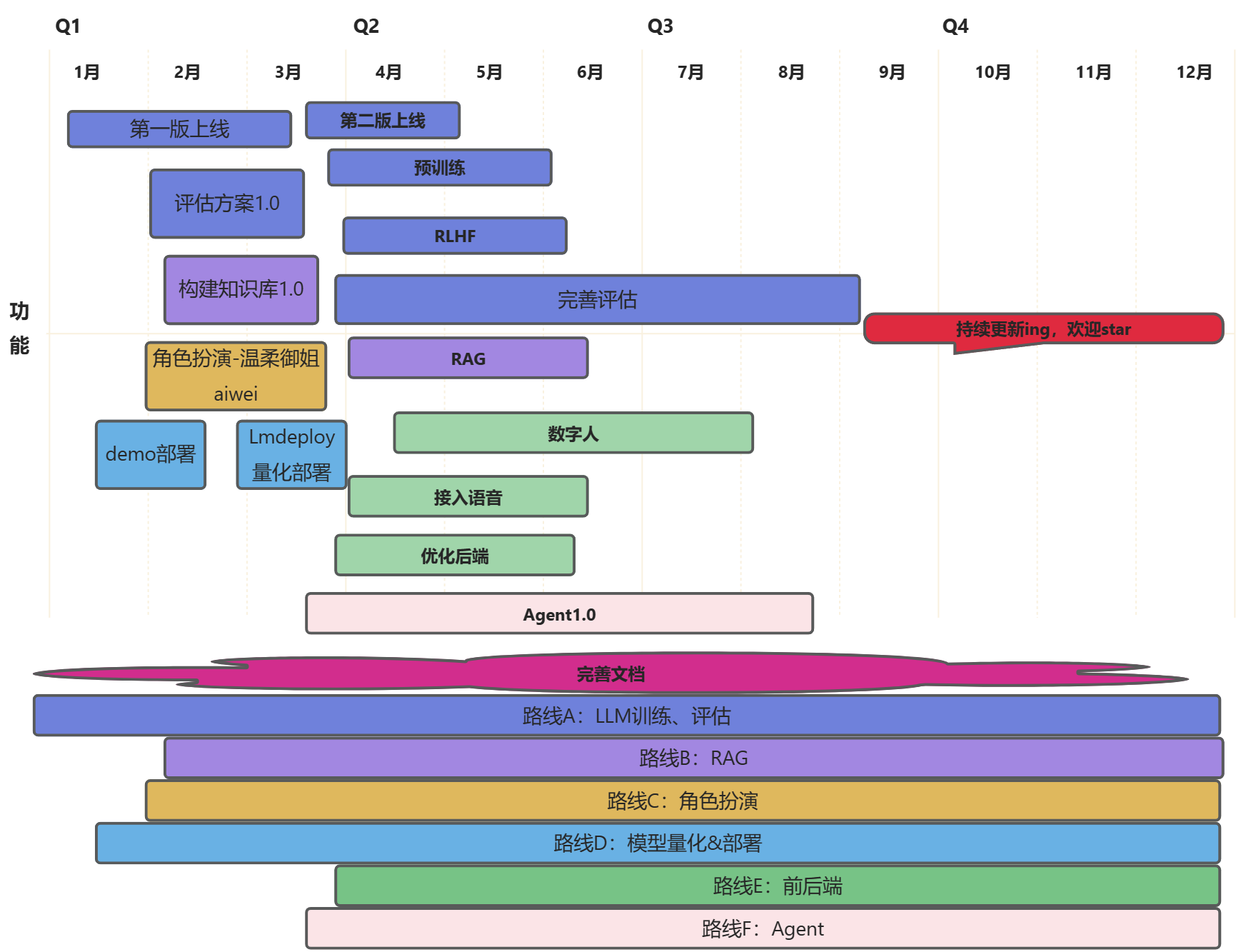

🎯路线图

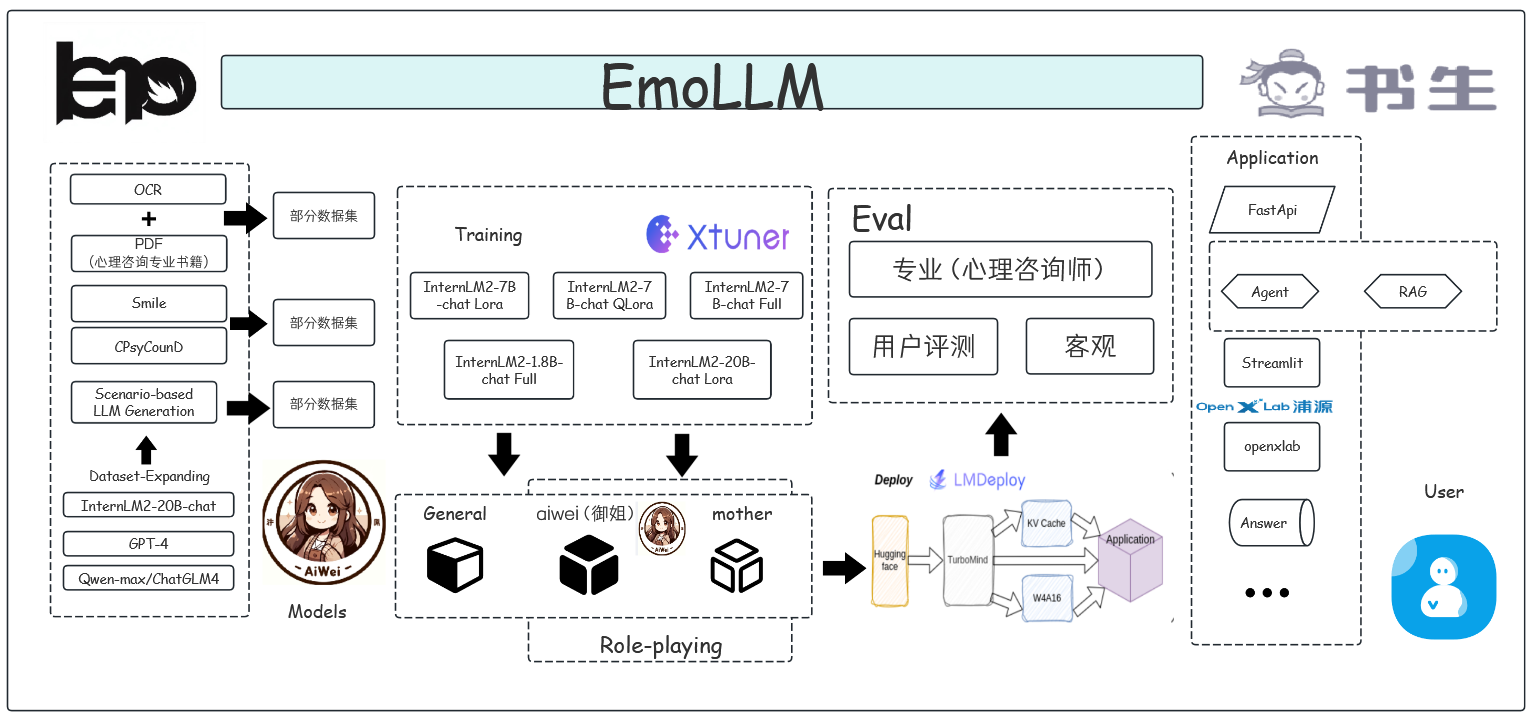

🔗框架图

目录

开发前的配置要求

- 硬件:A100 40G(仅针对InternLM2_7B_chat+qlora微调+deepspeed zero2优化)

- todo:发布更多硬件消耗细节

使用指南

- 克隆仓库

git clone https://github.com/SmartFlowAI/EmoLLM.git

🍪快速体验

- 请阅读快速体验查阅

- 快速上手:Baby EmoLLM

📌数据构建

🎨增量预训练、微调指南

- 增量预训练详见增量预训练指南

- 【基于xtuner】全量、LoRA、QLoRA微调详见微调指南

- 【基于ms-swift】全量、LoRA、QLoRA微调详见微调指南

- 【基于LLaMA-Factory】全量、LoRA、QLoRA微调详见微调指南

- todo:待更新DPO训练

🔧部署指南

⚙RAG(检索增强生成)

- 详见RAG

🎓评测指南

- 本模型评测分为通用评测和专业评测,请阅读评测指南查阅

更多详情

使用到的框架

- xtuner:用于微调

- Transformers

- Pytorch

- LMDeploy:用于量化部署

- Stremlit:用于构建Demo

- DeepSpeed:并行训练

- LLaMA-Factory:训练框架

- ms-swift:训练框架

如何参与本项目

贡献使开源社区成为一个学习、激励和创造的绝佳场所。你所作的任何贡献都是非常感谢的。

- 分支项目

- 创建你的功能分支 (

git checkout -b feature/AmazingFeature) - 提交你的更改 (

git commit -m 'Add some AmazingFeature') - 推送到分支 (

git push origin feature/AmazingFeature) - 打开拉取请求

作者(排名不分先后)

| 用户名 | 学校/组织 | 备注 | 贡献 |

|---|---|---|---|

| aJupyter | 南开大学在读硕士 | DataWhale成员 | 项目发起人 |

| MING-ZCH | 华中科技大学在读本科生 | LLM x Mental health 研究者 | 项目联合负责人 |

| chg0901 | 韩国光云大学在读博士 MiniSora | DataWhale意向成员 DataWhale鲸英助教团成员 | 项目联合负责人 |

| jujimeizuo | 江南大学在读硕士 | ||

| Smiling-Weeping-zhr | 哈尔滨工业大学(威海)在读本科生 | ||

| 8baby8 | 飞桨领航团区域主管 | 文心大模型核心开发者 | |

| zxazys | 南开大学在读硕士 | ||

| JasonLLLLLLLLLLL | swufe | ||

| MrCatAI | AI搬用工 | ||

| ZeyuBa | 自动化所在读硕士 | ||

| aiyinyuedejustin | 宾夕法尼亚大学在读硕士 | ||

| Nobody-ML | 中国石油大学(华东)在读本科生 | ||

| Mxoder | 北京航空航天大学在读本科生 | ||

| Anooyman | 南京理工大学硕士 | ||

| Vicky-3021 | 西安电子科技大学硕士(研0) | ||

| SantiagoTOP | 太原理工大学在读硕士 | 数据清洗,文档管理、Baby EmoLLM维护 | |

| zealot52099 | 个人开发者 | 清洗数据、LLM微调、RAG | |

| wwwyfff | 复旦大学在读硕士 | ||

| Yicooong | 南开大学在读硕士 | ||

| jkhumor | 南开大学在读硕士 | RAG | |

| lll997150986 | 南开大学在读硕士 | 微调 | |

| nln-maker | 南开大学在读硕士 | 前后端开发 | |

| dream00001 | 南开大学在读硕士 | 前后端开发 | |

| 王几行XING | 北京大学硕士毕业 | 清洗数据、LLM微调、前后端开发 | |

| [思在] | 北京大学硕士毕业(微软美国) | LLM微调、前后端开发 | |

| TingWei | 电子科技大学硕士毕业 | 微信公众号:AI大模型在手 | 微调 |

| PengYu | 石河子大学在读硕士 | LLM微调 | |

| Kedreamix | 深圳大学在读硕士 | DataWhale成员 | 首个心理健康R1蒸馏数据集 |

| HaiyangPeng | AI算法工程师 | 开发AI心理助手-深度思考版 |

版权说明

该项目签署了 MIT 授权许可,详情请参阅 LICENSE

引用

如果本项目对您的工作有所帮助,请使用以下格式引用:

@misc{2024EmoLLM,

title={EmoLLM: Reinventing Mental Health Support with Large Language Models},

author={EmoLLM Team},

howpublished={\url{https://github.com/SmartFlowAI/EmoLLM}},

year={2024}

}

工作列表

有如下工作引用了EmoLLM(如有遗漏,欢迎补充,排名不分先后)

- Yin C, Li F, Zhang S, et al. Mdd-5k: A new diagnostic conversation dataset for mental disorders synthesized via neuro-symbolic llm agents[C]//Proceedings of the AAAI Conference on Artificial Intelligence. 2025, 39(24): 25715-25723.

- Gu Q, Li S, Zheng T, et al. Steel-LLM: From Scratch to Open Source--A Personal Journey in Building a Chinese-Centric LLM[J]. arXiv preprint arXiv:2502.06635, 2025.

- Dai C, Hu J, Shi H, et al. Psyche-R1: Towards Reliable Psychological LLMs through Unified Empathy, Expertise, and Reasoning[J]. arXiv preprint arXiv:2508.10848, 2025.

- Wang M, Wang P, Wu L, et al. AnnaAgent: Dynamic Evolution Agent System with Multi-Session Memory for Realistic Seeker Simulation[J]. arXiv preprint arXiv:2506.00551, 2025.

- Feng Y, Wang Q, Liu K, et al. AI PsyRoom: Artificial Intelligence Platform for Segmented Yearning and Reactive Outcome Optimization Method[J]. arXiv preprint arXiv:2506.06740, 2025.

特别鸣谢

相关项目

人员

⚠️ 免责声明

本仓库所有开源代码及模型均遵循 MIT 许可协议。当前开源的 EmoLLM 模型可能存在某些局限性,因此我们声明如下:

EmoLLM 目前仅能提供情绪支持和相关建议服务,尚无法提供专业的心理咨询和心理治疗服务。EmoLLM 不能替代专业的心理医生或心理咨询师,可能存在固有局限性,并可能生成错误的、有害的、冒犯性的或其他不良输出。在关键或高风险场景中,用户需保持审慎,避免将 EmoLLM 的输出作为最终决策依据,以免造成个人伤害、财产损失或其他重大损失。

在任何情况下,作者、贡献者或版权所有者均不对因 EmoLLM 软件使用或交易引发的任何索赔、损害赔偿或其他责任(无论基于合同、侵权行为或其他法律原因)承担责任。

使用 EmoLLM 即表示您同意上述条款与条件,并承认了解其使用可能带来的潜在风险。您还同意赔偿并使作者、贡献者和版权所有者免受因您使用 EmoLLM而引发的任何索赔、损害赔偿或责任的影响。

Star History

🌟 Contributors

交流群

- 如果失效,请移步Issue区

版本历史

v0.62025/05/18v0.52025/03/23v0.42024/10/21v0.32024/07/11v0.22024/06/28v0.12024/05/30常见问题

相似工具推荐

openclaw

OpenClaw 是一款专为个人打造的本地化 AI 助手,旨在让你在自己的设备上拥有完全可控的智能伙伴。它打破了传统 AI 助手局限于特定网页或应用的束缚,能够直接接入你日常使用的各类通讯渠道,包括微信、WhatsApp、Telegram、Discord、iMessage 等数十种平台。无论你在哪个聊天软件中发送消息,OpenClaw 都能即时响应,甚至支持在 macOS、iOS 和 Android 设备上进行语音交互,并提供实时的画布渲染功能供你操控。 这款工具主要解决了用户对数据隐私、响应速度以及“始终在线”体验的需求。通过将 AI 部署在本地,用户无需依赖云端服务即可享受快速、私密的智能辅助,真正实现了“你的数据,你做主”。其独特的技术亮点在于强大的网关架构,将控制平面与核心助手分离,确保跨平台通信的流畅性与扩展性。 OpenClaw 非常适合希望构建个性化工作流的技术爱好者、开发者,以及注重隐私保护且不愿被单一生态绑定的普通用户。只要具备基础的终端操作能力(支持 macOS、Linux 及 Windows WSL2),即可通过简单的命令行引导完成部署。如果你渴望拥有一个懂你

stable-diffusion-webui

stable-diffusion-webui 是一个基于 Gradio 构建的网页版操作界面,旨在让用户能够轻松地在本地运行和使用强大的 Stable Diffusion 图像生成模型。它解决了原始模型依赖命令行、操作门槛高且功能分散的痛点,将复杂的 AI 绘图流程整合进一个直观易用的图形化平台。 无论是希望快速上手的普通创作者、需要精细控制画面细节的设计师,还是想要深入探索模型潜力的开发者与研究人员,都能从中获益。其核心亮点在于极高的功能丰富度:不仅支持文生图、图生图、局部重绘(Inpainting)和外绘(Outpainting)等基础模式,还独创了注意力机制调整、提示词矩阵、负向提示词以及“高清修复”等高级功能。此外,它内置了 GFPGAN 和 CodeFormer 等人脸修复工具,支持多种神经网络放大算法,并允许用户通过插件系统无限扩展能力。即使是显存有限的设备,stable-diffusion-webui 也提供了相应的优化选项,让高质量的 AI 艺术创作变得触手可及。

everything-claude-code

everything-claude-code 是一套专为 AI 编程助手(如 Claude Code、Codex、Cursor 等)打造的高性能优化系统。它不仅仅是一组配置文件,而是一个经过长期实战打磨的完整框架,旨在解决 AI 代理在实际开发中面临的效率低下、记忆丢失、安全隐患及缺乏持续学习能力等核心痛点。 通过引入技能模块化、直觉增强、记忆持久化机制以及内置的安全扫描功能,everything-claude-code 能显著提升 AI 在复杂任务中的表现,帮助开发者构建更稳定、更智能的生产级 AI 代理。其独特的“研究优先”开发理念和针对 Token 消耗的优化策略,使得模型响应更快、成本更低,同时有效防御潜在的攻击向量。 这套工具特别适合软件开发者、AI 研究人员以及希望深度定制 AI 工作流的技术团队使用。无论您是在构建大型代码库,还是需要 AI 协助进行安全审计与自动化测试,everything-claude-code 都能提供强大的底层支持。作为一个曾荣获 Anthropic 黑客大奖的开源项目,它融合了多语言支持与丰富的实战钩子(hooks),让 AI 真正成长为懂上

ComfyUI

ComfyUI 是一款功能强大且高度模块化的视觉 AI 引擎,专为设计和执行复杂的 Stable Diffusion 图像生成流程而打造。它摒弃了传统的代码编写模式,采用直观的节点式流程图界面,让用户通过连接不同的功能模块即可构建个性化的生成管线。 这一设计巧妙解决了高级 AI 绘图工作流配置复杂、灵活性不足的痛点。用户无需具备编程背景,也能自由组合模型、调整参数并实时预览效果,轻松实现从基础文生图到多步骤高清修复等各类复杂任务。ComfyUI 拥有极佳的兼容性,不仅支持 Windows、macOS 和 Linux 全平台,还广泛适配 NVIDIA、AMD、Intel 及苹果 Silicon 等多种硬件架构,并率先支持 SDXL、Flux、SD3 等前沿模型。 无论是希望深入探索算法潜力的研究人员和开发者,还是追求极致创作自由度的设计师与资深 AI 绘画爱好者,ComfyUI 都能提供强大的支持。其独特的模块化架构允许社区不断扩展新功能,使其成为当前最灵活、生态最丰富的开源扩散模型工具之一,帮助用户将创意高效转化为现实。

gemini-cli

gemini-cli 是一款由谷歌推出的开源 AI 命令行工具,它将强大的 Gemini 大模型能力直接集成到用户的终端环境中。对于习惯在命令行工作的开发者而言,它提供了一条从输入提示词到获取模型响应的最短路径,无需切换窗口即可享受智能辅助。 这款工具主要解决了开发过程中频繁上下文切换的痛点,让用户能在熟悉的终端界面内直接完成代码理解、生成、调试以及自动化运维任务。无论是查询大型代码库、根据草图生成应用,还是执行复杂的 Git 操作,gemini-cli 都能通过自然语言指令高效处理。 它特别适合广大软件工程师、DevOps 人员及技术研究人员使用。其核心亮点包括支持高达 100 万 token 的超长上下文窗口,具备出色的逻辑推理能力;内置 Google 搜索、文件操作及 Shell 命令执行等实用工具;更独特的是,它支持 MCP(模型上下文协议),允许用户灵活扩展自定义集成,连接如图像生成等外部能力。此外,个人谷歌账号即可享受免费的额度支持,且项目基于 Apache 2.0 协议完全开源,是提升终端工作效率的理想助手。

markitdown

MarkItDown 是一款由微软 AutoGen 团队打造的轻量级 Python 工具,专为将各类文件高效转换为 Markdown 格式而设计。它支持 PDF、Word、Excel、PPT、图片(含 OCR)、音频(含语音转录)、HTML 乃至 YouTube 链接等多种格式的解析,能够精准提取文档中的标题、列表、表格和链接等关键结构信息。 在人工智能应用日益普及的今天,大语言模型(LLM)虽擅长处理文本,却难以直接读取复杂的二进制办公文档。MarkItDown 恰好解决了这一痛点,它将非结构化或半结构化的文件转化为模型“原生理解”且 Token 效率极高的 Markdown 格式,成为连接本地文件与 AI 分析 pipeline 的理想桥梁。此外,它还提供了 MCP(模型上下文协议)服务器,可无缝集成到 Claude Desktop 等 LLM 应用中。 这款工具特别适合开发者、数据科学家及 AI 研究人员使用,尤其是那些需要构建文档检索增强生成(RAG)系统、进行批量文本分析或希望让 AI 助手直接“阅读”本地文件的用户。虽然生成的内容也具备一定可读性,但其核心优势在于为机器