OmniSVG

OmniSVG 是首个端到端的多模态可缩放矢量图形(SVG)生成模型系列,能够根据文本描述或图像参考,直接生成从简约图标到复杂动漫角色等各种精细的 SVG 文件。它有效解决了传统 AI 绘图工具多仅能生成位图、难以编辑且放大易失真的痛点,让创作者能直接获得无限缩放不失真、便于后续编辑修改的矢量素材。

这款工具非常适合设计师、插画师、前端开发者以及 AI 研究人员使用。设计师可利用它快速产出高质量矢量图标和插图素材;开发者能将其集成到工作流中自动化生成界面资源;研究人员则可基于其开源的代码、数据集(如 MMSVG)及评测基准(MMSVGBench)进行深入探索。

OmniSVG 的核心技术亮点在于创新性地利用了预训练的视觉 - 语言大模型(VLMs),实现了真正的端到端生成。它不仅支持复杂的细节刻画,还发布了包括 4B 和 8B 参数量的多个模型版本,并提供了完善的训练代码与 Hugging Face 在线演示,极大地降低了矢量图形生成的门槛,推动了多模态内容创作的发展。

使用场景

某独立游戏开发团队正在为一款复古风格 RPG 制作大量需要无限缩放且文件体积极小的 UI 图标与角色立绘。

没有 OmniSVG 时

- 设计师需手动使用 Illustrator 逐帧绘制矢量路径,从简单图标到复杂动漫角色耗时极长,严重拖慢迭代速度。

- 若尝试用现有 AI 生成位图再转矢量,得到的 SVG 路径杂乱无章、锚点冗余,无法直接用于生产环境。

- 难以保持美术风格统一,不同成员绘制的图标在笔触粗细和色彩风格上存在明显割裂感。

- 修改需求响应慢,一旦策划调整角色配色或细节,几乎需要重新绘制整个矢量文件。

使用 OmniSVG 后

- 团队只需输入“像素风宝剑图标”或“赛博朋克女战士”等自然语言描述,OmniSVG 即可端到端生成结构清晰、细节丰富的专业级 SVG 代码。

- 生成的矢量图形路径简洁优化,锚点分布合理,无需人工清理即可直接集成到游戏引擎中。

- 利用预训练视觉语言模型的理解能力,OmniSVG 能精准捕捉并复现指定的艺术风格,确保全套素材高度一致。

- 面对修改需求,开发者仅需微调提示词(如“将盔甲改为金色”),OmniSVG 能在秒级内输出更新后的完美矢量图。

OmniSVG 通过将复杂的多模态理解转化为精准的矢量生成,彻底重构了从创意构思到高质量 SVG 落地的生产管线。

运行环境要求

- Linux

- macOS

需要 NVIDIA GPU,显存需求:OmniSVG1.1_8B 需 26GB,OmniSVG1.1_4B 和 OmniSVG-3B 需 17GB,CUDA 12.1

未说明

快速开始

OmniSVG:统一的可缩放矢量图形生成模型

🔥🔥🔥 最新消息!!

- [2026/03/02] 🔥 我们发布了首个 Lottie 动画生成模型——OmniLottie,详情请见 OpenVGLab/OmniLottie

- [2025/12/31] 👋 我们已发布 OmniSVG 的训练代码,请查看 OpenVGLab/OmniSVG-Train

- [2025/12/22] 我们更新了 MMSVG-Icon(26.4万→90.4万)和 MMSVG-Illustration(6.6万→25.5万)数据集,增加了更丰富的描述和 PNG 预览图!详情请见 MMSVG-Icon 和 MMSVG-Illustration。

- [2025/12/02] 我们发布了 OmniSVG1.1_8B 模型权重,并更新了 OmniSVG1.1_4B 模型权重!详情请见 OmniSVG1.1_8B 和 OmniSVG1.1_4B。

- [2025/12/02] 我们发布了 MMSVGBench 基准数据集及评估代码!详情请见 MMSVGBench 和 评估。

- [2025/09/18] OmniSVG 被 NeurIPS 2025 接收啦🔥!圣地亚哥见!

- [2025/07/22] 👋 我们发布了 Huggingface 演示。🤗演示。

- [2025/07/22] 👋 我们发布了 MMSVG-Icon 和 MMSVG-Illustration 数据集的推理代码及模型权重。🤗权重。

- [2025/04/09] 👋 发布了 MMSVG-Icon 和 MMSVG-Illustration 数据集。🤗数据集。

- [2025/04/09] 👋 上传论文并启动项目。阅读

🧩 社区贡献

如果您正在项目中开发或使用 OmniSVG,或者希望为 OmniSVG 做出贡献,请随时告知我们🎉。

- 如果您在使用 MMSVG 数据集时发现任何问题,请通过此 表格 提交反馈。

- 👋 @smthemex 开发的 OmniSVG ComfyUI 插件 ComfyUI_OmniSVG。

📑 开源计划

- 项目主页与技术报告

- MMSVG-Icon 和 MMSVG-Illustration 数据集发布

- MMSVG-Icon 和 MMSVG-Illustration 数据集的推理代码及模型权重

- 在线演示(基于 Gradio 的 Huggingface 空间)

- OmniSVG1.1_8B 模型权重发布

- OmniSVG1.1_4B 模型权重发布

- MMSVGBench 基准测试与评估代码发布

1. 引言

OmniSVG 是首个端到端多模态 SVG 生成器系列,它利用预训练的视觉-语言模型(VLM),能够生成复杂而精细的 SVG 图形,从简单的图标到精美的动漫角色皆可胜任。同时,我们还推出了 MMSVG-2M 多模态数据集,包含两百万个标注丰富的 SVG 资源,并制定了一套标准化的条件式 SVG 生成任务评估协议。

2. 模型下载

| 模型 | 下载链接 | 大小 | 更新日期 |

|---|---|---|---|

| OmniSVG1.1_8B | Huggingface | 17.2 GB | 2025-12-02 |

| OmniSVG1.1_4B | Huggingface | 7.69 GB | 2025-12-02 |

| OmniSVG-3B | Huggingface | 8.49 GB | 2025-07-22 |

3. 依赖与安装

按照以下说明配置的依赖项将为您提供一个适合推理的环境。

3.1 克隆仓库

git clone https://github.com/OmniSVG/OmniSVG.git

cd OmniSVG

3.2 创建 Conda 环境

创建并激活一个使用 Python 3.10 的新 Conda 环境:

conda create -n omnisvg python=3.10

conda activate omnisvg

3.3 安装依赖

系统依赖

在安装 Python 包之前,您需要先安装 CairoSVG 所需的 Cairo 库:

macOS:

brew install cairo

Linux(Ubuntu/Debian):

sudo apt update

sudo apt install libcairo2 libcairo2-dev

提示: 提前安装 Cairo 系统库有助于避免在通过 pip 安装

CairoSVG时可能出现的构建错误。

Python 依赖

我们已在 CUDA 12.1 环境下测试过我们的运行环境。您可以按照 CUDA Toolkit 安装指南 安装 CUDA 12.1。

安装支持 CUDA 12.1 的 PyTorch:

pip install torch==2.3.0+cu121 torchvision==0.18.0+cu121 --index-url https://download.pytorch.org/whl/cu121

安装其余依赖:

pip install -r requirements.txt

4. 推理脚本

| GPU 内存占用 | 每 256/512/1024/2048/4096 个 token 的耗时 | |

|---|---|---|

| OmniSVG1.1_8B | 26G | 5.38/9.02/20.11/40.34/98.11 秒 |

| OmniSVG1.1_4B | 17G | 4.08/8.68/18.07/37.51/82.70 秒 |

| OmniSVG-3B | 17G | 4.08/8.68/18.07/37.51/82.70 秒 |

注意:此处显示的推理时间是基于 OmniSVG SVG tokens 计算的,而我们在论文中报告的推理时间则是基于 XML 代码 tokens 计算的,以便与基线方法进行公平比较。

快速入门

下载模型权重

首先,安装 Hugging Face CLI 工具:

pip install huggingface-hub

从 Hugging Face 下载模型:

# 下载 OmniSVG1.1-8B

huggingface-cli download OmniSVG/OmniSVG1.1_8B --local-dir /PATH/TO/OmniSVG1.1_8B

# 下载 OmniSVG1.1-4B

huggingface-cli download OmniSVG/OmniSVG1.1_4B --local-dir /PATH/TO/OmniSVG1.1_4B

# 下载 OmniSVG-3B(旧版)

huggingface-cli download OmniSVG/OmniSVG --local-dir /PATH/TO/OmniSVG-3B

文本到 SVG 生成

基本用法 - 从文本文件生成 SVG:

python inference.py --task text-to-svg --input prompts.txt --output ./output_text --save-all-candidates

使用 4B 模型:

python inference.py --task text-to-svg --input prompts.txt --output ./output_text --model-size 4B --save-all-candidates

生成更多候选并保存 PNG:

python inference.py --task text-to-svg --input prompts.txt --output ./output_text \

--num-candidates 8 --save-png --save-all-candidates

自定义生成参数:

python inference.py --task text-to-svg --input prompts.txt --output ./output_text \

--temperature 0.5 --top-p 0.9 --top-k 50 --repetition-penalty 1.05

使用本地模型:

python inference.py --task text-to-svg --input prompts.txt --output ./output_text \

--model-path /path/to/qwen --weight-path /path/to/omnisvg

图像到 SVG 生成

python inference.py --task image-to-svg --input ./examples --output ./output_image --save-all-candidates

交互式演示

我们提供了基于 Gradio 的交互式生成界面:

本地部署

python app.py在线演示

请在 Hugging Face Spaces 上体验我们的实时演示。

5. 评估

我们提供了 MMSVGBench,用于对 SVG 生成模型进行标准化评估。

下载 MMSVGBench:

huggingface-cli download OmniSVG/MMSVGBench --repo-type dataset --local-dir /PATH/TO/MMSVGBench

基准概述

MMSVGBench 是一个 纯合成基准,其中所有提示和图像均使用 GPT 模型生成,确保数据在模型训练期间 未被见过,从而实现公平的泛化能力评估。MMSVGBench 的生成过程会记录提示信息,例如 text2svg 提示日志。

| 任务 | 复杂度级别 | 样本数 | 描述 |

|---|---|---|---|

| 文本到 SVG | 图标 | 150 | 简单图标(1-2 个元素) |

| 文本到 SVG | 描绘图 | 150 | 复杂描绘图(1-3 个相互作用的元素) |

| 图像到 SVG | 图标 | 150 | GPT-4o 生成的图标图像 |

| 图像到 SVG | 描绘图 | 150 | GPT-4o 生成的描绘图图像 |

合成设计的关键优势:

- ✅ 真正的泛化测试 — 模型在训练过程中不可能见过这些样本

- ✅ 可控的多样性 — 系统性地覆盖多种风格和语义类别

- ✅ 公平性 — 不存在因训练数据重叠而导致的不公平优势

评估代码位于 metrics 目录中。有关 MMSVGBench 构建及评估指标的更多详细信息,请参阅 MMSVGBench。

6. 许可证

OmniSVG 采用 Apache License 2.0 许可证,而 MMSVG 数据集则采用 Creative Commons Attribution Non Commercial Share Alike 4.0 License。许可证文件可在相应的 GitHub 和 Hugging Face 仓库中找到。

引用

@article{yang2025omnisvg,

title={OmniSVG: 一种统一的可扩展矢量图形生成模型},

author={Yiying Yang 和 Wei Cheng 和 Sijin Chen 和 Xianfang Zeng 和 Jiaxu Zhang 和 Liao Wang 和 Gang Yu 和 Xinjun Ma 和 Yu-Gang Jiang},

journal={arXiv 预印本 arxiv:2504.06263},

year={2025}

}

致谢

我们感谢以下优秀的开源项目:

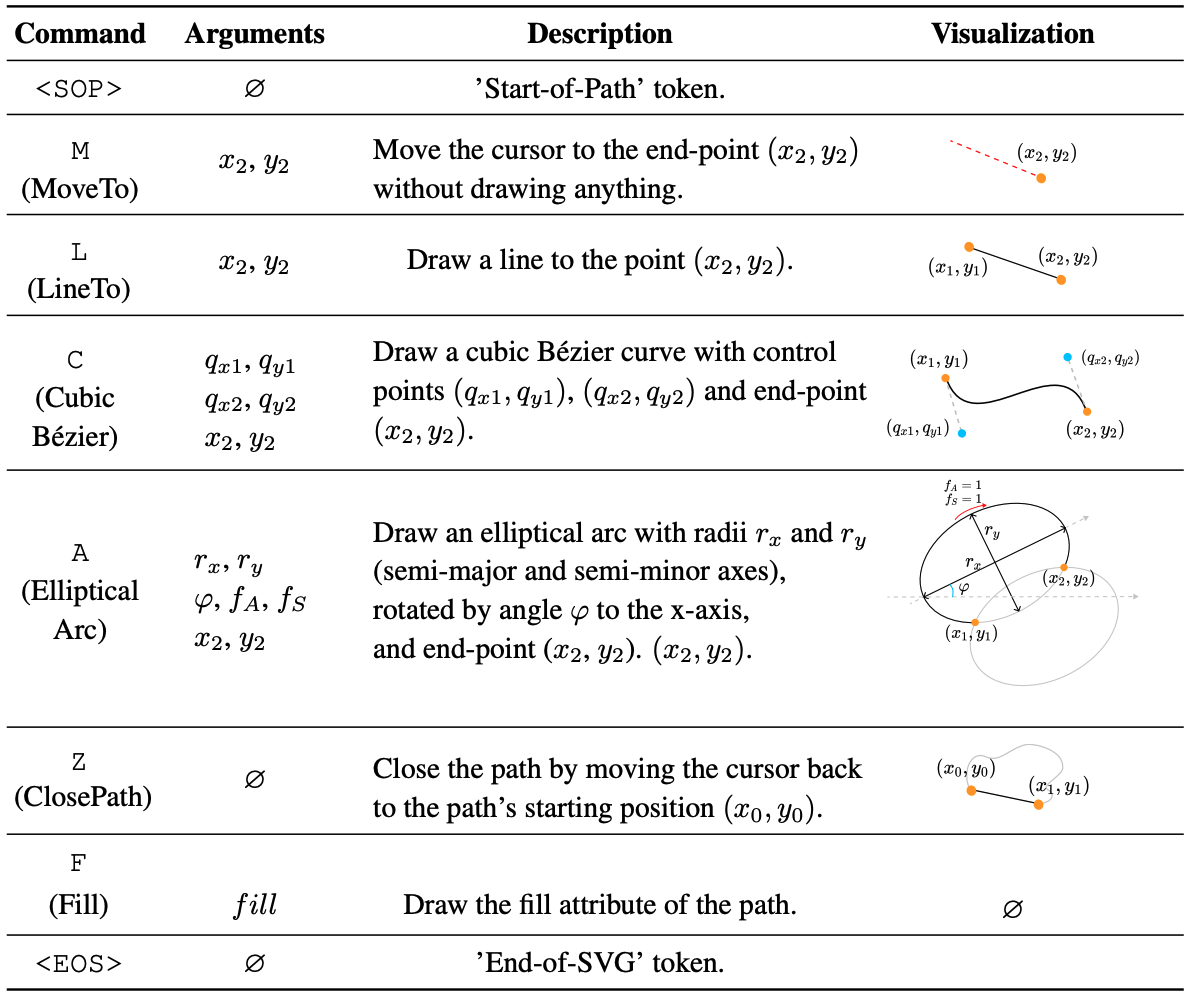

IconShop:是首个利用大语言模型生成单色图标级 SVG 的先进工作。我们参考了其参数化实现。

以下是高度相关的同期研究:

LLM4SVG:将 SVG 坐标视为数字字符串,并预测小数部分以提高空间精度。

StarVector:为大语言模型配备了图像编码器,用于图像到 SVG 的生成。

星标历史

常见问题

相似工具推荐

openclaw

OpenClaw 是一款专为个人打造的本地化 AI 助手,旨在让你在自己的设备上拥有完全可控的智能伙伴。它打破了传统 AI 助手局限于特定网页或应用的束缚,能够直接接入你日常使用的各类通讯渠道,包括微信、WhatsApp、Telegram、Discord、iMessage 等数十种平台。无论你在哪个聊天软件中发送消息,OpenClaw 都能即时响应,甚至支持在 macOS、iOS 和 Android 设备上进行语音交互,并提供实时的画布渲染功能供你操控。 这款工具主要解决了用户对数据隐私、响应速度以及“始终在线”体验的需求。通过将 AI 部署在本地,用户无需依赖云端服务即可享受快速、私密的智能辅助,真正实现了“你的数据,你做主”。其独特的技术亮点在于强大的网关架构,将控制平面与核心助手分离,确保跨平台通信的流畅性与扩展性。 OpenClaw 非常适合希望构建个性化工作流的技术爱好者、开发者,以及注重隐私保护且不愿被单一生态绑定的普通用户。只要具备基础的终端操作能力(支持 macOS、Linux 及 Windows WSL2),即可通过简单的命令行引导完成部署。如果你渴望拥有一个懂你

stable-diffusion-webui

stable-diffusion-webui 是一个基于 Gradio 构建的网页版操作界面,旨在让用户能够轻松地在本地运行和使用强大的 Stable Diffusion 图像生成模型。它解决了原始模型依赖命令行、操作门槛高且功能分散的痛点,将复杂的 AI 绘图流程整合进一个直观易用的图形化平台。 无论是希望快速上手的普通创作者、需要精细控制画面细节的设计师,还是想要深入探索模型潜力的开发者与研究人员,都能从中获益。其核心亮点在于极高的功能丰富度:不仅支持文生图、图生图、局部重绘(Inpainting)和外绘(Outpainting)等基础模式,还独创了注意力机制调整、提示词矩阵、负向提示词以及“高清修复”等高级功能。此外,它内置了 GFPGAN 和 CodeFormer 等人脸修复工具,支持多种神经网络放大算法,并允许用户通过插件系统无限扩展能力。即使是显存有限的设备,stable-diffusion-webui 也提供了相应的优化选项,让高质量的 AI 艺术创作变得触手可及。

ComfyUI

ComfyUI 是一款功能强大且高度模块化的视觉 AI 引擎,专为设计和执行复杂的 Stable Diffusion 图像生成流程而打造。它摒弃了传统的代码编写模式,采用直观的节点式流程图界面,让用户通过连接不同的功能模块即可构建个性化的生成管线。 这一设计巧妙解决了高级 AI 绘图工作流配置复杂、灵活性不足的痛点。用户无需具备编程背景,也能自由组合模型、调整参数并实时预览效果,轻松实现从基础文生图到多步骤高清修复等各类复杂任务。ComfyUI 拥有极佳的兼容性,不仅支持 Windows、macOS 和 Linux 全平台,还广泛适配 NVIDIA、AMD、Intel 及苹果 Silicon 等多种硬件架构,并率先支持 SDXL、Flux、SD3 等前沿模型。 无论是希望深入探索算法潜力的研究人员和开发者,还是追求极致创作自由度的设计师与资深 AI 绘画爱好者,ComfyUI 都能提供强大的支持。其独特的模块化架构允许社区不断扩展新功能,使其成为当前最灵活、生态最丰富的开源扩散模型工具之一,帮助用户将创意高效转化为现实。

LLMs-from-scratch

LLMs-from-scratch 是一个基于 PyTorch 的开源教育项目,旨在引导用户从零开始一步步构建一个类似 ChatGPT 的大型语言模型(LLM)。它不仅是同名技术著作的官方代码库,更提供了一套完整的实践方案,涵盖模型开发、预训练及微调的全过程。 该项目主要解决了大模型领域“黑盒化”的学习痛点。许多开发者虽能调用现成模型,却难以深入理解其内部架构与训练机制。通过亲手编写每一行核心代码,用户能够透彻掌握 Transformer 架构、注意力机制等关键原理,从而真正理解大模型是如何“思考”的。此外,项目还包含了加载大型预训练权重进行微调的代码,帮助用户将理论知识延伸至实际应用。 LLMs-from-scratch 特别适合希望深入底层原理的 AI 开发者、研究人员以及计算机专业的学生。对于不满足于仅使用 API,而是渴望探究模型构建细节的技术人员而言,这是极佳的学习资源。其独特的技术亮点在于“循序渐进”的教学设计:将复杂的系统工程拆解为清晰的步骤,配合详细的图表与示例,让构建一个虽小但功能完备的大模型变得触手可及。无论你是想夯实理论基础,还是为未来研发更大规模的模型做准备

Deep-Live-Cam

Deep-Live-Cam 是一款专注于实时换脸与视频生成的开源工具,用户仅需一张静态照片,即可通过“一键操作”实现摄像头画面的即时变脸或制作深度伪造视频。它有效解决了传统换脸技术流程繁琐、对硬件配置要求极高以及难以实时预览的痛点,让高质量的数字内容创作变得触手可及。 这款工具不仅适合开发者和技术研究人员探索算法边界,更因其极简的操作逻辑(仅需三步:选脸、选摄像头、启动),广泛适用于普通用户、内容创作者、设计师及直播主播。无论是为了动画角色定制、服装展示模特替换,还是制作趣味短视频和直播互动,Deep-Live-Cam 都能提供流畅的支持。 其核心技术亮点在于强大的实时处理能力,支持口型遮罩(Mouth Mask)以保留使用者原始的嘴部动作,确保表情自然精准;同时具备“人脸映射”功能,可同时对画面中的多个主体应用不同面孔。此外,项目内置了严格的内容安全过滤机制,自动拦截涉及裸露、暴力等不当素材,并倡导用户在获得授权及明确标注的前提下合规使用,体现了技术发展与伦理责任的平衡。

opencv

OpenCV 是一个功能强大的开源计算机视觉库,被誉为机器视觉领域的“瑞士军刀”。它主要解决让计算机“看懂”图像和视频的核心难题,提供了从基础的图像读取、色彩转换、边缘检测,到复杂的人脸识别、物体追踪、3D 重建及深度学习模型部署等全方位算法支持。无论是处理静态图片还是分析实时视频流,OpenCV 都能高效完成特征提取与模式识别任务。 这款工具特别适合计算机视觉开发者、人工智能研究人员以及机器人工程师使用。对于希望将视觉感知能力集成到应用中的软件工程师,或是需要快速验证算法原型的学术研究者,OpenCV 都是不可或缺的基础设施。虽然普通用户通常不会直接操作代码,但日常生活中使用的扫码支付、美颜相机和自动驾驶系统,背后往往都有它的身影。 OpenCV 的独特亮点在于其卓越的性能与广泛的兼容性。它采用 C++ 编写以确保高速运算,同时提供 Python、Java 等多种语言接口,极大降低了开发门槛。库中内置了数千种优化算法,并支持跨平台运行,能够无缝对接各类硬件加速器。作为社区驱动的项目,OpenCV 拥有活跃的生态系统和丰富的学习资源,持续推动着视觉技术的前沿发展。