Collaborative_Perception

Collaborative_Perception 是一个专注于自动驾驶领域协同感知技术的开源论文汇总库。它系统性地整理了近年来在车与车(V2V)、车与基础设施(V2I)及车与万物(V2X)场景下,多智能体协作感知的最新研究进展。

在自动驾驶中,单车感知常受限于视距遮挡和传感器盲区,难以应对复杂路况。Collaborative_Perception 通过汇集前沿学术成果,帮助从业者理解如何利用车辆间的通信共享数据,突破单点感知局限,实现超视距的环境理解,从而提升驾驶系统的安全性与鲁棒性。

该资源特别适合自动驾驶算法研究人员、高校学者及相关领域的开发者使用。它不仅按字母顺序梳理了大量核心论文,还精心分类了“方法与框架”、“数据集与模拟器”等关键板块。此外,库中独家收录了丰富的学习资源,包括权威的综述文章、顶级会议的技术教程视频以及专用的代码库(如 V2Xverse),为用户提供了从理论入门到代码复现的一站式支持。对于希望深入探索协同感知机制、追踪技术前沿或寻找实验基准的专业人士而言,这是一个极具价值的知识导航工具。

使用场景

某自动驾驶车队在复杂城市路口进行 L4 级路测时,面临多车协同感知的算法选型与集成难题。

没有 Collaborative_Perception 时

- 研发团队需在海量学术论文中盲目摸索,难以快速定位适用于 V2V(车对车)或 V2I(车对路)场景的最新协同感知框架。

- 由于缺乏统一的数据集和模拟器索引,复现基准模型耗时耗力,且常因训练设置不透明导致结果无法公平对比。

- 面对通信带宽受限或时序异步等实际工程痛点,找不到经过验证的解决方案(如 Where2comm 或 CoBEVFlow),只能重复造轮子。

- 团队成员对协同感知的理论边界认知模糊,缺乏系统的综述资源和学习路径,导致技术路线决策缓慢。

使用 Collaborative_Perception 后

- 开发者可直接查阅按字母排序的论文库,迅速锁定针对特定场景(如遮挡消除)的最优方法论与代码实现。

- 利用整理好的数据集与模拟器资源清单,大幅缩短环境搭建周期,并参考归档版本中的历史数据避免复现陷阱。

- 通过推荐的视频教程和专题报告,快速掌握解决通信中断、带宽优化及异构协作等关键问题的前沿技术。

- 依托丰富的综述文献与学习资源,团队能清晰构建从理论到落地的知识体系,高效制定技术演进路线。

Collaborative_Perception 通过一站式聚合前沿成果与实战资源,将自动驾驶协同感知技术的研发探索周期从数月缩短至数周。

运行环境要求

未说明

未说明

快速开始

协作感知

本仓库是对V2I / V2V / V2X 自动驾驶场景下协作 / 合作 / 多智能体 感知领域近期进展的论文摘要。论文按首字母顺序排列。

:link:跳转至:

注:由于部分已发表的结果是在未明确训练和测试设置的情况下获得的,甚至使用了修改后的模型架构,因此很难在每个基准上公平地比较所有方法。事实上,许多研究都是在自己的设置下评估所有基线并报告结果。因此,不同论文之间可能会存在不一致之处。基于此,我在之前的更新中放弃了收集和复现所有基准的工作。如果你感兴趣,可以在这个归档版本中找到大量相关结果。

:star2:推荐

有用的学习资源:thumbsup::thumbsup::thumbsup:

- (论文) 当自动驾驶汽车遇上V2X协同感知:我们离目标还有多远?[论文],端到端V2X协同自动驾驶竞赛中的研究挑战与进展[论文],自动驾驶车辆应与自然语言连接[论文],面向自动驾驶的协同感知数据集:综述[论文],面向网联自动驾驶的协同感知:挑战、可能解决方案及机遇[论文],用于自动驾驶的V2X协同感知:最新进展与挑战[论文],迈向车路协同自动驾驶:关于协同感知的综述[论文],自动驾驶中的协同感知:方法、数据集与挑战[论文],合作感知的综述与框架:从异构单体到层次化合作[论文]

- (讲座) 车对车通信(Waabi CVPR 24 自动驾驶教程)[视频],车对车通信(Waabi CVPR 23 自动驾驶教程)[视频],L4自动驾驶的终极解决方案[视频],当视觉Transformer遇上协同感知[视频],超越可见范围的场景理解[视频],抗通信中断的鲁棒协同感知[视频],自动驾驶中的协同与对抗性3D感知[视频],自动驾驶中的车对车通信[视频],自动驾驶的对抗鲁棒性[视频],L4感知系统的终极形态:协同驾驶[视频],CoBEVFlow——解决车-车/路协同感知的时序异步问题[视频],新一代协作感知Where2comm将通信带宽降低十万倍[视频],从任务相关到任务无关的多机器人协同感知[视频],协同自动驾驶:仿真与感知[视频],基于群体协作的超视距态势感知[视频]

- (库) V2Xverse:基于V2X的端到端协同自动驾驶代码库[代码] [文档],HEAL:开放异构协同感知的可扩展框架[代码] [文档],OpenCOOD:面向自动驾驶的开放合作检测框架[代码] [文档],CoPerception:协同感知SDK[代码] [文档],OpenCDA:集成原型合作驾驶自动化功能的仿真工具[代码] [文档]

- (研讨会) Co-Intelligence@ECCV'24 [网站],CoPerception@ICRA'23 [网站],ScalableAD@ICRA'23 [网站]

- (背景知识) 智能体中点云目标检测的当前方法与未来方向[视频],自动驾驶中的3D目标检测:综述与新视角[论文],DACOM:为多智能体强化学习学习延迟感知通信[视频],带有通信的多智能体强化学习综述[论文]

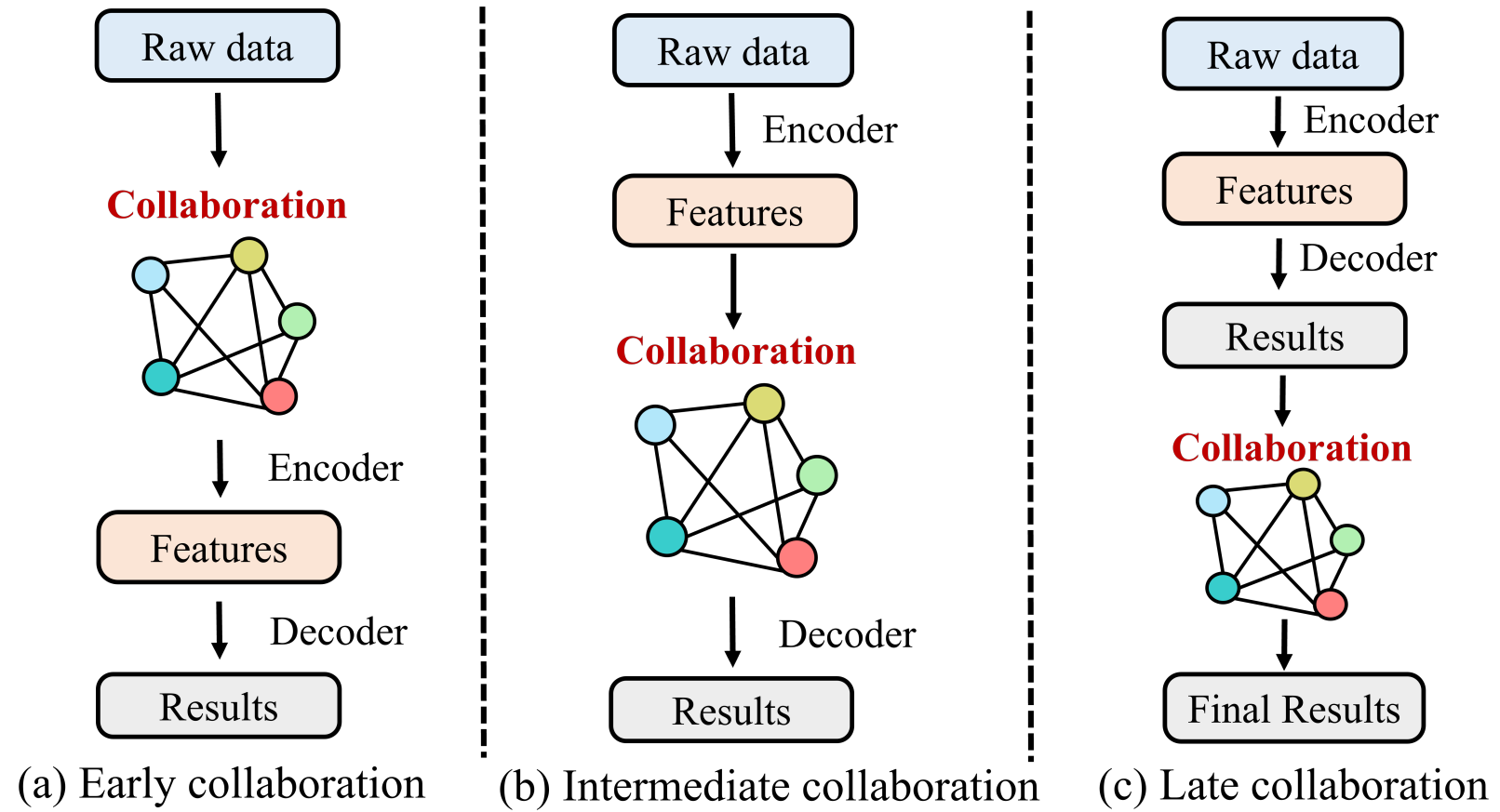

典型的合作模式:handshake::handshake::handshake:

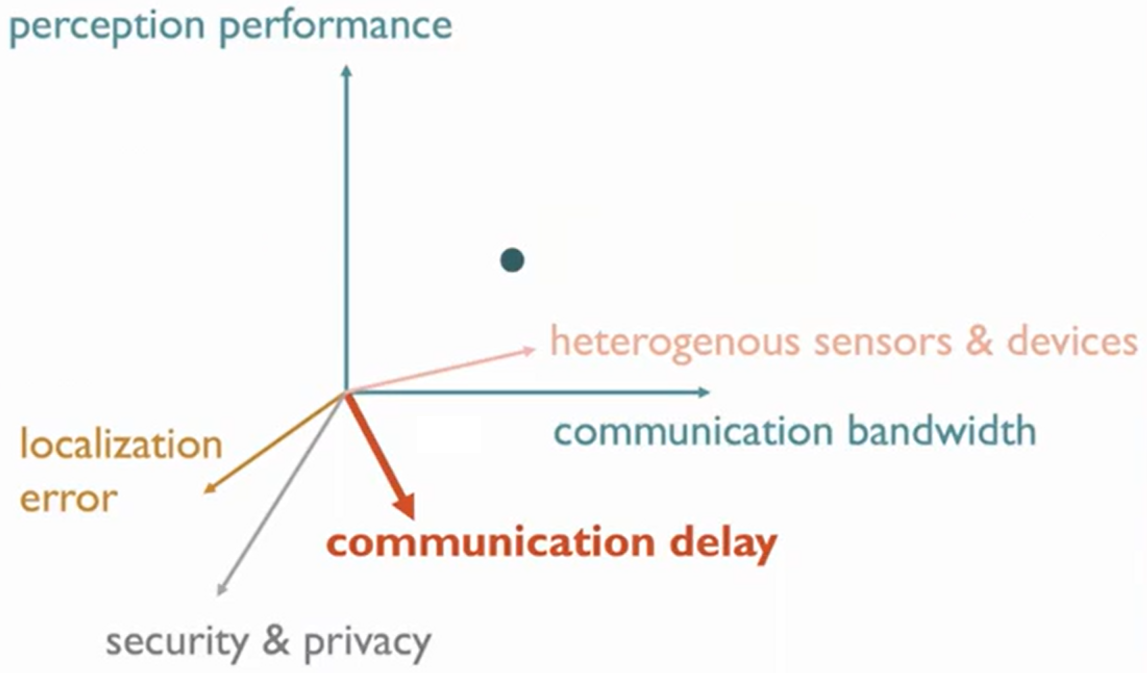

可能的优化方向:fire::fire::fire:

:bookmark:方法与框架

注:{Related} 表示该论文并非纯粹的协同感知论文,但包含相关内容。

精选预印本

- ACCO(协作感知只需离散化融合吗?)[论文] [代码]

- AR2VP(基于路侧到车端视觉的动态V2X自主感知)[论文] [代码]

- CPPC(点簇:一种用于通信高效协作感知的紧凑消息单元)[论文&评审] [

代码] - CP-FREEZER(CP-FREEZER:针对车载协作感知的时延攻击)[论文] [代码]

- CMP(CMP:基于多智能体通信的协作运动预测)[论文] [

代码] - CoBEVFusion(CoBEVFusion:激光雷达与摄像头鸟瞰图融合的协作感知)[论文] [

代码] - CoBEVGlue(自定位协作感知)[论文] [代码]

- CoCMT(CoCMT:迈向通信高效的跨模态Transformer协作感知)[论文&评审] [代码]

- CoDiff(CoDiff:用于协作3D目标检测的条件扩散模型)[论文] [

代码] - CoDriving(迈向协作式自动驾驶:仿真平台与端到端系统)[论文] [代码]

- CoDrivingLLM(迈向交互式可学习的协作驾驶自动化:一个大语言模型驱动的决策框架)[论文] [代码]

- CollaMamba(CollaMamba:基于跨智能体时空状态空间模型的高效协作感知)[论文] [

代码] - CoLMDriver(CoLMDriver:基于LLM的协商助力协作式自动驾驶)[论文] [代码]

- CoMamba(CoMamba:利用状态空间模型解锁实时协作感知)[论文] [

代码] - CoPLOT(超越BEV:优化点级标记以实现协作感知)[论文] [代码]

- CP-Guard+(CP-Guard+:协作感知中恶意智能体检测与防御的新范式)[论文&评审] [

代码] - CTCE(利用时间上下文增强车路协同感知)[论文] [

代码] - Debrief(对话车辆:通过自然语言实现协作驾驶)[论文&评审] [

代码] - DeepFleet(DeepFleet:面向移动机器人的多智能体基础模型)[论文] [

代码] - DiffCP(DiffCP:基于扩散模型的超低比特协作感知)[论文] [

代码] - FadeLead(背景淡化,前景主导:课程引导的背景剪枝以实现高效的以前景为中心的协作感知)[论文] [

代码] - Faster-HEAL(Faster-HEAL:一种高效且隐私友好的异构自动驾驶协作感知框架)[论文] [

代码] - FlowAdapt(移动关键信息:通过最优传输流实现参数高效的领域适应以支持协作感知)[论文] [

代码] - HeatV2X(HeatV2X:通过高效对齐与交互实现可扩展的异构协作感知)[论文] [代码]

- HyComm(基于混合协作的通信高效多智能体3D检测)[论文] [

代码] - HyDRA(HyDRA:面向异构协作感知的混合领域感知鲁棒架构)[论文] [

代码] - InSPE(InSPE:快速评估异构多模态基础设施传感器布局)[论文] [

代码] - I2XTraj(面向基础设施到万物的信号交叉口知识驱动多智能体轨迹预测)[论文] [

代码] - JigsawComm(JigsawComm:面向通信高效协作感知的联合语义特征编码与传输)[论文] [代码]

- LCV2I(LCV2I:基于低分辨率激光雷达的通信高效、高性能协作感知框架)[论文] [

代码] - LMMCoDrive(LMMCoDrive:基于大型多模态模型的协作驾驶)[论文] [代码]

- {相关} MDG(MDG:用于交通环境中多智能体行为建模的掩码去噪生成)[论文] [

代码] - mmCooper(mmCooper:一个多智能体多阶段、通信高效且协作鲁棒的协作感知框架)[论文] [

代码] - MOT-CUP(具有保形不确定性传播的协作多目标跟踪)[论文] [代码]

- OpenCOOD-Air(OpenCOOD-Air:通过空间转换和偏移预测促进异构地面-空中协作感知)[论文] [

代码] - RefPtsFusion(从特征到参考点:轻量级且适应性强的融合以支持协作式自动驾驶)[论文] [

代码] - {相关} RopeBEV(RopeBEV:鸟瞰视角下的多摄像头路侧感知网络)[论文] [

代码] - ParCon(ParCon:基于多模块并行连接的抗噪声协作感知)[论文] [

代码] - PragComm(多智能体协作感知中的务实通信)[论文] [代码]

- QPoint2Comm(少发多知:用于容错协作感知的掩码量化点云通信)[论文] [

代码] - QuantV2X(QuantV2X:一个完全量化的多智能体协作感知系统)[论文] [代码]

- QUEST(QUEST:用于车路协同感知的查询流)[论文] [

代码] - RCDN(RCDN:通过基于动态特征的3D神经建模实现对相机不敏感的稳健协作感知)[论文] [

代码] - RC-GeoCP(RC-GeoCP:用于雷达-摄像头协作感知的几何一致性)[论文] [

代码] - ReVQom(用于通信高效多智能体感知的残差向量量化)[论文] [

代码] - RG-Attn(RG-Attn:用于多模态多智能体协作感知的弧度粘合注意力)[论文] [

代码] - RiskMM(风险地图作为中间件:迈向可解释的协作式端到端自动驾驶,实现风险感知规划)[论文] [

代码] - RoCo-Sim(RoCo-Sim:通过前景模拟增强路侧协作感知)[论文] [代码]

- SafeCoop(SafeCoop:解开代理式协作驾驶中的全栈安全性)[论文] [代码]

- ShareVerse(ShareVerse:用于共享世界建模的多智能体一致视频生成)[论文] [

代码] - SiCP(SiCP:面向网联与自动驾驶车辆3D目标检测的同时个体与协作感知)[论文] [代码]

- SparseAlign(SparseAlign:一个完全稀疏的协作目标检测框架)[论文] [

代码] - Talking Vehicles(通过自我博弈实现自然语言通信,迈向协作式自动驾驶)[论文] [代码]

- TOCOM-V2I(面向任务的车路协同感知通信)[论文] [

代码] - {相关} TYP(转移你的视角:在驾驶场景中从任意视角可控地生成3D内容)[论文] [

代码] - UniMM-V2X(UniMM-V2X:MoE增强的多层级融合,用于端到端协作式自动驾驶)[论文] [代码]

- VIMI(VIMI:基于摄像头的3D目标检测中车路多视角中间融合)[论文] [代码]

- VLIF(是否只需中间融合即可实现基于无人机的协作感知?)[论文] [代码]

- V2V-GoT(V2V-GoT:基于多模态大语言模型和思维之图的车对车协作式自动驾驶)[论文] [

代码] - V2V-LLM(V2V-LLM:基于多模态大语言模型的车对车协作式自动驾驶)[论文] [代码]

- V2XPnP(V2XPnP:面向多智能体感知与预测的车到万物时空融合)[论文] [代码]

- V2X-DGPE(V2X-DGPE:解决领域差距与姿态误差以实现稳健的协作3D目标检测)[论文] [代码]

- V2X-DGW(V2X-DGW:恶劣天气条件下多智能体感知的领域泛化)[论文] [

代码] - V2X-DSC(V2X-DSC:基于分布式源编码指导通信的多智能体协作感知)[论文] [

代码] - V2X-M2C(V2X-M2C:两种连接方式的高效多模块协作感知)[论文] [

代码] - V2X-PC(V2X-PC:基于点簇的车到万物协作感知)[论文] [

代码] - V2X-REALM(V2X-REALM:基于视觉-语言模型的稳健端到端协作式自动驾驶,具备自适应长尾建模能力)[论文] [

代码] - V2X-RECT(V2X-RECT:通过冗余交互过滤与跟踪误差校正实现高效的V2X轨迹预测框架)[论文] [

代码] - V2X-ReaLO(V2X-ReaLO:一个开放的在线框架与数据集,用于现实中的协作感知)[论文] [

代码] - V2X-UniPool(V2X-UniPool:统一多模态感知与知识推理以支持自动驾驶)[论文] [代码]

- V2X-VLM(V2X-VLM:通过大型视觉-语言模型实现端到端V2X协作式自动驾驶)[论文] [

代码]

CVPR 2026

- CATNet(CATNet:用于协作感知的协同对齐与变换网络)[论文] [

代码] - CodeAlign(异构协作感知中的模态隔离链接)[论文] [代码]

- CoLC(CoLC:基于激光雷达补全的通信高效协作感知)[论文] [代码]

- CoopDiff(CoopDiff:一种受扩散模型引导的抗干扰协作方法)[论文] [

代码] - MVIG(用于自适应对抗性协作感知的互视信息图学习)[论文] [代码]

- WhisperNet(WhisperNet:一种可扩展的带宽高效协作方案)[论文] [

代码]

ICLR 2026

AAAI 2026

- InfoCom(InfoCom:基于信息瓶颈的千字节级通信高效协作感知)[论文] [代码]

- SparseCoop(SparseCoop:基于运动学约束查询的协作感知)[论文] [代码]

- V2VLoc(V2VLoc:通过激光雷达定位实现的鲁棒无GNSS协作感知)[论文] [代码]

ICRA 2026

WACV 2026

CVPR 2025

- CoGMP(用于协作BEV语义分割的生成式地图先验)[论文] [

代码] - CoSDH(CoSDH:基于供需感知与中后期混合的通信高效协作感知)[论文] [代码]

- HeCoFuse(HeCoFuse:基于异构传感器的跨模态互补V2X协作感知)[论文] [代码]

- LangCoop(LangCoop:基于语言的协作驾驶)[论文] [代码]

- PolyInter(一即足够:用于不可变异构协作感知的多态特征解释器)[论文] [代码]

- SparseAlign(SparseAlign:用于协作目标检测的全稀疏框架)[论文] [

代码] - TraF-Align(TraF-Align:面向异步多智能体感知的轨迹感知特征对齐)[论文] [代码]

- V2X-R(V2X-R:基于去噪扩散的3D目标检测用协作激光雷达-4D雷达融合)[论文] [代码]

NeurIPS 2025

ICCV 2025

- CoopTrack(CoopTrack:探索端到端学习以实现高效的协作序列感知)[论文] [代码]

- CoST(CoST:从统一时空视角出发的高效协作感知)[论文] [代码]

- INSTINCT(INSTINCT:基于查询的协作感知的实例级交互架构)[论文] [代码]

- MamV2XCalib(MamV2XCalib:基于V2X的无靶标基础设施相机标定,采用状态空间模型)[论文] [代码]

- SlimComm(SlimComm:基于多普勒引导的稀疏查询,用于带宽高效的3D协作感知)[论文] [代码]

- TurboTrain(TurboTrain:迈向多智能体感知与预测的高效均衡多任务学习)[论文] [代码]

ICLR 2025

- CPPC(点簇:用于通信高效协作感知的紧凑消息单元)[论文&评审] [

代码] - R&B-POP(从他人的预测中学习3D感知)[论文&评审] [代码]

- STAMP(STAMP:可扩展的任务与模型无关的协作感知)[论文&评审] [代码]

AAAI 2025

- CoPEFT(CoPEFT:基于参数高效微调的多智能体协同感知快速适应框架)[论文] [代码]

- CP-Guard(CP-Guard:协同鸟瞰感知中的恶意智能体检测与防御)[论文] [

代码] - DSRC(DSRC:学习抗损坏的密度无关语义感知协同表示)[论文] [代码]

- UniV2X(通过V2X协作实现端到端自动驾驶)[论文] [代码]

MM 2025

- How2Compress(How2Compress:通过自适应粒度视频压缩实现可扩展且高效的边缘视频分析)[论文] [代码]

- Selective Shift(Selective Shift:迈向多智能体协同感知中的个性化领域适应)[

论文] [代码]

ICRA 2025

- CoDynTrust(CoDynTrust:基于动态特征信任模量的鲁棒异步协同感知)[论文] [代码]

- CoopDETR(CoopDETR:一种基于对象查询的统一3D目标检测协同感知框架)[论文] [

代码] - Co-MTP(Co-MTP:面向自动驾驶的多时间尺度融合协同轨迹预测框架)[论文] [代码]

- Direct-CP(Direct-CP:通过主动注意力实现联网自动驾驶车辆的定向协同感知)[论文] [

代码] - V2X-DG(V2X-DG:面向车联网协同感知的领域泛化)[论文] [

代码]

IROS 2025

- CooPre(CooPre:面向V2X协同感知的协同预训练)[论文] [代码]

- CoPAD(CoPAD:V2X场景下基于锚点导向解码器的多源轨迹融合与协同轨迹预测)[论文] [

代码] - CRUISE(CRUISE:利用高斯泼溅技术在V2X场景中进行协同重建与编辑)[论文] [代码]

CVPR 2024

- CoHFF(联网自动驾驶车辆中基于混合特征融合的协同语义占用预测)[论文] [

代码] - CoopDet3D(TUMTraf V2X协同感知数据集)[论文] [代码]

- CodeFilling(通过码本信息填充实现通信高效的协同感知)[论文] [代码]

- ERMVP(ERMVP:在复杂环境中实现通信高效且协作鲁棒的多车感知)[论文] [代码]

- MRCNet(基于运动感知鲁棒通信网络的多智能体协同感知)[论文] [代码]

NeurIPS 2024

ECCV 2024

ICLR 2024

AAAI 2024

- CMiMC(什么构成了良好的协同视图?基于对比互信息最大化的多智能体感知)[论文] [代码]

- DI-V2X(DI-V2X:学习车路协同3D目标检测的领域不变表示)[论文] [代码]

- V2XFormer(DeepAccident:面向V2X自动驾驶的运动与事故预测基准)[论文] [代码]

WACV 2024

ICRA 2024

CVPR 2023

- {相关} BEVHeight(BEVHeight:基于视觉的路边3D目标检测鲁棒框架)[论文] [代码]

- CoCa3D(协作助力摄像头在3D目标检测中超越LiDAR)[论文] [代码]

- FF-Tracking(V2X-Seq:面向车路协同感知与预测的大规模序列数据集)[论文] [代码]

NeurIPS 2023

- CoBEVFlow(基于鸟瞰图流的鲁棒异步协同3D检测)[论文&评审] [代码]

- FFNet(基于流的特征融合用于车路协同3D目标检测)[论文&评审] [代码]

- How2comm(How2comm:通信高效且协作实用的多智能体感知)[论文&评审] [代码]

ICCV 2023

- CORE(CORE:面向多智能体感知的协同重建)[论文] [代码]

- HM-ViT(HM-ViT:基于视觉Transformer的异构模态车车协同感知)[论文] [代码]

- ROBOSAC(Among Us:通过共识实现对抗性鲁棒的协同感知)[论文] [代码]

- SCOPE(面向多智能体协同感知的时空域感知)[论文] [代码]

- TransIFF(TransIFF:基于Transformer的车路协同3D检测实例级特征融合框架)[论文] [

代码] - UMC(UMC:统一的带宽高效多分辨率协同感知框架)[论文] [代码]

ICLR 2023

CoRL 2023

MM 2023

- DUSA(DUSA:解耦的无监督Sim2Real适应用于车联网协同感知)[论文] [代码]

- FeaCo(FeaCo:在噪声姿态条件下实现鲁棒的特征级一致性)[论文] [代码]

- What2comm(What2comm:通过特征解耦实现通信高效的协同感知)[论文] [

代码]

WACV 2023

ICRA 2023

- CoAlign(在姿态误差存在时的鲁棒协同3D目标检测)[论文] [代码]

- {相关} DMGM(用于协同感知中对应关系识别的深度掩码图匹配)[论文] [代码]

- Double-M Quantification(面向自动驾驶的协同检测不确定性量化)[论文] [代码]

- MAMP(模型无关的多智能体感知框架)[论文] [代码]

- MATE(通过多智能体轨迹交换进行通信关键型规划)[论文] [

代码] - MPDA(弥合多智能体感知的领域差距)[论文] [代码]

- WNT(我们需要谈谈:识别并克服自动驾驶中的通信关键场景)[论文] [

代码]

CVPR 2022

- Coopernaut(COOPERNAUT:面向联网车辆的协同感知端到端驾驶)[论文] [代码]

- {相关} LAV(向所有车辆学习)[论文] [代码]

- TCLF(DAIR-V2X:用于车路协同3D目标检测的大规模数据集)[论文] [代码]

NeurIPS 2022

ECCV 2022

CoRL 2022

IJCAI 2022

- IA-RCP(抗通信中断的鲁棒协同感知)[论文] [

代码]

MM 2022

- CRCNet(面向多智能体感知的互补增强与冗余最小化协作网络)[论文] [

代码]

ICRA 2022

NeurIPS 2021

ICCV 2021

- Adversarial V2V(多智能体通信中的对抗攻击)[论文] [

代码]

IROS 2021

CVPR 2020

ECCV 2020

CoRL 2020

ICRA 2020

:bookmark:数据集与仿真平台

注:{Real}表示传感器数据来源于真实世界采集,而非仿真。

精选预印本

- Adver-City(Adver-City:面向恶劣天气下协作感知的开源多模态数据集)[论文] [代码] [项目]

- AirV2X(AirV2X:空地车辆到万物协同统一)[论文] [代码] [项目]

- CATS-V2V(CATS-V2V:包含复杂恶劣交通场景的真实车车协同感知数据集)[论文] [

代码] [项目] - {Real} CoInfra(CoInfra:恶劣天气下的大规模协同基础设施感知系统及数据集)[论文] [代码] [

项目] - CP-GuardBench(CP-Guard+:协作感知中恶意代理检测与防御的新范式)[论文&评审] [

代码] [项目] - Griffin(Griffin:空地协同探测与跟踪数据集及基准测试)[论文] [代码] [项目]

- {Real} InScope(InScope:面向开放交通场景的新型真实3D基础设施侧协作感知数据集)[论文] [代码] [

项目] - MobileVerse(MobiVerse:利用混合轻量级领域专用生成器和大语言模型扩展城市出行仿真)[论文] [代码] [

项目] - Multi-V2X(Multi-V2X:面向协作感知的大规模多模态、多渗透率数据集)[论文] [代码] [

项目] - M3CAD(M3CAD:迈向通用协作自动驾驶基准测试)[论文] [代码] [项目]

- OPV2V-N(RCDN:基于动态特征的3D神经建模,实现鲁棒的相机不敏感协作感知)[论文] [

代码] [项目] - TalkingVehiclesGym(通过自我博弈实现协作自动驾驶的自然语言通信)[论文] [代码] [项目]

- TruckV2X(TruckV2X:以卡车为中心的感知数据集)[论文] [

代码] [项目] - {Real} UrbanV2X(UrbanV2X:面向城市区域协同导航的多传感器车路协同数据集)[论文] [代码] [项目]

- V2V-QA(V2V-LLM:基于多模态大语言模型的车车协同自动驾驶)[论文] [代码] [项目]

- {Real} V2XPnP-Seq(V2XPnP:面向多智能体感知与预测的车到万物时空融合)[论文] [代码] [项目]

- {Real} V2X-Radar(V2X-Radar:包含4D雷达的多模态协同感知数据集)[论文] [代码] [项目]

- {Real} V2X-Real(V2X-Real:面向车到万物协同感知的大规模数据集)[论文] [

代码] [项目] - {Real} V2X-ReaLO(V2X-ReaLO:现实环境中协作感知的开放式在线框架与数据集)[论文] [

代码] [项目] - WHALES(WHALES:用于提升自动驾驶中协作效率的多智能体调度数据集)[论文] [代码] [项目]

CVPR 2025

- Mono3DVLT-V2X(Mono3DVLT:基于单目视频的三维视觉语言跟踪)[论文] [

代码] [项目] - RCP-Bench(RCP-Bench:针对多种干扰下的协同感知鲁棒性基准测试)[论文] [代码] [

项目] - V2X-R(V2X-R:基于去噪扩散的协作式激光雷达-4D雷达融合3D目标检测)[论文] [代码] [

项目]

NeurIPS 2025

- {真实} AGC-Drive(AGC-Drive:面向驾驶场景中空地协同的真实世界大规模数据集)[论文&评审] [代码] [项目]

- UrbanIng-V2X(UrbanIng-V2X:跨多个交叉口的大规模多车辆、多基础设施协同感知数据集)[论文&评审] [代码] [项目]

ICCV 2025

- CoPe-R(SlimComm:基于多普勒引导的稀疏查询,用于带宽高效的三维协同感知)[论文] [代码] [

项目] - {真实} Mixed Signals(Mixed Signals:面向异构激光雷达V2X协同的多样化点云数据集)[论文] [代码] [项目]

CVPR 2024

- {真实} HoloVIC(HoloVIC:多传感器全息交叉口与车路协同的大规模数据集及基准测试)[论文] [

代码] [项目] - {真实} Open Mars Dataset(多智能体、多路径、多模态自动驾驶:Open MARS数据集)[代码] [论文] [项目]

- {真实} RCooper(RCooper:面向路边协同感知的真实世界大规模数据集)[论文] [代码] [项目]

- {真实} TUMTraf-V2X(TUMTraf V2X协同感知数据集)[论文] [代码] [项目]

NeurIPS 2024

ECCV 2024

- {真实} H-V2X(H-V2X:面向BEV感知的大规模高速公路数据集)[论文] [

代码] [项目]

ICLR 2024

AAAI 2024

CVPR 2023

- CoPerception-UAV+(协作助力摄像头在3D检测中超越激光雷达)[论文] [代码] [项目]

- OPV2V+(协作助力摄像头在3D检测中超越激光雷达)[论文] [代码] [项目]

- {真实} V2V4Real(V2V4Real:面向车车协同感知的大规模真实世界数据集)[论文] [代码] [项目]

- {真实} DAIR-V2X-Seq(V2X-Seq:面向车路协同感知与预测的大规模序列数据集)[论文] [代码] [项目]

NeurIPS 2023

- IRV2V(通过鸟瞰视图流实现鲁棒的异步协同3D检测)[论文&评审] [

代码] [项目]

ICCV 2023

- Roadside-Opt(优化自动驾驶中路边激光雷达的部署位置)[论文] [

代码] [项目]

ICRA 2023

- {真实} DAIR-V2X-C Complemented(在姿态误差存在时实现鲁棒的协同3D物体检测)[论文] [代码] [项目]

- RLS(利用真实的激光雷达仿真库分析基础设施激光雷达的部署)[论文] [代码] [

项目] - V2XP-ASG(V2XP-ASG:为车到万物感知生成对抗场景)[论文] [代码] [

项目]

CVPR 2022

- AutoCastSim(COOPERNAUT:面向联网车辆的端到端协同感知自动驾驶)[论文] [代码] [项目]

- {真实} DAIR-V2X(DAIR-V2X:面向车路协同3D目标检测的大规模数据集)[论文] [代码] [项目]

NeurIPS 2022

ECCV 2022

ICRA 2022

ACCV 2022

ICCV 2021

CoRL 2017

常见问题

相似工具推荐

openclaw

OpenClaw 是一款专为个人打造的本地化 AI 助手,旨在让你在自己的设备上拥有完全可控的智能伙伴。它打破了传统 AI 助手局限于特定网页或应用的束缚,能够直接接入你日常使用的各类通讯渠道,包括微信、WhatsApp、Telegram、Discord、iMessage 等数十种平台。无论你在哪个聊天软件中发送消息,OpenClaw 都能即时响应,甚至支持在 macOS、iOS 和 Android 设备上进行语音交互,并提供实时的画布渲染功能供你操控。 这款工具主要解决了用户对数据隐私、响应速度以及“始终在线”体验的需求。通过将 AI 部署在本地,用户无需依赖云端服务即可享受快速、私密的智能辅助,真正实现了“你的数据,你做主”。其独特的技术亮点在于强大的网关架构,将控制平面与核心助手分离,确保跨平台通信的流畅性与扩展性。 OpenClaw 非常适合希望构建个性化工作流的技术爱好者、开发者,以及注重隐私保护且不愿被单一生态绑定的普通用户。只要具备基础的终端操作能力(支持 macOS、Linux 及 Windows WSL2),即可通过简单的命令行引导完成部署。如果你渴望拥有一个懂你

stable-diffusion-webui

stable-diffusion-webui 是一个基于 Gradio 构建的网页版操作界面,旨在让用户能够轻松地在本地运行和使用强大的 Stable Diffusion 图像生成模型。它解决了原始模型依赖命令行、操作门槛高且功能分散的痛点,将复杂的 AI 绘图流程整合进一个直观易用的图形化平台。 无论是希望快速上手的普通创作者、需要精细控制画面细节的设计师,还是想要深入探索模型潜力的开发者与研究人员,都能从中获益。其核心亮点在于极高的功能丰富度:不仅支持文生图、图生图、局部重绘(Inpainting)和外绘(Outpainting)等基础模式,还独创了注意力机制调整、提示词矩阵、负向提示词以及“高清修复”等高级功能。此外,它内置了 GFPGAN 和 CodeFormer 等人脸修复工具,支持多种神经网络放大算法,并允许用户通过插件系统无限扩展能力。即使是显存有限的设备,stable-diffusion-webui 也提供了相应的优化选项,让高质量的 AI 艺术创作变得触手可及。

everything-claude-code

everything-claude-code 是一套专为 AI 编程助手(如 Claude Code、Codex、Cursor 等)打造的高性能优化系统。它不仅仅是一组配置文件,而是一个经过长期实战打磨的完整框架,旨在解决 AI 代理在实际开发中面临的效率低下、记忆丢失、安全隐患及缺乏持续学习能力等核心痛点。 通过引入技能模块化、直觉增强、记忆持久化机制以及内置的安全扫描功能,everything-claude-code 能显著提升 AI 在复杂任务中的表现,帮助开发者构建更稳定、更智能的生产级 AI 代理。其独特的“研究优先”开发理念和针对 Token 消耗的优化策略,使得模型响应更快、成本更低,同时有效防御潜在的攻击向量。 这套工具特别适合软件开发者、AI 研究人员以及希望深度定制 AI 工作流的技术团队使用。无论您是在构建大型代码库,还是需要 AI 协助进行安全审计与自动化测试,everything-claude-code 都能提供强大的底层支持。作为一个曾荣获 Anthropic 黑客大奖的开源项目,它融合了多语言支持与丰富的实战钩子(hooks),让 AI 真正成长为懂上

ComfyUI

ComfyUI 是一款功能强大且高度模块化的视觉 AI 引擎,专为设计和执行复杂的 Stable Diffusion 图像生成流程而打造。它摒弃了传统的代码编写模式,采用直观的节点式流程图界面,让用户通过连接不同的功能模块即可构建个性化的生成管线。 这一设计巧妙解决了高级 AI 绘图工作流配置复杂、灵活性不足的痛点。用户无需具备编程背景,也能自由组合模型、调整参数并实时预览效果,轻松实现从基础文生图到多步骤高清修复等各类复杂任务。ComfyUI 拥有极佳的兼容性,不仅支持 Windows、macOS 和 Linux 全平台,还广泛适配 NVIDIA、AMD、Intel 及苹果 Silicon 等多种硬件架构,并率先支持 SDXL、Flux、SD3 等前沿模型。 无论是希望深入探索算法潜力的研究人员和开发者,还是追求极致创作自由度的设计师与资深 AI 绘画爱好者,ComfyUI 都能提供强大的支持。其独特的模块化架构允许社区不断扩展新功能,使其成为当前最灵活、生态最丰富的开源扩散模型工具之一,帮助用户将创意高效转化为现实。

gemini-cli

gemini-cli 是一款由谷歌推出的开源 AI 命令行工具,它将强大的 Gemini 大模型能力直接集成到用户的终端环境中。对于习惯在命令行工作的开发者而言,它提供了一条从输入提示词到获取模型响应的最短路径,无需切换窗口即可享受智能辅助。 这款工具主要解决了开发过程中频繁上下文切换的痛点,让用户能在熟悉的终端界面内直接完成代码理解、生成、调试以及自动化运维任务。无论是查询大型代码库、根据草图生成应用,还是执行复杂的 Git 操作,gemini-cli 都能通过自然语言指令高效处理。 它特别适合广大软件工程师、DevOps 人员及技术研究人员使用。其核心亮点包括支持高达 100 万 token 的超长上下文窗口,具备出色的逻辑推理能力;内置 Google 搜索、文件操作及 Shell 命令执行等实用工具;更独特的是,它支持 MCP(模型上下文协议),允许用户灵活扩展自定义集成,连接如图像生成等外部能力。此外,个人谷歌账号即可享受免费的额度支持,且项目基于 Apache 2.0 协议完全开源,是提升终端工作效率的理想助手。

LLMs-from-scratch

LLMs-from-scratch 是一个基于 PyTorch 的开源教育项目,旨在引导用户从零开始一步步构建一个类似 ChatGPT 的大型语言模型(LLM)。它不仅是同名技术著作的官方代码库,更提供了一套完整的实践方案,涵盖模型开发、预训练及微调的全过程。 该项目主要解决了大模型领域“黑盒化”的学习痛点。许多开发者虽能调用现成模型,却难以深入理解其内部架构与训练机制。通过亲手编写每一行核心代码,用户能够透彻掌握 Transformer 架构、注意力机制等关键原理,从而真正理解大模型是如何“思考”的。此外,项目还包含了加载大型预训练权重进行微调的代码,帮助用户将理论知识延伸至实际应用。 LLMs-from-scratch 特别适合希望深入底层原理的 AI 开发者、研究人员以及计算机专业的学生。对于不满足于仅使用 API,而是渴望探究模型构建细节的技术人员而言,这是极佳的学习资源。其独特的技术亮点在于“循序渐进”的教学设计:将复杂的系统工程拆解为清晰的步骤,配合详细的图表与示例,让构建一个虽小但功能完备的大模型变得触手可及。无论你是想夯实理论基础,还是为未来研发更大规模的模型做准备