AutoAgents

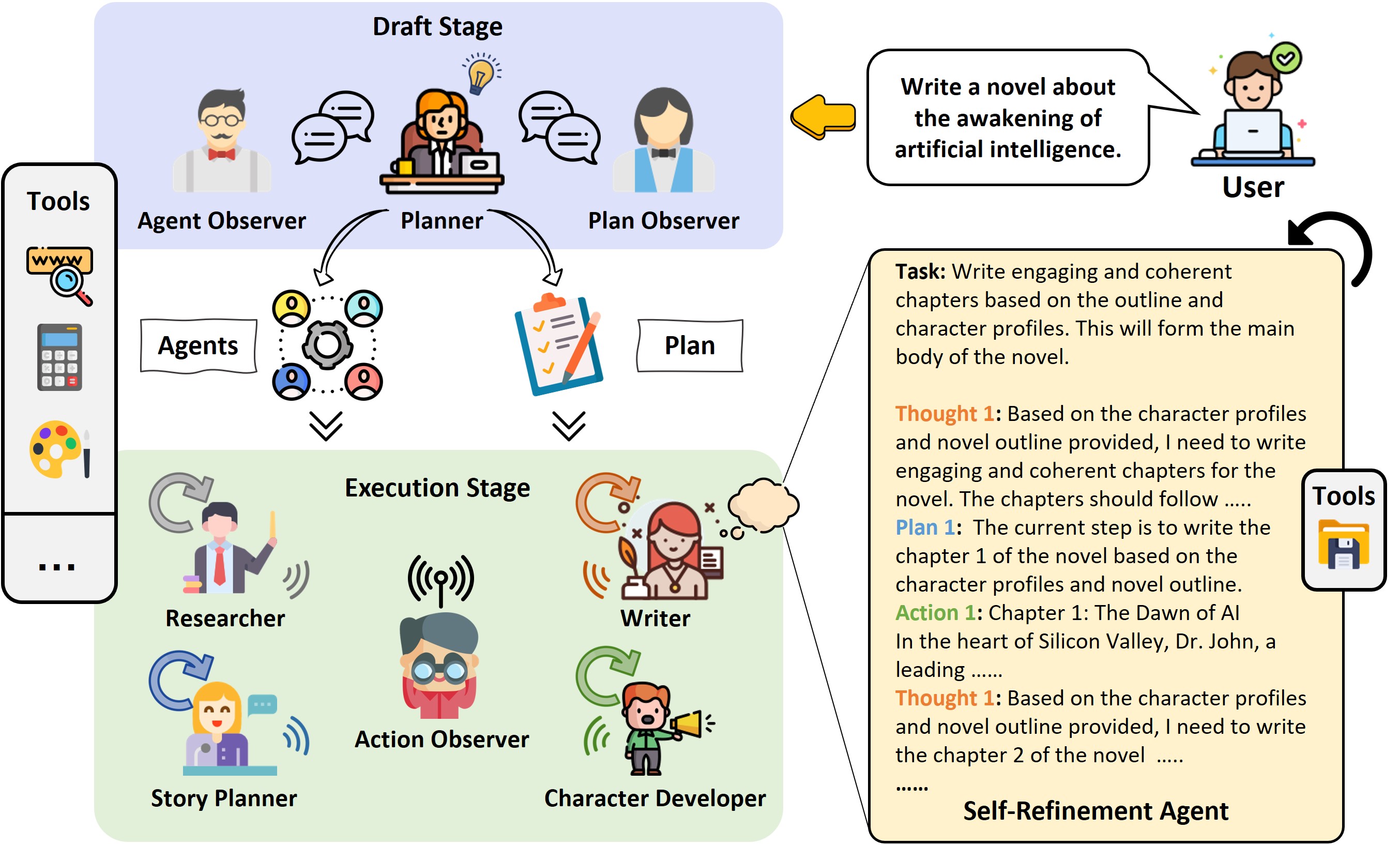

AutoAgents 是一个基于大语言模型(LLM)的开源框架,旨在自动为复杂任务生成多个具备不同专家角色的智能体,并让它们协同工作以达成目标。传统 AI 应用往往依赖人工预设固定流程,难以灵活应对多变且复杂的场景,而 AutoAgents 通过自动化机制解决了这一痛点。它内置了“规划器”来拆解任务并分配专家角色,“观察员”负责实时监控执行过程并进行反思修正,确保多智能体协作的高效与准确。

该工具的独特亮点在于其全自动的角色生成与动态协作能力。用户只需设定最终目标,系统即可自主创建包含特定名称、专长及工具使用能力的专家智能体,并制定详细的执行计划。从谣言核查到游戏策略生成,AutoAgents 展示了其在处理非标准化任务上的强大潜力。

AutoAgents 非常适合 AI 研究人员、开发者以及希望探索多智能体协作模式的技术爱好者使用。研究人员可借此深入探究智能体交互机制,开发者则能快速构建适应复杂逻辑的应用原型。虽然目前主要面向具备一定技术背景的用户,但其模块化设计也为未来降低使用门槛留下了空间。作为一篇入选 IJCAI 2024 的论文成果,AutoAgents 为构建更灵活、自主的 AI 系统提供了极具价值的实验范式。

使用场景

某初创公司的产品团队需要在 24 小时内完成一份关于“生成式 AI 在医疗影像诊断领域”的深度竞品分析报告,涉及技术原理、市场格局及潜在风险。

没有 AutoAgents 时

- 角色切换频繁:产品经理需独自扮演研究员、数据分析师和撰稿人,频繁在不同思维模式间切换,导致逻辑断层和精力分散。

- 信息搜集低效:面对海量英文文献和新闻,人工检索耗时极长,且容易遗漏关键的非中文源头的最新技术动态。

- 缺乏自我纠错:生成的初稿往往存在事实性幻觉或逻辑漏洞,需要人工反复核查验证,迭代周期漫长。

- 协作成本高:若组建多人小组,沟通对齐需求、分配任务及整合不同成员的输出格式,消耗了大量协调时间。

使用 AutoAgents 后

- 自动组建专家团队:AutoAgents 根据任务自动规划并生成“医疗 AI 专家”、“市场分析师”和“事实核查员”等多个专属智能体,各司其职并行工作。

- 智能化全流程执行:内置的搜索工具让智能体自主抓取全球最新论文与资讯,无需人工干预即可完成从信息收集到清洗的全过程。

- 内置反思机制:观察器(Observers)实时监控执行过程,自动发现并修正逻辑矛盾或数据错误,确保输出内容的准确性与严谨性。

- 无缝协同产出:多个智能体像真实团队一样协作,自动整合各自的专业见解,直接输出一份结构完整、数据详实的高质量报告。

AutoAgents 通过将单一指令转化为多角色协同的自动化工作流,将原本需要数天的人工调研压缩至小时级,极大提升了复杂任务的解决效率与质量。

运行环境要求

- Linux

- macOS

- Windows

未说明 (基于 LLM API 调用,本地无需 GPU)

未说明

快速开始

AutoAgents:自动代理生成框架

为GPT生成不同角色,形成协作实体以完成复杂任务。

AutoAgents是一个基于LLM的自动代理生成实验的开源应用。该程序由LLM驱动,能够自主生成多代理,以实现您设定的任何目标。

:boom: 更新

- 2024年4月16日:我们非常激动地宣布,我们的论文已被IJCAI 2024接收。更多更新即将发布!

- 2023年9月31日:📝 我们很高兴分享与本仓库相关的论文AutoAgents:自动代理生成框架。

- 2023年8月30日:🚀 新增自定义代理库AgentBank,允许您添加自定义代理。

🚀 功能

- 规划器:根据问题确定需要添加的专家角色及具体的执行计划。

- 工具:可使用的工具集合,目前仅兼容搜索工具。

- 观察者:负责反思规划器以及执行过程中的结果是否合理,目前包括对代理、计划和行动的反思检查。

- 代理:由规划器生成的专家角色代理,包含名称、专长、使用的工具以及LLM增强信息。

- 计划:执行计划由生成的专家角色组成,每一步执行计划都至少对应一个专家角色代理。

- 行动:执行计划中专家角色的具体动作,例如调用工具或输出结果。

演示

在线演示:

视频演示:

- 谣言验证

- 贪吃蛇游戏

安装与使用

安装

git clone https://github.com/LinkSoul-AI/AutoAgents

cd AutoAgents

python setup.py install

配置

- 可通过环境变量设置密钥,或将其作为CLI参数传递。不再需要YAML配置文件。

- 必需密钥:

OPENAI_API_KEY(或LLM_API_KEY)和SERPAPI_API_KEY。 - 可选设置:

OPENAI_API_MODEL(默认:gpt-4o)OPENAI_API_BASE、OPENAI_API_TYPE、OPENAI_API_VERSION、DEPLOYMENT_ID(Azure风格的OpenAI)GLOBAL_PROXY或OPENAI_PROXY用于HTTP(S)代理;或使用--proxy标志- 搜索引擎选择通过

SEARCH_ENGINE进行(默认:serpapi_google)。其他密钥:SERPER_API_KEY、GOOGLE_API_KEY、GOOGLE_CSE_ID

示例

# 最低要求

export OPENAI_API_KEY="sk-..."

export SERPAPI_API_KEY="your-serpapi-key"

# 可选:更改模型并设置代理

export OPENAI_API_MODEL="gpt-4o-mini"

export GLOBAL_PROXY="http://127.0.0.1:7890"

# 可选:Azure风格的OpenAI

export OPENAI_API_TYPE="azure"

export OPENAI_API_BASE="https://<your-azure-endpoint>/openai/deployments"

export OPENAI_API_VERSION="2024-02-01"

export DEPLOYMENT_ID="<your-deployment>"

使用

- 命令行模式:

# 使用环境变量(会提示缺少的密钥)

python main.py --mode commandline --idea "LK-99真的是室温超导材料吗?"

# 或者显式传递密钥

python main.py --mode commandline \

--llm_api_key "$OPENAI_API_KEY" \

--serpapi_key "$SERPAPI_API_KEY" \

--idea "LK-99真的是室温超导材料吗?"

# 可选HTTP代理

python main.py --mode commandline --proxy "http://127.0.0.1:7890" --idea "..."

- WebSocket服务模式:

python main.py --mode service --host 127.0.0.1 --port 9000

服务会在ws://<host>:<port>上开放WebSocket端点。您可以使用frontend/app/demo.html下的演示UI,只需用任意静态HTTP服务器提供frontend/app文件夹即可。

Docker

- 构建Docker镜像:

IMAGE="linksoul.ai/autoagents"

VERSION=1.0

docker build -f docker/Dockerfile -t "${IMAGE}:${VERSION}" .

- 启动Docker容器:

docker run -it --rm -p 7860:7860 "${IMAGE}:${VERSION}"

- 在浏览器中打开http://127.0.0.1:7860。

贡献

AutoAgents 致力于为大型语言模型打造前沿的自动化多智能体环境。我们诚挚邀请充满热情的合作者加入我们,共同开启这段激动人心的创新之旅。

本项目得以存在,离不开所有贡献者的支持:

您如何参与贡献?

问题报告与拉取请求:在使用 AutoAgents 时遇到困难?欢迎用英文提交问题。同时,您也可以主动解决这些问题。只需申请将该问题分配给您,完成后提交包含解决方案的拉取请求(PR)即可。

软件开发贡献:作为工程师,您的技能可以显著提升 AutoAgents 的质量。我们一直在寻找优秀的开发者,对框架进行优化、改进和扩展,丰富功能并开发新模块。

文档与教程内容创作:如果您擅长写作,欢迎加入我们,完善文档并编写教程或博客文章。您的贡献将使 AutoAgents 更加易用,吸引更多不同背景的用户。

创新应用探索:对多智能体系统充满兴趣吗?如果您希望尝试使用 AutoAgents,我们非常乐意支持您的探索,并期待看到您的创新成果。

用户反馈与战略建议:我们高度重视用户的反馈。请积极参与 AutoAgents 的使用,并分享您的意见。您的见解对我们持续改进至关重要,有助于确保框架的卓越性能和实用性。

联系方式

如您对本项目有任何疑问或反馈,请随时联系我们。我们非常感谢您的宝贵建议!

- 邮箱:gy.chen@foxmail.com, ymshi@linksoul.ai

- GitHub Issues:如有更技术性的问题,您也可以在我们的 GitHub 仓库 中创建新问题。

我们将在 2–3 个工作日内回复所有问题。

许可证

引用

如果您觉得我们的工作和这个仓库很有帮助,请考虑给我们一颗星 :star: 并引用一下 :beer::

@inproceedings{ijcai2024p3,

title = {{AutoAgents}: A Framework for Automatic Agent Generation},

author = {Chen, Guangyao and Dong, Siwei and Shu, Yu and Zhang, Ge and Sesay, Jaward and Karlsson, Börje F. and Fu, Jie and Shi, Yemin},

booktitle = {Proceedings of the Thirty-Third International Joint Conference on

Artificial Intelligence, {IJCAI-24}},

pages = {22--30},

year = {2024},

month = {8},

note = {Main Track},

doi = {10.24963/ijcai.2024/3},

url = {https://doi.org/10.24963/ijcai.2024/3},

}

致谢

本代码库中的 system、action_bank 和 role_bank 均基于 MetaGPT 构建。

框架中的图标由 Darius Dan、Freepik、kmg design、Flat Icons 和 Vectorslab 在 FlatIcon 上制作。

常见问题

相似工具推荐

openclaw

OpenClaw 是一款专为个人打造的本地化 AI 助手,旨在让你在自己的设备上拥有完全可控的智能伙伴。它打破了传统 AI 助手局限于特定网页或应用的束缚,能够直接接入你日常使用的各类通讯渠道,包括微信、WhatsApp、Telegram、Discord、iMessage 等数十种平台。无论你在哪个聊天软件中发送消息,OpenClaw 都能即时响应,甚至支持在 macOS、iOS 和 Android 设备上进行语音交互,并提供实时的画布渲染功能供你操控。 这款工具主要解决了用户对数据隐私、响应速度以及“始终在线”体验的需求。通过将 AI 部署在本地,用户无需依赖云端服务即可享受快速、私密的智能辅助,真正实现了“你的数据,你做主”。其独特的技术亮点在于强大的网关架构,将控制平面与核心助手分离,确保跨平台通信的流畅性与扩展性。 OpenClaw 非常适合希望构建个性化工作流的技术爱好者、开发者,以及注重隐私保护且不愿被单一生态绑定的普通用户。只要具备基础的终端操作能力(支持 macOS、Linux 及 Windows WSL2),即可通过简单的命令行引导完成部署。如果你渴望拥有一个懂你

stable-diffusion-webui

stable-diffusion-webui 是一个基于 Gradio 构建的网页版操作界面,旨在让用户能够轻松地在本地运行和使用强大的 Stable Diffusion 图像生成模型。它解决了原始模型依赖命令行、操作门槛高且功能分散的痛点,将复杂的 AI 绘图流程整合进一个直观易用的图形化平台。 无论是希望快速上手的普通创作者、需要精细控制画面细节的设计师,还是想要深入探索模型潜力的开发者与研究人员,都能从中获益。其核心亮点在于极高的功能丰富度:不仅支持文生图、图生图、局部重绘(Inpainting)和外绘(Outpainting)等基础模式,还独创了注意力机制调整、提示词矩阵、负向提示词以及“高清修复”等高级功能。此外,它内置了 GFPGAN 和 CodeFormer 等人脸修复工具,支持多种神经网络放大算法,并允许用户通过插件系统无限扩展能力。即使是显存有限的设备,stable-diffusion-webui 也提供了相应的优化选项,让高质量的 AI 艺术创作变得触手可及。

everything-claude-code

everything-claude-code 是一套专为 AI 编程助手(如 Claude Code、Codex、Cursor 等)打造的高性能优化系统。它不仅仅是一组配置文件,而是一个经过长期实战打磨的完整框架,旨在解决 AI 代理在实际开发中面临的效率低下、记忆丢失、安全隐患及缺乏持续学习能力等核心痛点。 通过引入技能模块化、直觉增强、记忆持久化机制以及内置的安全扫描功能,everything-claude-code 能显著提升 AI 在复杂任务中的表现,帮助开发者构建更稳定、更智能的生产级 AI 代理。其独特的“研究优先”开发理念和针对 Token 消耗的优化策略,使得模型响应更快、成本更低,同时有效防御潜在的攻击向量。 这套工具特别适合软件开发者、AI 研究人员以及希望深度定制 AI 工作流的技术团队使用。无论您是在构建大型代码库,还是需要 AI 协助进行安全审计与自动化测试,everything-claude-code 都能提供强大的底层支持。作为一个曾荣获 Anthropic 黑客大奖的开源项目,它融合了多语言支持与丰富的实战钩子(hooks),让 AI 真正成长为懂上

ComfyUI

ComfyUI 是一款功能强大且高度模块化的视觉 AI 引擎,专为设计和执行复杂的 Stable Diffusion 图像生成流程而打造。它摒弃了传统的代码编写模式,采用直观的节点式流程图界面,让用户通过连接不同的功能模块即可构建个性化的生成管线。 这一设计巧妙解决了高级 AI 绘图工作流配置复杂、灵活性不足的痛点。用户无需具备编程背景,也能自由组合模型、调整参数并实时预览效果,轻松实现从基础文生图到多步骤高清修复等各类复杂任务。ComfyUI 拥有极佳的兼容性,不仅支持 Windows、macOS 和 Linux 全平台,还广泛适配 NVIDIA、AMD、Intel 及苹果 Silicon 等多种硬件架构,并率先支持 SDXL、Flux、SD3 等前沿模型。 无论是希望深入探索算法潜力的研究人员和开发者,还是追求极致创作自由度的设计师与资深 AI 绘画爱好者,ComfyUI 都能提供强大的支持。其独特的模块化架构允许社区不断扩展新功能,使其成为当前最灵活、生态最丰富的开源扩散模型工具之一,帮助用户将创意高效转化为现实。

gemini-cli

gemini-cli 是一款由谷歌推出的开源 AI 命令行工具,它将强大的 Gemini 大模型能力直接集成到用户的终端环境中。对于习惯在命令行工作的开发者而言,它提供了一条从输入提示词到获取模型响应的最短路径,无需切换窗口即可享受智能辅助。 这款工具主要解决了开发过程中频繁上下文切换的痛点,让用户能在熟悉的终端界面内直接完成代码理解、生成、调试以及自动化运维任务。无论是查询大型代码库、根据草图生成应用,还是执行复杂的 Git 操作,gemini-cli 都能通过自然语言指令高效处理。 它特别适合广大软件工程师、DevOps 人员及技术研究人员使用。其核心亮点包括支持高达 100 万 token 的超长上下文窗口,具备出色的逻辑推理能力;内置 Google 搜索、文件操作及 Shell 命令执行等实用工具;更独特的是,它支持 MCP(模型上下文协议),允许用户灵活扩展自定义集成,连接如图像生成等外部能力。此外,个人谷歌账号即可享受免费的额度支持,且项目基于 Apache 2.0 协议完全开源,是提升终端工作效率的理想助手。

LLMs-from-scratch

LLMs-from-scratch 是一个基于 PyTorch 的开源教育项目,旨在引导用户从零开始一步步构建一个类似 ChatGPT 的大型语言模型(LLM)。它不仅是同名技术著作的官方代码库,更提供了一套完整的实践方案,涵盖模型开发、预训练及微调的全过程。 该项目主要解决了大模型领域“黑盒化”的学习痛点。许多开发者虽能调用现成模型,却难以深入理解其内部架构与训练机制。通过亲手编写每一行核心代码,用户能够透彻掌握 Transformer 架构、注意力机制等关键原理,从而真正理解大模型是如何“思考”的。此外,项目还包含了加载大型预训练权重进行微调的代码,帮助用户将理论知识延伸至实际应用。 LLMs-from-scratch 特别适合希望深入底层原理的 AI 开发者、研究人员以及计算机专业的学生。对于不满足于仅使用 API,而是渴望探究模型构建细节的技术人员而言,这是极佳的学习资源。其独特的技术亮点在于“循序渐进”的教学设计:将复杂的系统工程拆解为清晰的步骤,配合详细的图表与示例,让构建一个虽小但功能完备的大模型变得触手可及。无论你是想夯实理论基础,还是为未来研发更大规模的模型做准备