skills

skills 是由 GudaStudio 开发的一套 Agent Skills 集合,旨在打破单一 AI 模型的能力边界。它基于 Anthropic 推出的模块化扩展机制,让 Claude Code 能够按需加载专业技能,从而实现与 OpenAI Codex、Google Gemini 等其他顶尖 AI 模型的无缝协作。

在实际开发中,开发者往往受限于特定模型的专长或上下文窗口。skills 解决了这一痛点,允许用户将编码任务灵活委托给更擅长的模型:例如调用 Codex 进行快速原型开发,或借助 Gemini 执行代码审查与调试。这种“强强联合”的模式,让 Claude 变成了协调多模型工作的超级指挥官,显著提升了复杂工程任务的解决效率。

该工具主要面向软件开发者、技术研究人员及 AI 应用构建者。只要熟悉命令行操作并拥有相应的 CLI 工具(如 Codex CLI 或 Gemini CLI),即可轻松上手。其独特的技术亮点在于提供了一键安装脚本,支持在 Linux、macOS 和 Windows 平台上灵活选择安装范围(用户级或项目级),并能自动管理技能加载路径。通过简单的配置,用户就能构建出一个融合多家之长的高效智能开发工作流。

使用场景

某全栈开发者正利用 Claude Code 重构一个遗留系统,需要同时验证核心算法在 OpenAI Codex 和 Google Gemini 不同模型下的运行表现与代码风格差异。

没有 skills 时

- 手动切换上下文繁琐:开发者需反复退出当前会话,分别启动 Codex CLI 和 Gemini CLI 终端,手动复制粘贴代码片段进行多次测试。

- 协作流程断裂:Claude 无法直接调用外部模型能力,导致“分析 - 执行 - 对比”的工作流被割裂,严重依赖人工中转信息。

- 环境配置重复:每次尝试新模型协作都需要重新编写提示词(Prompt)来定义交互规则,极易出现指令不一致导致的输出偏差。

- 调试效率低下:当发现某模型生成的代码有 Bug 时,难以快速将错误上下文同步给另一模型进行交叉验证,排查耗时倍增。

使用 skills 后

- 无缝多模型协同:安装

collaborating-with-codex和collaborating-with-gemini后,Claude 可直接在单次对话中按需委托任务给指定模型,无需切换终端。 - 工作流自动化闭环:开发者只需下达“请用 Codex 实现该模块并用 Gemini 审查”的指令,skills 自动处理模型间的数据路由与结果回传。

- 标准化能力加载:通过一键脚本安装预置技能包,统一了不同模型间的交互协议,确保每次调用的提示词逻辑一致且专业。

- 即时交叉验证:遇到代码疑点时,Claude 能立即调用另一模型进行二次确认或重构建议,将原本数小时的对比测试压缩至分钟级。

skills 通过模块化扩展机制,将 Claude 从单一对话者升级为能够灵活调度多模型资源的智能协作中枢,极大提升了复杂开发任务的执行效率。

运行环境要求

- Linux

- macOS

- Windows

未说明

未说明

快速开始

一、项目简介

Agent Skills 是 Anthropic 推出的模块化能力扩展机制,让 LLM 能够按需加载专业领域知识与工作流。本仓库收录了 GudaStudio 开发的 Agent Skills 集合,实现 Claude 与其他 AI 模型、工具的无缝协作。

展开查看已收录的 Skills

| Skill | 功能描述 | 协作模型 |

|---|---|---|

| collaborating-with-codex | 将编码任务委托给 Codex CLI,用于原型开发、调试和代码审查 | OpenAI Codex |

| collaborating-with-gemini | 将编码任务委托给 Gemini CLI,用于原型开发、调试和代码审查 | Google Gemini |

二、快速开始

0. 前置要求

[!IMPORTANT] 本项目使用于Python运行脚本,并要求版本在3.8以上,开发测试python版本为3.10.

请确保已安装并配置以下工具!

- Claude Code (v2.0.56+)

- Codex CLI (若使用 collaborating-with-codex)

- Gemini CLI (若使用 collaborating-with-gemini)

1. 获取仓库

克隆仓库到任意位置。

git clone --recurse-submodules https://github.com/GuDaStudio/skills

cd skills

本项目提供一键安装脚本,支持灵活选择安装范围和目标位置。

Linux / macOS

查看可用 Skills:

./install.sh --list

方式一:一键安装所有 Skills

# 用户级安装(所有项目生效)

./install.sh --user --all

# 项目级安装(仅当前项目生效,需在项目根目录执行)

./install.sh --project --all

方式二:选择性安装

# 仅安装 collaborating-with-codex

./install.sh --user --skill collaborating-with-codex

# 安装多个指定 Skill

./install.sh --user -s collaborating-with-codex -s collaborating-with-gemini

方式三:自定义安装路径

./install.sh --target /your/custom/path --all

Windows (PowerShell)

查看可用 Skills:

.\install.ps1 -List

方式一:一键安装所有 Skills

# 用户级安装(所有项目生效)

.\install.ps1 -User -All

# 项目级安装(仅当前项目生效,需在项目根目录执行)

.\install.ps1 -Project -All

方式二:选择性安装

# 仅安装 collaborating-with-codex

.\install.ps1 -User -Skill collaborating-with-codex

# 安装多个指定 Skill

.\install.ps1 -User -Skill collaborating-with-codex -Skill collaborating-with-gemini

方式三:自定义安装路径

.\install.ps1 -Target C:\your\custom\path -All

点击查看完整参数说明

| 参数 (Bash) | 参数 (PowerShell) | 简写 | 说明 |

|---|---|---|---|

--user |

-User |

-u |

安装到用户级目录 (~/.claude/skills/) |

--project |

-Project |

-p |

安装到项目级目录 (./.claude/skills/) |

--target <path> |

-Target <path> |

-t |

安装到自定义路径 |

--all |

-All |

-a |

安装所有可用 Skills |

--skill <name> |

-Skill <name> |

-s |

安装指定 Skill(可多次使用) |

--list |

-List |

-l |

列出所有可用 Skills |

--help |

-Help |

-h |

显示帮助信息 |

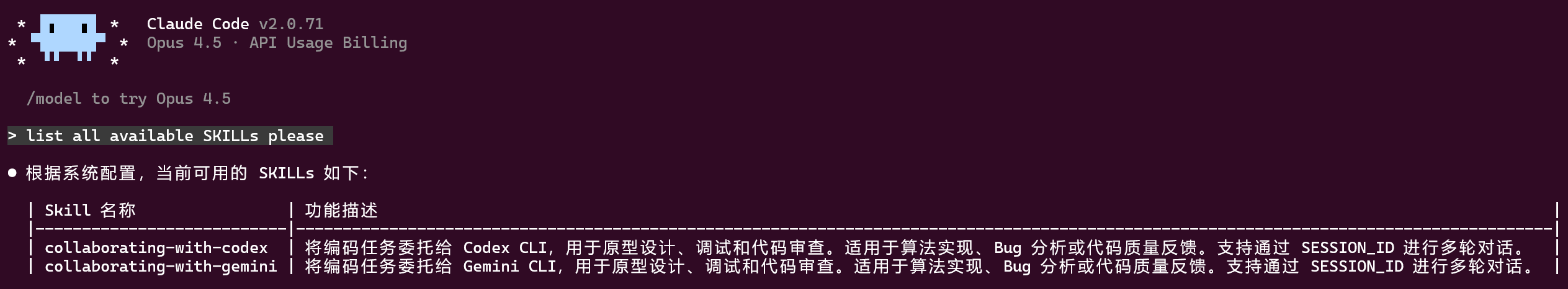

3. 验证安装

启动 Claude Code 后,Skills 会自动加载。可通过以下方式验证:

- 让claude列出所有skill:

list all available SKILLs please - Claude 应能识别并调用

collaborating-with-codex和collaborating-with-gemini

4. (🎊可选,但强烈推荐)配置提示词

为让本SKILLS集合更加Claude Code等CLI,我们强烈推荐您在 ~/.claude/CLAUDE.md中 配置/追加 以下提示词。

[!IMPORTANT] 本全局提示词使用了auggie-mcp,可参考官方安装教程.

# Global Protocols

- 若任务简单,可不进行多模型协作,但**必须**立即中止所有行为,向用户报告不进行协作的具体原因,直到收到用户许可才可进行下一步行动。例如,向用户输出,“这是一个简单xx任务,无需多模型协作。您是否同意此任务下不再进行任何多模型协作过程?我会等待您的回复并严格遵循本次特定协作规则!”

- 严格遵守 **1. Workflow**。跳过任何phase均被视为 **危险级操作**,需要 *立即终止任务* 并向用户 *报告跳过的原因*。例如,向用户输出,“在当前的xx phase,我发现xx,所以下一xx phase的任务实质上已经被xx解决。您是否同意我跳过xx phase?我会等待,直到收到您确定的回复再继续下一phase行动!”

- 除极个别特殊情况外,始终 **强制**与 Codex/Gemini 协作(SKILLs形式`python /path/to/scripts/*.py --cd "/path/to/project" --PROMPT "Analyze..." [OPTIONS]`,**Run in the background**,**不设置** timeout)。

----

## 0. Core Instruction

### 0.1 交互与状态管理

- **语言协议**。与工具/模型交互:**英语**;与用户交互:**中文**。

- **会话连续性**。如果工具返回 `SESSION_ID`,立即存储;在调用工具之前,**思考**:“这是一个后续操作吗?”如果是,在命令后追加 `--SESSION_ID <ID>`;如果内核输出被截断,自动执行继续命令或循环,直到 `Unified Diff`(统一差异)在语法上完整。

### 0.2 异步操作(原子循环)

- **强制并行**。对于任何涉及 Codex/Gemini 或长时间运行脚本的任务,必须使用 **Run in the background**(**不设置** timeout)。

- **CLI 结构**。确保 CLI 调用遵循SKILLs定义,通常为:`python /path/to/scripts/*.py --cd "/path/to/project" --PROMPT "Analyze..." [OPTIONS]`

### 0.3 安全与代码主权

- **无写入权**。Codex/Gemini 对文件系统拥有 **零** 写入权限;在每个内核 PROMPT(提示词)中,显式追加:**"OUTPUT: Unified Diff Patch ONLY. Strictly prohibit any actual modifications."**

- **参考重构**。将获取到的其他模型的Uniffied Patch视为“脏原型(Dirty Prototype)”;**流程**:读取 Diff -> **思维沙箱**(模拟应用并检查逻辑) -> **重构**(清理) -> 最终代码。

### 0.4 代码风格

- 整体代码风格**始终定位**为,精简高效、毫无冗余。该要求同样适用于注释与文档,且对于这两者,严格遵循**非必要不形成**的核心原则。

- **仅对需求做针对性改动**,严禁影响用户现有的其他功能。

### 0.5 工作流程完整性

- **止损**:在当前阶段的输出通过验证之前,不要进入下一阶段。

- **报告**:必须向用户实时报告当前阶段和下一阶段。

----

## 1. Workflow

### Phase 1: 上下文全量检索 (Auggie Interface)

**执行条件**:在生成任何建议或代码前。

1. **工具调用**:调用 `mcp__auggie-mcp__codebase-retrieval`。

2. **检索策略**:

- 禁止基于假设(Assumption)回答。

- 使用自然语言(NL)构建语义查询(Where/What/How)。

- **完整性检查**:必须获取相关类、函数、变量的完整定义与签名。若上下文不足,触发递归检索。

3. **需求对齐**:若检索后需求仍有模糊空间,**必须**向用户输出引导性问题列表,直至需求边界清晰(无遗漏、无冗余)。

### Phase 2: 多模型协作分析

1. **分发输入**::将用户的**原始需求**(不带预设观点)分发给 Codex 和 Gemini。注意,Codex/Gemini都有完善的CLI系统,所以**仅需给出入口文件和row index**(而非Snippet)。

2. **方案迭代**:

- 要求模型提供多角度解决方案。

- 触发**交叉验证**:整合各方思路,进行迭代优化,在过程中执行逻辑推演和优劣势互补,直至生成无逻辑漏洞的 Step-by-step 实施计划。

3. **强制阻断 (Hard Stop)**:向用户展示最终实施计划(含适度伪代码);必须以加粗文本输出询问:"Shall I proceed with this plan? (Y/N)";立即终止当前回复。绝对禁止在收到用户明确的 "Y" 之前执行 Phase 3 或调用任何文件读取工具。

### Phase 3: 原型获取

- **Route A: 前端/UI/样式 (Gemini Kernel)**

- **限制**:上下文 < 32k。gemini对于后端逻辑的理解有缺陷,其回复需要客观审视。

- **指令**:请求 CSS/React/Vue 原型。以此为最终前端设计原型与视觉基准。

- **Route B: 后端/逻辑/算法 (Codex Kernel)**

- **能力**:利用其逻辑运算与 Debug 能力。

- **指令**:请求逻辑实现原型。

- **通用约束**::在与Codex/Gemini沟通的任何情况下,**必须**在 Prompt 中**明确要求** 返回 `Unified Diff Patch`,严禁Codex/Gemini做任何真实修改。

### 第 4 阶段:编码实施

**执行准则**:

1. **逻辑重构**:基于 Phase 3 的原型,去除冗余,**重写**为高可读、高可维护性、企业发布级代码。

2. **文档规范**:非必要不生成注释与文档,代码自解释。

3. **最小作用域**:变更仅限需求范围,**强制审查**变更是否引入副作用并做针对性修正。

### 第 5 阶段:审计与交付

1. **自动审计**:变更生效后,**强制立即调用** Codex与Gemini **同时进行** Code Review,并进行整合修复。

2. **交付**:审计通过后反馈给用户。

----

## 2. 资源矩阵

此矩阵定义了各阶段的**强制性**资源调用策略。Claude 作为**主控模型 (Orchestrator)**,必须严格根据当前 Workflow 阶段,按以下规格调度外部资源。

| Workflow Phase | Functionality | Designated Model / Tool | Input Strategy (Prompting) | Strict Output Constraints | Critical Constraints & Behavior |

| :----------------------- | :---------------------- | :--------------------------------------- | :----------------------------------------------------------- | :-------------------------------------------------- | :----------------------------------------------------------- |

| **Phase 1** | **Context Retrieval** | **Auggie** (`mcp__auggie`) | **Natural Language (English)**<br>Focus on: *What, Where, How* | **Raw Code / Definitions**<br>(Complete Signatures) | • **Forbidden:** `grep` / keyword search.<br>• **Mandatory:** Recursive retrieval until context is complete. |

| **Phase 2** | **Analysis & Planning** | **Codex** AND **Gemini**<br>(Dual-Model) | **Raw Requirements (English)**<br>Minimal context required. | **Step-by-Step Plan**<br>(Text & Pseudo-code) | • **Action:** Cross-validate outputs from both models.<br>• **Goal:** Eliminate logic gaps before coding starts. |

| **Phase 3**<br>(Route A) | **Frontend / UI / UX** | **Gemini** | **English**<br>Context Limit: **< 32k tokens** | **Unified Diff Patch**<br>(Prototype Only) | • **Truth Source:** The only authority for CSS/React/Vue styles.<br>• **Warning:** Ignore its backend logic suggestions. |

| **Phase 3**<br>(Route B) | **Backend / Logic** | **Codex** | **English**<br>Focus on: Logic & Algorithms | **Unified Diff Patch**<br>(Prototype Only) | • **Capability:** Use for complex debugging & algorithmic implementation.<br>• **Security:** **NO** file system write access allowed. |

| **Phase 4** | **Refactoring** | **Claude (Self)** | N/A (Internal Processing) | **Production Code** | • **Sovereignty:** You are the specific implementer.<br>• **Style:** Clean, efficient, no redundancy. Minimal comments. |

| **Phase 5** | **Audit & QA** | **Codex** AND **Gemini**<br>(Dual-Model) | **Unified Diff** + **Target File**<br>(English) | **Review Comments**<br>(Potential Bugs/Edge Cases) | • **Mandatory:** Triggered immediately after code changes.<br>• **Action:** Synthesize feedback into a final fix. |

三、Skills 详解

collaborating-with-codex

将编码任务委托给 OpenAI Codex CLI,适用于算法实现、Bug 分析和代码审查。

点击查看参数说明

| 参数 | 类型 | 必填 | 默认值 | 说明 |

|---|---|---|---|---|

--PROMPT |

str |

✅ | - | 发送给 Codex 的任务指令 |

--cd |

Path |

✅ | - | 工作目录根路径 |

--sandbox |

Literal |

❌ | read-only |

沙箱策略:read-only / workspace-write / danger-full-access |

--SESSION_ID |

UUID |

❌ | None |

会话 ID(None 则开启新会话) |

--skip-git-repo-check |

bool |

❌ | False |

是否允许在非 Git 仓库运行 |

--return-all-messages |

bool |

❌ | False |

是否返回完整推理信息 |

--image |

List[Path] |

❌ | None |

附加图片文件到初始提示词 |

--model |

str |

❌ | None |

指定模型(仅在用户明确要求时使用) |

--yolo |

bool |

❌ | False |

跳过所有审批与沙箱限制 |

点击查看使用示例

基础调用:

python scripts/codex_bridge.py --cd "/project" --PROMPT "分析认证流程"

多轮对话:

# 开启新会话

python scripts/codex_bridge.py --cd "/project" --PROMPT "审查 login.py 的安全问题"

# 继续会话

python scripts/codex_bridge.py --cd "/project" --SESSION_ID "uuid-from-response" --PROMPT "针对发现的问题提供修复建议"

获取 Diff 原型:

python scripts/codex_bridge.py --cd "/project" --PROMPT "生成添加日志功能的 unified diff"

collaborating-with-gemini

将编码任务委托给 Google Gemini CLI,适用于算法实现、Bug 分析和代码审查。

点击查看参数说明

| 参数 | 类型 | 必填 | 默认值 | 说明 |

|---|---|---|---|---|

--PROMPT |

str |

✅ | - | 发送给 Gemini 的任务指令 |

--cd |

Path |

✅ | - | 工作目录根路径 |

--sandbox |

bool |

❌ | False |

是否启用沙箱模式 |

--SESSION_ID |

str |

❌ | "" |

会话 ID(空字符串则开启新会话) |

--return-all-messages |

bool |

❌ | False |

是否返回完整推理信息 |

--model |

str |

❌ | None |

指定模型(仅在用户明确要求时使用) |

点击查看使用示例

基础调用:

python scripts/gemini_bridge.py --cd "/project" --PROMPT "分析认证流程"

多轮对话:

# 开启新会话

python scripts/gemini_bridge.py --cd "/project" --PROMPT "审查 login.py 的安全问题"

# 继续会话

python scripts/gemini_bridge.py --cd "/project" --SESSION_ID "uuid-from-response" --PROMPT "针对发现的问题提供修复建议"

返回值结构

两个 Skill 均返回统一的 JSON 格式:

成功时:

{

"success": true,

"SESSION_ID": "550e8400-e29b-41d4-a716-446655440000",

"agent_messages": "模型回复内容...",

"all_messages": []

}

失败时:

{

"success": false,

"error": "错误信息描述"

}

四、FAQ

Q1: 什么是 Agent Skills?

Agent Skills 是 Anthropic 推出的模块化能力扩展机制。每个 Skill 包含指令、元数据和可选资源(脚本、模板),Claude 会在相关任务时自动使用。Skills 采用渐进式加载,仅在需要时加载相关内容,有效管理上下文窗口。

Q2: 是否需要额外付费?

Skills 本身完全免费开源。 但使用协作模型(Codex、Gemini)可能产生相应的 API 费用,具体取决于各平台的定价策略。

Q3: 多轮对话时 SESSION_ID 有什么作用?

SESSION_ID 用于维护会话上下文。首次调用时返回一个新的 SESSION_ID,后续调用传入该 ID 可继续之前的对话,模型会记住之前的交互内容。每个 SESSION_ID 对应独立的会话,不同会话之间完全隔离。

Q4: 如何确保代码安全?

建议始终使用 read-only 沙箱策略,并在 PROMPT 中明确要求模型返回 unified diff patch 而非直接修改文件。外部模型生成的代码仅作为参考原型,最终实现应由 Claude 重构确认。

🤝 贡献指南

我们欢迎所有形式的贡献!

开发环境配置

# 克隆仓库(含子模块)

git clone --recurse-submodules https://github.com/GuDaStudio/skills.git

cd skills

提交规范

- 遵循 Conventional Commits

- 提交测试用例

- 更新相关文档

📄 许可证

本项目采用 MIT License 开源协议。

Copyright (c) 2025 guda.studio

常见问题

相似工具推荐

openclaw

OpenClaw 是一款专为个人打造的本地化 AI 助手,旨在让你在自己的设备上拥有完全可控的智能伙伴。它打破了传统 AI 助手局限于特定网页或应用的束缚,能够直接接入你日常使用的各类通讯渠道,包括微信、WhatsApp、Telegram、Discord、iMessage 等数十种平台。无论你在哪个聊天软件中发送消息,OpenClaw 都能即时响应,甚至支持在 macOS、iOS 和 Android 设备上进行语音交互,并提供实时的画布渲染功能供你操控。 这款工具主要解决了用户对数据隐私、响应速度以及“始终在线”体验的需求。通过将 AI 部署在本地,用户无需依赖云端服务即可享受快速、私密的智能辅助,真正实现了“你的数据,你做主”。其独特的技术亮点在于强大的网关架构,将控制平面与核心助手分离,确保跨平台通信的流畅性与扩展性。 OpenClaw 非常适合希望构建个性化工作流的技术爱好者、开发者,以及注重隐私保护且不愿被单一生态绑定的普通用户。只要具备基础的终端操作能力(支持 macOS、Linux 及 Windows WSL2),即可通过简单的命令行引导完成部署。如果你渴望拥有一个懂你

stable-diffusion-webui

stable-diffusion-webui 是一个基于 Gradio 构建的网页版操作界面,旨在让用户能够轻松地在本地运行和使用强大的 Stable Diffusion 图像生成模型。它解决了原始模型依赖命令行、操作门槛高且功能分散的痛点,将复杂的 AI 绘图流程整合进一个直观易用的图形化平台。 无论是希望快速上手的普通创作者、需要精细控制画面细节的设计师,还是想要深入探索模型潜力的开发者与研究人员,都能从中获益。其核心亮点在于极高的功能丰富度:不仅支持文生图、图生图、局部重绘(Inpainting)和外绘(Outpainting)等基础模式,还独创了注意力机制调整、提示词矩阵、负向提示词以及“高清修复”等高级功能。此外,它内置了 GFPGAN 和 CodeFormer 等人脸修复工具,支持多种神经网络放大算法,并允许用户通过插件系统无限扩展能力。即使是显存有限的设备,stable-diffusion-webui 也提供了相应的优化选项,让高质量的 AI 艺术创作变得触手可及。

everything-claude-code

everything-claude-code 是一套专为 AI 编程助手(如 Claude Code、Codex、Cursor 等)打造的高性能优化系统。它不仅仅是一组配置文件,而是一个经过长期实战打磨的完整框架,旨在解决 AI 代理在实际开发中面临的效率低下、记忆丢失、安全隐患及缺乏持续学习能力等核心痛点。 通过引入技能模块化、直觉增强、记忆持久化机制以及内置的安全扫描功能,everything-claude-code 能显著提升 AI 在复杂任务中的表现,帮助开发者构建更稳定、更智能的生产级 AI 代理。其独特的“研究优先”开发理念和针对 Token 消耗的优化策略,使得模型响应更快、成本更低,同时有效防御潜在的攻击向量。 这套工具特别适合软件开发者、AI 研究人员以及希望深度定制 AI 工作流的技术团队使用。无论您是在构建大型代码库,还是需要 AI 协助进行安全审计与自动化测试,everything-claude-code 都能提供强大的底层支持。作为一个曾荣获 Anthropic 黑客大奖的开源项目,它融合了多语言支持与丰富的实战钩子(hooks),让 AI 真正成长为懂上

ComfyUI

ComfyUI 是一款功能强大且高度模块化的视觉 AI 引擎,专为设计和执行复杂的 Stable Diffusion 图像生成流程而打造。它摒弃了传统的代码编写模式,采用直观的节点式流程图界面,让用户通过连接不同的功能模块即可构建个性化的生成管线。 这一设计巧妙解决了高级 AI 绘图工作流配置复杂、灵活性不足的痛点。用户无需具备编程背景,也能自由组合模型、调整参数并实时预览效果,轻松实现从基础文生图到多步骤高清修复等各类复杂任务。ComfyUI 拥有极佳的兼容性,不仅支持 Windows、macOS 和 Linux 全平台,还广泛适配 NVIDIA、AMD、Intel 及苹果 Silicon 等多种硬件架构,并率先支持 SDXL、Flux、SD3 等前沿模型。 无论是希望深入探索算法潜力的研究人员和开发者,还是追求极致创作自由度的设计师与资深 AI 绘画爱好者,ComfyUI 都能提供强大的支持。其独特的模块化架构允许社区不断扩展新功能,使其成为当前最灵活、生态最丰富的开源扩散模型工具之一,帮助用户将创意高效转化为现实。

gemini-cli

gemini-cli 是一款由谷歌推出的开源 AI 命令行工具,它将强大的 Gemini 大模型能力直接集成到用户的终端环境中。对于习惯在命令行工作的开发者而言,它提供了一条从输入提示词到获取模型响应的最短路径,无需切换窗口即可享受智能辅助。 这款工具主要解决了开发过程中频繁上下文切换的痛点,让用户能在熟悉的终端界面内直接完成代码理解、生成、调试以及自动化运维任务。无论是查询大型代码库、根据草图生成应用,还是执行复杂的 Git 操作,gemini-cli 都能通过自然语言指令高效处理。 它特别适合广大软件工程师、DevOps 人员及技术研究人员使用。其核心亮点包括支持高达 100 万 token 的超长上下文窗口,具备出色的逻辑推理能力;内置 Google 搜索、文件操作及 Shell 命令执行等实用工具;更独特的是,它支持 MCP(模型上下文协议),允许用户灵活扩展自定义集成,连接如图像生成等外部能力。此外,个人谷歌账号即可享受免费的额度支持,且项目基于 Apache 2.0 协议完全开源,是提升终端工作效率的理想助手。

markitdown

MarkItDown 是一款由微软 AutoGen 团队打造的轻量级 Python 工具,专为将各类文件高效转换为 Markdown 格式而设计。它支持 PDF、Word、Excel、PPT、图片(含 OCR)、音频(含语音转录)、HTML 乃至 YouTube 链接等多种格式的解析,能够精准提取文档中的标题、列表、表格和链接等关键结构信息。 在人工智能应用日益普及的今天,大语言模型(LLM)虽擅长处理文本,却难以直接读取复杂的二进制办公文档。MarkItDown 恰好解决了这一痛点,它将非结构化或半结构化的文件转化为模型“原生理解”且 Token 效率极高的 Markdown 格式,成为连接本地文件与 AI 分析 pipeline 的理想桥梁。此外,它还提供了 MCP(模型上下文协议)服务器,可无缝集成到 Claude Desktop 等 LLM 应用中。 这款工具特别适合开发者、数据科学家及 AI 研究人员使用,尤其是那些需要构建文档检索增强生成(RAG)系统、进行批量文本分析或希望让 AI 助手直接“阅读”本地文件的用户。虽然生成的内容也具备一定可读性,但其核心优势在于为机器