CodexMonitor

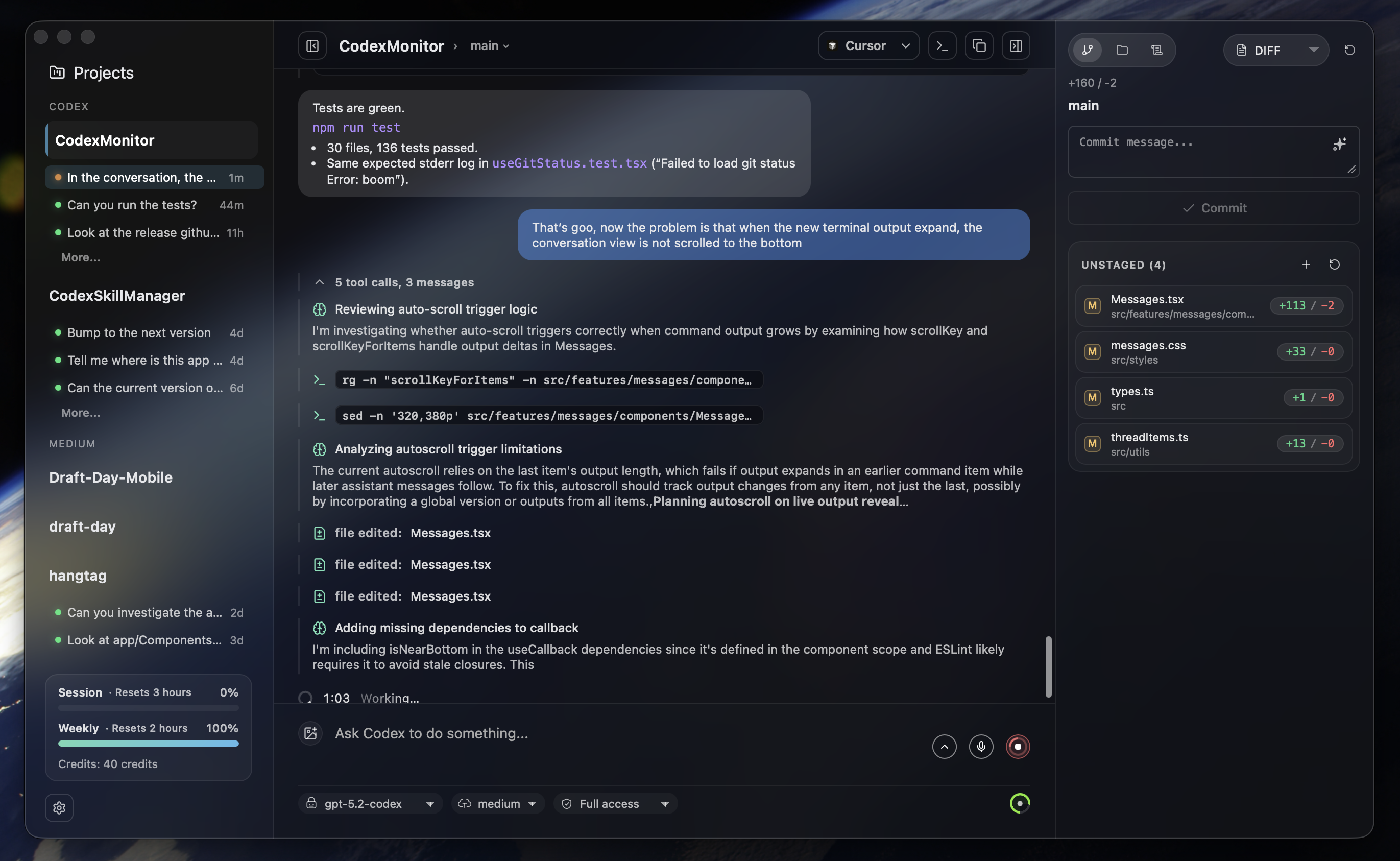

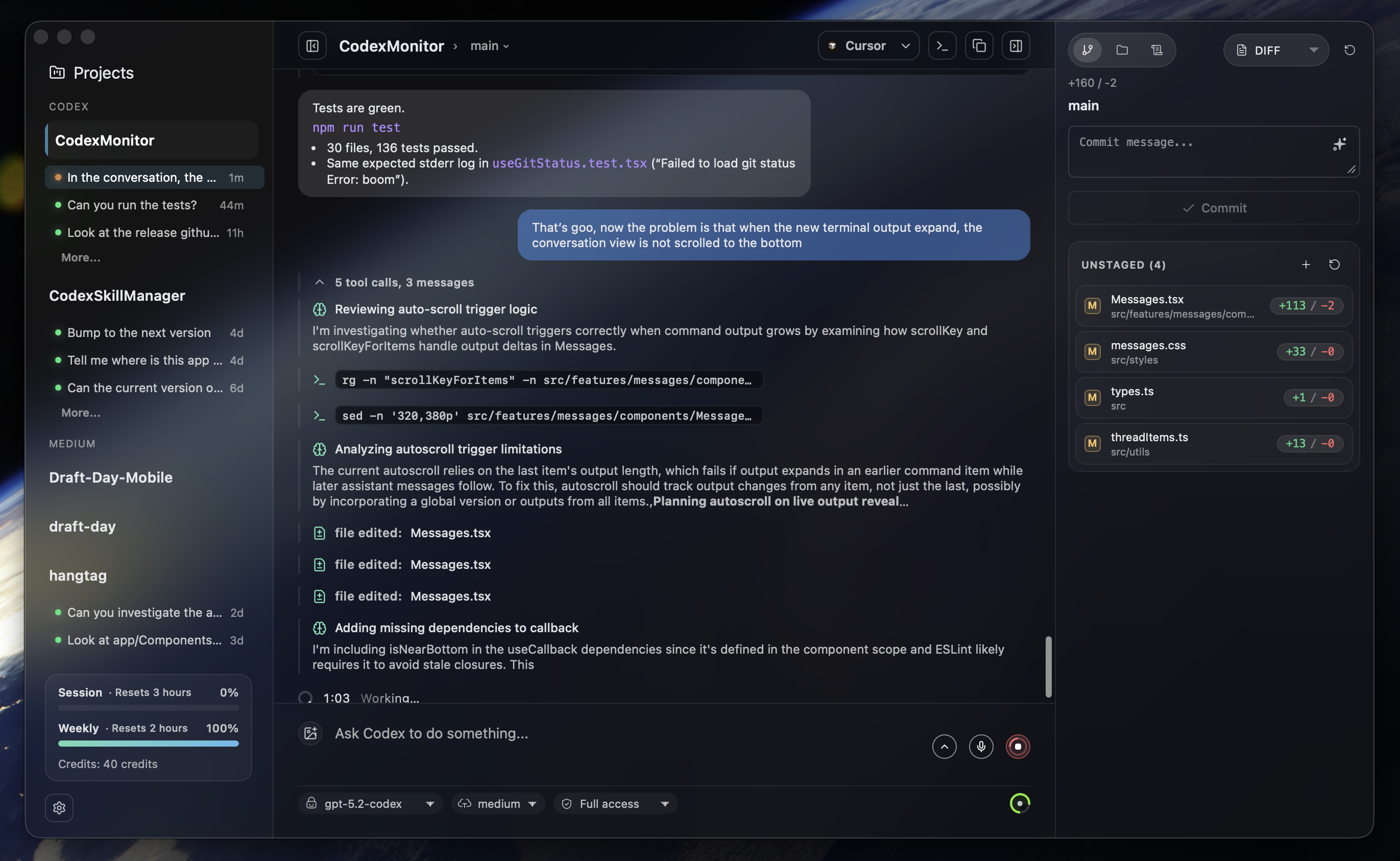

CodexMonitor 是一款基于 Tauri 构建的桌面应用,旨在帮助开发者高效统筹和管理多个 Codex AI 代理。它解决了在复杂开发场景中,难以同时监控不同项目下 AI 代理运行状态、对话线程及代码变更的痛点,让多任务协作变得井井有条。

这款工具特别适合需要频繁利用 AI 辅助编程的软件工程师和技术研究人员。通过直观的侧边栏和仪表盘,用户可以轻松切换工作区,实时查看代理的读写状态、未读消息及运行进度。其独特亮点在于深度集成了 Git 与 GitHub 工作流,不仅支持分支管理、差异对比和提交历史查看,还能直接将 PR 上下文注入新的代理线程进行智能分析。此外,CodexMonitor 提供了丰富的交互控制,如语音输入(Whisper)、技能自动补全、图像附件支持以及精细的线程管理(暂停、归档、重命名)。对于需要在多台设备间协同的用户,它还支持远程后端模式,配合 Tailscale 即可实现跨机器的安全连接。无论是本地单兵作战还是分布式团队协作,CodexMonitor 都能提供流畅、透明且强大的 AI 编排体验。

使用场景

资深全栈工程师李明正在同时维护三个微服务项目,并需要频繁切换上下文来处理代码审查、分支管理及多轮 AI 辅助编程任务。

没有 CodexMonitor 时

- 上下文切换混乱:需要在多个终端窗口手动启动不同的

codex app-server,极易搞混哪个会话对应哪个项目,导致指令发错位置。 - 协作流程割裂:查看 GitHub PR 差异、切换分支和让 AI 生成修复代码需在浏览器、Git 命令行和聊天窗口间反复跳转,打断心流。

- 状态监控缺失:无法直观看到哪些 AI 任务正在运行、哪些线程有未读回复,常因遗漏关键审批提示或错误信息而延误进度。

- 资源管理粗放:缺乏统一的凭据用量和工作区仪表盘,难以评估各项目的 Token 消耗情况,容易意外触发速率限制。

使用 CodexMonitor 后

- 工作区一键编排:通过侧边栏直接管理持久化的工作区,为每个项目独立运行 Agent 实例,点击即可无缝切入最近的对话现场。

- 全流程闭环操作:在应用内直接浏览 Git 分支、对比文件差异、评论 PR,并能将 PR 上下文一键发送给 AI 线程生成修复方案,无需离开界面。

- 实时状态透视:首页仪表盘清晰展示各线程的运行/暂停状态及未读消息,支持随时中断执行或处理审批请求,确保任务零遗漏。

- 精细化资源管控:内置用量计量器实时显示账户额度消耗快照,帮助团队合理分配推理资源,避免突发性的服务不可用。

CodexMonitor 将分散的 AI 代理、版本控制与系统监控整合为统一的指挥中枢,让多项目并行开发变得井然有序且高效可控。

运行环境要求

- Linux

- macOS

- Windows

未说明

未说明

快速开始

CodexMonitor

CodexMonitor 是一款基于 Tauri 的应用,用于在本地工作区中编排多个 Codex 代理。它提供了一个侧边栏来管理项目、一个用于快速操作的主屏幕,以及基于 Codex 应用服务器协议的对话视图。

功能特性

工作区与线程

- 添加并持久化工作区,对其进行分组和排序,并从主页仪表板快速跳转到最近的代理活动。

- 每个工作区启动一个

codex app-server实例,恢复线程并跟踪未读及运行状态。 - 使用工作树和克隆代理进行隔离工作;工作树存储在应用数据目录下(支持旧版

.codex-worktrees)。 - 线程管理:固定/重命名/归档/复制,每个线程都有草稿功能,并可停止或中断正在进行的回合。

- 可选的远程后端(守护进程)模式,用于在另一台机器上运行 Codex。

- 远程设置助手,用于自托管连接(检测 Tailscale 或为 TCP 模式引导主机)。

编辑器与代理控制

- 支持图片附件(通过选择器、拖放或粘贴),并可配置后续行为(在运行时选择“队列”或“转向”)。

- 使用

Shift+Cmd+Enter(macOS)或Shift+Ctrl+Enter(Windows/Linux)发送单条消息的相反后续操作。 - 自动补全技能(

$)、提示词(/prompts:)、评审(/review)和文件路径(@)。 - 模型选择器、协作模式(启用时)、推理力度、访问模式和上下文使用环形控件。

- 语音输入支持长按说话快捷键和实时波形显示(Whisper)。

- 渲染推理/工具/差异项,并处理批准提示。

Git 与 GitHub

- 显示差异统计、暂存/未暂存文件差异、撤销/暂存控件以及提交日志。

- 分支列表支持检出/创建分支,并显示上游领先或落后数量。

- 通过

gh工具查看 GitHub Issues 和 Pull Requests(列表、差异、评论),并在浏览器中打开提交和 PR。 - PR 编辑器:“Ask PR”可将 PR 上下文发送到新的代理线程。

文件与提示库

- 文件树支持搜索、文件类型图标,并可在 Finder 或资源管理器中显示文件位置。

- 提示库用于全局或工作区级别的提示:可创建/编辑/删除/移动提示,并在当前或新线程中运行。

用户界面与体验

- 可调整大小的侧边栏、右侧面板、计划面板、终端和调试面板,尺寸会持久保存。

- 响应式布局(桌面、平板、手机),支持标签页导航。

- 侧边栏使用情况和账户配额计量器,以及主页使用情况快照。

- 终端停靠区支持多标签页后台命令(实验性功能)。

- 应用内更新通过提示框驱动下载和安装,调试面板可复制或清空内容,支持声音通知,并提供平台特定的窗口效果(macOS 的叠加标题栏 + 鲜艳效果),以及透明度降低开关。

系统要求

- Node.js + npm

- Rust 工具链(稳定版)

- CMake(构建原生依赖所需;语音输入/Whisper 使用 CMake)

- LLVM/Clang(Windows 上需要 Clang 来通过 bindgen 构建语音输入依赖)

- 已安装 Codex CLI,并可在

PATH中以codex命令调用(或在应用/工作区设置中配置自定义 Codex 二进制文件) - Git CLI(用于工作树操作)

- GitHub CLI (

gh) 用于 GitHub Issues/PR 集成(可选)

如果遇到原生构建错误,请运行:

npm run doctor

快速开始

安装依赖:

npm install

以开发模式运行:

npm run tauri:dev

iOS 支持(开发中)

iOS 支持目前仍在开发中。

- 当前状态:移动端布局已运行,远程后端流程已打通,iOS 默认使用远程后端模式。

- 当前限制:终端和语音输入功能在移动端版本中仍不可用。

- 桌面端行为保持不变:macOS、Linux 和 Windows 仍以本地优先,除非显式选择远程模式。

iOS + Tailscale 设置(TCP)

当您需要通过 Tailscale 尾网将 iOS 应用连接到桌面托管的守护进程时,请使用此方法。

官方指南:docs/mobile-ios-tailscale-blueprint.md。

- 在桌面和 iPhone 上分别安装并登录 Tailscale(同一尾网)。

- 在桌面版 CodexMonitor 中,打开

设置 > 服务器。 - 设置一个

远程后端令牌。 - 在

移动访问守护进程中,点击启动守护进程。 - 在

Tailscale 助手中,使用检测 Tailscale功能,并记下建议的主机地址(例如your-mac.your-tailnet.ts.net:4732)。 - 在 iOS 版 CodexMonitor 中,打开

设置 > 服务器。 - 输入桌面端的 Tailscale 主机地址和相同的令牌。

- 点击

连接并测试,确认连接成功。

注意事项:

- 桌面守护进程必须在 iOS 连接期间保持运行。

- 如果测试失败,请确认两台设备都在 Tailscale 中在线,并且主机地址和令牌与桌面设置一致。

无桌面 UI 的独立守护进程管理

当您希望在不打开桌面应用的情况下启用 iOS 远程模式时,可以使用独立的守护进程控制 CLI。

构建二进制文件:

cd src-tauri

cargo build --bin codex_monitor_daemon --bin codex_monitor_daemonctl

示例:

# 查看当前守护进程状态

./target/debug/codex_monitor_daemonctl status

# 使用 settings.json 中的主机和令牌启动守护进程

./target/debug/codex_monitor_daemonctl start

# 停止守护进程

./target/debug/codex_monitor_daemonctl stop

# 打印等效的启动命令

./target/debug/codex_monitor_daemonctl command-preview

常用选项:

--data-dir <path>:包含settings.json和workspaces.json的应用数据目录。--listen <addr>:覆盖绑定地址。--token <token>:覆盖令牌。--daemon-path <path>:指定codex-monitor-daemon二进制文件路径。--json:输出机器可读格式。

iOS 前置条件

- 已安装 Xcode 和命令行工具。

- 已安装 Rust 的 iOS 目标:

rustup target add aarch64-apple-ios aarch64-apple-ios-sim

# 可选(Intel Mac 模拟器构建):

rustup target add x86_64-apple-ios

- 已配置 Apple 签名(开发团队)。

- 在

src-tauri/tauri.ios.local.conf.json中设置bundle.iOS.developmentTeam和identifier(推荐用于本地机器设置),或 - 在

src-tauri/tauri.ios.conf.json中设置这些值,或 - 在设备脚本中传递

--team <TEAM_ID>。 build_run_ios*.sh和release_testflight_ios.sh会自动合并src-tauri/tauri.ios.local.conf.json(如果存在)。

- 在

在 iOS 模拟器上运行

./scripts/build_run_ios.sh

选项:

--simulator "<name>":指定目标模拟器。--target aarch64-sim|x86_64-sim:覆盖架构。--skip-build:复用当前的应用包。--no-clean:保留src-tauri/gen/apple/build目录,以便多次构建。

在 USB 设备上运行

列出可发现的设备:

./scripts/build_run_ios_device.sh --list-devices

在特定设备上构建、安装并启动:

./scripts/build_run_ios_device.sh --device "<设备名称或标识符>" --team <TEAM_ID>

附加选项:

--target aarch64用于覆盖架构。--skip-build用于复用当前的应用程序包。--bundle-id <id>用于启动非默认的捆绑包标识符。

首次设置设备通常需要:

- iPhone 已解锁,并已信任此 Mac。

- iPhone 上已启用开发者模式。

- 至少在 Xcode 中批准过一次配对/签名。

如果签名尚未准备好,可以从脚本流程中打开 Xcode:

./scripts/build_run_ios_device.sh --open-xcode

iOS TestFlight 发布(脚本化)

使用端到端脚本归档、上传、配置合规性、分配测试组并提交进行 Beta 审核。

./scripts/release_testflight_ios.sh

该脚本会自动从 .testflight.local.env(已忽略于 Git)加载发布元数据。对于新设置,请将 .testflight.local.env.example 复制到 .testflight.local.env 并填写相应值。

发布构建

构建生产环境的 Tauri 包:

npm run tauri:build

生成的工件将位于 src-tauri/target/release/bundle/(平台特定子文件夹)。

Windows(可选)

Windows 构建是可选的,并使用单独的 Tauri 配置文件,以避免 macOS 专用的窗口效果。

npm run tauri:build:win

生成的工件将位于:

src-tauri/target/release/bundle/nsis/(安装程序 exe)src-tauri/target/release/bundle/msi/(msi)

注意:在 Windows 上从源代码构建需要 LLVM/Clang(用于 bindgen / libclang),以及 CMake。

类型检查

运行 TypeScript 检查器(不输出):

npm run typecheck

注意:npm run build 也会在打包前端之前运行 tsc。

验证

推荐的验证命令:

npm run lint

npm run test

npm run typecheck

cd src-tauri && cargo check

代码库导航

对于任务导向的文件查找(“如果你需要 X,就编辑 Y”),请使用:

docs/codebase-map.md

项目结构

src/

features/ 功能拆分的 UI + hooks

features/app/bootstrap/ 应用启动编排

features/app/orchestration/ 应用布局/线程/工作区编排

features/threads/hooks/threadReducer/ 线程 reducer 分片

services/ Tauri IPC 封装

styles/ 按区域划分的 CSS

types.ts 共享类型

src-tauri/

src/lib.rs Tauri 应用后端命令注册表

src/bin/codex_monitor_daemon.rs 远程守护进程 JSON-RPC 进程

src/bin/codex_monitor_daemon/rpc/ 守护进程 RPC 域处理程序

src/shared/ 应用 + 守护进程共用的后端核心

src/shared/git_ui_core/ git/github 共用核心模块

src/shared/workspaces_core/ 作业空间/工作树共用核心模块

src/workspaces/ 作业空间/工作树适配器

src/codex/ codex 应用服务器适配器

src/files/ 文件适配器

tauri.conf.json 窗口配置

笔记

- 工作区会持久化到应用数据目录下的

workspaces.json。 - 应用设置会持久化到应用数据目录下的

settings.json(主题、后端模式/提供商、远程端点/令牌、Codex 路径、默认访问模式、UI 缩放、后续消息行为)。 - 功能设置在 UI 中支持,并在加载/保存时同步到

$CODEX_HOME/config.toml(或~/.codex/config.toml)。稳定功能包括:协作模式(features.collaboration_modes)、个性(personality)和后台终端(features.unified_exec)。实验性功能包括:应用(features.apps)。控制能力仍遵循 Codex 的features.steer,但后续默认行为由设置 → Composer 控制。 - 启动时及窗口获得焦点时,应用会重新连接并刷新每个工作区的线程列表。

- 线程通过使用工作区的

cwd过滤thread/list结果来恢复。 - 选择线程时始终调用

thread/resume以从磁盘刷新消息。 - 如果 CLI 会话的

cwd与工作区路径匹配,则会显示;除非被恢复,否则不会实时显示。 - 应用通过 stdio 使用

codex app-server;详见src-tauri/src/lib.rs和src-tauri/src/codex/。 - 远程守护进程入口点为

src-tauri/src/bin/codex_monitor_daemon.rs;RPC 路由位于src-tauri/src/bin/codex_monitor_daemon/rpc.rs,域处理程序位于src-tauri/src/bin/codex_monitor_daemon/rpc/。 - 共享域逻辑位于

src-tauri/src/shared/(尤其是src-tauri/src/shared/git_ui_core/和src-tauri/src/shared/workspaces_core/)。 - Codex 主目录根据工作区设置(若已设置)解析,其次为旧版

.codexmonitor/,最后为$CODEX_HOME/~/.codex。 - 工作树代理位于应用数据目录下(

worktrees/<workspace-id>);旧版.codex-worktrees/路径仍受支持,且应用不再编辑仓库的.gitignore文件。 - UI 状态(面板大小、透明度切换、最近线程活动)存储在

localStorage中。 - 自定义提示从

$CODEX_HOME/prompts(或~/.codex/prompts)加载,可选带前言描述/参数提示。

Tauri IPC 接口

前端调用位于 src/services/tauri.ts 中,并映射到 src-tauri/src/lib.rs 中的命令。当前接口包括:

- 设置/配置/文件:

get_app_settings、update_app_settings、get_codex_config_path、get_config_model、file_read、file_write、codex_doctor、menu_set_accelerators。 - 工作区/工作树:

list_workspaces、is_workspace_path_dir、add_workspace、add_clone、add_worktree、worktree_setup_status、worktree_setup_mark_ran、rename_worktree、rename_worktree_upstream、apply_worktree_changes、update_workspace_settings、remove_workspace、remove_worktree、connect_workspace、list_workspace_files、read_workspace_file、open_workspace_in、get_open_app_icon。 - 线程/回合/评审:

start_thread、fork_thread、compact_thread、list_threads、resume_thread、archive_thread、set_thread_name、send_user_message、turn_interrupt、respond_to_server_request、start_review、remember_approval_rule、get_commit_message_prompt、generate_commit_message、generate_run_metadata。 - 账户/模型/协作:

model_list、account_rate_limits、account_read、skills_list、apps_list、collaboration_mode_list、codex_login、codex_login_cancel、list_mcp_server_status。 - Git/GitHub:

get_git_status、list_git_roots、get_git_diffs、get_git_log、get_git_commit_diff、get_git_remote、stage_git_file、stage_git_all、unstage_git_file、revert_git_file、revert_git_all、commit_git、push_git、pull_git、fetch_git、sync_git、list_git_branches、checkout_git_branch、create_git_branch、get_github_issues、get_github_pull_requests、get_github_pull_request_diff、get_github_pull_request_comments。 - 提示词:

prompts_list、prompts_create、prompts_update、prompts_delete、prompts_move、prompts_workspace_dir、prompts_global_dir。 - 终端/听写/通知/使用情况:

terminal_open、terminal_write、terminal_resize、terminal_close、dictation_model_status、dictation_download_model、dictation_cancel_download、dictation_remove_model、dictation_request_permission、dictation_start、dictation_stop、dictation_cancel、send_notification_fallback、is_macos_debug_build、local_usage_snapshot。 - 远程后端辅助工具:

tailscale_status、tailscale_daemon_command_preview、tailscale_daemon_start、tailscale_daemon_stop、tailscale_daemon_status。

版本历史

v0.7.672026/03/24v0.7.662026/03/22v0.7.652026/03/22v0.7.642026/03/22v0.7.632026/03/17v0.7.622026/03/10v0.7.612026/03/07v0.7.602026/02/27v0.7.592026/02/26v0.7.582026/02/25v0.7.572026/02/23v0.7.562026/02/22v0.7.552026/02/18v0.7.542026/02/16v0.7.532026/02/14v0.7.522026/02/13v0.7.502026/02/11v0.7.492026/02/10v0.7.482026/02/09v0.7.472026/02/09常见问题

相似工具推荐

openclaw

OpenClaw 是一款专为个人打造的本地化 AI 助手,旨在让你在自己的设备上拥有完全可控的智能伙伴。它打破了传统 AI 助手局限于特定网页或应用的束缚,能够直接接入你日常使用的各类通讯渠道,包括微信、WhatsApp、Telegram、Discord、iMessage 等数十种平台。无论你在哪个聊天软件中发送消息,OpenClaw 都能即时响应,甚至支持在 macOS、iOS 和 Android 设备上进行语音交互,并提供实时的画布渲染功能供你操控。 这款工具主要解决了用户对数据隐私、响应速度以及“始终在线”体验的需求。通过将 AI 部署在本地,用户无需依赖云端服务即可享受快速、私密的智能辅助,真正实现了“你的数据,你做主”。其独特的技术亮点在于强大的网关架构,将控制平面与核心助手分离,确保跨平台通信的流畅性与扩展性。 OpenClaw 非常适合希望构建个性化工作流的技术爱好者、开发者,以及注重隐私保护且不愿被单一生态绑定的普通用户。只要具备基础的终端操作能力(支持 macOS、Linux 及 Windows WSL2),即可通过简单的命令行引导完成部署。如果你渴望拥有一个懂你

stable-diffusion-webui

stable-diffusion-webui 是一个基于 Gradio 构建的网页版操作界面,旨在让用户能够轻松地在本地运行和使用强大的 Stable Diffusion 图像生成模型。它解决了原始模型依赖命令行、操作门槛高且功能分散的痛点,将复杂的 AI 绘图流程整合进一个直观易用的图形化平台。 无论是希望快速上手的普通创作者、需要精细控制画面细节的设计师,还是想要深入探索模型潜力的开发者与研究人员,都能从中获益。其核心亮点在于极高的功能丰富度:不仅支持文生图、图生图、局部重绘(Inpainting)和外绘(Outpainting)等基础模式,还独创了注意力机制调整、提示词矩阵、负向提示词以及“高清修复”等高级功能。此外,它内置了 GFPGAN 和 CodeFormer 等人脸修复工具,支持多种神经网络放大算法,并允许用户通过插件系统无限扩展能力。即使是显存有限的设备,stable-diffusion-webui 也提供了相应的优化选项,让高质量的 AI 艺术创作变得触手可及。

everything-claude-code

everything-claude-code 是一套专为 AI 编程助手(如 Claude Code、Codex、Cursor 等)打造的高性能优化系统。它不仅仅是一组配置文件,而是一个经过长期实战打磨的完整框架,旨在解决 AI 代理在实际开发中面临的效率低下、记忆丢失、安全隐患及缺乏持续学习能力等核心痛点。 通过引入技能模块化、直觉增强、记忆持久化机制以及内置的安全扫描功能,everything-claude-code 能显著提升 AI 在复杂任务中的表现,帮助开发者构建更稳定、更智能的生产级 AI 代理。其独特的“研究优先”开发理念和针对 Token 消耗的优化策略,使得模型响应更快、成本更低,同时有效防御潜在的攻击向量。 这套工具特别适合软件开发者、AI 研究人员以及希望深度定制 AI 工作流的技术团队使用。无论您是在构建大型代码库,还是需要 AI 协助进行安全审计与自动化测试,everything-claude-code 都能提供强大的底层支持。作为一个曾荣获 Anthropic 黑客大奖的开源项目,它融合了多语言支持与丰富的实战钩子(hooks),让 AI 真正成长为懂上

opencode

OpenCode 是一款开源的 AI 编程助手(Coding Agent),旨在像一位智能搭档一样融入您的开发流程。它不仅仅是一个代码补全插件,而是一个能够理解项目上下文、自主规划任务并执行复杂编码操作的智能体。无论是生成全新功能、重构现有代码,还是排查难以定位的 Bug,OpenCode 都能通过自然语言交互高效完成,显著减少开发者在重复性劳动和上下文切换上的时间消耗。 这款工具专为软件开发者、工程师及技术研究人员设计,特别适合希望利用大模型能力来提升编码效率、加速原型开发或处理遗留代码维护的专业人群。其核心亮点在于完全开源的架构,这意味着用户可以审查代码逻辑、自定义行为策略,甚至私有化部署以保障数据安全,彻底打破了传统闭源 AI 助手的“黑盒”限制。 在技术体验上,OpenCode 提供了灵活的终端界面(Terminal UI)和正在测试中的桌面应用程序,支持 macOS、Windows 及 Linux 全平台。它兼容多种包管理工具,安装便捷,并能无缝集成到现有的开发环境中。无论您是追求极致控制权的资深极客,还是渴望提升产出的独立开发者,OpenCode 都提供了一个透明、可信

ComfyUI

ComfyUI 是一款功能强大且高度模块化的视觉 AI 引擎,专为设计和执行复杂的 Stable Diffusion 图像生成流程而打造。它摒弃了传统的代码编写模式,采用直观的节点式流程图界面,让用户通过连接不同的功能模块即可构建个性化的生成管线。 这一设计巧妙解决了高级 AI 绘图工作流配置复杂、灵活性不足的痛点。用户无需具备编程背景,也能自由组合模型、调整参数并实时预览效果,轻松实现从基础文生图到多步骤高清修复等各类复杂任务。ComfyUI 拥有极佳的兼容性,不仅支持 Windows、macOS 和 Linux 全平台,还广泛适配 NVIDIA、AMD、Intel 及苹果 Silicon 等多种硬件架构,并率先支持 SDXL、Flux、SD3 等前沿模型。 无论是希望深入探索算法潜力的研究人员和开发者,还是追求极致创作自由度的设计师与资深 AI 绘画爱好者,ComfyUI 都能提供强大的支持。其独特的模块化架构允许社区不断扩展新功能,使其成为当前最灵活、生态最丰富的开源扩散模型工具之一,帮助用户将创意高效转化为现实。

gemini-cli

gemini-cli 是一款由谷歌推出的开源 AI 命令行工具,它将强大的 Gemini 大模型能力直接集成到用户的终端环境中。对于习惯在命令行工作的开发者而言,它提供了一条从输入提示词到获取模型响应的最短路径,无需切换窗口即可享受智能辅助。 这款工具主要解决了开发过程中频繁上下文切换的痛点,让用户能在熟悉的终端界面内直接完成代码理解、生成、调试以及自动化运维任务。无论是查询大型代码库、根据草图生成应用,还是执行复杂的 Git 操作,gemini-cli 都能通过自然语言指令高效处理。 它特别适合广大软件工程师、DevOps 人员及技术研究人员使用。其核心亮点包括支持高达 100 万 token 的超长上下文窗口,具备出色的逻辑推理能力;内置 Google 搜索、文件操作及 Shell 命令执行等实用工具;更独特的是,它支持 MCP(模型上下文协议),允许用户灵活扩展自定义集成,连接如图像生成等外部能力。此外,个人谷歌账号即可享受免费的额度支持,且项目基于 Apache 2.0 协议完全开源,是提升终端工作效率的理想助手。