folib

Folib 是一个专为 AI 研发打造的全语言软件供应链服务平台。在人工智能开发过程中,团队常面临依赖包来源分散、下载速度慢、安全漏洞难管控以及多语言环境维护复杂等痛点。Folib 通过提供统一的代理与同步服务,一站式解决了这些难题。

它全面支持 npm、Maven、PyPi、Docker、Go 等 23 种主流编程语言仓库,并深度集成 Huggingface、ModelScope 等核心 AI 模型库,让开发者能够在一个平台内高效管理从代码依赖到大型模型的所有资产。无论是企业内部私有化部署,还是跨团队协作,Folib 都能确保软件供应的安全与稳定。

这款工具特别适合 AI 算法工程师、全栈开发者以及负责基础设施运维的技术团队使用。其独特亮点在于引入了 AIAgent 与 MCP 协议支持,不仅能智能查询和推荐制品,还能自动分析依赖关系、识别安全漏洞并提供修复建议。此外,Folib 具备强大的云原生能力,支持多种容器镜像格式及大文件断点续传,显著提升了大规模模型文件的传输效率。通过构建清晰的元数据知识图谱,Folib 让复杂的软件供应链管理变得简单透明,是加速 AI 项目落地的得力助手。

使用场景

某大型金融科技公司的 AI 研发团队,正面临从传统微服务向"AI+ 大模型”架构转型的挑战,需同时管理 Java 后端、Python 算法及私有化部署的 LLM 模型。

没有 folib 时

- 多源依赖管理混乱:团队需分别配置 npm、Maven、PyPi 及 Huggingface 等多个远程源,内网环境常因网络波动导致构建失败,开发效率极低。

- 模型资产分散且不安全:AI 模型散落在个人电脑或公共云端,缺乏统一的版本控制与权限审计,核心算法模型存在泄露风险。

- 漏洞修复滞后:当开源组件爆出安全漏洞时,人工排查所有项目的依赖树耗时数天,无法快速定位受影响的服务。

- 大文件传输困难:GB 级别的 Docker 镜像或模型文件在跨地域同步时经常中断,缺乏断点续传机制,部署周期长达数小时。

使用 folib 后

- 全语言统一代理加速:folib 一站式代理了 23+ 种语言仓库及 Huggingface 等模型站,内网缓存机制让构建速度提升 10 倍,彻底消除网络抖动影响。

- 模型资产私有化闭环:通过 folib 建立企业级私有模型仓库,实现从上传、晋级到分发的全流程管控,确保核心 AI 资产仅在授权范围内流转。

- 智能安全治理:利用 folib 的图谱分析能力,系统自动扫描并告警依赖漏洞,甚至能通过 AIAgent 推荐修复方案,将响应时间从“天”级缩短至“分钟”级。

- 云原生高效分发:依托分层传输与单层断点续传技术,超大镜像和模型文件的同步稳定性达到 99.9%,部署窗口从小时级压缩至分钟级。

folib 通过构建全语言、全生态的软件供应链底座,让企业在 AI 转型中实现了依赖管理的统一化、资产安全可控化与交付效率极致化。

运行环境要求

- Linux

未说明

推荐 8GB+ (基于 JVM 参数 -Xmx8192m)

快速开始

一个为Ai研发而生的、全语言软件供应链服务平台

)

?logo=springboot)

?logo=openjdk)

English | 简体中文

FOLib 是一个为Ai研发而生的、全语言软件供应链服务平台。

- 语言支持范围:23+种全语言仓库,涵盖npm、Maven、Cangjie(cjpm)、Ohpm、PyPi、Docker、Gradle、SBT、Cocoapods、Swift、RPM、Debian、OPKG、PHP、Go、Pub、Ivy、NuGet、Conda、Cargo、Conan、Yarn、GitLFS、Helm等主流工具;

- AI模型库与生态:涵盖Huggingface、Ollama、ModelScope 等主流AI模型仓库的代理与同步, 并支持工具私有化上传与晋级分发;

- AIAgent与MCP支持:支持元数据需求-服务-制品-安全漏洞-依赖证书等多维图数据的查询与展示,并支持MCP上下文协议,可通过AIAgent实现制品库的智能查询与推荐、安全漏洞的智能修复、智能晋级同步等功能;

- 容器化与云原生支持:支持Docker V1/V2/OCI镜像格式,支持nerdctl、crictl、ctr、podman等多客户端,支持分层传输,单层断点续传。 支持webdav为大文件提供云原生数据挂载能力。

快速开始

我们的代码地址

- Gitcode: https://gitcode.com/folib/folib

- Github: https://github.com/BoCloud/folib

镜像部署

Tips: MYSQL需要先准备好,并且准备好docker-ce环境

1、创建目录,以/data/folib为例

mkdir -p /data/folib/folib-data/logs

2、启动容器

docker run -itd -p 38080:38080 -p 7010:7010 -p 7011:7011 -p 7199:7199 -p 49142:49142 -p 8182:8182 \

--name folib-server \

--restart=always --privileged=true \

-e FOLIB_PORT=38080 \

-e FOLIB_JVM_XMX=8192m \

-e FOLIB_JVM_XMS=8192m \

-e FOLIB_JVM_XSS=512k \

-e FOLIB_MYSQL_HOST=127.0.0.1 \

-e FOLIB_MYSQL_PORT=3306 \

-e FOLIB_MYSQL_DB=folib \

-e FOLIB_MYSQL_USER=root \

-e FOLIB_MYSQL_PASSWORD=folib@v587 \

-e FOLIB_ARTIFACT_UPLOAD_RESTRICTIONS=true \

-v /data/folib/folib-conf:/opt/folib/folib-3.0-SNAPSHOT/etc/conf \

-v /data/folib/folib-data:/opt/folib/folib-data \

-v /data/folib/tmp:/opt/folib/folib-3.0-SNAPSHOT/tmp \

public.folib.com/oss/docker/folib-server:latest

3、查看日志

docker logs -f --tail 100 folib-server

4、重启

docker restart folib-server

docker logs -f --tail 100 folib-server

# 用户名: admin

# 密码: folib@v587

虚机启动

Tips: JAVA环境需要先准备好

1、将folib-build模块下的/target/folib-build-3.0-SNAPSHOT.tar.gz或者/target/folib-build-3.0-SNAPSHOT.zip解压

2、将解压后的folib-build-3.0-SNAPSHOT目录下的folib-3.0-SNAPSHOT、folib-data拷贝至部署机器的/opt/folib目录下

3、准备启动脚本

#!/bin/bash

# 配置环境变量

export FOLIB_PORT=38080 # 服务对外访问端口

export FOLIB_JVM_XMX=8192m

export FOLIB_JVM_XMS=8192m

export FOLIB_JVM_XSS=512k

export FOLIB_MYSQL_HOST=127.0.0.1 # 数据库IP

export FOLIB_MYSQL_PORT=3306 # 数据库端口

export FOLIB_MYSQL_DB=folib # 数据库名称

export FOLIB_MYSQL_USER=root # 数据库账号

export FOLIB_MYSQL_PASSWORD=folib@v587 # 数据库密码

export FOLIB_ARTIFACT_UPLOAD_RESTRICTIONS=true

# 启动folib-server

nohup /opt/folib/folib-3.0-SNAPSHOT/bin/folib console > folib-server.log 2>&1 &

4、将3步骤保存到folib-server-start.sh中

5、授权

chmod u+x folib-server-start.sh

6、启动folib-server

sh folib-server-start.sh

7、查看日志

tail -f -n 100 folib-server.log

8、启动完成后,重启

/opt/folib/folib-3.0-SNAPSHOT/bin/folib stop

sh folib-server-start.sh

tail -f -n 100 folib-server.log

用户名: admin 密码: folib@v587

你也可以通过 HelmChat 快速部署 Folib。

如果是内网环境,推荐使用 离线安装包方式 进行安装部署。

如你有更多问题,可以通过论坛和技术交流群与我们交流。

技术交流群

欢迎加入我们的技术交流群,还有不定期的各种活动。

版本说明

FOLib 会平均每个季度一个版本。版本更新列表请看Change-Log,

当前最新版本为V3.10。支持仓颉语言的 cjpm ,我们在此基础上,开源了一个cjpmp,工具详情请见folib-cjpmp。

V3.20产品预告

下个版本将支持ModelScope/Swift,另外FOLib 产品版本分为社区版和企业版,详情请参见:FOLib产品版本对比

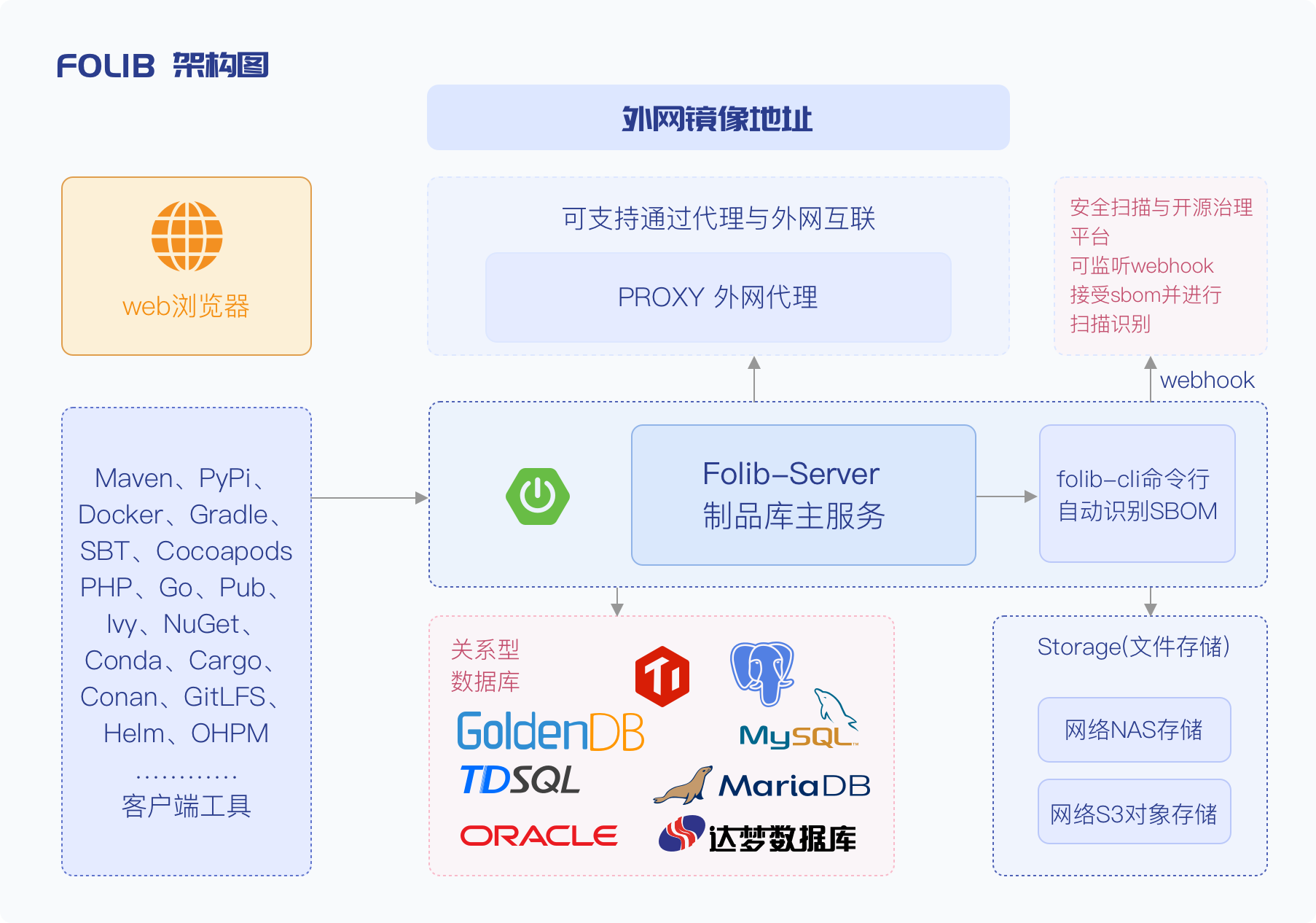

技术栈与架构

- 后端: Spring Boot3.x

- 前端: Vue.js

- 关系型数据库: 大部分数据库都支持

- 基础设施: Docker

- 文件存储: NFS/S3协议均支持

前端打包成静态资源文件后与后端放在一起进行打包。

开发编译说明

环境准备

- 安装 [OPENJDK 17](URL_ADDRESS- 安装 [OPENJDK 17](https://www.oracle.com/java/technologies

- 安装maven 3.8.6

- 安装node 14.21.3

编译执行

在代码根路径下找到folib-package.sh文件并进行执行

sh folib-package.sh

License & Copyright

Folib - [新一代AI制品仓库] Copyright (C) 2025 bocloud.com.cn folib@beyondcent.com

This program is free software: you can redistribute it and/or modify it under the terms of the GNU General Public License as published by the Free Software Foundation, either version 3 of the License, or (at your option) any later version.

本程序是自由软件:您可依据GNU通用公共许可证(GPL-3.0+)条款重新发布和修改, 但禁止任何形式的商业售卖行为(包括但不限于:直接销售、捆绑销售、云服务商用)。

This program is distributed WITHOUT ANY WARRANTY. Commercial sale of this software is expressly prohibited.

For license details, see: https://www.gnu.org/licenses/gpl-3.0.html 商业授权咨询请联系:folib@beyondcent.com

版本历史

3.1.02025/09/23相似工具推荐

openclaw

OpenClaw 是一款专为个人打造的本地化 AI 助手,旨在让你在自己的设备上拥有完全可控的智能伙伴。它打破了传统 AI 助手局限于特定网页或应用的束缚,能够直接接入你日常使用的各类通讯渠道,包括微信、WhatsApp、Telegram、Discord、iMessage 等数十种平台。无论你在哪个聊天软件中发送消息,OpenClaw 都能即时响应,甚至支持在 macOS、iOS 和 Android 设备上进行语音交互,并提供实时的画布渲染功能供你操控。 这款工具主要解决了用户对数据隐私、响应速度以及“始终在线”体验的需求。通过将 AI 部署在本地,用户无需依赖云端服务即可享受快速、私密的智能辅助,真正实现了“你的数据,你做主”。其独特的技术亮点在于强大的网关架构,将控制平面与核心助手分离,确保跨平台通信的流畅性与扩展性。 OpenClaw 非常适合希望构建个性化工作流的技术爱好者、开发者,以及注重隐私保护且不愿被单一生态绑定的普通用户。只要具备基础的终端操作能力(支持 macOS、Linux 及 Windows WSL2),即可通过简单的命令行引导完成部署。如果你渴望拥有一个懂你

stable-diffusion-webui

stable-diffusion-webui 是一个基于 Gradio 构建的网页版操作界面,旨在让用户能够轻松地在本地运行和使用强大的 Stable Diffusion 图像生成模型。它解决了原始模型依赖命令行、操作门槛高且功能分散的痛点,将复杂的 AI 绘图流程整合进一个直观易用的图形化平台。 无论是希望快速上手的普通创作者、需要精细控制画面细节的设计师,还是想要深入探索模型潜力的开发者与研究人员,都能从中获益。其核心亮点在于极高的功能丰富度:不仅支持文生图、图生图、局部重绘(Inpainting)和外绘(Outpainting)等基础模式,还独创了注意力机制调整、提示词矩阵、负向提示词以及“高清修复”等高级功能。此外,它内置了 GFPGAN 和 CodeFormer 等人脸修复工具,支持多种神经网络放大算法,并允许用户通过插件系统无限扩展能力。即使是显存有限的设备,stable-diffusion-webui 也提供了相应的优化选项,让高质量的 AI 艺术创作变得触手可及。

ComfyUI

ComfyUI 是一款功能强大且高度模块化的视觉 AI 引擎,专为设计和执行复杂的 Stable Diffusion 图像生成流程而打造。它摒弃了传统的代码编写模式,采用直观的节点式流程图界面,让用户通过连接不同的功能模块即可构建个性化的生成管线。 这一设计巧妙解决了高级 AI 绘图工作流配置复杂、灵活性不足的痛点。用户无需具备编程背景,也能自由组合模型、调整参数并实时预览效果,轻松实现从基础文生图到多步骤高清修复等各类复杂任务。ComfyUI 拥有极佳的兼容性,不仅支持 Windows、macOS 和 Linux 全平台,还广泛适配 NVIDIA、AMD、Intel 及苹果 Silicon 等多种硬件架构,并率先支持 SDXL、Flux、SD3 等前沿模型。 无论是希望深入探索算法潜力的研究人员和开发者,还是追求极致创作自由度的设计师与资深 AI 绘画爱好者,ComfyUI 都能提供强大的支持。其独特的模块化架构允许社区不断扩展新功能,使其成为当前最灵活、生态最丰富的开源扩散模型工具之一,帮助用户将创意高效转化为现实。

gemini-cli

gemini-cli 是一款由谷歌推出的开源 AI 命令行工具,它将强大的 Gemini 大模型能力直接集成到用户的终端环境中。对于习惯在命令行工作的开发者而言,它提供了一条从输入提示词到获取模型响应的最短路径,无需切换窗口即可享受智能辅助。 这款工具主要解决了开发过程中频繁上下文切换的痛点,让用户能在熟悉的终端界面内直接完成代码理解、生成、调试以及自动化运维任务。无论是查询大型代码库、根据草图生成应用,还是执行复杂的 Git 操作,gemini-cli 都能通过自然语言指令高效处理。 它特别适合广大软件工程师、DevOps 人员及技术研究人员使用。其核心亮点包括支持高达 100 万 token 的超长上下文窗口,具备出色的逻辑推理能力;内置 Google 搜索、文件操作及 Shell 命令执行等实用工具;更独特的是,它支持 MCP(模型上下文协议),允许用户灵活扩展自定义集成,连接如图像生成等外部能力。此外,个人谷歌账号即可享受免费的额度支持,且项目基于 Apache 2.0 协议完全开源,是提升终端工作效率的理想助手。

LLMs-from-scratch

LLMs-from-scratch 是一个基于 PyTorch 的开源教育项目,旨在引导用户从零开始一步步构建一个类似 ChatGPT 的大型语言模型(LLM)。它不仅是同名技术著作的官方代码库,更提供了一套完整的实践方案,涵盖模型开发、预训练及微调的全过程。 该项目主要解决了大模型领域“黑盒化”的学习痛点。许多开发者虽能调用现成模型,却难以深入理解其内部架构与训练机制。通过亲手编写每一行核心代码,用户能够透彻掌握 Transformer 架构、注意力机制等关键原理,从而真正理解大模型是如何“思考”的。此外,项目还包含了加载大型预训练权重进行微调的代码,帮助用户将理论知识延伸至实际应用。 LLMs-from-scratch 特别适合希望深入底层原理的 AI 开发者、研究人员以及计算机专业的学生。对于不满足于仅使用 API,而是渴望探究模型构建细节的技术人员而言,这是极佳的学习资源。其独特的技术亮点在于“循序渐进”的教学设计:将复杂的系统工程拆解为清晰的步骤,配合详细的图表与示例,让构建一个虽小但功能完备的大模型变得触手可及。无论你是想夯实理论基础,还是为未来研发更大规模的模型做准备

Deep-Live-Cam

Deep-Live-Cam 是一款专注于实时换脸与视频生成的开源工具,用户仅需一张静态照片,即可通过“一键操作”实现摄像头画面的即时变脸或制作深度伪造视频。它有效解决了传统换脸技术流程繁琐、对硬件配置要求极高以及难以实时预览的痛点,让高质量的数字内容创作变得触手可及。 这款工具不仅适合开发者和技术研究人员探索算法边界,更因其极简的操作逻辑(仅需三步:选脸、选摄像头、启动),广泛适用于普通用户、内容创作者、设计师及直播主播。无论是为了动画角色定制、服装展示模特替换,还是制作趣味短视频和直播互动,Deep-Live-Cam 都能提供流畅的支持。 其核心技术亮点在于强大的实时处理能力,支持口型遮罩(Mouth Mask)以保留使用者原始的嘴部动作,确保表情自然精准;同时具备“人脸映射”功能,可同时对画面中的多个主体应用不同面孔。此外,项目内置了严格的内容安全过滤机制,自动拦截涉及裸露、暴力等不当素材,并倡导用户在获得授权及明确标注的前提下合规使用,体现了技术发展与伦理责任的平衡。