SARDet_100K

SARDet_100K 是一个面向合成孔径雷达(SAR)图像的大规模目标检测开源项目,包含一个包含10万张标注图像的数据集及配套的基准算法实现。它解决了SAR目标检测领域长期缺乏高质量、大规模公开数据集和统一评估标准的问题,为该方向的研究提供了坚实基础。SARDet_100K 特别适合遥感、计算机视觉领域的研究人员和开发者使用,尤其适用于希望探索雷达图像理解、旋转目标检测或国防与民用遥感应用的团队。项目还引入了多尺度特征对齐(MSFA)等技术,并支持后续工作如DenoDet(用于SAR图像去噪检测)和RSAR(提供带角度标注的旋转检测基准),形成了较为完整的SAR检测工具链。通过开放数据与代码,SARDet_100K 有效降低了进入该领域的门槛,助力学术界和工业界在这一具有国家战略价值的方向上加速创新。

使用场景

某国防科技团队正在研发一套基于合成孔径雷达(SAR)图像的海上舰船自动识别系统,用于全天候、全天时的海洋监视任务。

没有 SARDet_100K 时

- 缺乏公开的大规模 SAR 目标检测数据集,只能依赖少量私有或小规模数据(如 MSTAR),难以训练鲁棒的深度学习模型。

- 现有开源代码稀少且不统一,复现论文效果困难,调试和对比实验耗时耗力。

- SAR 图像特有的斑点噪声和旋转目标特性导致通用检测算法(如 Faster R-CNN)性能骤降,需自行设计复杂预处理流程。

- 团队成员需花费大量时间从零构建数据标注规范和评估基准,拖慢整体研发进度。

- 难以验证模型在多类别、大尺度变化下的泛化能力,系统上线风险高。

使用 SARDet_100K 后

- 直接使用包含 10 万张图像、覆盖 10 类海上/陆地目标的 SARDet_100K 数据集,快速启动模型训练与验证。

- 基于官方提供的完整代码库(含 MSFA 和 DenoDet 等先进方法),轻松复现 SOTA 结果并进行二次开发。

- 利用内置的旋转框标注和去噪模块,显著提升对倾斜舰船目标的检测精度,mAP 提升超 15%。

- 借助统一的评估协议和预训练模型,团队两周内完成基线搭建,研发周期缩短近 60%。

- 可无缝迁移到其姊妹项目 RSAR 的旋转检测基准,为后续算法升级预留技术路径。

SARDet_100K 将原本封闭、低效的 SAR 目标检测研发转变为开放、标准化的高效开发流程,真正打通了从学术研究到工程落地的“最后一公里”。

运行环境要求

- Linux

- macOS

- Windows

未说明

未说明

快速开始

🔥🔥 SARDet-100K 已被 NeurIPS 2024 接收为 spotlight 论文!!

🔥🔥 我们的新工作 RSAR 被 CVPR 2025 接收!!!

"RSAR: Restricted State Angle Resolver and Rotated SAR Benchmark"

该工作包含一个大规模多类别旋转 SAR(合成孔径雷达)目标检测数据集,是 SARDet-100K 的近似旋转标注版本。

本仓库现已支持 DenoDet!!

"DenoDet: Attention as Deformable Multi-Subspace Feature Denoising for Target Detection in SAR Images" 见:https://arxiv.org/pdf/2406.02833

Jittor 版本实现在 NK-JittorCV/nk-det

"SARDet-100K: Towards Open-Source Benchmark and ToolKit for Large-Scale SAR Object Detection" 见:https://arxiv.org/pdf/2403.06534.pdf

李宇轩,李翔*,李玮杰,侯淇彬,刘丽,程明明,杨健*

走过路过不要错过!!

面对2024年的科研战场,你是否感到了前所未有的科研压力?计算机视觉的各大任务仿佛已经达到了饱和点,榜单一次又一次被那些拥有海量数据和计算资源的大模型所主宰。对于我们这些还在校园里奋斗的学生来说,手头的资源始终显得那么微不足道,似乎永远也竞争不过那些垄断科研的巨头。每一个方向似乎都被人挖得满满的,想发表一篇paper变得越来越难,快毕业的你是否也在焦虑地寻找一个真正属于自己的研究方向?多少次,我们都幻想能回到15年前ImageNet发布的那个夜晚,那时候没有群魔乱舞的注意力机制,也没有数以Billion计参数的大模型,每一个任务都是一片待开垦的蓝海……

但是今天,告诉你,有这么一个方向,曾一度因为缺乏大规模数据集和寥寥无几的开源代码而默默无闻,它的发展似乎一直滞后。但随着开源大规模数据集的诞生和完善的代码库的出现,之前的难题统统烟消云散。现在,就如同被一道闪电击中,穿越回了数年前,还有一片未被充分开发的蓝海正展现在你的眼前,等待你去探索、去征服。

所以,你想知道我说的是什么领域吗?今天,你不需要支付998,也不需要98,只需在 GitHub 上给我们一个Star,SAR目标检测的大礼包就能免费带回家!这里有你需要的一切:从大规模数据集到详尽的实现代码,我们都为你准备好了。是的,我在说的就是遥感目标检测的掌上明珠:SAR(合成孔径雷达)目标检测!可能听起来有些神秘,但这个领域的潜力和含金量,真正懂的人都心照不宣,DDDD,YYDS!它不仅完美契合当前的国家战略需求,而且无论是在科研界还是工业界,都有着广阔的应用前景和无限的可能性。近年来,在SAR检测领域发表文章变得更加容易,这预示着这一领域的迅速发展和对新思想、新技术的渴求。现在就加入SAR目标检测的行列吧!它就像15年前的比特币,20年前的房地产,现在入局不后悔!让我们一起驰骋在这片广袤的蓝海之中,探索它的未知之处,共同开拓它的无限可能!

Don't miss out as you pass by!

Facing the scientific research battlefield of 2024, do you feel unprecedented pressure in research? The major tasks in Computer Vision seem to have reached a saturation point, with the charts being dominated time and again by large models that have access to massive data and computational resources. For those of us still striving in academia, our resources always seem so insignificant, as if we could never compete with those giants monopolizing research. Every direction seems to be thoroughly explored, making it increasingly difficult to publish a paper. Are you, about to graduate, also anxiously looking for a research direction that truly belongs to you? How many times have we fantasized about going back to the night when ImageNet was released 15 years ago, when there was no chaotic dance of attention mechanisms, no models with billions of parameters, and every task was an uncharted blue ocean...

But today, let me tell you my friend, about a direction that once lingered in obscurity due to the lack of large-scale datasets and scarce open-source codes, its development seemed to be always lagging. But with the emergence of open-source large-scale datasets and comprehensive code libraries, all previous problems have vanished like smoke. Now, as if struck by lightning and transported back several years, there is an undeveloped blue ocean in front of you, waiting for you to explore and conquer.

So, do you want to know what field I am talking about? Today, you don't need to pay 998, not even 98, just give us a Star on GitHub, and the SAR object detection big gift pack can be taken home for free! Here you have everything you need: from large-scale datasets to detailed implementation codes, we have prepared everything for you. Yes, I am talking about the jewel in the crown of remote sensing target detection: SAR (Synthetic Aperture Radar) object detection! It might sound mysterious, but the potential and value of this field are well understood by those in the know. It not only perfectly matches the current national strategic needs but also has a wide range of applications and limitless possibilities in both the scientific and industrial communities. In recent years, publishing articles in the SAR detection field has become easier, indicating the rapid development of this field and its thirst for new ideas and technologies. Join the ranks of SAR object detection now! It's like Bitcoin 15 years ago, real estate 20 years ago, getting involved now is something you won't regret! Let's gallop together in this vast blue ocean, explore its unknowns, and jointly tap into its limitless possibilities!

摘要

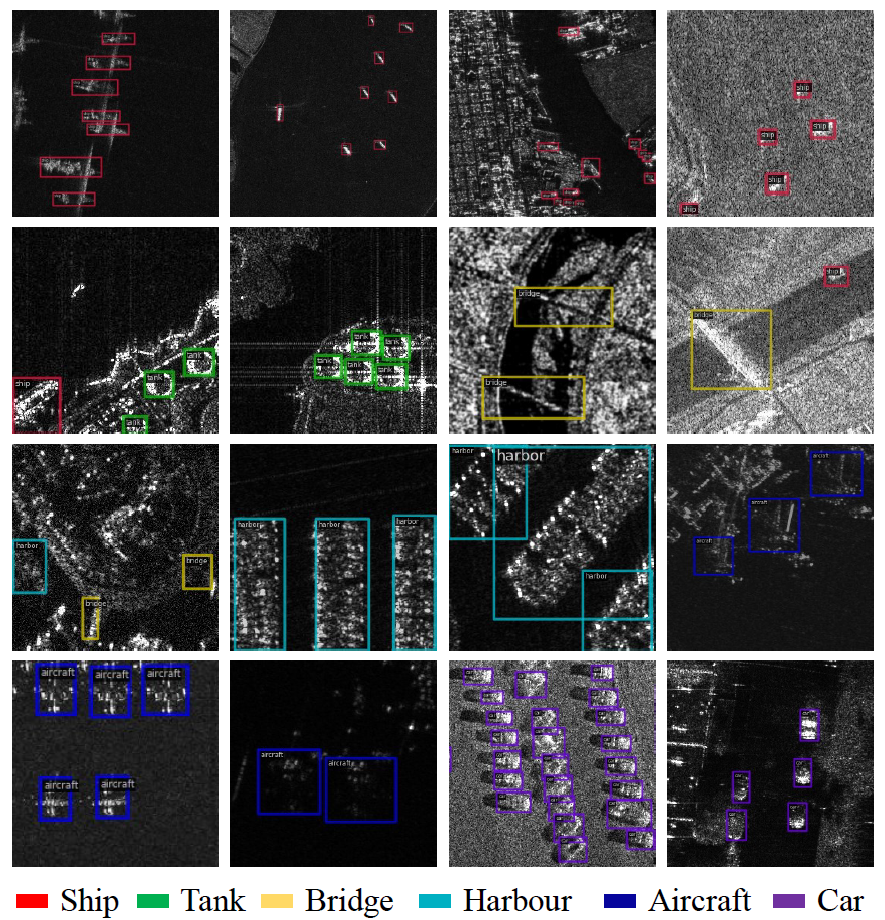

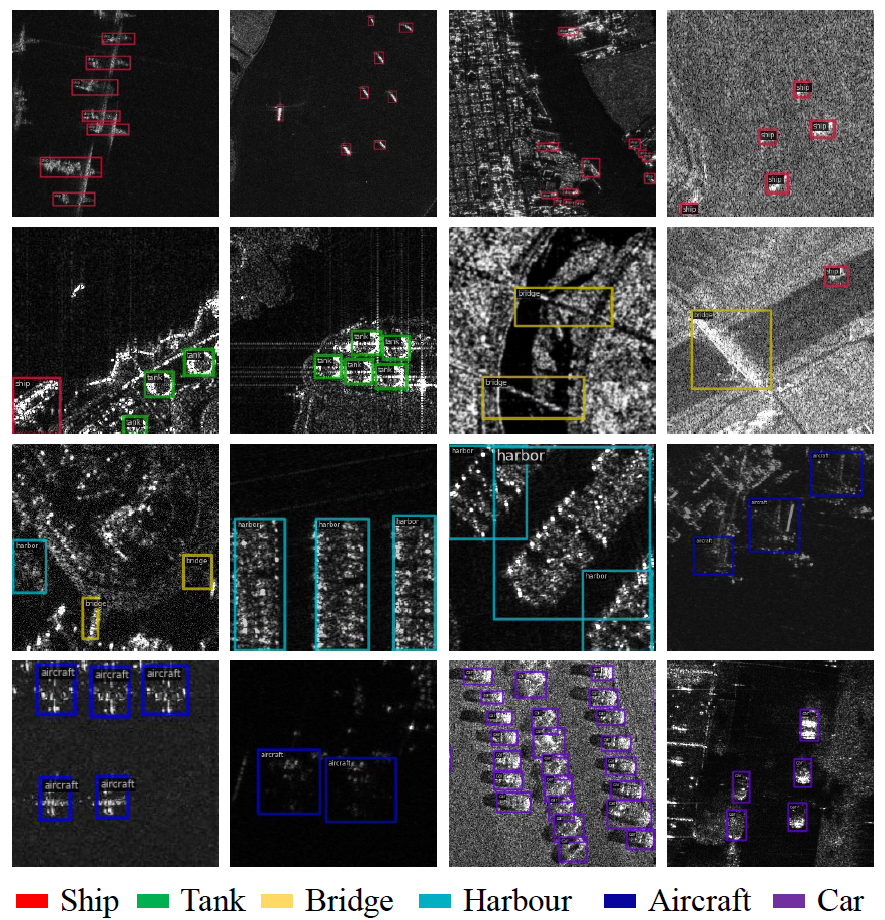

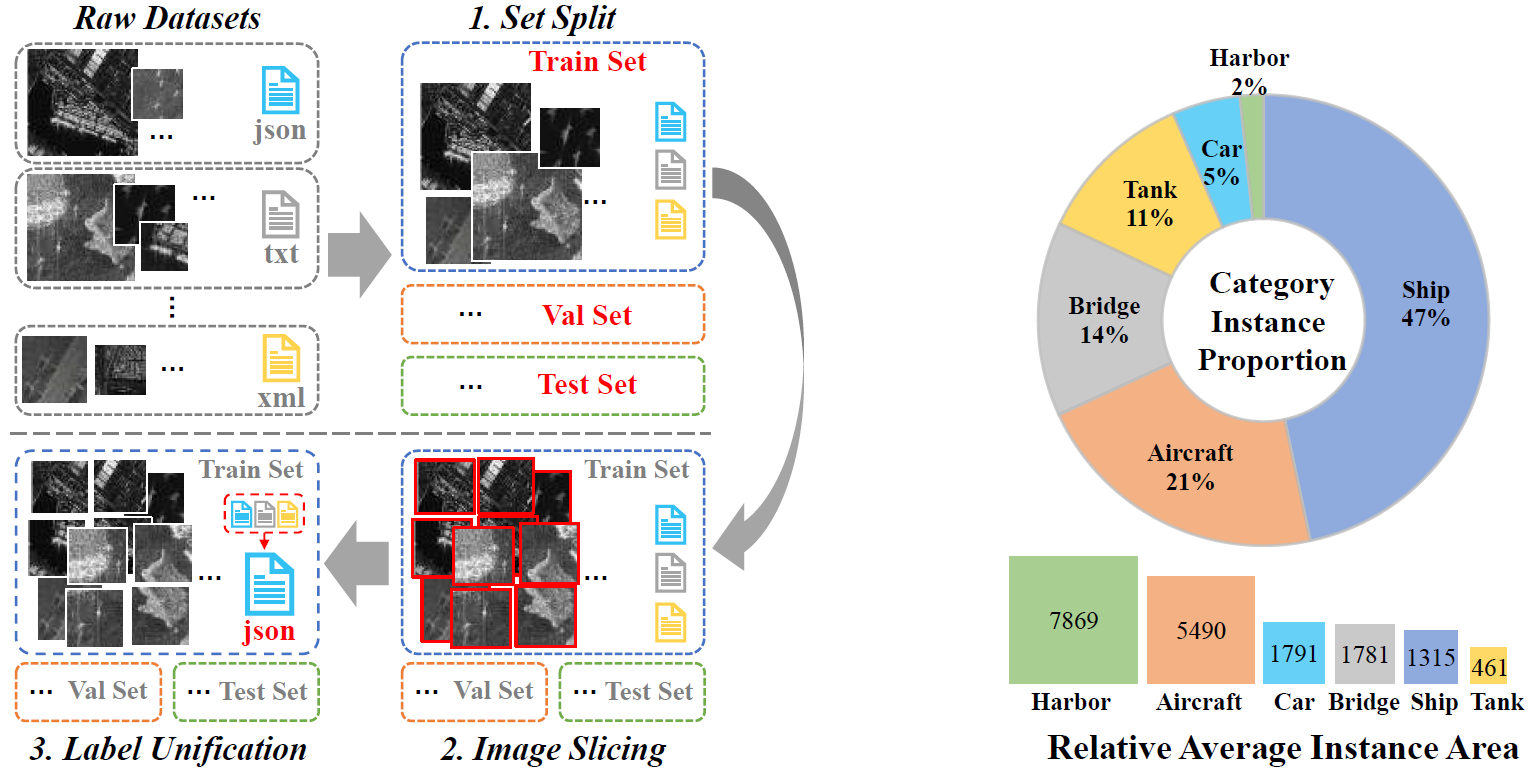

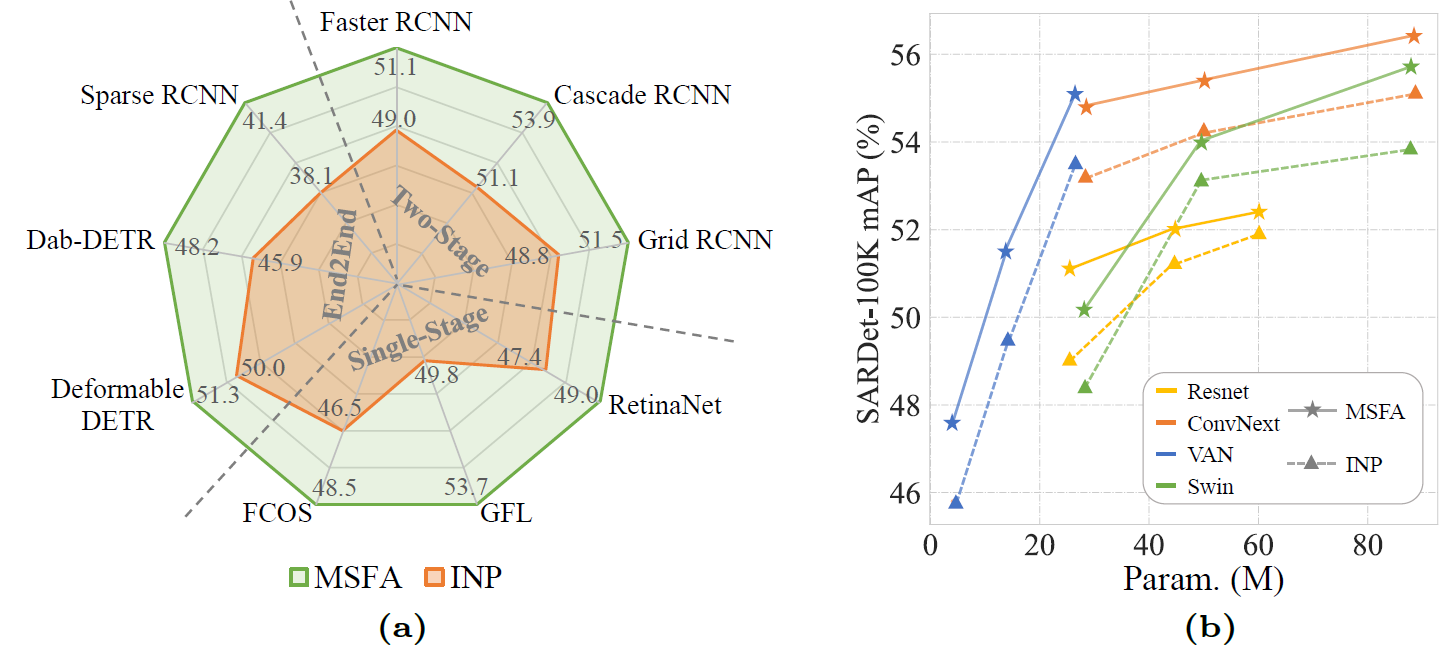

合成孔径雷达(Synthetic Aperture Radar, SAR)目标检测因其不可替代的全天候成像能力而受到广泛关注。然而,该研究领域长期受限于公开数据集规模有限(大多包含少于2K张图像,且仅含单一类别目标)以及源代码难以获取。为应对这些挑战,我们构建了一个面向大规模 SAR 目标检测的新基准数据集及开源方法。我们的数据集 SARDet-100K 是通过对10个现有 SAR 检测数据集进行深入调研、收集与标准化整合而成,为研究提供了大规模且多样化的数据资源。据我们所知,SARDet-100K 是首个达到 COCO 级别的大规模多类别 SAR 目标检测数据集。基于这一高质量数据集,我们开展了全面实验,并揭示了 SAR 目标检测中的一个关键挑战:在 RGB 数据集上的预训练与在 SAR 数据集上的微调之间,在数据域和模型结构方面存在显著差异。为弥合这些差距,我们提出了一种新颖的多阶段滤波增强(Multi-Stage with Filter Augmentation, MSFA)预训练框架,从数据输入、域迁移和模型迁移三个角度系统性地解决上述问题。所提出的 MSFA 方法显著提升了 SAR 目标检测模型的性能,并在多种模型上展现出卓越的泛化能力与灵活性。本工作旨在为 SAR 目标检测领域的进一步发展铺平道路。

引言

本仓库是论文 "SARDet-100K: Towards Open-Source Benchmark and ToolKit for Large-Scale SAR Object Detection" 的官方代码库,论文地址:https://arxiv.org/pdf/2403.06534.pdf

数据集下载地址:

(训练集、验证集、测试集)

模型权重下载地址:

(目前仅发布了训练集和验证集。)

| 数据集 | 图像数量 | 实例数量 | 实例/图像 | ||||||

| 训练集 | 验证集 | 测试集 | 总计 | 训练集 | 验证集 | 测试集 | 总计 | ||

| AIR_SARShip 1* | 438 | 23 | 40 | 501 | 816 | 33 | 209 | 1,058 | 2.11 |

| AIR_SARShip 2 | 270 | 15 | 15 | 300 | 1,819 | 127 | 94 | 2,040 | 6.80 |

| HRSID | 3,642 | 981 | 981 | 5,604 | 11,047 | 2,975 | 2,947 | 16,969 | 3.03 |

| MSAR* | 27,159 | 1,479 | 1,520 | 30,158 | 58,988 | 3,091 | 3,123 | 65,202 | 2.16 |

| SADD | 795 | 44 | 44 | 883 | 6,891 | 448 | 496 | 7,835 | 8.87 |

| SAR-AIRcraft* | 13,976 | 1,923 | 2,989 | 18,888 | 27,848 | 4,631 | 5,996 | 38,475 | 2.04 |

| ShipDataset | 31,784 | 3,973 | 3,972 | 39,729 | 40,761 | 5,080 | 5,044 | 50,885 | 1.28 |

| SSDD | 928 | 116 | 116 | 1,160 | 2,041 | 252 | 294 | 2,587 | 2.23 |

| OGSOD | 14,664 | 1,834 | 1,833 | 18,331 | 38,975 | 4,844 | 4,770 | 48,589 | 2.65 |

| SIVED | 837 | 104 | 103 | 1,044 | 9,561 | 1,222 | 1,230 | 12,013 | 11.51 |

| SARDet-100k | 94,493 | 10,492 | 11,613 | 116,598 | 198,747 | 22,703 | 24,023 | 245,653 | 2.11 |

| 数据集 | 目标 | 分辨率 (m) | 波段 | 极化方式 | 卫星 |

| AIR_SARShip | S | 1,3m | C | VV | GF-3 |

| HRSID | S | 0.5~3m | C/X | HH, HV, VH, VV | S-1B,TerraSAR-X,TanDEMX |

| MSAR | A, T, B, S | < 1m | C | HH, HV, VH, VV | HISEA-1 |

| SADD | A | 0.5~3m | X | HH | TerraSAR-X |

| SAR-AIRcraft | A | 1m | C | 单极化(Uni-polar) | GF-3 |

| ShipDataset | S | 3~25m | C | HH, VV, VH, HV | S-1,GF-3 |

| SSDD | S | 1~15m | C/X | HH, VV, VH, HV | S-1,RadarSat-2,TerraSAR-X |

| OGSOD | B, H, T | 3m | C | VV/VH | GF-3 |

| SIVED | C | 0.1,0.3m | Ka,Ku,X | VV/HH | 机载 SAR 合成切片(Airborne SAR synthetic slice) |

MSFA:多阶段滤波增强(Multi-Stage with Filter Augmentation)预训练框架

简介

本仓库是论文《SARDet-100K: Towards Open-Source Benchmark and ToolKit for Large-Scale SAR Object Detection》中提出的多阶段滤波增强(MSFA)预训练框架的官方实现。

滤波增强(Filter Augmentation)代码位于 MSFA/msfa/models/backbones/MSFA.py。

SARDet-100K 数据集相关代码位于 MSFA/msfa/datasets/SAR_Det.py。

论文中使用的训练/测试配置文件位于 local_configs 目录下。

结果与模型

| 模型输入 | 预训练(Pretrain) | mAP | 配置(Config) | 权重(Weight) | ||||||||||||||||||||||||||||||||||

| 多阶段(Multi-stage) | 数据集(Dataset) | 组件(Component) | ||||||||||||||||||||||||||||||||||||

|

SAR (原始像素) |

✕ | ImageNet | 主干网络(Backbone) | 49.0 | config | weight | ||||||||||||||||||||||||||||||||

√|

ImageNet + DIOR

|

整体框架(Framework)

|

49.5

|

config

|

weight

|

√ |

ImageNet + DOTA

|

主干网络(Backbone)

|

49.3

|

config

|

weight

|

整体框架(Framework)

|

50.2

|

config

|

weight

|

SAR+WST | (滤波增强)

✕ |

ImageNet

|

主干网络(Backbone)

|

49.2

|

config

|

weight

|

√ |

ImageNet + DIOR

|

整体框架(Framework)

|

50.1

|

config

|

weight

|

√ |

ImageNet + DOTA

|

主干网络(Backbone)

|

49.6

|

config

|

weight

|

整体框架(Framework)

|

51.1

|

config

|

weight

| |

AI 工具分析助手

你是一个专业的 AI 工具分析助手,擅长将英文技术内容翻译和整理为中文。

| 框架 | 预训练/模型 | 测试指标 | 配置文件 | 权重 | ||||||

| mAP | @50 | @75 | @s | @m | @l | |||||

|

两阶段

(Two Stage) | Faster RCNN | IMP | 49.0 | 82.2 | 52.9 | 43.5 | 60.6 | 55.0 | config | weight |

| MSFA | 51.1 (+2.1) | 83.9 | 54.7 | 45.2 | 62.3 | 57.5 | config | weight | ||

| Cascade RCNN | IMP | 51.1 | 81.9 | 55.8 | 44.9 | 62.9 | 60.3 | config | weight | |

| MSFA | 53.9 (+2.8) | 83.4 | 59.8 | 47.2 | 66.1 | 63.2 | config | weight | ||

| Grid RCNN | IMP | 48.8 | 79.1 | 52.9 | 42.4 | 61.9 | 55.5 | config | weight | |

| MSFA | 51.5 (+2.7) | 81.7 | 56.3 | 45.1 | 64.1 | 60.0 | config | weight | ||

|

单阶段

(Single Stage) | RetinaNet | IMP | 47.4 | 79.3 | 49.7 | 40.0 | 59.2 | 57.5 | config | weight |

| MSFA | 49.0 (+1.6) | 80.1 | 52.6 | 41.3 | 61.1 | 59.4 | config | weight | ||

| GFL | IMP | 49.8 | 80.9 | 53.3 | 42.3 | 62.4 | 58.1 | config | weight | |

| MSFA | 53.7 (+3.9) | 84.2 | 57.8 | 47.8 | 66.2 | 59.5 | config | weight | ||

| DenoDet | 55.4 (+5.6) | 84.7 | 58.3 | 49.5 | 67.6 | 63.2 | config | weight | ||

| FCOS | IMP | 46.5 | 80.9 | 49.0 | 41.1 | 59.2 | 50.4 | config | weight | |

| MSFA | 48.5 (+2.0) | 82.1 | 51.4 | 42.9 | 60.4 | 56.0 | config | weight | ||

|

端到端

(End to End) | DETR | IMP | 31.8 | 62.3 | 30.0 | 22.2 | 44.9 | 41.1 | config | weight |

| MSFA | 47.2 (+15.4) | 77.5 | 49.8 | 37.9 | 62.9 | 58.2 | config | weight | ||

| Deformable DETR | IMP | 50.0 | 85.1 | 51.7 | 44.0 | 65.1 | 61.2 | config | weight | |

| MSFA | 51.3 (+1.3) | 85.3 | 54.0 | 44.9 | 65.6 | 61.7 | config | weight | ||

|

| ||||||||||

| Framework | #P(M) | Pretrain | Test | Config | Weight | |||||

| mAP | @50 | @75 | @s | @m | @l | |||||

| R50 | 25.6 | IMP | 49.0 | 82.2 | 52.9 | 43.5 | 60.6 | 55.0 | config | weight |

| MSFA | 51.1 (+2.1) | 83.9 | 54.7 | 45.2 | 62.3 | 57.5 | config | weight | ||

| R101 | 44.7 | IMP | 51.2 | 84.1 | 55.6 | 45.9 | 61.9 | 56.3 | config | weight |

| MSFA | 52.0 (+0.8) | 84.6 | 56.6 | 46.6 | 63.4 | 57.7 | config | weight | ||

| R152 | 60.2 | IMP | 51.9 | 85.2 | 55.9 | 46.4 | 62.5 | 57.9 | config | weight |

| MSFA | 52.4 (+0.5) | 85.4 | 57.2 | 47.4 | 63.3 | 58.7 | config | weight | ||

| ConvNext-T | 28.6 | IMP | 53.2 | 86.3 | 58.1 | 47.2 | 65.2 | 59.6 | config | weight |

| MSFA | 54.8 (+1.6) | 87.1 | 59.8 | 48.8 | 66.7 | 62.1 | config | weight | ||

| ConvNext-S | 50.1 | IMP | 54.2 | 87.8 | 59.2 | 49.2 | 65.8 | 59.8 | config | weight |

| MSFA | 55.4 (+1.2) | 87.6 | 60.7 | 50.1 | 67.1 | 61.3 | config | weight | ||

| ConvNext-B | 88.6 | IMP | 55.1 | 87.8 | 59.5 | 48.9 | 66.9 | 61.1 | config | weight |

| MSFA | 56.4 (+1.3) | 88.2 | 61.5 | 51.1 | 68.3 | 62.4 | config | weight | ||

| VAN-T | 4.1 | IMP | 45.8 | 79.8 | 48.0 | 38.6 | 57.9 | 53.3 | config | weight |

| MSFA | 47.6 (+1.8) | 81.4 | 50.6 | 40.5 | 59.4 | 56.7 | config | weight | ||

| VAN-S | 13.9 | IMP | 49.5 | 83.8 | 52.8 | 43.2 | 61.6 | 56.4 | config | weight |

| MSFA |

51.5 (+2.0)

安装我们的代码依赖于 PyTorch、MMCV 和 MMDetection。 快速开始有关 MMDetection 的基本用法,请参阅 get_started.md。 致谢我们向 Bo Zhang、Chenglong Li、Tian Tian、Tianwen Zhang、Xiaoling Zhang(按名字首字母排序)以及众多其他研究人员致以最诚挚的感谢,感谢他们允许我们集成其数据集。他们的贡献极大地推动并促进了该领域的研究发展。 引用如果您在研究中使用了本工具箱或基准,请引用本项目。 Star 历史许可证本项目采用 署名-非商业性使用 4.0 国际许可协议(Attribution-NonCommercial 4.0 International) 发布。 常见问题相似工具推荐stable-diffusion-webuistable-diffusion-webui 是一个基于 Gradio 构建的网页版操作界面,旨在让用户能够轻松地在本地运行和使用强大的 Stable Diffusion 图像生成模型。它解决了原始模型依赖命令行、操作门槛高且功能分散的痛点,将复杂的 AI 绘图流程整合进一个直观易用的图形化平台。 无论是希望快速上手的普通创作者、需要精细控制画面细节的设计师,还是想要深入探索模型潜力的开发者与研究人员,都能从中获益。其核心亮点在于极高的功能丰富度:不仅支持文生图、图生图、局部重绘(Inpainting)和外绘(Outpainting)等基础模式,还独创了注意力机制调整、提示词矩阵、负向提示词以及“高清修复”等高级功能。此外,它内置了 GFPGAN 和 CodeFormer 等人脸修复工具,支持多种神经网络放大算法,并允许用户通过插件系统无限扩展能力。即使是显存有限的设备,stable-diffusion-webui 也提供了相应的优化选项,让高质量的 AI 艺术创作变得触手可及。 162.1k|★★★☆☆|今天 ComfyUIComfyUI 是一款功能强大且高度模块化的视觉 AI 引擎,专为设计和执行复杂的 Stable Diffusion 图像生成流程而打造。它摒弃了传统的代码编写模式,采用直观的节点式流程图界面,让用户通过连接不同的功能模块即可构建个性化的生成管线。 这一设计巧妙解决了高级 AI 绘图工作流配置复杂、灵活性不足的痛点。用户无需具备编程背景,也能自由组合模型、调整参数并实时预览效果,轻松实现从基础文生图到多步骤高清修复等各类复杂任务。ComfyUI 拥有极佳的兼容性,不仅支持 Windows、macOS 和 Linux 全平台,还广泛适配 NVIDIA、AMD、Intel 及苹果 Silicon 等多种硬件架构,并率先支持 SDXL、Flux、SD3 等前沿模型。 无论是希望深入探索算法潜力的研究人员和开发者,还是追求极致创作自由度的设计师与资深 AI 绘画爱好者,ComfyUI 都能提供强大的支持。其独特的模块化架构允许社区不断扩展新功能,使其成为当前最灵活、生态最丰富的开源扩散模型工具之一,帮助用户将创意高效转化为现实。 107.7k|★★☆☆☆|2天前 ML-For-BeginnersML-For-Beginners 是由微软推出的一套系统化机器学习入门课程,旨在帮助零基础用户轻松掌握经典机器学习知识。这套课程将学习路径规划为 12 周,包含 26 节精炼课程和 52 道配套测验,内容涵盖从基础概念到实际应用的完整流程,有效解决了初学者面对庞大知识体系时无从下手、缺乏结构化指导的痛点。 无论是希望转型的开发者、需要补充算法背景的研究人员,还是对人工智能充满好奇的普通爱好者,都能从中受益。课程不仅提供了清晰的理论讲解,还强调动手实践,让用户在循序渐进中建立扎实的技能基础。其独特的亮点在于强大的多语言支持,通过自动化机制提供了包括简体中文在内的 50 多种语言版本,极大地降低了全球不同背景用户的学习门槛。此外,项目采用开源协作模式,社区活跃且内容持续更新,确保学习者能获取前沿且准确的技术资讯。如果你正寻找一条清晰、友好且专业的机器学习入门之路,ML-For-Beginners 将是理想的起点。 85k|★★☆☆☆|今天 ragflowRAGFlow 是一款领先的开源检索增强生成(RAG)引擎,旨在为大语言模型构建更精准、可靠的上下文层。它巧妙地将前沿的 RAG 技术与智能体(Agent)能力相结合,不仅支持从各类文档中高效提取知识,还能让模型基于这些知识进行逻辑推理和任务执行。 在大模型应用中,幻觉问题和知识滞后是常见痛点。RAGFlow 通过深度解析复杂文档结构(如表格、图表及混合排版),显著提升了信息检索的准确度,从而有效减少模型“胡编乱造”的现象,确保回答既有据可依又具备时效性。其内置的智能体机制更进一步,使系统不仅能回答问题,还能自主规划步骤解决复杂问题。 这款工具特别适合开发者、企业技术团队以及 AI 研究人员使用。无论是希望快速搭建私有知识库问答系统,还是致力于探索大模型在垂直领域落地的创新者,都能从中受益。RAGFlow 提供了可视化的工作流编排界面和灵活的 API 接口,既降低了非算法背景用户的上手门槛,也满足了专业开发者对系统深度定制的需求。作为基于 Apache 2.0 协议开源的项目,它正成为连接通用大模型与行业专有知识之间的重要桥梁。 77.1k|★★★☆☆|昨天 PaddleOCRPaddleOCR 是一款基于百度飞桨框架开发的高性能开源光学字符识别工具包。它的核心能力是将图片、PDF 等文档中的文字提取出来,转换成计算机可读取的结构化数据,让机器真正“看懂”图文内容。 面对海量纸质或电子文档,PaddleOCR 解决了人工录入效率低、数字化成本高的问题。尤其在人工智能领域,它扮演着连接图像与大型语言模型(LLM)的桥梁角色,能将视觉信息直接转化为文本输入,助力智能问答、文档分析等应用场景落地。 PaddleOCR 适合开发者、算法研究人员以及有文档自动化需求的普通用户。其技术优势十分明显:不仅支持全球 100 多种语言的识别,还能在 Windows、Linux、macOS 等多个系统上运行,并灵活适配 CPU、GPU、NPU 等各类硬件。作为一个轻量级且社区活跃的开源项目,PaddleOCR 既能满足快速集成的需求,也能支撑前沿的视觉语言研究,是处理文字识别任务的理想选择。 74.9k|★★★☆☆|今天 tesseractTesseract 是一款历史悠久且备受推崇的开源光学字符识别(OCR)引擎,最初由惠普实验室开发,后由 Google 维护,目前由全球社区共同贡献。它的核心功能是将图片中的文字转化为可编辑、可搜索的文本数据,有效解决了从扫描件、照片或 PDF 文档中提取文字信息的难题,是数字化归档和信息自动化的重要基础工具。 在技术层面,Tesseract 展现了强大的适应能力。从版本 4 开始,它引入了基于长短期记忆网络(LSTM)的神经网络 OCR 引擎,显著提升了行识别的准确率;同时,为了兼顾旧有需求,它依然支持传统的字符模式识别引擎。Tesseract 原生支持 UTF-8 编码,开箱即用即可识别超过 100 种语言,并兼容 PNG、JPEG、TIFF 等多种常见图像格式。输出方面,它灵活支持纯文本、hOCR、PDF、TSV 等多种格式,方便后续数据处理。 Tesseract 主要面向开发者、研究人员以及需要构建文档处理流程的企业用户。由于它本身是一个命令行工具和库(libtesseract),不包含图形用户界面(GUI),因此最适合具备一定编程能力的技术人员集成到自动化脚本或应用程序中 73.3k|★★☆☆☆|3天前 | |||||||||