xiaogpt

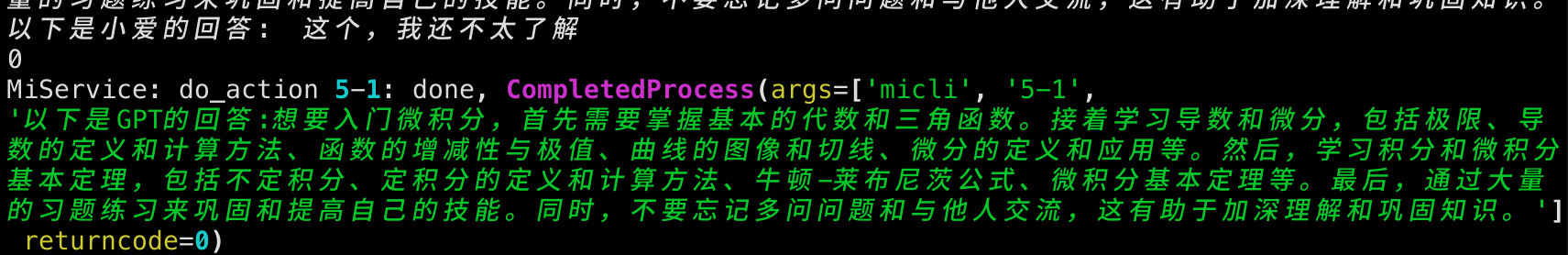

xiaogpt 是一款巧妙的开源工具,它能让小米小爱音箱“变身”为 ChatGPT、Gemini、通义千问等各大主流大模型的语音交互终端。通过该项目,用户只需对音箱说出以“帮我”开头的问题,音箱即可调用云端 AI 能力进行智能回答,并用自然流畅的语音反馈结果,从而突破原生音箱仅能执行固定指令的限制,实现真正的开放式人机对话。

这一方案主要解决了传统智能音箱在复杂问答、创意生成及逻辑推理场景下能力不足的问题,让旧款硬件也能享受最前沿的 AI 服务。它特别适合喜爱折腾智能家居的极客、希望低成本体验大模型语音交互的开发者,以及想要为家庭增添智能乐趣的普通用户。

xiaogpt 的技术亮点在于无需对音箱进行 Root 破解,仅需通过简单的命令行配置获取设备 DID 即可运行。它不仅支持多种大模型接口切换,还集成了 Edge、Azure、Fish Audio 等多种高质量 TTS(语音合成)引擎以提升听感,甚至支持基于 LangChain 的联网检索与数学运算。无论是通过 API 密钥还是账号密码,用户都能轻松部署,让家里的小爱同学瞬间拥有“最强大脑”。

使用场景

独居的程序员老张习惯在厨房边做饭边听技术播客,某天他想查询一段复杂的 Python 异步代码写法,却因双手沾满油污无法操作手机或电脑。

没有 xiaogpt 时

- 交互受限:小爱同学只能回答固定的百科知识或执行简单的智能家居指令,无法理解“如何用 asyncio 重写这个爬虫”等专业编程问题。

- 流程中断:必须停下手中的活,洗净擦干手后拿起手机搜索,打断烹饪节奏且容易弄脏设备屏幕。

- 信息滞后:内置的知识库更新缓慢,无法获取最新的 AI 模型特性或刚发布的技术文档内容。

- 体验割裂:若想获得高质量答案,需手动复制粘贴到 ChatGPT 网页版,无法通过语音直接获得流畅的自然语言回复。

使用 xiaogpt 后

- 能力跃升:通过配置

--use_chatgpt_api,小爱音响瞬间变身私人技术顾问,能精准解答复杂的代码逻辑和最新的技术概念。 - 无感交互:老张只需说出“帮我写一个基于 FastAPI 的 Hello World",xiaogpt 即刻调用大模型并通过 TTS 语音播报代码结构,全程无需动手。

- 实时同步:直接接入 ChatGLM、Moonshot 等最新大模型接口,确保获取的技术方案与社区前沿保持同步。

- 持续对话:开启“持续对话”模式后,老张可以像与人讨论一样多轮追问细节,xiaogpt 能结合上下文给出连贯的优化建议。

xiaogpt 将闲置的传统智能音箱升级为连接顶尖大模型的语音终端,让开发者在任何生活场景中都能实现“动口不动手”的高效人机协作。

运行环境要求

- Linux

- macOS

- Windows

未说明

未说明

快速开始

xiaogpt

用小米AI音箱玩ChatGPT及其他大模型

支持的AI类型

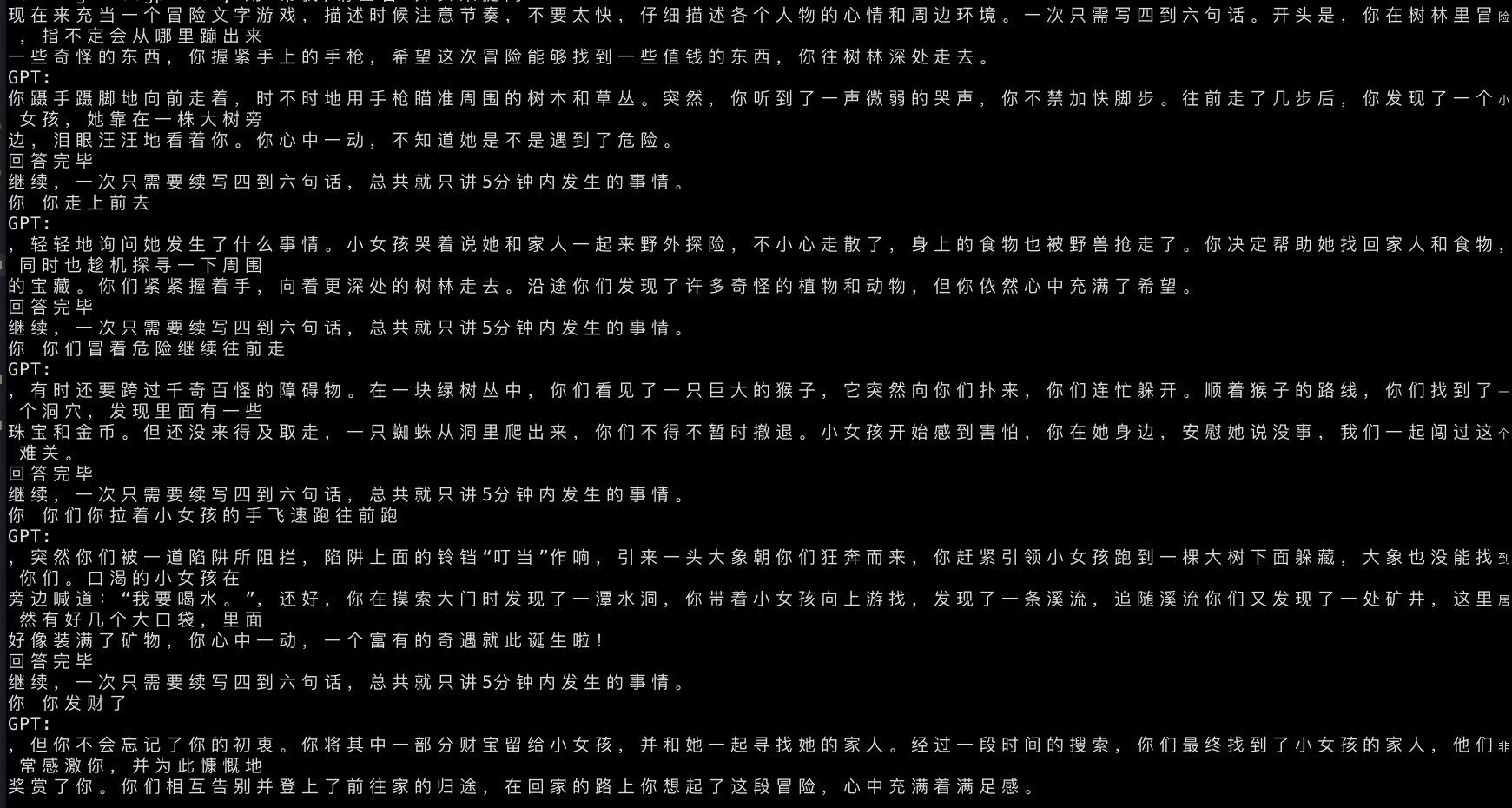

获取小米音响DID

| 系统和 Shell | Linux *sh | Windows CMD 用户 | Windows PowerShell 用户 |

|---|---|---|---|

| 1、安装包 | pip install miservice_fork |

pip install miservice_fork |

pip install miservice_fork |

| 2、设置变量 | export MI_USER=xxx export MI_PASS=xxx |

set MI_USER=xxxset MI_PASS=xxx |

$env:MI_USER="xxx" $env:MI_PASS="xxx" |

| 3、取得 MI_DID | micli list |

micli list |

micli list |

| 4、设置 MI_DID | export MI_DID=xxx |

set MI_DID=xxx |

$env:MI_DID="xxx" |

- 注意不同shell对环境变量的处理是不同的,尤其是powershell赋值时,可能需要双引号来包括值。

- 如果获取did报错时,请更换一下无线网络,有很大概率解决问题。

一点原理

准备

- ChatGPT id

- 小爱音响

- 能正常联网的环境或proxy

- python3.8+

使用

pip install -U --force-reinstall xiaogpt[locked]- 参考我fork的MiService项目README并在本地terminal跑

micli list拿到你音响的DID成功别忘了设置export MI_DID=xxx这个MI_DID用 - run

xiaogpt --hardware ${your_hardware} --use_chatgpt_apihardware你看小爱屁股上有型号,输入进来,如果在屁股上找不到或者型号不对,可以用micli mina找到型号 - 跑起来之后就可以问小爱同学问题了,“帮我"开头的问题,会发送一份给ChatGPT然后小爱同学用tts回答

- 如果上面不可用,可以尝试用手机抓包,https://userprofile.mina.mi.com/device_profile/v2/conversation找到cookie利用

--cookie '${cookie}'cookie别忘了用单引号包裹 - 默认用目前ubus,如果你的设备不支持ubus可以使用

--use_command来使用command来tts - 使用

--mute_xiaoai选项,可以快速停掉小爱的回答 - 使用

--account ${account} --password ${password} - 如果有能力可以自行替换唤醒词,也可以去掉唤醒词

- 使用

--use_chatgpt_api的api那样可以更流畅的对话,速度特别快,达到了对话的体验,openai api,命令--use_chatgpt_api - 如果你遇到了墙需要用Cloudflare Workers替换api_base请使用

--api_base ${url}来替换。请注意,此处你输入的api应该是'https://xxxx/v1'的字样,域名需要用引号包裹 --use_moonshot_api和其他模型请参考下文- 可以跟小爱说

开始持续对话自动进入持续对话状态,结束持续对话结束持续对话状态。 - 可以使用

--tts edge来获取更好的tts能力 - 可以使用

--tts fish --fish_api_key <your-fish-key> --fish_voice_key <fish-voice>来获取fish-audio能力(如何获取fish voice见下) - 可以使用

--tts openai来获取openai tts能力 - 可以使用

--tts azure --azure_tts_speech_key <your-speech-key>来获取Azure TTS能力 - 可以使用

--use_langchain替代--use_chatgpt_api来调用LangChain(默认chatgpt)服务,实现上网检索、数学运算..

e.g.

export OPENAI_API_KEY=${your_api_key}

xiaogpt --hardware LX06 --use_chatgpt_api

# 或

xiaogpt --hardware LX06 --cookie ${cookie} --use_chatgpt_api

# 如果你想直接输入账号密码

xiaogpt --hardware LX06 --account ${your_xiaomi_account} --password ${your_password} --use_chatgpt_api

# 如果你想mute小米的回答

xiaogpt --hardware LX06 --mute_xiaoai --use_chatgpt_api

# 使用流式响应,获得更快的响应

xiaogpt --hardware LX06 --mute_xiaoai --stream

# 如果你想使用google的gemini

xiaogpt --hardware LX06 --mute_xiaoai --use_gemini --gemini_key ${gemini_key}

# 如果你想使用自己的google gemini服务

python3 xiaogpt.py --hardware LX06 --mute_xiaoai --use_gemini --gemini_key ${gemini_key} --gemini_api_domain ${gemini_api_domain}

# 如果你想使用阿里的通义千问

xiaogpt --硬件 LX06 --mute_xiaoai --use_qwen --qwen_key ${qwen_key}

# 如果你想使用kimi

xiaogpt --硬件 LX06 --mute_xiaoai --use_moonshot_api --moonshot_api_key ${moonshot_api_key}

# 如果你想使用llama3

xiaogpt --硬件 LX06 --mute_xiaoai --use_llama --llama_api_key ${llama_api_key}

# 如果你想使用01

xiaogpt --硬件 LX06 --mute_xiaoai --use_yi_api --ti_api_key ${yi_api_key}

# 如果你想使用LangChain+SerpApi实现上网检索或其他本地服务(目前仅支持stream模式)

export OPENAI_API_KEY=${your_api_key}

export SERPAPI_API_KEY=${your_serpapi_key}

xiaogpt --硬件 Lx06 --use_langchain --mute_xiaoai --stream --openai_key ${your_api_key} --serpapi_api_key ${your_serpapi_key}

使用git clone运行

export OPENAI_API_KEY=${your_api_key}

python3 xiaogpt.py --硬件 LX06

# 或

python3 xiaogpt.py --硬件 LX06 --cookie ${cookie}

# 如果你想直接输入账号密码

python3 xiaogpt.py --硬件 LX06 --account ${your_xiaomi_account} --password ${your_password} --use_chatgpt_api

# 如果你想mute小米的回答

python3 xiaogpt.py --硬件 LX06 --mute_xiaoai

# 使用流式响应,获得更快的响应

python3 xiaogpt.py --硬件 LX06 --mute_xiaoai --stream

# 如果你想使用ChatGLM api

python3 xiaogpt.py --硬件 LX06 --mute_xiaoai --use_glm --glm_key ${glm_key}

# 如果你想使用google的gemini

python3 xiaogpt.py --硬件 LX06 --mute_xiaoai --use_gemini --gemini_key ${gemini_key}

# 如果你想使用自己的google gemini服务

python3 xiaogpt.py --硬件 LX06 --mute_xiaoai --use_gemini --gemini_key ${gemini_key} --gemini_api_domain ${gemini_api_domain}

# 如果你想使用阿里的通义千问

python3 xiaogpt.py --硬件 LX06 --mute_xiaoai --use_qwen --qwen_key ${qwen_key}

# 如果你想使用kimi

xiaogpt --硬件 LX06 --mute_xiaoai --use_moonshot_api --moonshot_api_key ${moonshot_api_key}

# 如果你想使用01

xiaogpt --硬件 LX06 --mute_xiaoai --use_yi_api --ti_api_key ${yi_api_key}

# 如果你想使用豆包

python3 xiaogpt.py --硬件 LX06 --mute_xiaoai --use_doubao --stream --volc_access_key xxxx --volc_secret_key xxx

# 如果你想使用llama3

python3 xiaogpt.py --硬件 LX06 --mute_xiaoai --use_llama --llama_api_key ${llama_api_key}

# 如果你想使用LangChain+SerpApi实现上网检索或其他本地服务(目前仅支持stream模式)

export OPENAI_API_KEY=${your_api_key}

export SERPAPI_API_KEY=${your_serpapi_key}

python3 xiaogpt.py --硬件 Lx06 --use_langchain --mute_xiaoai --stream --openai_key ${your_api_key} --serpapi_api_key ${your_serpapi_key}

config.yaml

如果想通过单一配置文件启动也是可以的,可以通过--config参数指定配置文件,config文件必须是合法的Yaml或JSON格式

参数优先级

- cli args > default > config

python3 xiaogpt.py --config xiao_config.yaml

# 或者

xiaogpt --config xiao_config.yaml

或者

cp xiao_config.yaml.example xiao_config.yaml

python3 xiaogpt.py

若要指定 OpenAI 的模型参数,如 model, temperate, top_p,请在 config.yaml 中指定:

gpt_options:

temperature: 0.9

top_p: 0.9

具体参数作用请参考 Open AI API 文档。 ChatGLM 文档

配置项说明

| 参数 | 说明 | 默认值 | 可选值 |

|---|---|---|---|

| hardware | 设备型号 | ||

| account | 小爱账户 | ||

| password | 小爱账户密码 | ||

| openai_key | OpenAI 的 API 密钥 | ||

| moonshot_api_key | Moonshot Kimi 的 API 密钥 | ||

| yi_api_key | 01 万物的 API 密钥 | ||

| llama_api_key | Groq 的 Llama3 API 密钥 | ||

| serpapi_api_key | SerpAPI 的密钥,参考 SerpAPI | ||

| glm_key | ChatGLM 的 API 密钥 | ||

| gemini_key | Gemini 的 API 密钥 参考 | ||

| gemini_api_domain | Gemini 的自定义域名 参考 | ||

| qwen_key | Qwen 的 API 密钥 参考 | ||

| cookie | 小爱账户 Cookie(如果使用上述密码登录,可不填) | ||

| mi_did | 设备 DID | ||

| use_command | 使用 MI Command 与小爱交互 | false |

|

| mute_xiaoai | 快速停止小爱自身的回答 | true |

|

| verbose | 是否打印详细日志 | false |

|

| bot | 使用的机器人类型,目前支持 ChatGPT API、New Bing、Qwen、Gemini | ChatGPT API |

|

| tts | 使用的 TTS 类型 | mi |

edge、OpenAI、Azure、Volc、Baidu、Google、Minimax |

| tts_options | TTS 参数字典,参考 Tetos 获取可用参数 | ||

| prompt | 自定义提示语 | 请用100字以内回答 |

|

| keyword | 自定义请求词列表 | ["请"] |

|

| change_prompt_keyword | 更改提示词触发列表 | ["更改提示词"] |

|

| start_conversation | 开始持续对话关键词 | 开始持续对话 |

|

| end_conversation | 结束持续对话关键词 | 结束持续对话 |

|

| stream | 使用流式响应,获得更快的响应 | true |

|

| proxy | 支持 HTTP 代理,传入 HTTP 代理 URL | "" | |

| gpt_options | OpenAI API 的参数字典 | {} |

|

| deployment_id | Azure OpenAI 服务的部署 ID | 参考此如何找到部署ID | |

| api_base | 如果需要替换默认的 API 地址,或者使用 Azure OpenAI 服务 | 例如:https://abc-def.openai.azure.com/ |

|

| volc_access_key | 火山引擎的访问密钥,请在这里获取 | ||

| volc_secret_key | 火山引擎的秘密密钥,请在这里获取 |

注意

- 请开启小爱同学的蓝牙

- 如果要更改提示词和 PROMPT 在代码最上面自行更改

- 目前已知 LX04、X10A 和 L05B L05C 可能需要使用

--use_command,否则可能会出现终端能输出 GPT 的回复但小爱同学不回答 GPT 的情况。这几个型号也只支持小爱原本的 tts. - 在 wsl 使用时,需要设置代理为 <http://wls 的 ip:port(vpn 的代理端口)>, 否则会出现连接超时的情况,详情 报错:Error communicating with OpenAI

QA

- 用破解么?不用

- 你做这玩意也没用啊?确实。。。但是挺好玩的,有用对你来说没用,对我们来说不一定呀

- 想把它变得更好?PR Issue always welcome.

- 还有问题?提 Issue 哈哈

- Exception: Error https://api2.mina.mi.com/admin/v2/device_list?master=0&requestId=app_ios_xxx: Login failed @KJZH001

这是由于小米风控导致,海外地区无法登录大陆的账户,请尝试 cookie 登录 无法抓包的可以在本地部署完毕项目后再用户文件夹C:\Users\用户名下面找到.mi.token,然后扔到你无法登录的服务器去

若是 linux 则请放到当前用户的 home 文件夹,此时你可以重新执行先前的命令,不出意外即可正常登录(但 cookie 可能会过一段时间失效,需要重新获取)

详情请见 https://github.com/yihong0618/xiaogpt/issues/332

视频教程

https://www.youtube.com/watch?v=K4YA8YwzOOA

Docker

常规用法

X86/ARM Docker Image: yihong0618/xiaogpt

docker run -e OPENAI_API_KEY=<your-openapi-key> yihong0618/xiaogpt <命令行参数>

如

docker run -e OPENAI_API_KEY=<your-openapi-key> yihong0618/xiaogpt --account=<your-xiaomi-account> --password=<your-xiaomi-password> --hardware=<your-xiaomi-hardware> --use_chatgpt_api

使用配置文件

xiaogpt 的配置文件可通过指定 volume /config,以及指定参数--config 来处理,如

docker run -v <your-config-dir>:/config yihong0618/xiaogpt --config=/config/config.yaml

网络使用 host 模型

docker run -v <your-config-dir>:/config --network=host yihong0618/xiaogpt --config=/config/config.yaml

本地编译 Docker Image

docker build -t xiaogpt .

如果在安装依赖时构建失败或安装缓慢时,可以在构建 Docker 镜像时使用 --build-arg 参数来指定国内源地址:

docker build --build-arg PIP_INDEX_URL=https://pypi.tuna.tsinghua.edu.cn/simple -t xiaogpt .

如果需要在 Apple M1/M2上编译x86

docker buildx build --platform=linux/amd64 -t xiaogpt-x86 .

第三方 TTS

我们目前支持是三种第三方 TTS:edge/openai/azure/volc/baidu/google

edge-tts 提供了类似微软 tts 的能力 azure-tts 提供了微软 azure tts 的能力 openai-tts 提供了类似 openai tts 的能力 fish-tts 提供了 fish tts 的能力

Usage

你可以通过参数 tts, 来启用它

tts: edge

For edge 查看更多语言支持,从中选择一个

edge-tts --list-voices

如果你想使用 fish-tts

- 注册 https://fish.audio/zh-CN/go-api/ 拿到 api key

- 选择你想要的声音自建声音或者使用热门声音 https://fish.audio/zh-CN/text-to-speech/?modelId=e80ea225770f42f79d50aa98be3cedfc 其中

e80ea225770f42f79d50aa98be3cedfc就声音的 key id - python3 xiaogpt.py --hardware LX06 --account xxxx --password xxxxx --use_chatgpt_api --mute_xiaoai --stream --tts fish --fish_api_key xxxxx --fish_voice_key xxxxx

- 或者在 xiao_config.yaml 中配置

tts: fish

# TTS 参数字典,参考 https://github.com/frostming/tetos 获取可用参数

tts_options: {

"api_key": "xxxxx",

"voice": "xxxxxx"

}

在容器中使用 edge-tts/azure-tts/openai-tts/volc/google/baidu/fish

由于 Edge TTS 启动了一个本地的 HTTP 服务,所以需要将容器的端口映射到宿主机上,并且指定本地机器的 hostname:

docker run -v <your-config-dir>:/config -p 9527:9527 -e XIAOGPT_HOSTNAME=<your ip> yihong0618/xiaogpt --config=/config/config.yaml

注意端口必须映射为与容器内一致,XIAOGPT_HOSTNAME 需要设置为宿主机的 IP 地址,否则小爱无法正常播放语音。

推荐的类似项目

感谢

赞赏

谢谢就够了

版本历史

v3.232025/10/26v3.222025/08/11v3.212025/06/10v3.202025/04/20v3.102025/03/19v3.052024/10/30v3.042024/10/29v3.032024/10/11v3.022024/10/10v3.012024/09/22v2.922024/08/17v2.912024/07/22v2.902024/07/08v2.842024/05/22v2.832024/05/20v2.822024/05/18v2.812024/05/18v2.802024/05/17v2.712024/05/14v2.702024/05/03常见问题

相似工具推荐

everything-claude-code

everything-claude-code 是一套专为 AI 编程助手(如 Claude Code、Codex、Cursor 等)打造的高性能优化系统。它不仅仅是一组配置文件,而是一个经过长期实战打磨的完整框架,旨在解决 AI 代理在实际开发中面临的效率低下、记忆丢失、安全隐患及缺乏持续学习能力等核心痛点。 通过引入技能模块化、直觉增强、记忆持久化机制以及内置的安全扫描功能,everything-claude-code 能显著提升 AI 在复杂任务中的表现,帮助开发者构建更稳定、更智能的生产级 AI 代理。其独特的“研究优先”开发理念和针对 Token 消耗的优化策略,使得模型响应更快、成本更低,同时有效防御潜在的攻击向量。 这套工具特别适合软件开发者、AI 研究人员以及希望深度定制 AI 工作流的技术团队使用。无论您是在构建大型代码库,还是需要 AI 协助进行安全审计与自动化测试,everything-claude-code 都能提供强大的底层支持。作为一个曾荣获 Anthropic 黑客大奖的开源项目,它融合了多语言支持与丰富的实战钩子(hooks),让 AI 真正成长为懂上

LLMs-from-scratch

LLMs-from-scratch 是一个基于 PyTorch 的开源教育项目,旨在引导用户从零开始一步步构建一个类似 ChatGPT 的大型语言模型(LLM)。它不仅是同名技术著作的官方代码库,更提供了一套完整的实践方案,涵盖模型开发、预训练及微调的全过程。 该项目主要解决了大模型领域“黑盒化”的学习痛点。许多开发者虽能调用现成模型,却难以深入理解其内部架构与训练机制。通过亲手编写每一行核心代码,用户能够透彻掌握 Transformer 架构、注意力机制等关键原理,从而真正理解大模型是如何“思考”的。此外,项目还包含了加载大型预训练权重进行微调的代码,帮助用户将理论知识延伸至实际应用。 LLMs-from-scratch 特别适合希望深入底层原理的 AI 开发者、研究人员以及计算机专业的学生。对于不满足于仅使用 API,而是渴望探究模型构建细节的技术人员而言,这是极佳的学习资源。其独特的技术亮点在于“循序渐进”的教学设计:将复杂的系统工程拆解为清晰的步骤,配合详细的图表与示例,让构建一个虽小但功能完备的大模型变得触手可及。无论你是想夯实理论基础,还是为未来研发更大规模的模型做准备

NextChat

NextChat 是一款轻量且极速的 AI 助手,旨在为用户提供流畅、跨平台的大模型交互体验。它完美解决了用户在多设备间切换时难以保持对话连续性,以及面对众多 AI 模型不知如何统一管理的痛点。无论是日常办公、学习辅助还是创意激发,NextChat 都能让用户随时随地通过网页、iOS、Android、Windows、MacOS 或 Linux 端无缝接入智能服务。 这款工具非常适合普通用户、学生、职场人士以及需要私有化部署的企业团队使用。对于开发者而言,它也提供了便捷的自托管方案,支持一键部署到 Vercel 或 Zeabur 等平台。 NextChat 的核心亮点在于其广泛的模型兼容性,原生支持 Claude、DeepSeek、GPT-4 及 Gemini Pro 等主流大模型,让用户在一个界面即可自由切换不同 AI 能力。此外,它还率先支持 MCP(Model Context Protocol)协议,增强了上下文处理能力。针对企业用户,NextChat 提供专业版解决方案,具备品牌定制、细粒度权限控制、内部知识库整合及安全审计等功能,满足公司对数据隐私和个性化管理的高标准要求。

ML-For-Beginners

ML-For-Beginners 是由微软推出的一套系统化机器学习入门课程,旨在帮助零基础用户轻松掌握经典机器学习知识。这套课程将学习路径规划为 12 周,包含 26 节精炼课程和 52 道配套测验,内容涵盖从基础概念到实际应用的完整流程,有效解决了初学者面对庞大知识体系时无从下手、缺乏结构化指导的痛点。 无论是希望转型的开发者、需要补充算法背景的研究人员,还是对人工智能充满好奇的普通爱好者,都能从中受益。课程不仅提供了清晰的理论讲解,还强调动手实践,让用户在循序渐进中建立扎实的技能基础。其独特的亮点在于强大的多语言支持,通过自动化机制提供了包括简体中文在内的 50 多种语言版本,极大地降低了全球不同背景用户的学习门槛。此外,项目采用开源协作模式,社区活跃且内容持续更新,确保学习者能获取前沿且准确的技术资讯。如果你正寻找一条清晰、友好且专业的机器学习入门之路,ML-For-Beginners 将是理想的起点。

ragflow

RAGFlow 是一款领先的开源检索增强生成(RAG)引擎,旨在为大语言模型构建更精准、可靠的上下文层。它巧妙地将前沿的 RAG 技术与智能体(Agent)能力相结合,不仅支持从各类文档中高效提取知识,还能让模型基于这些知识进行逻辑推理和任务执行。 在大模型应用中,幻觉问题和知识滞后是常见痛点。RAGFlow 通过深度解析复杂文档结构(如表格、图表及混合排版),显著提升了信息检索的准确度,从而有效减少模型“胡编乱造”的现象,确保回答既有据可依又具备时效性。其内置的智能体机制更进一步,使系统不仅能回答问题,还能自主规划步骤解决复杂问题。 这款工具特别适合开发者、企业技术团队以及 AI 研究人员使用。无论是希望快速搭建私有知识库问答系统,还是致力于探索大模型在垂直领域落地的创新者,都能从中受益。RAGFlow 提供了可视化的工作流编排界面和灵活的 API 接口,既降低了非算法背景用户的上手门槛,也满足了专业开发者对系统深度定制的需求。作为基于 Apache 2.0 协议开源的项目,它正成为连接通用大模型与行业专有知识之间的重要桥梁。

PaddleOCR

PaddleOCR 是一款基于百度飞桨框架开发的高性能开源光学字符识别工具包。它的核心能力是将图片、PDF 等文档中的文字提取出来,转换成计算机可读取的结构化数据,让机器真正“看懂”图文内容。 面对海量纸质或电子文档,PaddleOCR 解决了人工录入效率低、数字化成本高的问题。尤其在人工智能领域,它扮演着连接图像与大型语言模型(LLM)的桥梁角色,能将视觉信息直接转化为文本输入,助力智能问答、文档分析等应用场景落地。 PaddleOCR 适合开发者、算法研究人员以及有文档自动化需求的普通用户。其技术优势十分明显:不仅支持全球 100 多种语言的识别,还能在 Windows、Linux、macOS 等多个系统上运行,并灵活适配 CPU、GPU、NPU 等各类硬件。作为一个轻量级且社区活跃的开源项目,PaddleOCR 既能满足快速集成的需求,也能支撑前沿的视觉语言研究,是处理文字识别任务的理想选择。