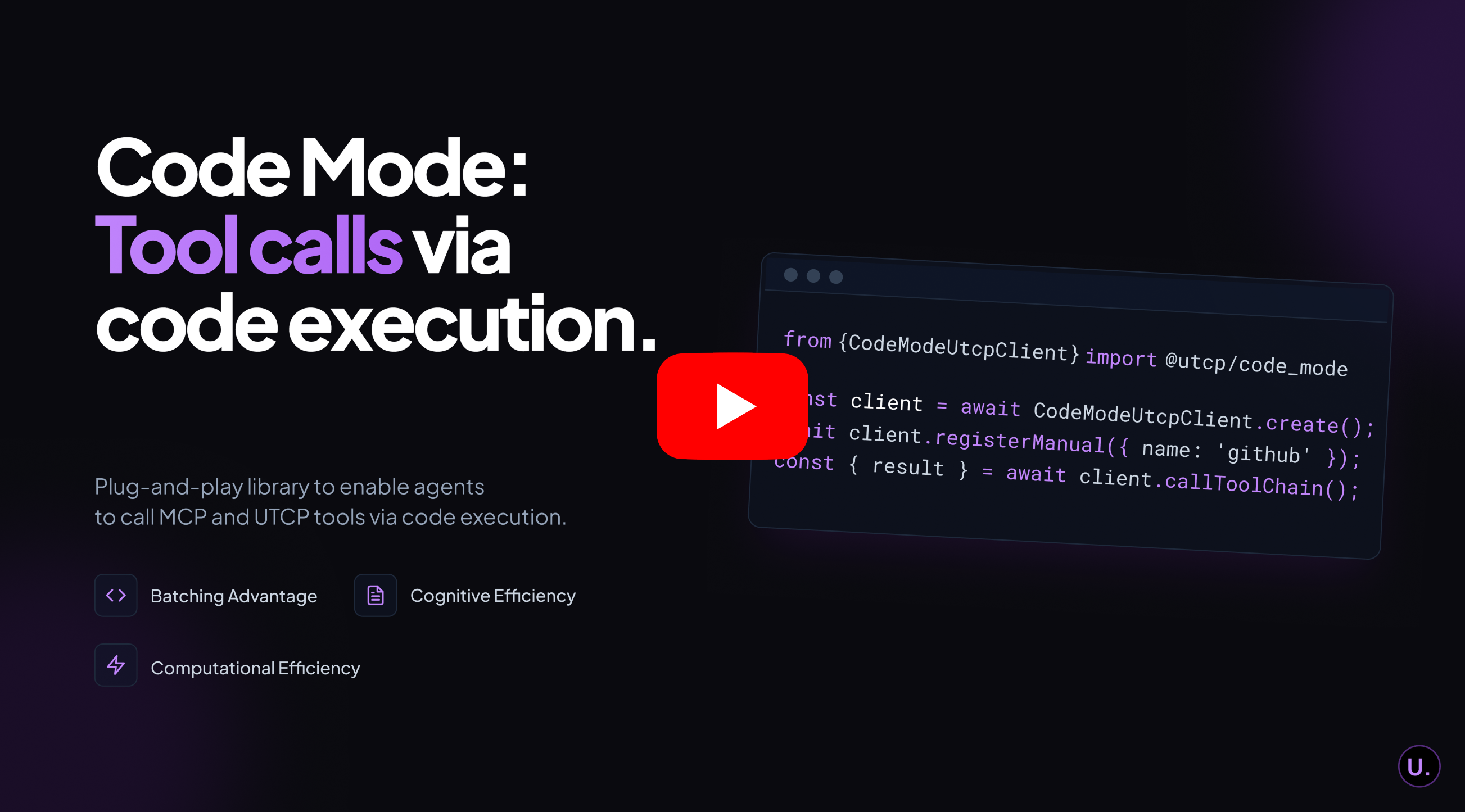

code-mode

code-mode 是一款专为 AI 智能体设计的开源库,旨在通过代码执行的方式,让智能体能够高效调用 MCP(模型上下文协议)和 UTCP(通用工具调用协议)工具。只需几行代码,即可将复杂的工具调用流程转化为简单的代码执行任务,实现“即插即用”的集成体验。

传统的大语言模型在直接调用大量工具时,往往面临上下文冗长、步骤繁琐且容易出错的问题。code-mode 巧妙地解决了这一痛点:它不再向模型暴露成百上千个独立的工具接口,而是提供一个统一的代码执行环境。由于大模型在生成代码方面表现卓越,这种方式让模型能够通过编写 TypeScript 代码来一次性编排和执行多个工具操作,从而大幅减少交互迭代次数。

数据显示,在处理复杂任务时,code-mode 相比传统方法可提升高达 88% 的执行效率,并显著降低 API 调用成本。其核心技术亮点包括支持动态工具发现(仅加载所需工具)、批量处理优势以及避免重复上下文处理的计算效率优化。

这款工具非常适合开发者、AI 工程师及研究人员使用,特别是那些正在构建需要频繁与外部系统交互的智能体应用的人群。如果你希望提升 AI 智能体在处理多步工作流时的稳定性与速度,或者想简化 MCP/UTCP 工具的集成过程,code-mode 提供了一个优雅且高效的解决方案。它不仅降低了开发门槛,还让智能体从笨拙的“工具调用者”进化为高效的“代码执行者”。

使用场景

某后端工程师需要开发一个自动化脚本,用于每日从 GitHub 拉取特定项目的 Pull Request 数据,结合 Jira 上的任务状态进行交叉验证,并将最终报告同步至 Slack 频道。

没有 code-mode 时

- 交互繁琐且缓慢:LLM 必须通过传统的函数调用模式,依次单独调用 GitHub API、Jira API 和 Slack API。每步操作都需要等待模型生成 JSON 参数并解析返回结果,导致整个流程需经历十几次往返交互。

- 上下文窗口压力大:每次工具调用后,完整的工具定义和中间结果都要重新填入提示词中。随着步骤增加,上下文迅速膨胀,不仅消耗大量 Token,还容易因超出长度限制而丢失早期关键信息。

- 逻辑编排易出错:让 LLM 直接协调多个独立工具的执行顺序极其困难。模型常出现参数传递错误(如将 PR 号错传给 Jira),或在处理条件分支(如“若 Jira 状态为 Done 则发送 Slack”)时产生幻觉,导致脚本频繁中断。

- 调试与维护成本高:一旦流程失败,开发者难以定位是模型理解偏差还是工具参数错误,排查过程如同在黑盒中摸索,严重拖慢开发迭代速度。

使用 code-mode 后

- 单次执行高效完成:工程师只需让 LLM 生成一段包含所有逻辑的 TypeScript 代码。code-mode 将这段代码作为单一工具执行,一次性完成数据抓取、逻辑判断和消息发送,将原本十几次的交互压缩为一次请求。

- 显著降低资源消耗:由于无需在每次调用间重复注入庞大的工具描述信息,Token 用量大幅减少。基准测试显示,在复杂场景下可节省高达 88% 的处理时间,直接转化为真金白银的成本节约。

- 利用编码优势提升准确率:LLM 擅长编写代码而非 orchestration(编排)。通过代码执行,模型可以利用标准的编程语法(如 if-else、循环)精确控制业务逻辑,彻底解决了多工具协作中的参数错位和流程混乱问题。

- 原生支持动态发现:code-mode 允许代理按需搜索和加载工具,无需预先暴露数百个工具定义。这不仅简化了初始化配置,还让 Agent 能更专注地处理核心业务逻辑。

code-mode 通过将“工具调用”转化为“代码执行”,充分发挥了 LLM 的编程特长,以极简的架构实现了复杂工作流的高效、稳定自动化。

运行环境要求

- Linux

- macOS

- Windows

未说明

未说明

快速开始

仅需三行代码,即可将您的 AI 代理从笨拙的工具调用者转变为高效的代码执行者。

为什么这会彻底改变一切

大语言模型擅长编写代码,但在工具调用方面却表现不佳。与其直接暴露数百种工具,不如为它们提供一个能够执行 TypeScript 代码并访问您整个工具集的单一工具。

Apple、Cloudflare 和 Anthropic 都认为,与传统的先传递函数信息再提取 JSON 进行调用的方式相比,Code-Mode 是一种更高效的工具调用方法。

基准测试

独立的 Python 基准研究 证实了其性能优势,在每天 1,000 个场景下可节省 $9,536/年:

| 场景复杂度 | 传统方式 | Code Mode | 提升幅度 |

|---|---|---|---|

| 简单(2-3 个工具) | 3 次迭代 | 1 次执行 | 快 67% |

| 中等(4-7 个工具) | 8 次迭代 | 1 次执行 | 快 75% |

| 复杂(8 个以上工具) | 16 次迭代 | 1 次执行 | 快 88% |

为什么 Code Mode 占据主导地位:

批处理优势 - 单一代码块取代多次 API 调用

认知效率 - 大语言模型擅长代码生成而非工具编排

计算效率 - 无需在每次操作之间重新处理上下文

开始使用

三步快速入门

import { CodeModeUtcpClient } from '@utcp/code-mode';

const client = await CodeModeUtcpClient.create(); // 1. 初始化

await client.registerManual({ name: 'github', /* MCP 配置 */ }); // 2. 添加工具

const { result } = await client.callToolChain(`/* TypeScript */`); // 3. 执行代码

就这么简单。您的 AI 代理现在只需一次请求就能执行复杂的流程,而不再需要发出数十次请求。

您将获得的内容

渐进式工具发现

// 代理动态发现工具,只加载所需内容

const tools = await client.searchTools('github pull request');

// 从 500 种工具定义变为仅需 3 种相关工具

自然的代码执行

const { result, logs } = await client.callToolChain(`

// 在一次请求中串联多个操作

const pr = await github.get_pull_request({ owner: 'microsoft', repo: 'vscode', pull_number: 1234 });

const comments = await github.get_pull_request_comments({ owner: 'microsoft', repo: 'vscode', pull_number: 1234 });

const reviews = await github.get_pull_request_reviews({ owner: 'microsoft', repo: 'vscode', pull_number: 1234 });

// 在沙盒环境中高效处理数据

return {

title: pr.title,

commentCount: comments.length,

approvals: reviews.filter(r => r.state === 'APPROVED').length

};

`);

// 一次 API 调用即可替代 15 次以上的传统工具调用

自动生成的 TypeScript 接口

namespace github {

interface get_pull_requestInput {

/** 仓库所有者 */

owner: string;

/** 仓库名称 */

repo: string;

/** 拉取请求编号 */

pull_number: number;

}

}

企业级就绪

- 安全的 VM 沙箱 – Node.js 隔离机制防止未经授权的访问

- 超时保护 – 可配置的执行限制防止失控代码运行

- 全面可观性 – 完整的控制台输出捕获和错误处理

- 零外部依赖 – 工具仅可通过注册的 UTCP/MCP 服务器访问

- 运行时内省 – 动态接口发现支持自适应工作流

如果您在企业工作并需要支持,请在此预约咨询 这里。

通用协议支持

适用于 任何工具生态系统:

| 协议 | 描述 | 使用方式 |

|---|---|---|

| MCP | 模型上下文协议服务器 | call_template_type: 'mcp' |

| HTTP | 具有自动发现功能的 REST API | call_template_type: 'http' |

| 文件 | 本地 JSON/YAML 配置 | call_template_type: 'file' |

| CLI | 命令行工具执行 | call_template_type: 'cli' |

安装

npm install @utcp/code-mode

更轻松:开箱即用的 MCP 服务器

想无需任何设置就使用 Code Mode 吗? 使用我们的即插即用 MCP 服务器,配合 Claude Desktop 或任何 MCP 客户端:

{

"mcpServers": {

"code-mode": {

"command": "npx",

"args": ["@utcp/code-mode-mcp"],

"env": {

"UTCP_CONFIG_FILE": "/path/to/your/.utcp_config.json"

}

}

}

}

就这么简单! 无需安装,也不需要掌握 Node.js 知识。Code Mode MCP 服务器 会自动:

- 通过

npx下载并运行最新版本 - 从 JSON 文件加载您的工具配置

- 为 Claude Desktop 提供代码执行能力

- 为您提供用于 TypeScript 执行的

call_tool_chainMCP 工具

非常适合希望在 Claude Desktop 中使用 Code Mode 功能的非开发者!

直接使用 TypeScript

1. MCP 服务器集成

连接到任何模型上下文协议服务器:

import { CodeModeUtcpClient } from '@utcp/code-mode';

const client = await CodeModeUtcpClient.create();

// 连接到 GitHub 的 MCP 服务器

await client.registerManual({

name: 'github',

call_template_type: 'mcp',

config: {

mcpServers: {

github: {

command: 'docker',

args: ['run', '-i', '--rm', '-e', 'GITHUB_PERSONAL_ACCESS_TOKEN', 'mcp/github'],

env: { GITHUB_PERSONAL_ACCESS_TOKEN: process.env.GITHUB_TOKEN }

}

}

}

});

2. 执行多步骤工作流

用一次代码执行替代15次以上的工具调用:

const { result, logs } = await client.callToolChain(`

// 传统方式:4次独立的API往返 → 代码模式:1次执行

const pr = await github.get_pull_request({ owner: 'microsoft', repo: 'vscode', pull_number: 1234 });

const comments = await github.get_pull_request_comments({ owner: 'microsoft', repo: 'vscode', pull_number: 1234 });

const reviews = await github.get_pull_request_reviews({ owner: 'microsoft', repo: 'vscode', pull_number: 1234 });

const files = await github.get_pull_request_files({ owner: 'microsoft', repo: 'vscode', pull_number: 1234 });

// 在沙箱中处理数据(无需额外的令牌开销)

const summary = {

title: pr.title,

state: pr.state,

author: pr.user.login,

stats: {

comments: comments.length,

reviews: reviews.length,

filesChanged: files.length,

approvals: reviews.filter(r => r.state === 'APPROVED').length

},

topDiscussion: comments.slice(0, 3).map(c => ({

author: c.user.login,

preview: c.body.substring(0, 100) + '...'

}))

};

console.log(\`PR "\${pr.title}" analysis complete\`);

return summary;

`);

console.log('分析结果:', result);

// 控制台输出:'PR "修复hooks中的内存泄漏" 分析完成'

高级功能

多协议工具链

在一次执行中混合使用不同的工具生态系统:

// 注册多个工具源

await client.registerManual({ name: 'github', call_template_type: 'mcp', /* 配置 */ });

await client.registerManual({ name: 'slack', call_template_type: 'http', /* 配置 */ });

await client.registerManual({ name: 'db', call_template_type: 'file', file_path: './db-tools.json' }); // 从JSON文件加载UTCP手册

const result = await client.callToolChain(`

// 从GitHub获取PR数据(MCP)

const pr = await github.get_pull_request({ owner: 'company', repo: 'api', pull_number: 42 });

// 从数据库查询部署状态(File)

const deployment = await db.get_deployment_status({ pr_id: pr.id });

// 向Slack发送通知(HTTP)

await slack.post_message({

channel: '#releases',

text: \`PR #42 "\${pr.title}" 已部署到 \${deployment.environment}\`

});

return { pr: pr.title, environment: deployment.environment };

`);

运行时接口自省

工具可以动态发现并适应可用的接口:

const result = await client.callToolChain(`

// 运行时发现可用工具

console.log('可用接口:', __interfaces);

// 获取特定工具接口进行验证

const prInterface = __getToolInterface('github.get_pull_request');

console.log('PR工具期望的接口:', prInterface);

// 使用接口信息构建动态工作流

const hasSlackTools = __interfaces.includes('namespace slack');

if (hasSlackTools) {

await slack.post_message({ channel: '#dev', text: '分析完成' });

}

return { toolsAvailable: hasSlackTools };

`);

上下文高效的数据处理

在不增加模型上下文负担的情况下处理大型数据集:

const result = await client.callToolChain(`

// 获取大型数据集

const allIssues = await github.list_repository_issues({ owner: 'facebook', repo: 'react' });

console.log('已获取', allIssues.length, '个问题');

// 在沙箱中高效处理

const criticalBugs = allIssues

.filter(issue => issue.labels.some(l => l.name === 'bug'))

.filter(issue => issue.labels.some(l => l.name === '高优先级'))

.map(issue => ({

number: issue.number,

title: issue.title,

author: issue.user.login,

年龄: Math.floor((Date.now() - new Date(issue.created_at)) / (1000 * 60 * 60 * 24))

}))

.sort((a, b) => b.年龄 - a.年龄);

// 只返回处理后的摘要,而非1万条原始问题

return {

totalIssues: allIssues.length,

criticalBugs: criticalBugs.slice(0, 10), // 最古老的10个严重问题

summary: \`发现了 \${criticalBugs.length} 个严重问题,最老的已有 \${criticalBugs[0]?.年龄} 天\`

};

`);

错误处理与可观ility

内置错误处理机制,提供完整的执行透明度:

const { result, logs } = await client.callToolChain(`

try {

console.log('开始多步工作流程...');

const data = await external_api.fetch_data({ id: 'user-123' });

console.log('数据获取成功');

const processed = await data_processor.transform(data);

console.warn('处理完成,共遇到', processed.warnings.length, '条警告');

return processed;

} catch (error) {

console.error('工作流程失败:', error.message);

throw error; // 将错误传递给外部错误处理机制

}

`, 30000); // 30秒超时

// 完整的可观ility

console.log('结果:', result);

console.log('执行日志:', logs);

// ['开始多步工作流程...', '数据获取成功', '[WARN] 处理完成,共遇到2条警告']

自定义超时

为不同类型的负载配置执行限制:

// 快速操作(5秒)

const quickResult = await client.callToolChain(`return await ping.check();`, 5000);

// 重型数据处理(2分钟)

const heavyResult = await client.callToolChain(`

const bigData = await database.export_full_dataset();

return await analytics.process_dataset(bigData);

`, 120000);

AI代理集成

可与任何AI框架即插即用。内置提示模板处理所有复杂性:

import { CodeModeUtcpClient } from '@utcp/code-mode';

const systemPrompt = `

你是一个拥有通过UTCP CodeMode访问工具能力的AI助手。

${CodeModeUtcpClient.AGENT_PROMPT_TEMPLATE}

其他指令...

`;

// 适用于任何AI库

const response = await openai.chat.completions.create({

model: 'gpt-4',

messages: [

{ role: 'system', content: systemPrompt },

{ role: 'user', content: '分析microsoft/vscode中的最新PR' }

]

});

该模板提供了全面的指导:

- 工具发现工作流程(

searchTools→__interfaces→callToolChain) - 层次化访问模式(

manual.tool()语法) - 接口自省(

__getToolInterface()) - 错误处理和最佳实践

API参考

核心方法

callToolChain(code: string, timeout?: number)

以完整的工具访问权限和可观ability执行 TypeScript 代码。

- 返回值:包含执行结果和捕获的控制台输出的

{result: any, logs: string[]} - 默认超时时间:30秒

getAllToolsTypeScriptInterfaces()

生成用于 IDE 集成的完整 TypeScript 接口。

- 返回值:包含所有命名空间接口定义的字符串

searchTools(query: string) (来自 UtcpClient)

通过自然语言查询发现工具。

- 返回值:包含描述和接口的相关工具数组

静态方法

CodeModeUtcpClient.create(root_dir?, config?)

创建新的客户端实例,可选配置。

CodeModeUtcpClient.AGENT_PROMPT_TEMPLATE

适用于 AI 代理的生产就绪提示模板。

安全与性能

设计安全

- Node.js VM 沙箱 – 隔离的执行上下文

- 无文件系统访问权限 – 工具仅通过注册的服务端访问

- 超时保护 – 可配置的执行限制

- 零网络访问 – 不暴露外部依赖或 API 密钥

性能优化

- 最小内存占用 – VM 上下文轻量级

- 高效的工具缓存 – TypeScript 接口自动缓存

- 流式控制台输出 – 实时日志捕获,无需缓冲

- 标识符净化 – 能够优雅地处理无效的 TypeScript 标识符

开发体验

IDE 集成

生成 TypeScript 定义以实现完整的 IntelliSense 支持:

# 生成工具接口

const interfaces = await client.getAllToolsTypeScriptInterfaces();

await fs.writeFile('generated-tools.d.ts', interfaces);

# 添加到 tsconfig.json

{

"compilerOptions": {

"typeRoots": ["./generated-tools.d.ts"]

}

}

调试与监控

内置可观ability,适用于生产部署:

const { result, logs } = await client.callToolChain(userCode);

// 将日志发送到你的监控系统

logs.forEach(log => {

if (log.startsWith('[ERROR]')) 监控.error(log);

if (log.startsWith('[WARN]')) 监控.warn(log);

});

基准测试方法

全面的 Python 研究 测试了 16 个真实场景,涵盖:

- 金融工作流(开票、费用跟踪)

- DevOps 运维(部署、监控)

- 数据处理(分析、报告)

- 业务自动化(CRM、通知)

测试模型:Claude Haiku、Gemini Flash

定价依据:输入 0.25 美元/100 万 token,输出 1.25 美元/100 万 token

规模:每天 1,000 个场景,使用 Code Mode 每年可节省 9,536 美元

了解更多

- Cloudflare Research – 原始 Code Mode 白皮书

- Anthropic 研究 – MCP 代码执行的优势

- Python 基准研究 – 全面的性能分析

- UTCP 规范 – 官方 TypeScript 实现

- 提交问题 – Bug 报告和功能请求

许可证

MPL-2.0 – 开源且对商业友好。

版本历史

v1.0.62025/11/23v1.0.52025/11/15常见问题

相似工具推荐

stable-diffusion-webui

stable-diffusion-webui 是一个基于 Gradio 构建的网页版操作界面,旨在让用户能够轻松地在本地运行和使用强大的 Stable Diffusion 图像生成模型。它解决了原始模型依赖命令行、操作门槛高且功能分散的痛点,将复杂的 AI 绘图流程整合进一个直观易用的图形化平台。 无论是希望快速上手的普通创作者、需要精细控制画面细节的设计师,还是想要深入探索模型潜力的开发者与研究人员,都能从中获益。其核心亮点在于极高的功能丰富度:不仅支持文生图、图生图、局部重绘(Inpainting)和外绘(Outpainting)等基础模式,还独创了注意力机制调整、提示词矩阵、负向提示词以及“高清修复”等高级功能。此外,它内置了 GFPGAN 和 CodeFormer 等人脸修复工具,支持多种神经网络放大算法,并允许用户通过插件系统无限扩展能力。即使是显存有限的设备,stable-diffusion-webui 也提供了相应的优化选项,让高质量的 AI 艺术创作变得触手可及。

everything-claude-code

everything-claude-code 是一套专为 AI 编程助手(如 Claude Code、Codex、Cursor 等)打造的高性能优化系统。它不仅仅是一组配置文件,而是一个经过长期实战打磨的完整框架,旨在解决 AI 代理在实际开发中面临的效率低下、记忆丢失、安全隐患及缺乏持续学习能力等核心痛点。 通过引入技能模块化、直觉增强、记忆持久化机制以及内置的安全扫描功能,everything-claude-code 能显著提升 AI 在复杂任务中的表现,帮助开发者构建更稳定、更智能的生产级 AI 代理。其独特的“研究优先”开发理念和针对 Token 消耗的优化策略,使得模型响应更快、成本更低,同时有效防御潜在的攻击向量。 这套工具特别适合软件开发者、AI 研究人员以及希望深度定制 AI 工作流的技术团队使用。无论您是在构建大型代码库,还是需要 AI 协助进行安全审计与自动化测试,everything-claude-code 都能提供强大的底层支持。作为一个曾荣获 Anthropic 黑客大奖的开源项目,它融合了多语言支持与丰富的实战钩子(hooks),让 AI 真正成长为懂上

ComfyUI

ComfyUI 是一款功能强大且高度模块化的视觉 AI 引擎,专为设计和执行复杂的 Stable Diffusion 图像生成流程而打造。它摒弃了传统的代码编写模式,采用直观的节点式流程图界面,让用户通过连接不同的功能模块即可构建个性化的生成管线。 这一设计巧妙解决了高级 AI 绘图工作流配置复杂、灵活性不足的痛点。用户无需具备编程背景,也能自由组合模型、调整参数并实时预览效果,轻松实现从基础文生图到多步骤高清修复等各类复杂任务。ComfyUI 拥有极佳的兼容性,不仅支持 Windows、macOS 和 Linux 全平台,还广泛适配 NVIDIA、AMD、Intel 及苹果 Silicon 等多种硬件架构,并率先支持 SDXL、Flux、SD3 等前沿模型。 无论是希望深入探索算法潜力的研究人员和开发者,还是追求极致创作自由度的设计师与资深 AI 绘画爱好者,ComfyUI 都能提供强大的支持。其独特的模块化架构允许社区不断扩展新功能,使其成为当前最灵活、生态最丰富的开源扩散模型工具之一,帮助用户将创意高效转化为现实。

ML-For-Beginners

ML-For-Beginners 是由微软推出的一套系统化机器学习入门课程,旨在帮助零基础用户轻松掌握经典机器学习知识。这套课程将学习路径规划为 12 周,包含 26 节精炼课程和 52 道配套测验,内容涵盖从基础概念到实际应用的完整流程,有效解决了初学者面对庞大知识体系时无从下手、缺乏结构化指导的痛点。 无论是希望转型的开发者、需要补充算法背景的研究人员,还是对人工智能充满好奇的普通爱好者,都能从中受益。课程不仅提供了清晰的理论讲解,还强调动手实践,让用户在循序渐进中建立扎实的技能基础。其独特的亮点在于强大的多语言支持,通过自动化机制提供了包括简体中文在内的 50 多种语言版本,极大地降低了全球不同背景用户的学习门槛。此外,项目采用开源协作模式,社区活跃且内容持续更新,确保学习者能获取前沿且准确的技术资讯。如果你正寻找一条清晰、友好且专业的机器学习入门之路,ML-For-Beginners 将是理想的起点。

ragflow

RAGFlow 是一款领先的开源检索增强生成(RAG)引擎,旨在为大语言模型构建更精准、可靠的上下文层。它巧妙地将前沿的 RAG 技术与智能体(Agent)能力相结合,不仅支持从各类文档中高效提取知识,还能让模型基于这些知识进行逻辑推理和任务执行。 在大模型应用中,幻觉问题和知识滞后是常见痛点。RAGFlow 通过深度解析复杂文档结构(如表格、图表及混合排版),显著提升了信息检索的准确度,从而有效减少模型“胡编乱造”的现象,确保回答既有据可依又具备时效性。其内置的智能体机制更进一步,使系统不仅能回答问题,还能自主规划步骤解决复杂问题。 这款工具特别适合开发者、企业技术团队以及 AI 研究人员使用。无论是希望快速搭建私有知识库问答系统,还是致力于探索大模型在垂直领域落地的创新者,都能从中受益。RAGFlow 提供了可视化的工作流编排界面和灵活的 API 接口,既降低了非算法背景用户的上手门槛,也满足了专业开发者对系统深度定制的需求。作为基于 Apache 2.0 协议开源的项目,它正成为连接通用大模型与行业专有知识之间的重要桥梁。

OpenHands

OpenHands 是一个专注于 AI 驱动开发的开源平台,旨在让智能体(Agent)像人类开发者一样理解、编写和调试代码。它解决了传统编程中重复性劳动多、环境配置复杂以及人机协作效率低等痛点,通过自动化流程显著提升开发速度。 无论是希望提升编码效率的软件工程师、探索智能体技术的研究人员,还是需要快速原型验证的技术团队,都能从中受益。OpenHands 提供了灵活多样的使用方式:既可以通过命令行(CLI)或本地图形界面在个人电脑上轻松上手,体验类似 Devin 的流畅交互;也能利用其强大的 Python SDK 自定义智能体逻辑,甚至在云端大规模部署上千个智能体并行工作。 其核心技术亮点在于模块化的软件智能体 SDK,这不仅构成了平台的引擎,还支持高度可组合的开发模式。此外,OpenHands 在 SWE-bench 基准测试中取得了 77.6% 的优异成绩,证明了其解决真实世界软件工程问题的能力。平台还具备完善的企业级功能,支持与 Slack、Jira 等工具集成,并提供细粒度的权限管理,适合从个人开发者到大型企业的各类用户场景。