HyperLPR

HyperLPR 是一款高性能的中文车牌识别开源框架,专为快速、准确地从图像或视频流中提取车牌信息而设计。它有效解决了传统识别方案在复杂光线、大角度拍摄或多车牌场景下准确率低、部署困难的问题,尤其在出入口管理等实际应用中,识别准确率可达 95% 至 97%。

这款工具非常适合开发者、研究人员以及需要集成车牌识别功能的企业用户。无论是构建智能停车系统、交通监控平台,还是在树莓派等嵌入式设备上进行边缘计算开发,HyperLPR 都能提供强有力的支持。其核心亮点在于采用了端到端的深度学习模型,无需繁琐的字符分割步骤即可直接输出结果,显著提升了处理速度。在普通笔记本电脑的单核 CPU 上,它对 720p 画面的平均识别耗时不到 100 毫秒,实现了真正的实时检测。

此外,HyperLPR 具备出色的跨平台兼容性,不仅支持 Python 快速调用和 WebAPI 服务一键部署,还提供了完善的 C++ 库及 Android SDK,覆盖 Linux、MacOS、Windows 及多种嵌入式架构。配合详细的文档与社区资源,即使是初学者也能在五分钟内完成环境搭建并开始测试,是中文车牌识别领域高效且实用的开发利器。

使用场景

某智慧社区物业团队正在升级地下车库管理系统,需要实时自动记录进出车辆信息以替代人工登记。

没有 HyperLPR 时

- 识别速度慢导致拥堵:传统方案在低配工控机上处理一张图片需耗时 300ms 以上,早晚高峰期间车辆排队严重,车主体验极差。

- 复杂场景准确率低下:遇到光线昏暗、车牌大角度倾斜或污损情况,系统频繁识别失败,保安不得不介入人工核对,失去了自动化意义。

- 部署与维护成本高昂:原有方案依赖字符分割步骤,流程繁琐且对硬件算力要求高,难以在树莓派等边缘设备上流畅运行,增加了硬件采购预算。

- 跨平台适配困难:想要开发移动端巡检 App 让保安手持设备查车时,发现核心算法难以移植到 Android 端,导致数据无法实时同步。

使用 HyperLPR 后

- 毫秒级响应畅通无阻:得益于端到端识别架构,HyperLPR 在单核 2.2GHz CPU 上平均识别时间低于 100ms,实现了 720p 视频流的实时处理,车道通行效率提升 3 倍。

- 高鲁棒性应对复杂环境:无需字符分割的特性使其对模糊、倾斜及光照变化具有极强适应性,出入口综合识别率稳定在 95%-97%,基本杜绝了人工干预。

- 轻量化部署降低成本:支持 Linux、MacOS 及树莓派等嵌入式设备,物业直接利用现有旧硬件即可完成升级,大幅节省了服务器与边缘计算节点的投入。

- 全平台无缝集成:提供成熟的 Python、C++ 及 Android SDK,团队仅用数行代码即可将识别能力嵌入 Web 管理后台和保安手持终端,实现了多端数据实时联动。

HyperLPR 凭借其高性能与跨平台优势,将原本昂贵的车牌识别技术转化为低成本、易部署的标准化能力,彻底解决了智慧停车场景下的效率与落地难题。

运行环境要求

- Linux

- macOS

- Windows

未说明 (支持 CPU 实时运行,720p 单核 Intel 2.2GHz CPU 平均识别时间小于 100ms)

未说明

快速开始

HyperLPR3 - 高性能车牌识别框架。

演示APP安装

- 安卓APP:扫描二维码

快速安装

python -m pip install hyperlpr3

支持:python3, Windows, Mac, Linux, Raspberry Pi。

720p CPU实时(在MBP r15 2.2GHz haswell上运行)。

快速测试

# 图片URL

lpr3 sample -src https://koss.iyong.com/swift/v1/iyong_public/iyong_2596631159095872/image/20190221/1550713902741045679.jpg

# 图片路径

lpr3 sample -src images/test_img.jpg -det high

使用方法

# 导入opencv

import cv2

# 导入hyperlpr3

import hyperlpr3 as lpr3

# 实例化对象

catcher = lpr3.LicensePlateCatcher()

# 加载图片

image = cv2.imread("images/test_img.jpg")

# 打印结果

print(catcher(image))

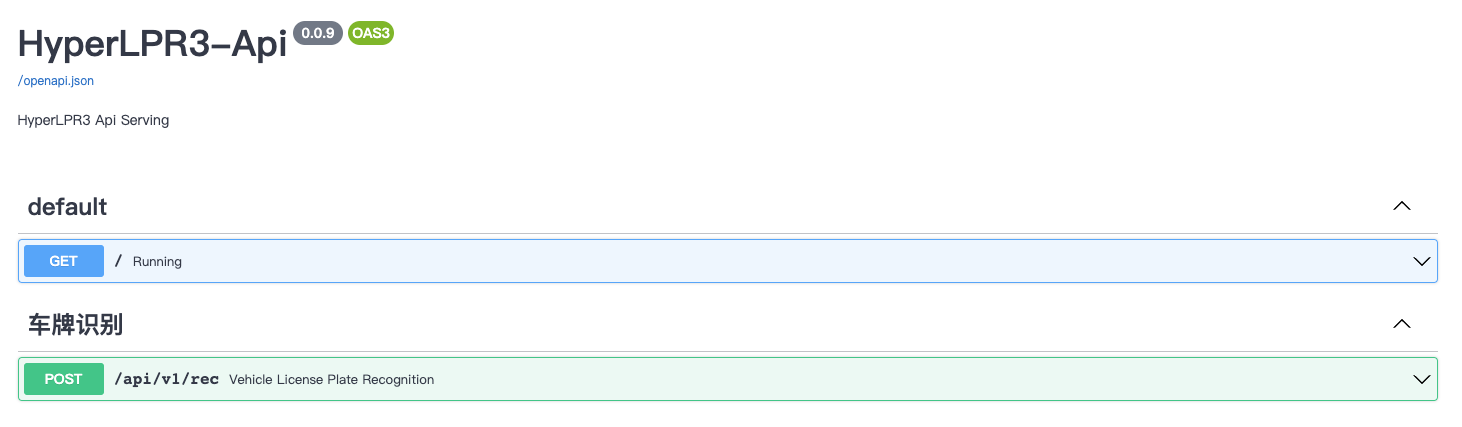

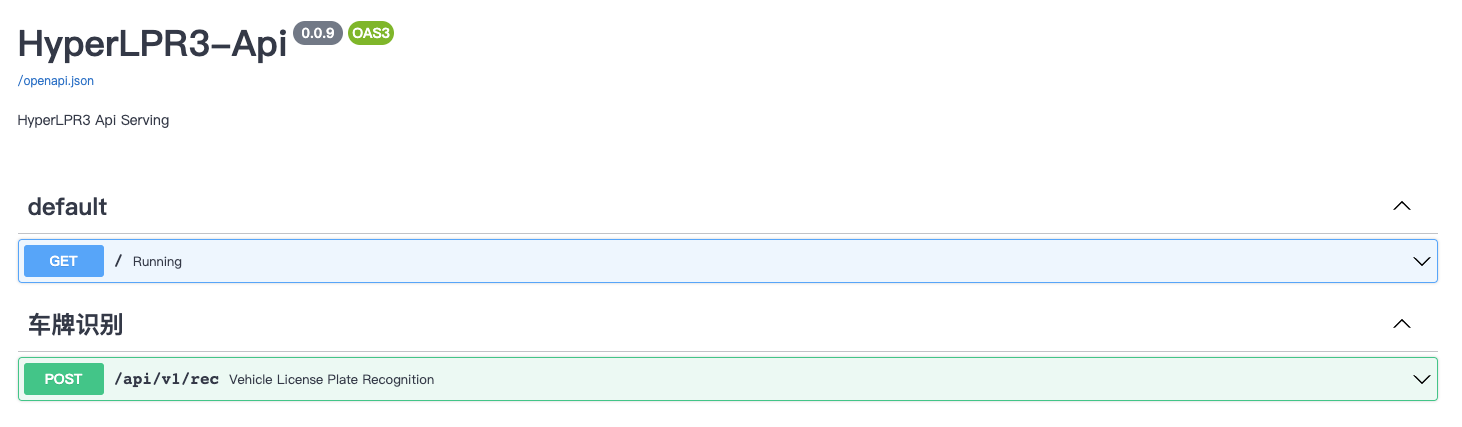

启动WebAPI服务

# 启动服务器

lpr3 rest --port 8715 --host 0.0.0.0

启动后打开SwaggerUI的路径:http://localhost:8715/api/v1/docs 查看并测试在线识别API服务:

问答

Q:项目中的安卓版本准确率是否与apk-demo一致?

A:请从发布版中编译或下载安卓共享库,并将其复制到Prj-Android中进行测试。

Q:车牌训练数据的来源是什么?

A:由于用于训练的车牌数据涉及法律隐私等问题,本项目无法提供。可参考更多公开的大数据集 CCPD 注册数据集。

Q:是否提供训练代码?

A:目前提供了旧版的训练代码,HyperLPR3的训练方法将在后续整理并公布。

资源

待补充... 欢迎贡献

其他版本

TODO

- 支持WebApi服务的快速部署

- 支持多车牌及双层车牌

- 支持大角度车牌

- 轻量级识别模型

特色

- 720p更快,单核Intel 2.2G CPU(MaBook Pro 2015)平均识别时间小于100ms

- 端到端车牌识别无需字符分割

- 识别率高,出入口场景准确率约95%-97%

- 支持跨平台编译和快速部署

注意事项:

- 本项目的C++和Python实现是分开的

- 编译C++项目时必须使用OpenCV 4.0和MNN 2.0,否则无法编译

- 安卓项目编译时NDK应尽量使用21版本

Python依赖

- opencv-python (>3.3)

- onnxruntime (>1.8.1)

- fastapi (0.92.0)

- uvicorn (0.20.0)

- loguru (0.6.0)

- python-multipart

- tqdm

- requests

跨平台支持

平台

- Linux: x86、Armv7、Armv8

- MacOS: x86

- Android: arm64-v8a、armeabi-v7a

嵌入式开发板

- Rockchip: rv1109rv1126(RKNPU)

CPP依赖

- Opencv 4.0以上

- MNN 2.0以上

C/C++编译依赖

编译C/C++项目需要使用第三方依赖库。下载库后解压,通过复制或软链接的方式将其放入根目录(与CMakeLists.txt同级)。百度网盘 提供代码:eu31。

Linux/Mac共享库编译

- 需要将依赖项放置或链接到项目根目录(与CMakeLists.txt同级)

- 建议自行编译OpenCV并安装到系统中,这样可以减少因版本不匹配和系统依赖问题导致的编译错误。当然,也可以尝试使用我们提供的预编译OpenCV静态库进行编译。为此,需启用 LINUX_USE_3RDPARTY_OPENCV 开关。

# 执行脚本

sh command/build_release_linux_share.sh

编译后的文件位于 build/linux/install/hyperlpr3 目录下,包含:

- include - 头文件

- lib - 共享库目录

- resource - 测试图像和模型目录

将所需文件复制到您的项目中即可。

Linux/Mac演示程序编译

- 需先完成上述编译步骤并确保成功。编译好的文件会位于根目录:build/linux/install/hyperlpr3。您需要手动将其复制到当前目录。

- 进入 Prj-Linux 文件夹

# 进入Prj-linux

cd Prj-Linux

# 执行sh脚本

sh build.sh

编译完成后生成可执行程序:PlateRecDemo,运行该程序

# 进入build目录

cd build/

# 第一个参数为模型目录,第二个参数为图片路径

./PlateRecDemo ../hyperlpr3/resource/models/r2_mobile ../hyperlpr3/resource/images/test_img.jpg

Linux/Mac 快速使用 SDK 代码示例

// 加载图像

cv::Mat image = cv::imread(image_path);

// 创建 ImageData

HLPR_ImageData data = {0};

data.data = image.ptr<uint8_t>(0); // 设置图像数据流

data.width = image.cols; // 设置图像宽度

data.height = image.rows; // 设置图像高度

data.format = STREAM_BGR; // 设置当前图像编码格式

data.rotation = CAMERA_ROTATION_0; // 设置当前图像旋转角度

// 创建 Buffer

P_HLPR_DataBuffer buffer = HLPR_CreateDataBuffer(&data);

// 配置车牌识别参数

HLPR_ContextConfiguration configuration = {0};

configuration.models_path = model_path; // 模型文件夹路径

configuration.max_num = 5; // 最大车牌数量

configuration.det_level = DETECT_LEVEL_LOW; // 检测器等级

configuration.use_half = false;

configuration.nms_threshold = 0.5f; // 非极大值抑制置信度阈值

configuration.rec_confidence_threshold = 0.5f; // 车牌号码文本置信度阈值

configuration.box_conf_threshold = 0.30f; // 检测器阈值

configuration.threads = 1;

// 实例化 Context

P_HLPR_Context ctx = HLPR_CreateContext(&configuration);

// 查询 Context 状态

HREESULT ret = HLPR_ContextQueryStatus(ctx);

if (ret != HResultCode::Ok) {

printf("创建失败。\n");

return -1;

}

HLPR_PlateResultList results = {0};

// 执行 LPR

HLPR_ContextUpdateStream(ctx, buffer, &results);

for (int i = 0; i < results.plate_size; ++i) {

// 获取结果

std::string type;

if (results.plates[i].type == HLPR_PlateType::PLATE_TYPE_UNKNOWN) {

type = “未知";

} else {

type = TYPES[results.plates[i].type];

}

printf("<%d> %s, %s, %f\n", i + 1, type.c_str(),

results.plates[i].code, results.plates[i].text_confidence);

}

// 释放 Buffer

HLPR_ReleaseDataBuffer(buffer);

// 释放 Context

HLPR_ReleaseContext(ctx);

Android:编译共享库

- 第一步是安装第三方依赖。

- 需要准备 NDK 并配置环境变量:$ANDROID_NDK。

- 支持在 Linux/MacOS 上进行交叉编译。

# 执行脚本

sh command/build_release_android_share.sh

编译后的目录为:build/release_android/,其中包含:

- arm64-v8a - 64位共享库

- armeabi-v7a - 32位共享库

编译完成后,将 arm64-v8a 和 armeabi-v7a 目录复制到 Prj-Android/hyperlpr3/libs,然后编译 Prj-Android 项目即可使用。

使用 Docker 编译

如果需要使用 Docker 进行编译,我们提供了以下几种方式:

1. 使用 Docker 编译 Linux-x86 共享库

需要安装 Docker 和 Docker Compose,并构建 hyperlpr_build 镜像:

docker build -t hyperlpr_build .

开始编译共享库:

docker-compose up build_linux_x86_shared_lib

编译输出目录:build/linux

Android SDK 示例

我们提供了一个基于 Android SDK 的示例项目:hyperlpr3-android-sdk,您可以根据需要编译共享库并使用该项目。

在 Android 中快速使用

如果您希望快速将我们的 SDK 集成到自己的 Android 项目中,可以在项目的 build.gradle 文件中添加以下依赖:

- 步骤 1:在根目录的 build.gradle 文件中的 repositories 部分末尾添加 JitPack 仓库:

allprojects {

repositories {

...

maven { url 'https://jitpack.io' }

}

}

- 步骤 2:添加依赖项:

dependencies {

implementation 'com.github.HyperInspire:hyperlpr3-android-sdk:1.0.3'

}

- 步骤 3:在应用中使用 HyperLPR:

// 初始化,通常只需执行一次,在程序启动时进行

HyperLPR3.getInstance().init(this, new HyperLPRParameter());

…

// 执行识别

Plate[] plates = HyperLPR3.getInstance().plateRecognition(bitmap, HyperLPR3.CAMERA_ROTATION_0, HyperLPR3.STREAM_BGRA);

更多信息请参阅:Prj-Android

支持的车牌类型(中文)

支持

- 单行蓝牌

- 单行黄牌

- 新能源车牌

- 教练车牌

有限支持

- 白色警用车牌

- 使馆/港澳车牌

- 双层黄牌

- 武警车牌

待支持

- 民航车牌

- 双层武警

- 双层军牌

- 双层农用车牌

- 双层个性化车牌

- 更多国家的车牌

注:由于训练过程中部分样本不平衡,一些特殊车牌的识别率较低,例如(使馆/港澳地区车牌),这些问题将在后续版本中得到改进。

示例

作者

- Jingyu Yan (tunmxy@163.com)

- Jack Yu (jack-yu-business@foxmail.com / https://github.com/szad670401)

- XiaoXiao (xiaoxiao@xidian.edu.cn)

帮助

- HyperInspire QQ 群:529385694

版本历史

v3.02023/02/28常见问题

相似工具推荐

stable-diffusion-webui

stable-diffusion-webui 是一个基于 Gradio 构建的网页版操作界面,旨在让用户能够轻松地在本地运行和使用强大的 Stable Diffusion 图像生成模型。它解决了原始模型依赖命令行、操作门槛高且功能分散的痛点,将复杂的 AI 绘图流程整合进一个直观易用的图形化平台。 无论是希望快速上手的普通创作者、需要精细控制画面细节的设计师,还是想要深入探索模型潜力的开发者与研究人员,都能从中获益。其核心亮点在于极高的功能丰富度:不仅支持文生图、图生图、局部重绘(Inpainting)和外绘(Outpainting)等基础模式,还独创了注意力机制调整、提示词矩阵、负向提示词以及“高清修复”等高级功能。此外,它内置了 GFPGAN 和 CodeFormer 等人脸修复工具,支持多种神经网络放大算法,并允许用户通过插件系统无限扩展能力。即使是显存有限的设备,stable-diffusion-webui 也提供了相应的优化选项,让高质量的 AI 艺术创作变得触手可及。

everything-claude-code

everything-claude-code 是一套专为 AI 编程助手(如 Claude Code、Codex、Cursor 等)打造的高性能优化系统。它不仅仅是一组配置文件,而是一个经过长期实战打磨的完整框架,旨在解决 AI 代理在实际开发中面临的效率低下、记忆丢失、安全隐患及缺乏持续学习能力等核心痛点。 通过引入技能模块化、直觉增强、记忆持久化机制以及内置的安全扫描功能,everything-claude-code 能显著提升 AI 在复杂任务中的表现,帮助开发者构建更稳定、更智能的生产级 AI 代理。其独特的“研究优先”开发理念和针对 Token 消耗的优化策略,使得模型响应更快、成本更低,同时有效防御潜在的攻击向量。 这套工具特别适合软件开发者、AI 研究人员以及希望深度定制 AI 工作流的技术团队使用。无论您是在构建大型代码库,还是需要 AI 协助进行安全审计与自动化测试,everything-claude-code 都能提供强大的底层支持。作为一个曾荣获 Anthropic 黑客大奖的开源项目,它融合了多语言支持与丰富的实战钩子(hooks),让 AI 真正成长为懂上

ComfyUI

ComfyUI 是一款功能强大且高度模块化的视觉 AI 引擎,专为设计和执行复杂的 Stable Diffusion 图像生成流程而打造。它摒弃了传统的代码编写模式,采用直观的节点式流程图界面,让用户通过连接不同的功能模块即可构建个性化的生成管线。 这一设计巧妙解决了高级 AI 绘图工作流配置复杂、灵活性不足的痛点。用户无需具备编程背景,也能自由组合模型、调整参数并实时预览效果,轻松实现从基础文生图到多步骤高清修复等各类复杂任务。ComfyUI 拥有极佳的兼容性,不仅支持 Windows、macOS 和 Linux 全平台,还广泛适配 NVIDIA、AMD、Intel 及苹果 Silicon 等多种硬件架构,并率先支持 SDXL、Flux、SD3 等前沿模型。 无论是希望深入探索算法潜力的研究人员和开发者,还是追求极致创作自由度的设计师与资深 AI 绘画爱好者,ComfyUI 都能提供强大的支持。其独特的模块化架构允许社区不断扩展新功能,使其成为当前最灵活、生态最丰富的开源扩散模型工具之一,帮助用户将创意高效转化为现实。

NextChat

NextChat 是一款轻量且极速的 AI 助手,旨在为用户提供流畅、跨平台的大模型交互体验。它完美解决了用户在多设备间切换时难以保持对话连续性,以及面对众多 AI 模型不知如何统一管理的痛点。无论是日常办公、学习辅助还是创意激发,NextChat 都能让用户随时随地通过网页、iOS、Android、Windows、MacOS 或 Linux 端无缝接入智能服务。 这款工具非常适合普通用户、学生、职场人士以及需要私有化部署的企业团队使用。对于开发者而言,它也提供了便捷的自托管方案,支持一键部署到 Vercel 或 Zeabur 等平台。 NextChat 的核心亮点在于其广泛的模型兼容性,原生支持 Claude、DeepSeek、GPT-4 及 Gemini Pro 等主流大模型,让用户在一个界面即可自由切换不同 AI 能力。此外,它还率先支持 MCP(Model Context Protocol)协议,增强了上下文处理能力。针对企业用户,NextChat 提供专业版解决方案,具备品牌定制、细粒度权限控制、内部知识库整合及安全审计等功能,满足公司对数据隐私和个性化管理的高标准要求。

ML-For-Beginners

ML-For-Beginners 是由微软推出的一套系统化机器学习入门课程,旨在帮助零基础用户轻松掌握经典机器学习知识。这套课程将学习路径规划为 12 周,包含 26 节精炼课程和 52 道配套测验,内容涵盖从基础概念到实际应用的完整流程,有效解决了初学者面对庞大知识体系时无从下手、缺乏结构化指导的痛点。 无论是希望转型的开发者、需要补充算法背景的研究人员,还是对人工智能充满好奇的普通爱好者,都能从中受益。课程不仅提供了清晰的理论讲解,还强调动手实践,让用户在循序渐进中建立扎实的技能基础。其独特的亮点在于强大的多语言支持,通过自动化机制提供了包括简体中文在内的 50 多种语言版本,极大地降低了全球不同背景用户的学习门槛。此外,项目采用开源协作模式,社区活跃且内容持续更新,确保学习者能获取前沿且准确的技术资讯。如果你正寻找一条清晰、友好且专业的机器学习入门之路,ML-For-Beginners 将是理想的起点。

ragflow

RAGFlow 是一款领先的开源检索增强生成(RAG)引擎,旨在为大语言模型构建更精准、可靠的上下文层。它巧妙地将前沿的 RAG 技术与智能体(Agent)能力相结合,不仅支持从各类文档中高效提取知识,还能让模型基于这些知识进行逻辑推理和任务执行。 在大模型应用中,幻觉问题和知识滞后是常见痛点。RAGFlow 通过深度解析复杂文档结构(如表格、图表及混合排版),显著提升了信息检索的准确度,从而有效减少模型“胡编乱造”的现象,确保回答既有据可依又具备时效性。其内置的智能体机制更进一步,使系统不仅能回答问题,还能自主规划步骤解决复杂问题。 这款工具特别适合开发者、企业技术团队以及 AI 研究人员使用。无论是希望快速搭建私有知识库问答系统,还是致力于探索大模型在垂直领域落地的创新者,都能从中受益。RAGFlow 提供了可视化的工作流编排界面和灵活的 API 接口,既降低了非算法背景用户的上手门槛,也满足了专业开发者对系统深度定制的需求。作为基于 Apache 2.0 协议开源的项目,它正成为连接通用大模型与行业专有知识之间的重要桥梁。