gelab-zero

GELab-Zero 是一款面向移动应用界面自动化的开源工具,专注于通过AI技术实现跨平台的GUI操作。它解决了移动生态碎片化带来的开发复杂性问题,无需依赖云服务即可完成本地化部署,保障用户数据隐私。该工具提供即插即用的完整基础设施,支持多设备协同与任务分发,特别适合需要进行自动化测试、智能交互开发的开发者,以及探索移动端AI应用的研究人员。其技术亮点包括开源架构、轻量级模型部署能力、与Hugging Face等平台的兼容性,以及配套的基准测试数据集,为用户提供从实验到落地的全链条支持。

使用场景

某电商平台开发团队需在100+种安卓设备上验证支付流程兼容性,传统测试方式面临以下挑战:

没有 gelab-zero 时

- 依赖第三方云测平台进行设备租赁,单次测试成本超2000元

- 支付界面元素需手动编写适配代码,每台设备平均耗时30分钟

- 测试数据通过公网传输,存在用户隐私泄露风险

- 多设备并行测试需搭建专用机房,硬件投入超50万元

- 测试脚本更新需重新部署整个测试环境,迭代周期长达3天

使用 gelab-zero 后

- 本地化部署后单次测试成本降至50元以下,设备资源可复用

- 通过预训练模型自动识别支付控件,设备测试时间压缩至5分钟

- 所有数据处理在本地完成,通过等保三级认证

- 利用MCP-Server实现千台设备并发测试,硬件成本降低80%

- 支持热更新测试脚本,迭代周期缩短至2小时

核心价值在于通过全栈开源方案,将移动GUI自动化测试的效率提升40倍,同时保障数据安全与成本可控。

运行环境要求

- Linux

- macOS

- Windows

未说明

未说明

快速开始

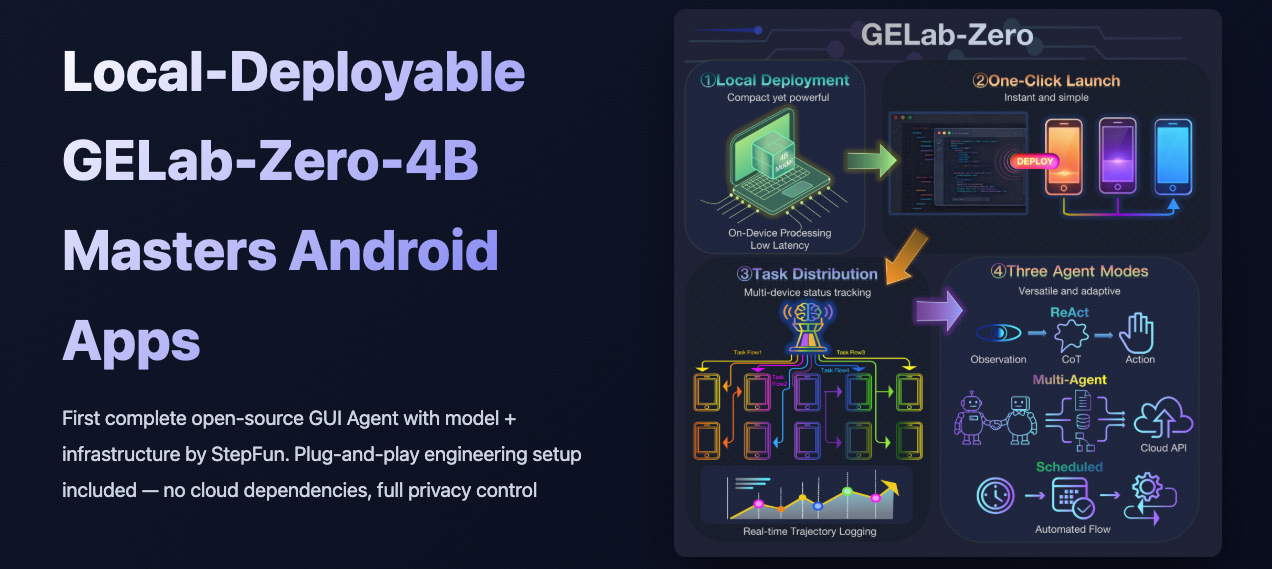

👋 大家好!我们自豪地推出首个完全开源的 GUI 代理,它同时包含了模型和基础设施。我们的解决方案采用即插即用的设计,无需任何云端依赖,让您完全掌控数据隐私。

📰 新闻

- 🎁 [2025-12-18] 我们在 arXiv 上发布了 Step-GUI 技术报告!

- 🎁 [2025-12-18] 我们发布了一个功能更强大的 API,用于 GUI 自动化任务。在此申请 API 访问权限!

- 🎁 [2025-12-12] 我们推出了支持多设备管理和任务分配的 MCP-Server。请参阅 安装与快速入门 和 MCP-Server 设置 获取设置说明。

- 🎁 [2025-12-1] 我们感谢以下项目和作者提供的量化工具及教程:GGUF_v1、GGUF_v2、EXL3、教程_CN、教程_EN

- 🎁 [2025-11-31] 我们在 Hugging Face 和 Model Scope 上发布了轻量级的 4B 模型 GELab-Zero-4B-preview。

- 🎁 [2025-11-31] 我们发布了来自 AndroidDaily 基准测试的任务。

- 🎁 [2025-11-30] 我们发布了当前的 GELab-Zero 工程基础设施。

- 🎁 [2025-10] 我们的关于 GELab-Engine 的 研究 论文已被 NeurIPS 2025 接受。

📑 目录

📧 联系方式

您可以通过加入我们的微信群与我们联系和交流:

| 微信群 |

|---|

|

📖 背景

随着人工智能在消费级设备中的应用日益普及,移动 Agent 研究正处于一个关键转折点:从 “可行性验证” 向 “大规模应用” 过渡。尽管基于 GUI 的解决方案具有普遍兼容性,但移动生态系统的碎片化却带来了沉重的工程负担,阻碍了创新。GELab-Zero 的设计正是为了打破这些壁垒。

⚡️ 开箱即用的全栈基础设施

通过统一的一键推理流程,解决了移动生态系统的碎片化问题。它能够自动处理多设备的 ADB 连接、依赖项和权限,使开发者可以专注于战略创新,而非工程基础设施。🖥️ 消费级本地部署

内置一个针对 Mac (M系列) 和 NVIDIA RTX 4060 完全优化的 4B GUI 代理模型。支持完全本地运行,确保在标准消费级硬件上实现数据隐私和低延迟。📱 灵活的任务分配与编排

支持跨多个设备分配任务,并记录交互轨迹。提供 ReAct 循环、多智能体协作和定时任务三种灵活模式,以应对复杂的现实业务场景。🚀 加速从原型到生产

赋能开发者快速验证交互策略,同时允许企业直接复用底层基础设施进行零成本的 MCP 集成,从而弥合“可行性验证”与“大规模应用”之间的关键鸿沟。

🎥 应用演示

推荐 - 科幻电影

任务:帮我找一些最近上映的好看的科幻电影

推荐 - 旅行目的地

任务:帮我找个周末可以带孩子去的地方

实用任务 - 领取补贴

任务:在企业福利平台上领取餐券

实用任务 - 地铁线路查询

任务:查询地铁1号线是否正常运营,然后导航到最近的1号线地铁站入口

复杂任务 - 多商品购物

任务:前往饿了么上最近的盒马鲜生门店,购买以下商品:红色草莓300克、秘鲁比安卡蓝莓125克(直径18毫米)、当季新鲜黄土豆500克、甜味小南瓜750克、盒马大粒虾滑、盒马纯黑豆浆2瓶(每瓶300毫升)、小王子夏威夷果可可脆饼120克、盒马菠菜面、盒马五香牛肉、好欢螺螺蛳粉5袋(重辣特臭口味,每袋400克)、m&m's牛奶巧克力豆100克。

复杂任务 - 信息检索

任务:在知乎上搜索“如何学习财务管理”,并查看第一个点赞数超过1万的回答。

复杂任务 - 条件搜索

任务:在淘宝上找到一双白色帆布鞋,尺码为37码,价格低于100元,然后将符合条件的第一件商品加入收藏夹。

复杂任务 - 在线答题

任务:前往百词斩,帮我完成词汇学习任务。

🏆 开放基准测试

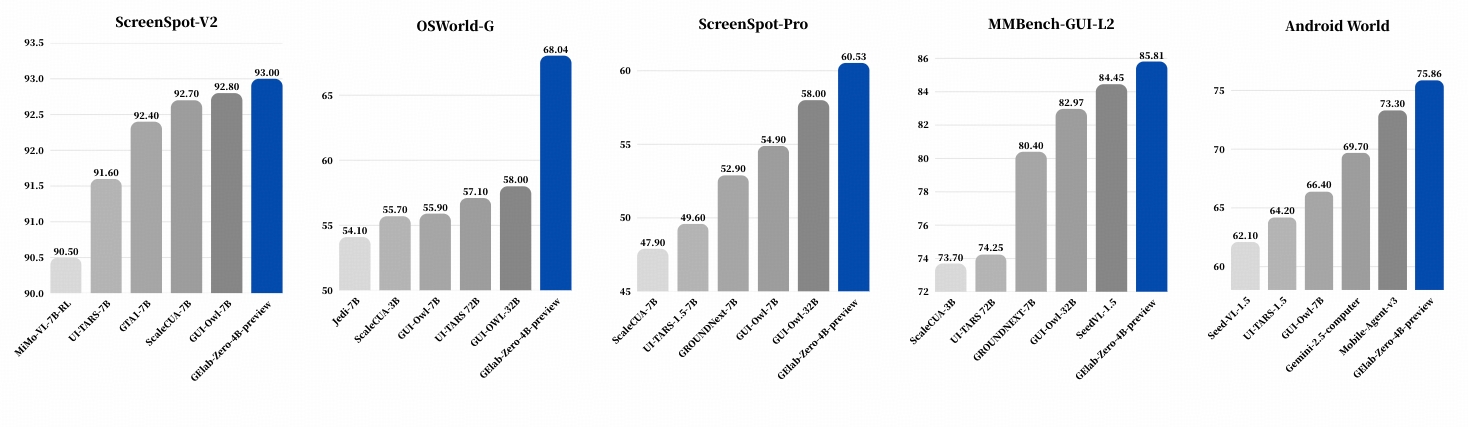

我们在多个开源基准测试中对GELab-Zero-4B-preview模型进行了全面评估,涵盖了GUI理解、本地化和交互等多个维度。与其他开源模型的对比结果如下:

基准测试结果显示,GELab-Zero-4B-preview在多个开源基准测试中表现出色,尤其在真实移动场景(Android世界)中表现尤为突出,证明了其在实际应用中的强大能力。

🚀 安装与快速入门

端到端推理只需几个简单步骤:

- 搭建LLM推理环境(ollama或vllm)

- 搭建安卓设备执行环境(adb配置)并开启开发者模式

- 搭建Agent运行环境(gelab-zero一键部署脚本)

- 搭建轨迹可视化环境(可选) 上述第三方基础设施依赖非常成熟,无需担心。

我们假设您已安装Python 3.12及以上版本,并具备一定的命令行操作基础。如果您尚未安装Python环境,请参考步骤0进行安装。

步骤0:Python环境搭建

如果您尚未安装Python 3.12及以上版本,可以参考以下步骤进行安装: 为了商业友好性和跨平台支持,我们推荐使用miniforge来安装和管理Python环境。官方网站:https://github.com/conda-forge/miniforge

- Windows用户:必须使用powershell

直接下载并手动安装Miniforge。请参考:https://github.com/conda-forge/miniforge中的“Install”部分。安装时,请务必勾选将Conda添加到**PATH**环境变量的选项,以确保Conda能够正确激活。

安装完成后,激活Conda。打开PowerShell并输入以下命令:

# 在PowerShell中激活Conda

conda init powershell

# 允许Conda脚本在PowerShell启动时运行

Set-ExecutionPolicy -ExecutionPolicy RemoteSigned -Scope CurrentUser

成功激活的标志是终端最新一行开头显示“(base)”。

- 建议使用VS Code进行代码执行和调试。请从官方网站下载并安装:https://code.visualstudio.com/

- MAC和Linux用户:

- 使用命令行下载并安装miniforge:

curl -L -O "https://github.com/conda-forge/miniforge/releases/latest/download/Miniforge3-$(uname)-$(uname -m).sh"

bash Miniforge3-$(uname)-$(uname -m).sh

安装完成后,创建并激活一个新的Python环境:

conda create -n gelab-zero python=3.12 -y

conda activate gelab-zero

步骤1:LLM推理环境搭建

我们验证了两种主流的LLM本地推理部署方法:ollama和vllm。建议个人用户使用ollama方法,而企业用户及有一定技术背景的用户可以选择vllm方法,以获得更稳定的推理服务。

步骤1.1:Ollama搭建(推荐个人用户)

对于进行本地推理的个人用户,我们强烈建议使用Ollama进行本地部署,因为它具有安装简单、使用方便的优点。

Windows和Mac用户:可以直接从官方网站下载并安装图形界面版本:https://ollama.com/。

Linux用户:请参考官方文档进行安装:https://ollama.com/download/linux。Linux用户的一键安装命令如下:

# 下载并安装最新版Linux Ollama AppImage

curl -fsSL https://ollama.com/install.sh | sh

步骤1.2:GELab-Zero-4B-preview模型搭建

完成Ollama的安装后,您需要使用以下命令下载并部署gelab-zero-4b-preview模型:

# 如果尚未安装huggingface cli,先执行此命令

pip install huggingface_hub

# 如果在中国下载速度较慢,可以尝试使用镜像加速“https://hf-mirror.com”

# WINDOWS用户可以使用以下命令:

# $env:HF_ENDPOINT = "https://hf-mirror.com"

# LINUX和MAC用户可以使用以下命令:

# export HF_ENDPOINT="https://hf-mirror.com"

# 从huggingface下载gelab-zero-4b-preview模型权重

hf download --no-force-download stepfun-ai/GELab-Zero-4B-preview --local-dir gelab-zero-4b-preview

# 将模型导入 ollama

cd gelab-zero-4b-preview

ollama create gelab-zero-4b-preview -f Modelfile

# 如果 Windows 用户遇到错误,需要指定安装路径,例如:

# C:\Users\admin\AppData\Local\Programs\Ollama\ollama.exe create gelab-zero-4b-preview -f Modelfile

# 如果您的电脑配置较低,可以考虑对模型进行量化以提高推理速度。请注意,量化可能会导致模型性能的一定程度下降。

# 详细文档请参阅:https://docs.ollama.com/import#quantizing-a-model

# 使用 int8 精度对模型进行量化(精度损失较小,模型大小变为 4.4G):

ollama create -q q8_0 gelab-zero-4b-preview

# 使用 int4 精度对模型进行量化(精度损失较大,模型大小变为 2.2G):

ollama create -q Q4_K_M gelab-zero-4b-preview

# 恢复到原始精度:

ollama create -q f16 gelab-zero-4b-preview

Windows 用户:您可以打开 Ollama 应用程序,选择 gelab-zero-4b-preview 模型,并发送一条消息来测试该模型是否能够正确回复。

Mac 和 Linux 用户:您可以通过以下命令测试模型是否已成功安装:

curl -X POST http://localhost:11434/v1/chat/completions \

-H "Content-Type: application/json" \

-d '{

"model": "gelab-zero-4b-preview",

"messages": [{"role": "user", "content": "Hello, GELab-Zero!"}]

}'

预期输出应包含模型的回复内容,表明模型已成功安装并运行。例如:

{"id":"chatcmpl-174","object":"chat.completion","created":1764405566,"model":"gelab-zero-4b-preview","system_fingerprint":"fp_ollama","choices":[{"index":0,"message":{"role":"assistant","content":"Hello! I'm here to help with any questions or information you might need. How can I assist you today?"},"finish_reason":"stop"}],"usage":{"prompt_tokens":16,"completion_tokens":24,"total_tokens":40}}

完成上述步骤后,说明您的 ollama 环境和 gelab-zero-4b-preview 模型已成功安装,您可以继续下一步的移动执行环境配置。

第二步:Android 设备执行环境设置

为了让 GELab-Zero 能够控制手机执行任务,您需要完成以下步骤来配置移动执行环境:

- 在手机上启用开发者模式和 USB 调试。

- 安装 ADB 工具,并确保计算机可以通过 ADB 连接到手机。(如果您已经安装了 adb 工具,可以跳过此步骤)

- 使用 USB 数据线将手机连接到计算机,并通过

adb devices命令确认连接是否成功。

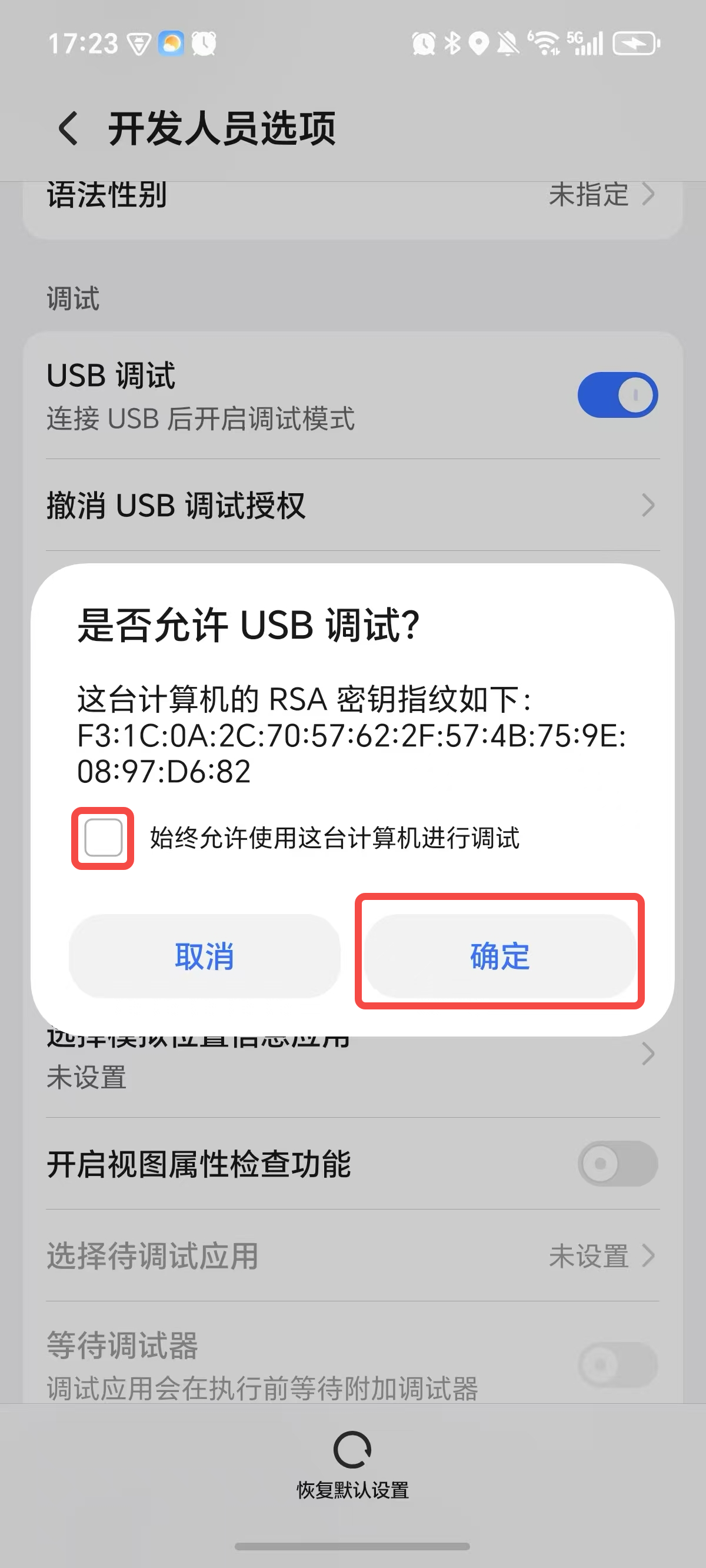

步骤 2.1:启用开发者模式和 USB 调试

通常,您可以通过以下步骤在 Android 手机上启用开发者模式和 USB 调试:

- 打开手机上的“设置”应用。

- 找到“关于手机”或“系统”选项,连续点击“版本号”10 次以上,直到出现“您现在是开发者”的提示。

- 返回主“设置”菜单,找到“开发者选项”。【重要,必须启用】

- 在“开发者选项”中,找到并启用“USB 调试”功能。按照屏幕上的指示启用 USB 调试。【重要,必须启用】

不同品牌的手机可能会有一些细微差异,请根据您的具体情况调整。一般来说,搜索“<手机品牌> 如何启用开发者模式”即可找到相关教程。 完成设置后,界面应如下图所示:

步骤 2.2:安装 ADB 工具

ADB(Android Debug Bridge)是用于 Android 设备与计算机之间通信的桥梁工具。您可以通过以下步骤安装 ADB 工具:

- Windows 用户:

- 下载 ADB 工具包:https://dl.google.com/android/repository/platform-tools-latest-windows.zip,并将其解压到合适的位置。

- 将解压后的文件夹路径添加到系统环境变量中,以便在命令行中直接使用 adb 命令。详细步骤请参阅:https://learn.microsoft.com/en-us/previous-versions/office/developer/sharepoint-2010/ee537574(v=office.14) 。具体步骤包括:

1. 在“开始”菜单中右键单击“计算机”,选择“属性”。

2. 单击“高级系统设置”。

3. 在“系统属性”对话框中,单击“环境变量”按钮。

4. 在“系统变量”部分,找到并选择“Path”变量,然后单击“编辑”按钮。

5. 在“编辑环境变量”对话框中,单击“新建”,然后输入 ADB 工具包的解压路径。

6. 单击“确定”保存更改,并关闭所有对话框。

- MAC 和 Linux 用户:

- 您可以通过 Homebrew(Mac)或包管理器(Linux)安装 ADB 工具。如果尚未安装 Homebrew,需先使用以下命令进行安装:

ruby -e $(curl -fsSL https://raw.githubusercontent.com/Homebrew/install/master/install)

- 然后使用以下命令安装 ADB 工具:

brew cask install android-platform-tools

步骤 2.3:将 Android 设备连接到计算机

使用 USB 数据线将手机连接到计算机后,打开终端或命令提示符,并输入以下命令:

adb devices

如果连接成功,您将看到类似以下的输出,显示已连接的设备列表:

List of devices attached

AN2CVB4C28000731 device

如果没有看到任何设备,请检查 USB 数据线以及手机上的 USB 调试设置是否已正确启用。首次连接时,手机可能会弹出授权提示,只需选择“允许”即可。如图所示:

如果安装失败,您可以参考第三方文档:https://github.com/quickappcn/issues/issues/120 进行进一步排查。

第三步:GELab-Zero 代理运行环境设置

完成上述步骤后,您可以通过以下命令部署 GELab-Zero 的运行环境:

# 克隆仓库

git clone https://github.com/stepfun-ai/gelab-zero

cd gelab-zero

# 安装依赖

pip install -r requirements.txt

# 进行单任务推理

python examples/run_single_task.py

(可选)步骤4:轨迹可视化环境搭建

轨迹默认会保存在 running_log/server_log/os-copilot-local-eval-logs/ 目录下。你可以使用 streamlit 来可视化轨迹:

# 如果希望局域网内的其他设备也能访问,使用 --server.address 0.0.0.0

streamlit run --server.address 0.0.0.0 visualization/main_page.py --server.port 33503

# 如果只希望在本机访问,使用以下命令:

streamlit run --server.address 127.0.0.1 visualization/main_page.py --server.port 33503

然后打开浏览器,访问 http://localhost:33503 即可进入可视化界面。

每次任务执行都会生成一个唯一的会话ID,你可以在可视化界面中通过该ID查询并展示对应的轨迹。

对于点击、滑动等带有位置信息的操作,会在截图上标注出来,以便更好地理解智能体的行为。

(可选)使用 llama.cpp 部署

请确保你已经将 GELab-Zero-4B-preview 模型下载到本地。

步骤1:使用 llama.cpp 将模型转换为 GGUF 格式

克隆官方的 llama.cpp 仓库:

git clone https://github.com/ggerganov/llama.cpp.git

cd llama.cpp

pip install -r requirements.txt

# 如果存在依赖冲突,请创建一个 Conda 虚拟环境。

将模型转换为 GGUF 格式。命令行参数说明如下:

- 第一个路径指向你从 Hugging Face 下载的本地 GELab-Zero-4B-preview 模型。

--outtype指定量化精度。--outfile是输出文件名,你可以自定义路径。

# 不进行量化,保持模型完整质量

python convert_hf_to_gguf.py /PATH/TO/gelab-zero-4b-preview --outtype f16 --verbose --outfile gelab-zero-4b-preview_f16.gguf

# 量化版本(速度更快但会有一定损失;已知问题:`<THINK>` 可能会变成 `<THIN>`)

python convert_hf_to_gguf.py /PATH/TO/gelab-zero-4b-preview --outtype q8_0 --verbose --outfile gelab-zero-4b-preview_q8_0.gguf

供参考,INT8 量化的 GGUF 文件大小约为 4.28 GB。

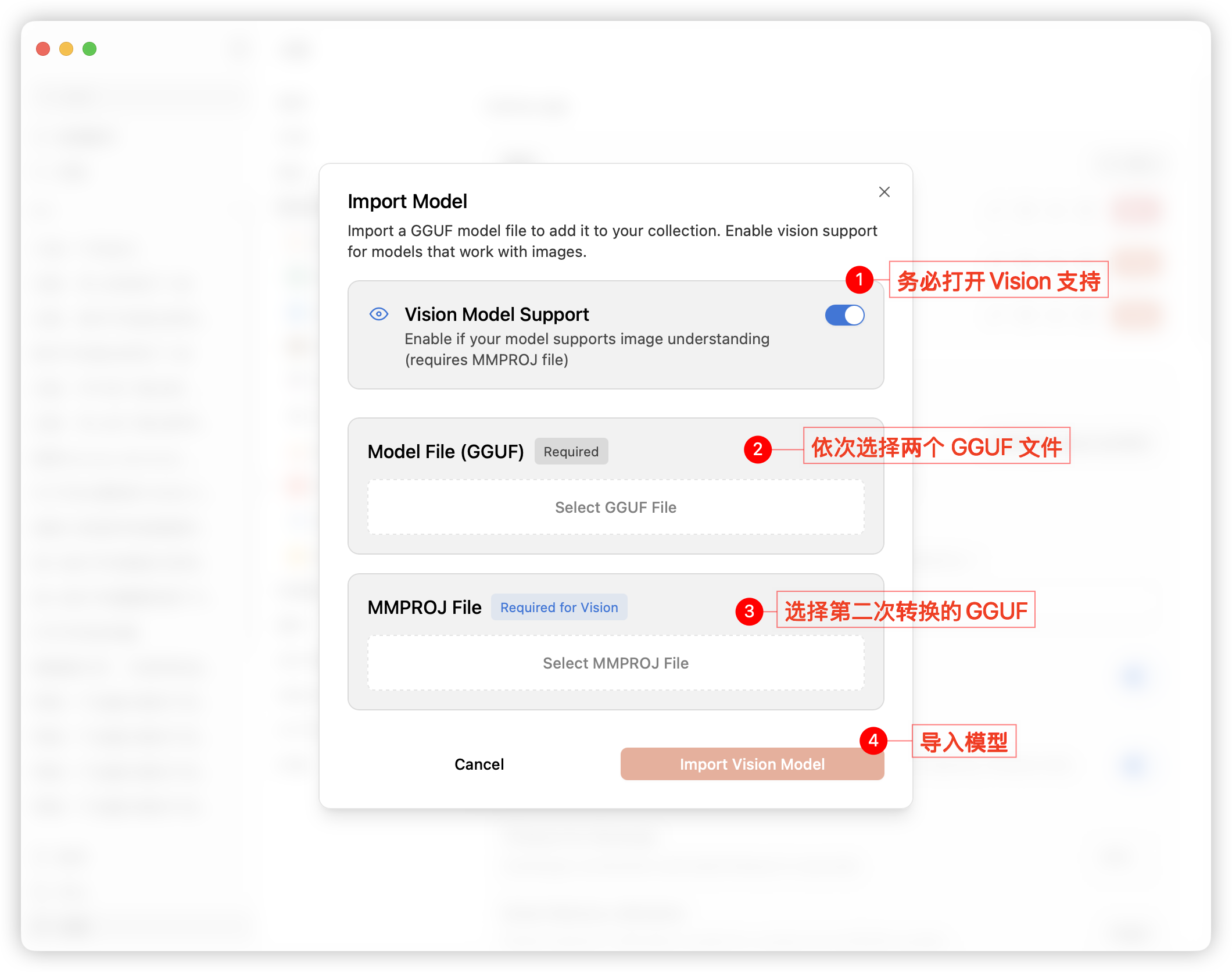

由于 GELab-Zero-4B-preview 是视觉模型,还需要导出一个 mmproj 文件:

# 对 mmproj 进行 INT8 量化

python convert_hf_to_gguf.py /PATH/TO/gelab-zero-4b-preview --outtype q8_0 --verbose --outfile gelab-zero-4b-preview_q8_0_mmproj.gguf --mmproj

供参考,INT8 量化的 mmproj GGUF 文件大小约为 454 MB。

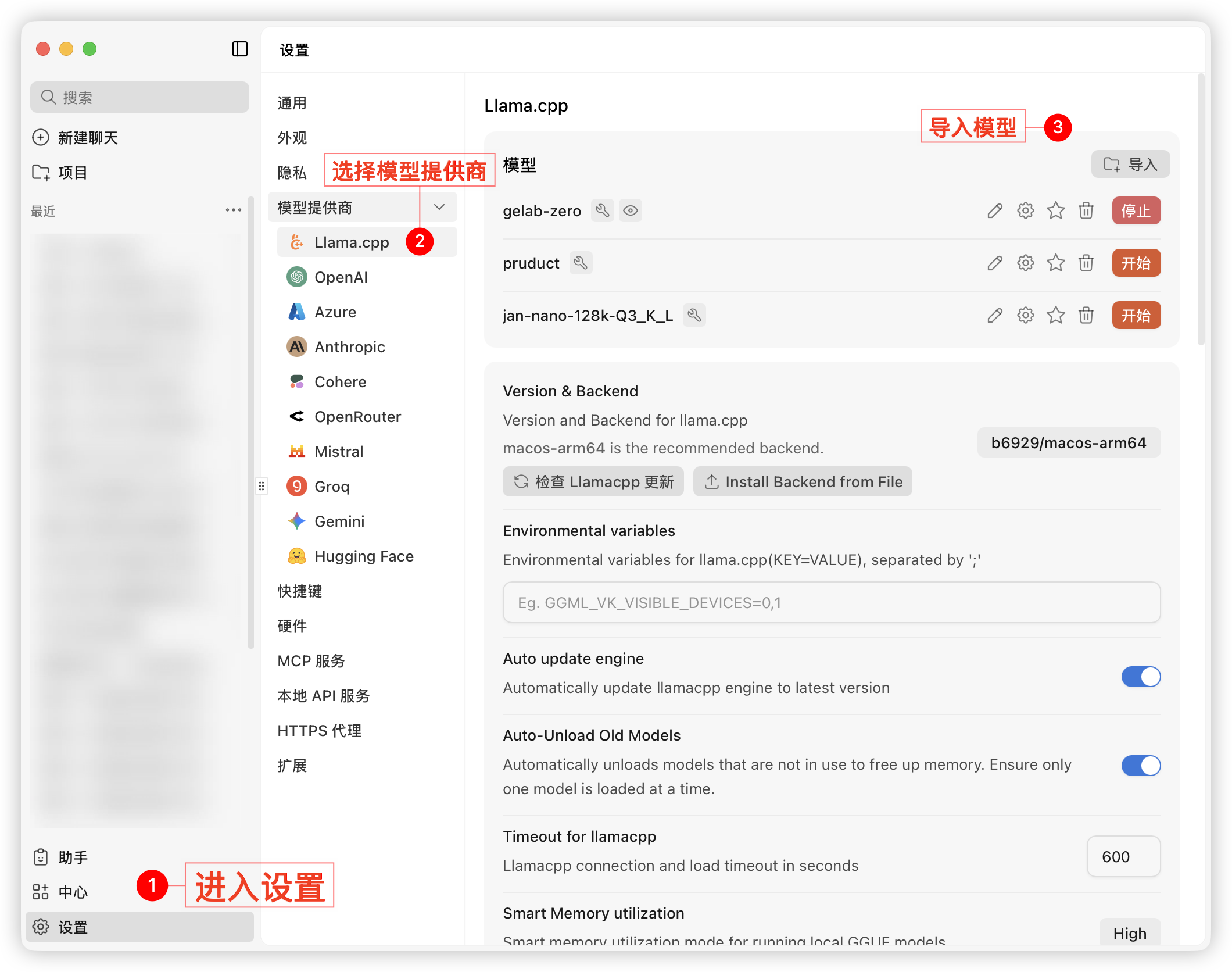

步骤2:使用 Jan 在本地提供服务

你可以使用任何兼容 llama.cpp 的客户端来启动本地 API 服务;这里以 Jan 为例:

下载 Jan 客户端并安装。

进入设置 → 模型提供商 → 选择 llama.cpp,然后导入模型:

选择刚刚转换好的两个 GGUF 文件:

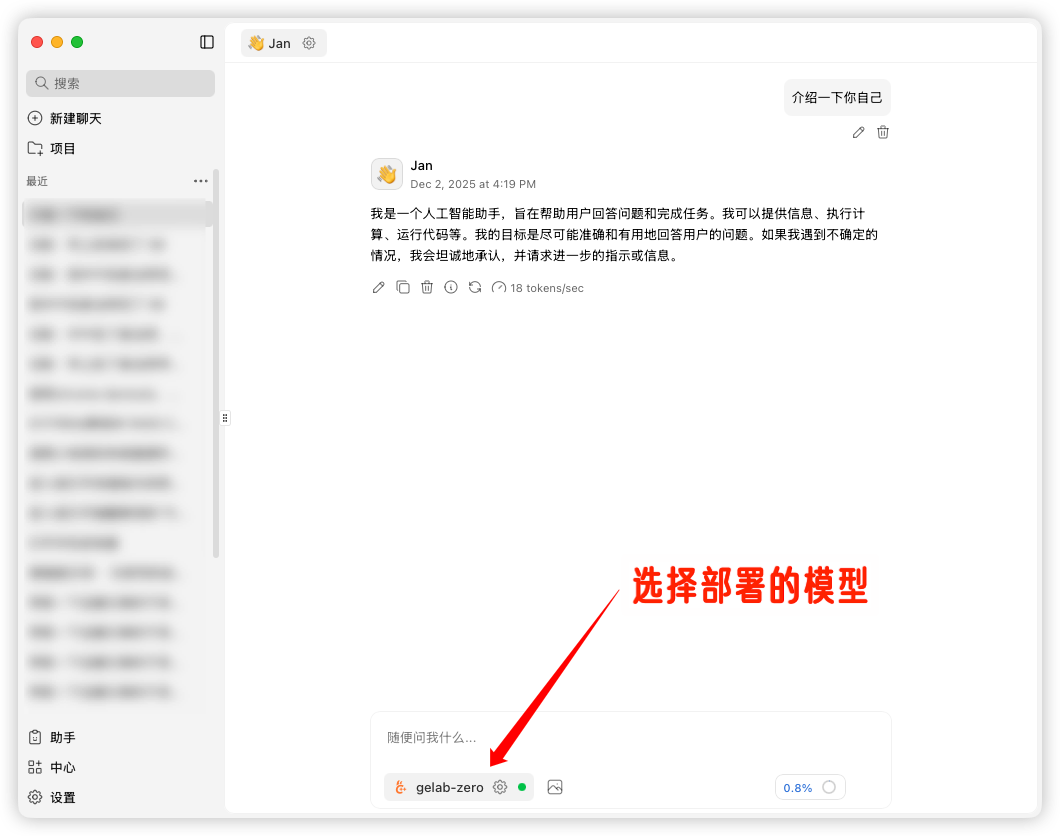

回到模型界面,点击“开始”。

创建一个聊天对话以验证模型是否正常运行:

当 token 流正常时,启动本地 API 服务器。

进入设置 → 本地 API 服务器,在服务器配置中创建一个 API 密钥,然后启动服务:

步骤3:调整 GELab-Zero Agent 的模型配置

llama.cpp 的服务与 Ollama 略有不同,因此你需要在 GELab-Zero Agent 中修改模型配置。具体有两个地方:

- 在

model_config.yaml中,更新端口和 API 密钥(使用你刚刚创建的密钥):

local:

api_base: "http://localhost:1337/v1"

api_key: "YOUR_KEY"

- 在

examples/run_single_task.py中,移除模型名称中的任何后缀参数(第21行):

local_model_config = {

"task_type": "parser_0922_summary",

"model_config": {

"model_name": "gelab-zero",

"model_provider": "local",

"args": {

"temperature": 0.1,

"top_p": 0.95,

"frequency_penalty": 0.0,

"max_tokens": 4096,

},

(可选)MCP-Server 搭建

步骤1:启动 MCP 服务器以支持多设备管理和任务分发

# 启动 mcp 服务器

python mcp_server/detailed_gelab_mcp_server.py

步骤2:在 Chatbox 中导入 MCP 工具

📝 引用

如果您在研究中使用了 GELab-Zero,请考虑引用我们的工作 :)

@misc{yan2025stepguitechnicalreport,

title={Step-GUI 技术报告},

author={Haolong Yan 和 Jia Wang 和 Xin Huang 和 Yeqing Shen 和 Ziyang Meng 和 Zhimin Fan 和 Kaijun Tan 和 Jin Gao 和 Lieyu Shi 和 Mi Yang 和 Shiliang Yang 和 Zhirui Wang 和 Brian Li 和 Kang An 和 Chenyang Li 和 Lei Lei 和 Mengmeng Duan 和 Danxun Liang 和 Guodong Liu 和 Hang Cheng 和 Hao Wu 和 Jie Dong 和 Junhao Huang 和 Mei Chen 和 Renjie Yu 和 Shunshan Li 和 Xu Zhou 和 Yiting Dai 和 Yineng Deng 和 Yingdan Liang 和 Zelin Chen 和 Wen Sun 和 Chengxu Yan 和 Chunqin Xu 和 Dong Li 和 Fengqiong Xiao 和 Guanghao Fan 和 Guopeng Li 和 Guozhen Peng 和 Hongbing Li 和 Hang Li 和 Hongming Chen 和 Jingjing Xie 和 Jianyong Li 和 Jingyang Zhang 和 Jiaju Ren 和 Jiayu Yuan 和 Jianpeng Yin 和 Kai Cao 和 Liang Zhao 和 Liguo Tan 和 Liying Shi 和 Mengqiang Ren 和 Min Xu 和 Manjiao Liu 和 Mao Luo 和 Mingxin Wan 和 Na Wang 和 Nan Wu 和 Ning Wang 和 Peiyao Ma 和 Qingzhou Zhang 和 Qiao Wang 和 Qinlin Zeng 和 Qiong Gao 和 Qiongyao Li 和 Shangwu Zhong 和 Shuli Gao 和 Shaofan Liu 和 Shisi Gao 和 Shuang Luo 和 Xingbin Liu 和 Xiaojia Liu 和 Xiaojie Hou 和 Xin Liu 和 Xuanti Feng 和 Xuedan Cai 和 Xuan Wen 和 Xianwei Zhu 和 Xin Liang 和 Xin Liu 和 Xin Zhou 和 Yingxiu Zhao 和 Yukang Shi 和 Yunfang Xu 和 Yuqing Zeng 和 Yixun Zhang 和 Zejia Weng 和 Zhonghao Yan 和 Zhiguo Huang 和 Zhuoyu Wang 和 Zheng Ge 和 Jing Li 和 Yibo Zhu 和 Binxing Jiao 和 Xiangyu Zhang 和 Daxin Jiang},

year={2025},

eprint={2512.15431},

archivePrefix={arXiv},

primaryClass={cs.CV},

url={https://arxiv.org/abs/2512.15431},

}

@software{gelab_zero_2025,

title={GELab-Zero:先进的移动代理推理系统},

author={GELab 团队},

year={2025},

url={https://github.com/stepfun-ai/gelab-zero}

}

@misc{gelab_engine,

title={GUI 探索实验室:通过多轮强化学习提升智能体的屏幕导航能力},

author={Haolong Yan 和 Yeqing Shen 和 Xin Huang 和 Jia Wang 和 Kaijun Tan 和 Zhixuan Liang 和 Hongxin Li 和 Zheng Ge 和 Osamu Yoshie 和 Si Li 和 Xiangyu Zhang 和 Daxin Jiang},

year={2025},

eprint={2512.02423},

archivePrefix={arXiv},

primaryClass={cs.CV},

url={https://arxiv.org/abs/2512.02423},

}

⭐ 星标历史

常见问题

相似工具推荐

stable-diffusion-webui

stable-diffusion-webui 是一个基于 Gradio 构建的网页版操作界面,旨在让用户能够轻松地在本地运行和使用强大的 Stable Diffusion 图像生成模型。它解决了原始模型依赖命令行、操作门槛高且功能分散的痛点,将复杂的 AI 绘图流程整合进一个直观易用的图形化平台。 无论是希望快速上手的普通创作者、需要精细控制画面细节的设计师,还是想要深入探索模型潜力的开发者与研究人员,都能从中获益。其核心亮点在于极高的功能丰富度:不仅支持文生图、图生图、局部重绘(Inpainting)和外绘(Outpainting)等基础模式,还独创了注意力机制调整、提示词矩阵、负向提示词以及“高清修复”等高级功能。此外,它内置了 GFPGAN 和 CodeFormer 等人脸修复工具,支持多种神经网络放大算法,并允许用户通过插件系统无限扩展能力。即使是显存有限的设备,stable-diffusion-webui 也提供了相应的优化选项,让高质量的 AI 艺术创作变得触手可及。

everything-claude-code

everything-claude-code 是一套专为 AI 编程助手(如 Claude Code、Codex、Cursor 等)打造的高性能优化系统。它不仅仅是一组配置文件,而是一个经过长期实战打磨的完整框架,旨在解决 AI 代理在实际开发中面临的效率低下、记忆丢失、安全隐患及缺乏持续学习能力等核心痛点。 通过引入技能模块化、直觉增强、记忆持久化机制以及内置的安全扫描功能,everything-claude-code 能显著提升 AI 在复杂任务中的表现,帮助开发者构建更稳定、更智能的生产级 AI 代理。其独特的“研究优先”开发理念和针对 Token 消耗的优化策略,使得模型响应更快、成本更低,同时有效防御潜在的攻击向量。 这套工具特别适合软件开发者、AI 研究人员以及希望深度定制 AI 工作流的技术团队使用。无论您是在构建大型代码库,还是需要 AI 协助进行安全审计与自动化测试,everything-claude-code 都能提供强大的底层支持。作为一个曾荣获 Anthropic 黑客大奖的开源项目,它融合了多语言支持与丰富的实战钩子(hooks),让 AI 真正成长为懂上

ComfyUI

ComfyUI 是一款功能强大且高度模块化的视觉 AI 引擎,专为设计和执行复杂的 Stable Diffusion 图像生成流程而打造。它摒弃了传统的代码编写模式,采用直观的节点式流程图界面,让用户通过连接不同的功能模块即可构建个性化的生成管线。 这一设计巧妙解决了高级 AI 绘图工作流配置复杂、灵活性不足的痛点。用户无需具备编程背景,也能自由组合模型、调整参数并实时预览效果,轻松实现从基础文生图到多步骤高清修复等各类复杂任务。ComfyUI 拥有极佳的兼容性,不仅支持 Windows、macOS 和 Linux 全平台,还广泛适配 NVIDIA、AMD、Intel 及苹果 Silicon 等多种硬件架构,并率先支持 SDXL、Flux、SD3 等前沿模型。 无论是希望深入探索算法潜力的研究人员和开发者,还是追求极致创作自由度的设计师与资深 AI 绘画爱好者,ComfyUI 都能提供强大的支持。其独特的模块化架构允许社区不断扩展新功能,使其成为当前最灵活、生态最丰富的开源扩散模型工具之一,帮助用户将创意高效转化为现实。

ML-For-Beginners

ML-For-Beginners 是由微软推出的一套系统化机器学习入门课程,旨在帮助零基础用户轻松掌握经典机器学习知识。这套课程将学习路径规划为 12 周,包含 26 节精炼课程和 52 道配套测验,内容涵盖从基础概念到实际应用的完整流程,有效解决了初学者面对庞大知识体系时无从下手、缺乏结构化指导的痛点。 无论是希望转型的开发者、需要补充算法背景的研究人员,还是对人工智能充满好奇的普通爱好者,都能从中受益。课程不仅提供了清晰的理论讲解,还强调动手实践,让用户在循序渐进中建立扎实的技能基础。其独特的亮点在于强大的多语言支持,通过自动化机制提供了包括简体中文在内的 50 多种语言版本,极大地降低了全球不同背景用户的学习门槛。此外,项目采用开源协作模式,社区活跃且内容持续更新,确保学习者能获取前沿且准确的技术资讯。如果你正寻找一条清晰、友好且专业的机器学习入门之路,ML-For-Beginners 将是理想的起点。

ragflow

RAGFlow 是一款领先的开源检索增强生成(RAG)引擎,旨在为大语言模型构建更精准、可靠的上下文层。它巧妙地将前沿的 RAG 技术与智能体(Agent)能力相结合,不仅支持从各类文档中高效提取知识,还能让模型基于这些知识进行逻辑推理和任务执行。 在大模型应用中,幻觉问题和知识滞后是常见痛点。RAGFlow 通过深度解析复杂文档结构(如表格、图表及混合排版),显著提升了信息检索的准确度,从而有效减少模型“胡编乱造”的现象,确保回答既有据可依又具备时效性。其内置的智能体机制更进一步,使系统不仅能回答问题,还能自主规划步骤解决复杂问题。 这款工具特别适合开发者、企业技术团队以及 AI 研究人员使用。无论是希望快速搭建私有知识库问答系统,还是致力于探索大模型在垂直领域落地的创新者,都能从中受益。RAGFlow 提供了可视化的工作流编排界面和灵活的 API 接口,既降低了非算法背景用户的上手门槛,也满足了专业开发者对系统深度定制的需求。作为基于 Apache 2.0 协议开源的项目,它正成为连接通用大模型与行业专有知识之间的重要桥梁。

OpenHands

OpenHands 是一个专注于 AI 驱动开发的开源平台,旨在让智能体(Agent)像人类开发者一样理解、编写和调试代码。它解决了传统编程中重复性劳动多、环境配置复杂以及人机协作效率低等痛点,通过自动化流程显著提升开发速度。 无论是希望提升编码效率的软件工程师、探索智能体技术的研究人员,还是需要快速原型验证的技术团队,都能从中受益。OpenHands 提供了灵活多样的使用方式:既可以通过命令行(CLI)或本地图形界面在个人电脑上轻松上手,体验类似 Devin 的流畅交互;也能利用其强大的 Python SDK 自定义智能体逻辑,甚至在云端大规模部署上千个智能体并行工作。 其核心技术亮点在于模块化的软件智能体 SDK,这不仅构成了平台的引擎,还支持高度可组合的开发模式。此外,OpenHands 在 SWE-bench 基准测试中取得了 77.6% 的优异成绩,证明了其解决真实世界软件工程问题的能力。平台还具备完善的企业级功能,支持与 Slack、Jira 等工具集成,并提供细粒度的权限管理,适合从个人开发者到大型企业的各类用户场景。