MCP-SuperAssistant

MCP SuperAssistant 是一款浏览器扩展插件,旨在打破各大主流 AI 聊天平台与本地数据之间的壁垒。它核心解决了当前网页版 AI 助手(如 ChatGPT、Gemini、Perplexity、Grok 等)无法直接访问用户本地文件、数据库或业务工具的痛点。通过集成由 Anthropic 推出的模型上下文协议(MCP),该插件让用户无需切换窗口或编写复杂代码,即可在熟悉的对话界面中直接调用本地资源,显著提升了 AI 处理实际任务的深度与准确性。

这款工具特别适合开发者、数据分析师以及需要频繁结合本地环境进行工作的研究人员使用,同时也适合希望让 AI 更懂个人数据的进阶普通用户。其独特的技术亮点在于广泛的兼容性,不仅支持 Chrome 和 Firefox 浏览器,还无缝适配包括 GitHub Copilot、Kimi、通义千问在内的十余种热门 AI 服务平台。作为连接 AI 模型与现实数据的通用桥梁,MCP SuperAssistant 以轻量化的方式实现了“万能接口”的功能,让智能助手真正融入你的工作流。

使用场景

某全栈开发者正在使用 Perplexity 进行遗留代码重构,需要实时读取本地数据库架构并调用内部 API 文档来生成准确的迁移脚本。

没有 MCP-SuperAssistant 时

- 数据孤岛严重:AI 无法直接访问本地 SQLite 文件或内部 Wiki,开发者必须手动复制粘贴大量表结构和 API 定义到对话框中,极易出错且耗时。

- 上下文断裂:每次切换查询本地文件或测试接口后,都需要重新向 AI 描述当前状态,导致对话历史冗长且逻辑分散。

- 操作繁琐低效:为了验证 AI 生成的代码,开发者需在终端、浏览器和编辑器之间反复切换,手动执行命令并反馈结果,打断心流。

- 安全风险不可控:将敏感的本地数据结构或硬编码密钥复制到公共 AI 聊天窗口,存在潜在的数据泄露隐患。

使用 MCP-SuperAssistant 后

- 无缝连接本地资源:直接在 Perplexity 或 ChatGPT 界面调用 MCP 工具,AI 可安全读取本地数据库架构和内部文档,无需任何手动复制。

- 闭环工作流:AI 能自动感知文件变更或 API 响应,基于实时上下文连续生成和优化代码,保持逻辑连贯性。

- 一键执行与验证:开发者可在聊天窗口直接触发本地命令运行测试脚本,AI 根据返回结果自动修正错误,实现“对话即开发”。

- 隐私本地化保障:敏感数据通过本地 MCP 服务器处理,仅将脱敏后的分析结果发送给大模型,确保核心资产不出内网。

MCP-SuperAssistant 打破了网页版 AI 与本地开发环境的壁垒,让大模型真正具备了操作现实世界工具的能力。

运行环境要求

- Windows

- macOS

- Linux

未说明

未说明

快速开始

MCP SuperAssistant Chrome 扩展

将 MCP 带入 ChatGPT、Perplexity、Grok、Gemini、Google AI Studio、OpenRouter、Kimi、Github Copilot、Mistral 等平台……

安装

概述

MCP SuperAssistant 是一款 Chrome 扩展,可将模型上下文协议(MCP)工具与 Perplexity、ChatGPT、Google Gemini、Google AI Studio、Grok 等 AI 平台集成。它允许用户直接从这些平台执行 MCP 工具,从而增强基于 Web 的 AI 助手的功能。

当前支持的平台

- ChatGPT

- Google Gemini

- Perplexity

- Grok

- Google AI Studio

- OpenRouter Chat

- DeepSeek

- T3 Chat

- GitHub Copilot

- Mistral AI

- Kimi

- Qwen Chat

- Z Chat

演示视频

Kimi.com

ChatGPT

观看演示,了解 MCP SuperAssistant 的实际应用!

设置教程

初次使用 MCP SuperAssistant? 观看本完整设置指南,几分钟内即可上手!

什么是 MCP?

模型上下文协议(MCP)是由 Anthropic 开发的开放标准,用于将 AI 助手连接到数据实际存储的系统,包括内容库、业务工具和开发环境。它作为一种通用协议,使 AI 系统能够安全且动态地实时与数据源交互。

主要特性

- 多 AI 平台支持:兼容 ChatGPT、Perplexity、Google Gemini、Grok、Google AI Studio、OpenRouter Chat、DeepSeek、Kagi、T3 Chat、GitHub Copilot、Mistral AI、Kimi、Qwen Chat、Z Chat 等

- 工具检测:自动检测 AI 响应中的 MCP 工具调用

- 工具执行:只需单击即可执行 MCP 工具

- 工具结果整合:无缝将工具执行结果插入 AI 对话中

- 渲染模式:呈现函数调用及函数结果。

- 自动执行模式:自动执行检测到的工具

- 自动提交模式:在插入结果后自动提交聊天输入

- 推送内容模式:可选择推送页面内容而非叠加显示

- 偏好设置持久化:记住侧边栏位置、大小及设置

- 深色/浅色模式支持:适配 AI 平台的主题

flowchart TD

A[AI 聊天界面] -->|生成| B[工具调用]

B -->|检测| C[扩展检测工具调用]

C -->|通过 SSE 发送| D[MCP 本地代理服务器]

D -->|转发| E[实际 MCP 服务器]

E -->|返回结果| D

D -->|返回结果| C

C -->|插入| F[将结果重新插入聊天]

连接到本地代理服务器

要将 Chrome 扩展连接到本地服务器以代理连接,请按照以下步骤操作:

通过 npx 运行 MCP SuperAssistant 代理:

创建一个包含 MCP 服务器详细信息的

config.json文件。例如,使用 Desktop Commander:示例 config.json:

{ "mcpServers": { "desktop-commander": { "command": "npx", "args": [ "-y", "@wonderwhy-er/desktop-commander" ] } } }config.json文件还支持其他 MCP 服务器配置,如远程 MCP 服务器 URL。您可以尝试 Composio MCP、Zapier MCP、Smithery 或任何其他远程 MCP 服务器。或使用 Cursor 或其他工具已有的配置文件路径:

macOS: ~/Library/Application Support/Claude/claude_desktop_config.json Windows: %APPDATA%\Claude\claude_desktop_config.json使用以下任一命令启动 MCP SuperAssistant 代理服务器:

npx -y @srbhptl39/mcp-superassistant-proxy@latest --config ./config.json --outputTransport sse或

npx -y @srbhptl39/mcp-superassistant-proxy --config ./config.json --outputTransport streamableHttp或

npx -y @srbhptl39/mcp-superassistant-proxy --config ./config.json --outputTransport ws查看所有可用选项:

npx -y @srbhptl39/mcp-superassistant-proxy@latest --help这对于以下场景非常有用:

- 代理远程 MCP 服务器

- 为远程服务器添加 CORS 支持

- 提供用于监控的健康端点

连接步骤:

- 使用上述任一命令启动代理服务器。

- 在支持的 AI 平台之一中打开 MCP SuperAssistant 侧边栏,此时应显示侧边栏界面。

- 点击服务器状态指示器(通常显示为“未连接”)。

- 输入本地服务器 URL(默认:

http://localhost:3006/sse)。URL 格式取决于所使用的--outputTransport方法:- 对于 SSE:

http://localhost:3006/sse - 对于 Streamable HTTP:

http://localhost:3006/mcp - 对于 WebSocket:

ws://localhost:3006/message - 选择合适的传输方法(SSE、Streamable HTTP 或 WebSocket)。

- 您也可以在此处添加任何远程 MCP 服务器 URL,前提是该服务器支持 CORS 或已通过此本地代理服务器进行代理。例如,Composio MCP、Zapier MCP、Smithery 或其他远程 MCP 服务器。

- 对于 SSE:

- 点击“连接”以建立连接。

- 如果成功,状态指示器应变为“已连接”。

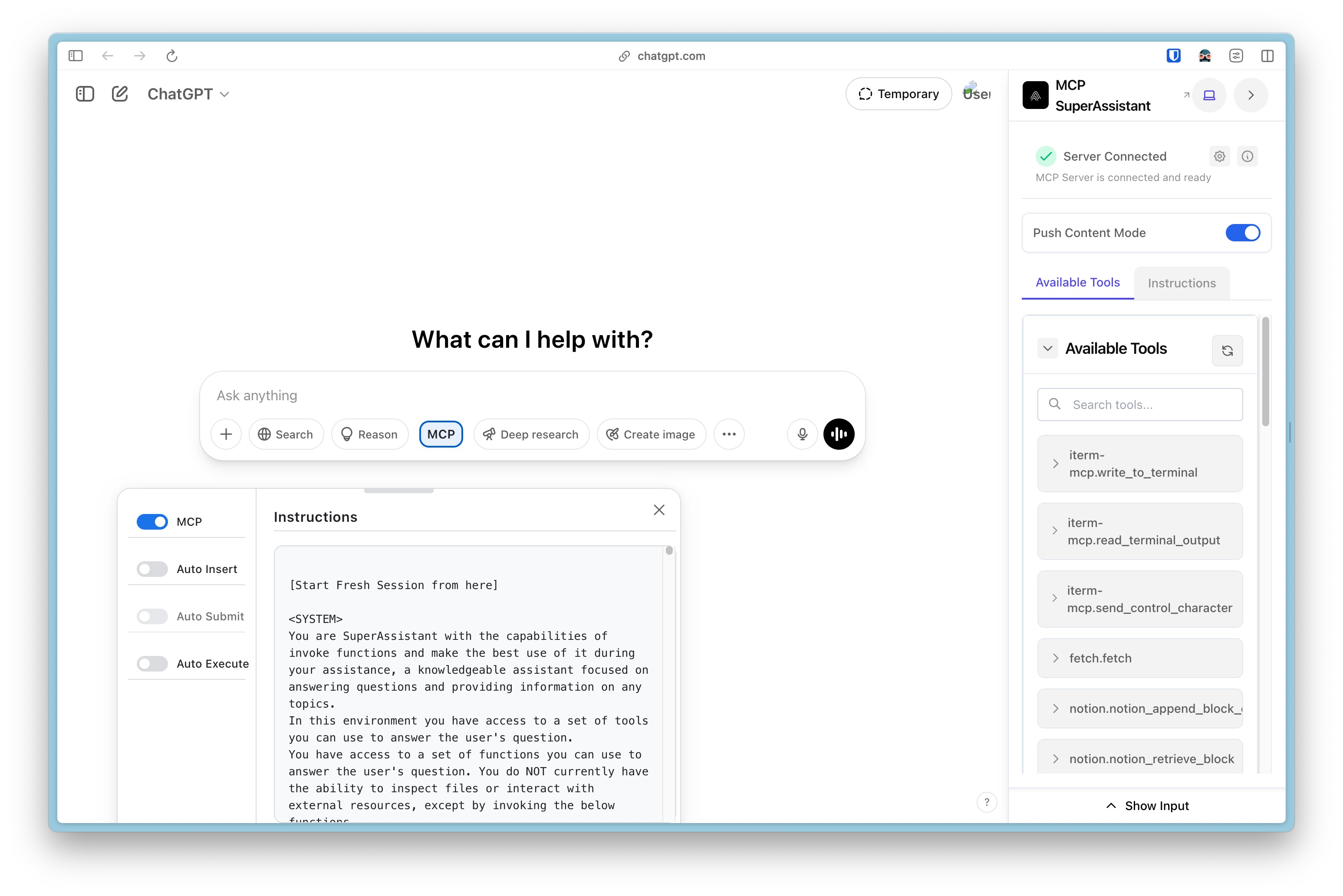

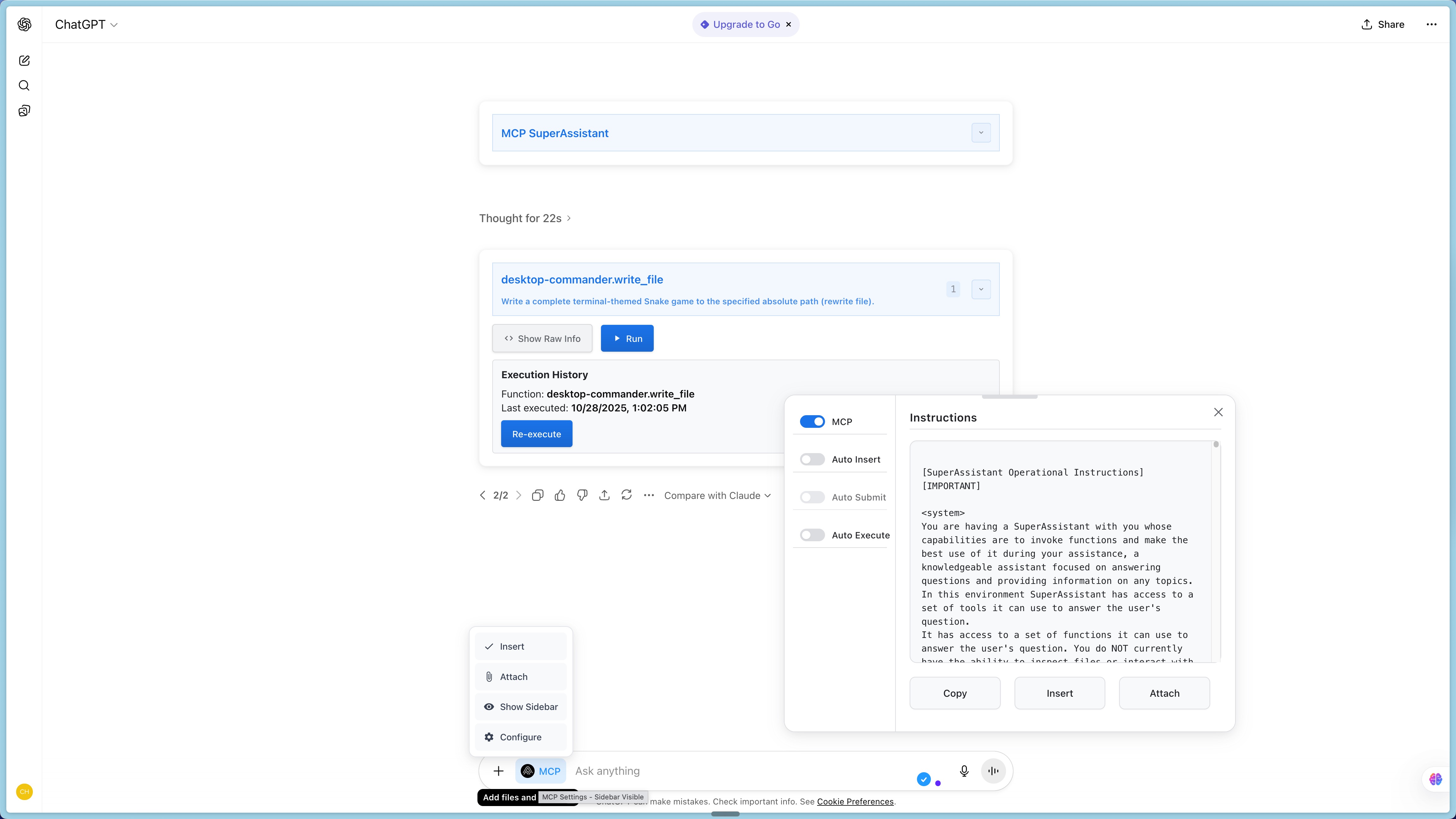

使用方法

示例工作流程:

- 导航到支持的 AI 平台,例如 ChatGPT。

- MCP SuperAssistant 侧边栏将出现在页面右侧。

- 配置您的 MCP 工具,启用或禁用您想要使用的工具。

- 在消息输入框区域,将鼠标悬停在“MCP”按钮上,即可查看可用工具及其描述。

- MCP SuperAssistant 需要在聊天中添加一条 MCP 工作指令提示,以说明其新功能及如何使用这些工具。使用“插入”或附件按钮添加该指令提示。

- 添加指令提示后,您可以要求它读取文件或执行任何相关的 MCP 工具操作。

- 当 AI 想要使用某个工具时,会显示一个自定义工具调用卡片,上面标明工具名称和参数。

- 用户可以手动点击工具调用卡片上的“运行”按钮来执行该工具调用;如果启用了自动执行模式,则会自动执行。

- 通过点击“MCP”按钮并配置自动执行和自动提交模式,可以实现自动化操作。

小贴士与技巧

- 关闭搜索模式(ChatGPT、Perplexity)在 AI 聊天界面中,以获得更好的工具调用提示体验,并防止 MCP SuperAssistant 被干扰。

- 开启推理模式(ChatGPT、Perplexity、Grok)在 AI 聊天界面中,这将有助于 AI 更好地理解上下文并生成正确的工具调用。

- 使用较新的高端模型,因为它们更擅长理解上下文并生成正确的工具调用。

- 复制 MCP 指令提示并将其粘贴到 AI 聊天系统的提示中(例如 Google AI Studio)。

- 在对话中明确提及您想要使用的特定工具。

- 使用 MCP 自动切换功能来控制工具的执行。

MCP SuperAssistant 常见问题

本页面涵盖了用户在使用 MCP SuperAssistant 时遇到的最常见问题,并提供了相应的解决方法。

1. 扩展无法检测工具调用

- 确保浏览器中已启用该扩展。

- 确保在开始聊天之前,MCP 指令提示已正确附加或插入到聊天中。

- 检查您的 AI 平台是否支持工具调用功能,并确认该功能已启用。

- 如果问题仍然存在,请刷新页面或重启浏览器。

2. 工具执行失败

- 确保您的代理服务器正在运行,并且侧边栏服务器设置中的 URL 正确。

- 检查您的

config.json文件是否存在错误或格式问题。 - 检查您的网络连接和防火墙设置。

3. 连接问题

- 确保您的 MCP 服务器正在运行且可访问。

- 检查扩展设置中的服务器 URL。

- 首先启动 npx mcp-SuperAssistant-proxy 代理服务器,然后从

chrome://extensions/页面重新加载或重启扩展。 - 检查代理服务器的日志,查看是否存在错误或问题。

- 确保您的防火墙或杀毒软件没有阻止连接。

- 确认服务器显示正确的连接状态,并暴露了

/sse端口。

4. 工具调用格式不正确

- 有时模型不会按要求生成正确的工具调用格式,这会导致工具检测失败。在这种情况下,建议使用更适合工具调用或具有更好工具调用能力的模型。

- 使用 MCP SuperAssistant 侧边栏中提供的自定义指令提示。

- 在提示中明确要求使用相关工具。

- 以下是 MCP 函数调用的正确格式示例,由 MCP SuperAssistant 扩展渲染:

```jsonl

{"type": "function_call_start", "name": "function_name", "call_id": 1}

{"type": "description", "text": "简短的一句话,描述该函数的功能"}

{"type": "parameter", "key": "parameter_1", "value": "value_1"}

{"type": "parameter", "key": "parameter_2", "value": "value_2"}

{"type": "function_call_end", "call_id": 1}

### 手动安装(开发)

#### 发布版本

1. 从 [Releases](https://github.com/srbhptl39/MCP-SuperAssistant/releases) 下载最新发布版本

2. 解压下载的文件

3. 在 Chrome 浏览器中打开 `chrome://extensions/`

4. 启用“开发者模式”

5. 点击“加载已解压的扩展程序”,并选择解压后的目录

6. 按照 [连接到本地代理服务器](#connecting-to-local-proxy-server) 的说明,连接到您的 MCP 服务器

## 开发

### 前提条件

- Node.js (v16+)

- pnpm

### 设置

```bash

# 安装依赖

pnpm install

# 启动开发服务器

pnpm dev

# 构建生产环境

pnpm build

# 创建用于分发的 zip 包

pnpm zip

贡献

欢迎贡献!请随时提交 Pull Request。

- Fork 该仓库

- 创建你的功能分支 (

git checkout -b feature/amazing-feature) - 提交你的更改 (

git commit -m '添加一些了不起的功能') - 推送到该分支 (

git push origin feature/amazing-feature) - 打开一个 Pull Request

作者

Saurabh Patel

赞助与支持

本项目完全在我的业余时间开发,源于我对 AI 和 Model Context Protocol (MCP) 的热情。作为一名全职从业者,要在工作和开源开发之间取得平衡,定期贡献并维持更新节奏颇具挑战性。

您的支持将帮助我投入更多时间:

- 🐛 修复 bug 和解决问题

- ✨ 添加新功能及平台支持

- 📚 改进文档和教程

- 🔄 更新依赖项

- 💬 回应社区需求

支持本项目:

- ⭐ 星标仓库以表达您的感谢

- 💖 在 GitHub 上赞助 以帮助持续开发

- 🐦 关注我在 Twitter (@srbhptl39) 的动态以获取最新信息

- 📧 如需私人支持或定制实现,请通过 Twitter 联系我

无论大小,每一份贡献都能让这个项目保持活力并不断进步!🙏

许可证

本项目采用 MIT 许可证授权——详情请参阅 LICENSE 文件。

致谢

- 受 Anthropic 的 Model Context Protocol (MCP) 启发

- 感谢 Cline 提供的想法灵感

- 基于 带有 React + Vite 的 Chrome 扩展模板 构建

星标历史

版本历史

v0.6.02026/02/09v.0.5.92026/01/17v.0.5.82025/11/03v0.5.72025/10/28v0.5.62025/09/07v0.5.52025/08/17v0.5.3-alpha2025/07/13v0.5.2-alpha2025/07/11v0.5.1-alpha2025/06/25v0.4.1-alpha2025/05/30v0.3.1-alpha2025/05/22v0.2.1-alpha2025/05/19v0.1.2-alpha2025/05/14v0.1.1-alpha2025/05/02相似工具推荐

everything-claude-code

everything-claude-code 是一套专为 AI 编程助手(如 Claude Code、Codex、Cursor 等)打造的高性能优化系统。它不仅仅是一组配置文件,而是一个经过长期实战打磨的完整框架,旨在解决 AI 代理在实际开发中面临的效率低下、记忆丢失、安全隐患及缺乏持续学习能力等核心痛点。 通过引入技能模块化、直觉增强、记忆持久化机制以及内置的安全扫描功能,everything-claude-code 能显著提升 AI 在复杂任务中的表现,帮助开发者构建更稳定、更智能的生产级 AI 代理。其独特的“研究优先”开发理念和针对 Token 消耗的优化策略,使得模型响应更快、成本更低,同时有效防御潜在的攻击向量。 这套工具特别适合软件开发者、AI 研究人员以及希望深度定制 AI 工作流的技术团队使用。无论您是在构建大型代码库,还是需要 AI 协助进行安全审计与自动化测试,everything-claude-code 都能提供强大的底层支持。作为一个曾荣获 Anthropic 黑客大奖的开源项目,它融合了多语言支持与丰富的实战钩子(hooks),让 AI 真正成长为懂上

NextChat

NextChat 是一款轻量且极速的 AI 助手,旨在为用户提供流畅、跨平台的大模型交互体验。它完美解决了用户在多设备间切换时难以保持对话连续性,以及面对众多 AI 模型不知如何统一管理的痛点。无论是日常办公、学习辅助还是创意激发,NextChat 都能让用户随时随地通过网页、iOS、Android、Windows、MacOS 或 Linux 端无缝接入智能服务。 这款工具非常适合普通用户、学生、职场人士以及需要私有化部署的企业团队使用。对于开发者而言,它也提供了便捷的自托管方案,支持一键部署到 Vercel 或 Zeabur 等平台。 NextChat 的核心亮点在于其广泛的模型兼容性,原生支持 Claude、DeepSeek、GPT-4 及 Gemini Pro 等主流大模型,让用户在一个界面即可自由切换不同 AI 能力。此外,它还率先支持 MCP(Model Context Protocol)协议,增强了上下文处理能力。针对企业用户,NextChat 提供专业版解决方案,具备品牌定制、细粒度权限控制、内部知识库整合及安全审计等功能,满足公司对数据隐私和个性化管理的高标准要求。

ML-For-Beginners

ML-For-Beginners 是由微软推出的一套系统化机器学习入门课程,旨在帮助零基础用户轻松掌握经典机器学习知识。这套课程将学习路径规划为 12 周,包含 26 节精炼课程和 52 道配套测验,内容涵盖从基础概念到实际应用的完整流程,有效解决了初学者面对庞大知识体系时无从下手、缺乏结构化指导的痛点。 无论是希望转型的开发者、需要补充算法背景的研究人员,还是对人工智能充满好奇的普通爱好者,都能从中受益。课程不仅提供了清晰的理论讲解,还强调动手实践,让用户在循序渐进中建立扎实的技能基础。其独特的亮点在于强大的多语言支持,通过自动化机制提供了包括简体中文在内的 50 多种语言版本,极大地降低了全球不同背景用户的学习门槛。此外,项目采用开源协作模式,社区活跃且内容持续更新,确保学习者能获取前沿且准确的技术资讯。如果你正寻找一条清晰、友好且专业的机器学习入门之路,ML-For-Beginners 将是理想的起点。

ragflow

RAGFlow 是一款领先的开源检索增强生成(RAG)引擎,旨在为大语言模型构建更精准、可靠的上下文层。它巧妙地将前沿的 RAG 技术与智能体(Agent)能力相结合,不仅支持从各类文档中高效提取知识,还能让模型基于这些知识进行逻辑推理和任务执行。 在大模型应用中,幻觉问题和知识滞后是常见痛点。RAGFlow 通过深度解析复杂文档结构(如表格、图表及混合排版),显著提升了信息检索的准确度,从而有效减少模型“胡编乱造”的现象,确保回答既有据可依又具备时效性。其内置的智能体机制更进一步,使系统不仅能回答问题,还能自主规划步骤解决复杂问题。 这款工具特别适合开发者、企业技术团队以及 AI 研究人员使用。无论是希望快速搭建私有知识库问答系统,还是致力于探索大模型在垂直领域落地的创新者,都能从中受益。RAGFlow 提供了可视化的工作流编排界面和灵活的 API 接口,既降低了非算法背景用户的上手门槛,也满足了专业开发者对系统深度定制的需求。作为基于 Apache 2.0 协议开源的项目,它正成为连接通用大模型与行业专有知识之间的重要桥梁。

PaddleOCR

PaddleOCR 是一款基于百度飞桨框架开发的高性能开源光学字符识别工具包。它的核心能力是将图片、PDF 等文档中的文字提取出来,转换成计算机可读取的结构化数据,让机器真正“看懂”图文内容。 面对海量纸质或电子文档,PaddleOCR 解决了人工录入效率低、数字化成本高的问题。尤其在人工智能领域,它扮演着连接图像与大型语言模型(LLM)的桥梁角色,能将视觉信息直接转化为文本输入,助力智能问答、文档分析等应用场景落地。 PaddleOCR 适合开发者、算法研究人员以及有文档自动化需求的普通用户。其技术优势十分明显:不仅支持全球 100 多种语言的识别,还能在 Windows、Linux、macOS 等多个系统上运行,并灵活适配 CPU、GPU、NPU 等各类硬件。作为一个轻量级且社区活跃的开源项目,PaddleOCR 既能满足快速集成的需求,也能支撑前沿的视觉语言研究,是处理文字识别任务的理想选择。

OpenHands

OpenHands 是一个专注于 AI 驱动开发的开源平台,旨在让智能体(Agent)像人类开发者一样理解、编写和调试代码。它解决了传统编程中重复性劳动多、环境配置复杂以及人机协作效率低等痛点,通过自动化流程显著提升开发速度。 无论是希望提升编码效率的软件工程师、探索智能体技术的研究人员,还是需要快速原型验证的技术团队,都能从中受益。OpenHands 提供了灵活多样的使用方式:既可以通过命令行(CLI)或本地图形界面在个人电脑上轻松上手,体验类似 Devin 的流畅交互;也能利用其强大的 Python SDK 自定义智能体逻辑,甚至在云端大规模部署上千个智能体并行工作。 其核心技术亮点在于模块化的软件智能体 SDK,这不仅构成了平台的引擎,还支持高度可组合的开发模式。此外,OpenHands 在 SWE-bench 基准测试中取得了 77.6% 的优异成绩,证明了其解决真实世界软件工程问题的能力。平台还具备完善的企业级功能,支持与 Slack、Jira 等工具集成,并提供细粒度的权限管理,适合从个人开发者到大型企业的各类用户场景。