awesome-multi-modal-reinforcement-learning

awesome-multi-modal-reinforcement-learning 是一个持续更新的多模态强化学习(MMRL)资源精选列表,旨在汇聚该领域的前沿研究论文与技术成果。它主要解决了研究人员在面对海量学术文献时难以快速定位高质量、跨模态(如视觉图像与自然语言文本)强化学习资料的痛点。通过系统性地整理来自 NeurIPS、ICML、ICLR 等顶级会议的最新论文,该项目为探索如何让智能体像人类一样直接从视频或文本中学习提供了清晰的路径。

这份资源特别适合人工智能领域的研究人员、算法工程师以及对多模态学习感兴趣的开发者使用。无论是希望追踪最新学术动态,还是寻找特定实验环境下的基准测试参考,用户都能从中获得宝贵线索。其独特亮点在于不仅收录了严格意义上的强化学习论文,还包容性地纳入了虽非直接相关但对 MMRL 研究具有启发意义的跨学科成果,并详细标注了每篇论文的核心关键词、作者团队及实验环境,极大地提升了文献调研的效率与深度。作为一个由社区共同维护的开源项目,它正成为连接理论创新与实际应用的重要桥梁。

使用场景

某机器人实验室团队正致力于研发一款能同时理解视觉指令和自然语言的家庭服务机器人,需要快速复现前沿的多模态强化学习算法以验证新架构。

没有 awesome-multi-modal-reinforcement-learning 时

- 文献检索如大海捞针:研究人员需在 ArXiv、NeurIPS、ICLR 等多个会议中手动筛选,极易遗漏像"PRIMT"或"VL-Rethinker"这类结合基础模型与多模态反馈的关键论文。

- 环境复现成本高昂:找到论文后,往往难以确认其具体的实验环境(如是用于机械臂操作还是文本生成),导致在错误的仿真平台上浪费数周时间搭建代码。

- 技术路线判断滞后:由于缺乏按年份和会议分类的结构化整理,团队难以快速把握从 2019 年到 2025 年的技术演进脉络,容易在过时的方法上投入过多资源。

- 跨模态关联困难:难以发现那些虽非纯 RL 但对多模态感知有重要价值的跨界研究,限制了智能体从视频和文本中直接学习的能力上限。

使用 awesome-multi-modal-reinforcement-learning 后

- 一站式获取前沿成果:直接查阅该清单即可锁定最新顶会论文,迅速定位到针对“多模态反馈”和“轨迹合成”的最新解决方案,将调研时间从数周缩短至数小时。

- 精准匹配实验场景:通过清单中明确标注的"ExpEnv"字段,团队能立即确认哪些算法适用于"6 项机械臂操作任务”,从而跳过无效尝试,直接复用适配的代码框架。

- 清晰把握演进趋势:利用按会议年份(如 ICLR 2024/2025)分类的目录,团队能快速梳理出视觉 - 语言模型推理能力的提升路径,制定出更具前瞻性的研发路线图。

- 拓宽技术视野:清单收录的非纯 RL 相关论文为团队提供了额外的灵感来源,成功引入了新的神经符号融合思路,显著提升了机器人对复杂指令的理解精度。

awesome-multi-modal-reinforcement-learning 通过结构化整合全球顶尖研究成果,让研发团队从繁琐的文献挖掘中解放出来,专注于核心算法的创新与落地。

运行环境要求

未说明

未说明

快速开始

令人惊叹的多模态强化学习

这是一个关于多模态强化学习 (MMRL) 的研究论文合集。 该仓库将持续更新,以追踪 MMRL 的前沿进展。 部分论文可能与强化学习无关,但我们仍将其收录,因为它们对 MMRL 研究可能具有参考价值。

欢迎关注并点赞!

简介

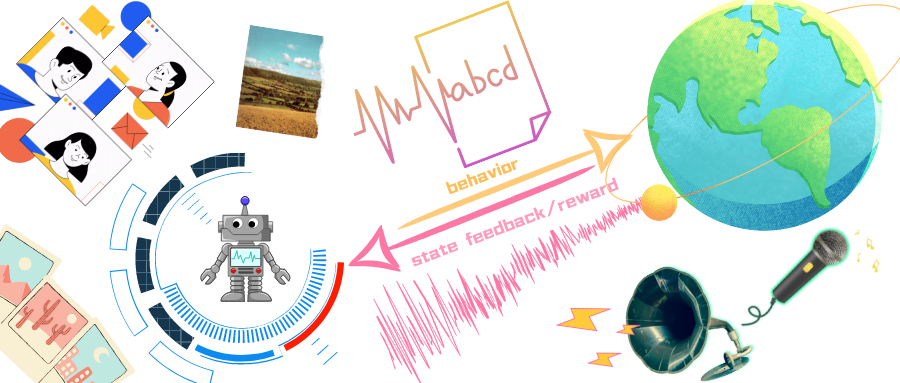

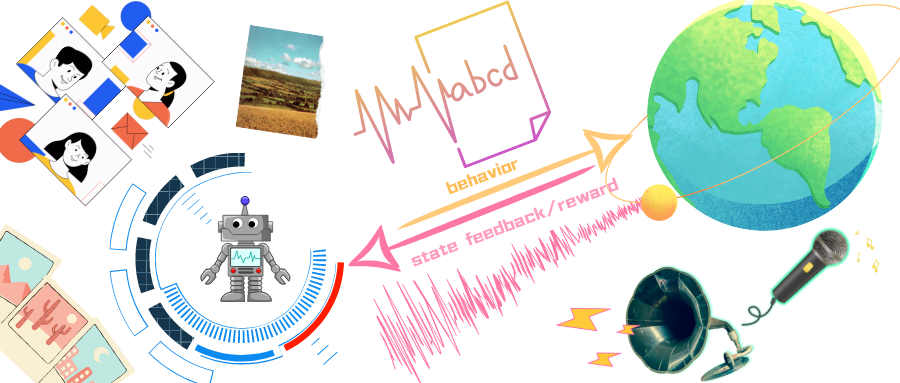

多模态强化学习智能体专注于像人类一样从视频(图像)、语言(文本)或两者中学习。我们认为,智能体直接从图像或文本中学习非常重要,因为这类数据很容易从互联网上获取。

目录

论文

格式:

- [标题](论文链接) [链接]

- 作者。

- 关键词。

- 实验环境。

NeurIPS 2025

PRIMT:基于偏好的多模态反馈与基础模型轨迹合成的强化学习

- 王瑞琪、赵德忠、袁子钦、邵天宇、陈国华、多米尼克·考、洪成勋、闵炳哲

- 关键词:基于偏好的强化学习、机器人基础模型、神经符号融合、多模态反馈、因果推断、轨迹合成、机器人操作

- 实验环境:2个移动任务和6个操作任务

-

- 蒋静静、司崇杰、罗俊、张汉旺、马超

- 关键词:强化学习、GRPO、统一多模态理解和生成

- 实验环境:文本到图像生成及多模态理解基准测试

VL-Rethinker:利用强化学习激励视觉-语言模型自我反思

- 王浩哲、曲超、黄祖明、楚伟、林方珍、陈文虎

- 关键词:视觉-语言模型、推理、强化学习

- 实验环境:MathVista、MathVerse、MathVision、MMMU-Pro、EMMA、MEGA-Bench

用更少达到顶尖:MCTS引导的样本选择用于数据高效的视觉推理自我改进

- 王希瑶、杨正源、冯超、陆洪进、李林杰、林忠清、林凯文、黄福荣、王丽娟

- 关键词:视觉语言模型;强化微调;视觉语言模型推理;数据选择

- 实验环境:MathVista及其他视觉推理基准测试

VisualQuality-R1:通过强化学习排序实现推理驱动的无参考图像质量评估

- 吴天赫、邹健、梁杰、张雷、马克德

- 关键词:图像质量评估、强化学习、推理驱动的无参考 IQA 模型

- 实验环境:图像质量评估基准测试

-

- 李伟奇、张轩宇、赵世杰、张亚斌、李俊林、张力、张建

- 关键词:图像质量理解、多模态大型语言模型、强化学习

- 实验环境:图像质量理解基准测试

-

- 李明、钟继科、赵士田、赖宇翔、张浩泉、朱王比尔、张凯鹏

- 关键词:视觉强化微调、明确思考、过度思考

- 实验环境:六个不同的视觉推理任务

-

- 肖文义、甘蕾蕾

- 关键词:大型视觉-语言模型、快慢思维、推理

- 实验环境:七个推理基准测试

SafeVLA:通过约束学习实现视觉-语言-动作模型的安全对齐

- 张博荣、张宇豪、季嘉铭、雷英山、戴约瑟夫、陈元培、杨耀东

- 关键词:视觉-语言-动作模型、安全对齐、大规模约束学习

- 实验环境:长时程移动操作任务

-

- 王佳琪、林庆宏、程詹姆斯、郑守迈克

- 关键词:视觉-语言模型、强化学习

- 实验环境:CLEVR、Super-CLEVR、GeoQA、AITZ

VisionThink:通过强化学习实现智能高效的视觉语言模型

- 杨森乔、李俊毅、赖欣、吴金明、李伟、马泽军、于蓓、赵恒爽、贾亚佳

- 关键词:视觉语言模型,强化学习

- 实验环境:通用VQA任务和OCR相关任务

-

- 何乐涵、陈泽仁、史哲伦、余天宇、盛陆、邵静

- 关键词:视觉语言模型(VLMs)、偏好学习、幻觉缓解、基于人工智能反馈的强化学习(RLAIF)

- 实验环境:ObjectHal-Bench及其他幻觉基准测试

-

- 王康睿、张平悦、王子涵、高雅宁、李林杰、王钦能、陈汉阳、陆一平、杨正源、王丽娟、兰杰·克里希纳、吴家俊、李飞飞、崔艺珍、李曼玲

- 关键词:视觉状态、世界建模、多轮强化学习、VLM智能体

- 实验环境:五种多样化的智能体任务

-

- 倪明亨、杨正源、李林杰、林忠清、凯文·林、左王猛、王丽娟

- 关键词:大型多模态模型、接地推理、强化学习

- 实验环境:ChartQA、CharXiv、PlotQA、IconQA、TabMWP

-

- 陈曦、朱明康、刘绍腾、吴晓洋、徐晓刚、刘宇、白翔、赵恒爽

- 关键词:视觉推理、思维链、LLM、VLM、MLLM

- 实验环境:多图像推理基准测试

DeepVideo-R1:基于难度感知的回归式GRPO进行视频强化微调

- 朴仁英、罗智惠、金仁英、金贤宇

- 关键词:视频大型语言模型、后训练、GRPO

- 实验环境:视频推理基准测试

-

- 黄嘉琪、许尊南、周俊、刘婷、肖义成、欧明文、季博文、李秀、袁可洪

- 关键词:强化学习、多模态大型模型、图像分割

- 实验环境:图像分割基准测试

SE-GUI:通过自进化强化学习提升GUI智能体的视觉接地能力

- 袁新斌、张健、李凯欣、蔡卓轩、姚路健、陈杰、王恩光、侯启彬、陈锦威、蒋鹏涛、李博

- 关键词:GUI智能体;强化学习;视觉接地

- 实验环境:ScreenSpot-Pro及其他接地基准测试

-

- 闫浩龙、沈业青、黄鑫、王佳、谭凯俊、梁志轩、李宏信、葛政、吉江修、李思、张向宇、姜大鑫

- 关键词:GUI环境、大型视觉语言模型、多轮强化学习、智能体

- 实验环境:PC软件和移动App模拟

-

- 谭华杰、姬宇恒、郝晓帅、陈先胜、王鹏威、王中元、张尚航

- 关键词:多模态、强化微调、视觉推理

- 实验环境:视觉计数、结构感知、空间变换

-

- 李云恒、景程、贾少勇、匡航毅、焦绍辉、侯启彬、程明明

- 关键词:时间接地;多模态大型语言模型;强化微调

- 实验环境:Charades-STA、ActivityNet Captions、QVHighlights

-

- 加布里埃尔·赫伯特·萨尔奇、斯尼格达·萨哈、奈蒂克·坎德尔瓦尔、阿尤什·贾因、迈克尔·J·塔尔、阿维拉尔·库马尔、卡特琳娜·弗拉基达基

- 关键词:视觉推理、视觉语言模型、强化学习、视觉接地

- 实验环境:SAT-2、BLINK、V*bench、ScreenSpot、VisualWebArena

-

- 万仲伟、窦志豪、刘彻、张宇、崔东飞、赵秦健、沈辉、熊静、辛毅、蒋义凡、陶超凡、何扬帆、张米、严申

- 关键词:MLLMs、推理

- 实验环境:MathVista、MathVision、Mathverse、MMMU-Pro

-

- 钟浩、朱牧之、杜宗泽、黄郑、赵灿宇、刘明宇、王文、陈浩、沈春华

- 关键词:RL、Omnimodal

- 实验环境:指代式视听分割(RefAVS)、推理型视频对象分割(REVOS)

Janus-Pro-R1:通过强化学习推进协作式视觉理解与生成

- 潘凯航、吴洋、卜文东、沈凯、李俊成、王颖婷、李云飞、唐思亮、肖俊、吴飞、赵航、庄月婷

- 关键词:图像生成、图像理解

- 实验环境:文本到图像生成及图像编辑基准测试

-

- 沈俊浩、赵海腾、顾宇哲、高松阳、刘奎坤、黄海安、高建飞、林大华、张文伟、陈凯

- 关键词:大型视觉语言模型、慢思考推理

- 实验环境:MathVision、OlympiadBench

ViCrit:一种可用于验证的强化学习代理任务,用于VLM中的视觉感知

- 王西瑶、杨正源、冯超、周宇航、刘晓宇、梁永源、李明、臧子怡、李林杰、林忠清、凯文·林、黄福荣、王丽娟

- 关键词:视觉推理;视觉语言模型;视觉字幕;奖励模型;视觉幻觉

- 实验环境:视觉感知基准测试

GuardReasoner-VL:通过强化推理保障视觉语言模型的安全

- 刘悦、翟圣芳、杜明哲、陈宇林、Tri Cao、高洪成、王成、李新峰、王坤、方俊峰、张嘉恒、Bryan Hooi

- 关键词:视觉语言模型、安全防护模型、强化学习、大型推理模型

- 实验环境:VLMs的安全基准测试

-

- 张帆睿、李典、张强、Chenjun、sinbadliu、林俊雄、严家宏、刘嘉伟、Zheng-Jun Zha

- 关键词:视频虚假信息检测、深度推理

- 实验环境:FakeVV基准测试

Open Vision Reasoner:将语言认知行为迁移到视觉推理中

- 魏雅娜、赵亮、孙建建、林康恒、尹继生、胡景程、张银民、于恩、吕浩然、翁泽佳、王佳、韩琪、葛政、张翔宇、蒋大鑫、Vishal M. Patel

- 关键词:多模态大语言模型、视觉推理、认知行为迁移

- 实验环境:MATH500、MathVision、MathVerse

VideoRFT:通过强化微调激励多模态大语言模型的视频推理能力

- 王琪、于彦睿、袁晔、毛瑞、周天飞

- 关键词:多模态大语言模型、视频推理、强化微调

- 实验环境:六个视频推理基准测试

-

- 季嘉铭、陈欣宇、潘睿、张聪辉、朱翰、李嘉豪、洪东海、陈博远、周佳怡、王凯乐、戴俊涛、陈志敏、唐一达、韩思睿、郭义克、杨耀东

- 关键词:AI安全、AI对齐

- 实验环境:BeaverTails-V基准测试

-

- 陈鸿浩、楼兴洲、冯晓坤、黄凯奇、王新龙

- 关键词:VLM、推理、PRM

- 实验环境:视觉语言推理基准测试

-

- 范悦、何学海、杨迪吉、郑凯智、郭清臣、郑雨婷、纳拉亚纳拉朱·斯拉瓦纳·乔蒂、关新泽、王新埃里克

- 关键词:多模态推理模型、强化学习

- 实验环境:多模态推理基准测试

NoisyGRPO:通过噪声注入和贝叶斯估计激励多模态CoT推理

- 邱龙田、宁善、孙家轩、何旭明

- 关键词:多模态大语言模型、强化学习

- 实验环境:CoT质量和幻觉基准测试

-

- 王烨、王子恒、徐博深、杜洋、林克军、肖子涵、岳子豪、鞠建忠、张亮、杨定毅、方湘楠、何泽文、罗振波、王文轩、林俊奇、栾健、金秦

- 关键词:大规模视觉语言模型、时间视频定位、强化学习、后训练

- 实验环境:Charades-STA、ActivityNet Captions、QVHighlights、TVGBench

Generative RLHF-V:从多模态人类偏好中学习原则

- 周佳怡、季嘉铭、陈博远、孙嘉鹏、陈文琪、洪东海、韩思睿、郭义克、杨耀东

- 关键词:对齐、安全、RLHF、偏好学习、多模态大语言模型

- 实验环境:七个多模态基准测试

OpenVLThinker:通过迭代SFT-RL循环实现复杂的视觉语言推理

- 邓义和、赫里提克·班萨尔、殷凡、彭南云、王伟、常凯威

- 关键词:视觉语言推理、迭代改进、蒸馏、强化学习

- 实验环境:MathVista、EMMA、HallusionBench

-

- 冯凯拓、龚凯雄、李博豪、郭宗浩、王一兵、彭天硕、吴俊飞、张晓英、王本友、岳向宇

- 关键词:多模态大语言模型、视频推理

- 实验环境:VideoMMMU、VSI-Bench、MVBench、TempCompass

Table2LaTeX-RL:基于强化多模态语言模型从表格图像生成高保真LaTeX代码

- 凌俊、齐尧、黄涛、周世博、黄艳琴、江阳、宋子琪、周颖、杨阳、沈恒涛、王鹏

- 关键词:表格识别、LaTeX生成

- 实验环境:表格转LaTeX基准测试

ReAgent-V:一种基于奖励驱动的多智能体框架,用于视频理解

- 周逸扬、何洋帆、苏耀峰、韩思伟、张乔尔、贝尔塔修斯·格达斯、班萨尔·莫希特、姚华秀

- 关键词:视频理解;多智能体框架;反思性推理;VLA对齐;视频推理

- 实验环境:涵盖视频理解、视频推理和VLA任务的12个数据集

-

- 占小宇、黄文轩、孙浩、傅新宇、马昌峰、曹绍胜、贾博文、林绍辉、尹振飞、LEI BAI、欧阳万利、李元启、郭杰、郭延文

- 关键词:视觉语言模型、3D推理、GRPO

- 实验环境:3D空间推理任务

EvolvedGRPO:通过渐进式指令进化解锁LVLM中的推理能力

- 沈哲北、于奇凡、李俊诚、季伟、陈其志、汤思良、庄月婷

- 关键词:多模态推理、强化学习、自我改进

- 实验环境:多模态推理任务

-

- 罗瑞琳、郑卓凡、王磊、王一凡、倪新哲、林子成、姜松涛、于一瑶、施楚凡、储瑞航、曾锦、杨宇久

- 关键词:多模态推理、数据合成、过程奖励模型、强化学习

- 实验环境:ChartQA及其他多模态数学基准测试

-

- 吴俊飞、管健、冯凯拓、刘强、吴树、王亮、吴伟、谭天牛

- 关键词:大规模视觉语言模型、空间推理

- 实验环境:空间推理基准测试

ICML 2025

ABNet:用于安全且可扩展的机器人学习的自适应显式屏障网络

- 魏晓、王敦轩、甘闯、丹妮拉·鲁斯

- 关键词:安全学习、机器人学习、可扩展学习、屏障网络、可证明的安全性、强化学习、多模态控制。

- 实验环境:二维机器人避障、安全机器人操作、基于视觉的端到端自动驾驶。

DexScale:自动化数据缩放以实现Sim2Real泛化机器人控制

- 刘桂良、邓越慈、赵润毅、周华义、陈健、陈继涛、徐瑞燕、邰云鑫、贾奎

- 关键词:数据引擎、具身AI、机器人控制、操作、策略学习、Sim2Real、领域随机化、领域适应、强化学习、多模态控制。

- 实验环境:机器人操作任务(如抓取与放置)、多样化任务、多种机器人形态。

-

- 王子儒、王梦梦、戴洁、马特利、齐国俊、刘勇、戴广、王井东

- 关键词:具身决策、多模态学习、视频动态抽象、机器人学习。

- 实验环境:LOReL Sawyer、Franka Kitchen、BabyAI、真实场景。

Craftium:弥合丰富3D单/多智能体环境中的灵活性与效率

- 米克尔·马拉贡、何苏·塞贝里奥、何塞·A·洛萨诺

- 关键词:3D环境、强化学习、多智能体系统、具身AI。

- 实验环境:Craftium构建的一对一多智能体战斗环境、Craftium中的开放世界环境、Craftium构建的程序化3D地牢。

-

- 萨凯斯·巴楚、埃尔凡·沙耶加尼、罗希特·拉尔、特里什娜·查克拉博蒂、阿林达姆·杜塔、宋成宇、董悦、纳埃尔·B·阿布-加扎莱、阿米特·罗伊-乔杜里

- 关键词:视觉语言模型、安全对齐、人类反馈强化学习(RLHF)、多模态强化学习。

- 实验环境:Jailbreak-V28K、AdvBench-COCO(源自AdvBench和MS-COCO)、HH-RLHF、VQA-v2、自定义提示。

ICLR 2025

-

- 马叶诚、乔伊·海纳、付楚源、德鲁夫·沙赫、杰基·梁、许卓、肖恩·基尔马尼、徐鹏、丹尼·德里斯、泰德·萧、奥斯伯特·巴斯塔尼、迪内什·贾亚拉曼、于文浩、张婷楠、多尔萨·萨迪格、夏菲

- 关键词:机器人学习、视觉语言模型、价值估计、操作

- 实验环境:超过300种不同的现实世界任务,涵盖多种机器人平台,包括双臂操作任务。

-

- 马尤克·德布、迈纳克·德布、阿普尔瓦·拉坦·穆尔蒂

- 关键词:拓扑结构、神经启发、卷积神经网络、Transformer、视觉皮层、神经科学

- 实验环境:ResNet-18、ResNet-50、ViT、GPT-Neo-125M、NanoGPT。

-

- 叶俊彦、周百川、黄子龙、张俊安、白天义、康恒睿、何军、林洪林、王子豪、吴彤、吴志正、陈一平、林大华、何聪辉、李伟嘉

- 关键词:LMMs、Deepfake、多模态性

- 实验环境:视频、图片、3D、文本、音频。

两种效应,一个触发:关于对比型视觉-语言模型中的模态差距、对象偏见与信息不平衡

- 西蒙·施罗迪、大卫·T·霍夫曼、马克思·阿尔古斯、沃尔克·费舍尔、托马斯·布罗克斯

- 关键词:CLIP、模态差距、对象偏见、对比损失、数据驱动、视觉语言模型、VLM

- 实验环境:对比型视觉-语言模型(VLM)分析。

-

- 约赖·绍尔、伊塔马尔·米沙尼、希瓦姆·瓦茨、李娇阳、马克西姆·利哈切夫

- 关键词:多智能体规划、机器人技术、生成模型

- 实验环境:模拟物流环境。

ICLR 2024

-

- 徐国伟、郑睿杰、梁永元、王希瑶、袁哲成、季天颖、罗宇、刘晓宇、袁佳欣、华璞、李淑珍、泽延杰、哈尔·道梅三世、黄福荣、徐华哲

- 关键词:视觉RL;休眠比率

- 实验环境:DeepMind Control Suite、Meta-world、Adroit。

-

- 胡建树、蒋云鹏、温保罗

- 关键词:强化学习、数据增强

- 实验环境:DeepMind Control Suite。

-

- 马国政、李璐、张森、刘子轩、王振、陈怡欣、沈莉、王雪倩、陶大成

- 关键词:可塑性、视觉强化学习、深度强化学习、样本效率

- 实验环境:DeepMind Control Suite、Atari。

-

- 丹·哈拉马蒂、塔尔·丹尼尔、阿维夫·塔马尔

- 关键词:深度强化学习、视觉强化学习、对象中心、机器人对象操作、组合泛化

- 实验环境:IsaacGym。

ICLR 2023

PaLI: 一种联合扩展的多语言语言-图像模型(值得关注的前5%)

- Xi Chen, Xiao Wang, Soravit Changpinyo, AJ Piergiovanni, Piotr Padlewski, Daniel Salz, Sebastian Goodman, Adam Grycner, Basil Mustafa, Lucas Beyer, Alexander Kolesnikov, Joan Puigcerver, Nan Ding, Keran Rong, Hassan Akbari, Gaurav Mishra, Linting Xue, Ashish Thapliyal, James Bradbury, Weicheng Kuo, Mojtaba Seyedhosseini, Chao Jia, Burcu Karagol Ayan, Carlos Riquelme, Andreas Steiner, Anelia Angelova, Xiaohua Zhai, Neil Houlsby, Radu Soricut

- 关键词:惊人的零样本能力、语言组件和视觉组件

- 实验环境:无

-

- Yunfan Jiang, Agrim Gupta, Zichen Zhang, Guanzhi Wang, Yongqiang Dou, Yanjun Chen, Li Fei-Fei, Anima Anandkumar, Yuke Zhu, Linxi Fan。NeurIPS 2022 工作坊

- 关键词:多模态提示、基于Transformer的通用智能体模型、大规模基准测试

- 实验环境:VIMA-Bench、VIMA-Data

MIND ’S EYE: 通过仿真进行 grounded 语言模型推理

- Ruibo Liu, Jason Wei, Shixiang Shane Gu, Te-Yen Wu, Soroush Vosoughi, Claire Cui, Denny Zhou, Andrew M. Dai

- 关键词:语言到物理世界的映射、推理能力

- 实验环境:MuJoCo

ICLR 2022

- CLIP 对视觉-语言任务能有多大帮助?

- Sheng Shen, Liunian Harold Li, Hao Tan 等。ICLR 2022

- 关键词:视觉-语言、CLIP

- 实验环境:无

ICLR 2021

-

- Austin W. Hanjie, Victor Zhong, Karthik Narasimhan。ICML 2021

- 关键词:多模态注意力

- 实验环境:Messenger

-

- Danijar Hafner, Timothy Lillicrap, Mohammad Norouzi 等。

- 关键词:世界模型

- 实验环境:Atari

-

- Adam Stooke, Kimin Lee, Pieter Abbeel 等。

- 关键词:表征学习、无监督学习

- 实验环境:DeepMind Control、Atari、DMLab

ICLR 2019

- 利用目标条件策略学习可行动的表征

- Dibya Ghosh, Abhishek Gupta, Sergey Levine。

- 关键词:可行动表征学习

- 实验环境:2D导航(2D墙、2D房间、轮式机器人、轮式房间、蚂蚁、推动物体)

NeurIPS 2024

-

- Moritz Schneider, Robert Krug, Narunas Vaskevicius, Luigi Palmieri, Joschka Boedecker

- 关键词:强化学习、rl、基于模型的强化学习、表征学习、pvr、视觉表征

- 实验环境:DeepMind Control Suite、ManiSkill2、Miniworld

-

- Zechu Li, Rickmer Krohn, Tao Chen, Anurag Ajay, Pulkit Agrawal, Georgia Chalvatzaki

- 关键词:强化学习、多模态行为、扩散模型

- 实验环境:AntMaze(导航)、机器人操作(Franka任务)

-

- Yangru Huang, Peixi Peng, Yifan Zhao, Guangyao Chen, Yonghong Tian

- 关键:多模态强化学习、视觉RL、动力学建模、模态一致性、模态不一致、DDM

- 实验环境:CARLA、DMControl

FlexPlanner: 基于深度强化学习的灵活3D平面布局设计,在混合动作空间中结合多模态表征

- Ruizhe Zhong, Xingbo Du, Shixiong Kai, Zhentao Tang, Siyuan Xu, Jianye Hao, Mingxuan Yuan, Junchi Yan

- 关键词:3D平面布局设计、深度强化学习、混合动作空间、多模态表征

- 实验环境:MCNC基准、GSRC基准

NeurIPS 2023

-

- David Brandfonbrener, Ofir Nachum, Joan Bruna

- 关键词:表征学习、模仿学习

- 实验环境:Sawyer开门、MetaWorld、Franka厨房、Adroit

-

- Keji He, Chenyang Si, Zhihe Lu, Yan Huang, Liang Wang, Xinchao Wang

- 关键词:视觉-语言导航、高频、数据增广

- 实验环境:Matterport3d

-

- Shaohan Huang, Li Dong, Wenhui Wang, Yaru Hao 等。

- 关键词:多模态感知、世界建模

- 实验环境:IQ50

NeurIPS 2022

NeurIPS 2021

SOAT:一种面向场景与物体的视觉-语言导航Transformer

- 阿比纳夫·莫德吉尔、阿琼·马朱姆达尔、哈什·阿格瓦尔等

- 关键词:视觉-语言导航

- 实验环境:Room-to-Room、Room-Across-Room

-

- 马克斯·施瓦策、尼塔尔尚·拉杰库马尔、迈克尔·诺霍维奇等

- 关键词:潜在动力学建模、无监督强化学习

- 实验环境:Atari

NeurIPS 2018

ICML 2024

-

- 金东虎、李浩俊、李京民、黄东润、秋在角

- 关键词:基于视觉的强化学习

- 实验环境:Atari

-

- 马浩哲、司马宽宽、武清荣、傅迪、梁泽云

- 关键词:双智能体奖励塑造框架

- 实验环境:Mujoco

-

- 傅宇伟、张海超、吴迪、许伟、博努瓦·布勒

- 关键词:高维观测、强化学习中的表征学习

- 实验环境:MetaWorld

-

- 宋宇达、吴丽丽、迪伦·J·福斯特、阿克谢·克里希纳穆提

- 关键词:VLM作为奖励函数

- 实验环境:迷宫

-

- 王博远、曲云、姜宇航、邵建准、刘畅、杨文明、季向阳

- 关键词:基于LLM的状态表示

- 实验环境:Mujoco

-

- 大卫·韦努托、穆罕默德·萨米·努尔·伊斯兰、马丁·克利萨罗夫等

- 关键词:视觉-语言模型、奖励函数

- 实验环境:MiniGrid

ICML 2022

-

- 黄文龙、皮特·阿贝尔、迪帕克·帕塔克等

- 关键词:大型语言模型、具身智能体

- 实验环境:VirtualHome

-

- 徐英教、李基敏、斯蒂芬·L·詹姆斯等

- 关键词:无动作预训练、视频

- 实验环境:Meta-world、DeepMind Control Suite

ICML 2019

- 从像素中学习潜在动力学以进行规划

- 达尼雅尔·哈夫纳、蒂莫西·利利克拉普、伊恩·费舍尔等

- 关键词:潜在动力学模型、像素观测

- 实验环境:DeepMind Control Suite

ICML 2017

- 通过多任务深度强化学习实现零样本任务泛化

- 欧俊赫、萨廷德·辛格、李洪洛克、普什米特·科利

- 关键词:未见指令、序列指令

- 实验环境:Minecraft

CVPR 2024

-

- 徐浩然、彭培熙、谭广、李源、徐新海、田永宏

- 关键词:视觉强化学习、多模态表征、动态视觉传感器

- 实验环境:Carla

-

- 王柳毅、何宗涛、邓荣浩、沈孟娇、刘成举、陈启军

- 关键词:视觉-语言导航、跨模态因果Transformer

- 实验环境:R2R、REVERIE、RxR-English、SOON

CVPR 2022

-

- Paul Hongsuck Seo、Arsha Nagrani、Anurag Arnab、Cordelia Schmid

- 关键词:多模态视频字幕生成、基于未来话语的预训练、多模态视频生成式预训练

- 实验环境:HowTo100M

-

- Shizhe Chen、Pierre-Louis Guhur、Makarand Tapaswi、Cordelia Schmid、Ivan Laptev

- 关键词:双尺度图变换器、双尺度图变换器、可供性检测

- 实验环境:无

-

- Tete Xiao、Ilija Radosavovic、Trevor Darrell等 ArXiv 2022

- 关键词:自监督学习、运动控制

- 实验环境:Isaac Gym

CoRL 2022

LM-Nav:基于大型预训练语言、视觉和动作模型的机器人导航

- Dhruv Shah、Blazej Osinski、Brian Ichter、Sergey Levine

- 关键词:机器人导航、目标条件化、未标注的大规模数据集、CLIP、ViNG、GPT-3

- 实验环境:无

-

- Ilija Radosavovic、Tete Xiao、Stephen James、Pieter Abbeel、Jitendra Malik、Trevor Darrell

- 关键词:真实世界机器人任务

- 实验环境:无

-

- Suraj Nair、Aravind Rajeswaran、Vikash Kumar等

- 关键词:Ego4D人类视频数据集、预训练视觉表征

- 实验环境:MetaWorld、Franka Kitchen, Adroit

其他

RL-EMO:一种用于多模态情感识别的强化学习框架 ICASSP 2024

- Chengwen Zhang、Yuhao Zhang、Bo Cheng

- 关键词:多模态情感识别、强化学习、图卷积网络

- 实验环境:无

基于非结构化数据的语言条件模仿学习 RSS 2021

- Corey Lynch、Pierre Sermanet

- 关键词:开放世界环境

- 实验环境:无

从“野外”人类视频中学习可泛化的机器人奖励函数 RSS 2021

- Annie S. Chen、Suraj Nair、Chelsea Finn

- 关键词:奖励函数、“野外”人类视频

- 实验环境:无

基于潜在空间模型的图像离线强化学习 L4DC 2021

- Rafael Rafailov、Tianhe Yu、Aravind Rajeswaran等

- 关键词:潜在空间模型

- 实验环境:DeepMind Control、Adroit Pen、Sawyer Door Open、Robel D’Claw Screw

跨注意力是否优于自注意力用于多模态情感识别? ICASSP 2022

- Vandana Rajan、Alessio Brutti、Andrea Cavallaro

- 关键词:多模态情感识别、跨注意力

- 实验环境:无

ArXiv

-

- 陈博远、徐卓、肖恩·基尔马尼、布赖恩·伊希特、丹尼·德里斯、皮特·弗洛伦斯、多尔萨·萨迪格、莱昂纳德·吉巴斯、夏飞

- 关键词:视觉问答、3D空间推理

- 实验环境:spatial VQA数据集

M2CURL:基于自监督表征学习的高效多模态强化学习,用于机器人操作

- 弗提奥斯·利格拉基斯、韦丹特·戴夫、埃尔马尔·吕克特

- 关键词:机器人操作、自监督表征

- 实验环境:Gym

-

- M·诺曼·库雷希、本·艾斯纳、大卫·赫尔德

- 关键词:策略输出的多模态性、动作头切换

- 实验环境:MetaWorld

-

- 夏宇阳、刘顺成、于权林、邓立伟、张友、苏汉、郑凯

- 关键词:自动驾驶、强化学习中的GNN

- 实验环境:CARLA

基于图卷积网络的强化学习,用于对话式智能体的上下文实时多模态情感识别

- 法蒂玛·阿卜杜勒·拉赫曼、卢广

- 关键词:情感识别、强化学习中的GNN

- 实验环境:IEMOCAP

-

- 张志正、谢文轩、张晓艺、陆燕

- 关键词:LLM、通用UI任务自动化API

- 实验环境:RicoSCA、MoTIF

使用LLM进行驾驶:融合对象级向量模态以实现可解释的自动驾驶

- 陈龙、奥列格·西纳夫斯基、扬·许内尔曼、爱丽丝·卡恩松、安德鲁·詹姆斯·威尔莫特、丹尼·伯奇、丹尼尔·芒德、杰米·肖顿

- 关键词:自动驾驶中的LLM、对象级多模态LLM

- 实验环境:RicoSCA、MoTIF

-

- 胡安·德尔·阿吉拉·费兰迪斯、若昂·莫拉、塞思·维贾亚库马尔

- 关键词:多模态探索方法

- 实验环境:KUKA iiwa机械臂

-

- 温武俊、张金荣、刘圣兰、李云恒、李启峰、冯琳

- 关键词:时序动作分割、视频分析中的RL

- 实验环境:EGTEA

做我能做的,而不是我得到的:多模态知识图谱上的拓扑感知多跳推理

- 郑尚飞、尹洪志、陈通、阮国越雄、陈伟、赵磊

- 关键词:多跳推理、多模态知识图谱、归纳设定、自适应强化学习

- 实验环境:无

-

- 阿法格·梅赫里·舍尔韦达尼、李思宇、纳塔武特·莫奈库尔、巴哈雷·阿巴西、芭芭拉·迪·欧根尼奥、米洛什·泽夫兰

- 关键词:稳健且深思熟虑的决策、端到端训练、重要性增强、相似性、改进IRL训练过程的多模态RL领域

- 实验环境:无

-

- 玛丽亚·阿塔里安、阿德瓦亚·古普塔、周子怡、于伟、伊戈尔·吉利琴斯基、阿尼梅什·加格

- 关键词:认知规划、语言指导的视频预测

- 实验环境:无

-

- 陈博远、夏飞、布赖恩·伊希特、卡尼什卡·拉奥、基尔塔娜·戈帕拉克里希南、迈克尔·S·瑞欧、奥斯汀·斯通、丹尼尔·卡普勒

- 关键词:目标检测、现实世界、机器人任务

- 实验环境:Say Can

-

- 迈克尔·安、安东尼·布罗汉、诺亚·布朗、叶夫根·切博塔尔、奥马尔·科尔特斯、拜伦·戴维、切尔西·芬恩、傅楚渊、基尔塔娜·戈帕拉克里希南、卡罗尔·豪斯曼、亚历克斯·赫尔佐格、丹尼尔·霍、贾斯敏·许、朱利安·伊巴尔斯、布赖恩·伊希特、亚历克斯·伊尔潘、埃里克·张、罗萨里奥·豪雷吉·鲁阿诺、凯尔·杰弗里、莎莉·杰斯蒙特、尼希尔·J·乔希、瑞安·朱利安、德米特里·卡拉什尼科夫、匡宇恒、李匡辉、谢尔盖·列文、陆耀、卢琳达、卡罗丽娜·帕拉达、彼得·帕斯托尔、乔内尔·奎安宝、卡尼什卡·拉奥、雅雷克·雷廷豪斯、迭戈·雷耶斯、皮埃尔·塞尔马内、尼古拉斯·西弗斯、克莱顿·谭、亚历山大·托舍夫、文森特·范胡克、夏飞、泰德·萧、徐鹏、徐思纯、严梦圆、张安迪

- 关键词:现实世界、自然语言

- 实验环境:Say Can

贡献

我们的目标是让这个仓库变得更好。如果你有兴趣参与贡献,请参阅此处获取贡献说明。

许可证

Awesome Multi-Modal Reinforcement Learning 采用 Apache 2.0 许可证发布。

相似工具推荐

ML-For-Beginners

ML-For-Beginners 是由微软推出的一套系统化机器学习入门课程,旨在帮助零基础用户轻松掌握经典机器学习知识。这套课程将学习路径规划为 12 周,包含 26 节精炼课程和 52 道配套测验,内容涵盖从基础概念到实际应用的完整流程,有效解决了初学者面对庞大知识体系时无从下手、缺乏结构化指导的痛点。 无论是希望转型的开发者、需要补充算法背景的研究人员,还是对人工智能充满好奇的普通爱好者,都能从中受益。课程不仅提供了清晰的理论讲解,还强调动手实践,让用户在循序渐进中建立扎实的技能基础。其独特的亮点在于强大的多语言支持,通过自动化机制提供了包括简体中文在内的 50 多种语言版本,极大地降低了全球不同背景用户的学习门槛。此外,项目采用开源协作模式,社区活跃且内容持续更新,确保学习者能获取前沿且准确的技术资讯。如果你正寻找一条清晰、友好且专业的机器学习入门之路,ML-For-Beginners 将是理想的起点。

ragflow

RAGFlow 是一款领先的开源检索增强生成(RAG)引擎,旨在为大语言模型构建更精准、可靠的上下文层。它巧妙地将前沿的 RAG 技术与智能体(Agent)能力相结合,不仅支持从各类文档中高效提取知识,还能让模型基于这些知识进行逻辑推理和任务执行。 在大模型应用中,幻觉问题和知识滞后是常见痛点。RAGFlow 通过深度解析复杂文档结构(如表格、图表及混合排版),显著提升了信息检索的准确度,从而有效减少模型“胡编乱造”的现象,确保回答既有据可依又具备时效性。其内置的智能体机制更进一步,使系统不仅能回答问题,还能自主规划步骤解决复杂问题。 这款工具特别适合开发者、企业技术团队以及 AI 研究人员使用。无论是希望快速搭建私有知识库问答系统,还是致力于探索大模型在垂直领域落地的创新者,都能从中受益。RAGFlow 提供了可视化的工作流编排界面和灵活的 API 接口,既降低了非算法背景用户的上手门槛,也满足了专业开发者对系统深度定制的需求。作为基于 Apache 2.0 协议开源的项目,它正成为连接通用大模型与行业专有知识之间的重要桥梁。

PaddleOCR

PaddleOCR 是一款基于百度飞桨框架开发的高性能开源光学字符识别工具包。它的核心能力是将图片、PDF 等文档中的文字提取出来,转换成计算机可读取的结构化数据,让机器真正“看懂”图文内容。 面对海量纸质或电子文档,PaddleOCR 解决了人工录入效率低、数字化成本高的问题。尤其在人工智能领域,它扮演着连接图像与大型语言模型(LLM)的桥梁角色,能将视觉信息直接转化为文本输入,助力智能问答、文档分析等应用场景落地。 PaddleOCR 适合开发者、算法研究人员以及有文档自动化需求的普通用户。其技术优势十分明显:不仅支持全球 100 多种语言的识别,还能在 Windows、Linux、macOS 等多个系统上运行,并灵活适配 CPU、GPU、NPU 等各类硬件。作为一个轻量级且社区活跃的开源项目,PaddleOCR 既能满足快速集成的需求,也能支撑前沿的视觉语言研究,是处理文字识别任务的理想选择。

awesome-machine-learning

awesome-machine-learning 是一份精心整理的机器学习资源清单,汇集了全球优秀的机器学习框架、库和软件工具。面对机器学习领域技术迭代快、资源分散且难以甄选的痛点,这份清单按编程语言(如 Python、C++、Go 等)和应用场景(如计算机视觉、自然语言处理、深度学习等)进行了系统化分类,帮助使用者快速定位高质量项目。 它特别适合开发者、数据科学家及研究人员使用。无论是初学者寻找入门库,还是资深工程师对比不同语言的技术选型,都能从中获得极具价值的参考。此外,清单还延伸提供了免费书籍、在线课程、行业会议、技术博客及线下聚会等丰富资源,构建了从学习到实践的全链路支持体系。 其独特亮点在于严格的维护标准:明确标记已停止维护或长期未更新的项目,确保推荐内容的时效性与可靠性。作为机器学习领域的“导航图”,awesome-machine-learning 以开源协作的方式持续更新,旨在降低技术探索门槛,让每一位从业者都能高效地站在巨人的肩膀上创新。

scikit-learn

scikit-learn 是一个基于 Python 构建的开源机器学习库,依托于 SciPy、NumPy 等科学计算生态,旨在让机器学习变得简单高效。它提供了一套统一且简洁的接口,涵盖了从数据预处理、特征工程到模型训练、评估及选择的全流程工具,内置了包括线性回归、支持向量机、随机森林、聚类等在内的丰富经典算法。 对于希望快速验证想法或构建原型的数据科学家、研究人员以及 Python 开发者而言,scikit-learn 是不可或缺的基础设施。它有效解决了机器学习入门门槛高、算法实现复杂以及不同模型间调用方式不统一的痛点,让用户无需重复造轮子,只需几行代码即可调用成熟的算法解决分类、回归、聚类等实际问题。 其核心技术亮点在于高度一致的 API 设计风格,所有估算器(Estimator)均遵循相同的调用逻辑,极大地降低了学习成本并提升了代码的可读性与可维护性。此外,它还提供了强大的模型选择与评估工具,如交叉验证和网格搜索,帮助用户系统地优化模型性能。作为一个由全球志愿者共同维护的成熟项目,scikit-learn 以其稳定性、详尽的文档和活跃的社区支持,成为连接理论学习与工业级应用的最

keras

Keras 是一个专为人类设计的深度学习框架,旨在让构建和训练神经网络变得简单直观。它解决了开发者在不同深度学习后端之间切换困难、模型开发效率低以及难以兼顾调试便捷性与运行性能的痛点。 无论是刚入门的学生、专注算法的研究人员,还是需要快速落地产品的工程师,都能通过 Keras 轻松上手。它支持计算机视觉、自然语言处理、音频分析及时间序列预测等多种任务。 Keras 3 的核心亮点在于其独特的“多后端”架构。用户只需编写一套代码,即可灵活选择 TensorFlow、JAX、PyTorch 或 OpenVINO 作为底层运行引擎。这一特性不仅保留了 Keras 一贯的高层易用性,还允许开发者根据需求自由选择:利用 JAX 或 PyTorch 的即时执行模式进行高效调试,或切换至速度最快的后端以获得最高 350% 的性能提升。此外,Keras 具备强大的扩展能力,能无缝从本地笔记本电脑扩展至大规模 GPU 或 TPU 集群,是连接原型开发与生产部署的理想桥梁。