Efficient-3DCNNs

Efficient-3DCNNs 是一个基于 PyTorch 实现的开源项目,专注于提供资源高效型的 3D 卷积神经网络(3D CNN)。它主要解决了在视频理解任务中,传统 3D 模型计算量大、对硬件要求高从而难以部署的问题。通过引入并复现多种轻量化架构,该工具让高精度的视频分析也能在资源受限的设备上流畅运行。

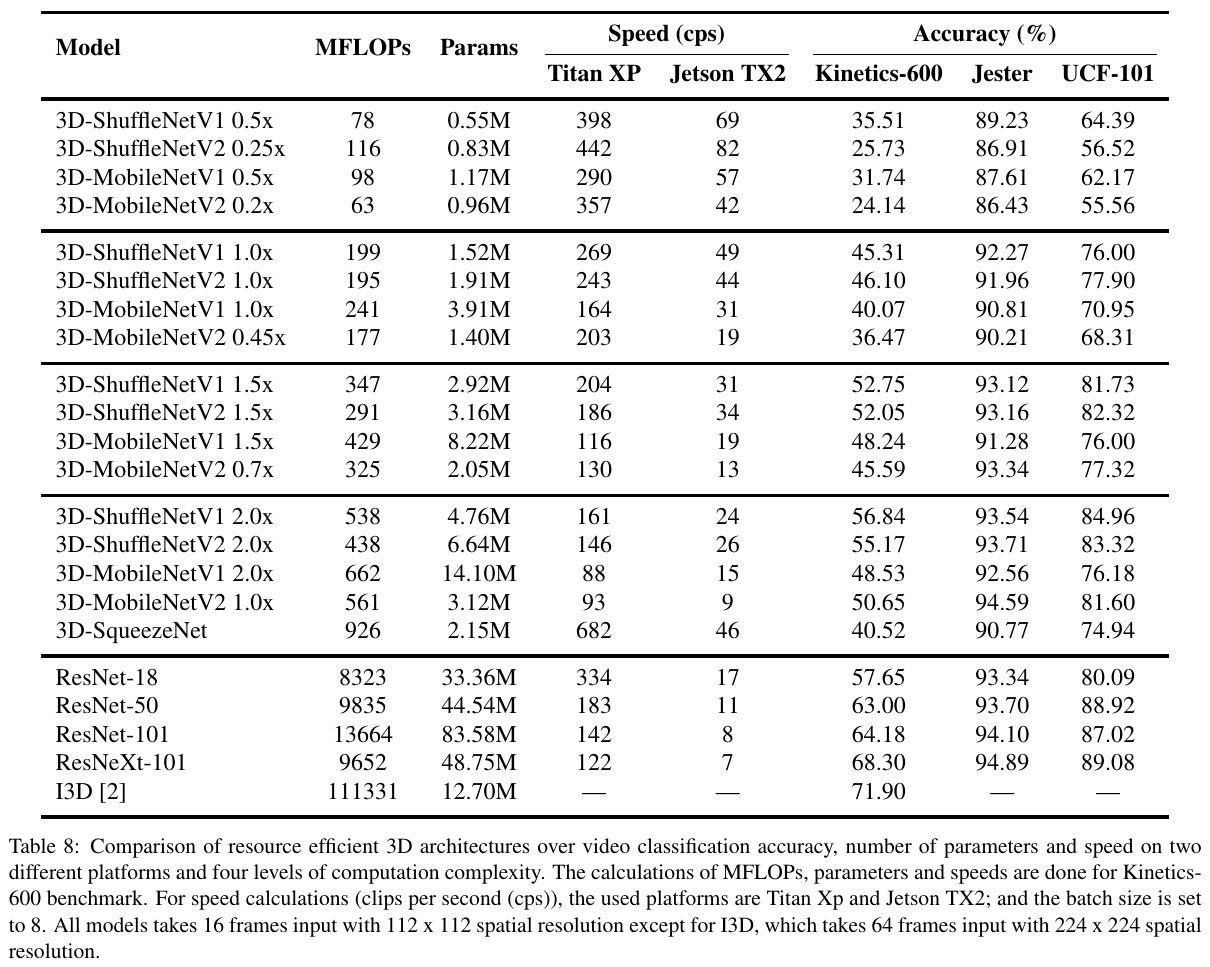

该项目非常适合从事计算机视觉研究的学者、需要部署视频算法的开发者,以及关注模型压缩与加速的技术人员使用。其核心亮点在于不仅实现了 3D SqueezeNet、3D MobileNet 系列及 3D ShuffleNet 系列等经典轻量模型,还补充了 3D ResNet 和 3D ResNeXt 作为性能基准。所有模型均支持通过调整“宽度乘数”来灵活控制复杂度,并在 Kinetics、Jester 和 UCF-101 等主流数据集上完成了验证。此外,项目提供了完整的预训练模型、数据预处理脚本及详细的运行配置,帮助用户快速复现论文结果或构建自己的高效视频分析应用。

使用场景

某智慧零售团队需要在边缘计算设备(如 NVIDIA Jetson)上实时分析店内监控视频,以识别顾客的特定手势交互行为。

没有 Efficient-3DCNNs 时

- 硬件门槛过高:传统的 3D ResNet-101 等模型参数量巨大,必须依赖昂贵的云端 GPU 集群进行推理,无法在低成本的边缘设备上运行。

- 响应延迟严重:视频数据需上传至云端处理再返回结果,网络传输导致识别延迟高达数百毫秒,无法满足“即时反馈”的交互需求。

- 带宽成本激增:为了维持实时性,需要持续上传多路高清视频流,产生了高昂的网络带宽费用和数据存储压力。

- 部署灵活性差:由于对算力要求苛刻,系统难以快速复制推广到成百上千个缺乏高性能服务器的线下门店。

使用 Efficient-3DCNNs 后

- 边缘端直接落地:利用其提供的 3D MobileNetV2 或 3D ShuffleNetV2 等轻量化预训练模型,成功将算法部署在低功耗的边缘盒子上,无需云端依赖。

- 实现毫秒级响应:直接在本地完成视频帧的特征提取与分类,消除了网络往返时间,手势识别延迟降低至 50 毫秒以内,体验流畅自然。

- 大幅降低运营成本:仅需上传最终的识别事件标签而非原始视频流,带宽占用减少 99% 以上,显著节省了长期运营开支。

- 弹性扩展能力增强:凭借模型对不同复杂度等级(width_multiplier)的支持,团队可根据不同门店的硬件配置灵活调整模型大小,实现规模化快速铺设。

Efficient-3DCNNs 通过提供资源高效型的 3D 卷积网络实现,成功打破了视频理解技术在边缘设备上的算力瓶颈,让实时智能分析变得低成本且触手可及。

运行环境要求

- 未说明

未说明(基于 PyTorch 3D CNN 训练通常建议配备 NVIDIA GPU,但 README 未指定具体型号或显存要求)

未说明

快速开始

高效3D CNN

论文“资源高效的3D卷积神经网络”(链接)的PyTorch实现,包含代码和预训练模型。

更新!

新增了3D ResNet和3D ResNeXt模型!这些模型的详细信息可在链接中找到。

环境要求

- PyTorch 1.0.1.post2

- OpenCV

- FFmpeg, FFprobe

- Python 3

预训练模型

预训练模型可从这里下载。

已实现的模型:

- 3D SqueezeNet

- 3D MobileNet

- 3D ShuffleNet

- 3D MobileNetv2

- 3D ShuffleNetv2

为了进行最先进方法的对比,还评估了以下模型:

- ResNet-18

- ResNet-50

- ResNet-101

- ResNext-101

所有模型(除SqueezeNet外)均通过调整其‘width_multiplier’参数,在两种不同的硬件平台上评估了四种不同的复杂度级别。

结果

数据集准备

Kinetics

使用官方爬虫下载视频。

- 测试集位于

video_directory/test。

- 测试集位于

与其他数据集不同,我们没有从视频中提取帧。相反,在整个训练过程中,我们直接使用OpenCV从视频中读取帧。如果您想为Kinetics数据集提取帧,请遵循Kensho Hara的代码库中的准备步骤。您还需要修改datasets文件夹中的kinetics.py文件。

使用

utils/kinetics_json.py生成类似于ActivityNet的JSON格式标注文件- 爬虫中包含了CSV文件(kinetics_{train, val, test}.csv)。

python utils/kinetics_json.py train_csv_path val_csv_path video_dataset_path dst_json_path

Jester

- 在这里下载视频。

- 使用

utils/n_frames_jester.py生成n_frames文件

python utils/n_frames_jester.py dataset_directory

- 使用

utils/jester_json.py生成类似于ActivityNet的JSON格式标注文件annotation_dir_path包括classInd.txt、trainlist.txt、vallist.txt

python utils/jester_json.py annotation_dir_path

UCF-101

- 在这里下载视频和训练/测试划分。

- 使用

utils/video_jpg_ucf101_hmdb51.py将AVI文件转换为JPG文件

python utils/video_jpg_ucf101_hmdb51.py avi_video_directory jpg_video_directory

- 使用

utils/n_frames_ucf101_hmdb51.py生成n_frames文件

python utils/n_frames_ucf101_hmdb51.py jpg_video_directory

- 使用

utils/ucf101_json.py生成类似于ActivityNet的JSON格式标注文件annotation_dir_path包括classInd.txt、trainlist0{1, 2, 3}.txt、testlist0{1, 2, 3}.txt

python utils/ucf101_json.py annotation_dir_path

运行代码

模型配置如下:

ShuffleNetV1-1.0x : --model shufflenet --width_mult 1.0 --groups 3

ShuffleNetV2-1.0x : --model shufflenetv2 --width_mult 1.0

MobileNetV1-1.0x : --model mobilenet --width_mult 1.0

MobileNetV2-1.0x : --model mobilenetv2 --width_mult 1.0

SqueezeNet : --model squeezenet --version 1.1

ResNet-18 : --model resnet --model_depth 18 --resnet_shortcut A

ResNet-50 : --model resnet --model_depth 50 --resnet_shortcut B

ResNet-101 : --model resnet --model_depth 101 --resnet_shortcut B

ResNeXt-101 : --model resnext --model_depth 101 --resnet_shortcut B --resnext_cardinality 32

请查看models文件夹中的所有“资源高效的3D CNN模型”,并提供必要的参数来运行代码。示例如下:

- 从头开始训练:

python main.py --root_path ~/ \

--video_path ~/datasets/jester \

--annotation_path Efficient-3DCNNs/annotation_Jester/jester.json \

--result_path Efficient-3DCNNs/results \

--dataset jester \

--n_classes 27 \

--model mobilenet \

--width_mult 0.5 \

--train_crop random \

--learning_rate 0.1 \

--sample_duration 16 \

--downsample 2 \

--batch_size 64 \

--n_threads 16 \

--checkpoint 1 \

--n_val_samples 1 \

- 从检查点恢复训练:

python main.py --root_path ~/ \

--video_path ~/datasets/jester \

--annotation_path Efficient-3DCNNs/annotation_Jester/jester.json \

--result_path Efficient-3DCNNs/results \

--resume_path Efficient-3DCNNs/results/jester_shufflenet_0.5x_G3_RGB_16_best.pth \

--dataset jester \

--n_classes 27 \

--model shufflenet \

--groups 3 \

--width_mult 0.5 \

--train_crop random \

--learning_rate 0.1 \

--sample_duration 16 \

--downsample 2 \

--batch_size 64 \

--n_threads 16 \

--checkpoint 1 \

--n_val_samples 1 \

- 从预训练模型开始训练。使用‘--ft_portion’并选择‘complete’或‘last_layer’进行微调:

python main.py --root_path ~/ \

--video_path ~/datasets/jester \

--annotation_path Efficient-3DCNNs/annotation_UCF101/ucf101_01.json \

--result_path Efficient-3DCNNs/results \

--pretrain_path Efficient-3DCNNs/results/kinetics_shufflenet_0.5x_G3_RGB_16_best.pth \

--dataset ucf101 \

--n_classes 600 \

--n_finetune_classes 101 \

--ft_portion last_layer \

--model shufflenet \

--groups 3 \

--width_mult 0.5 \

--train_crop random \

--learning_rate 0.1 \

--sample_duration 16 \

--downsample 1 \

--batch_size 64 \

--n_threads 16 \

--checkpoint 1 \

--n_val_samples 1 \

数据增强

有几种可用的数据增强技术。请查看spatial_transforms.py和temporal_transforms.py以了解增强方法的详细信息。

注意:不要对Jester数据集的训练使用“RandomHorizontalFlip”,因为它会改变某些类别的类别类型(例如,Swipe_Left --> RandomHorizontalFlip() --> Swipe_Right)。

计算视频准确率

为了计算视频准确率,您应该首先以‘--test’模式运行模型,以创建‘val.json’文件。然后,您需要在utils文件夹中运行‘video_accuracy.py’来计算视频准确率。

计算FLOPs

要计算FLOPs,请运行‘calculate_FLOP.py’文件。您需要先取消注释文件中所需的模型。

引用

如果您使用此代码或预训练模型,请引用以下文章:

@inproceedings{kopuklu2019resource,

title={Resource efficient 3d convolutional neural networks},

author={K{\"o}p{\"u}kl{\"u}, Okan and Kose, Neslihan and Gunduz, Ahmet and Rigoll, Gerhard},

booktitle={2019 IEEE/CVF International Conference on Computer Vision Workshop (ICCVW)},

pages={1910--1919},

year={2019},

organization={IEEE}

}

致谢

我们感谢Kensho Hara公开了他的代码库,我们的工作正是基于该代码库展开的。

常见问题

相似工具推荐

ML-For-Beginners

ML-For-Beginners 是由微软推出的一套系统化机器学习入门课程,旨在帮助零基础用户轻松掌握经典机器学习知识。这套课程将学习路径规划为 12 周,包含 26 节精炼课程和 52 道配套测验,内容涵盖从基础概念到实际应用的完整流程,有效解决了初学者面对庞大知识体系时无从下手、缺乏结构化指导的痛点。 无论是希望转型的开发者、需要补充算法背景的研究人员,还是对人工智能充满好奇的普通爱好者,都能从中受益。课程不仅提供了清晰的理论讲解,还强调动手实践,让用户在循序渐进中建立扎实的技能基础。其独特的亮点在于强大的多语言支持,通过自动化机制提供了包括简体中文在内的 50 多种语言版本,极大地降低了全球不同背景用户的学习门槛。此外,项目采用开源协作模式,社区活跃且内容持续更新,确保学习者能获取前沿且准确的技术资讯。如果你正寻找一条清晰、友好且专业的机器学习入门之路,ML-For-Beginners 将是理想的起点。

ragflow

RAGFlow 是一款领先的开源检索增强生成(RAG)引擎,旨在为大语言模型构建更精准、可靠的上下文层。它巧妙地将前沿的 RAG 技术与智能体(Agent)能力相结合,不仅支持从各类文档中高效提取知识,还能让模型基于这些知识进行逻辑推理和任务执行。 在大模型应用中,幻觉问题和知识滞后是常见痛点。RAGFlow 通过深度解析复杂文档结构(如表格、图表及混合排版),显著提升了信息检索的准确度,从而有效减少模型“胡编乱造”的现象,确保回答既有据可依又具备时效性。其内置的智能体机制更进一步,使系统不仅能回答问题,还能自主规划步骤解决复杂问题。 这款工具特别适合开发者、企业技术团队以及 AI 研究人员使用。无论是希望快速搭建私有知识库问答系统,还是致力于探索大模型在垂直领域落地的创新者,都能从中受益。RAGFlow 提供了可视化的工作流编排界面和灵活的 API 接口,既降低了非算法背景用户的上手门槛,也满足了专业开发者对系统深度定制的需求。作为基于 Apache 2.0 协议开源的项目,它正成为连接通用大模型与行业专有知识之间的重要桥梁。

PaddleOCR

PaddleOCR 是一款基于百度飞桨框架开发的高性能开源光学字符识别工具包。它的核心能力是将图片、PDF 等文档中的文字提取出来,转换成计算机可读取的结构化数据,让机器真正“看懂”图文内容。 面对海量纸质或电子文档,PaddleOCR 解决了人工录入效率低、数字化成本高的问题。尤其在人工智能领域,它扮演着连接图像与大型语言模型(LLM)的桥梁角色,能将视觉信息直接转化为文本输入,助力智能问答、文档分析等应用场景落地。 PaddleOCR 适合开发者、算法研究人员以及有文档自动化需求的普通用户。其技术优势十分明显:不仅支持全球 100 多种语言的识别,还能在 Windows、Linux、macOS 等多个系统上运行,并灵活适配 CPU、GPU、NPU 等各类硬件。作为一个轻量级且社区活跃的开源项目,PaddleOCR 既能满足快速集成的需求,也能支撑前沿的视觉语言研究,是处理文字识别任务的理想选择。

awesome-machine-learning

awesome-machine-learning 是一份精心整理的机器学习资源清单,汇集了全球优秀的机器学习框架、库和软件工具。面对机器学习领域技术迭代快、资源分散且难以甄选的痛点,这份清单按编程语言(如 Python、C++、Go 等)和应用场景(如计算机视觉、自然语言处理、深度学习等)进行了系统化分类,帮助使用者快速定位高质量项目。 它特别适合开发者、数据科学家及研究人员使用。无论是初学者寻找入门库,还是资深工程师对比不同语言的技术选型,都能从中获得极具价值的参考。此外,清单还延伸提供了免费书籍、在线课程、行业会议、技术博客及线下聚会等丰富资源,构建了从学习到实践的全链路支持体系。 其独特亮点在于严格的维护标准:明确标记已停止维护或长期未更新的项目,确保推荐内容的时效性与可靠性。作为机器学习领域的“导航图”,awesome-machine-learning 以开源协作的方式持续更新,旨在降低技术探索门槛,让每一位从业者都能高效地站在巨人的肩膀上创新。

scikit-learn

scikit-learn 是一个基于 Python 构建的开源机器学习库,依托于 SciPy、NumPy 等科学计算生态,旨在让机器学习变得简单高效。它提供了一套统一且简洁的接口,涵盖了从数据预处理、特征工程到模型训练、评估及选择的全流程工具,内置了包括线性回归、支持向量机、随机森林、聚类等在内的丰富经典算法。 对于希望快速验证想法或构建原型的数据科学家、研究人员以及 Python 开发者而言,scikit-learn 是不可或缺的基础设施。它有效解决了机器学习入门门槛高、算法实现复杂以及不同模型间调用方式不统一的痛点,让用户无需重复造轮子,只需几行代码即可调用成熟的算法解决分类、回归、聚类等实际问题。 其核心技术亮点在于高度一致的 API 设计风格,所有估算器(Estimator)均遵循相同的调用逻辑,极大地降低了学习成本并提升了代码的可读性与可维护性。此外,它还提供了强大的模型选择与评估工具,如交叉验证和网格搜索,帮助用户系统地优化模型性能。作为一个由全球志愿者共同维护的成熟项目,scikit-learn 以其稳定性、详尽的文档和活跃的社区支持,成为连接理论学习与工业级应用的最

keras

Keras 是一个专为人类设计的深度学习框架,旨在让构建和训练神经网络变得简单直观。它解决了开发者在不同深度学习后端之间切换困难、模型开发效率低以及难以兼顾调试便捷性与运行性能的痛点。 无论是刚入门的学生、专注算法的研究人员,还是需要快速落地产品的工程师,都能通过 Keras 轻松上手。它支持计算机视觉、自然语言处理、音频分析及时间序列预测等多种任务。 Keras 3 的核心亮点在于其独特的“多后端”架构。用户只需编写一套代码,即可灵活选择 TensorFlow、JAX、PyTorch 或 OpenVINO 作为底层运行引擎。这一特性不仅保留了 Keras 一贯的高层易用性,还允许开发者根据需求自由选择:利用 JAX 或 PyTorch 的即时执行模式进行高效调试,或切换至速度最快的后端以获得最高 350% 的性能提升。此外,Keras 具备强大的扩展能力,能无缝从本地笔记本电脑扩展至大规模 GPU 或 TPU 集群,是连接原型开发与生产部署的理想桥梁。