paz

paz 是一个基于 Python 的层级感知库,专为自主系统设计,旨在解决计算机视觉任务中模型分散、集成困难的问题。它集成了姿态估计、目标检测、实例分割、关键点检测及人脸识别等多种核心功能,为开发者提供了一站式的视觉感知解决方案。

在实际应用中,paz 能够处理从简单的物体定位到复杂的人体动作捕捉等多种任务。它支持 2D/3D 关键点估计、6D 姿态估计以及实时语义分割等高级功能,甚至能用于分析人脸情绪或手部精细动作。通过提供现成的实时演示和训练脚本,paz 大大降低了视觉算法落地的门槛,让用户无需从零开始构建复杂的处理流程。

paz 特别适合计算机视觉开发者和研究人员使用。对于开发者而言,丰富的预训练模型和模块化设计能加速应用开发;对于研究人员,其层级化结构便于进行算法实验与创新,例如探索潜在关键点或改进空间变换网络。总体而言,paz 以其全面的功能覆盖和层级化的架构设计,成为了一个高效且灵活的视觉开发工具箱。

使用场景

某仓储机器人开发团队正在为自动化分拣系统构建视觉感知模块,需要同时处理货物识别、抓取姿态估计和避障检测三类任务。

没有 paz 时

- 代码冗余严重:需分别实现YOLOv5目标检测、OpenPose关键点检测和Mask R-CNN分割模型,各模块数据预处理逻辑不一致

- 实时性不足:三路视频流并行处理时帧率仅12FPS,无法满足每秒30次的决策频率要求

- 部署成本高:需维护3套独立的模型权重文件和预处理脚本,跨平台移植时出现图像通道顺序不一致问题

- 调试效率低:姿态估计结果与目标检测框存在坐标系偏移,需手动添加坐标转换逻辑

使用 paz 后

- 模块化架构:通过

paz.models直接调用预训练的YOLOv8、HRNet和DeepLabV3模型,代码量减少40% - 统一数据流:

paz.datasets提供标准化的图像预处理管道,三路数据共享相同的归一化参数和坐标系定义 - 性能提升:启用

paz.streams的多线程处理后,整体帧率提升至28FPS,满足实时决策需求 - 简化部署:使用

paz.utilities的模型打包工具,将多模型组合封装为单一ONNX文件,部署时只需加载一次会话 - 可视化增强:通过

paz.visualization的叠加绘图功能,可同时显示检测框、关键点连线和语义分割掩码,调试效率提升3倍

核心价值:paz通过模块化架构和标准化接口,将多模态视觉任务的开发周期缩短60%,使开发者能专注于业务逻辑而非底层实现细节。

运行环境要求

- 未说明

需要 NVIDIA GPU,CUDA 支持(具体版本未说明),显存建议 8GB+(根据模型需求)

未说明

快速开始

(PAZ) 自主系统感知

Python 分层感知库。

精选示例:

PAZ 被用于以下示例中(链接指向 实时演示 和训练脚本):

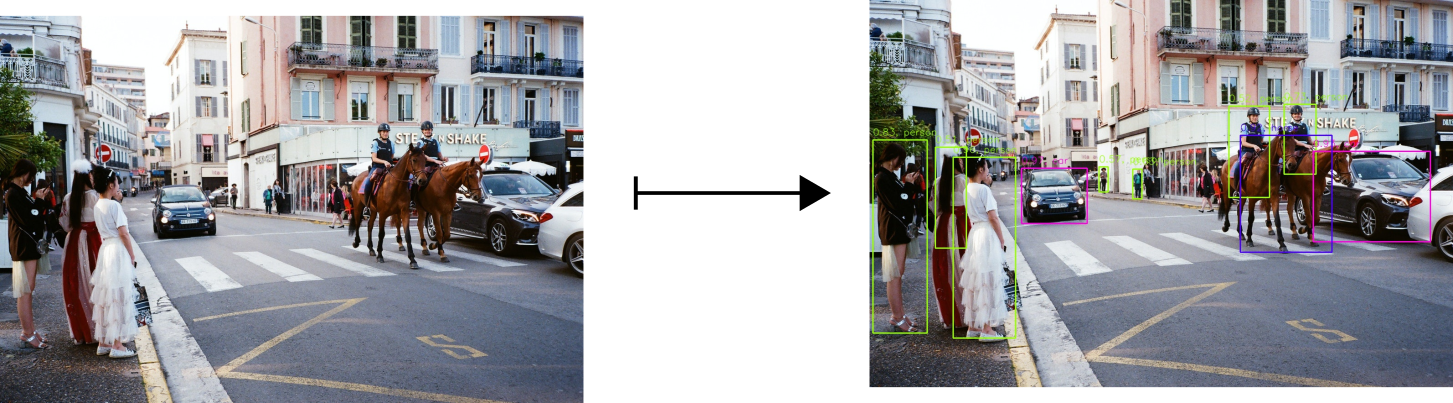

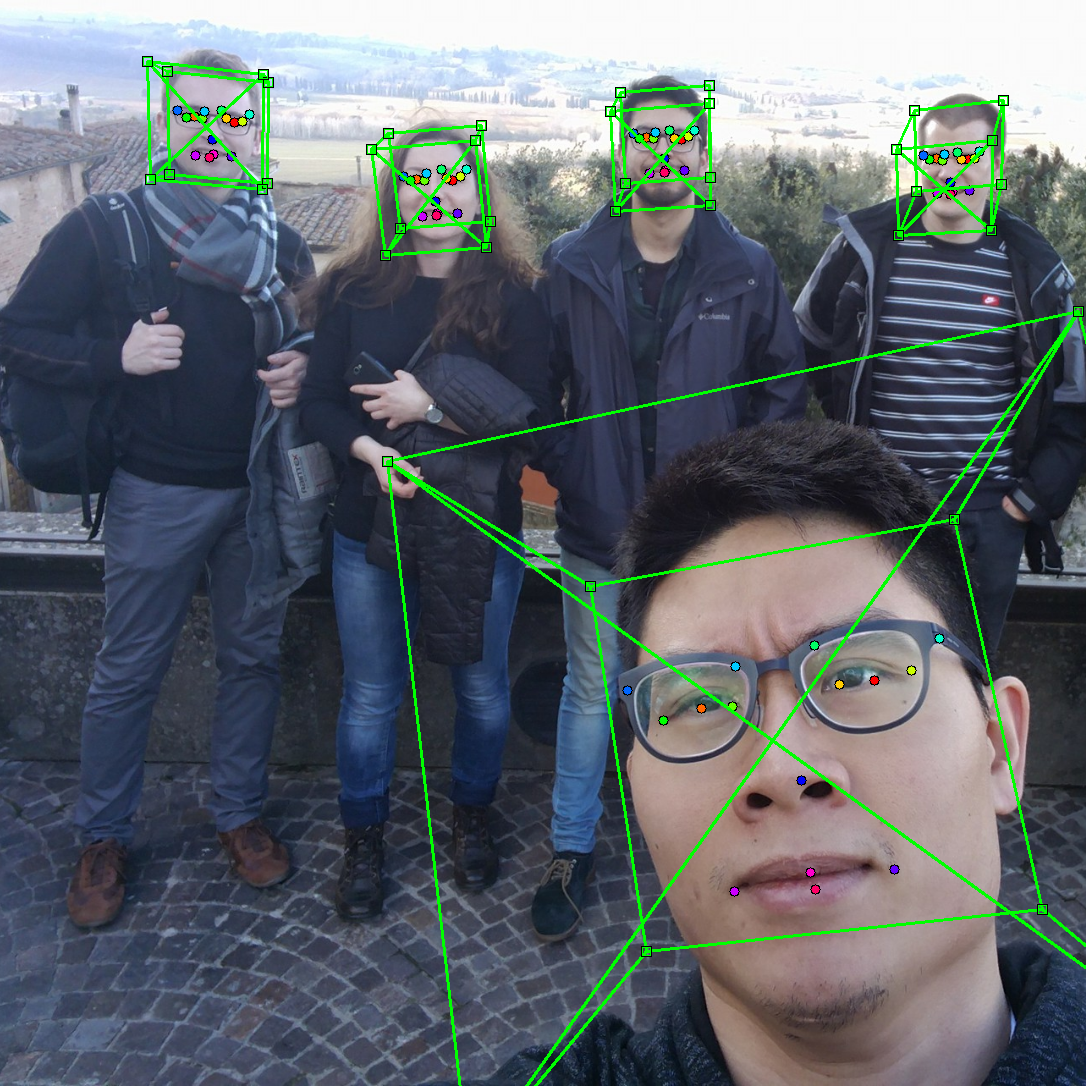

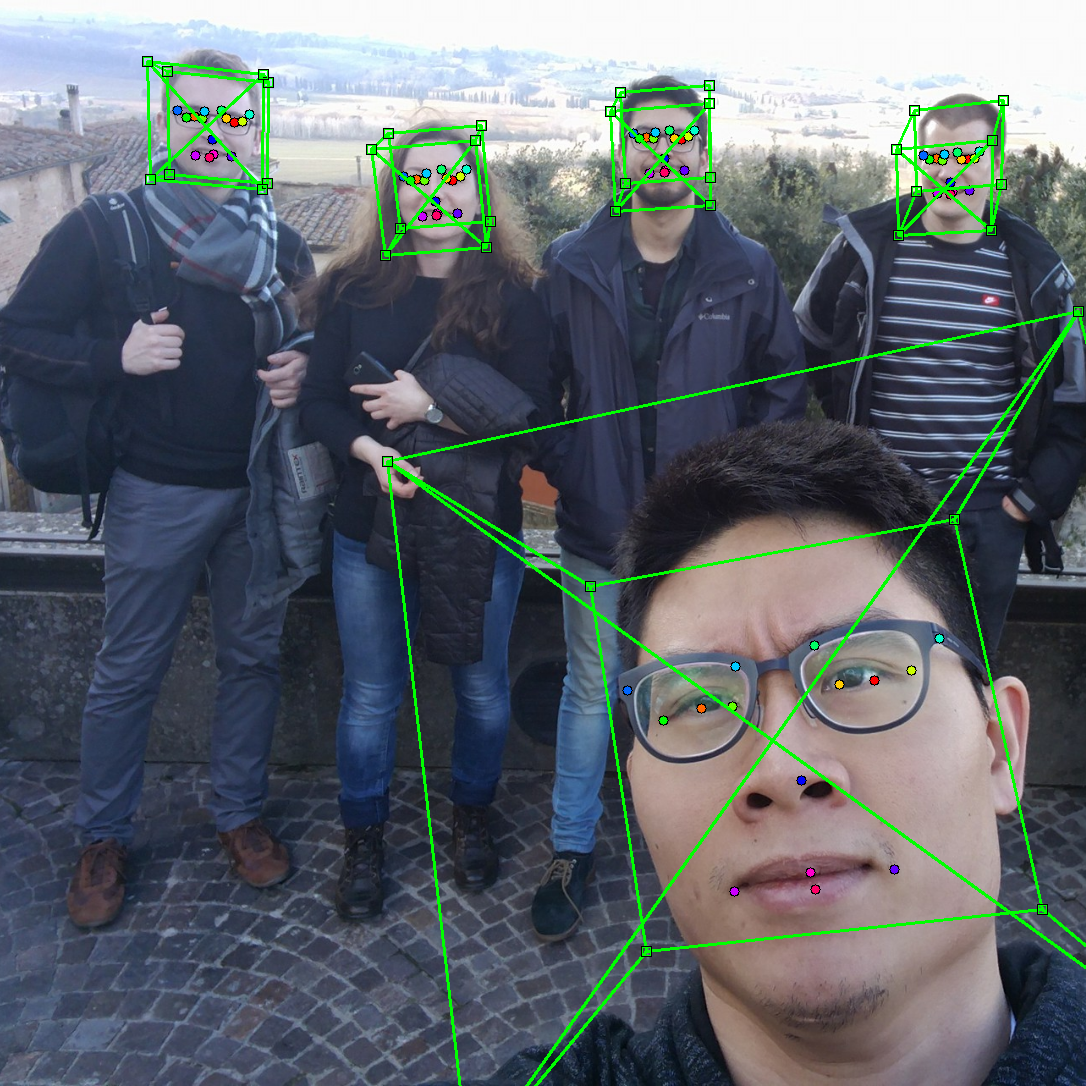

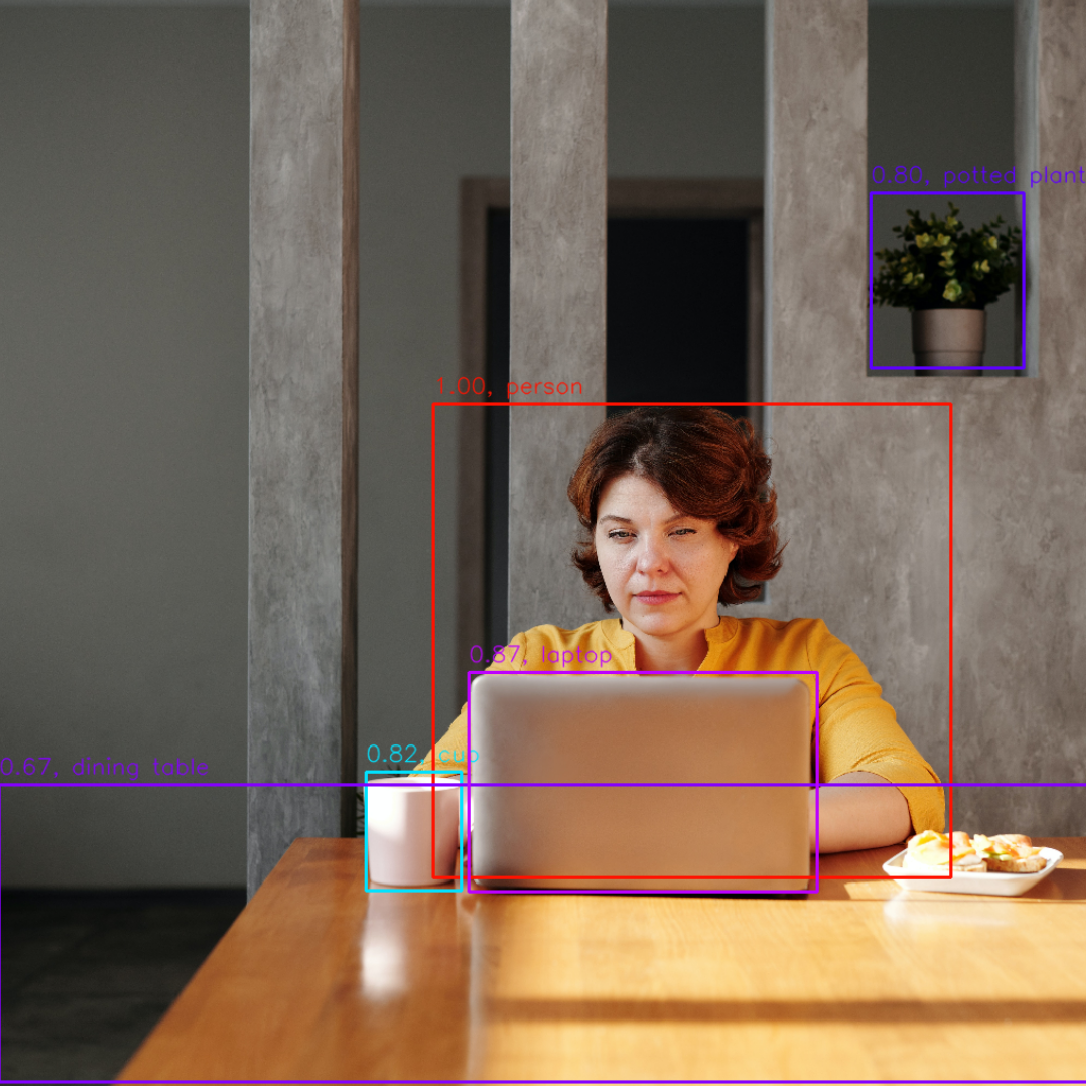

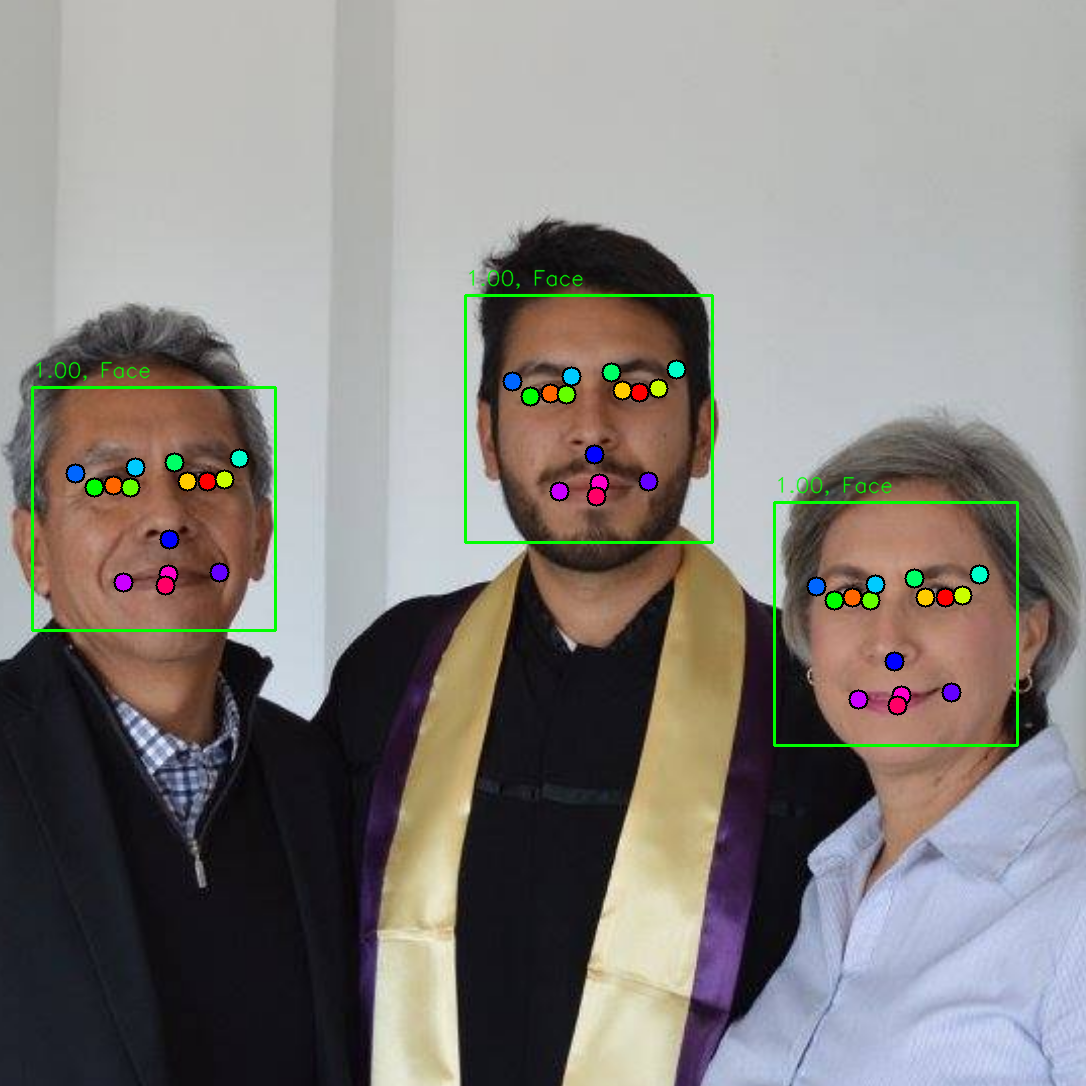

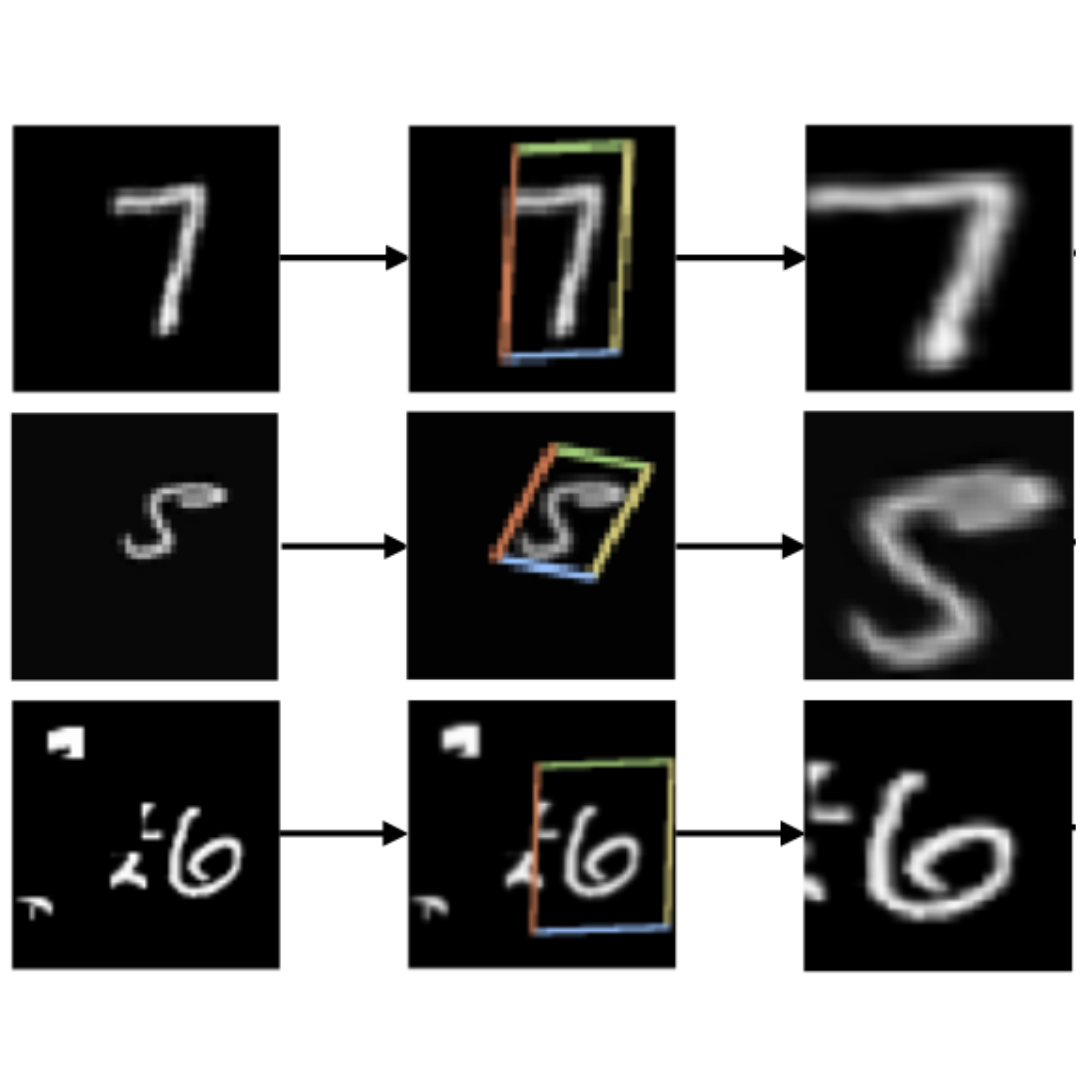

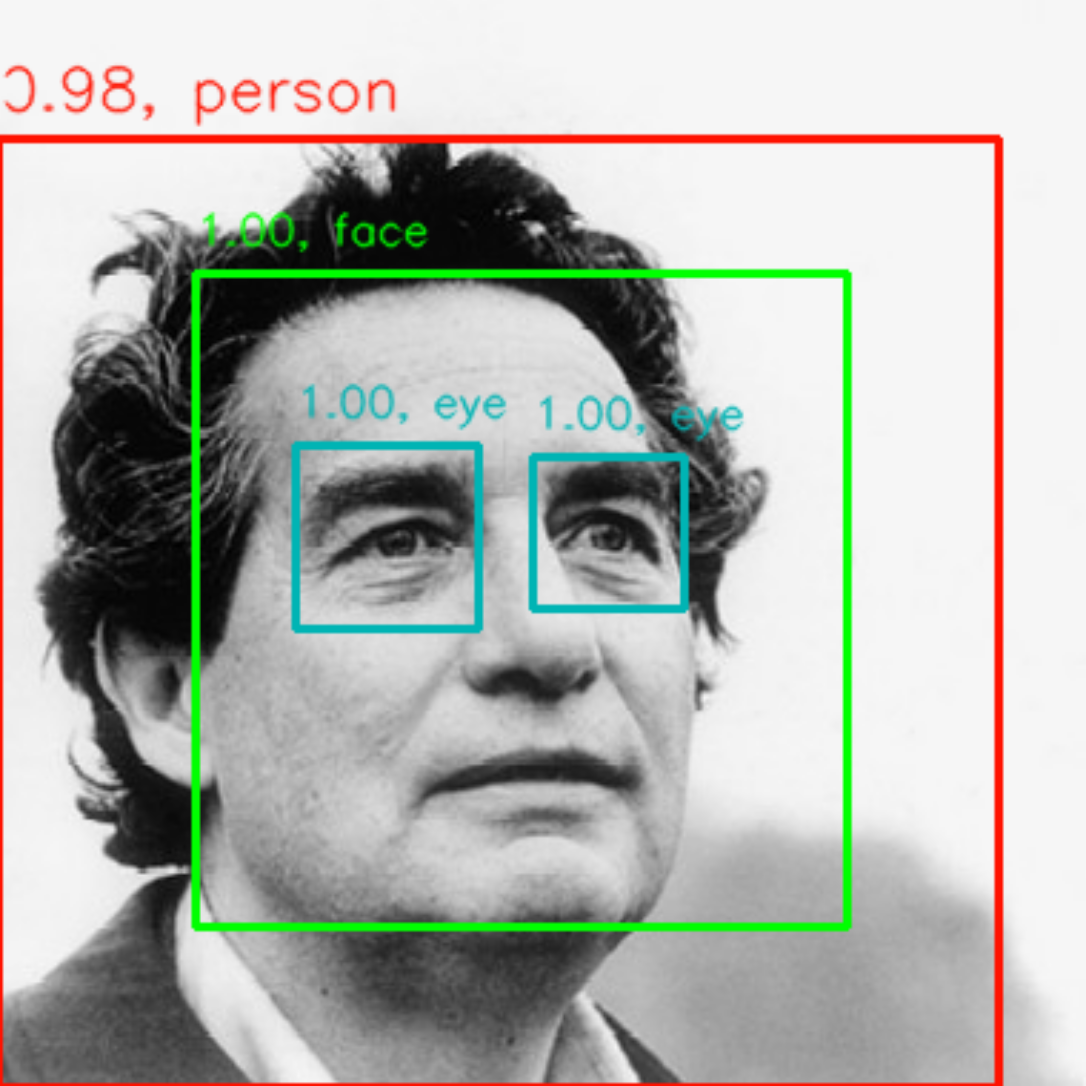

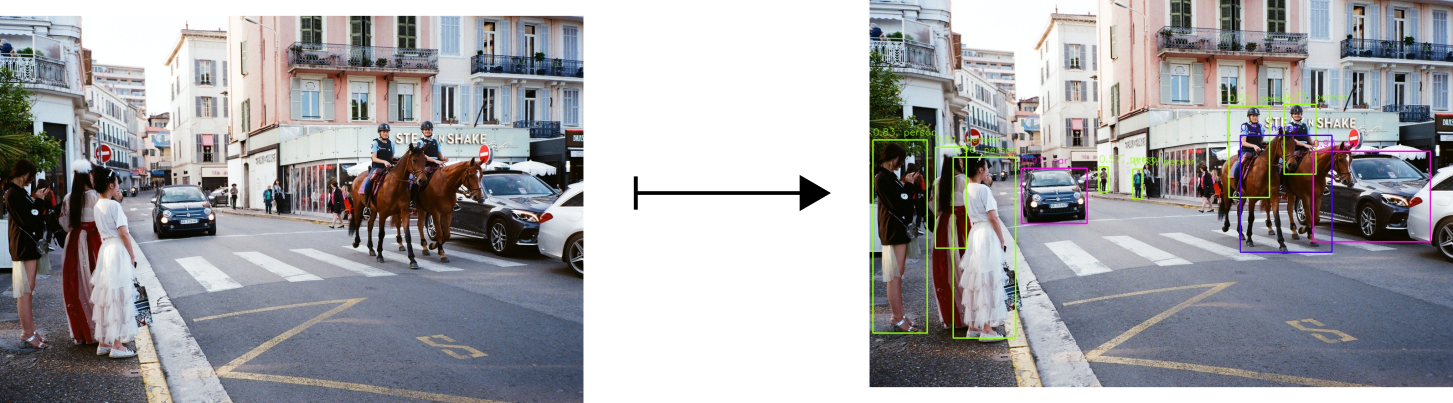

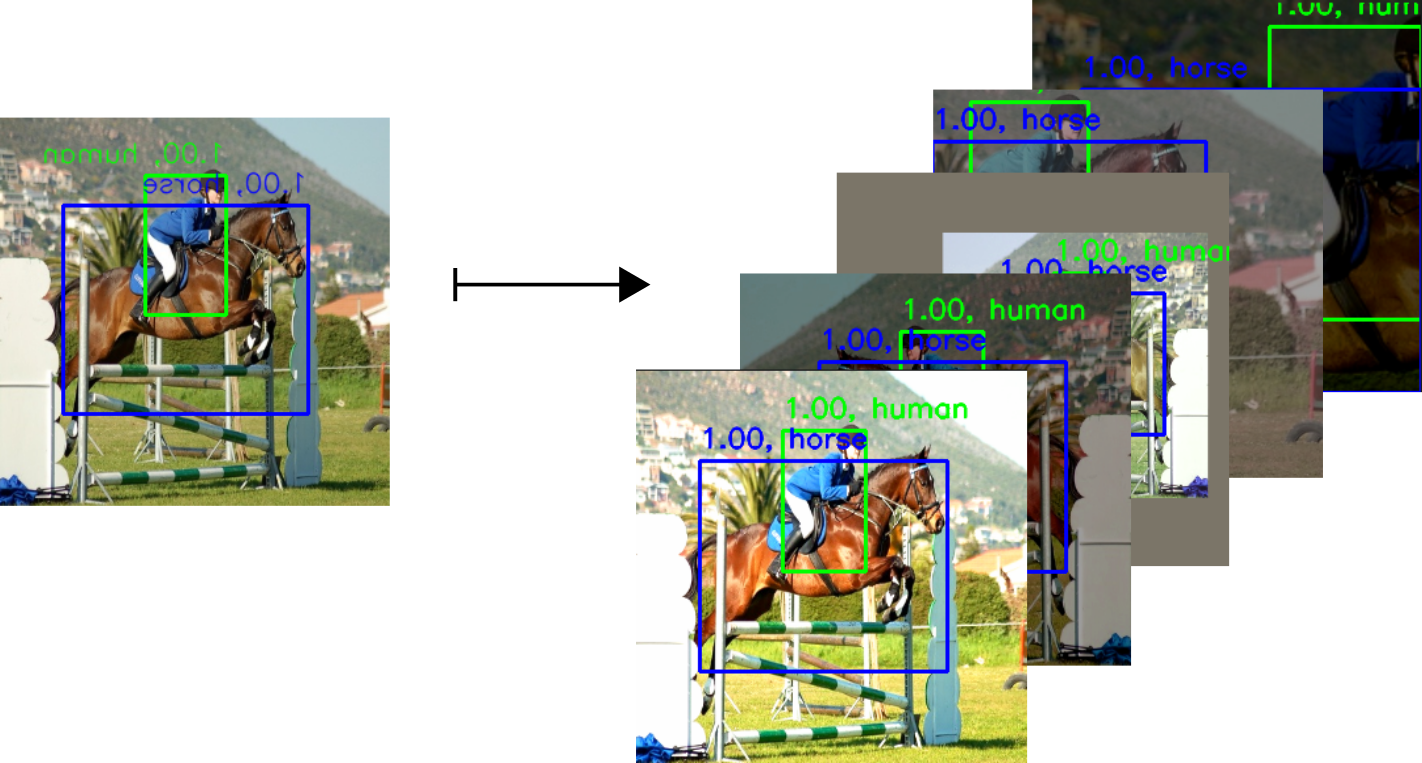

| 概率 2D 关键点 | 6D 头部姿态估计 | 目标检测 |

|---|---|---|

|

|

|

| 情感分类器 | 2D 关键点估计 | Mask-RCNN (开发中) |

|---|---|---|

|

|

|

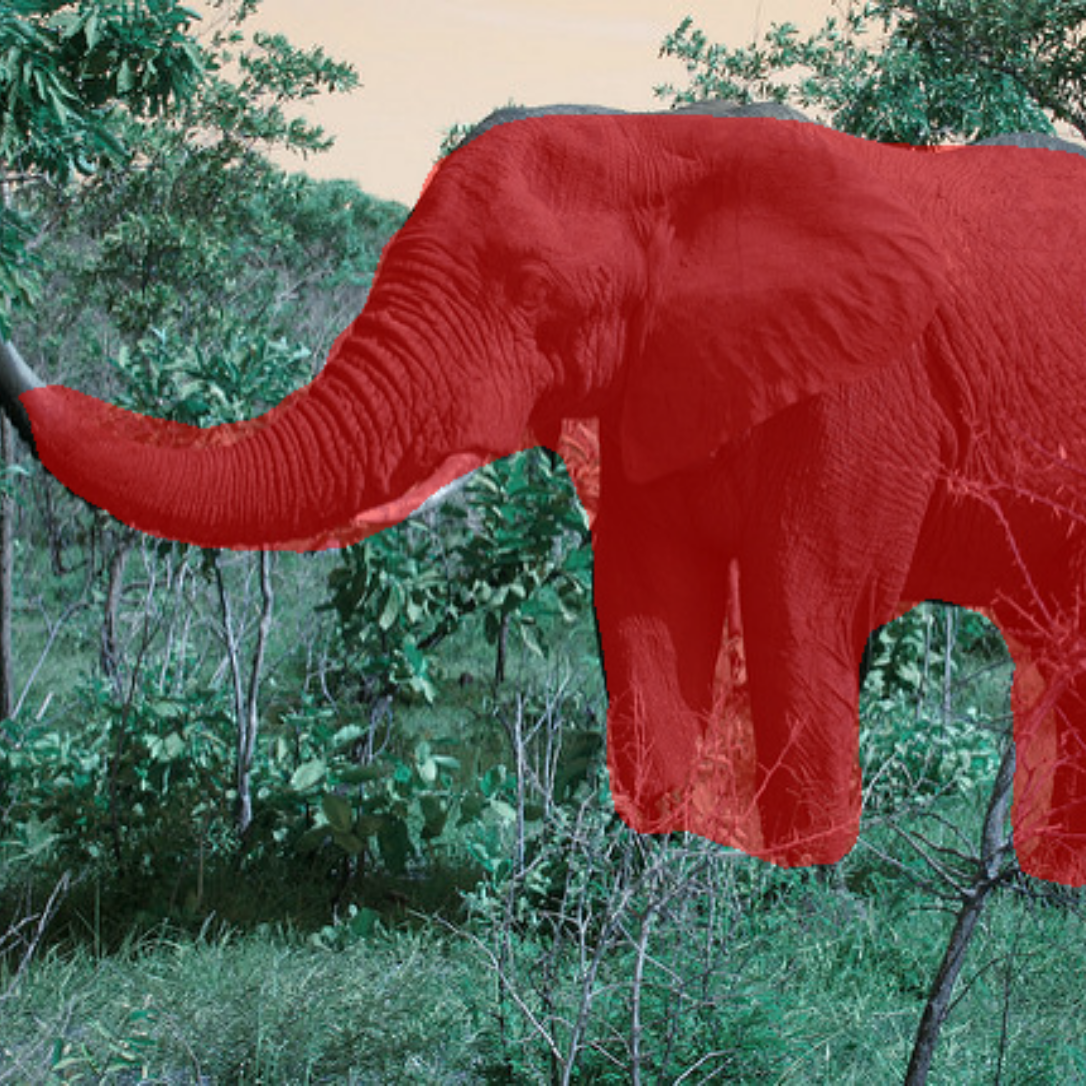

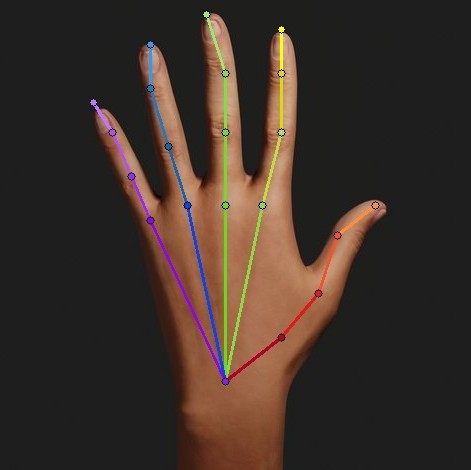

| 语义分割 | 手部姿态估计 | 2D 人体姿态估计 |

|---|---|---|

|

|

|

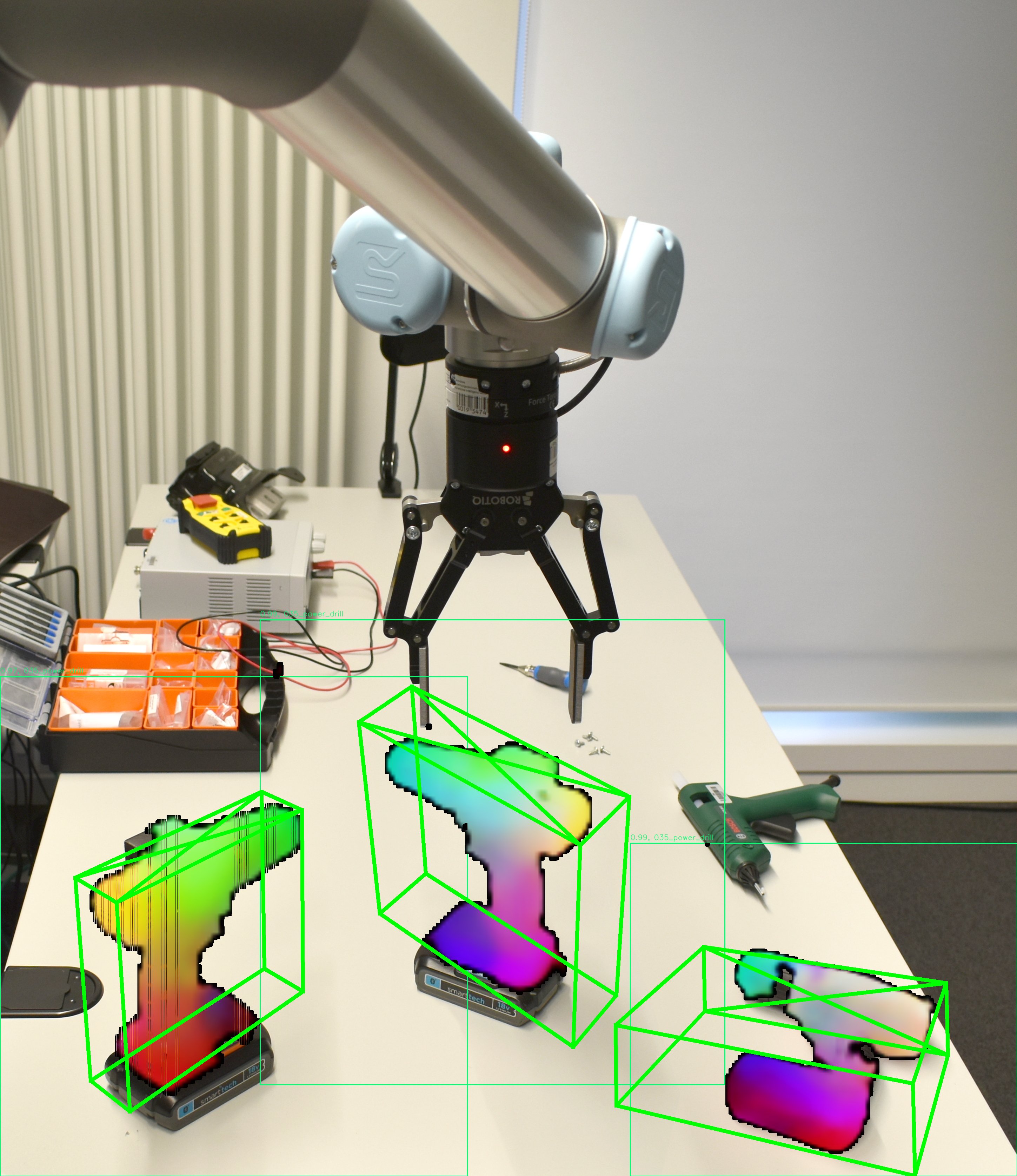

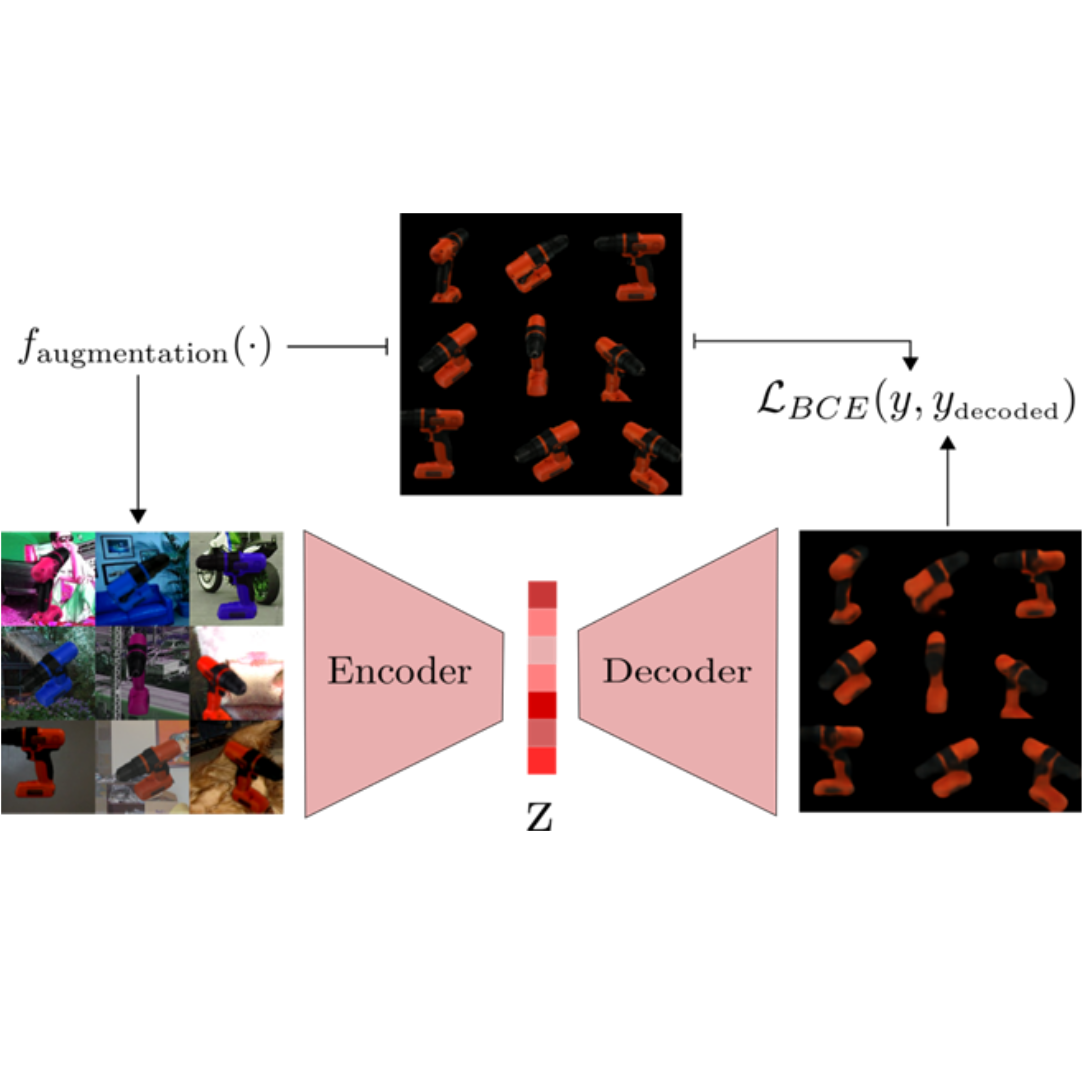

| 3D 关键点发现 | 手部闭合检测 | 6D 姿态估计 |

|---|---|---|

|

|

|

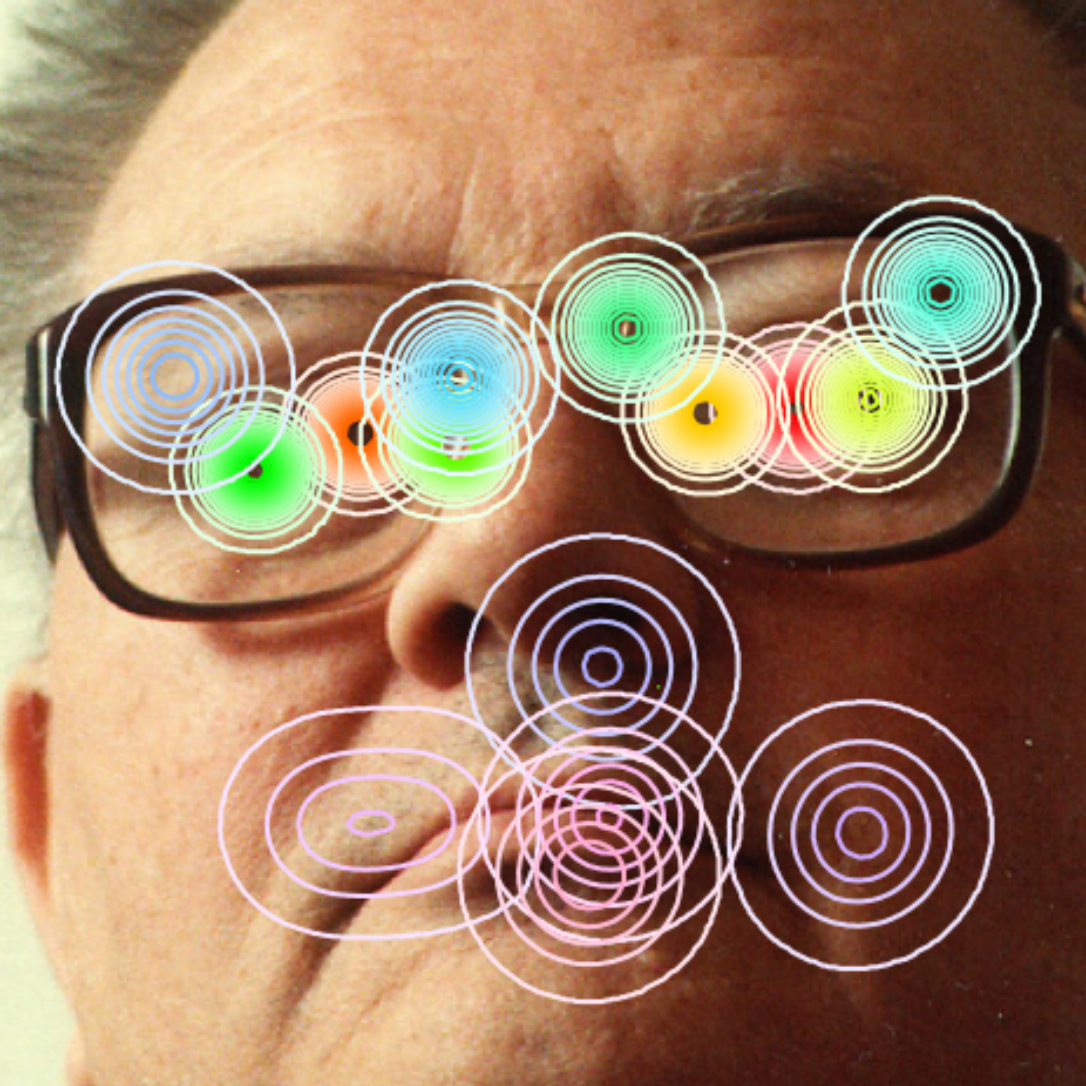

| 隐式方向 | 注意力机制 (STNs) | Haar 级联检测器 |

|---|---|---|

|

|

|

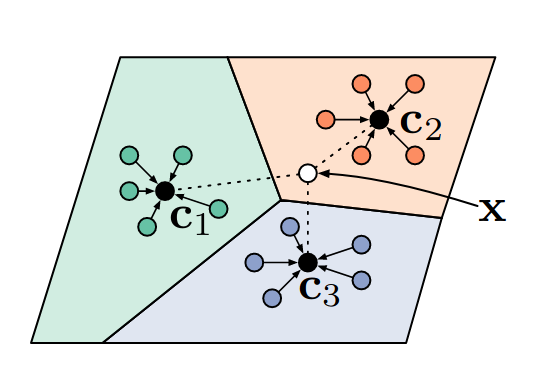

| 特征脸 | 原型网络 | 3D 人体姿态估计 |

|---|---|---|

|

|

|

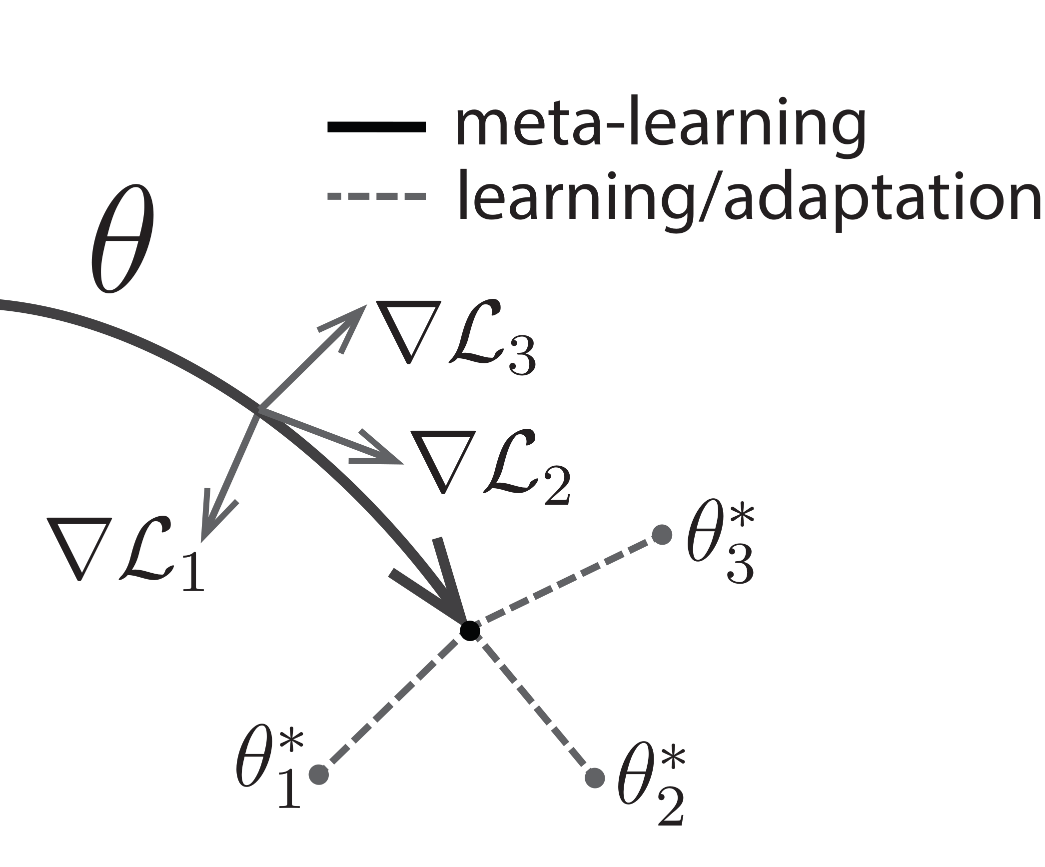

| MAML | ||

|---|---|---|

|

|

|

所有模型均可使用您自己的数据重新训练(Mask-RCNN 除外,我们正在此处进行开发)。

目录

安装

PAZ 仅包含 三个 依赖项:Tensorflow2.0、OpenCV 和 NumPy。

要通过 pypi 安装 PAZ,请运行:

pip install pypaz --user

文档

完整文档可在 https://oarriaga.github.io/paz/ 查看。

分层 API

PAZ 提供三个不同级别的 API,旨在满足用户特定的应用需求。

高级

开箱即用的简易预测功能。例如,为了检测目标,我们可以调用以下流水线:

from paz.applications import SSD512COCO

detect = SSD512COCO()

# apply directly to an image (numpy-array)

inferences = detect(image)

PAZ 中已经实现了多个高级函数,也称为 pipelines(流水线),可以在这里查看。这些函数是使用我们接下来要描述的中级 API 构建的。

Mid-level (中级 API)

虽然高级 API 对于快速应用非常有用,但可能不足以满足您的特定需求。因此,在 PAZ 中,我们可以使用中级 API 来构建高级函数。

Mid-level: Sequential (中级:顺序式)

如果您的函数是顺序执行的,可以使用 SequentialProcessor 构建顺序函数。在下面的示例中,我们创建了一个数据增强(data-augmentation)流水线:

from paz.abstract import SequentialProcessor

from paz import processors as pr

augment = SequentialProcessor()

augment.add(pr.RandomContrast())

augment.add(pr.RandomBrightness())

augment.add(pr.RandomSaturation())

augment.add(pr.RandomHue())

# you can now use this now as a normal function

image = augment(image)

您也可以添加 任何函数,而不仅仅是 processors 中的函数。例如,我们可以将一个 numpy 函数传递给我们原来的数据增强流水线:

augment.add(np.mean)

PAZ 中已经实现了多个函数,也称为 Processors(处理器),可以在这里查看。

使用这些处理器,我们可以构建更复杂的流水线,例如 用于目标检测的数据增强:pr.AugmentDetection

Mid-level: Explicit (中级:显式)

非顺序流水线也可以通过继承 Processor 来构建。在下面的示例中,我们使用高级和中级函数从头构建了一个情感分类器。

from paz.applications import HaarCascadeFrontalFace, MiniXceptionFER

import paz.processors as pr

class EmotionDetector(pr.Processor):

def __init__(self):

super(EmotionDetector, self).__init__()

self.detect = HaarCascadeFrontalFace(draw=False)

self.crop = pr.CropBoxes2D()

self.classify = MiniXceptionFER()

self.draw = pr.DrawBoxes2D(self.classify.class_names)

def call(self, image):

boxes2D = self.detect(image)['boxes2D']

cropped_images = self.crop(image, boxes2D)

for cropped_image, box2D in zip(cropped_images, boxes2D):

box2D.class_name = self.classify(cropped_image)['class_name']

return self.draw(image, boxes2D)

detect = EmotionDetector()

# you can now apply it to an image (numpy array)

predictions = detect(image)

Processors 允许我们轻松地组合、压缩和提取函数的参数。然而,大多数处理器是使用我们接下来展示的低级 API(后端)构建的。

Low-level (低级 API)

中级处理器主要由以下文件中的小型后端函数构建:boxes、cameras、images、keypoints 和 quaternions。

这些函数可以在 paz.backend 中找到:

from paz.backend import boxes, camera, image, keypoints, quaternion

例如,您可以在脚本中使用它们来加载或显示图像:

from paz.backend.image import load_image, show_image

image = load_image('my_image.png')

show_image(image)

Additional functionality (附加功能)

有自定义回调,例如在训练期间对目标检测器进行 MAP(平均精度均值)评估。

PAZ 附带了多个数据集的数据加载器: OpenImages、VOC、YCB-Video、FAT、FERPlus、FER2013、CityScapes。

我们提供了自动的批次创建和调度包装器,以便在您的

pipelines和 TensorFlow 生成器之间建立轻松连接。请查看教程了解更多信息。

模型

以下模型已在 PAZ 中实现,您可以使用自己的数据对其进行训练:

动机

尽管在不同的深度学习框架中已有多个高级计算机视觉库,但我感觉在我选择的框架中,仍然缺乏一个用于机器人感知的综合性深度学习库。

作为最后的说明,我想提到的是,我们往往容易忘记每个(开源)项目背后所付出的巨大努力和情感投入。我觉得我们很容易将公司名称与其背后的个人工作混淆,从而忘记了正是某些人在感受着我们的批评和赞扬。因此,无论您在这里发现了什么优秀的代码,都归功于 Pytorch、Tensorflow 和 Keras 等开源项目的软件工程师和贡献者。你们将心血公之于众供我们所有人使用和欣赏,我们首先应当向你们表达由衷的感谢。

为什么叫 PAZ?

- PAZ 这个名字符合其理论定义,它是 Perception for Autonomous Systems(自主系统感知)的首字母缩写,其中字母 S 被 Z 替换,以表明“System”(系统)指的是几乎任何事物,即 Z 作为一个经典的代数变量来表示未知元素。

测试与覆盖率

持续集成通过 github actions 使用 pytest 进行管理。 您可以通过运行以下命令来检查测试:

pytest tests

测试覆盖率可以使用 coverage 进行检查。

您可以通过调用以下命令安装 coverage:pip install coverage --user

然后您可以通过运行以下命令来检查测试覆盖率:

coverage run -m pytest tests/

coverage report -m

引用

如果您使用 PAZ,请考虑引用它。您也可以在 https://arxiv.org/abs/2010.14541 找到我们的论文。

@misc{arriaga2020perception,

title={Perception for Autonomous Systems (PAZ)},

author={Octavio Arriaga and Matias Valdenegro-Toro and Mohandass Muthuraja and Sushma Devaramani and Frank Kirchner},

year={2020},

eprint={2010.14541},

archivePrefix={arXiv},

primaryClass={cs.CV}

}

资助

PAZ 目前在 不莱梅大学 的 机器人小组 开发,并与位于 不莱梅 的 德国人工智能研究中心 (DFKI) 的 机器人创新中心 合作进行。 PAZ 由德国联邦经济事务和能源部以及 德国航空航天中心 (DLR) 资助。 PAZ 已在 TransFIT 和 KiMMI-SF 项目中被使用和/或开发。

版本历史

0.2.62025/02/030.2.52023/07/130.2.42023/06/100.2.22023/06/100.1.102022/09/070.1.92022/08/050.1.82022/04/250.1.72022/02/110.1.62021/05/100.1.52021/05/100.1.42021/02/110.1.32020/11/060.1.22020/11/050.1.12020/10/29常见问题

相似工具推荐

stable-diffusion-webui

stable-diffusion-webui 是一个基于 Gradio 构建的网页版操作界面,旨在让用户能够轻松地在本地运行和使用强大的 Stable Diffusion 图像生成模型。它解决了原始模型依赖命令行、操作门槛高且功能分散的痛点,将复杂的 AI 绘图流程整合进一个直观易用的图形化平台。 无论是希望快速上手的普通创作者、需要精细控制画面细节的设计师,还是想要深入探索模型潜力的开发者与研究人员,都能从中获益。其核心亮点在于极高的功能丰富度:不仅支持文生图、图生图、局部重绘(Inpainting)和外绘(Outpainting)等基础模式,还独创了注意力机制调整、提示词矩阵、负向提示词以及“高清修复”等高级功能。此外,它内置了 GFPGAN 和 CodeFormer 等人脸修复工具,支持多种神经网络放大算法,并允许用户通过插件系统无限扩展能力。即使是显存有限的设备,stable-diffusion-webui 也提供了相应的优化选项,让高质量的 AI 艺术创作变得触手可及。

ComfyUI

ComfyUI 是一款功能强大且高度模块化的视觉 AI 引擎,专为设计和执行复杂的 Stable Diffusion 图像生成流程而打造。它摒弃了传统的代码编写模式,采用直观的节点式流程图界面,让用户通过连接不同的功能模块即可构建个性化的生成管线。 这一设计巧妙解决了高级 AI 绘图工作流配置复杂、灵活性不足的痛点。用户无需具备编程背景,也能自由组合模型、调整参数并实时预览效果,轻松实现从基础文生图到多步骤高清修复等各类复杂任务。ComfyUI 拥有极佳的兼容性,不仅支持 Windows、macOS 和 Linux 全平台,还广泛适配 NVIDIA、AMD、Intel 及苹果 Silicon 等多种硬件架构,并率先支持 SDXL、Flux、SD3 等前沿模型。 无论是希望深入探索算法潜力的研究人员和开发者,还是追求极致创作自由度的设计师与资深 AI 绘画爱好者,ComfyUI 都能提供强大的支持。其独特的模块化架构允许社区不断扩展新功能,使其成为当前最灵活、生态最丰富的开源扩散模型工具之一,帮助用户将创意高效转化为现实。

ML-For-Beginners

ML-For-Beginners 是由微软推出的一套系统化机器学习入门课程,旨在帮助零基础用户轻松掌握经典机器学习知识。这套课程将学习路径规划为 12 周,包含 26 节精炼课程和 52 道配套测验,内容涵盖从基础概念到实际应用的完整流程,有效解决了初学者面对庞大知识体系时无从下手、缺乏结构化指导的痛点。 无论是希望转型的开发者、需要补充算法背景的研究人员,还是对人工智能充满好奇的普通爱好者,都能从中受益。课程不仅提供了清晰的理论讲解,还强调动手实践,让用户在循序渐进中建立扎实的技能基础。其独特的亮点在于强大的多语言支持,通过自动化机制提供了包括简体中文在内的 50 多种语言版本,极大地降低了全球不同背景用户的学习门槛。此外,项目采用开源协作模式,社区活跃且内容持续更新,确保学习者能获取前沿且准确的技术资讯。如果你正寻找一条清晰、友好且专业的机器学习入门之路,ML-For-Beginners 将是理想的起点。

ragflow

RAGFlow 是一款领先的开源检索增强生成(RAG)引擎,旨在为大语言模型构建更精准、可靠的上下文层。它巧妙地将前沿的 RAG 技术与智能体(Agent)能力相结合,不仅支持从各类文档中高效提取知识,还能让模型基于这些知识进行逻辑推理和任务执行。 在大模型应用中,幻觉问题和知识滞后是常见痛点。RAGFlow 通过深度解析复杂文档结构(如表格、图表及混合排版),显著提升了信息检索的准确度,从而有效减少模型“胡编乱造”的现象,确保回答既有据可依又具备时效性。其内置的智能体机制更进一步,使系统不仅能回答问题,还能自主规划步骤解决复杂问题。 这款工具特别适合开发者、企业技术团队以及 AI 研究人员使用。无论是希望快速搭建私有知识库问答系统,还是致力于探索大模型在垂直领域落地的创新者,都能从中受益。RAGFlow 提供了可视化的工作流编排界面和灵活的 API 接口,既降低了非算法背景用户的上手门槛,也满足了专业开发者对系统深度定制的需求。作为基于 Apache 2.0 协议开源的项目,它正成为连接通用大模型与行业专有知识之间的重要桥梁。

PaddleOCR

PaddleOCR 是一款基于百度飞桨框架开发的高性能开源光学字符识别工具包。它的核心能力是将图片、PDF 等文档中的文字提取出来,转换成计算机可读取的结构化数据,让机器真正“看懂”图文内容。 面对海量纸质或电子文档,PaddleOCR 解决了人工录入效率低、数字化成本高的问题。尤其在人工智能领域,它扮演着连接图像与大型语言模型(LLM)的桥梁角色,能将视觉信息直接转化为文本输入,助力智能问答、文档分析等应用场景落地。 PaddleOCR 适合开发者、算法研究人员以及有文档自动化需求的普通用户。其技术优势十分明显:不仅支持全球 100 多种语言的识别,还能在 Windows、Linux、macOS 等多个系统上运行,并灵活适配 CPU、GPU、NPU 等各类硬件。作为一个轻量级且社区活跃的开源项目,PaddleOCR 既能满足快速集成的需求,也能支撑前沿的视觉语言研究,是处理文字识别任务的理想选择。

tesseract

Tesseract 是一款历史悠久且备受推崇的开源光学字符识别(OCR)引擎,最初由惠普实验室开发,后由 Google 维护,目前由全球社区共同贡献。它的核心功能是将图片中的文字转化为可编辑、可搜索的文本数据,有效解决了从扫描件、照片或 PDF 文档中提取文字信息的难题,是数字化归档和信息自动化的重要基础工具。 在技术层面,Tesseract 展现了强大的适应能力。从版本 4 开始,它引入了基于长短期记忆网络(LSTM)的神经网络 OCR 引擎,显著提升了行识别的准确率;同时,为了兼顾旧有需求,它依然支持传统的字符模式识别引擎。Tesseract 原生支持 UTF-8 编码,开箱即用即可识别超过 100 种语言,并兼容 PNG、JPEG、TIFF 等多种常见图像格式。输出方面,它灵活支持纯文本、hOCR、PDF、TSV 等多种格式,方便后续数据处理。 Tesseract 主要面向开发者、研究人员以及需要构建文档处理流程的企业用户。由于它本身是一个命令行工具和库(libtesseract),不包含图形用户界面(GUI),因此最适合具备一定编程能力的技术人员集成到自动化脚本或应用程序中