gpt-tokenizer

gpt-tokenizer 是一款专为 JavaScript 环境打造的高性能工具,用于处理 OpenAI 系列大模型(涵盖 GPT-4o、o1、GPT-5 及更早版本)的文本分词编码与解码。它本质上是 OpenAI 官方 Python 库 tiktoken 的 TypeScript 移植版,但针对前端和 Node.js 场景进行了深度优化。

在开发基于大语言模型的应用时,准确计算 Token 数量对于控制 API 成本和确保输入不超限至关重要。gpt-tokenizer 解决了在 JavaScript 中缺乏快速、轻量且功能完整的分词方案的痛点。它不仅支持所有主流模型的编码格式,还能直接在浏览器中运行,无需复杂的后端服务。

这款工具非常适合前端工程师、全栈开发者以及 AI 应用研究人员使用。其独特亮点包括:提供专门的 encodeChat 函数轻松处理对话格式;内置 estimateCost 功能可直接估算 API 费用;拥有高效的 isWithinTokenLimit 方法,无需完整编码即可快速判断文本是否超标。此外,它支持同步操作和流式数据处理,且无全局缓存设计,有效避免了内存泄漏风险。如果你正在构建需要精确掌控 Token 消耗的 AI 应用,gpt-tokenizer 是一个可靠且高效的选择。

使用场景

某 SaaS 客服团队正在开发一个基于 GPT-4o 的智能工单摘要系统,需要在用户提交长文本时实时计算 Token 消耗并预估 API 成本。

没有 gpt-tokenizer 时

- 性能瓶颈严重:引入传统的 Node.js 绑定库导致浏览器端卡顿,无法在用户输入时即时反馈剩余字数限制。

- 模型支持滞后:官方库更新缓慢,难以适配最新的 GPT-4o 或 o1 模型编码规则,导致计数偏差引发 API 报错。

- 成本核算繁琐:缺乏内置计价逻辑,开发者需手动维护复杂的模型价格表来估算单次请求费用,容易出错。

- 内存泄漏风险:旧方案常依赖全局缓存处理分词,长时间运行后易造成前端页面内存溢出崩溃。

使用 gpt-tokenizer 后

- 极致响应速度:利用其纯 TypeScript 编写的高性能特性,实现毫秒级同步分词,用户打字时即可动态显示进度条。

- 全模型无缝兼容:直接调用内置的

o200k_base等最新编码配置,完美覆盖从 GPT-3.5 到 GPT-5 的所有迭代版本。 - 一键成本估算:通过

estimateCost函数自动匹配官方定价,实时向管理员展示当前对话的预计美元开销。 - 架构安全轻量:无全局缓存设计彻底杜绝内存泄漏,且无需异步加载,可直接嵌入 Web Worker 或边缘函数中运行。

gpt-tokenizer 将原本复杂的 Token 管理难题转化为简单的函数调用,让开发者能专注于业务逻辑而非底层编码细节。

运行环境要求

- 未说明

不需要 GPU

未说明

快速开始

gpt-tokenizer

gpt-tokenizer 是一个支持所有 OpenAI 模型(包括 GPT-5、GPT-4o、o1、o3、o4、GPT-4.1 以及更早的 GPT-3.5 和 GPT-4 等)的字节对编码器/解码器。它是适用于所有 JavaScript 环境的 [最快、最小且占用资源最少] 的 GPT 分词器,并使用 TypeScript 编写。

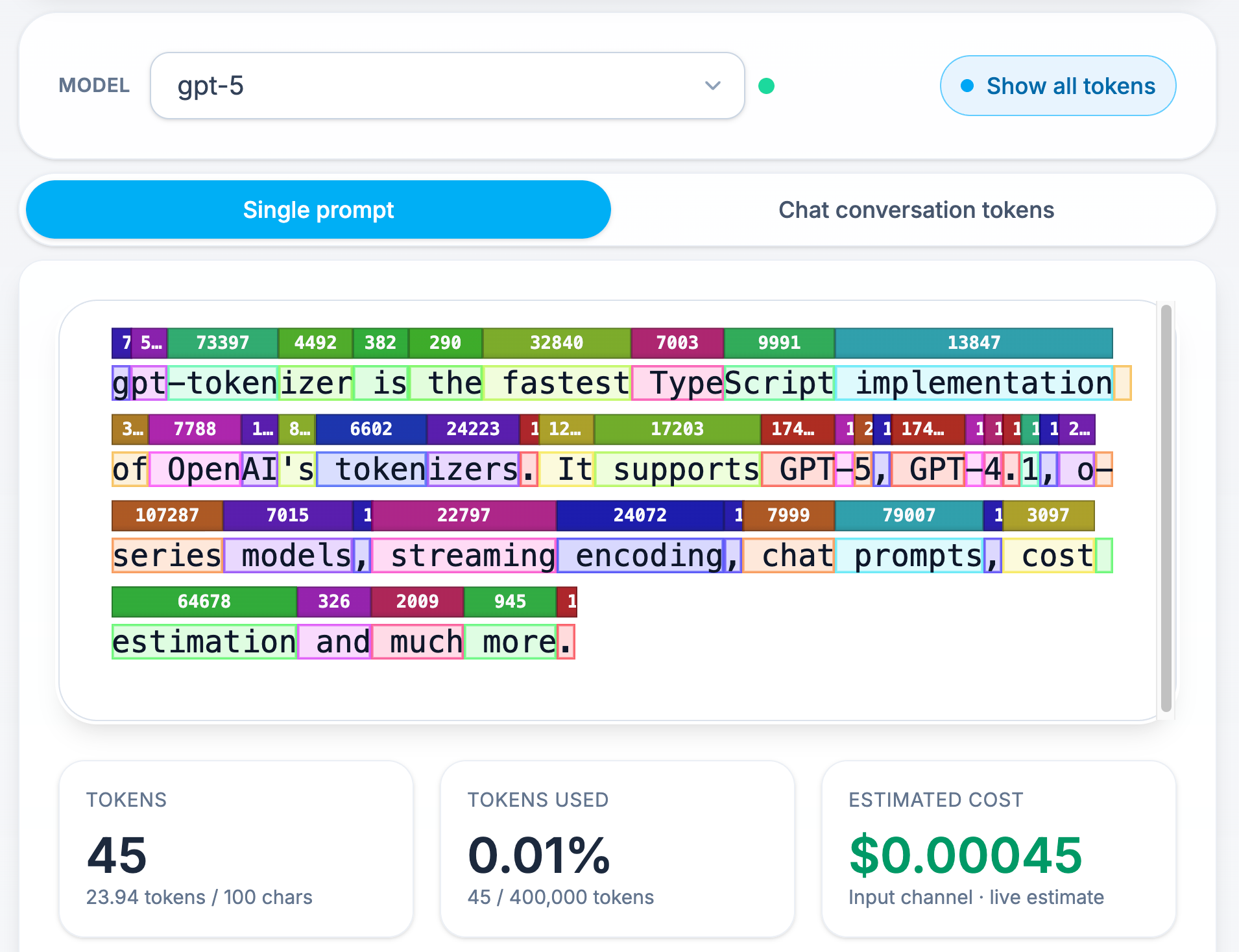

快来 游乐场 体验吧!

该库已被以下公司和项目信赖:

- 微软(Teams、GenAIScript)

- Elastic(Kibana)

- Effect TS

- CodeRabbit

- Ironclad 的 Rivet

如果您觉得这个项目有用,请考虑 🩷 赞助 该项目。

特性

它是 NPM 上功能最完整、开源的 GPT 分词器。本包是对 OpenAI 的 tiktoken 的移植,并在此基础上添加了一些独特的功能:

- 通过

encodeChat函数轻松对聊天内容进行分词 - 支持当前所有 OpenAI 模型(可用编码:

r50k_base、p50k_base、p50k_edit、cl100k_base、o200k_base和o200k_harmony) - 可以同步加载并运行!(即在非 async/await 上下文中也能使用)

- 解码器和编码器函数均提供生成器版本

- 提供解码异步数据流的能力(使用

decodeAsyncGenerator和decodeGenerator,可处理任何可迭代输入) - 无全局缓存(不会像原始 GPT-3 编码器实现那样出现意外内存泄漏)

- 内置高性能的

isWithinTokenLimit函数,无需对整段文本或聊天内容进行编码即可评估是否超出 token 限制 - 内置成本估算功能

estimateCost,用于计算 API 使用成本 - 包含完整的 OpenAI 模型库及详尽的价格信息(参见

src/models.ts和src/models.gen.ts) - 通过消除传递性数组提升了整体性能

- 类型安全(使用 TypeScript 编写)

- 在浏览器中开箱即用

安装

作为 NPM 包

npm install gpt-tokenizer

作为 UMD 模块

<script src="https://unpkg.com/gpt-tokenizer"></script>

<script>

// 现在可以通过全局变量访问该包:

const { encode, decode } = GPTTokenizer_cl100k_base

</script>

如果您希望使用自定义编码,请加载相应的脚本。

- https://unpkg.com/gpt-tokenizer/dist/o200k_base.js(适用于所有现代模型,如

gpt-5、gpt-4o、gpt-4.1、o1等) - https://unpkg.com/gpt-tokenizer/dist/o200k_harmony.js(适用于开放权重的 Harmony 模型,如

gpt-oss-20b和gpt-oss-120b) - https://unpkg.com/gpt-tokenizer/dist/cl100k_base.js(适用于

gpt-4和gpt-3.5) - https://unpkg.com/gpt-tokenizer/dist/p50k_base.js

- https://unpkg.com/gpt-tokenizer/dist/p50k_edit.js

- https://unpkg.com/gpt-tokenizer/dist/r50k_base.js

全局变量名格式为:GPTTokenizer_${encoding}。

更多信息请参阅 支持的模型及其编码 部分。

游乐场

游乐场已发布在一个便于记忆的 URL 上:https://gpt-tokenizer.dev/

使用方法

该库提供了多种函数,用于将文本转换为(以及从)可输入大型语言模型的整数序列(即标记)。这种转换是通过 OpenAI 使用的字节对编码(BPE)算法实现的。

import {

encode,

encodeChat,

decode,

isWithinTokenLimit,

encodeGenerator,

decodeGenerator,

decodeAsyncGenerator,

ALL_SPECIAL_TOKENS,

} from 'gpt-tokenizer'

// 注意:根据模型的不同,需从相应的文件中导入,例如:

// import {...} from 'gpt-tokenizer/model/gpt-4o'

const text = 'Hello, world!'

const tokenLimit = 10

// 将文本编码为标记

const tokens = encode(text)

// 将标记解码回文本

const decodedText = decode(tokens)

// 检查文本是否在标记限制内

// 如果超出限制则返回 false,否则返回实际的标记数量(真值)

const withinTokenLimit = isWithinTokenLimit(text, tokenLimit)

// 在需要时允许特殊标记

const withinTokenLimitWithSpecial = isWithinTokenLimit(text, tokenLimit, {

allowedSpecial: ALL_SPECIAL_TOKENS,

})

// 示例对话:

const chat = [

{ role: 'system', content: '你是一个有用的助手。' },

{ role: 'assistant', content: 'gpt-tokenizer 非常棒。' },

] as const

// 将对话编码为标记

const chatTokens = encodeChat(chat)

// 检查对话是否在标记限制内

const chatWithinTokenLimit = isWithinTokenLimit(chat, tokenLimit)

const chatWithinTokenLimitWithSpecial = isWithinTokenLimit(chat, tokenLimit, {

allowedSpecial: ALL_SPECIAL_TOKENS,

})

// 使用生成器编码文本

for (const tokenChunk of encodeGenerator(text)) {

console.log(tokenChunk)

}

// 使用生成器解码标记

for (const textChunk of decodeGenerator(tokens)) {

console.log(textChunk)

}

// 使用异步生成器解码标记

// (假设 `asyncTokens` 是一个 AsyncIterableIterator<number))

for await (const textChunk of decodeAsyncGenerator(asyncTokens)) {

console.log(textChunk)

}

默认情况下,从 gpt-tokenizer 导入会使用 o200k_base 编码,所有现代 OpenAI 模型都采用此编码,包括 gpt-4o、gpt-4.1、o1 等。

若需获取其他模型的分词器,可直接导入,例如:

import {

encode,

decode,

isWithinTokenLimit,

// 等等...

} from 'gpt-tokenizer/model/gpt-3.5-turbo'

如果使用的解析器不支持 package.json 的 exports 解析,可能需要从相应的 cjs 或 esm 目录中导入,例如:

import {

encode,

decode,

isWithinTokenLimit,

// 等等...

} from 'gpt-tokenizer/cjs/model/gpt-3.5-turbo'

延迟加载

如果您不介意以异步方式加载分词器,可以在函数内部使用动态导入,如下所示:

const {

encode,

decode,

isWithinTokenLimit,

// 等等...

} = await import('gpt-tokenizer/model/gpt-3.5-turbo')

加载自定义编码

如果您的模型未被本包支持,但您知道它使用的 BPE 编码,可以直接加载该编码,例如:

import {

encode,

decode,

isWithinTokenLimit,

// 等等...

} from 'gpt-tokenizer/encoding/cl100k_base'

支持的模型及其编码

我们支持所有 OpenAI 模型,包括最新版本,具体编码如下:

o系列模型,如o1-*、o3-*和o4-*(o200k_base)gpt-4o(o200k_base)gpt-oss-*(o200k_harmony)gpt-4-*(cl100k_base)gpt-3.5-*(cl100k_base)text-davinci-003(p50k_base)text-davinci-002(p50k_base)text-davinci-001(r50k_base)- …以及其他众多模型,详情请参阅 models.ts,其中列出了当前支持的模型及其编码。

如果您没有找到所需的模型,那么默认编码很可能就是您所需要的。

API

encode(text: string, encodeOptions?: EncodeOptions): number[]

将给定文本编码为标记序列。当您需要将一段文本转换为 GPT 模型可处理的标记格式时,请使用此方法。

可选的 encodeOptions 参数允许您指定特殊标记的处理方式(详见特殊标记)。

示例:

import { encode } from 'gpt-tokenizer'

const text = 'Hello, world!'

const tokens = encode(text)

decode(tokens: number[]): string

将标记序列解码回文本。当您希望将 GPT 模型的输出标记转换为人类可读的文本时,请使用此方法。

示例:

import { decode } from 'gpt-tokenizer'

const tokens = [18435, 198, 23132, 328]

const text = decode(tokens)

isWithinTokenLimit(text: string | Iterable<ChatMessage>, tokenLimit: number, encodeOptions?: EncodeOptions): false | number

检查输入是否在标记限制内。如果超出限制则返回 false,否则返回标记数量。当您需要快速检查给定文本或对话是否在 GPT 模型的标记限制范围内,而无需对整个输入进行编码时,可使用此方法。可选的 encodeOptions 参数允许您配置特殊标记的处理方式。

示例:

import { isWithinTokenLimit, ALL_SPECIAL_TOKENS } from 'gpt-tokenizer'

const text = 'Hello, world!'

const tokenLimit = 10

const withinTokenLimit = isWithinTokenLimit(text, tokenLimit)

const withinTokenLimitWithSpecial = isWithinTokenLimit(text, tokenLimit, {

allowedSpecial: ALL SPECIAL TOKENS,

})

countTokens(text: string | Iterable<ChatMessage>, encodeOptions?: EncodeOptions): number

统计输入文本或对话中的标记数量。当您需要确定标记数量而不必对照限制时,可使用此方法。

可选的 encodeOptions 参数允许您指定允许或禁止的特殊标记集合。

示例:

import { countTokens } from 'gpt-tokenizer'

const text = 'Hello, world!'

const tokenCount = countTokens(text)

countChatCompletionTokens(request: ChatCompletionRequest): number

计算一个调用函数的聊天完成请求将消耗的 token 数量,包括消息开销、可选的函数定义以及固定的函数调用。此辅助函数仅适用于支持 function_calling 功能的模型。

示例:

import {

countChatCompletionTokens,

type ChatCompletionRequest,

} from 'gpt-tokenizer/model/gpt-4o'

const request: ChatCompletionRequest = {

messages: [

{ role: 'system', content: '你是一位乐于助人的助手。' },

{ role: 'user', content: '查询旧金山的天气。' },

],

functions: [

{

name: 'get_weather',

description: '查询某个城市的天气。',

parameters: {

type: 'object',

required: ['city'],

properties: {

city: { type: 'string' },

unit: { type: 'string', enum: ['摄氏度', '华氏度'] },

},

},

},

],

}

const promptTokenEstimate = countChatCompletionTokens(request)

你也可以通过模块的默认导出来访问该辅助函数:

import gpt4o from 'gpt-tokenizer/model/gpt-4o'

// 复用上面定义的 `request`

const tokenCount = gpt4o.countChatCompletionTokens?.(request)

encodeChat(chat: ChatMessage[], model?: ModelName, encodeOptions?: EncodeOptions): number[]

将给定的聊天对话编码为一串 token 序列。可选的 encodeOptions 参数允许你配置特殊 token 的处理方式。

如果你没有直接导入模型版本,或者在初始化时未提供 model 参数,则必须在此处提供,以便正确地为特定模型对聊天进行分词。当你需要将聊天转换为 GPT 模型可以处理的 token 格式时,请使用此方法。

示例:

import { encodeChat } from 'gpt-tokenizer'

const chat = [

{ role: 'system', content: '你是一位乐于助人的助手。' },

{ role: 'assistant', content: 'gpt-tokenizer 真棒。' },

]

const tokens = encodeChat(chat)

请注意,即使你编码的是空聊天,它仍然会包含最少数量的特殊 token。

encodeGenerator(text: string): Generator<number[], void, undefined>

使用生成器对给定文本进行编码,每次生成一部分 token。 当你希望分块编码文本时,可以使用此方法,这在处理大型文本或流式数据时非常有用。

示例:

import { encodeGenerator } from 'gpt-tokenizer'

const text = '你好,世界!'

const tokens = []

for (const tokenChunk of encodeGenerator(text)) {

tokens.push(...tokenChunk)

}

encodeChatGenerator(chat: Iterator<ChatMessage>, model?: ModelName): Generator<number[], void, undefined>

与 encodeChat 相同,但输出为生成器,并且可以接受任何迭代器作为输入的聊天内容。

decodeGenerator(tokens: Iterable<number>): Generator<string, void, undefined>

使用生成器解码 token 序列,每次生成一部分解码后的文本。 当你希望分块解码 token 时,可以使用此方法,这在处理大型输出或流式数据时很有用。

示例:

import { decodeGenerator } from 'gpt-tokenizer'

const tokens = [18435, 198, 23132, 328]

let decodedText = ''

for (const textChunk of decodeGenerator(tokens)) {

decodedText += textChunk

}

decodeAsyncGenerator(tokens: AsyncIterable<number>): AsyncGenerator<string, void, undefined>

异步使用生成器解码 token 序列,每次生成一部分解码后的文本。当你希望以异步方式分块解码 token 时,可以使用此方法,这在异步上下文中处理大型输出或流式数据时非常有用。

示例:

import { decodeAsyncGenerator } from 'gpt-tokenizer'

async function processTokens(asyncTokensIterator) {

let decodedText = ''

for await (const textChunk of decodeAsyncGenerator(asyncTokensIterator)) {

decodedText += textChunk

}

}

estimateCost(tokenCount: number, modelSpec?: ModelSpec): PriceData

根据模型的定价信息,估算处理给定数量 token 的成本。此函数会计算不同 API 使用类型(主 API、批量 API)的成本,并在有缓存 token 的情况下考虑其成本。

该函数返回一个 PriceData 对象,结构如下:

main: 主 API 定价,包含input、output、cached_input和cached_output成本batch: 战略 API 定价,同样包含上述成本类别

所有成本均基于提供的 token 数量以美元计算。

示例:

import { estimateCost } from 'gpt-tokenizer/model/gpt-4o'

const tokenCount = 1000

const costEstimate = estimateCost(tokenCount)

console.log('主 API 输入成本:', costEstimate.main?.input)

console.log('主 API 输出成本:', costEstimate.main?.output)

console.log('批量 API 输入成本:', costEstimate.batch?.input)

注意:模型规格必须通过特定于模型的导入获得,或者作为第二个参数传递。并非所有模型都提供成本信息。

特殊 token

GPT 模型使用了一些特殊的 token。 需要注意的是,不是所有模型都支持所有的特殊 token。

默认情况下,所有特殊 token 均被禁止。

encode、encodeGenerator、encodeChat、encodeChatGenerator、countTokens 和 isWithinTokenLimit 函数都接受一个 EncodeOptions 参数,用于自定义特殊 token 的处理方式:

自定义允许集

gpt-tokenizer 允许你在编码文本时指定自定义的特殊 token 允许集。为此,你可以将包含允许特殊 token 的 Set 作为参数传递给 encode 函数:

import {

EndOfPrompt,

EndOfText,

FimMiddle,

FimPrefix,

FimSuffix,

ImStart,

ImEnd,

ImSep,

encode,

} from 'gpt-tokenizer'

const inputText = `一些文本 ${EndOfPrompt}`

const allowedSpecialTokens = new Set([EndOfPrompt])

const encoded = encode(inputText, { allowedSpecialTokens })

const expectedEncoded = [8538, 2991, 220, 100276]

expect(encoded).toBe(expectedEncoded)

你还可以使用一种特殊的简写方式来禁止或允许所有特殊 token,只需传递字符串 'all',例如 { allowedSpecial: 'all' }。

自定义禁止集

同样,你也可以在编码文本时指定自定义的特殊 token 禁止集。将包含禁止特殊 token 的 Set 作为参数传递给 encode 函数:

import { encode, EndOfText } from 'gpt-tokenizer'

const inputText = `一些文本 ${EndOfText}`

const disallowedSpecial = new Set([EndOfText])

// 将抛出错误:

const encoded = encode(inputText, { disallowedSpecial })

在这个例子中,由于输入文本包含被禁止的特殊 token,因此会抛出错误。

如果同时提供了 allowedSpecialTokens 和 disallowedSpecial,则以 disallowedSpecial 为准。

性能优化

LRU 合并缓存

分词器使用 LRU(最近最少使用)缓存来提升相似字符串的编码性能。默认情况下,它会存储最多 10 万个合并后的标记对。你可以根据具体用例调整此值以达到最佳效果:

- 增大缓存大小会使相似字符串的编码速度更快,但会占用更多内存。

- 将其设置为 0 会完全禁用缓存。

- 对于处理大量唯一字符串的应用程序,较小的缓存可能更为高效。

你可以使用 setMergeCacheSize 函数来修改缓存大小:

import { setMergeCacheSize } from 'gpt-tokenizer'

// 设置为 5000 条目

setMergeCacheSize(5000)

// 完全禁用缓存

setMergeCacheSize(0)

缓存会在多次编码调用之间保持持久化。若需显式清空缓存(例如释放内存),可以使用 clearMergeCache 函数:

import { clearMergeCache } from 'gpt-tokenizer'

clearMergeCache()

测试与验证

gpt-tokenizer 在 TestPlans.txt 文件中包含一组测试用例,用于确保其与 OpenAI 的 Python tiktoken 库兼容。这些测试用例验证了 gpt-tokenizer 的功能和行为,为开发者提供了一个可靠的参考。

运行单元测试并验证这些测试用例,有助于保持该库与原始 Python 实现的一致性。

模型信息

gpt-tokenizer 通过 gpt-tokenizer/models 中的 models 导出,提供了关于所有 OpenAI 模型的全面数据。这包括上下文窗口、费用、训练数据截止日期以及弃用状态等详细信息。

这些数据会定期维护,以匹配 OpenAI 的官方文档。欢迎贡献以保持数据的最新状态;如果你发现任何差异或有更新内容,请随时提交 Pull Request。

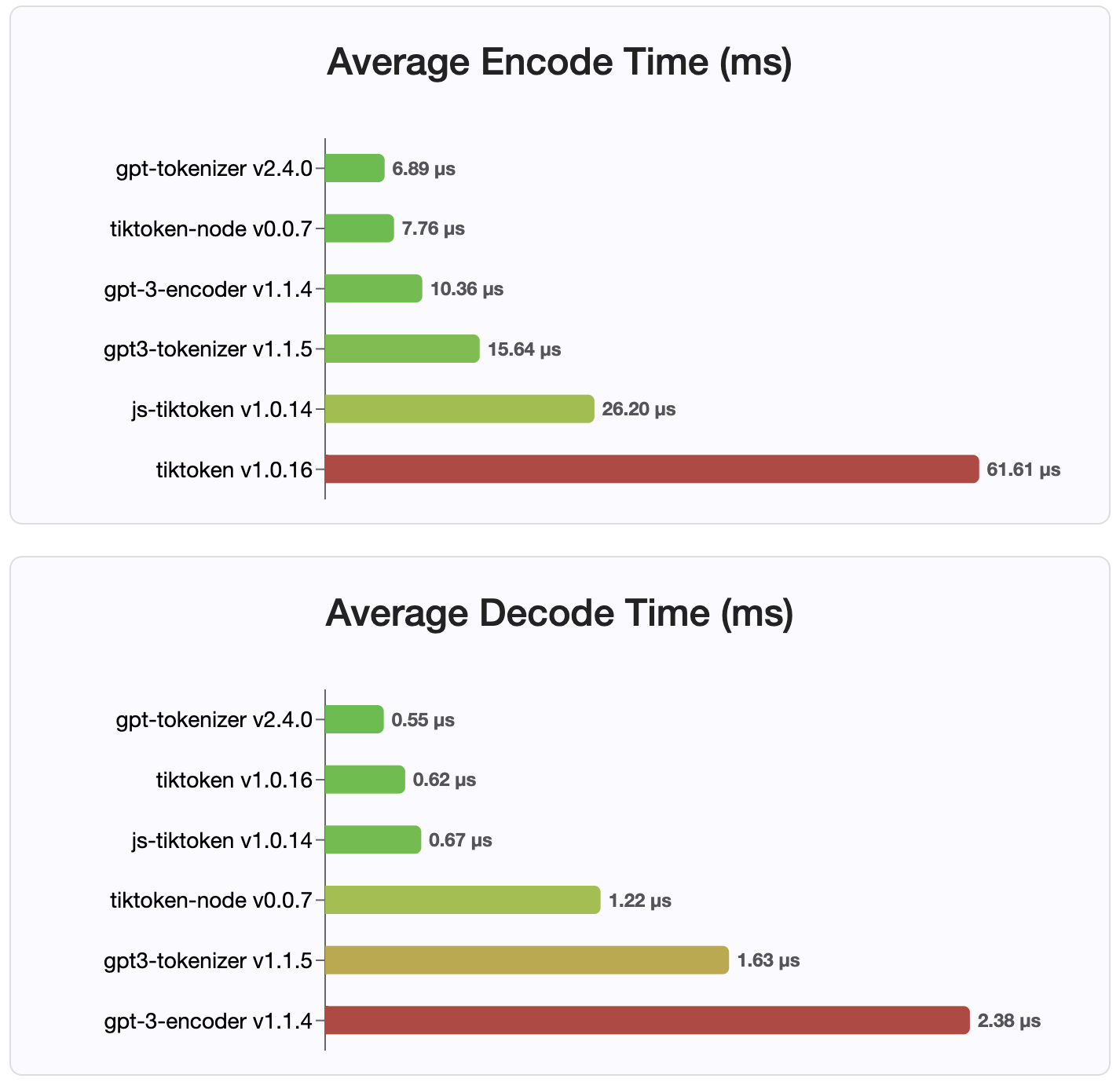

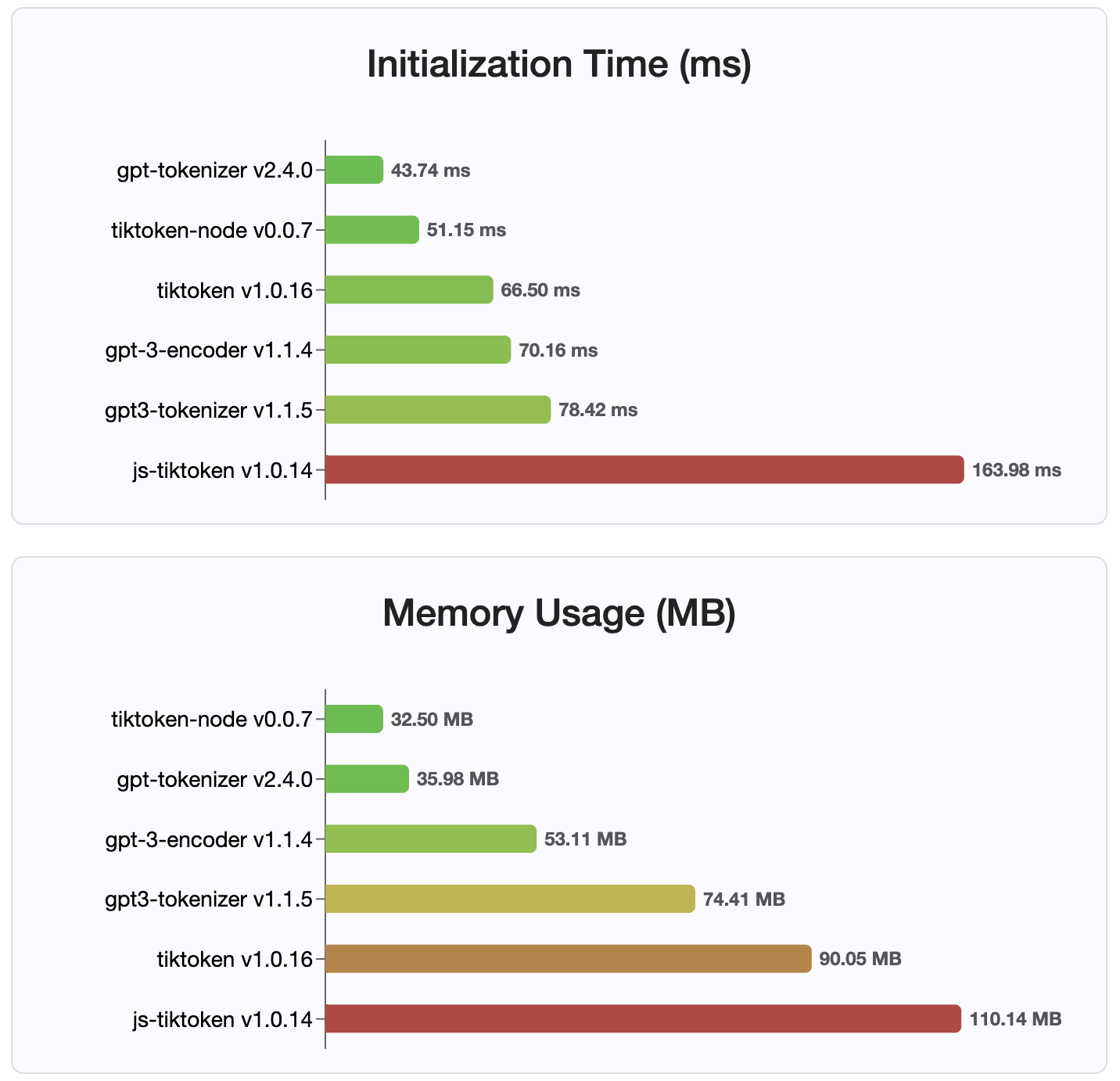

基准测试

自 2.4.0 版本以来,gpt-tokenizer 已成为 NPM 上最快的分词器实现,甚至比现有的 WASM/node 绑定实现还要快。它具有最快的编码和解码速度,同时内存占用极小,并且初始化速度也优于其他所有实现。

此外,由于采用紧凑的存储格式,其编码结果的文件尺寸也是最小的。

许可证

MIT

贡献

我们欢迎各种形式的贡献!请提交 Pull Request 或 Issue 来讨论你的问题报告,或者使用 Discussions 功能提出想法或其他疑问。

致谢

感谢 @dmitry-brazhenko 的 SharpToken,其代码为本次移植提供了参考。

希望你在项目中能充分利用 gpt-tokenizer!

版本历史

3.4.02025/11/073.3.02025/11/073.2.02025/10/093.1.02025/10/093.0.12025/06/133.0.02025/06/072.9.02025/03/052.8.12024/12/092.8.02024/12/092.7.02024/11/282.6.22024/11/132.6.12024/11/112.6.02024/11/042.5.12024/10/212.5.02024/10/092.4.12024/10/072.4.02024/09/232.3.02024/09/202.2.32024/09/162.2.22024/09/15常见问题

相似工具推荐

stable-diffusion-webui

stable-diffusion-webui 是一个基于 Gradio 构建的网页版操作界面,旨在让用户能够轻松地在本地运行和使用强大的 Stable Diffusion 图像生成模型。它解决了原始模型依赖命令行、操作门槛高且功能分散的痛点,将复杂的 AI 绘图流程整合进一个直观易用的图形化平台。 无论是希望快速上手的普通创作者、需要精细控制画面细节的设计师,还是想要深入探索模型潜力的开发者与研究人员,都能从中获益。其核心亮点在于极高的功能丰富度:不仅支持文生图、图生图、局部重绘(Inpainting)和外绘(Outpainting)等基础模式,还独创了注意力机制调整、提示词矩阵、负向提示词以及“高清修复”等高级功能。此外,它内置了 GFPGAN 和 CodeFormer 等人脸修复工具,支持多种神经网络放大算法,并允许用户通过插件系统无限扩展能力。即使是显存有限的设备,stable-diffusion-webui 也提供了相应的优化选项,让高质量的 AI 艺术创作变得触手可及。

everything-claude-code

everything-claude-code 是一套专为 AI 编程助手(如 Claude Code、Codex、Cursor 等)打造的高性能优化系统。它不仅仅是一组配置文件,而是一个经过长期实战打磨的完整框架,旨在解决 AI 代理在实际开发中面临的效率低下、记忆丢失、安全隐患及缺乏持续学习能力等核心痛点。 通过引入技能模块化、直觉增强、记忆持久化机制以及内置的安全扫描功能,everything-claude-code 能显著提升 AI 在复杂任务中的表现,帮助开发者构建更稳定、更智能的生产级 AI 代理。其独特的“研究优先”开发理念和针对 Token 消耗的优化策略,使得模型响应更快、成本更低,同时有效防御潜在的攻击向量。 这套工具特别适合软件开发者、AI 研究人员以及希望深度定制 AI 工作流的技术团队使用。无论您是在构建大型代码库,还是需要 AI 协助进行安全审计与自动化测试,everything-claude-code 都能提供强大的底层支持。作为一个曾荣获 Anthropic 黑客大奖的开源项目,它融合了多语言支持与丰富的实战钩子(hooks),让 AI 真正成长为懂上

ComfyUI

ComfyUI 是一款功能强大且高度模块化的视觉 AI 引擎,专为设计和执行复杂的 Stable Diffusion 图像生成流程而打造。它摒弃了传统的代码编写模式,采用直观的节点式流程图界面,让用户通过连接不同的功能模块即可构建个性化的生成管线。 这一设计巧妙解决了高级 AI 绘图工作流配置复杂、灵活性不足的痛点。用户无需具备编程背景,也能自由组合模型、调整参数并实时预览效果,轻松实现从基础文生图到多步骤高清修复等各类复杂任务。ComfyUI 拥有极佳的兼容性,不仅支持 Windows、macOS 和 Linux 全平台,还广泛适配 NVIDIA、AMD、Intel 及苹果 Silicon 等多种硬件架构,并率先支持 SDXL、Flux、SD3 等前沿模型。 无论是希望深入探索算法潜力的研究人员和开发者,还是追求极致创作自由度的设计师与资深 AI 绘画爱好者,ComfyUI 都能提供强大的支持。其独特的模块化架构允许社区不断扩展新功能,使其成为当前最灵活、生态最丰富的开源扩散模型工具之一,帮助用户将创意高效转化为现实。

Deep-Live-Cam

Deep-Live-Cam 是一款专注于实时换脸与视频生成的开源工具,用户仅需一张静态照片,即可通过“一键操作”实现摄像头画面的即时变脸或制作深度伪造视频。它有效解决了传统换脸技术流程繁琐、对硬件配置要求极高以及难以实时预览的痛点,让高质量的数字内容创作变得触手可及。 这款工具不仅适合开发者和技术研究人员探索算法边界,更因其极简的操作逻辑(仅需三步:选脸、选摄像头、启动),广泛适用于普通用户、内容创作者、设计师及直播主播。无论是为了动画角色定制、服装展示模特替换,还是制作趣味短视频和直播互动,Deep-Live-Cam 都能提供流畅的支持。 其核心技术亮点在于强大的实时处理能力,支持口型遮罩(Mouth Mask)以保留使用者原始的嘴部动作,确保表情自然精准;同时具备“人脸映射”功能,可同时对画面中的多个主体应用不同面孔。此外,项目内置了严格的内容安全过滤机制,自动拦截涉及裸露、暴力等不当素材,并倡导用户在获得授权及明确标注的前提下合规使用,体现了技术发展与伦理责任的平衡。

NextChat

NextChat 是一款轻量且极速的 AI 助手,旨在为用户提供流畅、跨平台的大模型交互体验。它完美解决了用户在多设备间切换时难以保持对话连续性,以及面对众多 AI 模型不知如何统一管理的痛点。无论是日常办公、学习辅助还是创意激发,NextChat 都能让用户随时随地通过网页、iOS、Android、Windows、MacOS 或 Linux 端无缝接入智能服务。 这款工具非常适合普通用户、学生、职场人士以及需要私有化部署的企业团队使用。对于开发者而言,它也提供了便捷的自托管方案,支持一键部署到 Vercel 或 Zeabur 等平台。 NextChat 的核心亮点在于其广泛的模型兼容性,原生支持 Claude、DeepSeek、GPT-4 及 Gemini Pro 等主流大模型,让用户在一个界面即可自由切换不同 AI 能力。此外,它还率先支持 MCP(Model Context Protocol)协议,增强了上下文处理能力。针对企业用户,NextChat 提供专业版解决方案,具备品牌定制、细粒度权限控制、内部知识库整合及安全审计等功能,满足公司对数据隐私和个性化管理的高标准要求。

ML-For-Beginners

ML-For-Beginners 是由微软推出的一套系统化机器学习入门课程,旨在帮助零基础用户轻松掌握经典机器学习知识。这套课程将学习路径规划为 12 周,包含 26 节精炼课程和 52 道配套测验,内容涵盖从基础概念到实际应用的完整流程,有效解决了初学者面对庞大知识体系时无从下手、缺乏结构化指导的痛点。 无论是希望转型的开发者、需要补充算法背景的研究人员,还是对人工智能充满好奇的普通爱好者,都能从中受益。课程不仅提供了清晰的理论讲解,还强调动手实践,让用户在循序渐进中建立扎实的技能基础。其独特的亮点在于强大的多语言支持,通过自动化机制提供了包括简体中文在内的 50 多种语言版本,极大地降低了全球不同背景用户的学习门槛。此外,项目采用开源协作模式,社区活跃且内容持续更新,确保学习者能获取前沿且准确的技术资讯。如果你正寻找一条清晰、友好且专业的机器学习入门之路,ML-For-Beginners 将是理想的起点。